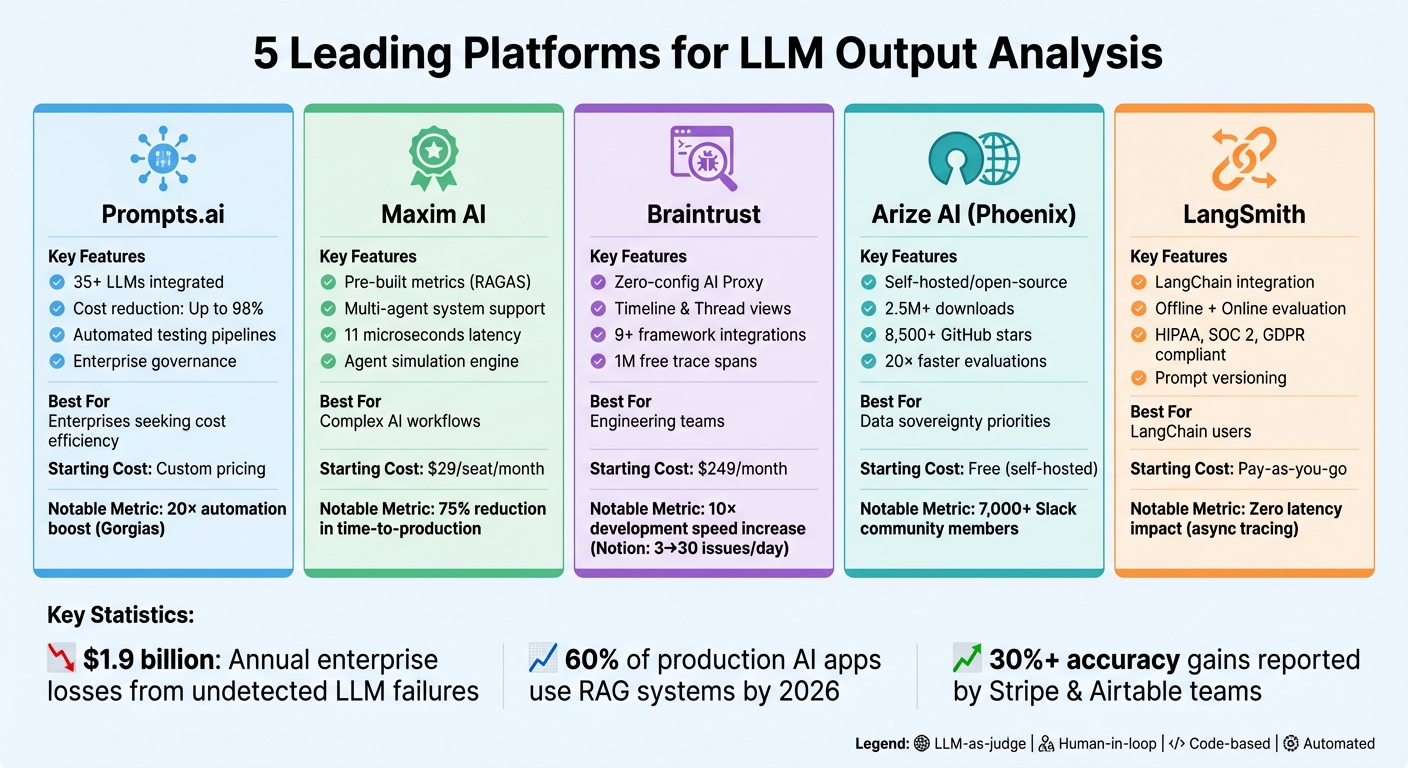

बड़े भाषा मॉडल (LLM) शक्तिशाली लेकिन अप्रत्याशित होते हैं, जो अक्सर असंगत या महंगे आउटपुट उत्पन्न करते हैं। इन चुनौतियों से निपटने के लिए, संगठन मूल्यांकन, निगरानी और लागत प्रबंधन के लिए विशेष उपकरणों पर भरोसा करते हैं। यह लेख बताता है पांच प्लेटफार्म जो एलएलएम आउटपुट विश्लेषण को कारगर बनाता है:

प्रत्येक प्लेटफ़ॉर्म एलएलएम वर्कफ़्लो के अनूठे पहलुओं को संबोधित करता है, जिसमें सटीकता में सुधार से लेकर लागत में कटौती और अनुपालन सुनिश्चित करना शामिल है।

ये प्लेटफ़ॉर्म एलएलएम प्रबंधन को सरल बनाते हैं, जिससे स्केलेबल, विश्वसनीय और लागत प्रभावी एआई संचालन सुनिश्चित होता है।

एलएलएम आउटपुट विश्लेषण प्लेटफ़ॉर्म तुलना: सुविधाएँ, मूल्य निर्धारण और सर्वोत्तम उपयोग के मामले

Prompts.ai एंटरप्राइज़-स्तरीय प्रॉम्प्ट इंजीनियरिंग और विस्तृत आउटपुट विश्लेषण के लिए डिज़ाइन किए गए एक एकीकृत प्लेटफ़ॉर्म में GPT‑5, क्लाउड, लामा और जेमिनी सहित 35+ शीर्ष स्तरीय LLM को एक साथ लाता है। यह स्वचालित परीक्षण पाइपलाइनों के साथ मूल्यांकन को सरल बनाता है।

Prompts.ai में प्रॉम्प्ट डेटासेट पर 20 से अधिक परीक्षण चलाने में सक्षम मूल्यांकन पाइपलाइन हैं। इनमें एलएलएम अभिकथन (ग्रेड आउटपुट के लिए AI का उपयोग करना), कोसाइन समानता के माध्यम से सिमेंटिक समानता जांच, सटीक मिलान मूल्यांकन और रेगेक्स-आधारित पैटर्न मिलान जैसी विधियाँ शामिल हैं। टीमें उपयोगकर्ता के अनुकूल डैशबोर्ड के माध्यम से मानव-इन-द-लूप मूल्यांकन भी शामिल कर सकती हैं, जिससे डोमेन विशेषज्ञ मानव फ़ीडबैक से सुदृढीकरण सीखने के हिस्से के रूप में मैन्युअल रूप से आउटपुट का आकलन कर सकते हैं।

उदाहरण के लिए, Gorgias, एक ग्राहक सहायता प्लेटफ़ॉर्म, ने लाखों दुकानदारों का समर्थन करने के लिए अपने AI-संचालित हेल्पडेस्क को स्केल करने के लिए Prompts.ai का उपयोग किया। इससे ऑटोमेशन में 20× का इजाफा हुआ। उनके एमएल इंजीनियर और सपोर्ट टीम तैनाती से पहले संभावित मुद्दों को पकड़ने के लिए बैकटेस्ट डेटासेट पर दैनिक रिग्रेशन टेस्ट चलाते हैं।

ये कठोर परीक्षण क्षमताएं मौजूदा वर्कफ़्लो में सहज एकीकरण सुनिश्चित करती हैं।

Prompts.ai की मूल्यांकन पाइपलाइन मूल रूप से CI/CD वर्कफ़्लो के साथ एकीकृत होती हैं और ऐतिहासिक उत्पादन डेटा के विरुद्ध बैकटेस्टिंग को सक्षम करती हैं। प्लेटफ़ॉर्म बाहरी HTTP एंडपॉइंट, कस्टम पायथन/जावास्क्रिप्ट स्क्रिप्ट और मॉडल कॉन्टेक्स्ट प्रोटोकॉल (MCP) क्रियाओं के माध्यम से कनेक्शन का समर्थन करता है।

स्पीक, एक भाषा सीखने वाला ऐप है, जिसने पाठ्यक्रम के विकास के महीनों को सिर्फ एक सप्ताह में समेटने के लिए इन स्वचालन सुविधाओं का लाभ उठाया है। इस दक्षता ने उन्हें एक ही समय में 10 नए बाजारों में AI- संचालित सुविधाओं को लॉन्च करने की अनुमति दी।

Prompts.ai साइड-बाय-साइड मॉडल तुलनात्मक दृश्य पेश करके टीमों को लागतों को अनुकूलित करने में भी मदद करता है। इन तुलनाओं से यूज़र API लागतों, लेटेंसी और क्वालिटी स्कोर के बीच ट्रेड-ऑफ़ का आकलन कर सकते हैं। टीमें आउटपुट को सारांशित कर सकती हैं या टोकन के उपयोग को कम करने के लिए मध्यवर्ती कार्यों के लिए छोटे, तेज़ मॉडल का उपयोग कर सकती हैं। NoreDink, जो अमेरिका के 60% स्कूल जिलों में सेवा प्रदान करता है, शिक्षक-स्तर की गुणवत्ता को बनाए रखते हुए, 1 मिलियन से अधिक छात्र ग्रेड पर AI-जनरेट फ़ीडबैक प्रदान करने के लिए इन लागत-बचत सुविधाओं का उपयोग करता है।

Prompts.ai LLM आउटपुट को परिष्कृत करने के लिए सभी हितधारकों को टूल से लैस करके सहयोग को बढ़ाता है। नो-कोड विज़ुअल एडिटर गैर-तकनीकी यूज़र को इंजीनियरों पर भरोसा किए बिना प्रॉम्प्ट संपादित करने और उनका परीक्षण करने देता है। केंद्रीकृत प्रॉम्प्ट रजिस्ट्री कुशल संस्करण प्रबंधन सुनिश्चित करती है।

उदाहरण के लिए, ParentLab ने गैर-तकनीकी डोमेन विशेषज्ञों को 700 त्वरित संशोधनों का प्रबंधन करने में सक्षम करके केवल छह महीनों में 400 से अधिक इंजीनियरिंग घंटे बचाए।

“Prompts.ai हमारे लिए गेम-चेंजर रहा है। इसने हमारी कंटेंट टीम को हमारे इंजीनियरों पर बोझ डाले बिना प्रॉम्प्ट पर तेजी से पुनरावृति करने, सही टोन खोजने और एज केस को संबोधित करने की अनुमति दी है। “- जॉन गिलमोर, पेरेंटलैब में ऑपरेशंस के वीपी

प्लेटफ़ॉर्म उपयोगकर्ता रेटिंग भी इकट्ठा करता है और उन्हें प्रदर्शन स्कोर में अनुवाद करता है, जिससे सभी एकीकृत मॉडलों में आउटपुट गुणवत्ता में सुधार करने के लिए एक निरंतर फीडबैक लूप बनता है।

मैक्सिम एआई गहन परीक्षण और निगरानी उपकरण प्रदान करता है, जटिल एआई वर्कफ़्लो का प्रबंधन करने वाली टीमों का समर्थन करने के लिए मानव प्रतिक्रिया के साथ मशीन-संचालित मूल्यांकन को सम्मिश्रण करता है। इसकी विशेषताओं को गहन मूल्यांकन सुनिश्चित करने के लिए डिज़ाइन किया गया है, जो मजबूत एलएलएम प्रदर्शन को बनाए रखने के लिए महत्वपूर्ण हैं।

मैक्सिम एआई एक मजबूत मूल्यांकन ढांचे का उपयोग करता है जिसमें नियतात्मक परीक्षण, सांख्यिकीय तरीके और स्वचालित निर्णय उपकरण शामिल हैं। द इवैलुएटर स्टोर RAGAS जैसे पूर्व-निर्मित मेट्रिक्स प्रदान करता है, जो पुनर्प्राप्ति-संवर्धित पीढ़ी प्रणालियों के लिए तैयार किया गया है - 2026 तक लगभग 60% उत्पादन AI अनुप्रयोगों में प्रमुख घटक। इसके अतिरिक्त, नोड-स्तरीय मेट्रिक्स पुनर्प्राप्ति और उत्पादन प्रक्रियाओं में विफलताओं की पहचान करने में मदद करें। प्लेटफ़ॉर्म का एजेंट सिमुलेशन इंजन पूर्व-परिनियोजन आकलन के लिए मल्टी-टर्न वार्तालाप परीक्षण और उपयोगकर्ता व्यक्तित्व निर्माण को सक्षम बनाता है। क्लिंक और माइंडटिकल जैसी कंपनियों ने इन गुणवत्ता मानकों को अपनाकर समय-दर-उत्पादन में 75% की कमी दर्ज की है।

मैक्सिम एआई के मूल्यांकन उपकरण आज के विकास के वातावरण के साथ आसानी से एकीकृत हो जाते हैं। यह पायथन, टाइपस्क्रिप्ट, जावा और गो में एसडीके का समर्थन करता है, जबकि लैंगचैन, लैंगग्राफ, क्रू एआई, ओपनएआई, एंथ्रोपिक, मिस्ट्रल और एडब्ल्यूएस बेडरॉक जैसे प्लेटफार्मों के साथ संगतता प्रदान करता है। प्लेटफ़ॉर्म इसका भी पालन करता है ओपन टेलीमेट्री वितरित अनुरेखण के लिए मानक और रीयल-टाइम अलर्ट के लिए स्लैक और पेजरड्यूटी जैसे टूल से जुड़ते हैं। एंटरप्राइज़ यूज़र परिनियोजन विकल्पों से लाभान्वित होते हैं जिनमें क्लाउड और इन-वीपीसी होस्टिंग, सभी SOC2, HIPAA और GDPR अनुपालन आवश्यकताओं को पूरा करना शामिल है।

द बिफ्रोस्ट एलएलएम गेटवे महंगे वर्कफ़्लो की पहचान करने और उन्हें संबोधित करने के लिए टोकन उपयोग और API लागतों की निगरानी करते समय खर्चों को कम करने के लिए सिमेंटिक कैशिंग का उपयोग करता है। यह उत्पादन के पैमाने के रूप में कुशल संचालन सुनिश्चित करता है।

मैक्सिम एआई नो-कोड UI उत्पाद प्रबंधकों और डिजाइनरों को संकेतों के साथ प्रयोग करने और स्वतंत्र रूप से मूल्यांकन करने का अधिकार देता है। राइज़ साइंस में प्रोडक्ट लीड केली मैलोनी ने साझा किया:

“एक बात जो हमें बहुत पसंद आई है, वह यह है कि मैक्सिम हमें प्रॉम्प्ट लिखने की प्रक्रिया को लोकतांत्रिक बनाने में कैसे मदद करता है। इसलिए यह हमारे उत्पाद, जो कि मेरी भूमिका है, दोनों को सशक्त बनाता है, साथ ही हमारी डिज़ाइन टीमों को भी वास्तव में इस प्रक्रिया का मालिक बनने का अधिकार देता है। इसलिए जिस गति से हम पुनरावृति करते हैं और आउटपुट की गुणवत्ता दोनों में वास्तव में तेजी आई है।”

प्लेटफ़ॉर्म में मानव-इन-द-लूप समीक्षाओं के लिए एनोटेशन कतारें, संस्करण नियंत्रण के साथ एक केंद्रीकृत प्रॉम्प्ट CMS और SAML/SSO समर्थन के साथ RBAC भी शामिल हैं। इन सहयोग उपकरणों का लाभ उठाने वाली टीमों ने शिपिंग वेग में पांच गुना वृद्धि हासिल की है, पुनरावृत्ति को सुव्यवस्थित किया है और उत्पादन रोलआउट को तेज किया है।

ब्रेनट्रस्ट ऑनलाइन स्कोरिंग के साथ ऑफ़लाइन प्रयोगों को जोड़ता है ताकि टीमों को विकास से लेकर तैनाती तक एलएलएम के प्रदर्शन का पूरा दृश्य मिल सके।

ब्रेनट्रस्ट 0 से 1 के पैमाने पर आउटपुट गुणवत्ता का मूल्यांकन करने के कई तरीके प्रदान करता है। टीमें तथ्यात्मकता और समानता जांच जैसे कार्यों के लिए स्वचालित स्कोरर का उपयोग कर सकती हैं, एलएलएम-ए-जज मूल्यांकन पर भरोसा कर सकती हैं, या अपनी विशिष्ट आवश्यकताओं के अनुरूप कस्टम कोड लॉजिक लागू कर सकती हैं। प्लेटफ़ॉर्म में शामिल हैं टाइमलाइन दृश्य बाधाओं की पहचान करने के लिए गैंट चार्ट के साथ, थ्रेड दृश्य मल्टी-टर्न वार्तालापों को डीबग करने के लिए, और प्राकृतिक भाषा-चालित ट्रेस विज़ुअलाइज़ेशन को सैंडबॉक्स किए गए रिएक्ट घटकों के रूप में प्रदर्शित किया जाता है। यह प्रत्येक इनपुट के लिए कई परीक्षण चलाने का भी समर्थन करता है, जिससे टीमों को भिन्नता मापने और निरंतरता बनाए रखने में मदद मिलती है।

ब्रेनट्रस्ट प्रमुख एआई फ्रेमवर्क के साथ आसानी से एकीकृत होता है, जो इसके लिए मूल समर्थन प्रदान करता है 9+ प्रमुख फ्रेमवर्क, जैसे कि OpenTelemetry, Vercel AI SDK, OpenAI Agent SDK, Instructor, LangChain, LangGraph, Google ADK, Mastra, और Pydantic AI। यह एकीकरण के लिए “रैप” दृष्टिकोण का उपयोग करता है - उदाहरणों में शामिल हैं WrapAISDK वर्सेल एआई एसडीके के लिए (v6 बीटा के माध्यम से संस्करण v3 को कवर करना) और रैप_ओपनआई प्रशिक्षक के लिए। प्लेटफ़ॉर्म इसका पालन करता है ओपन टेलीमेट्री जेनएआई सिमेंटिक कन्वेंशन, ब्रेनट्रस्ट फ़ील्ड में टोकन उपयोग और मॉडल पहचानकर्ताओं जैसे विवरणों को स्वचालित रूप से मैप करना। यह OpenAI, Anthropic, और Google Gemini सहित प्रमुख LLM प्रदाताओं के साथ निर्बाध रूप से काम करता है। डेवलपर इसका उपयोग भी कर सकते हैं इवल () फ़ंक्शन या सीएलआई के साथ --घड़ी जब भी फ़ाइलें विकास के दौरान अपडेट की जाती हैं, तो मूल्यांकन को स्वचालित रूप से फिर से चलाने के लिए फ़्लैग करें।

अंतर्निहित टूल के साथ टीम सहयोग को बढ़ावा देकर ब्रेनट्रस्ट मूल्यांकन से परे चला जाता है। यह है द्विदिश तुल्यकालन यह सुनिश्चित करता है कि उत्पाद प्रबंधक और इंजीनियर कोड और UI के बीच परस्पर संकेतों पर काम कर सकते हैं। द खेल का मैदान एक नो-कोड स्पेस प्रदान करता है जहां टीमें प्रॉम्प्ट का परीक्षण कर सकती हैं, मॉडल की साथ-साथ तुलना कर सकती हैं और त्वरित पुनरावृत्तियों के लिए कॉन्फ़िगरेशन साझा कर सकती हैं। डेडिकेटेड एनोटेशन टूल से टीमें मानव-इन-द-लूप फ़ीडबैक प्रदान कर सकती हैं, निशान और मॉडल आउटपुट में सीधे लेबल या सुधार जोड़ सकती हैं। विभिन्न मॉडल संस्करणों में गुणवत्ता का आकलन करने के लिए बाहरी एनोटेटर्स को आमंत्रित किया जा सकता है, जबकि साझा मूल्यांकन बैकलॉग डेटासेट और स्कोरिंग रूब्रिक को केंद्रीकृत करते हैं, जिससे मैन्युअल स्प्रेडशीट ट्रैकिंग की आवश्यकता समाप्त हो जाती है।

Arize AI का Phoenix एक ओपन-सोर्स प्लेटफ़ॉर्म है जिसे टीमों को बड़े भाषा मॉडल (LLM) के मूल्यांकन पर व्यापक नियंत्रण देने के लिए डिज़ाइन किया गया है। इसके मूल में OpenTelemetry के साथ निर्मित, फीनिक्स ने 2.5 मिलियन से अधिक डाउनलोड और 8,500+ GitHub सितारों के साथ ध्यान आकर्षित किया है। यह एलएलएम वर्कफ़्लो के हर चरण को ट्रैक करने के लिए विस्तृत ट्रेसिंग प्रदान करता है, जिससे यह पहचानना आसान हो जाता है कि समस्याएँ कहाँ उत्पन्न होती हैं।

फीनिक्स को रोजगार देता है एलएलएम-ए-ए-जज प्रासंगिकता, विषाक्तता और समग्र प्रदर्शन जैसे कारकों के लिए अन्य एलएलएम अनुप्रयोगों का आकलन करने के लिए ओपनएआई, एंथ्रोपिक और जेमिनी के फाउंडेशन मॉडल का उपयोग करना। यह रिट्रीवल-ऑगमेंटेड जेनरेशन (RAG) और फंक्शन कॉलिंग जैसे सामान्य कार्यों के लिए पूर्व-निर्मित मूल्यांकनकर्ताओं के साथ आता है। इसकी एक ख़ास विशेषता यह है स्पष्टीकरण क्षमता, जहां मूल्यांकन मॉडल अपने स्कोर के पीछे स्पष्ट तर्क प्रदान करते हैं, जिससे डेवलपर्स को प्रत्येक मूल्यांकन के पीछे के तर्क को समझने में मदद मिलती है। अतिरिक्त टूल में नियतात्मक कोड-आधारित जांच, इंटरफ़ेस के भीतर सीधे मानव एनोटेशन, और शामिल हैं डेटासेट क्लस्टरिंग जो शब्दार्थ रूप से समान प्रश्नों और प्रतिक्रियाओं को दृष्टिगत रूप से समूहबद्ध करने के लिए एम्बेडिंग का उपयोग करता है। यह क्लस्टरिंग उन क्षेत्रों को अलग करने में मदद करती है जहां मॉडल खराब प्रदर्शन करते हैं।

“फीनिक्स जटिल एलएलएम निर्णय लेने की कल्पना करके और जब और जहां मॉडल विफल होते हैं, गलत हो जाते हैं, खराब प्रतिक्रिया देते हैं या गलत तरीके से सामान्यीकरण करते हैं, उन्हें फ़्लैग करके [मतिभ्रम] को लक्षित करता है।” - शुभम शर्मा, वेंचरबीट

ये मूल्यांकन उपकरण प्लेटफ़ॉर्म के व्यापक विकास पारिस्थितिकी तंत्र के साथ मूल रूप से एकीकृत होते हैं।

फीनिक्स LLaMaindex, LangChain, DSpy, Mastra, और Vercel AI SDK जैसे लोकप्रिय फ्रेमवर्क के लिए ऑटो-इंस्ट्रूमेंटेशन का समर्थन करता है। यह पायथन, टाइपस्क्रिप्ट और जावा के साथ काम करता है, और इसका ओपनटेलीमेट्री-नेटिव डिज़ाइन यूज़र को विशिष्ट विक्रेताओं में लॉक किए बिना मौजूदा ऑब्जर्वेबिलिटी टूल के साथ संगतता सुनिश्चित करता है। टीमें तीसरे पक्ष के पुस्तकालयों जैसे कि रागास, डीपवल, या क्लीनलैब से मूल्यांकन भी शामिल कर सकती हैं, जो उनके वर्कफ़्लो में लचीलापन प्रदान करती हैं।

फीनिक्स को दक्षता, डिलीवरी के लिए बनाया गया है 20 गुना तक तेज मूल्यांकन चलता है संगामिति और बैचिंग के माध्यम से इसका प्रॉम्प्ट प्लेग्राउंड एक परीक्षण वातावरण प्रदान करता है जहां टीमें प्रॉम्प्ट को परिष्कृत कर सकती हैं और तैनाती से पहले मॉडल वेरिएंट की तुलना साथ-साथ कर सकती हैं, जिससे महंगी उत्पादन गलतियों का जोखिम कम हो जाता है।

पूरी तरह से ओपन-सोर्स और सेल्फ-होस्टेबल प्लेटफॉर्म के रूप में, फीनिक्स सुनिश्चित करता है कि टीमें अपने डेटा पर पूरा नियंत्रण बनाए रखें। जैसी सुविधाएँ मानव एनोटेशन कतारें ग्राउंड ट्रुथ लेबल को सीधे ट्रेस में जोड़ने की अनुमति दें, जिससे बेहतर सहयोग को बढ़ावा मिले। द प्रॉम्प्ट हब सभी वातावरणों में त्वरित संस्करण, संग्रहण और परिनियोजन का प्रबंधन करता है, जबकि स्पैन चैट टूल टीमों को प्रदर्शन समस्याओं को उजागर करने के लिए विशिष्ट वर्कफ़्लो सेगमेंट का मूल्यांकन और चर्चा करने में सक्षम बनाता है। 7,000 से अधिक सदस्यों के स्लैक समुदाय के साथ, उपयोगकर्ताओं के पास समस्या निवारण और जानकारी साझा करने के लिए एक नेटवर्क तक पहुंच है।

“फीनिक्स ने हमारी टीम के मौजूदा डेटा साइंस वर्कफ़्लो में एकीकृत किया और अनपेक्षित उपयोगकर्ता इनपुट, समस्याग्रस्त एलएलएम प्रतिक्रियाओं और हमारे ज्ञान के आधार में अंतराल के मूल कारणों की पहचान करने के लिए असंरचित टेक्स्ट डेटा की खोज को सक्षम किया।” - युकी वाका, एप्लिकेशन डेवलपर, क्लिक

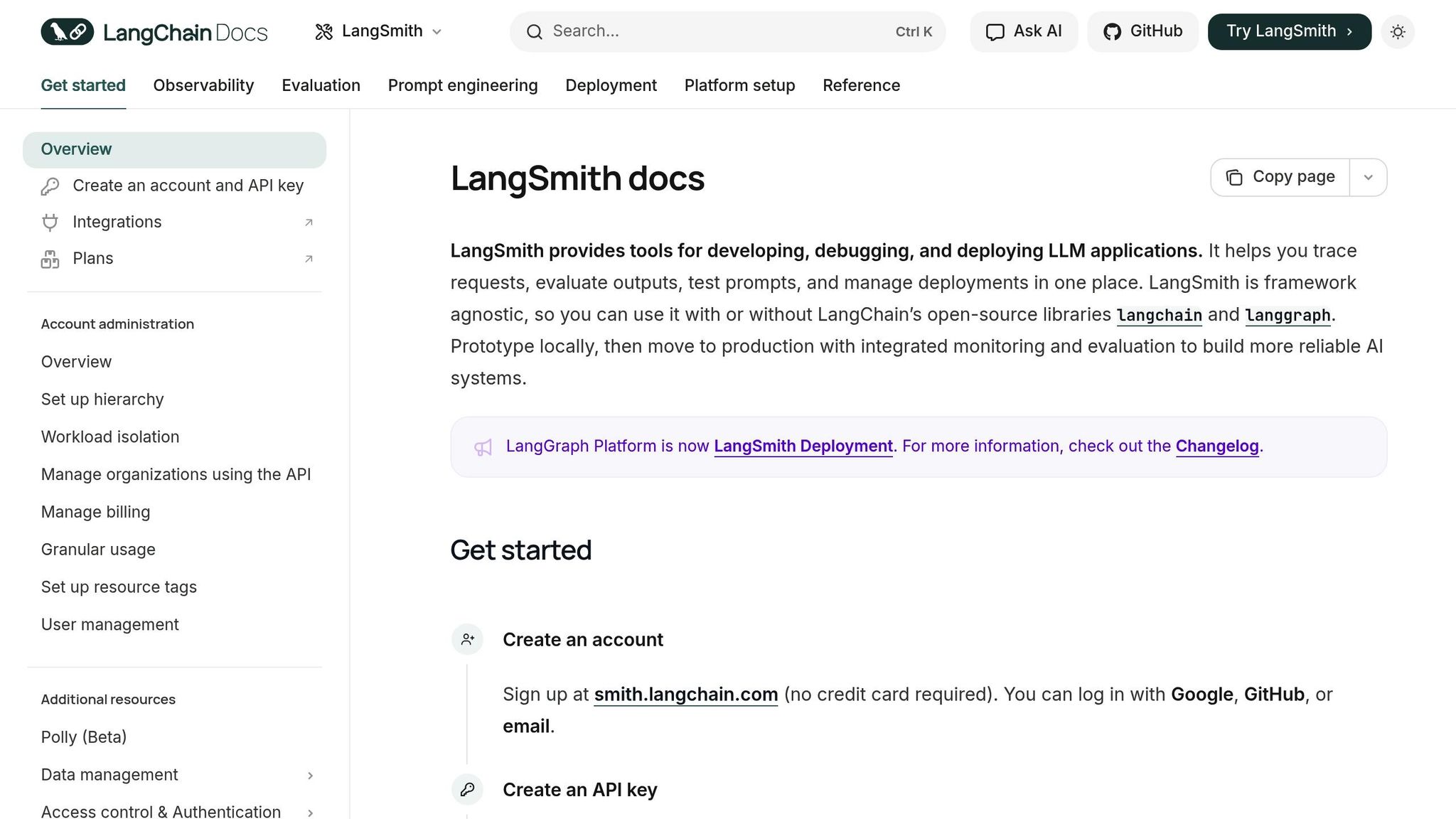

LangSmith एक बहुमुखी प्लेटफ़ॉर्म है जिसे LangChain के साथ या उसके बिना निर्बाध रूप से काम करने के लिए डिज़ाइन किया गया है, जो इसे किसी भी LLM स्टैक के अनुकूल बनाता है। यह OpenAI, Anthropic, CreWai, Vercel AI SDK, और Pydantic AI जैसे टूल के साथ आसानी से जुड़ जाता है, जो पहले से ही विशिष्ट फ्रेमवर्क का उपयोग करने वाली टीमों के लिए लचीलापन प्रदान करता है। प्लेटफ़ॉर्म HIPAA, SOC 2 टाइप 2 और GDPR जैसे अनुपालन मानकों को पूरा करता है, और निशान भेजने के लिए एक अतुल्यकालिक प्रक्रिया का उपयोग करता है, जिससे अंतिम उपयोगकर्ताओं के लिए कोई अतिरिक्त विलंबता सुनिश्चित नहीं होती है।

लैंगस्मिथ ऑफर दो मूल्यांकन मोड विभिन्न आवश्यकताओं के अनुरूप: विकास के दौरान क्यूरेट किए गए डेटासेट के परीक्षण के लिए ऑफ़लाइन मूल्यांकन और लाइव प्रोडक्शन ट्रैफ़िक की निगरानी के लिए ऑनलाइन मूल्यांकन। यह चार प्रकार के मूल्यांकनकर्ताओं का समर्थन करता है:

प्लेटफ़ॉर्म में उन्नत विश्लेषण उपकरण शामिल हैं जैसे डिफ व्यू, जो मॉडल आउटपुट और संदर्भ ग्रंथों के बीच अंतर को उजागर करता है, और प्रदर्शन बेंचमार्किंग के लिए अगल-बगल तुलना करता है। यह भी प्रदान करता है मेटाडेटा ग्रुपिंग, विषय क्षेत्र या उपयोगकर्ता प्रकार जैसी श्रेणियों के आधार पर सटीकता या लागत जैसे मैट्रिक्स के विश्लेषण को सक्षम करना। लैंगस्मिथ ओपन-सोर्स के साथ एकीकृत होता है ओपनवैल्स पैकेज, शुद्धता और संक्षिप्तता का आकलन करने के लिए पूर्व-निर्मित मूल्यांकनकर्ताओं की पेशकश करता है।

इन सुविधाओं से लैंगस्मिथ को मौजूदा वर्कफ़्लो और डेवलपमेंट टूल में एकीकृत करना आसान हो जाता है।

लैंगस्मिथ के साथ ट्रेसिंग को सरल बनाता है @traceable डेकोरेटर या क्लाइंट रैपर जो स्वचालित रूप से इनपुट और आउटपुट कैप्चर करते हैं। यह पायथन और टाइपस्क्रिप्ट/जावास्क्रिप्ट एसडीके, एक आरईएसटी एपीआई के साथ एकीकरण का समर्थन करता है, और पाइटेस्ट, विटेस्ट और जेस्ट जैसे परीक्षण ढांचे का परीक्षण करता है, जिससे मूल्यांकन को सीआई/सीडी पाइपलाइनों में एम्बेड करना आसान हो जाता है। इसके अतिरिक्त, OpenTelemetry इंटीग्रेशन टीमों को मौजूदा ऑब्जर्वेबिलिटी पाइपलाइनों से सीधे लैंगस्मिथ को निशान भेजने की अनुमति देता है।

LangSmith सहज फ़ीडबैक और एनोटेशन टूल के साथ टीम के सहयोग को बढ़ाता है। एनोटेशन कतारें कस्टम मानदंडों के आधार पर मैन्युअल समीक्षा और स्कोरिंग के लिए विषय-वस्तु विशेषज्ञों के लिए विशिष्ट रनों की स्वचालित रूटिंग सक्षम करें। द प्रॉम्प्ट हब टीमों के लिए एक केंद्रीकृत स्थान के रूप में कार्य करता है, ताकि वे विकास के दौरान निरंतरता बनाए रखने के लिए परिवर्तन ट्रैकिंग और रोलबैक सुविधाओं के साथ संकेतों को फिर से शुरू कर सकें, संस्करण बना सकें और संकेतों को साझा कर सकें। इनलाइन एनोटेशन क्षमताओं से टीम के सदस्य समस्याओं को फ़्लैग कर सकते हैं या प्रतिक्रिया गुणवत्ता पर लक्षित फ़ीडबैक प्रदान कर सकते हैं, जिससे मूल्यांकन सटीकता और वर्कफ़्लो दक्षता दोनों में सुधार होता है।

प्लेटफ़ॉर्म विस्तृत उपयोगकर्ता प्रबंधन और वर्कलोड आइसोलेशन भी प्रदान करता है, जिससे टीमों के बीच सहज सहयोग सुनिश्चित होता है। उपयोगकर्ता smith.langchain.com पर मुफ्त में साइन अप कर सकते हैं - किसी क्रेडिट कार्ड की आवश्यकता नहीं है। उत्पादन के उपयोग के लिए, LangSmith पे-एज़-यू-गो आधार पर काम करता है, जिसमें AWS, GCP, या Azure में Kubernetes क्लस्टर पर सेल्फ-होस्टिंग के लिए एंटरप्राइज़ प्लान उपलब्ध हैं।

एलएलएम मूल्यांकन के लिए प्लेटफार्मों का मूल्यांकन करते समय, तकनीकी अनुकूलता, लागत और मूल्यांकन विधियों पर विचार करना आवश्यक है। यहां विकल्पों पर करीब से नज़र डाली गई है:

Prompts.ai एक सुरक्षित इंटरफ़ेस के तहत 35+ अग्रणी मॉडल को एक साथ लाता है, जो FinOps नियंत्रण प्रदान करता है जो AI सॉफ़्टवेयर लागत को 98% तक कम कर सकता है। ब्रेनट्रस्ट शून्य-कॉन्फ़िगरेशन AI प्रॉक्सी के साथ सेटअप को सरल बनाता है, एक बेस URL के माध्यम से लॉग कैप्चर करता है। इसमें 1 मिलियन ट्रेस स्पैन निःशुल्क शामिल हैं, जिसमें भुगतान किए गए प्लान $249/माह से शुरू होते हैं। मैक्सिम एआई मौजूदा ऑब्जर्वेबिलिटी स्टैक के साथ मूल रूप से एकीकृत होता है, जो पूर्ण अनुरेखण पर गुणवत्ता स्कोरिंग पर ध्यान केंद्रित करता है। यह प्रति माह 10,000 लॉग तक की निःशुल्क योजना प्रदान करता है और भुगतान योजना $29 प्रति सीट/माह से शुरू होती है। अराइज़ फ़ीनिक्स डेटा गोपनीयता के लिए सेल्फ-होस्टिंग का समर्थन करता है, गहन मीट्रिक विश्लेषण के लिए RAGAS और Giskard जैसे टूल के साथ एकीकरण करता है। लैंग स्मिथ लैंगचैन उपयोगकर्ताओं के लिए तैयार किया गया है, जो उन्नत अवलोकन प्रदान करता है, हालांकि एंटरप्राइज़ समर्थन मूल्य भिन्न होता है। विशेष रूप से, नोशन ने ब्रेनट्रस्ट के साथ अपने विकास के वेग में दस गुना सुधार किया, जो रोज़ाना 3 मुद्दों को हल करने से बढ़कर 30 हो गया।

प्रत्येक प्लेटफ़ॉर्म का अद्वितीय दृष्टिकोण आपकी विशिष्ट मूल्यांकन आवश्यकताओं के आधार पर निर्णय लेने को सरल बनाता है। यहां बताया गया है कि मूल्यांकन के तरीकों, एकीकरण और परिनियोजन के संदर्भ में उनकी तुलना कैसे की जाती है:

एकीकरण की जटिलता भी एक महत्वपूर्ण भूमिका निभाती है। ब्रेनट्रस्ट का प्रॉक्सी-आधारित सेटअप सरल है - बस अपने API बेस URL को अपडेट करें। मैक्सिम एआई मौजूदा ऑब्जर्वेबिलिटी टूल के साथ एकीकृत होता है, जबकि लैंगस्मिथ का चुस्त लैंगचैन इंटीग्रेशन विशिष्ट अवलोकन संबंधी जरूरतों को पूरा करता है। Arize Phoenix डेटा संप्रभुता को प्राथमिकता देने वाले संगठनों के लिए सबसे अलग है, जो स्व-होस्टेड, ओपन-सोर्स समाधान पेश करते हैं। इस बीच, Prompts.ai एंटरप्राइज़-ग्रेड गवर्नेंस नियंत्रण और सुरक्षित संचालन के लिए पूर्ण ऑडिट ट्रेल्स प्रदान करता है।

“ब्रेनट्रस्ट निगरानी, मूल्यांकन और प्रयोग को मिलाकर संदर्भ स्विचिंग को समाप्त करता है। एक प्लेटफ़ॉर्म का अर्थ है उपकरण को एकीकृत करने में कम समय लगता है।” - ब्रेनट्रस्ट टीम

तीव्र अंतर्दृष्टि के लिए, प्रॉक्सी-आधारित परिनियोजन और गहन एकीकरण प्रक्रिया को सुव्यवस्थित करते हैं। LangChain यूज़र LangSmith को स्वाभाविक रूप से फिट पाएंगे, जबकि संवेदनशील डेटा का प्रबंधन करने वाले संगठन मजबूत शासन और ऑडिटिंग क्षमताओं के लिए Arize Phoenix या Prompts.ai जैसे ओपन-सोर्स समाधानों की ओर झुक सकते हैं।

प्रदान किए गए मूल्यांकन के आधार पर, प्रत्येक प्लेटफ़ॉर्म एलएलएम आउटपुट विश्लेषण को परिष्कृत करने के लिए अलग-अलग लाभ प्रदान करता है। Prompts.ai उद्यमों को अग्रणी मॉडलों तक केंद्रीकृत पहुंच प्रदान करता है, जिन्हें FinOps नियंत्रणों के साथ जोड़ा जाता है, जो मजबूत शासन और ऑडिट क्षमताओं को सुनिश्चित करते हुए AI लागत को 98% तक कम कर सकते हैं। ब्रेनट्रस्ट तेज-तर्रार इंजीनियरिंग टीमों के लिए तैयार किया गया है, जिसमें नोशन जैसी कंपनियां विकास की गति में 10 गुना वृद्धि की रिपोर्ट करती हैं - समस्या समाधान को प्रति दिन 3 से 30 तक बढ़ा रही हैं। इसी तरह, स्ट्राइप और एयरटेबल की टीमों ने प्लेटफॉर्म को अपनाने के कुछ हफ्तों के भीतर 30% से अधिक सटीकता हासिल की।

लैंगचैन इकोसिस्टम में गहराई से एकीकृत लोगों के लिए, लैंग स्मिथ सहज एकीकरण और तेज़ प्रोटोटाइप विकल्प प्रदान करता है। मैक्सिम एआई जटिल मल्टी-एजेंट सिस्टम के प्रबंधन पर ध्यान केंद्रित करने वाली टीमों को पूरा करता है, सटीक स्कोरिंग टूल और एक कम-विलंबता गेटवे प्रदान करता है, जो प्रति सेकंड 5,000 अनुरोधों की मात्रा में सिर्फ 11 माइक्रोसेकंड ओवरहेड पेश करता है। इस बीच, अराइज़ फ़ीनिक्स डेटा संप्रभुता को प्राथमिकता देने वाले संगठनों के लिए आदर्श है, जो एक स्व-होस्टेड, ओपन-सोर्स समाधान प्रदान करता है जो मौजूदा अवलोकन प्रणालियों में मूल रूप से फिट बैठता है।

प्रत्येक प्लेटफ़ॉर्म एलएलएम प्रदर्शन और लागत प्रबंधन में महत्वपूर्ण चुनौतियों का समाधान करता है। उद्यमों को संभावित नुकसान का सामना करना पड़ रहा है सालाना 1.9 बिलियन डॉलर उत्पादन में अनिर्धारित एलएलएम विफलताओं के कारण, विश्वसनीयता और दक्षता सुनिश्चित करने के लिए व्यक्तिपरक मूल्यांकन से आगे बढ़ने की आवश्यकता मापने योग्य, डेटा-संचालित मेट्रिक्स की ओर बढ़ने की आवश्यकता आवश्यक हो गई है।

ये उपकरण एलएलएम के विकास को एक संरचित इंजीनियरिंग अनुशासन में आगे बढ़ाते हैं। चाहे आपका ध्यान मासिक रूप से खरबों इवेंट्स को संभालने पर हो, टीमों के बीच सहयोग को सुव्यवस्थित करने, या सेल्फ-होस्टेड इन्फ्रास्ट्रक्चर पर नियंत्रण बनाए रखने पर हो, सही प्लेटफ़ॉर्म चुनने से यह सुनिश्चित होता है कि आपके एलएलएम वर्कफ़्लो आपके लक्ष्यों को पूरा करने के लिए आवश्यक विश्वसनीयता, गुणवत्ता और लागत-प्रभावशीलता प्राप्त करें।

इन प्लेटफार्मों को बड़े भाषा मॉडल (एलएलएम) के उपयोग की निगरानी करने और उसे ठीक करने के लिए उपकरण प्रदान करके संगठनों को एआई के खर्चों में कटौती करने में मदद करने के लिए डिज़ाइन किया गया है। उदाहरण के लिए, Prompts.ai जैसे समाधान यूज़र को वास्तविक समय में टोकन उपयोग को ट्रैक करने की अनुमति देते हैं, जिससे अनावश्यक टोकन खपत को पहचानना और कम करना आसान हो जाता है। इससे अत्यधिक API कॉल पर अधिक खर्च करने से बचने में मदद मिलती है, जिससे लागत प्रबंधन बेहतर होता है।

लागत नियंत्रण से परे, ये प्लेटफ़ॉर्म प्रदर्शन और आउटपुट गुणवत्ता में मूल्यवान अंतर्दृष्टि भी प्रदान करते हैं। वे मतिभ्रम या त्रुटियों जैसे मुद्दों का पता लगाने और उन्हें रोकने में मदद कर सकते हैं, जो अन्यथा महंगे काम का कारण बन सकते हैं। उपयोग के रुझानों का विश्लेषण करके और अक्षमताओं का पता लगाकर, संगठन वर्कफ़्लो को सरल बना सकते हैं, परिचालन लागत को कम कर सकते हैं और लगातार, उच्च-गुणवत्ता वाले परिणाम सुनिश्चित कर सकते हैं। यह सब AI बजट को प्रभावी ढंग से प्रबंधित करने के लिए बेहतर, डेटा-संचालित निर्णयों का समर्थन करता है।

एलएलएम प्लेटफ़ॉर्म विभिन्न ज़रूरतों को पूरा करने के लिए टूल और वर्कफ़्लो के साथ सहजता से जुड़ने के विभिन्न तरीके प्रदान करते हैं। कई प्लेटफ़ॉर्म SDK जैसे कि Python और JavaScript के माध्यम से मूल एकीकरण का समर्थन करते हैं, साथ ही LangChain और LangServe जैसे फ्रेमवर्क भी हैं। यह एलएलएम को कस्टम अनुप्रयोगों में एम्बेड करना सरल और कुशल बनाता है। निगरानी के लिए, प्लेटफ़ॉर्म अक्सर OpenTelemetry जैसे खुले मानकों का समर्थन करते हैं, जो मौजूदा अवसंरचना के साथ संगतता सुनिश्चित करते हैं।

कुछ प्लेटफ़ॉर्म CI/CD टूल जैसे GitHub Actions और Jenkins के साथ भी एकीकृत होते हैं, जो परीक्षण और परिनियोजन प्रक्रियाओं को सरल बनाते हैं। ऐसे संगठन जो अपने पर्यावरण पर नियंत्रण को प्राथमिकता देते हैं, उनके लिए सेल्फ-होस्टिंग विकल्प उपलब्ध हैं, जो डेटा सुरक्षा बनाए रखते हुए कस्टमाइज़ेशन की अनुमति देते हैं। ये एकीकरण सुविधाएं यूज़र को दक्षता बढ़ाने, प्रदर्शन को प्रभावी ढंग से मॉनिटर करने और एलएलएम को अपने संचालन के भीतर सुरक्षित रूप से लागू करने में सक्षम बनाती हैं।

उन लोगों के लिए जो प्रीमियम लगाते हैं डेटा गोपनीयता और नियंत्रण, ऑनप्रेम.एलएलएम एक उत्कृष्ट समाधान प्रदान करता है। विशेष रूप से गोपनीयता-संवेदनशील कार्यों के लिए डिज़ाइन किया गया, यह प्लेटफ़ॉर्म बड़े भाषा मॉडल (LLM) को गोपनीय या प्रतिबंधित डेटा को ऑफ़लाइन सेटिंग्स में सुरक्षित रूप से संभालने की अनुमति देता है। पूरी तरह से स्थानीय निष्पादन को सक्षम करके, यह डेटा एक्सपोज़र की संभावना को काफी कम कर देता है, साथ ही आवश्यक होने पर हाइब्रिड सेटअप के लिए वैकल्पिक क्लाउड इंटीग्रेशन भी प्रदान करता है।

अपने सहज, नो-कोड इंटरफ़ेस के साथ, OnPrem.LLM डेटा प्रबंधन की पूरी निगरानी बनाए रखते हुए, तकनीकी विशेषज्ञता के बिना उपयोगकर्ताओं के लिए एक्सेसिबिलिटी सुनिश्चित करता है। यह इसे विनियमित या संवेदनशील उद्योगों के संगठनों के लिए एक आदर्श विकल्प बनाता है जहाँ जानकारी की सुरक्षा करना सर्वोच्च प्राथमिकता है।