L'orchestration des flux de travail par IA transforme le mode de fonctionnement des entreprises en connectant les modèles, les données et les outils pour prendre des décisions plus intelligentes en temps réel. Alors que la plupart des projets pilotes d'IA d'entreprise échouent en raison d'une mauvaise coordination, les entreprises utilisant des plateformes d'orchestration rapportent jusqu'à Retour sur investissement supérieur de 60 %. Des plateformes comme Prompts.ai, Kubiya AI, et IBM Watsonx Orchestrate rationalisez les flux de travail, automatisez les tâches et garantissez la conformité, aidant ainsi les entreprises à évoluer efficacement.

Chaque plateforme excelle dans des domaines tels que interopérabilité, automatisation, et flexibilité de déploiement, ce qui les rend idéales pour différents cas d'utilisation. Qu'il s'agisse de centraliser les outils d'IA, de faire évoluer l'automatisation ou de garantir la conformité, ces solutions peuvent aider les entreprises à gagner du temps et à réduire leurs coûts.

Commencez par identifier vos principaux défis en matière de flux de travail et associez-les à la plateforme qui correspond à vos objectifs. Qu'il s'agisse de simplifier la gestion des modèles d'IA ou de faire évoluer l'automatisation des tâches, ces outils peuvent générer des résultats mesurables.

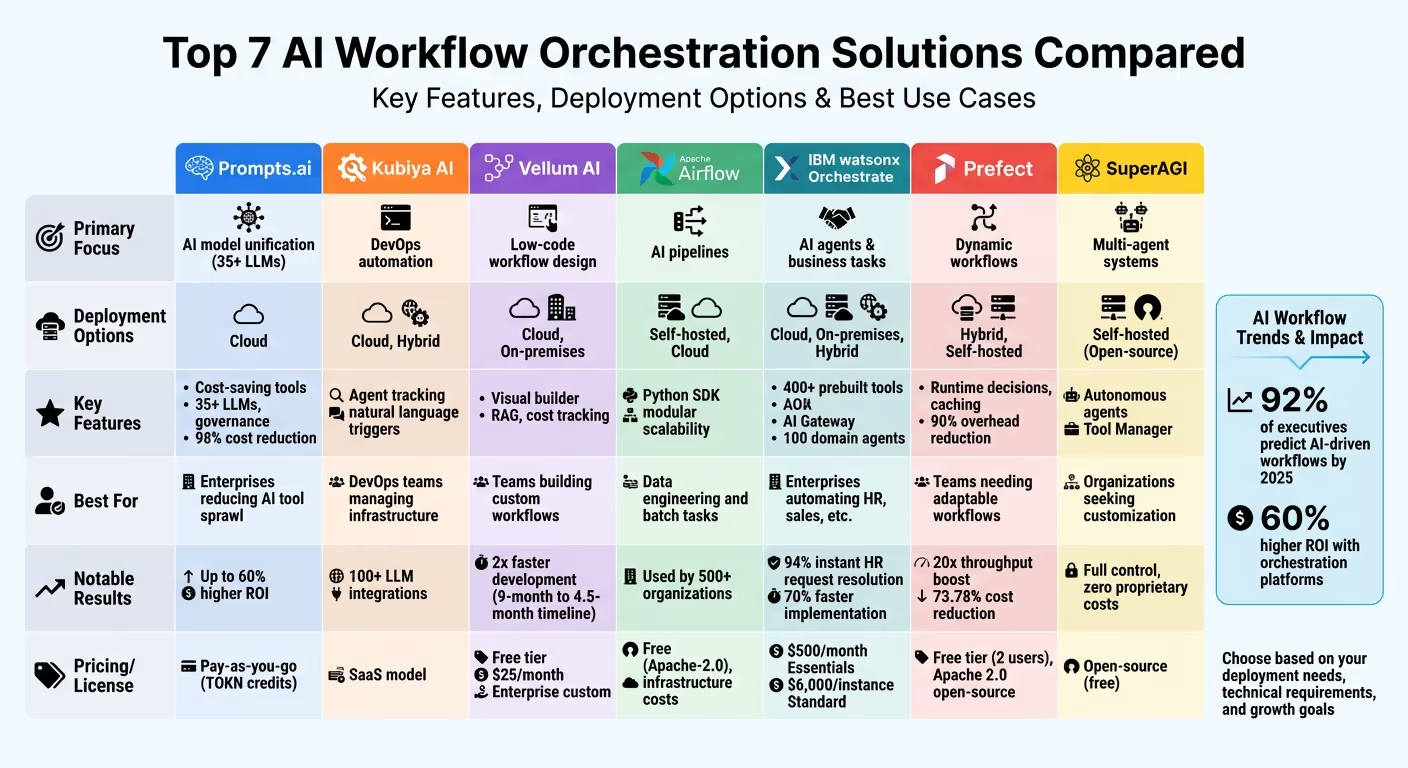

Comparaison des plateformes d'orchestration des flux de travail IA : fonctionnalités, déploiement et meilleurs cas d'utilisation

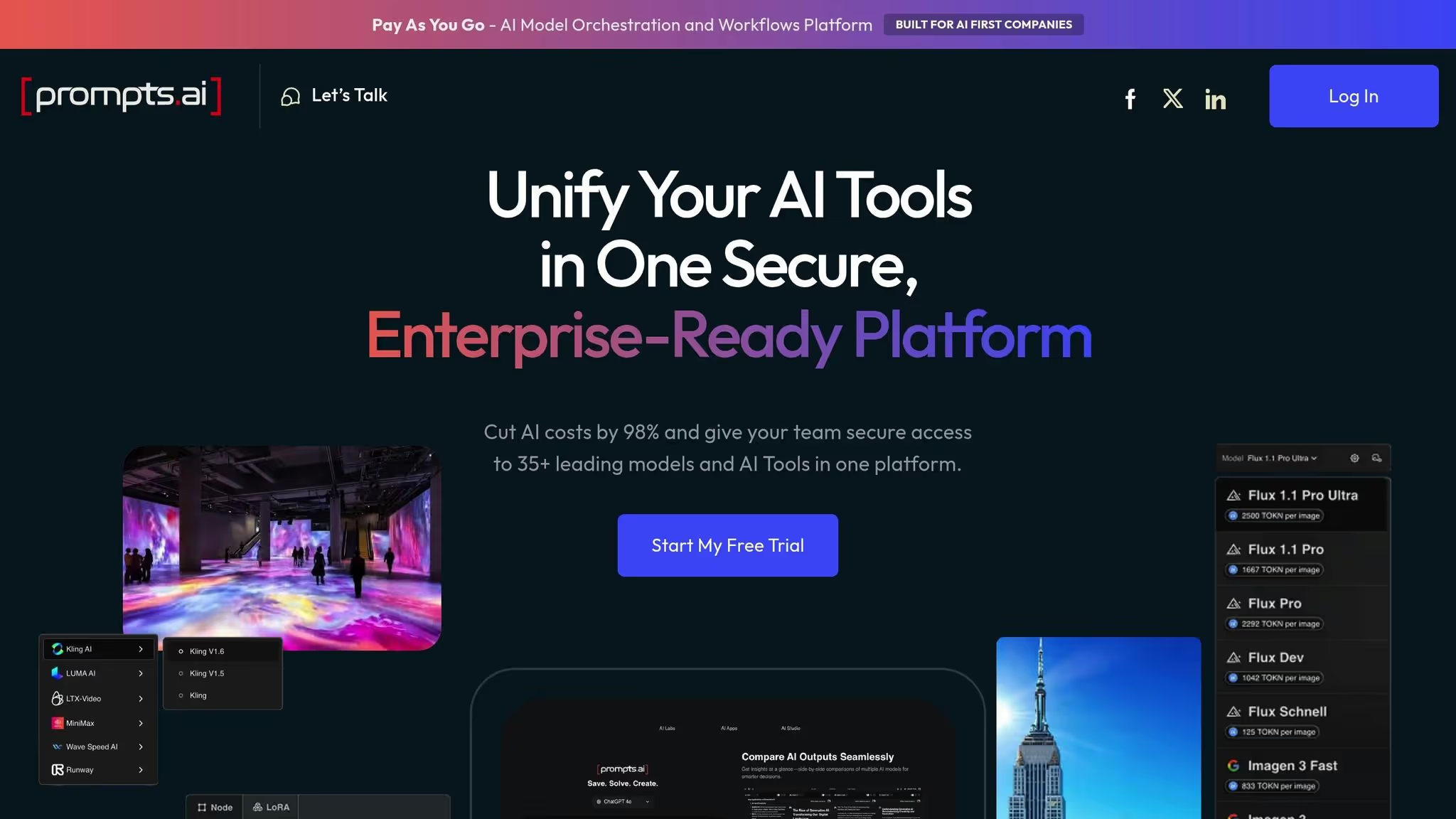

Prompts.ai est une plate-forme d'orchestration d'IA robuste conçue pour une utilisation en entreprise. Il combine plus de 35 grands modèles linguistiques de premier plan, notamment GPT-5, Claude, Lama, Gémeaux, Grok-4, Flux Pro et Kling, dans une interface sécurisée et rationalisée. En centralisant ces outils, la plateforme simplifie la gestion de plusieurs modèles d'IA, offrant ainsi aux équipes un espace unifié pour travailler plus efficacement.

Prompts.ai comble le fossé entre les différents modèles d'IA et systèmes d'entreprise, créant ainsi un flux de travail fluide. Il connecte les sources de données, les modèles et les API au sein d'une organisation, permettant une intégration fluide. Les équipes peuvent facilement passer d'un modèle à l'autre, par exemple en utilisant GPT-5 pour un raisonnement avancé ou Claude pour une création de contenu plus nuancée, tout en préservant la cohérence des modèles d'invite et des politiques de gouvernance. La plateforme s'intègre également à des outils commerciaux essentiels tels que les CRM, les ERP et les plateformes d'analyse, automatisant les actions en fonction de l'extraction de données en temps réel.

Avec Prompts.ai, les instructions en langage naturel peuvent être transformées en flux de travail automatisés, ce qui rend les processus de routine reproductibles et efficaces. Cette fonctionnalité est particulièrement utile pour les organisations qui développent rapidement leurs initiatives en matière d'IA. La conception de la plateforme permet une mise à l'échelle rapide, permettant aux entreprises d'ajouter de nouveaux modèles, de nouveaux utilisateurs et de nouvelles équipes sans effort. Associé à des protocoles de gouvernance robustes, il garantit que la mise à l'échelle ne compromet pas la conformité ou l'intégrité opérationnelle.

Prompts.ai offre une supervision complète avec des pistes d'audit intégrées pour l'utilisation des modèles, un historique rapide et l'accès aux données. Ce niveau de transparence est essentiel pour répondre aux normes de conformité des entreprises du Fortune 500 et des secteurs hautement réglementés. En outre, la plateforme suit la consommation de jetons, reliant directement les dépenses liées à l'IA aux résultats commerciaux. En consolidant la gestion de l'IA, les entreprises peuvent réduire leurs coûts logiciels jusqu'à 98 % par rapport à la gestion de plusieurs abonnements autonomes.

Prompts.ai fonctionne comme une plateforme SaaS basée sur le cloud, utilisant un modèle flexible de paiement à l'utilisation avec des crédits TOKN. Cette approche permet aux entreprises d'aligner les coûts sur l'utilisation réelle, évitant ainsi des frais mensuels fixes. Ses mesures de sécurité avancées garantissent la protection des données sensibles, même lorsque les équipes accèdent à un large éventail de modèles d'IA intégrés. Cette flexibilité et cette sécurité en font un choix idéal pour faire évoluer les opérations d'IA sans risques financiers ou opérationnels inutiles.

Kubiya AI est conçu pour rationaliser et automatiser les flux de travail d'IA en agissant comme une plateforme qui coordonne les agents d'IA pour atteindre les objectifs spécifiques des projets. Grâce à des indicateurs de performance clés clairement définis et à un suivi transparent des tâches, il simplifie la gestion de flux de travail complexes. La plateforme s'intègre à plus de 100 fournisseurs de grands modèles linguistiques (LLM), notamment IA ouverte, Anthropique, Google et Azure, via sa fonctionnalité LiteLM. Cela permet aux organisations de passer d'un modèle à l'autre sans avoir à réécrire le code, offrant ainsi une solution flexible et efficace.

L'architecture de Kubiya utilise une couche d'abstraction unifiée pour éviter toute dépendance vis-à-vis d'un fournisseur, ce qui permet aux équipes d'échanger des LLM pour améliorer la rentabilité et les performances sans avoir à refactoriser le code. Il prend en charge le protocole MCP (Model Context Protocol) pour une intégration standardisée avec les outils et fonctionne parfaitement avec divers environnements d'exécution tels que Agno et Claude Code. Sa technologie MicroVM permet aux agents d'exécuter des commandes de terminal et des tâches au niveau du système dans des environnements isolés, éliminant ainsi le besoin de configurations de protocoles complexes. Cette configuration garantit des opérations fluides et évolutives pour les agents IA.

La plateforme s'appuie sur des agents informatiques distribués et des files d'attente de tâches pour faire évoluer efficacement l'exécution des agents. Kubiya introduit un système Kanban agentic pour surveiller les tâches des agents selon des étapes définies : En attente, En cours, En attente de saisie, Terminé et Échec. Ce système fournit une visibilité claire de la progression du flux de travail et permet de suivre des indicateurs de performance clés mesurables. De plus, la mémoire cognitive permet aux agents de partager le contexte et d'apprendre les uns des autres, améliorant ainsi la coordination et l'efficacité de l'équipe.

Kubiya donne la priorité à la sécurité et à la conformité grâce à des fonctionnalités telles que les garde-fous basés sur Open Policy Agent (OPA), les politiques Zero Trust et l'isolation multi-tenant. Il fournit des pistes d'audit détaillées conformes aux normes SOC 2 Type II, GDPR et CCPA. Pour les organisations nécessitant des configurations auto-hébergées, la plateforme prend également en charge la conformité HIPAA. L'authentification à l'échelle des tâches garantit que les agents n'accèdent qu'aux outils et ressources spécifiques dont ils ont besoin pour leurs tâches, ajoutant ainsi un niveau de sécurité supplémentaire.

Kubiya propose trois modèles de déploiement pour répondre aux différents besoins organisationnels : le SaaS pour une mise en œuvre rapide, des plans de contrôle auto-hébergés pour les réseaux privés et des configurations ventilées pour les environnements nécessitant une sécurité élevée. Les organisations peuvent commencer par la version hébergée, puis intégrer des travailleurs auto-hébergés pour exécuter des tâches en toute sécurité sur les réseaux internes. La plateforme est compatible avec AWS, GCP, Azure et configurations sur site, offrant la flexibilité nécessaire pour répondre à diverses exigences de sécurité et de conformité.

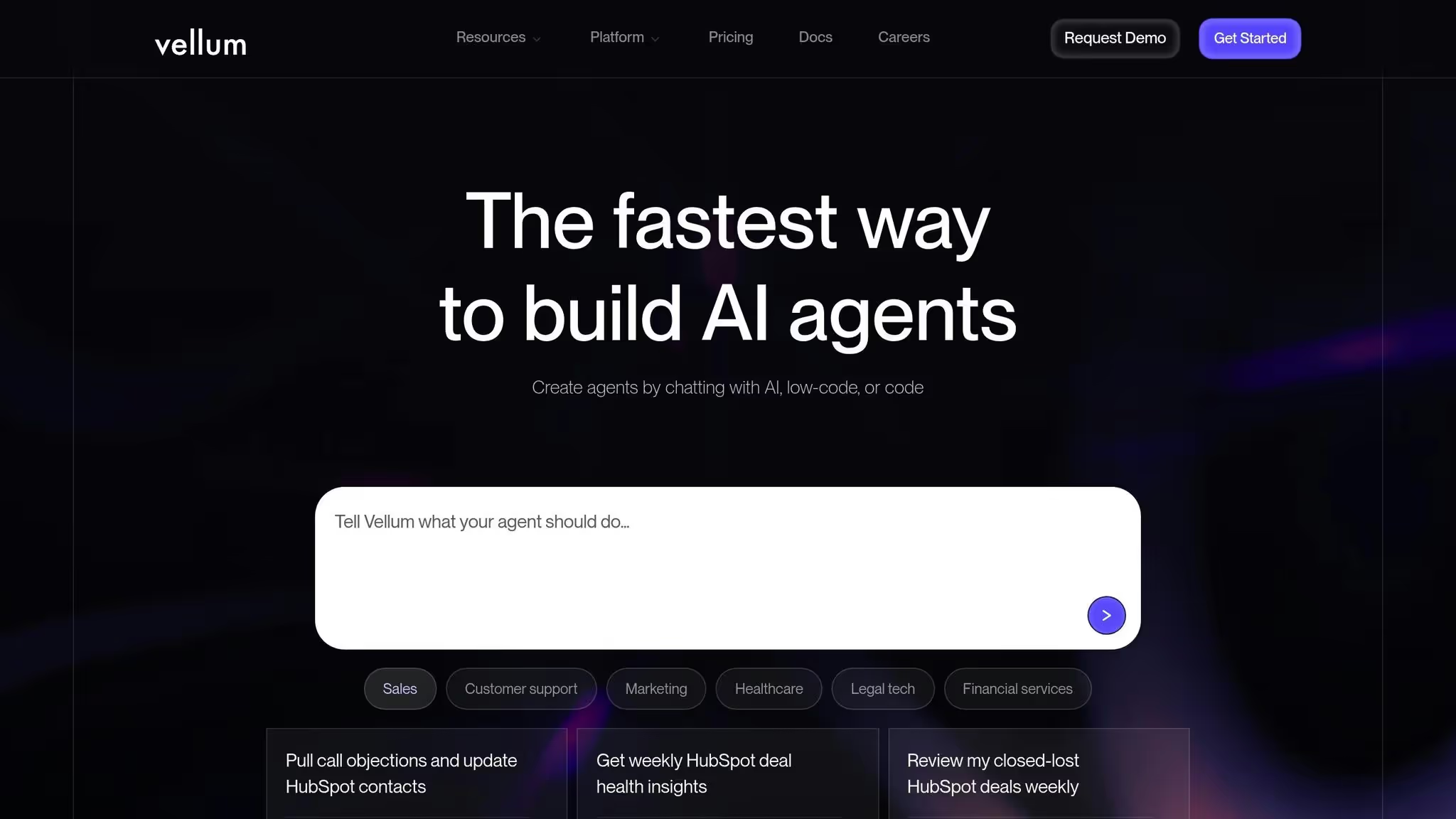

Vellum AI fournit un générateur visuel low-code conçu pour simplifier la création de flux de travail IA. En connectant des étapes individuelles, appelées nœuds, à des chemins d'exécution, appelés bords, les utilisateurs peuvent concevoir n'importe quoi, des chaînes d'instructions simples aux systèmes multi-agents complexes. Cette configuration permet aux chefs de produit et aux ingénieurs de collaborer de manière fluide sur une logique de flux de travail partagée.

La plateforme prend en charge divers fournisseurs de grands modèles de langage (LLM), permettant aux équipes de passer d'un modèle à l'autre ou de mettre en œuvre des stratégies de repli sans avoir à modifier le code. Le vélin comprend des nœuds polyvalents tels que :

En outre, le nœud de recherche natif facilite la génération augmentée par extraction (RAG) en interrogeant les index de documents provenant de diverses sources de données. Le SDK Workflows garantit une synchronisation parfaite entre l'éditeur visuel et le code, permettant aux utilisateurs techniques et non techniques de travailler à partir du même cadre logique.

Vellum optimise les tests et l'exécution des flux de travail grâce à des fonctionnalités telles que Node Mocking, qui élimine le besoin d'appels LLM coûteux pendant les tests, réduit les dépenses liées aux jetons et accélère les itérations. Le Nœud cartographique traite les baies en parallèle à l'aide de sous-flux de travail dédiés, tandis que Nœuds de sous-flux condenser la logique complexe en composants réutilisables, minimisant ainsi la redondance entre les projets. Pour des raisons de fiabilité, les fonctionnalités Retry and Try réexécutent automatiquement les nœuds défaillants. Une fois les flux de travail validés dans le sandbox, ils peuvent être déployés en tant que points de terminaison d'API prêts pour la production, avec la prise en charge de la diffusion des résultats intermédiaires afin de maintenir une faible latence.

« Nous avons multiplié par deux notre calendrier de 9 mois et avons atteint une précision à toute épreuve grâce à notre assistant virtuel. » - Max Bryan, vice-président de la technologie et du design

Vellum répond à des normes de sécurité d'entreprise rigoureuses, notamment la conformité SOC 2, GDPR et HIPAA. Il propose des outils de gouvernance robustes tels que le contrôle d'accès basé sur les rôles (RBAC), l'intégration SSO/SCIM, les journaux d'audit, les flux de travail d'approbation et la gestion complète des versions avec retour en arrière en un clic. Le suivi intégré des coûts pour les nœuds individuels et les sous-flux de travail complets aide les équipes à surveiller et à optimiser les dépenses de production.

Vellum propose des modèles de déploiement flexibles pour répondre à divers besoins, notamment le cloud, les VPC privés, les configurations hybrides et les configurations sur site (y compris les environnements isolés pour une sécurité maximale). Il prend en charge des environnements de développement, de préparation et de production isolés, ce qui facilite la gestion des transitions logiques de l'IA. Les vues de trace avancées offrent une journalisation en temps réel, permettant aux utilisateurs d'inspecter les chemins d'exécution, la latence et les détails des entrées/sorties à chaque étape. La tarification commence par un niveau gratuit, avec des forfaits payants disponibles à 25$ par mois et des options d'entreprise personnalisées. Ces choix de déploiement permettent aux équipes de faire évoluer et d'intégrer Vellum AI de manière fluide dans des flux de travail d'IA plus importants.

Apache Airflow est une plateforme open source conçue pour gérer les flux de travail sous forme de code Python, ce qui en fait une solution idéale pour gérer les pipelines d'IA. Les développeurs peuvent définir des pipelines contrôlables par version et testables, en les ajustant dynamiquement en fonction de paramètres tels que le type de modèle ou le volume de données. En traitant les flux de travail comme du code, Airflow transforme les pipelines d'IA en actifs logiciels qui s'alignent sans effort sur les flux de développement établis. Cette approche garantit une intégration fluide avec un large éventail d'outils et de systèmes d'IA.

Airflow se connecte parfaitement à presque tous les outils d'IA, proposant des packages spécialisés pour des plateformes telles que OpenAI, Cohère, Pomme de pin, Tisser, Qdrantet PGVector. Ces intégrations prennent en charge des tâches allant de l'ingénierie rapide à la gestion de bases de données vectorielles, le tout sans nécessiter de configurations personnalisées. L'introduction du SDK Task dans Airflow 3.0 (publié en avril 2025) sépare l'exécution des tâches du cœur de la plate-forme, garantissant ainsi l'isolement des sous-processus et évitant les conflits entre les différentes versions de modèles. Pour les tâches gourmandes en ressources, KubernetesPodOperator exécute chaque tâche d'IA dans son propre conteneur, fournissant ainsi une isolation supplémentaire. Airflow utilise également XCOM pour transmettre des métadonnées et des pointeurs de modèle entre les tâches, évitant ainsi le transfert de grands ensembles de données. Cela permet de maintenir l'efficacité des flux de travail tout en permettant la coordination avec des plateformes informatiques externes telles que Étincelle ou Flocon de neige.

La conception modulaire d'Airflow exploite les files d'attente de messages pour gérer un nombre illimité d'employés, en passant sans effort d'un seul ordinateur portable à des systèmes distribués capables de gérer des charges de travail massives. Les développeurs peuvent générer dynamiquement des DAG (graphes acycliques dirigés) à l'aide de boucles Python et d'une logique conditionnelle, créant ainsi des flux de travail paramétrés. La logique de branchement peut même redimensionner automatiquement les instances cloud si une tâche de formation rencontre des problèmes de mémoire. Des fonctionnalités telles que le remblayage permettent aux pipelines de retraiter les données historiques lorsque les modèles sont mis à jour, tandis que les réexécutions sélectives des tâches permettent d'optimiser les opérations de formation coûteuses. La sortie d'Airflow 3.1.0 le 25 septembre 2025 a introduit des « flux de travail centrés sur l'homme », permettant des étapes d'approbation manuelles au sein de pipelines automatisés. Cela est particulièrement utile pour les scénarios dans lesquels une validation humaine est requise avant de déployer des modèles en production.

Airflow prend en charge le déploiement dans des environnements cloud, sur site et hybrides, avec Docker images et cartes Helm Charts disponibles pour Kubernetes configurations. Il inclut des opérateurs prédéfinis pour AWS, Plateforme Google Cloud, et Microsoft Azure, garantissant une orchestration cohérente entre les fournisseurs de cloud. L'introduction du flux d'airctl Le 15 octobre 2025, la CLI a ajouté une méthode sécurisée pilotée par API pour gérer les déploiements sans accès direct à la base de données, améliorant ainsi la gouvernance. En décembre 2025, Apache Airflow 3.1.5 prend en charge les versions 3.10 à 3.13 de Python et est utilisé par environ 500 organisations dans le monde entier. Le logiciel est gratuit sous la licence Apache-2.0, bien que les équipes assument généralement des coûts d'infrastructure, que ce soit par le biais de services gérés ou de l'auto-hébergement.

IBM Watsonx Orchestrate est conçu pour rationaliser les flux de travail en coordonnant les agents d'IA via une interface conversationnelle. Il répond à un défi courant lorsque les agents d'IA autonomes ne parviennent pas à effectuer des tâches, en agissant en tant que superviseur qui garantit une collaboration fluide entre les agents spécialisés pour les processus en plusieurs étapes. En s'alignant sur les tendances modernes en matière d'orchestration de l'IA, watsonx Orchestrate montre comment des outils intégrés peuvent améliorer l'efficacité opérationnelle.

L'une des caractéristiques les plus remarquables de Watsonx Orchestrate est sa Passerelle IA, qui permet aux utilisateurs de sélectionner et de basculer entre différents modèles de base, notamment IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral, et Llama. Cette flexibilité permet aux organisations d'éviter de se retrouver dans une situation de dépendance vis-à-vis des fournisseurs. Pour les systèmes sans API ouvertes, la plateforme utilise des robots RPA pour connecter les systèmes existants. Il s'intègre également à plus de 80 applications d'entreprise telles que Salesforce, Slack, Microsoft Teams, Jira, Zendesk, et Facteurs de réussite SAP.

En outre, il propose un catalogue de plus de 400 outils prédéfinis et de 100 agents d'IA spécifiques à un domaine, adaptés aux tâches des ressources humaines, des ventes et des achats. Pour une personnalisation plus poussée, les utilisateurs peuvent créer leurs propres outils et agents à l'aide d'un studio sans code/low-code appelé Agent Builder. Cette capacité étendue d'intégration et de personnalisation fait de watsonx Orchestrate une solution évolutive et efficace répondant à divers besoins d'automatisation.

Watsonx Orchestrate prend en charge trois styles d'orchestration : Réagir, Planifier et agir, et Déterministe - pour répondre à diverses exigences opérationnelles. Cette capacité d'adaptation permet aux organisations de choisir l'approche qui répond à leurs besoins spécifiques. Par exemple, IBM a utilisé la plateforme pour résoudre instantanément 94 % de ses plus de 10 millions de demandes RH annuelles, permettant ainsi aux employés de se concentrer sur des tâches plus stratégiques. De même, Dun & Bradstreet a réduit de 20 % la durée des tâches d'approvisionnement en tirant parti des évaluations des risques des fournisseurs pilotées par l'IA.

Le catalogue prédéfini de la plateforme permet aux entreprises de mettre en œuvre l'automatisation jusqu'à 70 % plus rapidement qu'en partant de zéro. Dans le même temps, le studio Agent Builder permet aux utilisateurs, qu'ils aient une expertise technique ou non, de concevoir des agents et des outils personnalisés sans codage approfondi. Cette combinaison de vitesse, de flexibilité et de simplicité fait de watsonx Orchestrate un outil puissant pour faire évoluer les flux de travail d'IA.

La gouvernance est un aspect essentiel de Watsonx Orchestrate. Il s'intègre à watsonx.governance pour assurer la gestion du cycle de vie, l'évaluation des risques et la surveillance de la conformité. Des fonctionnalités telles que les garde-corps intégrés, l'application automatisée des politiques et la supervision centralisée contribuent à empêcher la prolifération des agents et à garantir le respect des normes de conformité. Ces fonctionnalités sont particulièrement utiles pour les secteurs qui nécessitent des pistes d'audit strictes et une conformité réglementaire.

Pour répondre aux différents besoins opérationnels, watsonx Orchestrate propose des modèles de déploiement flexibles, notamment des options cloud, sur site et hybrides. Cela permet aux organisations de répondre aux exigences de résidence des données et d'évoluer en fonction des besoins sans compromettre les fonctionnalités. La tarification commence à 500 USD par mois pour le plan Essentials et 6 000 USD par instance pour le plan Standard. Un essai gratuit de 30 jours est également disponible pour ceux qui souhaitent explorer les fonctionnalités de la plateforme.

Prefect adopte une approche dynamique des flux de travail d'IA en tirant parti du flux de contrôle Python natif au lieu de s'appuyer sur des DAG statiques. Cette flexibilité permet de prendre des décisions d'exécution, permettant aux agents d'IA d'ajuster les processus à la volée à l'aide de constructions Python standard telles que si/sinon déclarations et tandis que boucles. Cette adaptabilité garantit que les flux de travail répondent de manière intelligente au fur et à mesure de leur exécution, améliorant ainsi l'efficacité. Lancé en 2024, Prefect 3.0 a réduit les frais d'exécution de 90 %, ce qui en fait l'une des plateformes les plus efficaces pour gérer les flux de travail d'IA.

Prefect s'intègre parfaitement à des outils tels que Pydantic AI et LangGraph, dotant les agents de fonctionnalités puissantes telles que les nouvelles tentatives automatiques et l'observabilité au niveau des tâches. Grâce à MCP rapide, la plateforme utilise le protocole Model Context pour fournir un contexte aux systèmes d'IA de production, garantissant ainsi une intégration fluide. En outre, la capacité de Prefect à mettre en cache les réponses LLM permet de maintenir l'état de l'agent en cas de panne et de réduire les coûts d'API.

Andrew Waterman, ingénieur en apprentissage automatique, a souligné son efficacité :

« J'ai utilisé le réglage parallélisé des hyperparamètres avec Prefect et Dask pour réaliser 350 expériences en 30 minutes, ce qui aurait normalement pris 2 jours ».

Application CashL'équipe ML d'Airflow est passée d'Airflow à Prefect, en raison de sa sécurité supérieure et de son processus d'adoption convivial. Prefect intègre également une fonctionnalité humaine intégrée, permettant aux flux de travail de faire une pause pour les approbations manuelles via des formulaires d'interface utilisateur générés automatiquement. Cette fonctionnalité est particulièrement utile pour la conformité et le feedback dans les systèmes d'IA.

Avec 6 millions de téléchargements mensuels et une communauté de 30 000 ingénieurs, Prefect a eu un impact considérable sur l'automatisation des flux de travail basés sur l'IA. Par exemple, Plongée avec tuba AI a vu un Débit multiplié par 20 en utilisant Prefect pour le traitement asynchrone, permettant plus de 1 000 flux par heure et des dizaines de milliers d'exécutions quotidiennes. Smit Shah, directeur de l'ingénierie chez Snorkel AI, l'a décrit comme suit :

« notre cheval de bataille pour le traitement asynchrone : un couteau suisse ».

De même, Endpoint a signalé un Baisse de 73,78 % des frais de facturation après avoir migré d'Astronome à Préfet, tout en triplant leur production. Ces résultats soulignent la capacité de Prefect à gérer des flux de travail automatisés à grande échelle avec efficacité et précision.

Prefect utilise une architecture hybride : son plan de contrôle fonctionne dans Prefect Cloud, tandis que l'exécution du code et les données restent au sein de votre infrastructure sécurisée. Cette conception est idéale pour les secteurs soumis à des exigences de sécurité strictes, car elle conserve les données sensibles derrière votre pare-feu tout en tirant parti du cloud pour la gestion. Les options de déploiement incluent Kubernetes, Docker, AWS ECS et des plateformes sans serveur telles que Google Cloud Run.

Pour les petites équipes ou les utilisateurs individuels, Prefect propose un niveau gratuit prenant en charge 2 utilisateurs et 5 déploiements. Une version open source est également disponible sous licence Apache 2.0 pour l'auto-hébergement. Les utilisateurs professionnels peuvent accéder à des fonctionnalités avancées telles que le contrôle d'accès basé sur les rôles (RBAC), l'intégration SSO, les journaux d'audit et SCIM pour le provisionnement automatique des équipes.

SuperAgi fait forte impression dans le domaine des solutions de flux de travail basées sur l'IA en s'appuyant sur des agents autonomes. Il s'agit d'un framework open source conçu pour déployer plusieurs agents d'IA à grande échelle. Contrairement aux outils qui se concentrent sur des flux de travail à modèle unique, SuperAGI coordonne des réseaux d'agents spécialisés pour gérer des tâches complexes en plusieurs étapes avec un minimum d'intervention humaine.

Une caractéristique remarquable de SuperAGI est sa Gestionnaire d'outils, qui connecte les agents à des plateformes telles que GitHub, Google Search, Slack et diverses bases de données. Cette configuration permet une interaction fluide entre plusieurs grands modèles de langage (LLM), tels que les systèmes basés sur le GPT, ce qui permet aux agents de choisir le meilleur modèle pour chaque tâche. Cette fonctionnalité multimodèle garantit des opérations fluides et autonomes.

SuperAgi excelle dans l'automatisation des tâches d'entreprise en permettant aux agents de travailler de manière autonome, en déléguant et en surveillant les tâches de manière efficace. Cela correspond à la tendance croissante de l'IA agentique, selon laquelle les systèmes vont au-delà de la simple automatisation pour exécuter des flux de travail complexes axés sur les résultats. Ils peuvent planifier et mener à bien des processus en plusieurs étapes sur différentes plateformes. Notamment, Workflows alimentés par l'IA devraient connaître une croissance significative, passant de 3 % à 25 % des processus d'entreprise d'ici la fin de 2025.

En tant que plateforme open source, SuperAGI offre aux entreprises la flexibilité d'héberger elles-mêmes le système sur leur propre infrastructure. Pour les entreprises possédant une expertise technique, cela signifie éviter les coûts liés aux solutions propriétaires tout en ayant la possibilité de personnaliser largement la plateforme. Cette approche est idéale pour les entreprises qui cherchent à contrôler totalement leurs systèmes et données d'IA, tout en offrant une rentabilité et une confidentialité accrues.

Lors du choix de la bonne solution, il est essentiel d'évaluer l'interopérabilité, les options de déploiement et les capacités d'automatisation. Le tableau ci-dessous fournit une comparaison côte à côte de ces plateformes, en mettant en évidence leurs principales caractéristiques et points forts.

Chaque plateforme possède ses propres avantages, ce qui la rend adaptée à des cas d'utilisation spécifiques :

« Airflow n'était plus viable pour les flux de travail ML. Nous avions besoin de sécurité et de facilité d'adoption. Le préfet a assuré les deux. »

Prefect minimise également les coûts en mettant les résultats en cache pour éviter les appels d'API redondants. Dans le même temps, IBM Watsonx Orchestrate exploite Kubernetes pour faire évoluer les ressources en temps réel, et Prompts.ai intègre des contrôles FinOps pour optimiser les dépenses, augmentant potentiellement le retour sur investissement jusqu'à 60 %.

Le choix de la bonne plateforme d'orchestration des flux de travail peut faire toute la différence pour développer les initiatives d'IA et générer une valeur commerciale mesurable. Le succès d'un projet d'IA dépend souvent de facteurs clés tels que l'interopérabilité, la gouvernance et la gestion des coûts. Les plateformes qui connectent de manière fluide les modèles, les sources de données et les systèmes d'entreprise aident les équipes à dépasser les expériences isolées pour adopter des flux de travail intelligents et entièrement intégrés.

L'évolution vers une orchestration adaptative en temps réel est de plus en plus vitale pour les opérations d'IA modernes. À mesure que l'IA agentique prend de plus en plus d'importance, les outils d'orchestration doivent évoluer pour permettre une prise de décision en temps réel plutôt que de s'appuyer sur une automatisation rigide et préprogrammée. Les systèmes qui allouent les ressources de manière dynamique tout en garantissant des contrôles de conformité centralisés constituent une base solide pour une mise à l'échelle responsable. De nombreuses organisations mettant en œuvre ces flux de travail font état de gains d'efficacité significatifs, certaines équipes économisant des centaines d'heures chaque mois grâce à l'automatisation.

Alors que 92 % des dirigeants prévoient que leurs flux de travail seront numérisés et pilotés par l'IA d'ici 2025, le moment est venu de créer un cadre évolutif. Les entreprises qui investissent dans des cadres d'orchestration ont vu leurs retours sur investissements dans l'IA s'améliorer de 60 %, ce qui met en évidence la valeur des opérations coordonnées en matière d'IA.

Pour commencer, concentrez-vous sur le pilotage d'un flux de travail à fort impact, tel que le routage des prospects, l'intégration des clients ou la gestion de l'infrastructure. Recherchez des plateformes axées sur les API qui intègrent des points de contrôle humains et fournissent des indicateurs clairs, tels que les heures économisées ou le coût par tâche. N'oubliez pas que des données propres et normalisées sont essentielles, car une mauvaise qualité des données peut compromettre même les meilleurs systèmes d'orchestration.

La bonne plateforme a le pouvoir de transformer la collaboration, de rationaliser l'intégration des modèles et d'optimiser le retour sur investissement. Sélectionnez une solution qui correspond à vos besoins de déploiement, à vos exigences techniques et à vos objectifs de croissance à long terme. En donnant la priorité à l'interopérabilité, à la gouvernance et à la rentabilité, vous jetterez les bases d'un succès durable en matière d'IA.

Les plateformes d'orchestration des flux de travail d'IA simplifient la gestion des opérations d'IA complexes, en regroupant des tâches telles que les pipelines de données, les déploiements de modèles et l'allocation des ressources dans un système rationalisé. Cette centralisation n'est pas seulement permet de gagner du temps mais aussi réduit les coûts en automatisant les processus répétitifs et en optimisant l'utilisation des ressources en temps réel.

Ces plateformes sont conçues pour gérer efficacement la croissance tout en maintenant un niveau élevé de sécurité. Ils garantissent des performances fluides sans nécessiter d'intégrations compliquées. Des fonctionnalités telles que la surveillance intégrée et la gestion des erreurs ajoutent une couche supplémentaire fiabilité, ce qui permet de minimiser les erreurs et de garantir le bon fonctionnement des flux de travail. Le résultat ? Des déploiements plus rapides, des budgets maîtrisés et un cadre fiable pour étendre les initiatives d'IA à l'échelle de votre organisation.

Les plateformes d'orchestration de l'IA augmentent le retour sur investissement en automatisation et optimisation des flux de travail liés à l'IA, réduisant de manière significative le temps et les ressources nécessaires au développement et aux opérations. Les entreprises peuvent constater des réductions de coûts sur les modèles et les infrastructures d'IA, potentiellement jusqu'à 98 %, tout en améliorant l'efficacité, l'évolutivité et la supervision.

En simplifiant les processus complexes et en permettant une intégration fluide, ces plateformes permettent aux entreprises de se concentrer sur l'innovation et les initiatives stratégiques, ouvrant ainsi la voie à une rentabilité accrue et à une croissance durable.

Lorsque vous choisissez une plateforme d'orchestration d'IA, concentrez-vous sur intégration et compatibilité. La plateforme devrait relier sans effort de grands modèles de langage, des outils de données et des pipelines d'apprentissage automatique, afin de permettre aux flux de travail de fonctionner sans problème sans avoir à passer d'un système à l'autre.

Faites attention à évolutivité et transparence des coûts. Optez pour un modèle de tarification qui s'adapte à votre utilisation, tel que le paiement à l'utilisation, afin de gérer les coûts de manière efficace. La plateforme doit également prendre en charge tout, des petites tâches aux opérations complexes à grande échelle, afin de pouvoir évoluer en fonction de vos besoins.

Tout aussi importants sont sécurité et fiabilité. Recherchez des fonctionnalités telles que l'authentification forte, les contrôles d'accès basés sur les rôles et le respect des réglementations en matière de confidentialité des données. Des outils tels que la surveillance en temps réel, la gestion automatisée des erreurs et des interfaces conviviales peuvent faciliter l'adoption de la plateforme et garantir le bon fonctionnement des équipes aux compétences techniques variées.