La orquestación del flujo de trabajo con IA transforma la forma en que operan las empresas al conectar modelos, datos y herramientas para permitir decisiones más inteligentes y en tiempo real. Si bien la mayoría de los pilotos de IA empresarial fracasan debido a una mala coordinación, las empresas que utilizan plataformas de orquestación informan que hasta ROI un 60% más alto. Plataformas como Prompts.ai, Kubiya AI, y IBM watsonx Orchestrate agilice los flujos de trabajo, automatice las tareas y garantice el cumplimiento, lo que ayuda a las empresas a escalar de manera eficiente.

Cada plataforma sobresale en áreas como interoperabilidad, automatización, y flexibilidad de implementación, lo que los hace ideales para diferentes casos de uso. Ya sea que esté centralizando las herramientas de inteligencia artificial, ampliando la automatización o garantizando el cumplimiento, estas soluciones pueden ayudar a las empresas a ahorrar tiempo y reducir costos.

Comience por identificar sus principales desafíos de flujo de trabajo y adaptarlos a la plataforma que se alinee con sus objetivos. Ya sea para simplificar la gestión del modelo de IA o para ampliar la automatización de tareas, estas herramientas pueden generar resultados cuantificables.

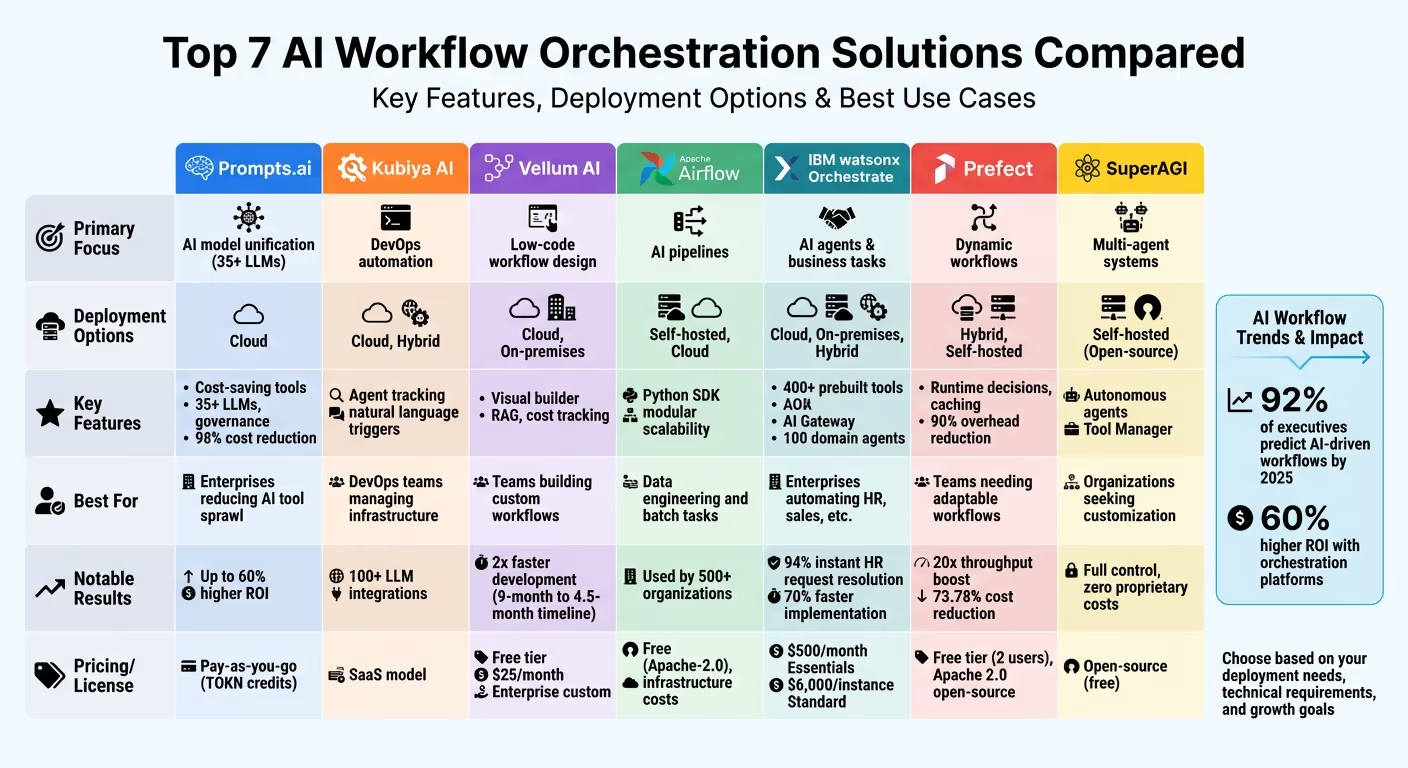

Comparación de plataformas de orquestación de flujos de trabajo de IA: características, implementación y mejores casos de uso

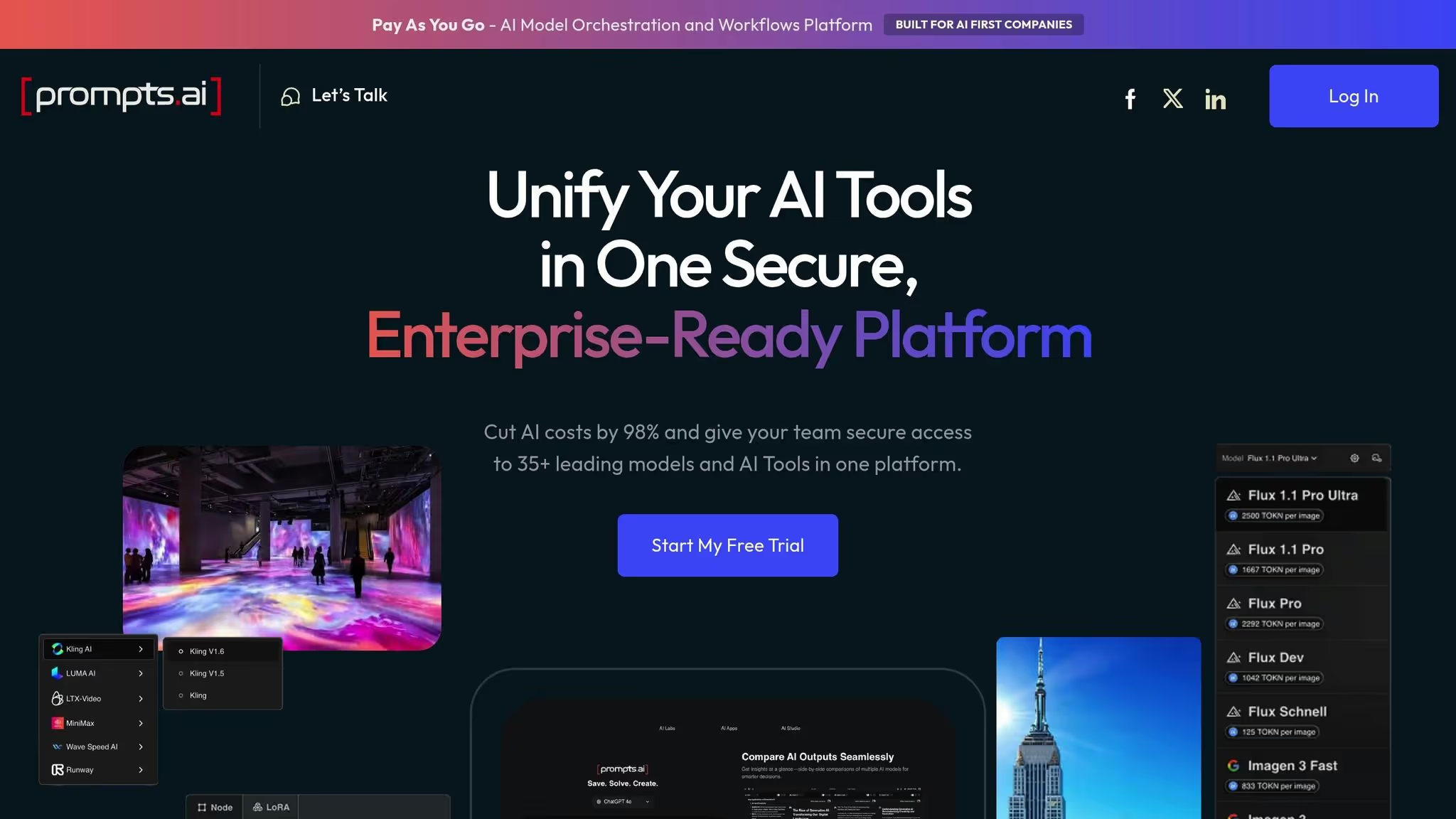

Prompts.ai es una sólida plataforma de orquestación de IA diseñada para uso empresarial. Combina más de 35 de los principales modelos lingüísticos de gran tamaño, entre los que se incluyen GPT-5, Claudio, Llama, Géminis, Grok-4, Flux Pro y Kling, en una interfaz segura y optimizada. Al centralizar estas herramientas, la plataforma simplifica la administración de varios modelos de IA, lo que brinda a los equipos un espacio unificado para trabajar de manera más eficiente.

Prompts.ai cierra la brecha entre los diversos modelos de IA y sistemas empresariales, creando un flujo de trabajo perfecto. Conecta las fuentes de datos, los modelos y las API en toda la organización, lo que permite una integración fluida. Los equipos pueden cambiar fácilmente de un modelo a otro (por ejemplo, usar GPT-5 para un razonamiento avanzado o Claude para crear contenido más detallado), sin dejar de mantener la coherencia entre las plantillas rápidas y las políticas de gobierno. La plataforma también se integra con herramientas empresariales esenciales, como los CRM, los ERP y las plataformas de análisis, y automatiza las acciones basándose en la extracción de datos en tiempo real.

Con Prompts.ai, las instrucciones en lenguaje natural se pueden transformar en flujos de trabajo automatizados, lo que hace que los procesos rutinarios sean repetibles y eficientes. Esta función es particularmente útil para las organizaciones que expanden rápidamente sus iniciativas de inteligencia artificial. El diseño de la plataforma permite un escalado rápido, lo que permite a las empresas añadir nuevos modelos, usuarios y equipos sin esfuerzo. En combinación con protocolos de gobierno sólidos, garantiza que la escalabilidad no comprometa el cumplimiento ni la integridad operativa.

Prompts.ai ofrece una supervisión integral con registros de auditoría integrados para el uso del modelo, el historial rápido y el acceso a los datos. Este nivel de transparencia es esencial para cumplir con los estándares de cumplimiento de las empresas de la lista Fortune 500 y de los sectores altamente regulados. Además, la plataforma rastrea el consumo de tokens, vinculando directamente los gastos de inteligencia artificial con los resultados empresariales. Al consolidar la gestión de la IA, las organizaciones pueden reducir los costos de software hasta en un 98% en comparación con la gestión de varias suscripciones independientes.

Prompts.ai funciona como una plataforma SaaS basada en la nube, utilizando un modelo flexible de pago por uso con créditos TOKN. Este enfoque permite a las empresas alinear los costos con el uso real, evitando las tarifas mensuales fijas. Sus medidas de seguridad avanzadas garantizan que los datos confidenciales permanezcan protegidos, incluso cuando los equipos acceden a una amplia gama de modelos de IA integrados. Esta flexibilidad y seguridad lo convierten en la opción ideal para escalar las operaciones de IA sin riesgos financieros u operativos innecesarios.

Kubiya AI está diseñada para agilizar y automatizar los flujos de trabajo de la IA al actuar como una plataforma que coordina a los agentes de IA para lograr los objetivos específicos del proyecto. Con KPI claramente definidos y un seguimiento transparente de las tareas, simplifica la gestión de flujos de trabajo complejos. La plataforma se integra con más de 100 proveedores de modelos lingüísticos extensos (LLM), entre los que se incluyen IA abierta, Antrópico, Google y Azure, a través de su función LitellM. Esto permite a las organizaciones cambiar de modelo sin necesidad de reescribir el código, lo que ofrece una solución flexible y eficiente.

La arquitectura de Kubiya utiliza una capa de abstracción unificada para evitar la dependencia de un proveedor, lo que permite a los equipos cambiar los LLM para obtener una mejor rentabilidad y rendimiento sin necesidad de refactorizar el código. Es compatible con el Model Context Protocol (MCP) para una integración estandarizada con las herramientas, y funciona a la perfección con varios tiempos de ejecución, como Agno y Claude Code. Su tecnología microVM permite a los agentes ejecutar comandos de terminal y tareas a nivel de sistema en entornos aislados, lo que elimina la necesidad de configuraciones de protocolo complejas. Esta configuración garantiza operaciones escalables y fluidas para los agentes de IA.

La plataforma aprovecha los trabajadores informáticos distribuidos y las colas de tareas para escalar la ejecución de los agentes de forma eficaz. Kubiya presenta un sistema Kanban de agencia para supervisar las tareas de los agentes en etapas definidas: pendientes, en ejecución, en espera de entrada, completadas y fallidas. Este sistema proporciona una visibilidad clara del progreso del flujo de trabajo y hace un seguimiento de los KPI mensurables. Además, la memoria cognitiva permite a los agentes compartir el contexto y aprender unos de otros, lo que mejora la coordinación y la eficiencia del equipo.

Kubiya prioriza la seguridad y el cumplimiento mediante funciones como las barreras de protección basadas en Open Policy Agent (OPA), las políticas de confianza cero y el aislamiento de múltiples inquilinos. Proporciona registros de auditoría detallados que se alinean con los estándares SOC 2 de tipo II, GDPR y CCPA. Para las organizaciones que requieren configuraciones autohospedadas, la plataforma también admite el cumplimiento de la HIPAA. La acreditación por tareas garantiza que los agentes solo accedan a las herramientas y los recursos específicos que necesitan para sus tareas, lo que añade otro nivel de seguridad.

Kubiya ofrece tres modelos de implementación que se adaptan a las diferentes necesidades organizativas: SaaS para una implementación rápida, planos de control autohospedados para redes privadas y configuraciones aisladas para entornos que requieren alta seguridad. Las organizaciones pueden empezar con la versión alojada y, más adelante, integrar a los trabajadores autohospedados para ejecutar las tareas de forma segura dentro de las redes internas. La plataforma es compatible con AWS, GCP, Azure y configuraciones locales, que ofrecen la flexibilidad necesaria para cumplir con diversos requisitos de seguridad y cumplimiento.

Vellum AI proporciona un generador visual de bajo código diseñado para simplificar la creación de flujos de trabajo de IA. Al conectar los pasos individuales, denominados nodos, con las rutas de ejecución, conocidas como bordes, los usuarios pueden diseñar cualquier cosa, desde cadenas de instrucciones sencillas hasta intrincados sistemas con múltiples agentes. Esta configuración permite a los ingenieros y administradores de productos colaborar sin problemas en una lógica de flujo de trabajo compartida.

La plataforma admite una variedad de proveedores de modelos de lenguaje extensos (LLM), lo que permite a los equipos cambiar de modelo o implementar estrategias alternativas sin necesidad de cambiar el código. Vellum incluye nodos versátiles como:

Además, el nodo de búsqueda nativo facilita la generación aumentada de recuperación (RAG) al consultar los índices de documentos en diversas fuentes de datos. El SDK de flujos de trabajo garantiza una sincronización perfecta entre el editor visual y el código, lo que permite a los usuarios técnicos y no técnicos trabajar desde el mismo marco lógico.

Vellum optimiza las pruebas y la ejecución del flujo de trabajo con funciones como Node Mocking, que elimina la necesidad de costosas llamadas de LLM durante las pruebas, lo que reduce los gastos de tokens y acelera las iteraciones. El Nodo de mapa procesa matrices en paralelo mediante subflujos de trabajo dedicados, mientras Nodos de subflujo de trabajo condense la lógica compleja en componentes reutilizables, minimizando la redundancia entre los proyectos. Para mayor confiabilidad, las funciones Retry and Try vuelven a ejecutar automáticamente los nodos fallidos. Una vez validados los flujos de trabajo en el entorno de pruebas, se pueden implementar como puntos finales de API listos para la producción y, además, permiten la transmisión de los resultados intermedios para mantener una latencia baja.

«Aceleramos nuestro plazo de 9 meses dos veces y logramos una precisión infalible con nuestro asistente virtual». - Max Bryan, vicepresidente de tecnología y diseño

Vellum cumple con rigurosos estándares de seguridad empresarial, incluido el cumplimiento de SOC 2, GDPR e HIPAA. Ofrece herramientas de gobierno sólidas, como el control de acceso basado en roles (RBAC), la integración entre SSO y SCIM, los registros de auditoría, los flujos de trabajo de aprobación y un control de versiones completo con la reversión con un solo clic. El seguimiento integrado de los costes de los nodos individuales y de los subflujos de trabajo completos ayuda a los equipos a supervisar y optimizar los gastos de producción.

Vellum proporciona modelos de implementación flexibles que se adaptan a diversas necesidades, incluidas la nube, las VPC privadas, las configuraciones híbridas y las configuraciones locales (incluso entornos aislados para una máxima seguridad). Es compatible con entornos aislados de desarrollo, puesta en escena y producción, lo que facilita la gestión de las transiciones lógicas de la IA. Las vistas de seguimiento avanzadas ofrecen registros en tiempo real, lo que permite a los usuarios inspeccionar las rutas de ejecución, la latencia y los detalles de entrada y salida en cada paso. Los precios comienzan con un nivel gratuito, con planes de pago disponibles a 25 USD al mes y opciones empresariales personalizadas. Estas opciones de implementación permiten a los equipos escalar e integrar Vellum AI sin problemas en flujos de trabajo de IA más grandes.

Apache Airflow es una plataforma de código abierto diseñada para administrar los flujos de trabajo como código Python, lo que la convierte en una excelente opción para gestionar las canalizaciones de IA. Los desarrolladores pueden definir canalizaciones controladas por versiones y comprobables, ajustándolas dinámicamente en función de parámetros como el tipo de modelo o el volumen de datos. Al tratar los flujos de trabajo como código, Airflow convierte las canalizaciones de IA en activos de software que se alinean sin esfuerzo con los flujos de trabajo de desarrollo establecidos. Este enfoque garantiza una integración fluida con una amplia gama de herramientas y sistemas de inteligencia artificial.

Airflow se conecta sin problemas con casi cualquier herramienta de IA y ofrece paquetes especializados para plataformas como OpenAI, CoHERE, Piña, Aviamos, Qaranty pgVector. Estas integraciones se encargan de tareas que van desde la ingeniería rápida hasta la administración de bases de datos vectoriales, todo ello sin necesidad de configuraciones personalizadas. La introducción del SDK de tareas en Airflow 3.0 (lanzado en abril de 2025) separa la ejecución de tareas del núcleo de la plataforma, lo que garantiza que los subprocesos permanezcan aislados y evita conflictos entre las diferentes versiones del modelo. Para las tareas que consumen muchos recursos, el KuberneSpodOperator ejecuta cada trabajo de IA en su propio contenedor, lo que proporciona un aislamiento adicional. Airflow también usa XCOM para pasar metadatos e indicadores de modelos entre tareas, lo que evita la transferencia de grandes conjuntos de datos. Esto mantiene la eficiencia de los flujos de trabajo y, al mismo tiempo, permite la coordinación con plataformas informáticas externas, como Chispa o Copo de nieve.

El diseño modular de Airflow aprovecha las colas de mensajes para gestionar un número ilimitado de trabajadores, lo que permite pasar sin esfuerzo de un solo portátil a sistemas distribuidos capaces de gestionar cargas de trabajo masivas. Los desarrolladores pueden generar dinámicamente DAG (gráficos acíclicos dirigidos) mediante bucles de Python y lógica condicional, creando flujos de trabajo parametrizados. La lógica de ramificación puede incluso cambiar el tamaño de las instancias en la nube automáticamente si una tarea de entrenamiento presenta problemas de memoria. Funciones como el relleno permiten a las canalizaciones volver a procesar los datos históricos cuando se actualizan los modelos, mientras que la repetición selectiva de tareas ayuda a optimizar las costosas operaciones de formación. La versión 3.1.0 de Airflow, el 25 de septiembre de 2025, introdujo los «flujos de trabajo centrados en las personas», que permitían los pasos de aprobación manuales dentro de los procesos automatizados. Esto es particularmente útil en situaciones en las que se requiere la validación humana antes de implementar los modelos en la producción.

Airflow admite la implementación en entornos híbridos, locales y en la nube, con Estibador imágenes y gráficos de timón disponibles para Kubernetes configuraciones. Incluye operadores prediseñados para AWS, Google Cloud Platform, y Microsoft Azure, lo que garantiza una orquestación uniforme entre los proveedores de la nube. La introducción del flujo de aire ctl El 15 de octubre de 2025, la CLI agregó un método seguro y basado en API para administrar las implementaciones sin acceso directo a la base de datos, lo que mejora la gobernanza. Desde diciembre de 2025, Apache Airflow 3.1.5 es compatible con las versiones 3.10 a 3.13 de Python y lo utilizan alrededor de 500 organizaciones de todo el mundo. El software es gratuito con la licencia Apache-2.0, aunque los equipos suelen incurrir en gastos de infraestructura, ya sea a través de servicios gestionados o de alojamiento propio.

IBM watsonx Orchestrate está diseñado para agilizar los flujos de trabajo mediante la coordinación de los agentes de IA a través de una interfaz conversacional. Aborda un desafío común en el que los agentes de IA independientes no pueden completar las tareas, actuando como supervisores que garantizan una colaboración fluida entre los agentes especializados en los procesos de varios pasos. Al alinearse con las tendencias modernas en la orquestación de la IA, watsonx Orchestrate demuestra cómo las herramientas integradas pueden mejorar la eficiencia operativa.

Una de las características más destacadas de watsonx Orchestrate es su Puerta de enlace de IA, que permite a los usuarios seleccionar y cambiar entre varios modelos básicos, incluidos IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral, y Llama. Esta flexibilidad ayuda a las organizaciones a evitar la dependencia de un solo proveedor. Para los sistemas sin API abiertas, la plataforma emplea bots de RPA para conectar los sistemas antiguos. También se integra con más de 80 aplicaciones empresariales, como Fuerza de ventas, Slack, Equipos de Microsoft, Jira, Zendesk, y Factores de éxito de SAP.

Además, ofrece un catálogo de más de 400 herramientas prediseñadas y 100 agentes de IA específicos del dominio diseñados para tareas de recursos humanos, ventas y adquisiciones. Para una mayor personalización, los usuarios pueden crear sus propias herramientas y agentes mediante un estudio sin código o con poco código llamado Agent Builder. Esta amplia capacidad de integración y personalización convierte a watsonx Orchestrate en una solución escalable y eficiente para diversas necesidades de automatización.

Watsonx Orchestrate admite tres estilos de orquestación - Reacciona, Planificar-actuar, y Determinístico - para adaptarse a diversos requisitos operativos. Esta adaptabilidad garantiza que las organizaciones puedan elegir el enfoque que se adapte a sus necesidades específicas. Por ejemplo, IBM utilizó la plataforma para resolver instantáneamente el 94% de sus más de 10 millones de solicitudes anuales de recursos humanos, lo que permitió a los empleados centrarse en tareas más estratégicas. Del mismo modo, Dun & Bradstreet logró una reducción del 20% en el tiempo dedicado a las tareas de adquisición al aprovechar las evaluaciones de riesgo de los proveedores impulsadas por la inteligencia artificial.

El catálogo prediseñado de la plataforma permite a las empresas implementar la automatización hasta un 70% más rápido en comparación con la creación desde cero. Mientras tanto, el estudio Agent Builder permite a los usuarios, tengan o no experiencia técnica, diseñar agentes y herramientas personalizados sin necesidad de programar mucho. Esta combinación de velocidad, flexibilidad y simplicidad convierte a watsonx Orchestrate en una poderosa herramienta para escalar los flujos de trabajo de la IA.

La gobernanza es un aspecto fundamental de watsonx Orchestrate. Se integra con watsonx.governance para gestionar el ciclo de vida, evaluar los riesgos y supervisar el cumplimiento. Funciones como las barreras de protección integradas, la aplicación automatizada de políticas y la supervisión centralizada ayudan a prevenir la dispersión de agentes y a garantizar el cumplimiento de las normas de cumplimiento. Estas capacidades son especialmente valiosas para los sectores que requieren registros de auditoría estrictos y el cumplimiento de la normativa.

Para satisfacer las diferentes necesidades operativas, watsonx Orchestrate ofrece modelos de implementación flexibles, que incluyen opciones en la nube, locales e híbridas. Esto garantiza que las organizaciones puedan cumplir con los requisitos de residencia de datos y escalar según sea necesario sin comprometer la funcionalidad. Los precios comienzan en 500 USD al mes para el plan Essentials y 6 000 USD por instancia para el plan Standard. También está disponible una prueba gratuita de 30 días para quienes deseen explorar las capacidades de la plataforma.

Prefect adopta un enfoque dinámico de los flujos de trabajo de IA al aprovechar el flujo de control nativo de Python en lugar de confiar en los DAG estáticos. Esta flexibilidad permite tomar decisiones en tiempo de ejecución, en las que los agentes de IA pueden ajustar los procesos sobre la marcha mediante construcciones estándar de Python, como si/si no declaraciones y mientras bucles. Esta adaptabilidad garantiza que los flujos de trabajo respondan de manera inteligente a medida que se ejecutan, lo que mejora la eficiencia. Lanzada en 2024, Prefect 3.0 redujo los gastos de ejecución hasta en un 90%, lo que la convirtió en una de las plataformas más eficientes para gestionar los flujos de trabajo de la IA.

Prefect se integra perfectamente con herramientas como IA pydántica y Gráfico de largo, lo que dota a los agentes de potentes funciones, como los reintentos automáticos y la observabilidad a nivel de tareas. A través de MCP rápido, la plataforma utiliza el protocolo Model Context para proporcionar contexto a los sistemas de IA de producción y garantizar una integración fluida. Además, la capacidad de Prefect para almacenar en caché las respuestas de LLM ayuda a mantener el estado de los agentes durante los fallos y reduce los costos de las API.

Andrew Waterman, ingeniero de aprendizaje automático, destacó su eficacia:

«Utilicé el ajuste de hiperparámetros paralelizado con Prefect y Dask para realizar 350 experimentos en 30 minutos; normalmente habría llevado 2 días».

Aplicación CashEl equipo de aprendizaje automático pasó de Airflow a Prefect, alegando su excelente seguridad y su proceso de adopción fácil de usar. Prefect también incorpora una funcionalidad que permite detener los flujos de trabajo para obtener aprobaciones manuales mediante formularios de interfaz de usuario generados automáticamente. Esta función es particularmente valiosa para el cumplimiento y la retroalimentación en los sistemas de IA.

Con 6 millones de descargas mensuales y una comunidad de 30 000 ingenieros, Prefect ha tenido un impacto sustancial en la automatización del flujo de trabajo de la IA. Por ejemplo, Snorkel AI vio un Aumento de 20 veces en el rendimiento mediante el uso de Prefect para el procesamiento asincrónico, lo que permite más de 1000 flujos por hora y decenas de miles de ejecuciones diarias. Smit Shah, director de ingeniería de Snorkel AI, lo describió así:

«nuestro caballo de batalla para el procesamiento asincrónico: una navaja suiza».

Del mismo modo, Endpoint informó de un Reducción del 73,78% en los costos de facturación tras pasar de ser Astronomer a Prefect y, al mismo tiempo, triplicar su producción. Estos resultados subrayan la capacidad de Prefect para gestionar flujos de trabajo automatizados a gran escala con eficiencia y precisión.

Prefect emplea una arquitectura híbrida: su plano de control funciona en Prefect Cloud, mientras que la ejecución del código y los datos permanecen dentro de su infraestructura segura. Este diseño es ideal para industrias con requisitos de seguridad estrictos, ya que mantiene los datos confidenciales detrás del firewall y aprovecha la nube para la administración. Las opciones de implementación incluyen Kubernetes, Docker, AWS ECS y plataformas sin servidor como Google Cloud Run.

Para equipos más pequeños o usuarios individuales, Prefect ofrece un nivel gratuito con soporte para 2 usuarios y 5 despliegues. También hay disponible una versión de código abierto con la licencia Apache 2.0 para autohospedaje. Los usuarios empresariales pueden acceder a funciones avanzadas, como el control de acceso basado en roles (RBAC), la integración del SSO, los registros de auditoría y el SCIM para el aprovisionamiento automatizado de equipos.

SuperAGI deja una fuerte impresión en el ámbito de las soluciones de flujo de trabajo de IA al aprovechar los agentes autónomos. Es un marco de código abierto diseñado para implementar varios agentes de IA a escala. A diferencia de las herramientas que se centran en los flujos de trabajo de un solo modelo, SuperAGI coordina redes de agentes especializados para gestionar tareas complejas de varios pasos con una intervención humana mínima.

Una característica destacada de SuperAgi es su Gestor de herramientas, que conecta a los agentes con plataformas como GitHub, Google Search, Slack y varias bases de datos. Esta configuración permite una interacción fluida entre varios modelos lingüísticos extensos (LLM), como los sistemas basados en el GPT, lo que permite a los agentes elegir el mejor modelo para cada tarea. Esta capacidad multimodelo garantiza operaciones fluidas y autónomas.

SuperAGI se destaca en la automatización de las tareas empresariales al permitir que los agentes trabajen de forma autónoma, delegando y supervisando las tareas de forma eficaz. Esto se alinea con la tendencia creciente de la IA mediante agencias, en la que los sistemas van más allá de la simple automatización para ejecutar flujos de trabajo complejos basados en los resultados. Pueden planificar y completar procesos de varios pasos en diferentes plataformas. En particular, Flujos de trabajo impulsados por IA se espera que se expandan significativamente, pasando del 3% al 25% de los procesos empresariales para finales de 2025.

Como plataforma de código abierto, SuperAGI brinda flexibilidad a las organizaciones para autohospedar el sistema en su propia infraestructura. Para las empresas con experiencia técnica, esto significa evitar los costos asociados a las soluciones propietarias y, al mismo tiempo, obtener la capacidad de personalizar la plataforma en gran medida. Este enfoque es ideal para las empresas que buscan un control total sobre sus sistemas y datos de inteligencia artificial, ya que ofrece una mayor rentabilidad y privacidad.

Al elegir la solución adecuada, es fundamental evaluar la interoperabilidad, las opciones de implementación y las capacidades de automatización. La siguiente tabla ofrece una comparación en paralelo de estas plataformas y destaca sus principales características y puntos fuertes.

Cada plataforma tiene sus propias ventajas únicas, lo que la hace adecuada para casos de uso específicos:

«El flujo de aire ya no era viable para los flujos de trabajo de aprendizaje automático. Necesitábamos seguridad y facilidad de adopción; Prefect nos dio ambas».

Prefect también minimiza los costos al almacenar en caché los resultados para evitar llamadas redundantes a la API. Mientras tanto, IBM watsonx Orchestrate aprovecha Kubernetes para escalar los recursos en tiempo real, y Prompts.ai integra los controles de FinOps para optimizar el gasto, lo que podría aumentar el ROI hasta en un 60%.

La elección de la plataforma de orquestación del flujo de trabajo adecuada puede marcar la diferencia a la hora de ampliar las iniciativas de IA y ofrecer un valor empresarial medible. El éxito de un proyecto de IA suele depender de factores clave como la interoperabilidad, la gobernanza y la gestión de costes. Las plataformas que conectan sin problemas modelos, fuentes de datos y sistemas empresariales ayudan a los equipos a superar los experimentos aislados y pasar a flujos de trabajo inteligentes y totalmente integrados.

El cambio hacia la orquestación adaptativa y en tiempo real es cada vez más vital para las operaciones modernas de IA. A medida que la IA de agencia adquiere más protagonismo, las herramientas de orquestación deben evolucionar para permitir la toma de decisiones en tiempo real, en lugar de depender de una automatización rígida y preprogramada. Los sistemas que asignan los recursos de forma dinámica y, al mismo tiempo, garantizan controles de cumplimiento centralizados proporcionan una base sólida para una escalabilidad responsable. Muchas organizaciones que implementan estos flujos de trabajo reportan ganancias significativas en la eficiencia, y algunos equipos ahorran cientos de horas cada mes gracias a la automatización.

Dado que el 92% de los ejecutivos predice que sus flujos de trabajo estarán digitalizados e impulsados por la IA para 2025, ha llegado el momento de crear un marco escalable. Las empresas que invierten en marcos de orquestación han registrado una mejora de la rentabilidad de las inversiones en IA de hasta un 60%, lo que pone de manifiesto el claro valor de las operaciones coordinadas de IA.

Para empezar, céntrese en poner a prueba un flujo de trabajo de alto impacto, como el enrutamiento de clientes potenciales, la incorporación de clientes o la gestión de la infraestructura. Busque plataformas centradas en las API que incorporen puntos de control independientes y proporcionen métricas claras, como el ahorro de horas o el coste por tarea. Tenga en cuenta que los datos limpios y estandarizados son fundamentales, ya que la mala calidad de los datos puede socavar incluso los mejores sistemas de orquestación.

La plataforma adecuada tiene el poder de transformar la colaboración, optimizar la integración de modelos y maximizar el ROI. Seleccione una solución que se adapte a sus necesidades de implementación, requisitos técnicos y objetivos de crecimiento a largo plazo. Al priorizar la interoperabilidad, la gobernanza y la rentabilidad, sentará las bases para un éxito sostenido de la IA.

Las plataformas de orquestación de flujos de trabajo de IA simplifican la administración de operaciones de IA complejas, al reunir tareas como las canalizaciones de datos, las implementaciones de modelos y la asignación de recursos en un sistema optimizado. Esta centralización no solo ahorra tiempo pero también reduce los costos automatizando los procesos repetitivos y optimizando el uso de los recursos en tiempo real.

Estas plataformas están diseñadas para gestionar el crecimiento de manera eficiente y, al mismo tiempo, mantener un alto nivel de seguridad. Garantizan un rendimiento fluido sin necesidad de integraciones complicadas. Funciones como la supervisión integrada y la gestión de errores añaden otra capa de fiabilidad, lo que ayuda a minimizar los errores y a mantener los flujos de trabajo funcionando sin problemas. ¿El resultado? Implementaciones más rápidas, presupuestos controlados y un marco fiable para ampliar las iniciativas de IA en toda la organización.

Las plataformas de orquestación de IA aumentan el ROI al automatizar y ajustar los flujos de trabajo de IA, lo que reduce considerablemente el tiempo y los recursos necesarios para el desarrollo y las operaciones. Las empresas pueden reducir los costos de los modelos y la infraestructura de inteligencia artificial (potencialmente hasta un 98%) y, al mismo tiempo, mejorar la eficiencia, la escalabilidad y la supervisión.

Al simplificar los procesos complejos y permitir una integración fluida, estas plataformas permiten a las empresas concentrarse en la innovación y las iniciativas estratégicas, lo que allana el camino para una mayor rentabilidad y un crecimiento sostenible.

Al elegir una plataforma de orquestación de IA, concéntrese en integración y compatibilidad. La plataforma debería vincular sin esfuerzo grandes modelos lingüísticos, herramientas de datos y procesos de aprendizaje automático, lo que permitiría que los flujos de trabajo se ejecuten sin problemas sin la molestia de saltar de un sistema a otro.

Presta atención a escalabilidad y transparencia de costos. Opte por un modelo de precios que se adapte a su uso, como el pago por uso, para gestionar los costes de forma eficaz. La plataforma también debería admitir todo tipo de tareas, desde tareas más pequeñas hasta operaciones complejas y a gran escala, garantizando que pueda evolucionar a la par de tus necesidades.

Igualmente importantes son seguridad y fiabilidad. Busque funciones como la autenticación sólida, los controles de acceso basados en roles y el cumplimiento de las normas de privacidad de datos. Herramientas como la supervisión en tiempo real, la gestión automatizada de errores y las interfaces fáciles de usar pueden facilitar la adopción de la plataforma y garantizar un funcionamiento fluido para los equipos con diferentes conocimientos técnicos.