Les systèmes de flux de travail basés sur l'IA en 2026 redéfinissent la façon dont les entreprises gèrent l'automatisation et rationalisent les opérations. L'accent a été mis sur des plateformes centralisées qui réduisent la prolifération des outils, améliorent l'interopérabilité et simplifient les processus complexes. Les principales avancées incluent la création de flux de travail en langage naturel, des capacités d'autoréparation et des outils de gouvernance robustes. Que vous soyez un utilisateur non spécialisé ou un développeur, il existe une solution adaptée à vos besoins.

Ces plateformes transforment l'automatisation en proposant des outils répondant à des besoins à la fois simples et complexes. Qu'il s'agisse d'automatiser des tâches, d'intégrer des API ou de gérer des flux de travail à l'échelle de l'entreprise, ces systèmes fournissent les outils nécessaires pour gagner du temps, réduire les coûts et garantir la conformité.

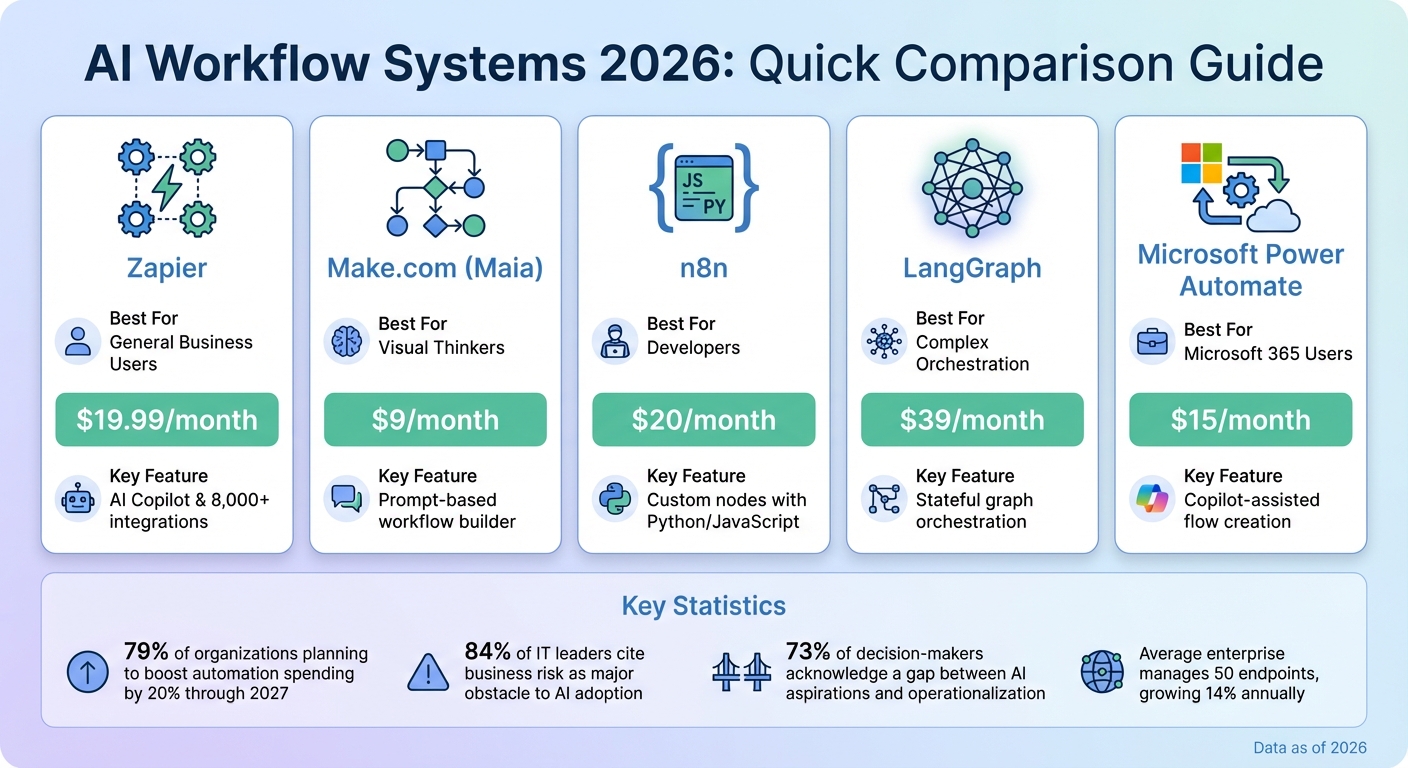

Comparaison des systèmes de flux de travail IA 2026 : fonctionnalités, prix et meilleurs cas d'utilisation

Les progrès du traitement du langage naturel permettent désormais de créer des flux de travail complets à l'aide d'une simple invite. Des outils tels que AI Copilot de Zapier et le prochain « Maia » de Make.com (dont le lancement est prévu pour 2026) permettent aux utilisateurs de décrire leurs besoins dans un anglais simple, et le système fait le reste. Par exemple, vous pouvez dire à Maia : « Créez un routeur principal qui vérifie LinkedIn », et il générera instantanément un graphique de flux de travail entièrement fonctionnel en 15 modules. De même, Zapier prend en charge plus de 8 000 intégrations d'applications et permet aux utilisateurs de taper des instructions telles que « Résumez chaque nouveau prospect de mon site Web et publiez-le sur Slack », créant ainsi la chaîne logique en quelques minutes seulement.

« L'IA conversationnelle « Maia » de Make.com crée des scénarios pour vous. Dites-lui « Construisez un routeur principal qui vérifie LinkedIn » et Maia générera instantanément le graphique à 15 modules. »

— Digital Applied

Microsoft Power Automate propose également la création de flux assistée par CoPilot, avec plus de 1 000 connecteurs prédéfinis conçus pour être faciles à utiliser, ce qui en fait une option accessible pour les débutants.

Pour simplifier davantage l'automatisation, ces outils sont associés à des modèles prédéfinis et à des interfaces conviviales.

Outre les générateurs de langage naturel, les interfaces glisser-déposer ont évolué pour gérer des tâches plus complexes, allant au-delà de la logique de base du « si-alors ». Par exemple, Lindy.ai propose plus de 4 000 intégrations et une variété de modèles prédéfinis adaptés à des secteurs tels que la finance et la santé. Leur plan Pro commence à 39,99$ par mois. De même, « Gummie » de Gumloop fait office d'assistant IA, guidant les utilisateurs tout au long des flux de travail marketing et commerciaux à l'aide de modèles prêts à l'emploi.

L'intégration des points de contrôle « human in-the-loop » (HITL) constitue une amélioration notable. Ils permettent aux utilisateurs non techniques de configurer des étapes d'approbation dans le cadre de processus automatisés. L'IA gère l'extraction, le routage et le formatage des données, mais fait une pause pour permettre à un humain de les examiner avant de finaliser les tâches, ce qui permet aux utilisateurs de garder le contrôle sans avoir besoin de compétences techniques avancées.

Alors que les outils conviviaux rendent la création de flux de travail accessible à un public plus large, les solutions axées sur les développeurs offrent la précision nécessaire pour des intégrations plus complexes.

Pour les développeurs qui souhaitent aller au-delà des modèles standard, des plateformes telles que n8n et Griptape autoriser la création de nœuds personnalisés à l'aide de Python ou JavaScript. Cela permet une intégration fluide d'API propriétaires, de bases de données et de modèles d'IA complexes dans les flux de travail. Griptape, en particulier, est conçu pour les extensions, permettant aux développeurs d'adapter les nœuds aux outils, API et processus spécifiques de leur équipe.

Les nœuds personnalisés peuvent également inclure une logique de validation pour détecter les erreurs potentielles avant l'exécution, réduisant ainsi le risque de défaillances en cours de processus. Pour rationaliser le développement, les guides de nœuds s'intègrent désormais à des outils de codage d'IA tels que Curseur, Claude Code, et Copilote GitHub, traduisant les descriptions en langage naturel en code fonctionnel. Les prix de ces plateformes varient : n8n commence à 20$ par mois pour l'hébergement dans le cloud (avec une option d'auto-hébergement gratuite), tandis que Chaîne Lang propose des plans pour développeurs à 39$ par siège et par mois.

Ces solutions flexibles ont ouvert la voie à des outils encore plus avancés adaptés aux développeurs qui gèrent des flux de travail complexes.

Les outils de débogage avancés vont encore plus loin dans la personnalisation, en donnant aux développeurs la possibilité d'affiner et d'optimiser les flux de travail. Des plateformes telles que LangGraph et Temporel fournissent une orchestration dynamique des graphes, spécialement conçue pour les développeurs. Ces systèmes prennent en charge les graphes orientés avec des cycles, des branchements conditionnels et une exécution parallèle, ce qui est essentiel pour les agents d'IA qui nécessitent un état persistant, même lors d'interactions humaines prolongées.

L'une des fonctionnalités phares de 2026, « AI Thought Debuggers », fait déjà sensation. Des outils tels que LangGraph Studio et Lang Smith offrent un traçage en temps réel, des mesures de latence et un débogage temporel, offrant aux développeurs une visibilité inégalée sur leurs flux de travail.

« La caractéristique la plus importante pour 2026 est l'observabilité. Une plateforme d'orchestration est inutile sans un « Debugger for AI Thoughts ». »

— Digital Applied

En outre, Ollama prend en charge l'intégration locale de modèles open source tels que GPT-OSS 20B, offrant une meilleure confidentialité des données et des économies pour les développeurs qui ont besoin de solutions personnalisées.

À mesure que les systèmes d'entreprise arrivent à maturité, la nécessité d'une supervision centralisée et d'une gouvernance efficace devient de plus en plus cruciale. La transition des prototypes à la production exige un équilibre entre le maintien du contrôle des flux de travail de l'IA et la promotion de l'innovation. Le succès de ces déploiements repose souvent sur deux fonctionnalités clés.

Les entreprises d'aujourd'hui gèrent généralement une cinquantaine de terminaux, un chiffre qui augmente de 14 % chaque année. Pour garder une longueur d'avance, les principales plateformes d'orchestration de l'IA disposent désormais de centres de contrôle unifiés qui fournissent une surveillance en temps réel de l'état des clusters de calcul et des informations détaillées sur les coûts. Cette approche centralisée répond à un défi pressant : 73 % des décideurs reconnaissent qu'il existe un écart important entre leurs aspirations en matière d'IA et leur capacité à les mettre en œuvre de manière efficace.

En outre, l'adoption de modèles de tarification basés sur l'exécution offre aux entreprises une plus grande prévisibilité dans la gestion des coûts par rapport aux structures traditionnelles basées sur les activités. Alors que 79 % des organisations prévoient d'augmenter leurs dépenses d'automatisation de 20 % en moyenne d'ici 2027, disposer d'une visibilité financière claire n'est plus une option. Les tableaux de bord modulaires qui suivent l'utilisation des jetons et les heures de calcul sont désormais des outils essentiels pour éviter les dépenses excessives et garantir le respect des budgets. En consolidant le contrôle, les entreprises peuvent renforcer leurs capacités d'exécution et améliorer leur transparence opérationnelle.

Pour les systèmes d'entreprise, il est crucial de maintenir une exécution continue sur de longs flux de travail, que ce soit en cas de retards liés à des approbations humaines ou d'interruptions telles que le redémarrage des serveurs. Cette résilience est particulièrement importante étant donné que 84 % des responsables informatiques citent le risque commercial comme un obstacle majeur à l'adoption de l'IA sans la mise en place de garanties appropriées.

Les cadres de gouvernance modernes donnent la priorité à une observabilité complète, en proposant des fonctionnalités telles que le débogage temporel et la traçabilité en temps réel pour établir des pistes de décision claires et vérifiables. Les plateformes avancées font de l'observabilité un atout de conformité en intégrant ces outils à la rédaction automatisée des informations personnelles et au cryptage AES-256. Ces mesures garantissent le respect des réglementations telles que le RGPD, l'HIPAA et le SOC 2, offrant aux organisations à la fois la sécurité opérationnelle et la tranquillité d'esprit réglementaire.

Ces exemples montrent comment les plateformes de flux de travail basées sur l'IA sont adaptées pour répondre aux demandes uniques de secteurs spécifiques, améliorer l'efficacité et résoudre des défis complexes.

Les systèmes de santé utilisent de plus en plus des flux de travail d'IA avancés pour gérer les tâches critiques. En janvier 2026, Anthropic a introduit Claude pour la santé et les sciences de la vie, tirant parti du modèle Claude Opus 4.5 d'une capacité étendue pouvant atteindre 64 000 jetons. Cet outil traite de grands volumes de dossiers médicaux tout en préservant précision et clarté. Il réduit considérablement le temps nécessaire aux tâches administratives telles que les autorisations préalables et les recours en matière de réclamations, rationalisant ainsi des processus qui prenaient auparavant beaucoup de temps.

Pour la prise de décisions cliniques, le Orchestrateur d'agents de santé, propulsé par Azure AI Foundry, est devenu un outil précieux pour des institutions de premier plan telles que Stanford Medicine et Johns Hopkins. Il intègre des données issues de la pathologie, de l'imagerie et de la génomique pour prendre en charge des flux de travail complexes tels que les conseils multidisciplinaires sur les tumeurs. En orchestrant plusieurs agents d'IA, cette plateforme réduit le temps d'analyse manuelle de plusieurs heures à quelques minutes seulement. Cela est particulièrement important, car 90 % des organisations de santé ont du mal à intégrer l'IA dans leurs systèmes. Le succès de ces plateformes reflète une tendance générale à l'adoption de l'IA dans tous les secteurs.

Dans le secteur financier, les systèmes d'IA sont utilisés pour améliorer les processus de conformité et réduire la fraude. Sensa Risk Intelligence de SymphonyAI La plateforme emploie des « agents Sensa » pour automatiser des tâches telles que la lutte contre le blanchiment d'argent (AML) et le filtrage des sanctions. La plateforme fournit une explicabilité en langage naturel et une auditabilité complète. Une grande institution financière américaine a fait état d'une réduction de 99 % des faux positifs et d'une diminution de 90 % des tâches manuelles liées à la conformité aux sanctions. De même, Absa Bank a réussi à réduire de 77 % le nombre de faux positifs dans le cadre de sa surveillance des transactions de lutte contre le blanchiment d'argent.

Pour traiter des données financières non structurées, des plateformes telles que Étendre et Ocrolus ont transformé les opérations. Ces outils traitent des documents tels que les demandes de prêt, les relevés bancaires et les chèques manuscrits en données structurées en quelques millisecondes, avec une précision élevée. LendingClub, par exemple, a noté que l'utilisation d'Ocrolus avait accéléré son processus de demande de prêt à la consommation, améliorant ainsi les taux de conversion. Ces systèmes utilisent souvent des flux de travail « maker-checker », dans lesquels plusieurs agents d'IA valident le travail de chacun. Cela garantit que les décisions sont à la fois rapides et fiables, répondant aux exigences rigoureuses de la fintech tout en maintenant la responsabilité.

Pour sélectionner le bon système de flux de travail basé sur l'IA, vous devez l'aligner sur les compétences et les objectifs opérationnels de votre équipe. Pour les équipes non techniques, des plateformes sans code comme Zapier, qui s'intègre à plus de 8 000 applications, offre simplicité et accessibilité. D'autre part, les équipes orientées vers les développeurs peuvent trouver des outils tels que LangGraph ou n8n plus adapté, en particulier pour gérer des processus complexes en plusieurs étapes où la tarification basée sur l'exécution peut réduire les coûts. Pour les organisations qui gèrent des flux de travail critiques, des plateformes telles que Temporel - utilisés par OpenAI pour le Codex - sont indispensables, offrant une exécution durable pour maintenir la persistance de l'état pendant les cycles d'approbation prolongés ou les interruptions du serveur.

L'un des principaux facteurs de différenciation entre les configurations expérimentales et les systèmes prêts à la production est observabilité, ce qui réduit le temps de débogage et garantit des opérations plus fluides. Pour les entreprises, des fonctionnalités telles que contrôle d'accès basé sur les rôles, pistes d'audit, et Conformité SOC 2 ne sont pas facultatifs : ils sont essentiels pour faire évoluer les opérations en toute sécurité. En outre, le Protocole d'agent LangGraph est en train de devenir une norme importante, permettant aux agents de différents frameworks de communiquer de manière fluide via des API standardisées, garantissant ainsi une adaptabilité à mesure que l'écosystème évolue.

Lors de la mise à l'échelle, il est judicieux de commencer par des flux de travail à agent unique avant de passer à des systèmes multi-agents, ce qui peut augmenter considérablement les coûts liés au débogage et aux API. L'intégration précoce de couches d'abstraction dans votre architecture permet de gagner en flexibilité, ce qui permet de changer plus facilement de framework à l'avenir sans avoir à reconstruire l'ensemble de votre système. La mise en œuvre d'outils d'observabilité, tels que la journalisation et la surveillance structurées, dès le départ peut permettre d'éviter des problèmes de production coûteux par la suite.

En fin de compte, le choix de la plateforme doit refléter vos besoins actuels tout en soutenant la croissance future. Pour les développeurs Python, LangGraph est un ajustement solide ; n8n fonctionne bien pour les équipes des opérations informatiques, tandis que Zapier s'adresse aux utilisateurs professionnels. Évaluez soigneusement l'expertise technique, les limites budgétaires et les exigences de conformité de votre organisation. Le système que vous choisissez aujourd'hui jouera un rôle central dans l'efficacité avec laquelle vous pourrez déployer des flux de travail pilotés par l'IA dans les années à venir.

Les générateurs de flux de travail en langage naturel facilitent l'automatisation en permettant aux utilisateurs de concevoir et de gérer des flux de travail en langage clair plutôt qu'en utilisant un codage complexe. Ces outils prennent des descriptions de tâches simples et les convertissent en flux de travail fonctionnels, ouvrant ainsi l'automatisation à un public plus large que les développeurs.

Cette méthode réduit la dépendance vis-à-vis des équipes informatiques, accélère le déploiement de l'automatisation et permet aux utilisateurs de se concentrer sur l'obtention de résultats, tels que la configuration d'un chatbot ou l'automatisation de tâches de reporting répétitives, sans nécessiter de compétences en codage. En éliminant les obstacles techniques, ces outils invitent davantage de personnes à participer à des efforts d'automatisation et stimulent la créativité au sein des organisations.

Les plateformes de flux de travail d'IA conçues pour les développeurs en 2026 visent à faciliter la gestion des processus complexes et à améliorer l'efficacité globale. Ces plateformes se concentrent sur automatisation, orchestration, et intégration, aidant les développeurs à gérer les modèles, les ensembles de données et les outils d'IA sans friction inutile. En tirant parti des graphes acycliques orientés (DAG), ils organisent les tâches de manière à garantir une exécution plus fluide et une meilleure gestion des erreurs, ce qui en fait une solution idéale pour les flux de travail à grande échelle.

L'automatisation des tâches répétitives, telles que le prétraitement et le déploiement des données, constitue une caractéristique remarquable. Cela permet aux développeurs de consacrer leur temps à la résolution de problèmes plus avancés. Ces plateformes mettent également l'accent compatibilité avec une large gamme d'outils d'IA, offrent de solides sécurité protocoles et répondent aux normes industrielles telles que SOC 2 Type II et HIPAA. En outre, ils fournissent des outils pour le suivi des coûts et la gestion des ressources en temps réel, garantissant ainsi l'efficacité et la conformité des opérations.

En substance, ces plateformes sont conçues pour répondre facilement aux demandes au niveau de l'entreprise, offrant évolutivité, adaptabilité, et sécurité nécessaires pour optimiser les pipelines d'IA dans des environnements complexes.

L'observabilité joue un rôle clé dans la gestion des flux de travail d'IA à grande échelle, permettant une surveillance et un débogage fluides et garantissant la fiabilité. À mesure que les systèmes d'IA deviennent plus sophistiqués et prennent en charge des tâches complexes, telles que la coordination de plusieurs modèles ou la gestion d'appels d'API externes, l'observabilité devient cruciale pour détecter les problèmes, évaluer les performances et maintenir l'efficacité des opérations.

De puissants outils d'observabilité permettent aux organisations d'identifier rapidement les défaillances, d'évaluer l'efficacité des instructions d'IA et de résoudre les problèmes au fur et à mesure qu'ils surviennent. Cela conduit à des processus pilotés par l'IA plus fiables et plus efficaces, même à l'échelle de l'entreprise.