Prompts.ai, Plateforme B, et Plateforme C sont trois plateformes clés qui façonnent actuellement les flux de travail d'apprentissage automatique (ML) pour les entreprises américaines. Chaque plateforme répond à des défis tels que l'intégration de grands modèles linguistiques (LLM), la gestion des coûts et la garantie de la conformité à des réglementations strictes. Voici un résumé rapide :

Comparaison rapide:

Pour les entreprises qui font évoluer l'IA, Prompts.ai offre une orchestration rationalisée et une rentabilité, Plateforme B met l'accent sur la simplicité, et Plateforme C offre une flexibilité hybride. Choisissez en fonction de la taille de votre organisation, de ses besoins en matière de conformité et de ses préférences en matière d'infrastructure.

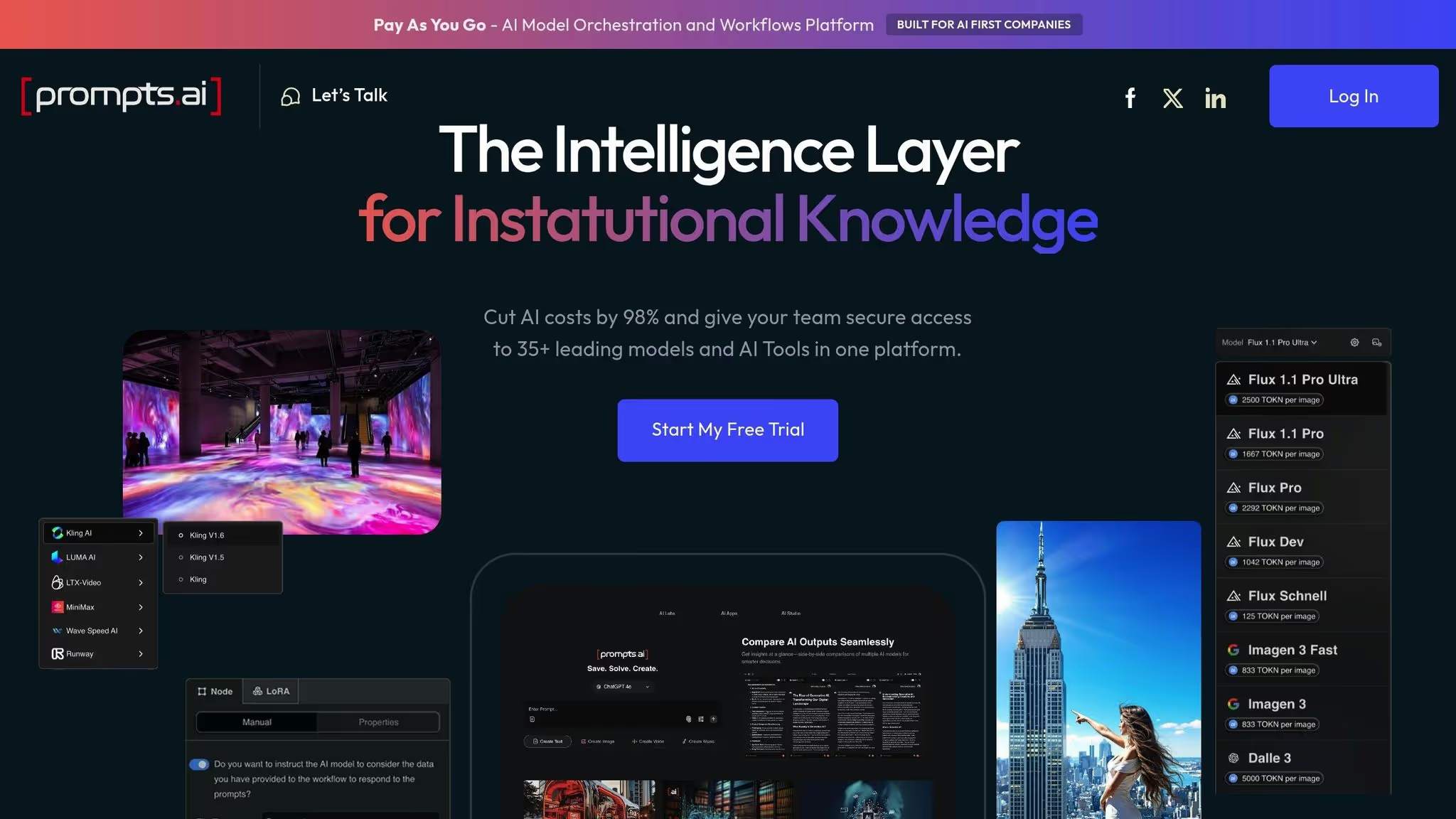

Prompts.ai est un plateforme d'orchestration de l'IA au niveau de l'entreprise conçu pour relever les défis auxquels les entreprises américaines sont confrontées lors de la mise à l'échelle des flux de travail d'apprentissage automatique. En consolidant plus de 35 grands modèles linguistiques (LLM) de premier plan, dont GPT-5, Claude, Lama, et Gemini : dans une interface sécurisée, il élimine le chaos lié à la jonglerie entre plusieurs outils. Cette approche rationalisée garantit une intégration fluide, une supervision claire des coûts, des mesures de conformité strictes et des capacités de performance qui répondent aux exigences de l'adoption moderne de l'IA.

L'une des fonctionnalités les plus remarquables de Prompts.ai est sa intégration parfaite avec les principaux LLM. Grâce à des connecteurs intégrés et à la prise en charge des API, les utilisateurs peuvent facilement se connecter à des modèles tels que IA ouvertes GPT-4, celui de Google PalM, et Claude d'Anthropic. Cela permet aux entreprises de gérer rapidement les flux de travail d'ingénierie, de chaînage et de réglage directement au sein de la plateforme. Le passage d'un fournisseur à l'autre devient un jeu d'enfant, ce qui permet d'éviter les blocages ou les complications techniques.

Par exemple, une équipe marketing peut utiliser la plateforme pour automatiser la création de contenu en enchaînant les invites sur plusieurs LLM, en équilibrant créativité et conformité. En outre, Prompts.ai permet comparaisons côte à côte des performances des modèles, en aidant les équipes à choisir le meilleur LLM pour des tâches spécifiques, le tout sans quitter la plateforme. Cette fonctionnalité simplifie non seulement la prise de décision, mais s'inscrit également dans la focalisation de la plateforme sur la gestion des coûts en temps réel.

Les coûts imprévisibles de l'IA constituent un défi courant pour les entreprises américaines, et Prompts.ai y remédie grâce à son outils de suivi des coûts en temps réel. La plateforme propose un tableau de bord complet qui surveille l'utilisation des API, les coûts d'inférence des modèles et la consommation de ressources au niveau du projet et de l'organisation, tous les coûts étant affichés dans DOLLAR AMÉRICAIN pour plus de clarté. Les utilisateurs peuvent définir des alertes budgétaires et recevoir des suggestions personnalisées pour optimiser l'efficacité rapide.

Par exemple, un responsable de la science des données peut suivre l'utilisation mensuelle de LLM, définir un Limite budgétaire de 1 000$, et soyez averti si les dépenses devraient dépasser ce seuil. La plateforme Crédits TOKN payables à l'utilisation le système élimine le besoin de frais d'abonnement récurrents, alignant les coûts sur l'utilisation réelle. Cette approche peut réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %, ce qui en fait une solution rentable pour les entreprises qui souhaitent maximiser leurs investissements dans l'IA.

Pour les secteurs soumis à des exigences réglementaires strictes, Prompts.ai propose outils de gouvernance avancés pour garantir le respect de normes telles que SOC 2, HIPAA et RGPD. La plateforme fournit également des options de résidence des données et crypte les informations sensibles pour protéger les données des utilisateurs.

Les principales caractéristiques de gouvernance incluent contrôle d'accès basé sur les rôles (RBAC), des journaux d'audit détaillés et des systèmes d'approbation des flux de travail. Par exemple, un établissement de santé peut restreindre l'accès aux flux de données des patients, en veillant à ce que seul le personnel autorisé puisse apporter des modifications, chaque action étant enregistrée à des fins d'audit.

Prompts.ai donne la priorité à la sécurité en surveillant en permanence son cadre et a lancé son Audit SOC 2 de type 2 le 19 juin 2025. Les entreprises peuvent accéder au Trust Center de la plateforme à l'adresse trust.prompts.ai pour consulter les mises à jour en temps réel sur les politiques de sécurité, les contrôles et les mesures de conformité. Grâce à ces fonctionnalités robustes, la plateforme permet aux entreprises de répondre aux exigences réglementaires tout en maintenant leur efficacité opérationnelle.

Construit sur un architecture distribuée native pour le cloud, Prompts.ai est conçu pour gérer des opérations à grande échelle. Ses capacités de dimensionnement horizontal lui permettent de gérer des milliers de flux de travail simultanés, les ressources étant automatiquement mises à l'échelle en fonction de la demande. Cela garantit des performances à faible latence et une haute disponibilité, même pour les entreprises internationales.

Par exemple, une entreprise mondiale de commerce électronique utilisant Prompts.ai peut servir des millions de clients en temps réel sans subir de ralentissement de ses performances. Cette évolutivité rend la plateforme idéale pour les entreprises du Fortune 500 tout en restant accessible aux petites organisations qui se préparent à se développer.

La plateforme améliore également la collaboration en équipe grâce à des espaces de travail partagés, au contrôle des versions et à des fils de commentaires. Les analystes commerciaux peuvent concevoir des flux de travail, les data scientists peuvent affiner les instructions LLM et les responsables de la conformité peuvent consulter les journaux d'audit, le tout dans le même environnement. Ce cadre collaboratif garantit un travail d'équipe efficace entre les services, consolidant ainsi Prompts.ai en tant qu'outil puissant pour les entreprises de toutes tailles.

La plate-forme B propose une approche simplifiée de l'automatisation de base des flux de travail, mais elle est insuffisante lorsqu'il s'agit de gérer une logique avancée, des tests approfondis et un contrôle de version fiable. Alors que certaines plateformes excellent grâce à leurs intégrations étendues et à leur capacité à gérer des flux de travail complexes, la plate-forme B privilégie la facilité d'utilisation, ce qui limite naturellement sa flexibilité. Ce compromis met en évidence l'équilibre entre la simplicité et les fonctionnalités d'orchestration plus complexes que l'on trouve dans les solutions de flux de travail ML de premier plan. L'exploration de ces différences fournit des informations précieuses sur les forces et les limites de chaque plateforme.

La plate-forme C s'appuie sur les atouts de Prompts.ai et de la plate-forme B, offrant une solution qui équilibre performances et simplicité pour les opérations d'IA modernes. Conçu avec flexibilité de déploiement hybride et d'optimisation automatisée, il répond aux besoins des entreprises qui ont besoin de fonctionnalités à la fois cloud et sur site, tout en garantissant des opérations fluides et efficaces.

La plate-forme C utilise un architecture modulaire pour s'intégrer de manière transparente à plusieurs LLM, en prenant en charge à la fois des modèles basés sur le cloud et hébergés localement. Contrairement aux plateformes qui dépendent uniquement des connexions API, elle permet aux organisations d'héberger des modèles propriétaires ou affinés au sein de leur propre infrastructure. Cette fonctionnalité répond aux préoccupations relatives à la souveraineté des données, qui sont particulièrement pertinentes pour les institutions financières et les sous-traitants gouvernementaux américains.

La plateforme fonction de routage automatique dirige intelligemment les demandes vers le LLM le plus approprié en fonction de la complexité des tâches, des considérations de coût et des besoins de performance. Par exemple, des tâches plus simples telles que la classification peuvent être acheminées vers des modèles plus petits et rentables, tandis que les tâches plus exigeantes nécessitant un raisonnement avancé sont envoyées vers des options puissantes telles que GPT-4 ou Claude. Cette allocation intelligente des ressources permet de réduire les coûts sans sacrifier les performances.

Avec ses modélisation prédictive des coûts, la plate-forme C permet aux entreprises de prévoir les dépenses mensuelles en fonction de l'utilisation passée et des charges de travail prévues. Tous les coûts sont affichés dans DOLLAR AMÉRICAIN, avec des ventilations détaillées par modèle, département et projet. La plateforme moteur d'optimisation des coûts propose des suggestions pratiques pour ajuster les flux de travail et réduire les dépenses, tout en maintenant des résultats de haute qualité.

La plateforme C emploie un structure de prix à plusieurs niveaux, qui propose des remises sur volume aux entreprises clientes. Les entreprises peuvent obtenir des taux fixes pour une durée maximale de 12 mois, ce qui donne aux directeurs financiers la prévisibilité budgétaire dont ils ont besoin pour les initiatives d'IA. Les tableaux de bord en temps réel fournissent une visibilité sur les coûts par inférence, permettant ainsi aux équipes de prendre des décisions plus intelligentes concernant l'utilisation des modèles et l'allocation des ressources.

La conformité réglementaire est une priorité pour la Plateforme C, réalisée grâce à application automatisée des politiques et une surveillance continue. Il contient Certification SOC 2 type II et supports Autorisation FedRAMP, ce qui en fait un choix fiable pour les clients gouvernementaux. La plateforme signale de manière proactive les violations de conformité potentielles avant qu'elles ne se produisent, réduisant ainsi le recours aux audits post-incidents.

La sécurité est renforcée par un modèle Zero-Trust, chiffrant toutes les données en transit et au repos. Les contrôles d'accès basés sur les rôles s'intègrent parfaitement aux systèmes de gestion des identités d'entreprise existants. De plus, des pistes d'audit immuables enregistrent chaque action de l'utilisateur, garantissant ainsi la conformité aux réglementations strictes en matière de traitement des données dans des secteurs tels que la santé et la finance.

Grâce à ses architecture conteneurisée, la plate-forme C peut évoluer rapidement entre plusieurs fournisseurs de cloud ou systèmes sur site. Les ressources sont automatiquement ajustées pendant les pics de demande et réduites pendant les périodes les plus calmes, ce qui garantit à la fois les performances et la rentabilité. Cette élasticité permet aux entreprises de gérer différentes charges de travail liées à l'IA sans nécessiter d'ajustements manuels.

La collaboration est facilitée grâce à bibliothèques de modèles partagées, permettant aux équipes de publier et de réutiliser des modèles entraînés dans tous les services. La plateforme comprend un concepteur de flux de travail permettant aux utilisateurs professionnels de créer des processus d'IA à l'aide d'outils de glisser-déposer, tandis que les data scientists peuvent tirer parti de fonctionnalités de script avancées. Des fonctionnalités telles que le contrôle de version et la restauration garantissent des expériences sécurisées tout en préservant la stabilité de la production, permettant ainsi une orchestration fluide des flux de travail qu'exigent les opérations d'IA d'aujourd'hui.

Sur la base de l'analyse précédente de la plateforme, voici un bref aperçu des points forts et de l'une des principales limites de Prompts.ai.

Prompts.ai excelle dans la simplification des opérations d'IA en intégrant plus de 35 LLM de premier plan dans une interface unique et sécurisée. Il propose des prix clairs, des outils de gouvernance solides et un processus d'intégration facile, le tout soutenu par une communauté dynamique. Ces fonctionnalités en font un excellent choix pour les organisations qui souhaitent faire évoluer efficacement les flux de travail liés à l'IA. Cependant, étant donné que la plateforme est entièrement basée sur le cloud, elle peut ne pas convenir à ceux qui ont besoin d'un déploiement sur site.

Sur la base de l'analyse de l'intégration, de la gouvernance et de l'évolutivité, Prompts.ai apparaît comme une solution exceptionnelle pour les entreprises américaines qui souhaitent rationaliser leurs opérations d'IA. En réunissant plus de 35 LLM de premier plan au sein d'une interface unique et sécurisée, il répond efficacement aux défis liés à la gestion de plusieurs outils d'IA.

Pour les entreprises qui priorisent contrôle des coûts, le système de crédit TOKN par répartition de Prompts.ai peut réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %, garantissant ainsi aux entreprises de ne payer que pour ce qu'elles utilisent. Cette approche permet d'aligner les dépenses financières sur les besoins opérationnels réels, offrant ainsi une solution pratique pour gérer les budgets.

Les organisations opérant dans le cadre de cadres réglementaires stricts, comme celles des secteurs de la santé, de la finance ou des marchés publics, apprécieront les fonctionnalités prêtes à être auditées de la plateforme et ses protocoles de gouvernance robustes. Ces garanties garantissent le respect des exigences strictes en matière de sécurité et de transparence des données, offrant ainsi la tranquillité d'esprit dans les secteurs où la précision et la responsabilité sont essentielles.

Prompts.ai fournit également un tableau de bord FinOps en temps réel, offrant aux directeurs financiers et aux responsables informatiques une visibilité complète sur les dépenses liées à l'IA. Cet outil permet de prendre des décisions éclairées et fondées sur des données, garantissant un contrôle budgétaire strict, une nécessité pour les sociétés cotées en bourse et les grandes entreprises qui gèrent des environnements financiers complexes.

Bien que l'architecture exclusivement cloud de la plateforme ne convienne pas aux entreprises ayant des exigences strictes en matière de locaux, son infrastructure cloud évolutive et sécurisée répond aux besoins de la plupart des entreprises américaines. Sa capacité à intégrer rapidement de nouveaux modèles, de nouveaux utilisateurs et de nouvelles équipes en fait un excellent choix pour les entreprises en croissance rapide ou celles qui développent leurs initiatives d'IA. Avec Prompts.ai, les entreprises peuvent faire évoluer leurs opérations de manière efficace tout en maintenant le contrôle et la sécurité.

Prompts.ai simplifie la gestion des coûts des flux de travail liés à l'IA grâce à son Système de crédit TOKN - une monnaie unique et unifiée pour des services tels que la génération de texte, d'images et de vidéos. Cette configuration offre une transparence totale, permettant aux utilisateurs de surveiller chaque interaction tout en offrant des informations en temps réel sur l'utilisation, les dépenses et le retour sur investissement (ROI).

Pour les entreprises, le système de crédit TOKN simplifie la budgétisation et garantit un contrôle précis des coûts. Il aide les organisations à allouer les ressources de manière efficace, permettant ainsi une évolutivité sans risque de dépenses imprévues.

Prompts.ai donne la priorité à une protection rigoureuse des données en s'alignant sur les principales normes de conformité, notamment SOC 2 Type II, HIPAA, et GDPR. Cela garantit que la plateforme répond à des critères de sécurité élevés en matière de protection des informations sensibles.

Pour maintenir une sécurité continue, Prompts.ai s'appuie sur Vanta pour une surveillance continue de ses contrôles de sécurité. La plateforme a également lancé son Processus d'audit SOC 2 de type II le 19 juin 2025, renforçant ainsi son engagement à respecter des protocoles de conformité stricts.

Ces pratiques robustes font de Prompts.ai une solution fiable pour les secteurs soumis à des exigences réglementaires et de sécurité des données strictes.

Prompts.ai permet aux entreprises de travailler plus facilement avec plusieurs grands modèles de langage (LLM) en offrant une plate-forme permettant des comparaisons côte à côte faciles. Cette fonctionnalité permet aux équipes d'évaluer et de choisir les modèles les mieux adaptés à leurs besoins spécifiques, ce qui permet d'améliorer la productivité.

Grâce à sa plateforme conviviale, Prompts.ai rationalise les flux de travail liés à l'IA, aidant les équipes à faire évoluer leurs opérations d'apprentissage automatique de manière efficace, sans complications inutiles.