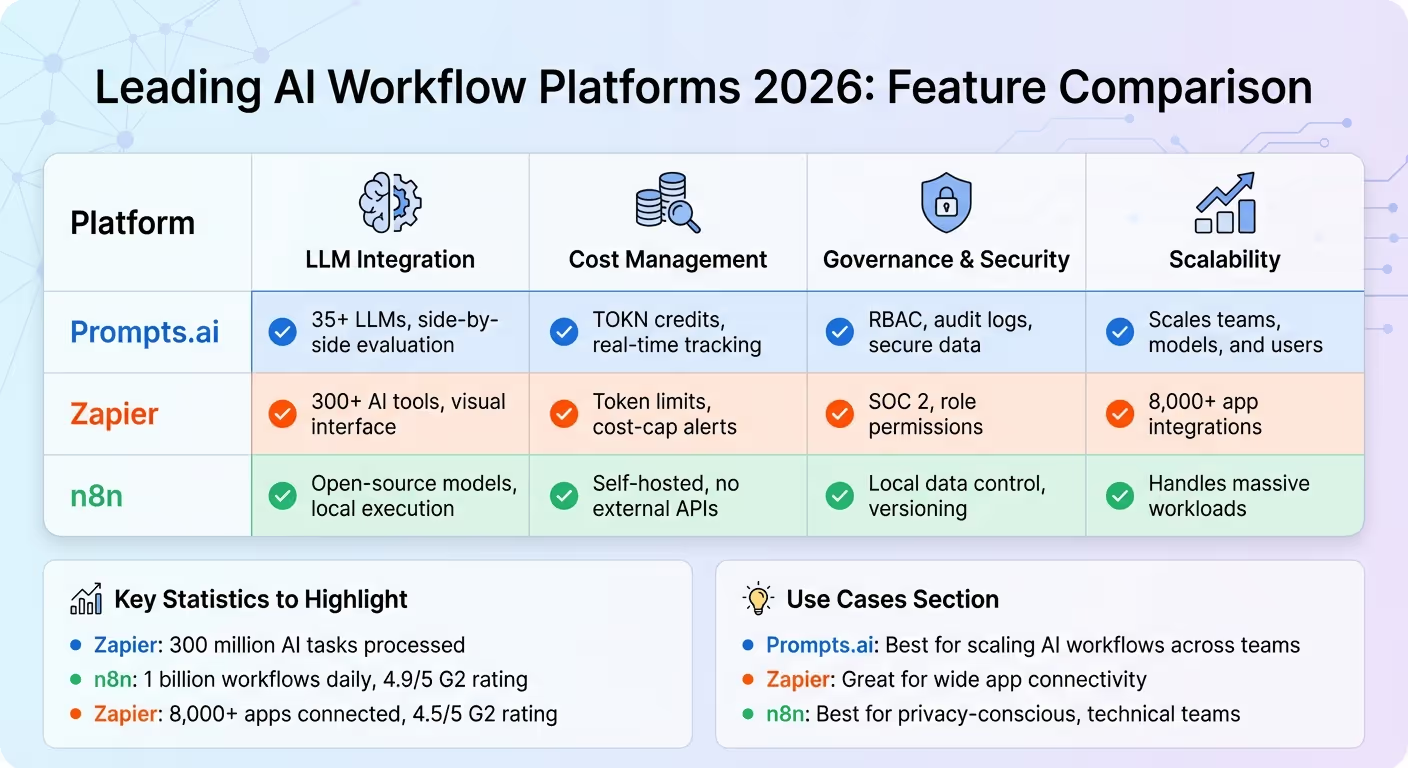

Les organisations se tournent de plus en plus vers les plateformes de flux de travail basées sur l'IA pour éliminer les inefficacités causées par des outils fragmentés et des systèmes déconnectés. Ces plateformes unifient différents grands modèles de langage (LLM), renforcent la gouvernance et optimisent les coûts, permettant aux entreprises de créer des flux de travail plus intelligents et plus efficaces. D'ici 2026, des outils tels que Prompts.ai, Zapier, et n8n mènent la course en aidant les équipes à gérer des milliers d'applications, à rationaliser les tâches d'IA et à faire évoluer les opérations de manière sûre et efficace. Voici un bref aperçu de ce qui les distingue :

Chaque plateforme répond à des besoins spécifiques, de la gestion des coûts à la gouvernance et à l'évolutivité. Vous trouverez ci-dessous une comparaison rapide pour vous aider à choisir celui qui convient le mieux à vos objectifs.

Ces plateformes transforment la façon dont les entreprises abordent l'IA, en simplifiant l'automatisation des tâches, en gagnant du temps et en réduisant les coûts. Approfondissez vos connaissances pour trouver la solution la mieux adaptée à votre équipe.

Comparaison des plateformes de flux de travail IA 2026 : fonctionnalités et capacités

Prompts.ai regroupe plus de 35 grands modèles de langage de premier plan, notamment GPT-5, Claude, Lama, Gémeaux, Grok-4, Flux Pro, et Kling - dans une interface sécurisée et rationalisée. Au lieu de jongler entre plusieurs abonnements et connexions, les équipes peuvent accéder à tous les principaux modèles en un seul endroit, simplifiant ainsi les flux de travail et réduisant les coûts. Cette plate-forme unifiée garantit que les tâches sont associées au modèle le mieux adapté, éliminant ainsi les tracas liés au passage d'un système déconnecté à un autre. En consolidant les outils, Prompts.ai renforce également les intégrations, améliore la gestion des coûts et renforce la sécurité.

L'architecture basée sur le langage naturel de la plateforme permet aux utilisateurs de créer et de déployer des flux de travail d'IA sans effort. Les équipes peuvent évaluer les résultats des modèles côte à côte en temps réel, qu'il s'agisse d'utiliser Claude pour une analyse approfondie des documents, GPT-5 pour un raisonnement avancé ou Gemini pour des tâches multimodales. Cette capacité d'adaptation permet aux organisations de rester agiles au fur et à mesure de l'introduction de nouveaux modèles. Ces intégrations s'inscrivent parfaitement dans une approche rentable, garantissant une flexibilité maximale sans dépenses excessives.

Prompts.ai inclut une couche d'opérations financières intégrée qui suit l'utilisation des jetons sur tous les modèles, reliant directement les dépenses aux résultats commerciaux. Son système de crédit TOKN à paiement à l'utilisation vous permet de ne payer que ce que vous utilisez, tandis que des tableaux de bord en temps réel et des limites de jetons permettent d'éviter des coûts imprévus. De nombreuses organisations ont réalisé des économies considérables en tirant parti de l'efficacité du système TOKN.

Prompts.ai donne la priorité à la gouvernance et à la sécurité grâce à des fonctionnalités telles que le contrôle d'accès basé sur les rôles (RBAC), qui restreint l'accès aux flux de travail sensibles et aux déploiements de modèles. Des journaux d'audit complets assurent la transparence, tandis que la plateforme conserve toutes les données sensibles dans le périmètre de sécurité de votre organisation, évitant ainsi toute exposition aux fournisseurs externes et garantissant la conformité aux normes réglementaires.

Conçu pour évoluer avec votre organisation, Prompts.ai permet d'ajouter rapidement de nouveaux modèles, de nouveaux utilisateurs et de nouvelles équipes. Son cadre unifié est non seulement évolutif sur le plan technique, mais encourage également l'adoption de pratiques normalisées. Le programme de certification Prompt Engineer de la plateforme aide à mettre en place ces pratiques au sein de votre personnel, tandis que sa communauté intégrée partage des « gains de temps » conçus par des experts, des flux de travail réutilisables qui accélèrent le déploiement. Cela permet aux équipes de passer des essais initiaux aux opérations à grande échelle sans l'inefficacité d'outils fragmentés.

Zapier est passé d'un outil d'automatisation de base à une plate-forme d'orchestration d'IA robuste, connectant plus de 8 000 applications et plus de 300 outils d'IA. À ce jour, elle a géré plus de 300 millions de tâches d'IA, allant de l'enrichissement des prospects au triage des tickets d'assistance client. Grâce à son interface visuelle sans code, Zapier simplifie les flux de travail d'IA tout en offrant la profondeur requise pour répondre aux besoins des entreprises. Cette transformation met en évidence les capacités de la plateforme à intégrer des modèles linguistiques, à gérer les coûts, à garantir la gouvernance et à faire évoluer les opérations.

Zapier améliore son interface visuelle en intégrant des modèles de langage avancés tels que Chat GPT et Jasper, rendant les tâches pilotées par l'IA plus fluides. Son copilote IA aide les utilisateurs à passer de l'idée à l'exécution, en proposant des modèles de démarrage adaptés aux projets d'IA. La plateforme intègre également Protocole de contexte du modèle (MCP), permettant des flux de travail d'IA plus complexes. Une fonctionnalité remarquable permet aux utilisateurs de combiner différents modèles en fonction des coûts et de la complexité des tâches, en utilisant des modèles plus abordables pour des résumés simples et des modèles haut de gamme pour une logique complexe. Ces intégrations garantissent que les flux de travail restent flexibles et alignés sur les objectifs plus généraux d'orchestration de l'IA.

Zapier met fortement l'accent sur le contrôle des dépenses liées à l'IA. Des fonctionnalités telles que les limites de jetons par étape empêchent les dépassements inattendus, tandis que les filtres conditionnels attribuent des crédits d'IA aux tâches prioritaires. Des alertes de plafonnement des coûts en temps réel surveillent l'utilisation des jetons et interrompent automatiquement les appels d'IA lorsque les seuils budgétaires sont atteints. Par exemple, l'équipe informatique de Remote a utilisé Zapier et ChatGPT pour gérer 1 100 tickets d'assistance mensuels en automatisant la classification des problèmes et les suggestions de solutions. Cette approche a permis de résoudre 28 % des tickets sans intervention humaine, soit un gain de plus de 600 heures par mois. Ces outils garantissent que les flux de travail d'IA restent efficaces et économiques.

Zapier répond aux normes de gouvernance de niveau entreprise grâce à la conformité SOC 2 et au chiffrement des données de bout en bout. Des fonctionnalités telles que les autorisations basées sur les rôles, l'historique des versions et les journaux d'exécution détaillés permettent une supervision complète des flux de travail automatisés. En outre, des paramètres de conservation des données configurables aident les entreprises à se conformer aux exigences réglementaires. Ces mesures créent un environnement sécurisé et fiable pour les opérations d'IA, conformément aux objectifs de flux de travail unifiés de la plateforme.

Les outils de Zapier, tels que Tables, Canvas et la fonctionnalité Agents, centralisent les données et permettent aux flux de travail de s'adapter de manière dynamique. La fonctionnalité Agents, en particulier, consolide plusieurs automatisations en un seul agent intelligent capable de s'adapter aux entrées. Par exemple, Campagne active a utilisé cette fonctionnalité pour développer un système d'intégration basé sur l'IA, ce qui a entraîné une augmentation de 440 % de la participation aux webinaires et une réduction de 15 % du taux de désabonnement anticipé des clients. Évaluations élevées des utilisateurs sur des plateformes telles que G2 et Capterra soulignent davantage la fiabilité et les nombreuses options d'intégration de Zapier.

n8n met l'accent sur le maintien du contrôle de vos données en donnant la priorité à l'exécution locale et à la souveraineté des données. Cette approche est particulièrement bénéfique pour les secteurs soumis à des réglementations strictes en matière de confidentialité, notamment les soins de santé, les finances et le gouvernement. Contrairement aux plateformes qui dépendent d'API externes, l'engagement de n8n en faveur du traitement local garantit une confidentialité et une sécurité renforcées.

n8n s'intègre parfaitement à Ollama, un environnement d'exécution conteneurisé qui exécute des modèles open source tels que LLama2, Mistral, et Phi sur le matériel local. Il prend en charge le changement dynamique de modèle pendant l'exécution, ce qui permet aux flux de travail de s'adapter en fonction des expressions de demande, par exemple en passant de mistral : 7b pour codellama selon les besoins. En maintenant les opérations d'IA locales, n8n élimine le besoin d'envoyer des données à des API externes, garantissant ainsi la sécurité et la confidentialité de votre environnement.

Fonctionnant selon le principe de « propriété de vos données », n8n garantit l'exécution des flux de travail sur votre compte Cloudflare, ce qui signifie que le fournisseur n'accède jamais à vos données. Les exécutions d'API sont protégées par une authentification à l'aide de jetons Bearer, et les mesures de sécurité robustes de Cloudflare, notamment les clés API et les contrôles d'autorisation, protègent les informations sensibles. En outre, le contrôle de version intégré permet aux équipes de suivre l'historique des flux de travail, d'auditer les modifications et de revenir en arrière si nécessaire.

Au-delà de l'accent mis sur la sécurité, n8n est conçu pour gérer efficacement des charges de travail massives. La plateforme traite plus d'un milliard de flux de travail par jour, tout en maintenant une tolérance aux pannes et une faible latence, même en cas de forte demande. Des fonctionnalités telles que la persistance automatique de l'état et la restauration contribuent à la fiabilité de ses performances. Les entreprises bénéficient également de la flexibilité nécessaire pour intégrer des microservices dans des langages tels que Python, Java, JavaScript, C# ou Go, grâce aux SDK open source. Cette adaptabilité permet aux organisations d'orchestrer des opérations d'IA complexes en utilisant leur infrastructure technologique existante.

Examinons les points forts et les défis de ces plateformes, en nous concentrant sur la manière dont elles répondent aux différents besoins techniques et à la complexité des flux de travail.

n8n brille avec ses Évaluation de 4,9/5 sur G2, offrant une solution extrêmement flexible aux équipes capables d'intégrer du code JavaScript ou Python personnalisé dans les flux de travail. Il prend également en charge l'auto-hébergement, donnant aux utilisateurs un contrôle total sur leurs données. Dennis Zahrt, directeur de la prestation de services informatiques mondiaux chez Delivery Hero, a partagé que n8n aide son équipe à économiser 200 heures de travail manuel chaque mois sur les tâches de gestion des utilisateurs. Cette flexibilité présente toutefois un inconvénient : les utilisateurs non techniques peuvent avoir du mal à gérer leurs propres clés et infrastructure d'API LLM.

Zapier se distingue par ses connectivité, qui compte plus de 8 000 intégrations d'applications et traite plus de 300 millions de tâches d'IA. Ce vaste réseau est idéal pour les flux de travail impliquant des outils de niche. Cependant, la tarification de la plateforme peut augmenter avec l'augmentation de l'utilisation, ce que certains utilisateurs ont qualifié de préoccupant. Sa note G2 de 4,5/5 reflète ce compromis.

Gumloop simplifie l'adoption de l'IA en regroupant des modèles LLM haut de gamme directement dans son abonnement, éliminant ainsi les tracas liés à la gestion de clés d'API distinctes. Fidji Simo, PDG de Instacart, a fait l'éloge de la plateforme en déclarant :

Gumloop a joué un rôle essentiel en aidant toutes les équipes d'Instacart, y compris celles qui n'ont pas de compétences techniques, à adopter l'IA et à automatiser leurs flux de travail, ce qui a considérablement amélioré notre efficacité opérationnelle.

Gumloop dispose également d'un Assistant IA, « Gummie », capable de créer automatiquement des flux de travail. Cependant, les équipes nécessitant une personnalisation technique approfondie peuvent le trouver moins adapté.

D'autres plateformes proposent une gamme de compromis entre accessibilité, facilité d'utilisation et personnalisation avancée.

Fabriquer est l'option la plus économique, à partir de 10,59$ par mois et proposant plus de 7 500 modèles prédéfinis. Cependant, les utilisateurs mentionnent souvent son interface maladroite et sa courbe d'apprentissage abrupte comme des inconvénients.

Relay.app gagne un Évaluation de 4,9/5 sur G2 pour son approche simple et ses étapes d'approbation humaines, mais il ne dispose pas d'un assistant IA pour créer des flux de travail.

Pour les équipes d'entreprise, Vélin AI et Stack AI fournissent une gestion du cycle de vie de bout en bout avec des fonctionnalités telles que la gestion rapide des versions, conçues pour empêcher une « dérive rapide » coûteuse de la production. Les deux plateformes prennent également en charge le déploiement de VPC et le contrôle d'accès basé sur les rôles, ce qui les rend idéales pour les organisations ayant des exigences strictes en matière de sécurité et de gouvernance.

Le choix de la bonne plateforme de flux de travail IA en 2026 dépend de l'adéquation de la plateforme avec l'expertise technique et les priorités de gouvernance de votre équipe. Les comparaisons décrites ci-dessus mettent en évidence la manière dont les différentes plateformes répondent aux différents besoins organisationnels.

Pour les équipes du marketing, des ventes ou des opérations qui manquent d'expertise technique, les plateformes dotées de nombreuses intégrations d'applications et d'interfaces faciles à utiliser sont pratiques et efficaces. D'autre part, les équipes techniques qui exigent une personnalisation approfondie et un contrôle total de leurs données peuvent préférer les solutions auto-hébergées, qui permettent d'intégrer du code JavaScript ou Python personnalisé directement dans les flux de travail.

Les organisations qui souhaitent une adoption fluide de l'IA avec un accès rapide à des modèles haut de gamme bénéficieront de solutions clés en main. Les équipes soucieuses des coûts peuvent tirer parti de plateformes proposant des milliers de modèles à des prix compétitifs, tandis que les entreprises nécessitant une gouvernance solide trouveront la gestion centralisée des politiques sur les agents d'IA mieux adaptée à leurs besoins.

Cet examen détaillé des fonctionnalités de la plateforme, de l'intégration de modèles unifiés à la gestion des coûts et à la souveraineté des données, vous permet de sélectionner la solution qui répond à vos objectifs opérationnels. L'évolution de la simple automatisation vers l'orchestration de l'IA est de plus en plus évidente. Les plateformes gèrent désormais des processus complets à l'aide de systèmes dynamiques et logiques au lieu de s'appuyer sur des règles rigides du « si c'est alors ». L'adoption du protocole MCP (Model Context Protocol) change également la donne en permettant aux principales plateformes de se connecter instantanément à des milliers d'applications sans nécessiter d'intégrations d'API individuelles complexes. Cette évolution vers des agents d'IA autonomes capables de prendre des décisions en fonction d'objectifs en langage naturel marque un changement radical dans l'automatisation des flux de travail, positionnant 2026 comme une année critique pour les organisations prêtes à adopter ces avancées.

Prompts.ai protège vos données à l'aide d'un cadre de sécurité multicouche adapté aux flux de travail d'IA de niveau entreprise. Avec Certification SOC 2 type II, la plateforme fournit des garanties avancées, notamment le cryptage des données (en transit et au repos), des contrôles d'accès et une journalisation complète des audits. Ces protections sont vérifiées de manière indépendante pour répondre à des normes industrielles rigoureuses.

Pour la gouvernance, Prompts.ai emploie autorisations basées sur les rôles et des politiques détaillées pour garantir que seuls les utilisateurs autorisés peuvent accéder aux flux de travail ou les modifier. Les administrateurs bénéficient d'une visibilité complète sur les coûts en temps réel, peuvent définir des limites de dépenses et suivre l'utilisation sur les plus de 35 LLM intégrés de la plateforme. Les journaux exportables et les pistes d'audit détaillées simplifient la conformité aux réglementations telles que GDPR et CCPA, offrant aux entreprises la confiance dans la sécurité, la transparence et le contrôle de leurs opérations d'IA.

Prompts.ai propose une suite d'outils conçus pour aider les équipes à maîtriser leurs dépenses liées à l'IA. Avec ses modèle de tarification à l'utilisation, vous êtes facturé sur la base de crédits symboliques, ce qui garantit que vous n'êtes facturé que pour la puissance de calcul que vous utilisez réellement. Cette approche vous donne un contrôle précis des coûts, ce qui vous permet d'allouer des crédits par petites tranches tout en surveillant de près les dépenses liées à des flux de travail spécifiques ou à des opérations de modélisation.

Pour faciliter encore la gestion des coûts, la plateforme propose suivi des coûts en temps réel et tableaux de bord intuitifs. Ces outils fournissent une vision claire des dépenses actuelles, de l'utilisation prévue et de la ventilation détaillée des coûts pour chaque modèle. Les équipes peuvent établir des budgets, recevoir des alertes lorsque les dépenses approchent des limites prédéfinies et identifier rapidement les opérations qui font grimper les coûts. Ces fonctionnalités rationalisent la gestion des flux de travail liés à l'IA et contribuent à réduire considérablement les dépenses.

Prompts.ai rationalise le processus de mise à l'échelle des flux de travail d'IA en fournissant une plate-forme unique qui connecte les utilisateurs à plus de 35 grands modèles linguistiques, y compris des options de pointe telles que GPT-5, Claude et Gemini. En consolidant l'accès, il élimine les tracas liés à la gestion de plusieurs comptes fournisseurs tout en maintenant des normes élevées en matière de confidentialité et de sécurité des données, grâce à la conformité intégrée à la norme SOC 2 Type II.

La collaboration en équipe devient un jeu d'enfant grâce à un espace de travail partagé conçu pour créer, contrôler les versions et publier des flux de travail. Des outils tels que le suivi des coûts en temps réel et un système de crédit Pay-As-You-Go permettent de minimiser les dépenses liées à l'IA, ce qui peut permettre de réduire les coûts jusqu'à 98 %. En outre, des fonctionnalités de gouvernance telles que les contrôles d'accès basés sur les rôles, les journaux d'audit et l'application des politiques garantissent la conformité des entreprises.

La conception native du cloud de la plateforme permet de lancer rapidement des projets, de dupliquer facilement les flux de travail et d'équilibrer automatiquement la charge entre les modèles et les ressources. Cela permet aux organisations de développer facilement leurs initiatives d'IA, en transformant les outils déconnectés en un système unifié, efficace et sécurisé.