Les flux de travail basés sur l'IA constituent l'épine dorsale de la mise à l'échelle de l'intelligence artificielle, des expériences aux applications du monde réel. Pourtant, 85 % des projets d'IA ne parviennent pas à s'étendre en raison de la fragmentation des outils, de la faiblesse de la gouvernance et de la médiocrité des infrastructures. Ce guide explique comment surmonter ces défis en se concentrant sur trois piliers : intégration des données, orchestration de modèles, et gouvernance.

Informations clés :

Solutions pratiques :

Des plateformes comme Prompts.ai simplifiez ces processus en unifiant plus de 35 modèles d'IA, en offrant une visibilité des coûts et en garantissant la conformité. Des entreprises comme Toyota et Le monde du camping ont déjà obtenu des résultats mesurables, tels qu'un Réduction de 50 % des temps d'arrêt et un Augmentation de 40 % de l'engagement client.

À emporter : La mise à l'échelle des flux de travail d'IA nécessite une orchestration intelligente, une gestion des coûts et une gouvernance solide. Avec des outils tels que Prompts.ai, vous n'êtes plus qu'à une étape de la transformation de vos projets d'IA en systèmes évolutifs et efficaces.

Mise en œuvre du flux de travail basé sur l'IA : statistiques clés et indicateurs de réussite

La création de flux de travail d'IA évolutifs repose sur trois piliers principaux : l'intégration des données, l'orchestration des modèles et la gouvernance. Ces éléments transforment les modèles d'IA expérimentaux en systèmes prêts à être mis en production en s'attaquant aux obstacles techniques, opérationnels et réglementaires.

Pour que les flux de travail d'IA fonctionnent efficacement, des données propres et bien structurées ne sont pas négociables. Pratiques DataOps , tels que la gestion des versions des données, la normalisation des champs et l'ingestion automatique, contribuent à maintenir des entrées cohérentes et fiables pour les modèles d'IA. Sans cela, même les systèmes les plus avancés peuvent produire des résultats erronés.

« Même la meilleure intelligence artificielle ne peut pas se sortir d'un ensemble de données désordonné. Des champs incohérents et une dénomination incohérente brisent le contexte des modèles en aval. » — Nicole Replogle, rédactrice, Zapier

Un exemple pratique de cela remonte à août 2025, lorsque Piscine a automatisé son processus d'enrichissement des données à l'aide de Zapier. En vérifiant les détails des prospects dans Google Sheets et en catégorisant automatiquement les données en temps réel, l'entreprise a économisé 20 000 dollars par an et a permis à son équipe commerciale de se concentrer sur des initiatives stratégiques.

Pour les flux de travail basés sur Génération augmentée par récupération (RAG), le prétraitement consiste à segmenter les documents volumineux en segments significatifs et à maintenir les index de recherche à jour. Cela inclut des reconstructions périodiques des index pour gérer les demandes de suppression de données et garantir leur pertinence.

Une fois l'intégrité des données établie, une couche d'orchestration centralisée prend le relais, dirigeant les tâches vers les modèles d'IA les plus adaptés.

UNE couche d'orchestration centralisée constitue l'épine dorsale de flux de travail d'IA efficaces. Il achemine les tâches vers les modèles les mieux équipés pour des fonctions spécifiques. Par exemple, Claude est habile à analyser de longs documents et du code, tandis que ChatGPT excelle dans le traitement du langage naturel. Ce routage intelligent garantit que les tâches sont adaptées au modèle qui offre des performances et une rentabilité optimales.

Zapier a géré plus de 300 millions de tâches d'IA, illustrant l'immense échelle à laquelle les plateformes d'orchestration peuvent fonctionner. Ce système est généralement mis en œuvre en tant que point de terminaison ou passerelle d'API, fournissant des fonctionnalités telles que l'équilibrage de charge et la surveillance des performances. Une telle architecture permet aux entreprises d'introduire progressivement de nouvelles versions de modèles sans perturber les flux de travail en cours.

Un exemple concret est UltraCamp, un fournisseur de logiciels de gestion de camps d'été. En 2025, ils ont développé un système d'IA orchestré pour rationaliser l'intégration des clients. En combinant des analyseurs Web avec un nettoyage et un enrichissement des données pilotés par l'IA, UltraCamp a permis d'économiser environ une heure de travail manuel par nouveau client tout en conservant une touche personnelle dans les communications.

Une fois l'orchestration des données et des modèles en place, la dernière pièce du puzzle est la gouvernance qui garantit la conformité et la responsabilité.

Les flux de travail d'IA doivent répondre à des normes réglementaires strictes, notamment HIPAA, SOC 2, NORME ISO 27001, et le RGPD. Cela implique la mise en œuvre de fonctionnalités telles que les contrôles d'accès basés sur les rôles (RBAC), l'authentification unique (SSO), le stockage secret chiffré et les pistes d'audit qui enregistrent chaque exécution de modèle et chaque accès aux données.

Par exemple, Delivery Hero a automatisé ses ITOps grâce à des contrôles de gouvernance, ce qui permet d'économiser 200 heures par mois. Dennis Zahrt a souligné les gains d'efficacité réalisés grâce à n8nfonctionnalités de gestion des utilisateurs.

Dans des domaines sensibles tels que les services juridiques ou financiers, L'humain dans la boucle (HITL) les étapes sont cruciales. Ces points de contrôle garantissent qu'une personne qualifiée examine les résultats générés par l'IA avant qu'ils ne soient partagés avec les clients ou qu'ils ne fassent partie des dossiers officiels. Cette approche atténue les risques tels que les hallucinations liées à l'IA ou les comportements imprévisibles. En outre, la définition de KPI clairs pour une IA responsable, tels que des mesures d'équité, de transparence et de précision, permet d'aligner les systèmes d'IA sur les normes éthiques et les objectifs commerciaux.

Une interopérabilité efficace joue un rôle crucial pour relever les défis liés à l'intégration des systèmes d'IA. Sans communication fluide entre les modèles et les outils d'IA, les équipes sont souvent obligées de créer des intégrations personnalisées pour chaque nouveau système, ce qui entraîne des tâches répétitives et des retards de déploiement. En permettant aux systèmes d'IA de collaborer par le biais de normes et de méthodes de connexion partagées, l'interopérabilité élimine ces obstacles.

Le défi est de taille. De nombreux frameworks d'IA fonctionnent au sein d'écosystèmes fermés, ce qui empêche les agents de différentes plateformes de travailler ensemble. Ces agents ne peuvent pas accéder à la mémoire interne ou aux implémentations d'outils de chacun, et les formats de données incompatibles obligent les développeurs à écrire du code personnalisé pour chaque intégration. Ce manque de connectivité limite le potentiel des flux de travail basés sur l'IA et ralentit les progrès des organisations.

Un modèle de données canonique sert de langage partagé que les systèmes d'IA d'un flux de travail peuvent comprendre universellement. En définissant les structures de données de base à l'aide de formats tels que Protocol Buffers, les équipes peuvent garantir un échange d'informations cohérent, que ce soit via des API JSON-RPC, gRPC ou REST.

Cette standardisation favorise l'exécution opaque, dans laquelle les agents d'IA interagissent uniquement en fonction des capacités déclarées sans accéder aux opérations internes des uns et des autres. Par exemple, un agent basé sur Chaîne Lang peut échanger de manière fluide des messages JSON structurés avec un message intégré IA de l'équipage, à condition qu'ils respectent le même schéma. Cela facilite également la découverte des agents, ce qui permet aux systèmes des environnements multifournisseurs d'identifier et de comprendre de manière dynamique les capacités des autres agents.

Les schémas standardisés permettent d'éviter la dérive des spécifications et de créer un cadre fiable pour la mise à l'échelle d'écosystèmes d'IA complexes. Ils permettent également aux flux de travail de gérer différents types de données (texte, audio, vidéo et données structurées) via un modèle d'interaction unifié.

Les API transforment les modèles d'IA d'outils isolés axés sur le raisonnement en composants sensibles au système capables d'effectuer des tâches exploitables, telles que la mise à jour des CRM, l'interrogation de bases de données ou l'envoi d'e-mails. Ce processus, souvent appelé appel de fonction ou utilisation d'un outil, permet aux modèles de convertir des entrées en langage naturel en appels d'API structurés qui effectuent des actions réelles.

L'utilisation d'API standardisées simplifie le traitement des tâches à grande échelle. Par exemple, le Protocole de contexte du modèle (MCP) est en train de devenir une architecture client-serveur unifiée qui remplace les wrappers d'API personnalisés. Au lieu de créer des connecteurs uniques pour chaque source de données, MCP propose des intégrations réutilisables compatibles avec différents modèles et plateformes d'IA. Des outils tels que Gestion des API Azure rationalisez davantage ce processus en centralisant l'authentification, les quotas et le routage.

La sécurité et la résilience sont essentielles à la réussite des intégrations d'API. L'utilisation de comptes de service dotés d'informations d'identification limitées dans le temps permet aux agents d'accéder uniquement aux données dont ils ont besoin. Les disjoncteurs peuvent arrêter les requêtes après des pannes répétées, évitant ainsi les problèmes en cascade. Pour les tâches sensibles telles que l'envoi d'e-mails aux clients, l'intégration des approbations humaines ajoute un niveau de sécurité supplémentaire.

Toutes les tâches ne nécessitent pas le modèle d'IA le plus avancé ou le plus coûteux. Le routage multimodèle attribue dynamiquement les tâches au modèle le plus approprié en fonction de facteurs tels que la vitesse, le coût et les capacités. Connue sous le nom de « routage LLM », cette méthode garantit que les tâches simples sont gérées par des modèles plus rapides et plus rentables, tandis que les tâches complexes sont dirigées vers des systèmes plus performants.

Une couche d'orchestration centralisée gère généralement cette logique de routage, évalue les demandes entrantes et détermine le modèle le mieux adapté à la tâche. Par exemple, un modèle léger peut être utilisé pour résumer des documents, tandis qu'un modèle plus avancé comme Claude, connu pour son raisonnement nuancé, pourrait gérer une analyse détaillée des contrats juridiques.

Les mécanismes de secours garantissent que les flux de travail restent opérationnels même si un modèle principal n'est pas disponible ou rencontre des erreurs. Dans ce cas, le système redirige la demande vers un modèle de sauvegarde doté de fonctionnalités similaires. En outre, la surveillance des performances permet de suivre des indicateurs tels que les temps de réponse et les taux d'erreur, ce qui permet aux équipes d'affiner les règles de routage en fonction des données de performance réelles.

Pour réduire la latence dans les flux de travail multimodèles, des techniques telles que le regroupement de connexions pour les bases de données et les tâches asynchrones parallèles sont utilisées lors de l'extraction de données provenant de sources multiples. L'objectif est de faire correspondre chaque tâche au modèle qui offre la meilleure combinaison de rapidité, de précision et de coût, afin de rationaliser les opérations sans nécessiter de supervision manuelle constante.

Cette orchestration des modèles d'IA renforce les flux de travail, ouvrant la voie à une meilleure gouvernance et à des environnements de production évolutifs.

Les modèles de flux de travail basés sur l'IA sont des approches structurées conçues pour relever des défis commerciaux spécifiques. Ces cadres intègrent des modèles, des sources de données et une supervision humaine pour créer des systèmes de production fiables.

Les flux de travail RAG relient les modèles d'IA génératifs à la base de connaissances interne de l'entreprise, réduisant ainsi les inexactitudes et améliorant la fiabilité des tâches basées sur les connaissances. Au lieu de s'appuyer uniquement sur les données d'entraînement d'un modèle, RAG extrait des informations pertinentes à partir de sources telles que des bases de données vectorielles, des magasins de documents ou des API avant de générer une réponse.

Ces flux de travail impliquent l'ingestion, la segmentation, l'intégration et le stockage de données pour une récupération rapide, ce qui améliore la précision des faits. Lorsqu'une requête est faite, le système récupère les blocs de données pertinents et les fournit au modèle de langage pour une réponse plus précise.

« RAG réduit le risque d'hallucinations en fournissant au LLM des informations pertinentes et factuelles. » - Hayden Wolff, ingénieur marketing technique, NVIDIA

RAG est particulièrement utile pour gérer des informations confidentielles, telles que les politiques RH, les manuels techniques ou les dossiers de vente. C'est également une alternative rentable au réglage fin, car elle améliore la qualité de sortie sans les frais de calcul liés à l'ajustement des poids du modèle. Pour garantir la précision, les équipes doivent régulièrement mettre à jour leurs bases de données vectorielles avec de nouvelles données et utiliser des techniques de recherche hybrides combinant similarité sémantique et correspondance de mots clés.

S'appuyant sur ces techniques de récupération, la génération de contenu en plusieurs étapes permet d'affiner les résultats de l'IA grâce à un traitement séquentiel.

La création de contenu complexe nécessite souvent de diviser les tâches en étapes distinctes, telles que la rédaction, la révision, l'affinement et la finalisation. Utilisation de flux de travail en plusieurs étapes chaînage rapide, où plusieurs appels IA sont liés entre eux, chaque étape améliorant le résultat précédent. Par exemple, un modèle peut rédiger le contenu, un autre peut en vérifier le ton et la précision, et un troisième peut gérer la mise en forme.

Ces flux de travail peuvent inclure des pauses pour la révision ou l'approbation manuelles, afin de garantir la qualité avant de passer à l'étape suivante. En gérant les invites sous forme de composants modulaires versionnés et en utilisant la mise en cache déterministe, les équipes peuvent réduire à la fois l'utilisation des jetons et la latence. En outre, des stratégies de repli peuvent être mises en œuvre pour passer à des modèles plus simples ou plus rentables si le modèle principal rencontre des problèmes tels que la latence ou les limites de jetons.

De même, les flux de travail de compréhension documentaire utilisent des processus séquentiels pour transformer le contenu non structuré en données exploitables.

Les organisations traitent souvent de gros volumes de documents non structurés qui doivent être analysés, classés et convertis en formats structurés. Les flux de travail de compréhension documentaire automatisent ce processus, ce qui facilite l'extraction d'informations exploitables à partir de divers types de documents.

Ces flux de travail combinent généralement la reconnaissance optique de caractères (OCR) pour les documents numérisés, l'analyse de la mise en page pour conserver le contexte structurel et les modèles de langage pour extraire des champs spécifiques ou classer des catégories de documents. Par exemple, un système de traitement des factures peut extraire les noms des fournisseurs, les dates, les rubriques et les totaux, puis transmettre les données structurées aux systèmes comptables pour approbation des paiements.

Le Planifier et exécuter Un schéma sépare la phase de planification de l'exécution. Une IA « planificatrice » décrit un processus étape par étape, tandis qu'un « exécuteur » exécute les tâches, améliorant ainsi la fiabilité et simplifiant le débogage. Pour les flux de travail impliquant des informations sensibles, les filtres de gestion des erreurs sont essentiels pour éviter les défaillances en cascade dans les processus à plusieurs étapes.

La gestion des coûts, la garantie de la fiabilité et le respect des principes de gouvernance sont essentiels pour faire évoluer efficacement les flux de travail d'IA. La mise à l'échelle exige non seulement des dépenses prévisibles, mais également une disponibilité constante et des mesures de conformité claires. Les projets d'IA connaissent souvent une modèle de coûts « en zig-zag » - des dépenses initiales élevées lors de la préparation des données, des coûts fluctuants lors des étapes de validation du concept et des dépenses plus stables une fois la charge de travail d'inférence réglée. Sans supervision adéquate, les équipes risquent d'épuiser leurs budgets avant même que les flux de travail n'atteignent la production.

Pour maîtriser les dépenses liées à l'IA, il faut disposer d'outils tels que la surveillance en temps réel des jetons et des demandes, des alertes budgétaires et des étiquettes de coûts spécifiques à chaque département. Des facteurs de surveillance tels que la longueur des messages, la taille des réponses et les dimensions vectorielles peuvent contribuer à réduire l'utilisation des jetons et les coûts de stockage. Des stratégies telles que mise en cache rapide pour les requêtes fréquemment utilisées, réduisez les dépenses redondantes, tandis que la mise en cache déterministe réduit la latence sans compromettre la précision.

Le choix du matériel joue un rôle clé dans la rentabilité. Par exemple, en utilisant du matériel d'IA spécialisé comme AWS Trainium pour la formation et AWS Inferentia car l'inférence peut réduire considérablement les coûts de calcul. Décider d'affiner les modèles de base existants ou d'en former de nouveaux à partir de zéro est une autre étape importante pour éviter des dépenses de formation initiale inutiles. De plus, la formation d'un conseil de gouvernance interfonctionnel qui inclut le service juridique, les ressources humaines, l'informatique et les achats, garantit un déploiement éthique tout en préservant la prévisibilité des coûts dans l'ensemble de l'organisation.

Outre la gestion des coûts, il est tout aussi essentiel de créer des flux de travail capables de se remettre rapidement des interruptions.

Les flux de travail d'IA peuvent rencontrer des défaillances inattendues, telles que des délais d'attente de l'API, des hallucinations de modèles ou des limites de débit, qui perturbent les opérations. Employant nouvelles tentatives automatisées avec des rétroactions exponentielles peuvent résoudre des problèmes de réseau temporaires, tandis que des bilans de santé proactifs surveillent les performances du système et déclenchent des actions de restauration en cas de problème. L'adoption de conceptions modulaires et d'une approche à responsabilité unique permet de limiter les points de défaillance et de simplifier le dépannage.

La transparence est cruciale, en particulier dans les secteurs réglementés. Les journaux d'audit doivent saisir les décisions relatives aux modèles, l'accès aux données et les actions politiques. L'attribution d'identités uniques (par exemple, Microsoft Entra Agent Identity) permet de suivre la propriété des agents et l'historique des versions. Plateformes d'observabilité centralisées telles que Azure Log Analytics fournir des tableaux de bord en temps réel pour surveiller le comportement, les performances et la conformité des agents sur l'ensemble des systèmes distribués.

Pour respecter les réglementations relatives aux données telles que le RGPD ou la HIPAA, appliquez souveraineté des données en identifiant l'emplacement des sources de données et des environnements d'exécution. Le contrôle d'accès basé sur les rôles (RBAC) et les comptes de service délimités garantissent que les agents héritent des autorisations des utilisateurs, empêchant ainsi tout accès non autorisé. Avant le déploiement en production, effectuez des tests de « Red Teaming » contradictoires pour découvrir des vulnérabilités telles qu'une injection rapide ou une fuite de données. Conservez des « fiches modèles » qui documentent l'intention du modèle, les données de formation et les processus de prise de décision pour faciliter la préparation à l'audit.

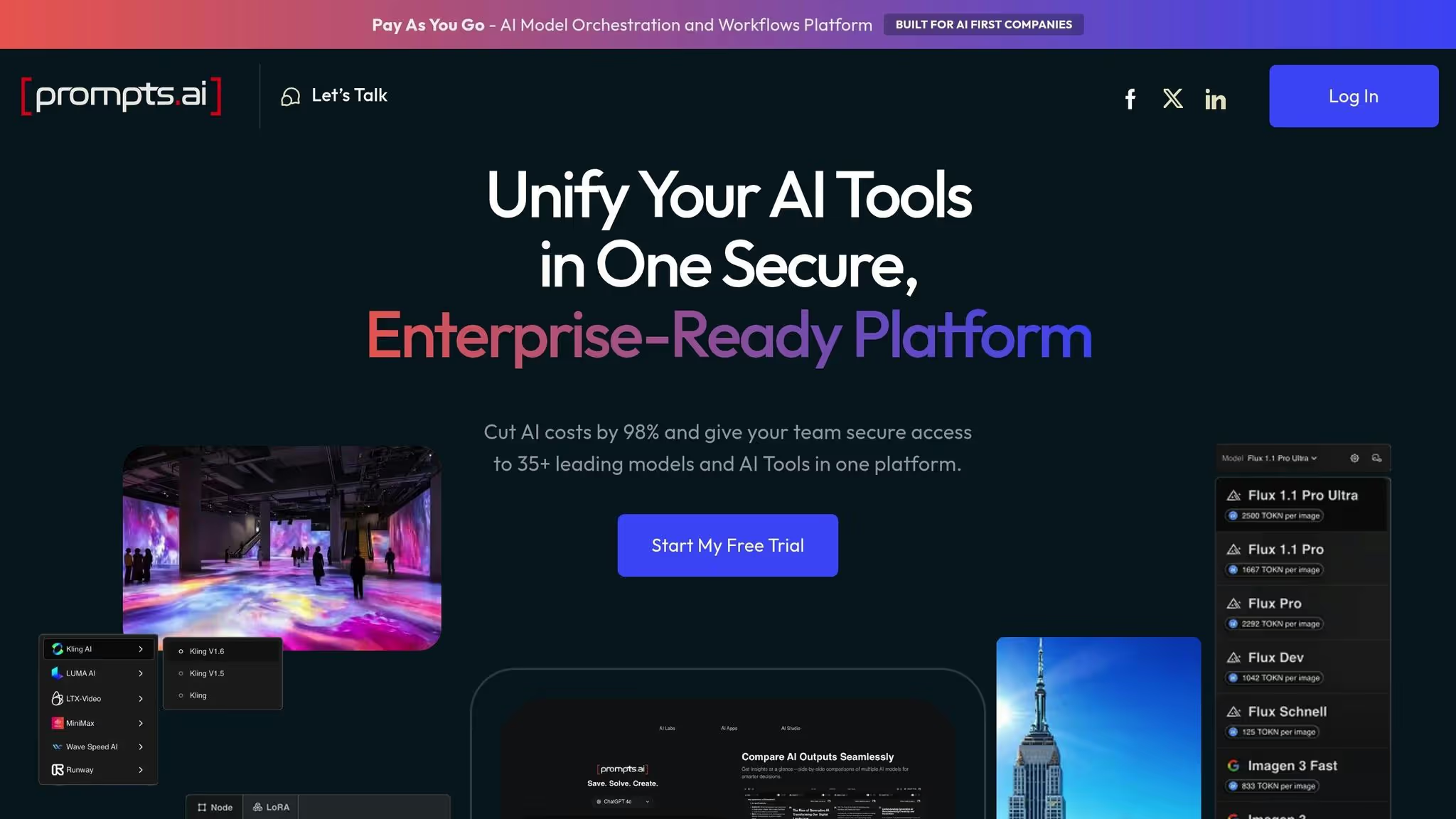

Prompts.ai franchit une nouvelle étape dans l'intégration de l'IA en permettant aux organisations d'adapter les flux de travail à l'ensemble de leurs opérations. En consolidant plus de 35 modèles haut de gamme, dont GPT-5, Claude, Lama, et Gémeaux - en une seule interface rationalisée, la plateforme simplifie l'utilisation des outils tout en garantissant la conformité aux normes de l'entreprise. Cette configuration unifiée permet de passer efficacement des prototypes initiaux au déploiement à grande échelle, tout en préservant la gouvernance, la supervision des coûts et la résilience opérationnelle.

Le passage du concept à la production échoue souvent en l'absence d'un suivi et d'une gouvernance appropriés. Prompts.ai comble cette lacune en proposant une boîte à outils complète qui comprend des comparaisons de modèles côte à côte, un suivi en temps réel et des pistes d'audit détaillées. Les équipes peuvent expérimenter des flux de travail en utilisant des crédits TOKN payables à l'utilisation, évitant ainsi l'engagement d'abonnements récurrents tout en conservant une visibilité totale sur les coûts. Une fois qu'un flux de travail a prouvé sa valeur, la plateforme facilite son passage en production, avec des contrôles d'accès basés sur les rôles et des bilans de santé automatisés pour garantir la conformité et la stabilité au niveau de l'entreprise.

Une intégration efficace est la clé d'une adoption généralisée au sein des organisations. Prompts.ai accélère ce processus grâce à des ressources telles que Université Gumloopdes cours à votre rythme, des cohortes d'apprentissage d'une semaine et l'assistant Gummie AI, qui aide les équipes à créer des flux de travail en langage naturel. Des outils supplémentaires, tels qu'une bibliothèque de modèles prêts à l'emploi, une communauté Slack solidaire et des webinaires en direct, garantissent que les équipes disposent de tout ce dont elles ont besoin pour démarrer.

Pour les entreprises basées aux États-Unis, les flux de travail doivent être conformes aux normes et aux attentes locales. Prompts.ai garantit cela en localisant automatiquement les sorties dans des formats tels que MM/DD/YYYY pour les dates, en unités impériales pour les mesures et en USD pour les rapports de coûts (par exemple, 1 234,56$). Il n'est donc plus nécessaire de procéder à des ajustements manuels dans les rapports de conformité, les tableaux de bord financiers ou les documents destinés aux clients. Les conseils de gouvernance interfonctionnels peuvent configurer ces paramètres de localisation une seule fois, et tous les flux de travail connexes en hériteront de manière fluide, ce qui permet de gagner du temps et de garantir la cohérence.

Création flux de travail d'IA efficaces exige une combinaison de supervision centralisée, intégration fluide, et des résultats mesurables. En regroupant les modèles d'IA sur une seule plateforme, les entreprises peuvent obtenir une visibilité instantanée sur les coûts, les performances et la conformité, mettant ainsi fin au chaos causé par la déconnexion des outils et des processus manuels. Alors que 92 % des dirigeants prévoient que leurs flux de travail seront numérisés et optimisés par l'IA d'ici 2025, il est essentiel de prendre des mesures rapides pour garder une longueur d'avance dans un environnement concurrentiel.

Prompts.ai propose une solution complète basée sur ces principes. En intégrant plus de 35 modèles d'IA de pointe dans une interface unique, la plateforme simplifie les opérations tout en intégrant Contrôles des coûts FinOps pour suivre les dépenses en temps réel. Les contrôles de gouvernance sont automatisés pour garantir la conformité réglementaire, et le système de crédits TOKN pay-as-you-go aligne les dépenses sur l'utilisation réelle. Des fonctionnalités telles que la comparaison de modèles et des pistes d'audit complètes permettent aux entreprises de passer plus facilement de l'expérimentation à la production à grande échelle. Pour les entreprises américaines, la plateforme inclut un support localisé, garantissant une mise en œuvre cohérente entre les équipes.

Les avantages de cette approche unifiée sont évidents dans les résultats obtenus par des entreprises telles que Toyota et Camping World. Toyota a rapporté un Réduction de 50 % des temps d'arrêt et un Réduction de 80 % des pannes d'équipement après avoir adopté des flux de maintenance prédictive pilotés par l'IA. Entre-temps, Le monde du camping a vu un Augmentation de 40 % de l'engagement client et réduisez les temps d'attente à 33 secondes à travers Automatisation des tâches basée sur l'IA. Ces succès font écho au point de vue de Rob Thomas, vice-président principal des logiciels et directeur commercial de IBM, qui a noté :

« Au lieu de prendre les emplois de chacun, comme certains le craignaient, [l'IA] pourrait améliorer la qualité du travail effectué en rendant chacun plus productif. »

La mise à l'échelle efficace des flux de travail d'IA nécessite une orchestration intelligente. Prompts.ai transforme les expériences fragmentées en processus structurés, reproductibles et conformes qui fournissent des résultats concrets. Alors que 80 % des organisations recherchent déjà une automatisation de bout en bout, les plateformes combinant gouvernance, transparence des coûts et optimisation des performances façonneront l'avenir de la productivité des entreprises. En unifiant ces éléments, Prompts.ai permet aux entreprises de dépasser les efforts isolés et de faire de l'IA la pierre angulaire de leur stratégie opérationnelle.

L'intégration des données joue un rôle crucial dans la réussite des projets d'IA en réunissant diverses sources de données dans un système unique, propre et formaté de manière cohérente. Cette approche élimine les silos de données et minimise les erreurs, permettant aux modèles d'IA de traiter les informations plus efficacement. Grâce à des pipelines de données unifiés, des transformations réutilisables deviennent possibles, ce qui permet de réduire les scripts manuels et de gagner un temps précieux tout en garantissant des résultats cohérents.

L'automatisation est l'un des principaux avantages de l'intégration des données. Les tâches telles que le nettoyage, l'enrichissement et l'extraction de caractéristiques sont transformées en flux de travail évolutifs capables de gérer de vastes ensembles de données. Cela garantit que des données de haute qualité sont toujours disponibles pour entraîner les modèles d'IA, réduire les erreurs et améliorer les performances globales. En outre, les organisations bénéficient d'une visibilité en temps réel sur la qualité des données, ce qui leur permet d'identifier et de résoudre les problèmes à un stade précoce, ce qui permet d'éviter les complications plus tard dans le processus.

Associée à des outils d'orchestration, l'intégration des données permet une automatisation fluide de bout en bout. Cela permet d'optimiser l'utilisation des ressources, de faire évoluer les charges de travail et de garantir des opérations fluides, réduisant ainsi les temps d'itération et les coûts. En adoptant cette approche globale, les entreprises sont mieux placées pour fournir des solutions d'IA efficaces et prêtes pour la production.

L'orchestration des modèles joue un rôle central dans la simplification des flux de travail d'IA en garantissant que plusieurs modèles fonctionnent ensemble de manière fluide. Il gère la séquence d'exécution, le mouvement des données et la distribution des ressources, en veillant à ce que chaque modèle fonctionne efficacement et au bon moment. Cela permet non seulement d'éliminer les retards inutiles, mais également de réduire la complexité opérationnelle, ce qui entraîne des réductions de coûts notables.

Au-delà de la réduction des coûts, l'orchestration améliore à la fois l'évolutivité et la fiabilité. Les équipes peuvent tirer parti de composants de flux de travail modulaires et réutilisables, accélérant ainsi le développement de nouveaux processus d'IA sans avoir à repartir de zéro. En automatisant des tâches telles que la gestion des erreurs, le suivi des progrès et la gestion des flux de données, l'orchestration permet aux systèmes d'IA de rester réactifs, sécurisés et prêts à s'adapter à l'évolution des demandes commerciales.

La gouvernance joue un rôle clé dans la mise à l'échelle de l'IA dans des secteurs strictement réglementés tels que la finance, la santé et l'énergie. Il garantit le respect de réglementations strictes tout en préservant la confiance et la sécurité. En mettant en œuvre un cadre de gouvernance clair, les organisations peuvent définir des politiques concernant la manière dont les données sont utilisées, suivre les performances des modèles et maintenir l'auditabilité. Cela permet de retracer les décisions jusqu'à des sources approuvées et garantit que tout changement est correctement documenté. Ces mesures protègent non seulement les informations sensibles, mais permettent également d'éviter les sanctions réglementaires et de renforcer la confiance des parties prenantes à mesure que les systèmes d'IA se développent.

Dans les secteurs où les risques sont particulièrement élevés, la mise à l'échelle de l'IA peut exposer les organisations à de plus grandes vulnérabilités. Une gouvernance efficace permet de faire face à ces risques grâce à une surveillance continue, à des contrôles de conformité automatisés et à des contrôles d'accès basés sur les rôles qui empêchent les modifications ou les violations non autorisées. L'intégration de normes de sécurité et d'éthique tout au long du cycle de vie de l'IA permet aux entreprises de déployer et de mettre à jour des modèles en toute confiance, tout en respectant des réglementations telles que la HIPAA, le RGPD ou d'autres règles spécifiques au secteur. Cela fait de la gouvernance la pierre angulaire de l'expansion sûre et efficace des capacités d'IA.