Los flujos de trabajo de IA son la columna vertebral para escalar la inteligencia artificial de los experimentos a las aplicaciones del mundo real. Sin embargo, El 85% de los proyectos de IA no se escalan debido a la fragmentación de las herramientas, la débil gobernanza y la mala infraestructura. Esta guía explica cómo superar estos desafíos centrándose en tres pilares: integración de datos, orquestación de modelos, y gobernanza.

Perspectivas clave:

Soluciones prácticas:

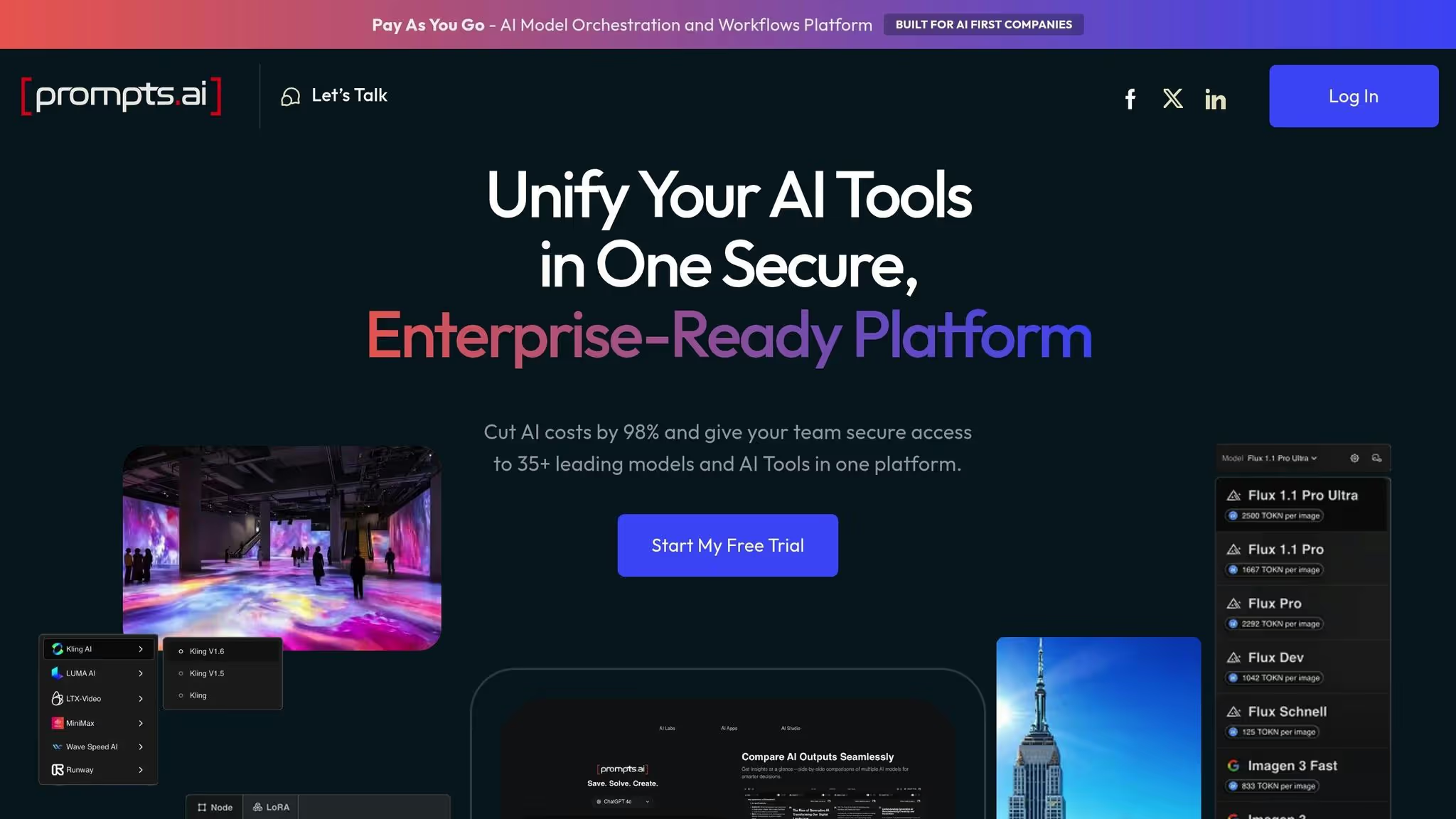

Plataformas como Prompts.ai simplifique estos procesos unificando más de 35 modelos de IA, proporcionando visibilidad de los costos y garantizando el cumplimiento. Empresas como Toyota y Mundo del camping ya han logrado resultados mensurables, como un Reducción del 50% en el tiempo de inactividad y un Un aumento del 40% en la participación de los clientes.

Para llevar: La ampliación de los flujos de trabajo de IA requiere una orquestación inteligente, una gestión de costes y una gobernanza sólida. Con herramientas como Prompts.ai, está a solo un paso de transformar sus proyectos de IA en sistemas escalables y eficientes.

Implementación del flujo de trabajo de IA: estadísticas clave y métricas de éxito

La creación de flujos de trabajo de IA escalables se basa en tres pilares principales: la integración de datos, la orquestación de modelos y la gobernanza. Estos elementos transforman los modelos experimentales de IA en sistemas listos para la producción al abordar los obstáculos técnicos, operativos y reglamentarios.

Para que los flujos de trabajo de IA funcionen de manera efectiva, los datos limpios y bien estructurados no son negociables. Prácticas de DataOps (como el control de versiones de datos, la normalización de campos y la ingesta automatizada) ayudan a mantener entradas consistentes y confiables para los modelos de IA. Sin ellos, incluso los sistemas más avanzados pueden producir resultados erróneos.

«Ni siquiera la mejor IA puede razonar para salir de un conjunto de datos desordenado. Los campos que no coinciden y los nombres inconsistentes interrumpen el contexto de los modelos posteriores». — Nicole Replogle, redactora de Zapier

Un ejemplo práctico de esto proviene de agosto de 2025, cuando Piscina automatizó su proceso de enriquecimiento de datos con Zapier. Al verificar los detalles de los clientes potenciales en Google Sheets y categorizar automáticamente los datos en tiempo real, la empresa ahorró 20 000 dólares al año y permitió a su equipo de ventas centrarse en iniciativas estratégicas.

Para flujos de trabajo basados en Generación aumentada de recuperación (RAG), el preprocesamiento implica segmentar documentos de gran tamaño en fragmentos significativos y mantener actualizados los índices de búsqueda. Esto incluye reconstrucciones periódicas de los índices para gestionar las solicitudes de eliminación de datos y garantizar su relevancia.

Una vez que se establece la integridad de los datos, una capa de orquestación centralizada asume el control y dirige las tareas a los modelos de IA más adecuados.

UN capa de orquestación centralizada constituye la columna vertebral de los flujos de trabajo de IA eficientes. Dirige las tareas a los modelos mejor equipados para funciones específicas. Por ejemplo, Claude es experto en analizar documentos y códigos extensos, mientras que ChatGPT se destaca en el procesamiento del lenguaje natural. Este enrutamiento inteligente garantiza que las tareas se ajusten al modelo que ofrece un rendimiento y una rentabilidad óptimos.

Zapier ha gestionado más de 300 millones de tareas de IA, que muestra la inmensa escala a la que pueden operar las plataformas de orquestación. Por lo general, este sistema se implementa como un punto final o puerta de enlace de API, y proporciona funciones como el equilibrio de carga y la supervisión del rendimiento. Esta arquitectura permite a las empresas introducir nuevas versiones de modelos de forma gradual sin interrumpir los flujos de trabajo en curso.

Un ejemplo del mundo real es UltraCamp, un proveedor de software de gestión de campamentos de verano. En 2025, desarrollaron un sistema de inteligencia artificial orquestado para agilizar la incorporación de clientes. Al combinar analizadores web con la limpieza y el enriquecimiento de datos impulsados por la inteligencia artificial, UltraCamp ahorró aproximadamente una hora de trabajo manual por cliente nuevo manteniendo un toque personal en las comunicaciones.

Con la orquestación de los datos y los modelos, la última pieza del rompecabezas es la gobernanza para garantizar el cumplimiento y la responsabilidad.

Los flujos de trabajo de IA deben cumplir con estándares regulatorios estrictos, que incluyen HIPÁ, SOC 2, ISO 27001, y GDPR. Esto implica implementar funciones como los controles de acceso basados en roles (RBAC), el inicio de sesión único (SSO), el almacenamiento secreto cifrado y los registros de auditoría que registran la ejecución de cada modelo y el acceso a los datos.

Por ejemplo, Héroe de la entrega automatizó sus ITOps con controles de gobierno, ahorrando 200 horas al mes. Dennis Zahrt destacó las ganancias de eficiencia logradas mediante n8nde funciones de administración de usuarios.

En áreas delicadas como los servicios legales o financieros, humano al día (HITL) los pasos son críticos. Estos puntos de control garantizan que una persona cualificada revise los resultados generados por la IA antes de compartirlos con los clientes o pasar a formar parte de los registros oficiales. Este enfoque mitiga riesgos como las alucinaciones provocadas por la IA o el comportamiento impredecible. Además, establecer indicadores clave de rendimiento claros para una IA responsable (como métricas de equidad, transparencia y precisión) ayuda a alinear los sistemas de IA con los estándares éticos y los objetivos empresariales.

La interoperabilidad efectiva desempeña un papel crucial a la hora de abordar los desafíos de la integración de los sistemas de IA. Sin una comunicación fluida entre los modelos y las herramientas de IA, los equipos suelen verse obligados a crear integraciones personalizadas para cada nuevo sistema, lo que provoca retrasos en el despliegue y el trabajo repetitivo. Al permitir que los sistemas de IA colaboren mediante estándares y métodos de conexión compartidos, la interoperabilidad elimina estos obstáculos.

El desafío es considerable. Muchos marcos de IA funcionan dentro de ecosistemas cerrados, lo que impide que los agentes de diferentes plataformas trabajen juntos. Estos agentes no pueden acceder a la memoria interna ni a las implementaciones de herramientas de los demás, y los formatos de datos incompatibles requieren que los desarrolladores escriban un código personalizado para cada integración. Esta falta de conectividad limita el potencial de los flujos de trabajo de la IA y ralentiza el progreso de las organizaciones.

Un modelo de datos canónico sirve como un lenguaje compartido que los sistemas de IA de un flujo de trabajo pueden entender universalmente. Al definir las estructuras de datos principales mediante formatos como los búferes de protocolo, los equipos pueden garantizar un intercambio de información coherente, ya sea a través de las API JSON-RPC, gRPC o REST.

Esta estandarización admite una ejecución opaca, en la que los agentes de IA interactúan basándose únicamente en las capacidades declaradas sin acceder a las operaciones internas de los demás. Por ejemplo, un agente basado en Cadena LANG puede intercambiar sin problemas mensajes JSON estructurados con uno integrado Tripulación AI, siempre que sigan el mismo esquema. Esto también facilita la detección de agentes, ya que permite a los sistemas de entornos de varios proveedores identificar y comprender de forma dinámica las capacidades de otros agentes.

Los esquemas estandarizados ayudan a prevenir la desviación de las especificaciones y crean un marco confiable para escalar ecosistemas de IA complejos. También permiten que los flujos de trabajo gestionen varios tipos de datos (texto, audio, vídeo y datos estructurados) a través de un modelo de interacción unificado.

Las API transforman los modelos de IA de herramientas aisladas y centradas en el razonamiento a componentes conscientes del sistema capaces de realizar tareas procesables, como actualizar los CRM, consultar bases de datos o enviar correos electrónicos. Este proceso, que suele denominarse llamada llamada a funciones o uso de herramientas, permite a los modelos convertir las entradas del lenguaje natural en llamadas a la API estructuradas que realizan acciones en el mundo real.

El uso de API estandarizadas simplifica el procesamiento de tareas a gran escala. Por ejemplo, el Protocolo de contexto modelo (MCP) se perfila como una arquitectura unificada cliente-servidor que reemplaza a los contenedores de API personalizados. En lugar de crear conectores únicos para cada fuente de datos, MCP ofrece integraciones reutilizables compatibles con varios modelos y plataformas de IA. Herramientas como Administración de API de Azure agilice aún más este proceso al centralizar la autenticación, las cuotas y el enrutamiento.

La seguridad y la resiliencia son fundamentales para que las integraciones de API tengan éxito. El uso de cuentas de servicio con credenciales con un alcance limitado y limitado garantiza que los agentes accedan solo a los datos que necesitan. Los disyuntores pueden detener las solicitudes después de errores repetidos, lo que evita que los problemas se generen en cascada. Para tareas delicadas, como el envío de correos electrónicos a los clientes, la incorporación de aprobaciones personalizadas añade un nivel adicional de seguridad.

No todas las tareas requieren el modelo de IA más avanzado (o caro). El enrutamiento multimodelo asigna las tareas de forma dinámica al modelo más adecuado en función de factores como la velocidad, el costo y la capacidad. Este método, conocido como «enrutamiento LLM», garantiza que las tareas simples se gestionen mediante modelos más rápidos y rentables, mientras que las tareas complejas se dirijan a sistemas más capaces.

Una capa de orquestación centralizada normalmente administra esta lógica de enrutamiento, evalúa las solicitudes entrantes y determina el mejor modelo para el trabajo. Por ejemplo, se podría usar un modelo ligero para resumir documentos, mientras que un modelo más avanzado como Claude, conocido por su razonamiento matizado, podría gestionar un análisis detallado de los contratos legales.

Los mecanismos alternativos garantizan que los flujos de trabajo permanezcan operativos incluso si un modelo principal no está disponible o detecta errores. En estos casos, el sistema redirige la solicitud a un modelo de respaldo con capacidades similares. Además, la supervisión del rendimiento monitorea métricas como los tiempos de respuesta y las tasas de error, lo que permite a los equipos ajustar las reglas de enrutamiento en función de los datos de rendimiento reales.

Para reducir la latencia en los flujos de trabajo multimodelo, se emplean técnicas como la agrupación de conexiones para bases de datos y las tareas asincrónicas paralelas al extraer datos de varias fuentes. El objetivo es adaptar cada tarea al modelo que ofrezca la mejor combinación de velocidad, precisión y coste, simplificando las operaciones sin necesidad de una supervisión manual constante.

Esta orquestación de modelos de IA refuerza los flujos de trabajo y allana el camino para una mejor gobernanza y entornos de producción escalables.

Los patrones de flujo de trabajo de la IA son enfoques estructurados diseñados para abordar desafíos empresariales específicos. Estos marcos integran modelos, fuentes de datos y supervisión humana para crear sistemas de producción confiables.

Los flujos de trabajo de RAG vinculan los modelos de IA generativa con la base de conocimiento interna de una empresa, lo que reduce las imprecisiones y mejora la confiabilidad de las tareas basadas en el conocimiento. A diferencia de basarse únicamente en los datos de entrenamiento de un modelo, RAG recupera la información relevante de fuentes como bases de datos vectoriales, almacenes de documentos o API antes de generar una respuesta.

Estos flujos de trabajo implican la ingesta, la segmentación, la incrustación y el almacenamiento de datos para una recuperación rápida, lo que mejora la precisión de los hechos. Cuando se realiza una consulta, el sistema recupera los fragmentos de datos relevantes y los suministra al modelo lingüístico para obtener una respuesta más precisa.

«RAG reduce la probabilidad de alucinaciones al proporcionar al LLM información relevante y objetiva». - Hayden Wolff, ingeniero de marketing técnico de NVIDIA

RAG es particularmente útil para gestionar información privada, como políticas de recursos humanos, manuales técnicos o registros de ventas. También es una alternativa rentable al ajuste fino, ya que mejora la calidad de los resultados sin la sobrecarga computacional que implica ajustar las ponderaciones de los modelos. Para mantener la precisión, los equipos deben actualizar periódicamente sus bases de datos vectoriales con datos nuevos y utilizar técnicas de búsqueda híbridas que combinen la similitud semántica con la coincidencia de palabras clave.

Basándose en estas técnicas de recuperación, la generación de contenido en varios pasos ofrece una forma de refinar los resultados de la IA mediante el procesamiento secuencial.

La creación de contenido complejo a menudo requiere dividir las tareas en distintas etapas, como la redacción, la revisión, el refinamiento y la finalización. Uso de flujos de trabajo de varios pasos encadenamiento rápido, donde varias llamadas de IA se vinculan entre sí, y cada paso mejora con respecto al resultado anterior. Por ejemplo, un modelo puede redactar el contenido, otro puede revisarlo para comprobar su tono y precisión, y un tercero puede gestionar el formato.

Estos flujos de trabajo pueden incluir pausas para la revisión o aprobación manual, lo que garantiza la calidad antes de pasar al siguiente paso. Al gestionar las solicitudes como componentes modulares y versionados y al utilizar el almacenamiento en caché determinista, los equipos pueden reducir tanto el uso de los tokens como la latencia. Además, se pueden implementar estrategias alternativas para cambiar a modelos más simples o más rentables si el modelo principal presenta problemas como la latencia o los límites de los tokens.

Del mismo modo, los flujos de trabajo de comprensión de documentos utilizan procesos secuenciales para transformar el contenido no estructurado en datos procesables.

Las organizaciones suelen tratar con grandes volúmenes de documentos no estructurados que deben analizarse, clasificarse y convertirse en formatos estructurados. Los flujos de trabajo de comprensión de documentos automatizan este proceso, lo que facilita la extracción de información procesable de diversos tipos de documentos.

Estos flujos de trabajo suelen combinar el reconocimiento óptico de caracteres (OCR) para documentos escaneados, el análisis de diseño para conservar el contexto estructural y los modelos lingüísticos para extraer campos específicos o clasificar categorías de documentos. Por ejemplo, un sistema de procesamiento de facturas puede extraer los nombres, las fechas, las partidas y los totales de los proveedores y, a continuación, reenviar los datos estructurados a los sistemas de contabilidad para la aprobación del pago.

El Planificar y ejecutar El patrón separa la fase de planificación de la ejecución. Una IA «planificadora» describe un proceso paso a paso, mientras que un «ejecutor» lleva a cabo las tareas, lo que mejora la fiabilidad y simplifica la depuración. Para los flujos de trabajo en los que interviene información confidencial, los filtros de gestión de errores son esenciales para evitar que se produzcan fallos en cascada en los procesos de varios pasos.

Administrar los costos, garantizar la confiabilidad y cumplir con los principios de gobierno son fundamentales para escalar los flujos de trabajo de IA de manera efectiva. La escalabilidad no solo exige gastos predecibles, sino también un tiempo de actividad constante y medidas de cumplimiento claras. Los proyectos de IA suelen experimentar un patrón de costos «en zigzag» - gastos iniciales elevados durante la preparación de los datos, costos fluctuantes en las etapas de prueba de concepto y gastos más estables una vez que se liquidan las cargas de trabajo de inferencia. Sin una supervisión adecuada, los equipos corren el riesgo de agotar los presupuestos incluso antes de que los flujos de trabajo lleguen a la fase de producción.

Mantener el gasto en IA bajo control requiere herramientas como el monitoreo de solicitudes y tokens en tiempo real, alertas presupuestarias y etiquetas de costos específicas para cada departamento. Los factores de supervisión, como la longitud de los mensajes, el tamaño de las respuestas y las dimensiones vectoriales, pueden ayudar a reducir los costos de uso y almacenamiento de los tokens. Estrategias como almacenamiento en caché rápido para las consultas de uso frecuente reduce los gastos redundantes, mientras que el almacenamiento en caché determinista reduce la latencia sin comprometer la precisión.

La selección del hardware desempeña un papel clave en la rentabilidad. Por ejemplo, el uso de hardware de IA especializado como AWS Trainium para la formación y Inferencia de AWS para la inferencia puede reducir significativamente los costos de procesamiento. La decisión de ajustar los modelos básicos existentes o entrenar otros nuevos desde cero es otro paso importante para evitar gastos de formación inicial innecesarios. Además, formar un junta de gobierno interfuncional que incluye asuntos legales, de recursos humanos, de TI y de compras, garantiza una implementación ética y, al mismo tiempo, mantiene los costos predecibles en toda la organización.

Además de la administración de costos, es igualmente esencial crear flujos de trabajo que puedan recuperarse rápidamente de las interrupciones.

Los flujos de trabajo de IA pueden sufrir errores inesperados (como tiempos de espera de API, alucinaciones con modelos o límites de velocidad) que interrumpen las operaciones. ¿Empleando reintentos automatizados con retrocesos exponenciales puede solucionar problemas temporales de la red, mientras que las comprobaciones de estado proactivas supervisan el rendimiento del sistema y activan acciones de recuperación cuando surgen problemas. La adopción de diseños modulares y un enfoque de responsabilidad única ayuda a limitar los puntos de falla y simplifica la solución de problemas.

La transparencia es crucial, especialmente en las industrias reguladas. Los registros de auditoría deben capturar las decisiones modelo, el acceso a los datos y las acciones políticas. La asignación de identidades únicas (por ejemplo, Microsoft Entra Agent Identity) permite rastrear la propiedad de los agentes y el historial de versiones. Plataformas de observabilidad centralizadas como Análisis de registros de Azure proporcionan paneles en tiempo real para supervisar el comportamiento, el rendimiento y el cumplimiento de los agentes en los sistemas distribuidos.

Para cumplir con las regulaciones de datos como el GDPR o la HIPAA, haga cumplir soberanía de datos identificando dónde se encuentran las fuentes de datos y los tiempos de ejecución. El control de acceso basado en roles (RBAC) y las cuentas de servicio delimitadas garantizan que los agentes hereden los permisos de los usuarios, lo que evita el acceso no autorizado. Antes de pasar a la fase de producción, lleve a cabo pruebas contradictorias tipo «red teaming» para descubrir vulnerabilidades, como la inyección rápida de datos o la filtración de datos. Conserve «tarjetas modelo» que documenten la intención del modelo, los datos de capacitación y los procesos de toma de decisiones para respaldar la preparación para la auditoría.

Prompts.ai da el siguiente paso en la integración de la IA al permitir a las organizaciones escalar los flujos de trabajo en toda su operación. Al consolidar más de 35 modelos de primer nivel, incluidos GPT-5, Claudio, Llama, y Géminis - en una interfaz optimizada, la plataforma simplifica el uso de las herramientas al tiempo que garantiza el cumplimiento de los estándares empresariales. Esta configuración unificada crea una ruta eficiente desde los prototipos iniciales hasta la implementación a gran escala, al tiempo que mantiene la gobernanza, la supervisión de los costos y la resiliencia operativa.

El paso del concepto a la producción a menudo fracasa sin la supervisión y la gobernanza adecuadas. Prompts.ai cierra esta brecha al ofrecer un conjunto de herramientas completo que incluye comparaciones de modelos en paralelo, seguimiento en tiempo real y registros de auditoría detallados. Los equipos pueden experimentar con los flujos de trabajo utilizando créditos TOKN de pago por uso, lo que evita el compromiso de suscripciones recurrentes y, al mismo tiempo, mantiene una visibilidad total de los costos. Una vez que un flujo de trabajo demuestra su valor, la plataforma facilita la escalación a la producción, e incluye controles de acceso basados en funciones y comprobaciones de estado automatizadas para garantizar el cumplimiento y la estabilidad a nivel empresarial.

La incorporación eficiente es clave para una adopción generalizada en las organizaciones. Prompts.ai acelera este proceso a través de recursos como Universidad de Gumloop, los cursos autodidácticos, las cohortes de aprendizaje de una semana de duración y el asistente de inteligencia artificial Gummie, que ayuda a los equipos a crear flujos de trabajo utilizando el lenguaje natural. Las herramientas adicionales, como una biblioteca de plantillas listas para usar, una comunidad de apoyo en Slack y seminarios web en directo, garantizan que los equipos tengan todo lo que necesitan para empezar a trabajar de inmediato.

Para las empresas con sede en EE. UU., los flujos de trabajo deben alinearse con los estándares y expectativas locales. Para ello, Prompts.ai localiza automáticamente los datos de salida en formatos como MM/DD/AAAA para las fechas, unidades imperiales para las medidas y USD para los informes de costes (por ejemplo, 1.234,56$). Esto elimina la necesidad de realizar ajustes manuales en los informes de cumplimiento, los paneles financieros o los materiales destinados a los clientes. Los consejos de gobierno interdisciplinarios pueden configurar estos ajustes de localización una vez y todos los flujos de trabajo relacionados los heredarán sin problemas, lo que permitirá ahorrar tiempo y garantizar la coherencia.

Creando flujos de trabajo de IA eficientes exige una combinación de supervisión centralizada, integración fluida, y resultados mensurables. Al reunir los modelos de IA en una sola plataforma, las organizaciones pueden obtener una visibilidad instantánea de los costos, el rendimiento y el cumplimiento, lo que pone fin al caos provocado por la desconexión de las herramientas y los procesos manuales. Dado que el 92% de los ejecutivos anticipa que sus flujos de trabajo estarán digitalizados y habilitados para la IA en 2025, tomar medidas rápidas es esencial para mantenerse a la vanguardia en un panorama competitivo.

Prompts.ai ofrece una solución integral basada en estos principios. Al integrar más de 35 modelos de IA líderes en una sola interfaz, la plataforma simplifica las operaciones durante la integración Controles de costos de FinOps para supervisar los gastos en tiempo real. Los controles de gobierno se automatizan para garantizar el cumplimiento de la normativa, y el sistema de créditos TOKN de pago por uso alinea los gastos con el uso real. Funciones como las comparaciones de modelos y los registros de auditoría completos facilitan a las empresas la transición de la experimentación a la producción a gran escala. Para las empresas estadounidenses, la plataforma incluye soporte localizado, lo que garantiza una implementación uniforme en todos los equipos.

Los beneficios de este enfoque unificado son evidentes en los resultados obtenidos por empresas como Toyota y Camping World. Toyota informó de un Reducción del 50% en el tiempo de inactividad y un Reducción del 80% en las averías de los equipos tras adoptar flujos de trabajo de mantenimiento predictivo impulsados por la IA. Mientras tanto, Mundo del camping vio un Aumento del 40% en la participación de los clientes y reduzca los tiempos de espera a solo 33 segundos por Automatización de tareas impulsada por IA. Estos éxitos se hacen eco de la perspectiva de Rob Thomas, vicepresidente sénior de software y director comercial de IBM, quien señaló:

«En lugar de quitarle el trabajo a todos, como algunos temían, [la IA] podría mejorar la calidad del trabajo que se está realizando al hacer que todos sean más productivos».

Escalar los flujos de trabajo de IA de manera eficaz requiere una orquestación inteligente. Prompts.ai convierte la experimentación fragmentada en procesos estructurados, repetibles y conformes con las normas que ofrecen resultados reales. Como el 80% de las organizaciones ya buscan la automatización integral, las plataformas que combinan la gobernanza, la transparencia de los costos y la optimización del rendimiento darán forma al futuro de la productividad empresarial. Al unificar estos elementos, Prompts.ai permite a las empresas ir más allá de los esfuerzos aislados y adoptar la IA como piedra angular de su estrategia operativa.

La integración de datos desempeña un papel crucial en el éxito de los proyectos de IA al reunir diversas fuentes de datos en un sistema único, limpio y con un formato uniforme. Este enfoque elimina los silos de datos y minimiza los errores, lo que permite a los modelos de IA procesar la información de manera más eficiente. Con las canalizaciones de datos unificadas, es posible realizar transformaciones reutilizables, lo que reduce el uso de scripts manuales y ahorra un tiempo valioso, al tiempo que garantiza resultados consistentes.

La automatización es una ventaja clave de la integración de datos. Las tareas como la limpieza, el enriquecimiento y la extracción de funciones se transforman en flujos de trabajo escalables capaces de gestionar conjuntos de datos extensos. Esto garantiza que los datos de alta calidad estén siempre disponibles para entrenar modelos de IA, lo que reduce los errores y mejora el rendimiento general. Además, las organizaciones obtienen una visibilidad en tiempo real de la calidad de los datos, lo que les permite identificar y resolver los problemas de forma temprana, lo que ayuda a evitar complicaciones más adelante en el proceso.

Cuando se combina con herramientas de orquestación, la integración de datos permite una automatización perfecta de principio a fin. Esto optimiza el uso de los recursos, escala las cargas de trabajo y garantiza operaciones fluidas y, en última instancia, reduce los tiempos de iteración y los costos. Al adoptar este enfoque integral, las organizaciones están mejor posicionadas para ofrecer soluciones de IA eficientes y listas para la producción.

La orquestación de modelos desempeña un papel fundamental en la simplificación de los flujos de trabajo de la IA al garantizar que varios modelos funcionen juntos sin problemas. Gestiona la secuencia de ejecución, el movimiento de datos y la distribución de los recursos, garantizando que cada modelo funcione de manera eficiente y en el momento adecuado. Esto no solo elimina las demoras innecesarias, sino que también reduce la complejidad operativa, lo que se traduce en una reducción notable de los costos.

Además de reducir los costos, la orquestación aumenta tanto la escalabilidad como la confiabilidad. Los equipos pueden aprovechar los componentes de flujo de trabajo modulares y reutilizables, lo que acelera el desarrollo de nuevos procesos de IA sin necesidad de empezar desde cero. Al automatizar tareas como la gestión de errores, el seguimiento del progreso y la gestión del flujo de datos, la orquestación mantiene los sistemas de IA responsivos, seguros y listos para adaptarse a las cambiantes demandas empresariales.

La gobernanza desempeña un papel clave a la hora de ampliar la IA en sectores estrictamente regulados, como las finanzas, la sanidad y la energía. Garantiza el cumplimiento de normas estrictas al tiempo que salvaguarda la confianza y la seguridad. Al implementar un marco de gobierno claro, las organizaciones pueden establecer políticas definidas sobre cómo se utilizan los datos, hacer un seguimiento del rendimiento de los modelos y mantener la auditabilidad. Esto permite rastrear las decisiones hasta las fuentes aprobadas y garantiza que cualquier cambio esté debidamente documentado. Estas medidas no solo protegen la información confidencial, sino que también ayudan a evitar las sanciones reglamentarias y a fortalecer la confianza de las partes interesadas a medida que se expanden los sistemas de inteligencia artificial.

En los sectores en los que los riesgos son especialmente altos, la ampliación de la IA puede exponer a las organizaciones a mayores vulnerabilidades. Una gobernanza eficaz ayuda a abordar estos riesgos mediante la supervisión continua, las comprobaciones de cumplimiento automatizadas y los controles de acceso basados en funciones que evitan los cambios o las infracciones no autorizados. La integración de los estándares éticos y de seguridad a lo largo del ciclo de vida de la IA permite a las empresas implementar y actualizar modelos con confianza y, al mismo tiempo, cumplir con normativas como la HIPAA, el RGPD u otras normas específicas del sector. Esto convierte a la gobernanza en la piedra angular para expandir las capacidades de IA de manera segura y eficiente.