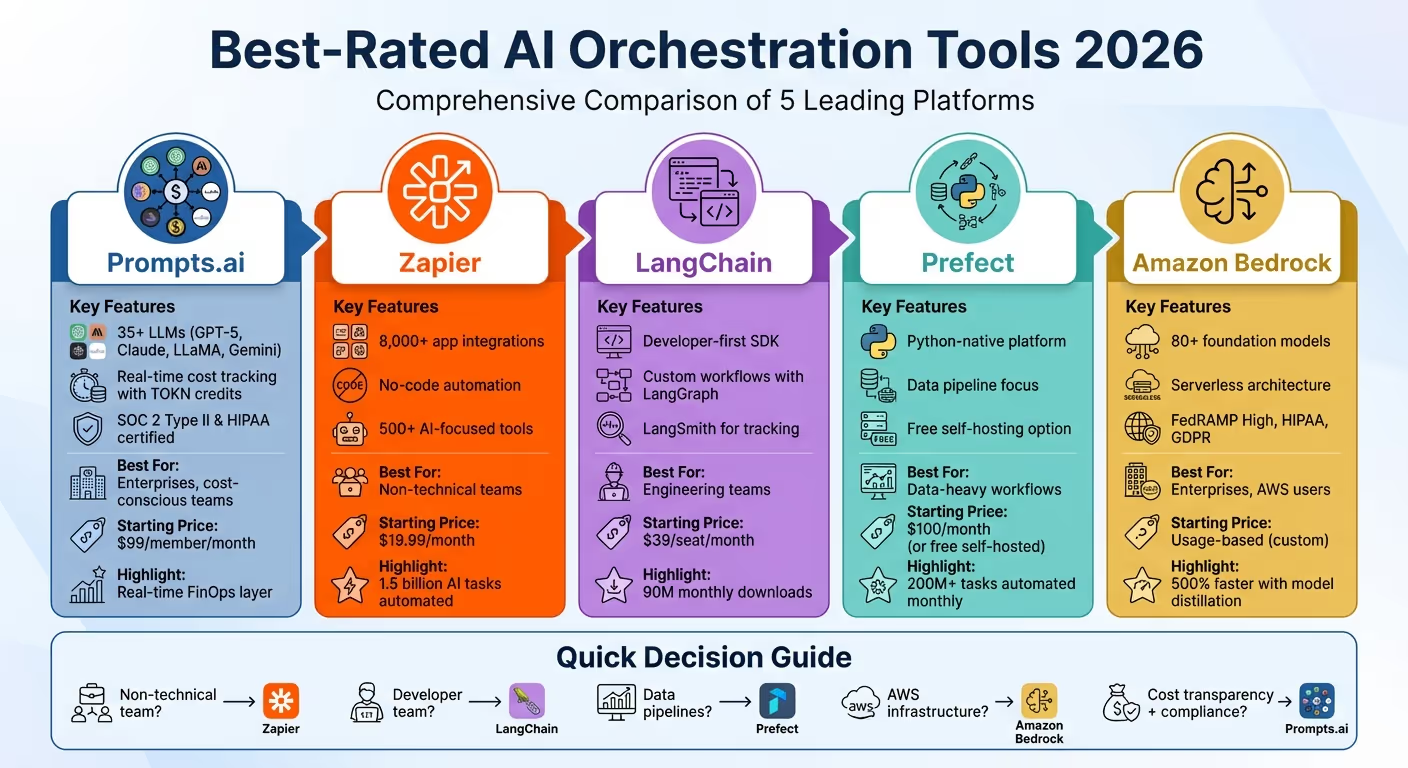

Les outils d'orchestration de l'IA simplifient la gestion des flux de travail complexes en connectant les modèles, les ensembles de données et les applications d'IA. Ces plateformes réduisent la prolifération des outils, rationalisent les processus et garantissent la sécurité et la conformité. En 2026, cinq plateformes de premier plan se démarquent, chacune répondant à des besoins différents :

Ces outils varient en termes de complexité technique, de structure de coûts et d'évolutivité. Il est donc essentiel de les adapter à l'expertise et aux objectifs de votre équipe.

Chaque plateforme possède des atouts uniques, que vous ayez besoin d'une simplicité sans code, de flexibilité pour les développeurs ou d'une conformité de niveau professionnel. Choisissez en fonction des besoins et de l'expertise technique de votre équipe.

Outils d'orchestration AI 2026 : comparaison des fonctionnalités et des prix

Prompts.ai réunit Plus de 35 LLM de premier plan - y compris GPT-5, Claude, LLama et Gemini, sur une seule plateforme rationalisée. Oubliez la gestion de plusieurs connexions pour des fournisseurs tels que IA ouverte, Anthropique, et Google ; cette interface unifiée permet aux équipes d'accéder facilement à tous les modèles en un seul endroit, éliminant ainsi les obstacles inutiles.

Grâce à son accès centralisé, Prompts.ai simplifie les comparaisons de modèles. Le outil de comparaison côte à côte permet aux équipes de tester simultanément la même invite sur différents modèles. Cette fonctionnalité est précieuse pour prendre des décisions éclairées. Que vous évaluiez GPT-5 pour des tâches créatives ou Claude pour la rédaction technique, vous pouvez évaluer leurs performances sans avoir à basculer entre les systèmes ou à jongler avec les clés API.

Prompts.ai remplace les tracas liés à plusieurs abonnements par un système de crédit TOKN à paiement à l'utilisation. Ce système suit les dépenses en temps réel sur tous les modèles, offrant une transparence grâce à une couche FinOps intégrée. Les équipes peuvent surveiller l'utilisation des jetons par projet, service ou utilisateur, tandis que les équipes financières bénéficient d'un tableau de bord consolidé qui met en évidence les habitudes de dépenses. Cette configuration permet d'identifier plus facilement les flux de travail coûteux et de choisir des modèles en fonction de l'utilisation réelle, maximisant ainsi l'efficacité.

Conçu pour les industries soumises à des exigences réglementaires strictes, Prompts.ai est Certifié SOC 2 Type II et HIPAA, avec une surveillance continue par Vanta. La plateforme comprend des contrôles d'accès basés sur les rôles (RBAC) et des pistes d'audit détaillées, garantissant que chaque interaction avec l'IA est enregistrée et traçable. Ces fonctionnalités sont essentielles pour les organisations qui ont besoin de démontrer leur conformité lors d'audits ou de révisions, et elles sont intégrées directement à l'infrastructure de la plateforme.

À partir de 99$ par membre et par mois pour le plan Core, Prompts.ai évolue sans effort pour répondre aux besoins croissants. Les niveaux Pro et Elite sont disponibles à 119$ et 129$, respectivement. L'architecture de la plateforme est conçue pour gérer des équipes, des utilisateurs et des modèles en pleine expansion, ce qui en fait une solution flexible pour les entreprises qui souhaitent développer leurs capacités d'IA au fil du temps.

Zapier connecte plus de 8 000 applications, dont plus de 500 outils axés sur l'IA tels que Chat GPT, Claude, Gemini et Perplexité. Avec plus de 1,5 milliard de tâches d'IA automatisées et plus d'un million d'entreprises faisant confiance à ses services, Zapier est devenu une référence en matière d'automatisation. Fait impressionnant, 87 % des entreprises du Forbes Cloud 100 utilisent Zapier, ce qui souligne son rôle dans la rationalisation des opérations commerciales. Cette connectivité étendue en fait une solution incontournable pour intégrer l'IA dans les flux de travail.

La fonctionnalité « AI by Zapier » de Zapier simplifie l'accès aux grands modèles de langage (LLM) sans avoir à gérer des clés d'API distinctes. Son protocole MCP (Model Context Protocol) permet à des outils d'IA externes tels que ChatGPT et Claude d'effectuer en toute sécurité plus de 30 000 actions au sein de l'écosystème de Zapier. Les équipes peuvent même créer des agents Zapier autonomes, capables de gérer des recherches et d'exécuter des tâches en plusieurs étapes basées sur des commandes en langage naturel.

En 2025, Marcus Saito, responsable de l'automatisation informatique et de l'IA chez télécommande, a mis en œuvre un système piloté par l'IA à l'aide de Zapier qui a permis d'économiser l'équivalent de 2 200 jours de travail par mois. Cette automatisation a également permis de résoudre 28 % des tickets de support, permettant à une petite équipe de trois personnes de gérer efficacement le support de 1 700 employés. Comme l'a dit Saito :

« Zapier donne à notre équipe de trois l'impression d'être une équipe de dix ».

Ces intégrations améliorent non seulement l'efficacité, mais réduisent également de manière significative les coûts du flux de travail en réduisant les configurations manuelles.

Les outils no-code de Zapier éliminent le besoin d'une assistance coûteuse pour les développeurs lors de la création d'intégrations. Des fonctionnalités telles que les limites de jetons et les filtres permettent aux utilisateurs de hiérarchiser les tâches à forte valeur ajoutée, tandis que les tables et interfaces Zapier, dont les déclencheurs et les actions ne sont pas considérés comme des tâches, contribuent à réduire davantage les coûts. Le tableau de bord analytique de la plateforme fournit des informations sur le coût par exécution, permettant aux équipes de mesurer efficacement le retour sur investissement.

Jacob Sirrs, spécialiste des opérations marketing chez Vendasta, a utilisé Zapier pour automatiser les tâches administratives, économisant 282 jours de travail manuel par an et récupérant 1 million de dollars de revenus potentiels. En automatisant les processus, l'équipe a également gagné 15 minutes par appel commercial, rationalisant ainsi ses opérations.

Zapier donne la priorité à la sécurité et à la conformité, en détenant des certifications telles que SOC 2 Type II, SOC 3, GDPR et CCPA. Pour les utilisateurs professionnels, les données sont automatiquement exclues de la formation de modèles d'IA tiers, et les autres utilisateurs peuvent se désinscrire manuellement. La plateforme propose également des fonctionnalités robustes telles que les autorisations basées sur les rôles, l'authentification unique (SSO/SAML), le SCIM pour le provisionnement automatisé et des journaux d'audit détaillés pour surveiller les activités d'automatisation. Les administrateurs informatiques peuvent contrôler davantage l'accès à des outils d'IA tiers spécifiques via Application Controls.

Connor Sheffield, responsable des opérations marketing et de l'automatisation chez Zones, a souligné :

« Les clients nous font confiance pour assurer la sécurité de leurs données. Je suis sûr à 100 % que Zapier gère ces données avec la plus grande sécurité ».

La conception modulaire de Zapier lui permet de s'adapter sans effort aux entreprises en pleine croissance. Son architecture prend en charge l'évolutivité horizontale, ce qui permet de maintenir les performances même lorsque les volumes de flux de travail augmentent. Les équipes peuvent décomposer les flux de travail en composants réutilisables, ce qui permet d'étendre plus facilement les initiatives d'IA à différents services. Avec Zapier Canvas, les utilisateurs peuvent concevoir visuellement et affiner des processus complexes avant de les déployer.

Spencer Siviglia, directeur des opérations chez Toyota d'Orlando, a utilisé les agents Zapier pour gérer plus de 30 000 enregistrements de prospects. Cette automatisation a permis à son équipe de gagner plus de 20 heures par semaine en identifiant les incohérences dans les données et en générant des informations exploitables.

Les forfaits commencent à 19,99$ par mois pour le niveau professionnel (facturés annuellement), tandis que les forfaits Team coûtent 69$ par mois et des tarifs personnalisés sont disponibles pour les utilisateurs Enterprise.

LangChain est le framework d'agents le plus téléchargé au monde, avec 90 millions de téléchargements mensuels et plus de 100 000 étoiles GitHub. Il s'agit d'une solution fiable pour l'orchestration de l'IA, utilisée par les plus grandes entreprises technologiques telles que Réplique, Cloudflare, Journée de travail, Klarna, et Élastique. Son approche simplifie la gestion des flux de travail liés à l'IA, ce qui en fait un outil essentiel pour les entreprises.

LangChain fournit une couche d'abstraction unifiée, permettant une intégration transparente des modèles provenant de fournisseurs tels qu'OpenAI, Anthropic et Google. Pour gérer des flux de travail complexes, il utilise LangGraph, qui crée des pipelines dynamiques en plusieurs étapes avec une exécution durable et des points de contrôle manuels.

Pour garantir des performances fiables, Lang Smith fournit des informations sur les chemins d'exécution des agents et les mesures d'exécution. Un utilisateur a bien décrit son utilité :

« LangChain est le moyen le plus simple de commencer à créer des agents et des applications alimentés par des LLM. »

Cependant, la plate-forme présente une courbe d'apprentissage plus abrupte, favorisant les personnes ayant une expertise en ingénierie par rapport à celles qui se concentrent sur une conception simple et rapide. Ces capacités techniques sont complétées par des fonctionnalités de sécurité robustes adaptées aux besoins des entreprises.

LangSmith offre une sécurité de haut niveau grâce à des certifications telles que la conformité SOC 2 Type 2, HIPAA et au RGPD, ainsi que des fonctionnalités de suivi fournissant une piste d'audit claire, essentielle pour les secteurs soumis à des exigences réglementaires strictes. LangGraph prend également en charge l'approbation manuelle des actions critiques de l'IA, ajoutant ainsi un niveau de contrôle supplémentaire.

Comme indiqué dans la documentation :

« LangSmith répond aux normes les plus strictes en matière de sécurité et de confidentialité des données grâce à la conformité aux normes HIPAA, SOC 2 Type 2 et RGPD. »

LangChain est conçu dans un souci d'évolutivité. Déploiement de LangSmith propose une infrastructure horizontale et prête à la production avec des API de dimensionnement automatique pour gérer les flux de travail de longue durée. De plus, les points de contrôle permanents de LangGraph permettent aux flux de travail de reprendre en douceur après des interruptions.

La tarification comprend un niveau gratuit avec 5 000 traces par mois, un plan Plus à partir de 39$ par siège et par mois et une tarification Enterprise personnalisée disponible sur demande.

Prefect propose une solution axée sur Python pour rationaliser les flux de travail en processus efficaces pilotés par l'IA. Avec des décorateurs simples comme @flow et @task, il transforme le code Python en flux de travail prêts pour la production sans avoir besoin de configurations YAML complexes. Chaque mois, Prefect automatise plus de 200 millions de tâches liées aux données pour plus de 25 000 praticiens.

Du préfet Intégration FastMCP fournit directement du contexte aux agents d'IA, permettant ainsi de puissantes boucles LLM avec des commandes intégrées à l'humain. Son serveur MCP permet une surveillance et un débogage en temps réel, tandis qu'une exécution durable garantit la reprise des flux de travail à partir de points de défaillance en enregistrant les résultats intermédiaires.

Le modèle d'exécution hybride de la plateforme assure la sécurité des données sensibles et des clés d'API LLM au sein de votre infrastructure. Les travailleurs récupèrent les instructions en interrogeant l'API Prefect, en transmettant uniquement des métadonnées au plan de contrôle. Cette architecture a joué un rôle déterminant pour des organisations telles que Plongée avec tuba AI, où Smit Shah, directeur de l'ingénierie, a fait la remarque suivante :

« Nous avons multiplié par 20 le débit grâce à Prefect. C'est notre outil de travail en matière de traitement asynchrone : un couteau suisse ».

Leur équipe gère désormais plus de 1 000 flux de travail par heure à l'aide du moteur open source de Prefect.

Du préfet sécurité Zero Trust Ce modèle élimine le besoin de connexions réseau entrantes, préservant ainsi l'intégrité du pare-feu lorsque les employés interrogent les tâches planifiées. Les fonctionnalités destinées aux entreprises incluent l'authentification unique (SSO), le contrôle d'accès basé sur les rôles (RBAC) au niveau du compte et de l'espace de travail, ainsi que des journaux d'audit détaillés pour toutes les actions. Prefect répond également à des normes de conformité strictes telles que FedRAMP, HIPAA et PCI-DSS, avec des options de déploiement qui incluent des configurations hybrides, PrivateLink et gérées par le client.

À Application Cash, Wendy Tang, ingénieure en machine learning, a utilisé Prefect pour moderniser les flux de travail de prévention des fraudes, soulignant ainsi son rôle dans l'amélioration du provisionnement de l'infrastructure. Le suivi de lignage intégré simplifie davantage l'analyse des causes profondes, en particulier dans les environnements réglementés.

La sortie de Prefect 3.0 en 2024 a considérablement réduit les frais d'exécution jusqu'à 90 %. C'est pools de travail séparer la logique des flux de travail des environnements d'exécution, ce qui permet de basculer facilement entre Docker, Kubernetes, ou des plateformes sans serveur comme AWS ECS sans modification de code. L'exécution dynamique de Prefect adapte les tâches en fonction des données en temps réel ou des sorties LLM, en contournant les limites des structures DAG rigides présentes dans d'autres outils.

Cette flexibilité et ces performances améliorées se traduisent par des économies de coûts mesurables. Endpoint a réduit ses coûts de facturation de 73,78 % tout en triplant sa capacité de production. De même, Louez The Runway réduit les coûts d'orchestration de 70 % en gérant les données de 2,5 millions de clients et de plus de 750 marques. Prefect propose un noyau open source gratuit avec un contrôle complet du VPC, ainsi qu'une option Prefect Cloud gérée qui inclut un niveau gratuit pour les développeurs individuels.

Amazon Bedrock se distingue en tant que plateforme sans serveur conçue pour répondre aux exigences d'évolutivité et de conformité réglementaire. Avec un accès à plus de 80 modèles de fondations, dont Anthropic, Méta, IA Mistral, et Amazon : grâce à une API unique, il propose une approche rationalisée pour les entreprises. Conçue avec une sécurité de niveau professionnel, la plateforme est particulièrement adaptée aux secteurs soumis à des exigences réglementaires strictes.

Flux rocheux fournit une interface visuelle permettant de connecter les modèles de base, les instructions et les services AWS. Laura Skylaki, vice-présidente de l'intelligence artificielle chez Thomson Reuters, a souligné sa valeur :

« Bedrock Flows nous permettra de créer des flux de travail complexes, flexibles et multiprompts que nous pourrons facilement évaluer, comparer et modifier. Nous pouvons également intégrer rapidement des flux à nos applications à l'aide des API du SDK pour une exécution de flux sans serveur, sans perdre de temps dans le déploiement et la gestion de l'infrastructure ».

Agents fondamentaux gérez les interactions entre les modèles et les sources de données à l'aide de groupes d'actions définis via des schémas OpenAPI, exécutés via des fonctions Lambda. Le Passerelle AgentCore garantit un accès sécurisé aux données de l'entreprise via le protocole Model Context. Par exemple, une entreprise de marketing Epsilon ont réduit le temps de développement de leurs agents de plusieurs mois à plusieurs semaines et ont automatisé des flux de campagne complexes à l'aide d'AgentCore. Cette intégration reflète les flux de travail fluides que l'on retrouve sur d'autres plateformes de premier plan, améliorant ainsi la productivité.

Bedrock utilise plusieurs stratégies de réduction des coûts pour maximiser l'efficacité :

Robinhood est passé de 500 millions à 5 milliards de jetons par jour en seulement six mois grâce à Bedrock, ce qui a permis de réduire de 80 % les coûts de l'IA et de réduire de moitié le temps de développement. Dev Tagare, responsable de l'IA chez Robinhood, a partagé :

« Les fonctionnalités de diversité des modèles, de sécurité et de conformité d'Amazon Bedrock sont spécialement conçues pour les secteurs réglementés ».

Ces caractéristiques renforcent l'accent mis par Bedrock sur l'efficacité et la transparence des coûts.

Pour les industries soumises à des exigences réglementaires strictes, Bedrock fournit des garde-corps robustes. Garde-corps Bedrock filtrez 88 % des contenus préjudiciables et utilisez le raisonnement automatique pour vérifier les réponses des modèles avec une précision allant jusqu'à 99 %. Pour les charges de travail de génération augmentée par extraction (RAG), les vérifications d'ancrage contextuelles filtrent plus de 75 % des réponses hallucinées. Il est important de noter que les données des clients ne sont jamais stockées ni utilisées pour entraîner des modèles, et toutes les données sont cryptées à la fois en transit et au repos. Bedrock est conforme aux normes ISO, SOC, CSA STAR niveau 2, GDPR, FedRAMP High et est éligible à la HIPAA.

Bedrock's architecture sans serveur évolue sans effort pour répondre à la demande. Le Runtime AgentCore s'intègre à AWS Lambda et Amazon ECS, en ajustant le comportement des agents de manière dynamique. En utilisant Fonctions AWS Step, la plateforme peut exécuter des flux de travail pour chaque élément de la baie S3, permettant ainsi un mappage distribué pour des milliers de flux de travail simultanés sans supervision manuelle. Cela permet aux entreprises de gérer facilement des charges de travail étendues.

Le choix du meilleur outil d'orchestration de l'IA dépend de l'expertise technique, des priorités budgétaires et des besoins de conformité de votre équipe. Chaque plateforme possède ses propres forces et limites, d'où l'importance d'aligner les fonctionnalités sur vos objectifs spécifiques.

Le tableau comparatif ci-dessous évalue cinq plateformes en fonction de quatre facteurs de performance clés. Prompts.ai se distingue par l'accès à plus de 35 LLM et une couche FinOps intégrée pour le suivi des coûts en temps réel, ce qui en fait un choix judicieux pour les organisations qui ont besoin de transparence des coûts et d'une conformité rigoureuse (SOC 2 Type II, HIPAA et RGPD). Zapier, avec ses plus de 8 000 intégrations d'applications, est idéale pour les équipes non techniques qui recherchent une mise en œuvre rapide, bien que sa facturation basée sur les tâches puisse entraîner des coûts imprévus lorsque les agents d'IA réessaient des actions pendant le raisonnement. Chaque nouvelle tentative fait grimper la facture. Chaîne Lang propose des mesures granulaires des coûts et de la latence via LangSmith, fournissant aux développeurs des informations détaillées pour affiner les flux de travail, mais nécessite une expertise technique pour tirer pleinement parti de ses fonctionnalités. Préfet propose une option d'auto-hébergement pour éviter les frais d'abonnement, bien que cela se fasse au détriment des fonctionnalités gérées telles que les webhooks et les automatisations. Enfin, Substrat rocheux d'Amazon s'adapte parfaitement à AWS et utilise un modèle de tarification basé sur l'utilisation, mais les petites équipes peuvent avoir des difficultés à surveiller les coûts en cas de volumes élevés. Ces points forts fournissent un aperçu avant d'approfondir des cas d'utilisation spécifiques.

Un récent Rapport Atlassian sur l'état des produits (2026) a révélé que 46 % des équipes produit citent la mauvaise intégration avec les flux de travail existants comme le principal obstacle à l'adoption de l'IA. Cela souligne l'importance de choisir des outils adaptés aux capacités de l'équipe - Zapier convient parfaitement aux équipes non techniques nécessitant un déploiement rapide, tandis que Chaîne Lang convient aux équipes d'ingénierie qui ont besoin d'une personnalisation approfondie et d'un réglage des performances.

Les données montrent également que les organisations qui s'associent à des solutions d'orchestration externes doublent leurs taux de réussite par rapport à la moyenne de 5 % des projets pilotes d'IA qui atteignent la production. Pour évaluer avec précision les coûts totaux, considérez bien plus que les frais d'abonnement : surveillez les dépenses cachées, telles que les connecteurs premium et les frais d'exécution par exécution. Pour des outils tels que Zapier, la mise en place de points de contrôle intégrés à l'humain peut empêcher les tentatives intempestives d'IA qui font grimper les coûts. Dans les secteurs réglementés, les plateformes dotées de pistes d'audit intégrées et de fonctionnalités de conformité automatisées sont essentielles pour répondre à des normes légales strictes.

Cette comparaison associe des aperçus des fonctionnalités à des informations stratégiques, aidant les entreprises à sélectionner l'outil d'orchestration qui correspond le mieux à leur expertise technique et à leurs objectifs opérationnels. L'adaptation de la plateforme aux capacités de votre équipe garantit une mise en œuvre plus fluide et de meilleurs résultats.

Le choix du bon outil d'orchestration de l'IA dépend de l'expertise, du budget et des exigences de sécurité de votre équipe, ainsi que des atouts uniques de chaque plateforme. Prompts.ai se distingue pour les organisations qui attachent de l'importance à la clarté des coûts et à l'accès à plusieurs LLM. Avec une interface unifiée vers plus de 35 modèles, un suivi FinOps en temps réel et des crédits TOKN payables à l'utilisation, éliminant ainsi les frais d'abonnement récurrents, il offre une solution pratique pour gérer efficacement les flux de travail d'IA. Pour les petites entreprises ou les équipes non techniques disposant de budgets plus serrés, Zapier offre un point de départ facile grâce à son niveau gratuit et à sa large gamme d'intégrations d'applications.

Les différentes plateformes répondent à des besoins variés en fonction de la taille de l'équipe et des exigences techniques :

Ces informations reflètent une évaluation approfondie des fonctionnalités et des applications pratiques de chaque outil. Les organisations qui collaborent avec des partenaires d'orchestration externes voient notamment leurs taux de réussite doubler par rapport à la norme de 5 % des pilotes d'IA qui arrivent en production. Cela souligne l'importance de choisir des outils adaptés à vos besoins opérationnels dès le départ. En faisant un choix judicieux, vous préparez le terrain pour un écosystème de flux de travail basé sur l'IA efficace, évolutif et sécurisé, comme indiqué dans cette revue.

Lors de la sélection d'un outil d'orchestration d'IA, il est essentiel de commencer par capacités d'intégration. La plateforme doit se connecter sans effort à votre écosystème existant, qu'il s'agisse de sources de données, d'API ou de systèmes DevOps, afin de permettre aux flux de travail de fonctionner correctement sans nécessiter de configurations personnalisées étendues. En outre, il doit prendre en charge les déploiements sur site et dans le cloud, donnant à votre équipe la flexibilité nécessaire pour équilibrer les coûts et répondre aux exigences de conformité.

Portez une attention particulière à évolutivité, gouvernance et gestion des coûts. L'outil doit être équipé pour gérer l'augmentation des données et des charges de travail tout en offrant une visibilité claire sur l'utilisation des ressources. Le suivi des dépenses en temps réel peut vous aider à éviter les surprises, tandis que des fonctionnalités telles que le contrôle d'accès basé sur les rôles, les journaux d'audit et les contrôles de conformité garantissent la sécurité et le respect des normes réglementaires.

Enfin, ne négligez pas facilité d'utilisation et support. Une interface simple, une documentation complète et un service client réactif peuvent faire toute la différence pour réduire la courbe d'apprentissage et maintenir l'efficacité de votre équipe. L'accès à une communauté solide ou à un réseau de partenaires peut également améliorer la valeur de la plateforme en proposant des intégrations supplémentaires et en partageant les meilleures pratiques.

Les outils d'orchestration de l'IA sont conçus avec sécurité et conformité en tant que priorités absolues. Ils sont dotés de fonctionnalités robustes telles que des contrôles d'accès basés sur les rôles, le cryptage des données (en transit et au repos) et des journaux d'audit immuables. Ces journaux enregistrent méticuleusement chaque action, y compris l'utilisation du modèle, les transferts de données et les modifications de configuration. Ces mécanismes garantissent l'application stricte des politiques, telles que la restriction des données sensibles aux modèles approuvés, tout en empêchant automatiquement toute activité non conforme. Cette approche favorise le respect de normes critiques telles que SOC 2, ISO 27001, GDPR et HIPAA.

En outre, ces plateformes fournissent des tableaux de bord de conformité en temps réel, des outils de suivi des coûts et des rapports prêts à être audités, ce qui facilite la gestion des processus réglementaires. En consolidant la gestion de plusieurs modèles d'IA dans un seul système de contrôle, ils normalisent les pratiques de sécurité, automatisent la rotation des informations d'identification et génèrent des journaux infalsifiables pour les audits. Ces fonctionnalités permettent aux entreprises de rationaliser leurs flux de travail d'IA en toute confiance, tout en restant en phase avec les exigences du secteur.

Prompts.ai est conçu pour fonctionner sans effort avec les outils et les systèmes dont votre entreprise dépend déjà. Son interface unifiée prend en charge une API REST robuste, ainsi que des SDK Python et JavaScript, ainsi que des fonctionnalités de webhook. Cette flexibilité permet aux développeurs de connecter des applications existantes avec un minimum d'ajustements de code.

La plateforme propose également des connecteurs prédéfinis pour le stockage cloud, les entrepôts de données et les systèmes CI/CD largement utilisés. Ces connecteurs simplifient l'intégration de tâches telles que l'ingestion de données, la formation de modèles et le déploiement dans vos flux de travail actuels. De plus, avec l'accès à plus de 35 grands modèles linguistiques via un seul point de terminaison, la mise à jour ou l'extension de vos capacités d'IA devient un processus simple qui ne perturbera pas vos opérations existantes.

Si votre équipe compte sur Flux d'air Apache, Kubernetes ou des scripts personnalisés, Prompts.ai s'intègre parfaitement à vos flux de travail. Il fournit également des outils de suivi des coûts et de gouvernance en temps réel qui s'intègrent à vos systèmes de surveillance actuels. En éliminant le besoin d'intergiciels complexes, la plateforme aide les entreprises à obtenir des résultats plus rapidement tout en optimisant leur efficacité.