Les flux de travail d'apprentissage automatique sont souvent confrontés à des problèmes d'efficacité en raison de la dispersion des outils et des processus manuels. Cet article évalue huit outils de premier plan conçus pour simplifier, automatiser et optimiser les pipelines d'apprentissage automatique. Chaque outil est évalué en termes d'intégration, d'évolutivité, de gouvernance et de gestion des coûts, afin de répondre à divers besoins, des solutions d'entreprise aux plateformes open source. Les principaux points à retenir sont les suivants :

Chaque outil présente des atouts distincts en fonction de l'expertise de l'équipe, de l'envergure du projet et du budget. Qu'il s'agisse d'automatiser les flux de travail, d'intégrer des LLM ou de gérer de grands ensembles de données, le choix du bon outil peut vous faire gagner du temps, réduire les coûts et améliorer les résultats.

Prompts.ai est une plateforme d'orchestration d'IA au niveau de l'entreprise conçue pour simplifier et améliorer les flux de travail rapides. Il connecte les utilisateurs à plus de 35 modèles d'IA de premier plan, tels que GPT-4, Claude, LLama et Gemini, via une interface unique et rationalisée, éliminant ainsi les tracas liés à la jonglerie entre plusieurs outils d'IA.

La plateforme met l'accent sur la conception visuelle des flux de travail et les fonctionnalités prêtes à l'emploi. Son interface conviviale par glisser-déposer est parfaite pour les experts techniques et les utilisateurs non techniques, car elle permet de créer des flux de travail d'IA avancés qui peuvent facilement passer des tests à la production à grande échelle. Ci-dessous, nous explorerons ses fonctionnalités exceptionnelles en matière d'intégration, d'évolutivité, de conformité et de gestion des coûts.

Prompts.ai se distingue par sa capacité à unifier différents systèmes d'IA grâce à une intégration fluide. Il prend en charge les connexions à un grand modèle linguistique (LLM) multi-fournisseurs, permettant aux équipes de combiner sans effort des modèles de fournisseurs tels que IA ouverte, Anthropique, et Visage étreignant dans un flux de travail cohérent. Au-delà des modèles d'IA, la plateforme s'intègre à des outils populaires tels que Slack, Gmail, et Trello, et propose des API et des connecteurs pour établir des liens avec des sources de données existantes. Cette capacité d'intégration résout efficacement le problème de la surcharge d'outils, en créant un flux de travail plus rationalisé et plus efficace.

Tirant parti de son infrastructure cloud native, Prompts.ai s'adapte à un large éventail de besoins, qu'il s'agisse de simples chaînes d'instructions ou d'automatisations complexes en plusieurs étapes. La plateforme gère facilement des tâches simultanées et de grands volumes de données, ce qui la rend adaptée aux petites équipes ainsi qu'aux opérations à l'échelle de l'entreprise. En juin 2025, GENAI.works a reconnu Prompts.ai comme une plateforme de premier plan pour l'automatisation des entreprises et la résolution de problèmes, soulignant sa fiabilité dans la gestion des charges de travail croissantes. Cette évolutivité correspond également à l'accent mis par la plateforme sur la conformité et l'auditabilité.

Prompts.ai répond à des normes de gouvernance d'entreprise rigoureuses en adhérant aux meilleures pratiques issues de frameworks tels que SOC 2 Type II, HIPAA et GDPR. En partenariat avec Vanta, la plateforme a lancé des audits SOC 2 de type II en juin 2025, renforçant ainsi son engagement en matière de sécurité et de conformité. Des fonctionnalités telles que les contrôles d'accès des utilisateurs, les journaux d'audit détaillés et la gestion rapide des versions garantissent la traçabilité de chaque interaction et le respect des exigences réglementaires.

Prompts.ai aide les organisations à réduire leurs dépenses en centralisant l'accès à plusieurs modèles d'IA. Les entreprises peuvent réduire les coûts liés à l'IA jusqu'à 98 % grâce à sa gestion intelligente des ressources, à ses analyses d'utilisation et à ses outils permettant d'affiner les flux de travail. Les fonctionnalités FinOps en temps réel de la plateforme surveillent l'utilisation des jetons, garantissant ainsi que les dépenses correspondent aux besoins réels. Son système de crédit TOKN pay-as-you-go lie les coûts directement à l'utilisation, ce qui le rend particulièrement pratique pour les entreprises dont la demande en IA fluctue. En centralisant la gestion des ressources et en fournissant des informations exploitables, Prompts.ai définit la norme en matière de flux de travail d'apprentissage automatique efficaces.

Contrairement aux plateformes conçues en mettant l'accent sur les utilisateurs professionnels, n8n se distingue par son modèle open source qui privilégie la flexibilité et la rentabilité. Cette plateforme d'automatisation des flux de travail permet aux organisations de concevoir, de personnaliser et de déployer des flux de travail d'apprentissage automatique (ML) sans être liées à un fournisseur spécifique. Son interface visuelle le rend accessible à la fois aux experts techniques et aux membres de l'équipe non techniques, comblant ainsi le fossé entre les différents ensembles de compétences.

n8n propose une version gratuite avec des fonctionnalités de base pour les utilisateurs individuels, ainsi qu'une édition d'entreprise pour ceux qui ont des besoins plus avancés. Cela en fait un choix attrayant pour les équipes qui souhaitent mettre en œuvre des flux de travail de machine learning sophistiqués sans encourir de frais de licence élevés.

« n8n permet aux équipes d'automatiser leurs flux de travail sans les contraintes des logiciels traditionnels, ce qui permet de gagner en innovation et en efficacité. » - Jan Oberhauser, cofondateur de n8n

La base open source de n8n permet des connexions fluides entre divers systèmes, ce qui en fait un outil idéal pour intégrer des environnements complexes. Avec plus de 200 intégrations prédéfinies, il connecte facilement les bases de données, les API, les services cloud et les outils essentiels aux flux de travail d'apprentissage automatique les plus courants. Cette polyvalence permet aux équipes d'unifier les systèmes CRM, les plateformes d'inventaire, les outils d'analyse et les points de terminaison des modèles de machine learning au sein d'un flux de travail unique et rationalisé.

Pour une personnalisation accrue, les utilisateurs peuvent injecter du code JavaScript ou Python directement dans les flux de travail, ce qui permet aux data scientists d'intégrer des algorithmes propriétaires et d'adapter les transformations de données à leurs besoins spécifiques.

En 2025, une entreprise de commerce électronique de taille moyenne a démontré la puissance d'intégration de n8n en reliant son CRM, son système de gestion des stocks et ses outils d'analyse au sein d'un flux de travail cohérent. Cette approche a réduit le temps de traitement des données de 40 % et amélioré la précision de leurs modèles de machine learning en garantissant un flux de données cohérent en temps réel.

L'option d'auto-hébergement de n8n donne aux organisations la liberté d'adapter leur infrastructure à mesure que les projets se développent. En tirant parti des installations auto-hébergées, les équipes peuvent gérer un nombre illimité de flux de travail et gérer de grands volumes de données, avec une évolutivité limitée uniquement par leurs ressources matérielles.

La plateforme est capable de gérer des flux de travail complexes en plusieurs étapes, ce qui la rend parfaitement adaptée aux initiatives de machine learning à grande échelle. Grâce à l'interface visuelle de n8n, les équipes peuvent orchestrer des pipelines de machine learning complets, de l'ingestion et du prétraitement des données à la formation et au déploiement des modèles.

En 2025, une société de services financiers a adopté n8n pour automatiser ses flux de travail de traitement des données. En intégrant divers modèles de machine learning et API, ils ont réduit de 40 % le temps de traitement de leurs pipelines de données, ce qui a permis d'accélérer la prise de décisions et d'améliorer l'efficacité opérationnelle.

La conception open source et les fonctionnalités d'auto-hébergement de n8n éliminent les frais par flux et les dépenses continues liées au cloud. Cette approche rentable est également soutenue par une solide communauté de plus de 70 000 stars GitHub, proposant des modèles et des ressources prédéfinis qui réduisent considérablement le temps de développement.

« n8n vous permet d'automatiser les flux de travail rapidement et efficacement, réduisant ainsi le besoin de développement personnalisé et les coûts associés. » - Shakudo Blog

La vaste bibliothèque d'intégrations prédéfinies de la plateforme évite également aux équipes d'investir dans le développement d'API personnalisées. En tirant parti des connecteurs existants, les organisations peuvent rationaliser leurs efforts d'automatisation tout en maîtrisant les coûts.

Chaîne Lang et LangGraph sont des outils conçus pour intégrer de grands modèles de langage (LLM) dans les flux de travail d'apprentissage automatique. Alors que LangChain fournit le cadre de base pour développer des applications basées sur LLM, LangGraph va encore plus loin en permettant des flux de travail complexes capables de gérer des processus de prise de décision complexes et dynamiques.

Les « cadres » architecture modulaire est particulièrement utile pour les équipes qui souhaitent intégrer des LLM à leurs pipelines d'apprentissage automatique existants sans avoir à remanier leur infrastructure. Les deux outils sont open source, sous licence MIT et Apache 2.0, ce qui les rend accessibles aux organisations de toutes tailles sans nécessiter d'investissements initiaux importants. Cette modularité garantit une intégration fluide entre les différents composants de l'apprentissage automatique.

« LangChain est devenu la norme de facto pour la création d'applications basées sur LLM, offrant une flexibilité inégalée pour les flux de travail expérimentaux. » - Vinod Chugani, expert en apprentissage automatique

L'un des principaux atouts de LangChain est sa capacité à connecter divers composants au sein d'écosystèmes d'apprentissage automatique. Le framework comprend des modèles et des bibliothèques qui simplifient l'intégration avec les frameworks de machine learning, les sources de données et les serveurs de modèles courants. Cette conception modulaire permet aux développeurs de relier différents systèmes sans avoir besoin d'un développement personnalisé approfondi.

LangChain prend en charge une variété de LLM, y compris des modèles d'OpenAI et de Hugging Face, ce qui donne aux équipes la flexibilité de sélectionner le modèle le mieux adapté à leurs besoins spécifiques. Grâce à sa vaste bibliothèque de connecteurs, les développeurs peuvent intégrer facilement ces modèles aux bases de données, aux API et aux outils d'analyse.

LangGraph apporte des fonctionnalités supplémentaires en gérant des flux de travail qui maintiennent le contexte dans de multiples interactions. Cela est particulièrement utile pour les applications qui doivent assurer la coordination entre différents modèles de machine learning et des systèmes externes tout en préservant les états des flux de travail. Cette capacité à gérer des flux de travail complexes facilite le déploiement de solutions évolutives et adaptables.

La conception modulaire de LangChain est conçue pour une évolutivité incrémentielle, permettant aux équipes de développer leurs applications sans être liées à une architecture rigide. Il gère efficacement les grands ensembles de données et les requêtes complexes, ce qui en fait un choix judicieux pour les projets au niveau de l'entreprise.

Par exemple, en 2025, une société de services financiers a mis en œuvre LangChain pour alimenter un chatbot qui gérait 100 000 requêtes quotidiennes. L'intégration, menée par leur équipe de développement de l'IA, a connecté LangChain aux systèmes CRM existants, ce qui a permis d'accélérer les temps de réponse et d'améliorer la satisfaction des clients.

« L'architecture modulaire de LangChain permet une mise à l'échelle et une intégration fluides, ce qui en fait un choix idéal pour les projets d'apprentissage automatique à grande échelle. » - Eryk Lewinson, data scientist, Towards AI

Un autre avantage est la compatibilité du framework avec plusieurs fournisseurs LLM. Les équipes peuvent commencer par des modèles plus petits pour le développement initial et les tests, puis passer à des modèles plus puissants à mesure que la complexité et la base d'utilisateurs de leurs applications augmentent.

À mesure que les applications se développent, il devient essentiel de garantir une gouvernance adéquate. LangChain et LangGraph incluent des fonctionnalités conçues pour répondre aux normes de l'industrie, en particulier dans des domaines hautement réglementés tels que la finance et la santé. Les deux frameworks prennent en charge contrôle d'accès basé sur les rôles (RBAC), permettant aux organisations d'attribuer des autorisations en fonction des rôles des utilisateurs et de protéger les données sensibles contre tout accès non autorisé.

Les plateformes incluent également des journaux d'audit pour suivre les actions des utilisateurs et les modifications du système, une fonctionnalité essentielle pour répondre aux exigences réglementaires. Ces journaux assurent la transparence et la responsabilité, essentielles à la conformité dans les secteurs qui exigent un lignage des données et des contrôles d'accès stricts.

De plus, les frameworks s'intègrent facilement aux outils de conformité existants, permettant aux organisations de maintenir leurs processus de gouvernance actuels tout en adoptant de nouvelles technologies LLM. Cela réduit la complexité liée au maintien de la conformité tout en explorant des flux de travail avancés d'apprentissage automatique.

La nature open source de LangChain et LangGraph élimine les frais de licence, réduisant ainsi les coûts pour les organisations qui adoptent des flux de travail alimentés par LLM. Sans frais d'abonnement, les dépenses sont principalement concentrées sur l'infrastructure et le développement.

Les cadres comprennent également un bibliothèque complète de composants préfabriqués, ce qui réduit le temps et les coûts associés au développement. Les équipes peuvent utiliser les modèles et les intégrations existants pour accélérer le déploiement, évitant ainsi d'avoir à créer des solutions personnalisées à partir de zéro.

Le support de LangChain à plusieurs fournisseurs de LLM s'améliore encore gestion des coûts. Les équipes peuvent sélectionner des modèles adaptés à leurs besoins en matière de performances et à leur budget, en changeant de fournisseur si nécessaire sans nécessiter de modifications architecturales importantes. Cette flexibilité permet aux organisations de contrôler les dépenses tout en optimisant les performances.

AutoGen est un framework conçu pour créer des systèmes collaboratifs dans lesquels plusieurs agents d'IA travaillent ensemble pour s'attaquer à des tâches complexes d'apprentissage automatique (ML). Contrairement aux outils d'automatisation traditionnels qui reposent sur des règles rigides pour déterminer si alors, AutoGen introduit une prise de décision dynamique, ce qui le rend parfaitement adapté aux projets de machine learning en évolution qui exigent de la flexibilité.

Le framework utilise un architecture basée sur les rôles, qui reflète le mode de fonctionnement habituel des équipes de machine learning. Chaque agent est spécialisé dans des tâches spécifiques, telles que le prétraitement des données, la formation de modèles, l'évaluation ou le déploiement. Cette approche garantit que les tâches sont clairement définies et distribuées efficacement, aidant ainsi les équipes à maintenir des flux de travail structurés tout en gérant efficacement les charges de travail.

AutoGen excelle dans la gestion de flux de travail expérimentaux complexes. Il prend en charge des conceptions automatisées telles que les tests A/B, permettant aux agents de superviser plusieurs conditions expérimentales à la fois. Cela élimine le besoin d'une surveillance manuelle constante, ce qui facilite le test de différents modèles et configurations. Cette fonctionnalité soutient directement les opérations qui doivent évoluer efficacement.

AutoGen est conçu pour faire évoluer les flux de travail de machine learning sans nécessiter une augmentation proportionnelle des ressources. À mesure que les exigences du projet augmentent, des agents supplémentaires peuvent être déployés pour gérer des tâches spécifiques, créant ainsi une approche de mise à l'échelle flexible et adaptative. En répartissant les responsabilités entre les agents spécialisés, les équipes peuvent rationaliser leurs flux de travail tout en optimisant l'utilisation des ressources.

Au-delà de l'évolutivité, AutoGen aide les équipes à réduire les coûts en optimisant l'allocation des ressources. Au lieu de s'appuyer sur de grands systèmes fonctionnant en continu, le modèle basé sur les agents permet aux équipes de déployer des agents à la demande pour des tâches spécifiques, minimisant ainsi la consommation inutile de ressources. En outre, en automatisant les expériences, AutoGen permet de gagner du temps et de réduire les coûts de main-d'œuvre, ce qui en fait une solution pratique pour les opérations de machine learning soucieuses des ressources.

Indice de lama constitue un puissant cadre de données qui relie les grands modèles de langage (LLM) à des sources de données externes, simplifiant ainsi le processus d'intégration et de gestion des données. En connectant les données brutes aux systèmes d'IA, il permet aux équipes de créer des applications d'apprentissage automatique (ML) plus intelligentes et sensibles au contexte.

Ce qui distingue LLamaIndex, c'est sa capacité à transformer des données non structurées en formats prêts pour l'apprentissage automatique. Cette fonctionnalité rationalise la gestion des connaissances et minimise le besoin de préparation manuelle des données, ce qui rend la formation sur les modèles beaucoup plus efficace. Ses pipelines de données intelligents peuvent analyser et comprendre le contexte et les relations au sein des ensembles de données, transformant ainsi des processus auparavant complexes en flux de travail fluides et reproductibles. Ces fonctionnalités font de LLamaIndex un outil clé pour améliorer l'intégration, l'évolutivité et la gestion des coûts.

LLamaIndex s'intègre sans effort aux LLM et à d'autres outils de traitement des données, créant ainsi un environnement de flux de travail unifié. Sa conception permet aux équipes de l'intégrer dans les systèmes existants sans nécessiter de modifications majeures de l'infrastructure.

Par exemple, en juin 2025, l'équipe de science des données d'une entreprise technologique a utilisé LLamaIndex pour connecter ses modèles ML existants à un nouveau framework LLM. Cette intégration a rationalisé la récupération des données, réduisant ainsi le temps de formation des modèles de 25 % et en améliorant la précision des prévisions. Le data scientist John Doe, qui a dirigé le projet, a fait remarquer que « la capacité de LLamaIndex à se connecter à divers outils a rendu notre flux de travail nettement plus efficace ».

« L'interopérabilité de LLamaIndex avec d'autres outils d'apprentissage automatique change la donne pour les équipes qui cherchent à optimiser leurs flux de travail. »

- Jane Smith, architecte de solutions d'IA, DataTech Inc.

LLamaIndex est conçu pour répondre aux besoins informatiques à grande échelle, en prenant en charge les systèmes distribués pour le traitement parallèle des données et la formation de modèles. Il s'intègre parfaitement aux services cloud, permettant une allocation dynamique des ressources pour répondre aux exigences de la charge de travail.

Le framework est capable de gérer des ensembles de données pouvant atteindre des téraoctets, ce qui le rend idéal pour les entreprises ayant des demandes de données importantes. Son architecture s'adapte automatiquement aux différentes tailles de données et à la charge de travail, garantissant à la fois l'adaptabilité et l'utilisation efficace des ressources. Comparé aux frameworks de machine learning traditionnels, LLamaIndex propose une approche de la mise à l'échelle plus rationalisée et plus respectueuse des ressources.

« LLamaIndex est conçu pour gérer la complexité des projets d'apprentissage automatique à grande échelle, afin que les équipes puissent se concentrer sur le développement de modèles plutôt que sur les défis d'infrastructure. »

- Source faisant autorité

En unifiant la préparation des données et la formation des modèles, LLamaIndex réduit considérablement les coûts opérationnels. Ses processus rationalisés éliminent le besoin de solutions multipoints, réduisant ainsi les frais de licence et simplifiant la maintenance du système.

Les organisations qui adoptent de solides pratiques MLOps, y compris des outils tels que LLamaIndex, peuvent bénéficier d'une Réduction de 60 à 70 % du temps de déploiement des modèles. Cela se traduit par une réduction des dépenses opérationnelles et une meilleure efficacité des ressources, ce qui permet un déploiement plus rapide et des itérations de modèles plus fréquentes. Le résultat ? Des flux de travail simplifiés et une automatisation améliorée.

« Les organisations qui mettent en œuvre des pratiques MLOps robustes constatent généralement une réduction de 60 à 70 % du temps de déploiement des modèles et une augmentation substantielle du nombre de modèles mis en production avec succès. »

- Sam Austin, expert en MLOps

Flowise est une plateforme conçue pour simplifier la création et la gestion de flux de travail d'apprentissage automatique, le tout sans nécessiter d'expertise en matière de codage. Cette solution sans code permet aux membres de l'équipe technique et non technique de développer des applications d'IA via une interface facile à utiliser. Son objectif principal est de rendre les flux de travail d'apprentissage automatique accessibles à tous tout le monde tout en conservant les fonctionnalités robustes nécessaires aux tâches au niveau de l'entreprise. Grâce à Flowise, les équipes peuvent rapidement prototyper, tester et déployer des flux de travail d'IA, en évitant les obstacles techniques habituels. La plateforme met également l'accent sur l'intégration, l'évolutivité, la conformité et la rentabilité.

Flowise se distingue par sa capacité à connecter de manière fluide divers outils et plateformes d'apprentissage automatique. Il offre de nombreuses options d'intégration, prenant en charge de nombreuses API et connecteurs, ce qui facilite l'intégration des données et des frameworks d'apprentissage automatique existants. Avec plus de 400 intégrations prédéfinies, les entreprises peuvent créer des pipelines de machine learning interconnectés tout en maximisant leurs investissements technologiques actuels.

« Les plateformes de flux de travail basées sur l'IA comblent cette lacune en intégrant l'intelligence directement au rythme de votre entreprise. » - Domo

Son interface visuelle simplifie la tâche de cartographie des flux de données entre différents systèmes, réduisant ainsi la complexité généralement associée à la gestion de plusieurs outils.

Conçu pour gérer des flux de travail complexes et des opérations de données à grande échelle, Flowise prend en charge la mise à l'échelle horizontale sur plusieurs nœuds. Cette fonctionnalité lui permet de gérer des milliers de tâches et de traiter efficacement de grands volumes de données, ce qui en fait le choix idéal pour les besoins des entreprises. Ses fonctionnalités de traitement des données en temps réel fournissent des informations immédiates, essentielles pour les opérations commerciales urgentes. En outre, l'allocation dynamique des ressources de la plateforme optimise les performances pendant les périodes de pointe tout en maîtrisant les coûts lors d'une utilisation moins intensive.

Flowise intègre la gestion de la conformité directement à ses flux de travail, aidant ainsi les organisations à répondre aux exigences réglementaires, ce qui est particulièrement important pour les secteurs soumis à une surveillance stricte. Les utilisateurs peuvent définir et appliquer des règles de conformité dans les flux de travail, en veillant à ce que le traitement des données soit conforme aux normes nécessaires. Par exemple, en 2025, une société de services financiers a utilisé Flowise pour automatiser ses rapports de conformité, réduisant ainsi de 50 % le temps consacré aux contrôles tout en permettant un suivi en temps réel du respect de la réglementation.

« Flowise permet aux équipes de créer des flux de travail conformes sans avoir besoin de connaissances approfondies en matière de codage. » - John Smith, chef de produit chez Flowise

La conception sans code de la plateforme est particulièrement avantageuse pour la conformité, car elle permet aux équipes d'adapter rapidement les flux de travail à l'évolution des réglementations sans nécessiter de reprogrammation importante.

En éliminant le besoin de compétences de programmation spécialisées, Flowise réduit les coûts tout en accélérant les délais de déploiement. Les équipes peuvent créer et ajuster des flux de travail sans expertise technique approfondie, ce qui réduit les dépenses de main-d'œuvre et accélère les délais de commercialisation des projets d'apprentissage automatique. En outre, les intégrations prédéfinies de la plateforme minimisent le besoin de développement personnalisé pour relier des systèmes disparates, réduisant ainsi les coûts de mise en œuvre initiaux et les dépenses de maintenance continues.

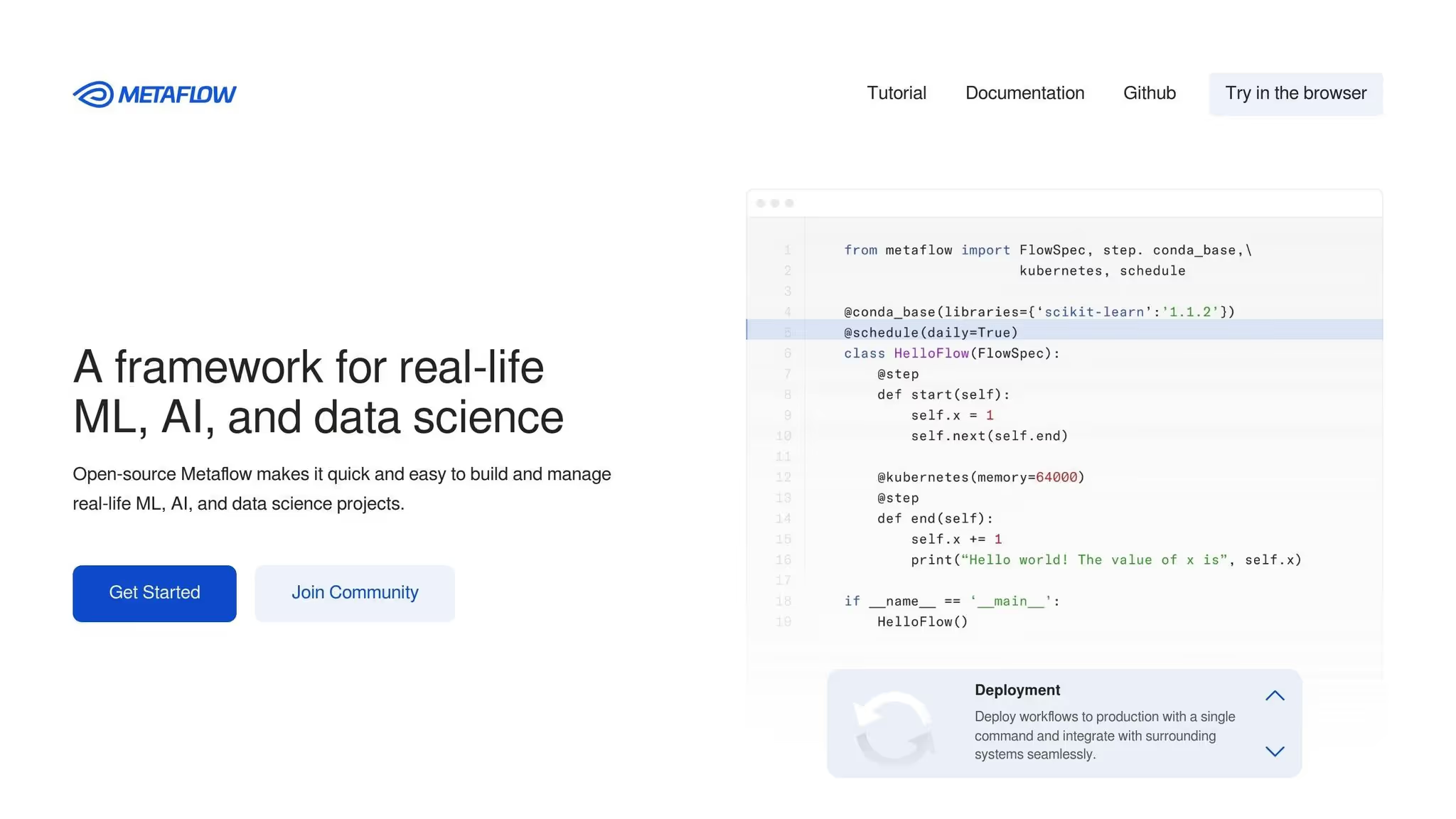

Métaflow, une plateforme de gestion des flux de travail open source créée par Netflix, simplifie les opérations d'apprentissage automatique en permettant aux data scientists de se concentrer sur la création de modèles. Il suit automatiquement les métadonnées et redémarre les étapes qui ont échoué, ce qui facilite la collaboration pour les équipes travaillant sur des flux de travail partagés.

« Metaflow aide les data scientists à se concentrer sur la création de modèles au lieu de se soucier de l'ingénierie MLOps. » - Anaconda Team, présentation des outils MLOps

Metaflow se distingue par sa capacité à s'intégrer de manière fluide dans les écosystèmes d'apprentissage automatique existants. Il fonctionne bien avec des bibliothèques largement utilisées comme TensorFlow et SciKit Learn, qui propose une API Python simple qui simplifie la définition des flux de travail. Cette facilité d'intégration permet aux équipes de connecter Metaflow à leurs outils préférés sans tracas.

La plateforme prend en charge le déploiement auprès de plusieurs fournisseurs de cloud, notamment AWS, Plateforme Google Cloud, et Microsoft Azure, offrant aux organisations la flexibilité nécessaire pour exécuter des flux de travail dans les environnements de leur choix. Cette compatibilité multicloud garantit la cohérence entre les différentes configurations d'infrastructure. Les équipes peuvent commencer par des projets à petite échelle pour tester la manière dont Metaflow s'intègre à leurs flux de travail existants avant de passer à des implémentations plus importantes. Cette adaptabilité facilite la mise à l'échelle des opérations pour répondre aux besoins de production.

Metaflow, qui a fait ses preuves dans l'environnement exigeant de Netflix, a démontré sa capacité à gérer efficacement des flux de travail d'apprentissage automatique à grande échelle. En 2023, Netflix l'a utilisé pour traiter des millions de points de données, améliorant ainsi les performances des modèles et accélérant les délais de déploiement.

« Metaflow permet aux data scientists de se concentrer sur leurs modèles tout en fournissant les outils nécessaires pour dimensionner et gérer efficacement les flux de travail. » - L'équipe d'ingénierie de Netflix

La capacité de la plateforme à s'adapter à différents environnements cloud en fait un choix judicieux pour les organisations qui gèrent de vastes ensembles de données et des modèles complexes. Son suivi automatique et sa gestion des versions des expériences garantissent la reproductibilité, ce qui est essentiel à mesure que la taille et la complexité des projets augmentent.

Metaflow inclut des fonctionnalités de gouvernance intégrées conçues pour garantir des flux de travail sécurisés et conformes, ce qui le rend particulièrement utile pour les secteurs soumis à des réglementations strictes. La plateforme suit et édite automatiquement les données et les expériences, créant ainsi une piste d'audit transparente qui garantit la conformité à des normes telles que GDPR et HIPAA.

En 2023, l'équipe de science des données de Netflix a constaté une amélioration de la conformité aux politiques de gouvernance internes après l'adoption de Metaflow. Ils ont également noté un déploiement plus rapide des modèles et une réduction du temps consacré à la gestion des expériences, soulignant la valeur de la plateforme dans les environnements réglementés.

Pour les entreprises confrontées à des environnements réglementaires en évolution, les fonctionnalités de gouvernance de Metaflow constituent un moyen fiable de maintenir la conformité sans sacrifier l'efficacité opérationnelle.

Metaflow permet de réaliser des économies grâce à sa nature open source et à sa conception axée sur Python. En éliminant les frais de licence, il permet aux entreprises de mettre en œuvre une puissante solution de gestion des flux de travail sans dépenses initiales importantes. Bien que l'infrastructure cloud puisse entraîner des coûts, l'utilisation efficace des ressources par la plateforme permet de minimiser ces dépenses opérationnelles.

Son approche basée sur Python réduit le besoin d'une expertise MLOps spécialisée, réduit les coûts de main-d'œuvre et accélère le déploiement. De plus, la compatibilité de Metaflow avec l'infrastructure cloud existante permet aux entreprises de tirer le meilleur parti de leurs investissements technologiques actuels. Grâce à une interface conviviale, il raccourcit la courbe d'apprentissage des équipes de science des données, réduit les coûts de formation et accélère l'adoption au sein de l'organisation.

Changement de vecteur simplifie les flux de travail d'apprentissage automatique en se connectant sans effort aux outils et systèmes existants. Il comble le fossé entre les plateformes déconnectées, permettant des flux de travail rationalisés et efficaces.

« L'interopérabilité est essentielle pour les entreprises qui cherchent à rationaliser leurs opérations d'apprentissage automatique. » - Expert du secteur, MLOps Insights

Cette focalisation sur l'intégration jette les bases de l'évolutivité et de solutions rentables.

VectorShift se distingue par sa capacité à s'intégrer parfaitement aux infrastructures d'apprentissage automatique existantes grâce à une prise en charge robuste des API et à des connecteurs prédéfinis. Au lieu de nécessiter une refonte complète du système, il fonctionne parallèlement aux outils actuels, permettant aux équipes de continuer à utiliser leurs infrastructures préférées avec un minimum de perturbations.

La plateforme propose des connecteurs pour les outils de science des données largement utilisés, ce qui réduit considérablement le temps et les efforts nécessaires à l'intégration. C'est architecture flexible répond à divers besoins organisationnels, en permettant aux utilisateurs d'adapter les flux de travail à leur infrastructure sans ajustements importants.

D'ici 2025, plus de 70 % des entreprises sont censés donner la priorité à l'intégration lors du choix des outils MLOps. VectorShift répond à cette demande croissante grâce à des options de connectivité prêtes à l'emploi qui réduisent les obstacles techniques, rendant l'adoption plus fluide et plus rapide.

VectorShift est conçu pour évoluer avec vos opérations d'apprentissage automatique. C'est Conception axée sur les API garantit que les flux de travail peuvent évoluer en fonction des besoins organisationnels sans rencontrer de problèmes d'intégration.

Cette conception permet aux équipes de créer des intégrations personnalisées adaptées à leurs environnements tout en préservant l'évolutivité. Les organisations peuvent commencer par une configuration plus petite et étendre leur utilisation de VectorShift à mesure que leurs initiatives d'apprentissage automatique se développent, garantissant ainsi une solution évolutive et prête pour l'avenir.

En mettant l'accent sur l'interopérabilité, VectorShift aide les organisations à réaliser des économies. Sa capacité à s'intégrer aux outils existants élimine le besoin de remplacements ou de révisions coûteux. La plateforme stratégie de connecteur réduit également le besoin de développement personnalisé, réduisant ainsi les dépenses supplémentaires.

Pour les entreprises qui ont déjà investi massivement dans des frameworks d'apprentissage automatique ou des outils de données spécifiques, VectorShift maximise ces investissements. Au lieu de partir de zéro, les organisations peuvent améliorer leurs flux de travail en connectant les systèmes existants, créant ainsi des opérations plus cohérentes et plus efficaces.

Pour tirer le meilleur parti de VectorShift, les entreprises doivent évaluer leurs outils actuels et découvrir comment ses fonctionnalités d'API peuvent unifier les systèmes déconnectés. En tirant parti de cette plateforme, les équipes peuvent améliorer le flux de données et l'efficacité opérationnelle sur l'ensemble du pipeline d'apprentissage automatique, renforçant ainsi l'importance de solutions MLOps efficaces et interconnectées.

Cette section présente les principales forces et limites de chaque outil, en offrant un aperçu clair de leur impact sur les résultats du projet. Chaque outil présente des fonctionnalités et des défis distincts, qui peuvent influencer de manière significative vos décisions en matière de flux de travail.

Ces comparaisons mettent en lumière les compromis pratiques de chaque outil. Par exemple, le succès de Netflix avec Metaflow met en évidence sa capacité à automatiser la gestion des versions et le suivi des données, ce qui entraîne des gains d'efficacité tangibles.

« Metaflow permet à nos data scientists de se concentrer sur la création de modèles plutôt que sur la gestion de l'infrastructure. » - Responsable de la science des données, Netflix

Le choix du bon outil dépend de l'expertise, du budget, des besoins d'intégration et des objectifs d'évolutivité de votre équipe. Des outils tels que n8n et Flowise donnez aux utilisateurs non techniques les moyens de créer des flux de travail, tandis que des plateformes telles que Chaîne Lang offrent une flexibilité avancée mais exigent des compétences techniques. Les organisations qui adoptent de solides pratiques MLOps signalent une réduction de 60 à 70 % du temps de déploiement des modèles, ce qui souligne l'importance de sélectionner le bon outil dès le départ.

« Les bons outils MLOps peuvent réduire considérablement le temps et les coûts associés au déploiement de modèles d'apprentissage automatique. » - Sam Austin, expert MLOps

Ces informations renforcent les évaluations précédentes, soulignant l'importance d'aligner votre choix d'outils sur les besoins techniques et les priorités organisationnelles.

Pour sélectionner les bons outils de flux de travail, il faut trouver un équilibre entre les besoins techniques, l'expertise de l'équipe et les objectifs organisationnels. La clé du succès réside dans l'adaptation des capacités d'un outil à vos besoins uniques.

Prompts.ai est un choix exceptionnel pour les organisations qui se concentrent sur la gestion de l'IA au niveau de l'entreprise. Il donne accès à plus de 35 grands modèles linguistiques de premier plan et fournit jusqu'à 98 % d'économies grâce à ses contrôles FinOps. Son système de gouvernance unifié est particulièrement adapté aux équipes qui gèrent des flux de travail complexes sur plusieurs modèles et départements.

Pour les équipes qui privilégient la facilité d'utilisation, des plateformes telles que n8n et Flowise proposent des générateurs de flux de travail visuels intuitifs, les rendant accessibles aux utilisateurs non techniques. Cependant, ces outils peuvent nécessiter des intégrations supplémentaires pour gérer des tâches avancées d'apprentissage automatique. D'autre part, LangChain/LangGraph excelle en termes de flexibilité pour les flux de travail des modèles linguistiques, mais présente une courbe d'apprentissage abrupte, nécessitant une expertise significative. De même, Métaflow est une excellente option pour gérer des projets gourmands en données, même si elle peut entraîner des coûts de service cloud plus élevés.

La planification budgétaire est un autre facteur essentiel. Des outils open source tels que n8n proposent souvent des niveaux gratuits, tandis que les solutions d'entreprise sont généralement proposées à des prix plus élevés. Il est essentiel d'évaluer le coût total de possession, en tenant compte des dépenses d'infrastructure, de formation et de maintenance.

Commencez par des outils adaptés à vos capacités actuelles et adaptez-vous à l'évolution de vos besoins. Au fur et à mesure que votre équipe gagne en expertise, vous pouvez passer à des plateformes plus avancées ou intégrer plusieurs outils pour étendre les fonctionnalités.

Les flux de travail basés sur l'IA devant passer de 3 % à 25 % des processus d'entreprise d'ici la fin de 2025, il est crucial de sélectionner des outils offrant un soutien communautaire solide, des mises à jour cohérentes et des options d'intégration transparentes. Ces facteurs garantiront que votre investissement demeure efficace et adaptable dans ce domaine en pleine évolution.

Pour choisir le bon outil de flux de travail d'apprentissage automatique, il est essentiel de commencer par identifier les besoins spécifiques de votre projet. Des facteurs tels que la complexité de vos données, la taille de votre équipe et les exigences de déploiement devraient guider votre décision. Recherchez des outils qui fournissent interopérabilité, évolutivité, et sont simples à utiliser, garantissant qu'ils répondent à la fois à vos objectifs immédiats et à vos plans à long terme.

Évaluez dans quelle mesure l'outil facilite la collaboration, rationalise l'automatisation et s'intègre à vos systèmes existants. La gestion d'un projet pilote ou d'un projet à petite échelle peut fournir des informations précieuses pour déterminer si la plateforme correspond aux objectifs de votre organisation. Concentrez-vous sur les options qui stimulent la productivité et simplifient les processus de votre équipe.

Pour maintenir la conformité et une gouvernance adéquate lors de l'intégration d'outils de flux de travail d'apprentissage automatique, les entreprises doivent se concentrer sur contrôle de version pour tous les artefacts associés, y compris les modèles, les ensembles de données et le code. Cette approche garantit la transparence et facilite le suivi des modifications tout au long du processus de développement.

L'automatisation du processus d'apprentissage automatique est une autre étape clé. Cela favorise non seulement la cohérence, mais minimise également le risque d'erreur humaine. Il est tout aussi important de mettre en place des processus complets de validation des données pour respecter qualité et intégrité des données, qui sont essentiels pour produire des résultats de modèle fiables et impartiaux.

En abordant ces domaines critiques, les organisations peuvent améliorer la responsabilisation, simplifier les flux de travail et respecter en toute confiance les normes réglementaires.

Des outils open source tels que n8n et Métaflow offrent un moyen rentable de gérer les flux de travail d'apprentissage automatique en éliminant les frais de licence élevés. Ils offrent aux équipes la flexibilité nécessaire pour personnaliser et automatiser les processus sans les coûts élevés liés aux plateformes propriétaires. Cela en fait une option intéressante pour les startups et les petites entreprises dont les budgets sont serrés.

Cela dit, ces outils comportent souvent des compromis. Ils peuvent manquer de fonctionnalités avancées, avoir des difficultés d'évolutivité ou proposer un support dédié limité. Bien qu'ils fonctionnent bien pour des projets plus petits ou moins complexes, leur mise à l'échelle pour répondre aux besoins de l'entreprise peut nécessiter des efforts supplémentaires, tels que le développement personnalisé ou la mise à niveau de l'infrastructure. Il est important d'évaluer la complexité de votre projet et les besoins de croissance futurs avant d'opter pour une solution open source.