غالبًا ما تواجه عمليات سير عمل التعلم الآلي أوجه قصور بسبب الأدوات المتناثرة والعمليات اليدوية. تقيّم هذه المقالة ثماني أدوات من الدرجة الأولى مصممة لتبسيط خطوط التعلم الآلي وأتمتتها وتحسينها. يتم تقييم كل أداة من حيث التكامل وقابلية التوسع والحوكمة وإدارة التكاليف، مما يلبي الاحتياجات المتنوعة من الحلول على مستوى المؤسسات إلى المنصات مفتوحة المصدر. تشمل الوجبات السريعة الرئيسية ما يلي:

تقدم كل أداة نقاط قوة متميزة استنادًا إلى خبرة الفريق وحجم المشروع والميزانية. سواء كنت تقوم بأتمتة عمليات سير العمل أو دمج LLMs أو إدارة مجموعات البيانات الكبيرة، فإن اختيار الأداة المناسبة يمكن أن يوفر الوقت ويقلل التكاليف ويحسن النتائج.

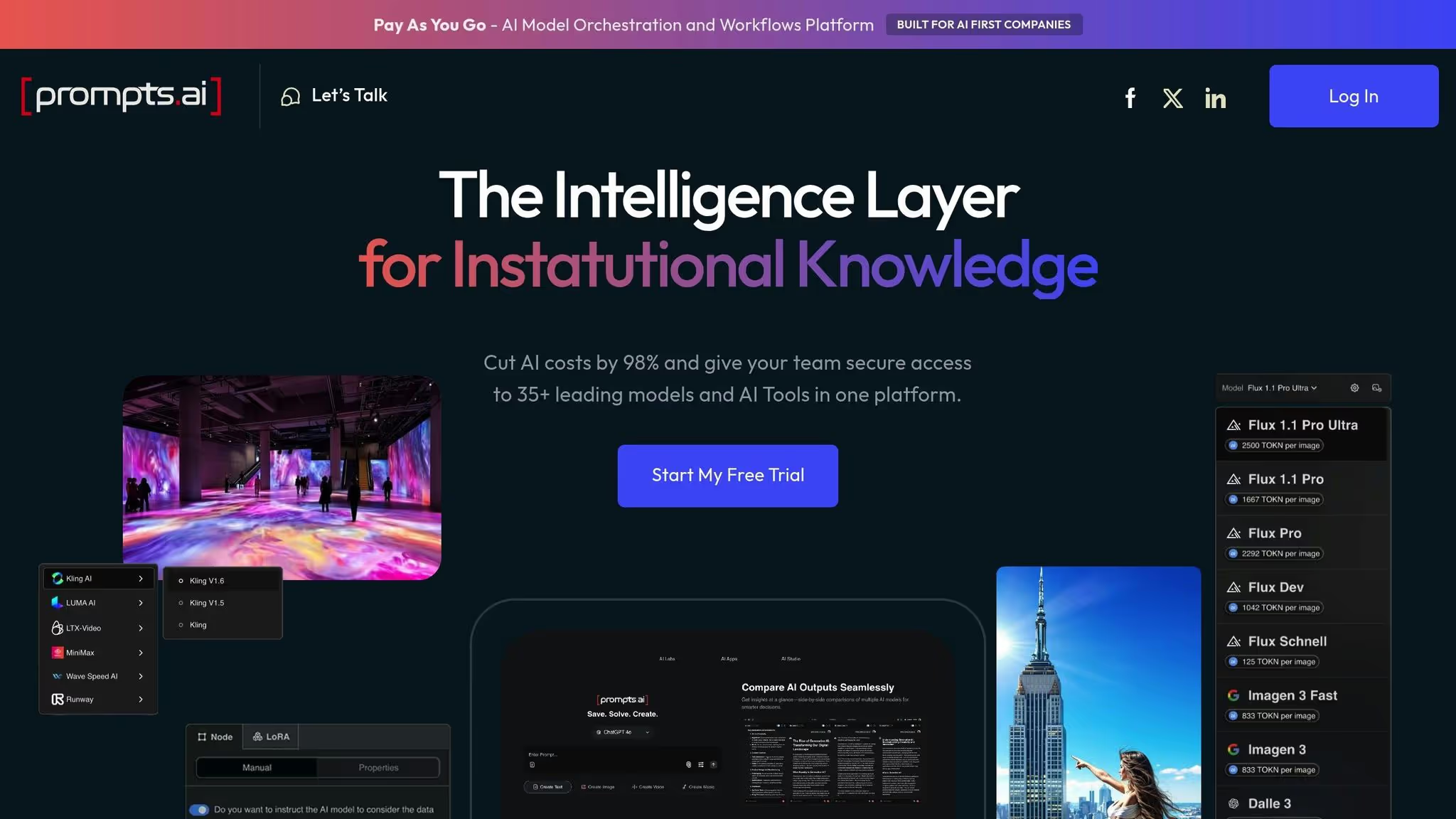

Prompts.ai عبارة عن منصة تنسيق AI على مستوى المؤسسة مصممة لتبسيط وتعزيز عمليات سير العمل القائمة على السرعة. إنه يربط المستخدمين بأكثر من 35 نموذجًا رائدًا للذكاء الاصطناعي - مثل GPT-4 و Claude و Llama و Gemini - من خلال واجهة واحدة مبسطة، مما يزيل متاعب التوفيق بين أدوات الذكاء الاصطناعي المتعددة.

تركز المنصة على تصميم سير العمل المرئي والوظائف الجاهزة للمؤسسات. تعد واجهة السحب والإسقاط سهلة الاستخدام مثالية لكل من الخبراء التقنيين والمستخدمين غير التقنيين، مما يتيح إنشاء تدفقات عمل متقدمة للذكاء الاصطناعي يمكنها الانتقال بسهولة من الاختبار إلى الإنتاج على نطاق واسع. فيما يلي، سنستكشف ميزاته البارزة في التكامل وقابلية التوسع والامتثال وإدارة التكلفة.

تتميز Prompts.ai بقدرتها على توحيد أنظمة الذكاء الاصطناعي المختلفة من خلال التكامل السلس. وهو يدعم اتصالات نموذج اللغة الكبيرة متعدد المزودين (LLM)، مما يسمح للفرق بدمج النماذج من مزودي خدمات مثل أوبن إيه آي، أنثروبي، و وجه معانق في سير عمل متماسك. بالإضافة إلى نماذج الذكاء الاصطناعي، تتكامل المنصة مع الأدوات الشائعة مثل سلاك، Gmail، و تريلو، ويقدم واجهات برمجة التطبيقات والموصلات للربط بمصادر البيانات الحالية. تعمل قدرة التكامل هذه على حل مشكلة التحميل الزائد للأدوات بشكل فعال، مما يؤدي إلى إنشاء سير عمل أكثر بساطة وكفاءة.

من خلال الاستفادة من البنية التحتية السحابية الأصلية، تتكيف Prompts.ai مع مجموعة واسعة من الاحتياجات - من السلاسل السريعة البسيطة إلى الأتمتة المعقدة متعددة الخطوات. تتعامل المنصة مع المهام المتزامنة وأحجام البيانات الكبيرة بسهولة، مما يجعلها مناسبة للفرق الصغيرة وكذلك العمليات على مستوى المؤسسة. في يونيو 2025، اعترفت Genai.works بـ Prompts.ai كمنصة من الدرجة الأولى لأتمتة المؤسسات وحل المشكلات، مما يسلط الضوء على موثوقيتها في إدارة أعباء العمل المتزايدة. تتوافق قابلية التوسع هذه أيضًا مع تركيز المنصة القوي على الامتثال وقابلية التدقيق.

يفي Prompts.ai بمعايير حوكمة المؤسسات الصارمة من خلال الالتزام بأفضل الممارسات من أطر مثل SOC 2 Type II و HIPAA و GDPR. بالشراكة مع فانتا، أطلقت المنصة عمليات تدقيق SOC 2 Type II في يونيو 2025، مما يعزز التزامها بالأمان والامتثال. تضمن الميزات مثل عناصر التحكم في وصول المستخدم وسجلات التدقيق التفصيلية والإصدار الفوري أن كل تفاعل يمكن تتبعه ويلبي المتطلبات التنظيمية.

يساعد Prompts.ai المؤسسات على تقليل النفقات من خلال تركيز الوصول إلى نماذج الذكاء الاصطناعي المتعددة. يمكن للشركات خفض تكاليف الذكاء الاصطناعي بنسبة تصل إلى 98% بفضل إدارة الموارد الذكية وتحليلات الاستخدام والأدوات لتحسين سير العمل. تراقب إمكانات FinOps في الوقت الفعلي للمنصة استخدام الرمز المميز، مما يضمن توافق الإنفاق مع الاحتياجات الفعلية. يربط نظام TOKN الائتماني للدفع أولاً بأول التكاليف مباشرة بالاستخدام، مما يجعله عمليًا بشكل خاص للشركات ذات متطلبات الذكاء الاصطناعي المتقلبة. من خلال تركيز إدارة الموارد وتوفير رؤى قابلة للتنفيذ، يضع Prompts.ai معيارًا لسير عمل التعلم الآلي الفعال.

على عكس المنصات المصممة بتركيز قوي على مستخدمي المؤسسات، رقم 8 تتميز بنموذجها مفتوح المصدر الذي يعطي الأولوية للمرونة والفعالية من حيث التكلفة. تسمح منصة التشغيل الآلي لسير العمل هذه للمؤسسات بتصميم وتخصيص ونشر عمليات سير عمل التعلم الآلي (ML) دون الارتباط بمورد معين. تجعل واجهته المرئية في متناول كل من الخبراء التقنيين وأعضاء الفريق غير التقنيين، مما يسد الفجوة بين مجموعات المهارات المختلفة.

تقدم n8n إصدارًا مجانيًا مع ميزات أساسية للمستخدمين الفرديين، جنبًا إلى جنب مع إصدار المؤسسة لأولئك الذين لديهم احتياجات أكثر تقدمًا. هذا يجعله خيارًا جذابًا للفرق التي تهدف إلى تنفيذ عمليات سير عمل ML المعقدة دون تكبد رسوم ترخيص باهظة.

«تعمل n8n على تمكين الفرق من أتمتة سير العمل دون قيود البرامج التقليدية، مما يسمح بمزيد من الابتكار والكفاءة». - جان أوبرهاوزر، المؤسس المشارك لـ n8n

تدعم مؤسسة n8n مفتوحة المصدر الاتصالات السلسة بين الأنظمة المتنوعة، مما يجعلها أداة مثالية لدمج البيئات المعقدة. من خلال أكثر من 200 عملية تكامل تم إنشاؤها مسبقًا، فإنها تربط بسهولة قواعد البيانات الشائعة وواجهات برمجة التطبيقات والخدمات السحابية والأدوات المهمة لسير عمل التعلم الآلي. يسمح هذا التنوع للفرق بتوحيد أنظمة CRM ومنصات المخزون وأدوات التحليلات ونقاط نهاية نموذج ML في سير عمل واحد ومبسط.

لمزيد من التخصيص، يمكن للمستخدمين حقن شفرة JavaScript أو Python مباشرة في عمليات سير العمل، مما يمكّن علماء البيانات من دمج الخوارزميات الخاصة وتخصيص تحويلات البيانات وفقًا لاحتياجاتهم الخاصة.

في عام 2025، عرضت شركة تجارة إلكترونية متوسطة الحجم قوة تكامل n8n من خلال ربط CRM ونظام إدارة المخزون وأدوات التحليلات في سير عمل واحد متماسك. أدى هذا النهج إلى تقليل وقت معالجة البيانات بنسبة 40٪ وتعزيز دقة نماذج ML الخاصة بهم من خلال ضمان تدفق البيانات المتسق في الوقت الفعلي.

يمنح خيار الاستضافة الذاتية لـ n8n المؤسسات حرية توسيع بنيتها التحتية مع نمو المشاريع. من خلال الاستفادة من عمليات التثبيت المستضافة ذاتيًا، يمكن للفرق إدارة عمليات سير العمل غير المحدودة والتعامل مع أحجام البيانات الكبيرة، مع قابلية التوسع التي تقتصر فقط على موارد الأجهزة الخاصة بهم.

المنصة قادرة على إدارة عمليات سير العمل المعقدة والمتعددة الخطوات، مما يجعلها مناسبة تمامًا لمبادرات التعلم الآلي واسعة النطاق. باستخدام الواجهة المرئية لـ n8n، يمكن للفرق تنسيق خطوط أنابيب ML بأكملها، بدءًا من استيعاب البيانات والمعالجة المسبقة وحتى التدريب على النماذج ونشرها.

في عام 2025، اعتمدت شركة خدمات مالية n8n لأتمتة عمليات سير عمل معالجة البيانات. من خلال دمج العديد من نماذج ML وواجهات برمجة التطبيقات، حققوا انخفاضًا بنسبة 40٪ في وقت المعالجة عبر خطوط أنابيب البيانات الخاصة بهم، مما يتيح اتخاذ قرارات أسرع وتعزيز الكفاءة التشغيلية.

يلغي تصميم n8n مفتوح المصدر وقدرات الاستضافة الذاتية الحاجة إلى رسوم التدفق والنفقات السحابية المستمرة. يتم دعم هذا النهج الفعال من حيث التكلفة بشكل إضافي من قبل مجتمع قوي يضم أكثر من 70،000 من نجوم GitHub، مما يوفر قوالب وموارد معدة مسبقًا تقلل بشكل كبير من وقت التطوير.

«n8n يسمح لك بأتمتة عمليات سير العمل بسرعة وكفاءة، مما يقلل من الحاجة إلى التطوير المخصص والتكاليف المرتبطة به». - مدونة Shakudo

تعمل المكتبة الواسعة للمنصة من عمليات الدمج المبنية مسبقًا أيضًا على حماية الفرق من الاستثمار في تطوير واجهة برمجة التطبيقات المخصصة. من خلال الاستفادة من الموصلات الحالية، يمكن للمؤسسات تبسيط جهود الأتمتة مع الحفاظ على التكاليف تحت السيطرة.

لانج تشين و لانغ غراف هي أدوات مصممة لدمج نماذج اللغات الكبيرة (LLMs) في عمليات سير عمل التعلم الآلي. بينما يوفر LangChain الإطار التأسيسي لتطوير التطبيقات التي تعمل بنظام LLM، فإن LangGraph يخطو خطوة إلى الأمام من خلال تمكين تدفقات العمل المعقدة التي يمكنها التعامل مع عمليات صنع القرار المعقدة وذات الحالة المعقدة.

الأطر» بنية تركيبية مفيد بشكل خاص للفرق التي تتطلع إلى دمج LLMs في خطوط أنابيب التعلم الآلي الحالية دون الحاجة إلى إصلاح بنيتها التحتية. كلتا الأداتين مفتوحة المصدر ومرخصة بموجب MIT و Apache 2.0، مما يجعلها في متناول المؤسسات من جميع الأحجام دون الحاجة إلى استثمارات مسبقة كبيرة. تضمن هذه الوحدة التكامل السلس عبر مكونات التعلم الآلي المختلفة.

«أصبح LangChain المعيار الفعلي لبناء التطبيقات التي تعمل بنظام LLM، مما يوفر مرونة لا مثيل لها لسير العمل التجريبي.» - فينود تشوجاني، خبير التعلم الآلي

تتمثل إحدى نقاط القوة الرئيسية لـ LangChain في قدرتها على ربط المكونات المتنوعة داخل النظم البيئية للتعلم الآلي. يتضمن الإطار قوالب ومكتبات تبسط التكامل مع أطر تعلم الآلة الشائعة ومصادر البيانات وخوادم النماذج. يسمح هذا التصميم المعياري للمطورين بربط أنظمة مختلفة دون الحاجة إلى تطوير مخصص شامل.

تدعم LangChain مجموعة متنوعة من LLMs، بما في ذلك نماذج من OpenAI و Hugging Face، مما يمنح الفرق المرونة لاختيار أفضل نموذج لاحتياجاتهم الخاصة. من خلال مكتبة الموصلات الشاملة، يمكن للمطورين دمج هذه النماذج بسلاسة مع قواعد البيانات وواجهات برمجة التطبيقات وأدوات التحليلات.

يوفر LangGraph إمكانات إضافية من خلال إدارة عمليات سير العمل التي تحافظ على السياق عبر تفاعلات متعددة. هذا مفيد بشكل خاص للتطبيقات التي تحتاج إلى التنسيق بين نماذج ML المختلفة والأنظمة الخارجية مع الحفاظ على حالات سير العمل. هذه القدرة على التعامل مع عمليات سير العمل المعقدة تجعل من السهل نشر حلول قابلة للتطوير والتكيف.

تم تصميم تصميم LangChain المعياري من أجل قابلية التوسع التدريجي، مما يسمح للفرق بتطوير تطبيقاتها دون ربطها ببنية صلبة. فهي تتعامل بكفاءة مع مجموعات البيانات الكبيرة والاستعلامات المعقدة، مما يجعلها خيارًا قويًا للمشاريع على مستوى المؤسسة.

على سبيل المثال، في عام 2025، قامت شركة خدمات مالية بتطبيق LangChain لتشغيل روبوت محادثة يدير 100,000 استفسار يومي. أدى التكامل، بقيادة فريق تطوير الذكاء الاصطناعي الخاص بهم، إلى ربط LangChain بأنظمة CRM الحالية، مما أدى إلى أوقات استجابة أسرع وتحسين رضا العملاء.

«تسمح بنية LangChain المعيارية بالتوسع والتكامل بسلاسة، مما يجعلها خيارًا مثاليًا لمشاريع التعلم الآلي واسعة النطاق.» - إريك لوينسون، عالم البيانات، Towards AI

ميزة أخرى هي توافق الإطار مع العديد من موفري LLM. يمكن للفرق البدء بنماذج أصغر للتطوير الأولي والاختبار، ثم الانتقال إلى نماذج أكثر قوة مع توسع تطبيقاتها من حيث التعقيد وقاعدة المستخدمين.

ومع نمو التطبيقات، يصبح ضمان الحوكمة السليمة أمرًا بالغ الأهمية. تتضمن LangChain و LangGraph ميزات مصممة لتلبية معايير الصناعة، خاصة في المجالات شديدة التنظيم مثل التمويل والرعاية الصحية. يدعم كلا الإطارين التحكم في الوصول المستند إلى الأدوار (RBAC)، مما يمكّن المؤسسات من تعيين الأذونات استنادًا إلى أدوار المستخدمين وحماية البيانات الحساسة من الوصول غير المصرح به.

تتضمن المنصات أيضًا سجلات تدقيق لتتبع إجراءات المستخدم وتغييرات النظام، وهي ميزة ضرورية لتلبية المتطلبات التنظيمية. توفر هذه السجلات الشفافية والمساءلة، وهما ضروريان للامتثال في الصناعات التي تتطلب نسب البيانات وضوابط الوصول الصارمة.

بالإضافة إلى ذلك، تتكامل الأطر بسهولة مع أدوات الامتثال الحالية، مما يسمح للمؤسسات بالحفاظ على عمليات الحوكمة الحالية مع اعتماد تقنيات LLM الجديدة. وهذا يقلل من تعقيد الحفاظ على التوافق أثناء استكشاف عمليات سير عمل التعلم الآلي المتقدمة.

تعمل طبيعة المصدر المفتوح لـ LangChain و LangGraph على التخلص من رسوم الترخيص، مما يقلل التكاليف للمؤسسات التي تتبنى تدفقات العمل المدعومة من LLM. بدون تكاليف الاشتراك، تركز النفقات بشكل أساسي على البنية التحتية والتطوير.

تتضمن الأطر أيضًا مكتبة واسعة من المكونات المبنية مسبقًا، مما يقلل من الوقت والتكلفة المرتبطة بالتطوير. يمكن للفرق استخدام القوالب وعمليات الدمج الحالية لتسريع النشر، وتجنب الحاجة إلى إنشاء حلول مخصصة من البداية.

يعزز دعم LangChain للعديد من مزودي LLM إدارة التكاليف. يمكن للفرق اختيار النماذج التي تتوافق مع احتياجات الأداء والميزانية، وتبديل مقدمي الخدمة حسب الضرورة دون الحاجة إلى تغييرات هيكلية كبيرة. تضمن هذه المرونة للمؤسسات التحكم في النفقات مع تحسين الأداء.

أوتوجين هو إطار عمل مصمم لإنشاء أنظمة تعاونية حيث يعمل العديد من وكلاء الذكاء الاصطناعي معًا لمعالجة مهام التعلم الآلي المعقدة (ML). على عكس أدوات الأتمتة التقليدية التي تعتمد على قواعد if-then الصارمة، تقدم AutoGen عملية صنع القرار الديناميكية، مما يجعلها مناسبة تمامًا لمشاريع تعلم الآلة المتطورة التي تتطلب المرونة.

يستخدم الإطار بنية قائمة على الأدوار، وهو ما يعكس الطريقة التي تعمل بها فرق تعلم الآلة عادةً. يتخصص كل وكيل في مهام محددة، مثل المعالجة المسبقة للبيانات أو التدريب النموذجي أو التقييم أو النشر. يضمن هذا الأسلوب تحديد المهام بوضوح وتوزيعها بكفاءة، مما يساعد الفرق على الحفاظ على سير العمل المنظم مع إدارة أعباء العمل بفعالية.

يتألق AutoGen في التعامل مع تدفقات العمل التجريبية المعقدة. وهو يدعم التصميمات الآلية مثل اختبار A/B، مما يمكّن الوكلاء من الإشراف على ظروف تجريبية متعددة في وقت واحد. هذا يلغي الحاجة إلى الإشراف اليدوي المستمر، مما يجعل من السهل اختبار النماذج والتكوينات المختلفة. تدعم هذه الإمكانية بشكل مباشر العمليات التي تحتاج إلى التوسع بكفاءة.

تم تصميم AutoGen لتوسيع نطاق سير عمل ML دون الحاجة إلى زيادة نسبية في الموارد. ومع توسع متطلبات المشروع، يمكن نشر وكلاء إضافيين لإدارة مهام محددة، وإنشاء نهج توسيع مرن وقابل للتكيف. من خلال تقسيم المسؤوليات بين الوكلاء المتخصصين، يمكن للفرق تبسيط سير العمل مع تحسين استخدام الموارد.

بالإضافة إلى قابلية التوسع، تساعد AutoGen الفرق على خفض التكاليف من خلال تحسين تخصيص الموارد. بدلاً من الاعتماد على الأنظمة الكبيرة التي تعمل باستمرار، يسمح النموذج القائم على الوكيل للفرق بنشر الوكلاء عند الطلب لمهام محددة، مما يقلل من استهلاك الموارد غير الضروري. بالإضافة إلى ذلك، من خلال التشغيل الآلي للتجارب، يوفر AutoGen الوقت وتكاليف العمالة، مما يجعله حلاً عمليًا لعمليات ML الواعية بالموارد.

مؤشر لاما يعمل كإطار بيانات قوي يربط نماذج اللغات الكبيرة (LLMs) بمصادر البيانات الخارجية، مما يبسط عملية دمج البيانات وإدارتها. ومن خلال ربط البيانات الأولية بأنظمة الذكاء الاصطناعي، فإنها تمكّن الفرق من بناء تطبيقات تعلم الآلة (ML) أكثر ذكاءً وإدراكًا للسياق.

ما يميز LLAmaIndex هو قدرته على تحويل البيانات غير المهيكلة إلى تنسيقات جاهزة للتعلم الآلي. تعمل هذه القدرة على تبسيط إدارة المعرفة وتقليل الحاجة إلى إعداد البيانات يدويًا، مما يجعل التدريب النموذجي أكثر كفاءة بكثير. يمكن لخطوط أنابيب البيانات الذكية الخاصة بها تحليل وفهم السياق والعلاقات داخل مجموعات البيانات، وتحويل العمليات المعقدة سابقًا إلى سير عمل سلس وقابل للتكرار. هذه الميزات تجعل LLAmaIndex أداة رئيسية لتحسين التكامل وقابلية التوسع وإدارة التكاليف.

يتكامل LlamaIndex بسهولة مع LLMs وأدوات معالجة البيانات الأخرى، مما يخلق بيئة سير عمل موحدة. يسمح تصميمها للفرق بدمجها في الأنظمة الحالية دون الحاجة إلى تغييرات كبيرة في البنية التحتية.

على سبيل المثال، في يونيو 2025، استخدم فريق علوم البيانات التابع لشركة تقنية LLAMaIndex لربط نماذج ML الحالية بإطار LLM الجديد. أدى هذا التكامل إلى تبسيط عملية استرداد البيانات وتقليل وقت التدريب النموذجي بمقدار 25% وتحسين دقة التنبؤ. قال عالم البيانات جون دو، الذي قاد المشروع، «إن قدرة LLAmaIndex على الاتصال بأدوات مختلفة جعلت سير العمل لدينا أكثر كفاءة بشكل ملحوظ.»

«تعد قابلية التشغيل البيني لـ LLAmaIndex مع أدوات التعلم الآلي الأخرى بمثابة تغيير لقواعد اللعبة بالنسبة للفرق التي تتطلع إلى تحسين سير العمل.»

- جين سميث، مهندسة حلول الذكاء الاصطناعي، DataTech Inc.

تم تصميم LLAmaIndex للتعامل مع احتياجات الحوسبة واسعة النطاق، ودعم الأنظمة الموزعة لمعالجة البيانات المتوازية والتدريب النموذجي. إنه يتكامل بسلاسة مع الخدمات السحابية، مما يتيح التخصيص الديناميكي للموارد لتتناسب مع متطلبات عبء العمل.

إن إطار العمل قادر على إدارة مجموعات بيانات كبيرة تصل إلى تيرابايت، مما يجعله مثاليًا للمؤسسات ذات المتطلبات الكبيرة للبيانات. تتكيف بنيتها تلقائيًا مع أحجام البيانات وأعباء العمل المختلفة، مما يضمن القدرة على التكيف والاستخدام الفعال للموارد. بالمقارنة مع أطر تعلم الآلة التقليدية، تقدم LLAMaIndex نهجًا أكثر بساطة ووعيًا بالموارد للتوسع.

«تم تصميم LLAmaIndex للتعامل مع تعقيدات مشاريع التعلم الآلي واسعة النطاق، مما يضمن قدرة الفرق على التركيز على تطوير النماذج بدلاً من تحديات البنية التحتية.»

- مصدر موثوق

من خلال توحيد إعداد البيانات والتدريب النموذجي، يقلل LLAMaIndex بشكل كبير من التكاليف التشغيلية. تعمل عملياتها المبسطة على التخلص من الحاجة إلى حلول متعددة النقاط وخفض رسوم الترخيص وتبسيط صيانة النظام.

يمكن للمنظمات التي تتبنى ممارسات MLOPS القوية، بما في ذلك أدوات مثل LLAmaIndex، تجربة تقليل وقت نشر النموذج بنسبة 60-70٪. وهذا يعني انخفاض النفقات التشغيلية وتحسين كفاءة الموارد، مما يتيح النشر بشكل أسرع وتكرار النماذج. النتيجة؟ عمليات سير عمل أصغر حجمًا وأتمتة محسّنة.

«عادةً ما تشهد المؤسسات التي تطبق ممارسات MLOPS القوية انخفاضًا بنسبة 60-70٪ في وقت نشر النموذج وزيادة كبيرة في عدد النماذج التي نجحت في الوصول إلى الإنتاج.»

- سام أوستن، خبير MLOPS

فلاويز عبارة عن منصة مصممة لتبسيط إنشاء وإدارة عمليات سير عمل التعلم الآلي، كل ذلك دون الحاجة إلى خبرة الترميز. يسمح هذا الحل بدون تعليمات برمجية لأعضاء الفريق التقنيين وغير التقنيين بتطوير تطبيقات الذكاء الاصطناعي من خلال واجهة سهلة الاستخدام. ويتمثل هدفها الأساسي في جعل عمليات سير عمل التعلم الآلي في متناول الجميع مع الحفاظ على القدرات القوية اللازمة للمهام على مستوى المؤسسة. باستخدام Flowise، يمكن للفرق وضع نماذج أولية لعمليات سير عمل الذكاء الاصطناعي واختبارها ونشرها بسرعة، وتجنب العقبات التقنية النموذجية. تؤكد المنصة أيضًا على التكامل وقابلية التوسع والامتثال والفعالية من حيث التكلفة.

تتميز Flowise بقدرتها على ربط العديد من أدوات ومنصات التعلم الآلي بسلاسة. يوفر خيارات تكامل شاملة، ويدعم العديد من واجهات برمجة التطبيقات والموصلات، مما يجعل من السهل دمج البيانات الحالية وأطر التعلم الآلي. من خلال أكثر من 400 عملية تكامل تم إنشاؤها مسبقًا، يمكن للمؤسسات إنشاء خطوط أنابيب ML مترابطة مع زيادة استثماراتها التكنولوجية الحالية إلى أقصى حد.

«تعمل منصات سير العمل بالذكاء الاصطناعي على سد هذه الفجوة من خلال دمج الذكاء مباشرة في إيقاعات عملك.» - دومو

تعمل واجهته المرئية على تبسيط مهمة رسم خرائط تدفقات البيانات عبر الأنظمة المختلفة، مما يقلل من التعقيد المرتبط عادةً بإدارة أدوات متعددة.

تم تصميم Flowise للتعامل مع عمليات سير العمل المعقدة وعمليات البيانات واسعة النطاق، وهو يدعم التحجيم الأفقي عبر العقد المتعددة. تضمن هذه الإمكانية إمكانية إدارة آلاف المهام ومعالجة كميات كبيرة من البيانات بكفاءة، مما يجعلها خيارًا مثاليًا للاحتياجات على مستوى المؤسسة. توفر ميزات معالجة البيانات في الوقت الفعلي رؤى فورية، وهي ضرورية لعمليات الأعمال الحساسة للوقت. بالإضافة إلى ذلك، يعمل تخصيص الموارد الديناميكي للمنصة على تحسين الأداء خلال فترات ذروة الطلب مع الحفاظ على التكاليف تحت السيطرة أثناء الاستخدام الأقل كثافة.

تقوم Flowise بدمج إدارة الامتثال مباشرة في سير العمل، مما يساعد المؤسسات على تلبية المتطلبات التنظيمية - وهي مهمة بشكل خاص للصناعات ذات الرقابة الصارمة. يمكن للمستخدمين تعيين قواعد الامتثال وفرضها ضمن عمليات سير العمل، مما يضمن توافق معالجة البيانات مع المعايير الضرورية. على سبيل المثال، في عام 2025، استخدمت إحدى شركات الخدمات المالية Flowise لأتمتة تقارير الامتثال الخاصة بها، مما أدى إلى خفض الوقت المستغرق في الشيكات بنسبة 50٪ مع تمكين المراقبة في الوقت الفعلي للالتزام التنظيمي.

«تعمل Flowise على تمكين الفرق من بناء عمليات سير عمل متوافقة دون الحاجة إلى معرفة واسعة بالترميز.» - جون سميث، مدير المنتج في Flowise

يعد تصميم المنصة بدون تعليمات برمجية مفيدًا بشكل خاص للامتثال، لأنه يسمح للفرق بتكييف سير العمل بسرعة مع اللوائح المتغيرة دون الحاجة إلى إعادة برمجة كبيرة.

من خلال القضاء على الحاجة إلى مهارات البرمجة المتخصصة، يقلل Flowise التكاليف مع تسريع الجداول الزمنية للنشر. يمكن للفرق إنشاء وتعديل عمليات سير العمل دون خبرة فنية عميقة، مما يقلل من نفقات العمالة ويسرع وقت الوصول إلى السوق لمشاريع التعلم الآلي. بالإضافة إلى ذلك، تقلل عمليات الدمج المبنية مسبقًا للمنصة من الحاجة إلى التطوير المخصص لربط الأنظمة المختلفة، مما يقلل من تكاليف التنفيذ الأولية ونفقات الصيانة المستمرة.

ميتافلو، وهي منصة مفتوحة المصدر لإدارة سير العمل أنشأتها Netflix، تبسط عمليات التعلم الآلي من خلال السماح لعلماء البيانات بالتركيز على بناء النماذج. يقوم تلقائيًا بتتبع البيانات الوصفية وإعادة تشغيل الخطوات الفاشلة، مما يجعل التعاون أسهل للفرق التي تعمل على عمليات سير العمل المشتركة.

«تساعد Metaflow علماء البيانات على التركيز على بناء النماذج بدلاً من القلق بشأن هندسة MLops.» - فريق Anaconda، نظرة عامة على أدوات MLops

تتميز Metaflow بقدرتها على الاندماج بسلاسة في النظم البيئية الحالية للتعلم الآلي. إنه يعمل بشكل جيد مع المكتبات المستخدمة على نطاق واسع مثل تينسورفلو و سكيكيت ليرن، حيث تقدم واجهة برمجة تطبيقات Python المباشرة التي تبسط تعريف عمليات سير العمل. تضمن سهولة التكامل هذه أن الفرق يمكنها توصيل Metaflow بأدواتها المفضلة دون متاعب.

تدعم المنصة النشر عبر العديد من مزودي السحابة، بما في ذلك الخدمات اللاسلكية المتقدمة، منصة جوجل كلاود، و ميكروسوفت أزور، مما يمنح المؤسسات المرونة اللازمة لتشغيل عمليات سير العمل في البيئات التي تختارها. يضمن هذا التوافق متعدد السحابات الاتساق عبر إعدادات البنية التحتية المختلفة. يمكن للفرق البدء بمشاريع صغيرة لاختبار مدى ملاءمة Metaflow لسير العمل الحالي قبل التوسع إلى تطبيقات أكبر. هذه القدرة على التكيف تجعل من السهل توسيع نطاق العمليات لتلبية احتياجات الإنتاج.

أثبتت Metaflow قدرتها على التعامل مع تدفقات عمل التعلم الآلي على نطاق واسع بكفاءة، حيث أثبتت أنها قادرة على التعامل مع تدفقات عمل التعلم الآلي على نطاق واسع بكفاءة. في عام 2023، استخدمتها Netflix لمعالجة ملايين نقاط البيانات، وتحقيق أداء أفضل للنماذج وأوقات نشر أسرع.

«تسمح Metaflow لعلماء البيانات بالتركيز على نماذجهم مع توفير الأدوات اللازمة لتوسيع نطاق سير العمل وإدارته بفعالية.» - فريق Netflix الهندسي

إن قدرة النظام الأساسي على التوسع عبر البيئات السحابية المختلفة تجعله خيارًا قويًا للمؤسسات التي تدير مجموعات بيانات واسعة ونماذج معقدة. يضمن التتبع التلقائي للتجارب وإصدارها إمكانية التكرار، وهو أمر بالغ الأهمية مع نمو المشاريع من حيث الحجم والتعقيد.

تتضمن Metaflow ميزات حوكمة مدمجة مصممة لضمان سير عمل آمن ومتوافق، مما يجعلها مفيدة بشكل خاص للصناعات ذات اللوائح الصارمة. تقوم المنصة تلقائيًا بتتبع البيانات والتجارب وإصدارها، مما يؤدي إلى إنشاء مسار تدقيق شفاف يدعم الامتثال لمعايير مثل GDPR و هيبا.

في عام 2023، أبلغ فريق علوم البيانات في Netflix عن تحسين الامتثال لسياسات الحوكمة الداخلية بعد اعتماد Metaflow. وأشاروا أيضًا إلى نشر النماذج بشكل أسرع وتقليل الوقت المستغرق في إدارة التجارب، مما يسلط الضوء على قيمة المنصة في البيئات المنظمة.

بالنسبة للمؤسسات التي تتنقل في المشهد التنظيمي المتطور، توفر ميزات حوكمة Metaflow طريقة موثوقة للحفاظ على الامتثال دون التضحية بالكفاءة التشغيلية.

توفر Metaflow وفورات في التكاليف من خلال طبيعتها مفتوحة المصدر وتصميمها الذي يركز على Python. من خلال إلغاء رسوم الترخيص، فإنه يسمح للمؤسسات بتنفيذ حل قوي لإدارة سير العمل دون نفقات مسبقة كبيرة. على الرغم من أنه قد تكون هناك تكاليف مرتبطة بالبنية التحتية السحابية، فإن الاستخدام الفعال لموارد النظام الأساسي يساعد في تقليل هذه النفقات التشغيلية.

يقلل نهجها القائم على Python من الحاجة إلى خبرة MLOPs المتخصصة، مما يقلل من تكاليف العمالة ويسرع النشر. بالإضافة إلى ذلك، فإن توافق Metaflow مع البنية التحتية السحابية الحالية يمكّن المؤسسات من تحقيق أقصى استفادة من استثماراتها التكنولوجية الحالية. من خلال واجهة سهلة الاستخدام، فإنها تقصر منحنى التعلم لفرق علوم البيانات، مما يقلل من تكاليف التدريب ويسرع التبني في جميع أنحاء المؤسسة.

فيكتور شيفت يعمل على تبسيط عمليات سير عمل التعلم الآلي من خلال الاتصال بسهولة بالأدوات والأنظمة الحالية. إنه يسد الفجوة بين المنصات غير المتصلة، مما يتيح سير عمل مبسط وفعال.

«قابلية التشغيل البيني هي المفتاح للمؤسسات التي تتطلع إلى تبسيط عمليات التعلم الآلي الخاصة بها.» - خبير الصناعة، MLops Insights

هذا التركيز على التكامل يضع الأساس لقابلية التوسع والحلول الفعالة من حيث التكلفة.

تتميز VectorShift بقدرتها على الاندماج بسلاسة مع البنى التحتية الحالية للتعلم الآلي من خلال دعم API القوي والموصلات المبنية مسبقًا. بدلاً من الحاجة إلى إصلاح كامل للنظام، فإنه يعمل جنبًا إلى جنب مع الأدوات الحالية، مما يسمح للفرق بمواصلة استخدام الأطر المفضلة لديهم مع الحد الأدنى من التعطيل.

توفر المنصة موصلات لأدوات علوم البيانات المستخدمة على نطاق واسع، مما يقلل بشكل كبير من الوقت والجهد اللازمين للتكامل. إنها بنية مرنة يلبي الاحتياجات التنظيمية المتنوعة، مما يسمح للمستخدمين بتخصيص تدفقات العمل لتناسب بنيتهم التحتية دون تعديلات شاملة.

بحلول عام 2025، أكثر 70% من الشركات من المتوقع أن تعطي الأولوية للتكامل عند اختيار أدوات MLops. تلبي VectorShift هذا الطلب المتزايد من خلال خيارات الاتصال الجاهزة للاستخدام التي تقلل الحواجز التقنية، مما يجعل الاعتماد أكثر سلاسة وسرعة.

تم تصميم VectorShift للنمو مع عمليات التعلم الآلي الخاصة بك. إنها تصميم واجهة برمجة التطبيقات لأول مرة يضمن أن عمليات سير العمل يمكن أن تتوسع جنبًا إلى جنب مع الاحتياجات التنظيمية دون مواجهة تحديات التكامل.

يسمح هذا التصميم للفرق بإنشاء عمليات تكامل مخصصة مصممة خصيصًا لبيئاتها مع الحفاظ على قابلية التوسع. يمكن للمؤسسات البدء بإعداد أصغر وتوسيع استخدامها لـ VectorShift مع نمو مبادرات التعلم الآلي الخاصة بها، مما يضمن حلاً قابلاً للتطوير وجاهزًا للمستقبل.

من خلال التركيز على قابلية التشغيل البيني، تساعد VectorShift المؤسسات على توفير المال. إن قدرتها على الاندماج مع الأدوات الحالية تلغي الحاجة إلى عمليات استبدال أو إصلاحات مكلفة. المنصة استراتيجية الموصل يقلل أيضًا من الحاجة إلى التطوير المخصص، مما يقلل من النفقات الإضافية.

بالنسبة للشركات التي استثمرت بالفعل بكثافة في أطر التعلم الآلي أو أدوات البيانات المحددة، تعمل VectorShift على زيادة هذه الاستثمارات إلى أقصى حد. بدلاً من البدء من الصفر، يمكن للمؤسسات تحسين سير العمل من خلال ربط الأنظمة الحالية، وإنشاء عمليات أكثر تماسكًا وكفاءة.

لتحقيق أقصى استفادة من VectorShift، يجب على المؤسسات تقييم مجموعات الأدوات الحالية واستكشاف كيف يمكن لإمكانيات API الخاصة بها توحيد الأنظمة غير المتصلة. من خلال الاستفادة من هذه المنصة، يمكن للفرق تحسين تدفق البيانات والكفاءة التشغيلية عبر خط أنابيب التعلم الآلي بأكمله، مما يعزز أهمية حلول MLOPs الفعالة والمترابطة.

يلخص هذا القسم نقاط القوة والقيود الرئيسية لكل أداة، ويقدم نظرة عامة واضحة عن تأثيرها على نتائج المشروع. توفر كل أداة إمكانات وتحديات مميزة، والتي يمكن أن تؤثر بشكل كبير على قرارات سير العمل.

تسلط هذه المقارنات الضوء على المقايضات العملية لكل أداة. على سبيل المثال، يسلط نجاح Netflix مع Metaflow الضوء على قدرتها على أتمتة إصدار البيانات وتتبعها، مما يؤدي إلى مكاسب ملموسة في الكفاءة.

«تسمح Metaflow لعلماء البيانات لدينا بالتركيز على بناء النماذج بدلاً من إدارة البنية التحتية». - قائد علوم البيانات في Netflix

يعتمد اختيار الأداة المناسبة على خبرة فريقك وميزانيتك واحتياجات التكامل وأهداف قابلية التوسع. أدوات مثل رقم 8 و فلاويز تمكين المستخدمين غير التقنيين من إنشاء عمليات سير العمل، في حين أن المنصات مثل لانج تشين توفر مرونة متقدمة ولكنها تتطلب الكفاءة الفنية. تشير المؤسسات التي تتبنى ممارسات MLOPS القوية إلى انخفاض بنسبة 60-70٪ في وقت نشر النموذج، مع التأكيد على أهمية اختيار الأداة المناسبة منذ البداية.

«يمكن لأدوات MLops المناسبة أن تقلل بشكل كبير الوقت والتكلفة المرتبطين بنشر نماذج التعلم الآلي.» - سام أوستن، خبير MLOPS

تعزز هذه الأفكار التقييمات السابقة، وتؤكد على أهمية مواءمة اختيار الأداة مع كل من الاحتياجات الفنية والأولويات التنظيمية.

يتطلب اختيار أدوات سير العمل المناسبة موازنة الاحتياجات الفنية وخبرة الفريق والأهداف التنظيمية. يكمن مفتاح النجاح في مواءمة قدرات الأداة مع متطلباتك الفريدة.

Prompts.ai هو خيار متميز للمؤسسات التي تركز على إدارة الذكاء الاصطناعي على مستوى المؤسسة. يوفر الوصول إلى أكثر من 35 نموذجًا لغويًا كبيرًا من الدرجة الأولى ويوفر ما يصل إلى توفير التكاليف بنسبة 98% من خلال ضوابط FinOps الخاصة بها. نظام الحوكمة الموحد الخاص بها مناسب بشكل خاص للفرق التي تتعامل مع تدفقات العمل المعقدة عبر نماذج وإدارات متعددة.

بالنسبة للفرق التي تعطي الأولوية لسهولة الاستخدام، فإن المنصات مثل رقم 8 و فلاويز تقديم أدوات إنشاء سير عمل مرئية سهلة الاستخدام، مما يجعلها في متناول المستخدمين غير التقنيين. ومع ذلك، قد تتطلب هذه الأدوات عمليات تكامل إضافية للتعامل مع مهام التعلم الآلي المتقدمة. من ناحية أخرى، لانجتشين/لانجراف يتفوق في المرونة لسير عمل نموذج اللغة ولكنه يأتي مع منحنى تعليمي حاد يتطلب خبرة كبيرة. وبالمثل، ميتافلو يعد خيارًا ممتازًا لإدارة المشاريع المليئة بالبيانات، على الرغم من أنه قد يؤدي إلى ارتفاع تكاليف الخدمة السحابية.

تخطيط الميزانية هو عامل حاسم آخر. أدوات مفتوحة المصدر مثل رقم 8 غالبًا ما توفر مستويات مجانية، بينما تأتي حلول المؤسسات عادةً بنقاط سعر أعلى. من الضروري تقييم التكلفة الإجمالية للملكية، مع مراعاة نفقات البنية التحتية والتدريب والصيانة.

ابدأ بالأدوات التي تتوافق مع قدراتك الحالية وقم بتوسيع نطاقها مع تطور احتياجاتك. عندما يكتسب فريقك الخبرة، يمكنك الانتقال إلى منصات أكثر تقدمًا أو دمج أدوات متعددة لتوسيع الوظائف.

مع توقع نمو تدفقات العمل المدعومة بالذكاء الاصطناعي من 3٪ إلى 25٪ من عمليات المؤسسة بحلول نهاية عام 2025، يعد اختيار الأدوات التي تقدم دعمًا مجتمعيًا قويًا وتحديثات متسقة وخيارات تكامل سلسة أمرًا بالغ الأهمية. ستضمن هذه العوامل بقاء استثمارك فعالًا وقابلًا للتكيف في هذا المجال سريع التقدم.

لاختيار أداة سير عمل التعلم الآلي المناسبة، من الضروري البدء بتحديد الاحتياجات المحددة لمشروعك. يجب أن توجه قرارك عوامل مثل تعقيد بياناتك وحجم فريقك ومتطلبات النشر. ابحث عن الأدوات التي توفر قابلية التشغيل البيني، القابلية للتطوير، وهي سهلة الاستخدام، مما يضمن أنها تلبي أهدافك الفورية وخططك طويلة الأجل.

قم بتقييم مدى نجاح الأداة في تسهيل التعاون وتبسيط التشغيل الآلي والتكامل مع أنظمتك الحالية. يمكن أن يوفر تشغيل مشروع صغير أو تجريبي رؤى قيمة حول ما إذا كانت المنصة تتوافق مع أهداف مؤسستك. ركز على الخيارات التي تعزز الإنتاجية وتبسط العمليات لفريقك.

للحفاظ على الامتثال والحوكمة السليمة عند دمج أدوات سير عمل التعلم الآلي، يجب على الشركات التركيز على التحكم في الإصدار لجميع القطع الأثرية ذات الصلة، بما في ذلك النماذج ومجموعات البيانات والتعليمات البرمجية. يضمن هذا النهج الشفافية ويسهل تتبع التغييرات طوال عملية التطوير.

تعد أتمتة خط أنابيب التعلم الآلي خطوة رئيسية أخرى. إنه لا يعزز الاتساق فحسب، بل يقلل أيضًا من مخاطر الخطأ البشري. بنفس القدر من الأهمية هو إنشاء عمليات تحقق شاملة من صحة البيانات لدعمها جودة البيانات ونزاهتها، والتي تعتبر حيوية لإنتاج نتائج نموذجية موثوقة وغير متحيزة.

من خلال معالجة هذه المجالات الحرجة، يمكن للمؤسسات تحسين المساءلة وتبسيط سير العمل وتلبية المعايير التنظيمية بثقة.

أدوات مفتوحة المصدر مثل رقم 8 و ميتافلو تقدم طريقة فعالة من حيث التكلفة لإدارة سير عمل التعلم الآلي من خلال إلغاء رسوم الترخيص الضخمة. إنها توفر للفرق المرونة لتخصيص العمليات وأتمتتها دون التكاليف العالية للمنصات الاحتكارية. وهذا يجعلها خيارًا جذابًا للشركات الناشئة والشركات الصغيرة التي تعمل بميزانيات ضيقة.

ومع ذلك، غالبًا ما تأتي هذه الأدوات مع بعض المقايضات. قد يفتقرون إلى الميزات المتقدمة أو يعانون من قابلية التوسع أو يقدمون دعمًا مخصصًا محدودًا. وعلى الرغم من أنها تعمل بشكل جيد للمشاريع الأصغر أو الأقل تعقيدًا، إلا أن توسيع نطاقها للتعامل مع الاحتياجات على مستوى المؤسسة قد يتطلب بذل جهد إضافي، مثل التطوير المخصص أو ترقيات البنية التحتية. من المهم أن تزن مدى تعقيد مشروعك واحتياجات النمو المستقبلية قبل اختيار حل مفتوح المصدر.