Les plateformes d'orchestration de l'IA sont désormais essentielles pour les entreprises américaines qui géreront des flux de travail complexes en 2025. Ces outils rationalisent les modèles d'IA, les pipelines de données et les API, garantissant ainsi efficacité et conformité à grande échelle. Voici les les 10 meilleures plateformes à prendre en compte, chacune offrant des fonctionnalités uniques d'intégration, d'automatisation et de gouvernance :

Ces plateformes permettent aux entreprises d'automatiser, de faire évoluer et de sécuriser les opérations d'IA, de gagner en efficacité et de réduire les coûts. Concentrez-vous sur les besoins en matière de flux de travail, les exigences de conformité et le budget de votre organisation pour sélectionner la solution la mieux adaptée.

Lors du choix d'une plateforme d'orchestration d'IA, il est essentiel de se concentrer sur les fonctionnalités qui distinguent les solutions prêtes à l'emploi des outils de base. Ces fonctionnalités garantissent que la plateforme offre une valeur à long terme tout en s'adaptant à l'évolution de vos besoins. Voici les principaux éléments à prendre en compte :

Interopérabilité et flexibilité des modèles constituent l'épine dorsale de toute plateforme d'orchestration d'IA efficace. Les meilleures solutions prennent en charge un large éventail de modèles d'IA, ce qui vous permet d'adopter rapidement de nouvelles technologies et d'éviter d'être lié à un seul fournisseur. Recherchez des plateformes qui s'intègrent parfaitement aux principaux modèles tels que les variantes GPT, Claude, LLama et Gemini.

Automatisation des flux de travail et gestion des pipelines rationalisez les tâches répétitives, gagnez du temps et réduisez les erreurs. Les plateformes avancées incluent des constructeurs visuels dotés d'outils de glisser-déposer pour concevoir des flux de travail complexes. Ils peuvent gérer des tâches telles que le prétraitement des données, le chaînage de modèles, la validation des sorties, la gestion des erreurs, la planification, le déclenchement d'actions et la gestion du contrôle des versions. Une telle automatisation est cruciale pour faire évoluer efficacement les opérations d'IA.

Cadre de sécurité et de conformité est indispensable, en particulier pour les organisations basées aux États-Unis qui doivent respecter des normes réglementaires strictes. Une plateforme fiable doit être conforme à des cadres tels que SOC 2 Type II, HIPAA et SOX. Des fonctionnalités telles que le chiffrement de bout en bout, les pistes d'audit détaillées et l'accès contrôlé aux données sensibles garantissent une sécurité et une conformité robustes.

Transparence des coûts et opérations financières (FinOps) aider à maintenir le contrôle budgétaire et l'efficacité opérationnelle. Les plateformes offrant des informations sur les coûts en temps réel vous permettent de surveiller les dépenses, d'identifier les domaines à optimiser et d'éviter les dépenses surprises.

Gestion de l'évolutivité et des performances assurez-vous que la plateforme peut évoluer en fonction des demandes croissantes de votre organisation en matière d'IA. Recherchez des fonctionnalités telles que la mise à l'échelle automatique pendant les périodes de forte utilisation, l'équilibrage de charge et la capacité à gérer des ensembles de données plus importants et des environnements informatiques distribués. Ces fonctionnalités sont essentielles pour maintenir des performances constantes au fur et à mesure que vos initiatives d'IA se développent.

Écosystème d'intégration et support des API déterminez la facilité avec laquelle la plateforme se connecte à vos outils et systèmes existants. Au-delà de l'automatisation des flux de travail, la solide prise en charge des API garantit une interaction fluide avec les applications métier telles que Salesforce, Microsoft 365 et Slack, ainsi qu'avec les principaux fournisseurs de cloud. Des connecteurs prédéfinis, une documentation complète sur les API et la prise en charge des API REST et GraphQL facilitent l'intégration et la personnalisation.

Capacités de gouvernance et d'audit fournir la supervision nécessaire aux opérations d'IA au niveau de l'entreprise. Une journalisation complète doit enregistrer chaque interaction, chaque décision et chaque événement d'accès aux données. Les contrôles d'accès basés sur les rôles garantissent que les membres de l'équipe n'ont accès qu'à ce dont ils ont besoin, tandis que le contrôle des versions permet des annulations rapides. Ces fonctionnalités sont essentielles au maintien de la conformité et à la simplification du dépannage.

Expérience utilisateur et outils de collaboration jouent un rôle clé dans l'adoption. Les interfaces intuitives réduisent la courbe d'apprentissage, ce qui permet aux équipes de démarrer plus facilement. Les fonctionnalités de collaboration, telles que les bibliothèques d'invites partagées, les espaces de travail d'équipe et les systèmes de commentaires intégrés, encouragent le partage des connaissances et le développement de meilleures pratiques. Les plateformes qui s'adressent à la fois aux utilisateurs débutants et avancés favorisent une adoption plus large et une mise en œuvre plus efficace.

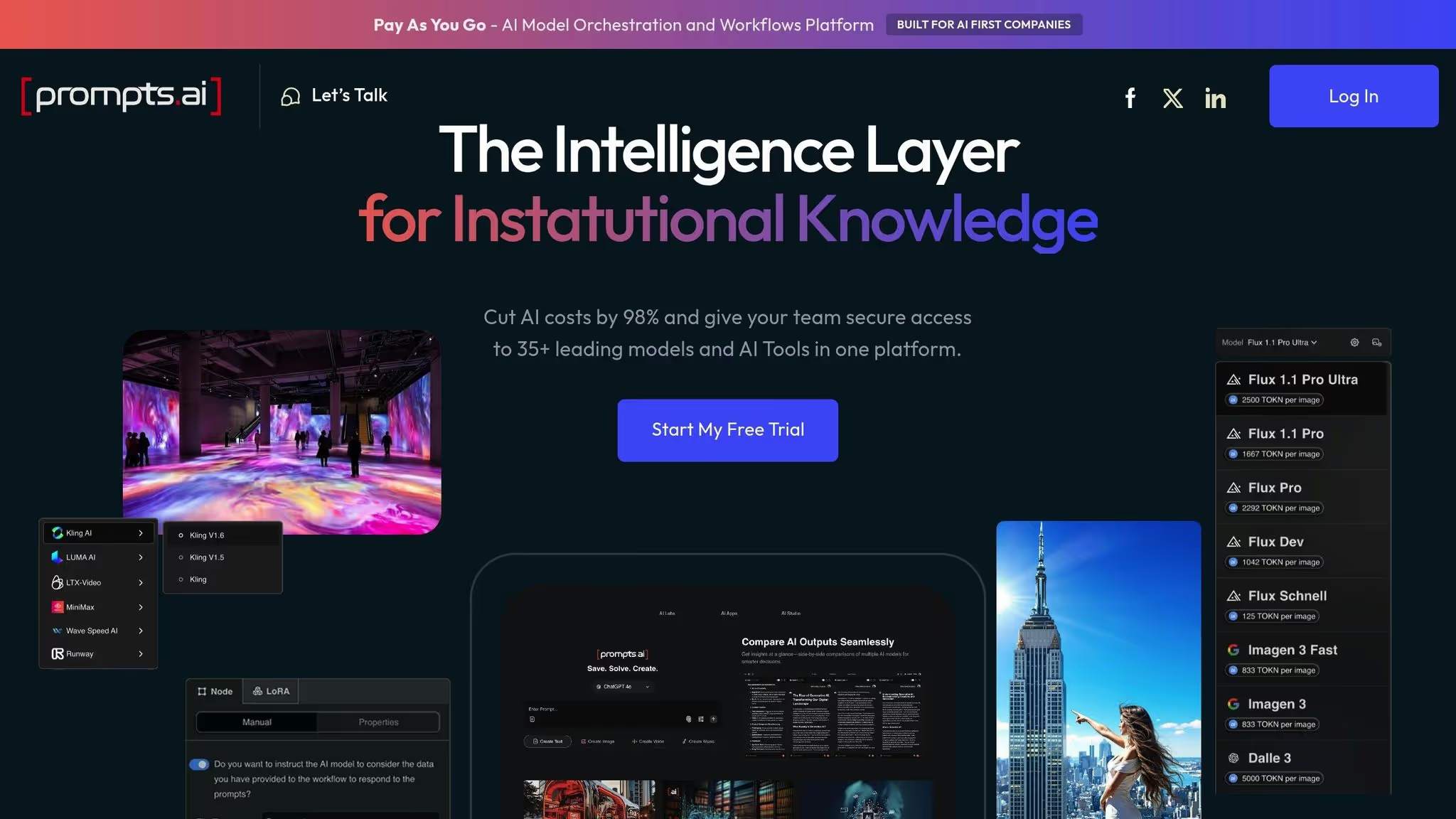

prompts.ai se distingue comme la meilleure solution de cette revue, car elle montre comment une plateforme unifiée peut simplifier l'orchestration de l'IA pour les entreprises. Ce plateforme d'IA de niveau entreprise réunit plus de 35 modèles d'IA de pointe sous un même toit, offrant aux entreprises la gouvernance et le contrôle des coûts dont elles ont besoin. Conçu pour les entreprises du Fortune 500, les agences de création et les laboratoires de recherche, il transforme les expériences dispersées en flux de travail reproductibles et conformes. L'intégration transparente de l'interopérabilité des modèles et des flux de travail automatisés de la plateforme en fait la pierre angulaire des opérations d'IA des entreprises.

L'un des principaux atouts de la plateforme est sa accès à une interface unique à un large éventail de modèles d'IA, y compris GPT-5, Claude, LLama et Gemini. En consolidant les outils au sein d'un écosystème unique, prompts.ai élimine les problèmes d'efficacité liés à la jonglerie entre plusieurs plateformes, rationalisant ainsi les flux de travail entre les équipes et les départements. Il prend également en charge collaboration entre plusieurs agents, permettant aux agents d'IA de travailler ensemble, de partager le contexte et de gérer les tâches pour des opérations évolutives. De plus, la plateforme s'intègre à des services cloud populaires tels que Google Cloud Vertex AI et Amazon Nova, tout en prenant en charge le schéma OpenAPI pour connecter des systèmes externes.

prompts.ai excelle dans transformer les tâches manuelles en flux de travail automatisés dans les différentes fonctions de l'entreprise. Les utilisateurs peuvent accéder à des flux de travail conçus par des experts et à des modèles d'invite personnalisables, permettant ainsi des processus cohérents et efficaces.

Des exemples concrets mettent en évidence son impact. Par exemple :

« Un directeur artistique lauréat d'un Emmy avait l'habitude de passer des semaines à réaliser des rendus dans 3D Studio et un mois à rédiger des propositions commerciales. Grâce aux LoRas et aux flux de travail de Prompts.ai, il réalise désormais les rendus et les propositions en une seule journée. Plus besoin d'attendre, plus de stress lié aux mises à niveau matérielles. » - PDG et fondateur, Steven Simmons

La plateforme comprend également fonctionnalités RAG intégrées avec prise en charge des bases de données vectorielles, permettant une intégration avancée avec les bases de connaissances pour créer des flux de travail plus intelligents. Les intégrations avec des outils tels que Slack, Gmail et Trello améliorent encore l'efficacité, garantissant le bon fonctionnement des processus au sein de l'entreprise. Combiné à l'automatisation, cela permet aux entreprises de gagner du temps et de se concentrer sur leurs objectifs stratégiques.

prompts.ai donne la priorité à la sécurité de l'entreprise en respectant des normes strictes telles que SOC 2 Type II, HIPAA et GDPR. La plateforme surveille en permanence la conformité à ces cadres, garantissant ainsi aux organisations de maintenir une solide posture de sécurité.

Le Centre de confiance fournit une visibilité en temps réel sur les politiques de sécurité, les contrôles et les progrès de conformité. Grâce à l'auditabilité complète de toutes les interactions avec l'IA et à des contrôles d'accès robustes basés sur les rôles, les entreprises peuvent faire évoluer leurs opérations d'IA tout en maintenant une gouvernance stricte.

L'une des caractéristiques les plus remarquables de la plateforme est sa capacité à relever les défis financiers liés à l'adoption de l'IA. prompts.ai propose outils FinOps en temps réel et une tarification transparente et basée sur l'utilisation qui donne aux entreprises une visibilité totale sur leurs dépenses.

Fonctionnant sur un Système de crédit TOKN Pay-As-You-Go, la plateforme élimine les frais récurrents, alignant les coûts directement sur l'utilisation. Cette approche permet non seulement de réduire les dépenses liées aux logiciels, mais aussi de lier l'utilisation des jetons aux résultats commerciaux. Les comparaisons de performances entre les modèles permettent aux équipes de prendre des décisions éclairées, transformant ainsi les dépenses liées à l'IA en un investissement stratégique et mesurable.

Kubiya AI est une plateforme multi-agents flexible conçue pour automatiser les flux de travail DevOps. Conçu pour les entreprises, il simplifie la gestion de l'infrastructure et les processus opérationnels grâce à une automatisation intelligente, ce qui en fait un choix judicieux pour les entreprises ayant des besoins d'infrastructure complexes.

L'une des caractéristiques les plus remarquables de Kubiya AI est sa capacité à réduire considérablement le temps de provisionnement de l'infrastructure, de quelques jours à quelques heures seulement. En permettant le provisionnement de l'infrastructure en libre-service, la plateforme élimine la nécessité de créer des scripts manuels, ce qui permet aux développeurs d'allouer des ressources en toute simplicité.

Lors de l'exécution du flux de travail, la plateforme applique temporairement les règles de sécurité, minimisant ainsi le risque d'erreur humaine tout en garantissant le respect des politiques organisationnelles. Cette approche garantit des opérations cohérentes et prévisibles, un facteur essentiel pour les entreprises où la fiabilité n'est pas négociable. Ces processus automatisés s'intègrent naturellement à des protocoles de sécurité plus stricts, garantissant ainsi des opérations fluides et sécurisées.

Kubiya AI intègre l'application automatique des règles de sécurité et de conformité pour se prémunir contre les violations des politiques. Cela réduit la nécessité d'une surveillance manuelle constante, ce qui permet de gagner du temps et de réduire le risque d'erreurs.

La journalisation complète garantit une auditabilité totale, fournissant un enregistrement détaillé indispensable aux entreprises des secteurs réglementés. Ces journaux, combinés à des mises à jour de statut en temps réel, renforcent la responsabilité et simplifient les audits de conformité. Cela permet non seulement de réduire les efforts manuels, mais aussi de favoriser une mise à l'échelle efficace des opérations. Grâce à ces mesures de sécurité robustes, Kubiya AI fournit également des informations sur les coûts, qui sont essentielles pour prendre des décisions éclairées pour les entreprises.

Bien que les détails des prix spécifiques de Kubiya AI ne soient pas divulgués publiquement, ses fonctionnalités avancées sont clairement positionnées pour les opérations à grande échelle.

Pour les entreprises qui évaluent son retour sur investissement, les principaux avantages incluent un provisionnement plus rapide de l'infrastructure et une meilleure productivité des développeurs. En automatisant les tâches de routine, la plateforme permet aux équipes DevOps de se concentrer sur des activités à plus forte valeur ajoutée, ce qui entraîne des économies de coûts importantes. L'accent mis sur la fiabilité et la réduction des interventions manuelles améliorent encore l'efficacité opérationnelle. Cependant, les fonctionnalités sophistiquées de la plateforme peuvent dépasser les besoins des petites équipes ou des environnements moins complexes, ce qui en fait la solution idéale pour les entreprises dont les besoins en infrastructure sont importants et dont l'envergure justifie l'investissement.

Domo fournit une plateforme de flux de travail d'IA sécurisée conçue avec des politiques de sécurité intégrées, des cadres de conformité, des journaux d'audit et des alertes proactives pour assurer la sécurité et l'efficacité des opérations. Ces outils permettent de garantir la qualité des données, de minimiser les risques et de soutenir une gouvernance évolutive. En mettant l'accent sur la sécurité et la conformité, Domo permet aux entreprises de développer leurs initiatives d'IA en toute confiance.

Apache Airflow est un orchestrateur de flux de travail open source largement utilisé, particulièrement apprécié dans les milieux de l'ingénierie des données et de l'IA pour sa capacité à gérer et à rationaliser efficacement les processus pilotés par l'IA. Sa conception garantit la transparence des dépendances du flux de travail et améliore la fiabilité de l'exécution des tâches.

Au cœur des fonctionnalités d'Airflow se trouvent les graphes acycliques dirigés (DAG), qui fournissent une représentation visuelle claire des dépendances entre les tâches. Ces DAG jouent un rôle essentiel dans la coordination de tâches complexes telles que la formation au machine learning, le déploiement de modèles et la génération augmentée par extraction.

Airflow est équipé d'une suite d'opérateurs prédéfinis conçus pour les flux de travail d'apprentissage automatique, couvrant des tâches telles que la formation de modèles, l'inférence et la surveillance. Ses fonctionnalités robustes de planification et de gestion des dépendances permettent une orchestration fluide de séquences d'automatisation complexes, garantissant ainsi le fonctionnement efficace des pipelines d'IA.

Les capacités d'Airflow vont au-delà de l'automatisation. L'une de ses caractéristiques les plus remarquables est sa capacité à s'intégrer sans effort aux principaux services de ML dans le cloud, tels que Google Cloud Platform (GCP), Amazon Web Services (AWS) et Azure ML. Cette interopérabilité est encore renforcée par son extensibilité via des bibliothèques Python et des plugins personnalisés, ce qui le rend hautement adaptable à l'automatisation des flux de travail au niveau de l'entreprise. Les équipes de développement peuvent également créer des opérateurs personnalisés, ce qui permet l'intégration avec pratiquement tous les services d'IA, ce qui rend la plateforme polyvalente pour diverses technologies.

En tant qu'outil open source, Apache Airflow offre la flexibilité et la personnalisation dont les entreprises ont besoin, ce qui en fait un excellent choix pour ceux qui souhaitent créer des solutions d'orchestration d'IA personnalisées.

IBM Watsonx Orchestrate associe l'IA conversationnelle, l'automatisation des flux de travail et l'optimisation des processus métier, s'appuyant sur des décennies d'expertise dans les logiciels d'entreprise. Il offre aux entreprises une solution d'IA sécurisée et conforme, à la fois puissante et conviviale.

Cette plateforme simplifie l'automatisation des flux de travail à l'aide de commandes en langage naturel, transformant ainsi les entrées des utilisateurs en processus exploitables sur différents systèmes.

Grâce à son architecture basée sur les compétences, watsonx Orchestrate fournit des fonctions prédéfinies dans des domaines tels que les ressources humaines, la gestion des services informatiques et les finances. Ces fonctions peuvent être personnalisées pour créer des flux de travail d'automatisation interservices. La plateforme est particulièrement efficace pour flux de travail axés sur l'humain, où une intervention humaine ou une approbation est requise à des étapes spécifiques. Ce modèle hybride garantit que même si les tâches de routine sont automatisées, les décisions critiques restent sous supervision humaine. Ces fonctionnalités constituent une base solide pour les nombreuses options d'intégration de la plateforme.

IBM Watsonx Orchestrate s'intègre parfaitement à IBM Découverte de Watson, Assistant Watson, et d'autres modèles watsonx.ai. En outre, il se connecte à des outils d'entreprise tels que Salesforce, ServiceNow, Microsoft 365 et SÈVE, grâce à sa conception axée sur l'API.

Pour les entreprises dotées de systèmes uniques, la plateforme prend en charge des connecteurs personnalisés, offrant la flexibilité nécessaire pour s'adapter à des exigences spécifiques. Cela garantit que les organisations ne sont pas liées à une seule pile technologique, ce qui leur permet d'adapter la plateforme à leurs besoins spécifiques. Ces intégrations sont renforcées par des protocoles de sécurité robustes.

La sécurité est au cœur de Watsonx Orchestrate. La plateforme utilise contrôles d'accès basés sur les rôles, en veillant à ce que les employés accèdent uniquement aux flux de travail et aux données pertinents pour leurs rôles. Cette approche granulaire soutient la gouvernance des données tout en favorisant une adoption plus large de l'IA.

Pour répondre aux besoins réglementaires, contrôles de résidence des données permettent aux entreprises de déterminer où leurs données sont traitées et stockées, une fonctionnalité essentielle pour des secteurs tels que la santé et la finance. La plateforme conserve également des pistes d'audit détaillées pour toutes les activités de flux de travail, offrant ainsi une transparence en matière de surveillance de la conformité et de la sécurité.

IBM a intégré gouvernance responsable de l'IA dans la plateforme, en fournissant des outils permettant de suivre les décisions prises par l'IA et d'expliquer les actions automatisées. Cette transparence aide les entreprises à respecter les nouvelles normes de gouvernance de l'IA et favorise la confiance dans les systèmes automatisés.

La plateforme fonctionne selon un modèle d'abonnement qui s'adapte en fonction de l'utilisation. Grâce à l'analytique intégrée, les entreprises peuvent identifier les inducteurs de coûts et planifier leurs budgets de manière plus efficace.

Son système de facturation basé sur la consommation, associé à des recommandations d'optimisation, garantit que les dépenses correspondent à l'utilisation réelle. Cette approche est particulièrement bénéfique pour les organisations dont la charge de travail en matière d'IA fluctue, car elle les aide à gérer leurs coûts de manière efficace.

La plateforme d'automatisation agentique UiPath fait passer l'automatisation des flux de travail à un niveau supérieur grâce à son approche basée sur les agents. En intégrant des agents d'IA intelligents, la plateforme transforme l'automatisation robotique des processus (RPA) traditionnelle en un système capable de gérer de manière autonome des flux de travail complexes et multisystèmes.

Grâce à sa conception agentique, la plateforme permet aux robots d'analyser des scénarios de manière indépendante et de gérer des processus complexes en plusieurs étapes avec un minimum d'intervention humaine. Cette combinaison de prise de décision et d'exécution des processus garantit des opérations fluides et efficaces.

La plateforme donne la priorité à la supervision et à la conformité grâce à des tableaux de bord de gouvernance centralisés, offrant une vue claire de toutes les activités d'automatisation. Les robots pilotés par l'IA améliorent encore cela en vérifiant le respect des normes réglementaires et des règles commerciales internes.

Bien que les détails spécifiques des prix ne soient pas divulgués, la capacité de la plateforme à rationaliser les processus et à améliorer la précision permet aux organisations de réorienter leurs ressources vers des tâches plus stratégiques et à forte valeur ajoutée. Cette efficacité se traduit par des améliorations opérationnelles, témoignant de l'engagement d'UiPath à combiner automatisation, sécurité et rentabilité pour des résultats commerciaux tangibles.

Anyscale est une plateforme d'orchestration d'IA avancée basée sur le framework open source Ray. Conçu pour gérer des opérations d'IA complexes sur plusieurs clusters, il est spécialisé dans la gestion des charges de travail d'IA distribuées, ce qui en fait un excellent choix pour les organisations gérant des projets d'apprentissage automatique à grande échelle.

En s'appuyant sur le framework Ray, Anyscale garantit la compatibilité avec les principaux frameworks d'apprentissage automatique, créant ainsi un environnement cohérent dans lequel divers modèles d'IA peuvent prospérer. Cette intégration permet aux équipes de data science d'utiliser leurs outils préférés tout en maintenant une orchestration fluide tout au long du pipeline d'IA.

La plateforme prend en charge opérations intercadres, permettant un déploiement fluide de modèles créés avec différentes bibliothèques d'apprentissage automatique. Cette capacité d'adaptation change la donne pour les entreprises disposant de portefeuilles d'IA variés, car elle leur permet d'unifier leurs flux de travail sans se soucier de la compatibilité. Les organisations peuvent ainsi automatiser les processus qui améliorent à la fois les performances et l'efficacité.

Propulsé par Ray Serve, Anyscale propose des services de modèles distribués hautes performances et automatise la distribution des tâches de formation sur les clusters GPU. Il adapte dynamiquement l'inférence en temps réel, garantissant ainsi que les ressources correspondent à la demande sans dépenses inutiles.

Prenons l'exemple d'une entreprise de services financiers utilisant des modèles prédictifs à grande échelle en 2025. Avec Anyscale, ils peuvent répartir les tâches de formation entre les GPU, déployer des modèles en production et adapter l'inférence de manière dynamique en fonction du volume de transactions. Cette configuration garantit des performances optimales tout en maîtrisant les coûts d'infrastructure.

De plus, Ray Serve excelle dans la gestion service de modèles sensibles à la latence à l'échelle de l'entreprise. Cette fonctionnalité est particulièrement utile pour les applications d'IA critiques qui nécessitent des performances fiables, même en cas de charges de travail fluctuantes.

Anyscale ne se contente pas d'optimiser les performances, elle donne également la priorité à la rentabilité. En utilisant une gestion intelligente des ressources et une mise à l'échelle dynamique, la plate-forme garantit que les ressources informatiques ne sont utilisées que lorsque cela est nécessaire. Cette approche se traduit par des économies mesurables par rapport aux déploiements statiques.

Cette conception soucieuse des coûts est particulièrement avantageuse pour les entreprises qui gèrent plusieurs charges de travail d'IA avec des besoins de calcul variables au cours de la journée ou selon les différents projets.

La sécurité reste une priorité absolue pour Anyscale. Avec des options de déploiement hybrides et des garanties pour les configurations multi-clusters, la plateforme permet aux entreprises de gérer en toute sécurité les données sensibles dans les environnements cloud et sur site.

Anyscale est conçu pour s'aligner sur les politiques de sécurité des entreprises, garantissant ainsi la sécurité des opérations d'IA distribuées sans compromettre les performances ou l'évolutivité. Cet équilibre en fait un choix fiable pour les organisations qui traitent des données sensibles ou réglementées.

SuperAgi est une plateforme open source conçue pour créer des agents d'IA autonomes capables de fonctionner de manière indépendante tout en se coordonnant parfaitement au sein de flux de travail complexes. Il se distingue par sa capacité à gérer ces agents de manière efficace, en veillant à ce qu'ils travaillent ensemble sans heurts.

L'architecture de SuperAgi est conçue pour s'intégrer à une variété de grands modèles de langage et de frameworks d'IA. Grâce à ses interfaces d'agent unifiées, la plateforme permet de passer facilement d'un modèle d'IA à l'autre sans avoir à modifier le code sous-jacent.

Cette capacité d'adaptation est particulièrement utile pour les entreprises qui souhaitent équilibrer performances et coûts entre différentes applications. Par exemple, une équipe du service client peut déployer des modèles légers pour les requêtes de routine et rediriger automatiquement les problèmes plus complexes vers des modèles avancés. SuperAgi gère ces transitions en arrière-plan, garantissant ainsi des performances constantes quel que soit le modèle utilisé.

Grâce à ses conception indépendante du modèle, les équipes peuvent facilement tester et adopter de nouveaux modèles d'IA au fur et à mesure de leur apparition, en évitant de se retrouver dans une dépendance vis-à-vis des fournisseurs et en gardant une longueur d'avance sur les avancées technologiques. Cette flexibilité prend également en charge des flux de travail complexes et multi-agents, ce qui facilite l'adaptation des solutions à l'évolution des besoins.

SuperAgi se distingue lorsqu'il s'agit d'orchestrer des flux de travail impliquant plusieurs agents d'IA travaillant ensemble. Ses outils de coordination avancés permettent aux agents de communiquer efficacement, de partager le contexte et d'exécuter des tâches de manière séquentielle ou parallèle.

Chaque agent peut se concentrer sur des tâches spécifiques tout en restant informé de l'ensemble du flux de travail. Par exemple, dans un projet de recherche automatisé, un agent peut collecter des données, un autre peut les analyser et un troisième peut compiler les résultats dans un rapport. Cette approche collaborative garantit efficacité et clarté dans les opérations complexes.

La plateforme architecture pilotée par les événements ajoute une nouvelle couche de fonctionnalités, permettant aux agents de s'adapter de manière dynamique à l'évolution des conditions. Ils peuvent surveiller les systèmes externes, réagir aux nouvelles informations et ajuster leurs actions sans intervention humaine. Cela fait de SuperAGI un excellent choix pour les applications en temps réel où des réponses rapides et flexibles sont essentielles.

SuperAgi complète ses solides capacités d'intégration et d'automatisation par de solides fonctionnalités de sécurité. À travers contrôle du comportement des agents et des protocoles de communication sécurisés, la plateforme garantit que les systèmes autonomes fonctionnent de manière sûre et responsable. Les contrôles basés sur les rôles et les mesures de sécurité personnalisables permettent de limiter les actions des agents, de minimiser les risques et d'éviter les résultats imprévus.

De plus, la plateforme tient à jour des journaux d'audit détaillés qui suivent chaque décision et action prise par ses agents. Cette transparence est essentielle pour les organisations qui doivent se conformer à des normes réglementaires ou à des politiques de gouvernance internes.

SuperAgi mécanismes de sécurité personnalisables permettre aux entreprises de définir les limites opérationnelles en fonction de leurs politiques spécifiques et de leur tolérance au risque. Même dans des situations imprévisibles, ces garanties garantissent que les agents agissent dans des limites acceptables, offrant ainsi la tranquillité d'esprit aux entreprises qui s'appuient sur des systèmes autonomes.

Microsoft AutoGen est un framework open source créé par Microsoft Research pour créer des systèmes d'IA conversationnelle multi-agents. Il est conçu pour permettre aux agents d'IA de collaborer efficacement sur des tâches complexes par le biais de conversations structurées, ce qui le rend particulièrement utile pour les scénarios nécessitant une expertise variée et une résolution itérative de problèmes.

L'architecture d'AutoGen est conçue pour s'intégrer sans effort à plusieurs grands modèles de langage, notamment la série GPT d'OpenAI, le service Azure OpenAI et diverses options open source. C'est design neutre par rapport au modèle permet aux développeurs de combiner différents modèles d'IA dans un seul flux de conversation, en équilibrant fonctionnalités et rentabilité.

Par exemple, un assistant de codage peut tirer parti d'un modèle axé sur la programmation, tandis qu'un agent d'écriture peut utiliser un modèle adapté aux tâches créatives. AutoGen garantit que ces agents peuvent communiquer de manière fluide, quels que soient les modèles d'IA sous-jacents sur lesquels ils s'appuient.

Le cadre prend également en charge l'utilisation de modèles personnalisés et affinés, permettant aux organisations d'intégrer leurs solutions d'IA propriétaires. Grâce à son interface standardisée, la commutation entre les modèles implique un minimum d'ajustements de code. Cela protège non seulement les investissements antérieurs dans l'infrastructure d'IA, mais permet également aux équipes d'expérimenter de nouvelles technologies. Cette adaptabilité ouvre la voie à une automatisation dynamique des flux de travail.

En élargissant ses capacités d'intégration, AutoGen facilite l'automatisation de flux de travail complexes grâce à programmation conversationnelle. Contrairement à l'automatisation linéaire traditionnelle, cette plateforme permet aux agents de participer à des dialogues dynamiques, de débattre d'idées et d'affiner leurs résultats de manière itérative grâce à des discussions structurées.

Le framework prend en charge tout, des simples interactions entre deux agents aux conversations multipartites complexes. Les agents peuvent assumer des rôles tels que proxies, assistants, ou critiques, chacun apportant des points de vue distincts. Cela est particulièrement bénéfique pour les tâches qui nécessitent de multiples cycles de révision et d'affinement.

AutoGen fonctionnalité de discussion de groupe améliore la coordination en permettant aux agents de rejoindre ou de quitter les conversations en fonction du contexte, de leur expertise ou de l'étape actuelle du flux de travail. Le système gère le tour de rôle, garantit des contributions pertinentes et conserve un historique détaillé des conversations à titre de référence.

Microsoft AutoGen est équipé de fonctionnalités de sécurité de niveau professionnel répondant aux normes organisationnelles. Il comprend outils de filtrage de contenu qui peuvent être personnalisés pour s'aligner sur les politiques de l'entreprise, garantissant ainsi que les résultats restent appropriés et professionnels dans toutes les interactions avec les agents.

La plateforme propose également pistes d'audit qui enregistrent chaque message, chaque décision et chaque appel de modèle dans le cadre de conversations multi-agents. Cette transparence est inestimable pour répondre aux exigences de conformité et pour revoir les processus décisionnels pilotés par l'IA.

Intégration avec Azure Active Directory et l'écosystème de sécurité élargi de Microsoft ajoute une couche de protection supplémentaire. Les organisations peuvent mettre en œuvre des contrôles d'accès basés sur les rôles, surveiller les activités des agents et appliquer des politiques de gouvernance conformes à leurs cadres de sécurité existants. Cela garantit que, tout en favorisant la collaboration entre les agents, la plateforme dispose également de protocoles de sécurité et de conformité robustes.

Botpress se distingue en tant que plateforme d'IA conversationnelle open source conçue pour rationaliser la gestion des dialogues tout en s'intégrant parfaitement à de grands modèles linguistiques. Sa configuration modulaire permet la création de flux de travail personnalisés, une mise en œuvre évolutive et une intégration fluide avec les systèmes de messagerie d'entreprise. Cela en fait un outil puissant pour automatiser les interactions conversationnelles et les intégrer dans des processus plus vastes pilotés par l'IA. En se concentrant sur une conception centrée sur les dialogues, Botpress s'aligne sur les stratégies avancées de flux de travail de l'IA, offrant aux organisations une solution pratique pour améliorer leurs capacités d'IA conversationnelle.

Le tableau ci-dessous simplifie les principales fonctionnalités des différentes plateformes, en mettant l'accent sur les éléments essentiels pour gérer efficacement les flux de travail liés à l'IA. Il fournit une référence rapide pour compléter les examens détaillés discutés précédemment.

Cette comparaison montre que chaque plateforme possède ses propres points forts et ses propres compromis. Pour choisir la bonne solution d'orchestration de l'IA, concentrez-vous sur les fonctionnalités qui correspondent aux besoins techniques, aux normes de conformité et aux considérations financières de votre organisation.

Pour choisir la bonne plateforme d'orchestration de l'IA, vous devez examiner attentivement les besoins uniques, les exigences techniques et les objectifs à long terme de votre organisation. Les plateformes abordées ici présentent une gamme d'options, allant de solutions d'entreprise complètes à des outils adaptés à des tâches spécifiques, chacune abordant différents aspects de la gestion des flux de travail liés à l'IA.

Gestion des coûts est une priorité absolue pour les entreprises américaines. Des outils tels que prompts.ai montrent comment des fonctionnalités telles que les fonctionnalités FinOps en temps réel peuvent réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %. En proposant un suivi transparent des jetons et une tarification à l'utilisation, ces plateformes alignent les coûts directement sur l'utilisation, ce qui en fait un choix pratique pour les organisations soucieuses de leur budget.

Conformité et sécurité ne sont pas négociables, en particulier pour les entreprises des secteurs réglementés. Les plateformes professionnelles dotées de pistes d'audit détaillées et de contrôles de gouvernance offrent la fiabilité nécessaire à une utilisation responsable de l'IA. Ces fonctionnalités garantissent la souveraineté des données et fournissent la documentation nécessaire pour répondre à des exigences de sécurité strictes.

Diversité des modèles joue un rôle crucial pour rester adaptable et éviter la dépendance vis-à-vis des fournisseurs. Les plateformes qui prennent en charge plus de 35 grands modèles linguistiques, tels que GPT-5, Claude, LLama et Gemini, permettent aux organisations de suivre le rythme des avancées technologiques tout en répondant à des charges de travail variées et à des besoins départementaux variés.

Pour les entreprises basées aux États-Unis qui commencent tout juste à utiliser l'orchestration de l'IA, concentrez-vous sur l'identification de votre flux de travail principal et de vos exigences de conformité. Déterminez si vous avez besoin d'un accès étendu aux modèles, d'une intégration à Kubernetes ou de fonctionnalités d'IA conversationnelle. En outre, donnez la priorité aux plateformes proposant une tarification basée sur l'utilisation afin de gérer efficacement les coûts en cas de fluctuations des charges de travail.

Alors que le domaine de l'orchestration de l'IA continue de se développer, recherchez des plateformes dotées d'un engagement communautaire actif, de mises à jour régulières et de feuilles de route de développement claires. Ces qualités contribueront à garantir que la plateforme conserve sa valeur au fur et à mesure de l'évolution des besoins de votre organisation et de la technologie elle-même.

Lorsque vous choisissez une plateforme d'orchestration d'IA, il est important de vous concentrer sur quelques aspects essentiels pour vous assurer qu'elle répond aux besoins de votre entreprise et respecte les normes de conformité. Capacités d'intégration devrait figurer en tête de liste. Optez pour une plateforme qui se connecte facilement à vos outils et systèmes actuels, afin de simplifier les flux de travail. Fonctionnalités d'automatisation constituent un autre facteur clé, car ils devraient rationaliser la gestion des tâches et minimiser les efforts manuels.

Tout aussi important est gouvernance et sécurité. La protection des données sensibles et le respect des réglementations du secteur ne devraient pas être négociables. Une offre de plateforme modularité et évolutivité est également utile, car il peut se développer avec votre entreprise et s'adapter à l'évolution des besoins. Enfin, ne négligez pas facilité d'utilisation - une interface simple et un support fiable peuvent considérablement faciliter la transition pour votre équipe.

Prompts.ai fournit aux entreprises une couche FinOps intégrée conçue pour apporter clarté des coûts et améliorez gestion financière. Cette fonctionnalité fournit des informations en temps réel sur l'utilisation, les dépenses et le retour sur investissement (ROI), permettant aux organisations de prendre des décisions plus intelligentes et d'affiner leurs stratégies de dépenses.

En fournissant une vue transparente des dépenses liées à l'IA, les entreprises peuvent allouer les ressources de manière plus efficace, en veillant à ce que leurs opérations et leurs objectifs financiers restent alignés.

L'interopérabilité joue un rôle clé dans les plateformes d'orchestration de l'IA, en garantissant que les différents modèles et systèmes d'IA peuvent fonctionner ensemble sans friction. Cette compatibilité permet aux organisations d'intégrer de nouveaux outils et technologies sans perturber leurs flux de travail actuels.

Lorsque divers modèles d'IA collaborent de manière fluide, les entreprises peuvent rapidement s'adapter à l'évolution des demandes, accélérer l'innovation et se préparer aux défis futurs. Il donne aux organisations la possibilité d'étendre leurs capacités d'IA tout en restant efficaces et adaptables.