Los flujos de trabajo de aprendizaje automático son esenciales para administrar los datos, capacitar modelos y garantizar una implementación fluida. Dado que se prevé que la IA crezca hasta 113.110 millones de dólares para 2025 y 503.410 millones de dólares para 2030, la plataforma adecuada puede reducir significativamente los costos, mejorar la eficiencia y mejorar la gobernanza. Este artículo evalúa seis plataformas líderes: Prompts.ai, MLFlow, Metaflow, Cadena LANG/Gráfico de largo, AutoGen, y n8n/Fluir a lo ancho - basado en la escalabilidad, la integración, la gobernanza y la transparencia de los costes.

Conclusiones clave:

Cada plataforma ofrece puntos fuertes distintos adaptados a las necesidades específicas, desde la orquestación empresarial hasta la automatización ligera. A continuación, desglosamos en detalle sus funciones, costos y mejores casos de uso.

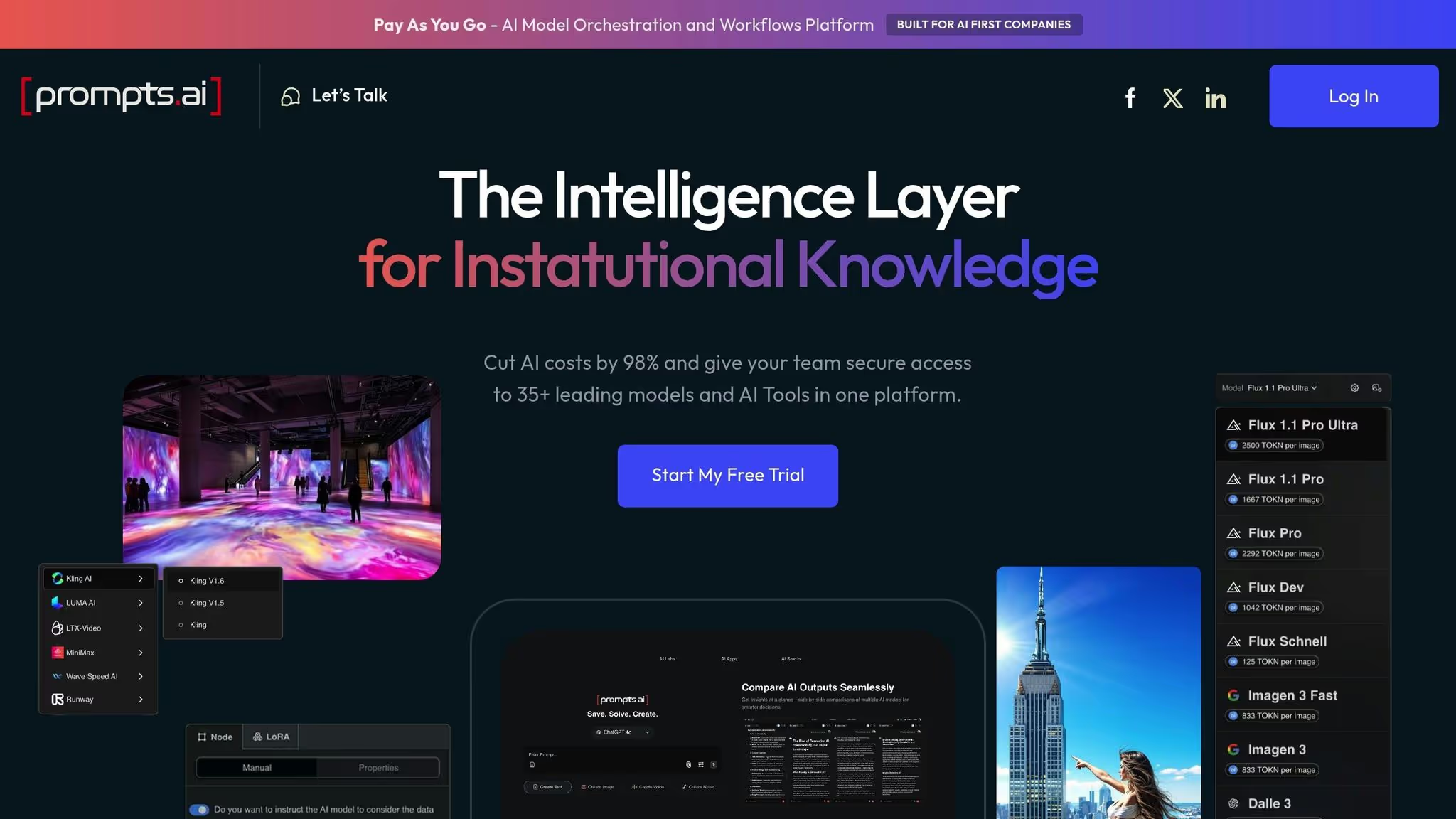

Prompts.ai es un plataforma de orquestación de IA de nivel empresarial que reúne más de 35 modelos líderes de IA, como GPT-5, Claude, LLama y Gemini, en un sistema centralizado. Esta plataforma unificada aborda el creciente problema de la sobrecarga de herramientas, un desafío común para las organizaciones que gestionan flujos de trabajo complejos de aprendizaje automático en varios equipos y departamentos.

La plataforma está diseñada para transformar tareas de IA dispersas en procesos escalables y repetibles, simplificando la gestión de las operaciones de aprendizaje automático a gran escala. Este enfoque ya ha beneficiado a una amplia gama de usuarios, desde empresas de la lista Fortune 500 hasta agencias creativas e instituciones de investigación. A continuación, analizaremos sus puntos fuertes en cuanto a escalabilidad, integración, gobernanza y transparencia de costos.

La arquitectura de Prompts.ai está diseñada para crecer con sus necesidades. Permite añadir modelos, usuarios y equipos sin problemas operativos. Ya sea que gestione conjuntos de datos masivos o gestione demandas de modelos cada vez más complejas, la plataforma ofrece un rendimiento constante. Algunos usuarios incluso han informado de hasta un Reducción del 98% en los costos de IA mientras escalan sus operaciones.

La integración es donde Prompts.ai realmente brilla. La plataforma se conecta sin esfuerzo con los sistemas de datos, los entornos de nube y las herramientas de desarrollo existentes, lo que permite a las organizaciones mejorar su infraestructura actual en lugar de reemplazarla. Al ofrecer una interfaz única que unifica el acceso a más de 35 modelos de IA, Prompts.ai elimina la molestia de administrar múltiples herramientas y fuentes de datos. Este enfoque simplificado lo convierte en una solución ideal para las organizaciones que se enfrentan a ecosistemas tecnológicos complejos y de múltiples proveedores.

Prompts.ai prioriza la seguridad y el cumplimiento, y cumple con los estándares del sector, como el SOC 2 de tipo II, la HIPAA y el RGPD. La plataforma inició su auditoría SOC 2 de tipo II en junio de 2025 y monitorea continuamente los controles a través de Vanta. Como explica Prompts.ai:

«Prompts.ai incorpora las mejores prácticas de los marcos SOC 2 Type II, HIPAA y GDPR para proteger sus datos». — Prompts.ai

El Trust Center de la plataforma ofrece actualizaciones en tiempo real sobre las medidas de seguridad, lo que brinda a las organizaciones una visión clara de su estado de cumplimiento. Esta transparencia tiene un valor incalculable para las empresas que deben demostrar el cumplimiento de los requisitos reglamentarios.

Prompts.ai destaca por su enfoque en la claridad de los costos. Proporciona métricas detalladas sobre los costos y la latencia para cada aspecto de un flujo de trabajo, lo que permite una administración precisa de los recursos. La plataforma utiliza un Sistema TOKN de pago por uso, vinculando los gastos directamente con el uso real y eliminando la necesidad de pagar cuotas de suscripción recurrentes. Sus herramientas FinOps mejoran aún más la visibilidad al rastrear cada token y vincular los gastos a resultados empresariales específicos. Los precios comienzan en 29 €/mes para equipos pequeños y se amplía hasta 129 USD al mes para funciones de nivel empresarial, con opciones para espacios de trabajo y colaboradores ilimitados.

MLFlow, creado por Ladrillos de datos, es un plataforma de código abierto diseñado para gestionar todas las etapas del ciclo de vida del aprendizaje automático, desde la experimentación hasta la implementación. Se ha convertido en una solución de referencia para las organizaciones que desean optimizar sus flujos de trabajo de aprendizaje automático sin incurrir en gastos de licencia. Gracias a su estructura modular, los equipos pueden elegir los componentes que mejor se adapten a sus necesidades, lo que la convierte en una opción flexible para las empresas con sistemas preexistentes.

La plataforma aborda los desafíos comunes en los flujos de trabajo de aprendizaje automático a través de cuatro módulos clave: Seguimiento de MLFlow para gestionar experimentos, Proyectos MLFlow para empaquetar código reproducible, Modelos MLFlow para estandarizar las implementaciones, y Registro MLFlow para el control de versiones de modelos. Esta configuración ha convertido a MLFlow en uno de los equipos favoritos de los equipos de ciencia de datos que se enfrentan a las complejidades de la administración de modelos.

MLFlow está diseñado para escalar en una variedad de configuraciones de infraestructura, y admite el escalado horizontal y vertical. Ya sea que maneje grandes conjuntos de datos o administre múltiples versiones de modelos, MLFlow funciona bien en entornos de producción de alta demanda. Se puede implementar localmente, en la nube o en las instalaciones, lo que ofrece flexibilidad para escalar las operaciones.

Las organizaciones que utilizan MLFlow han informado de beneficios cuantificables, que incluyen Tasa de implementación de modelos un 60% más rápida y un Disminución del 40% en los incidentes de producción debido a su enfoque estructurado de la gestión de modelos. Su capacidad para gestionar experimentos simultáneos y múltiples versiones de modelos se vuelve cada vez más valiosa a medida que los equipos crecen y los conjuntos de datos se vuelven más complejos.

Por ejemplo, en agosto de 2025, una organización sanitaria dirigida por la Dra. Emily Tran, directora científica de datos, integró MLFlow en su canal de datos. Esto redujo los tiempos de implementación en un 50%, lo que permitió acelerar la iteración y la implementación de modelos. ¿El resultado? Flujos de trabajo mejorados que mejoraron directamente la atención al paciente.

«MLFlow ha transformado nuestro enfoque de la gestión de modelos, lo que nos permite ampliar nuestras operaciones sin comprometer la calidad ni la velocidad». — Dra. Emily Tran, directora científica de datos de una organización sanitaria

Una de las características más destacadas de MLFlow es su capacidad de integrarse con las herramientas y los flujos de trabajo existentes. Su marco de código abierto admite varios lenguajes de programación, incluidos Python, R y Java, haciéndolo accesible a diversos equipos de desarrollo. También se conecta sin problemas con plataformas en la nube como AWS, Azure, y Google Cloud, lo que permite a las organizaciones aprovechar los recursos de la nube para capacitar e implementar modelos.

Más allá de las plataformas en la nube, MLFlow se integra con los marcos de aprendizaje automático y las fuentes de datos más populares, lo que permite a los equipos mejorar su infraestructura sin necesidad de una revisión completa.

En abril de 2025, una empresa de servicios financieros demostró las capacidades de integración de la plataforma al conectar MLFlow con AWS SageMaker. Esta integración redujo el tiempo de implementación en un 50% y mejoró la precisión predictiva en un 20%, lo que demuestra las ventajas reales de combinar MLFlow con otras herramientas.

El registro de modelos de MLFlow es una herramienta poderosa para la gobernanza, ya que ofrece versiones de modelos y un registro de auditoría claro para garantizar que solo se implementen los mejores modelos. Esto es especialmente importante para las industrias que requieren un cumplimiento estricto de las normas reglamentarias y los controles de calidad internos.

Las funciones de seguimiento de la plataforma proporcionan documentación detallada del linaje del modelo, incluidas las fuentes de datos, los parámetros y las métricas de rendimiento. Este nivel de transparencia es compatible tanto con la depuración técnica como con la elaboración de informes normativos, lo que la convierte en una opción sólida para sectores como el sanitario y el financiero, donde el cumplimiento no es negociable.

Como plataforma de código abierto, MLFlow elimina las tarifas de licencia, aunque los costos de implementación dependerán de la configuración elegida. Las implementaciones en la nube pueden implicar gastos de procesamiento y almacenamiento, mientras que las instalaciones locales requieren inversiones en hardware y mantenimiento.

El uso eficiente de los recursos y la capacidad de MLFlow para reducir los tiempos de implementación ayudan a reducir los costos operativos. Al automatizar las tareas de administración de modelos, permite a los equipos de ciencia de datos centrarse más en el desarrollo que en los gastos operativos. Estas eficiencias de costos se hacen aún más evidentes a medida que los equipos escalan sus operaciones y administran inventarios de modelos más grandes en producción.

Metaflow se destaca como una biblioteca basada en Python diseñada para administrar todo el flujo de trabajo de aprendizaje automático. Al centrarse en simplificar la transición de la creación de prototipos a la producción, automatiza las tareas repetitivas, como la gestión de dependencias y el control de versiones, lo que facilita a los desarrolladores centrarse en sus modelos.

Si bien a menudo se elogia a Metaflow por su escalabilidad, su perfecta integración en la nube y sus funciones de gobierno, la documentación disponible tiende a proporcionar solo una visión general de estos aspectos. Para comprender mejor sus capacidades en materia de procesamiento, cumplimiento y gestión de costos a gran escala, es esencial consultar la documentación oficial.

Esta descripción general proporciona una base para comparar la metodología de Metaflow con otras plataformas destacadas en el campo.

LangChain es un marco diseñado para desarrollar aplicaciones que utilizan modelos de lenguaje de gran tamaño, especialmente sobresaliendo en los flujos de trabajo de generación aumentada de recuperación (RAG). Simplifica el manejo de datos no estructurados y coordina varios componentes de la IA. Como complemento, LangGraph ofrece una interfaz visual para gestionar procesos complejos de varios pasos con mayor claridad.

El concepto de LLMoP aporta los principios de los MLOP a la IA generativa, centrándose en la gestión rápida, la recuperación de vectores y las métricas de evaluación esenciales.

La estructura modular de LangChain permite a los equipos crear componentes reutilizables, lo que reduce significativamente el consumo de recursos y los plazos de implementación. Su uso eficiente de la infraestructura de GPU garantiza que pueda satisfacer las altas exigencias computacionales de los modelos lingüísticos de gran tamaño. Además, los métodos de orquestación avanzados mejoran la distribución de los recursos en los flujos de trabajo de la IA, lo que maximiza la eficiencia.

Estas capacidades escalables convierten a LangChain y LangGraph en fuertes contendientes en el ecosistema de flujo de trabajo de IA que avanza rápidamente.

AutoGen es un marco diseñado para facilitar la colaboración entre varios agentes de IA en el desarrollo y la implementación del aprendizaje automático (ML). Al dividir los flujos de trabajo complejos en tareas más pequeñas y manejables, su objetivo es agilizar los procesos de aprendizaje automático.

La estructura multiagente de AutoGen permite distribuir las tareas entre varios agentes, lo que puede mejorar la eficiencia. Sin embargo, la documentación detallada sobre cómo escala o asigna las tareas sigue siendo limitada.

AutoGen es compatible con los entornos de aprendizaje automático y las API basados en Python, lo que lo hace accesible para muchos desarrolladores. Dicho esto, la información sobre su compatibilidad con las bibliotecas de aprendizaje automático más utilizadas y las principales plataformas en la nube no está fácilmente disponible.

Si bien AutoGen proporciona información inicial sobre el uso de los recursos en los flujos de trabajo de varios agentes, carece de herramientas sólidas para realizar un seguimiento y una gestión exhaustivos de los gastos computacionales.

Para las organizaciones que estén considerando AutoGen, es recomendable explorar la documentación oficial y realizar pruebas prácticas para asegurarse de que cumple con sus necesidades técnicas y se alinea con sus requisitos de flujo de trabajo. Esta comprensión fundamental sienta las bases para profundizar en los pros y los contras de estas plataformas en la siguiente sección.

A medida que los flujos de trabajo de aprendizaje automático (ML) siguen creciendo y cambiando, plataformas como n8n y Fluir a lo ancho, diseñados originalmente para la automatización general del flujo de trabajo, se están adaptando para abordar las necesidades de las operaciones de aprendizaje automático. Estas herramientas están atrayendo la atención por su capacidad para abordar aspectos relacionados con la escalabilidad, la integración y los costos, aunque inicialmente no se crearon pensando en el aprendizaje automático. Así es como se comparan en estas áreas clave:

Para escalar las operaciones de aprendizaje automático, n8n permite a los usuarios implementar varias instancias, lo que lo hace más adaptable a las crecientes cargas de trabajo. Por otro lado, Fluir a lo ancho normalmente funciona como una aplicación de instancia única. La administración de cargas de trabajo de aprendizaje automático más grandes con Flowise suele requerir recursos adicionales y configuraciones personalizadas, lo que puede aumentar la complejidad.

Ambas plataformas sobresalen en cuanto a conectividad de API. n8n proporciona una amplia gama de conectores para la integración con varios servicios en la nube, lo que lo hace versátil para diferentes casos de uso. Fluir a lo ancho, sin embargo, se especializa en flujos de trabajo de IA conversacional y se integra perfectamente con los servicios de modelos lingüísticos, centrándose en aplicaciones más específicas.

Una limitación de ambas plataformas es la falta de herramientas integradas para rastrear los costos asociados con el uso de la nube o la API. Los usuarios deben confiar en soluciones de monitoreo externas para mantener la visibilidad de los gastos, lo que puede requerir una configuración y supervisión adicionales.

Al seleccionar una plataforma de flujo de trabajo de aprendizaje automático, las organizaciones deben sopesar las fortalezas y desventajas únicas de cada opción. Estas compensaciones son cruciales para determinar qué plataforma se ajusta mejor a las necesidades operativas específicas.

He aquí un análisis más detallado de cómo se comparan algunas de las principales plataformas:

Prompts.ai ofrece acceso a más de 35 LLM y funciona con un sistema TOKN de pago por uso, lo que podría reducir los costos de IA hasta en un 98%. También ofrece una interfaz segura con sólidas funciones de gobierno, lo que la convierte en la mejor opción para la orquestación de la IA empresarial.

MLFlow destaca en el seguimiento de experimentos y el control de versiones de modelos, especialmente en entornos impulsados por la investigación donde la reproducibilidad es esencial. Su naturaleza de código abierto proporciona flexibilidad y ventajas de costes. Sin embargo, las exigencias de configuración e infraestructura de MLFlow pueden resultar abrumadoras para los equipos más pequeños que carecen de un soporte dedicado de DevOps.

Metaflow se destaca en el procesamiento de flujos de trabajo de datos a gran escala, especialmente para equipos profundamente integrados con AWS. Su escalado automático y su fiable gestión de errores la convierten en una opción sólida para los entornos de producción. Dicho esto, su estrecha integración con AWS puede llevar a la dependencia de un solo proveedor, lo que puede complicar las estrategias de nube múltiple.

LangChain y LangGraph ofrecen flexibilidad para crear sistemas avanzados de IA conversacional. Su arquitectura modular permite a los desarrolladores crear intrincadas cadenas de razonamiento y flujos de trabajo de varios pasos. Sin embargo, estas plataformas requieren una gran experiencia técnica y pueden presentar desafíos debido a las actualizaciones frecuentes.

AutoGen simplifica el desarrollo de sistemas de IA multiagente, lo que permite interacciones colaborativas con una codificación mínima. Es particularmente eficaz para la creación de prototipos, pero escalar más allá de la fase de prototipo puede resultar difícil, especialmente cuando se depuran interacciones complejas entre varios agentes.

n8n y Flowwise lleve la automatización del flujo de trabajo al espacio del aprendizaje automático con interfaces visuales fáciles de usar, que las hagan accesibles para los miembros del equipo no técnicos. Si bien n8n ofrece una mejor escalabilidad mediante la implementación en varias instancias, ambas plataformas carecen de herramientas integradas para rastrear los costos de la nube y las API, por lo que requieren soluciones de monitoreo externas.

La decisión depende en última instancia de los objetivos de la organización. Para los equipos que se centran en la reducción de costos y el acceso a diversos modelos, Prompts.ai es un fuerte contendiente. Las organizaciones impulsadas por la investigación pueden encontrar MLFlow indispensable para su capacidad de rastreo. Mientras tanto, las empresas que dependen de AWS pueden preferir Metaflow, a pesar de la preocupación por la dependencia de un solo proveedor. Plataformas como n8n y Fluir a lo ancho son ideales para los equipos que buscan expandir los flujos de trabajo de automatización existentes al dominio del aprendizaje automático.

Esta comparación proporciona una base para alinear las opciones de plataforma con prioridades específicas, garantizando que la herramienta seleccionada satisfaga las necesidades actuales y futuras.

Al seleccionar una plataforma, tenga en cuenta la escala, las necesidades de gobierno y las prioridades de costos de su organización. Cada opción descrita anteriormente aporta puntos fuertes específicos adaptados a los diferentes requisitos operativos.

Para organizaciones empresariales, Prompts.ai destaca por su capacidad para organizar los flujos de trabajo en más de 35 modelos. Ofrece seguridad de nivel empresarial y una gobernanza sólida, lo que la convierte en una opción excelente para las empresas e industrias de la lista Fortune 500 con requisitos reglamentarios estrictos.

Para equipos de investigación e instituciones académicas, MLFlow es ideal por su sólido seguimiento de experimentos y su flexibilidad de código abierto. Sus funciones de versionado y reproducibilidad de modelos son cruciales para documentar los resultados de forma eficaz. Sin embargo, sí requiere una infraestructura de DevOps sólida para respaldar sus operaciones.

Para flujos de datos a gran escala, considera Metaflow, diseñado por Netflix para simplificar los desafíos de infraestructura. Gestiona el escalado automático y la gestión de errores, lo que permite a los científicos de datos centrarse en el desarrollo de modelos sin quedarse atascados en las complejidades de los MLOps.

Para proyectos complejos de IA conversacional, plataformas como Cadena LANG y Gráfico de largo ofrecen diseños modulares y una flexibilidad sin igual. Estas herramientas pueden gestionar intrincados flujos de trabajo conversacionales, pero exigen una gran experiencia técnica y el compromiso de mantenerse al día con las actualizaciones frecuentes.

Para equipos pequeños y creación rápida de prototipos, n8n y Fluir a lo ancho proporcionan más de 400 integraciones prediseñadas e interfaces fáciles de usar y sin código. Estas plataformas hacen que la creación de flujos de trabajo con inteligencia artificial sea accesible sin requerir una amplia gestión de la infraestructura.

En última instancia, alinee las capacidades de la plataforma con los objetivos específicos de su organización. Las empresas que necesitan un acceso seguro y unificado a varios modelos se beneficiarán de Prompts.ai. Los equipos de investigación pueden preferir la adaptabilidad de código abierto de MLFlow, mientras que los equipos más pequeños pueden priorizar la facilidad de utilizar herramientas visuales con poco código, como n8n o Fluir a lo ancho.

Para garantizar el ajuste correcto, lleve a cabo despliegues piloto de sus principales opciones de plataforma. Probar el rendimiento en escenarios reales ayudará a confirmar que la solución seleccionada satisface las necesidades actuales y, al mismo tiempo, respalda el crecimiento a largo plazo.

Prompts.ai facilita la gestión de varios modelos de IA al incorporar funciones sólidas de cumplimiento y gobierno. Se adhiere a marcos importantes como SOC 2 tipo II, HIPAA, y GDPR, garantizando que sus datos se gestionan de forma segura y cumplen con todos los estándares reglamentarios necesarios.

Equipado con una supervisión de cumplimiento integrada, Prompts.ai permite a las organizaciones mantener los estándares del sector sin esfuerzo y, al mismo tiempo, optimizar los flujos de trabajo. Este enfoque permite a las empresas escalar sus proyectos de IA con confianza y eficiencia.

Si bien las plataformas de código abierto como MLFlow ofrecen la ventaja de la flexibilidad y la personalización, las soluciones comerciales como Prompts.ai están diseñadas para ofrecer una experiencia más fluida e intuitiva, adaptada específicamente a los requisitos empresariales.

Las herramientas de código abierto a menudo exigen una configuración exhaustiva, un mantenimiento continuo y un alto nivel de experiencia técnica para garantizar que funcionen de manera eficiente y se escalen según sea necesario. Por otro lado, Prompts.ai elimina gran parte de esta complejidad al proporcionar funciones preintegradas, una infraestructura escalable y un soporte dedicado. Esto lo convierte en una excelente opción para los equipos que desean ahorrar tiempo y concentrarse en lograr resultados tangibles.

En última instancia, la decisión depende de sus prioridades, ya sea que prefiera el control y la personalización de las herramientas de código abierto o la comodidad de una solución lista para usar diseñada para agilizar los flujos de trabajo de aprendizaje automático.

Al seleccionar una plataforma de flujo de trabajo de aprendizaje automático, las empresas deben priorizar qué tan bien se integra con los sistemas existentes, soporte durante todo el ciclo de vida del proyecto, y escalabilidad para adaptarse al crecimiento futuro. Estos factores garantizan que la plataforma pueda adaptarse a medida que la organización evoluciona.

Igualmente importantes son las plataformas herramientas de automatización, diseño fácil de usar, y eficiencia de costos, que desempeñan un papel clave en la racionalización del desarrollo y las operaciones diarias.

Por último, no pase por alto funciones de gobierno y cumplimiento que ayudan a cumplir con las normas reglamentarias y a proteger los datos confidenciales. La plataforma adecuada no solo simplificará la integración, sino que también aumentará la productividad y allanará el camino para los avances continuos.