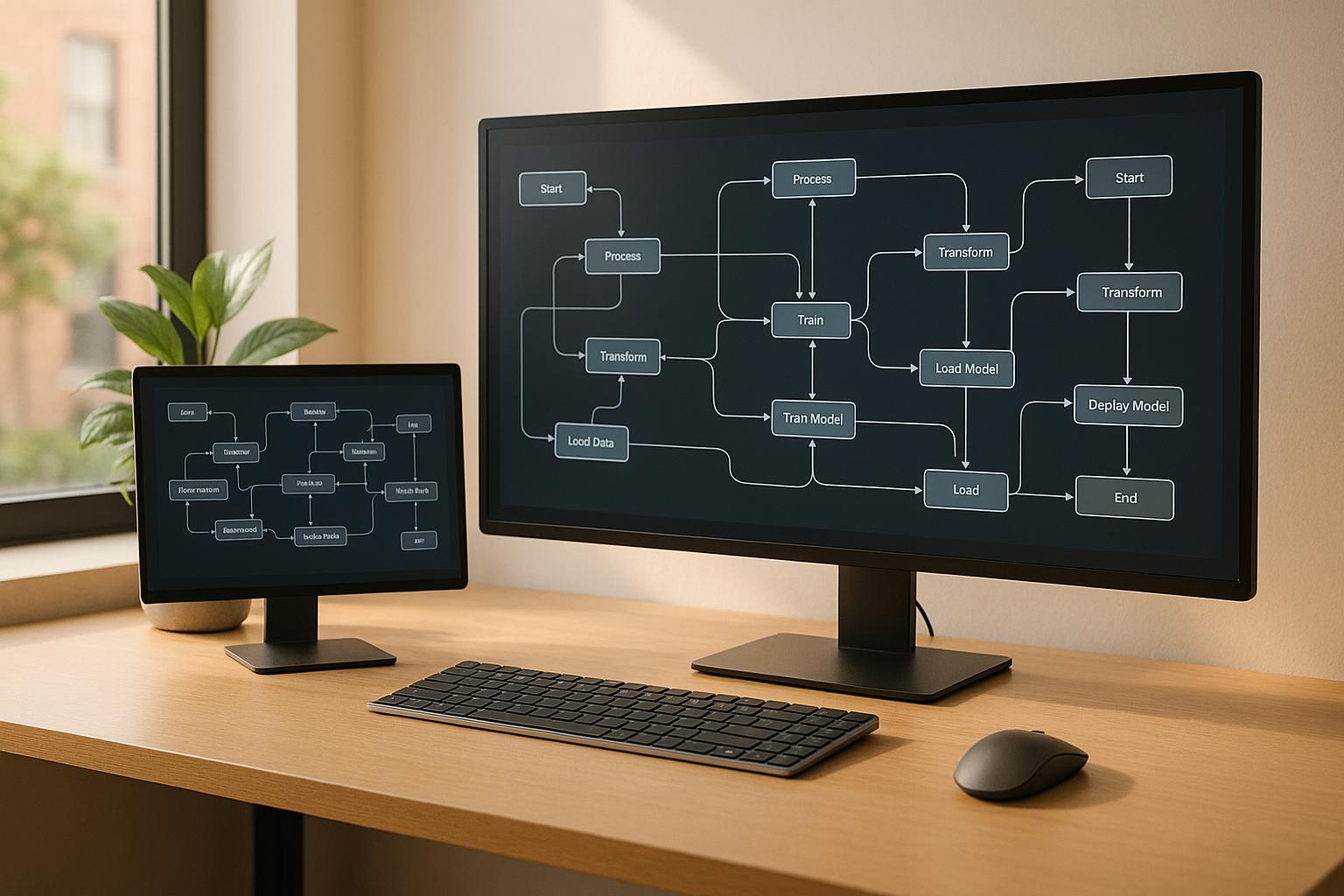

Los flujos de trabajo de inteligencia artificial pueden ser complejos, pero las herramientas adecuadas simplifican la automatización y garantizan la eficiencia, el control de costos y el cumplimiento. En este artículo se analizan las cuatro plataformas principales para la gestión canalizaciones de IA de varios pasos:

Cada herramienta tiene puntos fuertes únicos en cuanto a escalabilidad, integración y gobierno. A continuación se muestra una comparación rápida que le ayudará a elegir la que mejor se adapte a sus necesidades.

Elige una plataforma que se alinee con la experiencia, la infraestructura y los objetivos de tu equipo.

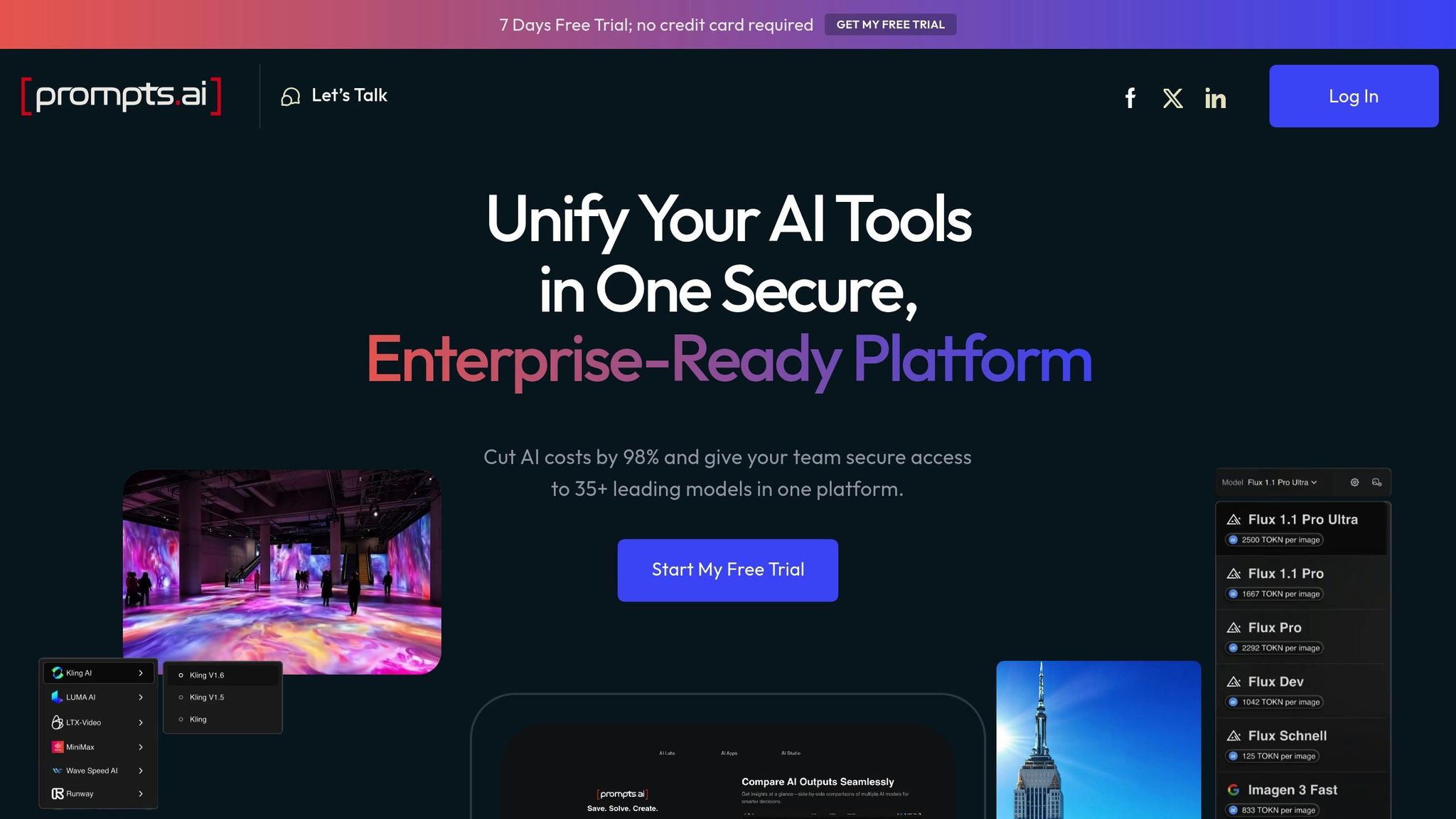

Prompts.ai es una potente plataforma empresarial diseñada para simplificar y automatizar complejos flujos de trabajo de IA. Al integrar la gestión de los oleoductos con el seguimiento de los costos, las funciones de gobierno y el acceso a más de 35 modelos lingüísticos líderes, proporciona una solución simplificada para las organizaciones que buscan maximizar la eficiencia y el control.

Una de las características más destacadas de Prompts.ai es su capacidad para unificar varias herramientas y servicios de IA en un entorno único e ininterrumpido. Esta integración permite a los equipos crear canales sofisticados que pueden cambiar de modelo sin la molestia de administrar API o procesos de autenticación independientes. Con el cambio de modelos en tiempo real, las organizaciones pueden ajustar los flujos de trabajo para optimizar tanto el rendimiento como los costos seleccionando el mejor modelo para cada tarea.

Para las empresas que operan en configuraciones de IA híbrida, la plataforma va más allá al integrarse con los sistemas empresariales existentes y, al mismo tiempo, mantener estrictas medidas de seguridad de datos. Esto garantiza que la información confidencial permanezca protegida durante los flujos de trabajo de procesamiento de varios pasos, lo que brinda a las empresas confianza en la seguridad de sus datos.

Prompts.ai está diseñado para crecer junto con su negocio. Al utilizar un sistema de crédito TOKN de pago por uso, los equipos pueden escalar las operaciones sin esfuerzo y bajo demanda.

La arquitectura de la plataforma facilita la adición de nuevos modelos, usuarios o equipos completos en cuestión de minutos, lo que elimina las demoras que normalmente se asocian con la adquisición y la integración. Esta flexibilidad es particularmente beneficiosa para las organizaciones con cargas de trabajo fluctuantes o para aquellas que expanden sus iniciativas de inteligencia artificial en varios departamentos a la vez.

La gobernanza es una piedra angular de Prompts.ai, especialmente en la automatización de canalizaciones de varios pasos. La plataforma proporciona un registro detallado de cada interacción de la IA, refuerza el acceso basado en roles e incorpora controles de cumplimiento automatizados. Este nivel de transparencia permite a las organizaciones mantenerse alineadas con las regulaciones del sector y, al mismo tiempo, mantener la responsabilidad en sus operaciones de IA.

Para las industrias con requisitos de cumplimiento estrictos, Prompts.ai permite flujos de trabajo de aprobación para tareas delicadas y mantiene registros completos de todas las actividades de IA. Estas funciones son indispensables para demostrar el cumplimiento de la normativa y garantizar procesos seguros y controlados.

Prompts.ai incorpora un enfoque de FinOps para ayudar a las organizaciones a administrar los costos de manera efectiva. Ofrece un seguimiento en tiempo real del uso de los tokens y modela los gastos, lo que permite a los equipos optimizar los flujos de trabajo tanto en términos de rendimiento como de presupuesto.

Más allá del seguimiento básico, la plataforma proporciona información detallada sobre el consumo de recursos. Los equipos pueden identificar qué etapas del proceso consumen más recursos, comparar los costos de los modelos para tareas similares y tomar decisiones informadas para optimizar los procesos. Este nivel de transparencia de costes ha permitido a las organizaciones reducir los gastos en software de IA hasta en un 98%, lo que supone una mejora significativa con respecto a la gestión de múltiples suscripciones y herramientas de IA independientes.

Apache Airflow es una popular plataforma de código abierto diseñada para organizar flujos de trabajo de datos complejos y canalizaciones de IA. Creada originalmente por Airbnb, esta herramienta basada en Python permite a los usuarios definir los flujos de trabajo como código mediante un formato de gráfico acíclico dirigido (DAG). Esto la hace particularmente eficaz para gestionar procesos de varios pasos, como el preprocesamiento de datos, el entrenamiento de modelos y la implementación en proyectos de IA. Su flexibilidad y capacidades de integración lo convierten en una opción poderosa para gestionar la escalabilidad, la supervisión y la rentabilidad.

Una de las características más destacadas de Airflow es su capacidad de integrarse sin problemas con una amplia gama de herramientas y servicios. Gracias a su amplia biblioteca de operadores y enlaces, los usuarios pueden conectarse a los principales proveedores de nube y tecnologías de contenedores, como AWS, Google Cloud Platform, Microsoft Azure, Kubernetes y Estibador. Su diseño modular garantiza la compatibilidad con diversos sistemas. Además, la función xCom facilita la transferencia de datos sin problemas entre las diferentes etapas de una canalización. Para los equipos que utilizan varias herramientas, los paquetes para proveedores de Airflow ofrecen soluciones personalizadas para integrar plataformas externas y, al mismo tiempo, respaldar la infraestructura de IA existente.

La arquitectura de Airflow está diseñada para gestionar cargas de trabajo de todos los tamaños y ofrece varios modos de ejecución para satisfacer diferentes demandas. Por ejemplo, el CeleryExecutor permite la ejecución distribuida de tareas en varios nodos de trabajo, mientras que el KubernetesExecutor crea módulos de forma dinámica para tareas individuales, lo que ofrece una escalabilidad elástica para las cargas de trabajo de IA que consumen muchos recursos. Esta flexibilidad permite a Airflow gestionar operaciones a gran escala, como el procesamiento por lotes de conjuntos de datos masivos o la ejecución simultánea de varias tareas de entrenamiento de modelos. Al permitir la paralelización de tareas, garantiza que los pasos independientes del proceso puedan ejecutarse simultáneamente, lo que acelera los flujos de trabajo y maximiza la eficiencia de los recursos.

Airflow va más allá de la orquestación al proporcionar herramientas sólidas para la gobernanza y la supervisión. A través de su interfaz web y su sistema de registro, mantiene registros de auditoría detallados y registra cada ejecución de las tareas, los reintentos y los errores con marcas de tiempo y métricas de rendimiento. Este nivel de visibilidad es esencial para rastrear el linaje de los modelos, monitorear la eficiencia de los oleoductos y diagnosticar problemas. El control de acceso basado en roles (RBAC) mejora aún más la seguridad, ya que permite a los administradores asignar permisos específicos; por ejemplo, otorga a los científicos de datos acceso de solo lectura y permite a los ingenieros modificar e implementar los flujos de trabajo. Además, la supervisión de los acuerdos de nivel de servicio garantiza que los equipos reciban una notificación si los procesos superan los tiempos de ejecución esperados, mediante el envío de alertas por correo electrónico. Slack, u otras herramientas de comunicación, que ayudan a resolver los problemas con rapidez.

Aunque Airflow es de código abierto, las organizaciones deben tener en cuenta los gastos operativos y de infraestructura. Sus funciones de administración de recursos permiten un control preciso de la programación de tareas y la asignación de recursos, lo que ayuda a minimizar los costos innecesarios. La generación dinámica de tareas permite que los flujos de trabajo se ajusten en función de la disponibilidad de los datos o de las cambiantes necesidades empresariales, lo que reduce el desperdicio de recursos. Combinada con su escalabilidad, esta adaptabilidad garantiza un uso eficiente de la potencia informática. El panel de monitoreo de Airflow proporciona información sobre la duración de las tareas y el uso de los recursos, lo que ayuda a los equipos a identificar las áreas de optimización y ahorro de costos en sus procesos de IA.

Kubeflow es una plataforma creada específicamente para Kubernetes, diseñada para gestionar las complejas demandas de los flujos de trabajo de IA mientras opera a escala. Proporciona un conjunto completo de herramientas diseñadas para cada fase del ciclo de vida del aprendizaje automático. Como lo describe el equipo de Kubeflow:

«La plataforma de referencia de IA de Kubeflow es componible, modular, portátil y escalable, y está respaldada por un ecosistema de proyectos nativos de Kubernetes para cada etapa del ciclo de vida de la IA».

La flexibilidad de Kubeflow destaca gracias a su diseño independiente de la nube, lo que lo hace compatible con varias infraestructuras. Ya sea que su organización opere en las principales plataformas de nube, como AWS, Google Cloud Platform o Microsoft Azure, o dependa de configuraciones locales, híbridas o multinube, Kubeflow se adapta a la perfección. Su arquitectura de microservicios es compatible con los principales marcos de aprendizaje automático, entre los que se incluyen PyTorch, TensorFlowy JAX. Incluso amplía sus capacidades a la computación periférica mediante la implementación de modelos ligeros en las pasarelas de IoT. Esta adaptabilidad garantiza una escalabilidad fluida y una gestión eficiente en una amplia gama de cargas de trabajo.

Basado en Kubernetes, Kubeflow está equipado para gestionar las crecientes demandas computacionales con facilidad. Su componente Trainer facilita el entrenamiento distribuido para modelos a gran escala, lo que permite ajustar con precisión marcos como PyTorch, TensorFlow y JAX. Kubeflow Pipelines (KFP) permite la creación de flujos de trabajo escalables y portátiles, mientras que la versión 1.9 introduce el almacenamiento en caché por volumen para reutilizar los resultados intermedios, lo que reduce el tiempo de procesamiento y el uso de recursos. Además, el aislamiento multiusuario, que también se introdujo en la versión 1.9, garantiza el manejo seguro de varios flujos de trabajo de aprendizaje automático dentro de un solo clúster. Para la implementación, KServe (anteriormente KFServing) ofrece un modelo de servicio nativo de Kubernetes, con escalado automático y equilibrio de carga para una inferencia eficiente en línea y por lotes.

Kubeflow garantiza una gran solidez gobierno y cumplimiento integrándose con herramientas de monitoreo como Prometeo y Grafana. Estas herramientas proporcionan información detallada sobre las métricas del sistema, como el uso de la CPU, la GPU y la memoria, así como sobre los indicadores de rendimiento del modelo, como la precisión del entrenamiento y la latencia de inferencia. En combinación con su función de aislamiento granular multiusuario, Kubeflow es ideal para las organizaciones que deben cumplir con estrictos requisitos reglamentarios.

Kubeflow ayuda a gestionar los costes de forma eficaz mediante escalado dinámico, que ajusta los recursos computacionales en función de las necesidades de la carga de trabajo, evitando un sobreaprovisionamiento innecesario. La introducción del almacenamiento en caché basado en volúmenes en Kubeflow Pipelines reduce aún más los cálculos redundantes y ahorra tiempo y recursos.

Como destaca el ingeniero de aprendizaje automático Anupama Babu:

«Lo que diferencia a Kubeflow es el uso de Kubernetes para la contenedorización y la escalabilidad. Esto no solo garantiza la portabilidad y la repetibilidad de sus flujos de trabajo, sino que también le brinda la confianza necesaria para escalar sin esfuerzo a medida que aumentan sus necesidades».

Prefect se destaca como una herramienta de orquestación del flujo de trabajo que prioriza un enfoque centrado en el código, lo que facilita la automatización de las canalizaciones de IA de varios pasos. Diseñada pensando en los desarrolladores, permite a los científicos e ingenieros de datos crear flujos de trabajo utilizando patrones de Python conocidos, evitando la rigidez que suelen presentar las herramientas de flujo de trabajo tradicionales.

Prefect sobresale en integración con las pilas de tecnología existentes, que ofrece una compatibilidad perfecta con plataformas como AWS, Google Cloud Platform y Microsoft Azure. Es modelo de ejecución híbrido garantiza que los flujos de trabajo puedan ejecutarse en cualquier lugar, desde configuraciones locales hasta clústeres de Kubernetes, sin necesidad de realizar ajustes importantes.

La plataforma sistema de bloques simplifica la integración al proporcionar conectores prediseñados para herramientas y servicios de uso generalizado. Estos incluyen bases de datos como PostgreSQL y MongoDB, almacenes de datos como Snowflake y BigQuery, y plataformas de aprendizaje automático como MLFlow y Weights & Biases. Esta amplia conectividad minimiza la necesidad de integraciones personalizadas, lo que permite a los equipos centrarse en crear canalizaciones de IA sólidas que puedan ampliarse sin esfuerzo en varios entornos.

Del prefecto arquitectura distribuida separa la definición del flujo de trabajo de la ejecución, lo que permite flexibilidad y eficiencia. Con su piscinas de trabajo función, las organizaciones pueden asignar recursos de forma dinámica en función de las necesidades de carga de trabajo. Esto significa que los contenedores livianos pueden gestionar tareas como el preprocesamiento de datos, mientras que las instancias con GPU gestionan procesos que consumen más recursos, como el entrenamiento de modelos.

La plataforma admite la ejecución simultánea de tareas, junto con los reintentos automáticos y la gestión de errores, lo que no solo reduce el tiempo de ejecución sino que también garantiza la resiliencia en los flujos de trabajo de IA a gran escala, incluso cuando surgen problemas temporales.

Prefect aborda los requisitos de gobierno a nivel empresarial a través de funciones como registro de auditoría y controles de acceso basados en funciones. Los registros detallados rastrean cada ejecución del flujo de trabajo y capturan el linaje de datos, el uso de los recursos y el historial de ejecución, algo esencial para cumplir con los estándares de cumplimiento como el GDPR y la HIPAA.

Es administración de despliegues Las herramientas ayudan a los equipos a mover los flujos de trabajo del desarrollo a la producción de manera controlada. Funciones como los procesos de aprobación y las puertas de prueba automatizadas garantizan que solo los oleoductos examinados minuciosamente entren en funcionamiento. Además, gestión secreta protege la información confidencial, como las claves de API y las credenciales de bases de datos, manteniéndolas seguras y fuera del código base.

Prefect proporciona herramientas para gestionar los costes de la infraestructura de IA de forma eficaz. Es priorización de colas de trabajos La función garantiza que se prioricen los flujos de trabajo críticos, mientras que las tareas menos urgentes esperan a los recursos, lo que evita el sobreaprovisionamiento y reduce los gastos innecesarios.

La plataforma infraestructura efímera Este enfoque es particularmente útil para tareas con mucha GPU, ya que aumenta los recursos solo cuando es necesario y los elimina automáticamente después. Este modelo bajo demanda evita los cargos por inactividad que a menudo se asocian a una infraestructura siempre activa.

Del prefecto características de observabilidad ofrecen información detallada sobre el uso de los recursos, realizando un seguimiento de métricas como el tiempo de ejecución, el consumo de memoria y los costos de procesamiento. Estos datos permiten a los equipos identificar las ineficiencias y tomar decisiones informadas sobre la asignación de recursos y la optimización del flujo de trabajo, lo que, en última instancia, impulsa el ahorro de costos y la eficiencia operativa.

Esta sección profundiza en la interoperabilidad de varias herramientas, un aspecto clave para optimizar la automatización del flujo de trabajo de la IA. La interoperabilidad se refiere a la forma en que estas herramientas se integran con diferentes sistemas, lo que permite operaciones más fluidas y una mayor eficiencia.

Esta es una comparación rápida de las funciones de interoperabilidad de cada herramienta:

Cada herramienta aporta sus propias fortalezas de interoperabilidad. Prompts.ai destaca por su interfaz unificada para acceder a varios modelos lingüísticos. Flujo de aire Apache brilla con su amplia conectividad basada en complementos. Kubeflow es ideal para entornos de aprendizaje automático que dependen de Kubernetes, mientras que Prefecto simplifica la integración de bases de datos y plataformas a través de sus conectores prediseñados.

La elección entre estas herramientas debe ajustarse a los requisitos específicos de su sistema y a la experiencia de su equipo, garantizando que la herramienta seleccionada se integre perfectamente en sus flujos de trabajo. Esta comparación subraya la importancia de evaluar la interoperabilidad a la hora de seleccionar la herramienta adecuada para sus necesidades técnicas.

La selección de la herramienta de automatización de canalizaciones de IA adecuada depende de las necesidades y capacidades técnicas únicas de su organización. Cada plataforma se adapta a las prioridades empresariales específicas, por lo que la decisión depende en gran medida de sus objetivos y recursos.

Prompts.ai se destaca como la opción ideal para las organizaciones centradas en reducción de costos y gobierno. Al ofrecer acceso unificado a más de 35 modelos lingüísticos, puede reducir los gastos de software de IA hasta en un 98%. Sus sólidas funciones de seguridad y cumplimiento lo hacen particularmente atractivo para las empresas de la lista Fortune 500 que operan bajo marcos regulatorios estrictos.

Flujo de aire Apache sigue siendo un fuerte competidor para las empresas que gestionan tareas complejas de ingeniería de datos dentro de los ecosistemas técnicos establecidos. Sin embargo, sus importantes requisitos de instalación y configuración hacen que sea el más adecuado para equipos con experiencia específica en DevOps.

Kubeflow es excelente para las organizaciones que abordan cargas de trabajo intensivas de aprendizaje automático en la infraestructura de Kubernetes. Es especialmente valioso para las empresas de tecnología con sede en EE. UU. que cuentan con entornos de contenedores maduros y equipos de ingeniería de aprendizaje automático con experiencia. Dicho esto, su pronunciada curva de aprendizaje puede plantear desafíos para los equipos que se inician en la orquestación de contenedores.

Prefecto logra un equilibrio para Equipos centrados en Python buscan modernizar sus flujos de trabajo sin la complejidad de Airflow. Sus conectores prediseñados lo convierten en una opción práctica para las empresas basadas en datos que desean optimizar la arquitectura de canalizaciones de manera eficiente.

Para las empresas que priorizan los costos, el sistema TOKN de pago por uso de Prompts.ai proporciona una solución escalable y rentable. Empresas que hacen hincapié gobierno y cumplimiento se beneficiará de las pistas de auditoría y los controles FinOps en tiempo real de Prompts.ai. Además, su enfoque de plataforma unificada elimina la proliferación de herramientas y ofrece escalabilidad en diversos casos de uso de IA.

En última instancia, su decisión debe alinearse con sus necesidades de integración, restricciones presupuestarias y objetivos de escalabilidad, garantizando que la herramienta elegida se adapte perfectamente a su infraestructura y experiencia.

Al elegir una herramienta para automatizar los flujos de trabajo de IA de varios pasos, es fundamental sopesar factores como la escalabilidad, la integración perfecta y la capacidad de personalizar los flujos de trabajo. Prompts.ai ofrece una solución integral al reunir más de 35 modelos lingüísticos de gran tamaño en una sola plataforma. Esto permite a los usuarios comparar los modelos uno al lado del otro y, al mismo tiempo, mantener un control preciso sobre las instrucciones, los flujos de trabajo y los resultados.

La plataforma también cuenta con un Capa FinOps, diseñado para supervisar y optimizar los costes, lo que facilita la gestión eficaz de los presupuestos. Al aprovechar estas capacidades, las organizaciones pueden simplificar incluso los flujos de trabajo de inteligencia artificial más complejos sin comprometer el rendimiento ni la gestión de los costos.

El Sistema de crédito TOKN on Prompts.ai ofrece un enfoque sencillo de pago por uso, que le brinda un mayor control sobre los costos de su software de IA. Solo se te cobra por los tokens que utilizas, lo que facilita el control de los gastos y elimina el derroche de dinero.

Este modelo permite a las empresas alinear sus presupuestos con el uso real, lo que agiliza la gestión de costes incluso para los flujos de trabajo de IA más complejos. Simplifica la planificación financiera y, al mismo tiempo, apoya el crecimiento, lo que garantiza que pueda escalar sin arruinarse. Con los créditos de TOKN, la presupuestación para sus proyectos de IA se vuelve predecible y clara.

Prompts.ai prioriza seguridad y cumplimiento de nivel empresarial, que ofrece funciones como la administración segura de API, registros de auditoría exhaustivos y configuraciones de permisos detalladas. Estas herramientas garantizan que el acceso se administre cuidadosamente y esté alineado con las políticas de su organización.

Con herramientas de gobierno integradas, la plataforma integra a la perfección la aplicación de políticas en los flujos de trabajo de IA. Esto incluye la aplicación automatizada de reglas, el seguimiento del uso en tiempo real y la supervisión continua del cumplimiento. Estas medidas proporcionan una sólida supervisión y protección de los datos, lo que convierte a Prompts.ai en una solución fiable para las empresas que se enfrentan a requisitos reglamentarios estrictos.