La orquestación de la IA es la clave para ampliar los flujos de trabajo de IA empresarial en 2026. Coordina las herramientas, los modelos y las automatizaciones para garantizar unas operaciones fluidas, gestionar los costes y mantener la gobernanza. Las empresas ahora confían en plataformas que integran modelos lingüísticos de gran tamaño (LLM), automatizan los flujos de trabajo y proporcionan una supervisión centralizada. Este es un desglose rápido de las principales soluciones:

Cada solución ofrece puntos fuertes únicos en cuanto a escalabilidad, cumplimiento, rentabilidad e integración. Ya sea que centralicen los flujos de trabajo de la IA, automaticen los procesos o aborden la latencia global, estas plataformas ayudan a las empresas a lograr la eficiencia operativa. Un enfoque híbrido suele ofrecer los mejores resultados al combinar herramientas centralizadas, automatización y capacidades periféricas.

Prompts.ai reúne más de 35 modelos de grandes lenguajes (LLM) líderes, incluidos GPT‑5, Claude, Llama, Géminis, Grok‑4, Flux Pro, y Kling - dentro de una plataforma segura y escalable. Permite a las organizaciones pasar sin problemas de proyectos piloto a pequeña escala a sistemas de producción a gran escala capaces de gestionar millones de solicitudes al mes. Al organizar flujos de trabajo complejos entre cientos de agentes de LLM, la plataforma garantiza una gestión eficiente de miles de interacciones con los clientes cada minuto. Esta potente orquestación es la base de las funciones avanzadas de escalabilidad que se describen a continuación.

Prompts.ai está diseñado para gestionar las principales demandas de carga de trabajo con facilidad, ya que admite el escalado horizontal mediante implementaciones en contenedores y de Kubernetes. Funciones como el escalado automático, las colas prioritarias y los grupos de trabajadores independientes garantizan un funcionamiento fluido incluso durante los picos de demanda. Por ejemplo, durante el Black Friday, los minoristas estadounidenses suelen ver cómo las cargas de trabajo de IA aumentan entre 5 y 10 veces. Prompts.ai permite a estas empresas escalar previamente o automáticamente, lo que garantiza que cumplen con los objetivos de nivel de servicio, como los objetivos de latencia p95, y aísla a los inquilinos para evitar problemas de rendimiento causados por «vecinos ruidosos». Esta escalabilidad elimina la necesidad de realizar costosas actualizaciones de infraestructura, lo que permite pasar sin problemas de los programas piloto a sistemas a gran escala listos para la producción. Además, se han incorporado medidas de gobierno estrictas para proteger todas las operaciones.

Prompts.ai aborda los estrictos estándares regulatorios de EE. UU. al incorporar funciones de gobierno sólidas. Estas incluyen el control de acceso basado en roles (RBAC), los permisos granulares para los flujos de trabajo y los datos y el registro de auditoría detallado para garantizar el cumplimiento de los estándares SOC 2 e HIPAA. Los equipos pueden implementar controles basados en políticas para restringir las transmisiones de datos confidenciales, mientras que funciones como el seguimiento del flujo de trabajo, el control rápido de versiones y el historial de cambios facilitan la revisión rápida de los incidentes, las anulaciones y la elaboración de informes de cumplimiento. Estas medidas proporcionan a las organizaciones las herramientas que necesitan para operar de forma segura y transparente.

El sistema de crédito Pay‑As‑You‑Go TOKN de la plataforma vincula los costos directamente con el uso, lo que ofrece a las organizaciones la posibilidad de reducir los gastos de software hasta en un 98%. El seguimiento y el análisis en tiempo real proporcionan visibilidad de los gastos, lo que permite a los usuarios refinar las instrucciones, cambiar de modelo o ajustar los umbrales de escalamiento y presupuesto según sea necesario. Los paneles interactivos muestran métricas críticas como el rendimiento, las tasas de error y los costes de modelización a lo largo del tiempo, lo que ayuda a los equipos a identificar las oportunidades de optimización. Este enfoque rentable se complementa con integraciones fluidas de sistemas, lo que garantiza un funcionamiento fluido en diversos entornos.

Prompts.ai se integra sin esfuerzo con las principales herramientas empresariales de EE. UU., como CRM de Salesforce, ServiceNow ARTÍCULO, Slack, Equipos de Microsoft, Copo de nieve, y BigQuery. También se conecta con los principales proveedores de modelos, como IA abierta, Antrópico, Google, Azure y AWS. Al aprovechar las API y los webhooks compatibles con formatos estandarizados como JSON y REST, la plataforma permite activar o actualizar los flujos de trabajo en varios sistemas. La seguridad sigue siendo una de las principales prioridades, ya que las conexiones cifradas, el almacenamiento seguro de credenciales, la administración de tokens y la gestión detallada de los secretos garantizan el cumplimiento y la protección de los datos. Además, las políticas configurables y las prácticas de residencia de datos protegen la información confidencial y garantizan que las integraciones sean seguras y confiables.

Si bien Prompts.ai se destaca como una plataforma de orquestación de IA especializada, las herramientas de automatización del flujo de trabajo más amplias ofrecen soluciones escalables adaptadas a una variedad de necesidades empresariales. Estas plataformas han pasado de ser simples herramientas de automatización a sistemas de orquestación avanzados capaces de gestionar millones de tareas de inteligencia artificial. Servicios como AWS Step Functions y Google Cloud Workflows se basan en arquitecturas sin servidor, lo que elimina la necesidad de administrar la infraestructura. Ya sea que se ocupen de unas cuantas tareas al día o de millones al mes, las organizaciones solo pagan por el tiempo de procesamiento real utilizado. Esta evolución ha allanado el camino para mejorar la escalabilidad, la integración perfecta y la rentabilidad, como se explica a continuación.

Las plataformas modernas utilizan procesamiento paralelo y ejecución distribuida para gestionar grandes conjuntos de datos de forma simultánea. Por ejemplo, AWS Step Functions incluye «mapas distribuidos», que permiten que los flujos de trabajo procesen miles de elementos a la vez, lo que reduce considerablemente el tiempo de ejecución. Google Cloud Workflows garantiza la confiabilidad al mantener los estados del flujo de trabajo, volver a intentar las tareas fallidas y gestionar las llamadas externas durante períodos prolongados. La capacidad de respuesta en tiempo real se logra mediante activadores basados en eventos, como Amazon EventBridge, que permite que los flujos de trabajo reaccionen al instante a los datos entrantes. Cada componente se puede escalar de forma independiente, adaptándose a las fluctuaciones de la demanda.

Las capacidades de integración son clave para conectar los flujos de trabajo de la IA con los sistemas existentes. Zapier, por ejemplo, ofrece acceso a más de 8.000 aplicaciones y 300 herramientas de IA especializadas, y los usuarios ya están ejecutando más de 300 millones de tareas de IA en la plataforma. AWS Step Functions se integra a la perfección con más de 220 servicios de AWS y admite tanto los puntos de enlace de la nube pública como las API privadas mediante conexiones cifradas. La introducción del Protocolo de contexto modelo (MCP) simplifica aún más la integración de la IA al transformar las API internas en herramientas estandarizadas que los modelos de lenguaje grande (LLM) pueden usar de inmediato. Esto elimina la necesidad de largos procesos de integración personalizados.

Estas plataformas no solo agilizan los flujos de trabajo, sino que también garantizan la rentabilidad al optimizar el uso de los recursos. Los modelos de precios sin servidor significan que los costos están directamente relacionados con el uso; a las organizaciones solo se les cobra por la ejecución activa del flujo de trabajo. Características como almacenamiento en caché de cómputos reduce las llamadas innecesarias a la API a los costosos servicios de LLM, lo que ayuda a controlar los gastos.

«La ingeniería rápida es la base del comportamiento de los agentes. No se trata solo de dar instrucciones a los agentes sobre las medidas que deben tomar, sino de definir claramente sus límites, restricciones y lo que deben evitar activamente». — Mehdi Fassaie, director de IA de Naveo Commerce

Las funciones de gobierno están integradas directamente en estas plataformas, lo que garantiza que los flujos de trabajo se alineen con los estándares de cumplimiento. El ser humano al día (HITL) los controles permiten la aprobación manual de productos sensibles, como documentos financieros o legales. El seguimiento exhaustivo de la ejecución y la gestión del estado garantizan que cada paso del flujo de trabajo se registre y sea auditable, lo cual es vital para cumplir con los requisitos del SOC 2. Plataformas como Orkes Conductor tratan las solicitudes como si fueran «ciudadanos de primera clase» e incorporan el control de versiones y la validación de acceso para transformar de forma segura las API internas en herramientas preparadas para la IA. La gestión automatizada de errores, que incluye reintentos exponenciales, aumenta la resiliencia del sistema durante los períodos de alta demanda. Además, los permisos basados en funciones garantizan que solo el personal autorizado pueda modificar los flujos de trabajo de producción.

Al ampliar el concepto de orquestación centralizada, las plataformas de inteligencia artificial perimetral llevan las cosas un paso más allá al permitir que las redes distribuidas funcionen de manera eficiente en todo el mundo.

La orquestación de IA perimetral traslada el procesamiento de centros centralizados a sistemas distribuidos, implementando flujos de trabajo en más de 200 regiones de todo el mundo. Esta configuración minimiza la latencia geográfica y ofrece tiempos de respuesta inferiores a 50 milisegundos. Por ejemplo, la infraestructura de Clarifai procesa más de 1,6 millones de solicitudes de inferencia por segundo y, al mismo tiempo, mantiene una confiabilidad de nivel empresarial. Al abordar la latencia y la demanda regional, este enfoque distribuido complementa a la perfección los flujos de trabajo centralizados.

Las plataformas Edge se destacan en la gestión de cargas de trabajo a gran escala mediante procesamiento paralelo distribuido, que permite que las tareas se ejecuten simultáneamente en varias regiones. Estas plataformas permiten que varios agentes de IA colaboren en la misma tarea, lo que reduce el tiempo de ejecución y garantiza resultados integrales. El alto rendimiento se logra mediante técnicas de optimización de recursos, como el fraccionamiento de la GPU, el procesamiento por lotes y el escalado automático, a la vez que se reduce al mínimo la administración de la infraestructura.

«La orquestación de cómputos de Clarifai mejora la potencia y la rentabilidad de la IA. Con el fraccionamiento de la GPU y el escalado automático, hemos podido reducir los costos de procesamiento en más de un 70% y, al mismo tiempo, escalar con facilidad». — Clarifai

Las plataformas perimetrales emplean estrategias de almacenamiento en caché de múltiples capas para reducir significativamente los costos. Al almacenar los resultados a los que se accede con frecuencia en espacios de nombres Key-Value (KV) y en cachés de AI Gateway, la latencia se reduce de unos 200 milisegundos a menos de 10 milisegundos, mientras que los costos de las llamadas a las API se reducen hasta 10 veces. Funciones como la reducción del contexto y la fragmentación semántica ayudan a eliminar la sobrecarga de tokens, lo que reduce las tasas de error en las implementaciones extendidas. Además, el uso de modelos lingüísticos más pequeños y especializados integrados directamente en las herramientas periféricas (en lugar de depender únicamente de modelos grandes) puede reducir los gastos relacionados con los tokens entre un 30 y un 50%. Las herramientas de gobierno automatizadas, como los límites presupuestarios, las alertas de uso y las pausas automáticas, evitan aún más los sobrecostos durante las pruebas y el escalado.

Las plataformas Edge están diseñadas para ofrecer flexibilidad y ofrecen compatibilidad con Polyglot SDK con bibliotecas para Python, Java, JavaScript, C# y Go. Esto permite a los desarrolladores crear microservicios en su lenguaje de programación preferido y, al mismo tiempo, mantener una orquestación centralizada. El protocolo Model Context simplifica la integración al convertir las API y bases de datos internas en herramientas estandarizadas, lo que elimina la necesidad de una codificación personalizada. IBM watsonx Orchestrate, por ejemplo, proporciona un catálogo de más de 400 herramientas prediseñadas y 100 agentes de IA específicos del dominio para una integración perfecta con las aplicaciones existentes. Clarifai admite la implementación en clústeres de SaaS, VPC, locales o incluso aislados sin necesidad de funciones de IAM personalizadas ni de interconexión de VPC. Las definiciones de flujo de trabajo basadas en YAML garantizan la compatibilidad con los flujos de trabajo de Git, evitando la dependencia de la propiedad.

Este nivel de integración exige una gobernanza sólida para garantizar despliegues perimetrales seguros y eficientes.

Las plataformas periféricas modernas vienen equipadas con herramientas de supervisión centralizadas, que incluyen políticas detalladas de control de acceso basado en roles (RBAC), barreras de protección integradas y registros de auditoría completos para garantizar el cumplimiento a gran escala. La administración inmutable del estado protege el progreso y permite la recuperación de los errores. Con una disponibilidad de hasta el 99,99%, estas plataformas cumplen con las exigencias de confiabilidad de las aplicaciones de misión crítica. Reconocimientos por parte de los líderes del sector, como la colocación de IBM en el 2025 Cuadrante Mágico de Gartner para las plataformas de desarrollo de aplicaciones de IA y la inclusión de Clarifai en el informe GigaOm Radar for AI Infrastructure v1, subraya la madurez de sus capacidades de gobierno.

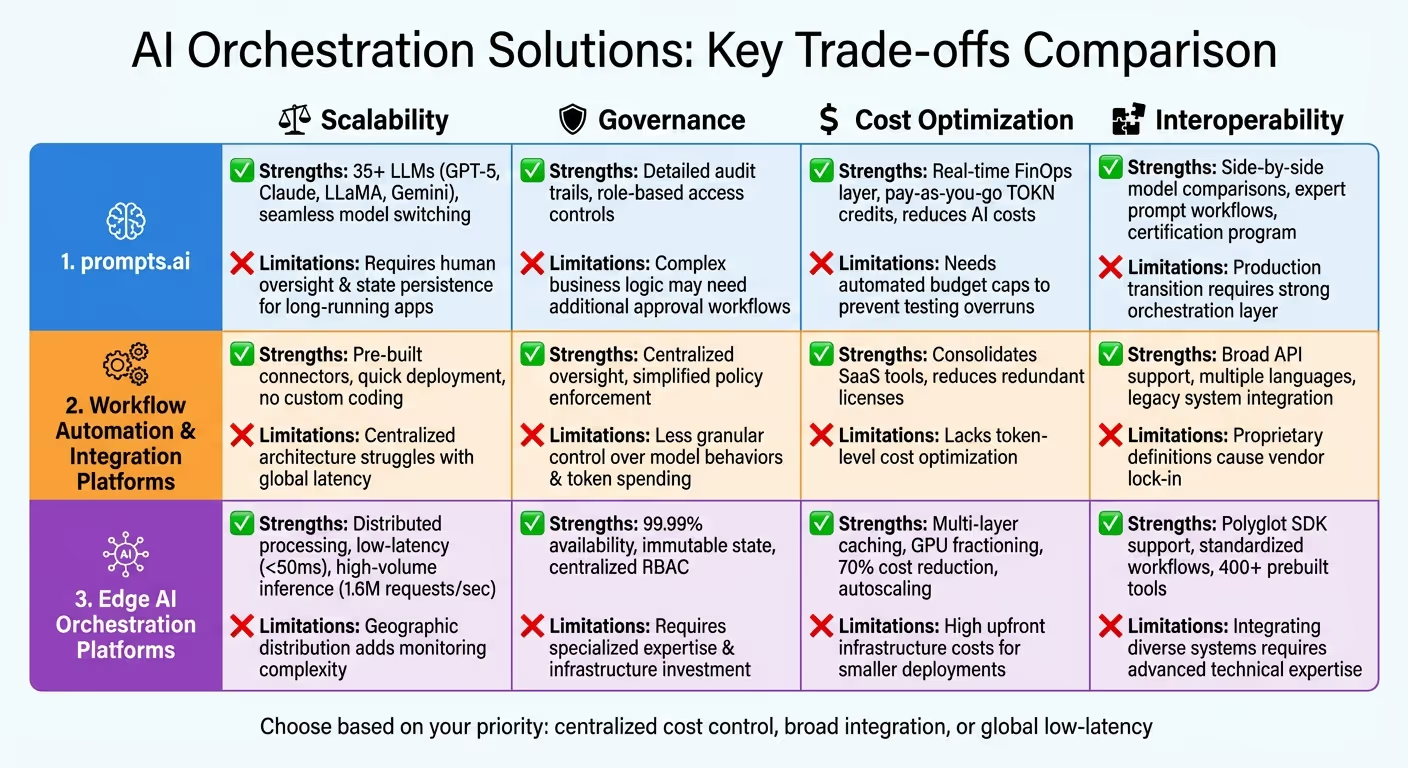

Comparación de soluciones de orquestación de IA: escalabilidad, gobierno, costo e interoperabilidad

Para ayudar a aclarar las diferencias entre las soluciones de orquestación, la siguiente tabla destaca las principales ventajas y desventajas entre prompts.ai, Plataformas de automatización e integración del flujo de trabajo, y Plataformas de orquestación de IA perimetral. Estas soluciones se comparan en cuatro áreas críticas: escalabilidad, gobernanza, optimización de costos e interoperabilidad.

Esta comparación ayuda a las organizaciones a alinear las fortalezas de las soluciones con sus prioridades operativas, ya sea que esas prioridades impliquen una transparencia de costos centralizada, una automatización optimizada o una distribución global de baja latencia. En muchos casos, la combinación de elementos de diferentes soluciones puede responder de manera eficaz a los diversos desafíos de escalabilidad de los flujos de trabajo de inteligencia artificial empresariales.

La selección de la solución de orquestación de IA ideal en 2026 depende de alinear las prioridades únicas de su organización con los puntos fuertes de cada plataforma. Prompts.ai se destaca por combinar la rentabilidad con una integración perfecta de modelos, lo que brinda a las empresas estadounidenses acceso instantáneo a más de 35 modelos lingüísticos de gran tamaño de primer nivel sin la carga de una administración de infraestructura adicional. Su capa FinOps en tiempo real y su sistema de crédito TOKN de pago por uso garantizan la total transparencia de los costos y eliminan los gastos ocultos. Estas características lo convierten en un sólido competidor a la hora de comparar los flujos de trabajo de IA centralizados con los sistemas de orquestación perimetral.

Las plataformas de automatización del flujo de trabajo destacan cuando se trata de simplificar y conectar las capacidades de IA en miles de aplicaciones empresariales sin necesidad de código personalizado. Al optimizar las integraciones, ofrecen ahorros cuantificables a las empresas que buscan mejorar la eficiencia.

Para las organizaciones que se enfrentan a desafíos de latencia a nivel mundial, las plataformas de inteligencia artificial perimetral proporcionan una solución atractiva. Estas plataformas logran tiempos de respuesta inferiores a un segundo para los usuarios distribuidos al aprovechar técnicas como el almacenamiento en caché de múltiples capas, las implementaciones regionales y el procesamiento distribuido. Sin embargo, la inversión inicial en infraestructura normalmente se justifica solo para cargas de trabajo de inferencia de gran volumen y no para proyectos de IA exploratorios más pequeños.

Un enfoque híbrido suele ser la estrategia más escalable, ya que combina la optimización de costos centralizada, la integración amplia y el rendimiento de baja latencia. Muchas empresas estadounidenses tienen éxito al utilizar Prompts.ai para la consolidación de modelos y la claridad de costos, al tiempo que incorpora la automatización del flujo de trabajo para las necesidades específicas de los departamentos o la orquestación perimetral para las tareas de latencia crítica. Evitar la dependencia de un solo proveedor y crear marcos de gobierno adaptables son cruciales para el éxito a largo plazo.

Industrias como la sanidad y las finanzas deben priorizar las plataformas con pistas de auditoría detalladas y controles de acceso basados en funciones para cumplir con las exigencias de cumplimiento. Mientras tanto, los equipos centrados en la ingeniería con experiencia en Kubernetes pueden preferir opciones de código abierto como Flujo de aire Apache por sus ventajas económicas. Dicho esto, la mayoría de las empresas se benefician de las plataformas administradas que simplifican las complejidades, como la persistencia del estado, la recuperación de errores y las aprobaciones interpersonales. En última instancia, la mejor solución equilibra la escalabilidad técnica, la rentabilidad y la gobernanza; lo ideal es ofrecer las tres cosas en un solo paquete.

La orquestación de la IA agiliza y automatiza los flujos de trabajo complejos mediante la integración de modelos, fuentes de datos y recursos informáticos en un sistema cohesivo. Este enfoque ayuda a las empresas a ajustar los flujos de trabajo de forma dinámica en función de la demanda, lo que minimiza la necesidad de supervisión manual y permite que las operaciones escalen sin esfuerzo.

Con funciones como automatización de tareas, programación consciente de los recursos, y ejecución distribuida, las plataformas de orquestación hacen un uso eficiente de la infraestructura. Gestionan conjuntos de datos más grandes, ejecutan más inferencias de modelos y gestionan los aumentos repentinos de la carga de trabajo con facilidad. Al optimizar la asignación de recursos, estas herramientas ayudan a las empresas a reducir los costos y, al mismo tiempo, a mantener un rendimiento de primer nivel.

Al simplificar todo el ciclo de vida de la IA, desde la implementación hasta la supervisión, la orquestación de la IA aumenta la eficiencia operativa. Permite a las empresas ampliar sus esfuerzos de inteligencia artificial en varios departamentos y mercados, al tiempo que garantiza que la escalabilidad y la fiabilidad permanezcan intactas.

Prompts.ai optimiza la gestión del flujo de trabajo de la IA al reunir más de 35 de los mejores modelos de idiomas extensos, como GPT-4 y Claude, en un panel único y fácil de usar. Esta integración elimina la necesidad de combinar varias cuentas o API, lo que ahorra tiempo y esfuerzo y reduce la complejidad operativa.

Una característica destacada es la plataforma Consola FinOps, que monitorea el uso y los gastos en tiempo real. Esta herramienta ayuda a las empresas a descubrir formas de reducir los costos, lo que permite ahorrar hasta 98% en comparación con la administración de modelos por separado. Con un plan de precios flexible de pago por uso que comienza en 99 a 129 USD por usuario al mes, las organizaciones pueden escalar sus operaciones con facilidad y sin cargos inesperados.

Prompts.ai también prioriza la seguridad y el cumplimiento de controles de gobierno de nivel empresarial, lo que lo convierte en una opción confiable para las industrias reguladas de EE. UU. Al centralizar el acceso a los modelos, ofrecer información sobre los costos en tiempo real y garantizar medidas de cumplimiento estrictas, Prompts.ai transforma los flujos de trabajo inconexos en un sistema eficiente y rentable.

Un enfoque híbrido reúne varias herramientas de orquestación o modelos de implementación, combinando sus puntos fuertes y abordando sus limitaciones. Por ejemplo, un Plataforma nativa de Kubernetes como Kubeflow, se destaca a la hora de escalar los flujos de trabajo de aprendizaje automático, mientras que Herramientas basadas en Python como Apache Airflow, proporcionan una programación precisa de tareas y un amplio ecosistema de complementos. Al integrar estas herramientas, los equipos pueden gestionar cargas de trabajo de alto rendimiento en Kubeflow y, al mismo tiempo, confiar en Airflow para tareas especializadas o antiguas, lo que se traduce en flujos de trabajo eficientes y flexibles.

Esta configuración también logra un equilibrio entre el costo, el rendimiento y la gobernanza. Soluciones como plataformas independientes de la nube tales como Prefecto Orión ofrecen una observabilidad avanzada sin vincular a los usuarios con proveedores específicos, mientras que las implementaciones locales o periféricas cumplen con estrictos requisitos de privacidad de datos o baja latencia. Esta flexibilidad permite a las organizaciones ampliar sus operaciones de IA, asignar los recursos de forma inteligente y reducir la complejidad operativa.

Además, plataformas modulares como Microsoft Foundry adoptan un enfoque «listo para usar», lo que permite a los equipos crear soluciones personalizadas seleccionando las herramientas más adecuadas para su industria o carga de trabajo específica. Este enfoque garantiza la escalabilidad, la seguridad y la gobernanza, a la vez que mantiene un alto rendimiento.