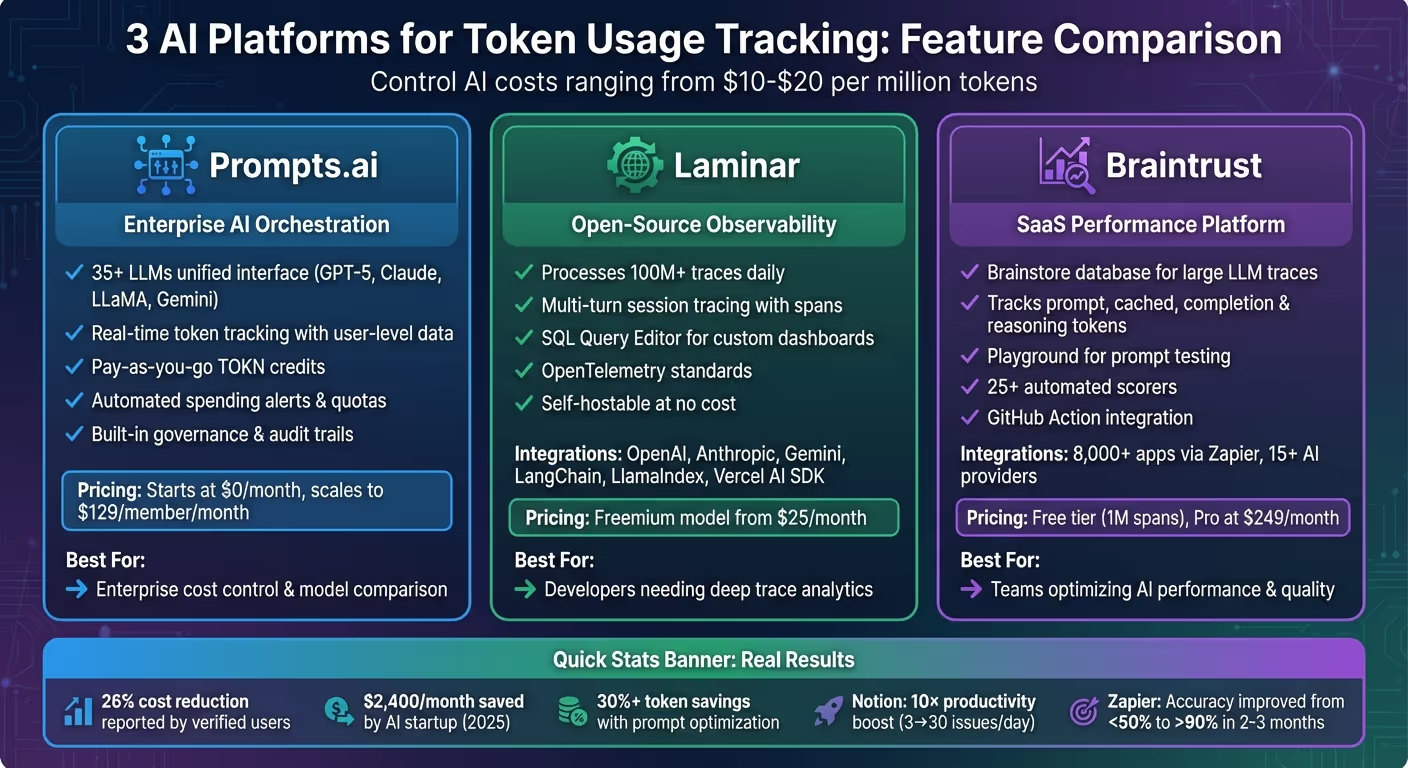

El uso de tokens puede aumentar silenciosamente los costos de la IA si no se controla. Con gastos que van desde De 10 a 20 dólares por millón de fichas, las operaciones a gran escala pueden escalar rápidamente a miles de millones de tokens al mes. El seguimiento del consumo de tokens es clave para controlar los costos, optimizar los flujos de trabajo y garantizar la responsabilidad del rendimiento. Este artículo explora tres plataformas que simplifican el seguimiento de los tokens y la administración de costos:

Cada plataforma ofrece funciones únicas para monitorear el uso de los tokens, optimizar los costos y mejorar el rendimiento de la IA. A continuación se muestra una comparación rápida que le ayudará a elegir la solución adecuada.

Comparación de plataformas de seguimiento de tokens de IA: Prompts.ai vs Laminar vs Braintrust

Prompts.ai sirve como plataforma de orquestación de IA empresarial, que reúne a la perfección más de 35 modelos lingüísticos avanzados, incluidos GPT-5, Claude, Llama, y Géminis - dentro de una interfaz única y optimizada. Diseñado para las organizaciones que buscan gestionar los gastos de inteligencia artificial a gran escala, combina el seguimiento de los tokens en tiempo real con controles financieros sólidos para ayudar a evitar gastos excesivos.

Prompts.ai proporciona información detallada sobre cada interacción de la IA, capturando datos críticos como el modelo utilizado, el identificador de usuario, el enrutamiento y el tiempo. A diferencia de los sistemas tradicionales que se basan en las facturas mensuales, esta plataforma ofrece una visibilidad inmediata del consumo de tokens, lo que le ayuda a identificar los flujos de trabajo con mayor uso y a descubrir oportunidades de optimización.

La plataforma simplifica el control de costos con funciones como refinamiento rápido y ajustes del flujo de trabajo. Al reducir el uso innecesario de tokens, como recortar el texto repetitivo o acortar los mensajes del sistema, los equipos pueden reducir significativamente los costos. Los datos de uso en tiempo real de cada modelo y solicitud permiten a los usuarios identificar las tareas costosas y redirigir las solicitudes más sencillas a modelos más económicos. Además, el sistema de crédito TOKN de pago por uso garantiza que solo se te cobre por lo que usas, lo que elimina la necesidad de pagar cuotas de suscripción recurrentes.

Prompts.ai se consolida Más de 35 LLM líderes en una sola plataforma, eliminando las ineficiencias de hacer malabares con múltiples herramientas. Los equipos pueden cambiar fácilmente de un modelo a otro, comparar su rendimiento en paralelo e implementar flujos de trabajo en cuestión de minutos, todo ello sin la molestia de administrar claves de API o sistemas de facturación independientes. Los registros de control y auditoría integrados garantizan que el cumplimiento se integre a la perfección en todos los flujos de trabajo.

La plataforma incluye controles de gastos automatizados, que ofrece alertas de cuotas y presupuestos para mantener los costos bajo control. Este enfoque proactivo garantiza que los equipos se mantengan dentro del presupuesto, abordando los posibles excedentes antes de que se produzcan, en lugar de reaccionar a posteriori. A continuación, analizaremos cómo Laminar amplía estas capacidades.

Laminar es un plataforma de observabilidad de código abierto diseñado para rastrear automáticamente el uso de los tokens en los flujos de trabajo de IA. Está diseñado para soportar una escala masiva y procesar cientos de millones de rastros a diario. A diferencia de los sistemas que se basan en el registro manual, Laminar comienza a capturar los recuentos de tokens de entrada y salida tan pronto como se configura en el punto de entrada de la aplicación.

Laminar registra meticulosamente su flujo de ejecución rastreando cada llamada de LLM, ejecución de función y solicitud de API. Cada seguimiento se divide en tramos que detallan el recuento de los tokens de entrada/salida, la latencia y el modelo utilizado. Estos intervalos se agrupan en sesiones, lo que permite supervisar conversaciones de varios turnos o flujos de trabajo complejos. Con su editor de consultas SQL integrado, puede crear paneles personalizados para descubrir las tendencias de gasto y los cuellos de botella en el rendimiento. Este nivel de seguimiento proporciona la base para identificar las áreas a fin de optimizar los costos y mejorar el rendimiento.

Laminar calcula los costos en tiempo real en función del volumen de tokens y del modelo específico utilizado para cada llamada a la API. También incluye un entorno de Playground en el que puede probar los modelos y las instrucciones antes de la implementación. Mediante el uso del @observe () decorador en Python o el observar () en JavaScript, puede rastrear funciones personalizadas e identificar llamadas LLM anidadas con muchos tokens. Esta visualización detallada resalta los componentes que consumen la mayor cantidad de tokens. Además, Laminar se integra perfectamente con varios proveedores y marcos de LLM, lo que lo convierte en una herramienta versátil para la gestión de costos y rendimiento.

Laminar admite la instrumentación automática para los principales proveedores de LLM como OpenAI, Anthropic, Gemini, Mistral, y Crecer. También se integra con marcos como LangChain, Índice Llama, SDK de IA de Vercel, y Litell M. Para los agentes de IA basados en navegadores, sincroniza las grabaciones de ventanas de herramientas como Browser Use, Stagehand, Dramaturgo, y Titiritero con rastros de ejecución. Construido sobre Telemetría abierta estándares, Laminar también ofrece una API de SQL para informes externos personalizados.

Laminar proporciona visibilidad en tiempo real de los intervalos y los pasos de ejecución, lo que le permite depurar los agentes de larga duración sin demora. Captura las excepciones a nivel de aplicación a medida que se producen y registra los errores junto con los datos pertinentes sobre el uso de los tokens. Su servicio gestionado en la nube, laminar.sh, ofrece una ingestión ilimitada de intervalos en una generosa capa gratuita, mientras que la plataforma se puede alojar automáticamente sin coste alguno.

Braintrust es una plataforma SaaS diseñada para ayudar a los equipos a rastrear el uso de los tokens y, al mismo tiempo, mejorar el rendimiento de la IA. Recopila automáticamente métricas detalladas de los tokens para cada llamada de LLM, lo que incluye los tokens rápidos, los tokens almacenados en caché, los tokens de finalización y los tokens de razonamiento. Su esencia es Brainstore, una base de datos creada específicamente para gestionar grandes trazas de LLM, que pueden abarcar decenas de kilobytes por operación.

Braintrust registra meticulosamente los detalles de la ejecución, como la duración total, el tiempo específico de LLM y el tiempo hasta el primer token (TTFT). También hace un seguimiento de las llamadas a herramientas y de LLM, junto con los tipos de error. La página Monitor de la plataforma consolida los recuentos y costos de los tokens en gráficos prediseñados, mientras que los paneles BTQL personalizados permiten a los usuarios organizar los datos por modelo o proyecto. Una característica destacada es la capacidad de convertir los rastros de producción en casos de evaluación con un solo clic, lo que permite realizar pruebas de regresión estructuradas. Estas capacidades sientan las bases para una gestión de costes eficaz.

La plataforma incluye un entorno Playground en el que los equipos pueden experimentar con las indicaciones utilizando datos de producción reales. Esta configuración facilita la comparación de modelos y el ajuste de las configuraciones, lo que ayuda a los equipos a identificar las opciones más rentables antes de la implementación. Para los usuarios del plan Pro, Braintrust se integra con el portal de uso de Orb y ofrece un seguimiento detallado de los costos durante todo el ciclo de facturación. La versión gratuita admite hasta 1 000 000 intervalos de rastreo y 10 000 puntuaciones, mientras que el plan Pro tiene un precio inicial de 249$ al mes y ofrece períodos ilimitados y 5 GB de datos. Empresas como Noción han registrado mejoras espectaculares, ya que han pasado de resolver 3 problemas al día a 30, lo que se ha traducido en un aumento de 10 veces en la productividad.

Braintrust simplifica las operaciones con un proxy de IA que proporciona una única API compatible con OpenAI para varios modelos, incluidos OpenAI, Anthropic y Google. Este proxy rastrea y almacena en caché automáticamente cada llamada. La plataforma admite el rastreo automático a través de las funciones de empaquetado de TypeScript y Python, capturando todas las métricas de los tokens. Además, se integra con más de 8000 aplicaciones y más de 450 herramientas de inteligencia artificial a través de Zapier, y también es compatible con más de 15 de los principales proveedores de inteligencia artificial, como AWS Bedrock, Azure OpenAI, Inteligencia artificial de Google Vertex, Ladrillos de datos, Crecer, Cerebras, y Fuegos artificiales . Desde agosto de 2023, la integración de Zapier con Braintrust ha permitido registrar las interacciones de los usuarios y automatizar las evaluaciones, lo que ha supuesto un salto en la precisión de los productos de IA (de menos del 50% a más del 90%) en tan solo 2 o 3 meses. Estas integraciones proporcionan una supervisión en tiempo real y mejoran significativamente la calidad de la producción.

Braintrust incluye marcadores en línea que revisan el tráfico en vivo para detectar problemas como alucinaciones o respuestas insatisfactorias a medida que ocurren. Una GitHub Action nativa publica los resultados de las evaluaciones directamente en las solicitudes de extracción, lo que agiliza los flujos de trabajo de desarrollo. Para los casos de uso de streaming, habilita la incluir_uso El parámetro en las opciones del modelo captura las métricas del token en tiempo real.

Prompts.ai, Laminar y Braintrust aportan puntos fuertes únicos y ofrecen distintos enfoques para la gestión, la integración y la fijación de precios de los tokens. Así es como se comparan en función de sus principales características:

Prompts.ai simplifica el seguimiento de los tokens con controles FinOps integrados, mientras que Laminar se centra en el análisis de trazas y Braintrust se destaca en la atribución detallada de costos mediante metadatos. Prompts.ai también destaca por consolidar las comparaciones de modelos, lo que permite a las empresas optimizar el rendimiento y los costes sin tener que hacer malabares con varias herramientas.

La flexibilidad de la integración varía según las plataformas:

Las estructuras de precios también difieren significativamente:

«El monitoreo de costos de Braintrust muestra exactamente a dónde van sus gastos en paneles de control en tiempo real e identifica los costosos flujos de trabajo. Puede agrupar los costos por cualquier campo de metadatos para saber qué partes de su aplicación consumen más tokens».

- Equipo Braintrust

Las plataformas mencionadas anteriormente destacan la importancia de un seguimiento preciso de los tokens para gestionar tanto los costos como el rendimiento en las operaciones de IA. Estas herramientas sustituyen las conjeturas por información precisa y basada en datos, ya que ofrecen una visibilidad detallada de los elementos de entrada, salida y razonamiento. Este nivel de transparencia permite a los equipos determinar exactamente a dónde van destinados sus gastos, ya sea que estén vinculados a una sesión de usuario, a un flujo de trabajo o a un agente de IA específico. Sin esa claridad, las organizaciones se arriesgan a realizar gastos inesperados y a hacer un uso ineficiente de los recursos.

El seguimiento de los tokens no solo tiene que ver con el control de los costos, sino que también mejora la supervisión del rendimiento. Al controlar métricas como la latencia, el rendimiento y las tasas de éxito en tiempo real, los desarrolladores pueden detectar y resolver los cuellos de botella antes de que afecten a la experiencia del usuario. Por ejemplo, la comparación de modelos como el GPT-4 y el Claude en tareas idénticas permite tomar decisiones informadas basadas en datos de rendimiento reales.

Las funciones de gobierno automatizadas, como los umbrales presupuestarios y los sistemas de alerta, ayudan a prevenir los sobrecostos. Estas medidas proactivas han arrojado resultados tangibles. Los usuarios verificados han informado de que han reducido los gastos de IA en un 26% y, al mismo tiempo, han aumentado el uso general, gracias a las visualizaciones de facturación unificadas. En 2025, Sarah Chen, directora de tecnología de una empresa emergente de inteligencia artificial, ahorró 2400 dólares al mes al aprovechar un panel de control centralizado para identificar las oportunidades de ahorro de costes en su sistema de IA.

La transición de la intuición a la observabilidad transforma la forma en que se gestionan los recursos de IA. Los equipos que adoptan prácticas como la disciplina rápida (eliminar el contexto repetitivo innecesario y establecer límites de producción estrictos), junto con modelos de enrutamiento inteligentes, han logrado un ahorro simbólico de más del 30% si las tasas de aciertos de la caché coinciden con esos puntos de referencia.

El análisis del costo por resultado conecta aún más el uso de los tokens con los resultados comerciales tangibles. Como el Statisig El equipo lo expresa acertadamente:

«El costo sin resultados es ruido; los resultados sin costo son esperanza».

Con herramientas de seguimiento eficaces, las organizaciones pueden escalar con confianza sus capacidades de IA y, al mismo tiempo, mantener un control estricto sobre el rendimiento y los gastos.

La supervisión del uso de los tokens le permite detectar solicitudes ineficientes y selecciones de modelos que no son ideales, lo que le permite ajustar sus flujos de trabajo. Al establecer límites de uso y elegir los modelos de forma más estratégica, puede reducir drásticamente los costos y, al mismo tiempo, mejorar el rendimiento. Algunos usuarios incluso han logrado ahorros de costos de hasta 98% mediante una gestión eficaz de los tokens.

Al elegir una plataforma de seguimiento de tokens, concéntrese en las herramientas que ofrecen monitoreo en tiempo real, control de costos, y información procesable. Las plataformas con análisis detallados pueden desglosar el uso de los tokens por proyecto o modelo, lo que ayuda a identificar las ineficiencias y optimizar los flujos de trabajo.

Opte por soluciones que incluyan límites y alertas personalizables para mantener los presupuestos por buen camino. Funciones como los límites de uso, las notificaciones automáticas cuando se acercan los umbrales y la posibilidad de pausar la actividad una vez que se alcanzan los límites pueden proteger contra los gastos inesperados.

Efectivo herramientas de administración de costos también son clave. Busque opciones que ofrezcan previsiones presupuestarias, asignaciones simbólicas e informes de gastos claros en dólares estadounidenses para ayudarlo a planificar y administrar los gastos. Las medidas de seguridad, como los registros de auditoría y el seguimiento de los usuarios, añaden un nivel adicional de control, garantizan el cumplimiento y protegen la integridad de los datos, al tiempo que mejoran el rendimiento de la IA.

El seguimiento de los tokens en tiempo real proporciona información instantánea sobre el uso de los tokens, lo que le permite ajustar las indicaciones y refinar las interacciones del modelo de forma inmediata. Este enfoque minimiza el uso innecesario, mejora los tiempos de respuesta y garantiza una calidad de salida constante.

Al vigilar de cerca el consumo de tokens en tiempo real, puede tomar decisiones informadas para controlar los costos y, al mismo tiempo, mantener un rendimiento de primer nivel en sus flujos de trabajo de IA, sin comprometer la eficiencia ni los resultados.