تعمل أتمتة سير العمل المدعومة بالذكاء الاصطناعي على تحويل الأعمال ولكنها تقدم مخاطر أمنية مثل خروقات البيانات والحقن الفوري والذكاء الاصطناعي الخفي. المخاطر عالية - 81% من الشركات يتبنون الذكاء الاصطناعي، لكن أكثر من تقرير ثالث زاد من المخاطر. في عام 2025، تسببت «LLMjacking» في خسائر يومية قدرها من 46 ألف دولار إلى 100 ألف دولارمما يؤكد الحاجة إلى حلول قوية.

تسلط هذه المقالة الضوء على سبع منصات تعالج هذه التحديات:

تتناول كل منصة أمن الذكاء الاصطناعي من خلال اكتشاف التهديدات والحوكمة والتكامل والامتثال، مما يضمن سير عمل أكثر أمانًا دون المساس بالكفاءة.

يعالج Prompts.ai تحديات أمان الذكاء الاصطناعي في التشغيل الآلي لسير العمل من خلال تركيز إدارة أكثر من 35 نموذجًا من أفضل اللغات - بما في ذلك GPT-5 و Claude و LLama و Gemini - على منصة واحدة جاهزة للمؤسسات. يسمح هذا النظام المبسط للمؤسسات بالتعامل مع تفاعلات الذكاء الاصطناعي دون عناء، مما يقلل من مخاطر الأدوات المتناثرة مع ضمان الإشراف الشامل للفرق والتطبيقات المختلفة.

تقوم المنصة بتضمين الحوكمة على مستوى المؤسسة في كل سير عمل. يوفر مسارات تدقيق مفصلة تتعقب النماذج التي يتم الوصول إليها والمطالبات المستخدمة وكيفية انتقال البيانات داخل العمليات الآلية. يساعد هذا المستوى من الشفافية في التخفيف من مخاطر الذكاء الاصطناعي في الظل، حيث يمكن أن يؤدي الاستخدام غير المصرح به لأدوات الذكاء الاصطناعي العامة إلى كشف المعلومات الحساسة. من خلال مواءمة سير العمل مع السياسات التنظيمية ودمج فحوصات الامتثال، يضمن Prompts.ai إمكانية توسيع عمليات الذكاء الاصطناعي بشكل آمن.

يعمل Prompts.ai على تبسيط الأمان من خلال تقديم واجهة موحدة تقضي على فوضى إدارة أدوات متعددة. بدلاً من التوفيق بين مفاتيح API المنفصلة ونقاط الوصول لخدمات الذكاء الاصطناعي المختلفة، يمكن للمؤسسات توجيه جميع التفاعلات من خلال بوابة آمنة واحدة. لا يعمل هذا النهج على تبسيط التكامل مع أنظمة الأمان الحالية فحسب، بل يضمن أيضًا التطبيق المتسق للسياسات عبر عمليات سير العمل الآلية.

توفر ضوابط تكلفة FinOps في الوقت الفعلي للشركات الرؤى المالية اللازمة لإعداد التقارير التنظيمية. من خلال تتبع استخدام الرموز وربط نفقات الذكاء الاصطناعي بنتائج الأعمال، تضمن المنصة الشفافية. يزيل نظام TOKN الائتماني للدفع أولاً بأول عبء الرسوم المتكررة مع الحفاظ على مسارات التدقيق التفصيلية الضرورية للامتثال. بالإضافة إلى ذلك، تضمن ضوابط معالجة البيانات بقاء المعلومات الحساسة ضمن الحدود التنظيمية، مما يمكّن الفرق من نشر عمليات سير عمل آمنة ومتوافقة مع الذكاء الاصطناعي بثقة.

أثبتت Arctic Wolf نفسها كشركة رائدة في مجال الأتمتة القائمة على الذكاء الاصطناعي من خلال حلولها الأمنية المتقدمة والمتكاملة. تعالج منصة Aurora الخاصة بها بشكل مثير للإعجاب 9 تريليون حدث أمني كل أسبوع من خلال محرك Alpha AI، مما يضمن حماية قوية لسير العمل الآلي. يقوم هذا النظام بأتمتة مهام الأمان الهامة والتعامل معها 7 ملايين تنبيه والأداء 2 مليون علاج سنويًا، مع الاستفادة من الرؤى الأمنية العميقة لاكتشاف التهديدات وتحييدها قبل تعطيل العمليات.

يقع محرك Alpha AI في قلب قدرات اكتشاف التهديدات في Arctic Wolf. إنها تتفوق في منع التهديدات في يوم الصفر والتحليل السلوكي واسع النطاق، مما يثري بيانات الأحداث للمراجعة المبسطة. بالتعاون مع Databricks في 2024-2025، قام Arctic Wolf بتوحيد القياس عن بُعد لأكثر من 10,000 منظمة، مما يتيح للمحللين تشغيل اكتشافات التعلم الآلي المتقدمة بنقرة واحدة فقط - مما يلغي الحاجة إلى البرمجة اليدوية ويسرع الاستجابة للحوادث بشكل كبير. بالإضافة إلى ذلك، يوفر AI Security Assistant، الذي تم تطويره بالشراكة مع Anthropic، تحليلًا للتهديدات في الوقت الفعلي على مدار الساعة طوال أيام الأسبوع. فهي تعمل على تبسيط التنبيهات المعقدة والسيرات الذاتية وتحويلها إلى رؤى قابلة للتنفيذ، مما يساعد على تقليل عبء عمل المحللين وإرهاقهم.

تعمل بنية XDR المفتوحة من Arctic Wolf على تحسين وظائفها من خلال الاندماج بسلاسة مع أكثر من 250 أداة خارجية. وتشمل هذه الأنظمة الرئيسية مثل Microsoft Defender XDR وOracle Cloud Guard وOneLogin وCyberArk، والتي تغطي أنظمة نقطة النهاية والشبكة والسحابة والهوية. يتجنب هذا النهج الحاجة إلى عمليات استبدال البنية التحتية المكلفة، وبدلاً من ذلك يوحد القياس عن بُعد في نظام تسجيل واحد موحد. لا تعمل عمليات الدمج هذه على تعزيز الأمان فحسب، بل تدعم أيضًا جهود الامتثال.

توفر منصة Aurora احتفاظًا غير محدود بالبيانات مع وصول سهل للسجلات عند الطلب، وكل ذلك بموجب نموذج تسعير ثابت. هذا يزيل عدم القدرة على التنبؤ بالتكاليف القائمة على الحجم. من خلال تكامل Unity Catalog، يمكن للمؤسسات تركيز إدارة البيانات وإدارة أذونات الأمان عبر مشهد البيانات بالكامل. يعمل مساعد الأمان بالذكاء الاصطناعي على تبسيط الامتثال من خلال تلخيص عناصر الإجراءات من «الرحلات الأمنية» وتوفير سياق MITRE ATT&CK المفصل لوثائق CVE. تضمن هذه الميزات أن عمليات سير العمل جاهزة للتدقيق، وتفي بالمتطلبات التنظيمية الصارمة لصناعات مثل الرعاية الصحية والتمويل والحكومة.

تستفيد Cato Networks من منصة SASE السحابية لتوحيد الأمان القائم على الذكاء الاصطناعي، مما يضمن وقت تشغيل بنسبة 99.999% أثناء إدارة أحداث الأمن العالمية. تدمج منصتها اكتشاف التهديدات وضوابط الحوكمة والتكامل السلس في نظام واحد فعال. والجدير بالذكر أنه في أبريل 2025، اعتمدت CloudFactory عناصر تحكم GenAI من Cato من خلال لوحة معلومات الظل الخاصة بالذكاء الاصطناعي، مما يتيح الاستخدام الآمن والمُدار للمخاطر لأدوات GenAI.

تتعامل Cato Networks مع التهديدات الحديثة من خلال أدوات الكشف المتقدمة التي تعمل بالذكاء الاصطناعي والمضمنة في منصتها الموحدة.

تقوم محركات الذكاء الاصطناعي الخاصة بالمنصة بمعالجة المئات من خلاصات معلومات التهديدات، مع الحفاظ على قائمة سوداء عالمية لـ أكثر من 5 ملايين مشاركة بدون إشراف بشري. من خلال تعيين درجات الخبث، يحدد كاتو النطاقات التي تم إنشاؤها آليًا ومحاولات السطو الإلكتروني، متفوقًا على القوائم السوداء الثابتة من خلال الحظر نطاقات ضارة أكثر بـ 3 إلى 6 مرات. تعمل ميزة Storyteller AI الخاصة بها على ترجمة بيانات الحوادث الأولية إلى روايات واضحة وقابلة للتنفيذ تتماشى مع إطار MITRE ATT&CK، مما يسرع من معالجة فرق الأمن التي تدير تدفقات العمل الآلية.

لمعالجة المخاطر الخاصة بالذكاء الاصطناعي، تنشر Cato حواجز وقت التشغيل التي تكتشف الإجراءات غير الآمنة، بما في ذلك الحقن الفوري ومحاولات الهروب من السجن ضمن عمليات سير العمل الآلية. يستخدم نظام منع فقدان البيانات (DLP) المدعوم بالذكاء الاصطناعي نماذج اللغات الكبيرة لفهم سياق المستندات الحساسة - سواء كانت مالية أو طبية أو متعلقة بالموارد البشرية - ويفرض سياسات لمنع تسرب البيانات إلى نماذج الذكاء الاصطناعي العامة.

يعمل محرك السياسات الذاتية من Cato على تعزيز الأمان من خلال تحسين وأتمتة سياسات الشبكة والوصول. ويحدد قواعد جدار الحماية الزائدة عن الحاجة أو الخطرة ويزيلها، مما يقلل من «تضخم القواعد» وينفذ سياسات انعدام الثقة تلقائيًا. كما أوضح أوفير أغاسي، نائب رئيس إدارة المنتجات في Cato Networks:

«لسنوات، سعى قادة تكنولوجيا المعلومات لتحقيق حلم الشبكات المستقلة والأمن - فقط ليصطدموا بجدار من التعقيد. مع سياسات كاتو الذاتية، نتجاوز أخيرًا هذا الحد».

تقوم لوحة معلومات Shadow AI بمراقبة وتصنيف أكثر من 950 تطبيقًا من تطبيقات GenAI، مما يسمح بالتحكم المفصل في إجراءات المستخدم. يضمن التحكم في الوصول المستند إلى الأدوار الوصول الأقل امتيازًا، حيث يوفر أدوارًا محددة مسبقًا مثل مسؤول الحساب ومسؤول الأمان ومسؤول الشبكة والمشاهد، مع خيار إنشاء أدوار مخصصة. تضمن الإجراءات الوقائية الإضافية، مثل المصادقة متعددة العوامل ومسار التدقيق ضمن علامة تبويب المراقبة، تتبع جميع تغييرات السياسة والمساءلة.

يعمل خادم بروتوكول السياق النموذجي (MCP) من Cato على تبسيط التفاعلات بين وكلاء الذكاء الاصطناعي وبيئة Cato، مما يتيح أوامر اللغة الطبيعية بدلاً من البرامج النصية المعقدة. يتكامل هذا الخادم المستند إلى Docker بسلاسة مع رؤى Cato وأنظمة الطرف الثالث مثل SIEM، مما يدعم استخراج البيانات والتكوينات الآلية وعمليات الدمج المخصصة. تعمل هذه الميزات على تبسيط معالجة البيانات ومهام الأمان الروتينية.

في مايو 2025، استخدمت شركة تصنيع المواد الكيميائية ESI أدوات الإدارة الموحدة والسياسة الآلية من Cato لتقليل الوقت اللازم لدمج الشركات المكتسبة حديثًا في شبكتها الآمنة من خلال 80%. توفر المنصة أيضًا رؤية مستمرة لـ «النظام البيئي الوكيل»، وتحديد وكلاء الظل، وخوادم MCP غير المُدارة، والوكلاء المُصممون خصيصًا عبر البيئات السحابية والمحلية. يستفيد المطورون من حواجز حماية وقت التشغيل المضمنة التي تحمي منطق الوكيل واستخدام الأدوات في عمليات سير العمل الخاصة بهم.

بالإضافة إلى دفاعاتها الفنية، تعمل Cato على تبسيط إدارة الامتثال والتدقيق.

تحافظ المنصة على قواعد نظيفة وتوفر رؤية في الوقت الفعلي لاستخدام الذكاء الاصطناعي عبر المؤسسة، مما يخفف عبء عمليات تدقيق الامتثال. تقوم تقنية DLP المدعومة بالذكاء الاصطناعي باكتشاف المحتوى الحساس وفرض سياسات الشركة، مما يمنع التحميلات غير المصرح بها لنماذج الذكاء الاصطناعي العامة. وفقًا لشركة جارتنر، بحلول عام 2027، أكثر من 40% من خروقات البيانات المتعلقة بالذكاء الاصطناعي سوف تنبع من الاستخدام غير السليم لـ GenAI عبر الحدود، مما يجعل هذه الضوابط لا غنى عنها للصناعات المنظمة.

تقوم إدارة Cato الموحدة بدمج التكوين والتحليلات والتدقيق في واجهة واحدة. على سبيل المثال، في عام 2025، انتقلت شركة Fidal للمحاماة من بنية MPLS القديمة إلى Cato SASE، مما أدى إلى تقليل تكاليف WAN والأمان بنسبة 50٪ مع تحسين أداء الشبكة ورؤيتها. بالإضافة إلى ذلك، يعمل التصحيح الافتراضي السريع للمنصة من خلال طبقة IPS الخاصة بها على تحييد نقاط الضعف في غضون ساعات، مما يضمن بقاء عمليات سير العمل الآلية آمنة ضد التهديدات الجديدة.

يعمل Cisco AI Defense على تأمين عمليات سير العمل المؤتمتة من خلال تضمين الحماية مباشرةً في البنية التحتية للشبكة، مما يلغي الحاجة إلى الوكلاء أو تغييرات التعليمات البرمجية. تقوم المنصة بفحص كل تفاعل للذكاء الاصطناعي - سواء كان ذلك عبارة عن مطالبات أو استجابات أو تدفقات بيانات - عبر مزودي السحابة الرئيسيين مثل AWS و Azure و GCP. كما أوضح تشاك روبينز، الرئيس والمدير التنفيذي لشركة Cisco:

«إن قدرتنا الفريدة على الجمع بين الشبكات والأمان والمراقبة والبيانات تمكن Cisco من تزويد عملائنا بالمرونة الرقمية لعصر الذكاء الاصطناعي.»

تم تصميم Cisco AI Defense خصيصًا لتأمين تدفقات عمل الذكاء الاصطناعي المؤتمتة. يمكن للفريق الأحمر الخوارزمي اختبار النماذج ضد أكثر من 200 أسلوب هجوم في ثوانٍ، ليحل محل ما قد يستغرق تقليديًا أسابيع من الجهد اليدوي. يحدد النظام مجموعة واسعة من التهديدات، بما في ذلك أكثر من 45 طريقة للحقن الفوري، و 30 خطرًا على خصوصية البيانات، و 20 ثغرة أمنية، و 50 تهديدًا للسلامة. وهذا يضمن اتباع نهج واسع وشامل للكشف عن التهديدات.

تعمل حماية وقت تشغيل النظام الأساسي في طبقة الشبكة، حيث تقوم بفحص كل حركة مرور الذكاء الاصطناعي دون الحاجة إلى وكلاء إضافيين. فهو يحظر بشكل استباقي التهديدات مثل هجمات رفض الخدمة النموذجية (DoS) ومحاولات الاستخراج الفوري وعمليات استغلال تنفيذ الأوامر وتسمم البيانات قبل أن تتمكن من التأثير على أنظمة الإنتاج. يضمن تعقيم المخرجات أيضًا عدم الكشف عن البيانات الحساسة مثل PII أو PHI أو شفرة المصدر. تقوم Cisco Talos، جنبًا إلى جنب مع مختبر أبحاث الذكاء الاصطناعي المخصص، بتحديث النظام الأساسي باستمرار بأحدث التكتيكات والتقنيات والإجراءات العدائية.

توفر وحدة التحكم AI Defense عرضًا مركزيًا للوضع الأمني للذكاء الاصطناعي للمؤسسة. تقوم ميزة AI Cloud Visibility تلقائيًا باكتشاف نماذج الذكاء الاصطناعي غير المصرح بها عبر البيئات السحابية، ومعالجة الثغرات التي غالبًا ما تغفلها أدوات الأمان التقليدية. من خلال علامة تبويب السياسات، يمكن لفرق الأمان إنشاء قواعد موحدة لحماية البيانات والامتثال، وتطبيقها عبر كل من الاتصالات التي تفرضها البوابة وواجهة برمجة التطبيقات.

علق كينت نويز، الرئيس العالمي للذكاء الاصطناعي والابتكار السيبراني في World Wide Technology، على أهمية المنصة:

«إن اعتماد الذكاء الاصطناعي يعرض الشركات لمخاطر جديدة لا تعالجها حلول الأمن السيبراني التقليدية. يمثل Cisco AI Defense قفزة كبيرة إلى الأمام في مجال أمن الذكاء الاصطناعي، حيث يوفر رؤية كاملة لأصول الذكاء الاصطناعي للمؤسسة والحماية من التهديدات المتطورة».

تقدم المنصة طريقتين للتنفيذ: وقت التشغيل الذي تفرضه البوابة، والذي يعترض حركة المرور ويحظرها تلقائيًا على مستوى الشبكة، ووقت التشغيل الذي تفرضه واجهة برمجة التطبيقات، والذي يتكامل مباشرة مع التطبيقات، مما يمكّن المطورين من تطبيق منطق الأمان المخصص. يتيح هذا النهج المزدوج للمؤسسات فرض سياسات على مستوى المؤسسة مع استيعاب الاحتياجات الخاصة بالتطبيقات، مما يضمن الإشراف الشامل.

تعمل Cisco AI Defense على توسيع نطاق حمايتها من خلال عمليات الدمج السلسة، مما يكمل ميزات الكشف والحوكمة. يوفر التكامل الأصلي مع مزودي LLM الرائدين مثل AWS Bedrock، مما يحمي تفاعلات النموذج دون تعطيل سير العمل. يعمل تكامل GitHub على أتمتة فحص ملفات نماذج الذكاء الاصطناعي ورمز MCP والسجلات وتحديد المحتوى الضار وضمان الامتثال للترخيص قبل النشر.

تسمح واجهة برمجة تطبيقات AI Defense Inspection للمطورين بتضمين إجراءات الأمان مباشرة في التطبيقات. وفي الوقت نفسه، يفرض نهج Multicloud Defense الخاص بالمنصة السياسات على مستوى نسيج الشبكة دون الحاجة إلى أي تغييرات في التعليمات البرمجية. يعمل التكامل مع Splunk على جعل التسجيل مركزيًا ويوفر رؤى مفصلة حول الأحداث الأمنية المتعلقة بالذكاء الاصطناعي. بالإضافة إلى ذلك، تعمل Cisco AI Defense جنبًا إلى جنب مع Cisco Secure Endpoint و Cisco Email Threat Defense لمعالجة مخاطر سلسلة التوريد وإدارة ملفات نماذج الذكاء الاصطناعي الضارة. حاليًا، تدعم المنصة فحص المحتوى باللغتين الإنجليزية واليابانية.

بالإضافة إلى قدرات الكشف عن التهديدات، تساعد Cisco AI Defense المؤسسات على التوافق مع الأطر التنظيمية الرئيسية، بما في ذلك إطار إدارة مخاطر NIST AI (AI-RMF)، و MITRE ATLAS، و OWASP Top 10 لتطبيقات LLM. تشتمل المنصة على حواجز حماية لمنع تسرب البيانات المنظمة، مثل PII و PHI بموجب HIPAA وبيانات PCI للخدمات المالية.

تعمل تقييمات الامتثال المؤتمتة على إنشاء تقارير نقاط الضعف في الوقت الفعلي وتقييم حالة الامتثال لتطبيقات الذكاء الاصطناعي. تقوم ميزات حوكمة سلسلة التوريد الخاصة بالمنصة بفحص ملفات نماذج الذكاء الاصطناعي للتأكد من الامتثال لترخيص البرامج ومخاطر المنشأ الجيوسياسي قبل إدخالها في شبكات المؤسسات. من خلال المئات من قواعد الحماية التي تم تكوينها مسبقًا والتي يمكن تصميمها وفقًا لنقاط ضعف معينة في النماذج، يضمن Cisco AI Defense أن حواجز الحماية في وقت التشغيل تعالج المخاطر الفريدة لكل نموذج تم نشره. يحمي هذا النهج عمليات سير عمل الذكاء الاصطناعي القائمة على الوكيل وتطبيقات الجيل المعزز للاسترداد (RAG) من المطالبات الضارة والتعرض للبيانات، كل ذلك مع الحفاظ على الوثائق الجاهزة للتدقيق.

تأخذ CrowdStrike أمان الذكاء الاصطناعي إلى المستوى التالي من خلال منصة Falcon، المصممة لحماية سير العمل الآلي وتبسيط عمليات الأمان.

تستخدم منصة Falcon بنية الأمان القائمة على الوكيل لمعالجة المهام بشكل مستقل، مما يقلل من الحاجة إلى الإشراف البشري المستمر. إنها شارلوت، منظمة العفو الدولية تسمح الميزة لفرق الأمان بالاستفادة من نماذج اللغات الكبيرة داخل Falcon Fusion SOAR. تقوم هذه الإمكانية بمعالجة البيانات غير المهيكلة وأتمتة الاستجابات المعقدة، مما يلغي الحاجة إلى التدخل اليدوي. كما تقول لوسيا ستانهام من CrowdStrike:

«يتجاوز الذكاء الاصطناعي في شارلوت الطيارين المشاركين، ويمثل فئة جديدة من الذكاء الاصطناعي الوكيل الذي يعمل ضمن معايير محددة من قبل الخبراء لتسريع النتائج عبر SOC.»

تم تطوير كراود سترايك اكتشاف الذكاء الاصطناعي والاستجابة له (AIDR) لتأمين «الطبقة السريعة» حيث تتفاعل نماذج اللغة مع عمليات سير العمل الآلية. هذه الطبقة محمية ضد التهديدات مثل الحقن الفوري وعمليات الهروب من السجن والتلاعب بالنماذج. مع تتبع قاعدة البيانات 180 تقنية للحقن الفوري، تعمل المنصة باستمرار على تحسين دفاعاتها. ال حماية بيانات فالكون تستخدم الأداة التعلم الآلي لاكتشاف السلوك غير المعتاد في حركة البيانات عبر المستخدمين والأقران والمؤسسات، مما يؤدي إلى استجابات تلقائية للأنشطة المشبوهة.

تقوم المنصة بنشر وكلاء متخصصين لمهام محددة. على سبيل المثال، عامل إنشاء سير العمل يترجم أوامر اللغة الطبيعية إلى عمليات سير عمل SOAR الآلية، بينما عامل تحليل البرامج الضارة يراجع الملفات المشبوهة ويربطها بالتهديدات المعروفة. يقوم نظام Charlotte AI Detection Triage بتصفية الإيجابيات الكاذبة وإنقاذ فرق الأمن 40 ساعة في الأسبوع والتوصيل إجابات أسرع بنسبة 75% حول بيئتهم الأمنية. مع ما يقرب من 45% من الموظفين باستخدام أدوات الذكاء الاصطناعي دون إخطار الإدارة، يعمل اكتشاف الظل بالذكاء الاصطناعي للمنصة على سد فجوات الرؤية الحرجة في عمليات المؤسسة.

تم تصميم إمكانات الكشف هذه على نموذج بيانات موحد، مما يتيح التشغيل الآلي السلس لسير العمل في جميع المجالات.

ال فالكون فيوجن سور يوفر إطار العمل عمليات تكامل أصلية بدون رسوم ترخيص إضافية، مما يسمح لفرق الأمان بإنشاء عمليات سير عمل آلية باستخدام واجهة سهلة الاستخدام وقوالب مسبقة الصنع. المنصة الرسم البياني للمؤسسة يدمج بيانات القياس عن بُعد من نقاط النهاية والهويات والخدمات السحابية وأدوات SaaS وأنظمة الطرف الثالث، مما يجعل جميع الإشارات قابلة للتنفيذ في الوقت الفعلي.

ال عامل تحويل البيانات يضمن تناسق البيانات عبر أدوات الطرف الثالث المختلفة، مما يزيل مشكلات التنسيق التي قد تعطل التشغيل الآلي. يتكامل CrowdStrike بشكل مباشر مع أدوات المؤسسة المستخدمة على نطاق واسع مثل ServiceNow لإصدار تذاكر الحوادث و Slack للإشعارات و Jira لإدارة المهام. ال تكامل ميكروسوفت تيمز يوفر وصولاً متميزًا محسّنًا، مما يمكّن المستخدمين من طلب امتيازات مرتفعة وتلقيها مباشرةً داخل Teams. بالإضافة إلى ذلك، فإن تعاون الاستجابة بين الوكالات تتيح الميزة لـ Charlotte AI التفاعل بأمان مع وكلاء الطرف الثالث الموثوق بهم والمحللين البشريين أثناء التحقيقات المعقدة. هذا يضمن الالتزام بـ قاعدة 1-10-60: اكتشاف التهديدات في غضون دقيقة واحدة، والتحقيق في غضون 10 دقائق، وعزلها في غضون 60 دقيقة.

تعمل منصة CrowdStrike على أتمتة مهام الاستجابة للحوادث - مثل اكتشاف التهديدات وعزل نقاط النهاية وإزالة البرامج الضارة - لضمان الامتثال التنظيمي. لقد كسبت شهادة الأيزو 42001، وهو معيار عالمي لحوكمة الذكاء الاصطناعي، مما يعكس تفانيه في ممارسات الذكاء الاصطناعي المسؤولة. تعمل الأتمتة الأمنية على فرض ضوابط السياسة والتحقق من التكوينات في الوقت الفعلي، مع الحفاظ على جاهزية التدقيق وتلبية معايير الامتثال.

تعالج المنصة التحدي المتمثل في إدارة كميات هائلة من بيانات الأمان، والتي تؤثر 62.5% من فرق الأمن. مع حصول المنظمات على متوسط 4500 تنبيه يوميًا، و 30% من هذه الحالات لم يتم التحقيق فيها بسبب الموارد المحدودة، تصبح الأتمتة ضرورية. من خلال التعامل مع المهام الروتينية مثل فرز التنبيهات وربط البيانات، يعمل CrowdStrike على تحسين الاتساق وتقليل الخطأ البشري. يتم توثيق جميع الإجراءات الآلية مع مسارات تدقيق كاملة، مما يضمن الشفافية وتلبية المتطلبات التنظيمية. تعمل إعدادات «الاستقلالية المحدودة» للمنصة على تقييد الوكلاء بحدود محددة مسبقًا، مما يتطلب موافقة بشرية على الإجراءات عالية التأثير التي يمكن أن تؤثر على الأمان أو الامتثال.

سينتينيل الذكاء الاصطناعي الأرجواني تنقل المنصة الأتمتة إلى المستوى التالي من خلال إدارة مهام الأمان المعقدة بشكل مستقل. إنها التفرد: التشغيل الآلي الفائق يعمل المحرك على تحويل رؤى الذكاء الاصطناعي إلى عمليات سير عمل قابلة للتنفيذ، مما يتيح الاستجابات في الوقت الفعلي مثل عزل نقاط النهاية المخترقة أو إلغاء وصول المستخدم - بدون استخدام اليدين تمامًا. يعمل هذا النهج الموحد على تبسيط عمليات الكشف والاستجابة والامتثال.

ال إطار وكيل الذكاء الاصطناعي الأرجواني يحاكي عملية صنع القرار لمحللي SOC المخضرمين، ويقوم تلقائيًا بفرز التهديدات والتحقيق فيها والاستجابة لها. وتقوم بإجراء تحقيقات متعددة الخطوات من خلال تحليل سجلات الأجهزة وسلوك المستخدم ونشاط الشبكة لإنشاء سرد مفصل للحوادث قبل اقتراح الاستجابات. إنها تحليل التشابه بالذكاء الاصطناعي يستفيد من تريليونات من نقاط البيانات والذكاء العالمي لتقييم ما إذا كانت التنبيهات حقيقية، مما يسمح لفرق الأمن بالتركيز على المخاطر الفعلية.

تم تسليط الضوء على قدرات SentinelOne في تقييم مؤسسة MITRE Engenuity ATT&CK لعام 2024، حيث حققت اكتشاف بنسبة 100٪ بدون أي تأخير. تشير المنظمات التي تستخدم Purple AI إلى زيادة الإنتاجية السنوية بمقدار 435,000 دولار، بينما تعمل المنصة على تقليل التنبيهات الخاطئة بنسبة 88% مقارنة بمعايير الصناعة، مما يخفف بشكل كبير من التعب الناتج عن التنبيه. يلخص الرئيس التنفيذي تومر وينجارتن هذه الرؤية:

«في SentinelOne، نعتقد أن الذكاء الاصطناعي يجب أن يفعل أكثر من مجرد مساعدة الفرق الأمنية - يجب أن يكون بمثابة امتداد لكل محلل ومنطق ويتصرف كمدافع بشري متمرس.»

ال التفرد: التشغيل الآلي الفائق تقدم المنصة أكثر من 100 عملية تكامل مُنشأة مسبقًا وأداة السحب والإسقاط بدون تعليمات برمجية لإنشاء عمليات سير عمل مخصصة دون معرفة البرمجة. باستخدام إطار مخطط الأمن السيبراني المفتوح (OCSF)، يقوم بتوحيد البيانات عند الاستيعاب، مما يتيح استعلامات سلسة عبر الأنظمة الأصلية وأنظمة الطرف الثالث دون الحاجة إلى التخطيط اليدوي. يمكن لفرق الأمان دمج الأدوات الحالية، مثل Splunk أو بحيرات البيانات التابعة لجهات خارجية، مع Purple AI، وتطبيق قدراتها المنطقية عبر جميع مصادر البيانات دون الحاجة إلى عمليات ترحيل مكلفة. بالإضافة إلى ذلك، فإن التفرد والذكاء الاصطناعي SIEM ينص 10 غيغابايت من استيعاب البيانات اليومي - من مصادر الطرف الأول والطرف الثالث - دون أي تكلفة إضافية، مما يجعلها في متناول المؤسسات من مختلف الأحجام.

يضمن إطار التكامل القوي هذا أن منصة SentinelOne ليست فعالة فحسب، بل قابلة للتكيف أيضًا مع النظم البيئية الأمنية المتنوعة.

تحافظ شركة Purple AI على مسار تدقيق ثابت لكل إجراء، مما يضمن الإثبات التنظيمي والمساءلة. تنتج ميزات مثل الإبلاغ التلقائي والتحقيقات التلقائية ملخصات مفصلة للحوادث لأغراض الامتثال. تتضمن المنصة أيضًا حوكمة «الإنسان في حلقة مفرغة»، مما يسمح للمحللين بالتحقق من إجراءات الذكاء الاصطناعي وتحويلها إلى تدفقات عمل محكومة لاستخدامها في المستقبل. يضمن هذا التوازن بين الأتمتة والإشراف الاتساق أثناء عمليات التدقيق مع التكيف مع احتياجات الامتثال المحددة.

كما يعطي SentinelOne الأولوية لأمن البيانات، حيث لم يتم تدريب نماذج الذكاء الاصطناعي مطلقًا على بيانات المستخدم. إنها الأمان الفوري تفرض الميزة ضوابط السياسة الآلية، وتدعم أكثر 15,000 موقع للذكاء الاصطناعي لاكتشاف مخاطر الذكاء الاصطناعي في الظل والتخفيف من حدتها. توفر هذه الإجراءات معًا حلاً آمنًا وشاملًا لإدارة تدفقات العمل الآلية مع تلبية المعايير التنظيمية الصارمة.

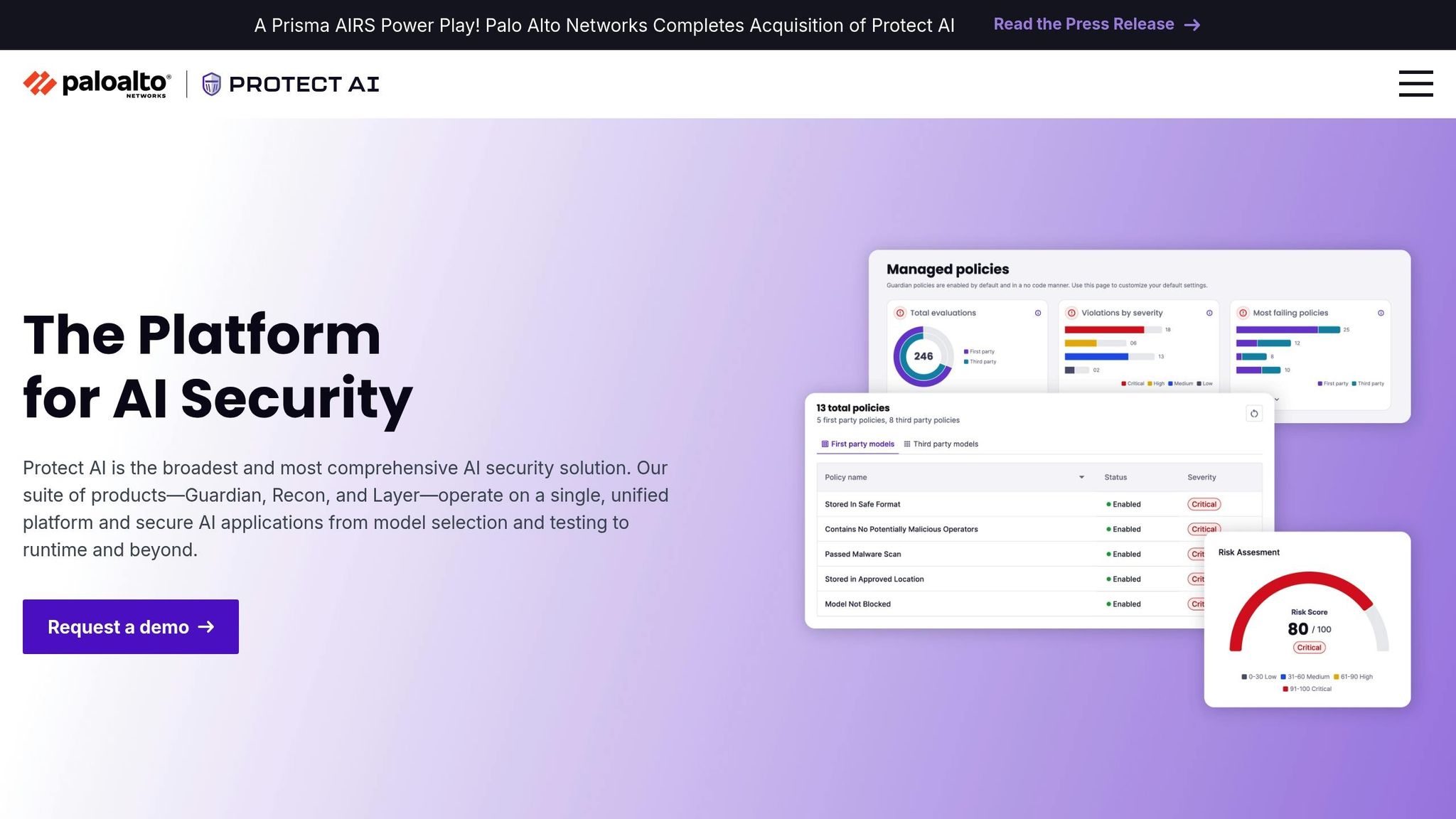

في عالم أمن الذكاء الاصطناعي المتغير باستمرار، تبرز منصة Protect AI Guardian من خلال التركيز على حماية سلامة نماذج الذكاء الاصطناعي. على عكس أدوات الأمان التقليدية التي تركز على البنية التحتية، تركز Guardian على ملفات النماذج التي تقود عمليات سير العمل الآلية. بحلول أبريل 2025، كانت المنصة قد فحصت بالفعل 4 ملايين موديل، بما في ذلك أكثر من 1.5 مليون من مستودع Huging Face. تضع قدرة المسح الشاملة هذه الأساس للكشف المتقدم عن التهديدات بالذكاء الاصطناعي.

تدعم الجارديان أكثر من 35 صيغة نموذجية، مثل PyTorch وTensorFlow وONNX وPickle وGGUF وSafetensors، حيث يقومون تلقائيًا بالبحث عن الثغرات الأمنية قبل نشر النماذج. إنه يستهدف تهديدات مثل هجمات إلغاء التسلسل والأبواب الخلفية المعمارية ونقاط الضعف في وقت التشغيل - القضايا التي غالبًا ما تغفلها الأدوات التقليدية. يتم تشغيل هذا الاكتشاف القوي بواسطة صياد، وهي شبكة عالمية تضم أكثر من 17,000 باحث أمني يقومون باستمرار بتحديد نقاط الضعف الخاصة بالذكاء الاصطناعي والإبلاغ عنها، مما يثري محرك المسح الخاص بـ Guardian.

«تقدم Guardian أكبر وأعمق مجموعة من الماسحات الضوئية النموذجية في السوق - تحدد إلغاء التسلسل والأبواب الخلفية المعمارية وتهديدات وقت التشغيل عبر جميع تنسيقات النماذج الرئيسية.» - Protect AI

من خلال تعاونها مع Huging Face، تضمن Guardian فحص النماذج مفتوحة المصدر وتأمينها قبل أن تقوم المؤسسات بدمجها، مما يمنع النماذج المخترقة بشكل فعال من دخول خطوط أنابيب CI/CD.

تسمح Guardian للمنظمات بالتأسيس سياسات أمان قابلة للتخصيص لكل من طرازات الطرف الأول والطرف الثالث. يمكن لفرق الأمان تحديد قواعد تفصيلية حول البيانات الوصفية للنموذج والتنسيقات المعتمدة والمصادر الموثوقة لضمان استخدام النماذج المعتمدة فقط في الإنتاج. تحافظ المنصة أيضًا على مسار التدقيق المركزي، وتوثيق كل تقييم نموذجي للمساعدة في الامتثال التنظيمي والتدقيق الداخلي.

من خلال فرض التنسيقات الآمنة مثل Safetensors وتقييد التنسيقات عالية المخاطر مثل Pickle، تخفف Guardian من مخاطر هجمات إلغاء التسلسل. تتسم هذه السياسات بالمرونة الكافية لاستيعاب مستويات المخاطر المختلفة عبر الفرق مع الحفاظ على ممارسات الأمان المتسقة والاندماج بسلاسة في عمليات سير العمل الحالية.

تم تصميم Guardian لتتناسب بسهولة مع عمليات سير العمل الحالية، وتقدم خيارات التكامل عبر CLI أو SDK أو حاوية Docker خفيفة الوزن. وهو يدعم مجموعة واسعة من مصادر النماذج، بما في ذلك سجل نماذج MLFlow وأمازون S3 وأمازون سيج ميكر ومستودعات Artifactory وGit، مما يسمح لفرق الأمن بتنفيذ مسح النماذج دون تعطيل عمليات التطوير الحالية أو الحاجة إلى تغييرات كبيرة في البنية التحتية.

«تتكامل Guardian بسلاسة مع خطوط أنابيب الذكاء الاصطناعي الحالية وسير عمل DevOps والمستودعات وبيئات البحث.» - Protect AI

بالنسبة للمؤسسات التي تحتاج إلى تحكم إضافي، يمكن نشر Local Scanner محليًا، مما يتيح المسح الآمن للملكية الفكرية الحساسة. يوفر هذا الإعداد ملاحظات فورية أثناء التطوير، مما يساعد الفرق على معالجة الثغرات الأمنية مبكرًا وليس بعد النشر.

مقارنة منصات أمان الذكاء الاصطناعي: الميزات والقدرات الرئيسية

يسلط تحليل منصات أمان الذكاء الاصطناعي الضوء على أهمية الحماية القوية لأتمتة سير العمل. نظرًا لأن المؤسسات تدير ما معدله 4500 تنبيه يوميًا وتواجه تكاليف خرق البيانات التي تبلغ حوالي 4.88 مليون دولار، فإن اتخاذ تدابير أمنية فعالة أصبح أكثر أهمية من أي وقت مضى.

في ما يلي تفصيل لميزات الأمان الرئيسية التي تقدمها Prompts.ai، والتي تعرض كيف تحمي عمليات سير العمل القائمة على الذكاء الاصطناعي عبر أربعة مجالات مهمة: اكتشاف التهديدات المستند إلى الذكاء الاصطناعي، ضوابط الحوكمة، قدرات التكامل، و دعم الامتثال.

اكتشاف التهديدات المستند إلى الذكاء الاصطناعي

يفحص Prompts.ai بعناية كل مطالبة واستجابة لـ GenAI لاكتشاف التهديدات وحظرها مثل هجمات الحقن الفوري وتسرب البيانات والمحتوى غير المناسب. يضمن هذا المستوى من الأمان الخاص بالمطالبة إيقاف المخاطر المحتملة قبل أن تتمكن من تعطيل سير العمل أو اختراق البيانات الحساسة.

ضوابط الحوكمة

توفر المنصة لفرق القيادة رؤية مركزية لجميع تفاعلات الذكاء الاصطناعي داخل المنظمة. تساعد هذه الشفافية على تقليل مخاطر الذكاء الاصطناعي في الظل وتضمن توافق استخدام الذكاء الاصطناعي مع السياسات المعمول بها، مما يجعل العمليات آمنة وخاضعة للمساءلة.

قدرات التكامل

يبسط Prompts.ai إدارة الأمان من خلال توحيد مراقبة جميع مطالبات واستجابات GenAI في واجهة واحدة. هذا يلغي الحاجة إلى التوفيق بين أدوات متعددة أو مفاتيح API، مما يضمن تطبيق الأمان المتسق دون التدخل في عمليات سير العمل الحالية.

دعم الامتثال

يوفر Prompts.ai، المصمم لتلبية احتياجات المؤسسة، ميزات مثل مسارات التدقيق التفصيلية، وضوابط التكلفة في الوقت الفعلي لإعداد التقارير التنظيمية، وإجراءات معالجة البيانات القوية. تساعد هذه الأدوات على ضمان بقاء عمليات سير العمل ضمن الحدود التنظيمية والتنظيمية، مما يجعلها جاهزة للتدقيق ومتوافقة.

يتطلب ضمان التشغيل الآلي الآمن لسير العمل المستند إلى الذكاء الاصطناعي دمج تدابير الأمان في كل مرحلة من مراحل دورة حياة الذكاء الاصطناعي. يتضمن ذلك ميزات مثل التصفية على المستوى الفوري والمراقبة السلوكية والحوكمة الفعالة ودمج الرقابة البشرية. مع التوسع السريع في استخدام الذكاء الاصطناعي، لم يعد التعامل مع أمن الذكاء الاصطناعي كفكرة لاحقة خيارًا للمؤسسات.

عند اختيار منصة، ركز على حماية وقت التشغيل بدلا من الاعتماد فقط على إدارة الوضعية. يمكن للأدوات التي تمنع التهديدات في الوقت الفعلي - مثل تلك التي تمنع الحقن الفوري أو تسرب البيانات - إيقاف المشكلات قبل تفاقمها. بالإضافة إلى ذلك، تعد معالجة مخاطر الذكاء الاصطناعي الخفية أمرًا بالغ الأهمية، كما أوضح أكثر من ثلث قادة المؤسسات. اختر الحلول التي توفر الإشراف المركزي على جميع أنشطة الذكاء الاصطناعي وفرض الحوكمة دون تعطيل سير العمل الحالي.

اختبار وضع الظل هو استراتيجية حيوية أخرى. يسمح للمؤسسات بالتحقق من صحة توصيات الذكاء الاصطناعي من خلال المراجعة البشرية قبل التشغيل الآلي الكامل للعمليات. كما توضح سريهارشا دوغا، رئيسة الدفاع الإلكتروني في شركة Abnormal AI:

«يقوم الذكاء الاصطناعي بصياغة السياق والجداول الزمنية والاقتراحات. يقرر البشر الإجراءات».

يقلل هذا النهج التعاوني أوقات المراجعة بشكل كبير - من 15-20 دقيقة إلى 3-4 دقائق فقط - مع ضمان المساءلة عن القرارات الحاسمة. من خلال اعتماد مثل هذه التدابير الاستباقية، يمكن للشركات الحفاظ على النزاهة التشغيلية وحماية نفسها من المخاطر المالية الرئيسية.

تجلب أتمتة سير العمل القائمة على الذكاء الاصطناعي مجموعة من التحديات الأمنية، بما في ذلك خروقات البيانات، التلاعب بالنموذج، و نقاط ضعف النظام. قد تحدث انتهاكات البيانات عندما يتم الكشف عن معلومات حساسة عن طريق الخطأ أثناء العمليات الآلية، مما يترك البيانات السرية عرضة للخطر. وفي الوقت نفسه، يمكن للتلاعب بالنماذج - مثل تغذية المدخلات العدائية - أن يخدع أنظمة الذكاء الاصطناعي لاتخاذ قرارات معيبة، مما قد يتسبب في اضطرابات سير العمل.

يمكن أن تعمل الثغرات الأمنية في النظام، مثل التكوينات الخاطئة أو عمليات تكامل API غير الآمنة، كبوابات للهجمات الضارة. إن الطبيعة المعقدة لأنظمة الذكاء الاصطناعي تجعلها عرضة لتهديدات مثل تسمم البيانات أو الوصول غير المصرح به. ولمعالجة هذه المخاطر، يجب على المؤسسات تنفيذ تدابير أمنية قوية، مثل التشفير وإدارة الهوية واكتشاف الأخطاء والمراقبة المستمرة. تساعد هذه الممارسات على ضمان بقاء عمليات سير عمل الذكاء الاصطناعي آمنة ويمكن الاعتماد عليها.

يجمع Prompts.ai أكثر من 35 نموذجًا للذكاء الاصطناعي داخل منصة مركزية، ويقدم أمان على مستوى المؤسسة لتلبية احتياجات الامتثال والحوكمة الخاصة بك. وتشمل ميزاته البارزة اكتشاف التهديدات في الوقت الفعلي، ومنع تسرب البيانات، وفحوصات الامتثال الآلية، ومسارات التدقيق الشاملة.

مصممة لتتماشى مع اللوائح الرائدة مثل GDPR، هيبا، سوك 2، أيزو 27001، و قانون الاتحاد الأوروبي للذكاء الاصطناعي، تساعد المنصة الشركات في الحفاظ على الأمان والامتثال مع تبسيط سير العمل الآلي.

يحمي Prompts.ai من هجمات الحقن الفوري من خلال استخدام نماذج الذكاء الاصطناعي المتقدمة مثل Anthropic Pro/Max و Opus 4.5. تم تصميم هذه النماذج خصيصًا لمعالجة مدخلات اللغة الطبيعية مع التركيز على الأمان والموثوقية.

لتعزيز الحماية بشكل أكبر، تستخدم Prompts.ai استراتيجيات الدفاع المتعمقة، ووضع تدابير أمنية متعددة للحد من المخاطر في معالجة اللغات الطبيعية. يضمن هذا المزيج من تصميم النموذج القوي والضمانات الاستباقية أن تظل عمليات سير العمل الآلية آمنة ومقاومة للتهديدات المحتملة.