सही भाषा मॉडल मूल्यांकन उपकरण चुनने से समय की बचत हो सकती है, लागत कम हो सकती है और दक्षता बढ़ सकती है। चाहे आप AI वर्कफ़्लो का प्रबंधन कर रहे हों, मॉडल की तुलना कर रहे हों, या बजट को अनुकूलित कर रहे हों, सर्वोत्तम टूल का चयन करना आवश्यक है। यहां चार प्रमुख विकल्पों का त्वरित अवलोकन दिया गया है:

त्वरित तुलना

प्रत्येक टूल आपकी तकनीकी विशेषज्ञता और वर्कफ़्लो आवश्यकताओं के आधार पर अद्वितीय लाभ प्रदान करता है। यह देखने के लिए गहराई से देखें कि ये टूल आपकी AI रणनीति में कैसे फिट हो सकते हैं।

AI भाषा मॉडल मूल्यांकन उपकरण तुलना चार्ट

Prompts.ai एक साथ पहुंच लाता है 35 से अधिक शीर्ष स्तरीय भाषा मॉडल एक सुव्यवस्थित कार्यक्षेत्र में इनमें OpenAI का GPT-4o और GPT-5 शामिल हैं, एंथ्रोपिकक्लाउड, गूगल जेमिनी, मेटालामा है, और विकलता सोनार। बस एक क्लिक के साथ, टीमें मॉडल के बीच स्विच कर सकती हैं, जिससे सीधी तुलना की जा सकती है। उदाहरण के लिए, कई मॉडलों में एक ही प्रॉम्प्ट चलाने से यूज़र यह मूल्यांकन कर सकते हैं कि ग्राहक सहायता या सामग्री निर्माण जैसे कार्यों के लिए कौन सबसे अच्छा टोन, कम त्रुटियां या तेज़ प्रतिक्रियाएँ देता है। सहायता वर्कफ़्लो के लिए GPT‑4o, Claude 4, और Gemini 2.5 का परीक्षण करने वाले US-आधारित SaaS स्टार्टअप की कल्पना करें। वे विक्रेता लॉक-इन से बचते हुए जल्दी से यह निर्धारित कर सकते हैं कि कौन सा मॉडल गुणवत्ता, API विश्वसनीयता और डेटा रेजीडेंसी के बीच सही संतुलन बनाता है।

Prompts.ai विस्तृत प्रदर्शन ट्रैकिंग की पेशकश करके पहुंच से परे चला जाता है। प्लेटफ़ॉर्म मॉनिटर करता है प्रतिक्रिया की गुणवत्ता, विलंबता, और त्रुटि दर प्रत्येक मॉडल के लिए जब समान प्रॉम्प्ट सेट का उपयोग किया जाता है। यह पुन: प्रयोज्य प्रॉम्प्ट लाइब्रेरी, A/B परीक्षण और कस्टम मेट्रिक्स के साथ एकीकृत समेकित परिणामों के माध्यम से व्यावहारिक परीक्षण का भी समर्थन करता है। उदाहरण के लिए, एक अमेरिकी ई-कॉमर्स कंपनी ने 200-प्रॉम्प्ट टेस्ट सेट बनाया, जिसमें रिटर्न नीतियों के बारे में पूछताछ, MM/DD/YYYY तारीखों के साथ अमेरिकी मापों में शिपिंग गणना और टोन-सेंसिटिव प्रतिक्रियाओं के बारे में पूछताछ शामिल है। इन परीक्षणों को विभिन्न मॉडलों पर मासिक रूप से चलाकर, वे मानव रेटिंग (1—5), कंपनी की नीतियों का अनुपालन, और प्रति प्रतिक्रिया औसत टोकन जैसे मेट्रिक्स को ट्रैक करते हैं। इससे उन्हें प्रत्येक तिमाही में सबसे अच्छा प्रदर्शन करने वाले मॉडल को अपने डिफ़ॉल्ट के रूप में चुनने में मदद मिलती है।

Prompts.ai टीमों को सक्षम करके लागत प्रबंधन को सरल बनाता है मॉडल और विक्रेताओं के बीच तेजी से स्विच करें, जिससे अधिक किफायती विकल्पों के साथ प्रयोग करना आसान हो जाता है। उदाहरण के लिए, टीमें Google Gemini जैसे छोटे, कम खर्चीले मॉडल की तुलना GPT-5 या Claude 4 जैसे प्रीमियम मॉडल से कर सकती हैं, जो लागत के मुकाबले गुणवत्ता के अंतर को मापते हैं। प्लेटफ़ॉर्म प्रति आउटपुट औसत टोकन लॉग करता है और USD टोकन की कीमतों (जैसे, प्रति 1,000 या 1,000,000 टोकन) की सीधी तुलना करने की अनुमति देता है, जिससे टीमों को प्रति अनुरोध और मासिक खर्चों की लागत का अनुमान लगाने में मदद मिलती है। उदाहरण के तौर पर, एक अमेरिकी एजेंसी ने एक मिड-टियर मॉडल खोजा, जिसने गुणवत्ता का त्याग किए बिना लागत को 40% प्रति ब्लॉग पोस्ट कम कर दिया। Prompts.ai अमेरिका के परिचालन बजट और मानकों के अनुरूप एकीकृत पहुंच और संसाधन पूलिंग के माध्यम से AI की लागत को 98% तक कम करने का दावा करता है।

Prompts.ai मौजूदा AI वर्कफ़्लो में मूल रूप से एकीकृत हो जाता है, जो एक नो-कोड लेयर के रूप में कार्य करता है जो कई मॉडल API को जोड़ता है। हालांकि तकनीकी टीमें अभी भी औपचारिक बेंचमार्क के लिए OpenAI Evals या Hugging Face जैसे टूल का उपयोग कर सकती हैं, Prompts.ai संकेतों को प्रबंधित करने, आउटपुट की तुलना करने और गैर-तकनीकी हितधारकों को मॉडल चयन में भाग लेने में सक्षम बनाने में उत्कृष्टता प्राप्त करता है। यह लोकप्रिय उत्पादकता टूल के साथ भी एकीकृत होता है, जो AI आउटपुट से सीधे वर्कफ़्लो को सुव्यवस्थित करता है। उदाहरण के लिए, यूएस-आधारित फिनटेक टीम खोजपूर्ण प्रॉम्प्ट डिज़ाइन, मॉडल तुलना और हितधारक समीक्षाओं जैसे कार्यों के लिए Prompts.ai का उपयोग करती है। वे अपने कोड और CI पाइपलाइनों के भीतर स्वचालित, विनियमित परीक्षण बनाए रखते हैं लेकिन सहयोगात्मक कार्य के लिए Prompts.ai पर भरोसा करते हैं। जीतने के संकेत और मॉडल चयन API या कॉन्फ़िगरेशन फ़ाइलों के माध्यम से उनके सिस्टम में वापस निर्यात किए जाते हैं, जिससे अनुपालन और सुरक्षित एकीकरण सुनिश्चित होता है - जो अमेरिका स्थित परिचालनों के लिए महत्वपूर्ण है।

OpenAI Eval Framework मुख्य रूप से OpenAI के मालिकाना मॉडल, जैसे GPT-4 और GPT-4.5 का आकलन करने पर केंद्रित है। जबकि विशेष रूप से OpenAI की पेशकशों के लिए तैयार किया गया है, यह एक मानकीकृत दृष्टिकोण का उपयोग करता है जो MMLU और GSM8K जैसे बेंचमार्क डेटासेट का उपयोग करता है, साथ ही 5-शॉट प्रॉम्प्टिंग प्रोटोकॉल का उपयोग करता है, ताकि सुसंगत और प्रत्यक्ष तुलना सुनिश्चित की जा सके। ये विधियाँ मॉडल के प्रदर्शन और व्यवहार को समझने के लिए एक संरचित तरीका प्रदान करती हैं।

बुनियादी सटीकता से परे, फ्रेमवर्क प्रदर्शन आयामों की एक श्रृंखला का मूल्यांकन करता है, जिसमें अंशांकन, मजबूती, पूर्वाग्रह, विषाक्तता और दक्षता शामिल है। कैलिब्रेशन यह सुनिश्चित करता है कि मॉडल का आत्मविश्वास उसकी वास्तविक सटीकता के अनुरूप हो, जबकि मजबूती इस बात का परीक्षण करती है कि वह टाइपो या बोली में बदलाव जैसी चुनौतियों को कितनी अच्छी तरह संभालती है। “LLM-as-a-Judge” पद्धति एक उल्लेखनीय अतिरिक्त है, जहाँ GPT-4 जैसे उन्नत मॉडल मानव मूल्यांकन का अनुमान लगाने के लिए 1-10 के पैमाने पर ओपन-एंडेड प्रतिक्रियाएँ देते हैं। स्टैनफोर्ड के शोधकर्ताओं ने फ्रेमवर्क की स्केलेबिलिटी का प्रदर्शन किया है, इसे 22 डेटासेट और 172 मॉडल पर लागू किया है।

फ्रेमवर्क में बेंचमार्क लागत में 50-80% की कटौती करने के लिए आइटम रिस्पांस थ्योरी (IRT) विधियों को शामिल किया गया है। संपूर्ण परीक्षण सूट चलाने के बजाय, अनुकूली परीक्षण कठिनाई के आधार पर प्रश्नों का चयन करता है, जिससे समय और API दोनों खर्चों की बचत होती है। कड़े बजट पर काम करने वाली अमेरिकी टीमों के लिए, यह दृष्टिकोण मूल्यांकन के दौरान टोकन के उपयोग को काफी कम करता है। टोकन की लागत व्यापक रूप से भिन्न होती है, जेम्मा 3n E4B जैसे मॉडल के लिए $0.03 प्रति 1M टोकन से लेकर GPT-4.5 जैसे प्रीमियम मॉडल के लिए $150 प्रति 1M टोकन तक। अनुकूली परीक्षण को अपनाकर, मॉडल प्रदर्शन में विश्वसनीय अंतर्दृष्टि बनाए रखते हुए टीमें सार्थक लागत में कटौती कर सकती हैं।

फ्रेमवर्क निर्बाध एकीकरण का समर्थन करता है, जो लैंगचैन जैसे उपकरणों के साथ एक-लाइन एसडीके परिनियोजन की पेशकश करता है। इसके REST API भाषा-अज्ञेय कार्यान्वयन को सक्षम करते हैं, जिससे Python, JavaScript, या अन्य प्रोग्रामिंग वातावरण का उपयोग करने वाली टीमों के लिए फ्रेमवर्क को अपने वर्कफ़्लो में शामिल करना आसान हो जाता है। इसके अतिरिक्त, लैंगस्मिथ, गैलीलियो और लैंगफ्यूज जैसे अवलोकन प्लेटफ़ॉर्म OpenAI द्वारा संचालित प्रक्रियाओं के लिए विस्तृत निगरानी प्रदान करते हैं, जिसमें ट्रेसिंग, लागत ट्रैकिंग और विलंबता विश्लेषण शामिल हैं। स्वचालित गुणवत्ता स्कोरिंग के लिए एक साझा मानक स्थापित करते हुए, “एलएलएम-एज़-ए-जज” पद्धति ने अन्य मूल्यांकन उपकरणों के बीच भी ध्यान आकर्षित किया है। अमेरिकी टीमों के लिए, विकास की शुरुआत में ऑब्जर्वेबिलिटी एसडीके को एकीकृत करने से उत्पादन को प्रभावित करने से पहले रिग्रेशन या मतिभ्रम जैसे मुद्दों की पहचान करने में मदद मिल सकती है।

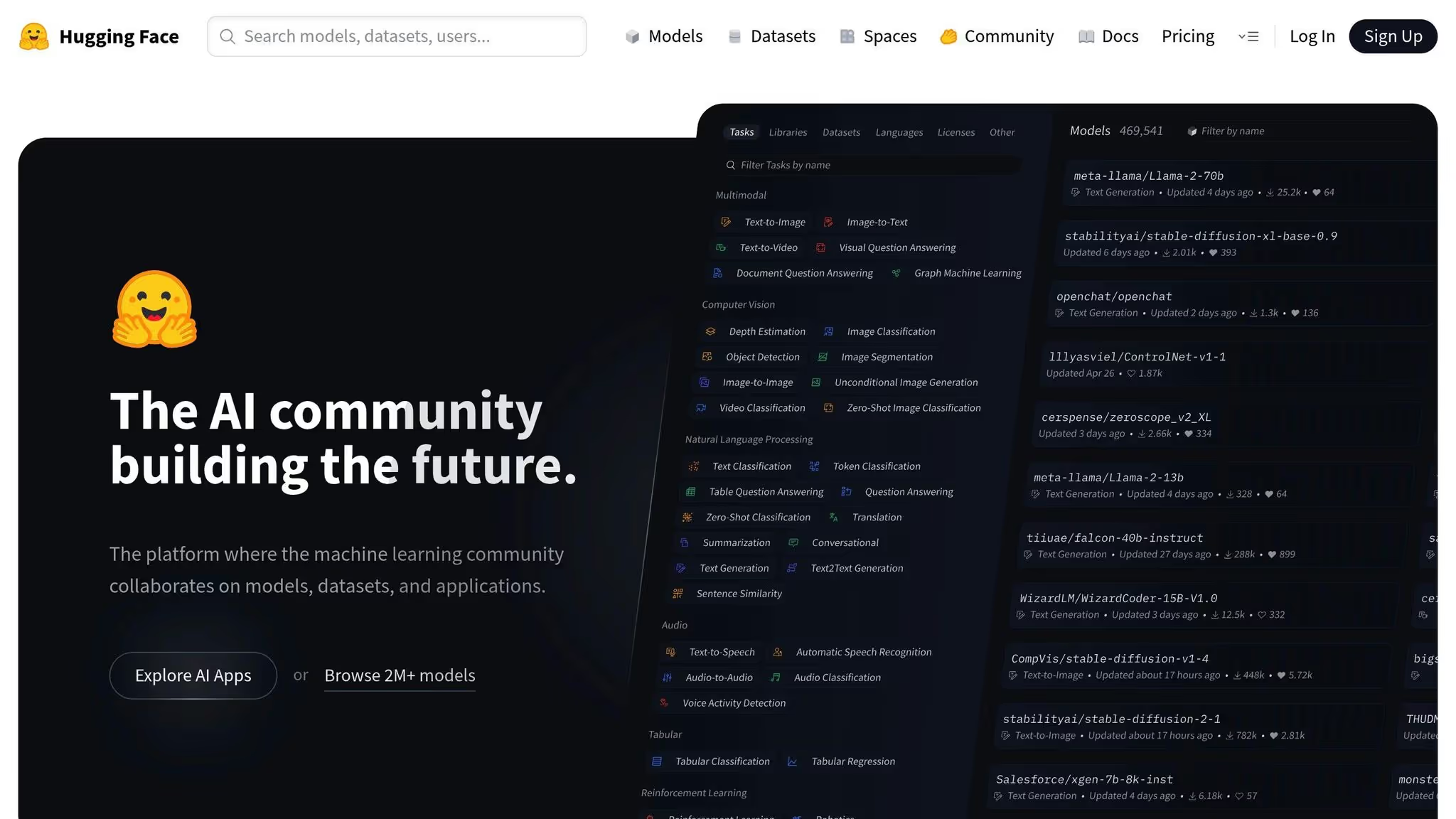

हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी एआई मूल्यांकन उपकरणों की दुनिया में एक असाधारण संसाधन है, जिसका श्रेय ओपन-वेट मॉडल के व्यापक इकोसिस्टम को जाता है।

ओपन-वेट मॉडल के हब के रूप में, हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी सिंगल-प्रोवाइडर प्लेटफॉर्म की तुलना में कहीं अधिक प्रकार के आर्किटेक्चर प्रदान करती है। यह प्रमुख वैश्विक प्रयोगशालाओं द्वारा विकसित मॉडलों की एक विस्तृत श्रृंखला का समर्थन करता है, जिसमें मेटा का लामा, गूगल का जेम्मा, अलीबाबा का क्वेन शामिल हैं, मिस्ट्रल ए. आई।, और डीप सीक। इसमें विशिष्ट मॉडल शामिल हैं जैसे Qwen2.5-कोडर कोडिंग कार्यों के लिए, लामा 3.2 विज़न छवि विश्लेषण के लिए, और लामा 4 स्काउट, जो 10 मिलियन टोकन तक की क्षमता के साथ लंबे संदर्भ वाले तर्क में उत्कृष्ट है। रीयल-टाइम वेब एक्सेस पर निर्भर टूल के विपरीत, हगिंग फेस वास्तविक मॉडल वेट प्रदान करता है, जिससे स्थानीय परिनियोजन या कस्टम इंटीग्रेशन सक्षम होते हैं। मॉडलों का यह विशाल चयन कठोर प्रदर्शन मूल्यांकन के लिए एक ठोस आधार सुनिश्चित करता है।

हगिंग फेस इसके माध्यम से पारदर्शिता और तुलनीयता को बढ़ाता है एलएलएम लीडरबोर्ड खोलें, जो मानकीकृत बेंचमार्क से प्रदर्शन डेटा संकलित करता है। मॉडल का मूल्यांकन कार्य-विशिष्ट मेट्रिक्स का उपयोग करके किया जाता है, जैसे:

अतिरिक्त बेंचमार्क, जिनमें शामिल हैं विनो ग्रांडे और मानवता की आखिरी परीक्षा, गणितीय समस्या-समाधान से लेकर तार्किक तर्क तक के कार्यों पर परीक्षण मॉडल। ये मेट्रिक्स प्रत्येक मॉडल की क्षमताओं के बारे में एक व्यापक दृष्टिकोण प्रदान करते हैं।

हगिंग फेस के माध्यम से उपलब्ध ओपन-वेट मॉडल महत्वपूर्ण लागत लाभ के साथ आते हैं। वे प्रतिस्पर्धी टोकन मूल्य निर्धारण और प्रभावशाली प्रोसेसिंग गति प्रदान करते हैं। उदाहरण के लिए, जेम्मा 3एन ई4बी बस से शुरू होता है $0.03 प्रति 1 मिलियन टोकन, जबकि लामा 3.2 1B और 3बी मॉडल बड़े पैमाने के कार्यों को संभालने के लिए किफायती विकल्प प्रदान करते हैं।

लाइब्रेरी का मानकीकृत API मॉडल के बीच स्विच करने की प्रक्रिया को सरल बनाता है, जिसके लिए केवल न्यूनतम कोड समायोजन की आवश्यकता होती है। यह लोकप्रिय MLOps प्लेटफ़ॉर्म जैसे लोकप्रिय MLOPS प्लेटफ़ॉर्म के साथ सहज रूप से एकीकृत होता है वज़न और पूर्वाग्रह, एमएलफ्लो, और Neptune.ai, जिससे प्रयोगों को ट्रैक करना और मॉडलों की तुलना करना आसान हो जाता है। मूल्यांकन के लिए, जैसे कि उपकरण गैलीलियो एआई और जाहिर तौर पर AI पूरी तरह से परीक्षण और सत्यापन सक्षम करें। इसके अतिरिक्त, डेवलपर स्थानीय परीक्षण के लिए सीधे हगिंग फेस हब से डेटासेट तक पहुंच सकते हैं, जिससे निजी क्लाउड, ऑन-प्रिमाइसेस सिस्टम या API एंडपॉइंट पर परिनियोजन के लिए लचीलापन सुनिश्चित किया जा सकता है। यह इंटरऑपरेबिलिटी हगिंग फेस को AI अनुप्रयोगों की एक विस्तृत श्रृंखला के लिए एक बहुमुखी और व्यावहारिक विकल्प बनाती है।

मूल्यांकन उपकरणों की हमारी चर्चा के आधार पर, AI लीडरबोर्ड कई बेंचमार्क से प्रदर्शन डेटा संकलित करके व्यापक परिप्रेक्ष्य प्रदान करते हैं। ये प्लेटफ़ॉर्म विभिन्न मॉडलों के प्रदर्शन के बारे में एक समेकित दृष्टिकोण प्रदान करते हैं, जो उनकी ताकत और कमजोरियों को उजागर करते हैं। एकल-उद्देश्य वाले मूल्यांकन टूल के विपरीत, लीडरबोर्ड व्यापक तुलना प्रस्तुत करने के लिए विविध डेटा को एक साथ लाते हैं, जो पहले चर्चा किए गए अधिक केंद्रित आकलनों का पूरक है।

AI लीडरबोर्ड मानकीकृत प्रणालियों के माध्यम से मालिकाना और ओपन-वेट मॉडल के मिश्रण का मूल्यांकन करते हैं। उदाहरण के लिए, आर्टिफिशियल एनालिसिस इंटेलिजेंस इंडेक्स v3.0, जिसे सितंबर 2025 में पेश किया गया था, 10 आयामों में मॉडल की जांच करता है। इनमें तर्क और ज्ञान के लिए MMLU-Pro, वैज्ञानिक तर्क के लिए GPQA डायमंड और प्रतिस्पर्धी गणित के लिए AIME 2025 जैसे टूल शामिल हैं। द वेल्लम एलएलएम लीडरबोर्ड अप्रैल 2024 के बाद लॉन्च किए गए अत्याधुनिक मॉडल पर अपना ध्यान केंद्रित करता है, जो प्रदाताओं के डेटा, स्वतंत्र मूल्यांकन और ओपन-सोर्स योगदान पर निर्भर करता है। इसके अतिरिक्त, आर्टिफिशियल एनालिसिस जैसे प्लेटफ़ॉर्म उपयोगकर्ताओं को उभरते या कस्टम-निर्मित मॉडल को मैन्युअल रूप से इनपुट करने की अनुमति देते हैं, जिससे स्थापित बेंचमार्क के खिलाफ तुलना की जा सकती है।

लीडरबोर्ड विभिन्न आयामों में विस्तृत स्कोर प्रदान करते हैं, जो मॉडल क्षमताओं पर एक संपूर्ण नज़र डालते हैं। मॉडल का मूल्यांकन और रैंक करने के लिए तर्क क्षमता, कोडिंग प्रदर्शन, प्रसंस्करण गति और विश्वसनीयता सूचकांक जैसे मेट्रिक्स का उपयोग किया जाता है। इन तुलनात्मक जानकारियों से टीमों को उन मॉडलों की पहचान करने में मदद मिलती है जो उनकी विशिष्ट ज़रूरतों के अनुरूप होते हैं।

मूल्य निर्धारण पारदर्शिता AI लीडरबोर्ड की एक अन्य प्रमुख विशेषता है, जो टोकन लागत का खुलासा करती है जो $0.03 से लेकर प्रीमियम दरों तक होती है। यह डेटा टीमों को प्रदर्शन और बजट दोनों के आधार पर मॉडल का आकलन करने की अनुमति देता है। उदाहरण के लिए, इंटेलिजेंस बनाम मूल्य विश्लेषण से पता चलता है कि उच्च इंटेलिजेंस हमेशा उच्च मूल्य टैग के साथ नहीं आता है। मॉडल जैसे डीपसीक-v3 $0.27 प्रति इनपुट और $1.10 प्रति आउटपुट प्रति 1 मिलियन टोकन की लागत पर मजबूत तर्क क्षमताओं का प्रदर्शन करें। इस तरह की जानकारी से उन मॉडलों का पता लगाना आसान हो जाता है जो लागत और प्रदर्शन के बीच सही संतुलन बनाते हैं।

निष्पक्ष तुलना सुनिश्चित करने के लिए, लीडरबोर्ड सामान्यीकृत स्कोरिंग सिस्टम का उपयोग करते हैं जो मालिकाना और ओपन-वेट मॉडल दोनों पर काम करते हैं। विशिष्ट बेंचमार्क, जैसे कि कोडिंग कार्य, बहुभाषी तर्क और टर्मिनल प्रदर्शन, मॉडल क्षमताओं की गहरी समझ प्रदान करते हैं। द एलएम एरिना (चैटबोट एरिना) क्राउडसोर्स किए गए ब्लाइंड टेस्ट का उपयोग करके एक अनूठा दृष्टिकोण प्रदान करता है, जहां उपयोगकर्ता मॉडल प्रतिक्रियाओं की तुलना करते हैं। ये परीक्षण मानवीय प्राथमिकताओं के आधार पर एलो रेटिंग उत्पन्न करते हैं, जो वास्तविक दुनिया का परिप्रेक्ष्य प्रदान करते हैं। संयुक्त रूप से, ये सुविधाएं अलग-अलग टूल से प्राप्त अंतर्दृष्टि को बढ़ाती हैं, जिससे AI वर्कफ़्लो को अनुकूलित करने के लिए अधिक संपूर्ण दृश्य पेश किया जाता है।

AI वर्कफ़्लो को अनुकूलित करने के लिए विभिन्न मूल्यांकन उपकरणों के लाभों और कमियों की स्पष्ट समझ की आवश्यकता होती है। यह अनुभाग प्रत्येक टूल के अद्वितीय लाभों और चुनौतियों पर प्रकाश डालता है, जिससे टीमों को उनकी विशिष्ट आवश्यकताओं के आधार पर सूचित निर्णय लेने में मदद मिलती है।

Prompts.ai कस्टम इंटीग्रेशन की आवश्यकता को समाप्त करने वाले एकीकृत इंटरफ़ेस के माध्यम से GPT, क्लाउड, जेमिनी और LLaMa वेरिएंट सहित 35 से अधिक मॉडलों तक अपनी सहज पहुंच के लिए सबसे अलग है। इसकी साथ-साथ तुलना और लागत ट्रैकिंग सुविधाएं त्वरित प्रोटोटाइप को सक्षम करती हैं और बजट दृश्यता में सुधार करती हैं। वर्कफ़्लो दक्षता को बढ़ाते हुए AI की लागत को 98% तक कम करने के दावों के साथ, यह उद्यमों के लिए एक मजबूत दावेदार है। हालांकि, डायरेक्ट क्लाउड बिलिंग के बजाय TOKN क्रेडिट पर इसकी निर्भरता कुछ टीमों के लिए बाधा बन सकती है। इसके अतिरिक्त, जिन संगठनों को अनुपालन उद्देश्यों के लिए सेल्फ-होस्टेड इन्फ्रास्ट्रक्चर की आवश्यकता होती है, उन्हें इसका प्रबंधित दृष्टिकोण प्रतिबंधात्मक लग सकता है।

द ओपनएआई इवल फ्रेमवर्क इंजीनियरिंग टीमों के लिए तैयार किया गया है, जो मानकीकृत, कार्य-विशिष्ट बेंचमार्किंग और पायथन-आधारित CI/CD पाइपलाइनों में सुचारू एकीकरण की पेशकश करती है। यह मॉडल संस्करणों के बीच संक्रमण करते समय स्वचालित गुणवत्ता जांच के लिए इसे एक उत्कृष्ट विकल्प बनाता है। नकारात्मक पक्ष यह है कि यह OpenAI के इकोसिस्टम तक ही सीमित है, जो पर्याप्त अनुकूलन के बिना क्रॉस-वेंडर तुलनाओं के लिए इसकी उपयोगिता को सीमित करता है। इसके अलावा, API उपयोग की लागत समय के साथ बढ़ सकती है।

हगिंग फेस ट्रांसफॉर्मर्स ओपन-सोर्स टूल को प्राथमिकता देने वाली टीमों के लिए बेजोड़ लचीलापन प्रदान करता है। यह PyTorch, TensorFlow, और JAX के साथ संगत एकीकृत API के माध्यम से सैकड़ों मॉडलों का समर्थन करता है, और यह अपनी सेल्फ-होस्टिंग क्षमताओं के कारण स्वास्थ्य देखभाल और वित्त जैसे गोपनीयता-संवेदनशील उद्योगों के लिए विशेष रूप से मूल्यवान है। इसके अतिरिक्त, यह मालिकाना डेटासेट पर फाइन-ट्यूनिंग की अनुमति देता है। हालांकि, इसकी पूरी क्षमता का लाभ उठाने के लिए उन्नत तकनीकी विशेषज्ञता की आवश्यकता होती है, जिसमें पायथन दक्षता और GPU/CPU अनुकूलन कौशल शामिल हैं। टीमों को अपने स्वयं के मॉनिटरिंग डैशबोर्ड भी बनाने होंगे, क्योंकि इसमें अंतर्निहित मूल्यांकन इंटरफ़ेस शामिल नहीं है। जबकि लागत प्रबंधन संभव है, उपयोगकर्ताओं को प्रदर्शन के मुकाबले खर्च को मैन्युअल रूप से ट्रैक करना चाहिए।

AI लीडरबोर्ड और बेंचमार्क कुल मानकीकृत मेट्रिक्स - जैसे कि रीज़निंग स्कोर, कोडिंग क्षमताएं, और अनुमानित मूल्य निर्धारण - कई मॉडलों में, जो उन्हें शुरुआती तुलनाओं के लिए आदर्श बनाते हैं। हालांकि, उनमें इंटरैक्टिव परीक्षण सुविधाओं की कमी है, जिसका अर्थ है कि उपयोगकर्ता डोमेन-विशिष्ट कार्यों के लिए कस्टम प्रॉम्प्ट नहीं चला सकते हैं या परिणामों को मान्य नहीं कर सकते हैं। इसके अतिरिक्त, लीडरबोर्ड हमेशा नवीनतम मॉडल अपडेट को प्रतिबिंबित नहीं कर सकते हैं या अमेरिका में विशिष्ट अनुपालन आवश्यकताओं को पूरा नहीं कर सकते हैं

ये जानकारियां मॉडल मूल्यांकन और चयन में शामिल ट्रेडऑफ़ को उजागर करती हैं। नीचे दी गई तालिका में चर्चा किए गए प्रमुख बिंदुओं को सारांशित किया गया है।

प्रत्येक उपकरण की जांच की गई - से लेकर Prompts.ai एआई लीडरबोर्ड के लिए - विभिन्न परिचालन आवश्यकताओं के अनुरूप, तालिका में अलग-अलग ताकतें लाता है। आपकी टीम के लिए सही भाषा मॉडल मूल्यांकन टूल अंततः आपकी प्राथमिकताओं और तकनीकी विशेषज्ञता के स्तर पर निर्भर करेगा।

Prompts.ai अपनी सरलता और सुलभता के लिए सबसे अलग है, जो पायथन ज्ञान की आवश्यकता के बिना, अंतर्निहित लागत ट्रैकिंग के साथ 35 से अधिक मॉडलों तक तत्काल पहुंच प्रदान करता है। उन टीमों के लिए जो ओपन-सोर्स फ्लेक्सिबिलिटी को महत्व देती हैं और सेल्फ-होस्टिंग पसंद करती हैं, हगिंग फेस ट्रांसफ़ॉर्मर्स लाइब्रेरी विविध मॉडल परिनियोजन के लिए व्यापक सहायता प्रदान करती है। इस बीच, ओपनएआई इवल फ्रेमवर्क स्वचालित CI/CD पाइपलाइनों का प्रबंधन करने वाली पायथन-केंद्रित इंजीनियरिंग टीमों के लिए अच्छी तरह से अनुकूल है। हालाँकि, इसके सिंगल-वेंडर स्कोप के लिए क्रॉस-प्लेटफ़ॉर्म बेंचमार्किंग के लिए अतिरिक्त स्क्रिप्टिंग की आवश्यकता हो सकती है। आपका निर्णय आपकी टीम की तकनीकी क्षमताओं और वर्कफ़्लो की ज़रूरतों के अनुरूप होना चाहिए।

AI लीडरबोर्ड प्रारंभिक शोध के लिए एक बेहतरीन संसाधन हैं, जो कई मॉडलों में स्पष्ट प्रदर्शन तुलना प्रदान करते हैं। इसके अलावा, केवल स्टैटिक मेट्रिक्स आपके विशिष्ट संकेतों और उपयोग के मामलों के अनुरूप हैंड्स-ऑन परीक्षण का विकल्प नहीं ले सकते हैं।

उत्तर अमेरिकी एलएलएम बाजार के 2030 तक 105.5 बिलियन डॉलर तक बढ़ने का अनुमान है, अब सुव्यवस्थित और प्रभावी मूल्यांकन प्रक्रियाओं को स्थापित करने का समय आ गया है।

Prompts.ai कई डिलीवर करता है महत्वपूर्ण फायदे, जैसे कि उद्यमों के लिए बनाई गई शीर्ष स्तरीय सुरक्षा, 35 से अधिक प्रमुख AI मॉडल के साथ सहज एकीकरण, और सुव्यवस्थित वर्कफ़्लो जो AI के खर्चों में 98% तक की कटौती कर सकते हैं। ये खूबियां इसे उन व्यवसायों के लिए एक मजबूत विकल्प के रूप में पेश करती हैं, जो अपनी AI प्रक्रियाओं को सरल बनाने और बढ़ाने का लक्ष्य रखते हैं।

हालांकि, प्लेटफ़ॉर्म मुख्य रूप से एंटरप्राइज़-स्तर के उपयोगकर्ताओं के लिए तैयार है, जो इसे व्यक्तिगत डेवलपर्स या छोटी टीमों के लिए कम उपयुक्त बना सकता है। इसके अतिरिक्त, एक ही प्लेटफ़ॉर्म के भीतर कई मॉडलों को नेविगेट करने और प्रबंधित करने से ऐसे सिस्टम में नए लोगों के लिए सीखने की अवस्था उत्पन्न हो सकती है। इन बातों के बावजूद, Prompts.ai जटिल AI आवश्यकताओं से निपटने वाले संगठनों के लिए एक शक्तिशाली उपकरण के रूप में सामने आता है।

OpenAI Eval फ्रेमवर्क निम्नलिखित द्वारा प्रदर्शन आकलन को सरल बनाता है मूल्यांकन प्रक्रिया को स्वचालित करना, आमतौर पर शामिल मैनुअल काम में काफी कटौती करता है। यह सपोर्ट करता है बैच परीक्षण, कई परिदृश्यों को एक साथ परीक्षण करने में सक्षम बनाता है, जिससे समय और संसाधन दोनों की बचत होती है।

मूल्यांकन प्रक्रिया को और अधिक कुशल बनाकर, यह ढांचा श्रम-गहन कार्यों की आवश्यकता को कम करता है और यह सुनिश्चित करता है कि संसाधनों का प्रभावी ढंग से उपयोग किया जाए, जो भाषा मॉडल को बेंचमार्क करने और तुलना करने का एक व्यावहारिक तरीका प्रदान करता है।

हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी तकनीकी टीमों के लिए एक शीर्ष चयन के रूप में सामने आती है, जो पेशकश करती है एडवांस टूल्स भाषा मॉडल के साथ निर्बाध रूप से काम करने के लिए। यह सक्षम बनाता है बाहरी डेटा स्रोतों के साथ रीयल-टाइम एकीकरण, यह सुनिश्चित करना कि परिणाम वर्तमान और सटीक रहें। लाइब्रेरी में मल्टी-मॉडल एक्सेस, गहन बेंचमार्किंग और प्रदर्शन विश्लेषण जैसी सुविधाएँ भी शामिल हैं, जो इसे अनुसंधान, विकास और मॉडल मूल्यांकन के लिए एक मजबूत विकल्प बनाती हैं।

प्रयोज्यता और कार्यक्षमता दोनों को ध्यान में रखते हुए डिज़ाइन की गई, यह लाइब्रेरी टीमों को सटीकता और विश्वसनीयता के साथ अपने AI उद्देश्यों का समर्थन करते हुए मॉडल की कुशलतापूर्वक तुलना करने और उन्हें ठीक करने की अनुमति देती है।