Les centres de commande basés sur l'IA transforment les opérations des entreprises en centralisant les outils d'IA, en garantissant la conformité et en réduisant les coûts. Si vous naviguez dans le paysage complexe de l'IA, ces plateformes peuvent unifier les flux de travail, renforcer la gouvernance et optimiser les dépenses. Voici ce que vous devez savoir sur les cinq meilleures solutions :

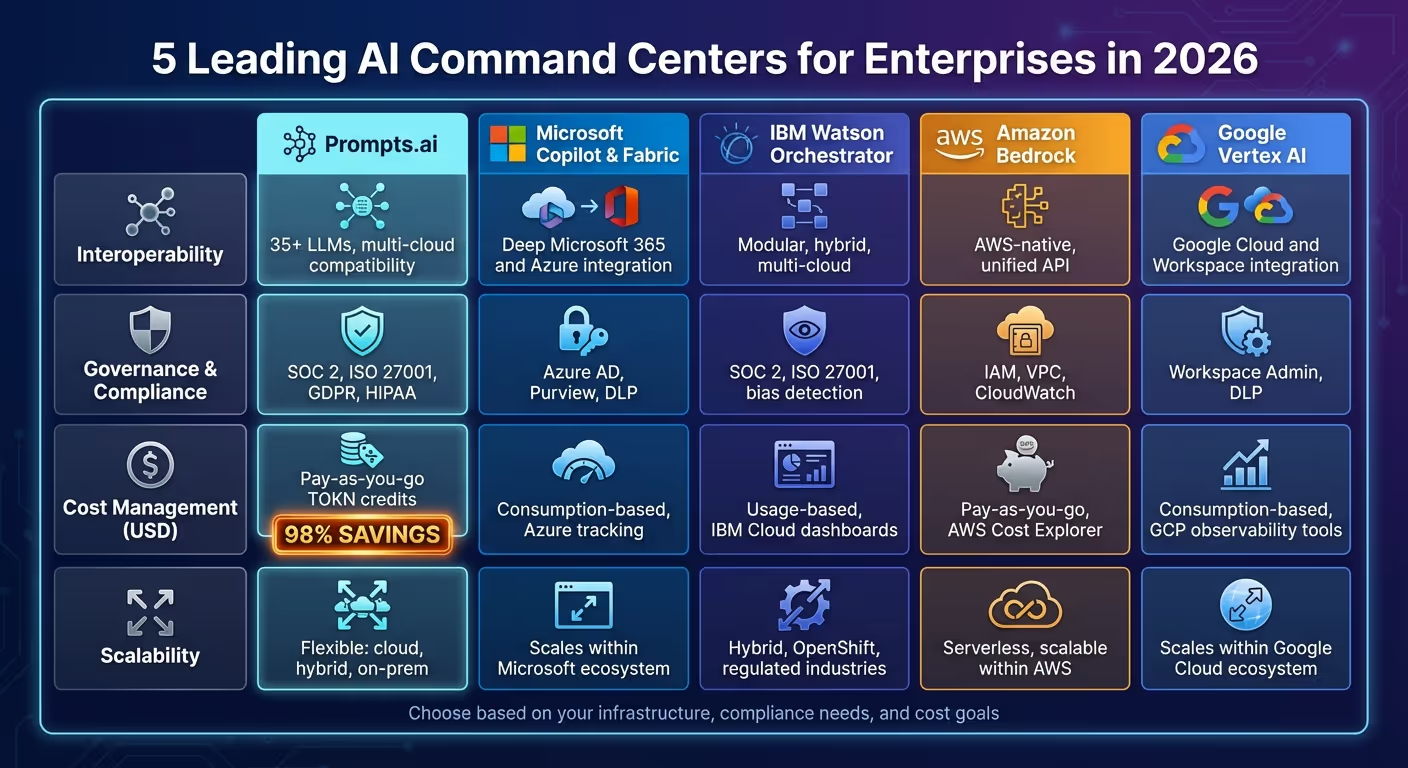

Chaque plateforme présente des atouts uniques en termes d'interopérabilité, de conformité, de gestion des coûts et d'évolutivité. Vous trouverez ci-dessous une comparaison rapide qui vous aidera à choisir celle qui répond aux besoins de votre entreprise.

Prochaines étapes: choisissez une plateforme adaptée à votre infrastructure, à vos besoins en matière de conformité et à vos objectifs de coûts. Concentrez-vous sur la gouvernance, l'évolutivité et la facilité d'intégration pour optimiser l'efficacité de l'IA en 2026.

Centre de commande IA Comparaison des solutions 2026 : fonctionnalités, coûts et évolutivité

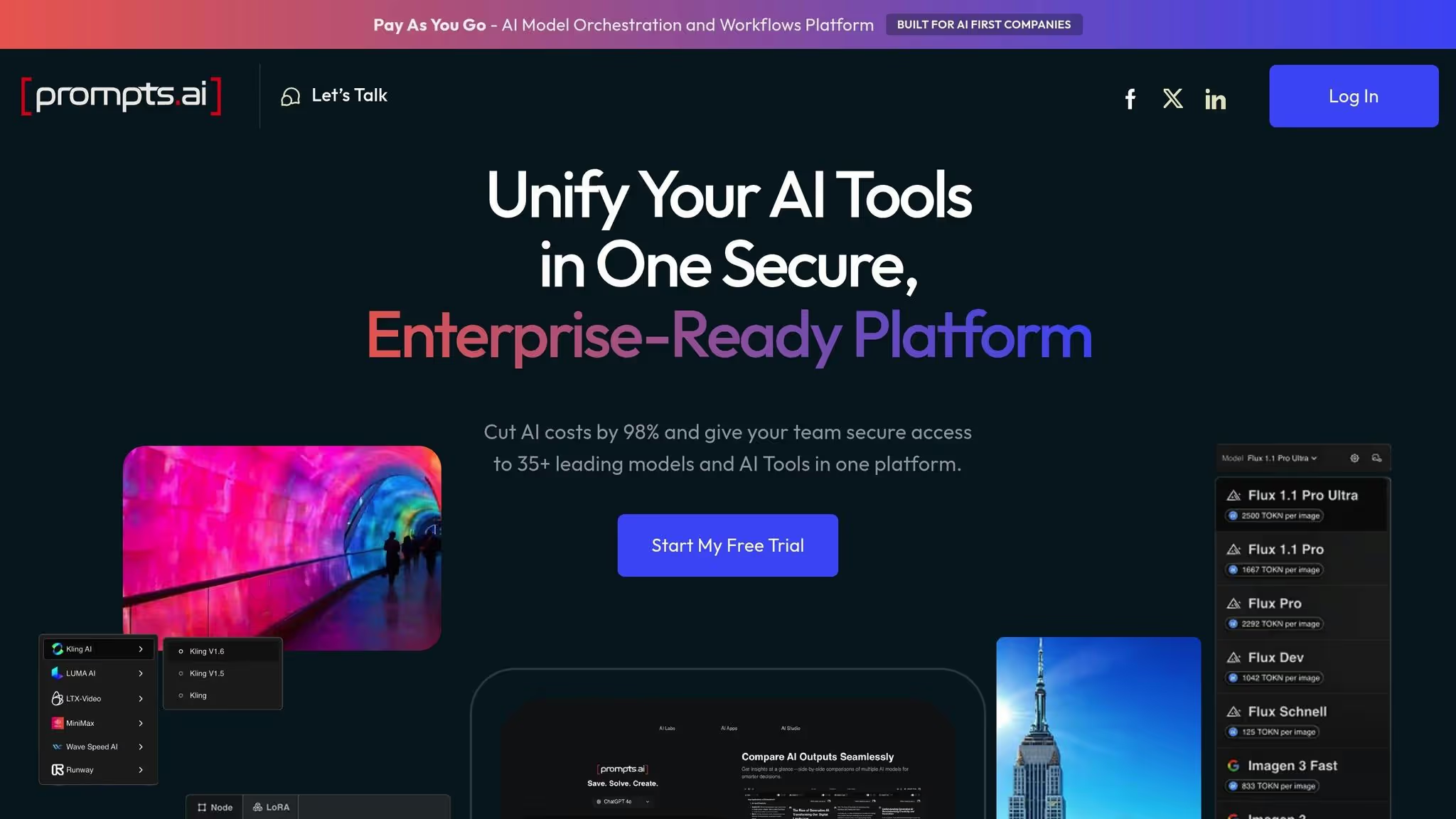

Prompts.ai regroupe plus de 35 modèles d'IA, dont TPT, Claude, Lama et Gémeaux - sur une plateforme unique et sécurisée. Cela élimine les tracas liés à la gestion de plusieurs abonnements et permet une automatisation rapide et évolutive des flux de travail. Les équipes peuvent facilement comparer les modèles, rationaliser les flux de travail entre les services et transformer les projets expérimentaux en processus reproductibles. Vous trouverez ci-dessous les fonctionnalités remarquables qui font de Prompts.ai un outil révolutionnaire pour les opérations d'IA des entreprises.

Prompts.ai fournit une interface unifiée qui connecte divers outils d'IA, supprimant ainsi la dépendance vis-à-vis des fournisseurs et minimisant la surcharge d'outils. Les équipes peuvent comparer de grands modèles linguistiques côte à côte, en sélectionnant le meilleur pour chaque tâche sans quitter la plateforme. Cette approche rationalisée a permis aux organisations de réaliser des projets en une seule journée, ce qui prenait auparavant des semaines, voire des mois. GENAI.works a reconnu Prompts.ai comme l'une des meilleures plateformes pour résoudre les problèmes des entreprises et automatiser les flux de travail.

Conçu avec une sécurité de niveau SOC 2 de type 2, HIPAA et GDPR, Prompts.ai garantit une protection de haut niveau pour une utilisation en entreprise. La plateforme a lancé son audit SOC 2 le 19 juin 2025, avec un suivi continu assuré par Vanta. Les entreprises peuvent accéder au Trust Center à l'adresse https://trust.prompts.ai/ pour suivre leur niveau de sécurité en temps réel, y compris les politiques, les contrôles et les progrès en matière de conformité. En offrant une visibilité et une auditabilité complètes pour toutes les interactions liées à l'IA, Prompts.ai apporte ordre et gouvernance à un écosystème d'IA par ailleurs chaotique.

Prompts.ai réduit les dépenses liées à l'IA jusqu'à 98 %, en consolidant plusieurs abonnements sur une seule plateforme. Le prix commence à 0$ par mois pour le niveau Pay As You Go, le plan Creator étant disponible à 29$ par mois et le plan Problem Solver à 99$ par mois. Les deux forfaits payants incluent des espaces de travail illimités et la création de flux de travail. En outre, le système de crédit TOKN permet aux équipes de regrouper leur utilisation, transformant ainsi les coûts fixes de l'IA en solutions évolutives à la demande.

Le plan Problem Solver prend en charge un nombre illimité d'espaces de travail, jusqu'à 99 collaborateurs et des flux de travail illimités pour répondre aux besoins des grandes entreprises. En gérant les ressources d'IA hybrides et multicloud via une interface unique, Prompts.ai garantit que les équipes, les modèles et les utilisateurs peuvent étendre leurs opérations sans complexité ni interruption inutiles.

Microsoft Copilot Studio fournit une plate-forme low-code parfaitement intégrée à l'écosystème Microsoft 365, y compris des outils tels que Teams, SharePoint, Plateforme d'alimentation, Dynamics 365et Azure. Cette intégration permet aux entreprises qui utilisent déjà l'infrastructure Microsoft de rationaliser et d'automatiser les flux de travail. Comme l'a fait remarquer le PDG de Microsoft, Satya Nadella :

« L'IA sera la plus grande révolution de productivité de notre vie »

Cet alignement garantit une interopérabilité fluide entre un large éventail de systèmes d'entreprise.

Copilot Studio offre une connectivité à des centaines de systèmes d'entreprise via une vaste bibliothèque de connecteurs prédéfinis et de flux Power Automate. À l'aide de commandes en langage naturel, les agents peuvent extraire des données de listes SharePoint, lancer des flux de travail automatisés et mettre à jour les systèmes CRM ou ERP. L'une des fonctionnalités les plus remarquables, « l'utilisation de l'ordinateur », permet aux agents d'interagir avec des applications plus anciennes dépourvues d'API, comblant ainsi les lacunes des systèmes existants. Cependant, la plate-forme est principalement adaptée à la pile d'IA de Microsoft, ce qui limite sa flexibilité lorsqu'il s'agit de travailler avec des modèles extérieurs à cet écosystème.

La plateforme s'appuie sur le cadre de sécurité de niveau entreprise d'Azure, notamment l'authentification Azure AD, les contrôles de résidence des données et la prévention des pertes de données (DLP). La gouvernance est encore renforcée par Microsoft Purview, qui propose des contrôles d'accès basés sur les rôles et des autorisations spécifiques à l'environnement. En outre, la collaboration de Microsoft avec ServiceNow AI Control Tower introduit une gouvernance unifiée pour ses agents d'IA, aidant les organisations à gérer les risques, à suivre les meilleures pratiques et à répondre aux exigences de conformité.

Le prix de Microsoft Power Automate commence à environ 15$ par utilisateur et par mois, Copilot Studio étant disponible en tant que module complémentaire d'entreprise. Les services Azure AI fonctionnent sur la base du paiement à l'utilisation, facturant les jetons, les demandes d'API ou les heures de calcul. L'approche low-code réduit les coûts de développement en éliminant le besoin d'intégrations d'API complexes. Cependant, la tarification basée sur des jetons peut entraîner une augmentation des dépenses à mesure que les flux de travail évoluent. Les entreprises doivent surveiller attentivement l'utilisation afin de gérer les coûts et d'éviter les dépassements de budget à mesure que leurs activités se développent.

IBM Watson Orchestrator, un composant clé de la plateforme Watsonx, est conçu pour simplifier les opérations d'IA des entreprises en combinant le développement de modèles avec une supervision au niveau de l'entreprise. Ce studio d'IA intégré permet aux entreprises de créer, d'affiner et de déployer des modèles de base parallèlement aux modèles d'apprentissage automatique traditionnels, le tout au sein de leur infrastructure existante. Spécialement conçu pour les flux de travail des entreprises, il optimise les agents d'IA pour répondre aux exigences des environnements commerciaux. Examinons ses caractéristiques techniques remarquables.

Watson Orchestrator assure une intégration fluide entre divers modèles et outils d'IA, créant ainsi un environnement unifié pour une utilisation en entreprise. Il prend en charge un large éventail de types de modèles et de durées d'exécution, ce qui permet aux entreprises de gérer plus facilement divers modèles d'IA en un seul endroit. Les options de déploiement incluent IBM Cloud, OpenShift et une infrastructure sur site, offrant la flexibilité nécessaire pour répondre aux différents besoins opérationnels. En outre, il orchestre les agents d'IA et les outils d'entreprise, rationalisant ainsi les flux de travail pour une plus grande efficacité.

Conçu pour les secteurs sensibles à la conformité, watsonx donne la priorité à la gouvernance et à la transparence tout au long du cycle de vie de l'IA. Des fonctionnalités telles que la détection des biais, la surveillance des dérives, l'explicabilité, les pistes d'audit, les flux de travail d'approbation des modèles et les évaluations des risques permettent aux entreprises de maintenir une surveillance stricte de leurs systèmes d'IA. La plateforme est conforme aux principales normes réglementaires, notamment ISO, NIST, GDPR et HIPAA, ce qui en fait un choix fiable pour les secteurs soumis à des exigences de conformité strictes. Comme le note aufaittechnologies.com :

« Watsonx.ai est l'une des meilleures options pour les entreprises où la conformité est aussi importante que l'innovation. Il apporte une gouvernance de niveau entreprise à chaque phase du cycle de vie de l'IA. »

La plateforme permet également une personnalisation sécurisée des modèles à l'aide d'ensembles de données privés, garantissant ainsi la protection des informations sensibles tout au long du processus de développement.

L'architecture évolutive de Watson Orchestrator prend en charge les déploiements hybrides et multicloud, offrant ainsi de la flexibilité aux entreprises dont les environnements informatiques sont complexes. Il peut être déployé sur IBM Cloud, des clusters OpenShift ou intégré directement à l'infrastructure d'une entreprise, ce qui le rend adaptable aux entreprises qui font la transition entre les fournisseurs de cloud. Sa conception modulaire permet une mise à l'échelle ciblée pour répondre à des besoins spécifiques, bien que la tarification dépende de l'utilisation des composants watsonx.ai, watsonx.data et watsonx.governance. Cette flexibilité permet aux organisations de développer leurs capacités d'IA sans compromettre l'efficacité opérationnelle.

Amazon Bedrock Enterprise Suite propose une solution axée sur AWS pour gérer l'IA à grande échelle, suivant la tendance des offres destinées aux entreprises telles que celles d'IBM. Cette plateforme gérée est conçue pour les entreprises qui exigent des contrôles d'IA stricts au sein de l'écosystème AWS. Il permet d'accéder à divers modèles de base, notamment les modèles Anthropic Claude, Amazon Titan, Meta Llama, Mistral et Stability, via une API unique. Cette approche unifiée permet aux utilisateurs de passer facilement d'un modèle à l'autre sans avoir à réécrire le code. Bedrock est conçu pour les entreprises qui accordent la priorité à la sécurité, à la gouvernance et à la fiabilité opérationnelle alors qu'elles intensifient leurs efforts en matière d'IA.

L'API unifiée de Bedrock simplifie le processus d'intégration des modèles d'IA en éliminant le besoin de gérer des connexions distinctes pour chacun d'eux. Il comprend des pipelines RAG intégrés et des bases de connaissances pour ancrer les modèles d'IA dans les données d'entreprise, rationalisant ainsi les flux de travail. La plateforme permet également de créer des systèmes d'IA agentiques qui interagissent avec les services AWS tels que DynamoDB, S3 et Lambda, connectant ainsi les modèles d'IA directement aux sources de données de l'entreprise. Les agents Bedrock permettent à de grands modèles de langage d'appeler des API et d'exécuter des tâches avec un minimum de codage, ce qui réduit la complexité pour les développeurs. Ces fonctionnalités jettent les bases d'une gouvernance détaillée, dont il sera question plus en détail dans la section suivante.

La sécurité et la conformité sont au cœur de la conception de Bedrock. La plateforme utilise des outils AWS tels que IAM, VPC, KMS et CloudWatch pour garantir la sécurité des données et garantir la conformité. Les garde-corps configurables fournissent des filtres de sécurité et permettent d'appliquer des politiques pour les invites, les réponses et les pipelines RAG, permettant aux entreprises de contrôler le comportement de l'IA. Les principales fonctionnalités incluent les options de résidence des données, la mise en réseau privée via VPC, un contrôle d'accès précis basé sur les rôles, la prise en charge SSO/SAML et des journaux d'audit immuables.

Bedrock fonctionne selon un modèle de tarification à l'utilisation, basé sur l'utilisation réelle du calcul et des services. Bien que cette approche flexible soit avantageuse pour les entreprises qui étendent leurs opérations d'IA, les charges de travail de calcul élevées peuvent entraîner une augmentation des dépenses. Pour gérer les coûts de manière efficace, les entreprises doivent optimiser leurs configurations AWS et surveiller de près les modèles d'utilisation. L'architecture sans serveur de la plateforme réduit les frais d'infrastructure, mais une planification minutieuse est nécessaire pour maîtriser les coûts de production.

Bedrock est conçu pour être évolutif, en particulier au sein de l'écosystème AWS. Son architecture sans serveur prend en charge les charges de travail mondiales, ce qui la rend idéale pour les déploiements à l'échelle de l'entreprise avec une sécurité et une fiabilité d'infrastructure renforcées. Cependant, sa nature centrée sur AWS limite la portabilité, ce qui signifie qu'il n'est pas aussi flexible pour les environnements cross-cloud. Pour les organisations déjà profondément intégrées à AWS, cet alignement étroit est un avantage. Cependant, les entreprises à la recherche de fonctionnalités cross-cloud étendues pourraient trouver la plateforme moins adaptée à leurs besoins.

Le centre de commande Vertex AI de Google sert de hub centralisé pour l'IA d'entreprise au sein du Plateforme Google Cloud (GCP) écosystème. Cette plateforme propose une solution cloud native robuste, adaptée aux organisations qui utilisent GCP. En combinant l'IA générative, la personnalisation des modèles et une intégration fluide avec les nombreux outils de données et d'analyse de Google, Vertex AI fournit un environnement d'apprentissage automatique (ML) complet. Également connue sous le nom de Vertex AI Agent Builder, la plateforme va au-delà des fonctionnalités d'IA standard en se connectant directement à Espace de travail Google applications comme Gmail, Docs, Sheets, Slides, Drive et Meet. Cette intégration transforme le contenu de Workspace en une couche d'intelligence cohérente destinée à une utilisation en entreprise.

Vertex AI répond à une variété de besoins en matière d'IA, en s'adaptant modèles multimodaux et personnalisés pour les entreprises aux exigences diverses. La plateforme offre des fonctionnalités linguistiques étendues et des plugins prédéfinis, ce qui la rend adaptable à différents cas d'utilisation. Les entreprises peuvent intégrer des modèles personnalisés, des pipelines d'orchestration et des ensembles de données spécialisés directement dans leurs applications Google Workspace, garantissant ainsi une connexion fluide entre les flux de travail d'IA et les opérations commerciales quotidiennes. En outre, tableaux de bord d'observabilité fournissent des informations sur l'utilisation des jetons, la latence, les erreurs et les performances des outils, donnant aux équipes une vision claire du fonctionnement de leurs systèmes d'IA. Ces fonctionnalités sont complétées par de puissants outils de gouvernance conçus pour les environnements d'entreprise.

Vertex AI intègre des fonctionnalités de gouvernance robustes pour répondre aux exigences des opérations à l'échelle de l'entreprise. Grâce à des outils de gestion centralisés, la plateforme garantit une gouvernance complète des données et une surveillance opérationnelle tout au long du cycle de vie de l'IA. L'intégration de Gemini for Workspace renforce la sécurité grâce à contrôles au niveau de l'administrateur, y compris la prévention des pertes de données (DLP). En s'alignant sur la pile de données et d'analyses de Google, Vertex AI assure une supervision de bout en bout, aidant les organisations à gérer les risques et à maintenir la conformité de leurs initiatives d'IA.

Fonctionnant sur un modèle de tarification basé sur la consommation, Vertex AI facture la formation, les prévisions et l'hébergement de modèles au sein de GCP. Bien que ce modèle permette l'évolutivité, la gestion des coûts peut devenir complexe, en particulier dans le cas des déploiements multimodèles. Les outils d'observabilité de la plateforme aident les entreprises à surveiller et à optimiser leurs dépenses, bien que ces fonctionnalités soient largement limitées à l'environnement Google Cloud. Les entreprises doivent élaborer avec soin leurs stratégies de déploiement afin d'éviter des coûts imprévus, en particulier lorsqu'il s'agit de faire évoluer les opérations sur plusieurs modèles.

Vertex AI est conçu pour fonctionner exceptionnellement bien dans Écosystème Google Cloud, mais sa portabilité sur les autres plateformes cloud est limitée. Cette focalisation sur Google Cloud en fait un excellent choix pour les organisations déjà engagées dans l'infrastructure GCP, en proposant des opérations rationalisées et des performances fiables. Cependant, les entreprises à la recherche de solutions hybrides ou multicloud peuvent rencontrer des difficultés en raison de la conception spécifique de la plateforme aux fournisseurs. Pour les entreprises qui accordent la priorité à la flexibilité et évitent de se retrouver dans une situation de dépendance vis-à-vis d'un fournisseur, cela pourrait constituer une limitation importante.

Lors de la sélection d'un centre de commande basé sur l'IA, il est essentiel d'évaluer la manière dont chaque plateforme répond aux défis essentiels du déploiement de l'IA en entreprise. Vous trouverez ci-dessous une comparaison détaillée de cinq solutions de pointe, en mettant l'accent sur interopérabilité, gouvernance et conformité, gestion des coûts, et évolutivité pour vous aider à déterminer la plateforme la mieux adaptée aux objectifs et à l'infrastructure de votre organisation.

Ce tableau met en évidence les points forts distincts de chaque plateforme. Prompts.ai se distingue par ses options de déploiement multicloud, qui réduisent considérablement la dépendance vis-à-vis des fournisseurs. Sa couche FinOps en temps réel fournit un suivi granulaire des coûts au niveau des jetons, ce qui permet aux organisations d'optimiser leurs dépenses sans être liées à un seul fournisseur.

Toutes les plateformes répondent aux principales normes de sécurité d'entreprise telles que SOC 2, ISO 27001, GDPR et HIPAA. Prompts.ai améliore la gouvernance grâce à des journaux d'audit immuables et à un RBAC affiné sur l'ensemble de son architecture. Microsoft exploite Azure AD et Purview pour une gouvernance unifiée, tandis qu'IBM Watson Orchestrator met l'accent sur la conformité grâce à son cadre modulaire. AWS Bedrock Enterprise Suite et Google Vertex AI Command Center intègrent la gouvernance directement dans leurs robustes systèmes de sécurité cloud.

Sur le plan des coûts, Prompts.ai propose un modèle de paiement à l'utilisation par le biais de crédits TOKN, évitant ainsi les frais d'abonnement récurrents et alignant les dépenses sur l'utilisation réelle. En revanche, Microsoft, Amazon et Google utilisent une tarification basée sur la consommation associée à leurs services cloud plus larges. La transparence de Prompts.ai, facilitée par sa couche FinOps, fournit des informations en temps réel sur les coûts de l'IA, une fonctionnalité qui n'est pas aussi importante sur les autres plateformes.

L'évolutivité dépend largement de votre infrastructure actuelle. Prompts.ai offre de la flexibilité grâce à l'isolation régionale et à la reprise après sinistre, ce qui en fait la solution idéale pour les entreprises opérant dans plusieurs environnements ou nécessitant des options sur site. Dans le même temps, Microsoft, AWS et Google excellent en termes d'évolutivité au sein de leurs écosystèmes, mais pourraient introduire une dépendance vis-à-vis des fournisseurs. IBM Watson Orchestrator associe ces approches à un support hybride et multicloud, répondant ainsi aux besoins des entreprises ayant des besoins d'infrastructure mondiaux diversifiés.

Les centres de commande d'IA sont devenus la pierre angulaire de la gestion des écosystèmes complexes d'IA de 2026. Ces plateformes répondent à un besoin pressant : comment concevoir, coordonner et superviser efficacement des agents d'IA à grande échelle tout en garantissant la productivité, la conformité et l'efficacité opérationnelle. En automatisant les tâches de routine, ils permettent aux équipes de se concentrer sur un travail plus stratégique et plus efficace.

Pour sélectionner la bonne plateforme, il faut d'abord l'aligner sur votre stratégie commerciale. La solution doit répondre directement aux défis et opportunités uniques de votre organisation. Il est essentiel de mettre fortement l'accent sur la qualité et la gestion des données : des données propres et accessibles dotées de capacités de récupération et de conservation fluides ne sont pas négociables.

L'interopérabilité et l'évolutivité sont également essentielles au succès de votre stratégie d'IA. Les centres de commande d'IA les plus efficaces intègrent des outils sans code, des fonctionnalités d'orchestration de modèles et de gouvernance, ce qui vous permet de prototyper, de tester et de déployer en toute sécurité des agents intelligents sur divers systèmes. Les plateformes dotées de connecteurs intégrés qui s'intègrent facilement à votre infrastructure d'entreprise existante sont particulièrement utiles.

Chacune des cinq solutions présentées présente des avantages distincts en matière d'orchestration de l'IA d'entreprise. L'essentiel est de choisir celui qui correspond à votre infrastructure, à vos exigences de conformité, à votre budget et à vos objectifs d'IA à long terme, en donnant la priorité à l'adéquation globale plutôt que de vous concentrer uniquement sur les fonctionnalités individuelles, comme indiqué dans la comparaison ci-dessus.

Les centres de commande basés sur l'IA permettent aux entreprises de réduire leurs coûts en simplification des flux de travail, unifier l'accès à divers outils d'IA, et automatisation des tâches de routine. En réunissant plusieurs modèles d'IA sur une seule plateforme, ils éliminent le besoin de systèmes distincts et réduisent le recours au travail manuel, ce qui peut entraîner une réduction notable des dépenses opérationnelles.

Ces plateformes garantissent également une gestion plus intelligente des ressources, permettant aux entreprises de n'utiliser que la puissance informatique et le stockage nécessaires à leurs besoins. Ce niveau d'efficacité permet non seulement d'économiser de l'argent, mais favorise également une croissance évolutive sans dépenses inutiles.

Lorsque vous envisagez un centre de commande basé sur l'IA pour une utilisation en entreprise, priorisez fonctionnalités de conformité qui répondent aux normes de l'industrie et aux exigences réglementaires. Recherchez des outils qui fournissent traitement sécurisé des données pour protéger les informations sensibles, pistes d'audit détaillées pour suivre les activités du système, et contrôles de gouvernance pour remédier à d'éventuels biais ou problèmes de performance.

Il est également essentiel que la plateforme prenne en charge mises à jour automatiques pour s'adapter à l'évolution des réglementations et s'aligner sur les normes spécifiques à l'industrie, telles que HIPAA pour les soins de santé ou SOX pour les services financiers. Ces fonctionnalités garantissent non seulement la sécurité opérationnelle, mais renforcent également la confiance et la fiabilité des flux de travail alimentés par l'IA.

Pour créer un centre de commande IA évolutif, les entreprises doivent établir des priorités allocation dynamique des ressources pour gérer efficacement les fluctuations de la demande. Tout aussi importante est l'utilisation de plateformes interopérables qui peut se connecter de manière fluide à une variété de technologies d'IA, garantissant ainsi l'efficacité et la cohésion des flux de travail. Enfin, établir de solides mesures de gouvernance et de sécurité est essentiel pour maintenir la conformité et soutenir la croissance et l'évolution de l'organisation.