Réduisez les coûts liés à l'IA jusqu'à 98 % tout en rationalisant vos flux de travail

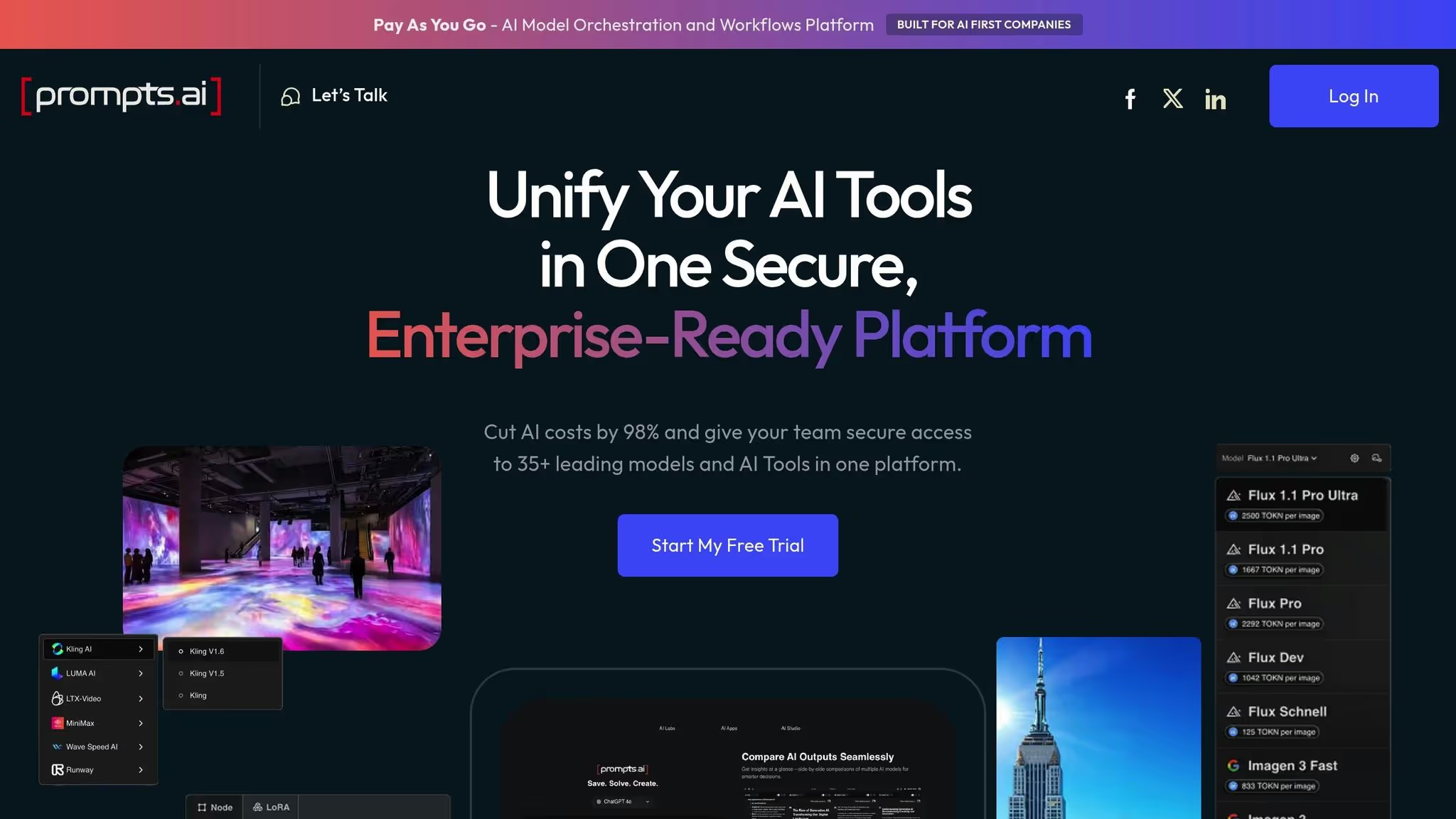

La gestion des instructions pour les modèles d'IA peut être chaotique, coûteuse et inefficace sans les bons outils. Plateformes avancées d'ingénierie rapide, telles que Prompts.ai, centralisez et simplifiez ce processus, en offrant des économies de coûts inégalées, une collaboration améliorée et une gouvernance de niveau entreprise.

Des plateformes telles que Prompts.ai transforment des processus éparpillés en opérations rationalisées et évolutives, permettant aux équipes d'élaborer des stratégies d'IA efficaces, sécurisées et rentables. Êtes-vous prêt à prendre le contrôle de vos flux de travail basés sur l'IA ? Allons-y.

Avantages de la plateforme d'ingénierie rapide : économies de coûts et fonctionnalités clés

Les plateformes modernes d'ingénierie rapide simplifient l'accès à un large éventail de modèles d'IA via une interface unique et unifiée. Prenons l'exemple de Prompts.ai : il propose des connexions à plus de 35 grands modèles de langage de premier plan, notamment GPT, Claude, Lamaet Gemini. Cette configuration permet aux ingénieurs de passer d'un modèle à l'autre en fonction de facteurs tels que le coût, la vitesse ou les performances, le tout sans avoir à réécrire la logique de l'application. Cette approche rationalisée aide les équipes à affiner leurs flux de travail pour une efficacité maximale.

Le routage dynamique va encore plus loin en sélectionnant automatiquement le modèle le mieux adapté à chaque tâche. Par exemple, un chatbot de service client peut s'appuyer sur un modèle léger pour les questions de routine, mais passer à un modèle plus avancé pour traiter les requêtes complexes. Les outils de comparaison de modèles côte à côte permettent aux équipes de tester des instructions identiques en temps réel, ce qui leur permet de mesurer la latence, la précision et l'utilisation des jetons avant de déployer des solutions. Cette flexibilité s'intègre parfaitement à des stratégies plus larges de gestion rapide.

Une gestion efficace des commandes transforme les demandes en ressources réutilisables et traçables. Le contrôle de version joue un rôle clé à cet égard, en enregistrant chaque modification et en permettant la création de modèles standardisés pour les modèles récurrents. Le suivi des expériences apporte une autre couche d'informations en enregistrant les entrées, les sorties, les paramètres du modèle et les mesures de performance. Ces données révèlent quelles variations rapides donnent les meilleurs résultats tout en suivant l'évolution des coûts, ce qui permet de reproduire plus facilement et avec précision les configurations réussies.

Une fois les instructions gérées, elles sont soumises à des tests et à un débogage rigoureux pour garantir leur fiabilité. Les frameworks de tests A/B permettent aux équipes d'envoyer du trafic en direct vers différentes versions rapides, en comparant des indicateurs tels que la précision, le coût et la satisfaction des utilisateurs. Les méthodes d'évaluation automatisées, telles que l'utilisation d'un modèle neutre pour évaluer les résultats en termes de cohérence, de ton ou de pertinence, fournissent des informations plus approfondies. Par exemple, un test utilisant le modèle gpt-4o-mini a montré qu'une invite de génération de base augmentée par récupération a réussi 86 % des contrôles de cohérence factuelle, tandis qu'une version plus avancée a atteint une précision de 84 %.

Les contrôles de sécurité constituent une autre caractéristique essentielle, car ils permettent de détecter des problèmes tels que le contenu préjudiciable, les données personnelles ou le langage contraire à la marque avant que les résultats ne parviennent aux utilisateurs. Les outils de surveillance des performances signalent les anomalies telles que les pics de latence inattendus ou les baisses de qualité, ce qui rend le processus de débogage systématique et piloté par les données.

Les plateformes permettent aux équipes d'enchaîner les instructions dans des flux de travail automatisés, où les résultats d'un modèle alimentent le suivant. Par exemple, un pipeline de génération de contenu peut commencer par un modèle rapide rédigeant un plan, suivi d'un modèle spécialisé ajoutant des détails et d'un autre vérifiant la précision. Les outils visuels permettent aux utilisateurs non techniques de créer facilement ces flux de travail à l'aide de composants par glisser-déposer tels que « résumer », « traduire » ou « classer », garantissant ainsi la prévisibilité et l'évolutivité des opérations.

L'automatisation pilotée par les événements intègre davantage l'IA dans les processus métier. Par exemple, lorsqu'un ticket d'assistance est reçu, un flux de travail peut extraire des informations clés, effectuer des recherches dans une base de connaissances, rédiger une réponse et la transmettre pour approbation, le tout en quelques secondes seulement. En se connectant à des CRM, à des bases de données ou à des API, ces flux de travail remplacent les tâches manuelles par une automatisation fiable et reproductible.

Pour garantir la sécurité et la conformité des opérations, les plateformes mettent en œuvre des fonctionnalités de gouvernance robustes. Les contrôles d'accès basés sur les rôles limitent le nombre de personnes autorisées à modifier les instructions de production, tandis que les pistes d'audit enregistrent chaque interaction pour des raisons de transparence. Le chiffrement des données protège les informations en transit et au repos, et les messages à haut risque nécessitent souvent l'approbation de la direction avant le déploiement. Les outils réglementaires documentent les processus décisionnels liés à l'IA, contribuant ainsi à répondre aux normes de conformité spécifiques au secteur. Ces mesures protègent non seulement les données, mais créent également un cadre pour des opérations d'IA évolutives et conformes.

Prompts.ai simplifie les opérations de l'entreprise en prenant en charge trois modèles de flux de travail clés que les entreprises utilisent au quotidien. Tâches à invite unique gérez des opérations simples et ponctuelles, telles que la classification des tickets d'assistance, la synthèse des notes de réunion ou l'extraction de données clés, pour obtenir des résultats rapides et exploitables. Conversations à plusieurs tours sont conçus pour des échanges continus, ce qui les rend idéaux pour les chatbots, les assistants virtuels ou les services d'assistance internes qui doivent mémoriser les préférences des utilisateurs et les interactions passées. Enfin, Génération augmentée par récupération (RAG) les pipelines combinent la recherche de documents avec la génération rapide, extrayant des informations pertinentes à partir de bases de connaissances pour répondre à des questions sur les politiques, la documentation technique ou les contrats avec des informations précises et actualisées.

Ces modèles répondent à différents besoins commerciaux tout en partageant une infrastructure unifiée. Par exemple, une équipe du service client peut commencer par utiliser des flux de travail à invite unique pour classer les tickets, puis passer à des conversations à plusieurs tours pour le support client, puis implémenter des flux de travail RAG pour une recherche rapide des politiques. Prompts.ai fournit des modèles prêts à l'emploi et des outils d'orchestration pour tous ces modèles, permettant aux équipes de créer des flux de travail sans recommencer à zéro à chaque fois. En s'appuyant sur ces modèles, les composants modulaires simplifient et normalisent davantage l'ingénierie rapide.

La décomposition des instructions en composants modulaires transforme l'édition d'une tâche manuelle en une approche rationalisée pilotée par la bibliothèque. Chaque invite peut être divisée en parties réutilisables, telles que des définitions de rôles, des instructions de tâches, des directives de style, des schémas de sortie et des contraintes de sécurité, ce qui facilite grandement les mises à jour et la réutilisation.

Ces composants agissent comme des modèles qui acceptent des variables, telles que des noms de produits ou des régions, au lieu de valeurs fixes. Les équipes peuvent stocker ces éléments grâce au contrôle de version, garantissant ainsi que les mises à jour des protocoles de sécurité ou des règles de formatage sont appliquées de manière cohérente. Une bibliothèque centrale peut inclure des rôles standard, des guides de style et des règles de mise en forme pour toutes les équipes, ainsi que des packs spécialisés dans des domaines tels que le support, les questions juridiques ou le marketing. Au lieu de copier-coller, les équipes peuvent référencer ces composants, appliquer des configurations personnalisées selon les besoins et parcourir un catalogue pour prévisualiser ou adapter les modèles avec les autorisations appropriées. Cette approche améliore non seulement la cohérence, mais permet également une intégration fluide entre les différents modèles et équipes.

L'exécution de flux de travail sur plusieurs modèles nécessite une conception standardisée et flexible. Prompts.ai utilise un interface indépendante du modèle, où les flux de travail interagissent avec des points de terminaison logiques tels que « general_qa » ou « code_assistant » au lieu d'être liés à des API de fournisseurs spécifiques. Un système de routage associe ces points de terminaison à des modèles spécifiques, qu'il s'agisse d'options de classe GPT-4, de type Claude, de poids ouvert ou sur site, en fonction de facteurs tels que le coût, la latence, la résidence des données ou la sensibilité. Par exemple, les flux de travail gérant des données sensibles peuvent garantir que les demandes sont traitées uniquement sur des serveurs basés aux États-Unis.

Les fonctionnalités du flux de travail, telles que les paramètres de température ou les limites de jetons, sont déclarées dès le départ, et Prompts.ai les associe aux API de modèle appropriées. Les tests automatisés vérifient la qualité, la longueur et le respect des schémas en sortie, garantissant ainsi la compatibilité avec les systèmes en aval tels que les CRM ou les outils BI. Les formats de réponse standardisés, généralement au format JSON, éliminent la dépendance aux particularités des modèles individuels. Cette configuration permet aux entreprises d'échanger ou de combiner des modèles sans devoir réécrire les instructions, tout en préservant la cohérence tout en optimisant les performances et les coûts. Cette conception modulaire et interopérable permet aux entreprises de répondre à leurs besoins techniques, de sécurité et budgétaires lors de la sélection de leur plateforme d'IA.

Lors de l'évaluation des plateformes, il est essentiel de s'assurer qu'elles s'intègrent parfaitement à vos systèmes existants. Optez pour une connectivité multimodèle étendue pour éviter de vous retrouver confiné à un seul fournisseur. La plate-forme doit proposer des API et des SDK robustes capables de gérer des mises à jour rapides via des pipelines CI/CD et des frameworks de support tels que Chaîne Lang, Indice de lama, et LangGraph. En outre, il doit se connecter à vos bases de données vectorielles, à vos graphes de connaissances et à vos entrepôts de données pour fournir un contexte en temps réel. La flexibilité du déploiement est un autre facteur clé : que ce soit par le biais d'options cloud, intégrées au VPC ou auto-hébergées, la plateforme doit répondre aux besoins de souveraineté des données. Enfin, assurez-vous qu'il peut exporter les données d'utilisation et de coûts vers vos outils de BI actuels pour un suivi cohérent des performances. Ces intégrations jettent les bases de la sécurité et de l'efficacité des opérations.

La sécurité et la conformité doivent être au cœur de votre décision. Recherchez des plateformes qui donnent la priorité au chiffrement, à la journalisation des audits et au respect des cadres de gouvernance tels que Cadre de gestion des risques liés à l'IA du NIST et Principes de l'OCDE relatifs à l'intelligence artificielle. Cela garantit la transparence, la responsabilité et la confidentialité. La plateforme doit également être conforme aux normes spécifiques au secteur, telles que SOX pour l'information financière, HIPAA pour les données de santé, et aux réglementations nationales telles que le CCPA et le règlement de cybersécurité du NYDFS. Au-delà de la conformité, assurez-vous que la plateforme dispose de garanties contre les injections rapides et les fuites de données, prend en charge les autorisations basées sur les rôles, gère des pistes d'audit détaillées et effectue régulièrement des évaluations des risques. Une fois ces mesures de sécurité mises en place, vous pouvez vous concentrer sur l'évaluation des coûts.

Une structure de prix transparente est essentielle. Recherchez un suivi au niveau des jetons et une surveillance des coûts pour aligner les dépenses sur l'utilisation réelle. Les plateformes dotées de modèles de paiement à l'utilisation sont idéales, car elles fournissent un lien direct entre la consommation et les coûts. Prompts.ai élimine les frais d'abonnement récurrents en utilisant des crédits TOKN, qui peuvent réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %. En outre, les tableaux de bord FinOps permettent aux équipes financières et d'ingénierie de définir des alertes budgétaires, de surveiller les dépenses par département ou par projet et d'affiner des stratégies rapides pour gérer les coûts efficacement.

La facilité d'utilisation et les outils de collaboration sont essentiels à l'adoption par les entreprises. Choisissez une plate-forme dotée d'outils low-code qui permettent aux membres de l'équipe non techniques de créer et de tester des invites sans avoir à écrire de code. Des fonctionnalités telles que les environnements partagés avec contrôle de version favorisent la collaboration entre les services. L'accès basé sur les rôles garantit que les membres juniors de l'équipe peuvent exécuter des flux de travail approuvés tandis que les ingénieurs seniors conservent le contrôle des modèles principaux. Prompts.ai améliore la convivialité grâce à un programme de certification Prompt Engineer dédié, à une intégration pratique et à une communauté dynamique qui partage des « gains de temps » conçus par des experts, des flux de travail prédéfinis que les équipes peuvent adapter à leurs besoins spécifiques.

Votre plateforme doit évoluer en même temps que votre entreprise. Assurez-vous qu'il peut s'adapter à un plus grand nombre d'utilisateurs, à de nouveaux modèles et à des cas d'utilisation évolutifs sans nécessiter de migration complète. La prise en charge des approches hybrides, qui combinent une ingénierie agile et rapide avec des sous-modèles affinés pour des tâches sensibles, devient de plus en plus importante. À mesure que l'incitation multimodale, intégrant du texte, des images et des données structurées, devient la norme, la plateforme devrait être prête à intégrer ces fonctionnalités. Prompts.ai regroupe plus de 35 modèles de premier plan, dont GPT-5, Claude, LLama, Gemini et des outils spécialisés tels que Flux Pro et Kling, dans le cadre d'une architecture unifiée. Cette configuration garantit un déploiement à l'échelle de l'entreprise tout en maintenant la gouvernance et le contrôle des coûts, préparant ainsi votre organisation aux avancées futures tout en restant efficace et sécurisée.

Définissez des normes claires pour une conception rapide, y compris les messages système, les formats de sortie et les délimiteurs. Attribuez des rôles ou des personnages spécifiques pour maintenir un ton et un style cohérents dans toutes les invites.

Utilisez des systèmes de contrôle de version, tels que les référentiels Git, pour suivre les modifications apportées aux invites et activer les annulations si nécessaire. Des outils tels que IA ouverteLe tableau de bord permet aux développeurs de créer des invites réutilisables avec des espaces réservés (par exemple, {{nom_client}}). Ils peuvent être référencés par identifiant et version dans les requêtes d'API, garantissant ainsi un comportement cohérent. En outre, l'épinglage des applications de production à des instantanés de modèles spécifiques (par exemple, gpt-4.1-2025-04-14) permet de maintenir des performances constantes au fur et à mesure de l'évolution des modèles.

Mettez en œuvre des contrôles et des flux de travail d'approbation basés sur les rôles. Cette configuration permet aux membres juniors de l'équipe de travailler dans le cadre de processus approuvés tandis que les ingénieurs seniors supervisent et gèrent les modèles de base.

Une fois les normes établies, faites passer les flux de travail à la production avec des déploiements contrôlés. Déployez des mises à jour rapides progressivement, en commençant par un petit segment d'utilisateurs pendant les périodes de faible trafic, puis développez-les à mesure que les performances se stabilisent. Certains outils de configuration d'IA permettent aux organisations de créer plusieurs versions d'invites adaptées à différents contextes, de répartir le trafic sans modifier le code et de surveiller des indicateurs en temps réel tels que l'utilisation des jetons et la satisfaction des utilisateurs.

Développez des suites de tests automatisées pour exécuter des tests de régression quotidiens, des benchmarks de performances (par exemple, précision > 95 %, latence inférieure à 2 secondes) et des validations de cas extrêmes. Configurez des systèmes d'alerte pour signaler les problèmes de performances, tels qu'une baisse de 8 % de la précision des réponses rapides, et configurez des mécanismes de restauration automatique pour résoudre les problèmes rapidement. Pour les tâches nécessitant une cohérence élevée, définissez le température paramètre compris entre 0 et 0,3 pour produire des sorties plus déterministes.

Une expérimentation efficace en production implique de trouver un équilibre entre les performances et l'utilisation des jetons. Dans certains cas, une invite plus simple peut être aussi efficace qu'une invite plus complexe pour des tâches moins exigeantes, offrant ainsi une meilleure rentabilité. Les tableaux de bord FinOps de Prompts.ai fournissent un suivi financier en temps réel, permettant aux équipes de définir des alertes budgétaires, de suivre les dépenses par département ou projet et d'ajuster les stratégies en fonction de la consommation réelle.

Décomposez les tâches complexes en étapes séquentielles à l'aide de techniques telles que l'enchaînement rapide ou la décomposition automatique pour améliorer la précision et gérer les coûts. En outre, l'utilisation d'une approche LLM-as-a-Judge, dans le cadre de laquelle un LLM évalue la qualité des résultats d'un autre, peut fournir des informations qualitatives précieuses lorsque l'évaluation humaine n'est pas possible.

« L'ingénierie rapide n'est pas une tâche ponctuelle, c'est un processus créatif et expérimental ».

Le développement de l'expertise interne accélère l'adoption rapide de l'ingénierie. Prompts.ai propose un programme de certification Prompt Engineer, qui comprend une intégration pratique pour doter les membres de l'équipe des compétences nécessaires pour devenir des champions internes. Créez des guides de style à l'échelle de l'organisation pour promouvoir une clarté et une spécificité rapides, en mettant l'accent sur l'utilisation de verbes d'action directe, en évitant les préambules inutiles et en définissant clairement les attentes en matière de qualité.

Encouragez la collaboration en partageant des flux de travail conçus par des experts, tels que « Time Savers » de Prompts.ai. L'enregistrement des interactions rapides en production, tout en respectant les mesures de confidentialité, permet de suivre les conditions de production et d'affiner les processus.

« Plus vous répétez vos instructions, plus vous découvrirez les dynamiques subtiles qui transforment une bonne invite en une excellente ».

Les plateformes avancées d'ingénierie rapide sont devenues une base essentielle pour définir les stratégies d'IA des entreprises. En centralisant la conception, les tests et le déploiement rapides, les entreprises peuvent bénéficier d'avantages évidents : l'ingénierie rapide structurée peut réduire les coûts d'exploitation jusqu'à 76 % tout en améliorant la qualité de la production. Prompts.ai répond à ces exigences en fournissant un accès à plus de 35 modèles de pointe via une interface unifiée et sécurisée. Cela élimine la prolifération des outils et introduit des tableaux de bord FinOps, permettant aux équipes de suivre les dépenses entre les départements, les projets ou les flux de travail.

La transition d'une invite ad hoc à une infrastructure gérée apporte des avantages transformateurs. Collaboration entre équipes, bibliothèques d'invites réutilisables et contrôles de gouvernance garantir l'évolutivité et la cohérence à mesure que les organisations se développent. Des modèles standardisés et des mesures d'évaluation empêchent la duplication des efforts et garantissent la qualité de milliers, voire de millions, d'interactions quotidiennes liées à l'IA. Ces fonctionnalités renforcent également la sécurité et la conformité au niveau de l'entreprise.

Grâce à des fonctionnalités telles que le routage multimodèle et l'orchestration des flux de travail, les entreprises peuvent rentabilité et flexibilité des performances. Les tâches de routine sont attribuées à des modèles rentables, tandis que les modèles haut de gamme sont réservés aux opérations critiques à forte valeur ajoutée. Cette approche optimise l'utilisation des jetons sans compromettre la qualité, tandis que les outils de suivi des performances permettent des itérations rapides et un déploiement rationalisé.

Le retour sur investissement d'une plateforme d'ingénierie rapide va bien au-delà des frais de licence. Des avantages tels que des délais de commercialisation plus rapides, des taux de réussite des tâches plus élevés et des risques de conformité réduits se traduisent par des gains commerciaux mesurables : moins d'heures d'ingénierie par fonctionnalité, baisse des dépenses liées aux API cloud et réduction de l'exposition aux sanctions réglementaires. À mesure que l'adoption de l'IA se développe, le fait de considérer l'ingénierie rapide comme une infrastructure stratégique garantit que chaque nouveau flux de travail hérite de composants réutilisables, de protections de base et d'une responsabilité financière claire. Cela permet aux organisations de réussir durablement et d'investir plus intelligemment dans l'IA.

Lors de la planification des initiatives d'IA au cours des 12 à 24 prochains mois, concentrez-vous sur l'offre de plateformes support multimodèle, intégration fluide avec les systèmes existants et gestion transparente des coûts. Les premiers investissements dans les bibliothèques partagées, l'activation interne et les normes, comme le programme de certification Prompt Engineer de Prompts.ai, créent une base solide pour la croissance. Cette infrastructure partagée permet aux unités commerciales de s'appuyer sur des ressources communes, en fournissant une valeur composée et en garantissant une évolutivité de l'IA à la fois responsable et rentable.

Les plateformes avancées d'ingénierie rapide jouent un rôle clé dans la réduction des dépenses liées à l'IA en améliorant la façon dont les invites sont conçues et appliquées dans les systèmes d'IA. En simplifiant les flux de travail, ils réduisent la puissance de calcul requise pour gérer les tâches, ce qui permet de réaliser des économies substantielles.

Ces plateformes améliorent également l'efficacité en créant des instructions plus précises et plus efficaces, ce qui minimise les erreurs et élimine les répétitions inutiles. Cette approche permet non seulement de gagner du temps, mais permet également aux entreprises de maintenir des résultats de haute qualité tout en maîtrisant les coûts, ce qui peut réduire les dépenses de 98 %.

La gestion de plusieurs modèles d'IA via une plateforme unique présente plusieurs avantages qui peuvent transformer la façon dont les organisations gèrent leurs systèmes d'IA. En centralisant les opérations, il simplifie les flux de travail, ce qui facilite grandement le suivi et l'ajustement des processus. Cette approche unifiée garantit la cohérence des résultats, car tous les modèles fonctionnent selon le même ensemble de directives et de normes.

Cela réduit également les défis liés à l'intégration de divers outils et cadres, économisant du temps et des ressources. Grâce à des opérations rationalisées, les organisations peuvent améliorer leur efficacité, faire évoluer leurs systèmes de manière plus efficace et tirer le meilleur parti de leurs investissements dans l'IA.

Prompts.ai donne la priorité à la conformité en s'alignant sur les normes du secteur et les meilleures pratiques en matière de développement de l'IA. La plateforme intègre de solides protocoles de confidentialité des données, une infrastructure sécurisée et effectue des audits réguliers pour répondre aux obligations légales et éthiques.

De plus, Prompts.ai surveille en permanence l'évolution des politiques et des directives, s'assurant que ses outils et ses cadres respectent les plus hauts niveaux de responsabilité et de transparence. Ce dévouement permet aux utilisateurs d'intégrer la plateforme de manière fluide et en toute confiance à leurs flux de travail d'IA.