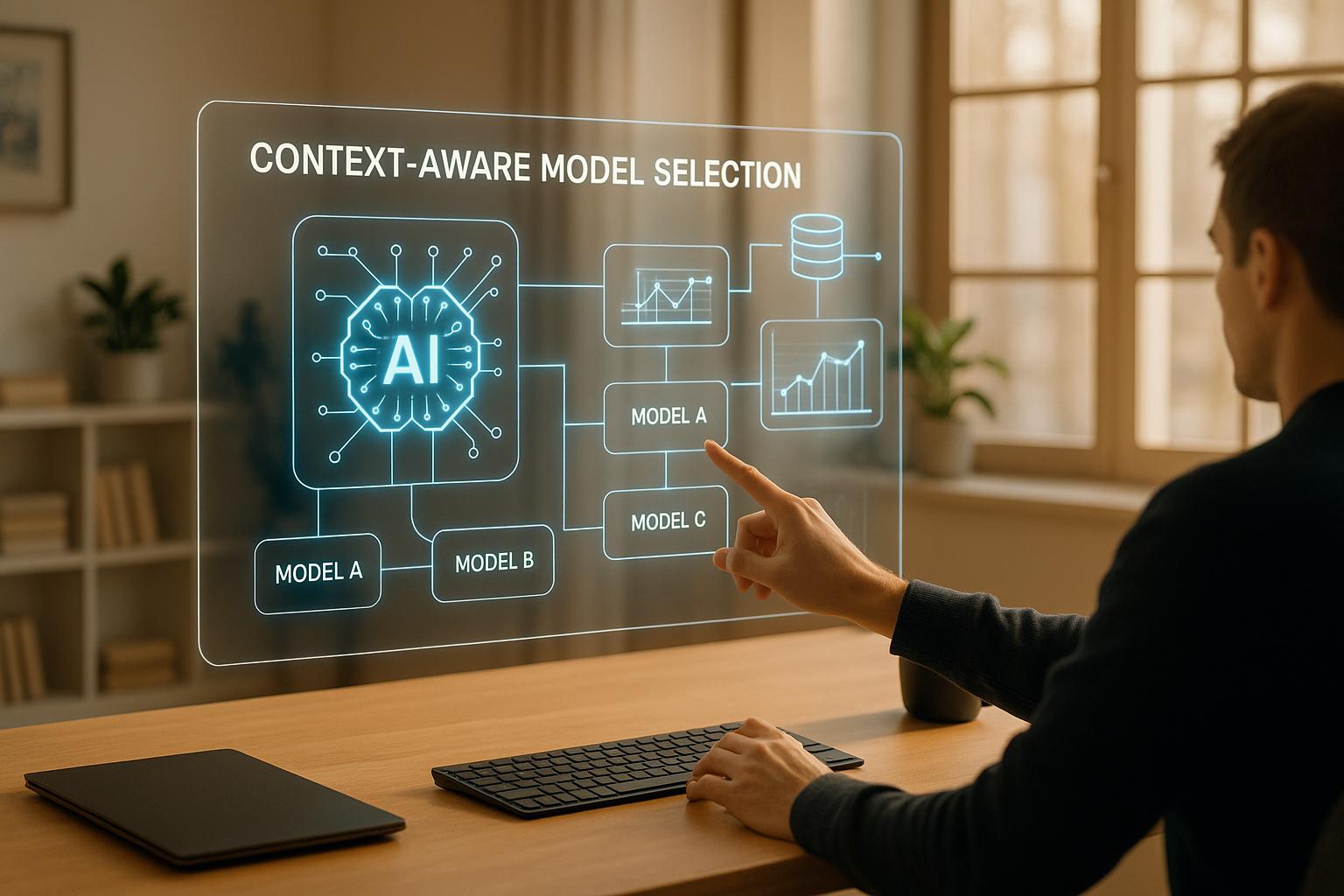

Los sistemas de IA son cada vez más inteligentes. La selección de modelos teniendo en cuenta el contexto permite a la IA adaptar sus decisiones en función de datos en tiempo real, lo que la hace más eficaz y personalizada. He aquí por qué es importante y cómo funciona:

Plataformas como prompts.ai haga que esta tecnología sea accesible simplificando los flujos de trabajo y reduciendo los costos. ¿Estás listo para aprender cómo la IA sensible al contexto está configurando el futuro? Vamos a sumergirnos.

En la IA, el contexto se refiere a toda la información relevante que da forma a una interacción. El investigador Anind Dey lo define como: «cualquier información que pueda usarse para caracterizar la situación de una entidad. Una entidad es una persona, lugar u objeto que se considera relevante para la interacción entre un usuario y una aplicación, incluidos el propio usuario y la aplicación».

El contexto implica una combinación de factores: la intención del usuario, las condiciones ambientales, los datos históricos y las entradas en tiempo real. Esta comprensión es la columna vertebral de cómo los sistemas se adaptan y responden de manera inteligente.

Tomemos un sistema de navegación por satélite, por ejemplo. Su entrada contextual principal es tu ubicación actual, que utiliza para ajustar los mapas y sugerir rutas en tiempo real. En un nivel más avanzado, SpotifyEl motor de recomendaciones tiene en cuenta elementos como la letra, el estado de ánimo, el tempo y el sentimiento para sugerir pistas que se ajusten a tus preferencias.

Los sistemas sensibles al contexto se destacan porque incorporan varias funciones críticas:

Esta es una comparación rápida entre la automatización tradicional y los sistemas basados en inteligencia artificial y sensibles al contexto:

A pesar de las capacidades de los sistemas conscientes del contexto, ignorar el contexto puede tener graves consecuencias. Sin él, las decisiones a menudo se toman sobre la base de información incompleta o inexacta, a veces con resultados devastadores.

Por ejemplo, durante la retirada de Estados Unidos de Afganistán en agosto de 2021, un sistema de guía de drones clasificó erróneamente un automóvil cerca de un aeropuerto como una amenaza, lo que tuvo consecuencias trágicas. El algoritmo no tuvo en cuenta las sutiles señales ambientales, lo que puso de manifiesto los peligros de una conciencia contextual insuficiente.

Este problema, a menudo denominado «desajuste de conciencia», se produce cuando hay una brecha entre lo que los usuarios entienden sobre una situación y lo que percibe el sistema. Ignorar el contexto también puede generar sesgos. El proyecto Gender Shades reveló que los sistemas de reconocimiento facial funcionaban mal en mujeres de piel más oscura debido a datos de entrenamiento erróneos. Del mismo modo, un sistema del Departamento de Trabajo y Pensiones del Reino Unido perfilaba injustamente a las personas en función de su edad, discapacidad y nacionalidad, en lugar de centrarse en actividades fraudulentas reales.

Incluso las empresas se enfrentan a desafíos. Según McKinseySegún una investigación de 2024, el 72% de las empresas utilizan la IA para mejorar la participación de los clientes, pero muchas tienen dificultades para comprender el contexto. Dado que hasta un 38,6% de los datos de formación pueden estar sesgados, la ausencia de contexto puede perpetuar y amplificar estos problemas.

Para abordar estos desafíos, incorporar la conciencia contextual en los sistemas de IA no es negociable. Los sistemas deben buscar y analizar activamente los detalles contextuales para cada decisión. Esto implica crear espacios de características jerárquicos para identificar los factores clave que influyen en el comportamiento, garantizar la transparencia en la forma en que se utilizan las entradas sensoriales y definir los parámetros para los diferentes contextos.

El cambio dinámico de modelos refina los sistemas de IA al permitirles alinear sus puntos fuertes con tareas específicas en tiempo real. Este enfoque garantiza que se seleccione el modelo más adecuado en función de la tarea en cuestión, lo que mejora la eficiencia y la eficacia. Por ejemplo, NetflixEl motor de recomendaciones y los sistemas de monitoreo de transacciones de los bancos demuestran cómo los diferentes modelos sobresalen en áreas especializadas, al integrarse a la perfección en los flujos de trabajo para mejorar los resultados.

Conmutación basada en reglas se basa en reglas predefinidas para determinar qué modelo usar. Estas reglas, a menudo elaboradas por expertos humanos, se activan en función de condiciones específicas, como el tipo de datos, la ubicación o la complejidad de las tareas. Las instituciones financieras utilizan con frecuencia este método para el cumplimiento y la validación, donde la explicabilidad es crucial. Sin embargo, a medida que aumenta el número de reglas, la escalabilidad se convierte en un desafío.

Selección basada en datos y activada por eventos procesa datos de eventos en vivo para ajustar los flujos de trabajo en tiempo real. Por ejemplo, el procesamiento del lenguaje natural (PNL) ayuda a la IA a comprender la intención y el contexto del usuario, lo que mejora el enrutamiento de las tareas. Una empresa de fabricación que adoptó esta estrategia para un control de calidad basado en la inteligencia artificial redujo las tasas de defectos en un 27% y procesó los datos de inspección 15 veces más rápido que los inspectores humanos. Este método prospera en entornos dinámicos, ya que se adapta continuamente a condiciones cambiantes, como el tipo de producto, la velocidad de la línea o el historial de defectos.

Enfoques de metaaprendizaje lleve la adaptabilidad al siguiente nivel. Estos sistemas aprenden a aprender, lo que permite una rápida adaptación a nuevas tareas con un mínimo de datos al aprovechar los conocimientos de las experiencias de aprendizaje anteriores. Por ejemplo, SciPlay, una empresa de juegos móviles, implementó el metaaprendizaje para optimizar sus estrategias de marketing. Al cambiar entre modelos adaptados a los diferentes juegos y comportamientos de los jugadores, ahorraron millones en gastos de marketing y, al mismo tiempo, mantuvieron una precisión de más del 90% en la selección de modelos. Este enfoque es particularmente efectivo en escenarios diversos y que cambian rápidamente.

Modelo Mesh Integración combina varios modelos de forma dinámica para abordar una variedad de casos de uso. Esta estrategia integra modelos lingüísticos de gran tamaño, como GPT-4o para tareas creativas, Claudio 3.5 para trabajos analíticos y modelos privados como Mistral para necesidades especializadas. Al cambiar de forma inteligente entre modelos, este método garantiza que se utilice la herramienta más adecuada para cada tarea, lo que permite realizar flujos de trabajo complejos en varios dominios.

Cada estrategia tiene sus puntos fuertes y limitaciones, lo que las hace adecuadas para diferentes aplicaciones:

Un proveedor de atención médica implementó estas estrategias con gran eficacia: redujo los costos de procesamiento en un 42%, mejoró la precisión del 91% al 99,3% y aceleró los ciclos de pago en 15 días, lo que permitió ahorrar 2,1 millones de dólares al año en gastos de reprocesamiento.

Para implementar correctamente la conmutación dinámica de modelos, comience con procesos de gran volumen basados en reglas antes de pasar a flujos de trabajo más complejos. Asegúrese de que su sistema sea capaz de procesar datos en tiempo real y utilizar la PNL para capturar el contexto. Esta base prepara sus flujos de trabajo de IA para las operaciones en tiempo real.

Dicho esto, los desafíos persisten. Se estima que es posible que alrededor del 90% de los pilotos de IA generativa de Proof of Concept no pasen pronto a la fase de producción. Superar estos obstáculos requiere equipos de IA dedicados, fomentar la colaboración y crear una infraestructura sólida, que incluya la contenedorización, las herramientas de orquestación y los sistemas de monitoreo integrales.

Para implementar la selección de modelos con reconocimiento del contexto de manera eficaz, necesita una infraestructura que conecte sin problemas los modelos, los datos y los procesos empresariales. Los sistemas de IA deben dejar de gestionar tareas aisladas para formar flujos de trabajo interconectados que puedan adaptarse de forma dinámica a los contextos y necesidades en evolución. Lograr este nivel de integración depende de los estándares de interoperabilidad, que permiten que los diferentes modelos de IA y sistemas externos se comuniquen sin problemas. A continuación se detallan los elementos críticos necesarios para crear estos flujos de trabajo conectados y sensibles al contexto.

La creación de flujos de trabajo que admitan la selección de modelos teniendo en cuenta el contexto implica la colaboración de varios componentes esenciales. Estos elementos garantizan el cambio dinámico de modelos y la adaptabilidad que requieren las aplicaciones de IA modernas.

Sobre la base de estos componentes fundamentales, prompts.ai simplifica el proceso de creación de flujos de trabajo sensibles al contexto. Ofrece acceso a más de 35 modelos de lenguaje de IA a través de una plataforma unificada, lo que garantiza una interoperabilidad perfecta entre los principales LLM. Los flujos de trabajo de IA de prompts.ai se adaptan automáticamente a los escenarios cambiantes, lo que permite a los usuarios comparar los modelos en paralelo y experimentar con estrategias adaptadas al contexto mediante herramientas integradas.

Funciones como la colaboración en tiempo real, las herramientas automatizadas para ventas y marketing y el manejo de datos multimodal facilitan el diseño y la implementación de los flujos de trabajo. Como destaca el experto en diseño de interfaz de usuario Heanri Dokanai:

«Haga que sus equipos trabajen juntos más estrechamente, incluso si están muy separados. Centralice las comunicaciones relacionadas con los proyectos en un solo lugar, intercambie ideas con pizarras blancas y redacte planes con documentos colaborativos».

El impacto de la plataforma se extiende también a las industrias creativas. Steven Simmons, director ejecutivo y fundador, comparte:

«Un director creativo ganador de un Emmy, solía pasar semanas haciendo renders y propuestas. Con los LoRaS y los flujos de trabajo de prompts.ai, ahora completa renderizaciones y propuestas en un solo día, sin tener que esperar ni preocuparse por las actualizaciones del hardware».

Además, prompts.ai modelo de pago por uso alinea los gastos con el uso real, lo que facilita a las organizaciones escalar sus implementaciones de IA sin grandes costos iniciales. Este enfoque ha ayudado a las empresas a ahorrar hasta un 98% en suscripciones. Los laboratorios de inteligencia artificial de la plataforma también permiten a los equipos probar modelos en entornos controlados antes de implementarlos en producción. Al convertir lo que antes requería un extenso desarrollo personalizado en flujos de trabajo configurables y escalables, prompts.ai aborda desafíos como la complejidad técnica, la administración de costos y la escalabilidad.

La selección de modelos teniendo en cuenta el contexto está demostrando su eficacia en varios sectores y ofrece resultados tangibles. Al aprovechar la conmutación dinámica de modelos, estas aplicaciones destacan el potencial transformador de la IA sensible al contexto. A continuación se muestran algunos ejemplos del mundo real que muestran cómo diferentes sectores utilizan esta tecnología para mejorar los resultados.

Gestión de infraestructuras urbanas: ETH Zúrich y Eawag implementó un modelo sensible al contexto para predecir los niveles de H₂S en los sistemas de drenaje urbano durante 2024-2025. El modelo alcanzó valores de R² entre 0,906 y 0,927, superando a los enfoques tradicionales.

Fabricación inteligente: En los entornos de la Industria 4.0, los sistemas sensibles al contexto ayudan a optimizar las líneas de producción y ayudan a los trabajadores mediante el ajuste dinámico de las operaciones en función de factores en tiempo real, como la disponibilidad de los trabajadores y las necesidades de producción.

Personalización del comercio electrónico: Los motores de recomendación basados en inteligencia artificial analizan el historial de compras, los hábitos de navegación y el comportamiento de los clientes para ofrecer sugerencias personalizadas y aumentar la participación y las ventas.

Diagnósticos de atención médica: Estos sistemas tienen en cuenta el historial del paciente, los síntomas actuales y las respuestas anteriores al tratamiento para proporcionar recomendaciones de diagnóstico más precisas en relación con las interacciones a largo plazo.

Negociación financiera: Los algoritmos sensibles al contexto evalúan las condiciones más amplias del mercado, lo que ayuda a los operadores a tomar decisiones informadas durante los períodos de alta volatilidad.

Estos ejemplos demuestran cómo la IA sensible al contexto mejora la eficiencia y, al mismo tiempo, ofrece beneficios mensurables, aunque persisten los desafíos.

Se ha demostrado que la selección de modelos teniendo en cuenta el contexto reduce las tasas de error en más de un 20% en comparación con los métodos tradicionales. Las experiencias personalizadas creadas por estos sistemas pueden aumentar la retención de usuarios entre un 40 y un 70% y, al mismo tiempo, reducir los costos de las API de LLM entre un 30 y un 60%.

Sin embargo, hay obstáculos que superar. La escasez de datos es un problema importante, especialmente en campos especializados o cuando se trata de nuevos usuarios con un historial de interacciones limitado. Los procesos empresariales complejos suelen basarse en el juicio humano y en información externa que la IA se esfuerza por modelar de forma eficaz. Además, muchos algoritmos de aprendizaje automático funcionan como «cajas negras», lo que dificulta la implementación de soluciones de IA explicables (XAI) y la obtención de la confianza de usuarios no expertos.

Por ejemplo, Bosch Automotive Electronics Portugal probó un sistema de apoyo a la toma de decisiones sensible al contexto para la previsión de la demanda de la cadena de suministro. Si bien el sistema utilizó con éxito los comentarios de las partes interesadas para seleccionar los métodos de XAI apropiados, también destacó los desafíos que supone encontrar un equilibrio entre la analítica avanzada y la comprensión del usuario.

La próxima generación de sistemas sensibles al contexto será aún más adaptable y responderá a los cambios contextuales dinámicos ajustando la priorización de la memoria en función de las necesidades cambiantes. La mejora de la interoperabilidad permitirá que estos sistemas se integren sin problemas en las infraestructuras existentes, reduciendo las barreras de implementación. El procesamiento contextual multimodal, que incorpora datos visuales, sonoros y de sensores, permitirá una toma de decisiones más sofisticada en una variedad de aplicaciones. Además, los diseños eficientes desde el punto de vista energético serán cada vez más importantes, especialmente para la computación móvil y perimetral, a medida que estos sistemas sigan ampliándose.

Estos avances están allanando el camino para flujos de trabajo más inteligentes y eficientes impulsados por una IA sensible al contexto, sentando las bases para una adopción e innovación más amplias en todos los sectores.

La selección de modelos teniendo en cuenta el contexto marca un alejamiento significativo de los sistemas de IA estáticos y únicos para todos. En cambio, introduce una forma dinámica e inteligente de tomar decisiones que se ajusta a las condiciones del mundo real en tiempo real. Este cambio refleja la creciente demanda de flujos de trabajo de IA que sean más receptivos y adaptables.

Las aplicaciones del mundo real muestran los beneficios tangibles de este enfoque. Por ejemplo, un sistema de gestión del tráfico metropolitano redujo los tiempos de viaje en un 20% al incorporar datos contextuales como los patrones temporales, las relaciones espaciales y el comportamiento de los usuarios. Estos sistemas prosperan al tener en cuenta una amplia gama de factores que los modelos tradicionales suelen pasar por alto.

Dicho esto, la implementación de la IA sensible al contexto no está exenta de desafíos. Las organizaciones deben abordar cuestiones como la escasez de datos, la complejidad de integrar sistemas avanzados y la naturaleza opaca de ciertos algoritmos. Un punto de partida práctico implica identificar casos de uso claros y aplicar gradualmente los conocimientos contextuales donde puedan tener el mayor impacto.

«La verdadera solución radica en conectar la IA con hechos gobernados, garantizando que sus resultados no solo sean precisos por casualidad, sino que se basen en una base de conocimiento verificable del mundo real». - Bryon Jacob, CTO de data.world

Plataformas como prompts.ai están avanzando a pasos agigantados en la democratización del acceso a la IA sensible al contexto. Al ofrecer más de 35 modelos de lenguaje de IA en una sola plataforma, junto con comparaciones paralelas y flujos de trabajo interoperables, las empresas pueden experimentar con un riesgo mínimo. Con precios de pago por uso que comienzan en 0 USD al mes y la posibilidad de consolidar más de 20 suscripciones y, al mismo tiempo, reducir los costos hasta en un 95%, incluso las organizaciones más pequeñas pueden explorar estas capacidades avanzadas de inteligencia artificial.

De cara al futuro, los sistemas de IA no solo decidirán qué para hacer, también determinarán cuando y cómo actuar. A medida que el mercado de la IA conductual se acerque a los 1.300 millones de dólares en 2030, las empresas que opten ahora por la selección de modelos teniendo en cuenta el contexto obtendrán una ventaja significativa. Las herramientas están disponibles. La oportunidad está aquí. La verdadera pregunta es: ¿su organización dará el salto?

La selección de modelos teniendo en cuenta el contexto permite que los sistemas de IA se ajusten dinámicamente en función del entorno, las preferencias y los comportamientos del usuario en tiempo real. Al aprovechar los datos contextuales (como la ubicación, el historial del usuario o las necesidades inmediatas), estos sistemas pueden crear experiencias que parezcan más personales y relevantes.

Esta capacidad mejora el rendimiento de la IA en varios sectores, incluidos el servicio al cliente, el marketing y la automatización del flujo de trabajo. Por ejemplo, puede refinar las respuestas de los chatbots para que se adapten mejor al usuario, ajustar las campañas de marketing para públicos específicos o hacer que los procesos operativos sean más eficientes. ¿El resultado? Ahorro de tiempo y valor añadido tanto para las empresas como para sus clientes.

La implementación de sistemas de IA sensibles al contexto no está exenta de obstáculos. Algunos de los mayores desafíos incluyen problemas de privacidad de datos, sesgo dentro de los algoritmos, y el complejidades técnicas de mantener el contexto. Además de eso, garantizar transparencia y justicia en los algoritmos no es poca cosa, pero es absolutamente crucial para ganarse la confianza y garantizar la confiabilidad.

Abordar estos desafíos requiere un enfoque multifacético. Utilizando conjuntos de datos diversos y de alta calidad durante el entrenamiento puede ayudar a reducir los sesgos y mejorar la precisión del sistema. La configuración de medidas de privacidad sólidas garantiza la protección de los datos confidenciales. Los marcos que enfatizan la equidad y la responsabilidad son clave para crear sistemas en los que los usuarios puedan confiar. Además, si damos prioridad a un diseño sólido del sistema y ajustamos la forma en que la IA maneja el contexto en las interacciones, podemos lograr un mejor rendimiento y resultados más confiables.

La conmutación basada en reglas funciona según un conjunto de reglas predefinidas, lo que la convierte en una opción práctica para entornos en los que las condiciones se mantienen estables. Su eficiencia y escalabilidad brillan en escenarios tan estables. Sin embargo, se queda corto cuando se enfrenta a situaciones nuevas o impredecibles, ya que carece de la capacidad de aprender o adaptarse de forma independiente.

El metaaprendizaje, por el contrario, prospera en entornos dinámicos. Puede procesar nuevos datos y ajustar los modelos sobre la marcha, lo que lo convierte en un sólido candidato para entornos que se encuentran en un estado de cambio constante. ¿Cuál es la contrapartida? Exige más recursos computacionales, lo que puede plantear desafíos para la escalabilidad, especialmente en aplicaciones con muchos recursos.

En pocas palabras, la conmutación basada en reglas es fundamental para realizar tareas consistentes y predecibles, mientras el metaaprendizaje se adapta mejor a los entornos que cambian rápidamente y en los que la flexibilidad es imprescindible.