使用智能提示路由优化 AI 支出

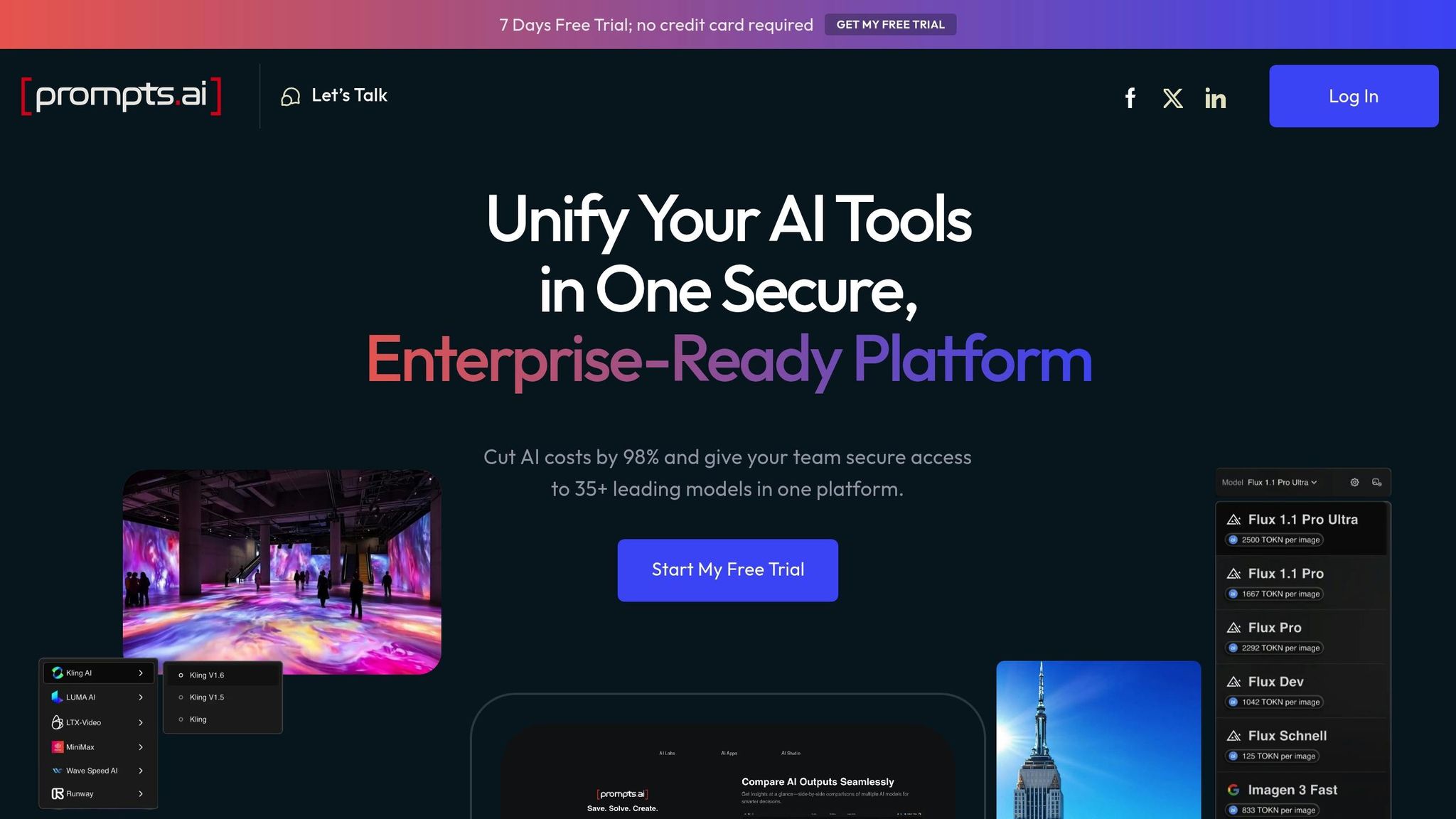

即时路由正在改变企业管理 AI 查询的方式,将每项任务定向到最合适的模型,从而确保高性能 削减成本。像这样的平台 prompts.ai、平台 B 和 Platform C 专门研究这个问题,提供的解决方案最多可以减少 AI 开支 99% 在不影响输出质量的情况下。以下是你需要知道的:

预计人工智能软件支出将达到高位 到 2027 年 3,000 亿美元,企业需要平衡性能和成本的工具。像这样的平台 prompts.ai 通过提供透明度、灵活性和可观的节省而脱颖而出,使其成为扩展 AI 运营的企业的理想之选。

快速比较:

诸如此类的平台可确保企业在控制开支的同时高效地扩展人工智能。无论您是对成本敏感、扩展运营还是寻求简便性,都有适合您需求的解决方案。

Prompts.ai 是一个 企业 AI 平台 它将超过 35 种大型语言模型汇集到一个安全统一的界面中。它专为从《财富》500强公司到创意机构等各种组织而设计,通过整合工具来简化人工智能管理,同时确保严格的治理和可控的成本。其先进的提示路由确保每个代币都提供最大价值。

Prompts.ai 使用动态系统将提示的复杂性与最合适的模型相匹配。通过其即用即付的TOKN积分系统,该平台最多可以将人工智能成本降低多达 98%,无需多次订阅。简单查询被定向到更快、成本更低的模型,而更复杂的任务只有在必要时才会路由到高级、成本更高的模型。

对于美国的企业,该平台提供 美元 ($) 货币报告 采用标准的美国数字格式,使投资回报率的计算简单易懂。这种本地化功能可确保财务报告与熟悉的会计惯例无缝一致。

Prompts.ai 使用强大的路由逻辑构建, 故障转移机制,以及实时监控,即使在需求高峰或模型中断期间也能提供稳定的性能。其企业级架构可确保顺畅稳定的即时处理,无论流量波动或意外中断如何。

该平台包括 自动重试 以及备用策略,这对于关键任务运营至关重要。高级分析持续跟踪性能指标,使系统能够根据模型的可用性和效率实时调整路由决策。

Prompts.ai 提供了广泛的 自定义选项,允许用户定义路由规则,选择首选型号或代理,并设置性能或成本阈值。这种灵活性使组织可以调整工作流程以适应其特定需求——无论是优先考虑客户支持的速度还是确保研究任务的精度。

两者都 视觉和基于代码的配置选项 可用,使技术团队和非技术用户都可以访问该平台。多代理协调和可自定义的提示流程确保了结构化、可追溯的流程。此外,该平台的治理工具可确保所有人工智能交互都符合企业级安全性和合规性标准。

prompts.ai 的一个突出特点是它的 集成的 FinOps 层,它可以跟踪所有代币并提供对人工智能支出的全面可见性。该平台的仪表板以易于理解的格式提供对代币消费、每次提示的成本和整体支出趋势的实时见解。

详细的指标,例如平均响应时间、按模型划分的代币使用量、每次提示的成本以及成功/失败率,使用户能够完善路由逻辑并解决效率低下的问题。内置预算警报可防止超支,强大的报告工具将人工智能支出直接与业务成果联系起来。对于需要证明投资回报率并对各个团队和应用程序进行严格预算监督的企业来说,这种透明度是非常宝贵的。

平台 B 与 prompts.ai 类似,专注于高效地将输入路由到最合适的语言模型。它优先考虑为每种代币获得最佳价值,同时保持稳定的运营并提供明确的成本可见性。通过在大型语言模型 (LLM) 和小型语言模型 (SLM) 之间动态定向提示,它可以在不牺牲性能的情况下显著节省成本。

Platform B 通过使用智能路由来分析每个提示的任务类型、域和复杂性而脱颖而出。这样可以确保将提示定向到最具成本效益的模型。这种方法至关重要,因为优质的人工智能模型可以达到 贵188倍 每个提示音的型号都比小型机型。

例如,该平台采用Arcee-Blitz之类的模型,其成本仅为 每百万个输出代币 0.05 美元 和 每百万个输入代币 0.03 美元。这意味着可以节省 每百万个代币 17.92 美元 与只播放《十四行诗》相比。

一个实际用例涉及营销团队使用该平台的自动模式创建LinkedIn帖子。成本?只是 0.00002038 美元,而不是 0.003282 美元 对于 Claude-3.7-Sonnet 来说-太惊人了 成本降低 99.38%。同样,对于工程工作流程,Virtuoso-Medium 模型处理了开发人员的常规问题 0.00018229 美元,相比于 0.007062 美元 配有 Claude-3.7-Sonnet,交付 节省 97.4% 每个提示音。

平台 B 不仅可以节省成本;它还能确保可靠的性能。对于常规任务,它将提示路由到更小、更快的模型。当面对需要高级推理的更复杂的查询时,它会将任务升级到诸如Claude-3.7-Sonnet之类的强大模型。

该平台还提供了 兼容OpenAI的端点,简化了与现有系统的集成。这种兼容性最大限度地减少了对重大基础架构变更的需求,降低了实施风险并确保了与当前工作流程的顺畅连接。

平台 B 支持多种路由策略,包括 静态和动态路由, LLM 辅助路由, 语义路由,以及 混合方法。组织可以使用专有数据微调分类器和嵌入模型,从而提高分类准确性并优化路由决策。这种定制允许透明、实时的成本跟踪,同时适应特定的业务需求。

在大规模金融业务中,平台B取得了显著成果,其中包括 成本降低 99.67% 和 处理时间缩短了 32% -14 秒,而 Claude-3.7-Sonnet 为 20.71 秒。通过智能选择模型,该系统最多可以削减人工智能处理成本 85% 的财务运营。此外,用户可以随着时间的推移完善参考提示集,确保路由决策与实际使用模式保持一致,从而进一步提高成本效率。

平台 C 利用亚马逊 Bedrock 的智能路由,提高即时交付的效率。其完全托管的系统侧重于平衡成本和性能,无需大量的技术投入。通过集成内置智能,该平台简化了路由流程,节省了时间和资源。

平台 C 通过亚马逊 Bedrock 的智能路由节省成本,它可以 在保持准确性的同时,最多可降低 30% 的成本。其定价模型反映了对效率的关注。对于诸如基本问题分类之类的简单任务, 亚马逊 Titan Text G1 — Express 模型 成本只是 每 1,000 个输入代币 0.0002 美元。对于语义路由, 亚马逊 Titan 文本嵌入 V2 模型 最大限度地创建问题嵌入 每 1,000 个输入代币 0.00002 美元。

对于更高级的需求,该平台可以无缝过渡到高级型号。 人类's Claude 3 Haiku 专为与历史相关的查询而设计,定价为 每 1,000 个输入代币 0.00025 美元,每 1,000 个输出代币 0.00125 美元。同样, Claude 3.5 十四行诗 处理数学问题,充电 每 1,000 个输入代币 0.003 美元,每 1,000 个输出代币 0.015 美元。

为了进一步优化开支,Platform C采用了即时缓存,将成本削减了90%,延迟减少了85%。此功能对于重复查询或标准化工作流程的企业尤其有利。

除了成本优势外,该平台还通过强大的运营措施确保可靠的性能。

平台 C 是围绕一个构建的 完全托管的服务模式 这样就无需自定义配置或持续维护。这种方法可以最大限度地降低运营风险,同时提供稳定的性能。

该平台的可靠性源于其与 Amazon Bedrock 基础设施的集成,这确保了企业级稳定性和正常运行时间。其智能路由系统主动监控模型性能和可用性,根据需要自动重新路由流量,以保持无缝服务。

但是,平台 C 有一些局限性,尤其是 模型托管灵活性。它仅支持在 Amazon Bedrock 和同一模型系列中托管的模型。这种限制可能会给需要外部模型托管或跨家族路由功能的组织带来挑战。

虽然 Platform C 强调简单性和效率,但它还提供基本的工作流程自定义。它提供了 针对成本和性能的预定义优化,适用于大多数标准用例。该平台同时支持两者 LLM 辅助路由 使用分类器模型和 语义路由 通过基于嵌入的方法。

用户可以在亚马逊 Bedrock 生态系统中配置路由策略,但该平台提供 对路由逻辑和优化标准的控制有限 与完全定制的解决方案相比。易用性与灵活性之间的这种平衡使其成为重视快速实施而不是精细控制的组织的绝佳选择。

平台 C 与 Bedrock 的分析工具无缝集成,提供代币使用和成本的实时跟踪。其实时仪表板提供了详细的见解,包括代币总消费、每个模型的成本和使用模式,可以立即调整预算。

该平台还提供特定模型的细分信息,显示 每种模型的代币使用量和成本。这些见解使经理能够创建数据驱动的报告,清楚地向领导层展示投资回报率。通过提供这种程度的透明度,Platform C可以帮助组织避免常见的陷阱,例如 预算管理不善、合规性问题和缺乏优化清晰度。

在管理即时路由方面,每个平台都有独特的优势和局限性。以下是详细的对比,可帮助您根据具体需求和预算考虑因素权衡选项。

透明度是这些平台运营价值的基石。由于70%的消费者偏爱公开分享其做法的企业,这种对清晰度的要求延伸到了企业人工智能解决方案。各组织越来越期望获得代币使用和成本的详细可见性,因为这种透明度支持预算调整并增强了对平台的信任。

通过提供实时代币跟踪,平台不仅可以改善预算管理,还可以提供对投资回报率(ROI)的清晰见解。这种可见度对于数据驱动的决策至关重要,可以帮助企业最大限度地提高其人工智能投资的价值。

另一个需要考虑的关键因素是定制和简单性之间的权衡。例如,而 平台 C 提供了用户友好的界面,它对同一个家族中由亚马逊Bedrock托管的模型的依赖限制了其灵活性。尽管有这些限制,它仍然可以取得成果。一家通过AWS Bedrock使用智能提示路由的法律技术公司报告说,在短短60天内,成本降低了35%,响应时间缩短了20%。

该示例突出表明,即使是有限制的平台在与特定的运营目标保持一致时也可以带来实质性的好处。

平台的成本结构会显著影响其整体价值。对于工作量波动的组织,TOKN积分等即用即付模式可能是一个明智的选择,无需长期承诺即可提供财务灵活性。另一方面,托管服务对于优先考虑易用性和操作简便性而不是精细控制的团队来说是理想的选择。

定制也起着重要作用。提供自定义提示路由的平台允许组织微调路由逻辑和优化标准。但是,这种控制水平增加了管理定制系统的复杂性,这可能不适合每个团队。

实时性能监控使企业级平台与众不同。此功能支持持续优化,提供有关系统性能和投资回报率的即时反馈。对于希望保持竞争力的企业来说,快速做出明智调整的能力是无价的。

根据我们的分析, prompts.ai 是平衡性能、成本管理和运营透明度的理想选择。该平台不仅符合前面概述的关键标准,而且还增强了在当今人工智能驱动的环境中蓬勃发展所需的财务和运营能力。它可以访问超过35种顶级型号,对于希望在不影响质量的情况下实现价值最大化的企业来说,这是一个明智的选择。

这些数据突显了高效的人工智能路由的强大影响。企业报告称,如果正确实施人工智能,成本将降低85-90%,收支平衡点通常达到每年50,000—55,000次互动。考虑到人工智能代理每次交互的成本仅为0.25至0.50美元,而人工代理的费用为3.00至6.00美元,智能路由的财务收益是显而易见的,可衡量的。

到2027年,人工智能软件支出预计将接近3000亿美元,97%的高管计划增加对生成式人工智能的投资。但是,标普全球数据显示,到2025年,42%的公司将放弃大多数人工智能项目,这通常是由于成本高昂和价值不明确。在这一背景下, prompts.ai 凭借其透明的代币跟踪和实时的投资回报率监控脱颖而出,确保花费的每一美元都能带来可衡量的结果。这些财务工具提供了许多组织认为其他解决方案所缺乏的清晰度和问责制。

对于大多数企业来说, prompts.ai 在功能、成本控制和可扩展性之间取得了完美的平衡。其专家工作流程、活跃的用户社区和久经考验的成本节约能力使其成为一个出色的选择。AI 实施的投资回收期通常仅为 4-6 个月,该平台通过更好的资源分配和切实可行的见解来提高效率并提供竞争优势。

Prompts.ai 的 即时路由 系统旨在通过将任务与最合适的人工智能模型进行匹配来削减成本。更简单的提示指向预算更友好的模型,而更高级的模型则留给处理复杂的任务。这种明智的分配可确保在省钱和保持可靠性能之间取得平衡。

该系统的另一个优势是它能够减少代币的使用量,在不牺牲准确性的情况下为用户提供更多价值。通过实时跟踪代币消费,用户可以密切关注其投资回报率,并根据数据见解微调工作流程,以实现最高效率。

使用 prompts.ai,根据您的特定需求量身定制 AI 工作流程非常简单。这个 可视化工作流程生成器 允许您创建多代理管道,将提示和代理汇集到一个有组织的空间中。为了处理更复杂的任务,你可以实现 多步提示链接,同时关注代币的使用情况 实时 以更好地控制成本。

诸如此类的功能 版本控制 和 性能分析 提供微调工作流程的工具,确保它们尽可能高效地运行。这些功能使您可以轻松调整人工智能流程并提供清晰、可衡量的结果。

这个 实时成本跟踪 Prompts.ai 中的功能通过持续监控代币使用情况和相关成本,帮助企业保持对人工智能支出的控制。这种持续的监督使团队能够快速进行调整,避免不必要的支出,并确保预算得到有效管理。

通过提供对支出趋势的清晰见解,企业可以更明智地分配资源,提高绩效,并看到人工智能投资的切实回报。