في مشهد الذكاء الاصطناعي سريع الحركة، لم تعد الحوكمة اختيارية. يمكن للأدوات المناسبة تبسيط الامتثال وخفض التكاليف والتأكد من أن سير العمل الخاص بك يفي باللوائح العالمية مثل قانون الاتحاد الأوروبي AI و NIST AI RMF. تستعرض هذه المقالة ست منصات رائدة - Prompts.aiو DataRobot و Collibra و Alation و OneTrust و Credo AI - كل منها يوفر نقاط قوة فريدة لإدارة تدفقات عمل الذكاء الاصطناعي بأمان وكفاءة. تشمل الميزات الرئيسية المراقبة في الوقت الفعلي والتوثيق الآلي وأطر الامتثال المركزية.

أبرز الملامح:

مقارنة سريعة (جدول تخفيض السعر):

مع فقط 18% من بين الشركات التي تتبنى أطر الحوكمة بشكل كامل، يعد اختيار الأداة المناسبة أمرًا بالغ الأهمية - خاصة مع دخول قانون الاتحاد الأوروبي للذكاء الاصطناعي حيز التنفيذ أغسطس 2026. سواء كنت بحاجة إلى توفير التكاليف أو التتبع التفصيلي أو الامتثال الآلي، توفر هذه المنصات حلولًا مصممة خصيصًا لتوسيع نطاق الذكاء الاصطناعي بشكل مسؤول.

مقارنة أدوات الامتثال لحوكمة الذكاء الاصطناعي: الميزات والتسعير وأفضل حالات الاستخدام

تبرز Prompts.ai كمنصة تنسيق للذكاء الاصطناعي مصممة لتبسيط وتوحيد الوصول إلى أكثر من 35 نموذجًا لغويًا كبيرًا من خلال واجهة واحدة آمنة. إنه يعالج تحديًا كبيرًا للمؤسسات التي تطغى عليها إدارة أدوات الذكاء الاصطناعي المتعددة - مما يلغي الحاجة إلى التوفيق بين العديد من عقود البائعين وعمليات تسجيل الدخول وأطر الامتثال. من خلال تقديم لوحة تحكم مركزية، تمكّن المنصة الفرق من تبسيط العمليات مع الحفاظ على السيطرة الكاملة على الحوكمة، بما في ذلك إنفاذ السياسات ومسارات التدقيق والامتثال التنظيمي. يضمن هذا الدمج عمليات أكثر سلاسة ورقابة أقوى.

يركز Prompts.ai على تبسيط سير العمل من خلال الجمع بين العمليات غير المتصلة معًا. يمكن للفرق استخدام عمليات سير العمل المضمنة، والمعروفة باسم «توفير الوقت»، لإنشاء عمليات قابلة للتكرار ومتوافقة التي تتوافق مع أفضل الممارسات. بدلاً من السماح للموظفين بالتجربة في صوامع، تعمل المنصة على توحيد التفاعلات مع نماذج اللغة، مما يضمن نتائج متسقة ويقلل من مخاطر الاستخدام غير المتوافق. بالإضافة إلى ذلك، يسمح النظام بإجراء مقارنات جنبًا إلى جنب بين النماذج المختلفة، مما يمكّن الفرق من تقييم واختيار الأنسب لمهام محددة، كل ذلك مع الحفاظ على بروتوكولات الحوكمة الصارمة.

تعطي المنصة الأولوية حوكمة على مستوى المؤسسة من خلال الدمج بسلاسة مع أطر الامتثال الرئيسية. وهو يدعم المعايير الأمريكية مثل NIST AI RMF و HIPAA و OCC SR 11-7، إلى جانب اللوائح الدولية مثل ISO 42001 وقانون الاتحاد الأوروبي للذكاء الاصطناعي. يقوم Prompts.ai تلقائيًا بتسجيل جميع تفاعلات الذكاء الاصطناعي، وإنشاء سجل قابل للتدقيق يتوافق مع كل من السياسات الداخلية والمتطلبات التنظيمية الخارجية. تقلل هذه الأتمتة من الجهد اليدوي المتضمن في تقارير الامتثال وتساعد المؤسسات على إظهار الالتزام أثناء عمليات التفتيش التنظيمية أو عمليات التدقيق.

عروض Prompts.ai المراقبة في الوقت الحقيقي لتفاعلات الذكاء الاصطناعي عبر المؤسسة، وتتبع المقاييس مثل أنماط الاستخدام، وخيارات النماذج، والتاريخ الفوري. تفرض المنصة ضمانات لحماية البيانات الحساسة وتحديد سوء الاستخدام المحتمل. من خلال التتبع التفصيلي، يمكن للمؤسسات تتبع أي مخرجات تم إنشاؤها بواسطة الذكاء الاصطناعي إلى المستخدم والنموذج والموجه المسؤول عن إنشائها. هذه الشفافية لا تقدر بثمن لتلبية المتطلبات التنظيمية والحفاظ على المساءلة الداخلية، وضمان التوازن بين الحوكمة والكفاءة التشغيلية.

إضافة إلى نقاط القوة التشغيلية، يتضمن Prompts.ai ملف طبقة FinOps يتتبع استخدام الرمز المميز في جميع النماذج، مما يوفر رابطًا واضحًا بين نفقات الذكاء الاصطناعي والنتائج. بدلاً من التعامل مع الرسوم المخفية أو الفواتير غير المتوقعة، تكتسب المؤسسات رؤية كاملة للتكاليف حسب الفريق أو المشروع أو حالة الاستخدام في الوقت الفعلي. تقدم المنصة أرصدة TOKN للدفع أولاً بأول بدءًا من 0 دولارًا للاستكشاف الأولي، مع خطط عمل تتراوح أسعارها بين 99 دولارًا و 129 دولارًا لكل عضو شهريًا. من خلال دمج اشتراكات البائعين المتعددين في نظام واحد، تدعي Prompts.ai أنها يمكن أن تساعد المؤسسات على تقليل نفقات برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪.

يعد تحقيق التوازن بين الكفاءة والامتثال أمرًا بالغ الأهمية في حوكمة الذكاء الاصطناعي، ويقوم DataRobot بالتوصيل على كلا الجبهتين. تحظى منصة حوكمة الذكاء الاصطناعي الشاملة هذه بثقة مؤسسات مثل Freddie Mac و NZ Post، وهي تتمتع بتصنيف 4.7/5 مثير للإعجاب على Gartner Peer Insights، مع استعداد 90٪ من المستخدمين للتوصية بها. تم تصميم DataRobot لإدارة الذكاء الاصطناعي التنبئي والتوليدي والفعّال، وهو يساعد المؤسسات في الحفاظ على السيطرة على محافظ الذكاء الاصطناعي المتنامية مع تلبية المعايير التنظيمية الصارمة في صناعات مثل الخدمات المالية والرعاية الصحية والقطاع العام. يعمل هذا النهج القوي على تبسيط إدارة سير العمل وتعزيز الامتثال.

يعمل DataRobot على تبسيط العمليات من خلال التكامل مع أدوات مثل Apache Airflow، مما يمكّن الفرق من أتمتة تدفقات عمل الذكاء الاصطناعي المجمعة دون إشراف يدوي. من خلال الاتصال بـ MLFlow، يقوم بدمج البيانات الوصفية والمعايير في سجل موحد. بالنسبة لأولئك الذين يستخدمون بالفعل منصات مثل Google Vertex أو Databricks أو Microsoft Azure، فإن ميزة «قابلية الملاحظة» في DataRobot تعزز الحوكمة دون تعطيل الإعدادات الحالية.

قال توم توماس، نائب رئيس استراتيجية البيانات والتحليلات وذكاء الأعمال في FordDirect: «تساعدنا DataRobot على نشر حلول الذكاء الاصطناعي في السوق في نصف الوقت الذي اعتدنا القيام به من قبل وإدارة رحلة الذكاء الاصطناعي بأكملها بسهولة».

لا يؤدي هذا التكامل السلس إلى تعزيز الكفاءة فحسب، بل يبسط أيضًا الامتثال للمتطلبات التنظيمية.

تقوم DataRobot بأتمتة الالتزام بالمعايير الرئيسية مثل NIST AI RMF و SR-117 وقانون مدينة نيويورك رقم 144 وكولورادو SB21-169 و AB-2013/SB-1047 في كاليفورنيا. كما أنه يتماشى مع إرشادات EEOC AI وإرشادات DIU المسؤولة للذكاء الاصطناعي. تعمل ميزة التوثيق بنقرة واحدة في المنصة على إنشاء تقارير جاهزة للتدقيق تربط بشكل مباشر سلوك النموذج الفني بمتطلبات قانونية محددة، مما يوفر ساعات لا حصر لها من العمل اليدوي. يمكن للمؤسسات المالية، على سبيل المثال، استخدام نماذجها المصممة خصيصًا لتوجيهات الاحتياطي الفيدرالي من 11 إلى 7 ريال سعودي بشأن إدارة المخاطر النموذجية.

توفر المنصة ضمانات في الوقت الفعلي لاكتشاف ومنع مشكلات مثل تسرب معلومات التعريف الشخصية والحقن الفوري والهلوسة والمخرجات السامة قبل وصولها إلى الإنتاج. يحافظ على مسار تدقيق شامل من خلال تتبع المطالبات والاستجابات ودرجات التقييم. يمكن تكوين التنبيهات المخصصة للتكامل مع أدوات SIEM الحالية، وتوفير إشعارات فورية إذا انحرفت النماذج عن حدود السياسة أو أظهرت انحرافًا.

قال لاكشمي بوروشوتامان، نائب رئيس الابتكار في علوم البيانات في فريدي ماك، «أصبحت قدرتنا على الاستفادة من علوم البيانات لمساعدتنا على تحديد الفوارق وإزالة الحواجز وتمكين القرارات المستنيرة... أسهل بكثير مع DataRobot.»

يدعم DataRobot النشر عبر مجموعة من البيئات، بما في ذلك الإعدادات السحابية والسحابة الخاصة والهجينة والمحلية والإعدادات ذات الفجوات الهوائية، مما يوفر المرونة لتلبية احتياجات الأمان المتنوعة. تعمل بيئة الحوسبة بدون خادم على تحسين تخصيص الموارد، مما يسمح للمستخدمين بتحديد أولويات التكلفة أو وقت الاستجابة أو التوفر حسب الحاجة. تضمن هذه البنية أن تظل سياسات الحوكمة متسقة، بغض النظر عن مكان تطوير أصول الذكاء الاصطناعي أو نشرها.

تواجه Collibra تحدي حوكمة الذكاء الاصطناعي المجزأة من خلال نهج النظام الأساسي الموحد. وقد حازت على التقدير كشركة رائدة في تقرير Gartner Magic Quadrant لعام 2025 لمنصات حوكمة البيانات والتحليلات وكأداء قوي في موجة Forrester لمنصات حوكمة الذكاء الاصطناعي (Q3 2025). اعتبارًا من ديسمبر 2025، حصلت على تقييمات رائعة للمستخدمين - 4.3/5 على Gartner Peer Insights و 4.5/5 على G2. تعالج هذه المنصة مشكلة صناعية ملحة: أوقفت 43٪ من المؤسسات مشاريع الذكاء الاصطناعي بسبب البيانات غير الموثوقة أو فجوات الحوكمة، بينما حققت 4٪ فقط نجاحًا قابلاً للتطوير في مجال الذكاء الاصطناعي.

تعمل Collibra على تبسيط حوكمة الذكاء الاصطناعي من خلال تركيز تناول حالات الاستخدام والتوثيق والملكية في نظام تسجيل مشترك. يعمل هذا النهج على مواءمة البيانات والذكاء الاصطناعي وفرق المخاطر منذ بداية المشروع. إنه يتكامل بسهولة مع منصات السحابة والذكاء الاصطناعي الرائدة مثل AWS و Azure و Google و Databricks و SAP. على سبيل المثال، يؤدي تكاملها مع Azure AI Foundry إلى أتمتة خياطة مجموعات البيانات والنماذج والوكلاء، مما يوفر تتبعًا كاملاً للنسب. يمكن لمستخدمي البيئة المخصصة أيضًا الاستفادة من دروس Python في Developer Portal لربط نماذج الذكاء الاصطناعي الخاصة. يضمن سير العمل المبسط هذا تضمين ضوابط الامتثال منذ البداية.

تدمج Collibra المعايير التنظيمية مباشرة في تدفقات عمل الذكاء الاصطناعي باستخدام قوالب التقييم المبنية مسبقًا لأطر مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي وإطار إدارة مخاطر NIST AI. يساعد هذا النهج المنظم المؤسسات على تجنب الغرامات الباهظة، والتي يمكن أن تصل إلى 35 مليون يورو أو 7٪ من الإيرادات السنوية العالمية لعدم الامتثال لقانون الاتحاد الأوروبي للذكاء الاصطناعي. تقوم المنصة بتعيين مسؤوليات الإشراف لمسؤولي الشؤون القانونية والخصوصية وحماية البيانات، مما يضمن المراجعة الشاملة. عرضت TELUS قدرات Collibra عندما نفذت كارين بوتوري، مديرة استراتيجية البيانات والتمكين، برنامج إدارة البيانات الوصفية، مما قلل الوقت المستغرق في البحث عن أصول البيانات بنسبة 83٪. عند الانتهاء من التقييمات، تقوم عمليات سير العمل المؤتمتة بتعيين المهام إلى Business Stewards استنادًا إلى المخاطر الموثقة وقيمة الأعمال.

تحتفظ Collibra بسجلات النماذج والوكلاء الشاملة التي تتعقب مراحل دورة الحياة والملكية وحالة الامتثال. يتم تسجيل كل خطوة من خطوات سير العمل، من المهام إلى القرارات، بدقة، مما يؤدي إلى إنشاء مسارات تدقيق مفصلة لتقارير الامتثال. أثناء عملية الموافقة، تقوم المنصة بإنشاء أصول مراجعة التقييم التي تحمل علامة «قيد المراجعة»، مما يدفع Business Stewards إلى إجراء تقييمات رسمية.

وسلّط تييري مارتن، رئيس بيانات المؤسسات والتحليلات في SAP، الضوء على فوائدها: «مع Collibra AI Governance، نهدف إلى تصور أي مجموعة بيانات، وتتبع استخدام نموذج الذكاء الاصطناعي الخاص بها، وتحديد المستهلكين النهائيين لها».

تضمن المنصة التتبع الكامل للنسب من بيانات المصدر إلى النشر، مما يجعلها جاهزة للتدقيق على نطاق واسع.

يتحكم تصميم Collibra غير القائم على النظام الأساسي في الذكاء الاصطناعي عبر AWS و Azure و Google و Databricks و SAP. يقوم نظام الحوكمة القائم على السياسة بتعيين تصنيفات المخاطر وفرض فحوصات جودة البيانات قبل النشر. يمكن تخصيص قوالب التقييم لإخطار المالكين والمحال إليهم عند بدء المهام أو تعيينها، مما يسهل مراجعات الامتثال في الوقت المناسب حتى عبر الفرق الموزعة. وهذا يضمن قدرة المؤسسات على توسيع نطاق مبادرات الذكاء الاصطناعي الخاصة بها بأمان وكفاءة.

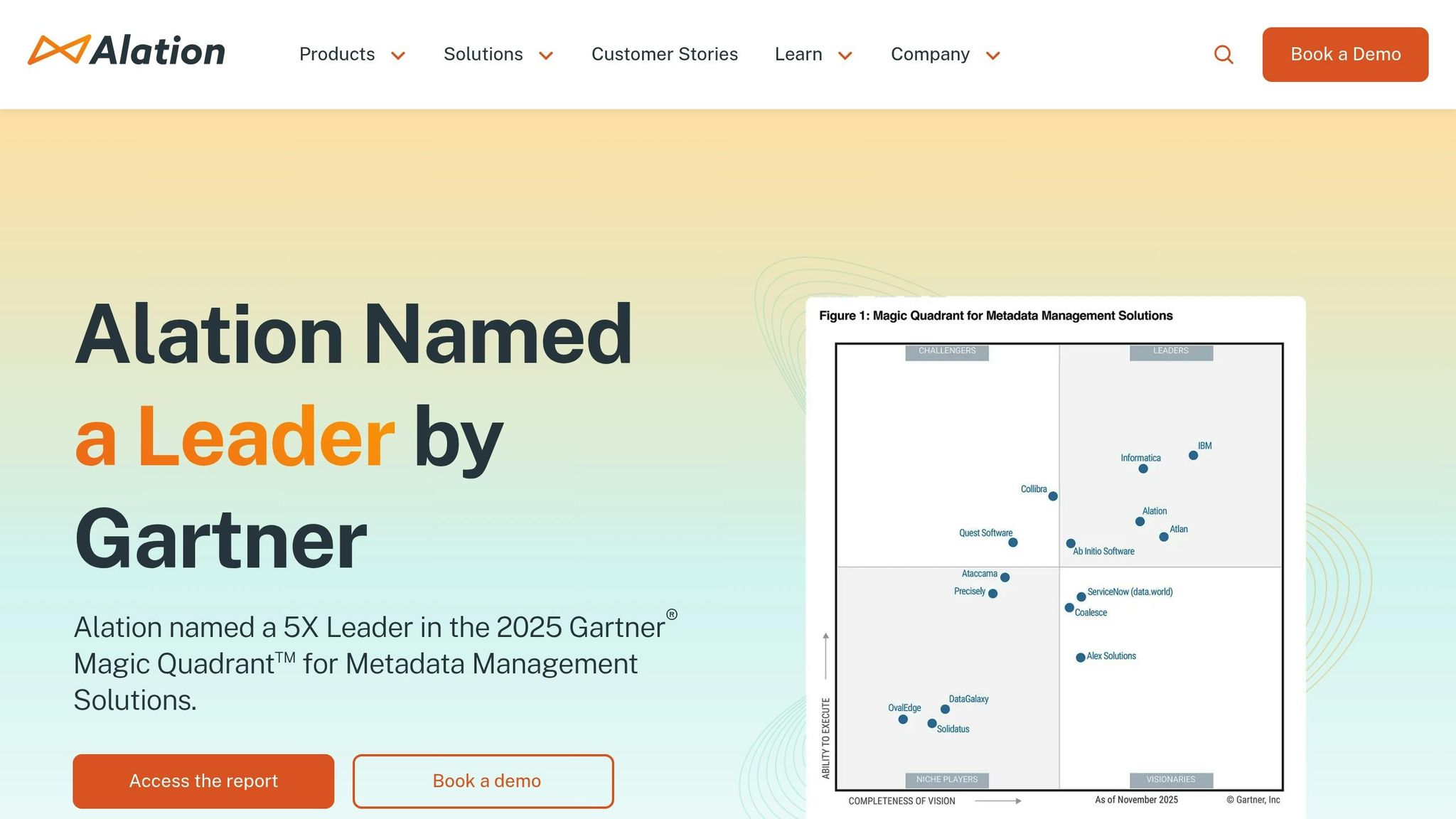

تعالج Alation واحدة من أصعب التحديات في مجال الذكاء الاصطناعي: توسيع المبادرات بما يتجاوز إثبات المفهوم. ومع تحقيق 11% فقط من هذه المشاريع للنجاح، غالبًا ما تقف فجوات الحوكمة والأمن في الطريق. حازت Alation على تقدير باعتبارها صاحبة رؤية في تقرير Gartner Magic Quadrant لعام 2025 لمنصات حوكمة البيانات والتحليلات وكرائدة في Forrester Wave لحلول إدارة البيانات (Q3 2025).

تدمج Alation الحوكمة بسلاسة في العمليات اليومية باستخدام افتح إطار الموصل، والتي تتضمن أكثر من 120 موصلًا مُصممًا مسبقًا خصيصًا لأنظمة المؤسسات. إنه يتكامل بسهولة مع الأدوات الشائعة مثل سلاك ومايكروسوفت تيمز وجيرا وسيرفيسناو. ال مركز سير العمل يعمل كمحور مركزي يدير طلبات التغيير والموافقات لكائنات البيانات. يتم توجيه التغييرات المقترحة إلى المراجعين المعينين، مما يضمن فحص التحديثات بعناية قبل ظهورها في الكتالوج.

المنصة استوديو الوكيل يقدم كلاً من SDK وقوالب بدون كود لإنشاء وكلاء AI محكومين. يرث هؤلاء الوكلاء تلقائيًا ضوابط الوصول والسياسات التنظيمية، ويبسطون المهام مثل إثراء البيانات الوصفية وتنفيذ السياسة. تسلط دراسة Forrester الضوء على كيف يمكن لأدوات Alation تعزيز التعاون في مجال البيانات بنسبة تصل إلى 25٪. بالإضافة إلى ذلك، يقلل مدير CDE الخاص به من تكاليف إدارة عناصر البيانات الهامة بنسبة 70٪، مع قيام الوكلاء الآليين بتوفير متوسط سبعة أيام لكل عنصر أثناء الإعداد. من خلال دمج الأدوات والعمليات، تضع Alation الأساس لقدرات الامتثال والتدقيق القوية.

تمتد قوة Alation في التكامل إلى أطر الامتثال العالمية الرئيسية، بما في ذلك قانون الاتحاد الأوروبي للذكاء الاصطناعي، وإطار NIST لإدارة مخاطر الذكاء الاصطناعي، ومبادئ منظمة التعاون الاقتصادي والتنمية في الميدان الاقتصادي، واللائحة العامة لحماية البيانات، وCCPA. وتحتفظ بسجل أصول الذكاء الاصطناعي المركزي لفهرسة مجموعات بيانات التدريب، ومطالبات LLM، ونماذج الذكاء الاصطناعي، ونقاط نهاية API، مما يضمن إمكانية التتبع الشامل عبر مشهد الذكاء الاصطناعي. استخدام قوالب بطاقة نموذجيةتقوم Alation بتوحيد وثائق الذكاء الاصطناعي، مما يوفر لأصحاب المصلحة والمراجعين الوضوح بشأن أنواع النماذج وبيانات التدريب والالتزام بالمعايير الأخلاقية.

قال سيباستيان كاوس، رئيس إدارة البيانات في Vattenfall: «تتطلب اللائحة العامة لحماية البيانات (GDPR) منا معرفة مكان وجود بياناتنا وكيفية معالجتها. نظرًا لأننا نخزن هذه المعلومات في Alation، يصبح من الأسهل بكثير بالنسبة لنا أن نكون متوافقين.»

المنصة مركز السياسات يركز جميع سياسات البيانات ويوظف أعلام الثقة لتوجيه المستخدمين نحو بيانات عالية الجودة ومتوافقة مع وضع علامة على مجموعات البيانات غير المتوافقة. مع مجموعات الكتالوجات4، تقوم Alation تلقائيًا بتصنيف البيانات الجديدة وتطبيق السياسات ذات الصلة، مع مواكبة التدفق السريع للمعلومات.

يوفر Alation تتبعًا تفصيليًا للنسب على مستوى العمود من مصادر البيانات إلى نماذج الذكاء الاصطناعي، مما يضمن قابلية التدقيق الشاملة. ال مركز سير العمل يسجل كل طلب تغيير وموافقة، مما يؤدي إلى إنشاء مسارات تدقيق شاملة لتقارير الامتثال.

في أكتوبر 2024، اعتمدت Interac حل حوكمة الذكاء الاصطناعي من Alation لإنشاء مخزون نموذجي مركزي. أشار إيليا جيلين، رئيس إدارة البيانات والذكاء الاصطناعي/التعلم الآلي في Interac، إلى ما يلي:

«بينما نقوم بتوسيع نطاق مبادرات الذكاء الاصطناعي الخاصة بنا، توفر Alation الشفافية وإمكانية التتبع والحوكمة اللازمة لبناء النماذج التحليلية وتوثيقها والتحقق من صحتها بثقة.»

تستفيد المنصة أيضًا من علامات جودة البيانات وتتبع النسب لضمان بقاء نماذج الذكاء الاصطناعي دقيقة ومحدثة ومتوافقة مع المعايير التشغيلية.

يدعم تصميم Alation المحايد للبائع البيئات متعددة السحابات والهجينة والمحلية، حتى تلك الموجودة خارج نظام Microsoft البيئي. إنه يفرض ضوابط الوصول على مستوى الصف والإخفاء الديناميكي لحماية البيانات الحساسة مع ضمان وصول المستخدمين المصرح لهم إلى المعلومات لتطوير الذكاء الاصطناعي. ال ألانتيشن في أي مكان تتيح الميزة للمستخدمين البحث عن أصول البيانات المحكومة ومشاركتها مباشرةً داخل أدوات مثل Microsoft Teams و Slack و Excel، مما يجعل التعاون سلسًا وآمنًا.

وتبرز OneTrust، التي يعتمد عليها أكثر من 14,000 عميل، بما في ذلك نصف العملاء العالميين البالغ عددهم 2,000 عميل، كشركة رائدة في برنامج Forrester Wave لإدارة الخصوصية (الربع الرابع من عام 2025). في مواجهة التحدي الرئيسي الذي تم تسليط الضوء عليه في استطلاع عام 2025 شمل 1250 من قادة تكنولوجيا المعلومات، تعالج OneTrust النقص المتزايد لأنظمة الحوكمة القديمة لمواكبة تطورات الذكاء الاصطناعي.

يتكامل OneTrust بسلاسة مع منصات MLops مثل قواعد البيانات، مما يسمح للمؤسسات باكتشاف وتتبع وكلاء الذكاء الاصطناعي والنماذج ومجموعات البيانات تلقائيًا عند إنشائها. من خلال توحيد استيعاب مشاريع الذكاء الاصطناعي مع تدفقات العمل القابلة لإعادة الاستخدام، تعمل المنصة على تسريع الموافقات مع ضمان بقاء الامتثال سليمًا.

رين نونيس، المدير الأول لحوكمة البيانات والذكاء الاصطناعي في بلاكبود، مشترك:

«مع OneTrust، يتمتع مجلس حوكمة الذكاء الاصطناعي لدينا بعملية تعتمد على التكنولوجيا لمراجعة المشاريع وتقييم احتياجات البيانات ودعم الامتثال. أدت عمليات سير العمل القابلة للتخصيص وتكامل النظام الأساسي ومواءمة إطار إدارة مخاطر NIST AI إلى تسريع الموافقات».

تقوم OneTrust بتضمين نقاط التفتيش الخاصة بالحوكمة في جميع مراحل عملية تطوير الذكاء الاصطناعي، وإعداد التنبيهات للمشكلات الحرجة مثل انحراف البيانات أو تغييرات النموذج. يعمل هذا النهج الاستباقي على التخلص من مشكلات الامتثال في اللحظة الأخيرة أثناء عمليات التدقيق. أبلغت المنظمات التي تستخدم المنصة عن زيادة الإنتاجية بنسبة 75% من خلال عمليات سير العمل الآلية و انخفاض بنسبة 87% في الوقت المستغرق للوصول إلى القيمة عن طريق قطع الاختناقات اليدوية. لا تؤدي هذه العمليات المبسطة إلى تعزيز الكفاءة فحسب، بل تضع أيضًا أساسًا قويًا للامتثال.

تدعم OneTrust مجموعة واسعة من معايير الامتثال، بدءًا من الأطر الأمريكية الرئيسية مثل إطار NIST لإدارة مخاطر الذكاء الاصطناعي، التي تقدم تقييمات معدة مسبقًا ومكتبات للمخاطر مصممة وفقًا لمتطلباتها. تتناول المنصة أيضًا اللوائح الناشئة على مستوى الدولة، مثل قوانين شفافية الذكاء الاصطناعي في كاليفورنيا و مشروع قانون الذكاء الاصطناعي في كولورادو (SB24-205)، والتي تعطي الأولوية لحماية المستهلك في تطبيقات الذكاء الاصطناعي. من أجل الامتثال الفيدرالي، تقوم OneTrust بتجهيز المستخدمين للقاء سياسة مكتب إدارة الأعمال متطلبات حوكمة الذكاء الاصطناعي في الوكالات الفيدرالية.

على الصعيد العالمي، تتوافق المنصة مع لوائح مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي، آيزو 42001، مبادئ منظمة التعاون الاقتصادي والتنمية للذكاء الاصطناعي، GDPR، و القانون الأساسي للذكاء الاصطناعي في كوريا الجنوبية. تتيح هذه التغطية الشاملة للمنظمات متعددة الجنسيات الحفاظ على حوكمة متسقة عبر الولايات القضائية. تعمل OneTrust أيضًا على تبسيط عمليات التدقيق التنظيمية من خلال إنشاء مستندات الشفافية الأساسية تلقائيًا، بما في ذلك البطاقات النموذجية وفواتير المواد بالذكاء الاصطناعي (BoM) وتقارير النسب - مما يساعد على تقليل مخاطر الامتثال بنسبة تصل إلى 75%.

يوفر OneTrust مخزونًا مركزيًا للذكاء الاصطناعي يتتبع المشاريع والنماذج ومجموعات البيانات، سواء تم تطويرها داخليًا أو من مصادر خارجية. تراقب المنصة باستمرار مشكلات مثل انحراف البيانات والتحيز والإنصاف والدقة والجودة، وإرسال تنبيهات فورية عند اكتشاف المشكلات. يتكامل هذا الإشراف في الوقت الفعلي مع أدوات MLops، مما يضمن مزامنة تغييرات نموذج الذكاء الاصطناعي تلقائيًا مع المخزون.

برايان ماكجوان، قائد الذكاء الاصطناعي العالمي والموثوق بالولايات المتحدة في KPMG، سلطت الضوء على تأثير المنصة:

«تساعد OneTrust AI Governance على تمكين الأتمتة عبر دورة حياة الذكاء الاصطناعي، والشفافية المحسنة، والتحكم اللازم للمؤسسات لتشغيل الذكاء الاصطناعي الموثوق به بثقة على نطاق واسع.»

تضمن المنصة أيضًا إمكانية التتبع الشامل للبيانات وتتبع كل شيء بدءًا من أصول البيانات وحتى النشر. يدعم هذا المستوى من المساءلة «الذكاء الاصطناعي المسؤول حسب التصميم»، وهو توقع متزايد من كل من المنظمين وأصحاب المصلحة.

تم تصميم بنية OneTrust لتوسيع نطاق واستيعاب كل شيء بدءًا من البرامج التجريبية في الأقسام الصغيرة وحتى عمليات نشر الذكاء الاصطناعي على مستوى المؤسسة عبر أقسام متعددة. من خلال توحيد فرق الخصوصية والمخاطر والبيانات والامتثال على واجهة واحدة، تسهل المنصة الضوابط الآلية والإنفاذ في جميع أنحاء المؤسسة، مما يكسر الصوامع التي غالبًا ما تعيق جهود الحوكمة.

بالإضافة إلى عمليات تكامل MLOPS الخاصة بها، تتواصل OneTrust مع السجلات النموذجية ومنصات البيانات، مما يسد الفجوة بين السياسات الشاملة والتنفيذ الفني. يظل الأمان أولوية، مع ميزات مثل عناصر التحكم في الوصول القائمة على الأدوار والمراقبة الآلية للسياسات طوال دورة حياة نشر الذكاء الاصطناعي. وهذا يضمن حماية البيانات الحساسة، بينما يمكن للفرق المعتمدة العمل بكفاءة لتعزيز مبادرات الذكاء الاصطناعي.

أثبتت Credo AI نفسها كشركة رائدة في حوكمة الذكاء الاصطناعي، واعترفت بها Forrester كأفضل أداء في إدارة سياسات الذكاء الاصطناعي والابتكار. وتتناول المنصة الحاجة المتزايدة لتحويل مبادئ الذكاء الاصطناعي عالية المستوى إلى عمليات قابلة للتنفيذ، وتقديم أدوات للمخزون المركزي وإدارة المخاطر والمراقبة المستمرة. أبلغت الشركات التي تستخدم Credo AI عن انخفاض بنسبة 60% في الجهد اليدوي بفضل التشغيل الآلي للحوكمة وشهدت تقصير دورات الحوكمة بمقدار 30-50٪.

تعمل Credo AI على تبسيط الحوكمة مع الحفاظ على المرونة التشغيلية. يتكامل بسلاسة مع أدوات مثل ندفة الثلج، قواعد البيانات، ومخازن النماذج لاكتشاف أصول الذكاء الاصطناعي وتسجيلها تلقائيًا. يسمح نهج «السياسة إلى الكود» للفرق الفنية بسحب الأدلة من مكتبات التقييم الحالية وأدوات MLOPs، مما يضمن الامتثال لمعايير الحوكمة للتحيز والأداء والمتانة - دون تكرار الجهود.

تستخدم المنصة عملية استيعاب من ثلاث خطوات - المدخول العام، ومدخول التقييم، والحوكمة - لتبسيط عمليات تقديم الذكاء الاصطناعي وأتمتة تقييمات المخاطر عبر فرق InfoSec والخصوصية والمشتريات. يقوم سير العمل هذا بتعيين المراجعين ومراقبة تقدم التخفيف وإرسال التنبيهات الآلية عندما تحيد أنظمة الذكاء الاصطناعي عن السياسات. أندرو ريسكيند، كبير مسؤولي البيانات في بطاقة ماستر كارد، مشترك:

«باستخدام منصة Credo AI، تستطيع Mastercard إدارة مخاطر الذكاء الاصطناعي وتنفيذ الذكاء الاصطناعي التوليدي بمسؤولية - بسرعة ونطاق أفضل من أي وقت مضى. لقد سمحت لنا ميزات مثل سجل الذكاء الاصطناعي وسجل البائع بالحفاظ على التحكم في جميع حالات استخدام الذكاء الاصطناعي...»

أبلغت المنظمات التي تستخدم Credo AI اعتماد سير العمل بشكل أسرع بنسبة 50% وثلاثة أضعاف المشاركة من الفرق القانونية وفرق المخاطر والبيانات. من خلال توفير رؤية موحدة لجميع أصول الذكاء الاصطناعي، بما في ذلك الذكاء الاصطناعي التوليدي والوكلاء المستقلين، تتعقب المنصة النسب والبيانات الوصفية ومستويات الاستقلالية، مما يضع الأساس للامتثال الفعال والتدقيق الشامل.

تدعم Credo AI الأطر الأمريكية الرئيسية مثل إطار NIST لإدارة مخاطر الذكاء الاصطناعي (RMF)، يتم تفعيلها من خلال «حزم السياسات» المعيارية. تقوم هذه الحزم بترجمة المتطلبات التنظيمية إلى ضوابط تقنية وعملية قابلة للتنفيذ، مما يلغي رسم الخرائط اليدوي ويمكّن المنظمات من تحقيق الامتثال لأطر مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي حتى أسرع 10 مرات.

تتوافق المنصة أيضًا مع المعايير العالمية مثل أيزو/إيك 42001، ال قانون الاتحاد الأوروبي للذكاء الاصطناعي، و مبادئ منظمة التعاون الاقتصادي والتنمية للذكاء الاصطناعي، مما يجعلها خيارًا مثاليًا للمنظمات متعددة الجنسيات. وهي تتضمن أدوات لاختبار التحيز وتقييمات الإنصاف والشفافية، مثل بطاقات النماذج الآلية وتقييمات الأثر. بالنسبة لأدوات الذكاء الاصطناعي التابعة لجهات خارجية، تعمل بوابة المورد الخاصة بها على توسيع نطاق الحوكمة من خلال تطبيق حزم السياسات على الأنظمة الخارجية وجمع الأدلة من البائعين، مما يضمن الامتثال في كل نقطة تفتيش من خلال عمليات التدقيق الآلية.

تقوم Credo AI تلقائيًا بتسجيل كل قرار في عملية الحوكمة، مما يؤدي إلى إنشاء مسارات جاهزة للتدقيق تلبي المعايير الدولية. توفر لوحات المعلومات الخاصة بها رؤى في الوقت الفعلي حول المخاطر المحتملة ونقاط الضعف في البيانات والمخاوف الأخلاقية - مثل الهلوسة أو السمية - قبل النشر وبعده.

توفر مساحة عمل حوكمة الذكاء الاصطناعي تخزينًا آمنًا للأدلة وتتبع التقدم وتعيين المراجع لحالات استخدام الذكاء الاصطناعي المحددة. بالنسبة للوكلاء والنماذج المستقلة، ترسل المنصة تنبيهات آلية عندما تحيد السلوكيات عن السياسات أو معايير الامتثال. أبلغت المنظمات التي تستخدم Credo AI عن تخفيض بنسبة 60% في أوقات المراجعة لفرق الشؤون القانونية والمخاطر والذكاء الاصطناعي.

باستخدام قوالب حزمة السياسة الموحدة، يمكن للمستخدمين إنشاء بطاقات نموذجية وتقييمات الأثر وتقارير الشفافية بنقرة واحدة. تتكامل المنصة مع أدوات MLOPs لجمع الأدلة حول أداء النموذج والتحيز والمتانة وقابلية التفسير. يساعد هذا النهج أيضًا في تحديد وإدارة «Shadow AI» من خلال اكتشاف أنظمة الذكاء الاصطناعي التي تتطلب الإشراف على الحوكمة.

تقدم Credo AI خيارات نشر مصممة خصيصًا لتلبية احتياجات الأمان المختلفة، بما في ذلك السحابة العامة، السحابة الخاصة، و الاستضافة الذاتية (مزودة بفتحات تهوية كاملة) البيئات. هذه المرونة تجعلها خيارًا قويًا للصناعات ذات اللوائح الصارمة، مثل الخدمات المالية وعلوم الحياة والوكالات الحكومية.

يقوم سجل وكلاء الذكاء الاصطناعي الخاص به بمراقبة المخاطر المرتبطة بالوكلاء المستقلين، مثل السلوكيات الناشئة ومستويات الاستقلالية. تم التعرف على Credo AI من قبل جارتنر بصفته «بائعًا رائعًا» في مجال الأمن السيبراني والحوكمة للذكاء الاصطناعي وتم اختياره كواحد من شركة فاست «الأشياء الكبيرة التالية في التكنولوجيا» لعام 2025. ومع ذلك، يلاحظ بعض المستخدمين أن منحنى التعلم الحاد للمنصة قد يشكل تحديات للفرق الصغيرة أو تلك الجديدة في حوكمة الذكاء الاصطناعي. يعتمد التسعير على العقد ويتم ترتيبه عادةً من خلال AWS Marketplace أو المشاركة المباشرة للبائعين، مع توفر عروض أسعار مخصصة للحلول المصممة خصيصًا.

يسلط هذا القسم الضوء على المزايا والتحديات الرئيسية للأدوات التي تمت مناقشتها سابقًا، ويقدم مقارنة موجزة للمساعدة في صنع القرار.

تتمتع كل أداة من أدوات حوكمة الذكاء الاصطناعي بنقاط القوة والمقايضات الخاصة بها عندما يتعلق الأمر بإدارة سير العمل. Prompts.ai تبرز من خلال دمج أكثر من 35 نموذجًا رائدًا في واجهة واحدة، مما يقلل من تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪ من خلال أرصدة TOKN للدفع أولاً بأول وعناصر تحكم FinOps في الوقت الفعلي. تكمن ميزتها الأساسية في القضاء على انتشار الأدوات مع تقديم حوكمة على مستوى المؤسسة دون الحاجة إلى رسوم اشتراك متكررة.

روبوت البيانات مناسب تمامًا لنظامه البيئي، حيث يوفر مراقبة في الوقت الفعلي لانجراف النموذج وجودة البيانات جنبًا إلى جنب مع الموافقات الآلية متعددة المستويات. ومع ذلك، فإنه يفتقر إلى المرونة للسيناريوهات التنظيمية المعقدة، مما يجعله مثاليًا للمؤسسات التي تستخدم DataRobot بالفعل.

كوليبرا تتفوق في إمكانية التتبع من خلال بياناتها الموحدة وفهرسة أصول الذكاء الاصطناعي، مما يوفر سجلات نموذجية يمكن الوصول إليها لكل من المستخدمين التقنيين وغير التقنيين. ومع ذلك، فإنه لا يوفر إدارة أصلية كاملة لدورة الحياة ويعتمد على أدوات MLops التابعة لجهات خارجية للتكامل.

ألاتيون يوفر فهرسة قوية للبيانات وتتبع النسب، مما يجعله خيارًا ممتازًا للمؤسسات التي تركز على ضمان الشفافية عبر أصول البيانات الخاصة بها.

ون ترست تشتهر بتكامل SaaS العالمي، مما يتيح تدفقات عمل الخصوصية الآلية المتوافقة مع أطر مثل GDPR وقانون الاتحاد الأوروبي للذكاء الاصطناعي. على الرغم من تصنيف Gartner Peer Insights المثالي 5/5، إلا أن التعقيد ومنحنى التعلم الحاد يمكن أن يشكلان تحديات للمستخدمين الجدد.

كريدو إيه آي يبسط الامتثال من خلال تحويل السياسات إلى ضوابط قابلة للتنفيذ آليًا من خلال نهج «السياسة إلى الكود». كما أنها توفر أدوات جاهزة للتدقيق، ولكن تكاليف التنفيذ المرتفعة يمكن أن تشكل حاجزًا أمام الفرق الصغيرة.

ومن الواضح أن هناك تحديًا صناعيًا أوسع نطاقًا: ففي حين تستخدم 90٪ من الشركات الذكاء الاصطناعي في العمليات اليومية، فإن 18٪ فقط لديها أطر حوكمة مطبقة بالكامل. لا يزال التكامل يمثل عقبة كبيرة، حيث إن ربط أدوات الحوكمة بأنظمة مثل إدارة الهوية والوصول (IAM) ومنع فقدان البيانات (DLP) والمعلومات الأمنية وإدارة الأحداث (SIEM) غالبًا ما يحد من كفاءة الإنفاذ الآلي. ولمعالجة ذلك، يجب على المؤسسات إعطاء الأولوية للأدوات القادرة على الاكتشاف الآلي لـ «الذكاء الاصطناعي الخفي» من خلال المسح بدلاً من الاعتماد على التسجيل اليدوي. هذا أمر بالغ الأهمية بشكل خاص بالنظر إلى عقوبات عدم الامتثال المحتملة بموجب قانون الاتحاد الأوروبي للذكاء الاصطناعي، والتي يمكن أن تصل إلى 35 مليون يورو أو 7٪ من المبيعات العالمية.

فيما يلي ملخص للسمات الأساسية لكل أداة:

يعد اختيار أداة الامتثال المناسبة لحوكمة الذكاء الاصطناعي أمرًا بالغ الأهمية لتحقيق التوازن بين الحاجة إلى الابتكار والمسؤوليات التنظيمية والأخلاقية. Prompts.ai تبرز من خلال تبسيط إدارة الذكاء الاصطناعي من خلال الوصول الموحد إلى أكثر من 35 نموذجًا، وائتمانات TOKN المرنة للدفع أولاً بأول، وعناصر تحكم FinOps في الوقت الفعلي. من خلال خفض تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪ - دون عبء رسوم الاشتراك المتكررة - يعد خيارًا ممتازًا للمؤسسات التي تعمل على توسيع نطاق سير عمل الذكاء الاصطناعي مع تجنب متاعب التوفيق بين عقود البائعين المتعددة.

تلبي المنصات الأخرى أيضًا احتياجات محددة اعتمادًا على النظام البيئي لمؤسستك. روبوت البيانات يوفر تكاملاً أصليًا سلسًا ومراقبًا في الوقت الفعلي، بينما توفر المنصات المصممة لبيئات السحابة المختلطة حلولًا مخصصة للشركات ذات المتطلبات المتخصصة. إذا كانت نسب البيانات وإمكانية التتبع من الأولويات، كوليبرا هو منافس قوي، على الرغم من أنه يتطلب أدوات MLOPs من طرف ثالث لإدارة دورة الحياة الكاملة.

تضيف الضغوط التنظيمية الإلحاح إلى هذه القرارات. على سبيل المثال، ون ترست يتفوق في التعامل مع الأطر العالمية المعقدة مثل GDPR وقانون الاتحاد الأوروبي للذكاء الاصطناعي، باستخدام الاكتشاف الآلي ورسم الخرائط. لقد حصل على درجة 5/5 مثالية على Gartner Peer Insights، على الرغم من أن بعض المستخدمين يجدون منحنى التعلم الخاص به حادًا. وفي الوقت نفسه، كريدو إيه آي تركز على إنتاج مواد جاهزة للتدقيق، وهي ذات قيمة خاصة لصناعات مثل التمويل والرعاية الصحية، على الرغم من أن تكاليف تنفيذها قد تكون صعبة للفرق الصغيرة.

مع بدء تطبيق قانون الاتحاد الأوروبي للذكاء الاصطناعي للأنظمة عالية المخاطر في أغسطس 2026 - والعقوبات التي تصل إلى 35 مليون دولار أو 7٪ من الإيرادات العالمية - لا تستطيع الشركات تحمل التأخير. على الرغم من أن 90٪ من الشركات تستخدم الذكاء الاصطناعي يوميًا، إلا أن 18٪ فقط اعتمدت أطر الحوكمة بالكامل. يسلط غال نكاش، المؤسس المشارك والرئيس التنفيذي لشركة ريكو، الضوء على أهمية الحوكمة الاستباقية:

«تعمل الحوكمة بشكل أفضل عندما تتطور جنبًا إلى جنب مع تبني الذكاء الاصطناعي، ودمج الامتثال في العمليات، وليس إبطائها».

للبقاء في المقدمة، حدد حالات استخدام الذكاء الاصطناعي الخاصة بك، وحدد أداة تتكامل مع أنظمة IAM و SIEM الخاصة بك، وقم بوضع سياسات متدرجة بناءً على أهمية تطبيقات الذكاء الاصطناعي الخاصة بك. يجب أن تعمل أداة الحوكمة الصحيحة على تحسين سير العمل الحالي، مما يضمن الامتثال دون إدخال عقبات غير ضرورية.

توفر أدوات الامتثال لحوكمة الذكاء الاصطناعي مجموعة من الفوائد، مما يسهل على المؤسسات إدارة تدفقات العمل القائمة على الذكاء الاصطناعي بثقة ودقة. الميزة البارزة هي قدرتها على الضمان الامتثال التنظيمي. من خلال التشغيل الآلي لسير العمل وإجراء تقييمات شاملة للمخاطر وإنفاذ السياسات المتوافقة مع الأطر العالمية مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي ومعايير NIST، تساعد هذه الأدوات المؤسسات على التعامل مع اللوائح المعقدة. هذا لا يقلل فقط من المخاطر القانونية والمتعلقة بالسمعة ولكن أيضًا يبسط الالتزام بالمتطلبات الأخلاقية والتشغيلية.

تكمن القوة الرئيسية الأخرى في الترويج الشفافية والمساءلة عبر دورة حياة الذكاء الاصطناعي بأكملها. تعمل هذه الأدوات على تسهيل التوثيق التفصيلي للنماذج وتتبع العمليات من البداية إلى النهاية وإنتاج تقارير جاهزة للتدقيق. لا تؤدي هذه الميزات إلى بناء الثقة فحسب، بل تضمن أيضًا العدالة في أنظمة الذكاء الاصطناعي. بالإضافة إلى ذلك، تم تجهيز العديد من الأدوات لاكتشاف التحيز ومعالجته، مما يتيح إنشاء نماذج ذكاء اصطناعي أكثر موثوقية وإنصافًا.

أخيرًا، تساعد هذه الأدوات تبسيط العمليات من خلال التشغيل الآلي لتطبيق السياسات والحفاظ على الرقابة المستمرة. هذا يقلل من الحاجة إلى التدخل اليدوي، ويقلل التكاليف التشغيلية، ويسرع التكامل المسؤول للذكاء الاصطناعي. ونتيجة لذلك، يمكن للمؤسسات توسيع نطاق سير العمل بشكل فعال مع الحفاظ على المعايير الأخلاقية.

توفر أدوات حوكمة الذكاء الاصطناعي للمؤسسات الوسائل اللازمة لتلبية المتطلبات التنظيمية، مثل تلك الموضحة في قانون الاتحاد الأوروبي للذكاء الاصطناعي. يفعلون ذلك من خلال العرض الأطر المهيكلة التي تتناول إدارة المخاطر وتعزز الشفافية وتدعم المساءلة طوال دورة حياة الذكاء الاصطناعي بأكملها. غالبًا ما تتضمن الميزات الرئيسية إمكانية تتبع النموذج، فحوصات الامتثال الآلي، و آليات إنفاذ السياسات، مما يساعد على ضمان التزام عمليات سير عمل الذكاء الاصطناعي بالمعايير الأخلاقية والتنظيمية.

تعمل هذه الأدوات على تبسيط المهام الهامة مثل التوثيق والمراقبة وإعداد التقارير. من خلال تبسيط هذه العمليات، لا يمكن للشركات فقط تلبية التزامات الامتثال بشكل أكثر كفاءة ولكن أيضًا تحسين سير العمل التشغيلي. وهذا يساعد على ضمان عمل أنظمة الذكاء الاصطناعي بشكل آمن وأخلاقي وبما يتماشى مع التوقعات التنظيمية العالمية.

عند اختيار أداة حوكمة الذكاء الاصطناعي، من الضروري التركيز على الميزات التي تلبي الأولويات الأخلاقية والتنظيمية والتشغيلية لمؤسستك. ابحث عن الأدوات التي توفر رقابة شاملة لنماذج الذكاء الاصطناعي، بما في ذلك قدرات المراقبة وإدارة المخاطر والامتثال لأطر مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي أو إرشادات NIST. ميزات مثل التتبع من البداية إلى النهاية - تغطية وثائق النموذج وتتبع النسب والاستعداد للتدقيق - هي المفتاح للحفاظ على الشفافية والمساءلة.

من الحكمة أيضًا تحديد أولويات الأدوات التي يمكنها التشغيل الآلي لسير العملوفرض السياسات والتعامل مع تقييمات الامتثال، مما يساعد على تقليل المهام اليدوية وتبسيط نشر الذكاء الاصطناعي. تأكد من تكامل الأداة بسلاسة مع أنظمتك الحالية، سواء كانت محلية أو قائمة على السحابة، لإعداد خالٍ من المتاعب. أخيرًا، ابحث عن الحلول التي تدعم معايير الامتثال العالمية ونقدم رؤى حول تغيير لوائح الذكاء الاصطناعي، مما يمكّن مؤسستك من البقاء في صدارة المتطلبات القانونية مع تعزيز الثقة في مبادرات الذكاء الاصطناعي الخاصة بك.