تعد حوكمة الذكاء الاصطناعي ضرورية حيث تعتمد المنظمات بشكل متزايد على الذكاء الاصطناعي. إنه يضمن أن تكون الأنظمة أخلاقية وشفافة ومتوافقة مع اللوائح. ومع ذلك، فإن تحديات مثل التحيز ومخاطر الخصوصية وفجوات الامتثال تجعل الحوكمة معقدة. مع توقع تضاعف الإنفاق العالمي على الذكاء الاصطناعي من 150 مليار دولار في عام 2023 إلى 300 مليار دولار بحلول عام 2026، تحتاج الشركات إلى أدوات موثوقة لإدارة المخاطر والتوسع بمسؤولية.

فيما يلي أهم الأدوات لحوكمة الذكاء الاصطناعي:

تتناول كل أداة جوانب محددة من الحوكمة - مثل الشفافية أو الامتثال أو الأمان - مما يجعل من الضروري مواءمة اختيارك مع أولويات مؤسستك.

تمثل هذه الأدوات أساليب مختلفة لحوكمة الذكاء الاصطناعي، من المنصات المركزية إلى الحلول المتخصصة. يعتمد اختيار الهدف المناسب على أهدافك - سواء كان ذلك من خلال خفض التكاليف أو ضمان الامتثال أو تعزيز الشفافية.

Prompts.ai عبارة عن منصة قوية لتنسيق الذكاء الاصطناعي مصممة للمؤسسات، وتوفر تحكمًا مركزيًا لمواجهة تحديات حوكمة الذكاء الاصطناعي. من خلال دمج أكثر من 35 نموذجًا للغات الكبيرة من الدرجة الأولى - بما في ذلك GPT-4 و Claude و لاما، و الجوزاء - في واجهة واحدة آمنة، فإنه يزيل فوضى إدارة أدوات متعددة مع ضمان الامتثال الصارم.

يوفر Prompts.ai الوضوح لعمليات الذكاء الاصطناعي من خلال الجمع بين اختيار النموذج وسير العمل السريع وإدارة التكاليف في الوقت الفعلي في نظام واحد متوافق. توفر لوحة التحكم المركزية تحديثات مباشرة حول الاستخدام والإنفاق والأداء لكل تفاعل مع الذكاء الاصطناعي. من خلال طبقة FinOps الخاصة بها، يتم تتبع كل رمز مستخدم، مما يوفر رؤى مفصلة حول تكاليف الذكاء الاصطناعي التي يمكن ربطها مباشرة بنتائج الأعمال وأنشطة الفريق.

تتيح المنصة أيضًا مقارنات الأداء جنبًا إلى جنب من النماذج المختلفة، وتمكين الفرق من اتخاذ قرارات مستنيرة بشأن النماذج التي تناسب احتياجاتهم الخاصة. وهذا يسمح للمؤسسات ليس فقط بتتبع ما تقوم به فرقها باستخدام الذكاء الاصطناعي ولكن أيضًا تقييم فعالية وكفاءة التكلفة لمختلف الأساليب.

بالإضافة إلى ذلك، تحتفظ Prompts.ai مسارات تدقيق شاملة لجميع عمليات سير العمل، مما يجعل من الممكن تتبع قرارات الذكاء الاصطناعي إلى أصولها. يعد هذا المستوى من الرؤية أمرًا حيويًا لإثبات الامتثال للمنظمين أو التحقيق في المشكلات في العمليات التي تعتمد على الذكاء الاصطناعي.

يضمن Prompts.ai الامتثال من خلال دمج السياسات التي تحمي البيانات الحساسة وتحول التجارب غير المنظمة إلى تدفقات عمل جاهزة للتنظيم.

يمكن للمنظمات التنفيذ عمليات سير عمل متسقة ومتوافقة التي تلبي المعايير التنظيمية، وتحول تجارب الذكاء الاصطناعي إلى عمليات منظمة. تسمح أدوات حوكمة المنصة للمسؤولين بفرض سياسات الامتثال عبر جميع تفاعلات الذكاء الاصطناعي تلقائيًا.

لمزيد من دعم الامتثال، تقدم المنصة برامج شهادة المهندس الفوري، مما يساعد المنظمات على تطوير الخبرات الداخلية والالتزام بأفضل الممارسات. يضمن هذا التدريب المنظم أنه مع نمو اعتماد الذكاء الاصطناعي، تظل معايير الامتثال سليمة.

الأمان هو حجر الزاوية في Prompts.ai، مع حماية على مستوى المؤسسة حماية كل تفاعل. من خلال توجيه جميع أنشطة الذكاء الاصطناعي من خلال بنيتها التحتية الآمنة، تقلل المنصة من المخاطر المرتبطة باستخدام أدوات متعددة غير خاضعة للمراقبة.

إنها تدابير حماية البيانات ضمان بقاء المعلومات الحساسة داخل البيئة الآمنة للمؤسسة، حتى عند استخدام نماذج الذكاء الاصطناعي الخارجية. هذا يعالج مصدر قلق رئيسي للشركات: خطر التعرض للبيانات عند استخدام أدوات الذكاء الاصطناعي المختلفة دون رقابة. لا يعزز هذا النهج المركزي الأمان فحسب، بل يدعم أيضًا التوسع السريع لعمليات الذكاء الاصطناعي.

تم تصميم Prompts.ai للنمو مع المنظمات، من فرق صغيرة للشركات العالمية، دون خلق صداع تشغيلي. يلغي نظام TOKN الائتماني للدفع أولاً بأول الحاجة إلى رسوم الاشتراك المتكررة، مما يسمح للشركات بتوسيع نطاق استخدام الذكاء الاصطناعي بناءً على الطلب الفعلي.

يمكن للمنصة خفض تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98%، مقارنة بإدارة العديد من اشتراكات أدوات الذكاء الاصطناعي المستقلة. تعتبر كفاءة التكلفة هذه أمرًا بالغ الأهمية بشكل خاص مع توسع اعتماد الذكاء الاصطناعي عبر الأقسام وحالات الاستخدام.

التحجيم سلس، مع تمت إضافة النماذج الجديدة والمستخدمين والفرق في دقائق، وتجنب التأخيرات المرتبطة عادة بالمشتريات والإعداد. تعمل الواجهة الموحدة أيضًا على تبسيط التدريب والإعداد، مما يمكّن المؤسسات من التركيز على منصة واحدة بدلاً من التوفيق بين أدوات متعددة. يضمن هذا النهج المبسط قدرة الفرق على التكيف بسرعة مع احتياجات الذكاء الاصطناعي المتطورة دون تعقيد غير ضروري.

Domo عبارة عن منصة قائمة على السحابة متخصصة في ذكاء الأعمال، وتقدم أدوات لتصور البيانات والتحليلات في الوقت الفعلي. من خلال لوحات المعلومات التفاعلية والقدرة على دمج مصادر البيانات المتعددة، توفر Domo للمؤسسات عرضًا مركزيًا لبياناتها. يساعد هذا المنظور الشامل الفرق على تتبع وإدارة العمليات المعقدة، بما في ذلك تلك المرتبطة بحوكمة الذكاء الاصطناعي، مما يضمن بقاء العمليات متوافقة وفعالة.

تم تصميم Domo استنادًا إلى أساس سحابي أصلي من أجل قابلية التوسع السلس والتكيف مع أحجام البيانات المتزايدة ومتطلبات الحوكمة. تعمل ميزاته التعاونية على تمكين الفرق من العمل معًا بفعالية، وتقديم رؤى مصممة خصيصًا تقود عملية صنع القرار المستنيرة.

الأمن هو محور التركيز الرئيسي لـ Domo. من خلال ميزات مثل عناصر التحكم في الوصول القائمة على الأدوار وتشفير البيانات، تحمي المنصة المعلومات الحساسة مع تعزيز الشفافية ومساعدة جهود الامتثال.

لا تزال المعلومات حول قدرات إدارة الذكاء الاصطناعي لشركة Velotix قيد المراجعة، وهناك حاجة إلى مزيد من التقييم لتحديد تطبيقاتها المحتملة. وفي الوقت نفسه، يتحول الانتباه إلى Monitaur لاستكشاف ميزاته لاكتشاف التحيز والامتثال.

تركز Monitaur على الإشراف المستمر وإدارة المخاطر لأنظمة الذكاء الاصطناعي، وتبرز كأداة رئيسية في مجال حوكمة الذكاء الاصطناعي. بدلاً من التعامل مع الحوكمة كإعداد لمرة واحدة، تؤكد Monitaur على أهمية المراقبة المستمرة بعد النشر، مما يضمن احتفاظ المؤسسات بالسيطرة على عمليات الذكاء الاصطناعي الخاصة بها.

ترتيب أولويات الشاشة إمكانية الرؤية في الوقت الفعلي في أداء نموذج الذكاء الاصطناعي واتخاذ القرار. يوفر مسارات التدقيق ولوحات المعلومات التي تقسم سلوكيات النماذج المعقدة إلى رؤى مباشرة. تسمح هذه الأدوات لأصحاب المصلحة بتتبع مقاييس الأداء وتحديد المخاوف وشرح القرارات القائمة على الذكاء الاصطناعي بوضوح. من خلال تبسيط العمليات الفنية إلى تقارير قابلة للفهم، تقوم Monitaur بسد الفجوة بين فرق تطوير الذكاء الاصطناعي وقادة الأعمال، وتعزيز التعاون المستنير عبر المؤسسة.

تم تصميم ميزات الامتثال الخاصة بالمنصة لتلبية مجموعة متنوعة من المتطلبات التنظيمية. تساعد القوالب المعدة مسبقًا والمراقبة المستمرة المؤسسات على تحديد انتهاكات السياسة ومعالجتها. تحتفظ Monitaur أيضًا بسجلات مفصلة لأنشطة الذكاء الاصطناعي، بما في ذلك الطوابع الزمنية وإجراءات المستخدم واستجابات النظام. تدعم هذه الوثائق الشاملة عمليات التدقيق وتقلل المخاطر، مما يضمن أساسًا قويًا للالتزام التنظيمي.

تحمي Monitaur البيانات وسلامة النموذج من خلال تدابير أمنية قوية. تضمن أدوات التحكم في الوصول القائمة على الأدوار أن الموظفين المصرح لهم فقط يمكنهم التفاعل مع الأنظمة الحساسة، بينما ينبه اكتشاف الأعطال الفرق إلى السلوكيات غير العادية. تساعد هذه الميزات المؤسسات على مواءمة معالجة البيانات مع كل من السياسات الداخلية واللوائح الخارجية.

تم تصميم Monitaur للتعامل مع المتطلبات على مستوى المؤسسة، وهو مجهز لمراقبة المئات من نماذج الذكاء الاصطناعي عبر بيئات مختلفة، سواء كانت قائمة على السحابة أو محلية أو مختلطة. تضمن قدرتها على تخصيص الموارد تلقائيًا الأداء السلس مع نمو متطلبات الحوكمة. إن قابلية التوسع هذه تجعل من Monitaur مكونًا حيويًا لاستراتيجية حوكمة الذكاء الاصطناعي الشاملة، حيث تتكامل بسلاسة مع المنصات المركزية لتوفير رقابة شاملة.

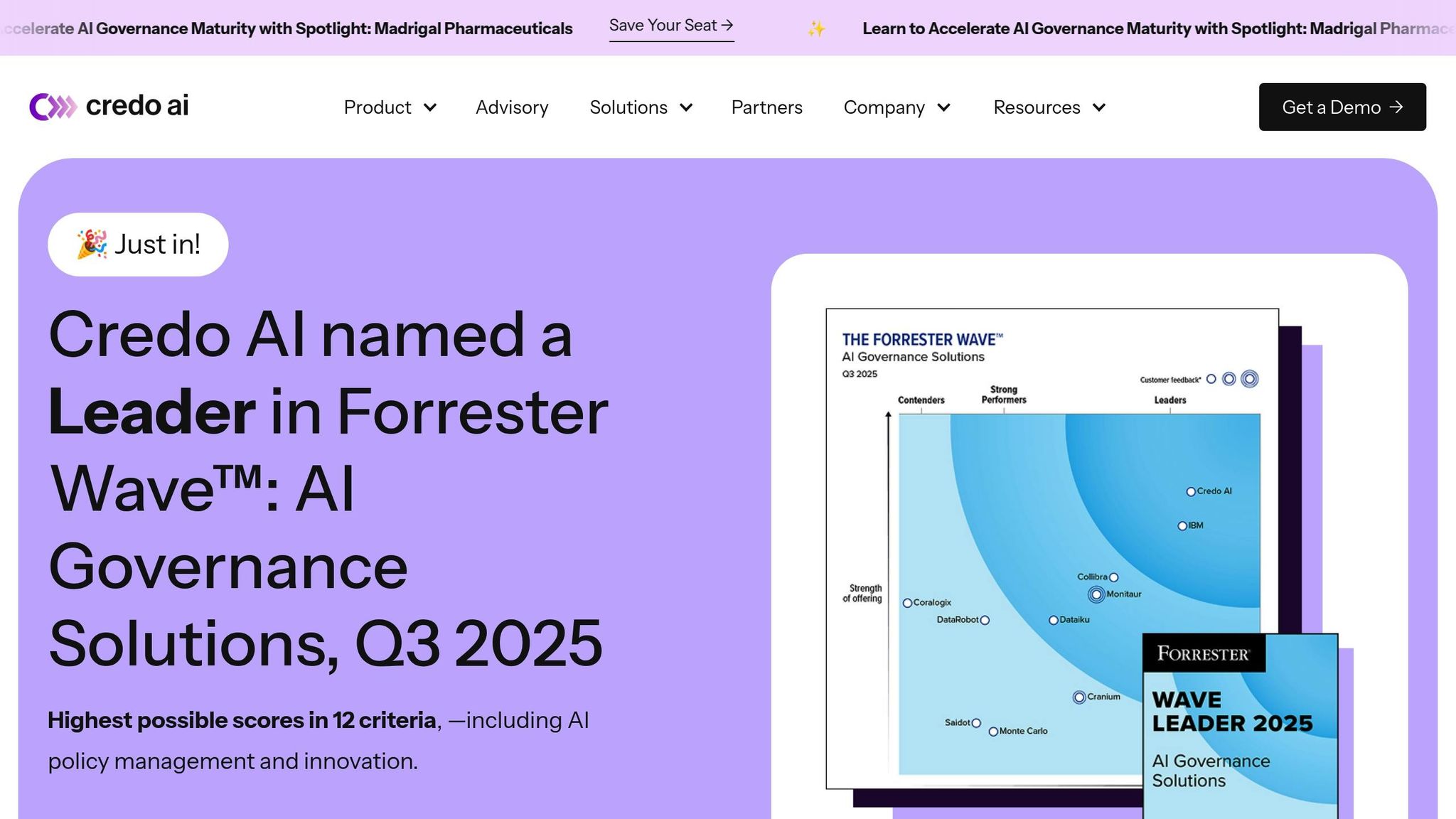

توفر Credo AI منصة ذكاء اصطناعي مسؤولة مصممة لمساعدة المؤسسات على التنقل في المشهد المعقد للوائح الذكاء الاصطناعي والمبادئ التوجيهية الأخلاقية. من خلال إنشاء أدلة جاهزة للتدقيق ووثائق نموذجية مفصلة، تعمل المنصة على تبسيط عمليات الامتثال، خاصة عند ظهور التدقيق التنظيمي. مثل الأدوات المماثلة، تعطي Credo AI الأولوية للشفافية والالتزام باللوائح والحوكمة التي يمكن أن تتناسب مع احتياجات المؤسسة.

تعالج Credo AI الحاجة المتزايدة للشفافية في أنظمة الذكاء الاصطناعي من خلال تقديم أدوات توثيق متقدمة. إحدى الميزات البارزة هي قدرتها على إنشاء بطاقات نموذجية تلقائيًا، والتي توضح بالتفصيل كيفية اتخاذ أنظمة الذكاء الاصطناعي للقرارات. أصبح هذا مهمًا بشكل متزايد مع تطور التوقعات التنظيمية.

جارتنر تتوقع أنه بحلول عام 2026، ستطلب أكثر من 70٪ من الشركات من البائعين تقديم بطاقات نموذجية - وهي في الأساس أوراق الشفافية لأنظمة الذكاء الاصطناعي.

تقوم المنصة بترجمة عمليات صنع القرار المعقدة المتعلقة بالذكاء الاصطناعي إلى تقارير واضحة وموجزة يمكن فهمها من قبل كل من الخبراء التقنيين وأصحاب المصلحة التجاريين. وهذا يضمن أن كل فرد في المؤسسة، بغض النظر عن خلفيته التقنية، يمكنه فهم كيفية عمل أنظمة الذكاء الاصطناعي واتخاذ القرارات. تساعد أدوات الشفافية هذه على سد الفجوة بين الفرق الفنية وقادة الأعمال، وتعزيز التواصل والفهم بشكل أفضل.

تم تصميم Credo AI لمعالجة مجموعة واسعة من المتطلبات التنظيمية. وهو يدعم الامتثال لقوانين محددة مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي، والقانون المحلي لمدينة نيويورك 144، وكولورادو SB21-169، مع التوافق أيضًا مع الأطر الأوسع مثل إطار NIST لإدارة مخاطر الذكاء الاصطناعي. تسمح هذه المرونة للمؤسسات بتصميم استراتيجيات الامتثال الخاصة بها لتلبية المتطلبات التنظيمية المختلفة.

تساعد التقييمات الفنية الآلية للمنصة، بما في ذلك أدوات اكتشاف التحيز، في تحديد المشكلات المحتملة مبكرًا، مما يقلل من مخاطر عدم الامتثال. تحافظ Credo AI أيضًا على مسارات تدقيق مفصلة وتنتج الوثائق اللازمة للمراجعات التنظيمية، مما يقلل بشكل كبير من الوقت والجهد اللازمين عادةً لهذه العمليات.

من خلال ميزات مثل التتبع وإعداد التقارير، تضمن المنصة أن المؤسسات يمكنها إثبات الامتثال المستمر. يسمح هذا النهج الاستباقي للشركات بالبقاء في صدارة التغييرات التنظيمية بدلاً من التسرع في اللحاق بالركب عند ظهور متطلبات جديدة.

تم تصميم Credo AI للتوسع جنبًا إلى جنب مع مبادرات الذكاء الاصطناعي للمؤسسات، حيث تقدم حلول الحوكمة التي يمكن أن تنمو مع احتياجات المؤسسة. حصلت المنصة على درجة 5/5 مثالية عبر 12 معيارًا رئيسيًا في ال فوريستر Wave™: حلول حوكمة الذكاء الاصطناعي، الربع الثالث 2025, مما يؤكد استعدادها المؤسسي.

تؤكد نافرينا سينغ، المؤسسة والمديرة التنفيذية لشركة Credo AI، على أن الحوكمة يجب ألا تعيق الابتكار بل تمكينه بدلاً من ذلك.

«لا ينبغي النظر إلى الحوكمة على أنها عائق أمام الابتكار. إذا تم القيام بذلك بشكل صحيح، فسيؤدي ذلك إلى تمكينه.» - نافرينا سينغ، المؤسسة والمديرة التنفيذية

تتجلى هذه العقلية في تصميم المنصة، الذي يدعم المنظمات أثناء توسيع برامج الذكاء الاصطناعي الخاصة بها. إن حضور Credo AI المستمر في تقارير المحللين والاعتراف بها كشركة رائدة في حوكمة الذكاء الاصطناعي يسلط الضوء على قدرتها على تلبية متطلبات الشركات عبر الصناعات المتنوعة وحالات الاستخدام.

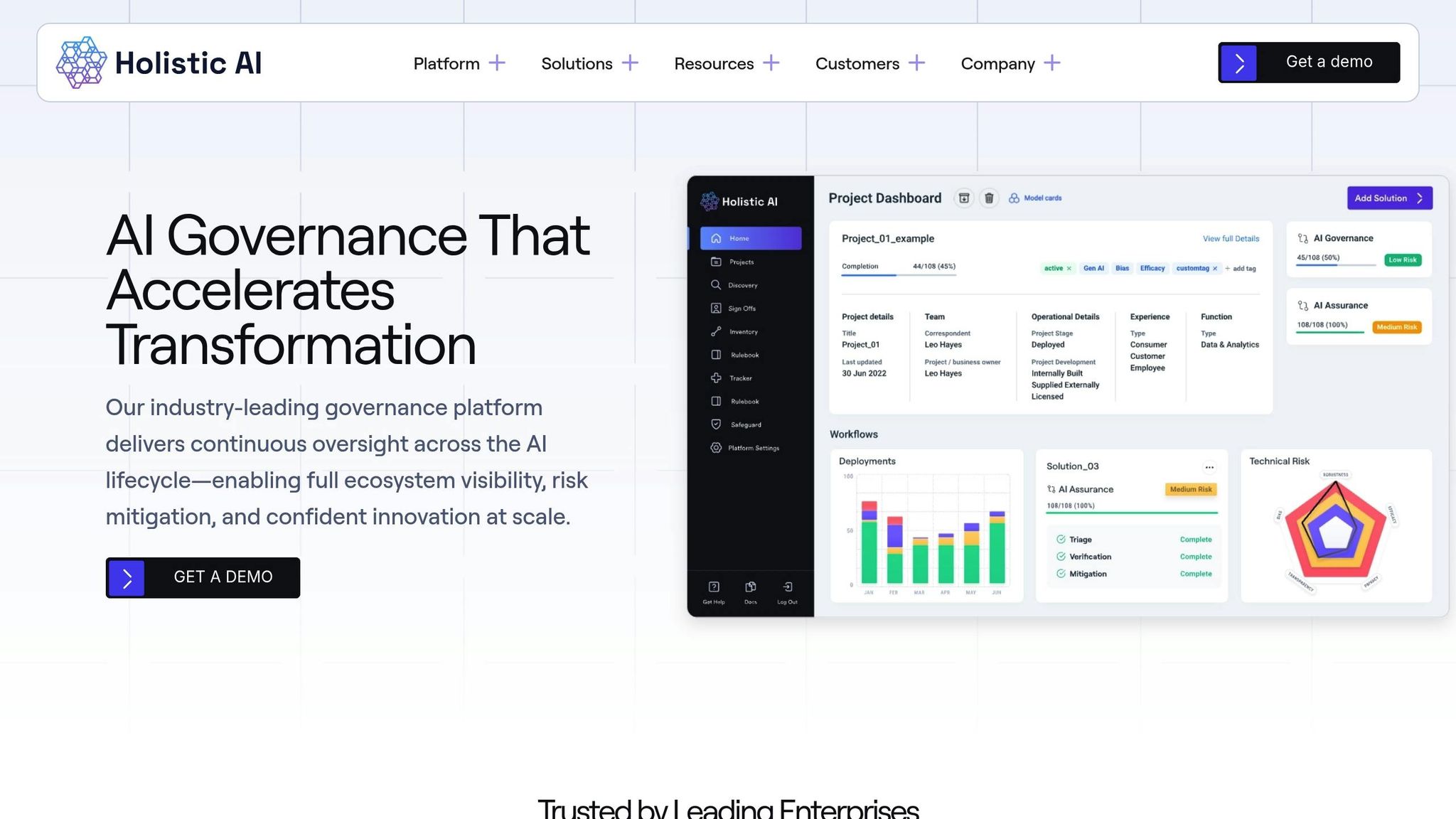

يقدم الذكاء الاصطناعي الشامل نفسه كمنصة تدمج إدارة المخاطر والشفافية والامتثال في إطار حوكمة واحد. على الرغم من أن هذه الميزات تبدو واعدة، إلا أنها تفتقر حاليًا إلى التحقق المستقل لدعم مطالبات المنصة.

تسلط المنصة الضوء على العديد من العروض الرئيسية: فهي تهدف إلى توفير عمليات قابلة للتفسير مع وثائق مفصلة لمساعدة أصحاب المصلحة على فهم عملية صنع القرار في مجال الذكاء الاصطناعي بشكل أفضل؛ وتدعم الامتثال من خلال التقييمات الآلية والأطر المصممة خصيصًا للمتطلبات التنظيمية المختلفة؛ وتعد بضوابط الحوكمة التي يمكن أن تتوسع جنبًا إلى جنب مع عمليات الذكاء الاصطناعي المتنامية. ومع ذلك، بدون التحقق الخارجي، تظل هذه الميزات مجرد تأكيدات وليست قدرات مثبتة.

وبالمقارنة مع المنصات ذات الأدوات التي تم التحقق منها ونتائج الحوكمة القابلة للقياس، لا تزال ادعاءات شركة Holistic AI بحاجة إلى إثبات لإثبات مصداقيتها. وإلى أن يتوفر هذا التحقق، تظل فوائده المحتملة قائمة على التخمين.

تعمل Truyo كمنصة للخصوصية وإدارة البيانات، مع التركيز على إدارة خصوصية البيانات وضمان الامتثال للوائح. في حين أنها تلعب دورًا رئيسيًا في التعامل مع الامتثال للخصوصية وإدارة حقوق موضوع البيانات، إلا أن ميزاتها أكثر انسجامًا مع الحوكمة العامة للبيانات من المتطلبات المحددة لحوكمة الذكاء الاصطناعي. نهج الخصوصية هذا يجعل Truyo إضافة مفيدة لاستراتيجية الحوكمة ولكن ليس حلاً مستقلاً للإشراف على أنظمة الذكاء الاصطناعي. على عكس المنصات المصممة خصيصًا للتحقق من نموذج الذكاء الاصطناعي، تعطي Truyo الأولوية للامتثال للخصوصية باعتبارها قوتها الأساسية.

تم تصميم أدوات الامتثال الخاصة بـ Truyo لمساعدة المؤسسات على التنقل في لوائح خصوصية البيانات المعقدة. تقوم المنصة بأتمتة طلبات الوصول إلى موضوع البيانات (DSARs) وتبسيط عمليات سير عمل إدارة الموافقة. كما يتضمن ميزات مثل تقييمات تأثير الخصوصية الآلية وأدوات لتتبع تدفق البيانات الشخصية. ومع ذلك، تركز هذه القدرات على إدارة الخصوصية العامة بدلاً من معالجة المخاوف الخاصة بالذكاء الاصطناعي مثل التحيز في الخوارزميات أو الشفافية في صنع القرار أو التكيف مع لوائح الذكاء الاصطناعي الناشئة. لتلبية احتياجات حوكمة الذكاء الاصطناعي بشكل كامل، ستحتاج المؤسسات إلى الجمع بين أدوات خصوصية Truyo والحلول الأخرى المتخصصة في التحقق من نموذج الذكاء الاصطناعي واختبار العدالة.

توفر المنصة أدوات تتبع نسب البيانات والتوثيق التي تعزز الرؤية في كيفية الحصول على البيانات ومعالجتها وتخزينها. تساعد هذه الميزات في توضيح تدفق البيانات وأصلها، وهو أمر بالغ الأهمية للامتثال للخصوصية. ومع ذلك، لا تقوم Truyo بتوسيع ميزات الشفافية الخاصة بها لتشمل رؤى حول نماذج الذكاء الاصطناعي أو المنطق وراء القرارات الخوارزمية. بالنسبة للمؤسسات التي تهدف إلى تحقيق الشفافية الكاملة في حوكمة الذكاء الاصطناعي، تسلط هذه الإغفالات الضوء على الحاجة إلى أدوات تكميلية تتناول قابلية التفسير والمساءلة الخوارزمية.

يتضمن Truyo تدابير أمنية قوية، بما في ذلك ضوابط الوصول القائمة على الأدوار، والتشفير (سواء أثناء النقل أو في حالة الراحة)، وتسجيل التدقيق، لحماية البيانات الحساسة. تضمن هذه الميزات سلامة البيانات التي تدعم أنظمة الذكاء الاصطناعي. ومع ذلك، فإن الإجراءات الأمنية للمنصة مصممة خصيصًا لحماية البيانات التقليدية ولا تعالج على وجه التحديد التحديات الفريدة للذكاء الاصطناعي، مثل الدفاع ضد تسمم النماذج أو الهجمات العدائية. بينما تقوم Truyo بتأمين البيانات التأسيسية بشكل فعال، يجب على المؤسسات تنفيذ إجراءات وقائية إضافية لحماية نماذج وأنظمة الذكاء الاصطناعي من هذه التهديدات المتخصصة.

كل أداة في هذه المقارنة تجلب نقاط القوة والتحديات الخاصة بها. فيما يلي تفصيل مفصل لميزاتها وقيودها البارزة.

Prompts.ai يبسط الوصول إلى أكثر من 35 نموذجًا لغويًا من خلال منصة واحدة. يلغي نظام TOKN الائتماني للدفع أولاً بأول الحاجة إلى الاشتراكات المتكررة، مما قد يقلل تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪. تضمن المنصة أمانًا قويًا وتوفر رؤى واضحة للتكلفة. ومع ذلك، فإن تركيزها على نماذج اللغات الكبيرة قد لا يلبي احتياجات المنظمات التي تعتمد على مناهج التعلم الآلي التقليدية.

دومو يتألق في تصور البيانات وذكاء الأعمال، مما يجعله مفيدًا بشكل خاص لتقديم مقاييس حوكمة الذكاء الاصطناعي لأصحاب المصلحة. يدعم تصميمها السحابي الأصلي قابلية التوسع ويتكامل بسلاسة مع أنظمة الأعمال الحالية. ومع ذلك، فإن طبيعتها ذات الأغراض العامة تحد من قدرتها على التعامل مع المهام المتخصصة مثل التحقق من نموذج الذكاء الاصطناعي أو اكتشاف التحيز.

فيلوتكس هو خيار قوي للمؤسسات التي تعطي الأولوية لأمن البيانات والخصوصية. تساعد ميزات اكتشاف البيانات وتصنيفها المؤتمتة في الحفاظ على الامتثال للوائح الخصوصية. ومع ذلك، فإن تركيزها على أمن البيانات يعني أنها تفتقر إلى ميزات شفافية الذكاء الاصطناعي وقابلية التفسير، وغالبًا ما تتطلب أدوات تكميلية لحوكمة الذكاء الاصطناعي الكاملة.

مونيتور متخصص في المراقبة المستمرة للنماذج، ويقدم رؤى مفصلة حول أداء النموذج. ومع ذلك، فإنها لا توفر قدرات حوكمة أوسع، مثل إدارة الامتثال الشاملة أو تتبع نسب البيانات.

كريدو إيه آي يتبع نهجًا شاملاً لحوكمة الذكاء الاصطناعي، مع التركيز على ممارسات الذكاء الاصطناعي الأخلاقية والامتثال التنظيمي. إنه يوفر أدوات قيمة لاكتشاف التحيز وتقييم العدالة. ومع ذلك، فإن تركيزها على الحلول على مستوى المؤسسة قد يمثل تحديات للمؤسسات الصغيرة ذات الموارد المحدودة.

الذكاء الاصطناعي الشمولي تقدم مجموعة واسعة من أدوات تقييم وإدارة مخاطر الذكاء الاصطناعي، وتتفوق في إعداد الامتثال التنظيمي. في حين أن نهجها الشامل فعال، إلا أن منحنى التعلم الحاد للمنصة والطلبات العالية على الموارد يمكن أن تبطئ عملية التنفيذ.

ترويو يُعد مكانًا بارزًا للامتثال للخصوصية، لا سيما في إدارة حقوق موضوع البيانات وأتمتة طلبات الوصول. إن تركيزها القوي على الخصوصية يجعلها مثالية للمؤسسات ذات الاحتياجات الصارمة لحماية البيانات. ومع ذلك، فإن افتقارها إلى الميزات الخاصة بالذكاء الاصطناعي، مثل الشفافية الخوارزمية وأدوات التحقق من صحة النموذج، يحد من فائدتها لحوكمة الذكاء الاصطناعي.

يوفر الجدول التالي دليلًا مرجعيًا سريعًا يلخص السمات الرئيسية لكل أداة:

تظهر هذه المقارنة أنه لا توجد منصة واحدة تهيمن على جميع الفئات. يعتمد اختيار الأداة المناسبة على أهداف الحوكمة المحددة للمؤسسة والاحتياجات الفنية.

نظرًا لأن الشركات تدمج الذكاء الاصطناعي بشكل متزايد في عمليات صنع القرار، فلا يمكن المبالغة في أهمية الحوكمة الفعالة. تتطلب إدارة مخاطر الذكاء الاصطناعي والحفاظ على المعايير الأخلاقية أكثر من مجرد الإشراف؛ فهي تتطلب منصات تضمن الشفافية والمساءلة والامتثال التنظيمي. تمثل هذه المنصات نوع النهج الشامل اللازم لمواجهة تحديات حوكمة الذكاء الاصطناعي.

توضح منصة التنسيق الموحدة لـ Prompts.ai كيف يمكن معالجة هذه الاحتياجات. من خلال ميزات مثل تتبع الاستخدام في الوقت الفعلي، ومسارات التدقيق التفصيلية، وضوابط التكلفة التي يمكن أن تخفض نفقات برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪، فإنها توفر حلاً مصممًا لكل من الحوكمة والكفاءة المالية. يتماشى هذا مع المناقشات السابقة حول ضرورة تحويل الأدوات المتناثرة إلى أطر متماسكة. بالإضافة إلى ذلك، يمكن للأدوات الأخرى ذات الوظائف المتخصصة أن تكمل هذه المنصات، مما يمنح المنظمات المرونة لتحديد أولويات احتياجات الحوكمة الخاصة بها.

تظل الشفافية والمساءلة في صميم الحوكمة الفعالة للذكاء الاصطناعي. تعتبر الأدوات التي تسلط الضوء على كيفية بناء أنظمة الذكاء الاصطناعي ونشرها وتشغيلها أمرًا بالغ الأهمية لبناء الثقة والسماح لأصحاب المصلحة بفهم الأبعاد الأخلاقية للقرارات التي يحركها الذكاء الاصطناعي. يتضمن ذلك ميزات مثل قابلية شرح النموذج ورؤية البيانات وتقييمات التحيز - وهي عناصر أساسية لتجنب مخاطر أنظمة «الصندوق الأسود» للذكاء الاصطناعي. من خلال الجمع بين التنسيق القوي وأدوات المراقبة المتخصصة، يمكن للمؤسسات تحقيق حوكمة شاملة وجديرة بالثقة، مما يضمن تشغيل أنظمة الذكاء الاصطناعي بشكل أخلاقي وفعال.

تأتي حوكمة الذكاء الاصطناعي مع العديد من التحديات الملحة، مثل معالجة التحيز والإنصاف، الحماية خصوصية البيانات وأمانها، والصيانة الشفافية والامتثال وسط اللوائح المتطورة باستمرار. لا تؤثر هذه التحديات على الثقة في أنظمة الذكاء الاصطناعي فحسب، بل تشكل أيضًا مخاطر كبيرة على المؤسسات.

للتغلب على هذه التعقيدات، أصبحت الأدوات المتخصصة لا غنى عنها. على سبيل المثال، برنامج كشف التحيز يساعد في تحديد النتائج غير العادلة وتصحيحها، مما يضمن اتخاذ قرارات أكثر إنصافًا في مجال الذكاء الاصطناعي. وبالمثل، منصات إدارة الامتثال مساعدة المنظمات في مواكبة المتطلبات التنظيمية المتغيرة. تم تصميم أدوات إضافية لمراقبة سير عمل الذكاء الاصطناعي ومعالجة المخاطر المحتملة وتعزيز الاستخدام المسؤول والأخلاقي للذكاء الاصطناعي. من خلال الاستفادة من هذه الحلول، يمكن للمؤسسات تعزيز الثقة وتقليل المخاطر ونشر أنظمة الذكاء الاصطناعي التي تعمل بشكل أخلاقي وفعال.

تركز Prompts.ai بشدة على الأمان والامتثال، وتستفيد من البنية على مستوى المؤسسة المصممة خصيصًا لإدارة نماذج الذكاء الاصطناعي المتعددة بفعالية. من بين ميزاته البارزة: معالجة آمنة لواجهة برمجة التطبيقات، مسارات تدقيق شاملة، و عناصر التحكم في الأذونات التي تنظم الوصول وتدعم السياسات التنظيمية.

لتعزيز حماية البيانات وتلبية المعايير التنظيمية، يتضمن Prompts.ai المراقبة في الوقت الحقيقي، إدارة الهوية الفيدرالية، و بروتوكولات الأمان المتقدمة. تعمل هذه الإجراءات معًا لتقليل المخاطر وحماية المعلومات الحساسة وضمان بقاء عمليات سير عمل الذكاء الاصطناعي آمنة ومتوافقة - كل ذلك مع الحفاظ على ذروة الكفاءة.

عند اختيار أداة حوكمة الذكاء الاصطناعي، فإن الخطوة الأولى هي تحديد الاحتياجات المحددة لمؤسستك. قد يشمل ذلك الامتثال للوائح الصناعة - مثل تلك المتعلقة بالرعاية الصحية أو التمويل - أو معالجة الأولويات الأخلاقية مثل الحد من التحيز وضمان الشفافية. ابحث عن الأدوات التي توفر ميزات مثل فحوصات الامتثال الآلي، مراقبة المخاطر في الوقت الحقيقي، و تكامل سلس مع أنظمة الذكاء الاصطناعي الحالية.

ومن المهم بنفس القدر تقييم ما إذا كانت المنصة تدعم أهدافك التشغيلية ومتطلباتك التنظيمية. ركز على الحلول التي تعزز ممارسات الذكاء الاصطناعي الأخلاقية، وتعزز كفاءة سير العمل، وتمكن الاستخدام المسؤول للذكاء الاصطناعي. إن اختيار أداة مصممة خصيصًا للتحديات الفريدة لمؤسستك سيساعدك على تحقيق أقصى استفادة من جهود الحوكمة الخاصة بك.