تعمل أدوات سير العمل بالذكاء الاصطناعي على تحويل كيفية إدارة الفرق لمشاريع التعلم الآلي (ML)، وتقديم حلول لمعالجة أوجه القصور التي تسببها الأنظمة غير المتصلة. تسلط هذه المقالة الضوء على خمس منصات بارزة - Prompts.ai، كيوبيفلو، ميتافلو، جوملوب، و رقم 8 - يتناول كل منها قابلية التوسع والتكامل والحوكمة والتحكم في التكاليف بطرق فريدة. إليك ما تحتاج إلى معرفته:

تلبي هذه الأدوات الاحتياجات المتنوعة، بدءًا من الامتثال لـ Fortune 500 إلى الشركات الناشئة المهتمة بالميزانية. يعتمد اختيار الشخص المناسب على خبرة فريقك وميزانيتك وأهداف المشروع.

مقارنة سريعة

لقد أثبتت Prompts.ai نفسها كشركة بارزة منصة تنسيق الذكاء الاصطناعي، ومعالجة التحديات الرئيسية التي تواجهها فرق تعلم الآلة الحديثة. من خلال تقديم واجهة موحدة لأكثر من 35 نموذجًا لغويًا رائدًا - مثل GPT-5 و Claude و Llama و Gemini - فإنها تلغي الحاجة إلى التوفيق بين العديد من الأدوات غير المتصلة. هذا النهج المبسط مفيد بشكل خاص للفرق التي تتطلع إلى تقليل تعقيد إدارة أدوات الذكاء الاصطناعي المختلفة مع الالتزام بمعايير الحوكمة الصارمة. إن قدرة Prompts.ai على تبسيط وتنظيم عمليات سير عمل ML تميزها في المجال المزدحم لحلول الذكاء الاصطناعي.

مبنية على بنية سحابية أصلية، تم تصميم Prompts.ai للتعامل مع أحجام البيانات المتزايدة ومتطلبات المستخدمين دون عناء. تتيح المنصة للفرق تنسيق عمليات سير العمل المعقدة مع المعالجة المتوازية، مما يجعلها مناسبة لكل من الشركات الصغيرة والمؤسسات الكبيرة مثل شركات Fortune 500.

تتمثل إحدى نقاط قوتها الرئيسية في القدرة على توسيع نطاق النماذج والمستخدمين والفرق الجديدة في غضون دقائق. تعد قدرة النشر السريع هذه أمرًا بالغ الأهمية للمؤسسات التي تحتاج إلى التكيف بسرعة مع احتياجات الأعمال المتطورة أو توسيع مبادرات الذكاء الاصطناعي عبر أقسام متعددة. بفضل تصميمها المستقبلي، تضمن Prompts.ai أن خطوط أنابيب ML يمكن أن تنمو بما يتماشى مع المتطلبات التنظيمية.

ملفات Prompts.ai واسعة النطاق الموصلات وواجهات برمجة التطبيقات تسمح لها بالاندماج بسلاسة مع مجموعة واسعة من الأدوات والمنصات. إنه يعمل بسهولة مع أطر ML مثل تينسورفلو و PyTorch، خيارات التخزين السحابي مثل AWS 3 و جوجل كلاود، وتطبيقات الأعمال مثل سلاك و سالسفورس.

تعمل قابلية التشغيل البيني هذه على تمكين الفرق من أتمتة عمليات سير العمل عبر بيئات متنوعة دون إصلاح البنية التحتية الحالية. من خلال الاندماج في مجموعات التكنولوجيا القائمة، يمكن للمؤسسات تعظيم استثماراتها الحالية مع الوصول إلى قدرات الذكاء الاصطناعي المتطورة - كل ذلك مع تلبية معايير وضع البيانات والامتثال في الولايات المتحدة.

بالنسبة للصناعات ذات اللوائح الصارمة، تقدم Prompts.ai ميزات حوكمة قوية. التحكم في الوصول المستند إلى الأدوار يضمن أن الأفراد المصرح لهم فقط يمكنهم التفاعل مع تدفقات عمل ونماذج محددة، بينما توفر سجلات التدقيق الشاملة إمكانية التتبع الكامل لأنشطة الذكاء الاصطناعي.

تتضمن المنصة أيضًا التحكم في الإصدار لسير العمل والمطالبات، مما يمنح الفرق القدرة على إدارة ومراقبة عمليات الذكاء الاصطناعي الخاصة بهم بدقة. يعد هذا المستوى من الرقابة ضروريًا للامتثال للوائح مثل GDPR و HIPAA، مما يجعل Prompts.ai خيارًا مثاليًا للمؤسسات التي تتطلب عمليات ذكاء اصطناعي آمنة ومتوافقة.

تتخذ Prompts.ai نهجًا شفافًا ومحسنًا لإدارة التكاليف. تراقب طبقة FinOps المدمجة استخدام الرمز المميز في الوقت الفعلي، مما يضمن توافق النفقات بشكل مباشر مع النتائج. يساعد هذا المستوى من تتبع التكاليف المؤسسات على تجنب الرسوم غير المتوقعة المرتبطة غالبًا بتبني الذكاء الاصطناعي السريع.

المنصة نظام ائتمان TOKN للدفع أولاً بأول يلغي رسوم الاشتراك التقليدية، مما يسمح للتكاليف بأن تعكس الاستخدام الفعلي بدلاً من التوقعات. تحقق العديد من المؤسسات وفورات تصل إلى 98٪ في تكاليف برامج الذكاء الاصطناعي من خلال دمج الأدوات وتحسين تخصيص الموارد. هذه المرونة مفيدة بشكل خاص للفرق ذات أعباء العمل المتغيرة، حيث يمكنها زيادة الموارد أو خفضها حسب الحاجة دون الالتزام بهياكل تسعير صارمة.

بالإضافة إلى ذلك، من خلال أتمتة المهام المتكررة وتسريع النشر، يعزز Prompts.ai الإنتاجية ويعزز العائد على الاستثمار. إنه حل مصمم لتقديم كل من الكفاءة والقيمة، بغض النظر عن حجم الفريق أو نطاقه.

Kubeflow، التي طورتها Google، هي عبارة عن منصة مفتوحة المصدر للتعلم الآلي مبنية على Kubernetes. وهي تهدف إلى جعل عمليات سير عمل التعلم الآلي محمولة وقابلة للتطوير، بحيث تستوعب مجموعة واسعة من البيئات. أصبحت هذه المنصة خيارًا مناسبًا للمؤسسات التي تسعى إلى توحيد عمليات التعلم الآلي الخاصة بها البنية التحتية السحابية الأصلية. إن قدرتها على تنسيق خطوط الأنابيب المعقدة مع الاستفادة من Kubernetes لإدارة الحاويات جعلتها جذابة بشكل خاص.

تسمح مؤسسة Kubeflow على Kubernetes بتخصيص الموارد ديناميكيًا بناءً على متطلبات عبء العمل، مما يضمن قابلية التوسع لكل من المشاريع التجريبية الصغيرة وعمليات نشر الإنتاج الكبيرة. تمكّن بنيتها القائمة على الخدمات المصغرة المكونات الفردية من التوسع بشكل مستقل، مما يحسن استخدام الموارد والأداء العام. على سبيل المثال، يمكن للفرق نشر ما يقرب من 30 Pods داخل مساحة اسم Kubeflow للتعامل بكفاءة مع أعباء عمل ML المختلفة.

تم تصميم Kubeflow وفقًا لمبادئ السحابة الأصلية، مما يجعله متوافقًا مع مزودي السحابة الرئيسيين والإعدادات المحلية. يدعم الاستخدام على نطاق واسع أطر تعلم الآلة مثل TensorFlowو PyTorch و scikit-learn، مما يسمح للفرق بالاستمرار في استخدام أدواتها المفضلة دون التقيد بمورد معين. يعمل نظام خطوط الأنابيب الخاص بها على تعزيز قابلية التشغيل البيني من خلال تمكين إنشاء تدفقات عمل تعمل باستمرار عبر بيئات متنوعة. تعتبر هذه الميزة ذات قيمة خاصة للمؤسسات التي تعمل في إعدادات السحابة المختلطة أو التخطيط لعمليات الترحيل، لأنها تضمن قابلية نقل سير العمل مع المساعدة في إدارة تكاليف البنية التحتية بفعالية.

في حين أن Kubeflow مفتوح المصدر ومجاني للاستخدام، إلا أن تكاليف البنية التحتية المرتبطة بها يمكن أن تكون كبيرة، خاصة بالنسبة للمشاريع الصغيرة. كما تلاحظ مهندسة MLOPS إيناس بنامور من شركة Gnomon Digital:

«على الرغم من أن Kubeflow مفتوح المصدر، إلا أنه يتحمل تكاليف مرتبطة بصيانة البنية التحتية، بما في ذلك الحاجة إلى بيئات الحاويات وموارد الحوسبة. قد لا يكون هذا الاستثمار المسبق والنفقات الجارية ممكنًا لجميع الشركات، حيث يتطلب نشر مجموعة كاملة من مكونات Kubeflow والإضافات تخصيصًا كبيرًا للموارد».

يمكن للمؤسسات تخفيف هذه التكاليف من خلال استخدام استراتيجيات مثل استخدام Spot VMs لتلبية احتياجات الحوسبة والضبط الدقيق لعدد العقد وأنواع الأجهزة وتكوينات الموارد (وحدة المعالجة المركزية والذاكرة ووحدات معالجة الرسومات) للتوافق مع متطلبات عبء العمل. تتضمن خطوط أنابيب Kubeflow أيضًا ميزات مثل التخزين المؤقت المدمج وتنفيذ المهام المتوازية، مما يساعد على التخلص من الحسابات الزائدة عن الحاجة وزيادة كفاءة الموارد إلى أقصى حد. بالنسبة لعمليات النشر السحابية، يمكن للخدمات المُدارة مثل Amazon RDS لتخزين البيانات الوصفية و Amazon S3 للقطع الأثرية و Amazon EFS لتخزين الملفات أن تقلل بشكل أكبر من النفقات التشغيلية. تلعب الإدارة الذكية للموارد دورًا رئيسيًا في الحفاظ على النفقات تحت السيطرة مع الحفاظ على الأداء. من خلال التخطيط الدقيق والتحسين المستمر، يمكن أن يؤدي الاستثمار الأولي في البنية التحتية في Kubeflow إلى كفاءات تشغيلية كبيرة وتقليل الجهد اليدوي بمرور الوقت.

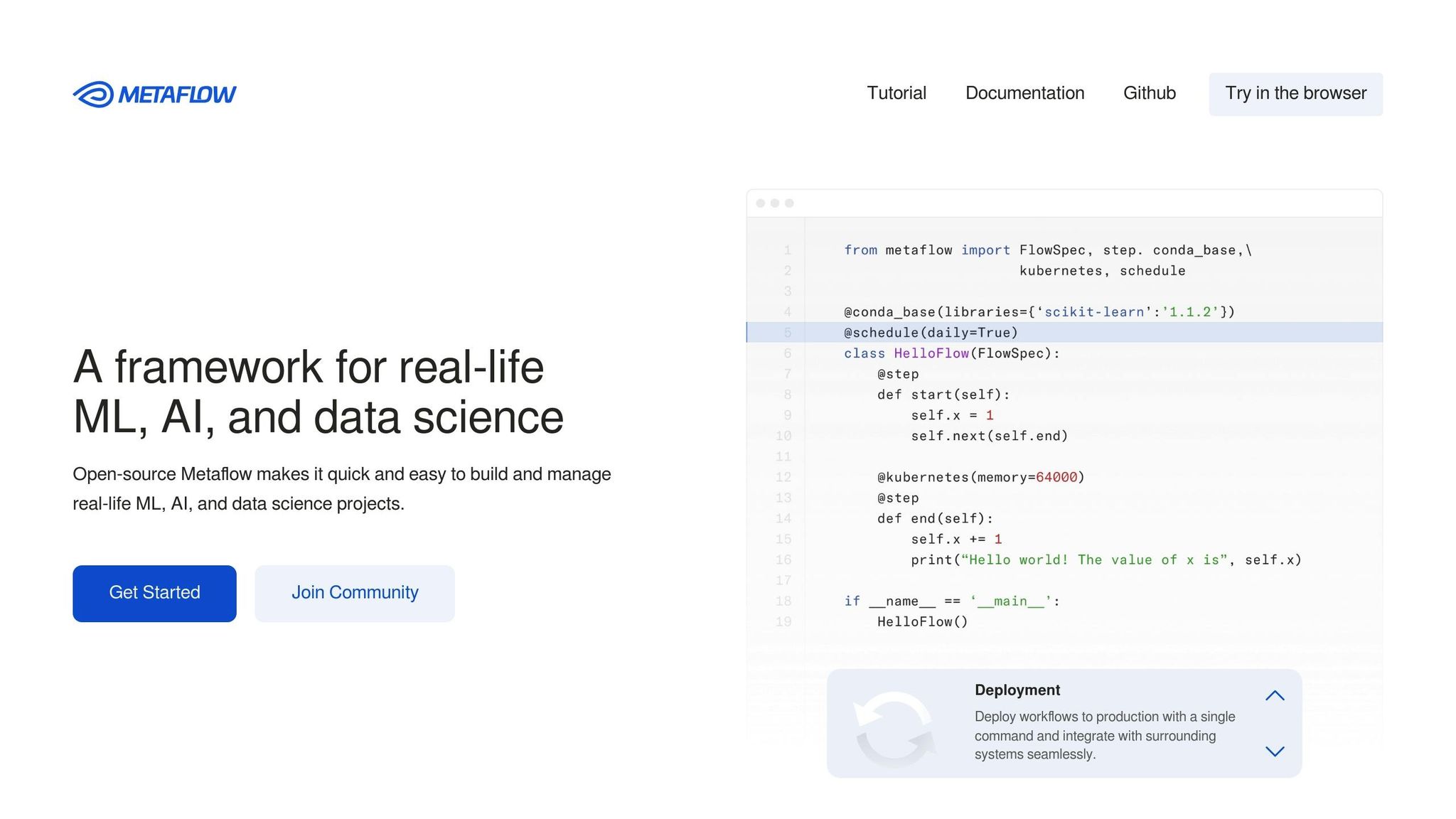

Metaflow هو إطار قائم على Python مصمم للتبسيط عمليات سير عمل علوم البيانات، مما يسمح للفرق بالتركيز أكثر على تطوير النماذج بدلاً من إدارة العمليات.

تم تصميم Metaflow للتعامل مع عمليات سير العمل من جميع الأحجام. هيكلها القائم على الخطوات لا ينظم المهام بكفاءة فحسب، بل يدعم أيضًا تنفيذ مواز، تقليل وقت المعالجة. من خلال ضبط موارد الحوسبة ديناميكيًا لكل خطوة من خطوات سير العمل، فإنها تضمن الاستخدام الفعال للموارد. بالإضافة إلى ذلك، فإنه يتكامل بسهولة مع مكتبات Python المستخدمة على نطاق واسع، مما يجعله اختيارًا مرنًا لمختلف المشاريع.

Metaflow متجذر بعمق في نظام Python البيئي، مما يضمن التوافق السلس مع أدوات Python الأساسية. وهو يتضمن نظامًا مدمجًا لإدارة القطع الأثرية، والذي يبسط إصدار البيانات ويتتبع النسب. تعمل هذه الميزة على تعزيز إمكانية تكرار التجربة وتبسيط تعاون الفريق، مما يسهل إدارة النتائج ومشاركتها.

مع التركيز على التطوير المراعي للتكلفة، تشجع Metaflow الاختبار والتطوير المحليين قبل التوسع إلى السحابة. تساعد قدرتها على تخصيص الموارد بذكاء وإلغاء تنشيط الموارد غير المستخدمة على تجنب النفقات غير الضرورية. يضمن هذا النهج المدروس لإدارة الموارد أن الفرق يمكن أن تعمل بكفاءة دون زيادة الإنفاق.

Gumloop عبارة عن منصة مصممة لتبسيط التشغيل الآلي لسير العمل مع ضمان الإشراف على مستوى المؤسسة لعمليات التعلم الآلي (ML). إنه يعالج تحديات مثل الامتثال والأمان والإدارة المركزية، وهي عقبات شائعة عند توسيع نطاق سير عمل الذكاء الاصطناعي.

تتميز Gumloop بأدوات الحوكمة القوية. في قلب نظامها يوجد حوكمة نموذج الذكاء الاصطناعي وتكوينه الميزة، والتي تمنح المسؤولين التحكم الكامل في استخدام الذكاء الاصطناعي وبيانات الاعتماد والتوجيه.

«توفر حوكمة وتهيئة نموذج الذكاء الاصطناعي لمؤسسات المؤسسات تحكمًا شاملاً في استخدام الذكاء الاصطناعي وبيانات الاعتماد والتوجيه. تعمل هذه الميزات على تمكين المسؤولين من تنفيذ سياسات الأمان وإدارة التكاليف وضمان الامتثال والحفاظ على التحكم المركزي في عمليات سير عمل التشغيل الآلي للذكاء الاصطناعي.»

القدرة الرئيسية الأخرى هي التحكم في الوصول إلى نموذج الذكاء الاصطناعي، مما يسمح للمسؤولين بفرض قيود تفصيلية على نماذج الذكاء الاصطناعي التي يمكن لأعضاء الفريق الوصول إليها. تقدم هذه الميزة وضعين: السماح بوضع القائمة ووضع رفض القائمة. يُعد وضع قائمة السماح مناسبًا بشكل خاص للمؤسسات التي يجب أن تلتزم بمعايير الامتثال الصارمة، حيث إنه يحد من الوصول إلى النماذج المعتمدة مسبقًا والتي تلبي المتطلبات التنظيمية أو متطلبات إقامة البيانات المحددة.

«السماح بوضع القائمة: الأفضل لبيئات التحكم الصارمة. يمكن للمستخدمين الوصول إلى النماذج المسموح بها بشكل صريح فقط. يوصى به للمؤسسات ذات الامتثال الثقيل.»

بالنسبة للصناعات ذات اللوائح الصارمة، فإن Gumloop توجيه بروكسي بالذكاء الاصطناعي تضمن الميزة توجيه جميع طلبات الذكاء الاصطناعي من خلال البنية التحتية المتوافقة. على سبيل المثال، يمكن للمؤسسة إعداد عنوان URL للوكيل مثل https://eu-ai-proxy.company.com/v1 لضمان امتثال الطلبات للوائح الاتحاد الأوروبي مع الحفاظ على مسارات التدقيق التفصيلية.

لا تعمل أدوات الحوكمة هذه على تعزيز الأمان فحسب، بل تمهد الطريق أيضًا لإدارة أفضل للتكاليف.

يبسط Gumloop التحكم في التكاليف من خلال أوراق اعتماد المؤسسة النظام، الذي يركز على إدارة مفاتيح API. وهذا يضمن توجيه جميع مكالمات الذكاء الاصطناعي من خلال الحسابات التي تسيطر عليها المؤسسة، مما يقلل من مخاطر الاستخدام غير المصرح به ويوفر رقابة واضحة على الفواتير.

«الأمن والحوكمة: تستخدم جميع مكالمات الذكاء الاصطناعي بيانات اعتماد مدققة وتتحكم فيها المؤسسة لمنع الاستخدام غير المصرح به.»

تساعد ميزة التحكم في الوصول النموذجي أيضًا على تجنب الاستخدام العرضي للنماذج المكلفة أو غير المناسبة. بالإضافة إلى ذلك، يمكن للمسؤولين تكوين نماذج احتياطية للحفاظ على استمرارية سير العمل عند طلب نماذج مقيدة. من خلال تركيز إدارة بيانات الاعتماد وتوفير التتبع الدقيق، تساعد Gumloop المؤسسات على إبقاء التكاليف تحت السيطرة دون المساس بالوظائف.

بالإضافة إلى الحوكمة وإدارة التكاليف، يتكامل Gumloop بسهولة مع بوابات الذكاء الاصطناعي الحالية للمؤسسات. يسمح هذا التوافق للمؤسسات بالاحتفاظ بسياسات الأمان الحالية مع الاستفادة من إمكانات سير عمل Gumloop. تعمل ميزاته - التحكم في الوصول النموذجي وبيانات اعتماد المؤسسة وتوجيه الوكيل بالذكاء الاصطناعي - معًا لضمان النشر السلس دون تعطيل أطر الامتثال أو الأمان المعمول بها.

يتم حماية جميع التكوينات من خلال التخزين المشفر ونقل البيانات الآمن وسجلات التدقيق التفصيلية، مما يجعل Gumloop خيارًا موثوقًا به حتى للبيئات الأكثر وعيًا بالأمان.

بينما نواصل استكشاف منصات سير عمل ML المتقدمة، رقم 8 يبرز كمثال رئيسي على كيف يمكن للأدوات مفتوحة المصدر تقديم أداء على مستوى المؤسسة مع الحفاظ على انخفاض التكاليف التشغيلية. أصبحت هذه المنصة خيارًا مفضلًا لفرق علوم البيانات التي تبحث عن حلول أتمتة مرنة تتوافق مع الميزانيات المحدودة.

n8n وضع قائمة الانتظار تم تصميمه للتعامل مع الطلبات على مستوى المؤسسة، ودعم عدد كبير من المستخدمين وسير العمل بسلاسة. تسمح بنيته المعيارية بتكييف عمليات سير العمل بسهولة وإعادة استخدامها عبر الأقسام، مما يمكّن المؤسسات من توسيع عمليات التعلم الآلي الخاصة بها دون تعقيد غير ضروري.

بالنسبة للتطبيقات التي تعتمد على الذكاء الاصطناعي، يدمج n8n عقدة ذاكرة بسيطة يقوم بتخزين سياق المحادثة واسترجاعه. هذه الميزة ضرورية للحفاظ على التفاعلات المتماسكة في مشاريع الذكاء الاصطناعي التحادثية المتنامية. في إعدادات الإنتاج، يمكن الاتصال بقواعد البيانات الخارجية مثل نظام إدارة البيانات للتخزين المستمر للسياق، مما يضمن الموثوقية على نطاق واسع.

في أغسطس 2025، عرض Vinod Chugani قابلية تطوير n8n من خلال إنشاء سير عمل هندسي للميزات مدعوم بالذكاء الاصطناعي. حوّل هذا النظام الخبرة الفردية إلى مورد على مستوى المؤسسة من خلال دمج نماذج اللغات الكبيرة للتوصيات الذكية. كما أنها مرتبطة بسلاسة بخطوط تدريب التعلم الآلي مثل Kubeflow و MLFlow، مما مكّن حتى علماء البيانات المبتدئين من الاستفادة من رؤى المهنيين المخضرمين. تسلط هذه القدرات الضوء على قدرة n8n على دعم مبادرات الذكاء الاصطناعي الناشئة والراسخة.

يقدم نموذج التسعير الخاص بـ n8n بديلاً منعشًا لمنصات سير العمل التقليدية. بدلاً من فرض رسوم على كل عملية أو مهمة، يتم فرض رسوم فقط على عمليات تنفيذ سير العمل الكاملة. هذا النهج يعني أنه حتى عمليات سير عمل الذكاء الاصطناعي المعقدة مع آلاف المهام يمكن تشغيلها دون تكاليف باهظة. على سبيل المثال، يمكن أن تعمل عمليات سير العمل التي قد تكلف مئات الدولارات على منصات أخرى مقابل 50 دولارًا في الشهر على خطة n8n الاحترافية.

واحدة من أقوى ميزات n8n هي قدرتها على توصيل الأنظمة والخدمات المختلفة، مما يجعلها خيارًا ممتازًا لعمليات سير عمل ML التي تعتمد على البيانات من مصادر متعددة وتحتاج إلى تقديم نتائج عبر منصات متنوعة. يوفر خيار النشر المستضاف ذاتيًا تحكمًا كاملاً في البنية التحتية، مما يسمح بالتطبيقات المخصصة. تتضمن مكتبة التكامل الواسعة للمنصة خدمات التخزين السحابي ومنصات ML وأدوات الاتصال، مما يضمن قابلية التشغيل البيني السلس.

في أغسطس 2025، استفاد المستخدم من n8n لبناء نظام دعم عملاء AI باستخدام الدردشة GPT، رقم 8، و سوباسي. قام هذا النظام بتصنيف نوايا المستخدم، وتوجيه الطلبات إلى وكلاء فرعيين متخصصين لمهام مثل تتبع الطلبات ومساعدة المنتج، والحفاظ على سياق المحادثة من خلال الذاكرة القائمة على الجلسة. يؤكد هذا المثال قدرة n8n على ربط الأنظمة وإنشاء تدفقات عمل متماسكة وفعالة لتطبيقات الذكاء الاصطناعي المعقدة.

بعد الغوص في المراجعات التفصيلية للمنصة، حان الوقت لتقييم مزايا و عيوب من كل أداة. تسلط هذه المقارنة الضوء على العوامل الرئيسية مثل قابلية التوسع وقابلية التشغيل البيني والحوكمة وكفاءة التكلفة.

Prompts.ai تبرز من خلال توفير الوصول إلى أكثر من 35 نموذجًا رائدًا للذكاء الاصطناعي، بما في ذلك GPT-5 و Claude، وكل ذلك ضمن منصة آمنة. يمكن أن يؤدي الوصول إلى نموذجها المركزي، المقترن بضوابط FinOps في الوقت الفعلي، إلى خفض التكاليف بنسبة تصل إلى 98٪، مما يجعلها خيارًا جذابًا للمؤسسات التي تعطي الأولوية لتوفير التكاليف والحوكمة.

كيوبيفلو، من ناحية أخرى، يوفر مجموعة قوية من ميزات التعلم الآلي مثل ضبط المعلمات الفائقة والتدريب الموزع وإمكانيات الخدمة في الوقت الفعلي. ومع ذلك، فإنه يأتي مع متطلبات تشغيلية عالية، وغالبًا ما تتطلب خبرة كبيرة في DevOps لإدارة عمليات النشر بفعالية.

ميتافلو، الذي طورته Netflix، يتبع نهجًا يركز على المصمم. ومن خلال استخلاص الكثير من تعقيدات البنية التحتية، فإنه يسمح لعلماء البيانات بالتركيز على بناء النماذج بدلاً من مواجهة التحديات التشغيلية، مما يؤدي إلى تحسين الإنتاجية بشكل كبير.

في النهاية، يعتمد الخيار الأفضل على الخبرة الفنية لفريقك والأهداف التنظيمية. بالنسبة لأولئك الذين لديهم خبرة قوية في Kubernetes، كيوبيفلو يوفر بيئة غنية بالميزات. إذا كان تبسيط إدارة البنية التحتية أولوية، ميتافلو مناسب جدًا. وفي الوقت نفسه، Prompts.ai مثالية للمؤسسات التي تسعى إلى الوصول إلى النماذج المركزية وكفاءة التكلفة.

تسلط هذه المقارنة الضوء على كيفية تلبية أدوات سير عمل الذكاء الاصطناعي المختلفة للاحتياجات التنظيمية المختلفة. بالنسبة للمؤسسات التي تسعى إلى تنسيق مبسط للذكاء الاصطناعي وتحقيق وفورات كبيرة في التكاليف، Prompts.ai تتميز بقدرتها على توفير خفض التكاليف بنسبة تصل إلى 98% وإمكانية الوصول إلى أكثر من 35 طرازًا رائدًا - وهو خيار جذاب لأولئك الذين يعطون الأولوية للكفاءة وقابلية التوسع.

كيوبيفلو يوفر ميزات تقنية قوية مصممة خصيصًا للفرق ذات الخبرة القوية في Kubernetes. ومع ذلك، فإن متطلباتها التشغيلية العالية تجعلها أكثر ملاءمة للمؤسسات التي لديها دعم DevOps مخصص. من ناحية أخرى، ميتافلو يعمل على تبسيط إدارة البنية التحتية، مما يسمح لفرق علوم البيانات بالتركيز على تطوير النماذج دون التعثر بسبب التعقيدات التشغيلية.

لتلبية الاحتياجات المتخصصة، جوملوب و رقم 8 تألق من خلال توفير التشغيل الآلي بدون تعليمات برمجية وإمكانيات التكامل المخصصة، مما يجعلها إضافات قيّمة لسير عمل التعلم الآلي الأكبر.

يعتمد اختيار الأداة المناسبة على الخبرة الفنية لفريقك وقيود الميزانية وأولويات الحوكمة. قد تستفيد الفرق ذات موارد DevOps المحدودة من الأنظمة الأساسية التي تقلل من تعقيد البنية التحتية، بينما يجب على أولئك الذين لديهم متطلبات امتثال صارمة إعطاء الأولوية للأدوات ذات ميزات التدقيق والأمان القوية. تعتبر الأسعار الشفافة وتتبع التكاليف في الوقت الفعلي جذابة بشكل خاص للفرق المهتمة بالميزانية.

في نهاية المطاف، ستساعد مواءمة نقاط قوة النظام الأساسي مع التحديات الخاصة بك - سواء كان ذلك من خلال خفض التكاليف أو تبسيط العمليات أو تحسين إمكانية الوصول إلى النموذج - على ضمان أفضل ملاءمة لفريقك ودفع الابتكار والكفاءة.

يعمل Prompts.ai على تمكين الشركات من خفض تكاليف برامج الذكاء الاصطناعي بمقدار 98% من خلال مزيج من التوجيه الديناميكي، تتبع التكلفة في الوقت الفعلي، و نموذج الدفع أولاً بأول. تم تصميم هذه الأدوات لتبسيط استخدام الموارد والقضاء على الإنفاق المهدر.

من خلال تقديم ميزات مثل التوفير الرمزي لحوالي 6.5% وتقليل تكاليف التوجيه الفوري بنسبة تصل إلى 78%، يوفر Prompts.ai طريقة فعالة من حيث التكلفة للمؤسسات لتوسيع نطاق عمليات الذكاء الاصطناعي الخاصة بها. يساعد هذا النهج الشركات على تحقيق عوائد أفضل على استثماراتها في الذكاء الاصطناعي مع الحفاظ على النفقات التشغيلية تحت السيطرة.

يتطلب Kubeflow خلفية تقنية قوية، لا سيما في Kubernetes و DevOps، نظرًا لبنيتها المعقدة والتخصيص الكبير الذي تتطلبه غالبًا. تحتاج الفرق التي تعمل مع Kubeflow عادةً إلى خبرة في إدارة البنية التحتية السحابية واستراتيجيات النشر المتقدمة لاستخدامها بفعالية.

في المقابل، تؤكد Metaflow سهولة الاستخدام وإمكانية الوصول، مما يجعله خيارًا أكثر ملاءمة لفرق علوم البيانات ذات الخبرة الفنية المحدودة. يقلل تصميمه من الحاجة إلى المعرفة العميقة بـ Kubernetes أو DevOps، مما يبسط عملية التنفيذ. ببساطة، يعد Kubeflow أكثر ملاءمة للفرق المتقدمة تقنيًا، بينما تلبي Metaflow احتياجات أولئك الذين يقدرون البساطة والنشر المباشر.

تدعم Gumloop المنظمات في الصناعات المنظمة من خلال تحديد الأولويات أمن و الالتزام. بفضل ميزات مثل تسجيل التدقيق، فإنه يتيح تتبع عمليات تنفيذ سير العمل والوصول إلى البيانات وأنشطة النظام وتعزيز المساءلة وتلبية المتطلبات التنظيمية.

تتوافق المنصة أيضًا مع معايير الأمان المعمول بها، بما في ذلك SOC 2 النوع 2 و GDPR، وضمان حماية البيانات وسلامتها. تساعد هذه الإجراءات الوقائية الشركات على اجتياز متطلبات الامتثال الصارمة مع تعزيز الثقة والموثوقية في عمليات الذكاء الاصطناعي الخاصة بها.