عمليات سير عمل الذكاء الاصطناعي هي تحويل الأعمال ولكنها تأتي مع مخاطر أمنية خطيرة مثل تسمم البيانات والمدخلات العدائية و سرقة النموذج. لمواجهة هذه التحديات، تقدم أفضل المنصات حلولًا مصممة خصيصًا لحماية أنظمة الذكاء الاصطناعي وسير العمل. فيما يلي نظرة عامة سريعة على الأدوات الرائدة:

تلبي كل منصة احتياجات محددة، مثل الامتثال أو كفاءة التكلفة أو التكامل السلس. يعتمد الاختيار الصحيح على البنية التحتية وأولويات الأمان والميزانية.

مقارنة سريعة

لا تعمل هذه الأدوات على تأمين سير العمل فحسب، بل تضمن أيضًا الامتثال والكفاءة التشغيلية. مع تسارع اعتماد الذكاء الاصطناعي، يعد الاستثمار في حلول الأمان المصممة أمرًا ضروريًا.

تتطلب معالجة نقاط الضعف في عمليات سير العمل القائمة على الذكاء الاصطناعي حلاً يدمج الأمان في كل مرحلة. Prompts.ai يتصدى لهذا التحدي من خلال العرض حماية قوية لسير عمل الذكاء الاصطناعي، ومعالجة المخاطر الفريدة التي تأتي مع دمج الذكاء الاصطناعي في العمليات الحرجة وبيئات البيانات الحساسة. بدلاً من التعامل مع أمن الذكاء الاصطناعي كفكرة لاحقة، تضمن المنصة ضمانات شاملة في كل نقطة يتفاعل فيها الذكاء الاصطناعي مع الأنظمة التنظيمية.

يركز Prompts.ai على تحديد ومعالجة الثغرات الأمنية الخاصة بالذكاء الاصطناعي والتي غالبًا ما تتجاهلها أدوات الأمان التقليدية. على سبيل المثال، تعمل على تحييد هجمات الحقن الفوري من خلال آليات المراقبة والتصفية المتقدمة، مما يوفر رؤية فورية للتهديدات المحتملة. بالإضافة إلى ذلك، تمنع المنصة تسرب البيانات الناجم عن نماذج الذكاء الاصطناعي التي تعرض معلومات حساسة عن غير قصد.

بالنسبة للمؤسسات التي تنشئ تطبيقات الذكاء الاصطناعي المخصصة، تعمل prompts.ai على تخفيف المخاطر المرتبطة بمخرجات نموذج اللغة الكبيرة الضارة (LLM)، والتي يمكن أن تعطل سير العمل أو توفر إرشادات غير صحيحة للأنظمة الآلية. يعمل الأمان على مستوى الماكينة في الوقت الفعلي، ويفرض السياسات حسب الحاجة. تتكامل قدرات الكشف هذه بسلاسة مع الميزات الأوسع للمنصة، مما يضمن نهجًا أمنيًا متماسكًا.

الميزة البارزة لـ prompts.ai هي تصميمها المحايد لـ LLM، مما يسمح لها بالاندماج بسهولة مع البنى التحتية الحالية للذكاء الاصطناعي والتكنولوجيا. هذا يجعلها فعالة بشكل خاص في تأمين مساعدي كود الذكاء الاصطناعي أثناء التطوير وحماية كود الملكية ومفاتيح API والملكية الفكرية. بالنسبة لتطبيقات Agentic AI، توفر المنصة الرؤية والتحكم اللازمين للحفاظ على الأمن دون إعاقة الكفاءة التشغيلية.

يتجاوز ملف Prompts.ai اكتشاف التهديدات من خلال ضمان سلامة البيانات من خلال تكامل الذكاء الاصطناعي. يسمح نهجها لحماية البيانات للمؤسسات بالابتكار مع الحفاظ على الامتثال لأطر الحوكمة. تمنع المنصة أيضًا عمليات نشر الذكاء الاصطناعي في الظل - الأنظمة غير المصرح بها التي تتجاوز عناصر التحكم في الأمان - مما يضمن بقاء جميع تفاعلات الذكاء الاصطناعي ضمن المعايير المعتمدة.

لقد تم إثبات قدرات المنصة في سيناريوهات العالم الحقيقي، لا سيما في الصناعات شديدة التنظيم. على سبيل المثال، في عام 2025، الرعاية الصحية في سانت جوزيف في هاميلتون استفادت من prompts.ai كجزء أساسي من استراتيجية تبني الذكاء الاصطناعي الخاصة بها. نجحت المنظمة في الحفاظ على خصوصية بيانات الرعاية الصحية مع تبني تطورات الذكاء الاصطناعي. قال ديف بيري، مدير عمليات مساحة العمل الرقمية:

«لقد كان Prompt Security جزءًا أساسيًا من إستراتيجيتنا لاعتماد الذكاء الاصطناعي. إن تبني الابتكار الذي جلبه الذكاء الاصطناعي إلى صناعة الرعاية الصحية أمر بالغ الأهمية بالنسبة لنا، ولكننا بحاجة إلى التأكد من أننا نقوم بذلك من خلال الحفاظ على أعلى مستويات خصوصية البيانات والحوكمة، ويقوم Prompt Security بذلك بالضبط».

وبالمثل، استخدمت 10x Banking prompts.ai للتنقل بين اللوائح المالية الصارمة مع حماية بيانات العملاء. أشار ريتشارد مور، مدير الأمن في 10x Banking، إلى أن المنصة مكنتهم من «الابتكار بسرعة الأعمال، وتلبية لوائح الصناعة، وحماية بيانات العملاء، وضمان الأمان القوي في المشهد التكنولوجي سريع التطور».

تتميز Prompts.ai أيضًا بنهجها الفعال من حيث التكلفة. توفر أداة تقييم مخاطر الذكاء الاصطناعي الخاصة بالمنصة تقييمات تفصيلية للمخاطر وتحديد الأولويات، مما يساعد المؤسسات على تركيز استثماراتها الأمنية بحكمة. بدلاً من الحاجة إلى إصلاحات شاملة للبنية التحتية، يتم دمج prompts.ai في عمليات سير العمل الحالية، مما يحافظ على انخفاض تكاليف التنفيذ ويقلل من الاضطرابات.

وقد تم تسليط الضوء على فوائد هذا النهج خلال تنفيذ Upstream لعام 2025. من خلال تقديم ملاحظات فورية حول استخدام GenAI للموظفين، قلل النظام بشكل كبير الوقت والجهد اللازمين لمراقبة الامتثال وتدريب الموظفين. وقد أشارت شارون شوارتزمان، رئيسة قسم المعلومات بشركة Upstream إلى ما يلي:

«أدى هذا النهج إلى تحسين الامتثال وتمكين المنظمة من احتضان فوائد أدوات GenAI بشكل آمن.»

الاستحواذ على الأمن الفوري من قبل سنتينلون في 5 أغسطس 2025، يؤكد أهميته في المشهد المتطور لأمن الذكاء الاصطناعي. تضع هذه الخطوة prompts.ai كلاعب حيوي في استراتيجيات أمن GenAI وأمن الوكلاء للمؤسسات. سوف تستكشف الأقسام التالية أدوات إضافية، مثل Microsoft Security Copilot.

يوفر Microsoft Security Copilot الأمان المستند إلى الذكاء الاصطناعي في طليعة التشغيل الآلي لسير العمل من خلال الاستفادة من معالجة اللغة الطبيعية. باستخدام هذه الأداة، يمكن للمستخدمين بدء التحقيقات ومراقبة الحالات باستخدام لغة مباشرة، والتكامل بسلاسة مع ميكروسوفت ديفندر XDR و ميكروسوفت سنتينل.

تعمل هذه المنصة على تبسيط اكتشاف التهديدات والاستجابة لها من خلال السماح للمستخدمين باستخدام مطالبات اللغة الطبيعية للتحقيقات وتحديثات الحالة. من خلال الاتصال المباشر مع ميكروسوفت ديفندر XDR ومايكروسوفت سنتينل، فإنه يعزز عمليات الأمان. يضمن التكامل ذلك تُترجم مدخلات اللغة الطبيعية إلى رؤى قابلة للتنفيذ، مما يجعل اكتشاف التهديدات أكثر سهولة وكفاءة.

يستخدم ميكروسوفت سيكوريتي كوبيلوت موصل كوبيلوت ستوديو للاندماج بسلاسة في عمليات سير العمل. يتوفر هذا الموصل في تطبيقات Microsoft Power Platform مثل Power Automate وتطبيقات الطاقة. إنه يمكّن المستخدمين من تضمين الذكاء الأمني مباشرة في عمليات التشغيل الآلي، مما يضمن الوصول إلى نتائج التحقيق داخل بيئة سير العمل.

CrowdStrike Falcon عبارة عن منصة أمان تعتمد على الذكاء الاصطناعي ومصممة لحماية كل مرحلة من مراحل دورة حياة الذكاء الاصطناعي. من خلال الجمع بين الكشف المتقدم عن التهديدات وCharlotte AI، مساعد الذكاء الاصطناعي المبتكر من CrowdStrike، تعمل المنصة على تبسيط عمليات الأمان باستخدام معالجة اللغة الطبيعية.

تستفيد منصة Falcon من التحليلات السلوكية وذكاء التهديدات لتحديد ومعالجة التهديدات الأمنية التي تستهدف تدفقات عمل الذكاء الاصطناعي. تعزز Charlotte AI هذه العملية من خلال السماح لفرق الأمن بإجراء التحقيقات من خلال استعلامات اللغة الطبيعية، مما يجعل العمليات أكثر سهولة. من خلال الاستحواذ على Pangea، وسعت CrowdStrike من قدرتها على حماية أنظمة الذكاء الاصطناعي طوال مراحل تطويرها ونشرها.

تضمن أدوات الكشف المتقدمة هذه تكامل النظام الأساسي بسهولة مع الأنظمة الأساسية.

تم تصميم CrowdStrike Falcon للتكامل بسلاسة مع منصات سير العمل بالذكاء الاصطناعي. يستخدم خادم Falcon-mcp الخاص به بروتوكولًا مفتوحًا وموحدًا لربط وكلاء الذكاء الاصطناعي والتطبيقات التي تعمل بنظام LLM بشكل آمن بالقياس عن بُعد الخاص بشركة Falcon، بما في ذلك الاكتشافات والحوادث وذكاء التهديدات والرؤى السلوكية. في يوليو 2025، وسعت CrowdStrike تعاونها مع خدمات أمازون ويب (AWS)، حيث تم تقديم برنامج Falcon-mcp و خدمات الفريق الأحمر بتقنية الذكاء الاصطناعي من CrowdStrike ضمن فئة وكلاء وأدوات الذكاء الاصطناعي الجديدة في AWS Marketplace.

تسمح هذه الشراكة لعملاء AWS بدمج أنظمة GenAI وحمايتها بشكل آمن داخل بيئات AWS الحالية. يعمل نظام Falcon-mcp على تبسيط عملية النشر من خلال توفير إمكانية التوصيل والتشغيل لبيانات Falcon، مما يسرع من اعتماد تدفقات عمل الوكلاء.

يوفر Falcon أيضًا عمليات تكامل أصلية مع خدمات AWS مثل أمازون سيج ميكر و أمازون بيدروك. حاليًا، يتوفر Falcon-mcp في المعاينة من خلال أمازون بيدروك AgentCore، مما يتيح الاختبار المبكر لعمليات الدمج هذه.

بالإضافة إلى ذلك، دخلت CrowdStrike في شراكة مع سالسفورس لدمج فالكون شيلد مع سالسفورس مركز الأمان ودمج شارلوت AI داخل Agentforce للأمن و Slack. سيتم الوصول إلى Falcon Shield قريبًا عبر سالسفورس مركز الأمن و سالسفورس AppExchange، بينما من المتوقع اندماج شارلوت آي في سلاك من خلال Agentforce for Security في وقت لاحق من هذا العام.

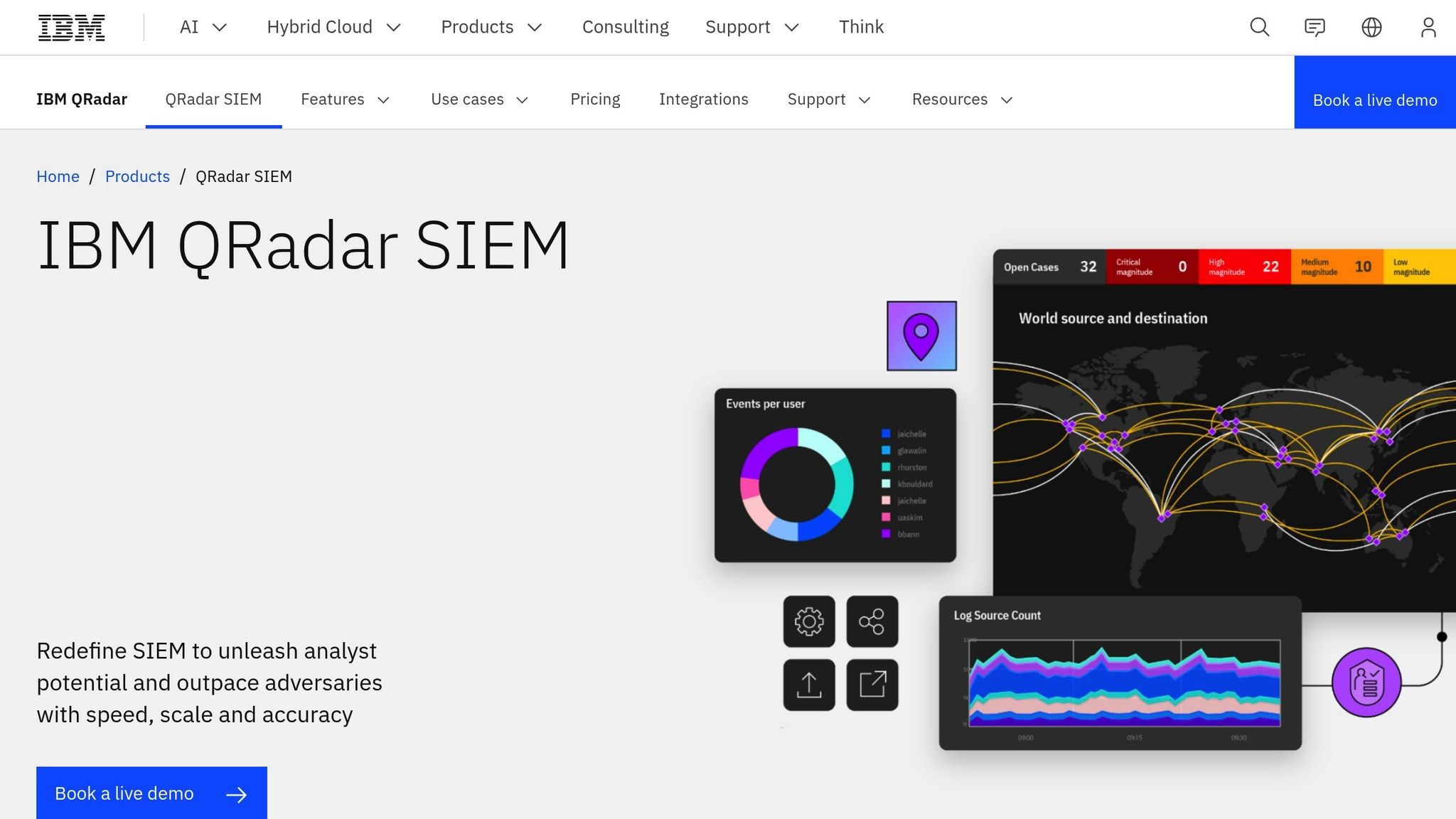

يجمع IBM QRadar with Watson بين عمليات الأمان على مستوى المؤسسة وذكاء التهديدات المتقدم بالذكاء الاصطناعي لحماية منصات سير العمل. تم تصميم هذا الحل للتعامل مع الحوادث الأمنية عبر البنى التحتية المعقدة، مما يوفر اكتشاف التهديدات في الوقت الفعلي بدعم من الذكاء الاصطناعي والتعلم الآلي.

للرادار اكتشاف نقطة النهاية والاستجابة لها (EDR) تم تصميم النظام لمكافحة تهديدات يوم الصفر من خلال استخدام العديد من نماذج التعلم الآلي والسلوك للكشف عن الحالات الشاذة بشكل شبه فوري. هذه القدرة فعالة بشكل خاص في البيئات التي تعمل بالذكاء الاصطناعي.

تتضمن المنصة أيضًا تحليلات سلوك المستخدم (UBA)، والتي تحدد السلوكيات الأساسية لتحديد النشاط غير المعتاد بسرعة ضمن عمليات سير العمل القائمة على الذكاء الاصطناعي. يعمل QRadar SIEM أيضًا على تحسين اكتشاف التهديدات من خلال الجمع بين تحليلات سلوك الشبكة والمستخدم مع ذكاء التهديدات في العالم الحقيقي. يضمن هذا النهج أن التنبيهات ليست دقيقة فحسب، بل أيضًا سياقية وذات أولوية.

قامت شركة IBM بإدخال برنامج متخصص الذكاء الاصطناعي التوليدي ملحق المحتوى، مع استكمال القواعد والإمكانيات المصممة لاكتشاف التهديدات الخاصة بأنظمة الذكاء الاصطناعي.

بالإضافة إلى الكشف المتقدم عن التهديدات، تتفوق QRadar في التكامل. تدعم مجموعة QRadar أكثر من 900 عملية تكامل مبنية مسبقًا، مما يتيح إمكانية التشغيل البيني السلس مع كل من منتجات IBM ومنتجات الجهات الخارجية. مدمج على منصة سحابية مختلطة مفتوحة باستخدام OpenShift، يدمج الحل البيانات من بيئات سحابية متنوعة، بما في ذلك السحابة العامة ومصادر سجل SaaS.

ال تجربة المحلل الموحدة (UAX) يعمل على تركيز عمليات سير العمل والرؤى عبر أدوات EDR/XDR و SIEM و SOAR وإدارة سجلات الأمان، سواء كانت IBM أو جهة خارجية. بالإضافة إلى ذلك، فإن QRadar بحث متحد تسمح الميزة للمحللين بالاستعلام عن البيانات عبر مصادر متعددة - سحابية أو محلية - دون الحاجة إلى ترحيل البيانات.

«يجمع الحل بين النظام الأساسي المستند إلى السحابة وتحليلات الأمان لتلبية احتياجات الشركات الكبيرة ذات احتياجات البنية التحتية الأمنية المعقدة. بالإضافة إلى ذلك، فإن قدرات التوافق والتكامل الواسعة تمكنها من تلبية حافظات الأمان المتنوعة لعملاء IBM.»

- مدونة Techaisle

يقوم QRadar SOAR (تنسيق الأمان والأتمتة والاستجابة) بأتمتة عمليات الاستجابة للحوادث وتوحيدها باستخدام تدفقات عمل قابلة للتخصيص. يعد هذا المستوى من الأتمتة أمرًا حيويًا لحماية بيانات تدريب الذكاء الاصطناعي ومخرجات النموذج. تراقب التحليلات السلوكية للمنصة باستمرار الوصول إلى البيانات وأنشطة المستخدم، مما يؤدي إلى إنشاء خطوط أساسية تساعد في اكتشاف الانتهاكات المحتملة أو الوصول غير المصرح به إلى مجموعات بيانات ومخرجات التدريب على الذكاء الاصطناعي.

تعمل شراكة IBM مع SAP على تعزيز عروضها من خلال دمج Watson مع SAP Start و S/4HANA Cloud. يعمل هذا التعاون على تحسين تجربة المستخدم وتبسيط التشغيل الآلي للمهام.

تبرز Mindgard بين الحلول عالية المستوى من خلال الجمع بين الكشف المتقدم عن التهديدات والتكامل السلس، المصمم خصيصًا لسير عمل الذكاء الاصطناعي. إنه يضمن أمان نماذج الذكاء الاصطناعي وتفاعلاتها في عمليات سير العمل. حصلت المنصة على جوائز مثل أفضل حل للذكاء الاصطناعي وأفضل شركة جديدة في جوائز SC Europe 2025، بالإضافة إلى جائزة الابتكار السيبراني في Infosecurity Europe 2024.

تتفوق Mindgard في تحديد نقاط الضعف عبر مجموعة الذكاء الاصطناعي بأكملها. تتجاوز قدراته الكشف الأساسي عن الهروب من السجن والتدقيق في التفاعلات بين نماذج الذكاء الاصطناعي والواجهات للكشف عن التهديدات الموثوقة ومخاطر الاستغلال. يساعد هذا النهج الشامل فرق الأمن على تحديد متجهات الهجوم المحتملة التي قد تمر دون أن يلاحظها أحد.

تدعم المنصة مجموعة واسعة من أنظمة الذكاء الاصطناعي، بما في ذلك الذكاء الاصطناعي التوليدي ونماذج اللغات الكبيرة (LLMs) مثل أوبن إيه آي، كلود، و Bard، بالإضافة إلى كل من النماذج مفتوحة المصدر والنماذج الاحتكارية.

تتمثل إحدى ميزات Mindgard البارزة في قدرتها على الاندماج بسلاسة مع أطر الأمان الحالية. يتناسب مع خطوط أنابيب CI/CD وجميع مراحل دورة حياة تطوير البرمجيات (SDLC)، لا تتطلب سوى الاستدلال أو نقطة نهاية API للتكامل. يقلل هذا الإعداد المباشر من تحديات النشر، مما يسمح للمؤسسات بتعزيز أمان الذكاء الاصطناعي دون تعطيل أنظمتها الحالية.

تتواصل Mindgard أيضًا بسهولة مع أدوات إعداد التقارير المعمول بها وأنظمة SIEM (معلومات الأمان وإدارة الأحداث). بالنسبة لمستخدمي Burp Suite، تعمل الإضافة المخصصة على دمج أمان الذكاء الاصطناعي في عمليات سير عمل اختبار الاختراق الحالية.

تم تصميم قدرات إعداد التقارير الخاصة بها لتلبية احتياجات الامتثال، بما يتماشى مع أطر مثل MITRE ATLAS™. هذا يجعل من السهل على المؤسسات إثبات الامتثال لمعايير أمان الذكاء الاصطناعي الناشئة.

علاوة على ميزات التكامل الخاصة بها، تعمل Mindgard على تعزيز سلامة البيانات من خلال مراقبة تفاعلات الذكاء الاصطناعي الهامة. من خلال التركيز على هذه التفاعلات، تحدد المنصة مخاطر التعرض للبيانات المحتملة قبل أن تتصاعد إلى حوادث خطيرة. هذا النهج يكمل ويعزز تدابير الأمن السيبراني الحالية.

يؤكد خبراء الصناعة أن المؤسسات لا تحتاج إلى إصلاح البنية التحتية الحالية للأمن السيبراني لاعتماد حلول أمان الذكاء الاصطناعي. بدلاً من ذلك، يمكنهم تكييف أطرهم الحالية لتغطية أنظمة الذكاء الاصطناعي بفعالية.

«لا تحتاج إلى التخلص من عمليات الأمن السيبراني الحالية وكتب اللعب والأدوات، بل تحتاج فقط إلى تحديثها أو إعادة تدعيمها من أجل AI/GENAI/LLMS.»

- مادينيس. كوم

تسمح هذه الإستراتيجية للمؤسسات بتعظيم قيمة استثماراتها الأمنية الحالية مع توسيع الحماية لسير العمل المدعوم بالذكاء الاصطناعي، مما يوفر طريقة فعالة من حيث التكلفة لتحقيق أمان الذكاء الاصطناعي الشامل.

يستلهم نظام المناعة للمؤسسات من Darktrace الإلهام من جهاز المناعة البشري باستخدام الذكاء الاصطناعي للتعلم الذاتي لاكتشاف التهديدات والتصدي لها في عمليات سير عمل الذكاء الاصطناعي. ومن خلال تحليل أنماط السلوك العادية داخل بيئات سير العمل، فإنه يحدد الحالات الشاذة التي قد تفوتها الأنظمة التقليدية القائمة على القواعد. يتيح هذا النهج الكشف المتقدم عن التهديدات والتكامل السلس والحماية القوية للبيانات والعمليات الفعالة من حيث التكلفة.

تستخدم المنصة التعلم الآلي بدون إشراف لتحليل حركة مرور الشبكة وسلوك المستخدم وتفاعلات النظام بشكل مستمر دون الاعتماد على قواعد أو توقيعات محددة مسبقًا. وهذا يسمح لها باكتشاف التهديدات الناشئة والتحقيق في الحوادث تلقائيًا وتقديم رؤى مفصلة حول تطور التهديدات وتأثيرها. فهي تحدد درجات التهديدات وتضع السلوكيات غير العادية في سياقها، مما يسهل على فرق الأمن الاستجابة بفعالية.

تتفوق Darktrace في تحديد المخاطر مثل محاولات استخراج البيانات، حركة جانبية، و تصعيد الامتياز ضمن تدفقات عمل الذكاء الاصطناعي. إنها أنتيجينا تعمل الوحدة على تحسين الأمان من خلال اتخاذ إجراءات مستقلة، مثل إبطاء الاتصالات المشبوهة أو حظر اتصالات معينة أو عزل الأجهزة المخترقة - مما يضمن بقاء العمليات التجارية دون انقطاع حتى أثناء الحدث الأمني. وهذا أمر بالغ الأهمية بشكل خاص في عمليات سير عمل الذكاء الاصطناعي، حيث يمكن أن يؤثر وقت التعطل بشدة على الإنتاجية.

يتكامل Darktrace بسلاسة مع أنظمة الأمان الحالية باستخدام واجهات برمجة التطبيقات والبروتوكولات القياسية، مما يمكّن المؤسسات من دمج رؤاها في أدوات مثل Splunk وIBM QRadar وMicrosoft Sentinel. وهو يدعم النشر عبر البيئات السحابية والهجينة والمحلية، مما يجعلها قابلة للتكيف مع مختلف إعدادات سير العمل بالذكاء الاصطناعي.

بالنسبة لمنصات الذكاء الاصطناعي، شاشات Darktrace اتصالات API، عمليات نقل البيانات بين نماذج الذكاء الاصطناعي، و تفاعلات المستخدم، مما يوفر رؤية شاملة لكيفية سير العمل في الظروف العادية. يساعد هذا الفهم العميق فرق الأمن على اكتشاف أي مخالفات ومعالجتها بسرعة.

التركيز الرئيسي لنظام المناعة في المؤسسة هو منع فقدان البيانات، تم تحقيقه من خلال رصد أنماط غير عادية في حركة البيانات. وهي تحدد النشاط غير الطبيعي عند الوصول إلى المعلومات الحساسة أو نقلها بطرق غير متوقعة، وهو أمر مهم بشكل خاص لعمليات سير عمل الذكاء الاصطناعي التي تتعامل مع بيانات الأعمال السرية.

يحمي Darktrace أيضًا من الوصول غير المصرح به إلى بيانات تدريب الذكاء الاصطناعي، استعلامات نموذجية غير عادية، و عمليات تصدير البيانات المشبوهة، وتعلم معايير معالجة البيانات الفريدة لكل منظمة. من خلال الإبلاغ عن الانحرافات، تضمن المنصة أن تظل بيانات التدريب الحساسة للذكاء الاصطناعي آمنة، حتى في عمليات سير العمل الديناميكية والمعقدة.

بالإضافة إلى ذلك، تدعم المنصة تقارير الامتثال للوائح مثل GDPR وHIPAA وSOX، مما يساعد المنظمات على إثبات التزامها بالمعايير القانونية. هذا أمر حيوي بشكل متزايد حيث تدير عمليات سير عمل الذكاء الاصطناعي البيانات الحساسة تحت إشراف تنظيمي متزايد.

تعمل Darktrace على تقليل التكاليف التشغيلية من خلال أتمتة اكتشاف التهديدات والاستجابة لها، والحد من الإيجابيات الكاذبة، وتقديم خيارات ترخيص قابلة للتطوير. تسمح أوقات الاكتشاف والاستجابة الأسرع (MTTD و MTTR المنخفضة) لفرق الأمن بالتركيز على التهديدات الحقيقية بدلاً من إهدار الموارد على الحالات الشاذة الحميدة.

تعمل إمكانات التعلم المستمر للمنصة على تقليل الإنذارات الكاذبة، مما يوفر الوقت والجهد للفرق التي تدير تدفقات عمل الذكاء الاصطناعي المعقدة. تتيح نماذج الترخيص المرنة للمؤسسات البدء بالميزات الأساسية والتوسع مع نمو احتياجاتها الأمنية. بالإضافة إلى ذلك، يقلل التصميم السحابي الأصلي من تكاليف البنية التحتية، ويتجنب النفقات الضخمة المرتبطة بالحلول المحلية التقليدية.

توفر كل أدوات أمان الذكاء الاصطناعي مجموعتها الخاصة من نقاط القوة والقيود، مما يجعل الاختيار يعتمد بشكل كبير على سير العمل المحدد والاحتياجات التنظيمية. فيما يلي مقارنة تفصيلية للميزات الرئيسية والتحديات وحالات الاستخدام المثالية لبعض أفضل الحلول في السوق.

تختلف طريقة دمج هذه الأدوات ونشرها أيضًا بشكل كبير. على سبيل المثال، تستفيد المؤسسات التي تستخدم حلول Microsoft بالفعل من التكامل السلس لـ Security Copilot مع Azure Sentinel و Defender. من ناحية أخرى، prompts.ai يوفر تكامل API عبر منصات سحابية متعددة، مما يوفر المرونة دون تأمين البائع. يعد CrowdStrike Falcon مثاليًا للبيئات ذات نقاط النهاية سريعة التوسع نظرًا لنشر العوامل خفيفة الوزن، بينما يتطلب IBM QRadar تخطيطًا كبيرًا للبنية التحتية لعمليات التنفيذ واسعة النطاق.

تسلط الإحصائيات الضوء على قيمة أدوات الأمان القائمة على الذكاء الاصطناعي: توفر المؤسسات التي تستخدم هذه الحلول ما متوسطه 1.76 مليون دولار من تكاليف الاستجابة للاختراق وتكتشف الاختراقات بشكل أسرع بـ 108 أيام مقارنة بتلك التي لا تحتوي على مثل هذه الأدوات. تحدد الميزات الفريدة لكل منصة أفضل تطبيقاتها. على سبيل المثال، prompts.ai يستخدم نظام ائتمان TOKN للدفع أولاً بأول، لمواءمة التكاليف مباشرة مع الاستخدام وتجنب الرسوم المتكررة. في المقابل، غالبًا ما تنطوي المنصات التقليدية مثل IBM QRadar على تكاليف ترخيص مسبقة كبيرة وصيانة مستمرة.

تلعب نماذج النشر أيضًا دورًا مهمًا. تتيح الحلول السحابية الأصلية مثل CrowdStrike Falcon و Darktrace التنفيذ السريع، مما يجعلها مناسبة للبيئات سريعة الحركة. وفي الوقت نفسه، توفر الخيارات المحلية، مع أنها تتطلب مزيدًا من التخطيط، تحكمًا أكبر في البيانات - وهو عامل أساسي للصناعات ذات المتطلبات التنظيمية الصارمة. تساعد موازنة هذه المقايضات فرق الأمان على اختيار حل يتوافق مع أولوياتها، سواء كان ذلك في إدارة التكاليف أو النشر السريع أو الحماية المتخصصة بالذكاء الاصطناعي أو الأمان الشامل للمؤسسات.

يعد اختيار حل أمان الذكاء الاصطناعي المناسب لمنصات سير العمل قرارًا مهمًا يعتمد على فهم الاحتياجات الفريدة لمؤسستك والبنية التحتية الحالية وخطط النمو المستقبلية. يقدم السوق مجموعة متنوعة من الأدوات، كل منها مصمم للتفوق في مجالات مختلفة. على سبيل المثال، prompts.ai يركز على التنسيق الموحد للذكاء الاصطناعي وكفاءة التكلفة، بينما مساعد برنامج الأمان من Microsoft يوفر تكاملاً سلسًا للمؤسسات التي تستخدم أدوات Microsoft بالفعل. وفي الوقت نفسه، كراود سترايك فالكون يوفر حماية قوية لنقطة النهاية، و أثر داكن تتميز بقدرات الاستجابة الذاتية الخاصة بها. يضمن هذا المشهد المتنوع وجود حل لكل مؤسسة، ولكن اتخاذ خيار مستنير أمر أساسي.

ولا يمكن المبالغة في إلحاح العمل. بحلول عام 2025، من المتوقع أن تنمو تدفقات العمل المدعومة بالذكاء الاصطناعي من 3٪ إلى 25٪ فقط من جميع عمليات المؤسسة. يؤكد هذا التحول السريع على الحاجة إلى أطر أمنية قوية لحماية العمليات التي تعتمد على الذكاء الاصطناعي والتي تزداد تعقيدًا. المخاطر المالية عالية بنفس القدر: وفقًا لدراسة IDC لفرص الأعمال لعام 2024 للذكاء الاصطناعي، تستخدم 75٪ من المؤسسات الآن الذكاء الاصطناعي التوليدي - قفزة كبيرة من 55٪ في عام 2023 - مما يحقق 3.70 دولارًا من العائدات مقابل كل دولار يتم استثماره.

بالنسبة للشركات التي تهدف إلى التحكم في التكاليف وإدارة نماذج الذكاء الاصطناعي المتعددة بفعالية، prompts.ai يقدم نظام ائتمان TOKN مرنًا للدفع أولاً بأول، والذي يمكنه خفض نفقات الذكاء الاصطناعي بنسبة تصل إلى 98٪. من ناحية أخرى، ستستفيد الشركات المندمجة بعمق في نظام Microsoft البيئي من مساعدي الأمن واجهة اللغة الطبيعية والتوافق السلس مع الأدوات الموجودة.

كما تمت مناقشته سابقًا، يكمن نجاح أدوات أمان الذكاء الاصطناعي في قدرتها على تعزيز اكتشاف التهديدات وأتمتة العمليات وتحسين الدقة بما يتجاوز القدرات البشرية. ومع ذلك، هناك توازن حاسم يجب الحفاظ عليه. تحذر شركة Gartner من أنه بحلول عام 2030، قد تفقد 75٪ من فرق SOC مهارات التحليل الأمني الأساسية بسبب الاعتماد المفرط على الأتمتة. وهذا يسلط الضوء على أهمية المنصات التي تكمل الخبرة البشرية بدلاً من أن تحل محلها.

عند اختيار حل، ضع في اعتبارك عوامل مثل البنية التحتية الحالية ومتطلبات التكامل وقابلية التوسع والميزانية. يجب أن تتجاوز أدوات أمان الذكاء الاصطناعي الفعالة الاستجابة للتهديدات - يجب أن تحدد نقاط الضعف المحتملة بشكل استباقي وتزيلها. لن يؤدي الاستثمار في إطار الأمان الصحيح اليوم إلى حماية مؤسستك فحسب، بل سيضعها أيضًا في وضع يمكنها من تسخير الإمكانات التحويلية لسير عمل الذكاء الاصطناعي بشكل كامل مع تسارع التبني.

يعزز Prompts.ai أمان عمليات سير العمل المدعومة بالذكاء الاصطناعي من خلال الاستفادة من التعلم الآلي المتقدم لاكتشاف التهديدات ومعالجتها فور حدوثها. على عكس الأنظمة التقليدية التي تعتمد على القواعد الثابتة أو التوقيعات المحددة مسبقًا، فإنه يكتشف السلوكيات غير العادية والشذوذات، مما يتيح اتخاذ تدابير استباقية ضد المخاطر المحتملة.

تسمح هذه الطريقة الديناميكية بردود فعل أسرع على نقاط الضعف الجديدة، مما يوفر حماية مستمرة تتكيف مع المشهد المتغير باستمرار لسير عمل الذكاء الاصطناعي. من خلال إعطاء الأولوية للتنبؤ والوقاية، يوفر Prompts.ai دفاعًا أقوى وأكثر موثوقية مقارنة بأدوات الأمان التقليدية.

عند اختيار حل أمان الذكاء الاصطناعي، يجب على الشركات التركيز على مدى ملاءمته لأنظمتها الحالية. يتضمن ذلك ضمان التوافق مع أدوات مثل منصات تشفير البيانات وآليات التحكم في الوصول وأطر الامتثال. يجب أن يتوافق الحل مع البنية التحتية الحالية مع معالجة المخاوف الأمنية الرئيسية، مثل حماية نقاط النهاية والحفاظ على سلامة البيانات.

من المهم أيضًا تقييم قدرات الحل في إدارة المخاطر وتلبية المتطلبات التنظيمية وحماية البيانات الحساسة طوال دورة حياة الذكاء الاصطناعي. بالإضافة إلى ذلك، ضع في اعتبارك ما إذا كان الحل قادرًا على التوسع لاستيعاب النمو المستقبلي والتكيف مع تدفقات العمل المتغيرة، مما يوفر دعمًا موثوقًا به بمرور الوقت.

لدمج أدوات أمان الذكاء الاصطناعي بشكل فعال مع الحفاظ على الخبرة الأمنية الأساسية، يجب على الشركات الاستثمار في التدريب المستمر لفرق SOC الخاصة بها. يجب أن يؤكد هذا التدريب التفكير النقدي، حل المشكلات، و تحليل خصومي، إلى جانب تعزيز المعرفة المتعلقة بالذكاء الاصطناعي. إن تعزيز هذه المهارات يضمن للفرق تفسير مخرجات الذكاء الاصطناعي بدقة والاستجابة بدقة.

ومن المهم بنفس القدر تنمية ثقافة مكان العمل التي تعطي الأولوية للمعرفة الأمنية الأساسية. يضمن هذا النهج لفرق SOC معالجة التهديدات المعقدة بثقة، حتى عندما تصبح أدوات الذكاء الاصطناعي أكثر تعقيدًا. من خلال الجمع بين التطورات في الذكاء الاصطناعي والأساس القوي في الممارسات الأمنية التقليدية، يمكن للمؤسسات دعم إطار أمني مرن ويمكن الاعتماد عليه.