تعمل أدوات تنسيق الذكاء الاصطناعي على تغيير كيفية إدارة المؤسسات لسير العمل، لكن المخاطر الأمنية من الأنظمة غير المتصلة تتزايد. تسلط هذه المقالة الضوء على سبع منصات مصممة لتركيز عمليات الذكاء الاصطناعي مع إعطاء الأولوية لحماية البيانات والامتثال والتحكم في الوصول.

تعالج كل أداة تحديات أمنية محددة، من منع خروقات البيانات إلى ضمان الامتثال. بالنسبة للفرق الواعية بالتكلفة التي تدير نماذج الذكاء الاصطناعي المتعددة، Prompts.ai تبرز مع توفير يصل إلى 98% بشأن تكاليف برامج الذكاء الاصطناعي.

Prompts.ai عبارة عن منصة تركز على الأمان تم تصميمها للمؤسسات، وهي مصممة لتبسيط عمليات الذكاء الاصطناعي وتأمينها. من خلال دمج أكثر من 35 نموذجًا للذكاء الاصطناعي من الدرجة الأولى - بما في ذلك جي بي تي -5، كلود، لاما، و الجوزاء - في نظام واحد متماسك، فإنه يزيل المخاطر وأوجه القصور المرتبطة بأدوات الذكاء الاصطناعي المجزأة.

يوفر Prompts.ai إطارًا موحدًا يجمع النماذج والأدوات والفرق، مما يضمن الإشراف الكامل والمساءلة لجميع أنشطة الذكاء الاصطناعي. يقلل هذا الأسلوب من الثغرات الأمنية الناتجة عن عمليات التنفيذ المفككة. تتضمن خطط الأعمال أدوات حوكمة مركزية للحفاظ على التحكم الصارم في استخدام الذكاء الاصطناعي، والحفاظ على العمليات آمنة ومتوافقة.

الالتزام بالمعايير الرائدة في الصناعة مثل SOC 2 من النوع الثانيوHIPAA وGDPR، تعطي Prompts.ai الأولوية لحماية البيانات. يستخدم المراقبة المستمرة من خلال فانتا، مع مراجعة SOC 2 من النوع الثاني المقرر إجراؤها في 19 يونيو 2025. للحصول على تحديثات في الوقت الفعلي حول إجراءات الأمان الخاصة بها، تفضل بزيارة https://trust.prompts.ai/.

تدعم المنصة إدارة المستخدمين المرنة والقابلة للتطوير، مما يمكّن المؤسسات من استيعاب المستخدمين والفرق بسرعة مع الحفاظ على التعاون الآمن. تتراوح خيارات الاشتراك من مساحات العمل الفردية بنظام الدفع أولاً بأول إلى خطط الأعمال مع عدد غير محدود من مساحات العمل والمتعاونين. يضمن هذا النهج المنظم للتحكم في الوصول أن المؤسسات يمكنها إدارة الهويات والأذونات بأمان، مما يكمل بنية الأمان القوية للمنصة.

تم تصميم Prompts.ai للتغلب على تعقيدات المتطلبات التنظيمية. تم دمج مراقبة الامتثال في خططها الأساسية والاحترافية والنخبة، مما يعزز التزامها بمعايير الأمان على مستوى المؤسسة.

تتصل المنصة بسلاسة بأدوات الأعمال المستخدمة على نطاق واسع مثل سلاك، Gmail، و تريلو. من خلال تمكين عمليات سير العمل الآمنة عبر هذه الأنظمة، تضمن Prompts.ai أن إجراءاتها الأمنية تمتد عبر النظام البيئي التكنولوجي بأكمله للمؤسسة، مما يوفر حماية متسقة على كل المستويات.

SentinelOne Singularity عبارة عن منصة للأمن السيبراني مصممة لتحسين اكتشاف التهديدات والاستجابة لها في عمليات سير عمل الذكاء الاصطناعي. في حين أن إمكانات المنصة واضحة، إلا أن هناك معلومات محدودة متاحة للجمهور حول معالجة البيانات، وضوابط الوصول، وإدارة الهوية، وقابلية التشغيل البيني. هذا النقص في الرؤى التفصيلية يجعل من الصعب إجراء تقييم كامل لنقاط القوة التقنية والنهج العام للتخفيف من التهديدات. من الضروري إجراء مراجعة أعمق لتقييم قدراتها ومقارنتها بفعالية مع الأدوات الأخرى في السوق.

تقدم Vectra AI منصة متطورة للكشف عن الشبكة والاستجابة لها مصممة لتحديد التهديدات السيبرانية المتقدمة ومكافحتها. من خلال الاستفادة من التحليل السلوكي القائم على الذكاء الاصطناعي، فإنه يوفر طبقة أساسية من الحماية لسير عمل الذكاء الاصطناعي المعقد، مكملاً لاستراتيجيات الأمان التي تمت مناقشتها سابقًا.

شركة فيكترا للذكاء الاصطناعي ذكاء إشارة الهجوم تراقب التكنولوجيا باستمرار حركة مرور الشبكة وسلوك المستخدم، باستخدام التعلم الآلي لوضع معايير سلوكية. عند حدوث انحرافات، فإنها تقوم بتعيين درجات التهديد ذات الأولوية، مما يتيح اتخاذ إجراءات سريعة ضد المخاطر المحتملة.

المنصة البحث الآلي عن التهديدات تبحث القدرات بنشاط عن علامات التسوية عبر البيئات المختلطة والمتعددة السحابات. إنها تتفوق في اكتشاف الأنشطة مثل الحركة الجانبية ومحاولات استخراج البيانات وتصاعد الامتيازات، وكلها يمكن أن تستهدف البنية التحتية للذكاء الاصطناعي.

لضمان الأمان مع تقليل المخاطر، تقوم Vectra AI بمعالجة البيانات الوصفية للشبكة والأنماط السلوكية فقط، وتجنب التعرض لحمولات البيانات الحساسة. يتم تشفير جميع بيانات القياس عن بُعد أثناء النقل والراحة باستخدام معايير تشفير AES-256.

تفرض المنصة سياسات الاحتفاظ بالبيانات التي تحذف تلقائيًا أحداث الأمان القديمة استنادًا إلى الجداول الزمنية القابلة للتكوين. لا تساعد هذه الميزة في إدارة تكاليف التخزين فحسب، بل تضمن أيضًا الامتثال للوائح حماية البيانات. بالنسبة للمؤسسات ذات الاحتياجات الصارمة لوضع البيانات، تدعم Vectra AI النشر المحلي.

تتكامل Vectra AI بسلاسة مع مزودي الهوية مثل الدليل النشطو LDAP و SAML، باستخدام عناصر تحكم الوصول القائمة على الأدوار والمصادقة متعددة العوامل لتأمين وصول المستخدم. تسجل سجلات التدقيق التفصيلية الخاصة بها الطوابع الزمنية وهويات المستخدمين والإجراءات، مما يوفر رؤية كاملة لأنشطة الوصول.

توفر المنصة واجهات برمجة تطبيقات REST وعمليات تكامل مبنية مسبقًا مع أدوات مثل منصات SIEM وأنظمة تنسيق الأمان وحلول الاستجابة للحوادث. من خلال دعم إشعارات webhook وعمليات الدمج المخصصة، تضمن Vectra AI دمج معلومات التهديدات والتنبيهات بسلاسة في البنى التحتية الأمنية الحالية.

قامت Microsoft بدمج نقاط القوة في Security Copilot و Sentinel لإنشاء منصة أمان قوية مدعومة بالذكاء الاصطناعي. يعمل هذا التكامل على تزويد المؤسسات بأدوات متقدمة لاكتشاف التهديدات والاستجابة لها، والاستفادة من معالجة اللغة الطبيعية والتعلم الآلي لحماية تدفقات عمل الذكاء الاصطناعي على مستوى المؤسسة.

يستخدم Microsoft Security Copilot الذكاء الاصطناعي التوليدي لتعزيز اكتشاف التهديدات وتحليلها. من خلال معالجة إشارات الأمان عبر نظام Microsoft البيئي باستخدام نماذج اللغات الكبيرة، فإنها تحدد أنماط الهجوم المعقدة التي قد تغفلها الأنظمة التقليدية. يمكن لفرق الأمان التفاعل مع المنصة من خلال واجهة لغة طبيعية، مما يبسط عملية التحقيق.

ميكروسوفت سنتينل يعمل بمثابة العمود الفقري لـ SIEM الأصلي للسحابة، وهو قادر على استيعاب كميات هائلة من بيانات الأمان من مئات المصادر على نطاق بيتابايت. تعمل ميزة تحليلات سلوك المستخدم والكيانات (UEBA) على إنشاء خطوط أساسية سلوكية للمستخدمين والأجهزة والتطبيقات، والإبلاغ عن الأنشطة غير العادية التي قد تشير إلى الأنظمة المخترقة أو انتهاكات البيانات. من خلال خوارزميات التعلم الآلي التي تتكيف مع التهديدات الجديدة، يضمن Sentinel الحماية لأنظمة الذكاء الاصطناعي المتطورة.

تمزج قدرات البحث عن التهديدات المتكاملة للمنصة بين الخبرة البشرية ودعم الذكاء الاصطناعي. يمكن لمحللي الأمن استخدام واجهة اللغة الطبيعية لـ Security Copilot للتحقيقات في الحوادث، بينما تتيح لغة Kusto Query Language (KQL) من Sentinel التحليل الجنائي المفصل عبر مجموعات البيانات الكبيرة.

تستخدم Microsoft مبادئ عدم الثقة لضمان أمان البيانات عبر نظامها الأساسي. يقوم Sentinel بتشفير جميع البيانات، سواء أثناء النقل أو في حالة الراحة، باستخدام تشفير AES-256، مع المفاتيح التي تتم إدارتها من خلال Azure Key Vault. بالنسبة للمؤسسات التي تتطلب مزيدًا من التحكم، يتم أيضًا دعم مفاتيح التشفير التي يديرها العميل (CMEK).

تسمح ضوابط وضع البيانات للمؤسسات بتحديد مكان تخزين بياناتها، مما يضمن الامتثال للوائح المحلية مثل اللائحة العامة لحماية البيانات. يدعم Sentinel أيضًا سياسات الاحتفاظ بالبيانات القابلة للتكوين، مما يتيح الحذف التلقائي للسجلات بناءً على التصنيف أو العمر أو المتطلبات التنظيمية.

بالنسبة لأحمال عمل الذكاء الاصطناعي الحساسة، توفر المنصة إخفاء البيانات والترميز لحماية معلومات التعريف الشخصية (PII) أثناء التحليل الأمني. تسمح هذه الإجراءات لفرق الأمن بالتحقيق في التهديدات دون الكشف عن بيانات التدريب الحساسة أو تفاصيل النموذج، مما يعزز الوصول القوي للبيانات وبروتوكولات الحماية.

تتكامل المنصة مع معرف Microsoft Entra (المعروف سابقًا باسم Azure Active Directory) لتقديم إدارة شاملة للهوية والوصول. تعمل سياسات الوصول المشروط على فرض المصادقة متعددة العوامل وتوافق الجهاز والقيود المستندة إلى الموقع للوصول إلى أدوات الأمان وموارد الذكاء الاصطناعي.

يضمن التحكم في الوصول المستند إلى الأدوار (RBAC) إعدادات الأذونات الدقيقة، مع أدوار الأمان المضمنة والقدرة على إنشاء أدوار مخصصة مصممة وفقًا لإطار حوكمة المؤسسة. يساعد ذلك في مواءمة مستويات الوصول مع مسؤوليات محددة، وتجنب الإفراط في الامتياز.

تضيف إدارة الهوية المميزة (PIM) طبقة إضافية من الأمان من خلال تمكين الوصول في الوقت المناسب للعمليات الحساسة. هذه الميزة مفيدة بشكل خاص في بيئات الذكاء الاصطناعي حيث قد يكون الوصول المؤقت إلى نماذج الإنتاج أو بيانات التدريب مطلوبًا أثناء الاستجابة للحوادث.

تم تصميم ميكروسوفت سيكوريتي كوبيلوت وسنتينيل لتلبية متطلبات أطر التوافق الرئيسية، بما في ذلك SOC 2 وISO 27001 وNIST وHIPAA وPCI DSS. تقدم المنصة مصنفات الامتثال المعدة مسبقًا والتي تنشئ تقارير ولوحات معلومات لتبسيط عمليات التدقيق التنظيمية.

تعمل مراقبة الامتثال الآلي باستمرار على تقييم البنية التحتية للذكاء الاصطناعي مقابل خطوط الأساس الأمنية والمعايير التنظيمية. عند حدوث انحرافات، يمكن للنظام تشغيل عمليات سير عمل المعالجة أو تنبيه فرق الامتثال. تسجل مسارات التدقيق التفصيلية جميع أنشطة الأمان وإجراءات المستخدم وتغييرات النظام، مما يدعم كلاً من التحقيقات الجنائية والامتثال التنظيمي.

تم تصميم منصة أمان Microsoft للتكامل السلس مع الأدوات والأنظمة الأخرى. من خلال واجهات برمجة تطبيقات REST وواجهة برمجة تطبيقات Microsoft Graph Security، فإنه يتصل بأدوات الأمان التابعة لجهات خارجية ومنصات تطوير الذكاء الاصطناعي والتطبيقات المخصصة. كما أنه يدعم بروتوكولات STIX/TAXII لمشاركة معلومات التهديدات مع مجتمعات الأمن الخارجية والوكالات الحكومية.

يتيح تكامل Logic Apps عمليات سير عمل الاستجابة التلقائية عبر أنظمة متعددة. على سبيل المثال، إذا اكتشف Sentinel تسممًا محتملاً لنموذج الذكاء الاصطناعي، فيمكنه عزل الأنظمة المتأثرة وإخطار أصحاب المصلحة وبدء بروتوكولات الاستجابة للحوادث.

يتضمن النظام البيئي للموصل الخاص بالمنصة أكثر من 300 عملية تكامل تم إنشاؤها مسبقًا مع موردي الأمان وموفري السحابة وتطبيقات المؤسسات. وهذا يضمن أن أدوات أمان Microsoft يمكن أن تعمل كمحور مركزي لإدارة هياكل أمان الذكاء الاصطناعي المعقدة والمتعددة البائعين.

تستفيد عمليات أمان Google (Secops) من البنية التحتية العالمية الشاملة لـ Google لتقديم تنسيق أمان متقدم لسير عمل الذكاء الاصطناعي. تم تصميم SecOps للتعامل مع القياس الأمني عن بُعد على نطاق واسع، ويركز على استيعاب البيانات ومعالجتها وحمايتها بسلاسة، كل ذلك مع الالتزام بمتطلبات إدارة البيانات الصارمة.

يوفر Google Secops أدوات فعالة لإدارة خطوط أنابيب البيانات، مما يسمح للمستخدمين بتوجيه القياس الأمني عن بُعد وتصفيته وتنقيحه وتحويله على نطاق واسع. مع حزمة Enterprise Plus، يحصل المستخدمون على حماية محسّنة لبيانات تدريب الذكاء الاصطناعي الحساسة ومعايير النموذج أثناء تحليل الأمان. والجدير بالذكر أن المنصة تشمل عام واحد من الاحتفاظ بالقياس الأمني عن بُعد بدون أي رسوم إضافية، إلى جانب 12 شهرًا من تخزين BigQuery للتصدير بدون تكلفة.

لتلبية احتياجات العملاء المتنوعة والحفاظ على سيادة البيانات، يتم توزيع عمليات البيانات عبر مناطق عالمية متعددة. والأهم من ذلك، تفرض Google سياسة واضحة تستبعد سجل المستخدم وبيانات محادثة Gemini من التدريب النموذجي، مما يضمن سرية التحقيقات الأمنية. تضع هذه الممارسات أساسًا قويًا لتلبية المعايير التنظيمية الصارمة.

تم تصميم SecOps لتتوافق مع معايير الصناعة الرئيسية، مثل SOC 2 و ISO 27001 و GDPR و HIPAA. من خلال تدابير حوكمة البيانات القوية، تضمن المنصة أن بيانات التدريب على الذكاء الاصطناعي ومخرجات النماذج تلبي المتطلبات التنظيمية أثناء التحليل الأمني.

يتكامل SecOps بسلاسة مع BigQuery، مما يتيح للمستخدمين إجراء تحليلات متقدمة وإنشاء تقارير مخصصة لمقاييس الأمان. يدعم هذا التكامل التحليل الجنائي طويل المدى، مما يمكّن فرق الأمن من الكشف عن رؤى مصممة خصيصًا لسير عمل الذكاء الاصطناعي.

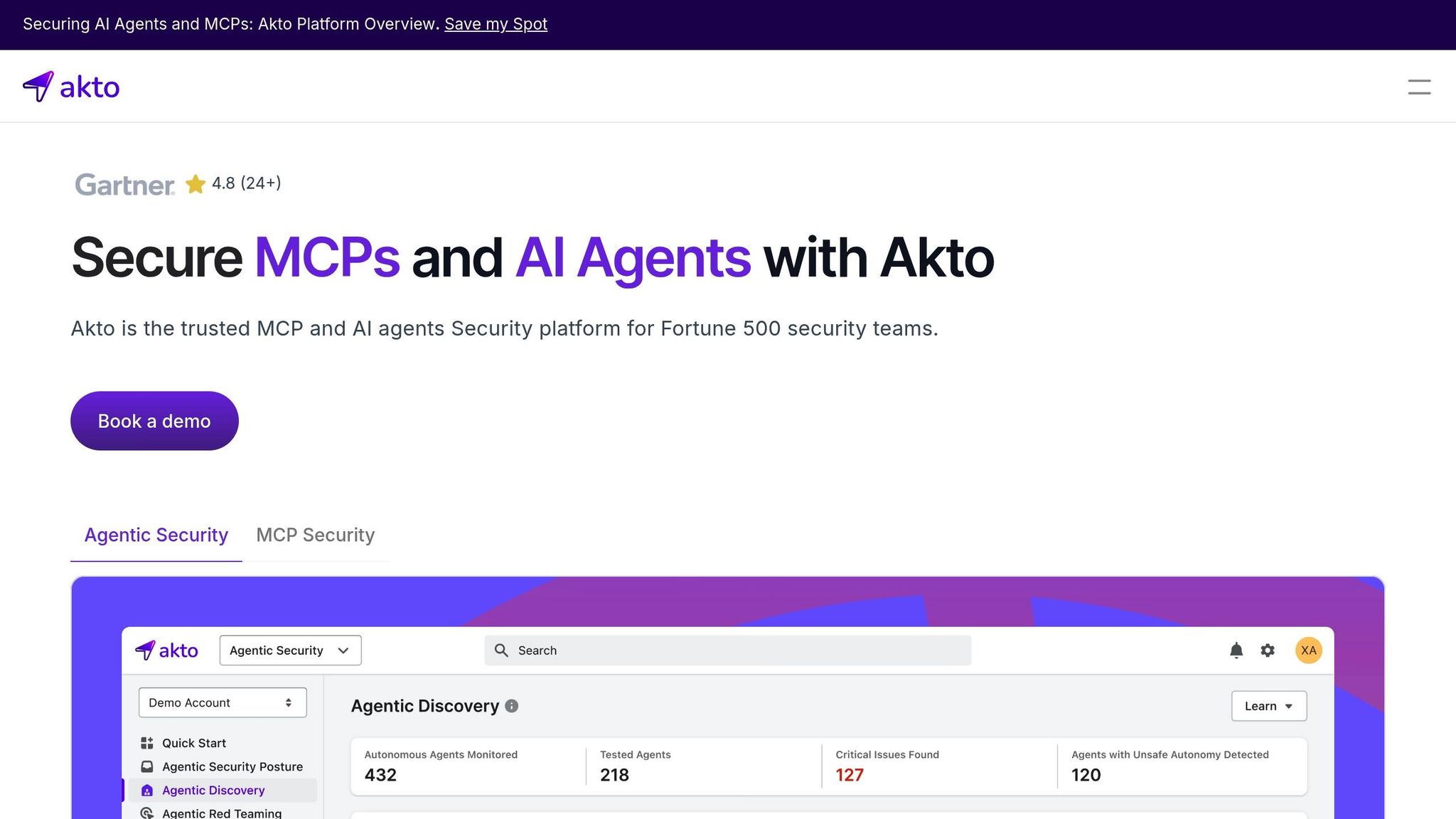

تم تصميم Akto.io لحماية وكلاء الذكاء الاصطناعي ومنصات السحابة المتعددة (MCPs) من الهجمات الإلكترونية المستهدفة. نظرًا لأن مخاطر الأمن السيبراني تتصدر قائمة مخاوف الشركات التي تنشر وكلاء الذكاء الاصطناعي في الإنتاج، يوفر Akto.io إطارًا أمنيًا مصممًا لتلبية متطلبات تدفقات عمل الذكاء الاصطناعي الحديثة.

يركز Akto.io على الاكتشاف واختبار الثغرات المستمر، مما يضمن الحماية الشاملة. تقوم المنصة تلقائيًا بتعيين وكلاء الذكاء الاصطناعي وشركات MCP والأدوات والموارد عبر البنية التحتية للمؤسسة والسحابة ونقاط النهاية. تلبي هذه القدرة حاجة ماسة، حيث يعتبر 9 من أصل 10 من قادة الأمن اكتشاف MCP/Agent أمرًا ضروريًا. يعزز Akto.io الأمان من خلال:

بالإضافة إلى ذلك، توظف Akto.io الفريق الأحمر الآلي وإدارة الوضعية لاختبار نقاط الضعف باستمرار، وتعزيز دفاعات المؤسسة ضد التهديدات المتطورة.

يعطي Akto.io الأولوية لحماية البيانات الحساسة أثناء عمليات وقت التشغيل. إنه يفرض حواجز حماية قابلة للتطوير لمنع الإجراءات غير المصرح بها مع توفير إمكانات اختبار متكاملة توفر تغطية أفضل بنسبة 100 مرة لـ إجراءات الوكيل. يتيح ذلك للمؤسسات تحديد مخاطر التعرض للبيانات المحتملة ومعالجتها بسرعة.

«أستخدم Akto لمخزون API والتخصيصات المتاحة، والواجهة الودية، والدعم الممتاز، ومراقبة البيانات الحساسة.»

يتم دعم مصداقية Akto.io من خلال الاعتراف بها في Techscape من Gartner للشركات الناشئة في أمان السحابة والتطبيقات وإدراجها كبائع تمثيلي في دليل السوق لعام 2024 لشركة Gartner لحماية API. تؤكد هذه الجوائز موثوقيتها في تأمين تدفقات عمل الذكاء الاصطناعي. مع تصنيف إجمالي يبلغ 4.8 من أصل 5، يظهر Akto.io أيضًا في أفضل مراجعات حلول أمان API.

تم تصميم Akto.io بتصميم أولي لواجهة برمجة التطبيقات، وهو يتكامل بسلاسة مع عمليات سير عمل التطوير الحالية. ويتسع اختبار الأمان الآلي الخاص بها بسهولة عبر بيئات متنوعة، بعد تحليل وتأمين أكثر من مليون إجراء بين الوكلاء والأدوات. لقد سلط العملاء الضوء على سهولة استخدامه وفعاليته:

«من السهل جدًا نشر أداة Akto، وليس هناك حاجة إلى الكثير من التهيئة. قم بدمج نفس الشيء في CICD، كل شيء يتم في مكان واحد.»

شارك عميل آخر من القطاع المصرفي:

«لقد ساعدتنا Akto إلى حد كبير في اختبار الأمان وفهرسة API، وتمكنا من إجراء اختبار الأمان الآلي على نطاق واسع.»

إن قدرات التكامل القوية هذه تجعل Akto.io حلاً متميزًا في المجال التنافسي للتنسيق الآمن للذكاء الاصطناعي.

يوفر Teleport وصولاً آمنًا بدون ثقة إلى الخوادم وقواعد البيانات والتطبيقات و كوبيرنيتيس المجموعات، مما يضمن حماية العمليات الحساسة في تدفقات عمل الذكاء الاصطناعي.

تستخدم Teleport المصادقة القائمة على الشهادات، وتصدر شهادات قصيرة الأجل لطلبات الوصول. يقلل هذا الأسلوب من الاعتماد على بيانات الاعتماد الثابتة ويقلل بشكل كبير من أسطح الهجوم المحتملة. بالإضافة إلى ذلك، فإنه يسجل جميع الجلسات، ويخلق مسارات تدقيق مفصلة للمراقبة المستمرة والمساءلة.

يتكامل التحكم في الوصول المستند إلى الأدوار (RBAC) في Teleport بسهولة مع موفري الهوية المستخدمين على نطاق واسع مثل Active Directory و SAML و OIDC. كما أنه يدعم توفير الوصول في الوقت المناسب، مما يسمح للفرق بمنح أذونات مؤقتة مرتفعة عند الضرورة، دون الاحتفاظ بحسابات ذات امتيازات عالية بشكل مستمر.

تتم حماية البيانات الحساسة من خلال سجلات التدقيق المشفرة وتشفير TLS المتبادل لجميع الاتصالات بين مكونات Teleport. تضمن ميزة الوصول الآمن إلى قاعدة البيانات اتصالات آمنة بمخازن البيانات، بينما يحمي الوصول المخصص للتطبيقات الواجهات الهامة من التعرض المباشر للإنترنت.

تساعد مسارات التدقيق المفصلة في Teleport المنظمات على الاجتماع معايير الامتثال مثل SOC 2. توفر بيانات الجلسة المسجلة دعمًا قويًا للرقابة التنظيمية، مما يدل على الالتزام بأفضل الممارسات الأمنية وضمان الشفافية.

تتكامل إجراءات أمان Teleport بسلاسة في بيئات تكنولوجيا المعلومات الحديثة. إنها تيرافورم يدعم الموفر عمليات سير عمل البنية التحتية ككود، مما يتيح التوفير الآلي لسياسات الوصول. يضمن تكامل Kubernetes تأمين أعباء العمل في حاويات، بينما يسمح تصميم API الأول بالتكامل السهل مع أدوات الأمان وأنظمة المراقبة الحالية. وهذا يضمن أن تصبح إدارة الوصول جزءًا طبيعيًا من استراتيجيات الأمان الأوسع.

يقدم هذا القسم مقارنة موجزة للأدوات، مع التركيز على نقاط القوة والقيود في مجالات مثل إدارة التكلفة واكتشاف التهديدات والتكامل. ومن خلال فحص هذه المقايضات، يمكن للمؤسسات مواءمة خياراتها بشكل أفضل مع أولويات الأمان المحددة.

Prompts.ai يتألق في خفض التكاليف وتقديم مجموعة واسعة من نماذج الذكاء الاصطناعي، مع إمكانية الوصول إلى أكثر من 35 نموذجًا لغويًا رائدًا من خلال واجهة واحدة. إنه يتميز بضوابط FinOps في الوقت الفعلي لرؤية الإنفاق الواضحة والحوكمة على مستوى المؤسسة للحفاظ على الامتثال. ومع ذلك، فإن تركيزها على التنسيق بدلاً من تحليلات الأمان العميقة قد لا يلبي احتياجات المؤسسات التي تتطلب الكشف المتقدم عن التهديدات.

تفرد سنتينلون يتفوق في حماية نقاط النهاية، مستفيدًا من التحليل السلوكي لاكتشاف تهديدات يوم الصفر في الوقت الفعلي. يمكن أن تحتوي قدرات الاستجابة الذاتية الخاصة به على التهديدات في غضون ثوانٍ، كما أن بنيته السحابية الأصلية تتوسع بشكل فعال عبر المؤسسات. على الجانب السلبي، قد يتطلب تعقيدها خبرة مخصصة، وقد تكون تكاليف الترخيص المرتفعة عقبة أمام المنظمات الصغيرة.

شركة فيكترا للذكاء الاصطناعي يركز على اكتشاف التهديدات القائمة على الشبكة، باستخدام التعلم الآلي لتحديد الحركات الجانبية والتهديدات الداخلية. بفضل معدلات الإيجابية الكاذبة المنخفضة والتحليلات السلوكية التفصيلية، فإنها تقلل من إجهاد التنبيه وتوفر رؤى قيمة للشبكة. ومع ذلك، يعتمد أدائها على الرؤية القوية للشبكة، الأمر الذي يمكن أن يمثل تحديًا في الإعدادات عالية التوزيع أو التي تعتمد على السحابة أولاً.

مساعد الطيار الأمني لـ Microsoft وSentinel يتكامل بسلاسة داخل نظام Microsoft البيئي، مما يوفر الاستعلام اللغوي الطبيعي لتبسيط عمليات الأمان. تتعامل SIEM الأصلية السحابية بكفاءة مع أحجام البيانات الكبيرة، كما تعمل أطر الامتثال المضمنة على تخفيف التحديات التنظيمية. ومع ذلك، قد تواجه المؤسسات غير المضمنة بالفعل في النظام البيئي لشركة Microsoft قفل البائع ومنحنى التعلم الحاد.

عمليات الأمان من Google (SecOps) يستفيد من معلومات التهديدات العالمية، بالاعتماد على مليارات الأحداث الأمنية لتعزيز دقة الكشف. ومع ذلك، يمكن أن تحد متطلبات إقامة البيانات من جاذبيتها في مناطق معينة، وقد يكون التكامل معقدًا للبيئات التي لا تركز على Google.

أكتو.io متخصص في أمان واجهة برمجة التطبيقات وأتمتة اكتشاف الثغرات الأمنية عبر واجهات برمجة تطبيقات REST و GraphQL و WebSocket. يتكامل تصميمها الصديق للمطورين جيدًا مع خطوط أنابيب CI/CD، مما يوفر مراقبة في الوقت الفعلي للحماية المستمرة. ومع ذلك، فإن تركيزها الضيق على أمان API قد يتطلب أدوات إضافية لاحتياجات الأمان الأوسع.

تيليبورت يؤكد على التحكم في الوصول بدون ثقة، باستخدام المصادقة القائمة على الشهادات لتقليل المخاطر المرتبطة ببيانات الاعتماد الثابتة. وهو يدعم الإدارة الآلية للسياسات وتسجيل الجلسات، على الرغم من أن تنفيذها قد يمثل تحديًا في الأنظمة القديمة، وقد يؤدي منحنى التعلم إلى إبطاء التبني المبكر.

تسلط هذه النظرة العامة الضوء على نقاط القوة الفريدة لكل أداة، مما يساعد المؤسسات على تقييم خياراتها بناءً على أولويات مثل توفير التكاليف أو الكشف المتقدم عن التهديدات أو احتياجات التكامل أو أمان API.

إن اختيار أداة تنسيق الذكاء الاصطناعي المثالية يعني تقييم عوامل مثل الأمان والامتثال والأداء التشغيلي. كل حل يجلب مزايا مميزة، ومطابقتها مع أهداف مؤسستك أمر ضروري.

بالنسبة للفرق التي تركز على خفض التكاليف مع الحفاظ على الإشراف الآمن، Prompts.ai تبرز. إنه يوفر وصولاً سلسًا إلى نماذج الذكاء الاصطناعي الرائدة جنبًا إلى جنب مع عناصر تحكم FinOps في الوقت الفعلي، مما يتيح ما يصل إلى توفير بنسبة 98% في تكاليف برامج الذكاء الاصطناعي. وفي الوقت نفسه، فإنه يضمن الامتثال والقابلية الكاملة للتدقيق، مما يعكس التحول المتزايد نحو عمليات سير عمل أكثر أمانًا وكفاءة في مجال الذكاء الاصطناعي.

تعمل أدوات تنسيق الذكاء الاصطناعي على تعزيز الأمان من خلال تنفيذ تدابير قوية لحماية البيانات الحساسة والحفاظ على الامتثال طوال عمليات سير العمل. الميزات الرئيسية مثل عناصر التحكم في الوصول المستندة إلى الأدوار، التشفير، والالتزام بمعايير أمن الصناعة المعمول بها يعملان معًا لحماية المعلومات بشكل فعال.

تعمل هذه الأدوات أيضًا على تحسين الرقابة والوضوح من خلال توفير رؤى مفصلة حول عمليات صنع القرار بالذكاء الاصطناعي، وتعزيز المساءلة والثقة. من خلال التشغيل الآلي لبروتوكولات الأمان وضمان التطبيق المتسق للسياسات، فإنها تسهل إدارة نماذج الذكاء الاصطناعي المتعددة مع تقليل المخاطر المحتملة بشكل فعال.

يتوافق Prompts.ai مع معايير الامتثال الهامة مثل GDPR، هيبا، و ISO/IEC 27001، مع إعطاء الأولوية لأمن البيانات والخصوصية والالتزام بالمتطلبات التنظيمية. تم تصميم هذه الأطر لحماية البيانات الحساسة وتنفيذ ضوابط وصول قوية وبناء الثقة في عمليات سير العمل المدعومة بالذكاء الاصطناعي من خلال تلبية الإرشادات القانونية والصناعية الصارمة.

يعد الالتزام بهذه المعايير أمرًا ضروريًا لحماية بياناتك وتقليل التعرض القانوني ودمج الأمان بسلاسة في عمليات الذكاء الاصطناعي الخاصة بك. من خلال الالتزام بهذه البروتوكولات، يضمن Prompts.ai للشركات الوفاء بمسؤولياتها الأمنية أثناء إدارة تدفقات عمل الذكاء الاصطناعي بكفاءة وأمان.

توفر أدوات تنسيق الذكاء الاصطناعي ميزة مزدوجة للشركات: توفير المال وتعزيز أمن البيانات. من خلال التشغيل الآلي للمهام الروتينية وتبسيط سير العمل، فإنها تسمح للفرق بتخصيص وقتهم لمشاريع أكثر استراتيجية. تعمل هذه الأدوات أيضًا على إدارة موارد الحوسبة عبر الإعدادات المختلطة أو متعددة السحابات، مما يضمن استخدام الموارد بكفاءة وتقليل الإنفاق المهدر.

على صعيد الأمان، تأتي هذه المنصات مجهزة بميزات قوية مثل عناصر التحكم في الوصول المستندة إلى الأدوار، تشفير البيانات، والالتزام بمعايير الصناعة. تعمل هذه الإجراءات على حماية البيانات الحساسة وضمان الامتثال التنظيمي، مما يمنح الشركات الثقة في إدارة عملياتها القائمة على الذكاء الاصطناعي بأمان.