A orquestração de IA é a chave para dimensionar as operações empresariais de IA. Com 95% dos pilotos de IA falhando devido à má coordenação, as empresas precisam de ferramentas para unificar, automatizar e gerenciar fluxos de trabalho complexos de IA. O cenário de 2025 introduz plataformas que integram vários modelos, protegem fluxos de trabalho e otimizam custos, proporcionando um ROI até 60% maior para os adotantes.

Here’s a quick breakdown of the top solutions:

Cada plataforma oferece pontos fortes únicos em escalabilidade, interoperabilidade, governança e gerenciamento de custos. Quer você precise de flexibilidade de código aberto ou conformidade de nível empresarial, essas ferramentas podem transformar sistemas de IA fragmentados em ecossistemas unificados e escaláveis.

Escolha a plataforma certa para dimensionar suas iniciativas de IA, melhorar a coordenação e maximizar o ROI.

Comparação de plataformas de orquestração de IA: escalabilidade, interoperabilidade, governança e eficiência. Custo

Prompts.ai é uma plataforma empresarial de ponta projetada para simplificar e agilizar as operações de IA. Ele reúne mais de 35 modelos de linguagem de alto nível - incluindo GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro e Kling - em uma interface segura e unificada. Ao centralizar o acesso a esses modelos, a plataforma elimina o caos do gerenciamento de múltiplas ferramentas, ajudando as organizações a dimensionar seus esforços de IA com facilidade.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Como um hub centralizado, o Prompts.ai garante que todos os processos orientados por IA dependam de modelos de prompt autorizados e controlados por versão, em vez de strings dispersas e codificadas. Sua arquitetura permite a seleção fácil de modelos e comparações de desempenho lado a lado, capacitando as equipes a identificar e implantar o modelo de linguagem grande (LLM) mais eficaz para cada tarefa. Tudo isso é conseguido sem a necessidade de reescrever código ou ajustar pipelines, economizando tempo e esforço.

Prompts.ai prioriza segurança e controle por meio de controle de acesso robusto baseado em funções (RBAC). Isso permite que as organizações definam permissões precisas para quem pode criar, modificar ou implantar prompts em ambientes de produção. Cada interação é meticulosamente registrada com trilhas de auditoria e rastreamento de versão, oferecendo total transparência. Esta estrutura de governança ajuda as empresas a cumprir os padrões de conformidade, ao mesmo tempo que mantêm a visibilidade e o controle sobre as operações de IA. Ao combinar medidas rigorosas de segurança com eficiência operacional, a plataforma ajuda as organizações a gerir a IA de forma segura e eficaz.

A plataforma inclui uma camada FinOps que rastreia o uso de tokens, conectando diretamente os gastos com IA aos resultados de negócios. Muitas organizações relataram redução de custos em até 98%, consolidando relacionamentos com fornecedores e cortando assinaturas desnecessárias. Com métricas de uso e desempenho em tempo real, as equipes podem monitorar e otimizar os gastos continuamente, evitando gastos inesperados no final do mês. Este nível de transparência financeira transforma a IA de uma incerteza orçamental num investimento mensurável com retornos claros.

LangChain se destaca como uma estrutura poderosa para aplicativos de IA, com impressionantes 90 milhões de downloads mensais e mais de 100.000 estrelas no GitHub. Seu design modular divide a funcionalidade em pacotes leves, como langchain-core para abstrações básicas e langchain-community para integrações de terceiros. Essa abordagem garante fluxos de trabalho de IA simplificados sem sobrecarga desnecessária, tornando-a uma opção ideal para gerenciar a complexidade e a escala.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

A LangSmith segue padrões de conformidade rigorosos, incluindo HIPAA, SOC 2 Tipo 2 e GDPR. Ele oferece rastreamento de execução detalhado, criando uma trilha de auditoria abrangente para depuração e revisões de conformidade. O LangGraph aprimora isso com recursos humanos no circuito, incluindo recursos de “viagem no tempo” para inspeção, reversão e correção em tempo real.

__XLATE_10__

Garrett Spong, Diretor SWE, destaca: "O LangGraph estabelece a base de como podemos construir e dimensionar cargas de trabalho de IA - desde agentes de conversação, automação de tarefas complexas até experiências personalizadas apoiadas por LLM que 'simplesmente funcionam'".

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) se destaca com um histórico impressionante: 258 milhões de downloads de PyPI, 33.100 estrelas no GitHub e uma comunidade próspera de mais de 3.000 colaboradores. Projetado para ser executado nativamente no Kubernetes, o KFP executa cada etapa de um pipeline como um pod separado, permitindo dimensionar dinamicamente os recursos de computação em seu cluster conforme necessário. Sua arquitetura depende de uma estrutura Directed Acíclica Graph (DAG), permitindo a execução paralela de tarefas em contêineres, a menos que dependências de dados específicas sejam definidas [18, 19]. Essa configuração é fundamental para sua capacidade de lidar com fluxos de trabalho complexos com eficiência.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

O KFP garante flexibilidade e portabilidade por meio de seu formato IR YAML, que permite que pipelines sejam executados perfeitamente em diferentes back-ends KFP, desde configurações de código aberto até serviços gerenciados como Google Cloud Vertex AI Pipelines. Isso significa que você pode desenvolver localmente e implantar em escala na nuvem sem reescrever seu código. A plataforma também se integra a ferramentas populares como Spark, Ray e Dask para preparação de dados, bem como KServe para inferência de modelo escalonável. Com seu SDK Python, os cientistas de dados podem definir fluxos de trabalho complexos usando práticas de codificação familiares, enquanto o back-end os traduz automaticamente em operações do Kubernetes.

Segurança e governança são essenciais para o KFP. Ele usa recursos integrados do Kubernetes, como controle de acesso baseado em função (RBAC), namespaces para isolamento e políticas de rede, para garantir a execução segura do fluxo de trabalho. A plataforma rastreia metadados e artefatos centralmente, criando uma trilha de auditoria detalhada para cada execução de pipeline [8, 22]. Ao executar cada etapa do pipeline em um contêiner isolado, o KFP mantém o isolamento do processo e o manuseio seguro dos dados. Os administradores têm a capacidade de definir limites de recursos para tarefas individuais, garantindo uma distribuição justa de recursos entre as equipes e evitando o uso excessivo. Para dados ou cargas de trabalho confidenciais, os seletores de nós podem ser usados para restringir tarefas a hardware específico e seguro.

Embora o KFP em si seja de código aberto e de uso gratuito, os custos associados à infraestrutura subjacente do Kubernetes - seja no AWS EKS, no Google GKE ou no local - ainda se aplicam. Versões gerenciadas, como Google Cloud Vertex AI Pipelines, operam em um modelo de preços pré-pago [19, 20]. O KFP também inclui recursos como mecanismos de repetição para falhas transitórias, que ajudam a evitar as despesas de reinicialização de pipelines de longa execução, e manipuladores de saída que garantem que as tarefas de limpeza sejam executadas mesmo se as etapas anteriores falharem. Esses recursos contribuem para um uso mais eficiente de recursos e controle de custos.

Argo Workflows é um mecanismo popular de execução de fluxo de trabalho projetado especificamente para Kubernetes, com mais de 200 organizações contando com ele em ambientes de produção. Como uma solução nativa de contêiner, ela orquestra trabalhos paralelos executando cada etapa do fluxo de trabalho em um pod isolado. Essa arquitetura permite o escalonamento dinâmico com base na capacidade disponível do seu cluster Kubernetes, tornando-o particularmente eficaz para tarefas de IA que exigem gerenciamento flexível de recursos.

Argo Workflows oferece suporte ao dimensionamento por meio de otimização vertical e fragmentação. Ao aumentar o parâmetro --workflow-workers, você pode alocar mais núcleos de CPU para acelerar a reconciliação do fluxo de trabalho. Para operações maiores, a fragmentação pode ser implementada implantando instalações separadas por namespace ou executando várias instâncias de controlador no mesmo cluster usando IDs de instância. Para proteger o servidor API Kubernetes, Argo emprega limitação de taxa do lado do cliente (padrão: 20 consultas por segundo com um intervalo de 30) e limita a simultaneidade de etapas foreach em 100 tarefas. Esta abordagem escalável garante uma integração suave com sistemas externos, mesmo sob cargas de trabalho pesadas.

Como uma definição de recursos personalizados (CRD) do Kubernetes, o Argo se integra perfeitamente a qualquer cluster Kubernetes e alimenta plataformas de IA proeminentes, como Kubeflow Pipelines, Netflix Metaflow, Seldon e Kedro. Os desenvolvedores podem definir fluxos de trabalho usando SDKs oficiais para Python (Hera), Java e Go, oferecendo flexibilidade na escolha da linguagem. Para gerenciamento de artefatos, a Argo oferece suporte a várias soluções de armazenamento, incluindo AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory e Alibaba Cloud OSS. Essa compatibilidade garante um fluxo de dados suave em diversos ambientes. Além disso, os fluxos de trabalho podem ser acionados por sinais externos, como webhooks ou alterações de armazenamento usando Argo Events. De acordo com a documentação do Metaflow, o Argo Workflows é o único orquestrador de produção que oferece suporte ao acionamento de eventos por meio do Argo Events. Esta combinação de flexibilidade e funcionalidade torna-o uma escolha robusta para automação de fluxo de trabalho.

Argo Workflows aproveita os recursos nativos do Kubernetes para garantir uma segurança forte. O Controle de Acesso Baseado em Função (RBAC) gerencia permissões para o controlador de fluxo de trabalho, usuários e pods individuais. Para melhorar o isolamento, o controlador pode ser restrito a um único namespace usando o modo "namespace-install". Em ambientes de produção, o Argo suporta Single Sign-On (SSO) via OAuth2 e OIDC, ao mesmo tempo que protege os dados em trânsito com criptografia TLS. Os administradores podem impor restrições de fluxo de trabalho, permitindo que os usuários enviem apenas modelos pré-aprovados, e os contextos de segurança do pod ajudam a evitar que os pods sejam executados como root. As políticas de rede regulam o tráfego do Argo Server e do Workflow Controller, e um limite de profundidade de recursão padrão de 100 chamadas evita loops infinitos.

Argo Workflows é uma ferramenta de código aberto disponível sob a licença Apache 2.0, tornando seu uso gratuito. Para gerenciar custos, ele emprega estratégias TTL e Pod Garbage Collection (PodGC) para excluir automaticamente fluxos de trabalho concluídos e limpar pods não utilizados, reduzindo o desperdício de recursos. As tarefas podem ser agendadas em infraestrutura econômica, como instâncias spot, usando seletores de nós e regras de afinidade. Além disso, o uso de recursos é rastreado por etapa, ajudando os usuários a monitorar os gastos. Se você notar "aceleração do lado do cliente" nos logs do controlador, aumentar os valores --qps e --burst pode melhorar a eficiência da comunicação com a API Kubernetes. Este design cuidadoso ajuda a equilibrar desempenho com economia.

O Apache Airflow se tornou um participante importante no gerenciamento de fluxos de trabalho de IA, oferecendo uma estrutura flexível e baseada em código para orquestrar operações complexas. É especialmente proeminente em Operações de Aprendizado de Máquina (MLOps), onde 23% de seus usuários o aplicam, e em projetos de IA Generativa, usados por 9% de sua comunidade. Lançado sob a licença Apache 2.0, o Airflow permite que os desenvolvedores definam fluxos de trabalho em Python, integrando-se perfeitamente a qualquer biblioteca de aprendizado de máquina.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

O KubernetesExecutor é especialmente útil para lidar com cargas de trabalho imprevisíveis e com muitos recursos. Recursos como o mapeamento dinâmico de tarefas permitem que as tarefas sejam dimensionadas com base em dados em tempo real, tornando-o perfeito para grandes conjuntos de dados e fluxos de trabalho com vários modelos. Enquanto isso, os Operadores Diferíveis melhoram a eficiência gerenciando longos estados de espera, como o monitoramento do treinamento do modelo, sem ocupar vagas de trabalho. Essa abordagem aumenta significativamente o rendimento e a utilização de recursos.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

A API TaskFlow simplifica a criação de fluxo de trabalho usando decoradores Python para transformar scripts em tarefas do Airflow, gerenciando automaticamente as transferências de dados por meio de XComs. As equipes podem encaminhar tarefas para ambientes apropriados, como pods Kubernetes para treinamento intensivo em GPU ou clusters Spark para pré-processamento de dados. Além disso, a API REST e a CLI do airflowctl permitem integração segura com pipelines de CI/CD, garantindo um gerenciamento de fluxo de trabalho tranquilo e auditável.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

Para governança de dados, o Airflow se integra ao OpenLineage, um padrão para rastreamento de linhagem de dados, que ajuda a atender a requisitos de conformidade como GDPR e HIPAA. A CLI do airflowctl interage exclusivamente com a API REST, evitando acesso direto ao banco de dados de metadados para maior segurança. As equipes também podem gerenciar ambientes reproduzíveis usando tarefas de configuração e desmontagem, tratando a infraestrutura como código para melhor supervisão e consistência.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

O Azure Machine Learning oferece uma solução poderosa para as necessidades empresariais de IA, com GPUs avançadas, rede InfiniBand, tempo de atividade de 99,9% e mais de 100 certificações de conformidade. Apoiado por uma equipe de 34.000 engenheiros e 15.000 especialistas em segurança, garante confiabilidade e segurança em grande escala.

A plataforma foi projetada para lidar com cargas de trabalho de qualquer tamanho por meio de suporte para computação distribuída entre dados, modelos e pipelines, maximizando a eficiência dos recursos. Os endpoints on-line gerenciados permitem a implantação perfeita de modelos com escalonamento automático para acomodar picos de demanda. Por exemplo, Marcas & Spencer utilizou o Azure ML para processar dados de mais de 30 milhões de clientes, aproveitando ao mesmo tempo o cache e os registros do pipeline para reduzir o tempo e os custos de treinamento. Da mesma forma, na BRF, ML e MLOps automatizados eliminaram tarefas manuais de 15 analistas, permitindo-lhes concentrar-se em trabalhos de maior valor.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"Sem o fluxo imediato da IA do Azure, teríamos sido forçados a investir em engenharia personalizada bastante significativa para fornecer uma solução. Em vez disso, conseguimos alcançar grande velocidade integrando facilmente nossos microsserviços existentes na solução de fluxo imediato."

O Azure ML também oferece suporte ao treinamento distribuído que preserva a privacidade, conforme demonstrado por Johan Bryssinck, da Swift, que usou a plataforma para treinar modelos em dispositivos de borda locais, em vez de centralizar os dados, garantindo a escalabilidade e a privacidade dos dados. Seu contrato de API unificado, juntamente com integrações com Azure Logic Apps e Azure Functions, aprimora ainda mais a conectividade com ferramentas externas.

O Azure Machine Learning prioriza a segurança com recursos como o Microsoft Entra ID para controle de acesso baseado em função (RBAC) e redes virtuais para isolar recursos e limitar o acesso à API. Os dados são protegidos com criptografia TLS 1.2/1.3 durante o trânsito e criptografia dupla em repouso, com opções de chaves gerenciadas pelo cliente para maior controle. Defesas em tempo real, como Prompt Shields, evitam jailbreaks e ataques de injeção imediata, enquanto o Customer Lockbox exige aprovação administrativa para que a Microsoft acesse os dados do cliente. Ferramentas adicionais rastreiam versões de ativos, linhagem de dados e cotas, e o Microsoft Defender for Cloud fornece proteção contra ameaças em tempo de execução.

O Azure Machine Learning funciona num modelo de preços pré-pago, cobrando apenas por recursos de computação, como CPUs e GPUs especializadas. Serviços de suporte como Blob Storage, Key Vault, Container Registry e Application Insights também são cobrados com base no uso. As equipes podem escolher hardware adaptado para tarefas específicas, enquanto recursos como cache de pipeline reduzem cálculos redundantes. A infraestrutura como código garante implantação consistente e gerenciamento eficiente de recursos.

O Google Vertex AI Pipelines simplifica o gerenciamento da infraestrutura automatizando fluxos de trabalho de aprendizado de máquina (ML). Ele organiza tarefas em um gráfico acíclico direcionado (DAG) de componentes em contêineres, permitindo que as equipes se concentrem no desenvolvimento de modelos em vez de no gerenciamento de servidores.

O Vertex AI Pipelines usa uma abordagem sem servidor para lidar com cargas de trabalho, delegando tarefas de processamento intensivo a ferramentas como BigQuery, Dataflow e Cloud Serverless para Apache Spark. Para cálculos distribuídos de Python e ML, ele se integra perfeitamente ao Ray on Vertex AI.

A plataforma suporta nós das séries A3 e A3 Mega equipados com GPUs NVIDIA H100/H200. Os nós A3 Mega, com 8 GPUs H100, oferecem uma impressionante largura de banda entre nós de 1.600 Gbps. Por exemplo, a Vectra analisou 300.000 ligações mensais de clientes usando Gemini e Vertex AI, alcançando um aumento de 500% na velocidade de análise.

A eficiência de custos é integrada ao cache de execução, que reutiliza resultados para minimizar despesas. Vertex ML Metadata garante reprodutibilidade rastreando a linhagem de artefatos, parâmetros e métricas em escala. Esse design escalável integra-se facilmente a uma variedade de ferramentas, tornando-o uma solução versátil para fluxos de trabalho de ML.

O SDK do Google Cloud Pipeline Components (GCPC) simplifica a integração, oferecendo componentes pré-construídos que conectam serviços da Vertex AI, como AutoML, jobs de treinamento personalizados e implantação de modelo, diretamente em pipelines.

O gerenciamento de pipeline é flexível, com opções como Cloud Composer (Apache Airflow gerenciado) e gatilhos Cloud Data Fusion para orquestrar fluxos de trabalho entre serviços. Conexões nativas com BigQuery, Cloud Storage e Dataproc simplificam o processamento de dados, enquanto os metadados podem ser sincronizados com o Dataplex Universal Catalog para rastreamento de linhagem entre projetos. Além disso, o Model Garden oferece acesso a mais de 200 modelos, incluindo Gemini do Google, Claude da Anthropic e Llama da Meta.

As definições de pipeline são compiladas em um formato YAML padronizado, garantindo portabilidade entre repositórios como o Artifact Registry.

O Vertex AI Pipelines foi projetado tendo em mente a governança e a segurança. As contas de serviço garantem que cada componente opere apenas com as permissões necessárias. O VPC Service Controls estabelece um perímetro seguro, evitando que dados confidenciais, como conjuntos de dados de treinamento, modelos e resultados de previsão em lote, saiam dos limites da rede.

Para organizações com necessidades rigorosas de conformidade, a plataforma oferece suporte a chaves de criptografia gerenciadas pelo cliente (CMEK), além da criptografia em repouso padrão do Google Cloud. O Vertex ML Metadata fornece uma trilha de auditoria detalhada registrando automaticamente parâmetros, artefatos e métricas de cada execução de pipeline.

Recursos de segurança como o Model Armor protegem contra injeção imediata e exfiltração de dados. Os pipelines podem ser configurados para serem executados em redes VPC com peering, e o Cloud Logging permite que as equipes monitorem eventos de pipeline em busca de quaisquer anomalias de segurança.

O Vertex AI Pipelines opera em um modelo pré-pago, com rótulos de faturamento aplicados automaticamente para rastreamento de custos por meio de exportações do Cloud Billing para o BigQuery. O cache de execução reduz ainda mais os custos ao reutilizar os resultados.

Para reduzir as despesas com trabalhos de treinamento tolerantes a interrupções, as VMs Spot estão disponíveis a preços reduzidos. Para compromissos de infraestrutura de longo prazo, os Descontos por Uso Comprometido (CUDs) proporcionam economia de custos e capacidade garantida. O Dynamic Workload Scheduler (DWS) oferece capacidade para cargas de trabalho flexíveis a preços de tabela mais baixos, enquanto clusters de treinamento dedicados garantem capacidade de acelerador reservada para trabalhos em grande escala.

O IBM watsonx Orchestrate atua como um hub central, coordenando agentes de IA, funcionando como supervisor, roteador e planejador para ferramentas especializadas e modelos básicos. A plataforma oferece suporte a várias abordagens de orquestração: React para tarefas exploratórias, Plan-Act para fluxos de trabalho estruturados e orquestração determinística para processos de negócios previsíveis.

Projetado para operações em larga escala, o watsonx Orchestrate usa orquestração multiagente para rotear solicitações de forma eficiente para as ferramentas apropriadas e grandes modelos de linguagem (LLMs) em tempo real. As organizações podem optar por implementar o watsonx Orchestrate como um serviço gerenciado na IBM Cloud ou AWS, ou instalá-lo no local para se alinhar à infraestrutura existente.

A plataforma já apresentou resultados mensuráveis. Por exemplo, a IBM resolveu 94% dos 10 milhões de solicitações anuais de RH instantaneamente por meio do watsonx Orchestrate, permitindo que as equipes de RH se concentrassem em tarefas de maior valor. Da mesma forma, Dun & A Bradstreet reduziu o tempo de aquisição em até 20% com avaliações de risco de fornecedores baseadas em IA, economizando aos clientes mais de 10% no tempo de avaliação.

Para oferecer suporte à implantação rápida, a plataforma inclui um Agent Builder sem código e um Agent Development Kit (ADK) para criar ferramentas personalizadas baseadas em Python. Além disso, um catálogo com mais de 100 agentes de IA específicos de domínio e mais de 400 ferramentas pré-construídas oferece componentes escalonáveis para atender a diversas necessidades operacionais.

Esta escalabilidade garante uma integração suave com os sistemas existentes, tornando-o adaptável a uma ampla variedade de ambientes empresariais.

O AI Gateway da plataforma facilita o roteamento contínuo entre vários modelos básicos, incluindo IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral e Llama, ajudando as organizações a evitar a dependência de fornecedores. O Agent Development Kit oferece suporte à criação de ferramentas personalizadas usando especificações OpenAPI para serviços web remotos e Python para funcionalidade estendida.

A integração com Langflow adiciona uma interface visual de arrastar e soltar para projetar aplicativos de IA, que podem então ser importados para o ambiente Orchestrate. Além disso, o watsonx Orchestrate se conecta facilmente a sistemas empresariais como Salesforce, SAP, Workday e Microsoft 365, eliminando a necessidade de extensas mudanças de infraestrutura.

Com AgentOps, a plataforma monitora as atividades dos agentes de IA e aplica políticas em tempo real para garantir confiabilidade e conformidade. Grades de proteção integradas e supervisão centralizada ajudam a manter a adesão aos regulamentos internos.

__XLATE_52__

“Com AgentOps, cada ação é monitorada e governada, permitindo que anomalias sejam sinalizadas e corrigidas em tempo real.” - Redação da IBM

A integração do IBM Guardium aprimora a segurança identificando implementações de IA não autorizadas e expondo vulnerabilidades ou configurações incorretas. A plataforma também implementa controle de acesso baseado em função (RBAC), que inclui quatro funções principais – Administrador, Construtor, Usuário e Especialista em Produto – para proteger as configurações do ambiente. As empresas que usam watsonx.governance relataram um aumento de 30% no ROI de suas iniciativas de IA.

A plataforma oferece preços flexíveis para atender a diferentes necessidades organizacionais:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31 de janeiro de 2026.

O UiPath AI Center reúne agentes de IA, bots de RPA e trabalhadores humanos em fluxos de trabalho empresariais, criando um ecossistema escalável projetado para atender às demandas de 2025. Em sua essência, a plataforma utiliza o UiPath Maestro como seu centro de controle inteligente, gerenciando processos de longa execução em operações de negócios complexas.

O UiPath AI Center oferece duas opções de implantação para atender às diversas necessidades de negócios: Automation Cloud, que fornece escalonamento elástico instantâneo, e Automation Suite, adaptado para implantação local. Seu sistema MLOps apresenta uma interface fácil de arrastar e soltar para implantar e monitorar modelos, permitindo que eles sejam escalonados perfeitamente em um número ilimitado de robôs. Por exemplo, a SunExpress Airlines relatou uma economia de mais de US$ 200.000 e reduziu os atrasos em dois meses. A plataforma também garante que os modelos permaneçam precisos por meio de reciclagem contínua humana, tornando-a uma ferramenta poderosa para integrar IA em diversos sistemas.

A plataforma adota uma estratégia “Bring Your Own Model” (BYOM), permitindo a integração com estruturas de terceiros como LangChain, Anthropic e Microsoft. Além disso, o protocolo Agent2Agent (A2A), desenvolvido em colaboração com o Google Cloud, facilita a comunicação tranquila entre agentes de IA em plataformas empresariais.

__XLATE_59__

Harrison Chase, CEO da LangChain, compartilhou: “Nossa colaboração com a UiPath no Protocolo de Agente garante que os agentes LangGraph possam participar perfeitamente das automações da UiPath, ampliando seu alcance e permitindo que os desenvolvedores criem fluxos de trabalho mais coesos e multiplataforma”.

O UiPath AI Center se conecta a centenas de aplicativos SaaS por meio de APIs padronizadas, oferece suporte a BPMN 2.0 para modelagem de processos e usa modelo de decisão e notação (DMN) para gerenciar regras de negócios. Um exemplo notável é o Heritage Bank, o maior banco mútuo da Austrália, que utilizou o AI Centre para automatizar seu processo de revisão de empréstimos, melhorando a experiência do cliente e reduzindo as tarefas manuais de back-end.

O UiPath AI Center prioriza governança e segurança, oferecendo controles de acesso em nível de projeto e locatário para manter a rastreabilidade e a conformidade. Seus recursos de agência controlada garantem que os agentes de IA não possam executar ações não autorizadas ou inseguras de forma autônoma.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

O UiPath AI Center emprega um modelo de licenciamento baseado em consumo usando unidades de IA, que medem atividades como treinamento de modelo, hospedagem e previsões. Eles se integram perfeitamente ao sistema de licenciamento UiPath mais amplo por meio de Unidades de Plataforma, cobrindo as necessidades de orquestração e execução. Para ajudar as organizações a explorar seus recursos, uma avaliação gratuita de 60 dias está disponível para as versões Automation Cloud e Automation Suite, facilitando a avaliação de seu valor e ao mesmo tempo mantendo os custos sob controle.

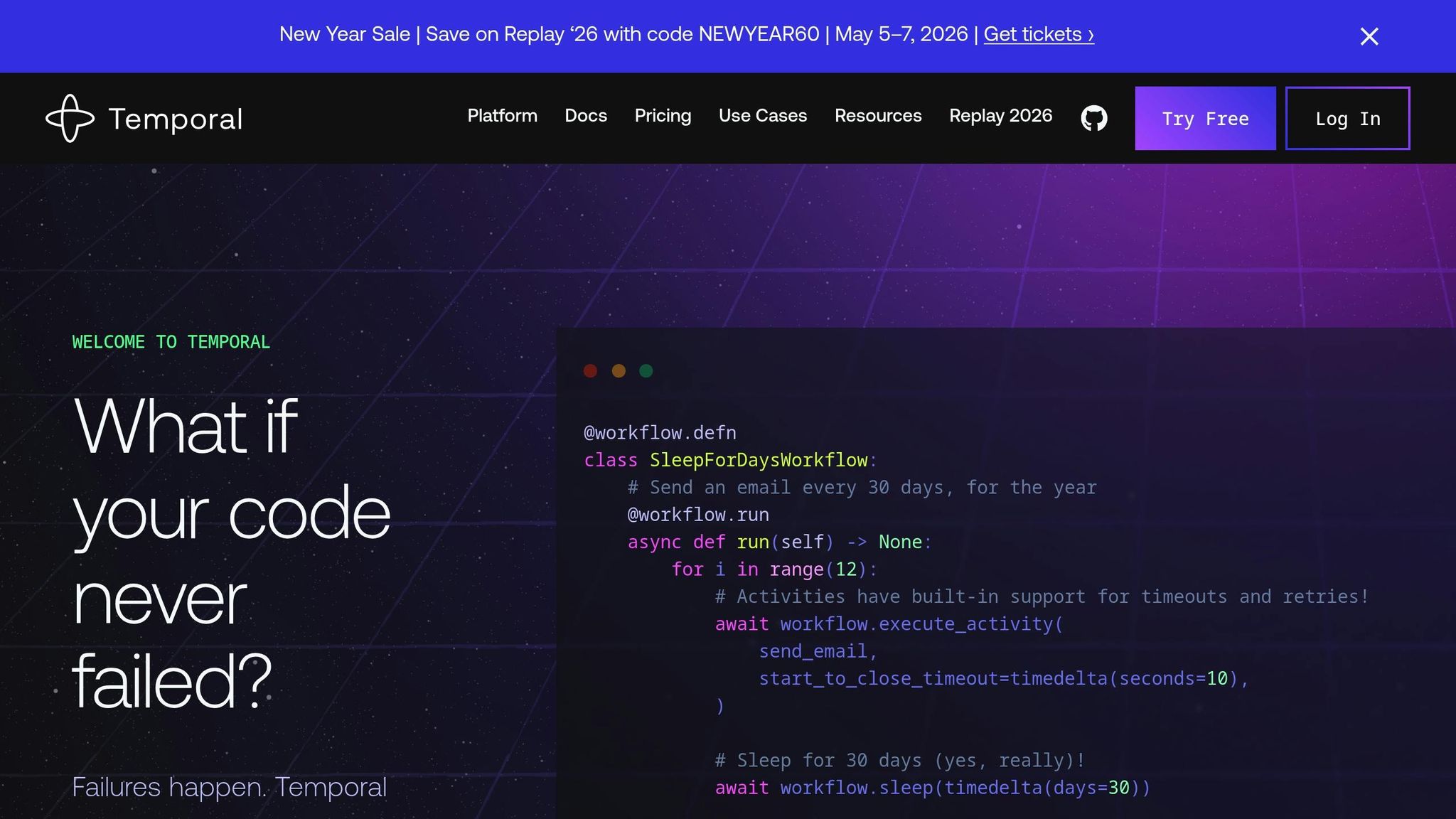

Temporal adota uma abordagem exclusiva usando código durável e recuperável em vez de depender de arquivos de configuração. Ele captura todas as etapas do fluxo de trabalho em um histórico de eventos imutável, garantindo que os processos possam continuar exatamente de onde pararam após uma interrupção. Um ótimo exemplo disso é o Replit, que fez a transição do plano de controle do agente de codificação para Temporal, melhorando significativamente a confiabilidade e a experiência do usuário.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, gerente de produto, Retool

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Essa escalabilidade garante integração perfeita com várias ferramentas e sistemas.

Os desenvolvedores podem escrever fluxos de trabalho como código em linguagens populares como Python, Go, Java, TypeScript, .NET e PHP. Temporal também se integra facilmente às principais estruturas de IA, incluindo OpenAI Agents SDK, Pydantic AI, LangGraph e Crew AI. Seu suporte ao Model Context Protocol (MCP) aumenta a confiabilidade do agente. A observabilidade é melhorada através de conexões com ferramentas de monitoramento específicas de IA, como o Langfuse. Por exemplo, Gorgias utiliza essa flexibilidade para ajudar mais de 15.000 marcas de comércio eletrônico a gerenciar agentes de atendimento ao cliente orientados por IA.

O histórico de eventos da Temporal fornece uma trilha de auditoria completa e inalterável de cada mudança de estado nos fluxos de trabalho de IA. Esse recurso oferece suporte à governança humana, permitindo que os fluxos de trabalho sejam pausados para validação externa antes de executar decisões autônomas. Esta salvaguarda é particularmente útil em ambientes de produção para evitar problemas como alucinações LLM. Nas implantações de nuvem temporal, o provedor não pode acessar o código do aplicativo, enquanto a opção de servidor de código aberto licenciado pelo MIT permite que as organizações hospedem a plataforma em sua própria infraestrutura segura. Os engenheiros da Netflix destacaram como esse design minimiza a manutenção e simplifica o tratamento de falhas.

O Temporal Cloud opera em um modelo pré-pago, enquanto o Temporal Server de código aberto é gratuito para auto-hospedagem. Novos usuários podem explorar a plataforma com US$ 1.000 em créditos gratuitos para Temporal Cloud. Ao suspender fluxos de trabalho sem consumir recursos computacionais, os usuários podem reduzir significativamente os custos operacionais e de infraestrutura. O design do Temporal não apenas melhora a eficiência e a confiabilidade, mas também mantém as despesas sob controle à medida que as operações de IA crescem.

A seleção da plataforma de orquestração de IA ideal requer equilíbrio entre flexibilidade e facilidade de uso. Opções de código aberto como Apache Airflow e LangChain oferecem independência de fornecedor e personalização profunda, mas exigem habilidades técnicas avançadas e configurações manuais para segurança e governança. Por outro lado, plataformas empresariais como IBM watsonx Orchestrate e UiPath incluem recursos integrados como controle de acesso baseado em função (RBAC), trilhas de auditoria e conformidade com HIPAA, embora venham com taxas de licenciamento e flexibilidade reduzida.

As estratégias de escalabilidade variam amplamente entre plataformas. Ferramentas nativas do Kubernetes, como Kubeflow e Argo Workflows, se destacam na portabilidade em contêineres, enquanto o agendamento baseado em gráfico acíclico direcionado (DAG) do Apache Airflow é eficaz para gerenciar dependências complexas em configurações híbridas e multinuvem. A Temporal é conhecida por seu alto rendimento, enquanto o Azure Machine Learning e o Google Vertex AI Pipelines aproveitam seus ecossistemas de nuvem pai para alocar recursos dinamicamente durante picos de demanda. Estas variações destacam os compromissos que as organizações devem considerar ao avaliar soluções.

A interoperabilidade é outro fator crítico para garantir fluxos de trabalho unificados. LangChain permite que os desenvolvedores conectem vários modelos de linguagem grandes (LLMs) e APIs sem revisar os sistemas existentes, e o Kubeflow oferece suporte a estruturas como PyTorch, TensorFlow e JAX em um único pipeline. Plataformas como Prompts.ai visam reduzir a fragmentação unificando vários modelos, enquanto plataformas específicas de fornecedores, como Azure Machine Learning e IBM watsonx Orchestrate, fornecem integrações nativas perfeitas, mas podem exigir conectores adicionais para compatibilidade mais ampla.

As compensações operacionais também desempenham um papel fundamental nas decisões de implantação e no retorno do investimento (ROI). A governação e a gestão de custos são áreas onde as plataformas diferem significativamente. Soluções de nível empresarial, como IBM watsonx Orchestrate e UiPath, fornecem painéis centralizados e recursos de segurança robustos, tornando-as adequadas para setores regulamentados, como saúde e finanças. Por outro lado, as ferramentas de código aberto geralmente exigem configuração manual para obter uma supervisão comparável. Do ponto de vista dos custos, embora Apache Airflow, LangChain e Kubeflow sejam de implantação gratuita, eles podem incorrer em despesas ocultas relacionadas ao tempo e experiência de engenharia. A Temporal Cloud oferece preços pré-pagos com US$ 1.000 em créditos gratuitos, enquanto a Prompts.ai reduz significativamente os custos de software de IA - até 98% - por meio de seu sistema de crédito TOKN unificado que elimina taxas recorrentes.

A tabela abaixo fornece uma comparação detalhada de cada plataforma nas principais dimensões operacionais:

A seleção da melhor plataforma de orquestração de IA depende dos recursos técnicos, das necessidades de conformidade e dos planos de crescimento da sua organização. Opções de código aberto como Apache Airflow e LangChain oferecem flexibilidade incomparável sem taxas de licenciamento, tornando-as uma escolha ideal para equipes orientadas por desenvolvedores em startups de tecnologia e empresas de rápido crescimento que valorizam configurações modulares. No entanto, essas estruturas exigem habilidades avançadas de engenharia para configurar recursos críticos como segurança, governança e escalabilidade. Por outro lado, plataformas empresariais como o IBM watsonx Orchestrate atendem a setores como saúde e finanças, onde medidas de conformidade integradas – como controles de acesso baseados em funções, trilhas de auditoria e certificações como HIPAA e SOC 2 – não são negociáveis. Estas plataformas demonstram frequentemente retornos tangíveis, simplificando fluxos de trabalho e ligando funcionalidades de governação a melhores resultados de negócio.

Para as grandes empresas, as plataformas de governação pesada são essenciais, mas as empresas de média dimensão necessitam frequentemente de soluções que equilibrem custos e desempenho. Prompts.ai simplifica essa equação integrando mais de 35 modelos em uma interface, oferecendo controles FinOps em tempo real e créditos TOKN pré-pagos para minimizar a fragmentação da ferramenta e despesas inesperadas. Enquanto isso, ferramentas nativas do Kubernetes, como Kubeflow Pipelines e Argo Workflows, brilham quando a portabilidade e as implantações de nuvem híbrida são essenciais, especialmente para equipes de ciência de dados que gerenciam pipelines complexos de aprendizado de máquina em sistemas distribuídos.

Conforme discutido anteriormente, o surgimento da IA de agência – onde agentes autônomos colaboram no raciocínio em várias etapas – destaca a crescente importância da orquestração contínua. Para citar Domo:

__XLATE_78__

“O sucesso na IA não consiste mais em ter o maior número de modelos – trata-se de orquestrá-los de forma eficaz”.

Para as organizações dos EUA, é crucial escolher plataformas que correspondam à sua maturidade técnica atual, ao mesmo tempo que oferecem espaço para escalar à medida que a IA se torna mais integrada entre os departamentos. Um ponto de partida inteligente é um projeto piloto focado em um fluxo de trabalho específico, rastreando entradas, saídas e erros para estabelecer uma linha de base de observabilidade para escalonamento futuro. A plataforma de orquestração certa faz mais do que apenas conectar ferramentas de IA – ela redefine a forma como as equipes colaboram, resolvem problemas e criam valor em maior escala.

As plataformas de orquestração de IA simplificam fluxos de trabalho complexos, reunindo vários modelos de IA, fontes de dados e processos em um sistema automatizado. Eles gerenciam tarefas como agendamento, distribuição de recursos e integração de API, minimizando o esforço manual e reduzindo significativamente o tempo de desenvolvimento e as despesas operacionais.

Essas plataformas são construídas para serem escalonadas sem esforço, permitindo que as empresas passem do gerenciamento de um punhado de tarefas para o gerenciamento de milhares sem revisar sua infraestrutura. Eles se destacam no processamento de grandes volumes de dados, tornando o uso de recursos mais eficiente e mantendo uma supervisão consistente. Isso leva a implantações mais rápidas, maior produtividade e soluções de IA mais bem equipadas para atender às necessidades dinâmicas das empresas.

As plataformas de orquestração de IA muitas vezes gerenciam despesas por meio de modelos de preços baseados no uso, permitindo que as empresas paguem apenas pelo que usam, em vez de se comprometerem com licenças fixas. Muitas dessas plataformas vêm equipadas com ferramentas financeiras em tempo real, incluindo painéis para monitorar gastos por modelo ou fluxo de trabalho, sistemas de alerta orçamentário e marcação de carga de trabalho para análise detalhada de custos. Estas ferramentas garantem que as empresas tenham uma visão clara das suas despesas relacionadas com a IA e mantenham o controlo sobre os seus orçamentos.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai está estabelecendo o padrão para orquestração segura de IA em 2025, oferecendo às empresas uma plataforma confiável para dimensionar suas operações de IA sem esforço. Seu painel unificado foi projetado para simplificar o gerenciamento, apresentando ferramentas de governança integradas, rastreamento de custos em tempo real e trilhas de auditoria imutáveis. Esses recursos garantem que as empresas permaneçam em conformidade, ao mesmo tempo que mantêm a supervisão completa de seus fluxos de trabalho de IA.

Equipado com medidas de segurança de nível empresarial, como controle de acesso baseado em função, criptografia ponta a ponta e monitoramento contínuo de conformidade, o Prompts.ai protege dados confidenciais em todas as fases da operação. Com a integração de mais de 35 LLMs líderes em uma única estrutura segura, reduz os riscos e capacita as empresas a expandir suas capacidades de IA com confiança e eficiência.