AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Aprofunde-se para encontrar a estrutura certa para sua equipe e seus fluxos de trabalho.

Prompts.ai atua como uma plataforma centralizada baseada em nuvem que conecta usuários corporativos a mais de 35 modelos líderes de IA, incluindo GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro e Kling - todos acessíveis por meio de uma única interface. Nenhuma instalação de software é necessária, facilitando que equipes de qualquer tamanho incorporem IA em seus fluxos de trabalho.

A plataforma enfrenta um grande desafio na adoção da IA: a expansão de ferramentas. Ao fornecer um ambiente unificado, ele consolida a seleção de modelos, fluxos de trabalho imediatos e monitoramento de desempenho em um único sistema. Essa abordagem muda o uso da IA de experimentos dispersos e únicos para processos consistentes e escaláveis que as organizações podem implantar facilmente em todos os departamentos.

Prompts.ai se concentra na automatização de fluxos de trabalho de IA empresarial, ajudando as organizações a cortar custos desnecessários e ao mesmo tempo abordar questões de governança. Desde empresas Fortune 500 até agências criativas e laboratórios de pesquisa, os usuários podem criar fluxos de trabalho auditáveis e compatíveis sem arriscar a exposição de dados confidenciais a vários serviços de terceiros.

A plataforma foi reconhecida pela GenAI.Works como a melhor solução de IA para solução de problemas empresariais e automação, com uma impressionante classificação de usuário de 4,8 em 5. As empresas confiam no Prompts.ai para tarefas como agilizar a criação de conteúdo, automatizar fluxos de trabalho estratégicos e acelerar o desenvolvimento de propostas. Em alguns casos, projetos que costumavam levar semanas foram reduzidos a apenas um dia.

Um exemplo notável vem de maio de 2025, quando o diretor freelance de IA, Johannes Vorillon, usou a plataforma para integrar perfeitamente as animações do Google DeepMind Veo2 em um vídeo promocional da Breitling e da Força Aérea Francesa. Este projeto destacou como o Prompts.ai permite a orquestração suave de várias ferramentas de IA.

Prompts.ai simplifica a forma como as equipes trabalham com IA, integrando o acesso a mais de 35 idiomas e modelos de imagem por meio de uma única interface. Isso elimina o incômodo de gerenciar múltiplas assinaturas, chaves de API e sistemas de cobrança. Os usuários podem combinar diferentes modelos para tarefas específicas em um único fluxo de trabalho, criando pipelines de orquestração contínuos.

A plataforma opera em um sistema de crédito TOKN, que padroniza o uso em todos os modelos, simplificando o rastreamento de custos e a alocação de recursos. As equipes podem alternar entre modelos conforme necessário, com base nos requisitos de desempenho. Os planos de negócios incluem espaços de trabalho e colaboradores ilimitados, tornando mais fácil para as organizações dimensionarem a adoção da IA.

Com um modelo de preços pré-pago, Prompts.ai alinha os custos com o uso real, começando em US$ 0/mês para exploração inicial. Os planos empresariais, que variam de US$ 99 a US$ 129 mensais por membro, oferecem níveis variados de créditos TOKN (250.000 a 1.000.000) e 10 GB de armazenamento em nuvem em todos os níveis.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 de junho de 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

Os planos de negócios (Core, Pro e Elite) incluem ferramentas para monitoramento de conformidade e administração de governança, oferecendo visibilidade total das interações de IA e mantendo trilhas de auditoria detalhadas para atender aos requisitos regulatórios. Mesmo equipes menores e profissionais individuais que usam os planos Personal Creator e Family se beneficiam desses recursos de governança de nível empresarial.

Os dados confidenciais são mantidos em um ambiente centralizado e controlado, reduzindo os riscos associados à disseminação de informações entre vários serviços de terceiros. Esta arquitetura segura não apenas minimiza possíveis vulnerabilidades, mas também simplifica o gerenciamento de conformidade para organizações que operam sob regulamentações rígidas.

Projetado com uma arquitetura nativa da nuvem, o Prompts.ai permite que as organizações escalem sem esforço. As equipes podem adicionar novos membros, expandir espaços de trabalho e acessar modelos adicionais em minutos, garantindo que a adoção da IA possa crescer tão rapidamente quanto necessário.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI oferece uma solução de automação de fluxo de trabalho alimentada por interfaces conversacionais. Embora detalhes específicos sobre sua arquitetura de implantação e métodos de orquestração não estejam disponíveis publicamente, sua ênfase em interfaces conversacionais destaca um ângulo único na simplificação da automação do fluxo de trabalho.

O IBM watsonx Orchestrate traz automação orientada por IA para operações empresariais, com foco em tornar a automação acessível para profissionais de negócios, e não apenas para desenvolvedores. Ao permitir que os usuários emitam comandos em linguagem natural, a plataforma simplifica tarefas complexas para equipes não técnicas de RH, finanças, vendas, suporte ao cliente e compras. Essa abordagem elimina a necessidade de conhecimento especializado em codificação, capacitando as equipes de negócios a automatizar processos de forma independente.

A plataforma se destaca ao automatizar tarefas repetitivas que muitas vezes consomem o tempo dos funcionários. Com comandos de linguagem simples, os usuários podem iniciar fluxos de trabalho para tarefas como agendamento de entrevistas, resumo de perfis de candidatos, processamento de empréstimos e geração de relatórios. O watsonx Orchestrate lida com essas atividades em vários sistemas de back-end, ao mesmo tempo que adere aos padrões de segurança de nível empresarial.

Por exemplo, uma grande instituição financeira implementou o watsonx Orchestrate para agilizar o suporte ao cliente e as funções administrativas. Os funcionários usaram entradas em linguagem natural para automatizar fluxos de trabalho para processamento de empréstimos e solicitações de serviços. A plataforma integrou-se perfeitamente aos sistemas back-end, manteve a conformidade por meio de governança integrada e proporcionou melhorias visíveis: tempos de processamento mais rápidos, menos erros manuais e maior satisfação do cliente. Este exemplo destaca a capacidade da plataforma de transformar tarefas empresariais rotineiras em processos eficientes e automatizados.

O IBM watsonx Orchestrate oferece opções de implementação de nuvem híbrida, permitindo que fluxos de trabalho sejam executados na nuvem, no local ou em ambos. Esta flexibilidade é particularmente valiosa para organizações com políticas rígidas de residência de dados ou infraestrutura legada. A plataforma aproveita Large Language Models (LLMs), APIs e aplicativos corporativos para executar tarefas com segurança, garantindo compatibilidade com vários ambientes operacionais.

O watsonx Orchestrate integra-se perfeitamente a diversos sistemas, tornando-o uma solução robusta para automação empresarial. Ele se conecta a plataformas de CRM, ERP e nuvem como AWS e Azure usando conectores visuais e APIs. Além disso, ele trabalha em estreita colaboração com os serviços IBM Watson e outros modelos de IA da IBM, ampliando seus recursos além da automação básica do fluxo de trabalho. Para usuários avançados, o acesso programático à API permite maior personalização e integração com ferramentas existentes.

__XLATE_18__

"O IBM watsonx Orchestrate foi projetado para trazer a automação alimentada por IA diretamente para os fluxos de trabalho de negócios. Ao contrário das ferramentas centradas no desenvolvedor, o watsonx Orchestrate é direcionado a profissionais de RH, finanças, vendas e suporte ao cliente que desejam agilizar tarefas sem codificação pesada." - Domo

A plataforma também inclui aplicativos de IA pré-construídos e conjuntos de habilidades específicas do setor, permitindo uma implementação mais rápida para casos de uso comuns. No entanto, as organizações devem observar que a sua funcionalidade pode ser mais limitada fora do ecossistema IBM em comparação com plataformas com opções de integração mais amplas.

O IBM watsonx Orchestrate se destaca por sua forte estrutura de governança, tornando-o a escolha preferida para setores regulamentados. Os controles de acesso baseados em funções garantem que o acesso aos dados seja restrito a usuários autorizados e funcionalidades específicas.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

Projetado para escalar em ambientes híbridos, o watsonx Orchestrate oferece suporte tanto a pequenas equipes quanto a grandes empresas. Melhora a eficiência operacional, garante a conformidade com as políticas, mitiga riscos e aumenta a produtividade dos funcionários. As organizações podem começar pequenas – concentrando-se em departamentos específicos – e expandir gradualmente as capacidades de automação à medida que vêem resultados e desenvolvem conhecimentos internos.

Apache Airflow é uma plataforma de código aberto construída para orquestrar fluxos de trabalho de dados complexos usando gráficos acíclicos direcionados (DAGs). Inicialmente desenvolvido pela Airbnb e agora sob a Apache Software Foundation, tornou-se uma escolha popular para agendamento, monitoramento e gerenciamento de pipelines de dados. Ao contrário das ferramentas de automação personalizadas para usuários corporativos, o Airflow foi projetado pensando em engenheiros e desenvolvedores de dados, oferecendo controle programático sobre a execução do fluxo de trabalho.

O Airflow se destaca no gerenciamento de pipelines de dados que envolvem dependências complexas, tarefas agendadas e lógica de transformação. As equipes de dados contam com ele para diversas finalidades, incluindo coordenação de processos ETL (Extrair, Transformar, Carregar), treinar modelos de aprendizado de máquina, executar trabalhos de processamento em lote, ingerir dados de diversas fontes, transformar conjuntos de dados e gerar relatórios de acordo com um cronograma. Ao definir fluxos de trabalho em Python, os desenvolvedores ganham ampla flexibilidade para implementar lógica personalizada e lidar com erros de forma eficaz.

A plataforma inclui uma interface visual que fornece insights sobre o status do fluxo de trabalho, dependências de tarefas e histórico de execução. Isso torna mais fácil monitorar o desempenho e solucionar falhas. Por exemplo, se uma tarefa falhar, o Airflow poderá repeti-la automaticamente, enviar alertas ou pular tarefas subsequentes para evitar problemas em cascata. Essa funcionalidade o torna uma escolha versátil para diversas necessidades de implantação.

O Airflow pode ser implantado como uma configuração de servidor único ou dimensionado para clusters distribuídos, onde o agendador, os trabalhadores e o servidor web operam em máquinas separadas. A arquitetura é composta por vários componentes principais: um agendador que aciona tarefas com base em cronogramas definidos, trabalhadores que executam tarefas, um servidor web para a interface do usuário e um banco de dados de metadados que armazena definições de fluxo de trabalho e histórico de execução.

Este design modular permite que as organizações aumentem a capacidade dos trabalhadores de forma independente, dependendo das demandas da carga de trabalho. Em ambientes nativos da nuvem, o Kubernetes é frequentemente usado para implantar o Airflow, com o KubernetesExecutor criando pods isolados para tarefas individuais. Essa configuração aprimora o isolamento de recursos e permite que as equipes aloquem recursos de computação específicos para cada tarefa. Para aqueles que buscam reduzir as despesas gerais de gerenciamento de infraestrutura, os serviços gerenciados do Airflow estão disponíveis, embora acarretem custos operacionais adicionais.

Os amplos recursos de integração do Airflow o tornam altamente adaptável. Ele oferece conectores pré-construídos para bancos de dados, plataformas em nuvem, data warehouses e sistemas de mensagens, juntamente com a capacidade de criar operadores personalizados usando Python. Essa flexibilidade garante que o Airflow possa atender a diversos requisitos organizacionais.

O rico ecossistema de bibliotecas do Python também pode ser aproveitado em fluxos de trabalho, permitindo transformações e análises avançadas de dados diretamente nas definições de pipeline. Para aplicativos de IA e aprendizado de máquina, o Airflow se integra perfeitamente a estruturas como TensorFlow, PyTorch e scikit-learn. Essas integrações ajudam os cientistas de dados a orquestrar fluxos de trabalho para tarefas como busca de dados, pré-processamento de recursos, treinamento de modelos, avaliação de desempenho e implantação de modelos em produção.

O Airflow inclui controle de acesso baseado em função (RBAC) para gerenciar permissões de usuário em fluxos de trabalho e funções administrativas. Os administradores podem definir funções com privilégios específicos, garantindo que apenas usuários autorizados possam visualizar, editar ou executar determinados DAGs. Esse controle granular ajuda a manter a integridade do fluxo de trabalho e evita alterações não autorizadas.

As opções de autenticação incluem login baseado em senha, integração LDAP e provedores OAuth. As credenciais confidenciais são gerenciadas separadamente por meio do sistema de conexões e variáveis do Airflow. Para maior segurança, ferramentas externas de gerenciamento de segredos, como HashiCorp Vault ou AWS Secrets Manager, podem ser integradas.

O registro de auditoria é outro recurso importante, rastreando as ações do usuário e as execuções do fluxo de trabalho. Isso cria um registro detalhado de atividades, que é inestimável para fins de conformidade e solução de problemas.

O Airflow é dimensionado horizontalmente adicionando mais nós de trabalho para lidar com o aumento das cargas de trabalho. A plataforma suporta vários tipos de executores para distribuir tarefas de forma eficaz: o LocalExecutor executa tarefas na mesma máquina que o agendador, o CeleryExecutor distribui tarefas por várias máquinas de trabalho usando uma fila de mensagens e o KubernetesExecutor gera pods isolados para cada tarefa.

Para otimizar o desempenho, o design cuidadoso do DAG e a alocação de recursos são essenciais. Altos volumes de tarefas podem sobrecarregar o agendador, por isso as equipes geralmente dividem grandes DAGs, ajustam as configurações do agendador e garantem que o armazenamento de metadados tenha recursos suficientes.

O Airflow também lida com preenchimentos de forma eficiente, permitindo que as equipes reprocessem dados históricos quando a lógica do fluxo de trabalho muda. Embora o preenchimento simplifique as atualizações, ele pode consumir recursos computacionais significativos, exigindo um planejamento cuidadoso para evitar interrupções nas cargas de trabalho de produção.

Por ser de código aberto, o Airflow oferece às organizações controle total sobre suas implantações. No entanto, isto também significa que devem gerir a infraestrutura, a monitorização e as atualizações, o que requer recursos de engenharia dedicados para manter a fiabilidade e o desempenho em escala.

Kubeflow se destaca como uma plataforma dedicada para gerenciar fluxos de trabalho de aprendizado de máquina, diferente de ferramentas de fluxo de trabalho de uso geral. Projetada especificamente para Kubernetes, esta solução de código aberto oferece suporte a todo o ciclo de vida de aprendizado de máquina, fornecendo aos cientistas de dados e engenheiros de ML as ferramentas necessárias para criar, implantar e gerenciar modelos prontos para produção usando recursos nativos do Kubernetes.

O Kubeflow é feito sob medida para orquestrar fluxos de trabalho completos de aprendizado de máquina em ambientes Kubernetes. Abrange todos os estágios do ciclo de vida do ML, incluindo pré-processamento de dados, engenharia de recursos, treinamento de modelo, validação, implantação e monitoramento. Ao permitir que as equipes criem pipelines modulares e reutilizáveis, o Kubeflow simplifica o gerenciamento de cargas de trabalho de ML distribuídas. Sua abordagem centralizada também auxilia no rastreamento de experimentos e na supervisão de modelos em vários projetos. Além disso, o Kubeflow pode automatizar fluxos de trabalho de retreinamento quando novos dados são introduzidos, garantindo que os modelos permaneçam atualizados e relevantes.

Desenvolvido no Kubernetes, o Kubeflow aproveita a orquestração de contêineres, o escalonamento dinâmico e o gerenciamento de recursos para otimizar os fluxos de trabalho de ML. Os usuários podem interagir com a plataforma por meio de uma interface baseada na web para gerenciamento visual ou de uma interface de linha de comando para automação. Dependendo da carga de trabalho, o Kubeflow aloca recursos dinamicamente – como provisionamento de GPUs para tarefas de treinamento e CPUs para inferência. Sua flexibilidade permite a implantação em qualquer cluster Kubernetes, seja localmente, na nuvem ou em configurações híbridas, garantindo adaptabilidade entre ambientes.

Kubeflow integra-se perfeitamente com estruturas populares de aprendizado de máquina, como TensorFlow, PyTorch e XGBoost, ao mesmo tempo que oferece suporte a estruturas personalizadas por meio de seu design extensível. Além das estruturas de ML, ele se conecta a vários serviços em nuvem e soluções de armazenamento, permitindo que pipelines acessem armazenamento de objetos para dados, data warehouses para recuperação de recursos e ferramentas de monitoramento para rastrear desempenho. Sua compatibilidade com bibliotecas Python agiliza ainda mais a transição da experimentação para a produção.

O Kubeflow usa os recursos de escalonamento inerentes do Kubernetes para distribuir cargas de trabalho entre recursos de cluster, tornando-o adequado para treinamento em grande escala e tarefas de processamento de dados. Isso garante a utilização eficiente de recursos e oferece suporte a operações de ML de alto desempenho. Como Akka afirmou apropriadamente:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Com a sua capacidade de alocar recursos de forma independente, o Kubeflow preenche a lacuna entre a experimentação e a produção, proporcionando flexibilidade e desempenho.

Flyte é uma plataforma de orquestração nativa da nuvem projetada para agilizar o gerenciamento de fluxos de trabalho de aprendizado de máquina (ML) em contêineres usando Kubernetes. Ele elimina a complexidade da implantação de pipelines de ML, distribuindo recursos de maneira eficiente em ambientes de nuvem. Essa abordagem garante escalonamento suave e desempenho consistente, independentemente do tamanho da implantação.

Flyte foi desenvolvido para lidar com fluxos de trabalho de ML de qualquer escala, alocando recursos dinamicamente para atender a diversas demandas. Sua arquitetura robusta garante que as cargas de trabalho sejam gerenciadas de forma eficiente, tornando-a uma escolha confiável para uma ampla variedade de tarefas de ML em infraestruturas baseadas em nuvem.

Prefect é uma plataforma de orquestração baseada em Python projetada para simplificar o gerenciamento de pipelines de dados complexos e fluxos de trabalho de aprendizado de máquina. Ele se concentra na facilidade de uso, no monitoramento claro e na minimização de obstáculos operacionais, permitindo que cientistas e engenheiros de dados se concentrem na criação de fluxos de trabalho em vez de se preocuparem com a infraestrutura.

Prefect se destaca na automação de pipelines de aprendizado de máquina, fluxos de trabalho em nuvem e processos de transformação de dados. É particularmente adequado para lidar com tarefas de ETL e fluxos de trabalho complexos de aprendizado de máquina que envolvem múltiplas dependências, execuções paralelas e processamento em tempo real. Seu sistema de agendamento flexível permite que tarefas sejam acionadas com base em intervalos de tempo, eventos específicos ou chamadas de API, tornando-o adaptável a diversas necessidades de automação.

O Prefect é otimizado para ambientes em nuvem, garantindo que possa ser dimensionado e adaptado às demandas de infraestrutura moderna. Construído nativamente em Python, ele se integra perfeitamente aos ecossistemas de dados baseados em Python, eliminando a necessidade de aprender novas linguagens ou ferramentas de programação.

O Prefect oferece compatibilidade perfeita com uma ampla variedade de ferramentas e plataformas de dados. Ele se integra facilmente a ferramentas populares como dbt, PostgreSQL, Snowflake e Looker, ao mesmo tempo que oferece suporte a sistemas em tempo real como Apache Kafka. Para ambientes em nuvem, funciona com grandes provedores como Amazon Web Services (AWS), Google Cloud Platform (GCP) e Microsoft Azure, dando às equipes a flexibilidade para otimizar cargas de trabalho com base em custo e desempenho. Além disso, o Prefect oferece suporte a ferramentas de conteinerização como Docker e Kubernetes e funciona com estruturas de processamento distribuído, como Dask e Apache Spark. Para manter as equipes informadas, ele também fornece notificações do Slack para atualizações do fluxo de trabalho.

O Prefect foi desenvolvido para lidar com volumes crescentes de dados e aumentar a complexidade do fluxo de trabalho com facilidade. Seu mecanismo tolerante a falhas garante que os fluxos de trabalho possam se recuperar de erros, repetindo tarefas com falha ou ignorando problemas, tornando-o altamente confiável em ambientes de produção. O monitoramento em tempo real oferece insights detalhados sobre a execução do fluxo de trabalho, ajudando as equipes a identificar e resolver problemas rapidamente. Com sua capacidade de escalar com eficiência, o Prefect conta com a confiança das principais empresas de tecnologia para gerenciar fluxos de trabalho dinâmicos. Para equipes que estão começando, o Prefect oferece um plano gratuito, enquanto preços personalizados estão disponíveis para implantações maiores que exigem recursos e suporte adicionais.

Metaflow é uma plataforma de infraestrutura de aprendizado de máquina inicialmente desenvolvida pela Netflix para enfrentar os desafios de dimensionar fluxos de trabalho de aprendizado de máquina. Ele se concentra em tornar os processos fáceis de usar e eficientes, ajudando os cientistas de dados a passarem suavemente dos protótipos à produção, sem lidar com infraestruturas complexas.

O Metaflow foi desenvolvido para gerenciar fluxos de trabalho escalonáveis de aprendizado de máquina em nível de produção. Ele simplifica a jornada desde a análise exploratória de dados e treinamento de modelo até a implantação. Os cientistas de dados podem escrever fluxos de trabalho em Python usando bibliotecas familiares, enquanto a plataforma cuida do controle de versão, do gerenciamento de dependências e da alocação automática de recursos de computação.

A plataforma elimina a necessidade de gerenciamento manual da infraestrutura, provisionando automaticamente os recursos computacionais necessários. Isso permite uma mudança perfeita do desenvolvimento local para a produção na nuvem, sem exigir quaisquer modificações no código.

__XLATE_53__

"O Metaflow orquestra fluxos de trabalho de ML escalonáveis com simplicidade, oferecendo integrações simplificadas na nuvem, controle de versão robusto e abstração de infraestrutura para implantação pronta para produção." -Akka.io

O processo de implantação do Metaflow é complementado por sua capacidade de integração fácil com serviços em nuvem e plataformas de dados. Seu design nativo em Python garante compatibilidade com bibliotecas amplamente utilizadas para aprendizado de máquina, processamento de dados e visualização, permitindo que as equipes maximizem as ferramentas nas quais já contam.

Originalmente criado pela Netflix para oferecer suporte a extensas operações de aprendizado de máquina, o Metaflow apresenta um poderoso sistema de controle de versão. Este sistema rastreia experimentos, conjuntos de dados e versões de modelos, garantindo que os experimentos sejam reproduzíveis e permitindo reversões fáceis quando necessário.

Dagster aumenta a linha de estruturas de orquestração, concentrando-se na manutenção da integridade dos dados e, ao mesmo tempo, oferecendo gerenciamento de pipeline adaptável. Esta ferramenta de código aberto foi criada para melhorar a qualidade, rastrear a linhagem de dados e garantir visibilidade nos fluxos de trabalho de aprendizado de máquina (ML). Basicamente, a Dagster é especializada na construção de pipelines de dados confiáveis e seguros que mantêm altos padrões de integridade de dados e fornecem insights claros sobre as transformações.

O Dagster é particularmente eficaz para gerenciar fluxos de trabalho de ML onde a qualidade e a precisão dos dados não são negociáveis. Ele é feito sob medida para equipes que precisam de validação integrada, rastreamento robusto de metadados e observabilidade abrangente em todos os seus processos. Um exemplo prático de sua utilidade pode ser visto no setor de saúde, onde as organizações confiam no Dagster para processar dados confidenciais de saúde com o nível de integridade necessário para atender rigorosos padrões de conformidade e qualidade.

O Dagster permite que os desenvolvedores definam fluxos de trabalho complexos diretamente no código, um recurso essencial para dimensionar operações de IA. Sua estrutura modular oferece suporte a modelos e agentes de encadeamento para criar fluxos de trabalho avançados, completos com gerenciamento automatizado de dependências, mecanismos de repetição e execução paralela. Além disso, o Dagster integra-se perfeitamente com várias plataformas em nuvem, APIs e bancos de dados vetoriais, tornando-o adequado para lidar com dados em grande escala e tarefas de IA.

Essa arquitetura flexível garante integração suave com diversos sistemas.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

O Microsoft AutoGen é uma estrutura de código aberto desenvolvida pela Microsoft Research que permite que vários agentes de IA colaborem por meio de conversas para lidar com tarefas complexas. Este sistema permite que os desenvolvedores criem aplicações onde agentes especializados trabalham juntos, cada um contribuindo com sua experiência única para atingir objetivos comuns. Ao introduzir uma interface de conversação, o AutoGen simplifica o processo muitas vezes complexo de coordenação de vários componentes de IA.

O AutoGen apresenta uma nova abordagem para orquestração multiagente, aproveitando o diálogo como meio de colaboração. Essa estrutura é particularmente eficaz em cenários de solução de problemas que exigem que vários agentes trabalhem juntos de forma dinâmica. Por exemplo, no desenvolvimento de software, um agente pode gerar código enquanto outro se concentra em testes e validação, com ambos os agentes iterando para refinar a saída. Esse modelo conversacional é ideal para tarefas como automatizar fluxos de trabalho de software, auxiliar na pesquisa e lidar com processos complexos de tomada de decisão, onde diversas perspectivas ou habilidades melhoram os resultados.

As equipes que buscam melhorias iterativas em seus fluxos de trabalho consideram o AutoGen especialmente atraente. Sua capacidade de facilitar trocas entre agentes reflete a colaboração humana, tornando mais fácil para os desenvolvedores projetar sistemas que evoluem e melhorem por meio de diálogo e feedback contínuos.

O AutoGen enfatiza a modularidade ao mesmo tempo que se destaca pelo design do seu agente conversacional. Cada agente opera com funções e instruções específicas, que podem incluir acesso a ferramentas, APIs externas ou modelos de linguagem. A estrutura oferece suporte a agentes autônomos e agentes proxy de usuário que incorporam informações humanas, oferecendo flexibilidade no gerenciamento de fluxos de trabalho.

O sistema pode ser executado localmente durante o desenvolvimento e dimensionado para ambientes de nuvem para produção. Os desenvolvedores podem definir como os agentes interagem, seja por meio de fluxos de trabalho sequenciais, onde os agentes se revezam, ou de padrões mais complexos, onde vários agentes contribuem simultaneamente. Usando configurações baseadas em Python, as equipes obtêm controle total sobre a lógica de orquestração sem sacrificar a legibilidade, simplificando o processo de gerenciamento de interações multiagentes.

O AutoGen lida com as complexidades do gerenciamento de múltiplas chamadas de modelo e conversas de agentes, permitindo que os desenvolvedores se concentrem na elaboração da lógica e do comportamento de seus sistemas, em vez de se preocuparem com a infraestrutura.

O AutoGen integra-se perfeitamente com o Azure OpenAI Service e outros modelos por meio de chamadas de função, dando aos desenvolvedores flexibilidade na seleção de back-ends de IA. Ele também oferece suporte à conexão de agentes a ferramentas e serviços externos, permitindo-lhes recuperar dados, executar código ou interagir com APIs de terceiros durante suas conversas.

A estrutura permite que os desenvolvedores criem tipos de agentes personalizados, padrões de conversa reutilizáveis e modelos de orquestração. Essa flexibilidade significa que as equipes podem aproveitar padrões pré-existentes para tarefas comuns e, ao mesmo tempo, personalizá-los profundamente para necessidades especializadas.

Para organizações que já utilizam ferramentas Microsoft, o AutoGen oferece fácil integração com serviços Azure, Visual Studio Code e outras plataformas de desenvolvimento. Apesar desse alinhamento com o ecossistema da Microsoft, a estrutura é independente de plataforma e funciona bem em diversos ambientes tecnológicos.

O AutoGen dá grande ênfase ao controle dos recursos dos agentes e ao gerenciamento do acesso a recursos externos. Os desenvolvedores definem permissões específicas para cada agente, como quais APIs eles podem acessar ou quais dados podem recuperar. Essa abordagem granular garante que os agentes operem sob princípios de privilégio mínimo, executando apenas as tarefas necessárias para suas funções.

A natureza conversacional da estrutura cria inerentemente trilhas de auditoria, registrando interações de agentes e processos de tomada de decisão. Esses logs fornecem transparência sobre como os resultados são gerados, auxiliando nos esforços de conformidade e depuração. As equipes podem revisar esses registros para analisar o comportamento do agente e identificar áreas para refinamento.

Os recursos humanos no circuito melhoram a supervisão, permitindo que os fluxos de trabalho sejam pausados para revisão humana em pontos de decisão críticos. Esse recurso garante que ações confidenciais possam ser avaliadas antes de prosseguir, equilibrando a eficiência da automação com governança e controle.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

As organizações podem melhorar o desempenho armazenando em cache o contexto da conversa, usando modelos mais rápidos para tarefas rotineiras e reservando modelos mais avançados para raciocínios complexos. Projetar padrões de conversação para minimizar trocas desnecessárias também aumenta a eficiência. Quando apropriado, a estrutura oferece suporte à execução paralela de agentes, permitindo que tarefas independentes sejam executadas simultaneamente, em vez de sequencialmente.

Para lidar com altas cargas de trabalho, o AutoGen pode ser implantado em uma infraestrutura de nuvem com escalonamento automático, garantindo que o sistema possa gerenciar demandas variadas e, ao mesmo tempo, manter os custos sob controle. As interações de agentes sem estado simplificam o dimensionamento horizontal, embora a manutenção do contexto entre as trocas exija um planejamento de arquitetura cuidadoso.

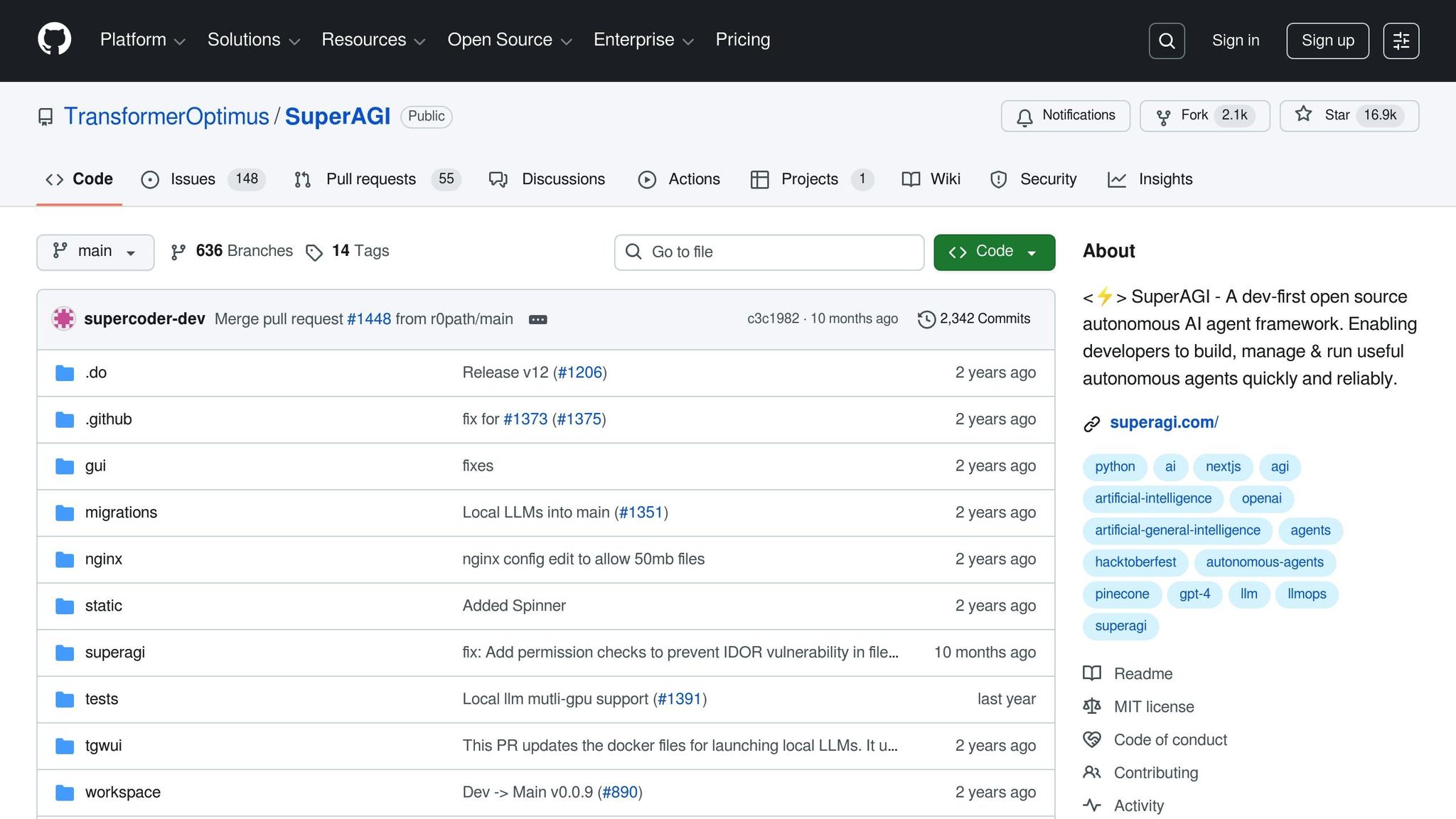

Com base nas estruturas de orquestração que exploramos, o SuperAGI apresenta uma nova maneira de gerenciar a colaboração multiagente. Esta plataforma de código aberto foi projetada para coordenar agentes autônomos de IA, capacitando os desenvolvedores a criar, implantar e supervisionar agentes que podem planejar, executar e se adaptar a tarefas por meio de aprendizado contínuo. SuperAGI permite que vários agentes trabalhem juntos de forma integrada, delegando tarefas dinamicamente e colaborando para enfrentar desafios complexos. Ele combina o gerenciamento adaptativo de tarefas com o trabalho em equipe multiagente, diferenciando-o como uma ferramenta poderosa para orquestração avançada de IA.

SuperAGI brilha na automação de tarefas complexas e em evolução para empresas. Suas redes de agentes se destacam no planejamento e execução avançados de tarefas, melhorando continuamente por meio de aprendizado por reforço e ciclos de feedback. Isto torna-o particularmente útil para organizações que lidam com operações de grande escala, onde a coordenação inteligente é fundamental. Os agentes da plataforma aprendem com suas interações e resultados, permitindo-lhes refinar seu comportamento ao longo do tempo.

O destaque da plataforma é a delegação dinâmica de tarefas. Em vez de se aterem a fluxos de trabalho rígidos, os agentes avaliam situações em tempo real, identificam tarefas prioritárias e atribuem-nas aos membros da rede mais adequados. Esta flexibilidade garante que os recursos sejam alocados de forma eficiente, mesmo em cenários complexos.

A arquitetura do SuperAGI foi projetada com escalabilidade e modularidade em sua essência. Os desenvolvedores podem expandir facilmente redes de agentes e cargas de trabalho para atender a diversas necessidades de aplicativos. Cada agente opera de forma independente, mas se comunica perfeitamente, garantindo uma colaboração tranquila.

Uma interface gráfica amigável permite que as equipes visualizem as interações dos agentes e ajustem as configurações. Os painéis de monitoramento fornecem insights sobre o desempenho dos agentes, ajudando os desenvolvedores a identificar e resolver ineficiências. A plataforma também suporta execução paralela, permitindo que vários agentes lidem com tarefas independentes simultaneamente. Esse design aumenta significativamente o rendimento, especialmente em ambientes de alta demanda.

SuperAGI apresenta um sistema de plug-in extensível que se integra a APIs de terceiros, ferramentas de fluxo de trabalho e módulos personalizados. Esta flexibilidade acelera o desenvolvimento e incentiva contribuições da comunidade mais ampla de desenvolvedores, enriquecendo as capacidades da plataforma.

A arquitetura distribuída e modular da plataforma suporta escalabilidade horizontal, tornando-a adaptável para implementações em larga escala. O uso de aprendizagem por reforço e ciclos de feedback melhora o desempenho geral, garantindo que as tarefas sejam alocadas de forma eficiente. Ao permitir colaboração eficaz e alto rendimento, o SuperAGI é adequado para organizações que exigem desempenho robusto em cenários complexos e de alto volume.

Escolher a estrutura de orquestração de IA certa significa compreender os pontos fortes e as limitações de cada opção. Essas plataformas são projetadas com diferentes prioridades em mente, atendendo a necessidades como segurança de nível empresarial, adaptabilidade do desenvolvedor ou fluxos de trabalho especializados, como pipelines de aprendizado de máquina. Cada estrutura reflete sua filosofia de design exclusiva e seus casos de uso específicos.

Por exemplo, plataformas como Prompts.ai se destacam na centralização do acesso a grandes modelos de linguagem (LLMs), enquanto ferramentas como Apache Airflow e Prefect se concentram na automação geral do fluxo de trabalho. Por outro lado, Kubeflow e Flyte são adaptados para pipelines de aprendizado de máquina, e estruturas como SuperAGI e Microsoft AutoGen ampliam os limites da colaboração de IA multiagente, permitindo que sistemas autônomos lidem juntos com tarefas complexas.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Estruturas de custos: as plataformas tradicionais geralmente cobram por usuário ou execução, o que pode levar a custos mais elevados à medida que as operações crescem. Em contraste, Prompts.ai usa um modelo pré-pago com créditos TOKN, vinculando as despesas diretamente ao uso. Essa abordagem é particularmente útil ao experimentar diferentes modelos ou gerenciar cargas de trabalho flutuantes.

Segurança e conformidade: Para setores como o de saúde ou financeiro, medidas de segurança robustas são essenciais. Plataformas como Prompts.ai, IBM watsonx Orchestrate e Prefect fornecem ferramentas de conformidade integradas, como trilhas de auditoria e controles de acesso baseados em funções. Opções de código aberto como Apache Airflow, no entanto, exigem configuração adicional para atender a padrões de conformidade rígidos.

Curva de aprendizado: a usabilidade varia amplamente. Plataformas como Prefect e Dagster são mais amigáveis para iniciantes, oferecendo APIs Python intuitivas e mensagens de erro úteis. Enquanto isso, Apache Airflow e Kubeflow exigem conhecimentos técnicos mais profundos e habilidades de gerenciamento de infraestrutura. Prompts.ai simplifica ainda mais isso com uma interface unificada que equilibra facilidade de uso com recursos avançados para usuários avançados.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Ecossistema de Integração: A integração perfeita com as ferramentas existentes é crítica. Apache Airflow lidera com centenas de plug-ins para serviços em nuvem, bancos de dados e ferramentas de monitoramento. Prompts.ai, por outro lado, concentra-se especificamente em LLMs, oferecendo acesso simplificado a dezenas de modelos por meio de uma única API.

Escalabilidade: plataformas como Kubeflow e Flyte são construídas para escalabilidade horizontal, aproveitando o Kubernetes para distribuição de carga de trabalho. O Metaflow usa serviços AWS para escalabilidade elástica, enquanto o Prefect oferece suporte a opções de escalabilidade gerenciadas na nuvem e auto-hospedadas. SuperAGI emprega uma arquitetura de agente distribuída, permitindo execução paralela, embora isso exija uma coordenação cuidadosa.

A melhor estrutura para você depende de seus fluxos de trabalho específicos. Para orquestração LLM, Prompts.ai se destaca por seu acesso centralizado ao modelo e eficiência de custos. As equipes de engenharia de dados podem se inclinar para a confiabilidade do Apache Airflow, enquanto as equipes de ML que trabalham em treinamento e implantação em larga escala podem se beneficiar do Kubeflow ou Flyte. Se o seu foco é construir sistemas de IA autônomos, SuperAGI ou Microsoft AutoGen podem ser a opção certa.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Por exemplo, as equipes que priorizam a orquestração LLM podem achar o Prompts.ai particularmente atraente. Fornece acesso centralizado a mais de 35 modelos, como GPT-5, Claude e Gemini, tudo por meio de uma interface unificada. O sistema de crédito TOKN pré-pago elimina taxas de assinatura e oferece rastreamento de custos em tempo real. Com recursos como controles de acesso baseados em funções e trilhas de auditoria, Prompts.ai é uma escolha forte para setores que exigem governança rigorosa sem comprometer a velocidade.

As equipes de engenharia de dados que trabalham com pipelines ETL complexos podem gravitar em torno do Apache Airflow por seu robusto ecossistema de plug-ins e escalabilidade, embora exija conhecimentos mais avançados. Por outro lado, o Prefect oferece uma abordagem nativa do Python com tratamento de erros fácil de usar, tornando-o uma excelente opção para uma integração mais rápida da equipe.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

As organizações que exploram sistemas de IA autônomos podem considerar o Microsoft AutoGen por seus recursos de colaboração multiagente ou o SuperAGI para delegação dinâmica de tarefas. Essas ferramentas são ideais para pesquisas ou casos de uso especializados, mas geralmente exigem habilidades avançadas de codificação, tornando-as menos adequadas para necessidades imediatas de produção.

Em última análise, selecionar a estrutura certa envolve avaliar fatores como modularidade, extensibilidade, observabilidade e recursos de governança, como controles de acesso baseados em funções e certificações de conformidade. A flexibilidade de implantação e a integração com as ferramentas existentes são igualmente importantes. Além da funcionalidade, considere a experiência do desenvolvedor, incluindo SDKs, documentação e custo total de propriedade. A complexidade dos seus fluxos de trabalho – sejam tarefas simples de agente único ou sistemas multiagentes complexos com memória persistente – também deve orientar sua decisão.

A indústria está a tender para sistemas de IA integrados e escaláveis, com estruturas de código aberto que impulsionam a maioria das cargas de trabalho empresariais, enquanto os tempos de execução geridos pelo fornecedor simplificam os desafios operacionais.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Ao escolher uma estrutura de orquestração de IA, é essencial considerar quão bem ela se integra às suas ferramentas e sistemas atuais. Uma estrutura com fortes capacidades de integração garante que tudo funcione em conjunto sem complicações desnecessárias.

Preste atenção aos seus recursos de automação, como agendamento de fluxo de trabalho e gerenciamento de tarefas, pois podem simplificar as operações e economizar tempo. Igualmente importantes são as medidas de segurança e governação, que protegem dados sensíveis e ajudam-no a manter-se em conformidade com os regulamentos.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai simplifica o desafio de lidar com várias ferramentas de IA, reunindo mais de 35 grandes modelos de linguagem em uma plataforma unificada. Com essa configuração, os usuários podem comparar modelos lado a lado sem esforço, mantendo a supervisão completa de seus fluxos de trabalho imediatos, qualidade de saída e desempenho geral.

Somando-se à sua eficiência, o Prompts.ai apresenta uma camada FinOps integrada projetada para otimizar custos. Esta ferramenta fornece insights em tempo real sobre uso, gastos e retorno do investimento (ROI), permitindo que as organizações gerenciem seus recursos de forma eficaz e aproveitem ao máximo seus orçamentos de IA.

Prompts.ai prioriza segurança e conformidade de nível empresarial, alinhando-se com padrões do setor como SOC 2 Tipo II, HIPAA e GDPR para proteger seus dados em todas as etapas.

Para manter o monitoramento e a conformidade contínuos, a Prompts.ai colabora com a Vanta e iniciou seu processo de auditoria SOC 2 Tipo II em 19 de junho de 2025. Essas etapas garantem que seus fluxos de trabalho permaneçam seguros, compatíveis e confiáveis para operações empresariais.