La orquestación de la IA es la clave para escalar las operaciones de IA empresarial. Dado que el 95 % de los pilotos de IA fracasan debido a una mala coordinación, las empresas necesitan herramientas para unificar, automatizar y gestionar flujos de trabajo complejos de IA. El panorama de 2025 presenta plataformas que integran múltiples modelos, protegen los flujos de trabajo y optimizan los costos, ofreciendo un retorno de la inversión hasta un 60 % mayor para los adoptantes.

Here’s a quick breakdown of the top solutions:

Cada plataforma ofrece fortalezas únicas en escalabilidad, interoperabilidad, gobernanza y gestión de costos. Ya sea que necesite flexibilidad de código abierto o cumplimiento de nivel empresarial, estas herramientas pueden transformar sistemas de IA fragmentados en ecosistemas unificados y escalables.

Elija la plataforma adecuada para escalar sus iniciativas de IA, mejorar la coordinación y maximizar el retorno de la inversión.

Comparación de plataformas de orquestación de IA: escalabilidad, interoperabilidad, gobernanza y gestión Costo

Prompts.ai es una plataforma empresarial de vanguardia diseñada para simplificar y optimizar las operaciones de IA. Reúne más de 35 modelos de lenguajes grandes de primer nivel, incluidos GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro y Kling, en una interfaz segura y unificada. Al centralizar el acceso a estos modelos, la plataforma elimina el caos de administrar múltiples herramientas, lo que ayuda a las organizaciones a escalar sus esfuerzos de IA con facilidad.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Como centro centralizado, Prompts.ai garantiza que todos los procesos impulsados por IA dependan de plantillas de mensajes autorizadas y controladas por versiones en lugar de cadenas dispersas y codificadas. Su arquitectura permite la selección de modelos sin esfuerzo y comparaciones de rendimiento en paralelo, lo que permite a los equipos identificar e implementar el modelo de lenguaje grande (LLM) más eficaz para cada tarea. Todo esto se logra sin la necesidad de reescribir código o ajustar canalizaciones, ahorrando tiempo y esfuerzo.

Prompts.ai prioriza la seguridad y el control a través de un sólido control de acceso basado en roles (RBAC). Esto permite a las organizaciones definir permisos precisos sobre quién puede crear, modificar o implementar mensajes en entornos de producción. Cada interacción se registra meticulosamente con pistas de auditoría y seguimiento de versiones, lo que ofrece total transparencia. Este marco de gobernanza ayuda a las empresas a cumplir con los estándares de cumplimiento mientras mantiene la visibilidad y el control de las operaciones de IA. Al combinar estrictas medidas de seguridad con eficiencia operativa, la plataforma ayuda a las organizaciones a gestionar la IA de forma segura y eficaz.

La plataforma incluye una capa FinOps que rastrea el uso de tokens, conectando directamente el gasto en IA con los resultados comerciales. Muchas organizaciones han informado que han reducido los costos hasta en un 98 % al consolidar las relaciones con los proveedores y eliminar las suscripciones innecesarias. Con métricas de uso y rendimiento en tiempo real, los equipos pueden monitorear y optimizar el gasto continuamente, evitando gastos inesperados al final del mes. Este nivel de transparencia financiera hace que la IA pase de ser una incertidumbre presupuestaria a una inversión mensurable con retornos claros.

LangChain se destaca como un poderoso marco para aplicaciones de inteligencia artificial, con la impresionante cifra de 90 millones de descargas mensuales y más de 100.000 estrellas de GitHub. Su diseño modular divide la funcionalidad en paquetes livianos, como langchain-core para abstracciones fundamentales y langchain-community para integraciones de terceros. Este enfoque garantiza flujos de trabajo de IA optimizados sin gastos generales innecesarios, lo que lo convierte en una opción ideal para gestionar tanto la complejidad como la escala.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith cumple estrictos estándares de cumplimiento, incluidos HIPAA, SOC 2 tipo 2 y GDPR. Ofrece un seguimiento detallado de la ejecución, creando un seguimiento de auditoría completo para la depuración y las revisiones de cumplimiento. LangGraph mejora esto con funciones humanas, incluidas capacidades de "viaje en el tiempo" para inspección, reversión y corrección en tiempo real.

__XLATE_10__

Garrett Spong, director de SWE, destaca: "LangGraph sienta las bases sobre cómo podemos crear y escalar cargas de trabajo de IA, desde agentes conversacionales, automatización de tareas complejas hasta experiencias personalizadas respaldadas por LLM que 'simplemente funcionan'".

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) se destaca con un historial impresionante: 258 millones de descargas de PyPI, 33.100 estrellas de GitHub y una próspera comunidad de más de 3.000 contribuyentes. Diseñado para ejecutarse de forma nativa en Kubernetes, KFP ejecuta cada paso de una canalización como un Pod separado, lo que le permite escalar dinámicamente los recursos informáticos en su clúster según sea necesario. Su arquitectura se basa en una estructura de gráfico acíclico dirigido (DAG), que permite la ejecución paralela de tareas en contenedores a menos que se definan dependencias de datos específicas [18, 19]. Esta configuración es clave para su capacidad de manejar flujos de trabajo complejos de manera eficiente.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP garantiza flexibilidad y portabilidad a través de su formato IR YAML, que permite que los canales se ejecuten sin problemas en diferentes backends de KFP, desde configuraciones de código abierto hasta servicios administrados como Google Cloud Vertex AI Pipelines. Esto significa que puede desarrollar localmente e implementar a escala en la nube sin tener que volver a escribir el código. La plataforma también se integra con herramientas populares como Spark, Ray y Dask para la preparación de datos, así como con KServe para la inferencia de modelos escalables. Con su SDK de Python, los científicos de datos pueden definir flujos de trabajo complejos utilizando prácticas de codificación familiares, mientras que el backend los traduce automáticamente en operaciones de Kubernetes.

La seguridad y la gobernanza son parte integral de KFP. Utiliza las funciones integradas de Kubernetes, como el control de acceso basado en roles (RBAC), espacios de nombres para aislamiento y políticas de red, para garantizar una ejecución segura del flujo de trabajo. La plataforma rastrea metadatos y artefactos de forma centralizada, creando un seguimiento de auditoría detallado para cada ejecución del proceso [8, 22]. Al ejecutar cada paso del proceso en un contenedor aislado, KFP mantiene el aislamiento del proceso y el manejo seguro de los datos. Los administradores tienen la capacidad de establecer límites de recursos para tareas individuales, asegurando una distribución justa de los recursos entre los equipos y evitando el uso excesivo. Para cargas de trabajo o datos confidenciales, se pueden utilizar selectores de nodos para restringir las tareas a hardware seguro y específico.

Si bien KFP en sí es de código abierto y de uso gratuito, los costos asociados con la infraestructura subyacente de Kubernetes, ya sea en AWS EKS, Google GKE o local, aún se aplican. Las versiones administradas, como Google Cloud Vertex AI Pipelines, operan con un modelo de precios de pago por uso [19, 20]. KFP también incluye características como mecanismos de reintento para fallas transitorias, que ayudan a evitar el gasto de reiniciar canalizaciones de larga duración, y controladores de salida que garantizan que las tareas de limpieza se ejecuten incluso si los pasos anteriores fallan. Estas características contribuyen a un uso más eficiente de los recursos y al control de costos.

Argo Workflows es un popular motor de ejecución de flujo de trabajo diseñado específicamente para Kubernetes, y más de 200 organizaciones confían en él en entornos de producción. Como solución nativa de contenedor, organiza trabajos paralelos ejecutando cada paso del flujo de trabajo en un módulo aislado. Esta arquitectura permite el escalamiento dinámico según la capacidad disponible de su clúster de Kubernetes, lo que la hace particularmente efectiva para tareas de IA que exigen una gestión flexible de recursos.

Argo Workflows admite el escalado mediante optimización vertical y fragmentación. Al aumentar el parámetro --workflow-workers, puede asignar más núcleos de CPU para acelerar la conciliación del flujo de trabajo. Para operaciones más grandes, la fragmentación se puede implementar implementando instalaciones separadas por espacio de nombres o ejecutando múltiples instancias de controlador dentro del mismo clúster usando ID de instancia. Para proteger el servidor API de Kubernetes, Argo emplea una limitación de velocidad del lado del cliente (predeterminado: 20 consultas por segundo con una ráfaga de 30) y limita la concurrencia de cada paso a 100 tareas. Este enfoque escalable garantiza una integración fluida con sistemas externos, incluso con cargas de trabajo pesadas.

Como definición de recursos personalizados (CRD) de Kubernetes, Argo se integra perfectamente con cualquier clúster de Kubernetes y potencia plataformas de inteligencia artificial destacadas como Kubeflow Pipelines, Netflix Metaflow, Seldon y Kedro. Los desarrolladores pueden definir flujos de trabajo utilizando SDK oficiales para Python (Hera), Java y Go, lo que ofrece flexibilidad en la elección del idioma. Para la gestión de artefactos, Argo admite varias soluciones de almacenamiento, incluidas AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory y Alibaba Cloud OSS. Esta compatibilidad garantiza un flujo de datos fluido en diversos entornos. Además, los flujos de trabajo pueden activarse mediante señales externas, como webhooks o cambios de almacenamiento, mediante Argo Events. Según la documentación de Metaflow, Argo Workflows es el único orquestador de producción que admite la activación de eventos a través de Argo Events. Esta combinación de flexibilidad y funcionalidad lo convierte en una opción sólida para la automatización del flujo de trabajo.

Argo Workflows aprovecha las funciones nativas de Kubernetes para garantizar una seguridad sólida. El control de acceso basado en roles (RBAC) administra los permisos para el controlador de flujo de trabajo, los usuarios y los pods individuales. Para mejorar el aislamiento, el controlador se puede restringir a un único espacio de nombres usando el modo "instalación de espacio de nombres". En entornos de producción, Argo admite el inicio de sesión único (SSO) a través de OAuth2 y OIDC, al tiempo que protege los datos en tránsito con cifrado TLS. Los administradores pueden imponer restricciones en el flujo de trabajo, lo que permite a los usuarios enviar solo plantillas previamente aprobadas, y los contextos de seguridad de pods ayudan a evitar que los pods se ejecuten como root. Las políticas de red regulan el tráfico tanto para Argo Server como para Workflow Controller, y un límite de profundidad de recursión predeterminado de 100 llamadas evita bucles infinitos.

Argo Workflows es una herramienta de código abierto disponible bajo la licencia Apache 2.0, por lo que su uso es gratuito. Para gestionar los costos, emplea estrategias TTL y Pod Garbage Collection (PodGC) para eliminar automáticamente los flujos de trabajo completados y limpiar los pods no utilizados, lo que reduce el desperdicio de recursos. Las tareas se pueden programar en infraestructura rentable, como instancias puntuales, mediante selectores de nodos y reglas de afinidad. Además, el uso de recursos se rastrea por paso, lo que ayuda a los usuarios a controlar el gasto. Si nota una "limitación del lado del cliente" en los registros del controlador, aumentar los valores --qps y --burst puede mejorar la eficiencia de la comunicación con la API de Kubernetes. Este diseño bien pensado ayuda a equilibrar el rendimiento con la rentabilidad.

Apache Airflow se ha convertido en un actor clave en la gestión de flujos de trabajo de IA, ofreciendo un marco flexible basado en código para orquestar operaciones complejas. Destaca especialmente en Operaciones de Aprendizaje Automático (MLOps), donde lo aplica el 23% de sus usuarios, y en proyectos de IA Generativa, utilizados por el 9% de su comunidad. Lanzado bajo la licencia Apache 2.0, Airflow permite a los desarrolladores definir flujos de trabajo en Python, integrándose perfectamente con cualquier biblioteca de aprendizaje automático.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor es especialmente útil para manejar cargas de trabajo impredecibles y con muchos recursos. Funciones como el mapeo dinámico de tareas permiten que las tareas se escale en función de datos en tiempo real, lo que lo hace perfecto para grandes conjuntos de datos y flujos de trabajo multimodelo. Mientras tanto, los operadores diferibles mejoran la eficiencia al gestionar estados de espera largos, como monitorear la capacitación del modelo, sin ocupar espacios de trabajadores. Este enfoque aumenta significativamente el rendimiento y la utilización de recursos.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

La API TaskFlow simplifica la creación de flujos de trabajo mediante el uso de decoradores de Python para transformar scripts en tareas de Airflow, administrando automáticamente las transferencias de datos a través de XCom. Los equipos pueden enrutar tareas a entornos apropiados, como pods de Kubernetes para entrenamiento intensivo de GPU o clústeres Spark para preprocesamiento de datos. Además, la API REST y la CLI airflowctl permiten una integración segura con canalizaciones de CI/CD, lo que garantiza una gestión del flujo de trabajo fluida y auditable.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

Para el gobierno de datos, Airflow se integra con OpenLineage, un estándar para rastrear el linaje de datos, que ayuda a cumplir con requisitos de cumplimiento como GDPR e HIPAA. La CLI airflowctl interactúa exclusivamente con la API REST, evitando el acceso directo a la base de datos de metadatos para mayor seguridad. Los equipos también pueden gestionar entornos reproducibles mediante tareas de configuración y desmontaje, tratando la infraestructura como código para una mejor supervisión y coherencia.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning ofrece una potente solución para las necesidades de IA empresarial, con GPU avanzadas, redes InfiniBand, 99,9 % de tiempo de actividad y más de 100 certificaciones de cumplimiento. Respaldado por un equipo de 34 000 ingenieros y 15 000 expertos en seguridad, garantiza confiabilidad y seguridad a escala.

La plataforma está diseñada para manejar cargas de trabajo de cualquier tamaño a través de su soporte para computación distribuida a través de datos, modelos y canalizaciones, maximizando la eficiencia de los recursos. Los puntos finales en línea administrados permiten una implementación perfecta del modelo con escalado automático para adaptarse a los picos de demanda. Por ejemplo, Marks & Spencer utilizó Azure ML para procesar datos de más de 30 millones de clientes y, al mismo tiempo, aprovechó el almacenamiento en caché y los registros de canalización para reducir el tiempo y los costos de capacitación. De manera similar, en BRF, ML y MLOps automatizados eliminaron las tareas manuales para 15 analistas, permitiéndoles concentrarse en trabajos de mayor valor.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"Sin el flujo rápido de Azure AI, nos habríamos visto obligados a invertir en ingeniería personalizada bastante significativa para ofrecer una solución. En cambio, pudimos lograr una gran velocidad al integrar fácilmente nuestros microservicios existentes en la solución de flujo rápido".

Azure ML también admite capacitación distribuida que preserva la privacidad, como lo demostró Johan Bryssinck en Swift, quien usó la plataforma para entrenar modelos en dispositivos locales en lugar de centralizar datos, garantizando tanto la escalabilidad como la privacidad de los datos. Su contrato API unificado, junto con las integraciones con Azure Logic Apps y Azure Functions, mejora aún más la conectividad con herramientas externas.

Azure Machine Learning prioriza la seguridad con características como Microsoft Entra ID para control de acceso basado en roles (RBAC) y redes virtuales para aislar recursos y limitar el acceso a API. Los datos se protegen con cifrado TLS 1.2/1.3 durante el tránsito y cifrado doble en reposo, con opciones de claves administradas por el cliente para mayor control. Las defensas en tiempo real, como Prompt Shields, evitan jailbreaks y ataques de inyección rápida, mientras que Customer Lockbox requiere aprobación administrativa para que Microsoft acceda a los datos de los clientes. Herramientas adicionales realizan un seguimiento de las versiones de activos, el linaje de datos y las cuotas, y Microsoft Defender para la nube proporciona protección contra amenazas en tiempo de ejecución.

Azure Machine Learning opera con un modelo de precios de pago por uso y cobra solo por los recursos informáticos, como CPU y GPU especializadas. Los servicios de soporte como Blob Storage, Key Vault, Container Registry y Application Insights también se facturan según el uso. Los equipos pueden elegir hardware adaptado a tareas específicas, mientras que funciones como el almacenamiento en caché de canalizaciones reducen los cálculos redundantes. La infraestructura como código garantiza una implementación consistente y una gestión eficiente de los recursos.

Google Vertex AI Pipelines elimina la molestia de administrar la infraestructura al automatizar los flujos de trabajo de aprendizaje automático (ML). Organiza las tareas en un gráfico acíclico dirigido (DAG) de componentes en contenedores, lo que permite a los equipos centrarse en el desarrollo de modelos en lugar de en la gestión de servidores.

Vertex AI Pipelines utiliza un enfoque sin servidor para manejar cargas de trabajo, delegando tareas de procesamiento intensivo a herramientas como BigQuery, Dataflow y Cloud Serverless para Apache Spark. Para cálculos distribuidos de Python y ML, se integra perfectamente con Ray en Vertex AI.

La plataforma admite nodos de las series A3 y A3 Mega equipados con GPU NVIDIA H100/H200. Los nodos A3 Mega, con 8 GPU H100, ofrecen un impresionante ancho de banda entre nodos de 1600 Gbps. Por ejemplo, Vectra analizó 300.000 llamadas mensuales de clientes utilizando Gemini y Vertex AI, logrando un aumento del 500 % en la velocidad de análisis.

La rentabilidad está integrada con el almacenamiento en caché de ejecución, que reutiliza los resultados para minimizar los gastos. Vertex ML Metadata garantiza la reproducibilidad al rastrear el linaje de artefactos, parámetros y métricas a escala. Este diseño escalable se integra fácilmente con una variedad de herramientas, lo que lo convierte en una solución versátil para flujos de trabajo de aprendizaje automático.

El SDK de Google Cloud Pipeline Components (GCPC) simplifica la integración al ofrecer componentes prediseñados que conectan los servicios de Vertex AI, como AutoML, trabajos de capacitación personalizados e implementación de modelos, directamente en las canalizaciones.

La administración de canalizaciones es flexible, con opciones como Cloud Composer (Apache Airflow administrado) y activadores de Cloud Data Fusion para orquestar flujos de trabajo entre servicios. Las conexiones nativas a BigQuery, Cloud Storage y Dataproc agilizan el procesamiento de datos, mientras que los metadatos se pueden sincronizar con el Catálogo universal de Dataplex para el seguimiento del linaje entre proyectos. Además, Model Garden ofrece acceso a más de 200 modelos, incluidos Gemini de Google, Claude de Anthropic y Llama de Meta.

Las definiciones de canalización se compilan en un formato YAML estandarizado, lo que garantiza la portabilidad entre repositorios como Artifact Registry.

Vertex AI Pipelines está diseñado teniendo en cuenta la gobernanza y la seguridad. Las cuentas de servicio garantizan que cada componente funcione solo con los permisos necesarios. Los controles de servicio de VPC establecen un perímetro seguro, evitando que datos confidenciales, como conjuntos de datos de entrenamiento, modelos y resultados de predicción por lotes, salgan de los límites de la red.

Para organizaciones con necesidades de cumplimiento estrictas, la plataforma admite claves de cifrado administradas por el cliente (CMEK), además del cifrado en reposo predeterminado de Google Cloud. Vertex ML Metadata proporciona un seguimiento de auditoría detallado al registrar automáticamente parámetros, artefactos y métricas de cada ejecución de canalización.

Las funciones de seguridad como Model Armor protegen contra la inyección rápida y la filtración de datos. Las canalizaciones se pueden configurar para ejecutarse dentro de redes VPC emparejadas y Cloud Logging permite a los equipos monitorear los eventos de canalización para detectar anomalías de seguridad.

Vertex AI Pipelines opera con un modelo de pago por uso, con etiquetas de facturación que se aplican automáticamente para el seguimiento de costos a través de exportaciones de Cloud Billing a BigQuery. El almacenamiento en caché de ejecución reduce aún más los costos al reutilizar los resultados.

Para reducir los gastos de trabajos de capacitación tolerantes a interrupciones, las máquinas virtuales Spot están disponibles a precios reducidos. Para compromisos de infraestructura a largo plazo, los descuentos por uso comprometido (CUD) brindan ahorros de costos y capacidad garantizada. El Dynamic Workload Scheduler (DWS) ofrece capacidad para cargas de trabajo flexibles a precios de lista más bajos, mientras que los grupos de capacitación dedicados garantizan una capacidad de acelerador reservada para trabajos a gran escala.

IBM watsonx Orchestrate actúa como un centro central, coordinando a los agentes de IA funcionando como supervisor, enrutador y planificador de herramientas especializadas y modelos básicos. La plataforma admite varios enfoques de orquestación: React para tareas exploratorias, Plan-Act para flujos de trabajo estructurados y orquestación determinista para procesos comerciales predecibles.

Diseñado para operaciones a gran escala, watsonx Orchestrate utiliza la orquestación de múltiples agentes para enrutar solicitudes de manera eficiente a las herramientas y modelos de lenguaje grandes (LLM) apropiados en tiempo real. Las organizaciones pueden optar por implementar watsonx Orchestrate como un servicio administrado en IBM Cloud o AWS, o instalarlo localmente para alinearse con su infraestructura existente.

La plataforma ya ha arrojado resultados mensurables. Por ejemplo, IBM resolvió instantáneamente el 94 % de 10 millones de solicitudes anuales de recursos humanos a través de watsonx Orchestrate, lo que permitió a los equipos de recursos humanos centrarse en tareas de mayor valor. Del mismo modo, Dun & Bradstreet redujo el tiempo de adquisición hasta en un 20 % con evaluaciones de riesgos de proveedores basadas en inteligencia artificial, lo que ahorró a los clientes más del 10 % en tiempo de evaluación.

Para respaldar una implementación rápida, la plataforma incluye un Agent Builder sin código y un Kit de desarrollo de agentes (ADK) para crear herramientas personalizadas basadas en Python. Además, un catálogo con más de 100 agentes de IA de dominios específicos y más de 400 herramientas prediseñadas ofrece componentes escalables para satisfacer diversas necesidades operativas.

Esta escalabilidad garantiza una integración fluida con los sistemas existentes, lo que lo hace adaptable a una amplia gama de entornos empresariales.

AI Gateway de la plataforma facilita el enrutamiento fluido entre varios modelos básicos, incluidos IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral y Llama, lo que ayuda a las organizaciones a evitar la dependencia de proveedores. El kit de desarrollo de agentes admite la creación de herramientas personalizadas utilizando especificaciones OpenAPI para servicios web remotos y Python para una funcionalidad ampliada.

La integración con Langflow agrega una interfaz visual de arrastrar y soltar para diseñar aplicaciones de IA, que luego se pueden importar al entorno Orchestrate. Además, watsonx Orchestrate se conecta sin esfuerzo con sistemas empresariales como Salesforce, SAP, Workday y Microsoft 365, eliminando la necesidad de realizar grandes cambios en la infraestructura.

Con AgentOps, la plataforma monitorea las actividades de los agentes de IA y aplica políticas en tiempo real para garantizar la confiabilidad y el cumplimiento. Las barandillas integradas y la supervisión centralizada ayudan a mantener el cumplimiento de las normas internas.

__XLATE_52__

"Con AgentOps, cada acción es monitoreada y gobernada, lo que permite marcar y corregir anomalías en tiempo real". - Sala de prensa de IBM

La integración de IBM Guardium mejora la seguridad al identificar implementaciones de IA no autorizadas y exponer vulnerabilidades o configuraciones incorrectas. La plataforma también implementa control de acceso basado en roles (RBAC), que incluye cuatro roles principales (administrador, constructor, usuario y experto en producto) para salvaguardar la configuración del entorno. Las empresas que utilizan watsonx.governance han informado de un aumento del 30 % en el retorno de la inversión (ROI) de sus iniciativas de IA.

La plataforma ofrece precios flexibles para satisfacer diferentes necesidades organizacionales:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31 de enero de 2026.

UiPath AI Center reúne agentes de IA, robots RPA y trabajadores humanos dentro de flujos de trabajo empresariales, creando un ecosistema escalable diseñado para satisfacer las demandas de 2025. En esencia, la plataforma aprovecha UiPath Maestro como su centro de control inteligente, gestionando procesos de larga duración en operaciones comerciales complejas.

UiPath AI Center ofrece dos opciones de implementación para satisfacer las diversas necesidades comerciales: Automation Cloud, que proporciona escalamiento elástico instantáneo, y Automation Suite, diseñada para implementación local. Su sistema MLOps presenta una interfaz fácil de usar de arrastrar y soltar para implementar y monitorear modelos, lo que les permite escalar sin problemas en una cantidad ilimitada de robots. Por ejemplo, SunExpress Airlines informó haber ahorrado más de 200.000 dólares y haber reducido los retrasos en dos meses. La plataforma también garantiza que los modelos sigan siendo precisos mediante el reentrenamiento continuo de personas involucradas, lo que la convierte en una herramienta poderosa para integrar la IA en diversos sistemas.

La plataforma adopta una estrategia "Traiga su propio modelo" (BYOM), que permite la integración con marcos de terceros como LangChain, Anthropic y Microsoft. Además, el protocolo Agent2Agent (A2A), desarrollado en colaboración con Google Cloud, facilita una comunicación fluida entre agentes de IA en plataformas empresariales.

__XLATE_59__

Harrison Chase, director ejecutivo de LangChain, compartió: "Nuestra colaboración con UiPath en el protocolo de agentes garantiza que los agentes de LangGraph puedan participar sin problemas en las automatizaciones de UiPath, ampliando su alcance y permitiendo a los desarrolladores crear flujos de trabajo multiplataforma más cohesivos".

UiPath AI Center se conecta a cientos de aplicaciones SaaS a través de API estandarizadas, admite BPMN 2.0 para el modelado de procesos y utiliza el modelo de decisión y notación (DMN) para gestionar reglas comerciales. Un ejemplo notable es Heritage Bank, el banco mutuo más grande de Australia, que utilizó AI Center para automatizar su proceso de revisión de préstamos, mejorando la experiencia de los clientes y reduciendo las tareas manuales de backend.

UiPath AI Center prioriza la gobernanza y la seguridad, ofreciendo controles de acceso a nivel de proyecto y inquilino para mantener la trazabilidad y el cumplimiento. Sus funciones de agencia controlada garantizan que los agentes de IA no puedan realizar acciones no autorizadas o inseguras de forma autónoma.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath AI Center emplea un modelo de licencia basado en el consumo que utiliza unidades de IA, que miden actividades como entrenamiento de modelos, alojamiento y predicciones. Estos se integran perfectamente en el sistema de licencias UiPath más amplio a través de unidades de plataforma, cubriendo las necesidades de orquestación y ejecución. Para ayudar a las organizaciones a explorar sus capacidades, hay disponible una prueba gratuita de 60 días para las versiones de Automation Cloud y Automation Suite, lo que facilita la evaluación de su valor y mantiene los costos bajo control.

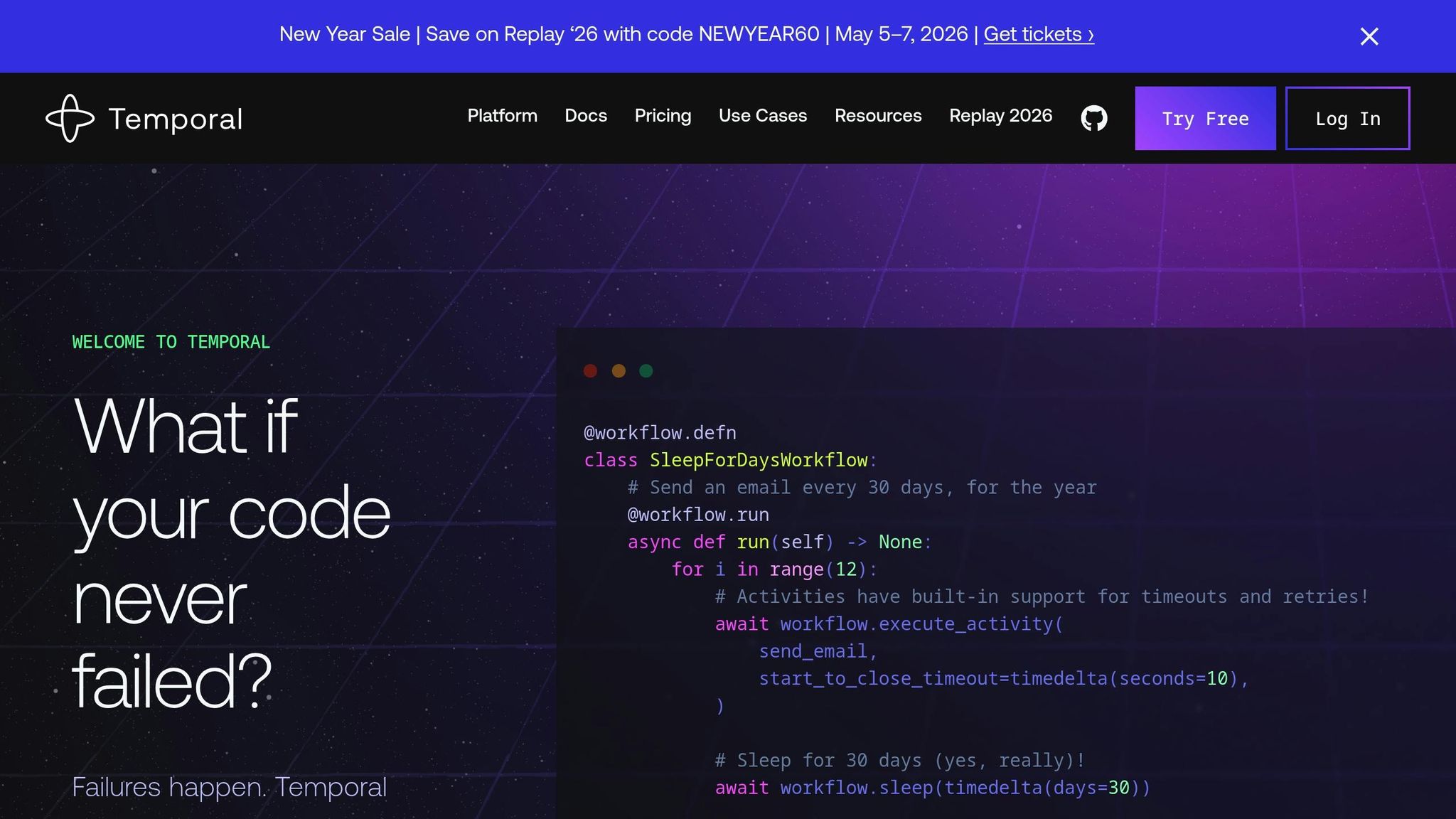

Temporal adopta un enfoque único al utilizar código duradero y reanudable en lugar de depender de archivos de configuración. Captura cada paso del flujo de trabajo en un historial de eventos inmutable, lo que garantiza que los procesos puedan continuar exactamente donde lo dejaron después de una interrupción. Un gran ejemplo de esto es Replit, que hizo la transición de su plano de control de agente de codificación a Temporal, mejorando significativamente la confiabilidad y la experiencia del usuario.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, gerente de producto, Retool

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Esta escalabilidad garantiza una integración perfecta con diversas herramientas y sistemas.

Los desarrolladores pueden escribir flujos de trabajo como código en lenguajes populares como Python, Go, Java, TypeScript, .NET y PHP. Temporal también se integra sin esfuerzo con los principales marcos de IA, incluidos OpenAI Agents SDK, Pydantic AI, LangGraph y Crew AI. Su compatibilidad con el protocolo de contexto modelo (MCP) mejora la confiabilidad del agente. La observabilidad se mejora mediante conexiones con herramientas de monitoreo específicas de IA, como Langfuse. Por ejemplo, Gorgias utiliza esta flexibilidad para ayudar a más de 15.000 marcas de comercio electrónico a gestionar agentes de servicio al cliente basados en IA.

El historial de eventos de Temporal proporciona un seguimiento de auditoría completo e inalterable de cada cambio de estado en los flujos de trabajo de IA. Esta característica admite la gobernanza humana, lo que permite que los flujos de trabajo se detengan para una validación externa antes de ejecutar decisiones autónomas. Esta protección es particularmente útil en entornos de producción para prevenir problemas como las alucinaciones LLM. En las implementaciones de Temporal Cloud, el proveedor no puede acceder al código de la aplicación, mientras que la opción de servidor de código abierto con licencia MIT permite a las organizaciones alojar la plataforma dentro de su propia infraestructura segura. Los ingenieros de Netflix han destacado cómo este diseño minimiza el mantenimiento y simplifica el manejo de fallas.

Temporal Cloud opera con un modelo de pago por uso, mientras que Temporal Server de código abierto se puede autohospedar de forma gratuita. Los nuevos usuarios pueden explorar la plataforma con $1000 en créditos gratuitos para Temporal Cloud. Al suspender los flujos de trabajo sin consumir recursos informáticos, los usuarios pueden reducir significativamente los costos operativos y de infraestructura. El diseño de Temporal no sólo mejora la eficiencia y la confiabilidad, sino que también mantiene los gastos bajo control a medida que crecen las operaciones de IA.

Seleccionar la plataforma de orquestación de IA ideal requiere equilibrar la flexibilidad con la facilidad de uso. Las opciones de código abierto como Apache Airflow y LangChain ofrecen independencia de proveedores y una profunda personalización, pero exigen habilidades técnicas avanzadas y configuraciones manuales para seguridad y gobernanza. Por otro lado, las plataformas empresariales como IBM watsonx Orchestrate y UiPath incluyen funciones integradas como control de acceso basado en roles (RBAC), pistas de auditoría y cumplimiento de HIPAA, aunque conllevan tarifas de licencia y flexibilidad reducida.

Las estrategias de escalabilidad varían ampliamente entre plataformas. Las herramientas nativas de Kubernetes como Kubeflow y Argo Workflows destacan en la portabilidad en contenedores, mientras que la programación basada en gráficos acíclicos dirigidos (DAG) de Apache Airflow es eficaz para gestionar dependencias complejas en configuraciones híbridas y de múltiples nubes. Temporal es conocido por su alto rendimiento, mientras que Azure Machine Learning y Google Vertex AI Pipelines aprovechan sus ecosistemas de nube principales para asignar recursos dinámicamente durante los picos de demanda. Estas variaciones resaltan las compensaciones que las organizaciones deben considerar al evaluar soluciones.

La interoperabilidad es otro factor crítico para garantizar flujos de trabajo unificados. LangChain permite a los desarrolladores conectar múltiples modelos de lenguajes grandes (LLM) y API sin necesidad de revisar los sistemas existentes, y Kubeflow admite marcos como PyTorch, TensorFlow y JAX dentro de una sola canalización. Plataformas como Prompts.ai tienen como objetivo reducir la fragmentación unificando múltiples modelos, mientras que plataformas específicas de proveedores como Azure Machine Learning e IBM watsonx Orchestrate brindan integraciones nativas perfectas, pero pueden requerir conectores adicionales para una compatibilidad más amplia.

Las compensaciones operativas también desempeñan un papel clave en las decisiones de implementación y el retorno de la inversión (ROI). La gobernanza y la gestión de costos son áreas en las que las plataformas difieren significativamente. Las soluciones de nivel empresarial como IBM watsonx Orchestrate y UiPath proporcionan paneles centralizados y características de seguridad sólidas, lo que las hace adecuadas para industrias reguladas como la atención médica y las finanzas. Por el contrario, las herramientas de código abierto a menudo requieren una configuración manual para lograr una supervisión comparable. Desde una perspectiva de costos, si bien Apache Airflow, LangChain y Kubeflow son de implementación gratuita, pueden incurrir en gastos ocultos relacionados con el tiempo y la experiencia de ingeniería. Temporal Cloud ofrece precios de pago por uso con $1000 en créditos gratuitos, mientras que Prompts.ai reduce significativamente los costos del software de inteligencia artificial (hasta un 98%) a través de su sistema de crédito TOKN unificado que elimina las tarifas recurrentes.

La siguiente tabla proporciona una comparación detallada de cada plataforma en dimensiones operativas clave:

La selección de la mejor plataforma de orquestación de IA depende de las capacidades técnicas, las necesidades de cumplimiento y los planes de crecimiento de su organización. Las opciones de código abierto como Apache Airflow y LangChain ofrecen una flexibilidad inigualable sin tarifas de licencia, lo que las convierte en una opción ideal para los equipos impulsados por desarrolladores en nuevas empresas tecnológicas y empresas de rápido crecimiento que valoran las configuraciones modulares. Sin embargo, estos marcos exigen habilidades de ingeniería avanzadas para configurar características críticas como seguridad, gobernanza y escalabilidad. Por otro lado, las plataformas empresariales como IBM watsonx Orchestrate atienden a industrias como la atención médica y las finanzas, donde las medidas de cumplimiento integradas, como controles de acceso basados en roles, pistas de auditoría y certificaciones como HIPAA y SOC 2, no son negociables. Estas plataformas a menudo demuestran retornos tangibles al optimizar los flujos de trabajo y vincular las funciones de gobernanza con mejores resultados comerciales.

Para las grandes empresas, las plataformas con mucha gobernanza son esenciales, pero las medianas empresas a menudo necesitan soluciones que equilibren costos y rendimiento. Prompts.ai simplifica esta ecuación al integrar más de 35 modelos en una interfaz, ofreciendo controles FinOps en tiempo real y créditos TOKN de pago por uso para minimizar la fragmentación de herramientas y los gastos inesperados. Mientras tanto, las herramientas nativas de Kubernetes como Kubeflow Pipelines y Argo Workflows brillan cuando la portabilidad y las implementaciones de nube híbrida son clave, especialmente para los equipos de ciencia de datos que administran procesos complejos de aprendizaje automático en sistemas distribuidos.

Como se analizó anteriormente, el surgimiento de la IA agencial (en la que agentes autónomos colaboran en un razonamiento de varios pasos) resalta la creciente importancia de una orquestación perfecta. Para citar a Domo:

__XLATE_78__

"El éxito en la IA ya no se trata de tener la mayor cantidad de modelos, sino de orquestarlos de manera efectiva".

Para las organizaciones estadounidenses, es crucial elegir plataformas que coincidan con su madurez técnica actual y al mismo tiempo ofrezcan espacio para escalar a medida que la IA se integra más entre los departamentos. Un punto de partida inteligente es un proyecto piloto centrado en un flujo de trabajo específico, rastreando entradas, salidas y errores para establecer una base de observabilidad para una futura ampliación. La plataforma de orquestación adecuada hace más que simplemente conectar herramientas de IA: redefine cómo los equipos colaboran, resuelven problemas y crean valor a mayor escala.

Las plataformas de orquestación de IA simplifican los flujos de trabajo complejos al reunir varios modelos, fuentes de datos y procesos de IA en un solo sistema automatizado. Gestionan tareas como programación, distribución de recursos e integración de API, minimizando el esfuerzo manual y reduciendo significativamente tanto el tiempo de desarrollo como los gastos operativos.

Estas plataformas están diseñadas para escalar sin esfuerzo, lo que permite a las empresas pasar de manejar un puñado de tareas a administrar miles sin necesidad de revisar su infraestructura. Se destacan en el procesamiento de grandes volúmenes de datos, haciendo que el uso de recursos sea más eficiente y manteniendo una supervisión constante. Esto conduce a implementaciones más rápidas, mayor productividad y soluciones de inteligencia artificial mejor equipadas para satisfacer las necesidades dinámicas de las empresas.

Las plataformas de orquestación de IA a menudo manejan los gastos a través de modelos de precios basados en el uso, lo que permite a las empresas pagar solo por lo que usan en lugar de comprometerse con licencias fijas. Muchas de estas plataformas vienen equipadas con herramientas financieras en tiempo real, incluidos paneles para monitorear el gasto por modelo o flujo de trabajo, sistemas de alerta presupuestaria y etiquetado de cargas de trabajo para un análisis de costos detallado. Estas herramientas garantizan que las empresas tengan una visión clara de sus gastos relacionados con la IA y mantengan el control sobre sus presupuestos.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai está estableciendo el estándar para la orquestación segura de IA en 2025, ofreciendo a las empresas una plataforma confiable para escalar sus operaciones de IA sin esfuerzo. Su panel unificado está diseñado para simplificar la gestión, con herramientas de gobernanza integradas, seguimiento de costos en tiempo real y pistas de auditoría inmutables. Estas características garantizan que las empresas sigan cumpliendo con las normas y al mismo tiempo mantengan una supervisión completa de sus flujos de trabajo de IA.

Equipado con medidas de seguridad de nivel empresarial, como control de acceso basado en roles, cifrado de extremo a extremo y monitoreo continuo del cumplimiento, Prompts.ai protege los datos confidenciales en cada etapa de la operación. Con la integración de más de 35 LLM líderes en un único marco seguro, se reducen los riesgos y se permite a las empresas ampliar sus capacidades de IA con confianza y eficiencia.