AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Profundice más para encontrar el marco adecuado para su equipo y flujos de trabajo.

Prompts.ai sirve como una plataforma centralizada basada en la nube que conecta a los usuarios empresariales con más de 35 modelos líderes de IA, incluidos GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro y Kling, todos accesibles a través de una única interfaz. No se requiere instalación de software, lo que facilita que equipos de cualquier tamaño incorporen IA en sus flujos de trabajo.

La plataforma aborda un desafío importante en la adopción de la IA: la expansión de herramientas. Al proporcionar un entorno unificado, consolida la selección de modelos, los flujos de trabajo rápidos y el seguimiento del rendimiento en un solo sistema. Este enfoque cambia el uso de la IA de experimentos únicos y dispersos a procesos consistentes y escalables que las organizaciones pueden implementar en todos los departamentos con facilidad.

Prompts.ai se centra en automatizar los flujos de trabajo de IA empresarial, ayudando a las organizaciones a reducir costos innecesarios y al mismo tiempo abordar las preocupaciones de gobernanza. Desde empresas Fortune 500 hasta agencias creativas y laboratorios de investigación, los usuarios pueden crear flujos de trabajo auditables y compatibles sin correr el riesgo de exponer datos confidenciales a múltiples servicios de terceros.

La plataforma ha sido reconocida por GenAI.Works como la mejor solución de inteligencia artificial para la automatización y la resolución de problemas empresariales, con una impresionante calificación de usuario de 4,8 sobre 5. Las empresas confían en Prompts.ai para tareas como optimizar la creación de contenido, automatizar flujos de trabajo estratégicos y acelerar el desarrollo de propuestas. En algunos casos, proyectos que antes llevaban semanas se han reducido a un solo día.

Un ejemplo notable proviene de mayo de 2025, cuando el director independiente de IA, Johannes Vorillon, utilizó la plataforma para integrar a la perfección las animaciones de Google DeepMind Veo2 en un vídeo promocional de Breitling y la Fuerza Aérea Francesa. Este proyecto destacó cómo Prompts.ai permite una orquestación fluida de múltiples herramientas de inteligencia artificial.

Prompts.ai simplifica la forma en que los equipos trabajan con la IA al integrar el acceso a más de 35 modelos de idiomas e imágenes a través de una única interfaz. Esto elimina la molestia de administrar múltiples suscripciones, claves API y sistemas de facturación. Los usuarios pueden combinar diferentes modelos para tareas específicas dentro de un único flujo de trabajo, creando canales de orquestación fluidos.

La plataforma opera con un sistema de crédito TOKN, que estandariza el uso en todos los modelos, lo que simplifica el seguimiento de costos y la asignación de recursos. Los equipos pueden cambiar entre modelos según sea necesario, según los requisitos de rendimiento. Los planes comerciales incluyen espacios de trabajo y colaboradores ilimitados, lo que facilita a las organizaciones escalar la adopción de la IA.

Con un modelo de precios de pago por uso, Prompts.ai alinea los costos con el uso real, comenzando en $0/mes para la exploración inicial. Los planes comerciales, que van desde $ 99 a $ 129 por miembro mensualmente, ofrecen distintos niveles de créditos TOKN (250 000 a 1 000 000) y 10 GB de almacenamiento en la nube en todos los niveles.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 de junio de 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

Los planes comerciales (Core, Pro y Elite) incluyen herramientas para el monitoreo del cumplimiento y la administración de la gobernanza, lo que ofrece visibilidad total de las interacciones de la IA y mantiene registros de auditoría detallados para cumplir con los requisitos reglamentarios. Incluso los equipos más pequeños y los profesionales individuales que utilizan los planes Personal Creator y Family se benefician de estas funciones de gobierno de nivel empresarial.

Los datos confidenciales se mantienen dentro de un entorno centralizado y controlado, lo que reduce los riesgos asociados con la difusión de información entre múltiples servicios de terceros. Esta arquitectura segura no solo minimiza las vulnerabilidades potenciales sino que también simplifica la gestión del cumplimiento para las organizaciones que operan bajo regulaciones estrictas.

Diseñado con una arquitectura nativa de la nube, Prompts.ai permite a las organizaciones escalar sin esfuerzo. Los equipos pueden agregar nuevos miembros, ampliar los espacios de trabajo y acceder a modelos adicionales en cuestión de minutos, lo que garantiza que la adopción de la IA pueda crecer tan rápido como sea necesario.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI ofrece una solución de automatización del flujo de trabajo impulsada por interfaces conversacionales. Si bien los detalles específicos sobre su arquitectura de implementación y métodos de orquestación no están disponibles públicamente, su énfasis en las interfaces conversacionales resalta un ángulo único en la optimización de la automatización del flujo de trabajo.

IBM watsonx Orchestrate lleva la automatización impulsada por la IA a las operaciones empresariales, enfocándose en hacer que la automatización sea accesible para los profesionales de negocios en lugar de solo para los desarrolladores. Al permitir a los usuarios emitir comandos en lenguaje natural, la plataforma simplifica tareas complejas para equipos no técnicos en recursos humanos, finanzas, ventas, atención al cliente y adquisiciones. Este enfoque elimina la necesidad de tener experiencia en codificación, lo que permite a los equipos empresariales automatizar procesos de forma independiente.

La plataforma destaca por la automatización de tareas repetitivas que a menudo consumen el tiempo de los empleados. Con comandos de lenguaje simple, los usuarios pueden iniciar flujos de trabajo para tareas como programar entrevistas, resumir perfiles de candidatos, procesar préstamos y generar informes. watsonx Orchestrate maneja estas actividades en múltiples sistemas backend mientras cumple con los estándares de seguridad de nivel empresarial.

Por ejemplo, una importante institución financiera implementó watsonx Orchestrate para optimizar la atención al cliente y las funciones administrativas. Los empleados utilizaron entradas de lenguaje natural para automatizar los flujos de trabajo para el procesamiento de préstamos y solicitudes de servicios. La plataforma se integró perfectamente con los sistemas backend, mantuvo el cumplimiento a través de una gobernanza integrada y entregó mejoras notables: tiempos de procesamiento más rápidos, menos errores manuales y mayor satisfacción del cliente. Este ejemplo destaca la capacidad de la plataforma para transformar tareas empresariales rutinarias en procesos eficientes y automatizados.

IBM watsonx Orchestrate ofrece opciones de implementación de nube híbrida, lo que permite que los flujos de trabajo se ejecuten en la nube, en las instalaciones o en ambas. Esta flexibilidad es particularmente valiosa para organizaciones con políticas estrictas de residencia de datos o infraestructura heredada. La plataforma aprovecha los modelos de lenguajes grandes (LLM), las API y las aplicaciones empresariales para ejecutar tareas de forma segura, garantizando la compatibilidad con diversos entornos operativos.

watsonx Orchestrate se integra perfectamente con diversos sistemas, lo que lo convierte en una solución sólida para la automatización empresarial. Se conecta a CRM, ERP y plataformas en la nube como AWS y Azure mediante conectores visuales y API. Además, trabaja en estrecha colaboración con los servicios IBM Watson y otros modelos de IA de IBM, ampliando sus capacidades más allá de la automatización básica del flujo de trabajo. Para los usuarios avanzados, el acceso API programático permite una mayor personalización e integración con las herramientas existentes.

__XLATE_18__

"IBM watsonx Orchestrate está diseñado para llevar la automatización impulsada por IA directamente a los flujos de trabajo empresariales. A diferencia de las herramientas centradas en desarrolladores, watsonx Orchestrate se dirige a profesionales de recursos humanos, finanzas, ventas y atención al cliente que desean optimizar las tareas sin una codificación pesada". -Domo

La plataforma también incluye aplicaciones de IA prediseñadas y conjuntos de habilidades específicas de la industria, lo que permite una implementación más rápida para casos de uso comunes. Sin embargo, las organizaciones deben tener en cuenta que su funcionalidad puede ser más limitada fuera del ecosistema de IBM en comparación con plataformas con opciones de integración más amplias.

IBM watsonx Orchestrate se destaca por su sólido marco de gobernanza, lo que lo convierte en la opción preferida para las industrias reguladas. Los controles de acceso basados en roles garantizan que el acceso a los datos esté restringido a usuarios autorizados y funcionalidades específicas.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

Diseñado para escalar en entornos híbridos, watsonx Orchestrate admite tanto equipos pequeños como grandes empresas. Mejora la eficiencia operativa, garantiza el cumplimiento de las políticas, mitiga los riesgos y aumenta la productividad de los empleados. Las organizaciones pueden empezar poco a poco, centrándose en departamentos específicos, y ampliar gradualmente las capacidades de automatización a medida que ven resultados y desarrollan experiencia interna.

Apache Airflow es una plataforma de código abierto creada para orquestar flujos de trabajo de datos complejos utilizando gráficos acíclicos dirigidos (DAG). Inicialmente desarrollado por Airbnb y ahora bajo la Apache Software Foundation, se ha convertido en una opción popular para programar, monitorear y administrar canales de datos. A diferencia de las herramientas de automatización diseñadas para usuarios empresariales, Airflow está diseñado pensando en los ingenieros y desarrolladores de datos y ofrece control programático sobre la ejecución del flujo de trabajo.

Airflow brilla en la gestión de canales de datos que involucran dependencias complejas, tareas programadas y lógica de transformación. Los equipos de datos dependen de él para una variedad de propósitos, incluida la coordinación de procesos ETL (Extracción, Transformación, Carga), entrenamiento de modelos de aprendizaje automático, ejecución de trabajos de procesamiento por lotes, ingesta de datos de múltiples fuentes, transformación de conjuntos de datos y generación de informes según un cronograma. Al definir flujos de trabajo en Python, los desarrolladores obtienen una amplia flexibilidad para implementar lógica personalizada y manejar errores de manera efectiva.

La plataforma incluye una interfaz visual que proporciona información sobre el estado del flujo de trabajo, las dependencias de las tareas y el historial de ejecución. Esto facilita el seguimiento del rendimiento y la resolución de fallos. Por ejemplo, si una tarea falla, Airflow puede volver a intentarla automáticamente, enviar alertas u omitir tareas posteriores para evitar problemas en cascada. Esta funcionalidad la convierte en una opción versátil para diversas necesidades de implementación.

Airflow se puede implementar como una configuración de servidor único o escalar a clústeres distribuidos, donde el programador, los trabajadores y el servidor web operan en máquinas separadas. La arquitectura se compone de varios componentes clave: un programador que desencadena tareas según cronogramas definidos, trabajadores que ejecutan tareas, un servidor web para la interfaz de usuario y una base de datos de metadatos que almacena definiciones de flujo de trabajo e historial de ejecución.

Este diseño modular permite a las organizaciones ampliar la capacidad de los trabajadores de forma independiente, según las demandas de la carga de trabajo. En entornos nativos de la nube, Kubernetes se utiliza a menudo para implementar Airflow, y KubernetesExecutor crea pods aislados para tareas individuales. Esta configuración mejora el aislamiento de recursos y permite a los equipos asignar recursos informáticos específicos para cada tarea. Para aquellos que buscan reducir los gastos generales de administración de infraestructura, los servicios administrados de Airflow están disponibles, aunque conllevan costos operativos adicionales.

Las amplias capacidades de integración de Airflow lo hacen altamente adaptable. Ofrece conectores prediseñados para bases de datos, plataformas en la nube, almacenes de datos y sistemas de mensajería, junto con la capacidad de crear operadores personalizados utilizando Python. Esta flexibilidad garantiza que Airflow pueda satisfacer diversos requisitos organizacionales.

El rico ecosistema de bibliotecas de Python también se puede aprovechar dentro de los flujos de trabajo, lo que permite realizar transformaciones y análisis de datos avanzados directamente en las definiciones de canalización. Para aplicaciones de inteligencia artificial y aprendizaje automático, Airflow se integra perfectamente con marcos como TensorFlow, PyTorch y scikit-learn. Estas integraciones ayudan a los científicos de datos a organizar flujos de trabajo para tareas como obtener datos, preprocesar funciones, entrenar modelos, evaluar el rendimiento e implementar modelos en producción.

Airflow incluye control de acceso basado en roles (RBAC) para administrar los permisos de los usuarios en todos los flujos de trabajo y funciones administrativas. Los administradores pueden definir roles con privilegios específicos, asegurando que solo los usuarios autorizados puedan ver, editar o ejecutar ciertos DAG. Este control granular ayuda a mantener la integridad del flujo de trabajo y evita cambios no autorizados.

Las opciones de autenticación incluyen inicio de sesión basado en contraseña, integración LDAP y proveedores de OAuth. Las credenciales confidenciales se gestionan por separado a través del sistema de variables y conexiones de Airflow. Para mejorar la seguridad, se pueden integrar herramientas externas de administración de secretos como HashiCorp Vault o AWS Secrets Manager.

El registro de auditoría es otra característica clave, que rastrea las acciones del usuario y las ejecuciones del flujo de trabajo. Esto crea un registro detallado de la actividad, lo cual es muy valioso para fines de cumplimiento y resolución de problemas.

El flujo de aire se escala horizontalmente al agregar más nodos trabajadores para manejar mayores cargas de trabajo. La plataforma admite varios tipos de ejecutores para distribuir tareas de manera efectiva: LocalExecutor ejecuta tareas en la misma máquina que el programador, CeleryExecutor distribuye tareas entre varias máquinas de trabajo utilizando una cola de mensajes y KubernetesExecutor activa pods aislados para cada tarea.

Para optimizar el rendimiento, es esencial un diseño cuidadoso de DAG y una asignación de recursos. Los volúmenes elevados de tareas pueden sobrecargar al programador, por lo que los equipos a menudo dividen DAG grandes, ajustan la configuración del programador y se aseguran de que el almacén de metadatos tenga recursos suficientes.

Airflow también maneja los reabastecimientos de manera eficiente, lo que permite a los equipos reprocesar datos históricos cuando cambia la lógica del flujo de trabajo. Si bien el backfill agiliza las actualizaciones, puede consumir importantes recursos computacionales, lo que requiere una planificación cuidadosa para evitar interrupciones en las cargas de trabajo de producción.

Al ser de código abierto, Airflow brinda a las organizaciones control total sobre sus implementaciones. Sin embargo, esto también significa que deben administrar la infraestructura, el monitoreo y las actualizaciones, lo que requiere recursos de ingeniería dedicados para mantener la confiabilidad y el rendimiento a escala.

Kubeflow se destaca como una plataforma dedicada para administrar flujos de trabajo de aprendizaje automático, distinta de las herramientas de flujo de trabajo de propósito más general. Diseñada específicamente para Kubernetes, esta solución de código abierto admite el ciclo de vida completo del aprendizaje automático, brindando a los científicos de datos e ingenieros de ML las herramientas que necesitan para construir, implementar y administrar modelos listos para producción utilizando capacidades nativas de Kubernetes.

Kubeflow está diseñado para orquestar flujos de trabajo completos de aprendizaje automático dentro de entornos de Kubernetes. Cubre todas las etapas del ciclo de vida del aprendizaje automático, incluido el preprocesamiento de datos, la ingeniería de funciones, el entrenamiento de modelos, la validación, la implementación y el monitoreo. Al permitir a los equipos crear canalizaciones modulares y reutilizables, Kubeflow simplifica la gestión de cargas de trabajo de aprendizaje automático distribuidas. Su enfoque centralizado también ayuda en el seguimiento de experimentos y la supervisión de modelos en varios proyectos. Además, Kubeflow puede automatizar los flujos de trabajo de reentrenamiento cuando se introducen nuevos datos, garantizando que los modelos se mantengan actualizados y relevantes.

Kubeflow, desarrollado sobre Kubernetes, aprovecha la orquestación de contenedores, el escalado dinámico y la gestión de recursos para optimizar los flujos de trabajo de aprendizaje automático. Los usuarios pueden interactuar con la plataforma a través de una interfaz basada en web para gestión visual o una interfaz de línea de comandos para automatización. Dependiendo de la carga de trabajo, Kubeflow asigna recursos dinámicamente, como aprovisionar GPU para tareas de entrenamiento y CPU para inferencia. Su flexibilidad permite la implementación en cualquier clúster de Kubernetes, ya sea local, en la nube o en configuraciones híbridas, lo que garantiza la adaptabilidad en todos los entornos.

Kubeflow se integra perfectamente con marcos de aprendizaje automático populares como TensorFlow, PyTorch y XGBoost, al mismo tiempo que admite marcos personalizados a través de su diseño extensible. Más allá de los marcos de aprendizaje automático, se conecta con varios servicios en la nube y soluciones de almacenamiento, lo que permite que las canalizaciones accedan al almacenamiento de objetos para datos, a almacenes de datos para la recuperación de funciones y a herramientas de monitoreo para rastrear el rendimiento. Su compatibilidad con las bibliotecas de Python agiliza aún más la transición de la experimentación a la producción.

Kubeflow utiliza las capacidades de escalamiento inherentes de Kubernetes para distribuir cargas de trabajo entre los recursos del clúster, lo que lo hace ideal para tareas de procesamiento de datos y capacitación a gran escala. Esto garantiza una utilización eficiente de los recursos y admite operaciones de aprendizaje automático de alto rendimiento. Como dijo acertadamente Akka:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Con su capacidad para asignar recursos de forma independiente, Kubeflow cierra la brecha entre la experimentación y la producción, brindando flexibilidad y rendimiento.

Flyte es una plataforma de orquestación nativa de la nube diseñada para optimizar la gestión de flujos de trabajo de aprendizaje automático (ML) en contenedores mediante Kubernetes. Elimina la complejidad de implementar canalizaciones de ML al distribuir eficientemente los recursos entre entornos de nube. Este enfoque garantiza un escalamiento fluido y un rendimiento consistente, sin importar el tamaño de la implementación.

Flyte está diseñado para manejar flujos de trabajo de aprendizaje automático de cualquier escala, asignando recursos dinámicamente para satisfacer diferentes demandas. Su sólida arquitectura garantiza que las cargas de trabajo se gestionen de manera eficiente, lo que la convierte en una opción confiable para una amplia gama de tareas de aprendizaje automático en infraestructuras basadas en la nube.

Prefect es una plataforma de orquestación basada en Python diseñada para simplificar la gestión de canales de datos complejos y flujos de trabajo de aprendizaje automático. Se centra en la facilidad de uso, la supervisión clara y la minimización de los obstáculos operativos, lo que permite a los científicos e ingenieros de datos concentrarse en crear flujos de trabajo en lugar de preocuparse por la infraestructura.

Prefect brilla en la automatización de procesos de aprendizaje automático, flujos de trabajo en la nube y procesos de transformación de datos. Es particularmente adecuado para manejar tareas ETL y flujos de trabajo complejos de aprendizaje automático que involucran múltiples dependencias, ejecuciones paralelas y procesamiento en tiempo real. Su sistema de programación flexible permite activar tareas en función de intervalos de tiempo, eventos específicos o llamadas API, lo que lo hace adaptable a una variedad de necesidades de automatización.

Prefect está optimizado para entornos de nube, lo que garantiza que pueda escalar y adaptarse a las demandas de infraestructura modernas. Construido de forma nativa en Python, se integra perfectamente con ecosistemas de datos basados en Python, eliminando la necesidad de aprender nuevos lenguajes o herramientas de programación.

Prefect ofrece compatibilidad perfecta con una amplia gama de herramientas y plataformas de datos. Se integra fácilmente con herramientas populares como dbt, PostgreSQL, Snowflake y Looker, y al mismo tiempo admite sistemas en tiempo real como Apache Kafka. Para entornos de nube, funciona con proveedores importantes como Amazon Web Services (AWS), Google Cloud Platform (GCP) y Microsoft Azure, brindando a los equipos la flexibilidad de optimizar las cargas de trabajo en función del costo y el rendimiento. Además, Prefect admite herramientas de contenedorización como Docker y Kubernetes y trabaja con marcos de procesamiento distribuido como Dask y Apache Spark. Para mantener informados a los equipos, también proporciona notificaciones de Slack sobre actualizaciones del flujo de trabajo.

Prefect está diseñado para manejar volúmenes de datos crecientes y una complejidad cada vez mayor del flujo de trabajo con facilidad. Su motor tolerante a fallas garantiza que los flujos de trabajo puedan recuperarse de errores reintentando tareas fallidas o evitando problemas, lo que lo hace altamente confiable en entornos de producción. La supervisión en tiempo real ofrece información detallada sobre la ejecución del flujo de trabajo, lo que ayuda a los equipos a identificar y resolver problemas rápidamente. Con su capacidad de escalar de manera eficiente, las principales empresas de tecnología confían en Prefect para gestionar flujos de trabajo dinámicos. Para los equipos que recién comienzan, Prefect ofrece un plan gratuito, mientras que hay precios personalizados disponibles para implementaciones más grandes que requieren funciones y soporte adicionales.

Metaflow es una plataforma de infraestructura de aprendizaje automático desarrollada inicialmente por Netflix para abordar los desafíos de escalar los flujos de trabajo de aprendizaje automático. Se centra en hacer que los procesos sean fáciles de usar y eficientes, ayudando a los científicos de datos a pasar sin problemas de los prototipos a la producción sin tener que lidiar con una infraestructura compleja.

Metaflow está diseñado para gestionar flujos de trabajo de aprendizaje automático escalables a nivel de producción. Simplifica el recorrido desde el análisis exploratorio de datos y la capacitación del modelo hasta la implementación. Los científicos de datos pueden escribir flujos de trabajo en Python utilizando bibliotecas conocidas, mientras que la plataforma se encarga del control de versiones, la gestión de dependencias y la asignación automática de recursos informáticos.

La plataforma elimina la necesidad de gestión manual de la infraestructura al aprovisionar automáticamente los recursos informáticos necesarios. Esto permite un cambio fluido del desarrollo local a la producción en la nube sin necesidad de modificar el código.

__XLATE_53__

"Metaflow organiza flujos de trabajo de aprendizaje automático escalables con simplicidad al ofrecer integraciones optimizadas en la nube, control de versiones sólido y abstracción de infraestructura para una implementación lista para producción". - Akka.io

El proceso de implementación de Metaflow se complementa con su capacidad para integrarse fácilmente con servicios en la nube y plataformas de datos. Su diseño nativo de Python garantiza la compatibilidad con bibliotecas ampliamente utilizadas para aprendizaje automático, procesamiento de datos y visualización, lo que permite a los equipos maximizar las herramientas en las que ya confían.

Metaflow, creado originalmente por Netflix para admitir extensas operaciones de aprendizaje automático, presenta un potente sistema de control de versiones. Este sistema rastrea experimentos, conjuntos de datos y versiones de modelos, garantizando que los experimentos sean reproducibles y permitiendo reversiones fáciles cuando sea necesario.

Dagster se suma a la gama de marcos de orquestación al centrarse en mantener la integridad de los datos y al mismo tiempo ofrecer una gestión de canalización adaptable. Esta herramienta de código abierto está diseñada para mejorar la calidad, realizar un seguimiento del linaje de datos y garantizar la visibilidad dentro de los flujos de trabajo de aprendizaje automático (ML). Básicamente, Dagster se especializa en crear canales de datos confiables y con seguridad de tipos que mantienen altos estándares de integridad de datos y brindan información clara sobre las transformaciones.

Dagster es particularmente eficaz para gestionar flujos de trabajo de aprendizaje automático donde la calidad y precisión de los datos no son negociables. Está diseñado para equipos que necesitan validación integrada, seguimiento sólido de metadatos y observabilidad integral en todos sus procesos. Un ejemplo práctico de su utilidad se puede ver en el sector sanitario, donde las organizaciones confían en Dagster para procesar datos sanitarios confidenciales con el nivel de integridad necesario para cumplir estrictos estándares de cumplimiento y calidad.

Dagster permite a los desarrolladores definir flujos de trabajo complejos directamente en el código, una característica esencial para escalar las operaciones de IA. Su estructura modular admite el encadenamiento de modelos y agentes para crear flujos de trabajo avanzados, completos con gestión automatizada de dependencias, mecanismos de reintento y ejecución paralela. Además, Dagster se integra perfectamente con varias plataformas en la nube, API y bases de datos vectoriales, lo que lo hace ideal para manejar datos a gran escala y tareas de inteligencia artificial.

Esta arquitectura flexible garantiza una integración fluida con diversos sistemas.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen es un marco de código abierto desarrollado por Microsoft Research que permite que múltiples agentes de IA colaboren a través de conversaciones para abordar tareas complejas. Este sistema permite a los desarrolladores crear aplicaciones donde agentes especializados trabajan juntos, cada uno aportando su experiencia única para lograr objetivos compartidos. Al introducir una interfaz conversacional, AutoGen simplifica el proceso, a menudo complejo, de coordinar múltiples componentes de IA.

AutoGen introduce un nuevo enfoque para la orquestación de múltiples agentes al aprovechar el diálogo como medio de colaboración. Este marco es particularmente efectivo en escenarios de resolución de problemas que requieren que múltiples agentes trabajen juntos dinámicamente. Por ejemplo, en el desarrollo de software, un agente puede generar código mientras otro se concentra en las pruebas y la validación, y ambos agentes iteran para refinar el resultado. Este modelo conversacional es una opción natural para tareas como automatizar flujos de trabajo de software, ayudar en la investigación y manejar procesos complejos de toma de decisiones donde diversas perspectivas o habilidades mejoran los resultados.

Los equipos que buscan mejoras iterativas en sus flujos de trabajo encuentran AutoGen especialmente atractivo. Su capacidad para facilitar los intercambios entre agentes refleja la colaboración humana, lo que facilita a los desarrolladores diseñar sistemas que evolucionan y mejoran a través del diálogo y la retroalimentación continuos.

AutoGen enfatiza la modularidad al tiempo que se destaca por su diseño de agente conversacional. Cada agente opera con roles e instrucciones específicas, que pueden incluir acceso a herramientas, API externas o modelos de lenguaje. El marco admite agentes autónomos y agentes proxy de usuario que incorporan aportaciones humanas, ofreciendo flexibilidad en la gestión de flujos de trabajo.

El sistema puede ejecutarse localmente durante el desarrollo y escalar a entornos de nube para producción. Los desarrolladores pueden definir cómo interactúan los agentes, ya sea a través de flujos de trabajo secuenciales donde los agentes se turnan o patrones más complejos donde varios agentes contribuyen simultáneamente. Al utilizar configuraciones basadas en Python, los equipos obtienen control total sobre la lógica de orquestación sin sacrificar la legibilidad, lo que agiliza el proceso de gestión de interacciones entre múltiples agentes.

AutoGen maneja las complejidades de administrar múltiples llamadas de modelos y conversaciones de agentes, lo que permite a los desarrolladores concentrarse en diseñar la lógica y el comportamiento de sus sistemas en lugar de preocuparse por la infraestructura.

AutoGen se integra perfectamente con Azure OpenAI Service y otros modelos mediante llamadas a funciones, lo que brinda a los desarrolladores flexibilidad para seleccionar backends de IA. También admite la conexión de agentes a herramientas y servicios externos, lo que les permite recuperar datos, ejecutar código o interactuar con API de terceros durante sus conversaciones.

El marco permite a los desarrolladores crear tipos de agentes personalizados, patrones de conversación reutilizables y plantillas de orquestación. Esta flexibilidad significa que los equipos pueden aprovechar patrones preexistentes para tareas comunes y, al mismo tiempo, personalizarlos profundamente para necesidades especializadas.

Para las organizaciones que ya utilizan herramientas de Microsoft, AutoGen proporciona una fácil integración con los servicios de Azure, Visual Studio Code y otras plataformas de desarrollo. A pesar de esta alineación con el ecosistema de Microsoft, el marco es independiente de la plataforma y funciona bien en una variedad de entornos tecnológicos.

AutoGen pone un fuerte énfasis en controlar las capacidades de los agentes y gestionar el acceso a recursos externos. Los desarrolladores definen permisos específicos para cada agente, como a qué API pueden acceder o qué datos pueden recuperar. Este enfoque granular garantiza que los agentes operen según principios de privilegios mínimos y realicen solo las tareas necesarias para sus funciones.

La naturaleza conversacional del marco crea inherentemente pistas de auditoría, registra las interacciones de los agentes y los procesos de toma de decisiones. Estos registros brindan transparencia sobre cómo se generan los resultados, lo que ayuda a los esfuerzos de cumplimiento y depuración. Los equipos pueden revisar estos registros para analizar el comportamiento de los agentes e identificar áreas de mejora.

Las capacidades de intervención humana mejoran la supervisión al permitir que los flujos de trabajo se detengan para la revisión humana en puntos de decisión críticos. Esta característica garantiza que las acciones sensibles se puedan evaluar antes de continuar, equilibrando la eficiencia de la automatización con la gobernanza y el control.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

Las organizaciones pueden mejorar el rendimiento almacenando en caché el contexto de la conversación, utilizando modelos más rápidos para tareas rutinarias y reservando modelos más avanzados para razonamientos complejos. Diseñar patrones de conversación para minimizar los intercambios innecesarios también mejora la eficiencia. Cuando corresponde, el marco admite la ejecución paralela de agentes, lo que permite que tareas independientes se ejecuten simultáneamente en lugar de secuencialmente.

Para manejar cargas de trabajo elevadas, AutoGen se puede implementar en una infraestructura de nube de escalamiento automático, lo que garantiza que el sistema pueda gestionar las diferentes demandas manteniendo los costos bajo control. Las interacciones de agentes sin estado simplifican el escalamiento horizontal, aunque mantener el contexto entre los intercambios requiere una planificación de arquitectura cuidadosa.

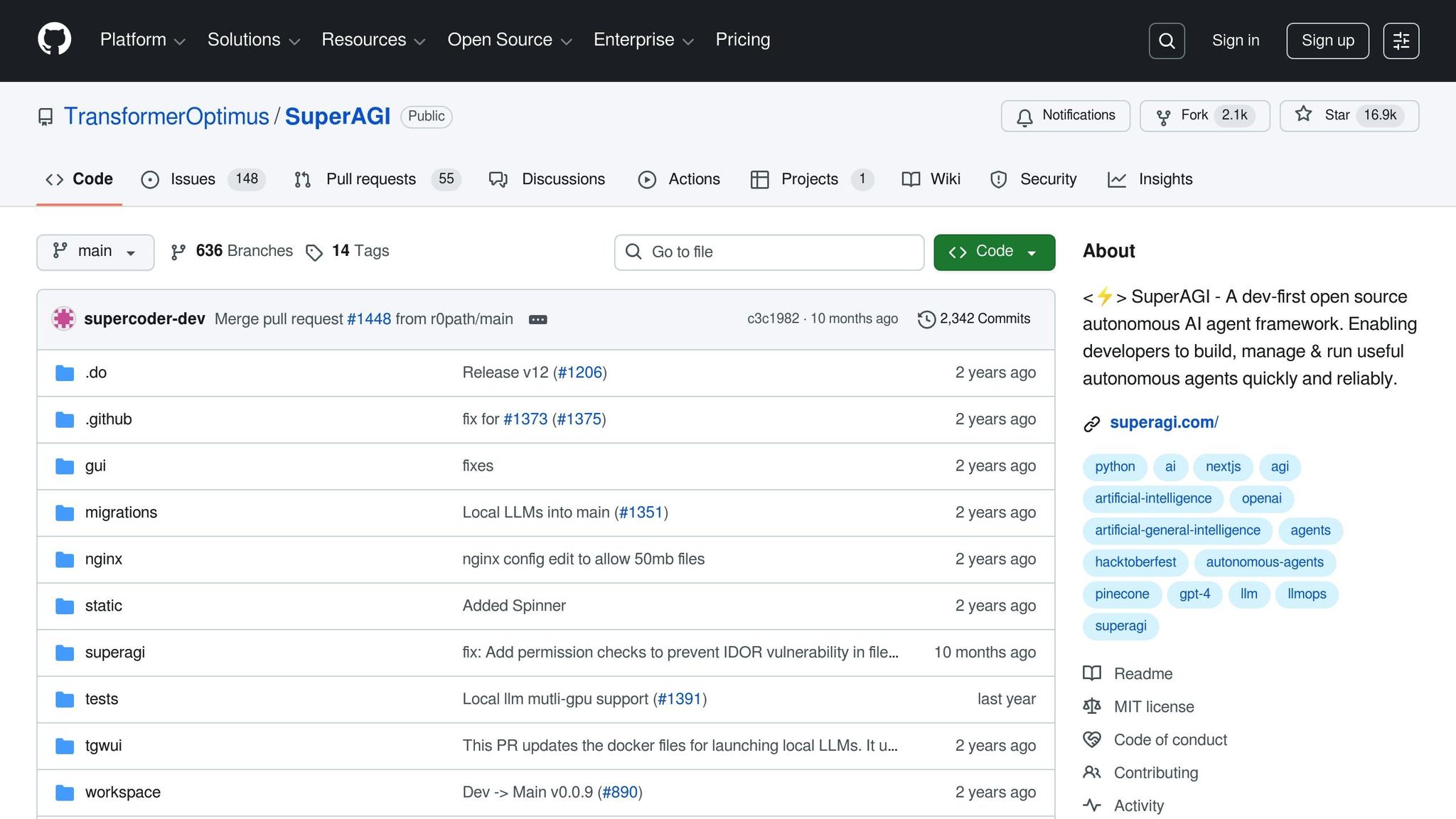

Sobre la base de los marcos de orquestación que hemos explorado, SuperAGI presenta una nueva forma de gestionar la colaboración entre múltiples agentes. Esta plataforma de código abierto está diseñada para coordinar agentes autónomos de IA, lo que permite a los desarrolladores crear, implementar y supervisar agentes que pueden planificar, ejecutar y adaptarse a tareas a través del aprendizaje continuo. SuperAGI permite que múltiples agentes trabajen juntos sin problemas, delegando tareas dinámicamente y colaborando para abordar desafíos complejos. Combina la gestión de tareas adaptativa con el trabajo en equipo de múltiples agentes, lo que la distingue como una poderosa herramienta para la orquestación avanzada de IA.

SuperAGI brilla en la automatización de tareas complejas y en evolución para las empresas. Sus redes de agentes destacan en la planificación y ejecución avanzada de tareas, y mejoran continuamente mediante el aprendizaje reforzado y los ciclos de retroalimentación. Esto lo hace particularmente útil para organizaciones que manejan operaciones a gran escala, donde la coordinación inteligente es clave. Los agentes dentro de la plataforma aprenden de sus interacciones y resultados, lo que les permite perfeccionar su comportamiento con el tiempo.

La característica destacada de la plataforma es su delegación dinámica de tareas. En lugar de ceñirse a flujos de trabajo rígidos, los agentes evalúan situaciones en tiempo real, identifican tareas prioritarias y las asignan a los miembros de la red más adecuados. Esta flexibilidad garantiza que los recursos se asignen de manera eficiente, incluso en escenarios complejos.

La arquitectura de SuperAGI está diseñada teniendo en cuenta la escalabilidad y la modularidad. Los desarrolladores pueden ampliar fácilmente las redes de agentes y las cargas de trabajo para satisfacer una variedad de necesidades de aplicaciones. Cada agente opera de forma independiente, pero se comunican sin problemas, lo que garantiza una colaboración fluida.

Una interfaz gráfica fácil de usar permite a los equipos visualizar las interacciones de los agentes y ajustar las configuraciones. Los paneles de monitoreo brindan información sobre el desempeño de los agentes, lo que ayuda a los desarrolladores a identificar y abordar las ineficiencias. La plataforma también admite la ejecución paralela, lo que permite que varios agentes manejen tareas independientes simultáneamente. Este diseño aumenta significativamente el rendimiento, especialmente en entornos de alta demanda.

SuperAGI presenta un sistema de complementos extensible que se integra con API de terceros, herramientas de flujo de trabajo y módulos personalizados. Esta flexibilidad acelera el desarrollo y fomenta las contribuciones de la comunidad de desarrolladores más amplia, enriqueciendo las capacidades de la plataforma.

La arquitectura modular distribuida de la plataforma admite el escalamiento horizontal, lo que la hace adaptable para implementaciones a gran escala. Su uso de aprendizaje por refuerzo y bucles de retroalimentación mejora el rendimiento general, asegurando que las tareas se asignen de manera eficiente. Al permitir una colaboración eficaz y un alto rendimiento, SuperAGI es ideal para organizaciones que exigen un rendimiento sólido en escenarios complejos y de gran volumen.

Elegir el marco de orquestación de IA adecuado significa comprender las fortalezas y limitaciones de cada opción. Estas plataformas están diseñadas con diferentes prioridades en mente, atendiendo necesidades como seguridad a nivel empresarial, adaptabilidad de los desarrolladores o flujos de trabajo especializados, como canales de aprendizaje automático. Cada marco refleja su filosofía de diseño única y sus casos de uso objetivo.

Por ejemplo, plataformas como Prompts.ai destacan por centralizar el acceso a grandes modelos de lenguaje (LLM), mientras que herramientas como Apache Airflow y Prefect se centran en la automatización general del flujo de trabajo. Por otro lado, Kubeflow y Flyte están diseñados para procesos de aprendizaje automático, y marcos como SuperAGI y Microsoft AutoGen amplían los límites de la colaboración de IA entre múltiples agentes al permitir que los sistemas autónomos manejen tareas complejas juntos.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Estructuras de costos: las plataformas tradicionales a menudo cobran por usuario o ejecución, lo que puede generar costos más altos a medida que crecen las operaciones. Por el contrario, Prompts.ai utiliza un modelo de pago por uso con créditos TOKN, vinculando los gastos directamente con el uso. Este enfoque es particularmente útil cuando se experimenta con diferentes modelos o se gestionan cargas de trabajo fluctuantes.

Seguridad y cumplimiento: para industrias como la atención médica o las finanzas, las medidas de seguridad sólidas son esenciales. Plataformas como Prompts.ai, IBM watsonx Orchestrate y Prefect proporcionan herramientas de cumplimiento integradas, como seguimientos de auditoría y controles de acceso basados en roles. Sin embargo, las opciones de código abierto como Apache Airflow requieren una configuración adicional para cumplir con estrictos estándares de cumplimiento.

Curva de aprendizaje: la usabilidad varía ampliamente. Plataformas como Prefect y Dagster son más amigables para los principiantes y ofrecen API de Python intuitivas y mensajes de error útiles. Mientras tanto, Apache Airflow y Kubeflow exigen experiencia técnica y habilidades de gestión de infraestructura más profundas. Prompts.ai simplifica esto aún más con una interfaz unificada que equilibra la facilidad de uso con funciones avanzadas para usuarios avanzados.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Ecosistema de integración: la integración perfecta con las herramientas existentes es fundamental. Apache Airflow lidera con cientos de complementos para servicios en la nube, bases de datos y herramientas de monitoreo. Prompts.ai, por otro lado, se centra específicamente en LLM y ofrece acceso optimizado a docenas de modelos a través de una única API.

Escalabilidad: plataformas como Kubeflow y Flyte están diseñadas para el escalamiento horizontal, aprovechando Kubernetes para la distribución de cargas de trabajo. Metaflow utiliza los servicios de AWS para un escalamiento elástico, mientras que Prefect admite opciones de escalamiento autohospedadas y administradas en la nube. SuperAGI emplea una arquitectura de agente distribuido, lo que permite la ejecución paralela, aunque esto requiere una coordinación cuidadosa.

El mejor marco para usted depende de sus flujos de trabajo específicos. Para la orquestación de LLM, Prompts.ai se destaca por su acceso centralizado al modelo y su rentabilidad. Los equipos de ingeniería de datos podrían inclinarse por la confiabilidad de Apache Airflow, mientras que los equipos de aprendizaje automático que trabajan en capacitación e implementación a gran escala podrían beneficiarse de Kubeflow o Flyte. Si su objetivo es construir sistemas de IA autónomos, SuperAGI o Microsoft AutoGen podrían ser la opción adecuada.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Por ejemplo, los equipos que priorizan la orquestación de LLM pueden encontrar Prompts.ai particularmente atractivo. Proporciona acceso centralizado a más de 35 modelos, como GPT-5, Claude y Gemini, todo a través de una interfaz unificada. El sistema de crédito TOKN de pago por uso elimina las tarifas de suscripción y ofrece seguimiento de costos en tiempo real. Con funciones como controles de acceso basados en roles y pistas de auditoría, Prompts.ai es una buena opción para industrias que requieren una gobernanza estricta sin comprometer la velocidad.

Los equipos de ingeniería de datos que trabajan con procesos ETL complejos pueden gravitar hacia Apache Airflow por su sólido ecosistema de complementos y su escalabilidad, aunque requiere experiencia más avanzada. Por otro lado, Prefect ofrece un enfoque nativo de Python con manejo de errores fácil de usar, lo que lo convierte en una excelente opción para una incorporación más rápida al equipo.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

Las organizaciones que exploran sistemas autónomos de IA podrían considerar Microsoft AutoGen por sus funciones de colaboración multiagente o SuperAGI para la delegación dinámica de tareas. Estas herramientas son ideales para casos de uso especializados o de investigación, pero a menudo requieren habilidades de codificación avanzadas, lo que las hace menos adecuadas para las necesidades de producción inmediatas.

En última instancia, seleccionar el marco adecuado implica evaluar factores como modularidad, extensibilidad, observabilidad y características de gobernanza, como controles de acceso basados en roles y certificaciones de cumplimiento. La flexibilidad de implementación y la integración con las herramientas existentes son igualmente importantes. Más allá de la funcionalidad, considere la experiencia del desarrollador, incluidos los SDK, la documentación y el costo total de propiedad. La complejidad de sus flujos de trabajo, ya sean tareas sencillas de un solo agente o complejos sistemas de múltiples agentes con memoria persistente, también debe guiar su decisión.

La industria tiende hacia sistemas de IA integrados y escalables, con marcos de código abierto que impulsan la mayoría de las cargas de trabajo empresariales, mientras que los tiempos de ejecución administrados por proveedores simplifican los desafíos operativos.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Al elegir un marco de orquestación de IA, es esencial considerar qué tan bien se integra con sus herramientas y sistemas actuales. Un marco con sólidas capacidades de integración garantiza que todo funcione en conjunto sin complicaciones innecesarias.

Preste atención a sus funciones de automatización, como la programación del flujo de trabajo y la gestión de tareas, ya que pueden simplificar las operaciones y ahorrar tiempo. Igualmente importantes son las medidas de seguridad y gobernanza, que salvaguardan los datos confidenciales y le ayudan a cumplir las normativas.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai simplifica el desafío de hacer malabarismos con múltiples herramientas de inteligencia artificial al reunir más de 35 grandes modelos de lenguaje dentro de una plataforma unificada. Con esta configuración, los usuarios pueden comparar modelos uno al lado del otro sin esfuerzo y, al mismo tiempo, mantener una supervisión completa de sus flujos de trabajo rápidos, la calidad de los resultados y el rendimiento general.

Para aumentar su eficiencia, Prompts.ai presenta una capa FinOps integrada diseñada para optimizar costos. Esta herramienta proporciona información en tiempo real sobre el uso, el gasto y el retorno de la inversión (ROI), lo que permite a las organizaciones gestionar sus recursos de forma eficaz y aprovechar al máximo sus presupuestos de IA.

Prompts.ai prioriza la seguridad y el cumplimiento de nivel empresarial, alineándose con estándares de la industria como SOC 2 Tipo II, HIPAA y GDPR para salvaguardar sus datos en cada etapa.

Para mantener el monitoreo y el cumplimiento continuos, Prompts.ai colabora con Vanta y comenzó su proceso de auditoría SOC 2 Tipo II el 19 de junio de 2025. Estos pasos garantizan que sus flujos de trabajo se mantengan seguros, conformes y confiables para las operaciones empresariales.