يمكن أن يؤدي اختيار أداة الذكاء الاصطناعي المناسبة لتقييم نماذج اللغات الكبيرة (LLMs) إلى توفير الوقت وتقليل التكاليف وتحسين عملية صنع القرار. مع العشرات من النماذج المتاحة - مثل جي بي تي -5، كلود، و لاما - تواجه المنظمات تحديات في مقارنة الأداء والدقة وكفاءة التكلفة. تتميز خمس منصات بتبسيط هذه العملية:

تتمتع كل منصة بنقاط قوة مصممة خصيصًا لتلبية الاحتياجات المختلفة، بدءًا من المقارنات الموفرة للتكاليف وحتى مراقبة الإنتاج. فيما يلي مقارنة سريعة لمساعدتك على اتخاذ القرار.

تساعد هذه الأدوات في تبسيط تقييم LLM، مما يضمن لك اختيار النموذج المناسب لأهدافك مع إدارة التكاليف والحفاظ على مخرجات عالية الجودة.

أدوات مقارنة مخرجات AI LLM: مخطط مقارنة الميزات

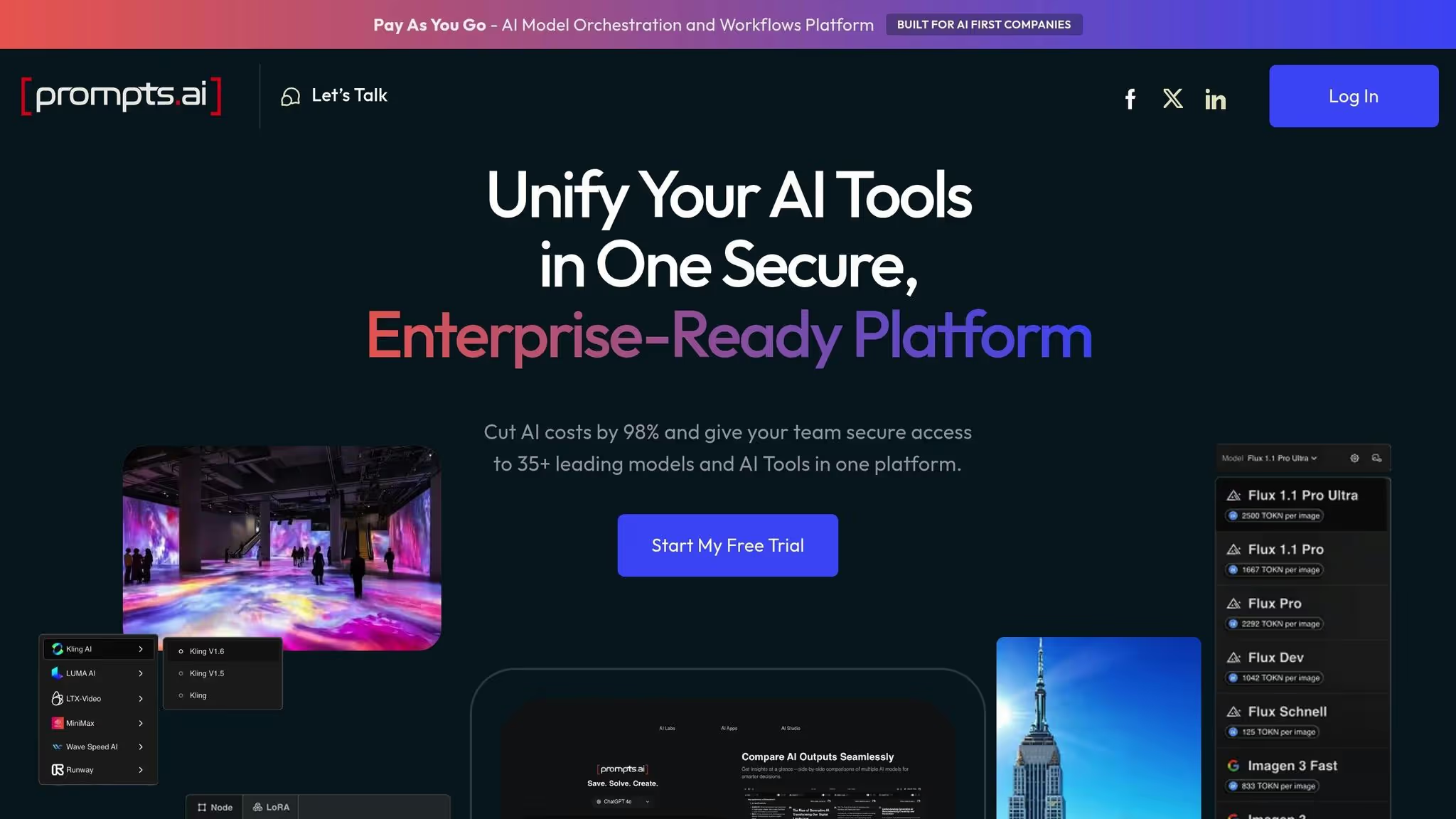

يجمع ملف Prompts.ai أكثر من 35 طرازًا من الدرجة الأولى، بما في ذلك GPT‑5 وكلود ولاما و الجوزاء، في منصة واحدة مبسطة. يسمح هذا الإعداد للفرق بمقارنة كيفية استجابة نماذج اللغات الكبيرة المختلفة (LLMs) لنفس المطالبة في الوقت الفعلي. سواء كنت تركز على التوثيق الفني أو صياغة المحتوى الإبداعي أو الضبط الدقيق للسرعة والدقة، فإن Prompts.ai يساعدك على تحديد أفضل نموذج للمهمة. تضع واجهته الموحدة الأساس لأدوات مقارنة المخرجات القوية، والتي يتم شرحها بالتفصيل أدناه.

تتمثل إحدى الميزات البارزة لـ Prompts.ai في قدرتها على اختبار نماذج متعددة في وقت واحد داخل واجهة واحدة. من خلال تشغيل مطالبات متطابقة عبر LLMs المختلفة، يمكن للمستخدمين بسهولة مقارنة الردود جنبًا إلى جنب، مع إبراز الاختلافات في التفكير والنبرة والدقة. هذا يزيل متاعب التبديل بين الأدوات أو دمج البيانات يدويًا في جداول البيانات. شارك المهندس المعماري June Chow أن استخدام Prompts.ai للمقارنات جنبًا إلى جنب قد أدى إلى تسريع سير عمل التصميم بشكل كبير وإطلاق الحلول الإبداعية. بالإضافة إلى ذلك، تقدم المنصة ميزة التحليلات - متوفر في خطط Creator (29 دولارًا في الشهر) و Problem Solver (99 دولارًا في الشهر) - والتي تتعقب اتجاهات الأداء بمرور الوقت.

الأمان هو التركيز الرئيسي في Prompts.ai. بدأت المنصة عملية تدقيق SOC 2 من النوع 2 في 19 يونيو 2025، وتلتزم بالممارسات المتوافقة مع معايير SOC 2 من النوع الثاني وHIPAA وGDPR. الشراكة مع فانتا لمراقبة التحكم المستمر، يضمن Prompts.ai قابلية التدقيق الكاملة لجميع تفاعلات الذكاء الاصطناعي. وهذا يعني تسجيل كل مطالبة واستجابة واختيار نموذج، وإنشاء سجل شامل للمراجعات الداخلية أو عمليات التدقيق الخارجية. من أجل الشفافية، يمكن للمستخدمين التحقق من حالة الأمان في الوقت الفعلي للمنصة على https://trust.prompts.ai/، والتي توفر تحديثات حول السياسات والضوابط وتقدم الامتثال.

تعمل Prompts.ai على نظام TOKN للدفع أولاً بأول، مما يسمح للمستخدمين بتجنب الرسوم المتكررة للنماذج الفردية. هذا الهيكل المرن مفيد بشكل خاص للمؤسسات الأمريكية التي تدير الميزانيات القائمة على الدولار، خاصة خلال المرحلة التجريبية للعمل مع العديد من LLMs. من خلال الوصول المركزي وتقليل الحاجة إلى اشتراكات منفصلة، يمكن للمنصة خفض تكاليف البرامج بنسبة تصل إلى 98٪. تعمل مساحة العمل المشتركة أيضًا على تبسيط تعاون الفريق، مما يتيح الوصول السلس إلى التجارب والنتائج وأدوات الحوكمة.

LangSmith، التي تم تقديمها في يوليو 2023، هي أداة تتبع مدمجة في LangChain. منذ إطلاقه، اكتسب زخمًا مع أكثر من 100,000 من أفراد المجتمع. بالنسبة لمستخدمي LangChain، فإنه يبسط العملية عن طريق تحميل آثار LLM تلقائيًا إلى الخدمة السحابية دون الحاجة إلى إعداد إضافي. هذا التكامل السلس يجعل جمع الآثار وتحليلها أكثر كفاءة.

يوفر LangSmith طريقتين مباشرتين لتقييم مخرجات LLM: المراجعة اليدوية من قبل الفرق أو التقييم الآلي باستخدام LLMs. تتضمن المنصة أيضًا أدوات لتحليل التكلفة وتحليلات الاستخدام، على الرغم من أن هذه الميزات تقتصر حاليًا على أوبن إيه آي التكامل.

تعمل LangSmith كمنصة SaaS قائمة على السحابة، وتقدم فئة مجانية تتضمن ما يصل إلى 5,000 أثر شهريًا. بالنسبة للمؤسسات الكبيرة، يتوفر خيار المؤسسة المستضافة ذاتيًا. علاوة على ذلك، تقدم LangSmith دعمها للوكلاء خارج نظام LangChain البيئي، مما يعزز مرونتها وسهولة استخدامها.

Langfuse عبارة عن منصة مفتوحة المصدر مرخصة بموجب Apache 2.0، وتوفر للفرق تحكمًا كاملاً في البنية التحتية لتقييم LLM الخاصة بهم. تم تصميمه للعمل بشكل مستقل عن نماذج أو أطر محددة، وهو يضمن التوافق عبر مختلف LLMs وأدوات التطوير. تتيح هذه المرونة مقارنة المخرجات وتقييمها بشكل شامل، مما يكمل القدرات التحليلية للمنصات المماثلة.

يتيح Langfuse التقييم البشري والمدفوع بالذكاء الاصطناعي لمخرجات النموذج. يضمن هذا النهج المزدوج للفرق أن تقيس بدقة جودة المحتوى الذي تم إنشاؤه بواسطة LLMs.

تتضمن المنصة لوحات معلومات مقاييس الأداء التي تساعد المطورين على قياس مخرجات LLM وتصحيحها. توفر لوحات المعلومات هذه رؤى قابلة للتنفيذ لتحسين أداء النموذج وتحسينه.

يتكامل Langfuse بسلاسة مع الأدوات الرئيسية في النظام البيئي لتطوير LLM. إنه يدعم افتح القياس عن بُعدو LangChain و OpenAI SDK و مؤشر لاما. بينما تظل ميزاتها الأساسية مجانية ومفتوحة المصدر، تقدم المنصة أيضًا خدمة سحابية بنموذج تسعير قائم على الاستخدام.

TruLens هي أداة مفتوحة المصدر، مرخصة بموجب ترخيص MIT، مصممة لمساعدة الفرق على إجراء التحليل النوعي لاستجابات LLM داخل بيئات التطوير القائمة على Python. مرونتها تجعلها موردًا قيمًا للمطورين الذين يهدفون إلى تقييم جودة مخرجات نموذج اللغة بشكل فعال.

يتيح TruLens التحليل النوعي من خلال تقديم الملاحظات بعد كل مكالمة LLM. تقوم هذه العملية بفحص المخرجات الأولية في الوقت الفعلي، مما يسمح للفرق بتقييم الجودة على الفور وتحسين نماذجها حسب الحاجة.

تستخدم المنصة نماذج التغذية الراجعة المستقلة لتقييم استجابات LLM الأولية. تطبق هذه النماذج معايير متعددة لضمان مراجعة الجودة الشاملة. يتماشى هذا النهج المنظم أيضًا بشكل جيد مع احتياجات النشر، مما يوفر رؤى يمكن أن توجه القرارات التشغيلية.

تم تصميم Trulens لعمليات نشر Python المحلية ولا تتضمن خيار سحابة الخدمة الذاتية. بالنسبة للاحتياجات المستندة إلى السحابة، يجب على الفرق تنسيق حلول النشر المخصصة لدمج Trulens في عمليات سير العمل الخاصة بهم.

إن قابلية الملاحظة في الإنتاج لا تقل أهمية عن مقارنة المخرجات المباشرة عند تقييم أنظمة الذكاء الاصطناعي. تركز Phoenix by Arize، وهي منصة مفتوحة المصدر مرخصة بموجب ELv2، على توفير أدوات المراقبة والمراقبة بالذكاء الاصطناعي لبيئات الإنتاج. تعمل على نموذج فريميوم، وهي تزود الفرق برؤى تفصيلية حول أداء أنظمة LLM الخاصة بهم عبر سيناريوهات وعمليات نشر مختلفة.

تغوص Phoenix بعمق في أداء LLM من خلال تقسيم الاستجابات وتحديد المجالات التي قد تعاني فيها النماذج. وهذا يشمل تحديات مثل الاختلافات في اللهجات والحالات اللغوية النادرة. كما أنها تستخدم تحليل التضمين لمقارنة التشابه الدلالي، مما يتيح التتبع الدقيق للأداء عبر المخرجات.

تتجاوز المنصة المراقبة على مستوى السطح من خلال تحديد مشكلات مثل تدهور الأداء، وانحراف البيانات، وتحيزات النموذج، والهلوسة - حيث يولد النموذج مخرجات ملفقة - في الوقت الفعلي. ومع ذلك، فإن تركيزها الأساسي ينصب على إمكانية الملاحظة بدلاً من التقييم، مما يوفر دعمًا محدودًا لمجموعات بيانات التقييم الشاملة.

تتكامل فينيكس بسلاسة مع الأطر الشائعة مثل LLAmaIndex و LangChain dSpy، كومة قش، و أوتوجين. كما أنه يدعم مجموعة من مزودي LLM، بما في ذلك OpenAI، بيدروك، الميسترال ريح شمالية، فيرتيكس إيه آي، و لايت إل إم. تضمن أجهزتها القائمة على OpenTelemetry الاندماج السلس في تدفقات عمل المراقبة الحالية.

فيما يلي تفصيل لنقاط القوة والمقايضات لكل منصة:

prompts.ai يجمع أكثر من 35 نموذجًا رائدًا تحت واجهة واحدة، مما يجعله خيارًا متميزًا للمؤسسات التي تتعامل مع تدفقات العمل متعددة النماذج. تتحكم عناصر تحكم FinOps المدمجة بدقة في تتبع استخدام الرمز المميز، مما يوفر وفورات كبيرة في التكاليف. ومع ذلك، قد تجد الفرق التي تركز حصريًا على الجيل المعزز بالاسترجاع أنها بحاجة إلى أدوات متخصصة إضافية لتلبية احتياجاتها.

لانج سميث هو منافس قوي لفرق التطوير، وذلك بفضل ميزات التتبع وتصحيح الأخطاء القوية. ومع ذلك، فإنه يتطلب مستوى أعلى من الخبرة الفنية، مما قد يشكل تحديًا للمستخدمين الأقل خبرة.

بالنسبة لأولئك الذين يبحثون عن المرونة، لانغفيوز يوفر خيارات نشر مفتوحة المصدر، مما يجعله قابلاً للتكيف بدرجة كبيرة. ومع ذلك، قد تحتاج الفرق إلى الاعتماد على الأدوات التكميلية لتحقيق تقييم شامل لمجموعات البيانات.

عدسة TruLens تتفوق في تقديم ملاحظات مفصلة وقابلة للتفسير حول مخرجات LLM من خلال مقاييس التقييم القوية. يعد تصميمه الذي يركز على الكود مثاليًا لعلماء البيانات، على الرغم من أنه يتطلب المزيد من المعرفة التقنية مقارنة بالمنصات ذات الواجهات المرئية الأكثر.

عندما يتعلق الأمر ببيئات الإنتاج، فينيكس من أريز تتميز بقدرات المراقبة في الوقت الفعلي. يكتشف مشكلات مثل تدهور الأداء وانحراف البيانات والهلوسة عند حدوثها. ومع ذلك، فإن تركيزها على إمكانية الملاحظة يعني أن دعمها لمجموعات بيانات التقييم أقل شمولاً.

يعتمد اختيار الأداة المناسبة في النهاية على أولوياتك. إذا كانت أهدافك هي تحسين التكلفة والوصول الموحد إلى نماذج متعددة، فإن المنصات المزودة بعناصر تحكم FinOps المتكاملة مثالية. بالنسبة للفرق التي تركز على تصحيح الأخطاء والتطوير، فإن الأدوات ذات ميزات التتبع المتقدمة مناسبة بشكل أفضل. وفي الوقت نفسه، تعد منصات المراقبة في الوقت الفعلي لا تقدر بثمن بالنسبة لسيناريوهات الإنتاج التي تتطلب إمكانية المراقبة واكتشاف الانجراف.

عند اختيار منصة الذكاء الاصطناعي، من الضروري العثور على منصة تتوافق مع أهداف مؤسستك والإعداد الفني. الصيغة «جودة المقاييس × جودة مجموعة البيانات» بمثابة حجر الزاوية لتقييم LLM الفعال. حدد أولويات المنصات التي تعمل بشكل جيد في كلا المجالين لضمان تحقيق أقصى استفادة من استثمارك.

بمجرد تحديد معايير التقييم الخاصة بك، ركز على التكامل. اختر نظامًا أساسيًا يعمل بسلاسة مع أدواتك الحالية، مثل OpenTelemetry، حزمة أدوات Vercel AIأو LangChain أو فهرس LLAM. هذا يقلل من وقت الإعداد ويقلل من جهود الصيانة المستمرة. بالنسبة للفرق التي تتعامل مع أطر الذكاء الاصطناعي المتعددة، يعد اعتماد استراتيجية موحدة للملاحظة أمرًا ضروريًا لتجنب الثغرات أو التناقضات في المراقبة.

يجب أن يعكس اختيارك أيضًا احتياجات النشر الخاصة بك. غالبًا ما تستفيد الشركات الناشئة من التسجيل السريع وبيئات الاختبار المرنة، بينما تتطلب الشركات الكبيرة عادةً التتبع الشامل والحوكمة. في إعدادات الإنتاج، تصبح المراقبة في الوقت الفعلي مع إمكانات التتبع وتصحيح الأخطاء المتقدمة أمرًا لا غنى عنه.

كما هو موضح في اللمحات العامة للمنصة، يمكن تحقيق التوازن بين الرؤية والتكلفة من خلال تخصيص المراقبة لبيئات محددة واستخدام أخذ عينات النطاق الذكي للعمليات عالية القيمة. بالإضافة إلى ذلك، يمكن أن يساعد دمج عناصر تحكم FinOps في عمليات سير العمل متعددة النماذج في إبقاء النفقات تحت السيطرة.

عند اختيار منصة الذكاء الاصطناعي لتقييم المخرجات من نماذج اللغات الكبيرة (LLMs)، هناك بعض الجوانب المهمة التي يجب وضعها في الاعتبار. ابدأ بـ شفافية التكلفة - ستحتاج إلى منصة توفر أسعارًا واضحة ومقدمة دون أي رسوم غير متوقعة. بعد ذلك، راجع مجموعة من النماذج المدعومة للتأكد من توافقها مع LLMs التي تعتمد عليها. أخيرًا، ابحث عن المنصات التي تقدم تكامل سلس مع عمليات سير العمل الحالية، والتي يمكن أن توفر لك الوقت والجهد.

سيساعدك التركيز على هذه العناصر على اختيار منصة تبسط عملية التقييم وتوفر نتائج دقيقة وقابلة للتنفيذ.

يركز Prompts.ai بشدة على أمان البيانات و الامتثال التنظيمي، مما يضمن منصة جديرة بالثقة لمستخدميها. من خلال استخدام بروتوكولات التشفير المتقدمة، نحمي المعلومات الحساسة ونتوافق مع معايير الصناعة المعمول بها لحماية البيانات.

كما أننا نلبي جميع المتطلبات القانونية والتنظيمية المعمول بها، مما يضمن إدارة بياناتك بمسؤولية وبشفافية كاملة. يتيح هذا التفاني في الأمان للمستخدمين التركيز على تحليل مخرجات LLM الخاصة بهم دون القلق بشأن سلامة بياناتهم.

يعمل نظام TOKN الخاص بـ Prompts.ai على تبسيط تقييم مخرجات نموذج اللغة الكبيرة (LLM)، مما يوفر الوقت والجهد. من خلال التشغيل الآلي للخطوات الحاسمة في المقارنة والتحليل، فإنها تقلل من الحاجة إلى العمل اليدوي، مما يساعد الشركات على خفض النفقات التشغيلية.

يعمل النظام أيضًا على تحسين الدقة والكفاءة، مما يقلل من مخاطر الأخطاء التي قد تؤدي إلى تصحيحات باهظة الثمن أو سوء فهم. يوفر هذا النهج حلاً مبسطًا وصديقًا للميزانية للمهنيين والمنظمات التي تعتمد على LLMs.