AI 编排是扩展企业 AI 运营的关键。由于 95% 的人工智能试点因协调不力而失败,企业需要工具来统一、自动化和管理复杂的人工智能工作流程。 2025 年的前景将引入集成多个模型、安全工作流程和优化成本的平台,为采用者提供高达 60% 的投资回报率。

Here’s a quick breakdown of the top solutions:

每个平台在可扩展性、互操作性、治理和成本管理方面都具有独特的优势。无论您需要开源灵活性还是企业级合规性,这些工具都可以将分散的人工智能系统转变为统一、可扩展的生态系统。

选择合适的平台来扩展您的人工智能计划、改善协调并最大限度地提高投资回报率。

人工智能编排平台比较:可扩展性、互操作性、治理和可扩展性成本

Prompts.ai 是一个尖端的企业平台,旨在简化和简化人工智能操作。它将超过 35 种顶级大型语言模型(包括 GPT-5、Claude、LLaMA、Gemini、Grok-4、Flux Pro 和 Kling)汇集到一个安全、统一的界面中。通过集中访问这些模型,该平台消除了管理多个工具的混乱,帮助组织轻松扩展其人工智能工作。

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

作为一个集中式中心,Prompts.ai 确保所有人工智能驱动的流程都依赖于授权的、版本控制的提示模板,而不是分散的、硬编码的字符串。其架构支持轻松的模型选择和并排性能比较,使团队能够为每项任务识别和部署最有效的大型语言模型 (LLM)。所有这一切都是无需重写代码或调整管道即可实现的,节省了时间和精力。

Prompts.ai 通过强大的基于角色的访问控制 (RBAC) 优先考虑安全性和控制。这允许组织为谁可以在生产环境中创建、修改或部署提示定义精确的权限。每次交互都会通过审核跟踪和版本跟踪进行仔细记录,从而提供完全的透明度。该治理框架可帮助企业满足合规标准,同时保持对人工智能运营的可见性和控制。通过将严格的安全措施与运营效率相结合,该平台可以帮助组织安全有效地管理人工智能。

该平台包括一个 FinOps 层,用于跟踪代币使用情况,直接将人工智能支出与业务成果联系起来。许多组织报告称,通过巩固供应商关系和削减不必要的订阅,成本削减了高达 98%。通过实时使用情况和性能指标,团队可以持续监控和优化支出,避免月底出现意外支出。这种程度的财务透明度将人工智能从预算不确定性转变为具有明确回报的可衡量投资。

LangChain 作为一个强大的人工智能应用框架脱颖而出,每月下载量高达 9000 万次,GitHub 星数超过 10 万。其模块化设计将功能拆分为轻量级包,例如用于基础抽象的 langchain-core 和用于第三方集成的 langchain-community。这种方法可确保简化人工智能工作流程,而不会产生不必要的开销,使其成为管理复杂性和规模的首选。

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith 遵守严格的合规标准,包括 HIPAA、SOC 2 Type 2 和 GDPR。它提供详细的执行跟踪,为调试和合规性审查创建全面的审计跟踪。 LangGraph 通过人机交互功能增强了这一点,包括用于实时检查、回滚和校正的“时间旅行”功能。

__XLATE_10__

SWE 负责人 Garrett Spong 强调:“LangGraph 为我们如何构建和扩展 AI 工作负载奠定了基础 - 从对话代理、复杂任务自动化到‘正常工作’的由法学硕士支持的定制体验”。

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) 凭借令人印象深刻的业绩记录脱颖而出:2.58 亿次 PyPI 下载量、33,100 名 GitHub 明星以及由 3,000 多名贡献者组成的蓬勃发展的社区。 KFP 设计为在 Kubernetes 上本地运行,将管道的每个步骤作为单独的 Pod 执行,使其能够根据需要在集群中动态扩展计算资源。其架构依赖于有向无环图(DAG)结构,除非定义了特定的数据依赖关系,否则可以并行执行容器化任务[18, 19]。此设置是其有效处理复杂工作流程的能力的关键。

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP 通过其 IR YAML 格式确保灵活性和可移植性,该格式允许管道在不同的 KFP 后端之间无缝运行,从开源设置到 Google Cloud Vertex AI Pipelines 等托管服务。这意味着您可以在本地进行开发并在云中大规模部署,而无需重写代码。该平台还集成了 Spark、Ray 和 Dask 等流行工具来进行数据准备,以及 KServe 来进行可扩展的模型推理。借助其 Python SDK,数据科学家可以使用熟悉的编码实践定义复杂的工作流程,而后端会自动将这些工作流程转换为 Kubernetes 操作。

安全和治理是 KFP 不可或缺的一部分。它使用 Kubernetes 的内置功能,例如基于角色的访问控制 (RBAC)、用于隔离的命名空间和网络策略,以确保安全的工作流执行。该平台集中跟踪元数据和工件,为每个管道运行创建详细的审计跟踪 [8, 22]。通过在隔离的容器中运行每个管道步骤,KFP 保持流程隔离和安全的数据处理。管理员能够为单个任务设置资源限制,确保团队之间公平的资源分配并防止过度使用。对于敏感数据或工作负载,可以使用节点选择器将任务限制到特定的安全硬件。

虽然 KFP 本身是开源且免费使用的,但与底层 Kubernetes 基础设施相关的成本(无论是在 AWS EKS、Google GKE 还是本地)仍然适用。托管版本(例如 Google Cloud Vertex AI Pipelines)采用即用即付定价模式 [19, 20]。 KFP 还包括针对暂时性故障的重试机制等功能,这有助于避免重新启动长时间运行的管道的费用,以及退出处理程序,确保即使早期步骤失败也能执行清理任务。这些功能有助于更有效地利用资源和控制成本。

Argo Workflows 是一款专为 Kubernetes 设计的流行工作流执行引擎,有超过 200 个组织在生产环境中依赖它。作为容器本机解决方案,它通过在隔离的 Pod 中运行每个工作流程步骤来编排并行作业。该架构支持根据 Kubernetes 集群的可用容量进行动态扩展,对于需要灵活资源管理的 AI 任务特别有效。

Argo Workflows 支持通过垂直优化和分片进行扩展。通过增加 --workflow-workers 参数,您可以分配更多 CPU 核心以加快工作流程协调速度。对于较大的操作,可以通过为每个命名空间部署单独的安装或使用实例 ID 在同一集群中运行多个控制器实例来实现分片。为了保护 Kubernetes API 服务器,Argo 采用客户端速率限制(默认:每秒 20 个查询,突发 30 个)并将 foreach 步骤的并发上限限制为 100 个任务。这种可扩展的方法即使在繁重的工作负载下也能确保与外部系统的顺利集成。

作为 Kubernetes 自定义资源定义 (CRD),Argo 可与任何 Kubernetes 集群无缝集成,并为 Kubeflow Pipelines、Netflix Metaflow、Seldon 和 Kedro 等著名 AI 平台提供支持。开发人员可以使用 Python (Hera)、Java 和 Go 的官方 SDK 定义工作流程,从而提供语言选择的灵活性。在工件管理方面,Argo支持各种存储解决方案,包括AWS S3、Google Cloud Storage、Azure Blob Storage、Artifactory和阿里云OSS。这种兼容性可确保跨不同环境的数据流畅流动。此外,工作流程可以通过外部信号(例如网络钩子)或使用 Argo Events 的存储更改来触发。根据 Metaflow 文档,Argo Workflows 是唯一支持通过 Argo Events 触发事件的生产编排器。这种灵活性和功能的结合使其成为工作流程自动化的可靠选择。

Argo Workflows 利用 Kubernetes 原生功能来确保强大的安全性。基于角色的访问控制 (RBAC) 管理工作流控制器、用户和各个 Pod 的权限。为了增强隔离,可以使用“命名空间安装”模式将控制器限制为单个命名空间。在生产环境中,Argo 通过 OAuth2 和 OIDC 支持单点登录 (SSO),同时通过 TLS 加密保护传输中的数据。管理员可以强制执行工作流程限制,允许用户仅提交预先批准的模板,Pod 安全上下文有助于防止 Pod 以 root 身份运行。网络策略调节 Argo 服务器和工作流控制器的流量,默认递归深度限制为 100 次调用,可防止无限循环。

Argo Workflows 是一款根据 Apache License 2.0 提供的开源工具,可以免费使用。为了管理成本,它采用 TTL 策略和 Pod 垃圾收集 (PodGC),自动删除已完成的工作流程并清理未使用的 Pod,减少资源浪费。可以使用节点选择器和亲和性规则在经济高效的基础设施(例如现货实例)上安排任务。此外,还可以跟踪每个步骤的资源使用情况,帮助用户监控支出。如果您注意到控制器日志中的“客户端限制”,则增加 --qps 和 --burst 值可以提高与 Kubernetes API 的通信效率。这种深思熟虑的设计有助于平衡性能与成本效益。

Apache Airflow 已成为管理 AI 工作流程的关键参与者,为编排复杂操作提供灵活的、基于代码的框架。它在机器学习操作 (MLOps) 中尤其突出,有 23% 的用户使用它,而在生成人工智能项目中,有 9% 的社区使用它。 Airflow 在 Apache License 2.0 下发布,允许开发人员在 Python 中定义工作流程,与任何机器学习库无缝集成。

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor 对于处理不可预测的资源密集型工作负载特别有用。动态任务映射等功能允许任务根据实时数据进行扩展,使其非常适合大型数据集和多模型工作流程。同时,Deferable Operators 通过管理长时间等待状态(例如监控模型训练)来提高效率,而无需占用工人槽位。这种方法显着提高了吞吐量和资源利用率。

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

TaskFlow API 使用 Python 装饰器将脚本转换为 Airflow 任务,从而通过 XComs 自动管理数据传输,从而简化了工作流程创建。团队可以将任务路由到适当的环境,例如用于 GPU 密集型训练的 Kubernetes Pod 或用于数据预处理的 Spark 集群。此外,REST API 和 airflowctl CLI 可与 CI/CD 管道安全集成,确保流畅且可审核的工作流程管理。

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

对于数据治理,Airflow 与 OpenLineage(一种跟踪数据沿袭的标准)集成,有助于满足 GDPR 和 HIPAA 等合规性要求。 airflowctl CLI 专门与 REST API 交互,避免直接访问元数据数据库以提高安全性。团队还可以使用设置和拆卸任务来管理可重现的环境,将基础设施视为代码以实现更好的监督和一致性。

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure 机器学习为企业 AI 需求提供了强大的解决方案,具有先进的 GPU、InfiniBand 网络、99.9% 的正常运行时间以及 100 多项合规性认证。它由 34,000 名工程师和 15,000 名安全专家组成的团队提供支持,可确保大规模的可靠性和安全性。

该平台旨在通过支持跨数据、模型和管道的分布式计算来处理任何规模的工作负载,从而最大限度地提高资源效率。托管在线端点可通过自动扩展实现无缝模型部署,以适应需求高峰。例如,Marks & Spencer 利用 Azure ML 处理超过 3000 万客户的数据,同时利用管道缓存和注册表来减少培训时间和成本。同样,在 BRF,自动化 ML 和 MLOps 消除了 15 名分析师的手动任务,使他们能够专注于更高价值的工作。

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

“如果没有 Azure AI 提示流,我们将被迫投资相当大的定制工程来提供解决方案。相反,我们能够通过轻松地将现有微服务集成到提示流解决方案中来实现极高的速度。”

Azure ML 还支持保护隐私的分布式训练,Swift 的 Johan Bryssinck 演示了这一点,他使用该平台在本地边缘设备上训练模型,而不是集中数据,从而确保可扩展性和数据隐私。其统一的 API 合约以及与 Azure 逻辑应用和 Azure Functions 的集成,进一步增强了与外部工具的连接性。

Azure 机器学习通过用于基于角色的访问控制 (RBAC) 的 Microsoft Entra ID 和虚拟网络等功能来优先考虑安全性,以隔离资源并限制 API 访问。数据在传输过程中通过 TLS 1.2/1.3 加密和静态时双重加密来保护,并提供客户管理密钥选项以增强控制。实时防御(例如 Prompt Shields)可防止越狱和提示注入攻击,而 Customer Lockbox 则需要 Microsoft 的管理批准才能访问客户数据。其他工具可跟踪资产版本、数据沿袭和配额,Microsoft Defender for Cloud 提供运行时威胁防护。

Azure 机器学习采用即用即付定价模式,仅对 CPU 和专用 GPU 等计算资源收费。 Blob 存储、Key Vault、容器注册表和 Application Insights 等支持服务也根据使用情况计费。团队可以选择适合特定任务的硬件,而管道缓存等功能可以减少冗余计算。基础设施即代码可确保一致的部署和高效的资源管理。

Google Vertex AI Pipelines 通过自动化机器学习 (ML) 工作流程,消除了管理基础设施的麻烦。它将任务组织成容器化组件的有向无环图(DAG),使团队能够专注于模型开发而不是服务器管理。

Vertex AI Pipelines 使用无服务器方法来处理工作负载,将密集处理任务委托给 BigQuery、Dataflow 和 Cloud Serverless for Apache Spark 等工具。对于分布式 Python 和 ML 计算,它与 Vertex AI 上的 Ray 无缝集成。

该平台支持配备 NVIDIA H100/H200 GPU 的 A3 和 A3 Mega 系列节点。 A3 Mega 节点配备 8 个 H100 GPU,可提供令人印象深刻的 1,600 Gbps 跨节点带宽。例如,Vectra 使用 Gemini 和 Vertex AI 分析了每月 300,000 个客户呼叫,实现了 500% 的分析速度提升。

成本效率内置于执行缓存中,它重用输出以最大限度地减少开支。 Vertex ML 元数据通过大规模跟踪工件、参数和指标的沿袭来确保可重复性。这种可扩展的设计可以轻松地与各种工具集成,使其成为机器学习工作流程的多功能解决方案。

Google Cloud Pipeline Components (GCPC) SDK 通过提供将 Vertex AI 服务(例如 AutoML、自定义训练作业和模型部署)直接连接到管道的预构建组件来简化集成。

管道管理非常灵活,可以使用 Cloud Composer(托管 Apache Airflow)和 Cloud Data Fusion 触发器等选项来编排跨服务的工作流程。与 BigQuery、Cloud Storage 和 Dataproc 的本机连接简化了数据处理,而元数据可以与 Dataplex 通用目录同步,以进行跨项目沿袭跟踪。此外,模型花园还提供 200 多个模型,包括 Google 的 Gemini、Anthropic 的 Claude 和 Meta 的 Llama。

管道定义被编译为标准化的 YAML 格式,确保跨存储库(如 ArtifactRegistry)的可移植性。

Vertex AI Pipelines 在设计时考虑了治理和安全性。服务帐户确保每个组件仅使用必要的权限进行操作。 VPC 服务控制建立安全边界,防止敏感数据(例如训练数据集、模型和批量预测结果)离开网络边界。

对于具有严格合规性需求的组织,除了 Google Cloud 的默认静态加密之外,该平台还支持客户管理的加密密钥 (CMEK)。 Vertex ML 元数据通过自动记录每次管道运行的参数、工件和指标来提供详细的审计跟踪。

Model Armor 等安全功能可防止快速注入和数据泄露。管道可以配置为在对等 VPC 网络中运行,并且云日志记录允许团队监控管道事件是否存在任何安全异常。

Vertex AI Pipelines 采用即用即付模式运行,通过 Cloud Billing 导出到 BigQuery,自动应用计费标签以进行成本跟踪。执行缓存通过重用输出进一步降低成本。

为了降低中断容忍训练作业的费用,Spot VM 可以降低价格。对于长期基础设施承诺,承诺使用折扣 (CUD) 可以节省成本并保证容量。动态工作负载调度程序 (DWS) 以较低的标价提供灵活工作负载的容量,而专用训练集群则确保为大规模作业预留加速器容量。

IBM watsonx Orchestrate 充当中央枢纽,通过充当专用工具和基础模型的监控器、路由器和规划器来协调 AI 代理。该平台支持各种编排方法:用于探索性任务的 React、用于结构化工作流程的 Plan-Act 以及用于可预测业务流程的确定性编排。

watsonx Orchestrate 专为大规模运营而设计,使用多代理编排将请求有效地实时路由到适当的工具和大型语言模型 (LLM)。组织可以选择将 watsonx Orchestrate 作为托管服务部署在 IBM Cloud 或 AWS 上,或者在本地安装以与现有基础设施保持一致。

该平台已经取得了可衡量的成果。例如,IBM 通过 watsonx Orchestrate 立即解决了 1000 万个年度 HR 请求中的 94%,使 HR 团队能够专注于更高价值的任务。同样,邓& Bradstreet 通过人工智能驱动的供应商风险评估将采购时间缩短了 20%,为客户节省了 10% 以上的评估时间。

为了支持快速部署,该平台包括一个无代码代理生成器和一个代理开发套件 (ADK),用于创建基于 Python 的自定义工具。此外,包含 100 多个特定领域的 AI 代理和 400 多个预构建工具的目录提供可扩展的组件,以满足不同的运营需求。

这种可扩展性确保了与现有系统的顺利集成,使其能够适应广泛的企业环境。

该平台的 AI 网关有助于各种基础模型之间的无缝路由,包括 IBM Granite、OpenAI、Anthropic、Google Gemini、Mistral 和 Llama,帮助组织避免供应商锁定。代理开发套件支持使用用于远程 Web 服务的 OpenAPI 规范和用于扩展功能的 Python 创建自定义工具。

与 Langflow 的集成添加了用于设计 AI 应用程序的可视化拖放界面,然后可以将其导入到 Orchestrate 环境中。此外,watsonx Orchestrate 可以轻松地与 Salesforce、SAP、Workday 和 Microsoft 365 等企业系统连接,无需进行大量基础设施更改。

借助 AgentOps,该平台可以监控 AI 代理活动并执行实时策略,以确保可靠性和合规性。内置护栏和集中监督有助于保持对内部法规的遵守。

__XLATE_52__

“通过 AgentOps,每个操作都会受到监控和管理,从而可以实时标记和纠正异常情况。” - IBM 新闻中心

IBM Guardium 集成通过识别未经授权的 AI 部署并暴露漏洞或错误配置来增强安全性。该平台还实施基于角色的访问控制 (RBAC),其中包括四个主要角色 - 管理员、构建者、用户和产品专家 - 以保护环境设置。使用 watsonx.governance 的公司报告称,其 AI 计划的投资回报率提高了 30%。

该平台提供灵活的定价,以满足不同组织的需求:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 2026年1月31日.

UiPath AI Center 将企业工作流程中的 AI 代理、RPA 机器人和人类工作人员聚集在一起,创建了一个可扩展的生态系统,旨在满足 2025 年的需求。该平台的核心利用 UiPath Maestro 作为其智能控制中心,管理复杂业务运营中的长期运行流程。

UiPath AI Center 提供两种部署选项来满足不同的业务需求:提供即时弹性扩展的 Automation Cloud 和专为本地部署量身定制的 Automation Suite。其 MLOps 系统具有用户友好的拖放界面来部署和监控模型,使它们能够在无限数量的机器人上无缝扩展。例如,SunExpress Airlines 报告称,在将积压订单减少两个月的同时,节省了超过 20 万美元。该平台还通过持续的人机循环再训练确保模型保持准确,使其成为跨不同系统集成人工智能的强大工具。

该平台采用“自带模型”(BYOM)策略,可以与LangChain、Anthropic和Microsoft等第三方框架集成。此外,与 Google Cloud 合作开发的 Agent2Agent (A2A) 协议可促进跨企业平台的 AI 代理之间的顺畅通信。

__XLATE_59__

LangChain 首席执行官 Harrison Chase 表示:“我们与 UiPath 在代理协议上的合作确保 LangGraph 代理可以无缝参与 UiPath 自动化,扩大其覆盖范围,并使开发人员能够构建更具凝聚力的跨平台工作流程。”

UiPath AI Center通过标准化API连接到数百个SaaS应用程序,支持BPMN 2.0进行流程建模,并使用决策模型和符号(DMN)来管理业务规则。一个著名的例子是澳大利亚最大的互惠银行 Heritage Bank,它利用 AI Center 实现贷款审查流程自动化,改善客户体验,同时减少手动后端任务。

UiPath AI Center 优先考虑治理和安全性,提供项目和租户级访问控制以保持可追溯性和合规性。其受控代理功能确保人工智能代理无法自主执行未经授权或不安全的操作。

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath AI Center 采用基于消费的许可模型,该模型使用 AI 单元来计量模型训练、托管和预测等活动。它们通过平台单元无缝集成到更广泛的 UiPath 许可系统中,涵盖编排和执行需求。为了帮助组织探索其功能,Automation Cloud 和 Automation Suite 版本均可提供 60 天免费试用,从而更轻松地评估其价值,同时控制成本。

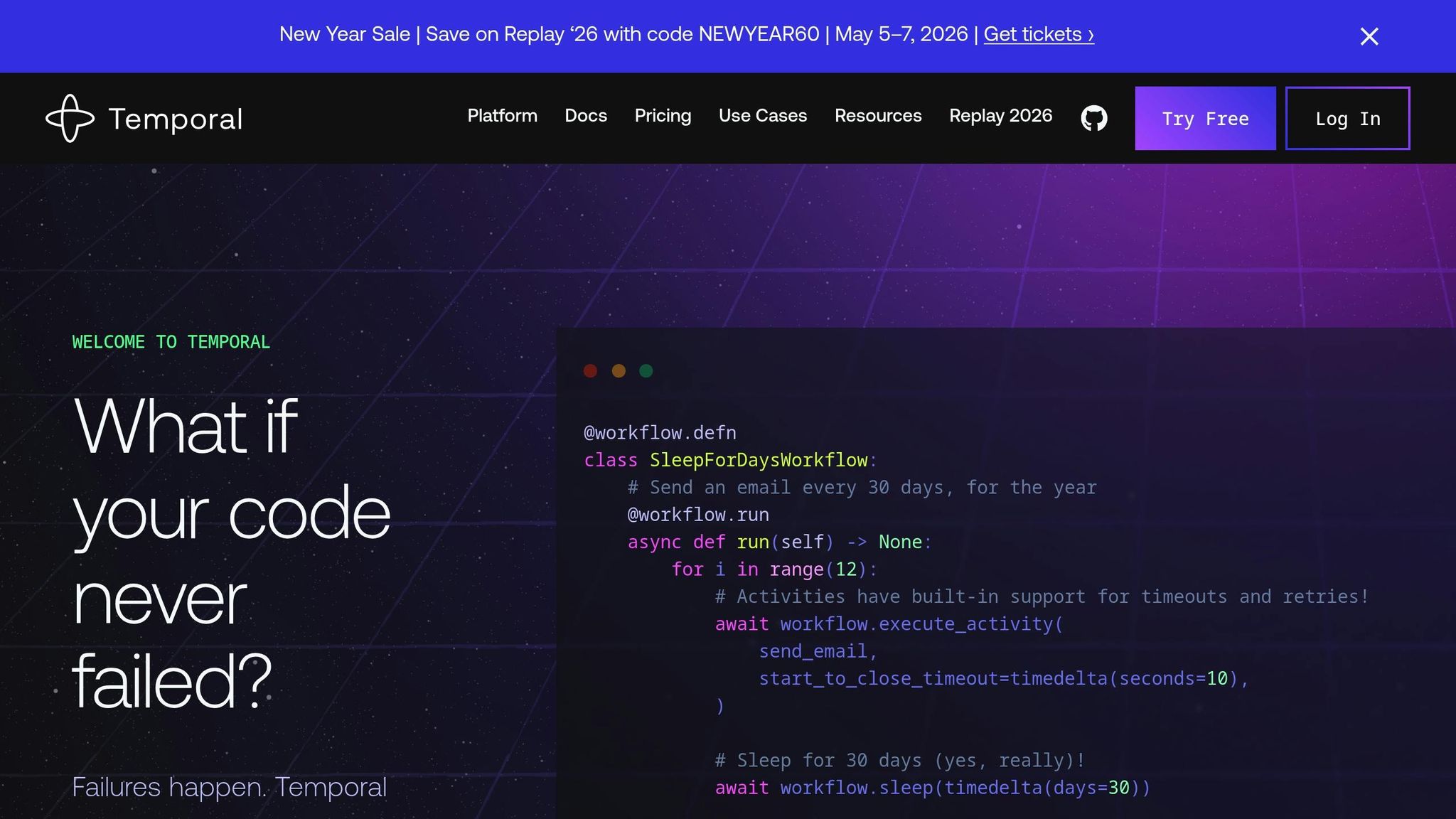

Temporal 采用独特的方法,使用持久、可恢复的代码,而不是依赖配置文件。它捕获不可变事件历史记录中的每个工作流程步骤,确保流程可以在中断后准确地从中断处继续。 Replit 就是一个很好的例子,它将其编码代理控制平面转换为 Temporal,显着提高了可靠性和用户体验。

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist,Retool 产品经理

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

这种可扩展性确保与各种工具和系统的无缝集成。

开发人员可以使用 Python、Go、Java、TypeScript、.NET 和 PHP 等流行语言将工作流编写为代码。 Temporal 还可以轻松地与领先的 AI 框架集成,包括 OpenAI Agents SDK、Pydantic AI、LangGraph 和 Crew AI。它对模型上下文协议 (MCP) 的支持增强了代理的可靠性。通过与 Langfuse 等人工智能专用监控工具的连接,可观察性得到提高。例如,Gorgias 利用这种灵活性帮助超过 15,000 个电子商务品牌管理人工智能驱动的客户服务代理。

Temporal 的事件历史记录为 AI 工作流程中的每个状态变化提供完整、不可更改的审计跟踪。此功能支持人机交互治理,使工作流程能够在执行自主决策之前暂停以进行外部验证。这种保护措施在生产环境中特别有用,可以防止 LLM 幻觉等问题。在时态云部署中,提供商无法访问应用程序代码,而开源 MIT 许可的服务器选项允许组织在自己的安全基础设施内托管平台。 Netflix 工程师强调了这种设计如何最大限度地减少维护并简化故障处理。

Temporal Cloud 采用即用即付模式运行,而开源 Temporal Server 可以免费自行托管。新用户可以使用 1,000 美元的 Temporal Cloud 免费积分来探索该平台。通过在不消耗计算资源的情况下暂停工作流程,用户可以显着降低基础设施和运营成本。 Temporal 的设计不仅提高了效率和可靠性,而且随着人工智能业务的增长,成本也得到了控制。

选择理想的人工智能编排平台需要平衡灵活性和易用性。 Apache Airflow 和 LangChain 等开源选项提供供应商独立性和深度定制,但需要先进的技术技能和手动配置来实现安全和治理。另一方面,IBM watsonx Orchestrate 和 UiPath 等企业平台包含基于角色的访问控制 (RBAC)、审计跟踪和 HIPAA 合规性等内置功能,尽管它们会产生许可费用并降低灵活性。

不同平台的可扩展性策略差异很大。 Kubeflow 和 Argo Workflows 等 Kubernetes 原生工具在容器化可移植性方面表现出色,而 Apache Airflow 基于有向无环图 (DAG) 的调度对于管理混合和多云设置中的复杂依赖关系非常有效。 Temporal 以其高吞吐量而闻名,而 Azure 机器学习和 Google Vertex AI Pipelines 利用其父云生态系统在高峰需求期间动态分配资源。这些变化凸显了组织在评估解决方案时必须考虑的权衡。

互操作性是确保统一工作流程的另一个关键因素。 LangChain 使开发人员能够连接多个大型语言模型 (LLM) 和 API,而无需彻底修改现有系统,而 Kubeflow 在单个管道中支持 PyTorch、TensorFlow 和 JAX 等框架。 Prompts.ai 等平台旨在通过统一多个模型来减少碎片,而 Azure 机器学习和 IBM watsonx Orchestrate 等供应商特定平台提供无缝本机集成,但可能需要额外的连接器以实现更广泛的兼容性。

运营权衡在部署决策和投资回报 (ROI) 中也发挥着关键作用。治理和成本管理是平台之间存在显着差异的领域。 IBM watsonx Orchestrate 和 UiPath 等企业级解决方案提供集中式仪表板和强大的安全功能,使其适合医疗保健和金融等受监管行业。相比之下,开源工具通常需要手动设置才能实现类似的监督。从成本角度来看,虽然 Apache Airflow、LangChain 和 Kubeflow 可以免费部署,但它们可能会产生与工程时间和专业知识相关的隐性费用。 Temporal Cloud 提供即用即付定价,提供 1,000 美元的免费积分,而 Prompts.ai 通过其统一的 TOKN 积分系统消除了经常性费用,显着降低了 AI 软件成本(高达 98%)。

下表提供了每个平台在关键运营维度上的详细比较:

选择最佳的人工智能编排平台取决于您组织的技术能力、合规性需求和增长计划。 Apache Airflow 和 LangChain 等开源选项提供了无与伦比的灵活性,且无需支付许可费用,使其成为重视模块化设置的科技初创公司和快速发展的公司中开发人员驱动的团队的首选。然而,这些框架需要先进的工程技能来配置安全性、治理和可扩展性等关键功能。另一方面,IBM watsonx Orchestrate 等企业平台迎合医疗保健和金融等行业,这些行业的内置合规性措施(例如基于角色的访问控制、审计跟踪以及 HIPAA 和 SOC 2 等认证)是不可协商的。这些平台通常通过简化工作流程并将治理功能与改进的业务成果联系起来来展示切实的回报。

对于大型企业来说,治理密集型平台至关重要,但中型企业通常需要平衡成本和性能的解决方案。 Prompts.ai 通过将 35 多个模型集成到一个界面中,提供实时 FinOps 控制和即用即付 TOKN 积分来简化这一方程式,以最大限度地减少工具碎片和意外费用。与此同时,当可移植性和混合云部署成为关键时,Kubeflow Pipelines 和 Argo Workflows 等 Kubernetes 原生工具就会大放异彩,特别是对于跨分布式系统管理复杂机器学习管道的数据科学团队而言。

如前所述,代理人工智能(自主代理在多步骤推理上进行协作)的出现凸显了无缝编排日益增长的重要性。引用多莫的话:

__XLATE_78__

“人工智能的成功不再在于拥有最多的模型,而是在于有效地编排它们”。

对于美国组织来说,选择与其当前技术成熟度相匹配的平台至关重要,同时随着人工智能在各部门之间的集成度越来越高,提供扩展空间。明智的起点是一个专注于特定工作流程的试点项目,跟踪输入、输出和错误,以便为未来的扩展建立可观察性基线。正确的编排平台不仅仅是连接人工智能工具,它还重新定义了团队协作、解决问题和更大规模创造价值的方式。

AI 编排平台通过将各种 AI 模型、数据源和流程整合到一个自动化系统中,简化了复杂的工作流程。他们管理调度、资源分配和 API 集成等任务,最大限度地减少手动工作量,同时显着减少开发时间和运营费用。

这些平台的构建可以轻松扩展,使企业能够从处理少量任务扩展到管理数千个任务,而无需彻底检修其基础设施。他们擅长处理大量数据、提高资源使用效率并保持一致的监督。这将带来更快的部署、更高的生产力以及更好地满足企业动态需求的人工智能解决方案。

人工智能编排平台通常通过基于使用的定价模型来处理费用,让企业只需为他们使用的内容付费,而不是承诺固定许可证。其中许多平台都配备了实时财务工具,包括按模型或工作流程监控支出的仪表板、预算警报系统以及用于详细成本分析的工作负载标记。这些工具可确保企业清楚地了解与人工智能相关的支出并保持对其预算的控制。

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai 正在制定 2025 年安全 AI 编排标准,为企业提供可靠的平台来轻松扩展其 AI 运营。其统一仪表板旨在简化管理,具有内置治理工具、实时成本跟踪和不可变的审计跟踪。这些功能可确保企业保持合规性,同时保持对其人工智能工作流程的全面监督。

Prompts.ai 配备了基于角色的访问控制、端到端加密和持续合规性监控等企业级安全措施,可在操作的每个阶段保护敏感数据。通过将超过 35 个领先的法学硕士集成到一个安全框架中,它降低了风险,并使企业能够自信、高效地扩展其人工智能能力。