AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

深入研究,找到适合您的团队和工作流程的框架。

Prompts.ai 是一个基于云的集中式平台,将企业用户连接到超过 35 个领先的 AI 模型,包括 GPT-5、Claude、LLaMA、Gemini、Grok-4、Flux Pro 和 Kling - 所有这些都可以通过单个界面进行访问。无需安装软件,任何规模的团队都可以轻松地将人工智能融入到他们的工作流程中。

该平台解决了人工智能采用中的一个重大挑战:工具蔓延。通过提供统一的环境,它将模型选择、提示工作流程和性能跟踪整合到一个系统中。这种方法将人工智能的使用从分散的、一次性的实验转变为一致的、可扩展的流程,组织可以轻松地跨部门部署。

Prompts.ai 专注于企业人工智能工作流程自动化,帮助组织削减不必要的成本,同时解决治理问题。从财富 500 强公司到创意机构和研究实验室,用户可以创建合规、可审核的工作流程,而无需冒敏感数据暴露给多个第三方服务的风险。

该平台被 GenAI.Works 评为企业问题解决和自动化的顶级人工智能解决方案,用户评分高达 4.8 分(满分 5 分)。公司依靠 Prompts.ai 来完成简化内容创建、自动化战略工作流程和加快提案开发等任务。在某些情况下,过去需要数周时间的项目已减少到只需一天的时间。

一个著名的例子来自 2025 年 5 月,当时自由人工智能总监 Johannes Vorillon 使用该平台将 Google DeepMind Veo2 动画无缝集成到百年灵和法国空军的宣传视频中。该项目重点介绍了 Prompts.ai 如何实现多个 AI 工具的顺利编排。

Prompts.ai 通过单一界面集成对 35 多种语言和图像模型的访问,简化了团队使用 AI 的工作方式。这消除了管理多个订阅、API 密钥和计费系统的麻烦。用户可以在单个工作流程中针对特定任务组合不同的模型,从而创建无缝的编排管道。

该平台在 TOKN 信用系统上运行,该系统标准化了所有模型的使用,使成本跟踪和资源分配变得简单。团队可以根据性能要求根据需要在模型之间切换。业务计划包括无限的工作空间和协作者,使组织更容易扩展人工智能的采用。

Prompts.ai 采用即用即付的定价模式,使成本与实际使用情况保持一致,初始探索的起价为每月 0 美元。商业计划的价格范围为每位会员每月 99 美元到 129 美元,提供不同级别的 TOKN 积分(250,000 到 1,000,000)以及所有级别的 10GB 云存储。

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 2025年6月19日, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

业务计划(Core、Pro 和 Elite)包括合规性监控和治理管理工具,提供对 AI 交互的全面可见性并维护详细的审计跟踪以满足监管要求。即使使用 Personal Creator 和 Family 计划的较小团队和个人专业人士也可以从这些企业级治理功能中受益。

敏感数据保存在集中、受控的环境中,降低了跨多个第三方服务传播信息所带来的风险。这种安全架构不仅可以最大程度地减少潜在漏洞,还可以简化在严格法规下运营的组织的合规性管理。

Prompts.ai 采用云原生架构设计,使组织能够轻松扩展。团队可以在几分钟内添加新成员、扩展工作空间并访问其他模型,确保人工智能的采用能够根据需要快速增长。

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI 提供由对话界面支持的工作流程自动化解决方案。虽然有关其部署架构和编排方法的具体细节尚未公开,但其对对话界面的强调凸显了简化工作流程自动化的独特角度。

IBM watsonx Orchestrate 将 AI 驱动的自动化引入企业运营,专注于让业务专业人员(而不仅仅是开发人员)能够使用自动化。通过使用户能够发出自然语言命令,该平台简化了人力资源、财务、销售、客户支持和采购等非技术团队的复杂任务。这种方法消除了对编码专业知识的需求,使业务团队能够独立地实现流程自动化。

该平台擅长自动执行经常占用员工时间的重复性任务。通过简单的语言命令,用户可以启动任务工作流程,例如安排面试、总结候选人资料、处理贷款和生成报告。 watsonx Orchestrate 跨多个后端系统处理这些活动,同时遵守企业级安全标准。

例如,一家大型金融机构实施了 watsonx Orchestrate 来简化客户支持和后台功能。员工使用自然语言输入来自动化贷款处理和服务请求的工作流程。该平台与后端系统无缝集成,通过内置治理保持合规性,并提供了显着的改进:更快的处理时间、更少的手动错误和更高的客户满意度。此示例强调了该平台将日常企业任务转变为高效、自动化流程的能力。

IBM watsonx Orchestrate 提供混合云部署选项,允许工作流在云端、本地或两者之间运行。这种灵活性对于具有严格数据驻留策略或遗留基础设施的组织尤其有价值。该平台利用大型语言模型 (LLM)、API 和企业应用程序来安全地执行任务,确保与各种操作环境的兼容性。

watsonx Orchestrate 与不同的系统无缝集成,使其成为企业自动化的强大解决方案。它使用可视连接器和 API 连接到 CRM、ERP 以及 AWS 和 Azure 等云平台。此外,它还与 IBM Watson 服务和其他 IBM AI 模型密切合作,将其功能扩展到基本工作流程自动化之外。对于高级用户,编程式 API 访问允许进一步定制并与现有工具集成。

__XLATE_18__

“IBM watsonx Orchestrate 旨在将人工智能驱动的自动化直接引入业务工作流程。与以开发人员为中心的工具不同,watsonx Orchestrate 的目标客户是人力资源、财务、销售和客户支持领域的专业人士,他们希望在无需繁重编码的情况下简化任务。” - 多莫

该平台还包括预构建的人工智能应用程序和行业特定的技能集,可以更快地实施常见用例。然而,组织应该注意,与具有更广泛集成选项的平台相比,其功能在 IBM 生态系统之外可能会受到更多限制。

IBM watsonx Orchestrate 因其强大的治理框架而脱颖而出,使其成为受监管行业的首选。基于角色的访问控制确保数据访问仅限于授权用户和特定功能。

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

watsonx Orchestrate 旨在跨混合环境进行扩展,支持小型团队和大型企业。它提高了运营效率,确保政策合规性,降低风险并提高员工生产力。组织可以从小规模开始(专注于特定部门),并在看到结果并发展内部专业知识时逐步扩大自动化能力。

Apache Airflow 是一个开源平台,旨在使用有向无环图 (DAG) 协调复杂的数据工作流程。它最初由 Airbnb 开发,现在隶属于 Apache 软件基金会,已成为调度、监控和管理数据管道的流行选择。与为业务用户量身定制的自动化工具不同,Airflow 在设计时考虑了数据工程师和开发人员的需求,提供对工作流程执行的编程控制。

Airflow 在管理涉及复杂依赖关系、计划任务和转换逻辑的数据管道方面表现出色。数据团队依靠它来实现多种目的,包括协调 ETL(提取、转换、加载)流程、训练机器学习模型、运行批处理作业、从多个源获取数据、转换数据集以及按计划生成报告。通过在 Python 中定义工作流程,开发人员可以获得广泛的灵活性来实现自定义逻辑并有效地处理错误。

该平台包括一个可视化界面,可提供对工作流状态、任务依赖性和执行历史记录的洞察。这使得监控性能和排除故障变得更加容易。例如,如果任务失败,Airflow 可以自动重试、发送警报或跳过后续任务以防止级联问题。此功能使其成为满足不同部署需求的多功能选择。

Airflow 可以部署为单服务器设置,也可以扩展到分布式集群,其中调度程序、工作线程和 Web 服务器在不同的计算机上运行。该架构由几个关键组件组成:根据定义的计划触发任务的调度程序、执行任务的工作人员、用户界面的 Web 服务器以及存储工作流定义和执行历史记录的元数据数据库。

这种模块化设计允许组织根据工作负载需求独立扩展员工容量。在云原生环境中,Kubernetes 通常用于部署 Airflow,其中 KubernetesExecutor 为各个任务创建隔离的 Pod。此设置增强了资源隔离,并使团队可以为每个任务分配特定的计算资源。对于那些希望减少基础设施管理开销的人来说,可以使用托管 Airflow 服务,尽管这些服务会带来额外的运营成本。

Airflow 广泛的集成功能使其具有高度适应性。它为数据库、云平台、数据仓库和消息传递系统提供预构建的连接器,并能够使用 Python 创建自定义运算符。这种灵活性确保 Airflow 能够满足不同的组织需求。

Python 丰富的库生态系统也可以在工作流程中利用,直接在管道定义中实现高级数据转换和分析。对于 AI 和机器学习应用程序,Airflow 与 TensorFlow、PyTorch 和 scikit-learn 等框架无缝集成。这些集成可帮助数据科学家编排任务工作流程,例如获取数据、预处理特征、训练模型、评估性能以及将模型部署到生产中。

Airflow 包括基于角色的访问控制 (RBAC),用于跨工作流和管理功能管理用户权限。管理员可以定义具有特定权限的角色,确保只有授权用户才能查看、编辑或执行某些 DAG。这种精细控制有助于维护工作流程的完整性并防止未经授权的更改。

身份验证选项包括基于密码的登录、LDAP 集成和 OAuth 提供程序。敏感凭证通过 Airflow 的连接和变量系统单独管理。为了增强安全性,可以集成 HashiCorp Vault 或 AWS Secrets Manager 等外部秘密管理工具。

审计日志记录是另一个关键功能,跟踪用户操作和工作流程执行。这会创建详细的活动记录,这对于合规性和故障排除目的非常宝贵。

Airflow 通过添加更多工作节点来水平扩展以处理增加的工作负载。该平台支持多种执行器类型来有效地分发任务:LocalExecutor 在与调度程序相同的机器上运行任务,CeleryExecutor 使用消息队列将任务分布在多个工作机器上,而 KubernetesExecutor 为每个任务启动独立的 Pod。

为了优化性能,仔细的 DAG 设计和资源分配至关重要。高任务量可能会给调度程序带来压力,因此团队经常拆分大型 DAG、调整调度程序设置,并确保元数据存储有足够的资源。

Airflow 还可以有效地处理回填,允许团队在工作流逻辑发生变化时重新处理历史数据。虽然回填简化了更新,但它可能会消耗大量计算资源,需要仔细规划以避免生产工作负载中断。

作为开源软件,Airflow 使组织能够完全控制其部署。然而,这也意味着他们必须管理基础设施、监控和升级,这需要专门的工程资源来维持大规模的可靠性和性能。

Kubeflow 作为管理机器学习工作流程的专用平台脱颖而出,与更通用的工作流程工具不同。该开源解决方案专为 Kubernetes 设计,支持整个机器学习生命周期,为数据科学家和机器学习工程师提供使用 Kubernetes 原生功能构建、部署和管理生产就绪模型所需的工具。

Kubeflow 专为在 Kubernetes 环境中编排完整的机器学习工作流程而定制。它涵盖了机器学习生命周期的每个阶段,包括数据预处理、特征工程、模型训练、验证、部署和监控。通过使团队能够创建模块化和可重用的管道,Kubeflow 简化了分布式机器学习工作负载的管理。其集中式方法还有助于跨多个项目进行实验跟踪和模型监督。此外,Kubeflow 可以在引入新数据时自动执行重新训练工作流程,确保模型保持更新和相关性。

Kubeflow 基于 Kubernetes 构建,利用容器编排、动态扩展和资源管理来优化 ML 工作流程。用户可以通过基于Web的界面进行可视化管理或通过命令行界面进行自动化与平台交互。根据工作负载,Kubeflow 动态分配资源,例如为训练任务配置 GPU,为推理配置 CPU。其灵活性允许部署在任何 Kubernetes 集群上,无论是在本地、云端还是混合设置中,从而确保跨环境的适应性。

Kubeflow 与 TensorFlow、PyTorch 和 XGBoost 等流行的机器学习框架无缝集成,同时还通过其可扩展设计支持自定义框架。除了机器学习框架之外,它还与各种云服务和存储解决方案连接,使管道能够访问数据的对象存储、用于特征检索的数据仓库以及用于跟踪性能的监控工具。它与 Python 库的兼容性进一步简化了从实验到生产的过渡。

Kubeflow 利用 Kubernetes 固有的扩展功能在集群资源之间分配工作负载,使其非常适合大规模训练和数据处理任务。这确保了资源的高效利用并支持高性能的机器学习操作。正如阿卡恰当地指出的:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

凭借独立分配资源的能力,Kubeflow 弥合了实验和生产之间的差距,提供灵活性和性能。

Flyte 是一个云原生编排平台,旨在简化使用 Kubernetes 的容器化机器学习 (ML) 工作流程的管理。它通过跨云环境有效地分配资源,降低了部署 ML 管道的复杂性。无论部署规模如何,这种方法都可以确保平滑扩展和一致的性能。

Flyte 旨在处理任何规模的 ML 工作流程,动态分配资源以满足不同的需求。其强大的架构可确保有效管理工作负载,使其成为跨基于云的基础设施的各种机器学习任务的可靠选择。

Prefect 是一个基于 Python 的编排平台,旨在简化复杂数据管道和机器学习工作流程的管理。它专注于易用性、清晰的监控和最大程度地减少操作障碍,使数据科学家和工程师能够专注于创建工作流程,而不是担心基础设施。

Prefect 在自动化机器学习管道、云工作流程和数据转换过程方面表现出色。它特别适合处理 ETL 任务和涉及多个依赖项、并行执行和实时处理的复杂机器学习工作流程。其灵活的调度系统可以根据时间间隔、特定事件或API调用触发任务,从而适应各种自动化需求。

Prefect 针对云环境进行了优化,确保其能够扩展并适应现代基础设施需求。它以 Python 原生构建,与基于 Python 的数据生态系统无缝集成,无需学习新的编程语言或工具。

Prefect 提供与各种数据工具和平台的无缝兼容性。它可以轻松地与 dbt、PostgreSQL、Snowflake 和 Looker 等流行工具集成,同时还支持 Apache Kafka 等实时系统。对于云环境,它与 Amazon Web Services (AWS)、Google Cloud Platform (GCP) 和 Microsoft Azure 等主要提供商合作,使团队能够根据成本和性能灵活地优化工作负载。此外,Prefect 支持 Docker 和 Kubernetes 等容器化工具,并可与 Dask 和 Apache Spark 等分布式处理框架配合使用。为了让团队随时了解情况,它还提供工作流程更新的 Slack 通知。

Prefect 旨在轻松处理不断增长的数据量和不断增加的工作流程复杂性。其容错引擎确保工作流程可以通过重试失败的任务或绕过问题来从错误中恢复,从而使其在生产环境中高度可靠。实时监控提供对工作流程执行的详细洞察,帮助团队快速识别和解决问题。凭借其高效扩展的能力,Prefect 受到大型科技公司的信赖,可以管理动态工作流程。对于刚刚起步的团队,Prefect 提供免费计划,而针对需要额外功能和支持的大型部署则可提供自定义定价。

Metaflow 是一个机器学习基础设施平台,最初由 Netflix 开发,旨在应对扩展机器学习工作流程的挑战。它专注于使流程变得用户友好且高效,帮助数据科学家从原型顺利过渡到生产,而无需处理复杂的基础设施。

Metaflow 旨在管理可扩展的生产级机器学习工作流程。它简化了从探索性数据分析和模型训练到部署的过程。数据科学家可以使用熟悉的库在 Python 中编写工作流程,而该平台则负责版本控制、依赖项管理和自动分配计算资源。

该平台通过自动配置所需的计算资源,消除了手动基础设施管理的需要。这允许从本地开发到云生产的无缝转变,而不需要任何代码修改。

__XLATE_53__

“Metaflow 通过提供简化的云集成、强大的版本控制和用于生产就绪部署的基础设施抽象,轻松协调可扩展的 ML 工作流程。” - Akka.io

Metaflow 的部署过程得到了与云服务和数据平台轻松集成的能力的补充。其 Python 原生设计确保与广泛使用的机器学习、数据处理和可视化库兼容,使团队能够最大限度地利用他们已经依赖的工具。

Metaflow 最初由 Netflix 创建,旨在支持广泛的机器学习操作,具有强大的版本控制系统。该系统跟踪实验、数据集和模型版本,确保实验可重复,并在需要时轻松回滚。

Dagster 专注于维护数据完整性,同时提供适应性强的管道管理,从而丰富了编排框架的阵容。这款开源工具旨在提高质量、跟踪数据沿袭并确保机器学习 (ML) 工作流程中的可见性。 Dagster 的核心是专门构建类型安全、可靠的数据管道,以维护高标准的数据完整性并为转换提供清晰的见解。

Dagster 对于管理 ML 工作流程特别有效,因为数据质量和精度是不容妥协的。它专为需要内置验证、强大的元数据跟踪和整个流程的全面可观察性的团队量身定制。其实用性的一个实际例子可以在医疗保健领域看到,该领域的组织依靠 Dagster 来处理敏感的医疗保健数据,其完整性级别需要满足严格的合规性和质量基准。

Dagster 使开发人员能够直接在代码中定义复杂的工作流程,这是扩展 AI 操作的基本功能。其模块化结构支持链接模型和代理来创建高级工作流程,并配有自动依赖管理、重试机制和并行执行。此外,Dagster 与各种云平台、API 和矢量数据库无缝集成,使其非常适合处理大规模数据和人工智能任务。

这种灵活的架构可确保与不同系统的顺利集成。

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen 是由 Microsoft Research 开发的开源框架,使多个 AI 代理能够通过对话进行协作以处理复杂的任务。该系统允许开发人员创建专业代理协同工作的应用程序,每个代理都贡献自己独特的专业知识来实现共同目标。通过引入对话界面,AutoGen 简化了协调多个人工智能组件的复杂过程。

AutoGen 通过利用对话作为协作手段,引入了一种新的多代理编排方法。该框架在需要多个代理动态协同工作的问题解决场景中特别有效。例如,在软件开发中,一个代理可能会生成代码,而另一个代理则专注于测试和验证,两个代理都会迭代以完善输出。这种对话模型非常适合自动化软件工作流程、协助研究和处理复杂的决策过程等任务,在这些过程中,不同的观点或技能可以改善结果。

旨在迭代改进工作流程的团队发现 AutoGen 特别有吸引力。它促进代理之间来回交流的能力反映了人类协作,使开发人员更容易设计通过持续对话和反馈不断发展和改进的系统。

AutoGen 强调模块化,同时以其对话式代理设计而脱颖而出。每个代理都按照特定的角色和指令进行操作,其中可以包括对工具、外部 API 或语言模型的访问。该框架支持自治代理和包含人工输入的用户代理代理,为管理工作流程提供了灵活性。

该系统可以在开发过程中在本地运行,并扩展到云环境以进行生产。开发人员可以定义代理如何交互 - 无论是通过代理轮流的顺序工作流程,还是多个代理同时贡献的更复杂的模式。使用基于 Python 的配置,团队可以完全控制编排逻辑,而无需牺牲可读性,从而简化了管理多代理交互的过程。

AutoGen 处理管理多个模型调用和代理对话的复杂性,使开发人员能够专注于设计系统的逻辑和行为,而不用担心基础设施。

AutoGen通过函数调用与Azure OpenAI服务和其他模型无缝集成,为开发人员提供了选择AI后端的灵活性。它还支持将代理连接到外部工具和服务,使它们能够在对话期间检索数据、执行代码或与第三方 API 交互。

该框架允许开发人员创建自定义代理类型、可重用对话模式和编排模板。这种灵活性意味着团队可以利用现有的模式来完成常见任务,同时根据特殊需求进行深度定制。

对于已经使用 Microsoft 工具的组织,AutoGen 提供与 Azure 服务、Visual Studio Code 和其他开发平台的轻松集成。尽管与 Microsoft 生态系统保持一致,但该框架与平台无关,并且可以在各种技术环境中良好运行。

AutoGen 非常重视控制代理功能和管理对外部资源的访问。开发人员为每个代理定义特定的权限,例如他们可以访问哪些 API 或允许他们检索哪些数据。这种精细的方法可确保代理在最小权限原则下运行,仅执行其角色所需的任务。

该框架的对话性质本质上创建了审计跟踪、记录代理交互和决策过程。这些日志提供了如何生成输出的透明度,有助于合规性和调试工作。团队可以查看这些记录来分析座席行为并确定需要改进的领域。

人机交互功能允许工作流程在关键决策点暂停以供人工审核,从而增强监督。此功能确保可以在继续之前评估敏感操作,从而平衡自动化效率与治理和控制。

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

组织可以通过缓存对话上下文、使用更快的模型来执行日常任务以及为复杂的推理保留更高级的模型来提高性能。设计对话模式以尽量减少不必要的交流也可以提高效率。在适当的情况下,该框架支持并行代理执行,使独立任务能够同时运行而不是顺序运行。

为了处理高工作负载,AutoGen 可以部署在自动扩展的云基础设施上,确保系统能够管理不同的需求,同时控制成本。无状态代理交互简化了水平扩展,尽管维护跨交换的上下文需要深思熟虑的架构规划。

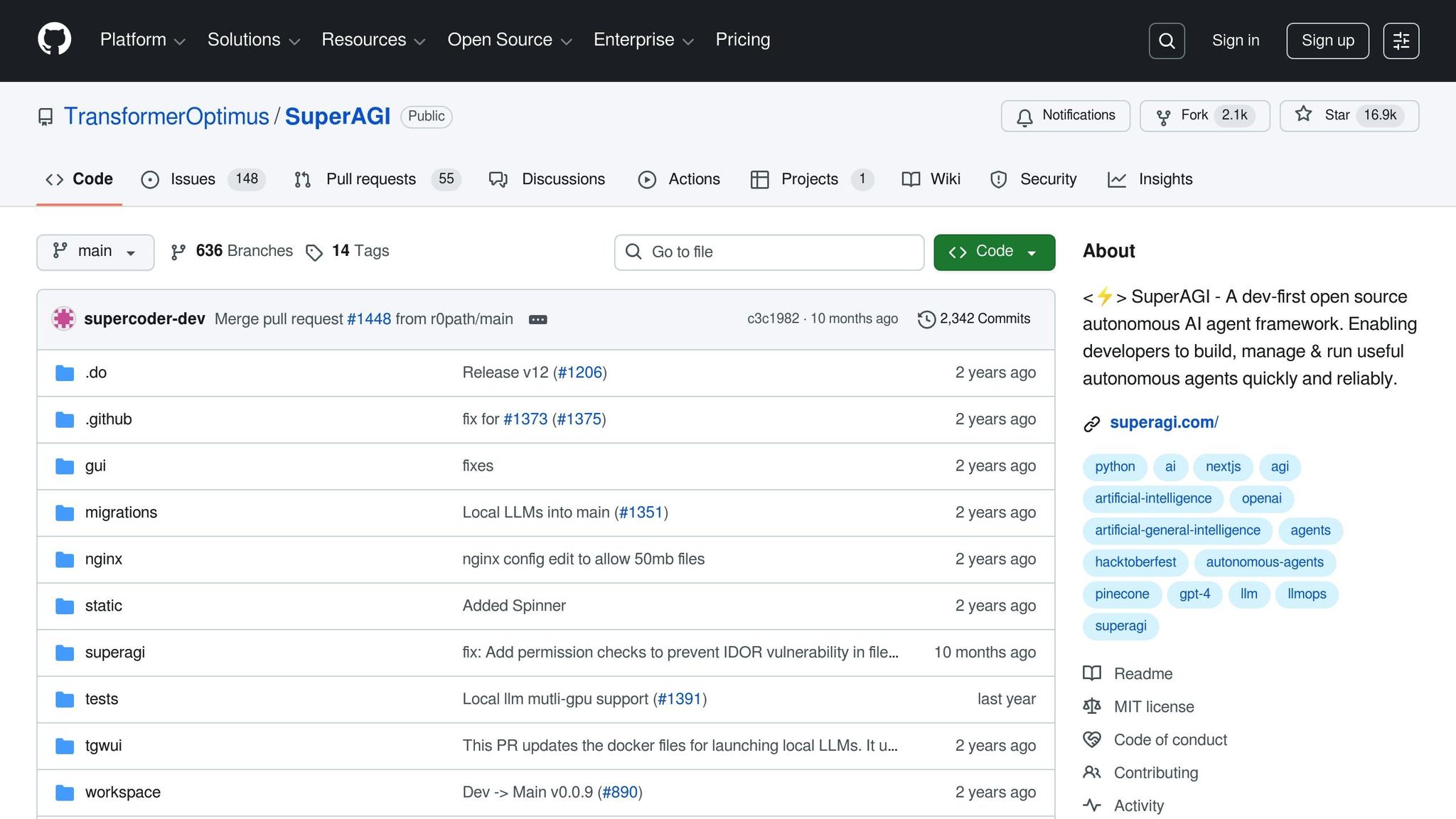

SuperAGI 以我们探索的编排框架为基础,引入了一种管理多代理协作的新方法。这个开源平台旨在协调自主人工智能代理,使开发人员能够创建、部署和监督代理,这些代理可以通过持续学习来规划、执行和适应任务。 SuperAGI 使多个代理能够无缝协作、动态委派任务并协作应对复杂的挑战。它将自适应任务管理与多代理团队合作相结合,使其成为高级人工智能编排的强大工具。

SuperAGI 擅长为企业自动执行复杂且不断变化的任务。其代理网络擅长高级任务规划和执行,通过强化学习和反馈循环不断改进。这使得它对于处理大规模运营的组织特别有用,其中智能协调是关键。平台内的代理从他们的互动和结果中学习,使他们能够随着时间的推移完善自己的行为。

该平台的突出特点是其动态任务委派。代理不拘泥于严格的工作流程,而是实时评估情况,确定优先任务,并将其分配给最合适的网络成员。这种灵活性确保了即使在复杂的场景中也能有效地分配资源。

SuperAGI 的架构设计以可扩展性和模块化为核心。开发人员可以轻松扩展代理网络和工作负载,以满足各种应用需求。每个代理独立运作,但他们无缝沟通,确保协作顺利。

用户友好的图形界面允许团队可视化代理交互并微调配置。监控仪表板可提供对代理绩效的洞察,帮助开发人员识别并解决效率低下的问题。该平台还支持并行执行,使多个代理能够同时处理独立的任务。这种设计显着提高了吞吐量,尤其是在高要求的环境中。

SuperAGI 具有可扩展的插件系统,可与第三方 API、工作流程工具和自定义模块集成。这种灵活性加速了开发并鼓励更广泛的开发者社区做出贡献,从而丰富了平台的功能。

该平台的分布式模块化架构支持水平扩展,使其适合大规模实施。它使用强化学习和反馈循环提高了整体性能,确保任务得到有效分配。通过实现有效协作和高吞吐量,SuperAGI 非常适合在复杂、大容量场景中需要强大性能的组织。

选择正确的人工智能编排框架意味着了解每个选项的优点和局限性。这些平台在设计时考虑了不同的优先级,以满足企业级安全性、开发人员适应性或机器学习管道等专业工作流程等需求。每个框架都反映了其独特的设计理念和目标用例。

例如,Prompts.ai 等平台擅长集中访问大型语言模型 (LLM),而 Apache Airflow 和 Prefect 等工具则专注于一般工作流程自动化。另一方面,Kubeflow 和 Flyte 是为机器学习管道量身定制的,SuperAGI 和 Microsoft AutoGen 等框架通过使自治系统能够共同处理复杂的任务来突破多智能体人工智能协作的界限。

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

成本结构:传统平台通常按用户或执行收费,这可能会随着运营的增长而导致成本更高。相比之下,Prompts.ai 使用带有 TOKN 积分的即用即付模式,将费用与使用直接挂钩。当尝试不同的模型或管理波动的工作负载时,这种方法特别有用。

安全性和合规性:对于医疗保健或金融等行业,强大的安全措施至关重要。 Prompts.ai、IBM watsonx Orchestrate 和 Prefect 等平台提供内置合规性工具,例如审计跟踪和基于角色的访问控制。然而,像 Apache Airflow 这样的开源选项需要额外的配置才能满足严格的合规性标准。

学习曲线:可用性差异很大。 Prefect 和 Dagster 等平台对初学者更加友好,提供直观的 Python API 和有用的错误消息。同时,Apache Airflow 和 Kubeflow 需要更深入的技术专业知识和基础设施管理技能。 Prompts.ai 通过统一的界面进一步简化了这一过程,为高级用户平衡了易用性和高级功能。

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

集成生态系统:与现有工具的无缝集成至关重要。 Apache Airflow 拥有数百个用于云服务、数据库和监控工具的插件。另一方面,Prompts.ai 特别关注法学硕士,通过单个 API 提供对数十个模型的简化访问。

可扩展性:Kubeflow 和 Flyte 等平台专为水平扩展而构建,利用 Kubernetes 进行工作负载分配。 Metaflow 使用 AWS 服务进行弹性扩展,而 Prefect 支持云管理和自托管扩展选项。 SuperAGI 采用分布式代理架构,支持并行执行,但这需要仔细协调。

最适合您的框架取决于您的具体工作流程。对于 LLM 编排,Prompts.ai 以其集中式模型访问和成本效率而脱颖而出。数据工程团队可能倾向于 Apache Airflow 的可靠性,而从事大规模训练和部署的 ML 团队可以从 Kubeflow 或 Flyte 中受益。如果您的重点是构建自主人工智能系统,SuperAGI 或 Microsoft AutoGen 可能是合适的选择。

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

例如,优先考虑 LLM 编排的团队可能会发现 Prompts.ai 特别有吸引力。它通过统一的界面提供对超过 35 个模型的集中访问,例如 GPT-5、Claude 和 Gemini。即用即付的 TOKN 信用系统消除了订阅费用,同时提供实时成本跟踪。凭借基于角色的访问控制和审计跟踪等功能,Prompts.ai 是需要严格治理而又不影响速度的行业的绝佳选择。

处理复杂 ETL 管道的数据工程团队可能会倾向于使用 Apache Airflow,因为它具有强大的插件生态系统和可扩展性,尽管它确实需要更高级的专业知识。另一方面,Prefect 提供了 Python 原生方法和用户友好的错误处理,使其成为更快的团队入职的绝佳选择。

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

探索自主人工智能系统的组织可能会考虑使用 Microsoft AutoGen 的多代理协作功能或 SuperAGI 的动态任务委派。这些工具非常适合研究或专业用例,但通常需要高级编码技能,因此不太适合即时生产需求。

最终,选择正确的框架涉及评估模块化、可扩展性、可观察性和治理功能(例如基于角色的访问控制和合规性认证)等因素。部署灵活性以及与现有工具的集成同样重要。除了功能之外,还要考虑开发人员体验,包括 SDK、文档和总拥有成本。您的工作流程的复杂性 - 无论是简单的单代理任务还是具有持久内存的复杂多代理系统 - 也应该指导您的决策。

该行业正趋向于可扩展、集成的人工智能系统,开源框架驱动大部分企业工作负载,而供应商管理的运行时则简化了运营挑战。

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

选择人工智能编排框架时,必须考虑它与您当前的工具和系统的集成程度。具有强大集成能力的框架可确保一切协同工作,而不会出现不必要的复杂情况。

请注意其自动化功能,例如工作流程调度和任务管理,因为这些可以简化操作并节省时间。同样重要的是安全和治理措施,它们可以保护敏感数据并帮助您遵守法规。

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai 通过将超过 35 种大型语言模型整合到一个统一平台中,简化了同时使用多个 AI 工具的挑战。通过此设置,用户可以轻松地并排比较模型,同时保留对其提示工作流程、输出质量和整体性能的完全监督。

Prompts.ai 具有集成的 FinOps 层,旨在优化成本,从而提高了效率。该工具提供有关使用情况、支出和投资回报 (ROI) 的实时洞察,使组织能够有效管理其资源并充分利用其 AI 预算。

Prompts.ai 优先考虑企业级安全性和合规性,符合 SOC 2 Type II、HIPAA 和 GDPR 等行业标准,在每个阶段保护您的数据。

To uphold ongoing monitoring and compliance, Prompts.ai collaborates with Vanta and began its SOC 2 Type II audit process on 2025年6月19日. These steps ensure your workflows stay secure, compliant, and dependable for enterprise operations.