Yapay zeka orkestrasyonu, kurumsal yapay zeka operasyonlarını ölçeklendirmenin anahtarıdır. Yapay zeka pilot uygulamalarının %95'inin zayıf koordinasyon nedeniyle başarısız olduğu göz önüne alındığında, işletmelerin karmaşık yapay zeka iş akışlarını birleştirmeye, otomatikleştirmeye ve yönetmeye yönelik araçlara ihtiyacı var. 2025 manzarası, birden fazla modeli entegre eden, iş akışlarını güvenli hale getiren ve maliyetleri optimize eden, benimseyenlere %60'a kadar daha yüksek yatırım getirisi sağlayan platformlar sunuyor.

Here’s a quick breakdown of the top solutions:

Her platform ölçeklenebilirlik, birlikte çalışabilirlik, yönetişim ve maliyet yönetimi konularında benzersiz güçler sunar. İster açık kaynak esnekliğine ister kurumsal düzeyde uyumluluğa ihtiyacınız olsun, bu araçlar parçalanmış yapay zeka sistemlerini birleşik, ölçeklenebilir ekosistemlere dönüştürebilir.

Yapay zeka girişimlerinizi ölçeklendirmek, koordinasyonu geliştirmek ve yatırım getirinizi en üst düzeye çıkarmak için doğru platformu seçin.

Yapay Zeka Düzenleme Platformları Karşılaştırması: Ölçeklenebilirlik, Birlikte Çalışabilirlik, Yönetişim ve Maliyet

Prompts.ai, yapay zeka operasyonlarını basitleştirmek ve kolaylaştırmak için tasarlanmış son teknoloji ürünü bir kurumsal platformdur. GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro ve Kling dahil olmak üzere 35'ten fazla üst düzey büyük dil modelini tek bir güvenli, birleşik arayüzde bir araya getirir. Platform, bu modellere erişimi merkezileştirerek birden fazla aracı yönetme kaosunu ortadan kaldırarak kuruluşların yapay zeka çalışmalarını kolaylıkla ölçeklendirmesine yardımcı oluyor.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Merkezi bir merkez olarak Prompts.ai, tüm AI odaklı süreçlerin dağınık, sabit kodlanmış dizeler yerine yetkili, sürüm kontrollü bilgi istemi şablonlarına dayanmasını sağlar. Mimarisi, zahmetsiz model seçimine ve yan yana performans karşılaştırmalarına olanak tanıyarak ekiplerin her görev için en etkili büyük dil modelini (LLM) belirlemesine ve dağıtmasına olanak tanır. Tüm bunlar, kodu yeniden yazmaya veya işlem hatlarını ayarlamaya gerek kalmadan, zamandan ve emekten tasarruf edilerek elde edilir.

Prompts.ai, güçlü rol tabanlı erişim kontrolü (RBAC) aracılığıyla güvenliğe ve kontrole öncelik verir. Bu, kuruluşların üretim ortamlarında bilgi istemlerini kimin oluşturabileceği, değiştirebileceği veya dağıtabileceği konusunda kesin izinler tanımlamasına olanak tanır. Her etkileşim, denetim izleri ve sürüm takibi ile titizlikle günlüğe kaydedilir ve tam şeffaflık sağlanır. Bu yönetişim çerçevesi, işletmelerin yapay zeka operasyonları üzerinde görünürlük ve kontrolü korurken uyumluluk standartlarını karşılamalarına yardımcı olur. Platform, katı güvenlik önlemlerini operasyonel verimlilikle birleştirerek kuruluşların yapay zekayı güvenli ve etkili bir şekilde yönetmesine yardımcı olur.

Platform, token kullanımını izleyen ve AI harcamalarını doğrudan iş sonuçlarına bağlayan bir FinOps katmanı içeriyor. Birçok kuruluş, satıcı ilişkilerini güçlendirerek ve gereksiz abonelikleri keserek maliyetleri %98'e kadar azalttığını bildirdi. Ekipler, gerçek zamanlı kullanım ve performans ölçümleri sayesinde harcamaları sürekli olarak izleyebilir ve optimize edebilir, böylece ay sonunda beklenmeyen harcamaların önüne geçebilirler. Bu düzeydeki finansal şeffaflık, yapay zekayı bütçe belirsizliğinden, net getirileri olan ölçülebilir bir yatırıma dönüştürür.

LangChain, ayda 90 milyon etkileyici indirme ve 100.000'den fazla GitHub yıldızıyla yapay zeka uygulamaları için güçlü bir çerçeve olarak öne çıkıyor. Modüler tasarımı, işlevselliği temel soyutlamalar için langchain-core ve üçüncü taraf entegrasyonları için langchain-community gibi hafif paketlere ayırır. Bu yaklaşım, yapay zeka iş akışlarının gereksiz masraflar olmadan kolaylaştırılmasını sağlayarak hem karmaşıklığı hem de ölçeği yönetmek için tercih edilen bir seçim haline getiriyor.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith, HIPAA, SOC 2 Tip 2 ve GDPR dahil olmak üzere sıkı uyumluluk standartlarına uyar. Hata ayıklama ve uyumluluk incelemeleri için kapsamlı bir denetim izi oluşturarak ayrıntılı yürütme takibi sunar. LangGraph bunu, gerçek zamanlı inceleme, geri alma ve düzeltme için "zaman yolculuğu" yetenekleri de dahil olmak üzere döngüdeki insan özellikleriyle geliştirir.

__XLATE_10__

SWE Müdürü Garrett Spong şunları vurguluyor: "LangGraph, konuşma aracılarından karmaşık görev otomasyonuna ve 'sadece işe yarayan' özel LLM destekli deneyimlere kadar yapay zeka iş yüklerini nasıl oluşturup ölçeklendirebileceğimizin temelini oluşturuyor".

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) etkileyici bir performans geçmişiyle öne çıkıyor: 258 milyon PyPI indirmesi, 33.100 GitHub yıldızı ve 3.000'den fazla katılımcıdan oluşan gelişen bir topluluk. Yerel olarak Kubernetes üzerinde çalışacak şekilde tasarlanan KFP, bir işlem hattının her adımını ayrı bir Pod olarak yürüterek kümenizdeki bilgi işlem kaynaklarını gerektiği gibi dinamik olarak ölçeklendirmesine olanak tanır. Mimarisi, belirli veri bağımlılıkları tanımlanmadıkça kapsayıcıya alınmış görevlerin paralel yürütülmesini sağlayan Yönlendirilmiş Asiklik Grafik (DAG) yapısına dayanır [18, 19]. Bu kurulum, karmaşık iş akışlarını verimli bir şekilde yönetme yeteneğinin anahtarıdır.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP, açık kaynaklı kurulumlardan Google Cloud Vertex AI Pipelines gibi yönetilen hizmetlere kadar ardışık düzenlerin farklı KFP arka uçlarında sorunsuz bir şekilde çalışmasına olanak tanıyan IR YAML biçimi aracılığıyla esneklik ve taşınabilirlik sağlar. Bu, kodunuzu yeniden yazmaya gerek kalmadan yerel olarak geliştirebileceğiniz ve bulutta uygun ölçekte dağıtabileceğiniz anlamına gelir. Platform aynı zamanda veri hazırlığı için Spark, Ray ve Dask gibi popüler araçların yanı sıra ölçeklenebilir model çıkarımı için KServe ile de entegre oluyor. Python SDK'sı sayesinde veri bilimcileri tanıdık kodlama uygulamalarını kullanarak karmaşık iş akışlarını tanımlayabilirken, arka uç bunları otomatik olarak Kubernetes işlemlerine çevirebilir.

Güvenlik ve yönetim KFP'nin ayrılmaz bir parçasıdır. Güvenli iş akışı yürütülmesini sağlamak için Kubernetes'in Rol Tabanlı Erişim Kontrolü (RBAC), izolasyon için ad alanları ve ağ politikaları gibi yerleşik özelliklerini kullanır. Platform, meta verileri ve yapıları merkezi olarak takip ederek her ardışık düzen çalıştırması için ayrıntılı bir denetim izi oluşturur [8, 22]. KFP, her boru hattı adımını yalıtılmış bir kapta çalıştırarak süreç izolasyonunu ve güvenli veri işlemeyi sürdürür. Yöneticiler, bireysel görevler için kaynak limitleri belirleme, ekipler arasında adil kaynak dağıtımı sağlama ve aşırı kullanımı önleme olanağına sahiptir. Hassas veriler veya iş yükleri için, görevleri belirli, güvenli donanımlarla sınırlamak amacıyla düğüm seçiciler kullanılabilir.

KFP'nin kendisi açık kaynaklı ve kullanımı ücretsiz olsa da, AWS EKS, Google GKE veya şirket içi olsun, temel Kubernetes altyapısıyla ilişkili maliyetler hâlâ geçerlidir. Google Cloud Vertex AI Pipelines gibi yönetilen sürümler, kullandıkça öde fiyatlandırma modeliyle çalışır [19, 20]. KFP ayrıca, uzun süredir devam eden işlem hatlarını yeniden başlatma masraflarını önlemeye yardımcı olan geçici arızalar için yeniden deneme mekanizmaları ve önceki adımlar başarısız olsa bile temizleme görevlerinin yürütülmesini sağlayan çıkış işleyicileri gibi özellikler içerir. Bu özellikler daha verimli kaynak kullanımına ve maliyet kontrolüne katkıda bulunur.

Argo Workflows, üretim ortamlarında 200'den fazla kuruluşun güvendiği Kubernetes için özel olarak tasarlanmış popüler bir iş akışı yürütme motorudur. Kapsayıcıda yerel bir çözüm olarak, her iş akışı adımını yalıtılmış bir bölmede çalıştırarak paralel işleri düzenler. Bu mimari, Kubernetes kümenizin mevcut kapasitesine bağlı olarak dinamik ölçeklendirmeye olanak tanıyarak, onu özellikle esnek kaynak yönetimi gerektiren yapay zeka görevleri için etkili kılar.

Argo Workflows, dikey optimizasyon ve parçalama yoluyla ölçeklendirmeyi destekler. --workflow-workers parametresini artırarak, iş akışı uzlaşmasını hızlandırmak için daha fazla CPU çekirdeği ayırabilirsiniz. Daha büyük işlemler için, parçalama, ad alanı başına ayrı kurulumlar dağıtılarak veya Örnek Kimlikleri kullanılarak aynı küme içinde birden fazla denetleyici örneği çalıştırılarak uygulanabilir. Argo, Kubernetes API sunucusunu korumak için istemci tarafı hız sınırlaması kullanır (varsayılan: saniyede 20 sorgu ve 30'luk artış) ve foreach adımlarının eş zamanlılığını 100 görevle sınırlandırır. Bu ölçeklenebilir yaklaşım, ağır iş yükleri altında bile harici sistemlerle sorunsuz entegrasyon sağlar.

Bir Kubernetes Özel Kaynak Tanımı (CRD) olan Argo, herhangi bir Kubernetes kümesiyle sorunsuz bir şekilde entegre olur ve Kubeflow Pipelines, Netflix Metaflow, Seldon ve Kedro gibi önde gelen yapay zeka platformlarına güç sağlar. Geliştiriciler, dil seçiminde esneklik sunan Python (Hera), Java ve Go için resmi SDK'ları kullanarak iş akışlarını tanımlayabilir. Yapı yönetimi için Argo, AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory ve Alibaba Cloud OSS dahil olmak üzere çeşitli depolama çözümlerini destekler. Bu uyumluluk, farklı ortamlarda sorunsuz veri akışı sağlar. Ek olarak iş akışları, Argo Events kullanılarak web kancaları veya depolama değişiklikleri gibi harici sinyaller tarafından tetiklenebilir. Metaflow belgelerine göre Argo Workflows, Argo Events aracılığıyla olay tetiklemeyi destekleyen tek üretim orkestratörüdür. Bu esneklik ve işlevsellik kombinasyonu, onu iş akışı otomasyonu için sağlam bir seçim haline getirir.

Argo Workflows, güçlü güvenlik sağlamak için Kubernetes'in yerel özelliklerinden yararlanır. Rol Tabanlı Erişim Kontrolü (RBAC), iş akışı denetleyicisi, kullanıcılar ve bireysel bölmeler için izinleri yönetir. Yalıtımı geliştirmek için denetleyici, "ad alanı kurulumu" modu kullanılarak tek bir ad alanıyla sınırlandırılabilir. Argo, üretim ortamlarında OAuth2 ve OIDC aracılığıyla Tek Oturum Açmayı (SSO) desteklerken aktarım halindeki verileri de TLS şifrelemeyle korur. Yöneticiler, kullanıcıların yalnızca önceden onaylanmış şablonlar göndermesine izin vererek iş akışı kısıtlamalarını uygulayabilir ve Bölme Güvenlik İçerikleri, bölmelerin kök olarak çalışmasını engellemeye yardımcı olur. Ağ politikaları, hem Argo Sunucusu hem de İş Akışı Denetleyicisi için trafiği düzenler ve 100 çağrılık varsayılan yineleme derinliği sınırı, sonsuz döngüleri önler.

Argo Workflows, Apache Lisansı 2.0 kapsamında sunulan ve kullanımını ücretsiz hale getiren açık kaynaklı bir araçtır. Maliyetleri yönetmek amacıyla, tamamlanan iş akışlarını otomatik olarak silmek ve kullanılmayan bölmeleri temizleyerek kaynak israfını azaltmak için TTL stratejilerini ve Kapsül Çöp Toplama'yı (PodGC) kullanır. Görevler, düğüm seçiciler ve benzeşim kuralları kullanılarak spot bulut sunucuları gibi uygun maliyetli altyapılarda planlanabilir. Ek olarak, kaynak kullanımı adım başına takip edilerek kullanıcıların harcamaları izlemesine yardımcı olur. Denetleyici günlüklerinde "istemci tarafında kısıtlama" fark ederseniz --qps ve --burst değerlerini artırmak Kubernetes API ile iletişim verimliliğini artırabilir. Bu düşünceli tasarım, performansı maliyet etkinliğiyle dengelemeye yardımcı olur.

Apache Airflow, karmaşık operasyonların düzenlenmesi için esnek, kod tabanlı bir çerçeve sunarak yapay zeka iş akışlarının yönetilmesinde önemli bir oyuncu haline geldi. Özellikle kullanıcılarının %23'ünün uyguladığı Makine Öğrenimi Operasyonlarında (MLOps) ve topluluğun %9'unun kullandığı Üretken Yapay Zeka projelerinde öne çıkıyor. Apache Lisansı 2.0 kapsamında yayımlanan Airflow, geliştiricilerin Python'da iş akışları tanımlamasına olanak tanıyarak herhangi bir makine öğrenimi kitaplığıyla sorunsuz bir şekilde entegre olur.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor özellikle öngörülemeyen, kaynak açısından ağır iş yüklerini yönetmek için kullanışlıdır. Dinamik Görev Eşleme gibi özellikler, görevlerin gerçek zamanlı verilere göre ölçeklendirilmesine olanak tanır ve bu da onu büyük veri kümeleri ve çok modelli iş akışları için mükemmel kılar. Bu arada Ertelenebilir Operatörler, çalışan yuvalarını işgal etmeden model eğitiminin izlenmesi gibi uzun bekleme durumlarını yöneterek verimliliği artırır. Bu yaklaşım, verimi ve kaynak kullanımını önemli ölçüde artırır.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

TaskFlow API, komut dosyalarını Airflow görevlerine dönüştürmek için Python dekoratörlerini kullanarak iş akışı oluşturmayı basitleştirir ve XCom'lar aracılığıyla veri aktarımlarını otomatik olarak yönetir. Ekipler, görevleri GPU ağırlıklı eğitim için Kubernetes bölmeleri veya veri ön işleme için Spark kümeleri gibi uygun ortamlara yönlendirebilir. Ek olarak REST API ve airflowctl CLI, CI/CD işlem hatlarıyla güvenli entegrasyon sağlayarak sorunsuz ve denetlenebilir iş akışı yönetimi sağlar.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

Veri yönetimi için Airflow, GDPR ve HIPAA gibi uyumluluk gereksinimlerinin karşılanmasına yardımcı olan, veri kökenini takip etmeye yönelik bir standart olan OpenLineage ile entegre olur. airflowctl CLI, ek güvenlik için meta veri veritabanına doğrudan erişimi önleyerek yalnızca REST API ile etkileşime girer. Ekipler ayrıca Kurulum ve Sökme görevlerini kullanarak tekrarlanabilir ortamları yönetebilir ve daha iyi gözetim ve tutarlılık için altyapıyı kod olarak ele alabilir.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning, gelişmiş GPU'lar, InfiniBand ağı, %99,9 çalışma süresi ve 100'den fazla uyumluluk sertifikası içeren kurumsal yapay zeka ihtiyaçları için güçlü bir çözüm sunar. 34.000 mühendis ve 15.000 güvenlik uzmanından oluşan bir ekip tarafından desteklenen bu sistem, geniş ölçekte güvenilirlik ve güvenlik sağlar.

Platform, veriler, modeller ve işlem hatları genelinde dağıtılmış bilgi işlem desteği sayesinde her boyuttaki iş yükünü yönetecek ve kaynak verimliliğini en üst düzeye çıkaracak şekilde tasarlanmıştır. Yönetilen çevrimiçi uç noktalar, talepteki ani artışları karşılamak için otomatik ölçeklendirmeyle sorunsuz model dağıtımına olanak tanır. Örneğin, İşaretler & Spencer, 30 milyondan fazla müşterinin verilerini işlemek için Azure ML'yi kullanırken, hem eğitim süresini hem de maliyetleri azaltmak için işlem hattı önbelleğe alma ve kayıt defterlerinden yararlandı. Benzer şekilde, BRF'de otomatikleştirilmiş ML ve MLOps, 15 analistin manuel görevlerini ortadan kaldırarak onların daha yüksek değerli işlere odaklanmasına olanak sağladı.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"Azure AI istem akışı olmasaydı, bir çözüm sunmak için oldukça önemli özel mühendisliğe yatırım yapmak zorunda kalırdık. Bunun yerine, mevcut mikro hizmetlerimizi istem akışı çözümüne kolayca entegre ederek büyük bir hız elde edebildik."

Azure ML ayrıca, platformu verileri merkezileştirmek yerine yerel uç cihazlar üzerinde modelleri eğitmek için kullanan ve hem ölçeklenebilirlik hem de veri gizliliği sağlayan Swift'den Johan Bryssinck'in gösterdiği gibi gizliliği koruyan dağıtılmış eğitimi de destekliyor. Birleştirilmiş API sözleşmesi, Azure Logic Apps ve Azure İşlevleri ile entegrasyonların yanı sıra, harici araçlarla bağlantıyı daha da geliştirir.

Azure Machine Learning, rol tabanlı erişim denetimi (RBAC) için Microsoft Entra ID ve kaynakları yalıtmak ve API erişimini sınırlamak için Sanal Ağlar gibi özelliklerle güvenliğe öncelik verir. Veriler, aktarım sırasında TLS 1.2/1.3 şifrelemeyle, bekleme sırasında ise çift şifrelemeyle ve daha fazla kontrol için Müşteri Tarafından Yönetilen Anahtar seçenekleriyle korunur. Prompt Shields gibi gerçek zamanlı savunmalar jailbreak'leri ve hızlı enjeksiyon saldırılarını önlerken Müşteri Kasası, Microsoft'un müşteri verilerine erişmesi için yönetici onayı gerektirir. Ek araçlar varlık sürümlerini, veri kökenini ve kotaları izler ve Bulut için Microsoft Defender çalışma zamanı tehdit koruması sağlar.

Azure Machine Learning, yalnızca CPU'lar ve özel GPU'lar gibi işlem kaynakları için ücret alan, kullandıkça öde fiyatlandırma modeliyle çalışır. Blob Storage, Key Vault, Container Registry ve Application Insights gibi destekleyici hizmetler de kullanıma göre faturalandırılır. Ekipler belirli görevlere göre uyarlanmış donanımları seçebilirken, ardışık düzen önbelleğe alma gibi özellikler gereksiz hesaplamaları azaltır. Kod Olarak Altyapı, tutarlı dağıtım ve verimli kaynak yönetimi sağlar.

Google Vertex AI Pipelines, makine öğrenimi (ML) iş akışlarını otomatikleştirerek altyapıyı yönetme zorluklarını ortadan kaldırır. Görevleri konteynerleştirilmiş bileşenlerden oluşan Yönlendirilmiş Döngüsel Grafik (DAG) halinde düzenleyerek ekiplerin sunucu yönetimi yerine model geliştirmeye odaklanmasını sağlar.

Vertex AI Pipelines, iş yüklerini yönetmek için sunucusuz bir yaklaşım kullanıyor ve yoğun işleme görevlerini BigQuery, Dataflow ve Apache Spark için Cloud Serverless gibi araçlara devrediyor. Dağıtılmış Python ve ML hesaplamaları için Vertex AI üzerinde Ray ile sorunsuz bir şekilde entegre olur.

Platform, NVIDIA H100/H200 GPU'larla donatılmış A3 ve A3 Mega serisi düğümleri destekler. 8 H100 GPU içeren A3 Mega düğümleri, 1.600 Gbps'lik etkileyici bir düğümler arası bant genişliği sunar. Örneğin Vectra, Gemini ve Vertex AI'yi kullanarak aylık 300.000 müşteri çağrısını analiz ederek analiz hızında %500 artış elde etti.

Maliyet verimliliği, giderleri en aza indirmek için çıktıları yeniden kullanan yürütme önbelleğe alma özelliğiyle yerleşiktir. Vertex ML Meta Verileri, yapıların, parametrelerin ve metriklerin kökenini uygun ölçekte izleyerek tekrarlanabilirlik sağlar. Bu ölçeklenebilir tasarım, çeşitli araçlarla zahmetsizce entegre olur ve bu da onu makine öğrenimi iş akışları için çok yönlü bir çözüm haline getirir.

Google Cloud Pipeline Components (GCPC) SDK'sı, AutoML, özel eğitim işleri ve model dağıtımı gibi Vertex AI hizmetlerini doğrudan ardışık düzenlere bağlayan önceden oluşturulmuş bileşenler sunarak entegrasyonu basitleştirir.

İşlem hattı yönetimi, hizmetler genelinde iş akışlarını düzenlemek için Cloud Composer (yönetilen Apache Airflow) ve Cloud Data Fusion tetikleyicileri gibi seçeneklerle esnektir. BigQuery, Cloud Storage ve Dataproc'a yerel bağlantılar veri işlemeyi kolaylaştırırken meta veriler, projeler arası köken takibi için Dataplex Evrensel Katalog ile senkronize edilebilir. Ayrıca Model Garden, Google'ın Gemini'si, Anthropic'in Claude'u ve Meta'nın Llama'sı da dahil olmak üzere 200'den fazla modele erişim sunuyor.

İşlem hattı tanımları standartlaştırılmış bir YAML formatında derlenerek Artifact Registry gibi depolar arasında taşınabilirlik sağlanır.

Vertex AI Pipelines, yönetişim ve güvenlik göz önünde bulundurularak tasarlanmıştır. Hizmet hesapları, her bileşenin yalnızca gerekli izinlerle çalışmasını sağlar. VPC Hizmet Kontrolleri güvenli bir çevre oluşturarak eğitim veri kümeleri, modeller ve toplu tahmin sonuçları gibi hassas verilerin ağ sınırından çıkmasını önler.

Platform, sıkı uyumluluk ihtiyaçları olan kuruluşlar için, Google Cloud'un kullanımda olmayan varsayılan şifrelemesine ek olarak Müşteri Tarafından Yönetilen Şifreleme Anahtarlarını (CMEK) destekler. Vertex ML Meta Verileri, her işlem hattı çalıştırmasındaki parametreleri, yapıları ve ölçümleri otomatik olarak kaydederek ayrıntılı bir denetim takibi sağlar.

Model Armor gibi güvenlik özellikleri, anında enjeksiyona ve veri sızmasına karşı koruma sağlar. İşlem hatları, eşlenen VPC ağlarında çalışacak şekilde yapılandırılabilir ve Cloud Logging, ekiplerin herhangi bir güvenlik anormalliği açısından işlem hattı olaylarını izlemesine olanak tanır.

Vertex AI Pipelines, Cloud Billing'in BigQuery'ye aktarımları aracılığıyla maliyet takibi için fatura etiketlerinin otomatik olarak uygulandığı, kullandıkça öde modelinde çalışır. Yürütme önbelleğe alma, çıktıları yeniden kullanarak maliyetleri daha da azaltır.

Kesintiye dayanıklı eğitim işlerinin masraflarını azaltmak için Spot VM'ler indirimli fiyatlarla sunulmaktadır. Uzun vadeli altyapı taahhütleri için Taahhütlü Kullanım İndirimleri (CUD'ler), maliyet tasarrufu ve garantili kapasite sağlar. Dinamik İş Yükü Zamanlayıcı (DWS), daha düşük liste fiyatlarıyla esnek iş yükleri için kapasite sunarken, özel eğitim kümeleri büyük ölçekli işler için ayrılmış hızlandırıcı kapasitesi sağlar.

IBM watsonx Orchestra, özel araçlar ve temel modeller için bir denetleyici, yönlendirici ve planlayıcı olarak işlev görerek yapay zeka aracılarını koordine eden merkezi bir merkez görevi görür. Platform çeşitli orkestrasyon yaklaşımlarını destekler: Keşif görevleri için React, yapılandırılmış iş akışları için Planla-Harekete Geç ve öngörülebilir iş süreçleri için deterministik orkestrasyon.

Büyük ölçekli operasyonlar için tasarlanan watsonx Orchestra, istekleri uygun araçlara ve büyük dil modellerine (LLM'ler) gerçek zamanlı olarak verimli bir şekilde yönlendirmek için çok aracılı orkestrasyonu kullanır. Kuruluşlar, Watsonx Orchestra'yı IBM Cloud veya AWS üzerinde yönetilen bir hizmet olarak devreye almayı veya mevcut altyapılarıyla uyumlu hale getirmek için şirket içinde kurmayı seçebilir.

Platform halihazırda ölçülebilir sonuçlar sunmuştur. Örneğin IBM, yıllık 10 milyon İK talebinin %94'ünü watsonx Orchestra aracılığıyla anında çözerek İK ekiplerinin daha yüksek değerli görevlere odaklanmasına olanak tanıdı. Benzer şekilde Dun &; Bradstreet, yapay zeka destekli tedarikçi risk değerlendirmeleriyle satın alma süresini %20'ye kadar kısaltarak müşterilerin değerlendirme süresinde %10'un üzerinde tasarruf sağladı.

Hızlı dağıtımı desteklemek için platform, kodsuz bir Ajan Oluşturucu ve özel Python tabanlı araçlar oluşturmaya yönelik bir Ajan Geliştirme Kiti (ADK) içerir. Ek olarak, 100'den fazla alana özgü yapay zeka aracısı ve 400'den fazla önceden oluşturulmuş araç içeren bir katalog, çeşitli operasyonel ihtiyaçları karşılamak için ölçeklenebilir bileşenler sunar.

Bu ölçeklenebilirlik, mevcut sistemlerle sorunsuz entegrasyon sağlayarak onu çok çeşitli kurumsal ortamlara uyarlanabilir hale getirir.

Platformun AI Ağ Geçidi, IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral ve Llama dahil olmak üzere çeşitli temel modeller arasında kesintisiz yönlendirmeyi kolaylaştırarak kuruluşların satıcıya bağlı kalmaktan kaçınmasına yardımcı oluyor. Aracı Geliştirme Kiti, uzak web hizmetleri için OpenAPI özelliklerini ve genişletilmiş işlevsellik için Python'u kullanarak özel araçlar oluşturmayı destekler.

Langflow ile entegrasyon, yapay zeka uygulamaları tasarlamak için görsel bir sürükle ve bırak arayüzü ekler ve bu arayüz daha sonra Orchestrat ortamına aktarılabilir. Ayrıca watsonx Orchestra, Salesforce, SAP, Workday ve Microsoft 365 gibi kurumsal sistemlere zahmetsizce bağlanarak kapsamlı altyapı değişikliklerine olan ihtiyacı ortadan kaldırır.

AgentOps ile platform, AI aracı faaliyetlerini izler ve güvenilirlik ve uyumluluk sağlamak için gerçek zamanlı politikaları uygular. Yerleşik korkuluklar ve merkezi gözetim, iç düzenlemelere bağlılığın korunmasına yardımcı olur.

__XLATE_52__

"AgentOps ile her eylem izleniyor ve yönetiliyor, böylece anormallikler gerçek zamanlı olarak işaretlenip düzeltilebiliyor." - IBM Haber Odası

IBM Guardium entegrasyonu, yetkisiz yapay zeka devreye alımlarını belirleyerek ve güvenlik açıklarını veya yanlış yapılandırmaları açığa çıkararak güvenliği artırır. Platform aynı zamanda ortam ayarlarını korumak için dört ana rolü (Yönetici, Oluşturucu, Kullanıcı ve Ürün Uzmanı) içeren rol tabanlı erişim kontrolünü (RBAC) de uygular. Watsonx.governance'ı kullanan şirketler, yapay zeka girişimlerinden yatırım getirisinde %30 artış bildirdi.

Platform, farklı organizasyonel ihtiyaçları karşılamak için esnek fiyatlandırma sunar:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31 Ocak 2026.

UiPath AI Center, kurumsal iş akışlarında yapay zeka aracılarını, RPA bot'larını ve insan çalışanlarını bir araya getirerek 2025'in taleplerini karşılamak üzere tasarlanmış ölçeklenebilir bir ekosistem oluşturuyor. Platform, özünde, karmaşık iş operasyonlarında uzun süredir devam eden süreçleri yöneten akıllı kontrol merkezi olarak UiPath Maestro'yu kullanıyor.

UiPath AI Center, değişen iş ihtiyaçlarına uyacak iki dağıtım seçeneği sunar: Anında esnek ölçeklendirme sağlayan Automation Cloud ve şirket içi dağıtım için özel olarak tasarlanmış Automation Suite. MLOps sistemi, modelleri dağıtmak ve izlemek için kullanıcı dostu bir sürükle ve bırak arayüzüne sahiptir ve sınırsız sayıda robotta sorunsuz bir şekilde ölçeklenmelerine olanak tanır. Örneğin SunExpress Havayolları, birikmiş iş yükünü iki ay azaltırken 200.000 doların üzerinde tasarruf sağladığını bildirdi. Platform aynı zamanda döngüdeki insanların sürekli olarak yeniden eğitilmesi yoluyla modellerin doğru kalmasını sağlar ve bu da onu yapay zekayı çeşitli sistemlere entegre etmek için güçlü bir araç haline getirir.

Platform, LangChain, Anthropic ve Microsoft gibi üçüncü taraf çerçevelerle entegrasyonu mümkün kılan "Kendi Modelinizi Getirin" (BYOM) stratejisini benimsiyor. Ek olarak, Google Cloud ile iş birliği içinde geliştirilen Agent2Agent (A2A) Protokolü, kurumsal platformlarda yapay zeka aracıları arasında sorunsuz iletişimi kolaylaştırır.

__XLATE_59__

LangChain CEO'su Harrison Chase şunları paylaştı: "Ajan Protokolü konusunda UiPath ile olan işbirliğimiz, LangGraph temsilcilerinin UiPath otomasyonlarına sorunsuz bir şekilde katılabilmelerini, erişimlerini genişletmelerini ve geliştiricilerin daha uyumlu, platformlar arası iş akışları oluşturmalarını sağlamasını sağlar."

UiPath AI Center, standartlaştırılmış API'ler aracılığıyla yüzlerce SaaS uygulamasına bağlanır, süreç modelleme için BPMN 2.0'ı destekler ve iş kurallarını yönetmek için Karar Modeli ve Gösterimi (DMN) kullanır. Dikkate değer bir örnek, Avustralya'nın en büyük ortak bankası olan Heritage Bank'tır; kredi inceleme sürecini otomatikleştirmek için AI Center'dan yararlanarak müşteri deneyimlerini geliştirirken manuel arka uç görevlerini azaltmıştır.

UiPath Yapay Zeka Merkezi, izlenebilirliği ve uyumluluğu sürdürmek için proje ve kiracı düzeyinde erişim kontrolleri sunarak yönetişim ve güvenliğe öncelik verir. Kontrollü ajans özellikleri, AI ajanlarının yetkisiz veya güvenli olmayan eylemleri özerk bir şekilde gerçekleştirememesini sağlar.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath Yapay Zeka Merkezi, model eğitimi, barındırma ve tahminler gibi etkinlikleri ölçen Yapay Zeka Birimlerini kullanan tüketime dayalı bir lisanslama modeli kullanır. Bunlar, orkestrasyon ve yürütme ihtiyaçlarını kapsayan Platform Birimleri aracılığıyla daha geniş UiPath lisanslama sistemine sorunsuz bir şekilde entegre olur. Kuruluşların yeteneklerini keşfetmesine yardımcı olmak amacıyla, hem Automation Cloud hem de Automation Suite sürümleri için 60 günlük ücretsiz deneme sürümü mevcuttur; bu, maliyetleri kontrol altında tutarken değerini değerlendirmeyi kolaylaştırır.

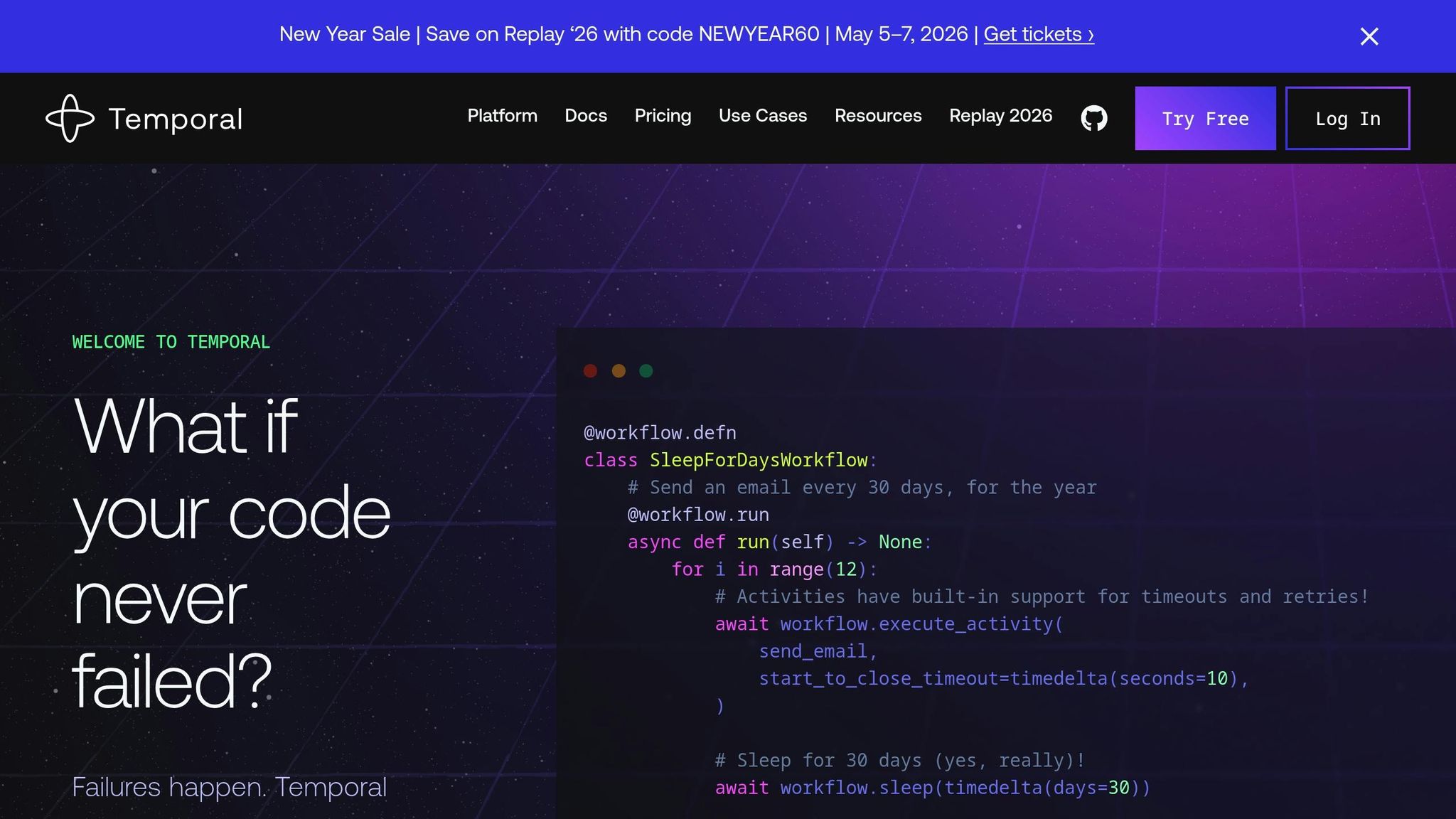

Temporal, yapılandırma dosyalarına güvenmek yerine dayanıklı, sürdürülebilen kod kullanarak benzersiz bir yaklaşım benimsiyor. Her iş akışı adımını değişmez bir Olay Geçmişi'nde yakalayarak süreçlerin bir kesinti sonrasında tam olarak kaldıkları yerden devam edebilmelerini sağlar. Bunun harika bir örneği, kodlama aracısı kontrol düzlemini Temporal'a geçirerek güvenilirliği ve kullanıcı deneyimini önemli ölçüde artıran Replit'tir.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, Ürün Müdürü, Yenileme Aracı

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Bu ölçeklenebilirlik, çeşitli araç ve sistemlerle kusursuz entegrasyon sağlar.

Geliştiriciler Python, Go, Java, TypeScript, .NET ve PHP gibi popüler dillerde iş akışlarını kod olarak yazabilirler. Temporal ayrıca OpenAI Agents SDK, Pydantic AI, LangGraph ve Crew AI dahil olmak üzere önde gelen AI çerçeveleriyle zahmetsizce entegre olur. Model Bağlam Protokolü (MCP) desteği, aracı güvenilirliğini artırır. Gözlemlenebilirlik, Langfuse gibi yapay zekaya özgü izleme araçlarıyla yapılan bağlantılar aracılığıyla iyileştirildi. Örneğin Gorgias, 15.000'den fazla e-ticaret markasının yapay zeka odaklı müşteri hizmetleri temsilcilerini yönetmesine yardımcı olmak için bu esnekliği kullanıyor.

Temporal'ın Olay Geçmişi, yapay zeka iş akışlarındaki her durum değişikliğinin eksiksiz, değiştirilemez bir denetim izini sağlar. Bu özellik, döngüdeki insan yönetimini destekleyerek, otonom kararları uygulamadan önce iş akışlarının harici doğrulama için duraklatılmasını sağlar. Bu koruma, LLM halüsinasyonları gibi sorunları önlemek için özellikle üretim ortamlarında faydalıdır. Temporal Bulut dağıtımlarında, sağlayıcı uygulama koduna erişemezken, açık kaynaklı MIT lisanslı sunucu seçeneği kuruluşların platformu kendi güvenli altyapıları içinde barındırmasına olanak tanır. Netflix mühendisleri, bu tasarımın bakımı nasıl en aza indirdiğini ve arıza yönetimini nasıl basitleştirdiğini vurguladı.

Temporal Cloud, kullandıkça öde modelinde çalışırken, açık kaynaklı Temporal Sunucunun kendi kendini barındırması ücretsizdir. Yeni kullanıcılar, Temporal Cloud için 1.000 ABD doları değerinde ücretsiz krediyle platformu keşfedebilirler. Kullanıcılar, bilgi işlem kaynaklarını tüketmeden iş akışlarını askıya alarak altyapı ve operasyonel maliyetleri önemli ölçüde azaltabilir. Temporal'ın tasarımı yalnızca verimliliği ve güvenilirliği artırmakla kalmıyor, aynı zamanda yapay zeka operasyonları büyüdükçe masrafları da kontrol altında tutuyor.

İdeal yapay zeka düzenleme platformunu seçmek, esneklik ile kullanım kolaylığını dengelemeyi gerektirir. Apache Airflow ve LangChain gibi açık kaynak seçenekleri satıcı bağımsızlığı ve derin özelleştirme sunar ancak güvenlik ve yönetim için gelişmiş teknik beceriler ve manuel yapılandırmalar gerektirir. Öte yandan, IBM watsonx Orchestra ve UiPath gibi kurumsal platformlar, lisans ücretleri ve azaltılmış esneklikle birlikte gelmesine rağmen, rol tabanlı erişim denetimi (RBAC), denetim izleri ve HIPAA uyumluluğu gibi yerleşik özellikler içerir.

Ölçeklenebilirlik stratejileri platformlar arasında büyük farklılıklar gösterir. Kubeflow ve Argo Workflows gibi Kubernetes'e özgü araçlar, konteynerleştirilmiş taşınabilirlik konusunda öne çıkarken Apache Airflow'un yönlendirilmiş döngüsel olmayan grafik (DAG) tabanlı zamanlaması, hibrit ve çoklu bulut kurulumlarındaki karmaşık bağımlılıkları yönetmek için etkilidir. Temporal, yüksek aktarım hızıyla tanınırken Azure Machine Learning ve Google Vertex AI Pipelines, talebin en yüksek olduğu zamanlarda kaynakları dinamik olarak tahsis etmek için ana bulut ekosistemlerinden yararlanıyor. Bu farklılıklar, kuruluşların çözümleri değerlendirirken dikkate alması gereken ödünleşimleri vurgulamaktadır.

Birlikte çalışabilirlik, birleşik iş akışlarının sağlanmasında bir başka kritik faktördür. LangChain, geliştiricilerin mevcut sistemleri elden geçirmeden birden fazla büyük dil modelini (LLM) ve API'yi bağlamasına olanak tanır ve Kubeflow, tek bir işlem hattı içinde PyTorch, TensorFlow ve JAX gibi çerçeveleri destekler. Prompts.ai gibi platformlar birden fazla modeli birleştirerek parçalanmayı azaltmayı hedeflerken, Azure Machine Learning ve IBM watsonx Orchestra gibi satıcıya özel platformlar sorunsuz yerel entegrasyonlar sağlar ancak daha geniş uyumluluk için ek bağlayıcılar gerektirebilir.

Operasyonel ödünleşimler aynı zamanda dağıtım kararlarında ve yatırım getirisinde (ROI) de önemli bir rol oynar. Yönetişim ve maliyet yönetimi, platformların önemli ölçüde farklılık gösterdiği alanlardır. IBM watsonx Orchestra ve UiPath gibi kurumsal düzeydeki çözümler, merkezi kontrol panelleri ve güçlü güvenlik özellikleri sunarak bunları sağlık ve finans gibi düzenlemeye tabi sektörler için uygun hale getiriyor. Buna karşılık, açık kaynaklı araçlar, karşılaştırılabilir bir gözetim sağlamak için genellikle manuel kurulum gerektirir. Maliyet açısından bakıldığında Apache Airflow, LangChain ve Kubeflow'un dağıtımı ücretsiz olsa da mühendislik süresi ve uzmanlıkla ilgili gizli harcamalara maruz kalabilirler. Temporal Cloud, 1.000 ABD doları tutarında ücretsiz krediyle kullandıkça öde fiyatlandırması sunarken Prompts.ai, yinelenen ücretleri ortadan kaldıran birleşik TOKN kredi sistemi aracılığıyla AI yazılım maliyetlerini önemli ölçüde (%98'e kadar) azaltır.

Aşağıdaki tablo, her platformun temel operasyonel boyutlarına göre ayrıntılı bir karşılaştırmasını sunmaktadır:

En iyi yapay zeka düzenleme platformunu seçmek kuruluşunuzun teknik yeteneklerine, uyumluluk ihtiyaçlarına ve büyüme planlarına bağlıdır. Apache Airflow ve LangChain gibi açık kaynak seçenekleri, lisans ücreti olmadan benzersiz bir esneklik sunarak, modüler kurulumlara değer veren yeni kurulan teknoloji şirketlerindeki geliştirici odaklı ekipler ve hızlı büyüyen şirketler için onları tercih edilen bir seçenek haline getiriyor. Ancak bu çerçeveler güvenlik, yönetişim ve ölçeklenebilirlik gibi kritik özellikleri yapılandırmak için ileri mühendislik becerileri gerektirir. Öte yandan, IBM Watsonx Orchestra gibi kurumsal platformlar, rol tabanlı erişim denetimleri, denetim izleri ve HIPAA ile SOC 2 gibi sertifikalar gibi yerleşik uyumluluk önlemlerinin tartışılamaz olduğu sağlık ve finans gibi sektörlere hitap ediyor. Bu platformlar genellikle iş akışlarını düzene sokarak ve yönetişim özelliklerini iyileştirilmiş iş sonuçlarına bağlayarak somut getiriler sağlar.

Büyük kuruluşlar için yönetişim ağırlıklı platformlar hayati öneme sahiptir ancak orta ölçekli şirketler genellikle maliyet ve performansı dengeleyen çözümlere ihtiyaç duyar. Prompts.ai, 35'ten fazla modeli tek bir arayüzde entegre ederek bu denklemi basitleştiriyor, gerçek zamanlı FinOps kontrolleri ve araç parçalanmasını ve beklenmedik masrafları en aza indirmek için kullandıkça öde TOKN kredileri sunuyor. Bu arada, Kubeflow Pipelines ve Argo Workflows gibi Kubernetes'e özgü araçlar, özellikle dağıtılmış sistemlerde karmaşık makine öğrenimi hatlarını yöneten veri bilimi ekipleri için taşınabilirlik ve hibrit bulut dağıtımları önemli olduğunda öne çıkıyor.

Daha önce tartışıldığı gibi, özerk etmenlerin çok adımlı akıl yürütme üzerinde işbirliği yaptığı etmenli yapay zekanın ortaya çıkışı, kusursuz düzenlemenin artan önemini vurgulamaktadır. Domo'dan alıntı yapmak gerekirse:

__XLATE_78__

"Yapay zekada başarı artık en fazla modele sahip olmakla ilgili değil, onları etkili bir şekilde düzenlemekle ilgili".

ABD'deki kuruluşlar için, mevcut teknik olgunluklarına uygun ve aynı zamanda AI departmanlar arasında daha entegre hale geldikçe ölçeklendirme alanı sunan platformları seçmek çok önemlidir. Akıllı bir başlangıç noktası, gelecekteki ölçeklendirme için gözlemlenebilirlik temeli oluşturmak amacıyla girdileri, çıktıları ve hataları takip ederek belirli bir iş akışına odaklanan bir pilot projedir. Doğru orkestrasyon platformu, yapay zeka araçlarını birbirine bağlamaktan daha fazlasını yapar; ekiplerin nasıl işbirliği yaptığını, sorunları çözdüğünü ve daha büyük ölçekte değer yarattığını yeniden tanımlar.

Yapay zeka düzenleme platformları, çeşitli yapay zeka modellerini, veri kaynaklarını ve süreçlerini tek bir otomatik sistemde bir araya getirerek karmaşık iş akışlarını basitleştirir. Planlama, kaynak dağıtımı ve API entegrasyonu gibi görevleri yöneterek manuel çabayı en aza indirirken hem geliştirme süresini hem de operasyonel giderleri önemli ölçüde azaltırlar.

Bu platformlar, zahmetsizce ölçeklendirilecek şekilde tasarlanmıştır ve işletmelerin, altyapılarını elden geçirmeden bir avuç görevi yerine getirmekten binlercesini yönetmeye kadar genişlemesine olanak tanır. Büyük hacimli verileri işleme, kaynak kullanımını daha verimli hale getirme ve tutarlı gözetim sağlama konusunda uzmandırlar. Bu, daha hızlı dağıtımlara, gelişmiş üretkenliğe ve kuruluşların dinamik ihtiyaçlarını karşılamak için daha iyi donatılmış yapay zeka çözümlerine yol açar.

Yapay zeka orkestrasyon platformları genellikle harcamaları kullanıma dayalı fiyatlandırma modelleri aracılığıyla karşılayarak işletmelerin sabit lisanslara bağlı kalmak yerine yalnızca kullandıkları kadar ödeme yapmasına olanak tanır. Bu platformların çoğu, harcamaları modele veya iş akışına göre izlemeye yönelik gösterge tabloları, bütçe uyarı sistemleri ve ayrıntılı maliyet analizi için iş yükü etiketleme gibi gerçek zamanlı finansal araçlarla donatılmıştır. Bu araçlar, işletmelerin yapay zeka ile ilgili harcamalarını net bir şekilde görebilmelerini ve bütçeleri üzerinde kontrol sahibi olmalarını sağlar.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai, 2025'te güvenli yapay zeka orkestrasyonu için standardı belirliyor ve işletmelere yapay zeka operasyonlarını zahmetsizce ölçeklendirmeleri için güvenilir bir platform sunuyor. Yerleşik yönetim araçları, gerçek zamanlı maliyet takibi ve değişmez denetim izleri içeren birleşik kontrol paneli, yönetimi basitleştirmek için tasarlanmıştır. Bu özellikler, işletmelerin AI iş akışlarının tam gözetimini sürdürürken uyumlu kalmasını sağlar.

Rol tabanlı erişim kontrolü, uçtan uca şifreleme ve sürekli uyumluluk izleme gibi kurumsal düzeyde güvenlik önlemleriyle donatılmış Prompts.ai, hassas verileri operasyonun her aşamasında korur. 35'ten fazla lider LLM'nin tek bir güvenli çerçeveye entegrasyonuyla riskleri azaltır ve işletmelerin yapay zeka yeteneklerini güven ve verimlilikle genişletmelerine olanak tanır.