AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Ekibiniz ve iş akışlarınız için doğru çerçeveyi bulmak için daha derine inin.

Prompts.ai, kurumsal kullanıcıları GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro ve Kling dahil olmak üzere hepsi tek bir arayüz üzerinden erişilebilen 35'ten fazla önde gelen yapay zeka modeline bağlayan merkezi, bulut tabanlı bir platform olarak hizmet veriyor. Herhangi bir yazılım kurulumu gerekmediğinden, her büyüklükteki ekibin yapay zekayı iş akışlarına dahil etmesi kolaydır.

Platform, yapay zekanın benimsenmesinde büyük bir zorluğun üstesinden geliyor: araçların yayılması. Birleşik bir ortam sağlayarak model seçimini, hızlı iş akışlarını ve performans takibini tek bir sistemde birleştirir. Bu yaklaşım, yapay zeka kullanımını dağınık, tek seferlik deneylerden, kuruluşların departmanlar arasında kolaylıkla dağıtabileceği tutarlı, ölçeklenebilir süreçlere kaydırıyor.

Prompts.ai, kurumsal yapay zeka iş akışlarını otomatikleştirmeye odaklanarak kuruluşların yönetişimle ilgili endişeleri giderirken gereksiz maliyetleri azaltmasına yardımcı olur. Fortune 500 şirketlerinden yaratıcı ajanslara ve araştırma laboratuvarlarına kadar kullanıcılar, hassas verilerin birden fazla üçüncü taraf hizmetine maruz kalması riskine girmeden uyumlu, denetlenebilir iş akışları oluşturabilir.

Platform, GenAI.Works tarafından kurumsal sorun çözme ve otomasyon için en iyi yapay zeka çözümü olarak tanındı ve 5 üzerinden 4,8'lik etkileyici bir kullanıcı puanı aldı. Şirketler, içerik oluşturmayı kolaylaştırmak, stratejik iş akışlarını otomatikleştirmek ve teklif geliştirmeyi hızlandırmak gibi görevler için Prompts.ai'ye güveniyor. Bazı durumlarda haftalar süren projeler artık sadece bir güne indirildi.

Dikkate değer bir örnek, serbest çalışan AI direktörü Johannes Vorillon'un Google DeepMind Veo2 animasyonlarını Breitling ve Fransız Hava Kuvvetleri için bir tanıtım videosuna sorunsuz bir şekilde entegre etmek için platformu kullandığı Mayıs 2025'ten geliyor. Bu proje, Prompts.ai'nin birden fazla yapay zeka aracının sorunsuz bir şekilde düzenlenmesini nasıl mümkün kıldığını vurguladı.

Prompts.ai, tek bir arayüz üzerinden 35'ten fazla dil ve görüntü modeline erişimi entegre ederek ekiplerin yapay zeka ile çalışma şeklini basitleştirir. Bu, birden fazla aboneliği, API anahtarını ve faturalandırma sistemini yönetme zorluğunu ortadan kaldırır. Kullanıcılar, belirli görevlere yönelik farklı modelleri tek bir iş akışında birleştirerek kesintisiz düzenleme hatları oluşturabilir.

Platform, tüm modellerde kullanımı standartlaştıran, maliyet takibini ve kaynak tahsisini kolaylaştıran bir TOKN kredi sistemi üzerinde çalışıyor. Ekipler performans gereksinimlerine göre modeller arasında gerektiği gibi geçiş yapabilir. İş planları sınırsız çalışma alanları ve ortak çalışanlar içerir, bu da kuruluşların yapay zekanın benimsenmesini ölçeklendirmesini kolaylaştırır.

Kullandıkça öde fiyatlandırma modeliyle Prompts.ai, ilk keşif için ayda 0 ABD dolarından başlayarak maliyetleri gerçek kullanımla uyumlu hale getiriyor. Üye başına aylık 99 ila 129 ABD Doları arasında değişen iş planları, tüm katmanlarda çeşitli düzeylerde TOKN kredisi (250.000 ila 1.000.000) ve 10 GB bulut depolama alanı sunar.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 Haziran 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

İş planları (Core, Pro ve Elite), mevzuat gerekliliklerini karşılamak için yapay zeka etkileşimlerine ilişkin tam görünürlük sunan ve ayrıntılı denetim izlerini sürdüren uyumluluk izleme ve yönetişim yönetimine yönelik araçlar içerir. Kişisel İçerik Oluşturucu ve Aile planlarını kullanan daha küçük ekipler ve bireysel profesyoneller bile bu kurumsal düzeyde yönetim özelliklerinden yararlanır.

Hassas veriler merkezi, kontrollü bir ortamda tutularak bilgilerin birden fazla üçüncü taraf hizmetine yayılmasıyla ilişkili riskler azaltılır. Bu güvenli mimari, yalnızca olası güvenlik açıklarını en aza indirmekle kalmaz, aynı zamanda katı düzenlemeler altında faaliyet gösteren kuruluşlar için uyumluluk yönetimini de basitleştirir.

Bulutta yerel bir mimariyle tasarlanan Prompts.ai, kuruluşların zahmetsizce ölçeklenmesine olanak tanır. Ekipler dakikalar içinde yeni üyeler ekleyebilir, çalışma alanlarını genişletebilir ve ek modellere erişebilir; böylece yapay zekanın benimsenmesinin gerektiği kadar hızlı bir şekilde artmasını sağlar.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI, konuşma arayüzleriyle desteklenen bir iş akışı otomasyon çözümü sunuyor. Dağıtım mimarisi ve düzenleme yöntemleri hakkındaki belirli ayrıntılar kamuya açık olmasa da, konuşma arayüzlerine yapılan vurgu, iş akışı otomasyonunu kolaylaştırmada benzersiz bir açıyı vurguluyor.

IBM watsonx Orchestra, otomasyonu yalnızca geliştiriciler için değil iş profesyonelleri için de erişilebilir kılmaya odaklanarak yapay zeka destekli otomasyonu kurumsal operasyonlara getiriyor. Kullanıcıların doğal dil komutları vermesini sağlayan platform, İK, finans, satış, müşteri desteği ve satın alma alanlarında teknik olmayan ekiplerin karmaşık görevlerini basitleştiriyor. Bu yaklaşım, kodlama uzmanlığına olan ihtiyacı ortadan kaldırarak iş ekiplerinin süreçleri bağımsız olarak otomatikleştirmesine olanak tanır.

Platform, çoğu zaman çalışanların zamanını tüketen tekrarlayan görevleri otomatikleştirme konusunda öne çıkıyor. Kullanıcılar basit dil komutlarıyla görüşmeleri planlamak, aday profillerini özetlemek, kredileri işlemek ve raporlar oluşturmak gibi görevler için iş akışlarını başlatabilir. watsonx Orchestra, kurumsal düzeyde güvenlik standartlarına bağlı kalarak bu etkinlikleri birden fazla arka uç sisteminde gerçekleştirir.

Örneğin büyük bir finans kurumu, müşteri desteğini ve arka ofis işlevlerini kolaylaştırmak için Watsonx Orchestra'yı uygulamaya koydu. Çalışanlar, kredi işleme ve hizmet taleplerine yönelik iş akışlarını otomatikleştirmek için doğal dil girişlerini kullandı. Platform, arka uç sistemlerle sorunsuz bir şekilde entegre oldu, yerleşik yönetişim aracılığıyla uyumluluğu korudu ve gözle görülür iyileştirmeler sağladı: daha hızlı işlem süreleri, daha az manuel hata ve daha yüksek müşteri memnuniyeti. Bu örnek, platformun rutin kurumsal görevleri verimli, otomatikleştirilmiş süreçlere dönüştürme yeteneğini vurgulamaktadır.

IBM watsonx Orchestra, iş akışlarının bulutta, şirket içinde veya her ikisinde birden çalıştırılmasına olanak tanıyan hibrit bulut devreye alma seçenekleri sunar. Bu esneklik, katı veri yerleşimi politikalarına veya eski altyapıya sahip kuruluşlar için özellikle değerlidir. Platform, görevleri güvenli bir şekilde yürütmek için Büyük Dil Modellerinden (LLM'ler), API'lerden ve kurumsal uygulamalardan yararlanarak çeşitli operasyonel ortamlarla uyumluluk sağlar.

watsonx Orchestra, çeşitli sistemlerle sorunsuz bir şekilde bütünleşerek onu kurumsal otomasyon için sağlam bir çözüm haline getiriyor. Görsel bağlayıcıları ve API'leri kullanarak CRM, ERP ve AWS ve Azure gibi bulut platformlarına bağlanır. Ayrıca IBM Watson hizmetleri ve diğer IBM yapay zeka modelleriyle yakın işbirliği içinde çalışarak yeteneklerini temel iş akışı otomasyonunun ötesine taşıyor. İleri düzey kullanıcılar için programatik API erişimi, daha fazla özelleştirmeye ve mevcut araçlarla entegrasyona olanak tanır.

__XLATE_18__

"IBM watsonx Orchestra, yapay zeka destekli otomasyonu doğrudan iş iş akışlarına taşımak için tasarlandı. Geliştirici merkezli araçların aksine, watsonx Orchestra, ağır kodlama olmadan görevleri kolaylaştırmak isteyen İK, finans, satış ve müşteri desteği alanındaki profesyonelleri hedefliyor." - Domo

Platform aynı zamanda önceden oluşturulmuş yapay zeka uygulamalarını ve sektöre özel beceri setlerini de içererek yaygın kullanım senaryolarının daha hızlı uygulanmasını sağlıyor. Ancak kuruluşların, daha geniş entegrasyon seçeneklerine sahip platformlarla karşılaştırıldığında işlevselliğinin IBM ekosistemi dışında daha sınırlı olabileceğini unutmaması gerekir.

IBM watsonx Orchestra, güçlü yönetişim çerçevesiyle öne çıkıyor ve bu da onu düzenlemeye tabi endüstriler için tercih edilen bir seçenek haline getiriyor. Rol bazlı erişim kontrolleri, veri erişiminin yetkili kullanıcılarla ve belirli işlevlerle sınırlandırılmasını sağlar.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

Hibrit ortamlarda ölçeklendirmek üzere tasarlanan watsonx Orchestra, hem küçük ekipleri hem de büyük işletmeleri destekler. Operasyonel verimliliği artırır, politika uyumluluğunu sağlar, riskleri azaltır ve çalışan verimliliğini artırır. Kuruluşlar, belirli departmanlara odaklanarak küçük başlayabilir ve sonuçları gördükçe ve şirket içi uzmanlık geliştirdikçe otomasyon yeteneklerini kademeli olarak genişletebilir.

Apache Airflow, yönlendirilmiş döngüsel olmayan grafikleri (DAG'ler) kullanarak karmaşık veri iş akışlarını düzenlemek için oluşturulmuş açık kaynaklı bir platformdur. Başlangıçta Airbnb tarafından geliştirilen ve şimdi Apache Software Foundation altında geliştirilen bu yazılım, veri hatlarını planlamak, izlemek ve yönetmek için popüler bir seçim haline geldi. Ticari kullanıcılar için özel olarak tasarlanmış otomasyon araçlarının aksine Airflow, veri mühendisleri ve geliştiriciler düşünülerek tasarlanmıştır ve iş akışının yürütülmesi üzerinde programatik kontrol sunar.

Airflow, karmaşık bağımlılıklar, zamanlanmış görevler ve dönüşüm mantığı içeren veri hatlarını yönetmede öne çıkıyor. Veri ekipleri, ETL (Çıkarma, Dönüştürme, Yükleme) süreçlerini koordine etmek, makine öğrenimi modellerini eğitmek, toplu işleme işlerini yürütmek, birden fazla kaynaktan veri almak, veri kümelerini dönüştürmek ve bir programa göre raporlar oluşturmak dahil olmak üzere çeşitli amaçlar için buna güvenir. Geliştiriciler, Python'da iş akışları tanımlayarak özel mantığı uygulamak ve hataları etkili bir şekilde ele almak için kapsamlı esneklik kazanır.

Platform, iş akışı durumuna, görev bağımlılıklarına ve yürütme geçmişine ilişkin öngörüler sağlayan görsel bir arayüz içerir. Bu, performansı izlemeyi ve arızaları gidermeyi kolaylaştırır. Örneğin, bir görev başarısız olursa Airflow, kademeli sorunları önlemek için görevi otomatik olarak yeniden deneyebilir, uyarılar gönderebilir veya sonraki görevleri atlayabilir. Bu işlevsellik, onu değişen dağıtım ihtiyaçları için çok yönlü bir seçim haline getirir.

Airflow, tek sunuculu bir kurulum olarak dağıtılabilir veya planlayıcının, çalışanların ve web sunucusunun ayrı makinelerde çalıştığı dağıtılmış kümelere ölçeklendirilebilir. Mimari birkaç temel bileşenden oluşur: görevleri tanımlanmış programlara göre tetikleyen bir zamanlayıcı, görevleri yürüten çalışanlar, kullanıcı arayüzü için bir web sunucusu ve iş akışı tanımlarını ve yürütme geçmişini saklayan bir meta veri veritabanı.

Bu modüler tasarım, kuruluşların iş yükü taleplerine bağlı olarak çalışan kapasitesini bağımsız olarak ölçeklendirmesine olanak tanır. Bulut tabanlı ortamlarda, Kubernetes genellikle Airflow'u dağıtmak için kullanılır ve KubernetesExecutor bireysel görevler için yalıtılmış bölmeler oluşturur. Bu kurulum, kaynak yalıtımını geliştirir ve ekiplerin her görev için belirli bilgi işlem kaynaklarını tahsis etmesine olanak tanır. Altyapı yönetimi yükünü azaltmak isteyenler için yönetilen Airflow hizmetleri mevcuttur, ancak bunlar ek işletim maliyetlerine de sahiptir.

Airflow'un kapsamlı entegrasyon yetenekleri onu son derece uyarlanabilir kılar. Veritabanları, bulut platformları, veri ambarları ve mesajlaşma sistemleri için önceden oluşturulmuş bağlayıcıların yanı sıra Python kullanarak özel operatörler oluşturma olanağı sunar. Bu esneklik, Airflow'un çeşitli organizasyonel gereksinimleri karşılayabilmesini sağlar.

Python'un zengin kütüphane ekosistemi, iş akışları içinde de kullanılabilir ve doğrudan ardışık düzen tanımlarında gelişmiş veri dönüşümlerine ve analizlere olanak tanır. AI ve makine öğrenimi uygulamaları için Airflow, TensorFlow, PyTorch ve scikit-learn gibi çerçevelerle sorunsuz bir şekilde bütünleşir. Bu entegrasyonlar, veri bilimcilerinin verileri getirme, özellikleri ön işleme, modelleri eğitme, performansı değerlendirme ve modelleri üretime dağıtma gibi görevlere yönelik iş akışlarını düzenlemesine yardımcı olur.

Airflow, iş akışları ve yönetim işlevleri genelinde kullanıcı izinlerini yönetmek için rol tabanlı erişim kontrolünü (RBAC) içerir. Yöneticiler belirli ayrıcalıklara sahip rolleri tanımlayarak yalnızca yetkili kullanıcıların belirli DAG'leri görüntüleyebilmesini, düzenleyebilmesini veya yürütebilmesini sağlayabilir. Bu ayrıntılı kontrol, iş akışı bütünlüğünün korunmasına yardımcı olur ve yetkisiz değişiklikleri önler.

Kimlik doğrulama seçenekleri arasında şifre tabanlı oturum açma, LDAP entegrasyonu ve OAuth sağlayıcıları bulunur. Hassas kimlik bilgileri Airflow'un bağlantıları ve değişkenleri sistemi aracılığıyla ayrı olarak yönetilir. Gelişmiş güvenlik için HashiCorp Vault veya AWS Secrets Manager gibi harici gizli bilgi yönetimi araçları entegre edilebilir.

Denetim günlüğü, kullanıcı eylemlerini ve iş akışı yürütmelerini izleyen başka bir önemli özelliktir. Bu, uyumluluk ve sorun giderme amaçları açısından çok değerli olan ayrıntılı bir etkinlik kaydı oluşturur.

Artan iş yüklerini karşılamak için daha fazla çalışan düğümü ekleyerek hava akışı yatay olarak ölçeklenir. Platform, görevleri etkili bir şekilde dağıtmak için çeşitli yürütücü türlerini destekler: LocalExecutor, görevleri zamanlayıcıyla aynı makinede çalıştırır, CeleryExecutor, bir mesaj kuyruğunu kullanarak görevleri birden fazla çalışan makineye yayar ve KubernetesExecutor, her görev için yalıtılmış bölmeleri döndürür.

Performansı optimize etmek için dikkatli DAG tasarımı ve kaynak tahsisi çok önemlidir. Yüksek görev hacimleri zamanlayıcıyı zorlayabilir; bu nedenle ekipler genellikle büyük DAG'leri böler, zamanlayıcı ayarlarını düzenler ve meta veri deposunun yeterli kaynaklara sahip olmasını sağlar.

Airflow ayrıca dolguları verimli bir şekilde yöneterek iş akışı mantığı değiştiğinde ekiplerin geçmiş verileri yeniden işlemesine olanak tanır. Dolgu, güncellemeleri kolaylaştırırken önemli miktarda bilgi işlem kaynağı tüketebilir ve üretim iş yüklerinde kesintileri önlemek için dikkatli planlama gerektirir.

Açık kaynaklı olan Airflow, kuruluşlara dağıtımları üzerinde tam kontrol sağlar. Ancak bu aynı zamanda altyapıyı, izlemeyi ve yükseltmeleri yönetmeleri gerektiği anlamına da gelir; bu da güvenilirliği ve performansı belirli ölçekte korumak için özel mühendislik kaynakları gerektirir.

Kubeflow, daha genel amaçlı iş akışı araçlarından farklı olarak, makine öğrenimi iş akışlarını yönetmek için özel bir platform olarak öne çıkıyor. Kubernetes için özel olarak tasarlanan bu açık kaynaklı çözüm, makine öğrenimi yaşam döngüsünün tamamını destekleyerek veri bilimcilere ve makine öğrenimi mühendislerine Kubernetes'in yerel yeteneklerini kullanarak üretime hazır modeller oluşturmak, dağıtmak ve yönetmek için ihtiyaç duydukları araçları sağlar.

Kubeflow, Kubernetes ortamlarında makine öğrenimi iş akışlarının tamamını düzenlemek için tasarlandı. Veri ön işleme, özellik mühendisliği, model eğitimi, doğrulama, dağıtım ve izleme dahil olmak üzere makine öğrenimi yaşam döngüsünün her aşamasını kapsar. Ekiplerin modüler ve yeniden kullanılabilir işlem hatları oluşturmasına olanak tanıyan Kubeflow, dağıtılmış makine öğrenimi iş yüklerinin yönetimini basitleştirir. Merkezi yaklaşımı aynı zamanda çeşitli projelerde deney takibine ve model gözetimine de yardımcı olur. Ek olarak Kubeflow, yeni veriler sunulduğunda yeniden eğitim iş akışlarını otomatikleştirerek modellerin güncel ve alakalı kalmasını sağlayabilir.

Kubernetes üzerine inşa edilen Kubeflow, makine öğrenimi iş akışlarını optimize etmek için konteyner orkestrasyonu, dinamik ölçeklendirme ve kaynak yönetiminden yararlanır. Kullanıcılar, görsel yönetim için web tabanlı bir arayüz veya otomasyon için bir komut satırı arayüzü aracılığıyla platformla etkileşime girebilir. İş yüküne bağlı olarak Kubeflow, eğitim görevleri için GPU'ların ve çıkarım için CPU'ların sağlanması gibi kaynakları dinamik olarak tahsis eder. Esnekliği, ister şirket içinde, ister bulutta ister hibrit kurulumlarda olsun, herhangi bir Kubernetes kümesinde dağıtıma izin vererek ortamlar arasında uyarlanabilirlik sağlar.

Kubeflow, TensorFlow, PyTorch ve XGBoost gibi popüler makine öğrenimi çerçeveleriyle sorunsuz bir şekilde bütünleşirken aynı zamanda genişletilebilir tasarımı aracılığıyla özel çerçeveleri de destekler. ML çerçevelerinin ötesinde, çeşitli bulut hizmetlerine ve depolama çözümlerine bağlanarak işlem hatlarının veriler için nesne depolamaya, özellik alımı için veri ambarlarına ve performansı izlemek için izleme araçlarına erişmesine olanak tanır. Python kitaplıklarıyla uyumluluğu, deneyden üretime geçişi daha da kolaylaştırır.

Kubeflow, iş yüklerini küme kaynakları arasında dağıtmak için Kubernetes'in doğal ölçeklendirme yeteneklerini kullanır ve bu da onu büyük ölçekli eğitim ve veri işleme görevleri için çok uygun hale getirir. Bu, verimli kaynak kullanımı sağlar ve yüksek performanslı makine öğrenimi işlemlerini destekler. Akka'nın çok yerinde bir şekilde ifade ettiği gibi:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Kaynakları bağımsız olarak tahsis etme yeteneği sayesinde Kubeflow, deneme ve üretim arasındaki boşluğu doldurarak hem esneklik hem de performans sunar.

Flyte, Kubernetes kullanarak konteynerli makine öğrenimi (ML) iş akışlarının yönetimini kolaylaştırmak için tasarlanmış, bulutta yerel bir orkestrasyon platformudur. Kaynakları bulut ortamları arasında verimli bir şekilde dağıtarak ML işlem hatlarını dağıtmanın karmaşıklığını ortadan kaldırır. Bu yaklaşım, dağıtım boyutu ne olursa olsun sorunsuz ölçeklendirme ve tutarlı performans sağlar.

Flyte, her ölçekteki makine öğrenimi iş akışlarını yönetmek ve değişen talepleri karşılamak için kaynakları dinamik olarak tahsis etmek üzere tasarlanmıştır. Sağlam mimarisi, iş yüklerinin verimli bir şekilde yönetilmesini sağlar ve bu da onu bulut tabanlı altyapılarda çok çeşitli makine öğrenimi görevleri için güvenilir bir seçim haline getirir.

Prefect, karmaşık veri hatlarını ve makine öğrenimi iş akışlarını yönetmeyi kolaylaştırmak için tasarlanmış Python tabanlı bir düzenleme platformudur. Kullanım kolaylığı, net izleme ve operasyonel engellerin en aza indirilmesine odaklanarak veri bilimcilerin ve mühendislerin altyapı konusunda endişelenmek yerine iş akışları oluşturmaya odaklanmasına olanak tanır.

Prefect, makine öğrenimi işlem hatlarını, bulut iş akışlarını ve veri dönüştürme süreçlerini otomatikleştirmede öne çıkıyor. Birden fazla bağımlılık, paralel yürütme ve gerçek zamanlı işleme içeren ETL görevlerini ve karmaşık makine öğrenimi iş akışlarını yönetmek için özellikle uygundur. Esnek planlama sistemi, görevlerin zaman aralıklarına, belirli olaylara veya API çağrılarına göre tetiklenmesini sağlayarak çeşitli otomasyon ihtiyaçlarına uyarlanabilir hale getirir.

Prefect, bulut ortamları için optimize edilmiş olup modern altyapı taleplerine ölçeklenebilmesini ve uyum sağlayabilmesini sağlar. Python'da yerel olarak oluşturulmuş olup, Python tabanlı veri ekosistemleriyle sorunsuz bir şekilde bütünleşerek yeni programlama dilleri veya araçları öğrenme ihtiyacını ortadan kaldırır.

Prefect, çok çeşitli veri araçları ve platformlarıyla kusursuz uyumluluk sunar. Dbt, PostgreSQL, Snowflake ve Looker gibi popüler araçlarla zahmetsizce entegre olurken aynı zamanda Apache Kafka gibi gerçek zamanlı sistemleri de destekler. Bulut ortamları için Amazon Web Services (AWS), Google Cloud Platform (GCP) ve Microsoft Azure gibi büyük sağlayıcılarla çalışarak ekiplere iş yüklerini maliyet ve performansa göre optimize etme esnekliği sağlar. Ayrıca Prefect, Docker ve Kubernetes gibi konteynerleştirme araçlarını destekler ve Dask ve Apache Spark gibi dağıtılmış işleme çerçeveleriyle çalışır. Ekipleri bilgilendirmek amacıyla iş akışı güncellemeleri için Slack bildirimleri de sağlar.

Prefect, artan veri hacimlerini ve artan iş akışı karmaşıklığını kolaylıkla yönetecek şekilde tasarlanmıştır. Hataya dayanıklı motoru, iş akışlarının, başarısız görevleri yeniden deneyerek veya sorunları atlayarak hatalardan kurtulmasını sağlar ve bu da onu üretim ortamlarında son derece güvenilir kılar. Gerçek zamanlı izleme, iş akışının yürütülmesine ilişkin ayrıntılı bilgiler sunarak ekiplerin sorunları hızlı bir şekilde tanımlamasına ve çözmesine yardımcı olur. Verimli bir şekilde ölçeklendirme yeteneği sayesinde, büyük teknoloji şirketleri dinamik iş akışlarını yönetme konusunda Prefect'e güvenmektedir. Prefect, yeni başlayan ekipler için ücretsiz bir plan sunarken, ek özellikler ve destek gerektiren daha büyük dağıtımlar için özel fiyatlandırma mevcuttur.

Metaflow, ilk olarak Netflix tarafından makine öğrenimi iş akışlarının ölçeklendirilmesindeki zorlukların üstesinden gelmek için geliştirilen bir makine öğrenimi altyapı platformudur. Veri bilimcilerin karmaşık altyapıyla uğraşmadan prototiplerden üretime sorunsuz bir şekilde geçmelerine yardımcı olarak süreçleri kullanıcı dostu ve verimli hale getirmeye odaklanır.

Metaflow, ölçeklenebilir, üretim düzeyinde makine öğrenimi iş akışlarını yönetmek için tasarlanmıştır. Keşif amaçlı veri analizi ve model eğitiminden dağıtıma kadar olan yolculuğu basitleştirir. Veri bilimcileri tanıdık kitaplıkları kullanarak Python'da iş akışları yazabilir; platform ise sürüm oluşturma, bağımlılık yönetimi ve bilgi işlem kaynaklarının otomatik olarak tahsis edilmesiyle ilgilenir.

Platform, gerekli bilgi işlem kaynaklarını otomatik olarak sağlayarak manuel altyapı yönetimi ihtiyacını ortadan kaldırır. Bu, herhangi bir kod değişikliği gerektirmeden yerel geliştirmeden bulut üretimine sorunsuz geçişe olanak tanır.

__XLATE_53__

"Metaflow, üretime hazır dağıtım için kolaylaştırılmış bulut entegrasyonları, sağlam sürüm oluşturma ve altyapı soyutlaması sunarak ölçeklenebilir makine öğrenimi iş akışlarını basitlikle yönetiyor." - Akka.io

Metaflow'un dağıtım süreci, bulut hizmetleri ve veri platformlarıyla kolayca entegre olma yeteneği ile tamamlanmaktadır. Python'a özgü tasarımı, makine öğrenimi, veri işleme ve görselleştirme için yaygın olarak kullanılan kitaplıklarla uyumluluk sağlayarak ekiplerin halihazırda güvendikleri araçları en üst düzeye çıkarmasına olanak tanır.

Orijinal olarak Netflix tarafından kapsamlı makine öğrenimi işlemlerini desteklemek üzere oluşturulan Metaflow, güçlü bir sürüm oluşturma sistemine sahiptir. Bu sistem deneyleri, veri kümelerini ve model versiyonlarını takip ederek deneylerin tekrarlanabilir olmasını sağlar ve gerektiğinde kolay geri alma olanağı sağlar.

Dagster, uyarlanabilir işlem hattı yönetimi sunarken veri bütünlüğünü korumaya odaklanarak düzenleme çerçeveleri serisine katkıda bulunur. Bu açık kaynaklı araç, kaliteyi artırmak, veri kökenini takip etmek ve makine öğrenimi (ML) iş akışlarında görünürlük sağlamak için tasarlanmıştır. Dagster, özünde, yüksek veri bütünlüğü standartlarını destekleyen ve dönüşümlere ilişkin net bilgiler sağlayan, tür açısından güvenli, güvenilir veri hatları oluşturma konusunda uzmanlaşmıştır.

Dagster, veri kalitesi ve hassasiyetin tartışmasız olduğu makine öğrenimi iş akışlarını yönetmek için özellikle etkilidir. Süreçleri boyunca yerleşik doğrulamaya, sağlam meta veri takibine ve kapsamlı gözlemlenebilirliğe ihtiyaç duyan ekipler için özel olarak tasarlanmıştır. Kullanımının pratik bir örneği, kuruluşların hassas sağlık hizmeti verilerini katı uyumluluk ve kalite kriterlerini karşılamak için gereken bütünlük düzeyiyle işleme konusunda Dagster'a güvendiği sağlık sektöründe görülebilir.

Dagster, geliştiricilerin karmaşık iş akışlarını doğrudan kodda tanımlamasına olanak tanır; bu, yapay zeka operasyonlarını ölçeklendirmek için önemli bir özelliktir. Modüler yapısı, otomatik bağımlılık yönetimi, yeniden deneme mekanizmaları ve paralel yürütmeyle tamamlanan gelişmiş iş akışları oluşturmak için modelleri ve aracıları zincirlemeyi destekler. Ek olarak Dagster, çeşitli bulut platformları, API'ler ve vektör veritabanlarıyla sorunsuz bir şekilde entegre olur ve bu da onu büyük ölçekli veriler ve yapay zeka görevlerinin yönetimi için çok uygun hale getirir.

Bu esnek mimari, çeşitli sistemlerle sorunsuz entegrasyon sağlar.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen, Microsoft Research tarafından geliştirilen ve birden fazla yapay zeka aracısının karmaşık görevlerin üstesinden gelmek için konuşma yoluyla işbirliği yapmasına olanak tanıyan açık kaynaklı bir çerçevedir. Bu sistem, geliştiricilerin, uzman temsilcilerin birlikte çalıştığı, her birinin ortak hedeflere ulaşmak için benzersiz uzmanlığına katkıda bulunduğu uygulamalar oluşturmasına olanak tanır. AutoGen, etkileşimli bir arayüz sunarak, çoğu zaman karmaşık olan birden fazla yapay zeka bileşenini koordine etme sürecini basitleştirir.

AutoGen, diyaloğu bir işbirliği aracı olarak kullanarak çok aracılı orkestrasyona yeni bir yaklaşım getiriyor. Bu çerçeve, birden fazla aracının dinamik olarak birlikte çalışmasını gerektiren sorun çözme senaryolarında özellikle etkilidir. Örneğin, yazılım geliştirmede, bir aracı kod üretirken diğeri test ve doğrulamaya odaklanırken her iki aracı da çıktıyı iyileştirmek için yineleme yapabilir. Bu etkileşimli model, yazılım iş akışlarını otomatikleştirmek, araştırmaya yardımcı olmak ve farklı bakış açıları veya becerilerin sonuçları iyileştirdiği karmaşık karar verme süreçlerini yönetmek gibi görevlere doğal bir uyum sağlar.

İş akışlarında sürekli iyileştirmeyi hedefleyen ekipler AutoGen'i özellikle çekici buluyor. Temsilciler arasındaki ileri geri alışverişi kolaylaştırma yeteneği, insan işbirliğini yansıtarak geliştiricilerin sürekli diyalog ve geri bildirim yoluyla gelişen ve iyileşen sistemler tasarlamasını kolaylaştırır.

AutoGen, etkileşimli aracı tasarımıyla öne çıkarken modülerliği vurguluyor. Her aracı, araçlara, harici API'lere veya dil modellerine erişimi içerebilen belirli roller ve talimatlarla çalışır. Çerçeve, insan girdisini birleştiren hem otonom aracıları hem de kullanıcı proxy aracılarını destekleyerek iş akışlarının yönetilmesinde esneklik sunar.

Sistem, geliştirme sırasında yerel olarak çalışabilir ve üretim için bulut ortamlarına ölçeklenebilir. Geliştiriciler, aracıların nasıl etkileşimde bulunduğunu tanımlayabilir; aracıların sırayla hareket ettiği sıralı iş akışları veya birden fazla aracının aynı anda katkıda bulunduğu daha karmaşık modeller aracılığıyla. Python tabanlı yapılandırmaları kullanan ekipler, okunabilirlikten ödün vermeden orkestrasyon mantığı üzerinde tam kontrol elde ederek çoklu aracı etkileşimlerini yönetme sürecini kolaylaştırır.

AutoGen, birden fazla model çağrısını ve temsilci görüşmesini yönetmenin karmaşıklığını ele alarak geliştiricilerin altyapı konusunda endişelenmek yerine sistemlerinin mantığını ve davranışını oluşturmaya odaklanmasına olanak tanır.

AutoGen, işlev çağrıları aracılığıyla Azure OpenAI Hizmeti ve diğer modellerle sorunsuz bir şekilde bütünleşerek geliştiricilere AI arka uçlarını seçme konusunda esneklik sağlar. Ayrıca aracıların harici araçlara ve hizmetlere bağlanmasını da destekleyerek, görüşmeleri sırasında verileri almalarına, kod yürütmelerine veya üçüncü taraf API'lerle etkileşimde bulunmalarına olanak tanır.

Çerçeve, geliştiricilerin özel aracı türleri, yeniden kullanılabilir konuşma kalıpları ve düzenleme şablonları oluşturmasına olanak tanır. Bu esneklik, ekiplerin ortak görevler için önceden var olan kalıplardan yararlanırken, özel ihtiyaçlara göre derinlemesine özelleştirebilmesi anlamına gelir.

AutoGen, halihazırda Microsoft araçlarını kullanan kuruluşlar için Azure hizmetleri, Visual Studio Code ve diğer geliştirme platformlarıyla kolay entegrasyon sağlar. Microsoft ekosistemiyle bu uyumluluğa rağmen çerçeve platformdan bağımsızdır ve çeşitli teknoloji ortamlarında iyi çalışır.

AutoGen, aracı yeteneklerinin kontrol edilmesine ve dış kaynaklara erişimin yönetilmesine büyük önem vermektedir. Geliştiriciler, her aracı için hangi API'lere erişebilecekleri veya hangi verileri almalarına izin verildiği gibi belirli izinleri tanımlar. Bu ayrıntılı yaklaşım, aracıların en az ayrıcalık ilkeleri altında çalışmasını ve yalnızca rolleri için gerekli görevleri yerine getirmesini sağlar.

Çerçevenin konuşmaya dayalı doğası, doğası gereği denetim izleri, günlük kaydı yapan aracı etkileşimleri ve karar verme süreçleri yaratır. Bu günlükler, çıktıların nasıl oluşturulduğu konusunda şeffaflık sağlayarak uyumluluk ve hata ayıklama çabalarına yardımcı olur. Ekipler, temsilci davranışını analiz etmek ve iyileştirilecek alanları belirlemek için bu kayıtları inceleyebilir.

Döngüdeki insan yetenekleri, kritik karar noktalarında iş akışlarının insan tarafından incelenmek üzere duraklatılmasına izin vererek gözetimi geliştirir. Bu özellik, otomasyon verimliliğini yönetişim ve kontrolle dengeleyerek hassas eylemlerin ilerlemeden önce değerlendirilebilmesini sağlar.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

Kuruluşlar, konuşma bağlamını önbelleğe alarak, rutin görevler için daha hızlı modeller kullanarak ve karmaşık akıl yürütme için daha gelişmiş modelleri ayırarak performansı artırabilir. Gereksiz alışverişleri en aza indirecek konuşma kalıpları tasarlamak da verimliliği artırır. Uygun olduğunda çerçeve, paralel aracı yürütmeyi destekleyerek bağımsız görevlerin sıralı yerine eş zamanlı olarak yürütülmesine olanak tanır.

AutoGen, yüksek iş yüklerinin üstesinden gelmek için otomatik ölçeklendirmeli bulut altyapısına yerleştirilebilir ve böylece sistemin değişen talepleri yönetirken maliyetleri kontrol altında tutabilmesi sağlanır. Durum bilgisi olmayan aracı etkileşimleri yatay ölçeklendirmeyi basitleştirir, ancak borsalar arasında bağlamı korumak dikkatli bir mimari planlama gerektirir.

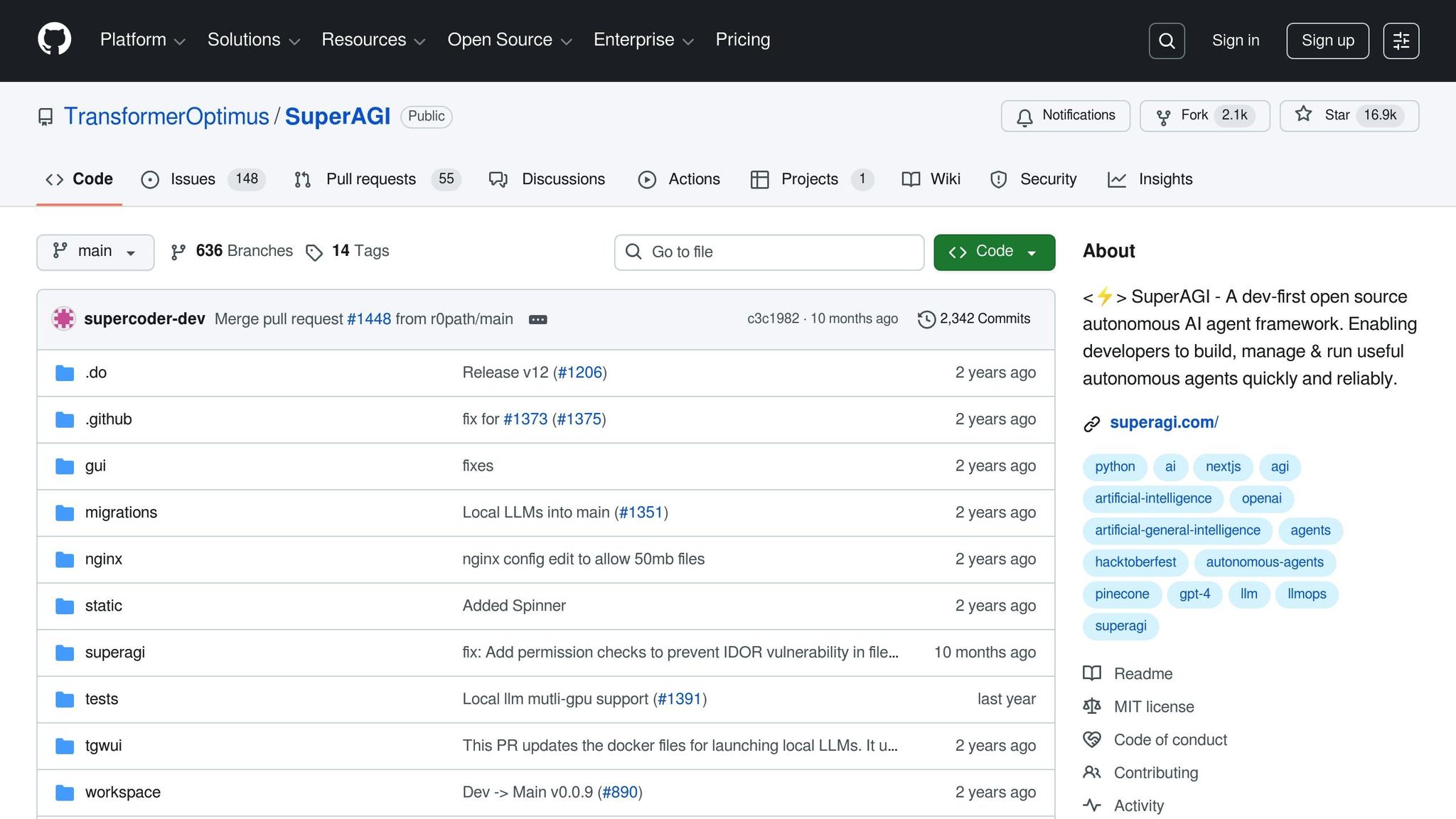

İncelediğimiz orkestrasyon çerçevelerini temel alan SuperAGI, çoklu aracılı işbirliğini yönetmenin yeni bir yolunu sunuyor. Bu açık kaynaklı platform, otonom yapay zeka aracılarını koordine etmek ve geliştiricilere sürekli öğrenme yoluyla görevleri planlayabilen, yürütebilen ve bunlara uyum sağlayabilen aracılar oluşturma, dağıtma ve denetleme yetkisi vermek üzere tasarlanmıştır. SuperAGI, birden fazla temsilcinin sorunsuz bir şekilde birlikte çalışmasına, görevleri dinamik olarak devretmesine ve karmaşık zorlukların üstesinden gelmek için işbirliği yapmasına olanak tanır. Uyarlanabilir görev yönetimini çok aracılı ekip çalışmasıyla birleştirerek gelişmiş yapay zeka orkestrasyonu için güçlü bir araç olarak öne çıkıyor.

SuperAGI, işletmeler için karmaşık ve gelişen görevlerin otomatikleştirilmesinde öne çıkıyor. Temsilci ağları, gelişmiş görev planlama ve yürütme konusunda üstündür ve takviyeli öğrenme ve geri bildirim döngüleri yoluyla sürekli olarak gelişir. Bu, onu özellikle akıllı koordinasyonun önemli olduğu büyük ölçekli operasyonları yürüten kuruluşlar için faydalı kılar. Platformdaki temsilciler, etkileşimlerinden ve sonuçlarından öğrenerek davranışlarını zaman içinde iyileştirmelerine olanak tanır.

Platformun öne çıkan özelliği dinamik görev delegasyonudur. Temsilciler katı iş akışlarına bağlı kalmak yerine durumları gerçek zamanlı olarak değerlendirir, öncelikli görevleri belirler ve bunları en uygun ağ üyelerine atar. Bu esneklik, karmaşık senaryolarda bile kaynakların verimli bir şekilde tahsis edilmesini sağlar.

SuperAGI'nin mimarisi, özünde ölçeklenebilirlik ve modülerlik olacak şekilde tasarlanmıştır. Geliştiriciler, çeşitli uygulama ihtiyaçlarını karşılamak için aracı ağlarını ve iş yüklerini kolayca genişletebilir. Her temsilci bağımsız olarak çalışır ancak sorunsuz bir şekilde iletişim kurarak sorunsuz bir işbirliği sağlar.

Kullanıcı dostu bir grafik arayüz, ekiplerin temsilci etkileşimlerini görselleştirmesine ve yapılandırmalarda ince ayar yapmasına olanak tanır. Kontrol panellerinin izlenmesi, aracı performansına ilişkin bilgiler sağlayarak geliştiricilerin verimsizlikleri tespit etmesine ve gidermesine yardımcı olur. Platform aynı zamanda paralel yürütmeyi de destekleyerek birden fazla aracının bağımsız görevleri aynı anda yürütmesine olanak tanır. Bu tasarım, özellikle talebin yüksek olduğu ortamlarda verimi önemli ölçüde artırır.

SuperAGI, üçüncü taraf API'ler, iş akışı araçları ve özel modüllerle entegre olabilen genişletilebilir bir eklenti sistemine sahiptir. Bu esneklik, geliştirmeyi hızlandırır ve daha geniş geliştirici topluluğunun katkılarını teşvik ederek platformun yeteneklerini zenginleştirir.

Platformun dağıtılmış, modüler mimarisi yatay ölçeklendirmeyi destekleyerek onu büyük ölçekli uygulamalara uyarlanabilir hale getiriyor. Takviyeli öğrenme ve geri bildirim döngülerinin kullanılması, genel performansı artırarak görevlerin verimli bir şekilde tahsis edilmesini sağlar. Etkili işbirliği ve yüksek verim sağlayan SuperAGI, karmaşık, yüksek hacimli senaryolarda güçlü performans talep eden kuruluşlar için çok uygundur.

Doğru yapay zeka düzenleme çerçevesini seçmek, her seçeneğin güçlü yönlerini ve sınırlamalarını anlamak anlamına gelir. Bu platformlar, kurumsal düzeyde güvenlik, geliştiricilerin uyarlanabilirliği veya makine öğrenimi hatları gibi özel iş akışları gibi ihtiyaçlara yanıt verecek şekilde farklı öncelikler göz önünde bulundurularak tasarlanmıştır. Her çerçeve, benzersiz tasarım felsefesini ve hedef kullanım durumlarını yansıtır.

Örneğin, Prompts.ai gibi platformlar büyük dil modellerine (LLM'ler) erişimi merkezileştirme konusunda uzmanlaşırken Apache Airflow ve Prefect gibi araçlar genel iş akışı otomasyonuna odaklanır. Öte yandan Kubeflow ve Flyte, makine öğrenimi hatları için özel olarak tasarlandı ve SuperAGI ve Microsoft AutoGen gibi çerçeveler, otonom sistemlerin karmaşık görevleri birlikte yürütmesine olanak tanıyarak çok aracılı yapay zeka işbirliğinin sınırlarını zorluyor.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Maliyet Yapıları: Geleneksel platformlar genellikle kullanıcı veya yürütme başına ücret alır ve bu da operasyonlar büyüdükçe daha yüksek maliyetlere yol açabilir. Buna karşılık Prompts.ai, masrafları doğrudan kullanıma bağlayan TOKN kredileriyle kullandıkça öde modelini kullanıyor. Bu yaklaşım özellikle farklı modellerle denemeler yaparken veya dalgalanan iş yüklerini yönetirken faydalıdır.

Güvenlik ve Uyumluluk: Sağlık ve finans gibi sektörler için sağlam güvenlik önlemleri hayati önem taşıyor. Prompts.ai, IBM watsonx Orchestra ve Prefect gibi platformlar, denetim izleri ve rol tabanlı erişim denetimleri gibi yerleşik uyumluluk araçları sağlar. Ancak Apache Airflow gibi açık kaynak seçenekleri, sıkı uyumluluk standartlarını karşılamak için ek yapılandırma gerektirir.

Öğrenme Eğrisi: Kullanılabilirlik büyük ölçüde değişir. Prefect ve Dagster gibi platformlar yeni başlayanlara daha uygundur ve sezgisel Python API'leri ve faydalı hata mesajları sunar. Bu arada Apache Airflow ve Kubeflow daha derin teknik uzmanlık ve altyapı yönetimi becerileri gerektirir. Prompts.ai, uzman kullanıcılar için kullanım kolaylığını gelişmiş özelliklerle dengeleyen birleşik bir arayüzle bunu daha da basitleştirir.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Entegrasyon Ekosistemi: Mevcut araçlarla kusursuz entegrasyon kritik öneme sahiptir. Apache Airflow, bulut hizmetleri, veritabanları ve izleme araçlarına yönelik yüzlerce eklentiyle lider konumdadır. Prompts.ai ise özellikle LLM'lere odaklanıyor ve tek bir API aracılığıyla düzinelerce modele akıcı erişim sunuyor.

Ölçeklenebilirlik: Kubeflow ve Flyte gibi platformlar, iş yükü dağıtımı için Kubernetes'ten yararlanarak yatay ölçeklendirme için tasarlanmıştır. Metaflow, elastik ölçeklendirme için AWS hizmetlerini kullanırken Prefect, hem bulut tarafından yönetilen hem de şirket içinde barındırılan ölçeklendirme seçeneklerini destekler. SuperAGI, dikkatli bir koordinasyon gerektirmesine rağmen paralel yürütmeyi mümkün kılan dağıtılmış bir aracı mimarisi kullanır.

Sizin için en iyi çerçeve, özel iş akışlarınıza bağlıdır. LLM orkestrasyonu için Prompts.ai, merkezi model erişimi ve maliyet verimliliğiyle öne çıkıyor. Veri mühendisliği ekipleri Apache Airflow'un güvenilirliğine yönelirken, büyük ölçekli eğitim ve dağıtım üzerinde çalışan makine öğrenimi ekipleri Kubeflow veya Flyte'tan yararlanabilir. Odak noktanız otonom yapay zeka sistemleri oluşturmaksa SuperAGI veya Microsoft AutoGen doğru seçim olabilir.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Örneğin, Yüksek Lisans düzenlemesine öncelik veren ekipler Prompts.ai'yi özellikle çekici bulabilir. Tamamı birleşik bir arayüz üzerinden GPT-5, Claude ve Gemini gibi 35'ten fazla modele merkezi erişim sağlar. Kullandıkça öde TOKN kredi sistemi, gerçek zamanlı maliyet takibi sunarken abonelik ücretlerini ortadan kaldırır. Rol tabanlı erişim kontrolleri ve denetim izleri gibi özelliklerle Prompts.ai, hızdan ödün vermeden sıkı yönetim gerektiren endüstriler için güçlü bir seçimdir.

Karmaşık ETL işlem hatlarıyla çalışan veri mühendisliği ekipleri, daha gelişmiş uzmanlık gerektirse de, güçlü eklenti ekosistemi ve ölçeklenebilirliği nedeniyle Apache Airflow'a yönelebilir. Öte yandan Prefect, kullanıcı dostu hata yönetimi ile Python'a özgü bir yaklaşım sunuyor ve bu da onu daha hızlı ekip katılımı için mükemmel bir seçenek haline getiriyor.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

Otonom yapay zeka sistemlerini araştıran kuruluşlar, çok aracılı işbirliği özellikleri için Microsoft AutoGen'i veya dinamik görev dağıtımı için SuperAGI'yi düşünebilir. Bu araçlar araştırma veya özel kullanım durumları için idealdir ancak çoğu zaman gelişmiş kodlama becerileri gerektirir, bu da onları acil üretim ihtiyaçları için daha az uygun hale getirir.

Sonuçta doğru çerçeveyi seçmek, modülerlik, genişletilebilirlik, gözlemlenebilirlik gibi faktörlerin yanı sıra rol tabanlı erişim kontrolleri ve uyumluluk sertifikaları gibi yönetişim özelliklerinin değerlendirilmesini içerir. Dağıtım esnekliği ve mevcut araçlarla entegrasyon da aynı derecede önemlidir. İşlevselliğin ötesinde, SDK'lar, belgeler ve toplam sahip olma maliyeti de dahil olmak üzere geliştirici deneyimini göz önünde bulundurun. İster basit tek aracılı görevler ister kalıcı belleğe sahip karmaşık çok aracılı sistemler olsun, iş akışlarınızın karmaşıklığı da kararınızı yönlendirmelidir.

Sektör, açık kaynaklı çerçevelerin kurumsal iş yüklerinin çoğunu yönlendirdiği ve satıcı tarafından yönetilen çalışma zamanlarının operasyonel zorlukları basitleştirdiği ölçeklenebilir, entegre yapay zeka sistemlerine yöneliyor.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Bir yapay zeka düzenleme çerçevesi seçerken mevcut araç ve sistemlerinizle ne kadar iyi entegre olduğunu dikkate almak önemlidir. Güçlü entegrasyon yeteneklerine sahip bir çerçeve, her şeyin gereksiz karmaşıklıklar olmadan birlikte çalışmasını sağlar.

İşlemleri basitleştirip zamandan tasarruf sağlayabileceği için iş akışı planlaması ve görev yönetimi gibi otomasyon özelliklerine dikkat edin. Hassas verileri koruyan ve düzenlemelere uyumlu kalmanıza yardımcı olan güvenlik ve yönetim önlemleri de aynı derecede önemlidir.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai, 35'ten fazla büyük dil modelini birleşik bir platformda bir araya getirerek birden fazla yapay zeka aracıyla hokkabazlık yapma zorluğunu basitleştiriyor. Bu kurulumla kullanıcılar, modelleri zahmetsizce yan yana karşılaştırabilir ve aynı zamanda hızlı iş akışlarını, çıktı kalitesini ve genel performansını tam olarak görebilirler.

Verimliliğine ek olarak Prompts.ai, maliyetleri optimize etmek için tasarlanmış entegre bir FinOps katmanına sahiptir. Bu araç, kullanım, harcama ve yatırım getirisi (ROI) hakkında gerçek zamanlı bilgiler sağlayarak kuruluşların kaynaklarını etkili bir şekilde yönetmelerine ve yapay zeka bütçelerinden en iyi şekilde yararlanmalarına olanak tanır.

Prompts.ai, verilerinizi her aşamada korumak için SOC 2 Type II, HIPAA ve GDPR gibi endüstri standartlarıyla uyumlu olarak kurumsal düzeyde güvenlik ve uyumluluğa öncelik verir.

Devam eden izleme ve uyumluluğu sürdürmek için Prompts.ai, Vanta ile işbirliği yaptı ve 19 Haziran 2025'te SOC 2 Tip II denetim sürecine başladı. Bu adımlar, iş akışlarınızın kurumsal operasyonlar için güvenli, uyumlu ve güvenilir kalmasını sağlar.