AI 오케스트레이션은 엔터프라이즈 AI 운영 확장의 핵심입니다. AI 파일럿의 95%가 잘못된 조정으로 인해 실패하므로 기업에는 복잡한 AI 워크플로를 통합, 자동화, 관리할 수 있는 도구가 필요합니다. 2025년 환경에서는 여러 모델을 통합하고 워크플로를 보호하며 비용을 최적화하여 채택자에게 최대 60% 더 높은 ROI를 제공하는 플랫폼이 도입됩니다.

Here’s a quick breakdown of the top solutions:

각 플랫폼은 확장성, 상호 운용성, 거버넌스 및 비용 관리 측면에서 고유한 장점을 제공합니다. 오픈 소스 유연성이 필요하든, 엔터프라이즈급 규정 준수가 필요하든 이러한 도구는 단편화된 AI 시스템을 통합되고 확장 가능한 생태계로 전환할 수 있습니다.

AI 이니셔티브를 확장하고 조정을 개선하며 ROI를 극대화하는 데 적합한 플랫폼을 선택하십시오.

AI 오케스트레이션 플랫폼 비교: 확장성, 상호 운용성, 거버넌스 & 비용

Prompts.ai는 AI 운영을 단순화하고 합리화하도록 설계된 최첨단 엔터프라이즈 플랫폼입니다. GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro 및 Kling을 포함하여 35개 이상의 최상위 대규모 언어 모델을 하나의 안전하고 통합된 인터페이스로 통합합니다. 플랫폼은 이러한 모델에 대한 액세스를 중앙 집중화함으로써 여러 도구를 관리하는 혼란을 없애고 조직이 AI 노력을 쉽게 확장할 수 있도록 돕습니다.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

중앙 집중식 허브인 Prompts.ai는 모든 AI 기반 프로세스가 흩어져 있고 하드 코딩된 문자열 대신 인증된 버전 제어 프롬프트 템플릿을 사용하도록 보장합니다. 해당 아키텍처를 통해 손쉽게 모델을 선택하고 성능을 나란히 비교할 수 있으므로 팀은 각 작업에 가장 효과적인 LLM(대형 언어 모델)을 식별하고 배포할 수 있습니다. 이 모든 것은 코드를 다시 작성하거나 파이프라인을 조정할 필요 없이 달성되므로 시간과 노력이 절약됩니다.

Prompts.ai는 강력한 역할 기반 액세스 제어(RBAC)를 통해 보안과 제어를 우선시합니다. 이를 통해 조직은 프로덕션 환경에서 프롬프트를 생성, 수정 또는 배포할 수 있는 사람에 대한 정확한 권한을 정의할 수 있습니다. 모든 상호 작용은 감사 추적 및 버전 추적을 통해 꼼꼼하게 기록되므로 완전한 투명성을 제공합니다. 이 거버넌스 프레임워크는 기업이 규정 준수 표준을 충족하는 동시에 AI 운영에 대한 가시성과 제어권을 유지하는 데 도움이 됩니다. 엄격한 보안 조치와 운영 효율성을 결합함으로써 이 플랫폼은 조직이 AI를 안전하고 효과적으로 관리할 수 있도록 지원합니다.

플랫폼에는 토큰 사용을 추적하여 AI 지출을 비즈니스 결과에 직접 연결하는 FinOps 레이어가 포함되어 있습니다. 많은 조직에서는 공급업체 관계를 통합하고 불필요한 구독을 줄임으로써 비용을 최대 98%까지 절감했다고 보고했습니다. 실시간 사용량 및 성능 지표를 통해 팀은 지출을 지속적으로 모니터링하고 최적화하여 월말에 예상치 못한 비용이 발생하는 것을 방지할 수 있습니다. 이러한 수준의 재정적 투명성은 AI를 예산상의 불확실성에서 명확한 수익을 제공하는 측정 가능한 투자로 전환시킵니다.

LangChain은 인상적인 월간 다운로드 수 9천만 건과 100,000개 이상의 GitHub 스타를 보유한 AI 애플리케이션을 위한 강력한 프레임워크로 두각을 나타내고 있습니다. 모듈식 설계는 기본 추상화를 위한 langchain-core 및 타사 통합을 위한 langchain-community와 같은 경량 패키지로 기능을 분할합니다. 이 접근 방식은 불필요한 오버헤드 없이 간소화된 AI 워크플로를 보장하므로 복잡성과 규모를 모두 관리하는 데 적합한 선택입니다.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith는 HIPAA, SOC 2 Type 2 및 GDPR을 포함한 엄격한 규정 준수 표준을 준수합니다. 자세한 실행 추적 기능을 제공하여 디버깅 및 규정 준수 검토를 위한 포괄적인 감사 추적을 생성합니다. LangGraph는 실시간 검사, 롤백 및 수정을 위한 "시간 이동" 기능을 포함한 인간 참여형(Human-In-The-Loop) 기능을 통해 이를 향상시킵니다.

__XLATE_10__

SWE 수석 Garrett Spong은 다음과 같이 강조합니다. "LangGraph는 대화형 에이전트, 복잡한 작업 자동화부터 '작동하는' 맞춤형 LLM 지원 경험에 이르기까지 AI 워크로드를 구축하고 확장할 수 있는 방법에 대한 기반을 설정합니다."

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines(KFP)는 2억 5,800만 건의 PyPI 다운로드, 33,100명의 GitHub 스타, 3,000명 이상의 기여자로 구성된 활발한 커뮤니티 등 인상적인 실적을 자랑합니다. Kubernetes에서 기본적으로 실행되도록 설계된 KFP는 파이프라인의 각 단계를 별도의 Pod로 실행하여 필요에 따라 클러스터 전체에서 컴퓨팅 리소스를 동적으로 확장할 수 있습니다. 해당 아키텍처는 DAG(방향성 비순환 그래프) 구조를 사용하므로 특정 데이터 종속성이 정의되지 않는 한 컨테이너화된 작업의 병렬 실행이 가능합니다[18, 19]. 이 설정은 복잡한 작업 흐름을 효율적으로 처리하는 능력의 핵심입니다.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP는 IR YAML 형식을 통해 유연성과 이식성을 보장합니다. 이를 통해 오픈 소스 설정부터 Google Cloud Vertex AI 파이프라인과 같은 관리형 서비스에 이르기까지 파이프라인이 다양한 KFP 백엔드에서 원활하게 실행될 수 있습니다. 즉, 코드를 다시 작성하지 않고도 로컬에서 개발하고 클라우드에서 규모에 맞게 배포할 수 있습니다. 또한 이 플랫폼은 데이터 준비를 위한 Spark, Ray 및 Dask와 확장 가능한 모델 추론을 위한 KServe와 같은 널리 사용되는 도구와 통합됩니다. Python SDK를 사용하면 데이터 과학자는 익숙한 코딩 방식을 사용하여 복잡한 워크플로를 정의할 수 있으며, 백엔드는 이를 자동으로 Kubernetes 작업으로 변환합니다.

보안과 거버넌스는 KFP의 핵심입니다. RBAC(역할 기반 액세스 제어), 격리를 위한 네임스페이스, 네트워크 정책과 같은 Kubernetes의 내장 기능을 사용하여 안전한 워크플로 실행을 보장합니다. 플랫폼은 메타데이터와 아티팩트를 중앙에서 추적하여 모든 파이프라인 실행에 대한 자세한 감사 추적을 생성합니다[8, 22]. KFP는 격리된 컨테이너에서 각 파이프라인 단계를 실행함으로써 프로세스 격리와 안전한 데이터 처리를 유지합니다. 관리자는 개별 작업에 대한 리소스 제한을 설정하여 팀 전체에 공정한 리소스 분배를 보장하고 남용을 방지할 수 있습니다. 민감한 데이터나 워크로드의 경우 노드 선택기를 사용하여 특정 보안 하드웨어로 작업을 제한할 수 있습니다.

KFP 자체는 오픈 소스이며 무료로 사용할 수 있지만 AWS EKS, Google GKE 또는 온프레미스 등 기본 Kubernetes 인프라와 관련된 비용은 여전히 적용됩니다. Google Cloud Vertex AI Pipelines와 같은 관리형 버전은 종량제 가격 모델로 작동합니다[19, 20]. KFP에는 또한 장기 실행 파이프라인을 다시 시작하는 데 드는 비용을 방지하는 데 도움이 되는 일시적인 오류에 대한 재시도 메커니즘과 이전 단계가 실패하더라도 정리 작업이 실행되도록 하는 종료 핸들러와 같은 기능이 포함되어 있습니다. 이러한 기능은 보다 효율적인 리소스 사용 및 비용 관리에 기여합니다.

Argo Workflows는 Kubernetes용으로 특별히 설계된 널리 사용되는 워크플로 실행 엔진으로, 200개 이상의 조직이 프로덕션 환경에서 이를 사용하고 있습니다. 컨테이너 기반 솔루션으로서 격리된 포드에서 각 워크플로 단계를 실행하여 병렬 작업을 조정합니다. 이 아키텍처는 Kubernetes 클러스터의 사용 가능한 용량을 기반으로 동적 확장을 지원하므로 유연한 리소스 관리가 필요한 AI 작업에 특히 효과적입니다.

Argo Workflows는 수직 최적화 및 샤딩을 통한 확장을 지원합니다. --workflow-workers 매개변수를 늘리면 더 많은 CPU 코어를 할당하여 워크플로 조정 속도를 높일 수 있습니다. 대규모 작업의 경우 네임스페이스별로 별도의 설치를 배포하거나 인스턴스 ID를 사용하여 동일한 클러스터 내에서 여러 컨트롤러 인스턴스를 실행하여 샤딩을 구현할 수 있습니다. Kubernetes API 서버를 보호하기 위해 Argo는 클라이언트 측 속도 제한(기본값: 초당 쿼리 20개, 버스트 30개)을 사용하고 각 단계의 동시성을 작업 100개로 제한합니다. 이러한 확장 가능한 접근 방식은 작업량이 많은 경우에도 외부 시스템과의 원활한 통합을 보장합니다.

Kubernetes CRD(사용자 정의 리소스 정의)인 Argo는 모든 Kubernetes 클러스터와 원활하게 통합되며 Kubeflow Pipelines, Netflix Metaflow, Seldon 및 Kedro와 같은 주요 AI 플랫폼을 지원합니다. 개발자는 Python(Hera), Java 및 Go용 공식 SDK를 사용하여 워크플로를 정의하여 언어 선택에 유연성을 제공할 수 있습니다. 아티팩트 관리를 위해 Argo는 AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory 및 Alibaba Cloud OSS를 포함한 다양한 스토리지 솔루션을 지원합니다. 이러한 호환성은 다양한 환경에서 원활한 데이터 흐름을 보장합니다. 또한 Argo Events를 사용하여 웹후크 또는 스토리지 변경과 같은 외부 신호에 의해 워크플로가 트리거될 수 있습니다. Metaflow 문서에 따르면 Argo Workflows는 Argo Events를 통해 이벤트 트리거링을 지원하는 유일한 프로덕션 오케스트레이터입니다. 이러한 유연성과 기능의 조합은 워크플로 자동화를 위한 강력한 선택입니다.

Argo Workflows는 Kubernetes 기본 기능을 활용하여 강력한 보안을 보장합니다. RBAC(역할 기반 액세스 제어)는 워크플로 컨트롤러, 사용자 및 개별 포드에 대한 권한을 관리합니다. 격리를 강화하기 위해 "namespace-install" 모드를 사용하여 컨트롤러를 단일 네임스페이스로 제한할 수 있습니다. 프로덕션 환경에서 Argo는 OAuth2 및 OIDC를 통해 SSO(Single Sign-On)를 지원하는 동시에 TLS 암호화로 전송 중인 데이터를 보호합니다. 관리자는 워크플로 제한을 적용하여 사용자가 사전 승인된 템플릿만 제출하도록 허용할 수 있으며, 포드 보안 컨텍스트는 포드가 루트로 실행되는 것을 방지하는 데 도움이 됩니다. 네트워크 정책은 Argo 서버와 워크플로 컨트롤러 모두에 대한 트래픽을 규제하며 기본 재귀 깊이 제한인 100개 호출은 무한 루프를 방지합니다.

Argo Workflows는 Apache License 2.0에 따라 무료로 사용할 수 있는 오픈 소스 도구입니다. 비용 관리를 위해 TTL 전략과 Pod 가비지 수집(PodGC)을 사용하여 완료된 워크플로를 자동으로 삭제하고 사용하지 않는 Pod를 정리하여 리소스 낭비를 줄입니다. 노드 선택기와 선호도 규칙을 사용하여 스팟 인스턴스와 같은 비용 효율적인 인프라에서 작업을 예약할 수 있습니다. 또한 리소스 사용량이 단계별로 추적되어 사용자가 지출을 모니터링하는 데 도움이 됩니다. 컨트롤러 로그에서 "클라이언트 측 조절"을 발견한 경우 --qps 및 --burst 값을 늘리면 Kubernetes API와의 통신 효율성이 향상될 수 있습니다. 이 사려 깊은 디자인은 성능과 비용 효율성의 균형을 맞추는 데 도움이 됩니다.

Apache Airflow는 복잡한 작업을 조정하기 위한 유연한 코드 기반 프레임워크를 제공하여 AI 워크플로 관리의 핵심 플레이어가 되었습니다. 이는 사용자의 23%가 적용하는 MLOps(기계 학습 작업)와 커뮤니티의 9%가 사용하는 생성 AI 프로젝트에서 특히 두드러집니다. Apache License 2.0에 따라 출시된 Airflow를 통해 개발자는 Python으로 워크플로를 정의하고 모든 기계 학습 라이브러리와 원활하게 통합할 수 있습니다.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor는 예측할 수 없고 리소스가 많이 드는 워크로드를 처리하는 데 특히 유용합니다. 동적 작업 매핑과 같은 기능을 사용하면 실시간 데이터를 기반으로 작업을 확장할 수 있으므로 대규모 데이터 세트 및 다중 모델 워크플로에 적합합니다. 한편, Deferrable Operators는 작업자 슬롯을 차지하지 않고 모델 교육 모니터링과 같은 장기 대기 상태를 관리하여 효율성을 향상시킵니다. 이 접근 방식은 처리량과 리소스 활용도를 크게 향상시킵니다.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

TaskFlow API는 Python 데코레이터를 사용하여 스크립트를 Airflow 작업으로 변환하고 XCom을 통한 데이터 전송을 자동으로 관리함으로써 워크플로 생성을 단순화합니다. 팀은 GPU 사용량이 많은 교육을 위한 Kubernetes 포드나 데이터 전처리를 위한 Spark 클러스터와 같은 적절한 환경으로 작업을 라우팅할 수 있습니다. 또한 REST API 및 airflowctl CLI를 사용하면 CI/CD 파이프라인과 안전하게 통합되어 원활하고 감사 가능한 워크플로 관리가 보장됩니다.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

데이터 거버넌스의 경우 Airflow는 데이터 계보 추적 표준인 OpenLineage와 통합되어 GDPR 및 HIPAA와 같은 규정 준수 요구 사항을 충족하는 데 도움이 됩니다. airflowctl CLI는 보안 강화를 위해 메타데이터 데이터베이스에 대한 직접 액세스를 방지하면서 REST API와만 상호 작용합니다. 또한 팀은 설정 및 해제 작업을 사용하여 재현 가능한 환경을 관리하고 더 나은 감독 및 일관성을 위해 인프라를 코드로 처리할 수 있습니다.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning은 고급 GPU, InfiniBand 네트워킹, 99.9% 가동 시간 및 100개 이상의 규정 준수 인증을 특징으로 하는 엔터프라이즈 AI 요구 사항에 맞는 강력한 솔루션을 제공합니다. 34,000명의 엔지니어와 15,000명의 보안 전문가로 구성된 팀의 지원을 받아 대규모 안정성과 보안을 보장합니다.

이 플랫폼은 데이터, 모델 및 파이프라인 전반에 걸친 분산 컴퓨팅 지원을 통해 모든 규모의 워크로드를 처리하고 리소스 효율성을 극대화하도록 설계되었습니다. 관리형 온라인 엔드포인트를 사용하면 수요 급증에 맞춰 자동 크기 조정을 통해 원활한 모델 배포가 가능합니다. 예를 들어 Marks & Spencer는 Azure ML을 활용하여 3천만 명이 넘는 고객의 데이터를 처리하는 동시에 파이프라인 캐싱 및 레지스트리를 활용하여 교육 시간과 비용을 모두 줄였습니다. 마찬가지로 BRF에서는 자동화된 ML 및 MLOps가 15명의 분석가를 위한 수동 작업을 제거하여 더 높은 가치의 작업에 집중할 수 있게 했습니다.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"Azure AI 프롬프트 흐름이 없었다면 우리는 솔루션을 제공하기 위해 상당한 규모의 사용자 지정 엔지니어링에 투자해야 했을 것입니다. 대신 기존 마이크로서비스를 프롬프트 흐름 솔루션에 쉽게 통합하여 엄청난 속도를 달성할 수 있었습니다."

또한 Azure ML은 데이터를 중앙 집중화하는 대신 로컬 에지 장치에서 모델을 교육하는 데 플랫폼을 사용하여 확장성과 데이터 개인 정보 보호를 모두 보장한 Swift의 Johan Bryssinck가 시연한 것처럼 개인 정보 보호 분산 교육을 지원합니다. Azure Logic Apps 및 Azure Functions와의 통합과 함께 통합 API 계약은 외부 도구와의 연결을 더욱 향상시킵니다.

Azure Machine Learning은 RBAC(역할 기반 액세스 제어)용 Microsoft Entra ID 및 가상 네트워크와 같은 기능을 통해 보안의 우선 순위를 지정하여 리소스를 격리하고 API 액세스를 제한합니다. 데이터는 전송 중 TLS 1.2/1.3 암호화와 저장 중 이중 암호화로 보호되며, 추가 제어를 위한 고객 관리 키 옵션도 제공됩니다. Prompt Shields와 같은 실시간 방어는 탈옥 및 즉각적인 주입 공격을 방지하는 반면, 고객 Lockbox는 Microsoft가 고객 데이터에 액세스하려면 관리 승인이 필요합니다. 추가 도구는 자산 버전, 데이터 계보 및 할당량을 추적하고 Microsoft Defender for Cloud는 런타임 위협 보호를 제공합니다.

Azure Machine Learning은 종량제 가격 책정 모델로 작동하며 CPU 및 특수 GPU와 같은 컴퓨팅 리소스에 대해서만 비용을 청구합니다. Blob Storage, Key Vault, Container Registry 및 Application Insights와 같은 지원 서비스도 사용량에 따라 요금이 청구됩니다. 팀은 특정 작업에 맞는 하드웨어를 선택할 수 있으며 파이프라인 캐싱과 같은 기능은 중복 계산을 줄여줍니다. 코드형 인프라(Infrastructure as Code)는 일관된 배포와 효율적인 리소스 관리를 보장합니다.

Google Vertex AI Pipelines는 머신러닝(ML) 워크플로를 자동화하여 인프라 관리의 번거로움을 덜어줍니다. 컨테이너화된 구성 요소의 DAG(방향성 비순환 그래프)로 작업을 구성하므로 팀은 서버 관리가 아닌 모델 개발에 집중할 수 있습니다.

Vertex AI Pipelines는 서버리스 접근 방식을 사용하여 워크로드를 처리하고 집약적인 처리 작업을 BigQuery, Dataflow, Apache Spark용 Cloud Serverless와 같은 도구에 위임합니다. 분산 Python 및 ML 계산을 위해 Vertex AI의 Ray와 원활하게 통합됩니다.

이 플랫폼은 NVIDIA H100/H200 GPU가 장착된 A3 및 A3 Mega 시리즈 노드를 지원합니다. 8개의 H100 GPU를 갖춘 A3 메가 노드는 인상적인 1,600Gbps의 노드 간 대역폭을 제공합니다. 예를 들어 Vectra는 Gemini 및 Vertex AI를 사용하여 월간 300,000건의 고객 통화를 분석하여 분석 속도를 500% 향상시켰습니다.

비용 효율성은 출력을 재사용하여 비용을 최소화하는 실행 캐싱을 통해 내장됩니다. Vertex ML Metadata는 대규모로 아티팩트, 매개변수, 측정항목의 계보를 추적하여 재현성을 보장합니다. 이 확장 가능한 디자인은 다양한 도구와 쉽게 통합되므로 ML 워크플로를 위한 다목적 솔루션이 됩니다.

Google Cloud 파이프라인 구성요소(GCPC) SDK는 AutoML, 커스텀 학습 작업, 모델 배포와 같은 Vertex AI 서비스를 파이프라인에 직접 연결하는 사전 빌드된 구성요소를 제공하여 통합을 단순화합니다.

Cloud Composer(관리형 Apache Airflow) 및 Cloud Data Fusion 트리거와 같은 옵션을 사용하여 서비스 전반에 걸쳐 워크플로를 조정하는 등 파이프라인 관리가 유연합니다. BigQuery, Cloud Storage, Dataproc에 대한 기본 연결로 데이터 처리가 간소화되고, 메타데이터는 프로젝트 간 계보 추적을 위해 Dataplex Universal Catalog와 동기화될 수 있습니다. 또한 Model Garden에서는 Google의 Gemini, Anthropic의 Claude 및 Meta의 Llama를 포함하여 200개 이상의 모델에 대한 액세스를 제공합니다.

파이프라인 정의는 표준화된 YAML 형식으로 컴파일되어 Artifact Registry와 같은 저장소 간 이식성을 보장합니다.

Vertex AI Pipelines는 거버넌스와 보안을 염두에 두고 설계되었습니다. 서비스 계정은 각 구성요소가 필요한 권한으로만 작동하도록 보장합니다. VPC 서비스 제어는 보안 경계를 설정하여 학습 데이터세트, 모델, 일괄 예측 결과와 같은 민감한 데이터가 네트워크 경계를 벗어나는 것을 방지합니다.

엄격한 규정 준수 요구사항이 있는 조직을 위해 플랫폼은 Google Cloud의 기본 저장 암호화 외에도 고객 관리 암호화 키(CMEK)를 지원합니다. Vertex ML Metadata는 모든 파이프라인 실행에서 매개변수, 아티팩트, 측정항목을 자동으로 기록하여 자세한 감사 추적을 제공합니다.

Model Armor와 같은 보안 기능은 신속한 주입 및 데이터 유출을 방지합니다. 피어링된 VPC 네트워크 내에서 실행되도록 파이프라인을 구성할 수 있으며, Cloud Logging을 통해 팀은 파이프라인 이벤트에서 보안 이상이 있는지 모니터링할 수 있습니다.

Vertex AI Pipelines는 사용한 만큼만 지불하는 모델로 작동하며, BigQuery로 Cloud Billing 내보내기를 통해 비용을 추적하기 위해 결제 라벨이 자동으로 적용됩니다. 실행 캐싱은 출력을 재사용하여 비용을 더욱 절감합니다.

중단 방지 교육 작업에 대한 비용을 낮추기 위해 스팟 VM을 할인된 가격으로 사용할 수 있습니다. 장기 인프라 약정의 경우 CUD(약정 사용 할인)를 통해 비용 절감과 용량 보장을 얻을 수 있습니다. DWS(Dynamic Workload Scheduler)는 저렴한 정가로 유연한 워크로드를 위한 용량을 제공하는 동시에 전용 교육 클러스터는 대규모 작업을 위해 예약된 가속기 용량을 보장합니다.

IBM watsonx Orchestrate는 전문 도구 및 기반 모델에 대한 감독자, 라우터 및 플래너 역할을 하여 AI 에이전트를 조정하는 중앙 허브 역할을 합니다. 플랫폼은 탐색 작업을 위한 React, 구조화된 워크플로를 위한 Plan-Act, 예측 가능한 비즈니스 프로세스를 위한 결정론적 오케스트레이션 등 다양한 오케스트레이션 접근 방식을 지원합니다.

대규모 작업을 위해 설계된 watsonx Orchestrate는 다중 에이전트 오케스트레이션을 사용하여 실시간으로 요청을 적절한 도구 및 대규모 언어 모델(LLM)에 효율적으로 라우팅합니다. 조직은 IBM Cloud 또는 AWS에서 관리형 서비스로 watsonx Orchestrate를 배포하거나 기존 인프라에 맞게 온프레미스에 설치할 수 있습니다.

플랫폼은 이미 측정 가능한 결과를 제공했습니다. 예를 들어, IBM은 watsonx Orchestrate를 통해 연간 천만 건의 HR 요청 중 94%를 즉시 해결하여 HR 팀이 더 높은 가치의 작업에 집중할 수 있도록 했습니다. 마찬가지로 Dun & Bradstreet는 AI 기반 공급업체 위험 평가를 통해 조달 시간을 최대 20% 단축하여 클라이언트의 평가 시간을 10% 이상 절약했습니다.

신속한 배포를 지원하기 위해 플랫폼에는 사용자 정의 Python 기반 도구를 생성하기 위한 코드 없는 Agent Builder 및 ADK(에이전트 개발 키트)가 포함되어 있습니다. 또한 100개 이상의 도메인별 AI 에이전트와 400개 이상의 사전 구축된 도구가 포함된 카탈로그는 다양한 운영 요구 사항을 충족할 수 있는 확장 가능한 구성 요소를 제공합니다.

이러한 확장성은 기존 시스템과의 원활한 통합을 보장하므로 광범위한 기업 환경에 적응할 수 있습니다.

플랫폼의 AI 게이트웨이는 IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral 및 Llama를 포함한 다양한 기반 모델 간의 원활한 라우팅을 촉진하여 조직이 공급업체 종속을 방지하도록 돕습니다. 에이전트 개발 키트는 원격 웹 서비스용 OpenAPI 사양과 확장 기능용 Python을 사용하여 사용자 정의 도구 생성을 지원합니다.

Langflow와의 통합은 AI 애플리케이션 설계를 위한 시각적 드래그 앤 드롭 인터페이스를 추가한 후 Orchestrate 환경으로 가져올 수 있습니다. 또한 watsonx Orchestrate는 Salesforce, SAP, Workday 및 Microsoft 365와 같은 엔터프라이즈 시스템과 쉽게 연결되므로 광범위한 인프라 변경이 필요하지 않습니다.

AgentOps를 통해 플랫폼은 AI 에이전트 활동을 모니터링하고 실시간 정책을 시행하여 안정성과 규정 준수를 보장합니다. 내장된 가드레일과 중앙 집중식 감독은 내부 규정을 준수하는 데 도움이 됩니다.

__XLATE_52__

"AgentOps를 사용하면 모든 작업을 모니터링하고 제어할 수 있으므로 이상 징후를 실시간으로 표시하고 수정할 수 있습니다." - IBM 뉴스룸

IBM Guardium 통합은 승인되지 않은 AI 배포를 식별하고 취약성 또는 잘못된 구성을 노출하여 보안을 강화합니다. 또한 플랫폼은 환경 설정을 보호하기 위해 관리자, 빌더, 사용자 및 제품 전문가의 네 가지 주요 역할을 포함하는 역할 기반 액세스 제어(RBAC)를 구현합니다. watsonx.governance를 사용하는 기업은 AI 이니셔티브를 통해 ROI가 30% 증가했다고 보고했습니다.

이 플랫폼은 다양한 조직 요구 사항을 충족하기 위해 유연한 가격을 제공합니다.

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 2026년 1월 31일.

유아이패스 AI 센터(UiPath AI Center)는 기업 워크플로우 내에서 AI 에이전트, RPA 봇, 인간 작업자를 통합하여 2025년의 요구 사항을 충족하도록 설계된 확장 가능한 생태계를 만듭니다. 플랫폼의 핵심은 유아이패스 마에스트로(UiPath Maestro)를 지능형 제어 허브로 활용하여 복잡한 비즈니스 운영 전반에 걸쳐 장기 실행 프로세스를 관리하는 것입니다.

UiPath AI Center는 다양한 비즈니스 요구 사항에 맞는 두 가지 배포 옵션, 즉 즉각적으로 탄력적인 확장을 제공하는 Automation Cloud와 온프레미스 배포에 맞춰진 Automation Suite를 제공합니다. MLOps 시스템은 모델을 배포하고 모니터링할 수 있는 사용자 친화적인 드래그 앤 드롭 인터페이스를 갖추고 있어 무제한의 로봇에서 원활하게 확장할 수 있습니다. 예를 들어 SunExpress Airlines는 백로그를 2개월 줄이면서 200,000달러 이상을 절약했다고 보고했습니다. 또한 이 플랫폼은 지속적인 Human-In-The-Loop 재교육을 통해 모델의 정확성을 유지하므로 다양한 시스템에 걸쳐 AI를 통합하기 위한 강력한 도구가 됩니다.

플랫폼은 "BYOM(Bring Your Own Model)" 전략을 채택하여 LangChain, Anthropic 및 Microsoft와 같은 타사 프레임워크와의 통합을 가능하게 합니다. 또한 Google Cloud와 협력하여 개발된 A2A(Agent2Agent) 프로토콜은 엔터프라이즈 플랫폼 전반에서 AI 에이전트 간의 원활한 통신을 촉진합니다.

__XLATE_59__

LangChain의 CEO인 Harrison Chase는 다음과 같이 말했습니다. "에이전트 프로토콜에서 UiPath와의 협력을 통해 LangGraph 에이전트는 UiPath 자동화에 원활하게 참여할 수 있으며 범위를 넓히고 개발자가 더욱 응집력 있는 크로스 플랫폼 워크플로우를 구축할 수 있습니다."

UiPath AI Center는 표준화된 API를 통해 수백 개의 SaaS 애플리케이션에 연결하고, 프로세스 모델링을 위해 BPMN 2.0을 지원하며, 비즈니스 규칙 관리를 위해 DMN(Decision Model and Notation)을 사용합니다. 주목할만한 사례로는 호주 최대 상호 은행인 Heritage Bank가 있습니다. 이 은행은 AI 센터를 활용하여 대출 검토 프로세스를 자동화하고 수동 백엔드 작업을 줄이면서 고객 경험을 개선했습니다.

UiPath AI Center는 거버넌스와 보안을 우선시하여 프로젝트 및 테넌트 수준의 액세스 제어를 제공하여 추적성과 규정 준수를 유지합니다. 통제된 에이전시 기능은 AI 에이전트가 승인되지 않거나 안전하지 않은 작업을 자율적으로 수행할 수 없도록 보장합니다.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath AI Center는 모델 훈련, 호스팅, 예측과 같은 활동을 측정하는 AI 유닛을 사용하는 소비 기반 라이선스 모델을 사용합니다. 이는 오케스트레이션 및 실행 요구 사항을 충족하는 플랫폼 유닛을 통해 더 광범위한 UiPath 라이센싱 시스템에 원활하게 통합됩니다. 조직이 기능을 탐색할 수 있도록 Automation Cloud 및 Automation Suite 버전 모두에서 60일 무료 평가판을 사용할 수 있으므로 비용을 확인하면서 가치를 더 쉽게 평가할 수 있습니다.

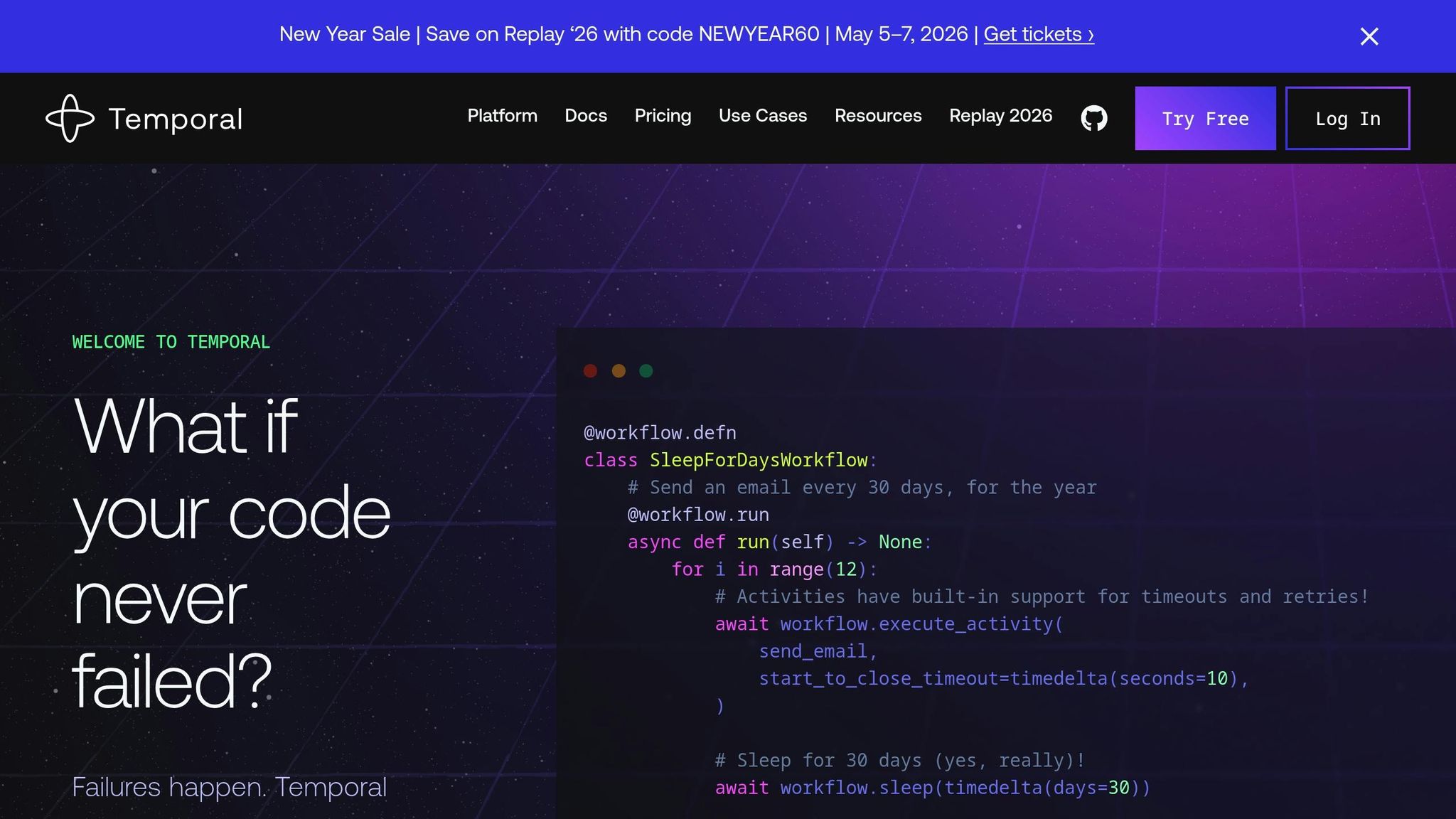

Temporal은 구성 파일에 의존하는 대신 내구성 있고 재개 가능한 코드를 사용하는 독특한 접근 방식을 취합니다. 불변의 이벤트 기록에 모든 워크플로 단계를 캡처하여 프로세스가 중단 후 중단된 위치를 정확하게 선택할 수 있도록 합니다. 이에 대한 좋은 예는 코딩 에이전트 제어 평면을 Temporal로 전환하여 안정성과 사용자 경험을 크게 향상시킨 Replit입니다.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, Retool 제품 관리자

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

이러한 확장성은 다양한 도구 및 시스템과의 원활한 통합을 보장합니다.

개발자는 Python, Go, Java, TypeScript, .NET, PHP 등 널리 사용되는 언어로 워크플로를 코드로 작성할 수 있습니다. Temporal은 또한 OpenAI Agents SDK, Pydantic AI, LangGraph 및 Crew AI를 포함한 주요 AI 프레임워크와 쉽게 통합됩니다. MCP(Model Context Protocol)에 대한 지원으로 에이전트 신뢰성이 향상됩니다. Langfuse 등 AI 전용 모니터링 도구와의 연결을 통해 관찰성이 향상됩니다. 예를 들어 Gorgias는 이러한 유연성을 활용하여 15,000개 이상의 전자상거래 브랜드가 AI 기반 고객 서비스 상담원을 관리하도록 지원합니다.

Temporal의 이벤트 기록은 AI 워크플로의 모든 상태 변경에 대한 완전하고 변경할 수 없는 감사 추적을 제공합니다. 이 기능은 Human-In-The-Loop 거버넌스를 지원하므로 자율적인 결정을 실행하기 전에 외부 검증을 위해 워크플로를 일시 중지할 수 있습니다. 이 보호 장치는 LLM 환각과 같은 문제를 방지하기 위해 프로덕션 환경에서 특히 유용합니다. Temporal Cloud 배포에서는 공급자가 애플리케이션 코드에 액세스할 수 없는 반면, 오픈 소스 MIT 라이선스 서버 옵션을 사용하면 조직이 자체 보안 인프라 내에서 플랫폼을 호스팅할 수 있습니다. Netflix 엔지니어들은 이 설계가 어떻게 유지 관리를 최소화하고 오류 처리를 단순화하는지 강조했습니다.

Temporal Cloud는 종량제 모델로 운영되는 반면, 오픈 소스 Temporal Server는 자체 호스팅이 무료입니다. 신규 사용자는 $1,000의 Temporal Cloud 무료 크레딧으로 플랫폼을 탐색할 수 있습니다. 컴퓨팅 리소스를 소비하지 않고 워크플로를 일시 중단함으로써 사용자는 인프라 및 운영 비용을 크게 줄일 수 있습니다. Temporal의 설계는 효율성과 신뢰성을 향상시킬 뿐만 아니라 AI 운영이 성장함에 따라 비용을 통제할 수 있습니다.

이상적인 AI 오케스트레이션 플랫폼을 선택하려면 유연성과 사용 편의성의 균형이 필요합니다. Apache Airflow 및 LangChain과 같은 오픈 소스 옵션은 공급업체 독립성과 심층적인 사용자 정의를 제공하지만 보안 및 거버넌스를 위한 고급 기술과 수동 구성이 필요합니다. 반면, IBM watsonx Orchestrate 및 UiPath와 같은 엔터프라이즈 플랫폼에는 역할 기반 액세스 제어(RBAC), 감사 추적, HIPAA 준수와 같은 기능이 내장되어 있지만 라이센스 비용이 들고 유연성이 떨어집니다.

확장성 전략은 플랫폼마다 크게 다릅니다. Kubeflow 및 Argo Workflows와 같은 Kubernetes 기반 도구는 컨테이너화된 이식성이 뛰어난 반면, Apache Airflow의 방향성 비순환 그래프(DAG) 기반 스케줄링은 하이브리드 및 멀티 클라우드 설정에서 복잡한 종속성을 관리하는 데 효과적입니다. Temporal은 높은 처리량으로 잘 알려진 반면, Azure Machine Learning 및 Google Vertex AI Pipelines는 상위 클라우드 생태계를 활용하여 최대 수요 동안 리소스를 동적으로 할당합니다. 이러한 변형은 조직이 솔루션을 평가할 때 고려해야 하는 장단점을 강조합니다.

상호 운용성은 통합된 워크플로를 보장하는 또 다른 중요한 요소입니다. LangChain을 사용하면 개발자는 기존 시스템을 점검하지 않고도 여러 LLM(대형 언어 모델)과 API를 연결할 수 있으며 Kubeflow는 단일 파이프라인 내에서 PyTorch, TensorFlow, JAX와 같은 프레임워크를 지원합니다. Prompts.ai와 같은 플랫폼은 여러 모델을 통합하여 조각화를 줄이는 것을 목표로 하는 반면, Azure Machine Learning 및 IBM watsonx Orchestrate와 같은 공급업체별 플랫폼은 원활한 기본 통합을 제공하지만 더 넓은 호환성을 위해 추가 커넥터가 필요할 수 있습니다.

운영상의 장단점은 배포 결정 및 투자 수익(ROI)에도 중요한 역할을 합니다. 거버넌스와 비용 관리는 플랫폼이 크게 다른 영역입니다. IBM watsonx Orchestrate 및 UiPath와 같은 엔터프라이즈급 솔루션은 중앙 집중식 대시보드와 강력한 보안 기능을 제공하므로 의료, 금융 등 규제 대상 산업에 적합합니다. 이와 대조적으로 오픈 소스 도구는 유사한 감독을 달성하기 위해 수동 설정이 필요한 경우가 많습니다. 비용 관점에서 Apache Airflow, LangChain 및 Kubeflow는 무료로 배포할 수 있지만 엔지니어링 시간 및 전문 지식과 관련된 숨겨진 비용이 발생할 수 있습니다. Temporal Cloud는 1,000달러의 무료 크레딧으로 종량제 가격을 제공하고, Prompts.ai는 반복 비용을 없애는 통합 TOKN 크레딧 시스템을 통해 AI 소프트웨어 비용을 최대 98%까지 크게 절감합니다.

아래 표는 주요 운영 측면에서 각 플랫폼을 자세히 비교한 것입니다.

최고의 AI 오케스트레이션 플랫폼을 선택하는 것은 조직의 기술 역량, 규정 준수 요구 사항 및 성장 계획에 따라 달라집니다. Apache Airflow 및 LangChain과 같은 오픈 소스 옵션은 라이선스 비용 없이 비교할 수 없는 유연성을 제공하므로 기술 스타트업의 개발자 중심 팀과 모듈식 설정을 중요시하는 빠르게 성장하는 회사가 선택할 수 있습니다. 그러나 이러한 프레임워크에는 보안, 거버넌스, 확장성과 같은 중요한 기능을 구성하기 위한 고급 엔지니어링 기술이 필요합니다. 반면, IBM watsonx Orchestrate와 같은 엔터프라이즈 플랫폼은 역할 기반 액세스 제어, 감사 추적, HIPAA 및 SOC 2와 같은 인증과 같은 내장된 규정 준수 조치가 협상 불가능한 의료 및 금융과 같은 산업에 적합합니다. 이러한 플랫폼은 워크플로우를 간소화하고 거버넌스 기능을 향상된 비즈니스 결과에 연결함으로써 실질적인 수익을 보여주는 경우가 많습니다.

대기업의 경우 거버넌스가 많은 플랫폼이 필수적이지만 중견 기업의 경우 비용과 성능의 균형을 맞추는 솔루션이 필요한 경우가 많습니다. Prompts.ai는 35개 이상의 모델을 하나의 인터페이스에 통합하고 실시간 FinOps 제어 및 종량제 TOKN 크레딧을 제공하여 도구 조각화 및 예상치 못한 비용을 최소화함으로써 이 방정식을 단순화합니다. 한편, Kubeflow Pipelines 및 Argo Workflows와 같은 Kubernetes 기반 도구는 이식성과 하이브리드 클라우드 배포가 핵심인 경우, 특히 분산 시스템 전반에서 복잡한 기계 학습 파이프라인을 관리하는 데이터 과학 팀의 경우 빛을 발합니다.

앞서 논의한 바와 같이 자율 에이전트가 다단계 추론을 위해 협력하는 에이전트 AI의 출현은 원활한 오케스트레이션의 중요성이 커지고 있음을 강조합니다. Domo를 인용하자면:

__XLATE_78__

"AI의 성공은 더 이상 가장 많은 모델을 보유하는 것이 아니라 모델을 효과적으로 조정하는 것입니다."

미국 조직의 경우 AI가 여러 부서에 더욱 통합됨에 따라 확장할 수 있는 여지를 제공하면서 현재의 기술적 성숙도에 맞는 플랫폼을 선택하는 것이 중요합니다. 현명한 시작점은 특정 워크플로에 초점을 맞추고 입력, 출력 및 오류를 추적하여 향후 확장을 위한 관찰 가능성 기준선을 설정하는 파일럿 프로젝트입니다. 올바른 오케스트레이션 플랫폼은 단순히 AI 도구를 연결하는 것 이상을 수행합니다. 팀이 협업하고, 문제를 해결하고, 더 큰 규모로 가치를 창출하는 방법을 재정의합니다.

AI 오케스트레이션 플랫폼은 다양한 AI 모델, 데이터 소스 및 프로세스를 하나의 자동화 시스템으로 통합하여 복잡한 워크플로를 단순화합니다. 일정 관리, 리소스 배포, API 통합과 같은 작업을 관리하여 수동 작업을 최소화하는 동시에 개발 시간과 운영 비용을 크게 줄입니다.

이러한 플랫폼은 손쉽게 확장할 수 있도록 구축되어 기업이 인프라를 점검하지 않고도 소수의 작업을 처리하는 것에서 수천 개의 작업을 관리하는 것으로 확장할 수 있도록 해줍니다. 대용량 데이터 처리, 리소스 사용 효율성 향상, 일관된 감독 유지에 탁월합니다. 이를 통해 배포 속도가 빨라지고 생산성이 향상되며 기업의 역동적인 요구 사항을 더욱 잘 충족할 수 있는 AI 솔루션이 제공됩니다.

AI 오케스트레이션 플랫폼은 사용량 기반 가격 모델을 통해 비용을 처리하는 경우가 많으므로 기업은 고정 라이선스를 약정하는 대신 사용한 만큼만 비용을 지불할 수 있습니다. 이러한 플랫폼 중 다수에는 모델 또는 워크플로별 지출을 모니터링하는 대시보드, 예산 알림 시스템, 자세한 비용 분석을 위한 워크로드 태그 지정 등 실시간 재무 도구가 장착되어 있습니다. 이러한 도구를 통해 기업은 AI 관련 비용을 명확하게 파악하고 예산에 대한 통제력을 유지할 수 있습니다.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai는 2025년 보안 AI 오케스트레이션의 표준을 설정하여 기업에 AI 운영을 손쉽게 확장할 수 있는 안정적인 플랫폼을 제공합니다. 통합 대시보드는 내장된 거버넌스 도구, 실시간 비용 추적, 불변의 감사 추적 기능을 통해 관리를 단순화하도록 설계되었습니다. 이러한 기능을 통해 기업은 AI 워크플로를 완벽하게 감독하면서 규정을 준수할 수 있습니다.

역할 기반 액세스 제어, 엔드투엔드 암호화, 지속적인 규정 준수 모니터링과 같은 엔터프라이즈급 보안 조치를 갖춘 Prompts.ai는 모든 운영 단계에서 민감한 데이터를 보호합니다. 35개 이상의 주요 LLM을 단일 보안 프레임워크에 통합함으로써 위험을 줄이고 기업이 자신감과 효율성을 가지고 AI 기능을 확장할 수 있도록 지원합니다.