AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

팀과 워크플로에 적합한 프레임워크를 찾으려면 더 자세히 알아보세요.

Prompts.ai는 기업 사용자를 GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro 및 Kling을 포함하여 35개 이상의 주요 AI 모델에 연결하는 중앙 집중식 클라우드 기반 플랫폼 역할을 하며 모두 단일 인터페이스를 통해 액세스할 수 있습니다. 소프트웨어 설치가 필요하지 않으므로 규모에 관계없이 모든 팀이 AI를 워크플로에 쉽게 통합할 수 있습니다.

이 플랫폼은 AI 채택의 주요 과제인 도구 확산을 해결합니다. 통합된 환경을 제공함으로써 모델 선택, 신속한 워크플로 및 성능 추적을 단일 시스템으로 통합합니다. 이 접근 방식은 AI 사용을 분산된 일회성 실험에서 조직이 여러 부서에 쉽게 배포할 수 있는 일관되고 확장 가능한 프로세스로 전환합니다.

Prompts.ai는 기업 AI 워크플로우 자동화에 중점을 두어 조직이 거버넌스 문제를 해결하는 동시에 불필요한 비용을 절감하도록 돕습니다. Fortune 500대 기업부터 크리에이티브 에이전시 및 연구소에 이르기까지 사용자는 민감한 데이터가 여러 제3자 서비스에 노출될 위험 없이 규정을 준수하고 감사 가능한 워크플로우를 생성할 수 있습니다.

이 플랫폼은 GenAI.Works에서 5점 만점에 4.8점이라는 인상적인 사용자 평가를 받아 기업 문제 해결 및 자동화를 위한 최고의 AI 솔루션으로 인정받았습니다. 기업은 콘텐츠 생성 간소화, 전략적 워크플로우 자동화, 제안 개발 가속화와 같은 작업을 위해 Prompts.ai를 사용합니다. 어떤 경우에는 몇 주가 걸리던 프로젝트가 단 하루로 단축되었습니다.

주목할만한 사례는 2025년 5월 프리랜서 AI 디렉터인 Johannes Vorillon이 플랫폼을 사용하여 Google DeepMind Veo2 애니메이션을 브라이틀링과 프랑스 공군을 위한 홍보 동영상에 원활하게 통합한 것입니다. 이 프로젝트는 Prompts.ai가 어떻게 여러 AI 도구의 원활한 조정을 가능하게 하는지를 강조했습니다.

Prompts.ai는 단일 인터페이스를 통해 35개 이상의 언어 및 이미지 모델에 대한 액세스를 통합하여 팀이 AI로 작업하는 방식을 단순화합니다. 이를 통해 여러 구독, API 키 및 청구 시스템을 관리하는 번거로움이 사라집니다. 사용자는 단일 워크플로 내에서 특정 작업을 위해 다양한 모델을 결합하여 원활한 오케스트레이션 파이프라인을 만들 수 있습니다.

이 플랫폼은 모든 모델의 사용량을 표준화하여 비용 추적 및 리소스 할당을 간단하게 만드는 TOKN 신용 시스템에서 작동합니다. 팀은 성능 요구 사항에 따라 필요에 따라 모델 간에 전환할 수 있습니다. 비즈니스 계획에는 무제한 작업 공간과 공동 작업자가 포함되어 있어 조직이 AI 채택을 더 쉽게 확장할 수 있습니다.

Prompts.ai는 종량제 가격 모델을 통해 초기 탐색을 위해 월 0달러부터 시작하여 실제 사용량에 맞춰 비용을 조정합니다. 월간 회원당 $99~$129 범위의 비즈니스 플랜은 모든 계층에 걸쳐 다양한 수준의 TOKN 크레딧(250,000~1,000,000)과 10GB의 클라우드 스토리지를 제공합니다.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 2025년 6월 19일, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

비즈니스 계획(Core, Pro 및 Elite)에는 규정 준수 모니터링 및 거버넌스 관리를 위한 도구가 포함되어 있어 AI 상호 작용에 대한 완전한 가시성을 제공하고 규제 요구 사항을 충족하기 위한 자세한 감사 추적을 유지 관리합니다. Personal Creator 및 Family 플랜을 사용하는 소규모 팀과 개인 전문가라도 이러한 엔터프라이즈급 거버넌스 기능의 이점을 누릴 수 있습니다.

민감한 데이터는 중앙 집중식으로 통제되는 환경에 보관되므로 여러 타사 서비스에 걸쳐 정보가 확산되는 것과 관련된 위험이 줄어듭니다. 이 보안 아키텍처는 잠재적인 취약성을 최소화할 뿐만 아니라 엄격한 규정에 따라 운영되는 조직의 규정 준수 관리를 단순화합니다.

클라우드 네이티브 아키텍처로 설계된 Prompts.ai를 사용하면 조직이 쉽게 확장할 수 있습니다. 팀은 몇 분 안에 새로운 구성원을 추가하고, 작업 공간을 확장하고, 추가 모델에 액세스할 수 있으므로 AI 도입이 필요에 따라 빠르게 증가할 수 있습니다.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI는 대화형 인터페이스를 기반으로 하는 워크플로 자동화 솔루션을 제공합니다. 배포 아키텍처 및 조정 방법에 대한 구체적인 세부 정보는 공개적으로 제공되지 않지만 대화형 인터페이스에 대한 강조는 워크플로 자동화 간소화의 고유한 측면을 강조합니다.

IBM watsonx Orchestrate는 AI 기반 자동화를 엔터프라이즈 운영에 도입하여 개발자가 아닌 비즈니스 전문가가 자동화에 액세스할 수 있도록 하는 데 중점을 둡니다. 사용자가 자연어 명령을 내릴 수 있도록 함으로써 플랫폼은 HR, 재무, 영업, 고객 지원 및 조달 분야의 비기술 팀의 복잡한 작업을 단순화합니다. 이 접근 방식을 사용하면 코딩 전문 지식이 필요하지 않으므로 비즈니스 팀이 프로세스를 독립적으로 자동화할 수 있습니다.

이 플랫폼은 직원의 시간을 낭비하는 반복 작업을 자동화하는 데 탁월합니다. 간단한 언어 명령을 사용하여 사용자는 인터뷰 예약, 후보자 프로필 요약, 대출 처리 및 보고서 생성과 같은 작업에 대한 워크플로를 시작할 수 있습니다. watsonx Orchestrate는 엔터프라이즈급 보안 표준을 준수하면서 여러 백엔드 시스템에서 이러한 활동을 처리합니다.

예를 들어, 한 주요 금융 기관에서는 고객 지원 및 백오피스 기능을 간소화하기 위해 watsonx Orchestrate를 구현했습니다. 직원들은 자연어 입력을 사용하여 대출 처리 및 서비스 요청에 대한 워크플로를 자동화했습니다. 플랫폼은 백엔드 시스템과 원활하게 통합되고, 내장된 거버넌스를 통해 규정 준수를 유지했으며, 처리 시간이 빨라지고, 수동 오류가 줄어들고, 고객 만족도가 높아지는 등 눈에 띄는 개선 사항을 제공했습니다. 이 예에서는 일상적인 기업 작업을 효율적이고 자동화된 프로세스로 전환하는 플랫폼의 능력을 강조합니다.

IBM watsonx Orchestrate는 하이브리드 클라우드 배치 옵션을 제공하여 워크플로우를 클라우드, 온프레미스 또는 둘 다에서 실행할 수 있도록 합니다. 이러한 유연성은 엄격한 데이터 상주 정책이나 레거시 인프라를 갖춘 조직에 특히 유용합니다. 이 플랫폼은 LLM(대형 언어 모델), API 및 엔터프라이즈 애플리케이션을 활용하여 작업을 안전하게 실행하고 다양한 운영 환경과의 호환성을 보장합니다.

watsonx Orchestrate는 다양한 시스템과 원활하게 통합되어 기업 자동화를 위한 강력한 솔루션입니다. 시각적 커넥터와 API를 사용하여 CRM, ERP 및 AWS 및 Azure와 같은 클라우드 플랫폼에 연결됩니다. 또한 IBM Watson 서비스 및 기타 IBM AI 모델과 긴밀하게 작동하여 기본 워크플로우 자동화 이상으로 기능을 확장합니다. 고급 사용자의 경우 프로그래밍 방식의 API 액세스를 통해 기존 도구와의 추가 사용자 정의 및 통합이 가능합니다.

__XLATE_18__

"IBM watsonx Orchestrate는 AI 기반 자동화를 비즈니스 워크플로우에 직접 도입하도록 설계되었습니다. 개발자 중심 도구와 달리 watsonx Orchestrate는 무거운 코딩 없이 작업을 간소화하려는 HR, 재무, 영업 및 고객 지원 전문가를 대상으로 합니다." - 도모

또한 이 플랫폼에는 사전 구축된 AI 애플리케이션과 산업별 기술 세트가 포함되어 있어 일반적인 사용 사례를 더 빠르게 구현할 수 있습니다. 그러나 조직은 더 광범위한 통합 옵션을 갖춘 플랫폼에 비해 IBM 에코시스템 외부에서는 해당 기능이 더 제한될 수 있다는 점에 유의해야 합니다.

IBM watsonx Orchestrate는 강력한 거버넌스 프레임워크가 뛰어나 규제 대상 산업에서 선호되는 선택입니다. 역할 기반 액세스 제어를 통해 데이터 액세스가 승인된 사용자 및 특정 기능으로 제한됩니다.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

하이브리드 환경 전반에 걸쳐 확장되도록 설계된 watsonx Orchestrate는 소규모 팀과 대기업을 모두 지원합니다. 이는 운영 효율성을 향상시키고, 정책 준수를 보장하며, 위험을 완화하고, 직원 생산성을 향상시킵니다. 조직은 특정 부서에 초점을 맞춰 소규모로 시작하여 결과를 확인하고 내부 전문 지식을 개발하면서 점차 자동화 기능을 확장할 수 있습니다.

Apache Airflow는 방향성 비순환 그래프(DAG)를 사용하여 복잡한 데이터 워크플로를 조정하기 위해 구축된 오픈 소스 플랫폼입니다. 처음에는 Airbnb에 의해 개발되었으며 현재는 Apache Software Foundation에 속해 있으며 데이터 파이프라인 예약, 모니터링 및 관리를 위한 인기 있는 선택이 되었습니다. 비즈니스 사용자를 위해 맞춤화된 자동화 도구와 달리 Airflow는 데이터 엔지니어와 개발자를 염두에 두고 설계되어 워크플로 실행을 프로그래밍 방식으로 제어할 수 있습니다.

Airflow는 복잡한 종속성, 예약된 작업, 변환 논리를 포함하는 데이터 파이프라인 관리에 탁월합니다. 데이터 팀은 ETL(추출, 변환, 로드) 프로세스 조정, 기계 학습 모델 교육, 일괄 처리 작업 실행, 여러 소스에서 데이터 수집, 데이터 세트 변환, 일정에 따른 보고서 생성 등 다양한 목적으로 이를 사용합니다. Python에서 워크플로를 정의함으로써 개발자는 사용자 지정 논리를 구현하고 오류를 효과적으로 처리할 수 있는 광범위한 유연성을 얻을 수 있습니다.

플랫폼에는 워크플로 상태, 작업 종속성 및 실행 기록에 대한 통찰력을 제공하는 시각적 인터페이스가 포함되어 있습니다. 이를 통해 성능을 보다 쉽게 모니터링하고 오류를 해결할 수 있습니다. 예를 들어 작업이 실패하면 Airflow는 자동으로 작업을 재시도하고, 경고를 보내거나 후속 작업을 건너뛰어 연쇄 문제를 방지할 수 있습니다. 이 기능을 통해 다양한 배포 요구 사항에 맞는 다양한 선택이 가능합니다.

Airflow는 단일 서버 설정으로 배포하거나 스케줄러, 작업자 및 웹 서버가 별도의 시스템에서 작동하는 분산 클러스터로 확장할 수 있습니다. 아키텍처는 정의된 일정에 따라 작업을 트리거하는 스케줄러, 작업을 실행하는 작업자, 사용자 인터페이스용 웹 서버, 워크플로 정의 및 실행 기록을 저장하는 메타데이터 데이터베이스 등 여러 주요 구성 요소로 구성됩니다.

이 모듈식 설계를 통해 조직은 워크로드 수요에 따라 작업자 용량을 독립적으로 확장할 수 있습니다. 클라우드 네이티브 환경에서 Kubernetes는 Airflow를 배포하는 데 자주 사용되며, KubernetesExecutor는 개별 작업을 위한 격리된 포드를 생성합니다. 이 설정은 리소스 격리를 강화하고 팀이 각 작업에 특정 컴퓨팅 리소스를 할당할 수 있게 해줍니다. 인프라 관리 오버헤드를 줄이려는 경우 관리형 Airflow 서비스를 사용할 수 있지만 추가 운영 비용이 발생합니다.

Airflow의 광범위한 통합 기능으로 인해 적응성이 뛰어납니다. Python을 사용하여 사용자 정의 연산자를 생성하는 기능과 함께 데이터베이스, 클라우드 플랫폼, 데이터 웨어하우스 및 메시징 시스템을 위한 사전 구축된 커넥터를 제공합니다. 이러한 유연성을 통해 Airflow는 다양한 조직 요구 사항을 충족할 수 있습니다.

Python의 풍부한 라이브러리 에코시스템을 워크플로 내에서 활용하여 파이프라인 정의에서 직접 고급 데이터 변환 및 분석을 수행할 수도 있습니다. AI 및 머신러닝 애플리케이션의 경우 Airflow는 TensorFlow, PyTorch, scikit-learn과 같은 프레임워크와 원활하게 통합됩니다. 이러한 통합은 데이터 과학자가 데이터 가져오기, 기능 사전 처리, 모델 교육, 성능 평가, 프로덕션에 모델 배포 등의 작업에 대한 워크플로를 조율하는 데 도움이 됩니다.

Airflow에는 워크플로 및 관리 기능 전반에 걸쳐 사용자 권한을 관리하는 역할 기반 액세스 제어(RBAC)가 포함되어 있습니다. 관리자는 특정 권한이 있는 역할을 정의하여 승인된 사용자만 특정 DAG를 보거나 편집하거나 실행할 수 있도록 할 수 있습니다. 이러한 세부적인 제어는 작업 흐름 무결성을 유지하고 무단 변경을 방지하는 데 도움이 됩니다.

인증 옵션에는 비밀번호 기반 로그인, LDAP 통합 및 OAuth 공급자가 포함됩니다. 민감한 사용자 인증 정보는 Airflow의 연결 및 변수 시스템을 통해 별도로 관리됩니다. 보안 강화를 위해 HashiCorp Vault 또는 AWS Secrets Manager와 같은 외부 비밀 관리 도구를 통합할 수 있습니다.

감사 로깅은 사용자 작업 및 워크플로 실행을 추적하는 또 다른 핵심 기능입니다. 이를 통해 자세한 활동 기록이 생성되며 이는 규정 준수 및 문제 해결 목적으로 매우 중요합니다.

Airflow는 증가된 워크로드를 처리하기 위해 더 많은 작업자 노드를 추가하여 수평으로 확장됩니다. 플랫폼은 작업을 효과적으로 배포하기 위해 여러 실행기 유형을 지원합니다. LocalExecutor는 스케줄러와 동일한 시스템에서 작업을 실행하고, CeleryExecutor는 메시지 대기열을 사용하여 여러 작업자 시스템에 작업을 분산하며, KubernetesExecutor는 각 작업에 대해 격리된 포드를 스핀업합니다.

성능을 최적화하려면 신중한 DAG 설계와 리소스 할당이 필수적입니다. 작업량이 많으면 스케줄러에 부담을 줄 수 있으므로 팀에서는 대규모 DAG를 분할하고 스케줄러 설정을 조정하며 메타데이터 저장소에 충분한 리소스가 있는지 확인하는 경우가 많습니다.

Airflow는 또한 백필을 효율적으로 처리하므로 팀이 워크플로 논리가 변경될 때 기록 데이터를 다시 처리할 수 있습니다. 채우기는 업데이트를 간소화하는 반면 상당한 컴퓨팅 리소스를 소비할 수 있으므로 프로덕션 워크로드가 중단되지 않도록 신중한 계획이 필요합니다.

오픈 소스인 Airflow를 통해 조직은 배포를 완벽하게 제어할 수 있습니다. 그러나 이는 또한 인프라, 모니터링 및 업그레이드를 관리해야 한다는 것을 의미하며, 이를 위해서는 대규모 안정성과 성능을 유지하기 위해 전용 엔지니어링 리소스가 필요합니다.

Kubeflow는 보다 일반적인 용도의 워크플로 도구와는 달리 머신러닝 워크플로 관리를 위한 전용 플랫폼으로 두각을 나타냅니다. Kubernetes용으로 특별히 설계된 이 오픈 소스 솔루션은 전체 기계 학습 수명 주기를 지원하여 데이터 과학자와 ML 엔지니어에게 Kubernetes 기본 기능을 사용하여 프로덕션 지원 모델을 구축, 배포 및 관리하는 데 필요한 도구를 제공합니다.

Kubeflow는 Kubernetes 환경 내에서 완전한 기계 학습 워크플로를 조정하는 데 적합합니다. 데이터 전처리, 기능 엔지니어링, 모델 교육, 검증, 배포 및 모니터링을 포함하여 ML 수명주기의 모든 단계를 다룹니다. Kubeflow는 팀이 재사용 가능한 모듈식 파이프라인을 생성할 수 있도록 지원하여 분산된 ML 워크로드 관리를 단순화합니다. 중앙 집중식 접근 방식은 다양한 프로젝트 전반에 걸쳐 실험 추적 및 모델 감독에도 도움이 됩니다. 또한 Kubeflow는 새로운 데이터가 도입될 때 재학습 워크플로를 자동화하여 모델이 업데이트되고 관련성을 유지하도록 보장합니다.

Kubernetes를 기반으로 구축된 Kubeflow는 컨테이너 조정, 동적 확장, 리소스 관리를 활용하여 ML 워크플로를 최적화합니다. 사용자는 시각적 관리를 위한 웹 기반 인터페이스 또는 자동화를 위한 명령줄 인터페이스를 통해 플랫폼과 상호 작용할 수 있습니다. 워크로드에 따라 Kubeflow는 학습 작업을 위한 GPU 프로비저닝, 추론을 위한 CPU 프로비저닝 등 리소스를 동적으로 할당합니다. 유연성 덕분에 온프레미스, 클라우드, 하이브리드 설정 등 모든 Kubernetes 클러스터에 배포할 수 있어 환경 전반에 걸친 적응성을 보장합니다.

Kubeflow는 TensorFlow, PyTorch, XGBoost와 같은 널리 사용되는 기계 학습 프레임워크와 원활하게 통합되는 동시에 확장 가능한 설계를 통해 맞춤형 프레임워크도 지원합니다. ML 프레임워크 외에도 다양한 클라우드 서비스 및 스토리지 솔루션과 연결되어 파이프라인이 데이터용 개체 스토리지, 기능 검색용 데이터 웨어하우스 및 성능 추적용 모니터링 도구에 액세스할 수 있도록 합니다. Python 라이브러리와의 호환성 덕분에 실험에서 생산으로의 전환이 더욱 간소화됩니다.

Kubeflow는 Kubernetes의 고유한 확장 기능을 사용하여 클러스터 리소스 전체에 작업 부하를 분산하므로 대규모 교육 및 데이터 처리 작업에 적합합니다. 이를 통해 효율적인 리소스 활용이 보장되고 고성능 ML 작업이 지원됩니다. Akka는 적절하게 다음과 같이 말했습니다.

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

리소스를 독립적으로 할당할 수 있는 능력을 갖춘 Kubeflow는 실험과 생산 사이의 격차를 해소하여 유연성과 성능을 모두 제공합니다.

Flyte는 Kubernetes를 사용하여 컨테이너화된 기계 학습(ML) 워크플로의 관리를 간소화하도록 설계된 클라우드 네이티브 오케스트레이션 플랫폼입니다. 클라우드 환경 전체에 리소스를 효율적으로 배포하여 ML 파이프라인 배포의 복잡성을 줄여줍니다. 이 접근 방식은 배포 규모에 관계없이 원활한 확장과 일관된 성능을 보장합니다.

Flyte는 모든 규모의 ML 워크플로를 처리하고 다양한 요구 사항을 충족하기 위해 리소스를 동적으로 할당하도록 제작되었습니다. 강력한 아키텍처는 워크로드의 효율적인 관리를 보장하므로 클라우드 기반 인프라 전반의 광범위한 ML 작업에 대한 안정적인 선택이 됩니다.

Prefect는 복잡한 데이터 파이프라인 및 기계 학습 워크플로를 더 간단하게 관리할 수 있도록 설계된 Python 기반 오케스트레이션 플랫폼입니다. 사용 편의성, 명확한 모니터링, 운영 장애물 최소화에 중점을 두어 데이터 과학자와 엔지니어가 인프라에 대해 걱정하는 대신 워크플로 생성에 집중할 수 있도록 합니다.

Prefect는 기계 학습 파이프라인, 클라우드 워크플로 및 데이터 변환 프로세스를 자동화하는 데 탁월합니다. 이는 여러 종속성, 병렬 실행 및 실시간 처리가 포함된 ETL 작업 및 복잡한 기계 학습 워크플로를 처리하는 데 특히 적합합니다. 유연한 예약 시스템을 통해 시간 간격, 특정 이벤트 또는 API 호출을 기반으로 작업을 트리거할 수 있으므로 다양한 자동화 요구 사항에 적응할 수 있습니다.

Prefect는 클라우드 환경에 최적화되어 있어 최신 인프라 요구 사항에 맞게 확장하고 적응할 수 있습니다. 기본적으로 Python으로 구축되어 Python 기반 데이터 생태계와 원활하게 통합되므로 새로운 프로그래밍 언어나 도구를 배울 필요가 없습니다.

Prefect는 광범위한 데이터 도구 및 플랫폼과의 원활한 호환성을 제공합니다. dbt, PostgreSQL, Snowflake 및 Looker와 같은 널리 사용되는 도구와 쉽게 통합되는 동시에 Apache Kafka와 같은 실시간 시스템도 지원합니다. 클라우드 환경의 경우 Amazon Web Services(AWS), Google Cloud Platform(GCP), Microsoft Azure와 같은 주요 제공업체와 협력하여 팀이 비용과 성능을 기반으로 워크로드를 최적화할 수 있는 유연성을 제공합니다. 또한 Prefect는 Docker 및 Kubernetes와 같은 컨테이너화 도구를 지원하고 Dask 및 Apache Spark와 같은 분산 처리 프레임워크와 함께 작동합니다. 팀에 최신 정보를 제공하기 위해 워크플로 업데이트에 대한 Slack 알림도 제공됩니다.

Prefect는 증가하는 데이터 볼륨과 증가하는 워크플로우 복잡성을 쉽게 처리하도록 제작되었습니다. 내결함성 엔진은 실패한 작업을 재시도하거나 문제를 우회하여 워크플로가 오류로부터 복구될 수 있도록 보장하므로 프로덕션 환경에서 안정성이 높습니다. 실시간 모니터링은 워크플로 실행에 대한 자세한 통찰력을 제공하여 팀이 문제를 신속하게 식별하고 해결하는 데 도움을 줍니다. 효율적으로 확장할 수 있는 능력을 갖춘 Prefect는 주요 기술 기업의 신뢰를 받아 동적 워크플로를 관리합니다. 이제 막 시작하는 팀을 위해 Prefect는 무료 플랜을 제공하고, 추가 기능과 지원이 필요한 대규모 배포에는 맞춤형 가격을 제공합니다.

Metaflow는 기계 학습 워크플로우 확장 문제를 해결하기 위해 Netflix가 처음 개발한 기계 학습 인프라 플랫폼입니다. 프로세스를 사용자 친화적이고 효율적으로 만드는 데 중점을 두고 데이터 과학자가 복잡한 인프라를 다루지 않고도 프로토타입에서 생산까지 원활하게 이동할 수 있도록 지원합니다.

Metaflow는 확장 가능한 프로덕션 수준의 기계 학습 워크플로를 관리하도록 구축되었습니다. 탐색적 데이터 분석 및 모델 교육부터 배포까지의 과정을 단순화합니다. 데이터 과학자는 친숙한 라이브러리를 사용하여 Python으로 워크플로를 작성할 수 있으며 플랫폼은 버전 관리, 종속성 관리 및 컴퓨팅 리소스 할당을 자동으로 처리합니다.

플랫폼은 필요한 컴퓨팅 리소스를 자동으로 프로비저닝하여 수동 인프라 관리의 필요성을 제거합니다. 이를 통해 코드 수정 없이 로컬 개발에서 클라우드 프로덕션으로 원활하게 전환할 수 있습니다.

__XLATE_53__

"Metaflow는 간소화된 클라우드 통합, 강력한 버전 관리 및 프로덕션 지원 배포를 위한 인프라 추상화를 제공하여 확장 가능한 ML 워크플로를 간단하게 조정합니다." - Akka.io

Metaflow의 배포 프로세스는 클라우드 서비스 및 데이터 플랫폼과 쉽게 통합할 수 있는 기능으로 보완됩니다. Python 기반 디자인은 기계 학습, 데이터 처리 및 시각화를 위해 널리 사용되는 라이브러리와의 호환성을 보장하므로 팀이 이미 사용하고 있는 도구를 극대화할 수 있습니다.

원래 광범위한 기계 학습 작업을 지원하기 위해 Netflix에서 만든 Metaflow는 강력한 버전 관리 시스템을 갖추고 있습니다. 이 시스템은 실험, 데이터 세트 및 모델 버전을 추적하여 실험의 재현성을 보장하고 필요할 때 쉽게 롤백할 수 있도록 합니다.

Dagster는 적응형 파이프라인 관리를 제공하는 동시에 데이터 무결성 유지에 중점을 두어 오케스트레이션 프레임워크 라인업을 추가합니다. 이 오픈 소스 도구는 품질을 향상시키고, 데이터 계보를 추적하고, 기계 학습(ML) 워크플로 내에서 가시성을 보장하도록 제작되었습니다. Dagster의 핵심은 높은 수준의 데이터 무결성을 유지하고 변환에 대한 명확한 통찰력을 제공하는 유형이 안전하고 안정적인 데이터 파이프라인을 구축하는 데 특화되어 있습니다.

Dagster는 데이터 품질과 정밀도가 타협할 수 없는 ML 워크플로를 관리하는 데 특히 효과적입니다. 프로세스 전반에 걸쳐 내장된 검증, 강력한 메타데이터 추적 및 포괄적인 관찰 가능성이 필요한 팀을 위해 맞춤화되었습니다. 그 유틸리티의 실제적인 예는 조직이 Dagster를 사용하여 엄격한 규정 준수 및 품질 벤치마크를 충족하는 데 필요한 무결성 수준으로 민감한 의료 데이터를 처리하는 의료 부문에서 볼 수 있습니다.

Dagster를 사용하면 개발자는 AI 작업 확장에 필수적인 기능인 복잡한 워크플로를 코드에서 직접 정의할 수 있습니다. 모듈식 구조는 연결 모델과 에이전트를 지원하여 자동화된 종속성 관리, 재시도 메커니즘 및 병렬 실행을 갖춘 고급 워크플로를 생성합니다. 또한 Dagster는 다양한 클라우드 플랫폼, API 및 벡터 데이터베이스와 원활하게 통합되므로 대규모 데이터 및 AI 작업을 처리하는 데 매우 적합합니다.

이 유연한 아키텍처는 다양한 시스템과의 원활한 통합을 보장합니다.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen은 여러 AI 에이전트가 대화를 통해 협업하여 복잡한 작업을 처리할 수 있도록 Microsoft Research에서 개발한 오픈 소스 프레임워크입니다. 이 시스템을 통해 개발자는 전문 에이전트가 함께 작업하고 각자 고유한 전문 지식을 제공하여 공유 목표를 달성하는 애플리케이션을 만들 수 있습니다. 대화형 인터페이스를 도입함으로써 AutoGen은 여러 AI 구성 요소를 조정하는 복잡한 프로세스를 단순화합니다.

AutoGen은 대화를 협업 수단으로 활용하여 다중 에이전트 오케스트레이션에 대한 새로운 접근 방식을 도입합니다. 이 프레임워크는 여러 에이전트가 동적으로 함께 작업해야 하는 문제 해결 시나리오에 특히 효과적입니다. 예를 들어, 소프트웨어 개발에서 한 에이전트는 코드를 생성하고 다른 에이전트는 테스트 및 검증에 중점을 두고 두 에이전트 모두 출력을 개선하기 위해 반복할 수 있습니다. 이 대화형 모델은 소프트웨어 워크플로 자동화, 연구 지원, 다양한 관점이나 기술이 결과를 향상시키는 복잡한 의사 결정 프로세스 처리와 같은 작업에 적합합니다.

워크플로우의 반복적인 개선을 목표로 하는 팀은 AutoGen이 특히 매력적이라고 생각합니다. 에이전트 간의 주고받는 교환을 촉진하는 기능은 인간의 협업을 반영하므로 개발자가 지속적인 대화와 피드백을 통해 발전하고 개선되는 시스템을 더 쉽게 설계할 수 있습니다.

AutoGen은 대화형 에이전트 설계를 돋보이게 하면서 모듈성을 강조합니다. 각 에이전트는 도구, 외부 API 또는 언어 모델에 대한 액세스를 포함할 수 있는 특정 역할 및 지침에 따라 작동합니다. 프레임워크는 인간의 입력을 통합하는 자율 에이전트와 사용자 프록시 에이전트를 모두 지원하여 워크플로 관리에 유연성을 제공합니다.

시스템은 개발 중에 로컬로 실행될 수 있으며 프로덕션을 위해 클라우드 환경으로 확장될 수 있습니다. 개발자는 에이전트가 교대로 작업하는 순차적 워크플로를 통하든 여러 에이전트가 동시에 참여하는 보다 복잡한 패턴을 통해 에이전트가 상호 작용하는 방식을 정의할 수 있습니다. Python 기반 구성을 사용하면 팀은 가독성을 저하시키지 않고 오케스트레이션 논리를 완벽하게 제어할 수 있으므로 다중 에이전트 상호 작용 관리 프로세스가 간소화됩니다.

AutoGen은 여러 모델 호출 및 에이전트 대화 관리의 복잡성을 처리하므로 개발자는 인프라에 대해 걱정하는 대신 시스템의 논리와 동작을 만드는 데 집중할 수 있습니다.

AutoGen은 함수 호출을 통해 Azure OpenAI Service 및 기타 모델과 원활하게 통합되므로 개발자가 AI 백엔드를 선택할 수 있는 유연성을 제공합니다. 또한 에이전트를 외부 도구 및 서비스에 연결하여 대화 중에 데이터를 검색하고, 코드를 실행하고, 타사 API와 상호 작용할 수 있도록 지원합니다.

프레임워크를 통해 개발자는 사용자 지정 에이전트 유형, 재사용 가능한 대화 패턴 및 오케스트레이션 템플릿을 만들 수 있습니다. 이러한 유연성은 팀이 일반적인 작업에 기존 패턴을 활용하는 동시에 특수한 요구 사항에 맞게 심층적으로 사용자 정의할 수 있음을 의미합니다.

이미 Microsoft 도구를 사용하고 있는 조직의 경우 AutoGen은 Azure 서비스, Visual Studio Code 및 기타 개발 플랫폼과의 손쉬운 통합을 제공합니다. Microsoft 에코시스템과의 이러한 일치에도 불구하고 프레임워크는 플랫폼에 구애받지 않으며 다양한 기술 환경에서 잘 작동합니다.

AutoGen은 에이전트 기능 제어 및 외부 리소스에 대한 액세스 관리에 중점을 두고 있습니다. 개발자는 액세스할 수 있는 API, 검색할 수 있는 데이터 등 각 에이전트에 대한 특정 권한을 정의합니다. 이러한 세분화된 접근 방식을 통해 에이전트는 최소 권한 원칙에 따라 작동하여 자신의 역할에 필요한 작업만 수행할 수 있습니다.

프레임워크의 대화형 특성은 본질적으로 감사 추적, 로깅 에이전트 상호 작용 및 의사 결정 프로세스를 생성합니다. 이러한 로그는 출력이 생성되는 방식에 대한 투명성을 제공하여 규정 준수 및 디버깅 노력을 돕습니다. 팀은 이러한 기록을 검토하여 상담원 행동을 분석하고 개선이 필요한 영역을 식별할 수 있습니다.

Human-in-the-Loop 기능은 중요한 결정 지점에서 사람이 검토할 수 있도록 워크플로를 일시 중지할 수 있도록 하여 감독을 강화합니다. 이 기능은 자동화 효율성과 거버넌스 및 제어의 균형을 유지하면서 진행하기 전에 민감한 작업을 평가할 수 있도록 보장합니다.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

조직은 대화 컨텍스트를 캐싱하고, 일상적인 작업에 더 빠른 모델을 사용하고, 복잡한 추론을 위해 고급 모델을 예약함으로써 성능을 향상시킬 수 있습니다. 불필요한 교환을 최소화하도록 대화 패턴을 설계하는 것도 효율성을 높입니다. 적절한 경우 프레임워크는 병렬 에이전트 실행을 지원하여 독립적인 작업을 순차적이 아닌 동시에 실행할 수 있도록 합니다.

높은 워크로드를 처리하기 위해 AutoGen을 자동 확장 클라우드 인프라에 배포하여 시스템이 비용을 억제하면서 다양한 수요를 관리할 수 있도록 보장할 수 있습니다. 상태 비저장 에이전트 상호 작용은 수평 확장을 단순화하지만 교환 전반에 걸쳐 컨텍스트를 유지하려면 신중한 아키텍처 계획이 필요합니다.

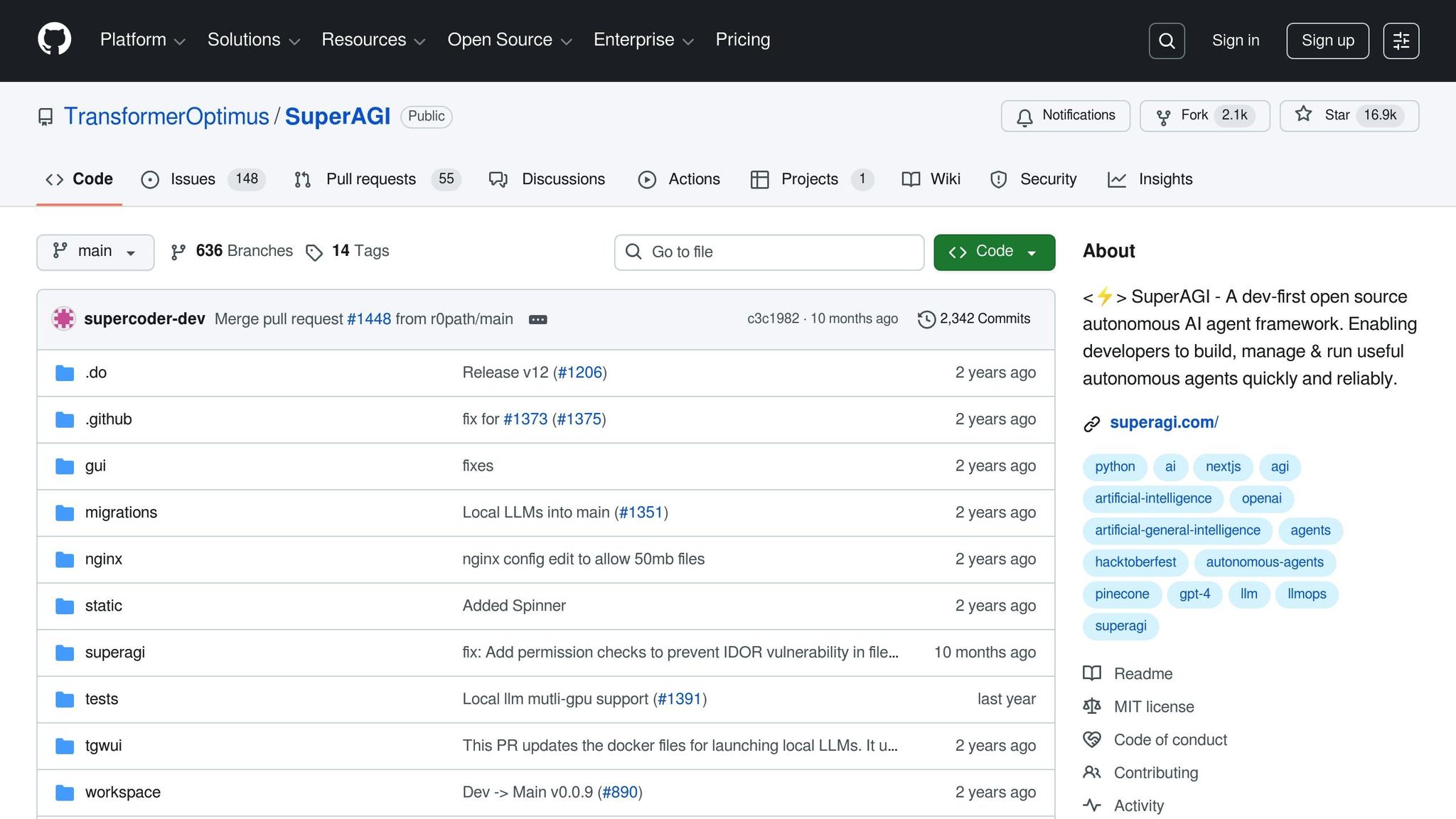

우리가 살펴본 오케스트레이션 프레임워크를 기반으로 SuperAGI는 다중 에이전트 협업을 관리하는 새로운 방법을 도입합니다. 이 오픈 소스 플랫폼은 자율 AI 에이전트를 조정하여 개발자가 지속적인 학습을 통해 작업을 계획, 실행 및 적응할 수 있는 에이전트를 생성, 배포 및 감독할 수 있도록 지원합니다. SuperAGI를 사용하면 여러 에이전트가 원활하게 협력하고 동적으로 작업을 위임하고 협업하여 복잡한 문제를 해결할 수 있습니다. 적응형 작업 관리와 다중 에이전트 팀워크를 병합하여 고급 AI 조정을 위한 강력한 도구로 차별화됩니다.

SuperAGI는 기업의 복잡하고 발전하는 작업을 자동화하는 데 빛을 발합니다. 에이전트 네트워크는 고급 작업 계획 및 실행에 탁월하며 강화 학습 및 피드백 루프를 통해 지속적으로 개선됩니다. 이는 지능형 조정이 중요한 대규모 작업을 처리하는 조직에 특히 유용합니다. 플랫폼 내의 에이전트는 상호 작용과 결과를 통해 학습하여 시간이 지남에 따라 행동을 개선할 수 있습니다.

플랫폼의 뛰어난 기능은 동적 작업 위임입니다. 에이전트는 엄격한 워크플로를 고수하는 대신 실시간으로 상황을 평가하고 우선 순위 작업을 식별하여 가장 적합한 네트워크 구성원에게 할당합니다. 이러한 유연성을 통해 복잡한 시나리오에서도 리소스를 효율적으로 할당할 수 있습니다.

SuperAGI의 아키텍처는 확장성과 모듈성을 핵심으로 설계되었습니다. 개발자는 에이전트 네트워크와 워크로드를 쉽게 확장하여 다양한 애플리케이션 요구 사항을 충족할 수 있습니다. 각 에이전트는 독립적으로 작동하면서도 원활하게 통신하여 원활한 협업을 보장합니다.

사용자 친화적인 그래픽 인터페이스를 통해 팀은 상담원 상호 작용을 시각화하고 구성을 미세 조정할 수 있습니다. 모니터링 대시보드는 에이전트 성능에 대한 통찰력을 제공하여 개발자가 비효율성을 식별하고 해결하는 데 도움을 줍니다. 또한 플랫폼은 병렬 실행을 지원하므로 여러 에이전트가 독립적인 작업을 동시에 처리할 수 있습니다. 이 설계는 특히 수요가 많은 환경에서 처리량을 크게 향상시킵니다.

SuperAGI는 타사 API, 워크플로 도구 및 사용자 정의 모듈과 통합되는 확장 가능한 플러그인 시스템을 갖추고 있습니다. 이러한 유연성은 개발을 가속화하고 광범위한 개발자 커뮤니티의 기여를 장려하여 플랫폼의 기능을 풍부하게 합니다.

플랫폼의 분산형 모듈식 아키텍처는 수평적 확장을 지원하므로 대규모 구현에 적합합니다. 강화 학습 및 피드백 루프를 사용하면 전반적인 성능이 향상되어 작업이 효율적으로 할당됩니다. 효과적인 협업과 높은 처리량을 지원함으로써 SuperAGI는 복잡한 대용량 시나리오에서 강력한 성능을 요구하는 조직에 매우 적합합니다.

올바른 AI 오케스트레이션 프레임워크를 선택한다는 것은 각 옵션의 장점과 한계를 이해하는 것을 의미합니다. 이러한 플랫폼은 엔터프라이즈 수준 보안, 개발자 적응성 또는 기계 학습 파이프라인과 같은 특수 워크플로와 같은 요구 사항을 충족하기 위해 다양한 우선 순위를 염두에 두고 설계되었습니다. 각 프레임워크는 고유한 디자인 철학과 대상 사용 사례를 반영합니다.

예를 들어 Prompts.ai와 같은 플랫폼은 대규모 언어 모델(LLM)에 대한 액세스를 중앙 집중화하는 데 탁월한 반면, Apache Airflow 및 Prefect와 같은 도구는 일반적인 워크플로 자동화에 중점을 둡니다. 반면 Kubeflow와 Flyte는 기계 학습 파이프라인에 맞게 조정되었으며 SuperAGI 및 Microsoft AutoGen과 같은 프레임워크는 자율 시스템이 복잡한 작업을 함께 처리할 수 있도록 지원하여 다중 에이전트 AI 협업의 한계를 확장합니다.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

비용 구조: 기존 플랫폼은 사용자 또는 실행당 비용을 청구하는 경우가 많으므로 운영이 증가함에 따라 비용이 높아질 수 있습니다. 이와 대조적으로 Prompts.ai는 TOKN 크레딧이 포함된 종량제 모델을 사용하여 비용을 사용량과 직접 연결합니다. 이 접근 방식은 다양한 모델을 실험하거나 변동하는 워크로드를 관리할 때 특히 유용합니다.

보안 및 규정 준수: 의료 또는 금융과 같은 산업의 경우 강력한 보안 조치가 필수적입니다. Prompts.ai, IBM watsonx Orchestrate 및 Prefect와 같은 플랫폼은 감사 추적 및 역할 기반 액세스 제어와 같은 내장형 규정 준수 도구를 제공합니다. 그러나 Apache Airflow와 같은 오픈 소스 옵션에는 엄격한 규정 준수 표준을 충족하기 위해 추가 구성이 필요합니다.

학습 곡선: 유용성은 매우 다양합니다. Prefect 및 Dagster와 같은 플랫폼은 초보자에게 더욱 친숙하며 직관적인 Python API와 유용한 오류 메시지를 제공합니다. 한편 Apache Airflow와 Kubeflow는 더 깊은 기술 전문 지식과 인프라 관리 기술을 요구합니다. Prompts.ai는 고급 사용자를 위한 고급 기능과 사용 편의성의 균형을 맞춘 통합 인터페이스를 통해 이를 더욱 단순화합니다.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

통합 생태계: 기존 도구와의 원활한 통합이 중요합니다. Apache Airflow는 클라우드 서비스, 데이터베이스 및 모니터링 도구를 위한 수백 개의 플러그인을 제공합니다. 반면 Prompts.ai는 특히 LLM에 중점을 두고 단일 API를 통해 수십 가지 모델에 대한 간소화된 액세스를 제공합니다.

확장성: Kubeflow 및 Flyte와 같은 플랫폼은 워크로드 분산을 위해 Kubernetes를 활용하여 수평 확장을 위해 구축되었습니다. Metaflow는 탄력적인 확장을 위해 AWS 서비스를 사용하고 Prefect는 클라우드 관리 및 자체 호스팅 확장 옵션을 모두 지원합니다. SuperAGI는 분산 에이전트 아키텍처를 사용하여 병렬 실행을 가능하게 하지만 이를 위해서는 신중한 조정이 필요합니다.

귀하에게 가장 적합한 프레임워크는 특정 워크플로우에 따라 다릅니다. LLM 오케스트레이션의 경우 Prompts.ai는 중앙 집중식 모델 액세스 및 비용 효율성이 돋보입니다. 데이터 엔지니어링 팀은 Apache Airflow의 안정성에 의지할 수 있고, 대규모 교육 및 배포를 수행하는 ML 팀은 Kubeflow 또는 Flyte의 이점을 누릴 수 있습니다. 자율 AI 시스템 구축에 중점을 두고 있다면 SuperAGI 또는 Microsoft AutoGen이 적합할 수 있습니다.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

예를 들어, LLM 오케스트레이션을 우선시하는 팀은 Prompts.ai가 특히 매력적일 수 있습니다. 통합 인터페이스를 통해 GPT-5, Claude, Gemini 등 35개 이상의 모델에 대한 중앙 집중식 액세스를 제공합니다. 종량제 TOKN 신용 시스템은 실시간 비용 추적을 제공하는 동시에 구독료를 제거합니다. 역할 기반 액세스 제어 및 감사 추적과 같은 기능을 갖춘 Prompts.ai는 속도 저하 없이 엄격한 거버넌스가 필요한 산업에 강력한 선택입니다.

복잡한 ETL 파이프라인을 사용하는 데이터 엔지니어링 팀은 강력한 플러그인 생태계와 확장성을 위해 Apache Airflow에 끌릴 수 있지만 고급 전문 지식이 필요합니다. 반면 Prefect는 사용자 친화적인 오류 처리 기능을 갖춘 Python 기반 접근 방식을 제공하므로 더 빠른 팀 온보딩을 위한 탁월한 옵션입니다.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

자율 AI 시스템을 탐색하는 조직은 다중 에이전트 협업 기능을 위해 Microsoft AutoGen을 고려하거나 동적 작업 위임을 위해 SuperAGI를 고려할 수 있습니다. 이러한 도구는 연구 또는 전문 사용 사례에 이상적이지만 종종 고급 코딩 기술이 필요하므로 즉각적인 생산 요구에는 적합하지 않습니다.

궁극적으로 올바른 프레임워크를 선택하려면 모듈성, 확장성, 관찰 가능성과 같은 요소와 역할 기반 액세스 제어 및 규정 준수 인증과 같은 거버넌스 기능을 평가해야 합니다. 배포 유연성과 기존 도구와의 통합도 마찬가지로 중요합니다. 기능 외에도 SDK, 문서, 총 소유 비용을 포함한 개발자 경험을 고려하십시오. 간단한 단일 에이전트 작업이든 영구 메모리가 있는 복잡한 다중 에이전트 시스템이든 워크플로의 복잡성도 결정의 기준이 되어야 합니다.

업계는 대부분의 기업 워크로드를 구동하는 오픈 소스 프레임워크를 갖춘 확장 가능한 통합 AI 시스템을 지향하는 동시에 공급업체 관리 런타임으로 운영 문제를 단순화하는 추세입니다.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

AI 오케스트레이션 프레임워크를 선택할 때 현재 도구 및 시스템과 얼마나 잘 통합되는지 고려하는 것이 중요합니다. 강력한 통합 기능을 갖춘 프레임워크는 불필요한 복잡성 없이 모든 것이 함께 작동하도록 보장합니다.

작업 흐름 예약 및 작업 관리와 같은 자동화 기능에 주의하세요. 이러한 기능은 운영을 단순화하고 시간을 절약할 수 있습니다. 민감한 데이터를 보호하고 규정을 준수하는 데 도움이 되는 보안 및 거버넌스 조치도 마찬가지로 중요합니다.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai는 통합 플랫폼 내에서 35개 이상의 대규모 언어 모델을 통합하여 여러 AI 도구를 저글링하는 과제를 단순화합니다. 이 설정을 통해 사용자는 신속한 작업 흐름, 출력 품질 및 전반적인 성능을 완벽하게 감독하면서 모델을 나란히 비교할 수 있습니다.

효율성에 더해 Prompts.ai는 비용을 최적화하도록 설계된 통합 FinOps 레이어를 갖추고 있습니다. 이 도구는 사용량, 지출 및 투자 수익률(ROI)에 대한 실시간 통찰력을 제공하여 조직이 리소스를 효과적으로 관리하고 AI 예산을 최대한 활용할 수 있도록 지원합니다.

Prompts.ai는 SOC 2 Type II, HIPAA 및 GDPR과 같은 업계 표준에 맞춰 엔터프라이즈급 보안 및 규정 준수를 우선시하여 모든 단계에서 데이터를 보호합니다.

To uphold ongoing monitoring and compliance, Prompts.ai collaborates with Vanta and began its SOC 2 Type II audit process on 2025년 6월 19일. These steps ensure your workflows stay secure, compliant, and dependable for enterprise operations.