AI オーケストレーションは、企業の AI 運用を拡張するための鍵です。 AI パイロットの 95% が調整不足により失敗しているため、企業は複雑な AI ワークフローを統合、自動化、管理するためのツールを必要としています。 2025 年の展望では、複数のモデルを統合し、安全なワークフローを実現し、コストを最適化するプラットフォームが導入され、導入者に最大 60% 高い ROI をもたらします。

Here’s a quick breakdown of the top solutions:

各プラットフォームは、スケーラビリティ、相互運用性、ガバナンス、コスト管理において独自の強みを備えています。オープンソースの柔軟性が必要な場合でも、エンタープライズ グレードのコンプライアンスが必要な場合でも、これらのツールを使用すると、断片化した AI システムを統合されたスケーラブルなエコシステムに変換できます。

AI イニシアチブを拡張し、連携を改善し、ROI を最大化するには、適切なプラットフォームを選択してください。

AI オーケストレーション プラットフォームの比較: スケーラビリティ、相互運用性、ガバナンス、および料金

Prompts.ai は、AI 運用を簡素化および合理化するために設計された最先端のエンタープライズ プラットフォームです。 GPT-5、Claude、LLaMA、Gemini、Grok-4、Flux Pro、Kling など、35 を超える最上位の大規模言語モデルを 1 つの安全な統合インターフェイスにまとめています。これらのモデルへのアクセスを一元化することで、プラットフォームは複数のツールを管理する混乱を排除し、組織が AI の取り組みを簡単に拡張できるようにします。

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Prompts.ai は、集中ハブとして、すべての AI 主導のプロセスが、分散したハードコードされた文字列ではなく、承認されたバージョン管理されたプロンプト テンプレートに依存するようにします。そのアーキテクチャにより、モデルの選択とパフォーマンスの並列比較が容易になり、チームはタスクごとに最も効果的な大規模言語モデル (LLM) を特定して導入できるようになります。これらはすべて、コードの書き直しやパイプラインの調整を必要とせずに実現され、時間と労力を節約します。

Prompts.ai は、堅牢なロールベースのアクセス制御 (RBAC) を通じてセキュリティと制御を優先します。これにより、組織は実稼働環境でプロンプトを作成、変更、または展開できるユーザーに対する正確な権限を定義できるようになります。すべてのやり取りは監査証跡とバージョン追跡によって細心の注意を払って記録され、完全な透明性が提供されます。このガバナンス フレームワークは、AI 運用の可視性と制御を維持しながら、企業がコンプライアンス基準を満たせるように支援します。このプラットフォームは、厳格なセキュリティ対策と運用効率を組み合わせることで、組織が AI を安全かつ効果的に管理するのに役立ちます。

このプラットフォームには、トークンの使用状況を追跡する FinOps レイヤーが含まれており、AI への支出をビジネスの成果に直接結びつけます。多くの組織は、ベンダーとの関係を統合し、不要なサブスクリプションを削減することで、コストを最大 98% 削減したと報告しています。リアルタイムの使用状況とパフォーマンスの指標により、チームは支出を継続的に監視して最適化し、月末の予期せぬ出費を回避できます。このレベルの財務透明性により、AI は予算上の不確実性から、明確な利益をもたらす測定可能な投資に変わります。

LangChain は AI アプリケーション用の強力なフレームワークとして傑出しており、毎月 9,000 万回のダウンロードと 100,000 を超える GitHub スターを獲得しています。そのモジュール設計により、基礎的な抽象化のための langchain-core やサードパーティ統合のための langchain-community など、機能が軽量のパッケージに分割されます。このアプローチにより、不必要なオーバーヘッドなしで AI ワークフローが合理化され、複雑さと規模の両方を管理するための有力な選択肢となります。

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith は、HIPAA、SOC 2 Type 2、GDPR などの厳格なコンプライアンス基準を遵守しています。詳細な実行トレースを提供し、デバッグとコンプライアンス レビューのための包括的な監査証跡を作成します。 LangGraph は、リアルタイム検査、ロールバック、修正のための「タイムトラベル」機能を含む人間参加型機能でこれを強化します。

__XLATE_10__

SWE プリンシパルの Garrett Spong 氏は、次のように強調しています。「LangGraph は、会話型エージェント、複雑なタスクの自動化から、LLM に裏付けられたカスタムの『まさに機能する』エクスペリエンスに至るまで、AI ワークロードを構築および拡張する方法の基礎を築きます。」

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) は、2 億 5,800 万の PyPI ダウンロード、33,100 人の GitHub スター、および 3,000 人を超える貢献者からなる活発なコミュニティなど、素晴らしい実績で際立っています。 Kubernetes 上でネイティブに実行するように設計された KFP は、パイプラインの各ステップを個別のポッドとして実行し、必要に応じてクラスター全体でコンピューティング リソースを動的に拡張できるようにします。そのアーキテクチャは有向非巡回グラフ (DAG) 構造に依存しており、特定のデータ依存関係が定義されていない限り、コンテナ化されたタスクの並列実行が可能です [18、19]。この設定は、複雑なワークフローを効率的に処理できるかどうかの鍵となります。

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP は、IR YAML 形式を通じて柔軟性と移植性を確保しており、オープンソースのセットアップから Google Cloud Vertex AI Pipelines などのマネージド サービスに至るまで、さまざまな KFP バックエンド間でパイプラインをシームレスに実行できます。これは、コードを書き直すことなく、ローカルで開発し、クラウドに大規模にデプロイできることを意味します。このプラットフォームは、データ準備のための Spark、Ray、Dask などの一般的なツールや、スケーラブルなモデル推論のための KServe とも統合されています。 Python SDK を使用すると、データ サイエンティストは使い慣れたコーディング手法を使用して複雑なワークフローを定義でき、バックエンドはこれらを Kubernetes オペレーションに自動的に変換します。

セキュリティとガバナンスは KFP にとって不可欠です。役割ベースのアクセス制御 (RBAC)、分離のための名前空間、ネットワーク ポリシーなどの Kubernetes の組み込み機能を使用して、安全なワークフローの実行を保証します。このプラットフォームはメタデータとアーティファクトを一元的に追跡し、パイプライン実行ごとに詳細な監査証跡を作成します [8、22]。 KFP は、パイプラインの各ステップを分離されたコンテナーで実行することにより、プロセスの分離と安全なデータ処理を維持します。管理者は、個々のタスクにリソース制限を設定して、チーム間で公平なリソース配分を確保し、過剰使用を防ぐことができます。機密データやワークロードの場合、ノード セレクターを使用してタスクを特定の安全なハードウェアに制限できます。

KFP 自体はオープンソースで無料で使用できますが、AWS EKS、Google GKE、オンプレミスのいずれであっても、基盤となる Kubernetes インフラストラクチャに関連するコストが引き続き適用されます。 Google Cloud Vertex AI Pipelines などのマネージド バージョンは、従量課金制の価格モデルで動作します [19、20]。 KFP には、一時的なエラーに対する再試行メカニズムなどの機能も含まれています。これにより、長時間実行されているパイプラインを再起動するコストを回避できます。また、前のステップが失敗した場合でもクリーンアップ タスクが確実に実行されるようにする終了ハンドラーも含まれています。これらの機能は、より効率的なリソースの使用とコスト管理に貢献します。

Argo Workflows は、Kubernetes 専用に設計された人気のワークフロー実行エンジンであり、200 以上の組織が実稼働環境で利用しています。コンテナネイティブのソリューションとして、分離されたポッドで各ワークフローステップを実行することで並列ジョブを調整します。このアーキテクチャにより、Kubernetes クラスターの利用可能な容量に基づいて動的なスケーリングが可能になり、柔軟なリソース管理が必要な AI タスクに特に効果的になります。

Argo Workflows は、垂直方向の最適化とシャーディングによるスケーリングをサポートします。 --workflow-workers パラメーターを増やすことで、より多くの CPU コアを割り当てて、ワークフローの調整を高速化できます。大規模な操作の場合、名前空間ごとに個別のインストールをデプロイするか、インスタンス ID を使用して同じクラスター内で複数のコントローラー インスタンスを実行することにより、シャーディングを実装できます。 Kubernetes API サーバーを保護するために、Argo はクライアント側のレート制限 (デフォルト: 1 秒あたり 20 クエリ、バースト 30) を採用し、foreach ステップの同時実行数を 100 タスクに制限します。このスケーラブルなアプローチにより、ワークロードが重い場合でも、外部システムとのスムーズな統合が保証されます。

Kubernetes カスタム リソース定義 (CRD) として、Argo はあらゆる Kubernetes クラスターとシームレスに統合し、Kubeflow Pipelines、Netflix Metaflow、Seldon、Kedro などの著名な AI プラットフォームを強化します。開発者は、Python (Hera)、Java、Go の公式 SDK を使用してワークフローを定義できるため、言語を柔軟に選択できます。アーティファクト管理の場合、Argo は AWS S3、Google Cloud Storage、Azure Blob Storage、Artifactory、Alibaba Cloud OSS などのさまざまなストレージ ソリューションをサポートしています。この互換性により、さまざまな環境間でのスムーズなデータ フローが保証されます。さらに、ワークフローは、Argo イベントを使用した Webhook やストレージ変更などの外部信号によってトリガーできます。 Metaflow のドキュメントによると、Argo Workflows は、Argo Events を介したイベント トリガーをサポートする唯一の実稼働オーケストレーターです。この柔軟性と機能性の組み合わせにより、ワークフロー自動化にとって強力な選択肢となります。

Argo Workflows は、Kubernetes ネイティブの機能を利用して、強力なセキュリティを確保します。ロールベースのアクセス制御 (RBAC) は、ワークフロー コントローラー、ユーザー、および個々のポッドの権限を管理します。分離を強化するために、「namespace-install」モードを使用してコントローラーを単一の名前空間に制限できます。運用環境では、Argo は OAuth2 および OIDC 経由のシングル サインオン (SSO) をサポートし、TLS 暗号化で転送中のデータを保護します。管理者はワークフロー制限を適用して、ユーザーが事前承認されたテンプレートのみを送信できるようにすることができます。また、ポッド セキュリティ コンテキストは、ポッドが root として実行されるのを防ぐのに役立ちます。ネットワーク ポリシーは Argo サーバーとワークフロー コントローラーの両方のトラフィックを規制し、デフォルトの再帰深さの制限である 100 呼び出しにより無限ループが防止されます。

Argo Workflows は、Apache License 2.0 に基づいて利用可能なオープンソース ツールであり、無料で使用できます。コストを管理するために、TTL 戦略とポッド ガベージ コレクション (PodGC) を採用して、完了したワークフローを自動的に削除し、未使用のポッドをクリーンアップして、リソースの無駄を削減します。ノード セレクターとアフィニティ ルールを使用して、スポット インスタンスなどのコスト効率の高いインフラストラクチャ上でタスクをスケジュールできます。さらに、リソースの使用状況がステップごとに追跡されるため、ユーザーは支出を監視できます。コントローラーのログに「クライアント側のスロットリング」があることに気付いた場合は、--qps および --burst の値を増やすと、Kubernetes API との通信効率が向上する可能性があります。この考え抜かれた設計により、パフォーマンスと費用対効果のバランスをとることができます。

Apache Airflow は AI ワークフロー管理の中心人物となっており、複雑な操作を調整するための柔軟なコードベースのフレームワークを提供します。ユーザーの 23% が適用している機械学習オペレーション (MLOps) と、コミュニティの 9% が使用している生成 AI プロジェクトで特に顕著です。 Apache License 2.0 に基づいてリリースされた Airflow を使用すると、開発者は Python でワークフローを定義し、あらゆる機械学習ライブラリとシームレスに統合できます。

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor は、予測不可能でリソースを大量に消費するワークロードを処理する場合に特に役立ちます。ダイナミック タスク マッピングなどの機能により、リアルタイム データに基づいてタスクを拡張できるため、大規模なデータセットやマルチモデル ワークフローに最適です。一方、Deferrable Operator は、ワーカー スロットを占有することなく、モデル トレーニングのモニタリングなどの長い待機状態を管理することで効率を向上させます。このアプローチにより、スループットとリソース使用率が大幅に向上します。

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

TaskFlow API は、Python デコレータを使用してスクリプトを Airflow タスクに変換し、XCom を介したデータ転送を自動的に管理することで、ワークフローの作成を簡素化します。チームは、GPU を多用するトレーニング用の Kubernetes ポッドやデータ前処理用の Spark クラスターなど、適切な環境にタスクをルーティングできます。さらに、REST API と airflowctl CLI により、CI/CD パイプラインとの安全な統合が可能になり、スムーズで監査可能なワークフロー管理が保証されます。

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

データ ガバナンスのために、Airflow はデータ リネージを追跡するための標準である OpenLineage と統合されており、GDPR や HIPAA などのコンプライアンス要件を満たすのに役立ちます。 airflowctl CLI は REST API と排他的に対話し、セキュリティを強化するためにメタデータ データベースへの直接アクセスを回避します。チームは、セットアップ タスクとティアダウン タスクを使用して再現可能な環境を管理し、インフラストラクチャをコードとして扱い、監視と一貫性を向上させることもできます。

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning は、高度な GPU、InfiniBand ネットワーキング、99.9% の稼働時間、100 を超えるコンプライアンス認定を備えた、エンタープライズ AI のニーズに対応する強力なソリューションを提供します。 34,000 人のエンジニアと 15,000 人のセキュリティ専門家からなるチームによって支えられ、大規模な信頼性とセキュリティを保証します。

このプラットフォームは、データ、モデル、パイプラインにわたる分散コンピューティングのサポートを通じてあらゆるサイズのワークロードを処理し、リソース効率を最大化するように設計されています。管理されたオンライン エンドポイントにより、需要の急増に対応する自動スケーリングを備えたシームレスなモデル展開が可能になります。たとえば、マークス& Spencer 氏は、Azure ML を利用して 3,000 万を超える顧客のデータを処理しながら、パイプライン キャッシュとレジストリを活用してトレーニング時間とコストの両方を削減しました。同様に、BRF では、自動化された ML と MLOps によって 15 人のアナリストの手動タスクが排除され、より価値の高い作業に集中できるようになりました。

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

「Azure AI プロンプト フローがなければ、ソリューションを提供するためにかなり大規模なカスタム エンジニアリングに投資する必要があったでしょう。その代わりに、既存のマイクロサービスをプロンプト フロー ソリューションに簡単に統合することで、大幅なスピードを達成することができました。」

Azure ML は、プライバシーを保護する分散トレーニングもサポートしています。Swift の Johan Bryssinck 氏が実証したように、彼はこのプラットフォームを使用してデータを一元管理するのではなく、ローカル エッジ デバイスでモデルをトレーニングし、スケーラビリティとデータ プライバシーの両方を確保しました。統合された API コントラクトと、Azure Logic Apps および Azure Functions との統合により、外部ツールとの接続がさらに強化されます。

Azure Machine Learning は、ロールベースのアクセス制御 (RBAC) 用の Microsoft Entra ID や仮想ネットワークなどの機能を使用してセキュリティを優先し、リソースを分離して API アクセスを制限します。データは、転送中は TLS 1.2/1.3 暗号化、保存中は二重暗号化で保護され、制御を強化するための顧客管理キーのオプションも備えています。プロンプト シールドなどのリアルタイム防御はジェイルブレイクやプロンプト インジェクション攻撃を防ぎますが、カスタマー ロックボックスでは顧客データにアクセスするために Microsoft に対する管理者の承認が必要です。追加のツールは資産バージョン、データ系統、クォータを追跡し、Microsoft Defender for Cloud はランタイム脅威保護を提供します。

Azure Machine Learning は従量課金制の価格モデルで動作し、CPU や特殊な GPU などのコンピューティング リソースに対してのみ課金されます。 Blob Storage、Key Vault、Container Registry、Application Insights などのサポート サービスも使用量に基づいて課金されます。チームは特定のタスクに合わせたハードウェアを選択できるほか、パイプライン キャッシュなどの機能により冗長な計算が削減されます。 Infrastructure as Code により、一貫したデプロイメントと効率的なリソース管理が保証されます。

Google Vertex AI Pipelines は、機械学習 (ML) ワークフローを自動化することで、インフラストラクチャ管理の煩わしさを軽減します。タスクをコンテナ化されたコンポーネントの有向非巡回グラフ (DAG) に編成し、チームがサーバー管理ではなくモデル開発に集中できるようにします。

Vertex AI Pipelines はサーバーレス アプローチを使用してワークロードを処理し、集中的な処理タスクを BigQuery、Dataflow、Cloud Serverless for Apache Spark などのツールに委任します。分散 Python および ML 計算の場合、Vertex AI 上の Ray とシームレスに統合されます。

このプラットフォームは、NVIDIA H100/H200 GPU を搭載した A3 および A3 Mega シリーズ ノードをサポートします。 8 つの H100 GPU を備えた A3 Mega ノードは、1,600 Gbps という驚異的なクロスノード帯域幅を実現します。たとえば、Vectra は Gemini と Vertex AI を使用して毎月 300,000 件の顧客からの問い合わせを分析し、分析速度の 500% の向上を達成しました。

コスト効率には実行キャッシュが組み込まれており、出力を再利用して出費を最小限に抑えます。 Vertex ML Metadata は、アーティファクト、パラメータ、メトリクスの系統を大規模に追跡することで再現性を保証します。このスケーラブルな設計はさまざまなツールと簡単に統合できるため、ML ワークフローの多用途なソリューションになります。

Google Cloud Pipeline Components (GCPC) SDK は、AutoML、カスタム トレーニング ジョブ、モデルのデプロイなどの Vertex AI サービスをパイプラインに直接接続する事前構築済みコンポーネントを提供することで、統合を簡素化します。

パイプライン管理は柔軟で、サービス全体でワークフローを調整するための Cloud Composer (マネージド Apache Airflow) や Cloud Data Fusion トリガーなどのオプションを利用できます。 BigQuery、Cloud Storage、Dataproc へのネイティブ接続によりデータ処理が合理化され、メタデータを Dataplex ユニバーサル カタログと同期してプロジェクト間のリネージを追跡できます。さらに、Model Garden では、Google の Gemini、Anthropic の Claude、Meta の Llama など 200 を超えるモデルへのアクセスが提供されます。

パイプライン定義は標準化された YAML 形式にコンパイルされ、Artifact Registry などのリポジトリ間での移植性が保証されます。

Vertex AI Pipelines は、ガバナンスとセキュリティを念頭に置いて設計されています。サービス アカウントにより、各コンポーネントが必要なアクセス許可のみで動作することが保証されます。 VPC Service Controls は安全な境界を確立し、トレーニング データセット、モデル、バッチ予測結果などの機密データがネットワーク境界から出るのを防ぎます。

厳格なコンプライアンスのニーズがある組織向けに、このプラットフォームは、Google Cloud のデフォルトの保存時の暗号化に加えて、顧客管理の暗号鍵(CMEK)をサポートしています。 Vertex ML Metadata は、すべてのパイプライン実行からのパラメーター、アーティファクト、メトリクスを自動的に記録することで、詳細な監査証跡を提供します。

Model Armor などのセキュリティ機能は、プロンプト インジェクションやデータ漏洩から保護します。パイプラインはピアリングされた VPC ネットワーク内で実行されるように構成でき、チームは Cloud Logging を使用してパイプライン イベントを監視してセキュリティ異常がないかどうかを確認できます。

Vertex AI Pipelines は従量課金制モデルで動作し、Cloud Billing の BigQuery へのエクスポートを通じてコスト追跡のために請求ラベルが自動的に適用されます。実行キャッシュは出力を再利用することでコストをさらに削減します。

中断に強いトレーニング ジョブの費用を削減するために、スポット VM を割引料金で利用できます。長期的なインフラストラクチャ契約の場合、確約利用割引 (CUD) によりコスト削減と容量の保証が提供されます。 Dynamic Workload Scheduler (DWS) は、より低い定価で柔軟なワークロードの容量を提供する一方、専用のトレーニング クラスターにより、大規模なジョブ用に予約されたアクセラレータの容量が確保されます。

IBM watsonx Orchestrate は中央ハブとして機能し、特殊なツールや基盤モデルのスーパーバイザー、ルーター、プランナーとして機能することで AI エージェントを調整します。このプラットフォームは、探索的タスクの React、構造化されたワークフローの Plan-Act、予測可能なビジネス プロセスの決定論的オーケストレーションなど、さまざまなオーケストレーション アプローチをサポートします。

大規模な運用向けに設計された watsonx Orchestrate は、マルチエージェント オーケストレーションを使用して、リクエストを適切なツールおよび大規模言語モデル (LLM) にリアルタイムで効率的にルーティングします。組織は、watsonx Orchestrate をマネージド・サービスとして IBM Cloud または AWS にデプロイするか、オンプレミスにインストールして既存のインフラストラクチャーと調整するかを選択できます。

このプラットフォームはすでに目に見える成果をもたらしています。たとえば、IBM は、年間 1,000 万件の人事リクエストの 94% を watsonx Orchestrate を通じて即座に解決し、人事チームがより価値の高いタスクに集中できるようにしました。同様に、ダン& Bradstreet は、AI を活用したサプライヤーのリスク評価により調達時間を最大 20% 削減し、クライアントの評価時間を 10% 以上節約しました。

迅速な導入をサポートするために、プラットフォームにはコード不要の Agent Builder と、Python ベースのカスタム ツールを作成するための Agent Development Kit (ADK) が含まれています。さらに、100 を超えるドメイン固有の AI エージェントと 400 を超える事前構築ツールを含むカタログは、多様な運用ニーズを満たすスケーラブルなコンポーネントを提供します。

この拡張性により、既存のシステムとのスムーズな統合が保証され、幅広いエンタープライズ環境に適応できるようになります。

このプラットフォームの AI ゲートウェイは、IBM Granite、OpenAI、Anthropic、Google Gemini、Mistral、Llama などのさまざまな基盤モデル間のシームレスなルーティングを容易にし、組織がベンダー ロックインを回避できるようにします。エージェント開発キットは、リモート Web サービス用の OpenAPI 仕様と拡張機能用の Python を使用したカスタム ツールの作成をサポートします。

Langflow との統合により、AI アプリケーションを設計するための視覚的なドラッグ アンド ドロップ インターフェイスが追加され、Orchestrate 環境にインポートできるようになります。さらに、watsonx Orchestrate は、Salesforce、SAP、Workday、Microsoft 365 などのエンタープライズ システムに簡単に接続できるため、大規模なインフラストラクチャの変更が不要になります。

AgentOps を使用すると、プラットフォームは AI エージェントのアクティビティを監視し、リアルタイムのポリシーを適用して信頼性とコンプライアンスを確保します。組み込みのガードレールと集中監視により、内部規制の順守を維持できます。

__XLATE_52__

「AgentOps を使用すると、あらゆるアクションが監視および管理され、異常をリアルタイムで通知して修正できるようになります。」 - IBM ニュースルーム

IBM Guardium の統合により、不正な AI 導入を特定し、脆弱性や構成ミスを明らかにすることでセキュリティが強化されます。このプラットフォームには、環境設定を保護するための 4 つの主要な役割 (管理者、ビルダー、ユーザー、製品エキスパート) が含まれる役割ベースのアクセス制御 (RBAC) も実装されています。 watsonx.governance を使用している企業は、AI への取り組みにより ROI が 30% 増加したと報告しています。

このプラットフォームは、組織のさまざまなニーズを満たすために柔軟な価格設定を提供します。

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 2026年1月31日.

UiPath AI Center は、エンタープライズ ワークフロー内で AI エージェント、RPA ボット、および人間のワーカーを統合し、2025 年の需要を満たすように設計されたスケーラブルなエコシステムを作成します。その中核となるプラットフォームは、インテリジェントな制御ハブとして UiPath Maestro を活用し、複雑な業務運営全体にわたる長時間実行プロセスを管理します。

UiPath AI Center は、さまざまなビジネス ニーズに合わせて 2 つの導入オプションを提供します。即時柔軟なスケーリングを提供する Automation Cloud と、オンプレミス導入向けに調整された Automation Suite です。その MLOps システムは、モデルを展開および監視するための使いやすいドラッグ アンド ドロップ インターフェイスを備えており、無制限の数のロボットにわたってシームレスに拡張できます。たとえば、サンエクスプレス航空は、受注残を 2 か月削減しながら 20 万ドル以上を節約したと報告しています。また、このプラットフォームは継続的な人間参加型の再トレーニングを通じてモデルの正確性を維持するため、多様なシステム間で AI を統合するための強力なツールになります。

このプラットフォームは「Bring Your Own Model」(BYOM) 戦略を採用しており、LangChain、Anthropic、Microsoft などのサードパーティ フレームワークとの統合が可能です。さらに、Google Cloud と協力して開発された Agent2Agent (A2A) プロトコルにより、エンタープライズ プラットフォーム全体の AI エージェント間のスムーズな通信が促進されます。

__XLATE_59__

LangChain の CEO、Harrison Chase 氏は次のように述べています。「エージェント プロトコルに関する UiPath との協力により、LangGraph エージェントは UiPath 自動化にシームレスに参加できるようになり、その範囲が広がり、開発者はより一貫したクロスプラットフォームのワークフローを構築できるようになります。」

UiPath AI Center は、標準化された API を通じて数百の SaaS アプリケーションに接続し、プロセス モデリングに BPMN 2.0 をサポートし、ビジネス ルールの管理に Decision Model and Notation (DMN) を使用します。注目に値する例は、オーストラリア最大の相互銀行であるヘリテージ バンクです。同社は AI Center を活用してローン審査プロセスを自動化し、バックエンドの手動タスクを削減しながら顧客エクスペリエンスを向上させました。

UiPath AI Center はガバナンスとセキュリティを優先し、プロジェクトおよびテナントレベルのアクセス制御を提供してトレーサビリティとコンプライアンスを維持します。その制御された機関機能により、AI エージェントが無許可または危険なアクションを自律的に実行することができなくなります。

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath AI Center は、モデルのトレーニング、ホスティング、予測などのアクティビティを測定する AI ユニットを使用した消費ベースのライセンス モデルを採用しています。これらは、プラットフォーム ユニットを介してより広範な UiPath ライセンス システムにシームレスに統合され、オーケストレーションと実行のニーズに対応します。組織がその機能を探索できるように、Automation Cloud と Automation Suite の両方のバージョンで 60 日間の無料トライアルを利用できるため、コストを抑えながらその価値を簡単に評価できます。

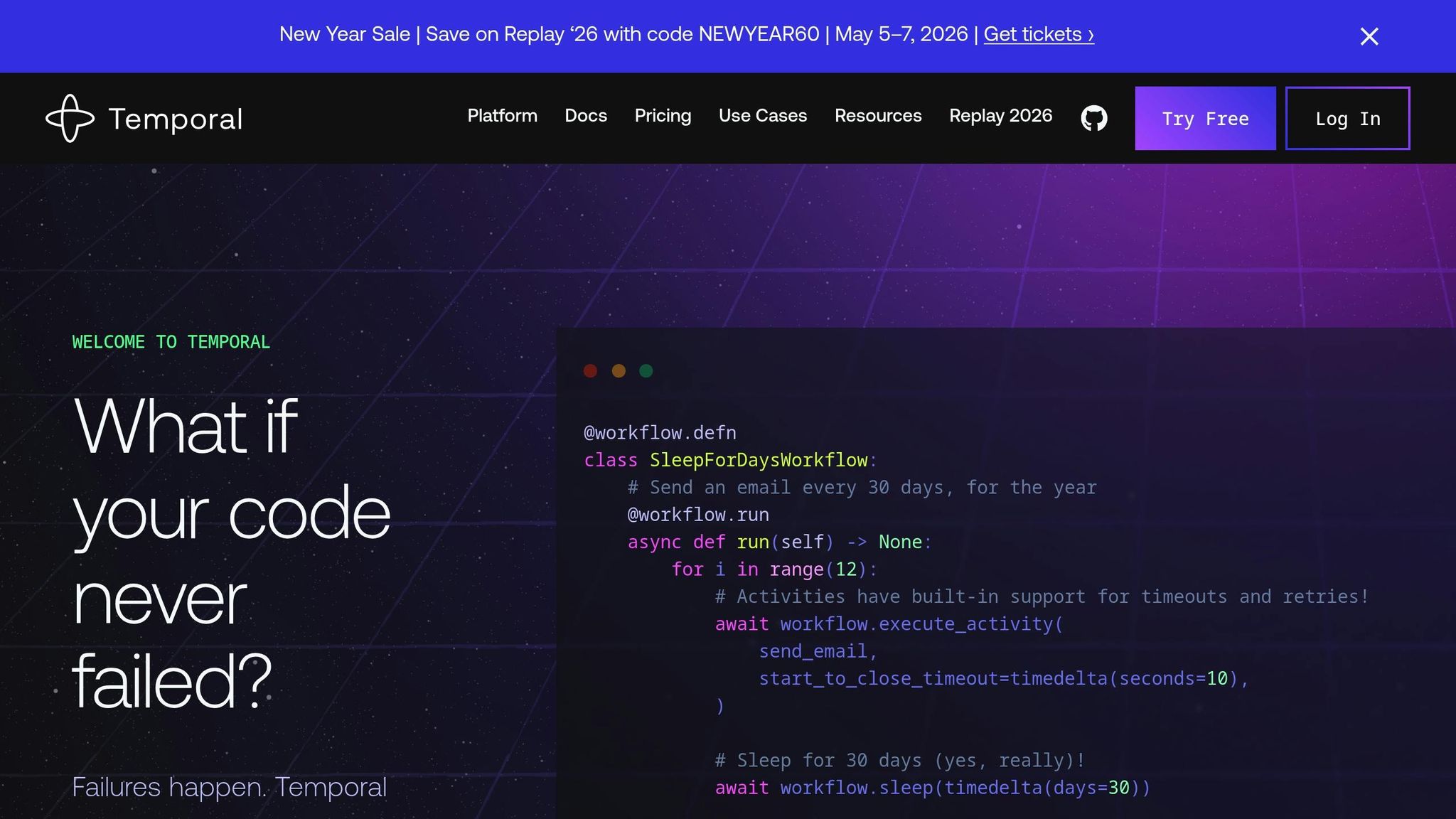

Temporal は、構成ファイルに依存するのではなく、耐久性があり再開可能なコードを使用するという独自のアプローチを採用しています。ワークフローのすべてのステップを不変のイベント履歴にキャプチャし、プロセスが中断後に中断したところから正確に再開できるようにします。この好例は、コーディング エージェント コントロール プレーンを Temporal に移行し、信頼性とユーザー エクスペリエンスを大幅に向上させた Replit です。

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist 氏、Retool プロダクト マネージャー

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

この拡張性により、さまざまなツールやシステムとのシームレスな統合が保証されます。

開発者は、Python、Go、Java、TypeScript、.NET、PHP などの一般的な言語でコードとしてワークフローを作成できます。 Temporal は、OpenAI Agents SDK、Pydantic AI、LangGraph、Crew AI などの主要な AI フレームワークとも簡単に統合できます。 Model Context Protocol (MCP) のサポートにより、エージェントの信頼性が向上します。 LangfuseなどのAI専用監視ツールとの連携により可観測性が向上します。たとえば、Gorgias はこの柔軟性を利用して、15,000 を超える e コマース ブランドが AI 主導のカスタマー サービス エージェントを管理できるように支援しています。

Temporal のイベント履歴は、AI ワークフローのあらゆる状態変化に関する完全で変更不可能な監査証跡を提供します。この機能は人間参加型のガバナンスをサポートし、自律的な決定を実行する前にワークフローを外部検証のために一時停止できるようにします。この保護機能は、実稼働環境で LLM 幻覚などの問題を防ぐために特に役立ちます。 Temporal Cloud 展開では、プロバイダーはアプリケーション コードにアクセスできませんが、オープンソースの MIT ライセンス サーバー オプションを使用すると、組織は独自の安全なインフラストラクチャ内でプラットフォームをホストできます。 Netflix のエンジニアは、この設計によりメンテナンスが最小限に抑えられ、障害処理が簡素化されることを強調しました。

Temporal Cloud は従量課金制モデルで動作しますが、オープンソースの Temporal Server は自由に自己ホストできます。新規ユーザーは、Temporal Cloud の 1,000 ドル分の無料クレジットを使用してプラットフォームを探索できます。コンピューティング リソースを消費せずにワークフローを一時停止することで、ユーザーはインフラストラクチャと運用コストを大幅に削減できます。 Temporal の設計は、効率と信頼性を向上させるだけでなく、AI 運用の拡大に伴う出費も抑制します。

理想的な AI オーケストレーション プラットフォームを選択するには、柔軟性と使いやすさのバランスをとる必要があります。 Apache Airflow や LangChain などのオープンソース オプションは、ベンダーからの独立性と詳細なカスタマイズを提供しますが、セキュリティとガバナンスのための高度な技術スキルと手動構成が必要です。一方、IBM watsonx Orchestrate や UiPath などのエンタープライズ プラットフォームには、ロールベースのアクセス制御 (RBAC)、監査証跡、HIPAA 準拠などの機能が組み込まれていますが、ライセンス料がかかり、柔軟性が低下します。

スケーラビリティ戦略はプラットフォームによって大きく異なります。 Kubeflow や Argo Workflows などの Kubernetes ネイティブ ツールは、コンテナ化された移植性に優れています。一方、Apache Airflow の有向非巡回グラフ (DAG) ベースのスケジューリングは、ハイブリッドおよびマルチクラウドのセットアップにおける複雑な依存関係の管理に効果的です。 Temporal はスループットが高いことで知られていますが、Azure Machine Learning と Google Vertex AI Pipelines は親クラウド エコシステムを活用して、ピーク需要時にリソースを動的に割り当てます。これらの変化は、組織がソリューションを評価する際に考慮する必要があるトレードオフを浮き彫りにします。

相互運用性は、統一されたワークフローを確保するためのもう 1 つの重要な要素です。 LangChain を使用すると、開発者は既存のシステムを全面的に改修することなく複数の大規模言語モデル (LLM) と API を接続でき、Kubeflow は単一のパイプライン内で PyTorch、TensorFlow、JAX などのフレームワークをサポートします。 Prompts.ai のようなプラットフォームは、複数のモデルを統合することで断片化を軽減することを目的としていますが、Azure Machine Learning や IBM watsonx Orchestrate などのベンダー固有のプラットフォームはシームレスなネイティブ統合を提供しますが、より広範な互換性のために追加のコネクタが必要になる場合があります。

運用上のトレードオフも、導入の決定と投資収益率 (ROI) において重要な役割を果たします。ガバナンスとコスト管理は、プラットフォームが大きく異なる領域です。 IBM watsonx Orchestrate や UiPath などのエンタープライズ グレードのソリューションは、一元化されたダッシュボードと堅牢なセキュリティ機能を提供するため、医療や金融などの規制が厳しい業界に適しています。対照的に、オープンソース ツールでは、同等の監視を実現するために手動セットアップが必要になることがよくあります。コストの観点から見ると、Apache Airflow、LangChain、Kubeflow は無料で導入できますが、エンジニアリング時間と専門知識に関連した隠れた費用が発生する可能性があります。 Temporal Cloud は、1,000 ドルの無料クレジットを含む従量課金制の価格設定を提供しています。一方、Prompts.ai は、定期的な料金を排除する統合 TOKN クレジット システムを通じて、AI ソフトウェアのコストを最大 98% 大幅に削減します。

以下の表は、主要な運用上の側面における各プラットフォームの詳細な比較を示しています。

最適な AI オーケストレーション プラットフォームを選択できるかどうかは、組織の技術的能力、コンプライアンスのニーズ、成長計画にかかっています。 Apache Airflow や LangChain などのオープンソース オプションは、ライセンス料なしで比類のない柔軟性を提供するため、モジュール式セットアップを重視するテクノロジー系スタートアップ企業や急成長している企業の開発者主導のチームにとって頼りになる選択肢となっています。ただし、これらのフレームワークでは、セキュリティ、ガバナンス、スケーラビリティなどの重要な機能を構成するための高度なエンジニアリング スキルが必要です。一方、IBM watsonx Orchestrate などのエンタープライズ プラットフォームは、役割ベースのアクセス制御、監査証跡、HIPAA や SOC 2 などの認証などの組み込みのコンプライアンス対策が交渉の余地のない、ヘルスケアや金融などの業界に対応しています。これらのプラットフォームは、ワークフローを合理化し、ガバナンス機能をビジネス成果の向上に結び付けることで、目に見える利益をもたらすことがよくあります。

大企業にとっては、ガバナンス重視のプラットフォームが不可欠ですが、中規模企業では多くの場合、コストとパフォーマンスのバランスが取れたソリューションが必要です。 Prompts.ai は、35 以上のモデルを 1 つのインターフェイスに統合することでこの方程式を簡素化し、リアルタイムの FinOps コントロールと従量課金制の TOKN クレジットを提供して、ツールの断片化と予期せぬ出費を最小限に抑えます。一方、Kubeflow Pipelines や Argo Workflows などの Kubernetes ネイティブ ツールは、特に分散システム全体で複雑な機械学習パイプラインを管理するデータ サイエンス チームにとって、ポータビリティとハイブリッド クラウド デプロイメントが重要な場合に威力を発揮します。

前述したように、自律エージェントが複数ステップの推論で協力するエージェント AI の出現は、シームレスなオーケストレーションの重要性の増大を浮き彫りにしています。どーもさんの言葉を引用すると、

__XLATE_78__

「AI における成功は、もはや最も多くのモデルを持つことではなく、それらを効果的にオーケストレーションすることです。」

米国の組織にとって、部門間で AI の統合が進むにつれて拡張する余地を提供しながら、現在の技術的成熟度に適合するプラットフォームを選択することが重要です。賢明な出発点は、特定のワークフローに焦点を当てたパイロット プロジェクトであり、入力、出力、エラーを追跡して、将来のスケーリングに向けた可観測性のベースラインを確立します。適切なオーケストレーション プラットフォームは、AI ツールを接続するだけではなく、チームがどのように協力し、問題を解決し、より大規模に価値を生み出すかを再定義します。

AI オーケストレーション プラットフォームは、さまざまな AI モデル、データ ソース、プロセスを 1 つの自動システムに統合することで、複雑なワークフローを簡素化します。スケジュール、リソースの配布、API 統合などのタスクを管理し、手動の労力を最小限に抑えながら、開発時間と運用コストの両方を大幅に削減します。

これらのプラットフォームは簡単に拡張できるように構築されているため、企業はインフラストラクチャを全面的に改修することなく、少数のタスクの処理から数千のタスクの管理に拡張できます。大量のデータの処理、リソースの使用効率の向上、一貫した監視の維持に優れています。これにより、導入の迅速化、生産性の向上、企業の動的なニーズを満たすための設備が強化された AI ソリューションが実現します。

AI オーケストレーション プラットフォームは、多くの場合、使用量ベースの価格設定モデルを通じて経費を処理し、企業は固定ライセンスを契約するのではなく、使用した分だけ支払うことができます。これらのプラットフォームの多くには、モデルまたはワークフローごとの支出を監視するダッシュボード、予算アラート システム、詳細なコスト分析のためのワークロードのタグ付けなど、リアルタイムの財務ツールが装備されています。これらのツールにより、企業は AI 関連の費用を明確に把握し、予算の管理を維持できるようになります。

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai は、2025 年の安全な AI オーケストレーションの標準を設定し、AI 運用を簡単に拡張できる信頼性の高いプラットフォームを企業に提供します。その統合ダッシュボードは管理を簡素化するように設計されており、組み込みのガバナンス ツール、リアルタイムのコスト追跡、不変の監査証跡を備えています。これらの機能により、企業は AI ワークフローの完全な監視を維持しながらコンプライアンスを維持できます。

Prompts.ai は、ロールベースのアクセス制御、エンドツーエンドの暗号化、継続的なコンプライアンス監視などのエンタープライズ グレードのセキュリティ対策を備えており、運用のあらゆる段階で機密データを保護します。 35 を超える主要な LLM を単一の安全なフレームワークに統合することで、リスクが軽減され、企業が自信を持って効率的に AI 機能を拡張できるようになります。