AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

さらに深く掘り下げて、チームとワークフローに適したフレームワークを見つけてください。

Prompts.ai は、企業ユーザーを、GPT-5、Claude、LLaMA、Gemini、Grok-4、Flux Pro、Kling を含む 35 以上の主要な AI モデルに接続する集中型のクラウドベースのプラットフォームとして機能し、すべて単一のインターフェイスからアクセスできます。ソフトウェアのインストールが不要なため、あらゆる規模のチームがワークフローに AI を簡単に組み込むことができます。

このプラットフォームは、ツールのスプロール化という AI 導入における大きな課題に取り組んでいます。統一された環境を提供することで、モデルの選択、迅速なワークフロー、パフォーマンスの追跡を 1 つのシステムに統合します。このアプローチにより、AI の使用は、分散した 1 回限りの実験から、組織が部門間で簡単に展開できる一貫したスケーラブルなプロセスに移行します。

Prompts.ai は、エンタープライズ AI ワークフローの自動化に焦点を当てており、ガバナンスの問題に対処しながら組織が不必要なコストを削減できるように支援します。 Fortune 500 企業からクリエイティブエージェンシーや研究所に至るまで、ユーザーは複数のサードパーティサービスに機密データが漏洩する危険を冒すことなく、準拠した監査可能なワークフローを作成できます。

このプラットフォームは、GenAI.Works によって企業の問題解決と自動化のための最高の AI ソリューションとして認められており、ユーザー評価は 5 点中 4.8 という素晴らしい評価を受けています。企業は、コンテンツ作成の合理化、戦略的ワークフローの自動化、提案開発のスピードアップなどのタスクで Prompts.ai を活用しています。場合によっては、これまで数週間かかっていたプロジェクトがわずか 1 日に短縮されたこともあります。

注目すべき例は、2025 年 5 月に発生したもので、フリーランスの AI ディレクター、ヨハネス・ヴォリヨン氏がこのプラットフォームを使用して、Google DeepMind Veo2 アニメーションをブライトリングとフランス空軍のプロモーション ビデオにシームレスに統合しました。このプロジェクトでは、Prompts.ai が複数の AI ツールのスムーズなオーケストレーションをどのように可能にするかを強調しました。

Prompts.ai は、単一のインターフェイスを介して 35 以上の言語および画像モデルへのアクセスを統合することで、チームが AI を使用する方法を簡素化します。これにより、複数のサブスクリプション、API キー、請求システムを管理する手間が省けます。ユーザーは、単一のワークフロー内の特定のタスクに対してさまざまなモデルを組み合わせて、シームレスなオーケストレーション パイプラインを作成できます。

このプラットフォームは TOKN クレジット システムで動作し、すべてのモデルで使用量を標準化し、コストの追跡とリソースの割り当てを簡単にします。チームは、パフォーマンス要件に基づいて、必要に応じてモデルを切り替えることができます。ビジネス プランには無制限のワークスペースとコラボレーターが含まれており、組織による AI 導入の拡大が容易になります。

Prompts.ai は、従量課金制の価格モデルを採用し、実際の使用量に応じてコストを調整し、初期探索は月額 0 ドルから開始します。ビジネス プランは、メンバーあたり月額 99 ドルから 129 ドルの範囲で、さまざまなレベルの TOKN クレジット (250,000 から 1,000,000) と、すべての層で 10 GB のクラウド ストレージを提供します。

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 2025年6月19日, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

ビジネス プラン (コア、プロ、エリート) には、コンプライアンス監視とガバナンス管理のためのツールが含まれており、AI の相互作用を完全に可視化し、規制要件を満たすための詳細な監査証跡を維持します。 Personal Creator プランや Family プランを使用する小規模なチームや個人の専門家であっても、これらのエンタープライズ グレードのガバナンス機能の恩恵を受けることができます。

機密データは一元管理された環境内に保管されるため、複数のサードパーティ サービスに情報が拡散することに伴うリスクが軽減されます。この安全なアーキテクチャは、潜在的な脆弱性を最小限に抑えるだけでなく、厳格な規制の下で運営されている組織のコンプライアンス管理を簡素化します。

クラウドネイティブ アーキテクチャで設計された Prompts.ai により、組織は簡単に拡張できます。チームは数分以内に新しいメンバーを追加し、ワークスペースを拡張し、追加のモデルにアクセスできるため、AI 導入を必要に応じて迅速に拡大できます。

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI は、会話型インターフェイスを活用したワークフロー自動化ソリューションを提供します。導入アーキテクチャとオーケストレーション方法に関する具体的な詳細は公開されていませんが、会話型インターフェイスに重点を置いていることで、ワークフロー自動化の合理化における独自の角度が強調されています。

IBM watsonx Orchestrate は、企業の運用に AI 主導の自動化をもたらし、開発者だけでなくビジネス専門家が自動化を利用できるようにすることに重点を置いています。このプラットフォームは、ユーザーが自然言語コマンドを発行できるようにすることで、人事、財務、販売、カスタマー サポート、調達などの非技術チームの複雑なタスクを簡素化します。このアプローチにより、コーディングの専門知識が不要になり、ビジネス チームが独立してプロセスを自動化できるようになります。

このプラットフォームは、従業員の時間を浪費することが多い反復的なタスクの自動化に優れています。ユーザーは、単純な言語コマンドを使用して、面接のスケジュール設定、候補者のプロフィールの要約、ローンの処理、レポートの生成などのタスクのワークフローを開始できます。 watsonx Orchestrate は、エンタープライズ グレードのセキュリティ標準を遵守しながら、複数のバックエンド システムにわたってこれらのアクティビティを処理します。

たとえば、大手金融機関は、顧客サポートとバックオフィス機能を合理化するために watsonx Orchestrate を導入しました。従業員は自然言語入力を使用して、融資処理とサービス リクエストのワークフローを自動化しました。このプラットフォームはバックエンド システムとシームレスに統合され、組み込みのガバナンスを通じてコンプライアンスを維持し、処理時間の短縮、手動エラーの減少、顧客満足度の向上といった顕著な改善を実現しました。この例では、日常的な企業タスクを効率的で自動化されたプロセスに変換するプラットフォームの機能を強調しています。

IBM watsonx Orchestrate は、ハイブリッド クラウド導入オプションを提供し、ワークフローをクラウド、オンプレミス、またはその両方で実行できるようにします。この柔軟性は、厳格なデータ保管ポリシーまたは従来のインフラストラクチャを備えた組織にとって特に価値があります。このプラットフォームは、Large Language Model (LLM)、API、エンタープライズ アプリケーションを活用してタスクを安全に実行し、さまざまな運用環境との互換性を確保します。

watsonx Orchestrate はさまざまなシステムとシームレスに統合し、エンタープライズ自動化のための堅牢なソリューションとなります。ビジュアル コネクタと API を使用して、CRM、ERP、AWS や Azure などのクラウド プラットフォームに接続します。さらに、IBM Watson サービスや他の IBM AI モデルと緊密に連携し、基本的なワークフローの自動化を超えてその機能を拡張します。上級ユーザーの場合、プログラムによる API アクセスにより、さらなるカスタマイズや既存のツールとの統合が可能になります。

__XLATE_18__

「IBM watsonx Orchestrateは、AIを活用した自動化をビジネスワークフローに直接導入するように設計されています。開発者中心のツールとは異なり、watsonx Orchestrateは、大量のコーディングを行わずにタスクを合理化したいと考えている人事、財務、販売、カスタマーサポートの専門家をターゲットにしています。」 - どーも

このプラットフォームには、事前に構築された AI アプリケーションと業界固有のスキル セットも含まれており、一般的なユースケースをより迅速に実装できます。ただし、組織は、より広範な統合オプションを備えたプラットフォームと比較して、IBM エコシステムの外ではその機能がより制限される可能性があることに注意する必要があります。

IBM watsonx Orchestrate は強力なガバナンス フレームワークで際立っており、規制された業界にとって好ましい選択肢となっています。ロールベースのアクセス制御により、データへのアクセスが承認されたユーザーと特定の機能に制限されます。

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

ハイブリッド環境全体に拡張できるように設計された watsonx Orchestrate は、小規模チームと大企業の両方をサポートします。これにより、業務効率が向上し、ポリシーへのコンプライアンスが確保され、リスクが軽減され、従業員の生産性が向上します。組織は、特定の部門に焦点を当てて小規模に開始し、結果を確認して内部の専門知識を開発するにつれて自動化機能を徐々に拡張できます。

Apache Airflow は、有向非巡回グラフ (DAG) を使用して複雑なデータ ワークフローを調整するために構築されたオープンソース プラットフォームです。当初は Airbnb によって開発され、現在は Apache Software Foundation の下で開発され、データ パイプラインのスケジューリング、監視、管理のための一般的な選択肢となっています。ビジネス ユーザー向けに調整された自動化ツールとは異なり、Airflow はデータ エンジニアや開発者を念頭に置いて設計されており、ワークフローの実行をプログラムで制御できます。

Airflow は、複雑な依存関係、スケジュールされたタスク、変換ロジックを含むデータ パイプラインの管理に威力を発揮します。データ チームは、ETL (抽出、変換、読み込み) プロセスの調整、機械学習モデルのトレーニング、バッチ処理ジョブの実行、複数のソースからのデータの取り込み、データセットの変換、スケジュールに基づいたレポートの生成など、さまざまな目的でこれを利用しています。 Python でワークフローを定義することにより、開発者はカスタム ロジックを実装し、エラーを効果的に処理するための幅広い柔軟性を得ることができます。

このプラットフォームには、ワークフローのステータス、タスクの依存関係、実行履歴に関する洞察を提供するビジュアル インターフェイスが含まれています。これにより、パフォーマンスの監視と障害のトラブルシューティングが容易になります。たとえば、タスクが失敗した場合、Airflow は自動的にタスクを再試行したり、アラートを送信したり、後続のタスクをスキップしたりして、問題の連鎖を防ぐことができます。この機能により、さまざまな展開ニーズに対応できる多用途の選択肢が得られます。

Airflow は、単一サーバーのセットアップとして展開することも、スケジューラー、ワーカー、Web サーバーが別々のマシンで動作する分散クラスターに拡張することもできます。このアーキテクチャは、定義されたスケジュールに基づいてタスクをトリガーするスケジューラー、タスクを実行するワーカー、ユーザー インターフェイス用の Web サーバー、ワークフロー定義と実行履歴を保存するメタデータ データベースといった、いくつかの主要コンポーネントで構成されています。

このモジュラー設計により、組織はワークロードの需要に応じてワーカーのキャパシティを個別に拡張できます。クラウドネイティブ環境では、Airflow のデプロイに Kubernetes がよく使用され、KubernetesExecutor が個々のタスク用に分離されたポッドを作成します。この設定によりリソースの分離が強化され、チームはタスクごとに特定のコンピューティング リソースを割り当てることができます。インフラストラクチャ管理のオーバーヘッドを削減したい場合は、マネージド Airflow サービスを利用できますが、追加の運用コストがかかります。

Airflow の広範な統合機能により、高度な適応性が実現します。データベース、クラウド プラットフォーム、データ ウェアハウス、メッセージング システム用の事前構築されたコネクタと、Python を使用してカスタム オペレーターを作成する機能を提供します。この柔軟性により、Airflow は組織のさまざまな要件を満たすことができます。

Python の豊富なライブラリ エコシステムをワークフロー内で活用することもでき、パイプライン定義で直接高度なデータ変換と分析を行うことができます。 AI および機械学習アプリケーションの場合、Airflow は TensorFlow、PyTorch、scikit-learn などのフレームワークとシームレスに統合します。これらの統合は、データ サイエンティストがデータの取得、機能の前処理、モデルのトレーニング、パフォーマンスの評価、本番環境へのモデルのデプロイなどのタスクのワークフローを調整するのに役立ちます。

Airflow には、ワークフローおよび管理機能全体でユーザーの権限を管理する役割ベースのアクセス制御 (RBAC) が含まれています。管理者は特定の権限を持つロールを定義して、承認されたユーザーのみが特定の DAG を表示、編集、実行できるようにすることができます。このきめ細かい制御により、ワークフローの整合性が維持され、不正な変更が防止されます。

認証オプションには、パスワードベースのログイン、LDAP 統合、OAuth プロバイダーが含まれます。機密の資格情報は、Airflow の接続および変数システムを通じて個別に管理されます。セキュリティを強化するために、HashiCorp Vault や AWS Secrets Manager などの外部シークレット管理ツールを統合できます。

監査ログは、ユーザーのアクションとワークフローの実行を追跡するもう 1 つの重要な機能です。これにより、アクティビティの詳細な記録が作成され、コンプライアンスやトラブルシューティングの目的で非常に役立ちます。

エアフローは、増加したワークロードを処理するためにワーカー ノードを追加することで水平方向にスケールします。このプラットフォームは、タスクを効果的に分散するためにいくつかのエグゼキュータ タイプをサポートしています。LocalExecutor はスケジューラと同じマシン上でタスクを実行し、CeleryExecutor はメッセージ キューを使用して複数のワーカー マシンにタスクを分散し、KubernetesExecutor はタスクごとに分離されたポッドをスピンアップします。

パフォーマンスを最適化するには、慎重な DAG 設計とリソース割り当てが不可欠です。タスク量が多いとスケジューラに負担がかかる可能性があるため、チームは多くの場合、大規模な DAG を分割し、スケジューラ設定を調整し、メタデータ ストアに十分なリソースがあることを確認します。

Airflow はバックフィルも効率的に処理するため、ワークフロー ロジックが変更されたときにチームが履歴データを再処理できるようになります。バックフィルは更新を合理化しますが、大量の計算リソースを消費する可能性があるため、運用ワークロードの中断を避けるために慎重な計画が必要です。

Airflow はオープンソースであるため、組織は展開を完全に制御できます。ただし、これはインフラストラクチャ、監視、アップグレードを管理する必要があることも意味しており、大規模な信頼性とパフォーマンスを維持するには専用のエンジニアリング リソースが必要です。

Kubeflow は、より汎用的なワークフロー ツールとは異なり、機械学習ワークフローを管理するための専用プラットフォームとして際立っています。 Kubernetes 向けに特別に設計されたこのオープンソース ソリューションは、完全な機械学習ライフサイクルをサポートし、データ サイエンティストと ML エンジニアに、Kubernetes ネイティブ機能を使用して運用対応モデルを構築、デプロイ、管理するために必要なツールを提供します。

Kubeflow は、Kubernetes 環境内で完全な機械学習ワークフローを調整するように調整されています。データの前処理、特徴エンジニアリング、モデルのトレーニング、検証、デプロイ、モニタリングなど、ML ライフサイクルのあらゆる段階をカバーします。 Kubeflow は、チームがモジュール式で再利用可能なパイプラインを作成できるようにすることで、分散 ML ワークロードの管理を簡素化します。その集中アプローチは、さまざまなプロジェクトにわたる実験の追跡とモデルの監視にも役立ちます。さらに、Kubeflow は、新しいデータが導入されたときに再トレーニング ワークフローを自動化し、モデルが常に最新で関連性のある状態を維持できるようにします。

Kubernetes 上に構築された Kubeflow は、コンテナ オーケストレーション、動的スケーリング、リソース管理を活用して ML ワークフローを最適化します。ユーザーは、視覚的な管理のための Web ベースのインターフェイス、または自動化のためのコマンドライン インターフェイスを通じてプラットフォームと対話できます。 Kubeflow はワークロードに応じて、トレーニング タスク用の GPU や推論用の CPU などのリソースを動的に割り当てます。その柔軟性により、オンプレミス、クラウド、ハイブリッド セットアップなど、あらゆる Kubernetes クラスターにデプロイでき、環境全体での適応性が確保されます。

Kubeflow は、TensorFlow、PyTorch、XGBoost などの一般的な機械学習フレームワークとシームレスに統合し、拡張可能な設計を通じてカスタム フレームワークもサポートします。 ML フレームワークを超えて、さまざまなクラウド サービスやストレージ ソリューションと接続し、パイプラインがデータのオブジェクト ストレージ、特徴を取得するデータ ウェアハウス、パフォーマンスを追跡する監視ツールにアクセスできるようにします。 Python ライブラリとの互換性により、実験から運用への移行がさらに効率化されます。

Kubeflow は、Kubernetes 固有のスケーリング機能を使用してクラスター リソース全体にワークロードを分散するため、大規模なトレーニングやデータ処理タスクに最適です。これにより、リソースの効率的な利用が確保され、高パフォーマンスの ML 操作がサポートされます。アッカは適切に次のように述べています。

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Kubeflow はリソースを個別に割り当てる機能により、実験と運用の間のギャップを埋め、柔軟性とパフォーマンスの両方を実現します。

Flyte は、Kubernetes を使用してコンテナ化された機械学習 (ML) ワークフローの管理を合理化するように設計されたクラウドネイティブのオーケストレーション プラットフォームです。クラウド環境全体にリソースを効率的に分散することで、ML パイプラインのデプロイの複雑さを軽減します。このアプローチにより、展開の規模に関係なく、スムーズなスケーリングと一貫したパフォーマンスが保証されます。

Flyte は、あらゆる規模の ML ワークフローを処理できるように構築されており、さまざまな需要に合わせてリソースを動的に割り当てます。その堅牢なアーキテクチャにより、ワークロードが効率的に管理され、クラウドベースのインフラストラクチャにわたる幅広い ML タスクにとって信頼できる選択肢となります。

Prefect は、複雑なデータ パイプラインと機械学習ワークフローの管理を簡素化するように設計された Python ベースのオーケストレーション プラットフォームです。使いやすさ、明確な監視、運用上のハードルの最小化に重点を置いており、データ サイエンティストやエンジニアはインフラストラクチャについて心配することなくワークフローの作成に集中できます。

Prefect は、機械学習パイプライン、クラウド ワークフロー、データ変換プロセスの自動化に威力を発揮します。これは、ETL タスクや、複数の依存関係、並列実行、リアルタイム処理を伴う複雑な機械学習ワークフローの処理に特に適しています。柔軟なスケジューリング システムにより、時間間隔、特定のイベント、または API 呼び出しに基づいてタスクをトリガーできるため、さまざまな自動化ニーズに適応できます。

Prefect はクラウド環境向けに最適化されており、最新のインフラストラクチャの需要に確実に拡張して適応できます。 Python でネイティブに構築されているため、Python ベースのデータ エコシステムとシームレスに統合できるため、新しいプログラミング言語やツールを学習する必要がありません。

Prefect は、幅広いデータ ツールおよびプラットフォームとのシームレスな互換性を提供します。 dbt、PostgreSQL、Snowflake、Looker などの一般的なツールと簡単に統合でき、Apache Kafka などのリアルタイム システムもサポートします。クラウド環境では、アマゾン ウェブ サービス (AWS)、Google Cloud Platform (GCP)、Microsoft Azure などの主要プロバイダーと連携し、コストとパフォーマンスに基づいてワークロードを最適化する柔軟性をチームに提供します。さらに、Prefect は Docker や Kubernetes などのコンテナ化ツールをサポートし、Dask や Apache Spark などの分散処理フレームワークと連携します。チームに常に情報を提供するために、ワークフローの更新に関する Slack 通知も提供します。

Prefect は、増大するデータ量と増大するワークフローの複雑さを簡単に処理できるように構築されています。フォールト トレラント エンジンにより、失敗したタスクを再試行するか問題を回避することでワークフローがエラーから回復できるため、運用環境での信頼性が高くなります。リアルタイム監視により、ワークフローの実行に関する詳細な洞察が得られ、チームが問題を迅速に特定して解決できるようになります。 Prefect は効率的に拡張できるため、動的なワークフローの管理において大手テクノロジー企業から信頼されています。始めたばかりのチーム向けに、Prefect は無料プランを提供していますが、追加の機能やサポートが必要な大規模な導入にはカスタム価格を利用できます。

Metaflow は、機械学習ワークフローのスケーリングという課題に取り組むために Netflix によって最初に開発された機械学習インフラストラクチャ プラットフォームです。プロセスをユーザーフレンドリーかつ効率的にすることに焦点を当てており、データサイエンティストが複雑なインフラストラクチャに対処することなくプロトタイプから本番環境にスムーズに移行できるように支援します。

Metaflow は、スケーラブルな運用レベルの機械学習ワークフローを管理するために構築されています。これにより、探索的なデータ分析とモデルのトレーニングから導入までのプロセスが簡素化されます。データ サイエンティストは、使い慣れたライブラリを使用して Python でワークフローを作成できますが、プラットフォームはバージョン管理、依存関係管理、コンピューティング リソースの割り当てを自動的に処理します。

このプラットフォームは、必要なコンピューティング リソースを自動的にプロビジョニングすることで、手動のインフラストラクチャ管理の必要性を排除します。これにより、コードを変更することなく、ローカル開発からクラウド実稼働へのシームレスな移行が可能になります。

__XLATE_53__

「Metaflow は、合理化されたクラウド統合、堅牢なバージョニング、本番環境に対応した展開のためのインフラストラクチャの抽象化を提供することで、スケーラブルな ML ワークフローをシンプルに調整します。」 - Akka.io

Metaflow の導入プロセスは、クラウド サービスやデータ プラットフォームと簡単に統合できる機能によって補完されます。 Python ネイティブの設計により、機械学習、データ処理、視覚化に広く使用されているライブラリとの互換性が保証され、チームがすでに利用しているツールを最大限に活用できるようになります。

Metaflow は、もともと大規模な機械学習操作をサポートするために Netflix によって作成されたもので、強力なバージョニング システムを備えています。このシステムは実験、データセット、モデルのバージョンを追跡し、実験の再現性を確保し、必要に応じて簡単にロールバックできるようにします。

Dagster は、適応性のあるパイプライン管理を提供しながらデータの整合性を維持することに重点を置くことで、オーケストレーション フレームワークのラインナップに追加します。このオープンソース ツールは、品質を向上させ、データ系統を追跡し、機械学習 (ML) ワークフロー内の可視性を確保するように作成されています。 Dagster はその中核として、高水準のデータ整合性を維持し、変換に対する明確な洞察を提供する、タイプセーフで信頼性の高いデータ パイプラインの構築を専門としています。

Dagster は、データの品質と精度が交渉の余地のない ML ワークフローの管理に特に効果的です。これは、組み込みの検証、堅牢なメタデータ追跡、プロセス全体にわたる包括的な可観測性を必要とするチーム向けに調整されています。その有用性の実例はヘルスケア分野に見られます。そこでは、組織は、厳格なコンプライアンスと品質ベンチマークを満たすために必要なレベルの整合性で機密のヘルスケア データを処理するために Dagster を利用しています。

Dagster を使用すると、開発者は複雑なワークフローをコードで直接定義できます。これは、AI 運用をスケーリングするために不可欠な機能です。そのモジュール構造は、自動化された依存関係管理、再試行メカニズム、並列実行を備えた高度なワークフローを作成するためのモデルとエージェントの連鎖をサポートします。さらに、Dagster はさまざまなクラウド プラットフォーム、API、ベクター データベースとシームレスに統合されているため、大規模なデータや AI タスクの処理に最適です。

この柔軟なアーキテクチャにより、さまざまなシステムとのスムーズな統合が保証されます。

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen は、Microsoft Research によって開発されたオープンソース フレームワークで、複数の AI エージェントが会話を通じて協力して複雑なタスクに取り組むことを可能にします。このシステムを使用すると、開発者は、専門のエージェントが連携して、共通の目標を達成するために独自の専門知識を提供するアプリケーションを作成できます。 AutoGen は会話型インターフェイスを導入することで、複数の AI コンポーネントを調整する複雑なプロセスを簡素化します。

AutoGen は、コラボレーションの手段として対話を活用することにより、マルチエージェント オーケストレーションへの新しいアプローチを導入します。このフレームワークは、複数のエージェントが動的に連携する必要がある問題解決シナリオで特に効果的です。たとえば、ソフトウェア開発では、1 つのエージェントがコードを生成し、もう 1 つのエージェントがテストと検証に重点を置き、両方のエージェントが反復して出力を改良する場合があります。この会話モデルは、ソフトウェア ワークフローの自動化、研究の支援、多様な視点やスキルが成果を向上させる複雑な意思決定プロセスの処理などのタスクに自然に適合します。

ワークフローの反復的な改善を目指すチームにとって、AutoGen は特に魅力的です。エージェント間のやり取りを促進する機能は人間のコラボレーションを反映しており、開発者が継続的な対話とフィードバックを通じて進化および改善するシステムを設計することが容易になります。

AutoGen は、会話型エージェントの設計で際立っていると同時に、モジュール性を重視しています。各エージェントは特定の役割と指示に従って動作します。これには、ツール、外部 API、または言語モデルへのアクセスが含まれる場合があります。このフレームワークは、自律エージェントと人間の入力を組み込んだユーザー プロキシ エージェントの両方をサポートし、ワークフローの管理に柔軟性を提供します。

このシステムは、開発中にローカルで実行でき、本番環境ではクラウド環境に拡張できます。開発者は、エージェントが順番に交代する順次ワークフローを通じて、または複数のエージェントが同時に貢献するより複雑なパターンを通じて、エージェントがどのように対話するかを定義できます。 Python ベースの構成を使用すると、チームは可読性を損なうことなくオーケストレーション ロジックを完全に制御できるようになり、マルチエージェントの対話を管理するプロセスが合理化されます。

AutoGen は、複数のモデル呼び出しとエージェントの会話の管理の複雑さを処理するため、開発者はインフラストラクチャについて心配するのではなく、システムのロジックと動作の作成に集中できます。

AutoGen は、関数呼び出しを通じて Azure OpenAI Service や他のモデルとシームレスに統合し、開発者が AI バックエンドを柔軟に選択できるようにします。また、エージェントと外部ツールやサービスの接続もサポートされており、エージェントが会話中にデータを取得したり、コードを実行したり、サードパーティ API と対話したりできるようになります。

このフレームワークを使用すると、開発者はカスタム エージェント タイプ、再利用可能な会話パターン、オーケストレーション テンプレートを作成できます。この柔軟性は、チームが特殊なニーズに合わせて深くカスタマイズしながら、一般的なタスクに既存のパターンを活用できることを意味します。

すでに Microsoft ツールを使用している組織にとって、AutoGen は、Azure サービス、Visual Studio Code、およびその他の開発プラットフォームとの簡単な統合を提供します。 Microsoft エコシステムとの連携にもかかわらず、このフレームワークはプラットフォームに依存せず、さまざまなテクノロジ環境で適切に動作します。

AutoGen は、エージェント機能の制御と外部リソースへのアクセスの管理に重点を置いています。開発者は、アクセスできる API や取得できるデータなど、エージェントごとに特定の権限を定義します。このきめ細かなアプローチにより、エージェントは最小権限の原則に基づいて動作し、その役割に必要なタスクのみを実行することが保証されます。

フレームワークの会話的な性質により、本質的に監査証跡が作成され、エージェントの対話と意思決定プロセスが記録されます。これらのログは、出力がどのように生成されるかについての透明性を提供し、コンプライアンスとデバッグ作業に役立ちます。チームはこれらの記録を確認してエージェントの動作を分析し、改善すべき領域を特定できます。

人間参加型機能は、重要な意思決定ポイントで人間によるレビューのためにワークフローを一時停止できるようにすることで、監視を強化します。この機能により、機密性の高いアクションを続行する前に評価できるようになり、自動化の効率とガバナンスおよび制御のバランスが取れます。

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

組織は、会話コンテキストをキャッシュし、日常的なタスクに高速なモデルを使用し、複雑な推論のためにより高度なモデルを予約することにより、パフォーマンスを向上させることができます。不必要なやり取りを最小限に抑える会話パターンを設計することも効率を高めます。必要に応じて、フレームワークは並列エージェント実行をサポートし、独立したタスクを順次ではなく同時に実行できるようにします。

高いワークロードを処理するために、AutoGen を自動スケーリングのクラウド インフラストラクチャにデプロイすることで、システムがコストを抑えながらさまざまな需要を管理できるようにすることができます。ステートレス エージェントの対話により水平方向のスケーリングが簡素化されますが、交換間でコンテキストを維持するには慎重なアーキテクチャ計画が必要です。

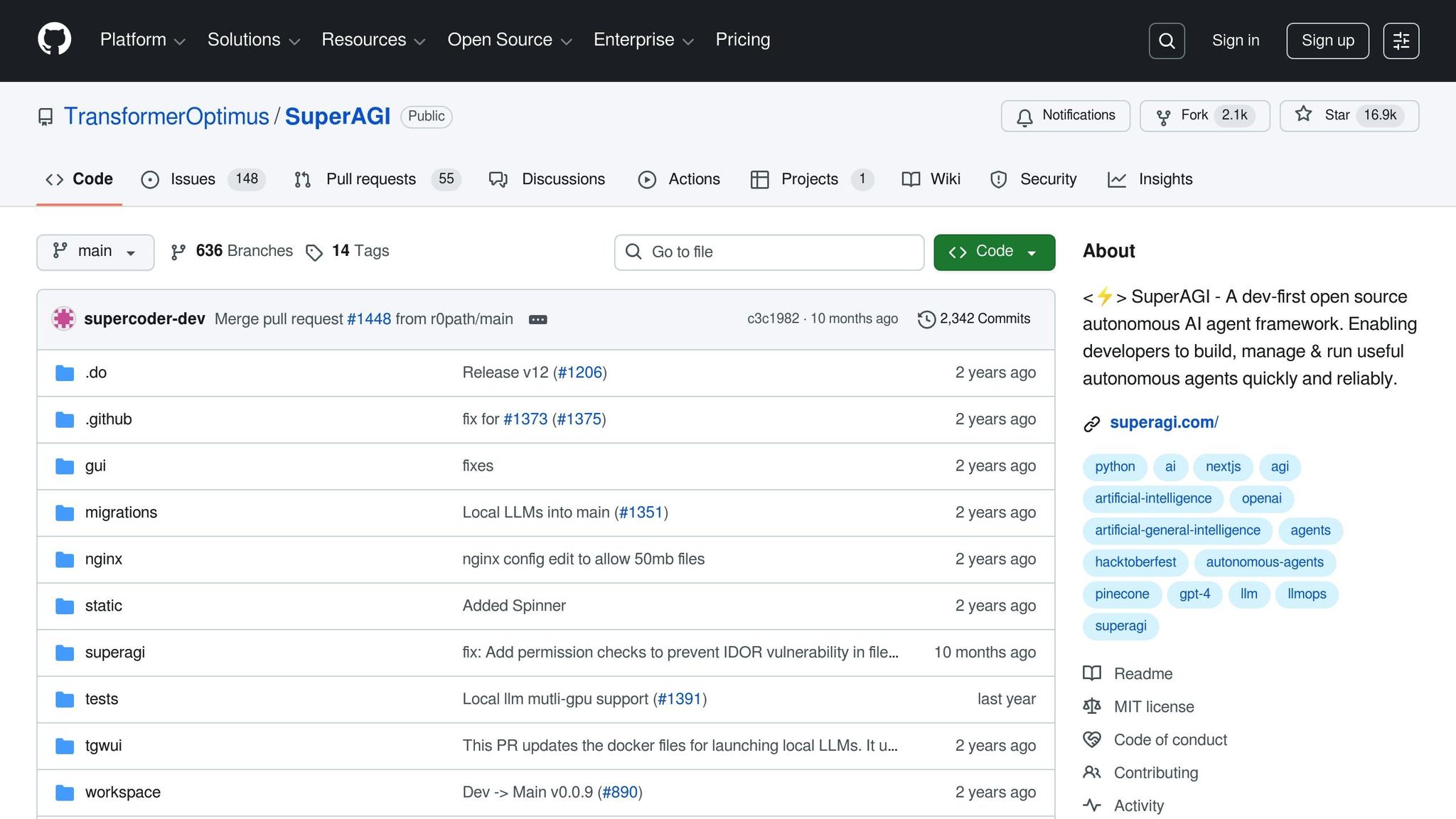

SuperAGI は、これまで検討してきたオーケストレーション フレームワークに基づいて、マルチエージェントのコラボレーションを管理する新しい方法を導入します。このオープンソース プラットフォームは、自律型 AI エージェントを調整するように設計されており、開発者が継続的な学習を通じてタスクを計画、実行、適応できるエージェントを作成、展開、監督できるようになります。 SuperAGI を使用すると、複数のエージェントがシームレスに連携し、タスクを動的に委任し、協力して複雑な課題に取り組むことができます。適応型タスク管理とマルチエージェントのチームワークを統合し、高度な AI オーケストレーションのための強力なツールとして際立たせます。

SuperAGI は、企業の複雑で進化するタスクの自動化に威力を発揮します。そのエージェント ネットワークは高度なタスクの計画と実行に優れており、強化学習とフィードバック ループを通じて継続的に改善されます。これは、インテリジェントな調整が鍵となる大規模な運用を扱う組織にとって特に役立ちます。プラットフォーム内のエージェントは、対話と結果から学習し、時間の経過とともに自分の行動を改善できるようになります。

このプラットフォームの際立った機能は、動的なタスクの委任です。エージェントは厳格なワークフローに固執するのではなく、リアルタイムで状況を評価し、優先タスクを特定し、それらを最適なネットワーク メンバーに割り当てます。この柔軟性により、複雑なシナリオでもリソースが効率的に割り当てられます。

SuperAGI のアーキテクチャは、拡張性とモジュール性を中心に設計されています。開発者は、エージェント ネットワークとワークロードを簡単に拡張して、さまざまなアプリケーションのニーズを満たすことができます。各エージェントは独立して動作しますが、シームレスに通信するため、スムーズなコラボレーションが保証されます。

ユーザーフレンドリーなグラフィカルインターフェイスにより、チームはエージェントのやり取りを視覚化し、設定を微調整することができます。モニタリング ダッシュボードはエージェントのパフォーマンスに関する洞察を提供し、開発者が非効率性を特定して対処するのに役立ちます。このプラットフォームは並列実行もサポートしており、複数のエージェントが独立したタスクを同時に処理できるようになります。この設計により、特に要求の高い環境でスループットが大幅に向上します。

SuperAGI は、サードパーティ API、ワークフロー ツール、カスタム モジュールと統合する拡張可能なプラグイン システムを備えています。この柔軟性により開発が加速され、より広範な開発者コミュニティからの貢献が促進され、プラットフォームの機能が強化されます。

このプラットフォームの分散モジュラー アーキテクチャは水平スケーリングをサポートしており、大規模な実装に適応できます。強化学習とフィードバック ループの使用により、全体的なパフォーマンスが向上し、タスクが効率的に割り当てられます。 SuperAGI は、効果的なコラボレーションと高スループットを可能にするため、複雑で大量のシナリオで堅牢なパフォーマンスを要求する組織に最適です。

適切な AI オーケストレーション フレームワークを選択するということは、各オプションの長所と限界を理解することを意味します。これらのプラットフォームは、さまざまな優先順位を念頭に置いて設計されており、エンタープライズ レベルのセキュリティ、開発者の適応性、機械学習パイプラインなどの特殊なワークフローなどのニーズに応えます。各フレームワークは、独自の設計哲学と対象となるユースケースを反映しています。

たとえば、Prompts.ai などのプラットフォームは大規模言語モデル (LLM) へのアクセスを一元化することに優れていますが、Apache Airflow や Prefect などのツールは一般的なワークフローの自動化に重点を置いています。一方、Kubeflow と Flyte は機械学習パイプライン向けに調整されており、SuperAGI や Microsoft AutoGen のようなフレームワークは、自律システムが複雑なタスクを一緒に処理できるようにすることで、マルチエージェント AI コラボレーションの限界を押し広げます。

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

コスト構造: 従来のプラットフォームはユーザーまたは実行ごとに料金が発生することが多く、運用が拡大するにつれてコストが増加する可能性があります。対照的に、Prompts.ai は TOKN クレジットを使用した従量課金制モデルを採用しており、費用と使用量を直接関連付けています。このアプローチは、さまざまなモデルを試したり、変動するワークロードを管理したりする場合に特に役立ちます。

セキュリティとコンプライアンス: 医療や金融などの業界では、堅牢なセキュリティ対策が不可欠です。 Prompts.ai、IBM watsonx Orchestrate、Prefect などのプラットフォームは、監査証跡や役割ベースのアクセス制御などの組み込みコンプライアンス ツールを提供します。ただし、Apache Airflow などのオープンソース オプションでは、厳格なコンプライアンス基準を満たすために追加の構成が必要です。

学習曲線: 使いやすさは大きく異なります。 Prefect や Dagster などのプラットフォームはより初心者に優しく、直感的な Python API と役立つエラー メッセージを提供します。一方、Apache Airflow と Kubeflow には、より深い技術的専門知識とインフラストラクチャ管理スキルが必要です。 Prompts.ai は、使いやすさとパワー ユーザー向けの高度な機能のバランスをとった統合インターフェイスにより、これをさらに簡素化します。

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

統合エコシステム: 既存のツールとのシームレスな統合が重要です。 Apache Airflow は、クラウド サービス、データベース、監視ツール用の何百ものプラグインを提供しています。一方、Prompts.ai は特に LLM に焦点を当てており、単一の API を介して数十のモデルへの合理化されたアクセスを提供します。

スケーラビリティ: Kubeflow や Flyte などのプラットフォームは、ワークロード分散に Kubernetes を活用し、水平スケーリングを目的に構築されています。 Metaflow は柔軟なスケーリングに AWS サービスを使用しますが、Prefect はクラウド管理型とセルフホスト型の両方のスケーリング オプションをサポートします。 SuperAGI は分散エージェント アーキテクチャを採用しており、並列実行が可能ですが、これには慎重な調整が必要です。

あなたにとって最適なフレームワークは、特定のワークフローによって異なります。 LLM オーケストレーションの場合、Prompts.ai は一元化されたモデルへのアクセスとコスト効率で際立っています。データ エンジニアリング チームは Apache Airflow の信頼性に頼るかもしれませんが、大規模なトレーニングと展開に取り組む ML チームは Kubeflow や Flyte の恩恵を受ける可能性があります。自律型 AI システムの構築に重点を置いている場合は、SuperAGI または Microsoft AutoGen が適している可能性があります。

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

たとえば、LLM オーケストレーションを優先するチームは、Prompts.ai を特に魅力的に感じるかもしれません。 GPT-5、Claude、Gemini などの 35 を超えるモデルへのすべての統一インターフェイスを介した一元的なアクセスを提供します。従量課金制の TOKN クレジット システムにより、サブスクリプション料金が不要になり、リアルタイムのコスト追跡が可能になります。ロールベースのアクセス制御や監査証跡などの機能を備えた Prompts.ai は、速度を犠牲にすることなく厳格なガバナンスを必要とする業界にとって強力な選択肢です。

複雑な ETL パイプラインを扱うデータ エンジニアリング チームは、より高度な専門知識が必要ですが、堅牢なプラグイン エコシステムとスケーラビリティを備えた Apache Airflow に惹かれる可能性があります。一方、Prefect はユーザーフレンドリーなエラー処理を備えた Python ネイティブのアプローチを提供しており、チームのオンボーディングを迅速化するための優れたオプションとなっています。

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

自律型 AI システムを検討している組織は、マルチエージェント コラボレーション機能については Microsoft AutoGen を、動的なタスク委任については SuperAGI を検討するかもしれません。これらのツールは研究や特殊な使用例には最適ですが、多くの場合高度なコーディング スキルが必要なため、当面の運用ニーズにはあまり適していません。

最終的に、適切なフレームワークの選択には、モジュール性、拡張性、可観測性、ロールベースのアクセス制御やコンプライアンス認証などのガバナンス機能などの要素を評価することが含まれます。導入の柔軟性と既存ツールとの統合も同様に重要です。機能以外にも、SDK、ドキュメント、総所有コストなどの開発者エクスペリエンスを考慮してください。単純な単一エージェントのタスクであるか、永続メモリを備えた複雑なマルチエージェント システムであるかなど、ワークフローの複雑さも決定の指針となります。

業界はスケーラブルな統合 AI システムに向かう傾向にあり、オープンソース フレームワークがエンタープライズ ワークロードの大部分を推進し、ベンダー管理のランタイムが運用上の課題を簡素化しています。

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

AI オーケストレーション フレームワークを選択するときは、現在のツールやシステムとどの程度うまく統合できるかを考慮することが重要です。強力な統合機能を備えたフレームワークにより、不必要な複雑化を引き起こすことなくすべてが連携して動作します。

ワークフローのスケジュール設定やタスク管理などの自動化機能に注目してください。これらにより操作が簡素化され、時間を節約できます。同様に重要なのは、機密データを保護し、規制への準拠を維持するのに役立つセキュリティとガバナンスの対策です。

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai は、35 を超える大規模な言語モデルを統合プラットフォーム内にまとめることで、複数の AI ツールをやりくりするという課題を簡素化します。このセットアップを使用すると、ユーザーはプロンプトのワークフロー、出力品質、全体的なパフォーマンスを完全に監視しながら、モデルを並べて簡単に比較できます。

Prompts.ai は、その効率性を高めるために、コストを最適化するように設計された統合された FinOps レイヤーを備えています。このツールは、使用状況、支出、投資収益率 (ROI) に関するリアルタイムの洞察を提供し、組織がリソースを効果的に管理し、AI 予算を最大限に活用できるようにします。

Prompts.ai は、エンタープライズ グレードのセキュリティとコンプライアンスを優先し、SOC 2 Type II、HIPAA、GDPR などの業界標準に準拠して、あらゆる段階でデータを保護します。

To uphold ongoing monitoring and compliance, Prompts.ai collaborates with Vanta and began its SOC 2 Type II audit process on 2025年6月19日. These steps ensure your workflows stay secure, compliant, and dependable for enterprise operations.