Orkestrasi AI adalah kunci untuk meningkatkan operasi AI perusahaan. Dengan 95% kegagalan uji coba AI karena koordinasi yang buruk, bisnis memerlukan alat untuk menyatukan, mengotomatisasi, dan mengelola alur kerja AI yang kompleks. Lanskap tahun 2025 memperkenalkan platform yang mengintegrasikan berbagai model, mengamankan alur kerja, dan mengoptimalkan biaya, sehingga memberikan ROI hingga 60% lebih tinggi bagi pengguna.

Here’s a quick breakdown of the top solutions:

Setiap platform menawarkan kekuatan unik dalam skalabilitas, interoperabilitas, tata kelola, dan manajemen biaya. Baik Anda memerlukan fleksibilitas sumber terbuka atau kepatuhan tingkat perusahaan, alat-alat ini dapat mengubah sistem AI yang terfragmentasi menjadi ekosistem terpadu dan terukur.

Pilih platform yang tepat untuk meningkatkan skala inisiatif AI Anda, meningkatkan koordinasi, dan memaksimalkan ROI.

Perbandingan Platform Orkestrasi AI: Skalabilitas, Interoperabilitas, Tata Kelola & Biaya

Prompts.ai adalah platform perusahaan mutakhir yang dirancang untuk menyederhanakan dan menyederhanakan operasi AI. Ini menyatukan lebih dari 35 model bahasa besar tingkat atas - termasuk GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro, dan Kling - ke dalam satu antarmuka terpadu yang aman. Dengan memusatkan akses ke model-model ini, platform ini menghilangkan kekacauan dalam mengelola berbagai alat, sehingga membantu organisasi meningkatkan upaya AI mereka dengan mudah.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Sebagai hub terpusat, Prompts.ai memastikan semua proses yang digerakkan oleh AI bergantung pada template prompt resmi yang dikontrol versi, bukan string yang tersebar dan dikodekan secara keras. Arsitekturnya memungkinkan pemilihan model yang mudah dan perbandingan kinerja secara berdampingan, memberdayakan tim untuk mengidentifikasi dan menerapkan model bahasa besar (LLM) yang paling efektif untuk setiap tugas. Semua ini dicapai tanpa perlu menulis ulang kode atau menyesuaikan saluran pipa, sehingga menghemat waktu dan tenaga.

Prompts.ai memprioritaskan keamanan dan kontrol melalui kontrol akses berbasis peran (RBAC) yang kuat. Hal ini memungkinkan organisasi untuk menentukan izin yang tepat tentang siapa yang dapat membuat, mengubah, atau menyebarkan perintah di lingkungan produksi. Setiap interaksi dicatat secara cermat dengan jejak audit dan pelacakan versi, sehingga menawarkan transparansi penuh. Kerangka tata kelola ini membantu bisnis memenuhi standar kepatuhan sekaligus menjaga visibilitas dan kontrol atas operasi AI. Dengan menggabungkan langkah-langkah keamanan yang ketat dengan efisiensi operasional, platform ini membantu organisasi mengelola AI dengan aman dan efektif.

Platform ini mencakup lapisan FinOps yang melacak penggunaan token, yang secara langsung menghubungkan pengeluaran AI dengan hasil bisnis. Banyak organisasi telah melaporkan pengurangan biaya hingga 98% dengan mengkonsolidasikan hubungan vendor dan memotong langganan yang tidak perlu. Dengan metrik penggunaan dan kinerja real-time, tim dapat memantau dan mengoptimalkan pengeluaran secara terus menerus, menghindari pengeluaran tak terduga di akhir bulan. Tingkat transparansi finansial ini mengubah AI dari ketidakpastian anggaran menjadi investasi terukur dengan keuntungan yang jelas.

LangChain menonjol sebagai kerangka kerja yang kuat untuk aplikasi AI, dengan 90 juta unduhan bulanan yang mengesankan dan lebih dari 100,000 bintang GitHub. Desain modularnya membagi fungsionalitas menjadi paket-paket ringan, seperti langchain-core untuk abstraksi dasar dan komunitas langchain untuk integrasi pihak ketiga. Pendekatan ini memastikan alur kerja AI yang efisien tanpa overhead yang tidak perlu, menjadikannya pilihan tepat untuk mengelola kompleksitas dan skala.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith mematuhi standar kepatuhan yang ketat, termasuk HIPAA, SOC 2 Tipe 2, dan GDPR. Ini menawarkan penelusuran eksekusi terperinci, menciptakan jejak audit komprehensif untuk debugging dan tinjauan kepatuhan. LangGraph menyempurnakannya dengan fitur human-in-the-loop, termasuk kemampuan "perjalanan waktu" untuk inspeksi, rollback, dan koreksi secara real-time.

__XLATE_10__

Garrett Spong, Principal SWE, menyoroti: "LangGraph menetapkan landasan bagi cara kami membangun dan menskalakan beban kerja AI - mulai dari agen percakapan, otomatisasi tugas kompleks, hingga pengalaman khusus yang didukung LLM yang 'berfungsi'".

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) menonjol dengan rekam jejak yang mengesankan: 258 juta unduhan PyPI, 33.100 bintang GitHub, dan komunitas yang berkembang dengan lebih dari 3.000 kontributor. Dirancang untuk berjalan secara native di Kubernetes, KFP mengeksekusi setiap langkah pipeline sebagai Pod terpisah, sehingga memungkinkannya untuk secara dinamis menskalakan sumber daya komputasi di seluruh cluster Anda sesuai kebutuhan. Arsitekturnya bergantung pada struktur Directed Acyclic Graph (DAG), yang memungkinkan eksekusi paralel tugas-tugas dalam container kecuali dependensi data tertentu ditentukan [18, 19]. Penyiapan ini adalah kunci kemampuannya menangani alur kerja yang kompleks secara efisien.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP memastikan fleksibilitas dan portabilitas melalui format IR YAML, yang memungkinkan pipeline berjalan dengan lancar di berbagai backend KFP, mulai dari penyiapan sumber terbuka hingga layanan terkelola seperti Google Cloud Vertex AI Pipelines. Artinya, Anda dapat mengembangkan secara lokal dan menerapkannya dalam skala besar di cloud tanpa harus menulis ulang kode Anda. Platform ini juga terintegrasi dengan alat populer seperti Spark, Ray, dan Dask untuk persiapan data, serta KServe untuk inferensi model yang dapat diskalakan. Dengan Python SDK-nya, data scientist dapat menentukan alur kerja yang rumit menggunakan praktik pengkodean yang sudah dikenal, sementara backend secara otomatis menerjemahkannya ke dalam operasi Kubernetes.

Keamanan dan tata kelola merupakan bagian integral dari KFP. Ia menggunakan fitur bawaan Kubernetes, seperti Kontrol Akses Berbasis Peran (RBAC), namespace untuk isolasi, dan kebijakan jaringan, untuk memastikan eksekusi alur kerja yang aman. Platform ini melacak metadata dan artefak secara terpusat, membuat jejak audit terperinci untuk setiap proses pipeline [8, 22]. Dengan menjalankan setiap langkah alur dalam wadah terisolasi, KFP mempertahankan isolasi proses dan penanganan data yang aman. Administrator memiliki kemampuan untuk menetapkan batas sumber daya untuk tugas individu, memastikan distribusi sumber daya yang adil di seluruh tim dan mencegah penggunaan berlebihan. Untuk data atau beban kerja sensitif, pemilih node dapat digunakan untuk membatasi tugas pada perangkat keras tertentu yang aman.

Meskipun KFP sendiri bersifat open-source dan gratis untuk digunakan, biaya yang terkait dengan infrastruktur dasar Kubernetes - baik di AWS EKS, Google GKE, atau on-premise - tetap berlaku. Versi terkelola, seperti Google Cloud Vertex AI Pipelines, beroperasi dengan model penetapan harga bayar sesuai pemakaian [19, 20]. KFP juga menyertakan fitur seperti mekanisme percobaan ulang untuk kegagalan sementara, yang membantu menghindari biaya memulai ulang pipeline yang sudah berjalan lama, dan pengendali keluar yang memastikan tugas pembersihan dijalankan bahkan jika langkah sebelumnya gagal. Fitur-fitur ini berkontribusi pada penggunaan sumber daya yang lebih efisien dan pengendalian biaya.

Argo Workflows adalah mesin eksekusi alur kerja populer yang dirancang khusus untuk Kubernetes, dengan lebih dari 200 organisasi mengandalkannya di lingkungan produksi. Sebagai solusi asli container, solusi ini mengatur pekerjaan paralel dengan menjalankan setiap langkah alur kerja dalam pod yang terisolasi. Arsitektur ini memungkinkan penskalaan dinamis berdasarkan kapasitas yang tersedia pada cluster Kubernetes Anda, sehingga sangat efektif untuk tugas-tugas AI yang memerlukan pengelolaan sumber daya yang fleksibel.

Alur Kerja Argo mendukung penskalaan melalui pengoptimalan vertikal dan sharding. Dengan meningkatkan parameter --workflow-workers, Anda dapat mengalokasikan lebih banyak inti CPU untuk mempercepat rekonsiliasi alur kerja. Untuk operasi yang lebih besar, sharding dapat diterapkan dengan menerapkan instalasi terpisah per namespace atau menjalankan beberapa instance pengontrol dalam cluster yang sama menggunakan ID Instance. Untuk melindungi server API Kubernetes, Argo menerapkan pembatasan laju sisi klien (default: 20 kueri per detik dengan lonjakan 30) dan membatasi konkurensi langkah-langkah foreach pada 100 tugas. Pendekatan yang terukur ini memastikan integrasi yang lancar dengan sistem eksternal, bahkan di bawah beban kerja yang berat.

Sebagai Definisi Sumber Daya Kustom (CRD) Kubernetes, Argo terintegrasi secara mulus dengan kluster Kubernetes mana pun dan mendukung platform AI terkemuka seperti Kubeflow Pipelines, Netflix Metaflow, Seldon, dan Kedro. Pengembang dapat menentukan alur kerja menggunakan SDK resmi untuk Python (Hera), Java, dan Go, yang menawarkan fleksibilitas dalam pilihan bahasa. Untuk manajemen artefak, Argo mendukung berbagai solusi penyimpanan, termasuk AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory, dan Alibaba Cloud OSS. Kompatibilitas ini memastikan kelancaran aliran data di berbagai lingkungan. Selain itu, alur kerja dapat dipicu oleh sinyal eksternal seperti webhook atau perubahan penyimpanan menggunakan Argo Events. Menurut dokumentasi Metaflow, Argo Workflows adalah satu-satunya orkestrator produksi yang mendukung pemicuan peristiwa melalui Argo Events. Kombinasi fleksibilitas dan fungsionalitas menjadikannya pilihan tepat untuk otomatisasi alur kerja.

Alur Kerja Argo memanfaatkan fitur asli Kubernetes untuk memastikan keamanan yang kuat. Kontrol Akses Berbasis Peran (RBAC) mengelola izin untuk pengontrol alur kerja, pengguna, dan pod individual. Untuk meningkatkan isolasi, pengontrol dapat dibatasi pada satu namespace menggunakan mode "namespace-install". Di lingkungan produksi, Argo mendukung Sistem Masuk Tunggal (SSO) melalui OAuth2 dan OIDC, sekaligus mengamankan data dalam transit dengan enkripsi TLS. Administrator dapat menerapkan pembatasan alur kerja, sehingga pengguna hanya dapat mengirimkan template yang telah disetujui sebelumnya, dan Konteks Keamanan Pod membantu mencegah pod agar tidak berjalan sebagai root. Kebijakan jaringan mengatur lalu lintas untuk Server Argo dan Pengontrol Alur Kerja, dan batas kedalaman rekursi default sebesar 100 panggilan mencegah loop tak terbatas.

Argo Workflows adalah alat sumber terbuka yang tersedia di bawah Lisensi Apache 2.0, sehingga gratis untuk digunakan. Untuk mengelola biaya, ia menggunakan strategi TTL dan Pod Garbage Collection (PodGC) untuk secara otomatis menghapus alur kerja yang telah selesai dan membersihkan pod yang tidak digunakan, sehingga mengurangi pemborosan sumber daya. Tugas dapat dijadwalkan pada infrastruktur yang hemat biaya, seperti instans spot, menggunakan pemilih node dan aturan afinitas. Selain itu, penggunaan sumber daya dilacak per langkah, membantu pengguna memantau pengeluaran. Jika Anda melihat "pelambatan sisi klien" di log pengontrol, meningkatkan nilai --qps dan --burst dapat meningkatkan efisiensi komunikasi dengan API Kubernetes. Desain yang bijaksana ini membantu menyeimbangkan kinerja dengan efektivitas biaya.

Apache Airflow telah menjadi pemain kunci dalam mengelola alur kerja AI, menawarkan kerangka kerja berbasis kode yang fleksibel untuk mengatur operasi yang kompleks. Hal ini terutama menonjol dalam Operasi Pembelajaran Mesin (MLOps), di mana 23% penggunanya menerapkannya, dan dalam proyek AI Generatif, digunakan oleh 9% komunitasnya. Dirilis di bawah Lisensi Apache 2.0, Airflow memungkinkan pengembang untuk menentukan alur kerja dengan Python, berintegrasi secara mulus dengan perpustakaan pembelajaran mesin apa pun.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

KubernetesExecutor sangat berguna untuk menangani beban kerja yang tidak dapat diprediksi dan membutuhkan banyak sumber daya. Fitur seperti Pemetaan Tugas Dinamis memungkinkan tugas untuk diskalakan berdasarkan data real-time, menjadikannya sempurna untuk kumpulan data besar dan alur kerja multi-model. Sementara itu, Operator yang Dapat Ditangguhkan meningkatkan efisiensi dengan mengelola status tunggu yang lama, seperti memantau pelatihan model, tanpa menempati slot pekerja. Pendekatan ini secara signifikan meningkatkan throughput dan pemanfaatan sumber daya.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

TaskFlow API menyederhanakan pembuatan alur kerja dengan menggunakan dekorator Python untuk mengubah skrip menjadi tugas Airflow, secara otomatis mengelola transfer data melalui XComs. Tim dapat merutekan tugas ke lingkungan yang sesuai, seperti pod Kubernetes untuk pelatihan intensif GPU atau kluster Spark untuk prapemrosesan data. Selain itu, REST API dan airflowctl CLI memungkinkan integrasi yang aman dengan pipeline CI/CD, memastikan manajemen alur kerja yang lancar dan dapat diaudit.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

Untuk tata kelola data, Airflow terintegrasi dengan OpenLineage, sebuah standar untuk melacak silsilah data, yang membantu memenuhi persyaratan kepatuhan seperti GDPR dan HIPAA. CLI airflowctl berinteraksi secara eksklusif dengan REST API, menghindari akses langsung ke database metadata untuk keamanan tambahan. Tim juga dapat mengelola lingkungan yang dapat direproduksi menggunakan tugas Penyiapan dan Pembongkaran, memperlakukan infrastruktur sebagai kode untuk pengawasan dan konsistensi yang lebih baik.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning menawarkan solusi canggih untuk kebutuhan AI perusahaan, yang dilengkapi GPU tingkat lanjut, jaringan InfiniBand, waktu aktif 99,9%, dan lebih dari 100 sertifikasi kepatuhan. Didukung oleh tim yang terdiri dari 34.000 insinyur dan 15.000 pakar keamanan, ini memastikan keandalan dan keamanan dalam skala besar.

Platform ini dirancang untuk menangani beban kerja dalam ukuran apa pun melalui dukungannya terhadap komputasi terdistribusi di seluruh data, model, dan saluran pipa, sehingga memaksimalkan efisiensi sumber daya. Titik akhir online yang terkelola memungkinkan penerapan model yang lancar dengan penskalaan otomatis untuk mengakomodasi lonjakan permintaan. Misalnya, Marks & Spencer menggunakan Azure ML untuk memproses data untuk lebih dari 30 juta pelanggan sambil memanfaatkan caching dan registri pipeline untuk mengurangi waktu dan biaya pelatihan. Demikian pula, di BRF, ML dan MLOps otomatis menghilangkan tugas manual untuk 15 analis, sehingga mereka dapat fokus pada pekerjaan yang bernilai lebih tinggi.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"Tanpa aliran cepat Azure AI, kami terpaksa berinvestasi dalam rekayasa kustom yang cukup signifikan untuk memberikan solusi. Sebaliknya, kami mampu mencapai kecepatan luar biasa dengan dengan mudah mengintegrasikan layanan mikro yang ada ke dalam solusi aliran cepat."

Azure ML juga mendukung pelatihan terdistribusi yang menjaga privasi, seperti yang ditunjukkan oleh Johan Bryssinck di Swift, yang menggunakan platform tersebut untuk melatih model pada perangkat edge lokal daripada memusatkan data, sehingga memastikan skalabilitas dan privasi data. Kontrak API terpadunya, bersama dengan integrasi dengan Azure Logic Apps dan Azure Functions, semakin meningkatkan konektivitas dengan alat eksternal.

Azure Machine Learning memprioritaskan keamanan dengan fitur seperti Microsoft Entra ID untuk kontrol akses berbasis peran (RBAC) dan Jaringan Virtual untuk mengisolasi sumber daya dan membatasi akses API. Data dilindungi dengan enkripsi TLS 1.2/1.3 selama transit dan enkripsi ganda saat disimpan, dengan opsi Kunci yang Dikelola Pelanggan untuk kontrol tambahan. Pertahanan waktu nyata, seperti Prompt Shields, mencegah jailbreak dan serangan injeksi cepat, sementara Customer Lockbox memerlukan persetujuan administratif agar Microsoft dapat mengakses data pelanggan. Alat tambahan melacak versi aset, silsilah data, dan kuota, dan Pertahanan Microsoft untuk Cloud memberikan perlindungan terhadap ancaman waktu proses.

Azure Machine Learning beroperasi dengan model harga bayar sesuai pemakaian, hanya mengenakan biaya untuk sumber daya komputasi seperti CPU dan GPU khusus. Layanan pendukung seperti Blob Storage, Key Vault, Container Registry, dan Application Insights juga ditagih berdasarkan penggunaan. Tim dapat memilih perangkat keras yang disesuaikan dengan tugas tertentu, sementara fitur seperti cache pipeline mengurangi komputasi yang berlebihan. Infrastruktur sebagai Kode memastikan penerapan yang konsisten dan pengelolaan sumber daya yang efisien.

Google Vertex AI Pipelines menghilangkan kerumitan pengelolaan infrastruktur dengan mengotomatiskan alur kerja pembelajaran mesin (ML). Ini mengatur tugas ke dalam Directed Acyclic Graph (DAG) yang terdiri dari komponen-komponen dalam container, memungkinkan tim untuk fokus pada pengembangan model daripada manajemen server.

Vertex AI Pipelines menggunakan pendekatan tanpa server untuk menangani beban kerja, mendelegasikan tugas pemrosesan intensif ke alat seperti BigQuery, Dataflow, dan Cloud Serverless untuk Apache Spark. Untuk komputasi Python dan ML terdistribusi, ini terintegrasi secara mulus dengan Ray di Vertex AI.

Platform ini mendukung node seri A3 dan A3 Mega yang dilengkapi dengan GPU NVIDIA H100/H200. Node A3 Mega, dilengkapi 8 GPU H100, menghadirkan bandwidth lintas node yang mengesankan sebesar 1.600 Gbps. Misalnya, Vectra menganalisis 300.000 panggilan pelanggan bulanan menggunakan Gemini dan Vertex AI, sehingga mencapai peningkatan kecepatan analisis sebesar 500%.

Efisiensi biaya dilengkapi dengan cache eksekusi, yang menggunakan kembali output untuk meminimalkan biaya. Metadata Vertex ML memastikan reproduktifitas dengan melacak silsilah artefak, parameter, dan metrik dalam skala besar. Desain skalabel ini terintegrasi dengan mudah dengan berbagai alat, menjadikannya solusi serbaguna untuk alur kerja ML.

SDK Google Cloud Pipeline Components (GCPC) menyederhanakan integrasi dengan menawarkan komponen bawaan yang menghubungkan layanan Vertex AI, seperti AutoML, tugas pelatihan khusus, dan penerapan model, langsung ke dalam pipeline.

Pengelolaan pipeline bersifat fleksibel, dengan opsi seperti Cloud Composer (Apache Airflow yang dikelola) dan pemicu Cloud Data Fusion untuk mengatur alur kerja di seluruh layanan. Koneksi asli ke BigQuery, Cloud Storage, dan Dataproc menyederhanakan pemrosesan data, sementara metadata dapat disinkronkan dengan Katalog Universal Dataplex untuk pelacakan silsilah lintas proyek. Selain itu, Model Garden menawarkan akses ke lebih dari 200 model, termasuk Google Gemini, Anthropic's Claude, dan Meta's Llama.

Definisi pipeline dikompilasi ke dalam format YAML standar, memastikan portabilitas di seluruh repositori seperti Artifact Registry.

Vertex AI Pipelines dirancang dengan mempertimbangkan tata kelola dan keamanan. Akun layanan memastikan bahwa setiap komponen beroperasi hanya dengan izin yang diperlukan. Kontrol Layanan VPC menetapkan perimeter aman, mencegah data sensitif - seperti set data pelatihan, model, dan hasil prediksi batch - meninggalkan batas jaringan.

Untuk organisasi dengan kebutuhan kepatuhan yang ketat, platform ini mendukung Kunci Enkripsi yang Dikelola Pelanggan (CMEK) selain enkripsi default Google Cloud saat tidak digunakan. Vertex ML Metadata menyediakan jejak audit mendetail dengan secara otomatis mencatat parameter, artefak, dan metrik dari setiap proses pipeline.

Fitur keamanan seperti Model Armor melindungi dari injeksi cepat dan penyelundupan data. Pipeline dapat dikonfigurasi untuk berjalan dalam jaringan VPC yang di-peering, dan Cloud Logging memungkinkan tim memantau peristiwa pipeline untuk mengetahui adanya anomali keamanan.

Vertex AI Pipelines beroperasi dengan model bayar sesuai pemakaian, dengan label penagihan otomatis diterapkan untuk pelacakan biaya melalui ekspor Cloud Billing ke BigQuery. Caching eksekusi semakin mengurangi biaya dengan menggunakan kembali keluaran.

Untuk menurunkan biaya pekerjaan pelatihan yang tahan terhadap gangguan, Spot VM tersedia dengan harga lebih murah. Untuk komitmen infrastruktur jangka panjang, Commited Use Discounts (CUDs) memberikan penghematan biaya dan jaminan kapasitas. Penjadwal Beban Kerja Dinamis (DWS) menawarkan kapasitas untuk beban kerja yang fleksibel dengan harga yang lebih rendah, sementara klaster pelatihan khusus memastikan kapasitas akselerator yang dicadangkan untuk pekerjaan skala besar.

IBM watsonx Orchestrate bertindak sebagai hub pusat, mengoordinasikan agen AI dengan berfungsi sebagai pengawas, router, dan perencana untuk alat khusus dan model landasan. Platform ini mendukung berbagai pendekatan orkestrasi: React untuk tugas eksplorasi, Plan-Act untuk alur kerja terstruktur, dan orkestrasi deterministik untuk proses bisnis yang dapat diprediksi.

Dirancang untuk operasi skala besar, watsonx Orchestrate menggunakan orkestrasi multi-agen untuk merutekan permintaan secara efisien ke alat yang sesuai dan model bahasa besar (LLM) secara real-time. Organisasi dapat memilih untuk menerapkan watsonx Orchestrate sebagai layanan terkelola di IBM Cloud atau AWS, atau menginstalnya secara lokal agar selaras dengan infrastruktur yang ada.

Platform ini telah memberikan hasil yang terukur. Misalnya, IBM menyelesaikan 94% dari 10 juta permintaan SDM tahunan secara instan melalui watsonx Orchestrate, sehingga memungkinkan tim SDM untuk fokus pada tugas-tugas yang bernilai lebih tinggi. Demikian pula, Dun & Bradstreet memangkas waktu pengadaan hingga 20% dengan evaluasi risiko pemasok berbasis AI, sehingga menghemat waktu evaluasi klien lebih dari 10%.

Untuk mendukung penerapan cepat, platform ini menyertakan Pembuat Agen tanpa kode dan Kit Pengembangan Agen (ADK) untuk membuat alat khusus berbasis Python. Selain itu, katalog yang berisi lebih dari 100 agen AI khusus domain dan lebih dari 400 alat siap pakai menawarkan komponen yang dapat diskalakan untuk memenuhi beragam kebutuhan operasional.

Skalabilitas ini memastikan kelancaran integrasi dengan sistem yang ada, sehingga dapat beradaptasi dengan berbagai lingkungan perusahaan.

AI Gateway pada platform ini memfasilitasi perutean yang mulus antara berbagai model dasar, termasuk IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral, dan Llama, sehingga membantu organisasi menghindari vendor lock-in. Agent Development Kit mendukung pembuatan alat kustom menggunakan spesifikasi OpenAPI untuk layanan web jarak jauh dan Python untuk fungsionalitas yang diperluas.

Integrasi dengan Langflow menambahkan antarmuka drag-and-drop visual untuk merancang aplikasi AI, yang kemudian dapat diimpor ke lingkungan Orchestrate. Selain itu, watsonx Orchestrate terhubung dengan mudah dengan sistem perusahaan seperti Salesforce, SAP, Workday, dan Microsoft 365, sehingga menghilangkan kebutuhan akan perubahan infrastruktur yang ekstensif.

Dengan AgentOps, platform memantau aktivitas agen AI dan menerapkan kebijakan real-time untuk memastikan keandalan dan kepatuhan. Pagar pembatas yang terpasang dan pengawasan terpusat membantu menjaga kepatuhan terhadap peraturan internal.

__XLATE_52__

"Dengan AgentOps, setiap tindakan dipantau dan diatur, memungkinkan anomali ditandai dan diperbaiki secara real-time." - Ruang Berita IBM

Integrasi IBM Guardium meningkatkan keamanan dengan mengidentifikasi penerapan AI yang tidak sah dan mengungkap kerentanan atau kesalahan konfigurasi. Platform ini juga menerapkan kontrol akses berbasis peran (RBAC), yang mencakup empat peran utama - Admin, Builder, Pengguna, dan Pakar Produk - untuk menjaga pengaturan lingkungan. Perusahaan yang menggunakan watsonx.governance telah melaporkan peningkatan ROI sebesar 30% dari inisiatif AI mereka.

Platform ini menawarkan harga yang fleksibel untuk memenuhi berbagai kebutuhan organisasi:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31 Januari 2026.

UiPath AI Center menyatukan agen AI, bot RPA, dan pekerja manusia dalam alur kerja perusahaan, menciptakan ekosistem terukur yang dirancang untuk memenuhi tuntutan tahun 2025. Pada intinya, platform ini memanfaatkan UiPath Maestro sebagai pusat kendali cerdas, yang mengelola proses jangka panjang di seluruh operasi bisnis yang rumit.

UiPath AI Center menawarkan dua opsi penerapan untuk memenuhi berbagai kebutuhan bisnis: Automation Cloud, yang menyediakan penskalaan elastis instan, dan Automation Suite, yang disesuaikan untuk penerapan di lokasi. Sistem MLOps-nya dilengkapi antarmuka drag-and-drop yang mudah digunakan untuk menyebarkan dan memantau model, memungkinkan mereka untuk melakukan penskalaan secara mulus pada jumlah robot yang tidak terbatas. Misalnya, SunExpress Airlines melaporkan penghematan lebih dari $200.000 sekaligus mengurangi simpanan selama dua bulan. Platform ini juga memastikan model tetap akurat melalui pelatihan ulang yang dilakukan secara terus-menerus, menjadikannya alat yang ampuh untuk mengintegrasikan AI di berbagai sistem.

Platform ini mengadopsi strategi "Bring Your Own Model" (BYOM), memungkinkan integrasi dengan kerangka kerja pihak ketiga seperti LangChain, Anthropic, dan Microsoft. Selain itu, Protokol Agent2Agent (A2A), yang dikembangkan melalui kerja sama dengan Google Cloud, memfasilitasi komunikasi yang lancar antara agen AI di seluruh platform perusahaan.

__XLATE_59__

Harrison Chase, CEO LangChain, berbagi: "Kolaborasi kami dengan UiPath pada Protokol Agen memastikan bahwa agen LangGraph dapat berpartisipasi dengan lancar dalam otomatisasi UiPath, memperluas jangkauan mereka dan memungkinkan pengembang membangun alur kerja lintas platform yang lebih kohesif."

UiPath AI Center terhubung ke ratusan aplikasi SaaS melalui API standar, mendukung BPMN 2.0 untuk pemodelan proses, dan menggunakan Decision Model and Notation (DMN) untuk mengelola aturan bisnis. Contoh penting adalah Heritage Bank, bank mutual terbesar di Australia, yang memanfaatkan AI Centre untuk mengotomatiskan proses peninjauan pinjamannya, meningkatkan pengalaman pelanggan sekaligus mengurangi tugas backend manual.

UiPath AI Center memprioritaskan tata kelola dan keamanan, menawarkan kontrol akses tingkat proyek dan penyewa untuk menjaga ketertelusuran dan kepatuhan. Fitur agensinya yang terkontrol memastikan agen AI tidak dapat melakukan tindakan yang tidak sah atau tidak aman secara mandiri.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

UiPath AI Center menggunakan model lisensi berbasis konsumsi menggunakan Unit AI, yang mengukur aktivitas seperti pelatihan model, hosting, dan prediksi. Ini terintegrasi secara mulus ke dalam sistem lisensi UiPath yang lebih luas melalui Unit Platform, yang mencakup kebutuhan orkestrasi dan eksekusi. Untuk membantu organisasi mengeksplorasi kemampuannya, uji coba gratis selama 60 hari tersedia untuk versi Automation Cloud dan Automation Suite, sehingga memudahkan untuk menilai nilainya sekaligus menjaga biaya tetap terkendali.

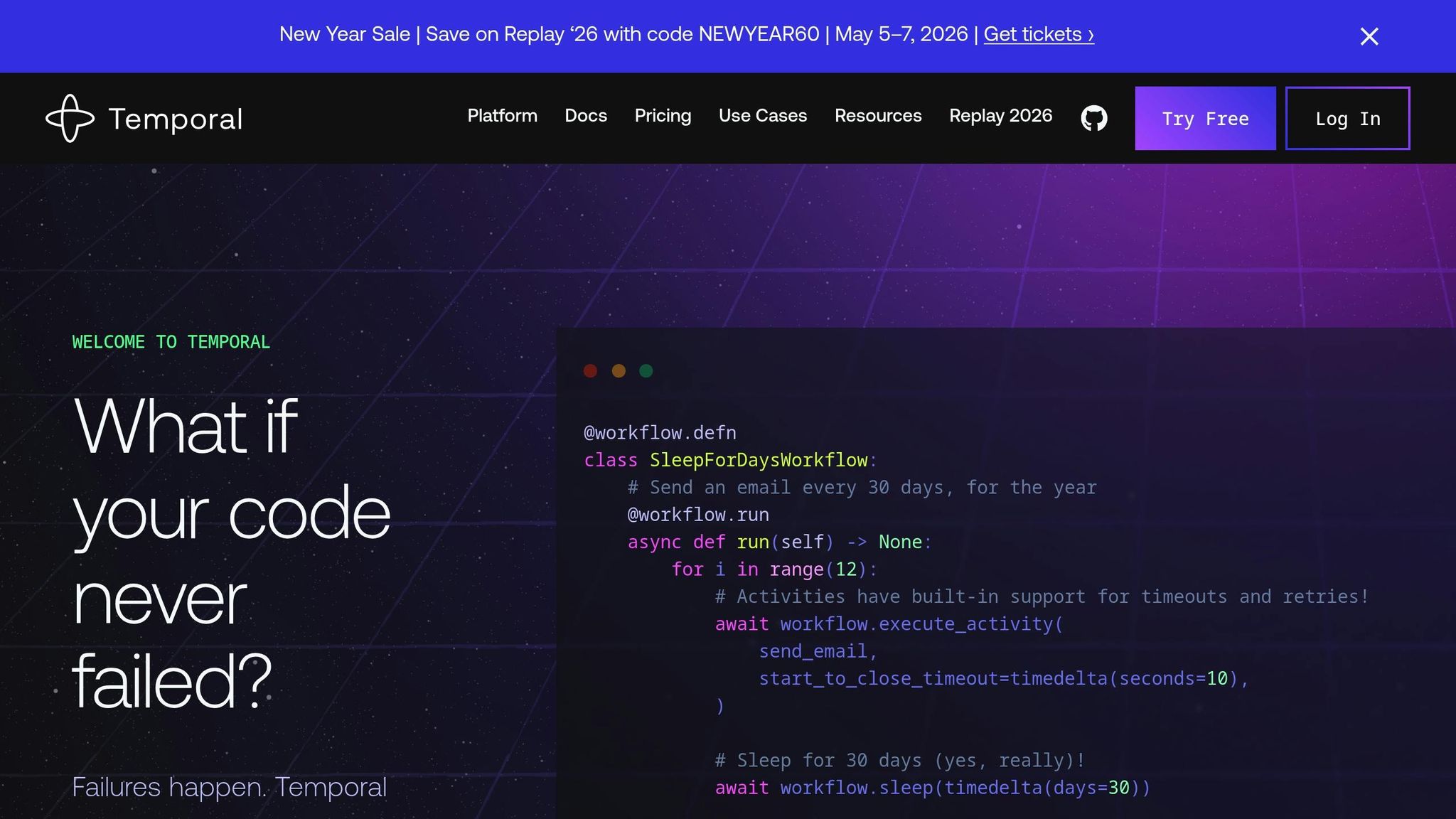

Temporal mengambil pendekatan unik dengan menggunakan kode yang tahan lama dan dapat dilanjutkan, alih-alih mengandalkan file konfigurasi. Ini menangkap setiap langkah alur kerja dalam Riwayat Peristiwa yang tidak dapat diubah, memastikan proses dapat melanjutkan tepat di tempat terakhirnya setelah gangguan. Contoh yang bagus dari hal ini adalah Replit, yang mentransisikan bidang kendali agen pengkodeannya ke Temporal, sehingga secara signifikan meningkatkan keandalan dan pengalaman pengguna.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, Manajer Produk, Retool

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Skalabilitas ini memastikan integrasi yang lancar dengan berbagai alat dan sistem.

Pengembang dapat menulis alur kerja sebagai kode dalam bahasa populer seperti Python, Go, Java, TypeScript, .NET, dan PHP. Temporal juga berintegrasi dengan mudah dengan kerangka kerja AI terkemuka, termasuk OpenAI Agents SDK, Pydantic AI, LangGraph, dan Crew AI. Dukungannya terhadap Model Context Protocol (MCP) meningkatkan keandalan agen. Observabilitas ditingkatkan melalui koneksi dengan alat pemantauan khusus AI seperti Langfuse. Misalnya, Gorgias memanfaatkan fleksibilitas ini untuk membantu lebih dari 15.000 merek e-niaga mengelola agen layanan pelanggan berbasis AI.

Riwayat Peristiwa Temporal memberikan jejak audit yang lengkap dan tidak dapat diubah dari setiap perubahan status dalam alur kerja AI. Fitur ini mendukung tata kelola human-in-the-loop, memungkinkan alur kerja berhenti sejenak untuk validasi eksternal sebelum menjalankan keputusan otonom. Perlindungan ini sangat berguna di lingkungan produksi untuk mencegah masalah seperti halusinasi LLM. Dalam penerapan Temporal Cloud, penyedia tidak dapat mengakses kode aplikasi, sedangkan opsi server sumber terbuka berlisensi MIT memungkinkan organisasi menghosting platform dalam infrastruktur aman mereka sendiri. Insinyur Netflix telah menyoroti bagaimana desain ini meminimalkan pemeliharaan dan menyederhanakan penanganan kegagalan.

Temporal Cloud beroperasi dengan model bayar sesuai penggunaan, sedangkan Server Temporal sumber terbuka dapat dihosting sendiri secara gratis. Pengguna baru dapat menjelajahi platform dengan kredit gratis senilai $1.000 untuk Temporal Cloud. Dengan menangguhkan alur kerja tanpa menggunakan sumber daya komputasi, pengguna dapat mengurangi biaya infrastruktur dan operasional secara signifikan. Desain Temporal tidak hanya meningkatkan efisiensi dan keandalan tetapi juga menjaga pengeluaran tetap terkendali seiring berkembangnya operasi AI.

Memilih platform orkestrasi AI yang ideal memerlukan keseimbangan fleksibilitas dan kemudahan penggunaan. Opsi sumber terbuka seperti Apache Airflow dan LangChain menawarkan independensi vendor dan penyesuaian mendalam, namun memerlukan keterampilan teknis tingkat lanjut dan konfigurasi manual untuk keamanan dan tata kelola. Di sisi lain, platform perusahaan seperti IBM watsonx Orchestrate dan UiPath menyertakan fitur bawaan seperti kontrol akses berbasis peran (RBAC), jalur audit, dan kepatuhan HIPAA, meskipun fitur tersebut dikenakan biaya lisensi dan fleksibilitas yang lebih rendah.

Strategi skalabilitas sangat bervariasi antar platform. Alat asli Kubernetes seperti Kubeflow dan Argo Workflows unggul dalam portabilitas dalam container, sementara penjadwalan berbasis grafik asiklik terarah (DAG) Apache Airflow efektif untuk mengelola dependensi kompleks dalam pengaturan hybrid dan multi-cloud. Temporal terkenal dengan throughputnya yang tinggi, sementara Azure Machine Learning dan Google Vertex AI Pipelines memanfaatkan ekosistem cloud induknya untuk mengalokasikan sumber daya secara dinamis selama permintaan puncak. Variasi ini menyoroti trade-off yang harus dipertimbangkan organisasi ketika mengevaluasi solusi.

Interoperabilitas adalah faktor penting lainnya untuk memastikan alur kerja terpadu. LangChain memungkinkan pengembang untuk menghubungkan beberapa model bahasa besar (LLM) dan API tanpa merombak sistem yang ada, dan Kubeflow mendukung kerangka kerja seperti PyTorch, TensorFlow, dan JAX dalam satu pipeline. Platform seperti Prompts.ai bertujuan untuk mengurangi fragmentasi dengan menyatukan beberapa model, sedangkan platform khusus vendor seperti Azure Machine Learning dan IBM watsonx Orchestrate menyediakan integrasi asli yang lancar namun mungkin memerlukan konektor tambahan untuk kompatibilitas yang lebih luas.

Pertukaran operasional juga memainkan peran penting dalam keputusan penerapan dan laba atas investasi (ROI). Tata kelola dan manajemen biaya adalah dua bidang yang platformnya berbeda secara signifikan. Solusi tingkat perusahaan seperti IBM watsonx Orchestrate dan UiPath menyediakan dasbor terpusat dan fitur keamanan yang kuat, sehingga cocok untuk industri yang diatur seperti layanan kesehatan dan keuangan. Sebaliknya, alat sumber terbuka sering kali memerlukan pengaturan manual untuk mencapai pengawasan yang sebanding. Dari sudut pandang biaya, meskipun Apache Airflow, LangChain, dan Kubeflow dapat diterapkan secara gratis, mereka dapat menimbulkan biaya tersembunyi terkait dengan waktu dan keahlian teknis. Temporal Cloud menawarkan harga bayar sesuai pemakaian dengan kredit gratis sebesar $1.000, sementara Prompts.ai secara signifikan mengurangi biaya perangkat lunak AI - hingga 98% - melalui sistem kredit TOKN terpadu yang menghilangkan biaya berulang.

Tabel di bawah ini memberikan perbandingan rinci setiap platform di seluruh dimensi operasional utama:

Memilih platform orkestrasi AI terbaik bergantung pada kemampuan teknis, kebutuhan kepatuhan, dan rencana pertumbuhan organisasi Anda. Opsi sumber terbuka seperti Apache Airflow dan LangChain menawarkan fleksibilitas tak tertandingi tanpa biaya lisensi, menjadikannya pilihan tepat bagi tim yang didorong oleh pengembang di perusahaan rintisan teknologi dan perusahaan berkembang pesat yang menghargai pengaturan modular. Namun, kerangka kerja ini memerlukan keterampilan teknik tingkat lanjut untuk mengonfigurasi fitur-fitur penting seperti keamanan, tata kelola, dan skalabilitas. Di sisi lain, platform perusahaan seperti IBM watsonx Orchestrate melayani industri seperti layanan kesehatan dan keuangan, di mana langkah-langkah kepatuhan bawaan – seperti kontrol akses berbasis peran, jalur audit, dan sertifikasi seperti HIPAA dan SOC 2 – tidak dapat dinegosiasikan. Platform ini sering kali menunjukkan keuntungan nyata dengan menyederhanakan alur kerja dan menghubungkan fitur tata kelola dengan peningkatan hasil bisnis.

Bagi perusahaan besar, platform yang mengutamakan tata kelola sangatlah penting, namun perusahaan skala menengah sering kali membutuhkan solusi yang menyeimbangkan biaya dan kinerja. Prompts.ai menyederhanakan persamaan ini dengan mengintegrasikan 35+ model ke dalam satu antarmuka, menawarkan kontrol FinOps real-time dan kredit TOKN bayar sesuai pemakaian untuk meminimalkan fragmentasi alat dan biaya tak terduga. Sementara itu, alat asli Kubernetes seperti Kubeflow Pipelines dan Argo Workflows unggul ketika portabilitas dan penerapan cloud hybrid menjadi hal yang penting, terutama bagi tim data science yang mengelola pipeline machine learning yang kompleks di seluruh sistem terdistribusi.

Seperti yang telah dibahas sebelumnya, kemunculan AI agen – di mana agen otonom berkolaborasi dalam penalaran multi-langkah – menyoroti semakin pentingnya orkestrasi yang lancar. Mengutip Domo:

__XLATE_78__

"Kesuksesan dalam AI bukan lagi tentang memiliki model sebanyak-banyaknya - namun tentang mengaturnya secara efektif".

Bagi organisasi-organisasi di AS, penting untuk memilih platform yang sesuai dengan kematangan teknis mereka saat ini, sekaligus memberikan ruang untuk berkembang seiring dengan semakin terintegrasinya AI di seluruh departemen. Titik awal yang cerdas adalah proyek percontohan yang berfokus pada alur kerja tertentu, melacak masukan, keluaran, dan kesalahan untuk menetapkan dasar observasi untuk penskalaan di masa mendatang. Platform orkestrasi yang tepat tidak hanya menghubungkan alat AI - platform ini mendefinisikan ulang cara tim berkolaborasi, memecahkan masalah, dan menciptakan nilai dalam skala yang lebih besar.

Platform orkestrasi AI menyederhanakan alur kerja yang rumit dengan menyatukan berbagai model AI, sumber data, dan proses ke dalam satu sistem otomatis. Mereka mengelola tugas-tugas seperti penjadwalan, distribusi sumber daya, dan integrasi API, meminimalkan upaya manual sekaligus mengurangi waktu pengembangan dan biaya operasional secara signifikan.

Platform-platform ini dibangun untuk berkembang dengan mudah, memungkinkan bisnis untuk berkembang dari menangani beberapa tugas menjadi mengelola ribuan tugas tanpa merombak infrastruktur mereka. Mereka unggul dalam memproses data dalam jumlah besar, menjadikan penggunaan sumber daya lebih efisien, dan menjaga pengawasan yang konsisten. Hal ini menghasilkan penerapan yang lebih cepat, peningkatan produktivitas, dan solusi AI yang lebih siap untuk memenuhi kebutuhan dinamis perusahaan.

Platform orkestrasi AI sering kali menangani pengeluaran melalui model penetapan harga berdasarkan penggunaan, sehingga memungkinkan bisnis hanya membayar untuk apa yang mereka gunakan alih-alih berkomitmen pada lisensi tetap. Banyak dari platform ini dilengkapi dengan alat keuangan real-time, termasuk dasbor untuk memantau pengeluaran berdasarkan model atau alur kerja, sistem peringatan anggaran, dan penandaan beban kerja untuk analisis biaya terperinci. Alat-alat ini memastikan bisnis memiliki pandangan yang jelas mengenai pengeluaran terkait AI dan mempertahankan kendali atas anggaran mereka.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai menetapkan standar untuk orkestrasi AI yang aman pada tahun 2025, menawarkan platform yang andal bagi bisnis untuk meningkatkan operasi AI mereka dengan mudah. Dasbor terpadunya dirancang untuk menyederhanakan manajemen, dilengkapi alat tata kelola bawaan, pelacakan biaya real-time, dan jalur audit yang tidak dapat diubah. Fitur-fitur ini memastikan bisnis tetap patuh sekaligus menjaga pengawasan penuh terhadap alur kerja AI mereka.

Dilengkapi dengan langkah-langkah keamanan tingkat perusahaan seperti kontrol akses berbasis peran, enkripsi ujung ke ujung, dan pemantauan kepatuhan berkelanjutan, Prompts.ai melindungi data sensitif di setiap tahap operasi. Dengan integrasi lebih dari 35 LLM terkemuka ke dalam satu kerangka kerja yang aman, hal ini mengurangi risiko dan memberdayakan bisnis untuk memperluas kemampuan AI mereka dengan percaya diri dan efisien.