AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Selami lebih dalam untuk menemukan kerangka kerja yang tepat untuk tim dan alur kerja Anda.

Prompts.ai berfungsi sebagai platform terpusat berbasis cloud yang menghubungkan pengguna perusahaan ke lebih dari 35 model AI terkemuka, termasuk GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro, dan Kling - semuanya dapat diakses melalui satu antarmuka. Tidak diperlukan instalasi perangkat lunak, sehingga memudahkan tim dengan ukuran berapa pun untuk memasukkan AI ke dalam alur kerja mereka.

Platform ini mengatasi tantangan besar dalam adopsi AI: perluasan alat. Dengan menyediakan lingkungan terpadu, ini menggabungkan pemilihan model, alur kerja yang cepat, dan pelacakan kinerja ke dalam satu sistem. Pendekatan ini mengubah penggunaan AI dari eksperimen yang tersebar dan hanya dilakukan satu kali menjadi proses yang konsisten dan terukur sehingga organisasi dapat diterapkan di seluruh departemen dengan mudah.

Prompts.ai berfokus pada otomatisasi alur kerja AI perusahaan, membantu organisasi mengurangi biaya yang tidak perlu sambil mengatasi masalah tata kelola. Dari perusahaan Fortune 500 hingga agensi kreatif dan laboratorium penelitian, pengguna dapat menciptakan alur kerja yang patuh dan dapat diaudit tanpa mempertaruhkan data sensitif terhadap beberapa layanan pihak ketiga.

Platform ini telah diakui oleh GenAI.Works sebagai solusi AI teratas untuk penyelesaian masalah dan otomatisasi perusahaan, dengan peringkat pengguna yang mengesankan sebesar 4,8 dari 5. Perusahaan mengandalkan Prompts.ai untuk tugas-tugas seperti menyederhanakan pembuatan konten, mengotomatiskan alur kerja strategis, dan mempercepat pengembangan proposal. Dalam beberapa kasus, proyek yang biasanya memakan waktu berminggu-minggu telah dikurangi menjadi hanya satu hari.

Contoh penting terjadi pada Mei 2025, ketika direktur AI lepas Johannes Vorillon menggunakan platform tersebut untuk mengintegrasikan animasi Google DeepMind Veo2 dengan lancar ke dalam video promosi untuk Breitling dan Angkatan Udara Prancis. Proyek ini menyoroti bagaimana Prompts.ai memungkinkan orkestrasi yang lancar pada beberapa alat AI.

Prompts.ai menyederhanakan cara tim bekerja dengan AI dengan mengintegrasikan akses ke 35+ bahasa dan model gambar melalui satu antarmuka. Hal ini menghilangkan kerumitan dalam mengelola beberapa langganan, kunci API, dan sistem penagihan. Pengguna dapat menggabungkan berbagai model untuk tugas tertentu dalam satu alur kerja, sehingga menciptakan alur orkestrasi yang lancar.

Platform ini beroperasi pada sistem kredit TOKN, yang menstandarkan penggunaan di semua model, sehingga memudahkan pelacakan biaya dan alokasi sumber daya. Tim dapat beralih antar model sesuai kebutuhan, berdasarkan persyaratan kinerja. Paket bisnis mencakup ruang kerja dan kolaborator tanpa batas, sehingga memudahkan organisasi untuk meningkatkan adopsi AI.

Dengan model penetapan harga bayar sesuai pemakaian, Prompts.ai menyelaraskan biaya dengan penggunaan sebenarnya, mulai dari $0/bulan untuk eksplorasi awal. Paket bisnis, mulai dari $99 hingga $129 per anggota setiap bulan, menawarkan berbagai tingkat kredit TOKN (250.000 hingga 1.000.000) dan penyimpanan cloud 10GB di semua tingkatan.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 Juni 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

Rencana bisnis (Core, Pro, dan Elite) mencakup alat untuk pemantauan kepatuhan dan administrasi tata kelola, menawarkan visibilitas penuh ke dalam interaksi AI dan mempertahankan jejak audit terperinci untuk memenuhi persyaratan peraturan. Bahkan tim yang lebih kecil dan profesional individu yang menggunakan paket Personal Creator dan Family akan mendapatkan manfaat dari fitur tata kelola tingkat perusahaan ini.

Data sensitif disimpan dalam lingkungan yang terpusat dan terkendali, sehingga mengurangi risiko yang terkait dengan penyebaran informasi ke berbagai layanan pihak ketiga. Arsitektur yang aman ini tidak hanya meminimalkan potensi kerentanan namun juga menyederhanakan manajemen kepatuhan untuk organisasi yang beroperasi berdasarkan peraturan yang ketat.

Didesain dengan arsitektur cloud-native, Prompts.ai memungkinkan organisasi untuk melakukan skala dengan mudah. Tim dapat menambah anggota baru, memperluas ruang kerja, dan mengakses model tambahan dalam hitungan menit, memastikan bahwa adopsi AI dapat tumbuh secepat yang diperlukan.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI menawarkan solusi otomatisasi alur kerja yang didukung oleh antarmuka percakapan. Meskipun detail spesifik tentang arsitektur penerapan dan metode orkestrasinya tidak tersedia untuk umum, penekanannya pada antarmuka percakapan menyoroti sudut pandang unik dalam menyederhanakan otomatisasi alur kerja.

IBM watsonx Orchestrate menghadirkan otomatisasi berbasis AI pada operasional perusahaan, dengan fokus menjadikan otomatisasi dapat diakses oleh para profesional bisnis, bukan hanya pengembang. Dengan memungkinkan pengguna mengeluarkan perintah bahasa alami, platform ini menyederhanakan tugas-tugas kompleks untuk tim non-teknis di bidang SDM, keuangan, penjualan, dukungan pelanggan, dan pengadaan. Pendekatan ini menghilangkan kebutuhan akan keahlian pengkodean, memberdayakan tim bisnis untuk mengotomatisasi proses secara mandiri.

Platform ini unggul dalam mengotomatiskan tugas berulang yang sering kali menghabiskan waktu karyawan. Dengan perintah bahasa sederhana, pengguna dapat memulai alur kerja untuk tugas-tugas seperti menjadwalkan wawancara, merangkum profil kandidat, memproses pinjaman, dan membuat laporan. watsonx Orchestrate menangani aktivitas ini di berbagai sistem backend sambil mematuhi standar keamanan tingkat perusahaan.

Misalnya, sebuah lembaga keuangan besar menerapkan watsonx Orchestrate untuk menyederhanakan dukungan pelanggan dan fungsi back-office. Karyawan menggunakan masukan bahasa alami untuk mengotomatisasi alur kerja untuk pemrosesan pinjaman dan permintaan layanan. Platform ini terintegrasi secara mulus dengan sistem backend, menjaga kepatuhan melalui tata kelola bawaan, dan memberikan peningkatan nyata: waktu pemrosesan lebih cepat, kesalahan manual lebih sedikit, dan kepuasan pelanggan lebih tinggi. Contoh ini menyoroti kemampuan platform untuk mengubah tugas rutin perusahaan menjadi proses yang efisien dan otomatis.

IBM watsonx Orchestrate menawarkan opsi penerapan cloud hibrid, yang memungkinkan alur kerja dijalankan di cloud, on-premise, atau di keduanya. Fleksibilitas ini sangat berharga bagi organisasi dengan kebijakan residensi data yang ketat atau infrastruktur lama. Platform ini memanfaatkan Model Bahasa Besar (LLM), API, dan aplikasi perusahaan untuk menjalankan tugas dengan aman, memastikan kompatibilitas dengan berbagai lingkungan operasional.

watsonx Orchestrate berintegrasi secara mulus dengan beragam sistem, menjadikannya solusi tangguh untuk otomatisasi perusahaan. Ini terhubung ke CRM, ERP, dan platform cloud seperti AWS dan Azure menggunakan konektor visual dan API. Selain itu, ia bekerja erat dengan layanan IBM Watson dan model AI IBM lainnya, sehingga memperluas kemampuannya melampaui otomatisasi alur kerja dasar. Untuk pengguna tingkat lanjut, akses API terprogram memungkinkan penyesuaian dan integrasi lebih lanjut dengan alat yang ada.

__XLATE_18__

“IBM watsonx Orchestrate dirancang untuk menghadirkan otomatisasi bertenaga AI langsung ke dalam alur kerja bisnis. Tidak seperti alat yang berpusat pada pengembang, watsonx Orchestrate menargetkan para profesional di bidang SDM, keuangan, penjualan, dan dukungan pelanggan yang ingin menyederhanakan tugas tanpa coding yang berat.” - Domo

Platform ini juga mencakup aplikasi AI bawaan dan keahlian khusus industri, sehingga memungkinkan penerapan yang lebih cepat untuk kasus penggunaan umum. Namun, organisasi harus memperhatikan bahwa fungsinya mungkin lebih terbatas di luar ekosistem IBM dibandingkan dengan platform dengan opsi integrasi yang lebih luas.

IBM watsonx Orchestrate menonjol karena kerangka tata kelolanya yang kuat, menjadikannya pilihan utama bagi industri yang diatur. Kontrol akses berbasis peran memastikan bahwa akses data dibatasi untuk pengguna yang berwenang dan fungsi tertentu.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

Dirancang untuk menjangkau seluruh lingkungan hibrid, watsonx Orchestrate mendukung tim kecil dan perusahaan besar. Hal ini meningkatkan efisiensi operasional, memastikan kepatuhan kebijakan, memitigasi risiko, dan meningkatkan produktivitas karyawan. Organisasi dapat memulai dari yang kecil – dengan fokus pada departemen tertentu – dan secara bertahap memperluas kemampuan otomatisasi seiring mereka melihat hasil dan mengembangkan keahlian internal.

Apache Airflow adalah platform sumber terbuka yang dibangun untuk mengatur alur kerja data yang kompleks menggunakan grafik asiklik terarah (DAG). Awalnya dikembangkan oleh Airbnb dan sekarang di bawah Apache Software Foundation, ini telah menjadi pilihan populer untuk penjadwalan, pemantauan, dan pengelolaan saluran data. Tidak seperti alat otomatisasi yang dirancang untuk pengguna bisnis, Airflow dirancang dengan mempertimbangkan insinyur dan pengembang data, menawarkan kontrol terprogram atas eksekusi alur kerja.

Airflow unggul dalam mengelola jalur data yang melibatkan ketergantungan rumit, tugas terjadwal, dan logika transformasi. Tim data mengandalkannya untuk berbagai tujuan, termasuk mengoordinasikan proses ETL (Ekstrak, Transformasi, Muat), melatih model pembelajaran mesin, menjalankan tugas pemrosesan batch, menyerap data dari berbagai sumber, mengubah kumpulan data, dan membuat laporan sesuai jadwal. Dengan mendefinisikan alur kerja dengan Python, pengembang mendapatkan fleksibilitas luas untuk mengimplementasikan logika khusus dan menangani kesalahan secara efektif.

Platform ini mencakup antarmuka visual yang memberikan wawasan tentang status alur kerja, ketergantungan tugas, dan riwayat eksekusi. Hal ini memudahkan untuk memantau kinerja dan memecahkan masalah kegagalan. Misalnya, jika suatu tugas gagal, Airflow dapat mencobanya lagi secara otomatis, mengirim peringatan, atau melewati tugas berikutnya untuk mencegah masalah berjenjang. Fungsionalitas ini menjadikannya pilihan serbaguna untuk berbagai kebutuhan penerapan.

Airflow dapat diterapkan sebagai pengaturan server tunggal atau diskalakan ke kluster terdistribusi, tempat penjadwal, pekerja, dan server web beroperasi pada mesin terpisah. Arsitekturnya terdiri dari beberapa komponen utama: penjadwal yang memicu tugas berdasarkan jadwal yang ditentukan, pekerja yang menjalankan tugas, server web untuk antarmuka pengguna, dan database metadata yang menyimpan definisi alur kerja dan riwayat eksekusi.

Desain modular ini memungkinkan organisasi untuk meningkatkan kapasitas pekerja secara mandiri, bergantung pada tuntutan beban kerja. Di lingkungan cloud-native, Kubernetes sering digunakan untuk menerapkan Airflow, dengan KubernetesExecutor membuat pod terisolasi untuk tugas-tugas individual. Penyiapan ini meningkatkan isolasi sumber daya dan memungkinkan tim mengalokasikan sumber daya komputasi tertentu untuk setiap tugas. Bagi mereka yang ingin mengurangi overhead manajemen infrastruktur, tersedia layanan Managed Airflow, meskipun layanan ini memerlukan biaya operasional tambahan.

Kemampuan integrasi Airflow yang luas membuatnya sangat mudah beradaptasi. Ia menawarkan konektor siap pakai untuk database, platform cloud, gudang data, dan sistem pesan, serta kemampuan untuk membuat operator khusus menggunakan Python. Fleksibilitas ini memastikan Airflow dapat memenuhi beragam kebutuhan organisasi.

Ekosistem perpustakaan Python yang kaya juga dapat dimanfaatkan dalam alur kerja, memungkinkan transformasi dan analisis data tingkat lanjut secara langsung dalam definisi saluran. Untuk aplikasi AI dan pembelajaran mesin, Airflow terintegrasi secara mulus dengan kerangka kerja seperti TensorFlow, PyTorch, dan scikit-learn. Integrasi ini membantu data scientist mengatur alur kerja untuk tugas-tugas seperti mengambil data, fitur pra-pemrosesan, melatih model, mengevaluasi performa, dan menerapkan model ke produksi.

Airflow mencakup kontrol akses berbasis peran (RBAC) untuk mengelola izin pengguna di seluruh alur kerja dan fungsi administratif. Administrator dapat menentukan peran dengan hak istimewa tertentu, memastikan bahwa hanya pengguna resmi yang dapat melihat, mengedit, atau menjalankan DAG tertentu. Kontrol granular ini membantu menjaga integritas alur kerja dan mencegah perubahan yang tidak sah.

Opsi autentikasi mencakup login berbasis kata sandi, integrasi LDAP, dan penyedia OAuth. Kredensial sensitif dikelola secara terpisah melalui koneksi dan sistem variabel Airflow. Untuk meningkatkan keamanan, alat manajemen rahasia eksternal seperti HashiCorp Vault atau AWS Secrets Manager dapat diintegrasikan.

Pencatatan audit adalah fitur utama lainnya, melacak tindakan pengguna dan eksekusi alur kerja. Hal ini menciptakan catatan aktivitas yang terperinci, yang sangat berharga untuk tujuan kepatuhan dan pemecahan masalah.

Aliran udara berskala secara horizontal dengan menambahkan lebih banyak node pekerja untuk menangani peningkatan beban kerja. Platform ini mendukung beberapa jenis eksekutor untuk mendistribusikan tugas secara efektif: LocalExecutor menjalankan tugas pada mesin yang sama dengan penjadwal, CeleryExecutor menyebarkan tugas ke beberapa mesin pekerja menggunakan antrian pesan, dan KubernetesExecutor menjalankan pod terisolasi untuk setiap tugas.

Untuk mengoptimalkan kinerja, desain DAG dan alokasi sumber daya yang cermat sangatlah penting. Volume tugas yang tinggi dapat membebani penjadwal, sehingga tim sering kali membagi DAG yang besar, menyesuaikan pengaturan penjadwal, dan memastikan penyimpanan metadata memiliki sumber daya yang memadai.

Airflow juga menangani pengisian ulang secara efisien, memungkinkan tim memproses ulang data historis ketika logika alur kerja berubah. Meskipun pengisian ulang menyederhanakan pembaruan, hal ini dapat menghabiskan sumber daya komputasi yang signifikan, sehingga memerlukan perencanaan yang cermat untuk menghindari gangguan pada beban kerja produksi.

Menjadi sumber terbuka, Airflow memberi organisasi kendali penuh atas penerapannya. Namun, hal ini juga berarti mereka harus mengelola infrastruktur, pemantauan, dan peningkatan, yang memerlukan sumber daya teknik khusus untuk menjaga keandalan dan kinerja dalam skala besar.

Kubeflow menonjol sebagai platform khusus untuk mengelola alur kerja pembelajaran mesin, berbeda dari alat alur kerja yang bertujuan umum. Dirancang khusus untuk Kubernetes, solusi sumber terbuka ini mendukung siklus hidup pembelajaran mesin secara penuh, memberikan para data scientist dan teknisi ML alat yang mereka perlukan untuk membangun, menerapkan, dan mengelola model siap produksi menggunakan kemampuan asli Kubernetes.

Kubeflow dirancang untuk mengatur alur kerja pembelajaran mesin yang lengkap dalam lingkungan Kubernetes. Ini mencakup setiap tahap siklus hidup ML, termasuk prapemrosesan data, rekayasa fitur, pelatihan model, validasi, penerapan, dan pemantauan. Dengan memungkinkan tim membuat pipeline modular dan dapat digunakan kembali, Kubeflow menyederhanakan pengelolaan beban kerja ML terdistribusi. Pendekatan terpusatnya juga membantu pelacakan eksperimen dan pengawasan model di berbagai proyek. Selain itu, Kubeflow dapat mengotomatiskan alur kerja pelatihan ulang ketika data baru diperkenalkan, memastikan model tetap diperbarui dan relevan.

Dibangun di Kubernetes, Kubeflow memanfaatkan orkestrasi container, penskalaan dinamis, dan manajemen sumber daya untuk mengoptimalkan alur kerja ML. Pengguna dapat berinteraksi dengan platform melalui antarmuka berbasis web untuk manajemen visual atau antarmuka baris perintah untuk otomatisasi. Bergantung pada beban kerja, Kubeflow secara dinamis mengalokasikan sumber daya - seperti penyediaan GPU untuk tugas pelatihan dan CPU untuk inferensi. Fleksibilitasnya memungkinkan penerapan pada klaster Kubernetes mana pun, baik on-premise, cloud, atau hybrid, sehingga memastikan kemampuan beradaptasi di seluruh lingkungan.

Kubeflow terintegrasi secara mulus dengan framework machine learning populer seperti TensorFlow, PyTorch, dan XGBoost, sekaligus mendukung framework kustom melalui desainnya yang dapat diperluas. Di luar kerangka kerja ML, ia terhubung dengan berbagai layanan cloud dan solusi penyimpanan, memungkinkan pipeline mengakses penyimpanan objek untuk data, gudang data untuk pengambilan fitur, dan alat pemantauan untuk melacak kinerja. Kompatibilitasnya dengan pustaka Python semakin menyederhanakan transisi dari eksperimen ke produksi.

Kubeflow menggunakan kemampuan penskalaan bawaan Kubernetes untuk mendistribusikan beban kerja ke seluruh sumber daya klaster, sehingga cocok untuk pelatihan skala besar dan tugas pemrosesan data. Hal ini memastikan pemanfaatan sumber daya yang efisien dan mendukung operasi ML berkinerja tinggi. Seperti yang dengan tepat dinyatakan Akka:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Dengan kemampuannya mengalokasikan sumber daya secara mandiri, Kubeflow menjembatani kesenjangan antara eksperimen dan produksi, sehingga memberikan fleksibilitas dan kinerja.

Flyte adalah platform orkestrasi cloud-native yang dirancang untuk menyederhanakan pengelolaan alur kerja pembelajaran mesin (ML) dalam container menggunakan Kubernetes. Hal ini menghilangkan kompleksitas penerapan pipeline ML dengan mendistribusikan sumber daya secara efisien di seluruh lingkungan cloud. Pendekatan ini memastikan penskalaan yang lancar dan kinerja yang konsisten, berapa pun ukuran penerapannya.

Flyte dibuat untuk menangani alur kerja ML dalam skala apa pun, mengalokasikan sumber daya secara dinamis untuk memenuhi berbagai permintaan. Arsitekturnya yang kuat memastikan beban kerja dikelola secara efisien, menjadikannya pilihan yang andal untuk berbagai tugas ML di seluruh infrastruktur berbasis cloud.

Prefect adalah platform orkestrasi berbasis Python yang dirancang untuk membuat pengelolaan pipeline data yang kompleks dan alur kerja pembelajaran mesin menjadi lebih sederhana. Hal ini berfokus pada kemudahan penggunaan, pemantauan yang jelas, dan meminimalkan hambatan operasional, sehingga ilmuwan dan insinyur data dapat berkonsentrasi dalam menciptakan alur kerja dibandingkan mengkhawatirkan infrastruktur.

Prefek unggul dalam mengotomatisasi alur pembelajaran mesin, alur kerja cloud, dan proses transformasi data. Ini sangat cocok untuk menangani tugas ETL dan alur kerja pembelajaran mesin rumit yang melibatkan banyak ketergantungan, eksekusi paralel, dan pemrosesan waktu nyata. Sistem penjadwalannya yang fleksibel memungkinkan tugas dipicu berdasarkan interval waktu, peristiwa tertentu, atau panggilan API, sehingga dapat disesuaikan dengan berbagai kebutuhan otomatisasi.

Prefek dioptimalkan untuk lingkungan cloud, memastikannya dapat berkembang dan beradaptasi dengan tuntutan infrastruktur modern. Dibangun secara asli dengan Python, ini terintegrasi secara mulus dengan ekosistem data berbasis Python, sehingga menghilangkan kebutuhan untuk mempelajari bahasa atau alat pemrograman baru.

Prefek menawarkan kompatibilitas sempurna dengan berbagai alat dan platform data. Ini terintegrasi dengan mudah dengan alat populer seperti dbt, PostgreSQL, Snowflake, dan Looker, sekaligus mendukung sistem real-time seperti Apache Kafka. Untuk lingkungan cloud, ini bekerja sama dengan penyedia besar seperti Amazon Web Services (AWS), Google Cloud Platform (GCP), dan Microsoft Azure, sehingga memberikan fleksibilitas kepada tim untuk mengoptimalkan beban kerja berdasarkan biaya dan performa. Selain itu, Prefect mendukung alat containerisasi seperti Docker dan Kubernetes dan bekerja dengan kerangka pemrosesan terdistribusi seperti Dask dan Apache Spark. Agar tim selalu mendapatkan informasi, ia juga menyediakan notifikasi Slack untuk pembaruan alur kerja.

Prefek dibangun untuk menangani pertumbuhan volume data dan peningkatan kompleksitas alur kerja dengan mudah. Mesinnya yang toleran terhadap kesalahan memastikan alur kerja dapat pulih dari kesalahan dengan mencoba kembali tugas yang gagal atau melewati masalah, menjadikannya sangat andal di lingkungan produksi. Pemantauan real-time menawarkan wawasan mendetail tentang eksekusi alur kerja, membantu tim mengidentifikasi dan menyelesaikan masalah dengan cepat. Dengan kemampuannya untuk melakukan penskalaan secara efisien, Prefect dipercaya oleh perusahaan teknologi besar untuk mengelola alur kerja yang dinamis. Untuk tim yang baru memulai, Prefek menawarkan paket gratis, sementara harga khusus tersedia untuk penerapan lebih besar yang memerlukan fitur dan dukungan tambahan.

Metaflow adalah platform infrastruktur pembelajaran mesin yang awalnya dikembangkan oleh Netflix untuk mengatasi tantangan penskalaan alur kerja pembelajaran mesin. Hal ini berfokus pada pembuatan proses yang mudah digunakan dan efisien, membantu ilmuwan data berpindah dengan lancar dari prototipe ke produksi tanpa harus berurusan dengan infrastruktur yang rumit.

Metaflow dibuat untuk mengelola alur kerja pembelajaran mesin tingkat produksi yang skalabel. Ini menyederhanakan perjalanan dari analisis data eksplorasi dan pelatihan model hingga penerapan. Ilmuwan data dapat menulis alur kerja dengan Python menggunakan pustaka yang sudah dikenal, sementara platform menangani pembuatan versi, manajemen ketergantungan, dan mengalokasikan sumber daya komputasi secara otomatis.

Platform ini menghilangkan kebutuhan akan manajemen infrastruktur manual dengan secara otomatis menyediakan sumber daya komputasi yang diperlukan. Hal ini memungkinkan peralihan yang mulus dari pengembangan lokal ke produksi cloud tanpa memerlukan modifikasi kode apa pun.

__XLATE_53__

"Metaflow mengatur alur kerja ML yang dapat diskalakan dengan kesederhanaan dengan menawarkan integrasi cloud yang disederhanakan, pembuatan versi yang kuat, dan abstraksi infrastruktur untuk penerapan siap produksi." - Akka.io

Proses penerapan Metaflow dilengkapi dengan kemampuannya untuk berintegrasi dengan mudah dengan layanan cloud dan platform data. Desain asli Python memastikan kompatibilitas dengan perpustakaan yang banyak digunakan untuk pembelajaran mesin, pemrosesan data, dan visualisasi, memungkinkan tim untuk memaksimalkan alat yang sudah mereka andalkan.

Awalnya dibuat oleh Netflix untuk mendukung operasi pembelajaran mesin yang ekstensif, Metaflow memiliki sistem versi yang kuat. Sistem ini melacak eksperimen, kumpulan data, dan versi model, memastikan eksperimen dapat direproduksi dan memungkinkan rollback yang mudah bila diperlukan.

Dagster menambah jajaran kerangka kerja orkestrasi dengan berfokus pada menjaga integritas data sambil menawarkan manajemen saluran yang dapat disesuaikan. Alat sumber terbuka ini dibuat untuk meningkatkan kualitas, melacak silsilah data, dan memastikan visibilitas dalam alur kerja pembelajaran mesin (ML). Pada intinya, Dagster berspesialisasi dalam membangun saluran data yang aman dan andal yang menjunjung standar integritas data yang tinggi dan memberikan wawasan yang jelas tentang transformasi.

Dagster sangat efektif untuk mengelola alur kerja ML di mana kualitas dan presisi data tidak dapat dinegosiasikan. Ini dirancang untuk tim yang memerlukan validasi bawaan, pelacakan metadata yang kuat, dan kemampuan observasi yang komprehensif di seluruh proses mereka. Contoh praktis dari kegunaannya dapat dilihat di sektor layanan kesehatan, di mana organisasi mengandalkan Dagster untuk memproses data layanan kesehatan sensitif dengan tingkat integritas yang diperlukan untuk memenuhi standar kepatuhan dan kualitas yang ketat.

Dagster memungkinkan pengembang untuk menentukan alur kerja yang rumit secara langsung dalam kode, sebuah fitur penting untuk menskalakan operasi AI. Struktur modularnya mendukung model rantai dan agen untuk menciptakan alur kerja tingkat lanjut, lengkap dengan manajemen ketergantungan otomatis, mekanisme percobaan ulang, dan eksekusi paralel. Selain itu, Dagster terintegrasi secara mulus dengan berbagai platform cloud, API, dan database vektor, sehingga cocok untuk menangani data berskala besar dan tugas AI.

Arsitektur fleksibel ini memastikan integrasi yang lancar dengan beragam sistem.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen adalah kerangka kerja sumber terbuka yang dikembangkan oleh Microsoft Research yang memungkinkan beberapa agen AI berkolaborasi melalui percakapan untuk menangani tugas-tugas kompleks. Sistem ini memungkinkan pengembang untuk membuat aplikasi di mana agen khusus bekerja sama, masing-masing menyumbangkan keahlian uniknya untuk mencapai tujuan bersama. Dengan memperkenalkan antarmuka percakapan, AutoGen menyederhanakan proses koordinasi beberapa komponen AI yang seringkali rumit.

AutoGen memperkenalkan pendekatan baru terhadap orkestrasi multi-agen dengan memanfaatkan dialog sebagai sarana kolaborasi. Kerangka kerja ini sangat efektif dalam skenario pemecahan masalah yang memerlukan banyak agen untuk bekerja sama secara dinamis. Misalnya, dalam pengembangan perangkat lunak, satu agen mungkin menghasilkan kode sementara agen lain berfokus pada pengujian dan validasi, dengan kedua agen melakukan iterasi untuk menyempurnakan keluarannya. Model percakapan ini cocok untuk tugas-tugas seperti mengotomatiskan alur kerja perangkat lunak, membantu penelitian, dan menangani proses pengambilan keputusan yang kompleks di mana beragam perspektif atau keterampilan dapat meningkatkan hasil.

Tim yang menginginkan peningkatan berulang dalam alur kerja mereka menganggap AutoGen sangat menarik. Kemampuannya untuk memfasilitasi pertukaran bolak-balik antar agen mencerminkan kolaborasi manusia, sehingga memudahkan pengembang untuk merancang sistem yang berkembang dan ditingkatkan melalui dialog dan umpan balik yang berkelanjutan.

AutoGen menekankan modularitas sambil menonjol karena desain agen percakapannya. Setiap agen beroperasi dengan peran dan instruksi tertentu, yang dapat mencakup akses ke alat, API eksternal, atau model bahasa. Kerangka kerja ini mendukung agen otonom dan agen proxy pengguna yang menggabungkan masukan manusia, sehingga menawarkan fleksibilitas dalam mengelola alur kerja.

Sistem dapat berjalan secara lokal selama pengembangan dan menskalakan ke lingkungan cloud untuk produksi. Pengembang dapat menentukan cara agen berinteraksi - baik melalui alur kerja berurutan di mana agen bergiliran atau pola yang lebih rumit di mana beberapa agen berkontribusi secara bersamaan. Dengan menggunakan konfigurasi berbasis Python, tim mendapatkan kontrol penuh atas logika orkestrasi tanpa mengorbankan keterbacaan, sehingga menyederhanakan proses pengelolaan interaksi multi-agen.

AutoGen menangani kompleksitas pengelolaan beberapa panggilan model dan percakapan agen, memungkinkan pengembang untuk fokus menyusun logika dan perilaku sistem mereka daripada mengkhawatirkan infrastruktur.

AutoGen terintegrasi secara mulus dengan Azure OpenAI Service dan model lainnya melalui panggilan fungsi, memberikan fleksibilitas kepada pengembang dalam memilih backend AI. Ini juga mendukung menghubungkan agen ke alat dan layanan eksternal, memungkinkan mereka mengambil data, mengeksekusi kode, atau berinteraksi dengan API pihak ketiga selama percakapan mereka.

Kerangka kerja ini memungkinkan pengembang membuat jenis agen khusus, pola percakapan yang dapat digunakan kembali, dan templat orkestrasi. Fleksibilitas ini berarti tim dapat memanfaatkan pola yang sudah ada untuk tugas-tugas umum sambil melakukan penyesuaian mendalam untuk kebutuhan khusus.

Untuk organisasi yang sudah menggunakan alat Microsoft, AutoGen menyediakan integrasi yang mudah dengan layanan Azure, Visual Studio Code, dan platform pengembangan lainnya. Meskipun selaras dengan ekosistem Microsoft, kerangka kerja ini bersifat platform-agnostik dan berfungsi dengan baik di berbagai lingkungan teknologi.

AutoGen sangat menekankan pada pengendalian kemampuan agen dan mengelola akses ke sumber daya eksternal. Pengembang menentukan izin khusus untuk setiap agen, seperti API mana yang dapat mereka akses atau data apa yang boleh diambil. Pendekatan terperinci ini memastikan agen beroperasi berdasarkan prinsip hak istimewa paling rendah, hanya melakukan tugas yang diperlukan untuk peran mereka.

Sifat percakapan dari kerangka kerja ini secara inheren menciptakan jejak audit, interaksi agen pencatatan, dan proses pengambilan keputusan. Log ini memberikan transparansi tentang bagaimana keluaran dihasilkan, membantu upaya kepatuhan dan debugging. Tim dapat meninjau catatan ini untuk menganalisis perilaku agen dan mengidentifikasi area yang perlu diperbaiki.

Kemampuan human-in-the-loop meningkatkan pengawasan dengan memungkinkan alur kerja berhenti sejenak untuk ditinjau oleh manusia pada titik keputusan penting. Fitur ini memastikan tindakan sensitif dapat dievaluasi sebelum melanjutkan, menyeimbangkan efisiensi otomatisasi dengan tata kelola dan kontrol.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

Organisasi dapat meningkatkan kinerja dengan menyimpan konteks percakapan dalam cache, menggunakan model yang lebih cepat untuk tugas-tugas rutin, dan menggunakan model yang lebih canggih untuk penalaran yang kompleks. Merancang pola percakapan untuk meminimalkan pertukaran yang tidak perlu juga meningkatkan efisiensi. Jika diperlukan, kerangka kerja ini mendukung eksekusi agen paralel, memungkinkan tugas independen dijalankan secara bersamaan, bukan secara berurutan.

Untuk menangani beban kerja yang tinggi, AutoGen dapat diterapkan pada infrastruktur cloud penskalaan otomatis, memastikan sistem dapat mengelola berbagai permintaan sekaligus menjaga biaya tetap terkendali. Interaksi agen tanpa kewarganegaraan menyederhanakan penskalaan horizontal, meskipun mempertahankan konteks di seluruh bursa memerlukan perencanaan arsitektur yang matang.

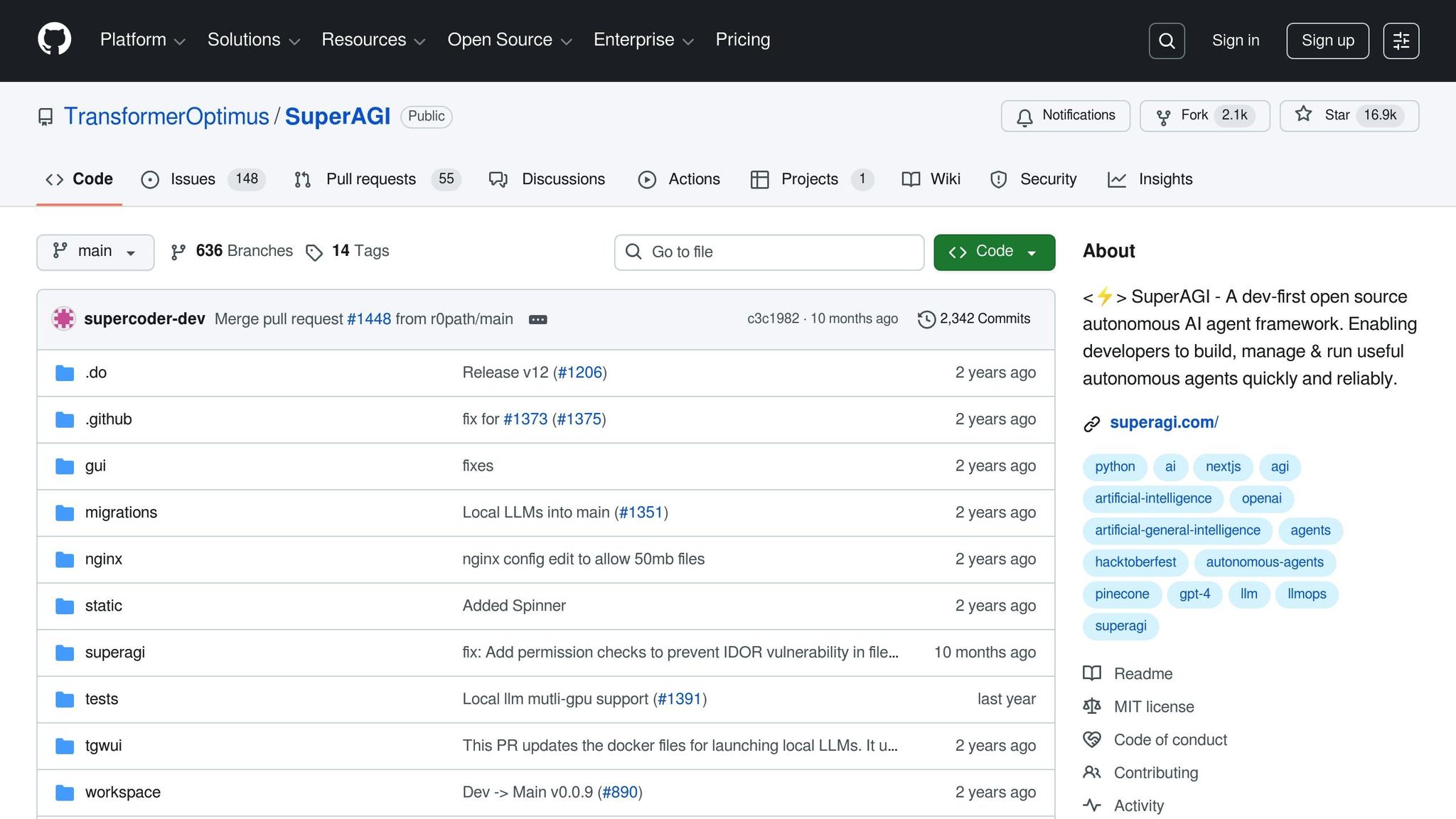

Berdasarkan kerangka orkestrasi yang telah kami jelajahi, SuperAGI memperkenalkan cara baru untuk mengelola kolaborasi multi-agen. Platform sumber terbuka ini dirancang untuk mengoordinasikan agen AI otonom, memberdayakan pengembang untuk membuat, menerapkan, dan mengawasi agen yang dapat merencanakan, melaksanakan, dan beradaptasi terhadap tugas melalui pembelajaran berkelanjutan. SuperAGI memungkinkan banyak agen untuk bekerja sama dengan lancar, mendelegasikan tugas secara dinamis, dan berkolaborasi untuk mengatasi tantangan yang kompleks. Ini menggabungkan manajemen tugas adaptif dengan kerja tim multi-agen, menjadikannya alat yang ampuh untuk orkestrasi AI tingkat lanjut.

SuperAGI unggul dalam mengotomatiskan tugas-tugas rumit dan berkembang untuk perusahaan. Jaringan agennya unggul dalam perencanaan dan pelaksanaan tugas tingkat lanjut, yang terus ditingkatkan melalui pembelajaran penguatan dan putaran umpan balik. Hal ini membuatnya sangat berguna bagi organisasi yang menangani operasi skala besar, dimana koordinasi cerdas adalah kuncinya. Agen dalam platform belajar dari interaksi dan hasil mereka, sehingga memungkinkan mereka menyempurnakan perilaku mereka seiring waktu.

Fitur menonjol dari platform ini adalah delegasi tugas dinamisnya. Daripada terpaku pada alur kerja yang kaku, agen mengevaluasi situasi secara real-time, mengidentifikasi tugas-tugas prioritas, dan menugaskannya ke anggota jaringan yang paling sesuai. Fleksibilitas ini memastikan sumber daya dialokasikan secara efisien, bahkan dalam skenario yang kompleks.

Arsitektur SuperAGI dirancang dengan skalabilitas dan modularitas sebagai intinya. Pengembang dapat dengan mudah memperluas jaringan agen dan beban kerja untuk memenuhi berbagai kebutuhan aplikasi. Setiap agen beroperasi secara independen, namun mereka berkomunikasi dengan lancar, memastikan kolaborasi yang lancar.

Antarmuka grafis yang ramah pengguna memungkinkan tim memvisualisasikan interaksi agen dan menyempurnakan konfigurasi. Dasbor pemantauan memberikan wawasan tentang kinerja agen, membantu pengembang mengidentifikasi dan mengatasi inefisiensi. Platform ini juga mendukung eksekusi paralel, memungkinkan banyak agen menangani tugas independen secara bersamaan. Desain ini meningkatkan throughput secara signifikan, terutama di lingkungan dengan permintaan tinggi.

SuperAGI memiliki fitur sistem plug-in yang dapat diperluas yang terintegrasi dengan API pihak ketiga, alat alur kerja, dan modul khusus. Fleksibilitas ini mempercepat pengembangan dan mendorong kontribusi dari komunitas pengembang yang lebih luas, sehingga memperkaya kemampuan platform.

Arsitektur modular platform yang terdistribusi mendukung penskalaan horizontal, sehingga dapat beradaptasi untuk implementasi skala besar. Penggunaan pembelajaran penguatan dan putaran umpan balik meningkatkan kinerja secara keseluruhan, memastikan tugas dialokasikan secara efisien. Dengan memungkinkan kolaborasi yang efektif dan throughput yang tinggi, SuperAGI sangat cocok untuk organisasi yang menuntut kinerja yang kuat dalam skenario yang kompleks dan bervolume tinggi.

Memilih kerangka orkestrasi AI yang tepat berarti memahami kekuatan dan keterbatasan setiap opsi. Platform ini dirancang dengan prioritas berbeda, memenuhi kebutuhan seperti keamanan tingkat perusahaan, kemampuan beradaptasi pengembang, atau alur kerja khusus seperti alur pembelajaran mesin. Setiap kerangka kerja mencerminkan filosofi desain unik dan kasus penggunaan targetnya.

Misalnya, platform seperti Prompts.ai unggul dalam memusatkan akses ke model bahasa besar (LLM), sementara alat seperti Apache Airflow dan Prefect fokus pada otomatisasi alur kerja umum. Di sisi lain, Kubeflow dan Flyte disesuaikan untuk alur pembelajaran mesin, dan kerangka kerja seperti SuperAGI dan Microsoft AutoGen mendorong batas-batas kolaborasi AI multi-agen dengan memungkinkan sistem otonom untuk menangani tugas-tugas kompleks secara bersama-sama.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Struktur Biaya: Platform tradisional sering kali mengenakan biaya per pengguna atau eksekusi, yang dapat menyebabkan biaya lebih tinggi seiring dengan berkembangnya operasi. Sebaliknya, Prompts.ai menggunakan model bayar sesuai pemakaian dengan kredit TOKN, yang menghubungkan pengeluaran langsung dengan penggunaan. Pendekatan ini sangat membantu ketika bereksperimen dengan model yang berbeda atau mengelola beban kerja yang berfluktuasi.

Keamanan dan Kepatuhan: Bagi industri seperti layanan kesehatan atau keuangan, langkah-langkah keamanan yang kuat sangatlah penting. Platform seperti Prompts.ai, IBM watsonx Orchestrate, dan Prefect menyediakan alat kepatuhan bawaan seperti jalur audit dan kontrol akses berbasis peran. Namun, opsi sumber terbuka seperti Apache Airflow memerlukan konfigurasi tambahan untuk memenuhi standar kepatuhan yang ketat.

Kurva Pembelajaran: Kegunaan sangat bervariasi. Platform seperti Prefect dan Dagster lebih ramah bagi pemula, menawarkan API Python yang intuitif dan pesan kesalahan yang bermanfaat. Sementara itu, Apache Airflow dan Kubeflow menuntut keahlian teknis dan keterampilan manajemen infrastruktur yang lebih mendalam. Prompts.ai menyederhanakan hal ini lebih lanjut dengan antarmuka terpadu yang menyeimbangkan kemudahan penggunaan dengan fitur-fitur canggih untuk pengguna tingkat lanjut.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Ekosistem Integrasi: Integrasi yang lancar dengan alat yang ada sangatlah penting. Apache Airflow memimpin dengan ratusan plugin untuk layanan cloud, database, dan alat pemantauan. Prompts.ai, di sisi lain, berfokus secara khusus pada LLM, menawarkan akses efisien ke lusinan model melalui satu API.

Skalabilitas: Platform seperti Kubeflow dan Flyte dibuat untuk penskalaan horizontal, memanfaatkan Kubernetes untuk distribusi beban kerja. Metaflow menggunakan layanan AWS untuk penskalaan elastis, sementara Prefek mendukung opsi penskalaan yang dikelola cloud dan dihosting sendiri. SuperAGI menggunakan arsitektur agen terdistribusi, memungkinkan eksekusi paralel, meskipun hal ini memerlukan koordinasi yang cermat.

Kerangka kerja terbaik untuk Anda bergantung pada alur kerja spesifik Anda. Untuk orkestrasi LLM, Prompts.ai menonjol dengan akses model terpusat dan efisiensi biaya. Tim teknik data mungkin mengandalkan keandalan Apache Airflow, sementara tim ML yang mengerjakan pelatihan dan penerapan skala besar dapat memanfaatkan Kubeflow atau Flyte. Jika fokus Anda adalah membangun sistem AI otonom, SuperAGI atau Microsoft AutoGen mungkin merupakan pilihan yang tepat.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Misalnya, tim yang memprioritaskan orkestrasi LLM mungkin menganggap Prompts.ai sangat menarik. Ini menyediakan akses terpusat ke lebih dari 35 model, seperti GPT-5, Claude, dan Gemini, semuanya melalui antarmuka terpadu. Sistem kredit TOKN bayar sesuai pemakaian menghilangkan biaya berlangganan sambil menawarkan pelacakan biaya waktu nyata. Dengan fitur seperti kontrol akses berbasis peran dan jalur audit, Prompts.ai adalah pilihan tepat bagi industri yang memerlukan tata kelola yang ketat tanpa mengorbankan kecepatan.

Tim teknik data yang bekerja dengan pipeline ETL yang kompleks mungkin tertarik pada Apache Airflow karena ekosistem plugin dan skalabilitasnya yang kuat, meskipun hal ini memerlukan keahlian yang lebih canggih. Di sisi lain, Prefek menawarkan pendekatan asli Python dengan penanganan kesalahan yang mudah digunakan, menjadikannya pilihan yang sangat baik untuk orientasi tim yang lebih cepat.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

Organisasi yang mengeksplorasi sistem AI otonom mungkin mempertimbangkan Microsoft AutoGen untuk fitur kolaborasi multi-agennya atau SuperAGI untuk delegasi tugas dinamis. Alat-alat ini ideal untuk penelitian atau kasus penggunaan khusus tetapi sering kali memerlukan keterampilan pengkodean tingkat lanjut, sehingga kurang cocok untuk kebutuhan produksi yang mendesak.

Pada akhirnya, pemilihan kerangka kerja yang tepat melibatkan evaluasi faktor-faktor seperti modularitas, ekstensibilitas, observabilitas, dan fitur tata kelola seperti kontrol akses berbasis peran dan sertifikasi kepatuhan. Fleksibilitas penerapan dan integrasi dengan alat yang ada juga sama pentingnya. Selain fungsionalitas, pertimbangkan pengalaman pengembang, termasuk SDK, dokumentasi, dan total biaya kepemilikan. Kompleksitas alur kerja Anda - baik tugas agen tunggal yang mudah atau sistem multi-agen yang rumit dengan memori persisten - juga harus memandu keputusan Anda.

Industri ini sedang menuju ke arah sistem AI yang skalabel dan terintegrasi, dengan kerangka kerja sumber terbuka yang mendorong sebagian besar beban kerja perusahaan, sementara runtime yang dikelola vendor menyederhanakan tantangan operasional.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Saat memilih kerangka kerja orkestrasi AI, penting untuk mempertimbangkan seberapa baik kerangka tersebut terintegrasi dengan alat dan sistem Anda saat ini. Kerangka kerja dengan kemampuan integrasi yang kuat memastikan semuanya bekerja sama tanpa komplikasi yang tidak perlu.

Perhatikan fitur otomatisasinya, seperti penjadwalan alur kerja dan manajemen tugas, karena ini dapat menyederhanakan pengoperasian dan menghemat waktu. Yang tidak kalah pentingnya adalah langkah-langkah keamanan dan tata kelola, yang melindungi data sensitif dan membantu Anda tetap mematuhi peraturan.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai menyederhanakan tantangan dalam mengelola berbagai alat AI dengan menyatukan lebih dari 35 model bahasa besar dalam satu platform terpadu. Dengan pengaturan ini, pengguna dapat dengan mudah membandingkan model secara berdampingan sambil tetap menjaga pengawasan penuh terhadap alur kerja cepat, kualitas keluaran, dan kinerja keseluruhan.

Menambah efisiensinya, Prompts.ai dilengkapi lapisan FinOps terintegrasi yang dirancang untuk mengoptimalkan biaya. Alat ini memberikan wawasan real-time mengenai penggunaan, pengeluaran, dan laba atas investasi (ROI), sehingga memungkinkan organisasi mengelola sumber daya mereka secara efektif dan mendapatkan hasil maksimal dari anggaran AI mereka.

Prompts.ai memprioritaskan keamanan dan kepatuhan tingkat perusahaan, selaras dengan standar industri seperti SOC 2 Tipe II, HIPAA, dan GDPR untuk melindungi data Anda di setiap tahap.

Untuk menegakkan pemantauan dan kepatuhan yang berkelanjutan, Prompts.ai berkolaborasi dengan Vanta dan memulai proses audit SOC 2 Tipe II pada 19 Juni 2025. Langkah-langkah ini memastikan alur kerja Anda tetap aman, patuh, dan dapat diandalkan untuk operasi perusahaan.