मशीन लर्निंग ऑर्केस्ट्रेशन प्लेटफ़ॉर्म एआई वर्कफ़्लो को सरल बनाते हैं, लागत कम करते हैं और स्केलेबिलिटी बढ़ाते हैं। यह मार्गदर्शिका आपकी व्यावसायिक आवश्यकताओं के लिए सही समाधान चुनने में मदद करने के लिए उनकी विशेषताओं, उपयोगिता और लागत पारदर्शिता के आधार पर 10 प्रमुख प्लेटफार्मों का मूल्यांकन करती है।

अपनी प्राथमिकताओं के आधार पर एक प्लेटफ़ॉर्म चुनें: लागत बचत, स्केलेबिलिटी, या मौजूदा टूल के साथ एकीकरण। एलएलएम-भारी वर्कफ़्लो के लिए, Prompts.ai सबसे आगे है। व्यापक एमएल जरूरतों के लिए, एयरफ्लो या क्यूबफ्लो मजबूत ओपन-सोर्स विकल्प हैं। क्लाउड-आधारित उद्यम निर्बाध एकीकरण के लिए Azure ML या Vertex AI को प्राथमिकता दे सकते हैं।

Prompts.ai एक एंटरप्राइज़-ग्रेड AI ऑर्केस्ट्रेशन प्लेटफ़ॉर्म है जिसे AI टूल के प्रबंधन को सरल बनाने के लिए डिज़ाइन किया गया है। यह टूल फैलाव और छिपे हुए खर्चों की चुनौतियों से निपटता है, जो अक्सर मापने योग्य परिणाम देने से पहले एआई पहल में बाधा डालते हैं।

इंटरऑपरेबिलिटी, स्केलेबिलिटी और कुशल वर्कफ़्लो प्रबंधन पर ध्यान केंद्रित करके, Prompts.ai एंटरप्राइज़ एआई संचालन में महत्वपूर्ण समस्या बिंदुओं को संबोधित करता है।

प्लेटफ़ॉर्म की असाधारण विशेषता एक एकल, सुरक्षित इंटरफ़ेस के माध्यम से GPT-4, क्लाउड, LLaMA और जेमिनी सहित 35 से अधिक प्रमुख बड़े भाषा मॉडल (एलएलएम) तक पहुंच को एकीकृत करने की क्षमता है। यह दृष्टिकोण उस विखंडन को समाप्त करता है जो आमतौर पर एंटरप्राइज़ एआई तैनाती को जटिल बनाता है।

Prompts.ai एक एकीकृत इंटरफ़ेस की पेशकश करके निर्बाध क्रॉस-मॉडल संगतता सुनिश्चित करता है जो विभिन्न एलएलएम प्रदाताओं पर काम करता है। यह स्लैक, जीमेल और ट्रेलो जैसे व्यापक रूप से उपयोग किए जाने वाले व्यावसायिक टूल के साथ भी एकीकृत होता है, जो इसे मौजूदा वर्कफ़्लो के लिए स्वाभाविक रूप से फिट बनाता है।

प्लेटफ़ॉर्म का आर्किटेक्चर विभिन्न मॉडलों की साथ-साथ तुलना का समर्थन करता है, जिससे उपयोगकर्ता कई इंटरफ़ेस या एपीआई कुंजियों की आवश्यकता के बिना प्रदर्शन का मूल्यांकन कर सकते हैं। यह सुव्यवस्थित दृष्टिकोण निर्णय लेने को सरल बनाता है और यह सुनिश्चित करता है कि प्रत्येक विशिष्ट उपयोग के मामले के लिए सर्वोत्तम मॉडल चुना जाए।

एंटरप्राइज़-स्तरीय मांगों को संभालने के लिए डिज़ाइन किया गया, Prompts.ai एक क्लाउड-नेटिव आर्किटेक्चर पेश करता है जो टीमों के बढ़ने और एआई उपयोग बढ़ने पर आसानी से स्केल कर सकता है। नए मॉडल, उपयोगकर्ता या टीम जोड़ना एक त्वरित और सीधी प्रक्रिया है, जिसके लिए किसी महत्वपूर्ण बुनियादी ढांचे में बदलाव की आवश्यकता नहीं है।

प्लेटफ़ॉर्म का पे-एज़-यू-गो TOKN क्रेडिट सिस्टम निश्चित मासिक सदस्यता की जगह लेता है, जिससे व्यवसायों के लिए वास्तविक जरूरतों के आधार पर एआई उपयोग को मापना आसान हो जाता है। यह लचीलापन उन कंपनियों के लिए विशेष रूप से मूल्यवान है जिनके कार्यभार में उतार-चढ़ाव होता है या जो नए स्वचालन अवसरों के साथ प्रयोग कर रहे हैं।

Prompts.ai एकबारगी AI कार्यों को संरचित, दोहराए जाने योग्य वर्कफ़्लो में बदल देता है। टीमें मैन्युअल प्रॉम्प्ट इंजीनियरिंग पर खर्च होने वाले समय को कम करते हुए लगातार आउटपुट सुनिश्चित करने के लिए मानकीकृत प्रॉम्प्ट वर्कफ़्लोज़ बना सकती हैं।

इसके अतिरिक्त, प्लेटफ़ॉर्म उन्नत अनुकूलन का समर्थन करता है, जिसमें प्रशिक्षण और फाइन-ट्यूनिंग LoRAs (लो-रैंक एडेप्टर) और AI एजेंट बनाना शामिल है। ये सुविधाएँ संगठनों को उनके विशिष्ट व्यावसायिक लक्ष्यों के अनुरूप अनुकूलित स्वचालन वर्कफ़्लो बनाने के लिए सशक्त बनाती हैं।

एलएलएम वर्कफ़्लोज़ के लिए विशेष रूप से निर्मित, Prompts.ai संकेतों को प्रबंधित करने, संस्करणों को ट्रैक करने और प्रदर्शन की निगरानी के लिए उपकरण प्रदान करता है।

इसमें विशेषज्ञ-डिज़ाइन किए गए "टाइम सेवर्स" भी शामिल हैं, जो प्रमाणित शीघ्र इंजीनियरों द्वारा बनाए गए पूर्व-निर्मित वर्कफ़्लो हैं। ये उपयोग के लिए तैयार समाधान व्यवसायों को उच्च-गुणवत्ता मानकों को बनाए रखते हुए सामान्य उपयोग के मामलों को शीघ्रता से लागू करने में मदद करते हैं।

एंटरप्राइज़ एआई अपनाने में अप्रत्याशित लागत एक बड़ी बाधा है, और Prompts.ai इसे वास्तविक समय खर्च अंतर्दृष्टि के साथ संबोधित करता है। प्लेटफ़ॉर्म मॉडल और टीमों में उपयोग किए जाने वाले प्रत्येक टोकन को ट्रैक करता है, जिससे संगठनों को उनके एआई खर्चों के बारे में स्पष्ट जानकारी मिलती है। कंपनी के आंकड़ों के अनुसार, Prompts.ai के माध्यम से AI टूल को समेकित करने से 98% तक लागत बचत हो सकती है। ये बचत सॉफ़्टवेयर सदस्यता को कम करने और प्रदर्शन और लागत दोनों के आधार पर मॉडल चयन को अनुकूलित करने से आती है।

प्लेटफ़ॉर्म की फिनऑप्स परत एआई खर्च को व्यावसायिक परिणामों से जोड़ती है, जिससे वित्त टीमों को निवेश को उचित ठहराने और बजट की अधिकता से बचने में मदद मिलती है। यह सुविधा सुनिश्चित करती है कि एआई पहल मापने योग्य मूल्य प्रदान करते हुए वित्तीय रूप से व्यवहार्य बनी रहे।

क्यूबफ़्लो एक ओपन-सोर्स प्लेटफ़ॉर्म है जिसे कुबेरनेट्स पर मशीन लर्निंग (एमएल) वर्कफ़्लो को व्यवस्थित करने के लिए डिज़ाइन किया गया है। मूल रूप से Google द्वारा विकसित और अब सीएनसीएफ समुदाय द्वारा प्रबंधित, यह कंटेनरीकृत एमएल वर्कफ़्लो को कुशलतापूर्वक तैनात करने, प्रबंधित करने और स्केल करने के लिए टूल का एक मजबूत सेट प्रदान करता है।

Built for Kubernetes-focused organizations, Kubeflow simplifies the complexities of ML operations, transforming them into streamlined, repeatable workflows. Let’s explore its scalability, workflow automation, integration with large language models (LLMs), and how it helps manage costs.

क्यूबफ्लो उद्यम स्तर पर मांग वाले एमएल कार्यभार को प्रबंधित करने के लिए कुबेरनेट्स के क्षैतिज स्केलिंग का लाभ उठाता है। कई नोड्स में कम्प्यूटेशनल कार्यों को वितरित करके, यह बड़े डेटासेट के कुशल संचालन और जटिल मॉडल के प्रशिक्षण को सक्षम बनाता है।

इसका आर्किटेक्चर TensorFlow और PyTorch जैसे लोकप्रिय ढांचे के लिए वितरित प्रशिक्षण का समर्थन करने के लिए डिज़ाइन किया गया है। यह टीमों को अपने कोड में किसी भी बदलाव की आवश्यकता के बिना, एकल मशीनों से कई जीपीयू तक अपने कार्यभार को निर्बाध रूप से बढ़ाने की अनुमति देता है।

Kubernetes’ resource management features, such as quotas and limits, further enhance scalability. Organizations can allocate specific CPU, memory, and GPU resources to various teams or projects, ensuring resources are distributed fairly and no single workflow overburdens the system.

क्यूबफ़्लो पाइपलाइन के साथ, टीमें विज़ुअल इंटरफ़ेस या पायथन एसडीके का उपयोग करके प्रतिलिपि प्रस्तुत करने योग्य वर्कफ़्लो बना सकती हैं। पाइपलाइन में प्रत्येक चरण कंटेनरीकृत और संस्करण-नियंत्रित है, जो इसे विभिन्न परियोजनाओं में पुन: प्रयोज्य बनाता है।

पूर्व-निर्मित पाइपलाइन टेम्पलेट डेटा प्रीप्रोसेसिंग, मॉडल प्रशिक्षण और सत्यापन जैसे दोहराए जाने वाले कार्यों को मानकीकृत करने में मदद करते हैं। यह न केवल नई परियोजनाओं के लिए सेटअप समय को कम करता है बल्कि टीमों के बीच निरंतरता भी सुनिश्चित करता है। इसके अलावा, क्यूबफ़्लो प्रत्येक पाइपलाइन रन से पैरामीटर, मेट्रिक्स और कलाकृतियों को स्वचालित रूप से लॉग करके प्रयोग ट्रैकिंग को सरल बनाता है, जिससे टीमों के लिए मॉडल संस्करणों की तुलना करना और सफल परिणामों को दोहराना आसान हो जाता है।

क्यूबफ़्लो, केसर्व द्वारा संचालित अपनी स्केलेबल मॉडल सेवा क्षमताओं के माध्यम से एलएलएम वर्कफ़्लो का समर्थन करने के लिए अच्छी तरह से सुसज्जित है। यह अनुमान समापन बिंदुओं की तैनाती को सक्षम बनाता है जो उच्च मांगों को संभाल सकते हैं। इसके अतिरिक्त, हगिंग फेस ट्रांसफॉर्मर्स जैसे पुस्तकालयों के साथ एकीकरण टीमों को पूर्व-प्रशिक्षित एलएलएम को अपनी पाइपलाइनों में सहजता से शामिल करने की अनुमति देता है।

क्यूबफ़्लो प्रोमेथियस जैसे कुबेरनेट्स निगरानी उपकरणों का लाभ उठाकर बुनियादी ढांचे के उपयोग में विस्तृत जानकारी प्रदान करता है। सीपीयू, मेमोरी और जीपीयू खपत को ट्रैक करके, टीमें अपने बुनियादी ढांचे को अनुकूलित करने और लागतों को प्रभावी ढंग से प्रबंधित करने के लिए आवश्यक दृश्यता प्राप्त करती हैं।

अपाचे एयरफ्लो अपने विशेष एक्सटेंशन की बदौलत मशीन लर्निंग वर्कफ़्लो के प्रबंधन के लिए एक शक्तिशाली मंच बन गया है। शुरुआत में 2014 में Airbnb द्वारा बनाया गया, यह ओपन-सोर्स टूल अब स्टार्टअप से लेकर प्रमुख निगमों तक के संगठनों के एमएल संचालन में महत्वपूर्ण भूमिका निभाता है।

एयरफ्लो की असाधारण विशेषताओं में से एक इसका डायरेक्टेड एसाइक्लिक ग्राफ (डीएजी) ढांचा है, जो उपयोगकर्ताओं को जटिल एमएल वर्कफ़्लो को कोड के रूप में डिजाइन करने की अनुमति देता है, जिससे लचीली और उच्च अनुकूलन योग्य पाइपलाइन निर्माण सक्षम होता है।

एयरफ्लो की ताकत मशीन लर्निंग टूल्स और सेवाओं की एक विस्तृत श्रृंखला के साथ सहजता से एकीकृत होने की क्षमता में निहित है। ऑपरेटरों और हुकों का इसका पारिस्थितिकी तंत्र लगभग किसी भी एमएल फ्रेमवर्क या क्लाउड प्लेटफॉर्म से सहज कनेक्शन सक्षम बनाता है। मूल एकीकरण में TensorFlow, PyTorch, और Scikit-learn, साथ ही AWS, Google Cloud और Microsoft Azure से क्लाउड-आधारित ML सेवाएँ शामिल हैं।

एयरफ्लो एमएल प्रदाता पैकेज एमएलफ्लो और वेट्स एंड amp जैसे उपकरणों के लिए विशेष ऑपरेटरों की पेशकश करके इस अंतरसंचालनीयता को और बढ़ाता है। पक्षपात. यह टीमों को एंड-टू-एंड वर्कफ़्लो बनाने की अनुमति देता है जो कस्टम एकीकरण कोड की आवश्यकता के बिना कई टूल को जोड़ता है। उदाहरण के लिए, एक एकल डीएजी स्नोफ्लेक से डेटा प्राप्त कर सकता है, स्पार्क का उपयोग करके इसे प्रीप्रोसेस कर सकता है, टेन्सरफ्लो के साथ एक मॉडल को प्रशिक्षित कर सकता है, और इसे कुबेरनेट्स पर तैनात कर सकता है - यह सब हर कदम पर पूर्ण नियंत्रण और दृश्यता बनाए रखते हुए।

एयरफ़्लो डेटाबेस कनेक्टिविटी में भी उत्कृष्टता प्राप्त करता है, जो PostgreSQL, MySQL, MongoDB और कई अन्य डेटा स्रोतों के लिए अंतर्निहित समर्थन प्रदान करता है। यह इसे विभिन्न डेटा प्रणालियों में जटिल एमएल वर्कफ़्लो प्रबंधित करने वाले संगठनों के लिए एक उत्कृष्ट विकल्प बनाता है।

एयरफ्लो की स्केलेबिलिटी CeleryExecutor और KubernetesExecutor द्वारा संचालित होती है, जो वर्कलोड को कई वर्कर नोड्स में क्षैतिज रूप से स्केल करने की अनुमति देती है। KubernetesExecutor एमएल कार्यों के लिए विशेष रूप से उपयुक्त है, क्योंकि यह वर्कफ़्लो के विभिन्न चरणों के लिए विशिष्ट संसाधन आवश्यकताओं वाले कंटेनरों को गतिशील रूप से आवंटित कर सकता है।

With its task parallelization capabilities, Airflow enables teams to run multiple ML experiments simultaneously, significantly cutting down the time required for hyperparameter tuning and model comparisons. Resource pools can be configured to ensure that resource-intensive tasks, such as training, don’t overwhelm the system, while lighter processes continue uninterrupted.

बड़े डेटासेट के साथ काम करने वाले संगठनों के लिए, एयरफ़्लो का बैकफ़िलिंग और कैचअप संचालन यह सुनिश्चित करता है कि नए मॉडल या सुविधाएँ पेश किए जाने पर ऐतिहासिक डेटा को कुशलतापूर्वक संसाधित किया जा सकता है।

एयरफ्लो एमएल वर्कफ़्लो को पायथन-आधारित डीएजी परिभाषाओं का उपयोग करके दस्तावेज़ीकृत, संस्करण-नियंत्रित पाइपलाइनों में बदलकर सरल बनाता है। प्रत्येक चरण को स्पष्ट रूप से परिभाषित किया गया है, जिसमें निर्भरता, पुनः प्रयास तर्क और विफलता प्रबंधन शामिल है, जो मजबूत पाइपलाइनों को सुनिश्चित करता है जो त्रुटियों से स्वचालित रूप से ठीक हो सकती हैं।

प्लेटफ़ॉर्म के सेंसर ऑपरेटर इवेंट-संचालित वर्कफ़्लो को संभव बनाते हैं, जब नया डेटा आता है या जब मॉडल का प्रदर्शन स्वीकार्य सीमा से नीचे चला जाता है, तो पुन: प्रशिक्षण प्रक्रिया शुरू हो जाती है। यह स्वचालन गतिशील उत्पादन वातावरण में मॉडल सटीकता बनाए रखने के लिए आवश्यक है जहां डेटा अक्सर बदलता रहता है।

कार्य निर्भरताओं को प्रबंधित करके, एयरफ़्लो यह सुनिश्चित करता है कि वर्कफ़्लो सही क्रम में निष्पादित हो। डाउनस्ट्रीम कार्य स्वचालित रूप से अपस्ट्रीम प्रक्रियाओं के सफलतापूर्वक समाप्त होने की प्रतीक्षा करते हैं, जिससे अपूर्ण या दूषित डेटा पर प्रशिक्षण मॉडल जैसी त्रुटियों का जोखिम कम हो जाता है। यह आमतौर पर जटिल पाइपलाइनों में आवश्यक अधिकांश मैन्युअल समन्वय को समाप्त कर देता है।

Although Airflow wasn’t initially designed for large language models (LLMs), recent developments have expanded its capabilities to handle fine-tuning pipelines for models like BERT and GPT variants. Airflow can now manage dependencies across tasks such as data preparation, tokenization, training, and evaluation.

लंबे समय तक चलने वाले कार्यों को संभालने की इसकी क्षमता इसे एलएलएम प्रशिक्षण नौकरियों के लिए आदर्श बनाती है जिनमें घंटों या दिन भी लग सकते हैं। एयरफ़्लो इन प्रक्रियाओं पर नज़र रखता है, समस्याएँ आने पर अलर्ट भेजता है, और चेकपॉइंट से विफल रन को स्वचालित रूप से पुनरारंभ करता है।

पुनर्प्राप्ति-संवर्धित पीढ़ी (आरएजी) प्रणालियों को लागू करने वाले संगठनों के लिए, एयरफ्लो पूरी प्रक्रिया को व्यवस्थित कर सकता है - दस्तावेज़ अंतर्ग्रहण और एम्बेडिंग पीढ़ी से लेकर वेक्टर डेटाबेस को अपडेट करने और तैनाती के लिए मॉडल तैयार करने तक। इसके अतिरिक्त, एयरफ्लो लागत को नियंत्रण में रखने के लिए आवश्यक परिचालन अंतर्दृष्टि प्रदान करता है।

एयरफ़्लो विस्तृत कार्य-स्तरीय लॉगिंग और निगरानी प्रदान करता है, जिससे टीमों को उनके वर्कफ़्लो में संसाधन उपयोग का स्पष्ट दृश्य मिलता है। यह बारीक ट्रैकिंग संगठनों को गणना लागतों को अधिक प्रभावी ढंग से प्रबंधित करने में मदद करती है, विशेष रूप से क्लाउड वातावरण में जहां लागत उदाहरण प्रकार और उपयोग के आधार पर भिन्न हो सकती है।

प्लेटफ़ॉर्म की कार्य अवधि ट्रैकिंग सुविधा पाइपलाइनों में बाधाओं की पहचान करती है, जिससे टीमों को संसाधन आवंटन को अनुकूलित करने और दक्षता में सुधार करने में सक्षम बनाया जाता है। क्लाउड-आधारित तैनाती के लिए, यह दृश्यता गणना-गहन कार्यों से जुड़े खर्चों को नियंत्रित करने के लिए महत्वपूर्ण है।

एसएलए मॉनिटरिंग के साथ, जब वर्कफ़्लो अपेक्षित रनटाइम से अधिक हो जाता है, तो एयरफ़्लो टीमों को सचेत करता है, उन अक्षमताओं को उजागर करता है जो अनावश्यक खर्च का कारण बन सकती हैं। लागत और प्रदर्शन का यह संतुलन एयरफ़्लो को अपने एमएल संचालन को अनुकूलित करने का लक्ष्य रखने वाले संगठनों के लिए एक मूल्यवान उपकरण बनाता है।

डोमिनोज़ डेटा लैब उद्यम स्तर पर मशीन लर्निंग को व्यवस्थित करने के लिए एक शक्तिशाली मंच के रूप में सामने आया है। बढ़ते कार्यभार और बड़े पैमाने पर तैनाती को संभालने के लिए निर्मित, यह कुशल संसाधन प्रबंधन और स्केलेबल प्रदर्शन के लिए एक ठोस आधार प्रदान करता है।

Domino Data Lab’s architecture is designed to adapt to changing demands. It employs dynamic resource allocation and elastic scaling to automatically adjust resources based on workload needs. By integrating with cluster systems, it enables smooth transitions from small-scale experiments to extensive model training. Its advanced workload scheduling ensures resources are distributed efficiently across projects, delivering consistent performance in enterprise settings.

डेटारोबोट एआई प्लेटफ़ॉर्म मशीन लर्निंग संचालन के प्रबंधन के लिए एक शक्तिशाली, उद्यम-स्तरीय समाधान प्रदान करता है। एक केंद्रीकृत खुफिया परत के रूप में कार्य करते हुए, यह विभिन्न एआई सिस्टम को जोड़ता है, जिससे यह कई तकनीकी सेटअपों के अनुकूल हो जाता है।

डेटारोबोट को इंटरऑपरेबिलिटी को ध्यान में रखकर बनाया गया है, जो एक खुली वास्तुकला की पेशकश करता है जो विविध एआई रणनीतियों का समर्थन करता है। यह डिज़ाइन संगठनों को उनकी विशिष्ट आवश्यकताओं के अनुरूप जेनेरिक एआई घटकों का मूल्यांकन और चयन करने की अनुमति देता है।

The platform supports deploying native, custom, and external models across different prediction environments. These deployments can occur on DataRobot’s infrastructure or external servers, providing flexibility for various operational needs.

एकीकरण को सरल बनाने के लिए, प्लेटफ़ॉर्म में REST API और Python क्लाइंट पैकेज शामिल हैं। यह तकनीकी और गैर-तकनीकी दोनों उपयोगकर्ताओं की जरूरतों को पूरा करते हुए कोडिंग वर्कफ़्लो और विज़ुअल इंटरफेस के बीच सहज बदलाव सुनिश्चित करता है।

इसके अलावा, डेटारोबोट प्रमुख क्लाउड प्रदाताओं और डेटा सेवाओं के साथ सहजता से एकीकृत होता है, जिससे लाइव क्लाउड वातावरण तक सीधी पहुंच संभव हो जाती है। ये सुविधाएँ डेटारोबोट को एंटरप्राइज़ एआई वर्कफ़्लो को सरल और एकीकृत करने के लिए एक प्रभावी उपकरण बनाती हैं।

प्रीफेक्ट ओरियन मशीन लर्निंग (एमएल) वर्कफ़्लो के ऑर्केस्ट्रेशन को सरल बनाता है, जो भरोसेमंद एमएल ऑटोमेशन को प्राथमिकता देने वाली टीमों को पूरा करता है। अवलोकन और सहज डेवलपर अनुभव पर ध्यान देने के साथ, प्लेटफ़ॉर्म एमएल वर्कफ़्लो की निगरानी और डिबगिंग को अधिक सरल बनाता है।

प्रीफेक्ट ओरियन अपने डेकोरेटर-आधारित सिस्टम के माध्यम से पायथन फ़ंक्शंस को ऑर्केस्ट्रेटेड वर्कफ़्लोज़ में बदल देता है। @फ्लो और @टास्क डेकोरेटर्स को लागू करके, टीमें अपने मौजूदा एमएल कोड को पूर्ण पुनर्लेखन की आवश्यकता के बिना प्रबंधित वर्कफ़्लो में अनुकूलित कर सकती हैं। इसका हाइब्रिड डिज़ाइन स्थानीय विकास और स्केलेबल निष्पादन वातावरण के बीच निर्बाध बदलाव का समर्थन करता है, जिससे आसान परीक्षण और डिबगिंग सुनिश्चित होती है। इसके अतिरिक्त, अंतर्निहित पुनर्प्रयास सुविधाएँ और विफलता-हैंडलिंग तंत्र समस्याएँ उत्पन्न होने पर स्वचालित रूप से कार्यों को पुनरारंभ करते हैं। यह स्वचालन व्यापक ऑर्केस्ट्रेशन सुविधाओं के साथ सहजता से एकीकृत होता है।

Prefect Orion’s architecture separates workflow logic from execution, enabling independent scaling of compute resources. Workflows can run on platforms like Kubernetes clusters, Docker containers, or cloud-based compute instances. The platform supports parallel task execution across multiple workers and uses work queues to optimize resource allocation. These features allow teams to efficiently manage diverse and demanding ML workloads.

फ़्लाइट पायथन फ़ंक्शंस को टाइप-सुरक्षित, डेकोरेटर-संचालित वर्कफ़्लो में बदलकर मशीन लर्निंग ऑर्केस्ट्रेशन को सरल बनाता है। संकलन-समय सत्यापन के साथ, त्रुटियों को जल्दी पकड़ लिया जाता है, और पृथक कंटेनर निष्पादन विश्वसनीय और सुसंगत परिणाम सुनिश्चित करता है।

फ़्लाइट पायथन फ़ंक्शंस को वर्कफ़्लो में बदलने के लिए डेकोरेटर-आधारित दृष्टिकोण का उपयोग करता है। यह स्वचालित रूप से प्रत्येक निष्पादन के लिए डेटा वंशावली को ट्रैक करता है, जिससे प्रक्रियाओं की निगरानी और ऑडिट करना आसान हो जाता है। टीमें जटिल कार्य निर्भरता को एक सिंटैक्स के साथ परिभाषित कर सकती हैं जो रनटाइम डेटा के आधार पर सशर्त निष्पादन, लूप और गतिशील कार्य निर्माण का समर्थन करता है।

प्लेटफ़ॉर्म वर्कफ़्लो टेम्प्लेटिंग भी प्रदान करता है, जो टीमों को पैरामीटरयुक्त टेम्प्लेट बनाने की अनुमति देता है। इन टेम्प्लेट को अलग-अलग कॉन्फ़िगरेशन के साथ पुन: उपयोग किया जा सकता है, दोहराव वाले कोड को कम किया जा सकता है और अलग-अलग हाइपरपैरामीटर या डेटासेट के साथ त्वरित प्रयोग को सक्षम किया जा सकता है।

ये स्वचालन उपकरण फ़्लाइट की स्केलिंग क्षमताओं के साथ निर्बाध रूप से काम करते हैं, जिससे वर्कफ़्लो प्रबंधन में दक्षता और लचीलापन सुनिश्चित होता है।

फ़्लाइट वर्कफ़्लो परिभाषाओं को उनके निष्पादन से अलग करता है, कुबेरनेट्स समूहों में क्षैतिज स्केलिंग को सक्षम करता है। यह डिज़ाइन सुनिश्चित करता है कि वर्कफ़्लो अलग-थलग हो, साथ ही टीमों को बहु-किरायेदार वातावरण में गणना संसाधनों को साझा करने की अनुमति मिलती है।

कार्य स्तर पर, टीमें विशिष्ट संसाधन आवश्यकताओं, जैसे सीपीयू, मेमोरी, या जीपीयू आवश्यकताओं को परिभाषित कर सकती हैं। फ़्लाइट इष्टतम प्रदर्शन सुनिश्चित करते हुए कार्यभार की माँगों के आधार पर इन संसाधनों का गतिशील रूप से प्रावधान और मापन करता है।

लागत दक्षता के लिए, फ़्लाइट गैर-महत्वपूर्ण बैच कार्यों के लिए स्पॉट इंस्टेंस का उपयोग करने के लिए क्लाउड प्रदाताओं के साथ एकीकृत होता है। यदि कोई स्पॉट इंस्टेंस बाधित होता है, तो इसका शेड्यूलर व्यवधान से बचने के लिए कार्यों को स्वचालित रूप से ऑन-डिमांड इंस्टेंस पर स्थानांतरित कर देता है।

फ़्लाइट PyTorch, TensorFlow, scikit-learn, और XGBoost जैसे लोकप्रिय फ़्रेमवर्क के साथ सहज एकीकरण का समर्थन करता है। यह स्पार्क का उपयोग करके बड़े पैमाने के कार्यों को भी समायोजित करता है।

प्रोटोटाइपिंग और प्रयोग के लिए, फ़्लाइट ज्यूपिटर नोटबुक के साथ एकीकृत होता है, जिससे नोटबुक कोशिकाओं को वर्कफ़्लो कार्यों में परिवर्तित किया जा सकता है। यह सुविधा विकास और उत्पादन के बीच के अंतर को पाटती है।

इसके अतिरिक्त, फ़्लाइट का REST API बाहरी सिस्टम और CI/CD पाइपलाइनों से जुड़ना आसान बनाता है। टीमें प्रोग्रामेटिक रूप से वर्कफ़्लो को ट्रिगर कर सकती हैं, उनकी प्रगति की निगरानी कर सकती हैं और लचीलेपन और परिचालन दक्षता को बढ़ाते हुए मानक HTTP इंटरफेस का उपयोग करके परिणाम प्राप्त कर सकती हैं।

टेक्टन एक फीचर स्टोर प्लेटफ़ॉर्म है जो प्रशिक्षण और वास्तविक समय अनुमान दोनों के लिए विश्वसनीय रूप से सुविधाएँ प्रदान करके डेटा इंजीनियरिंग और मशीन लर्निंग के बीच अंतर को पाटता है। यह अन्य ऑर्केस्ट्रेशन टूल को पूरक करते हुए, विभिन्न वातावरणों में सुविधाओं तक लगातार पहुंच प्रदान करके चिकनी एमएल वर्कफ़्लो सुनिश्चित करता है।

टेक्टन अपने पायथन-आधारित डिक्लेरेटिव एपीआई का उपयोग करके उद्यम बुनियादी ढांचे के साथ सहजता से एकीकृत होता है। यह टीमों को स्थापित कोड समीक्षा और सीआई/सीडी वर्कफ़्लो के साथ संरेखित करते हुए परिचित कोडिंग पैटर्न का उपयोग करके सुविधाओं को परिभाषित करने की अनुमति देता है। प्लेटफ़ॉर्म यूनिट परीक्षण और संस्करण नियंत्रण का भी समर्थन करता है, जिससे इसे मौजूदा इंजीनियरिंग पाइपलाइनों में शामिल करना आसान हो जाता है।

प्लेटफ़ॉर्म के लचीले डेटा अंतर्ग्रहण विकल्प विभिन्न प्रकार के डेटा आर्किटेक्चर को समायोजित करते हैं। टीमें S3, ग्लू, स्नोफ्लेक और रेडशिफ्ट जैसे बैच स्रोतों से डेटा खींच सकती हैं, या किनेसिस और काफ्का जैसे टूल से डेटा स्ट्रीम कर सकती हैं। फिर डेटा को फ़ीचर टेबल्स या कम-विलंबता इंजेस्ट एपीआई के माध्यम से पुश किया जा सकता है।

ऑर्केस्ट्रेशन के लिए, टेक्टन मैटेरियलाइजेशन जॉब्स और ट्रिगर मैटेरियलाइजेशन एपीआई प्रदान करता है, जो कस्टम शेड्यूलिंग जरूरतों के लिए एयरफ्लो, डैगस्टर या प्रीफेक्ट जैसे बाहरी टूल के साथ एकीकरण को सक्षम बनाता है।

जुलाई 2025 में, टेक्टन ने वास्तविक दुनिया के परिदृश्यों में अपनी अंतरसंचालनीयता प्रदर्शित करने के लिए मॉडलबिट के साथ साझेदारी की घोषणा की। यह सहयोग एमएल टीमों को एंड-टू-एंड पाइपलाइन बनाने की अनुमति देता है, जहां टेक्टन गतिशील सुविधाओं का प्रबंधन करता है और मॉडलबिट मॉडल परिनियोजन और अनुमान को संभालता है। एक धोखाधड़ी का पता लगाने का उदाहरण इस तालमेल पर प्रकाश डालता है: टेक्टन लेनदेन इतिहास और उपयोगकर्ता व्यवहार जैसी सुविधाओं को पेश करता है, जबकि मॉडलबिट अनुमान पाइपलाइन को तैनात करता है, उन्हें वास्तविक समय धोखाधड़ी का पता लगाने के लिए एक एकल कम-विलंबता एपीआई में संयोजित करता है।

Next, let’s explore how Tecton’s architecture scales to handle demanding ML workloads.

Tecton’s architecture is designed to scale, offering a flexible compute framework that supports Python (Ray & Arrow), Spark, and SQL engines. This flexibility allows teams to choose the right tool for their needs, whether it’s simple transformations or more complex feature engineering.

The platform’s latest version incorporates DuckDB and Arrow alongside the existing Spark and Snowflake-based systems. This setup provides fast local development while maintaining the scalability needed for large-scale production deployments.

The impact of Tecton’s scalability is evident in real-world use cases. For instance, Atlassian significantly reduced feature development time. Joshua Hanson, Principal Engineer at Atlassian, shared:

__XLATE_59__

"जब हमने पहली बार अपना स्वयं का फीचर वर्कफ़्लो बनाना शुरू किया, तो किसी फीचर को प्रोटोटाइप से उत्पादन में लाने में कई महीने - अक्सर तीन महीने - लग जाते थे। इन दिनों, टेक्टन के साथ, एक दिन के भीतर एक फीचर बनाना काफी व्यवहार्य है। टेक्टन वर्कफ़्लो और दक्षता दोनों के लिए गेम चेंजर रहा है।"

This scalability advantage also lays the foundation for Tecton’s ability to automate feature workflows effectively.

टेक्टन पूरे फीचर जीवनचक्र को स्वचालित करता है, जिसमें भौतिकीकरण, संस्करण और वंशावली ट्रैकिंग, मैन्युअल प्रयास को कम करना और दक्षता बढ़ाना शामिल है।

A standout feature is Tecton’s developer workflow experience. Joseph McAllister, Senior Engineer at Coinbase's ML Platform, noted:

__XLATE_62__

"टेक्टन के बारे में जो बात चमकती है वह फीचर इंजीनियरिंग अनुभव है - वह डेवलपर वर्कफ़्लो। शुरुआत से ही, जब आप एक नए डेटा स्रोत को ऑनबोर्ड कर रहे हैं और टेक्टन पर एक फीचर का निर्माण कर रहे हैं, तो आप उत्पादन डेटा के साथ काम कर रहे हैं, और इससे इसे तेजी से पुनरावृत्त करना वास्तव में आसान हो जाता है।"

HelloFresh offers another example of Tecton’s impact. Benjamin Bertincourt, Senior Manager of ML Engineering, described their challenges before adopting Tecton:

__XLATE_64__

"टेक्टन से पहले, हमारी विशेषताएं अलग-अलग स्पार्क पाइपलाइनों के साथ स्वतंत्र रूप से उत्पन्न होती थीं। उन्हें साझा करने के लिए नहीं बनाया गया था, उन्हें अक्सर सूचीबद्ध नहीं किया जाता था, और हमारे पास वास्तविक समय के अनुमान के लिए सुविधाओं की सेवा करने की क्षमता का अभाव था।"

Tecton is preparing for the future of AI with its upcoming integration with Databricks. Announced in July 2025, this partnership will embed Tecton’s real-time data serving capabilities directly into Databricks workflows and tooling. By combining Tecton’s feature serving with Databricks’ Agent Bricks, teams will be able to build, deploy, and scale personalized AI agents more efficiently within the Databricks ecosystem.

यह एकीकरण विशेष रूप से एलएलएम अनुप्रयोगों में वास्तविक समय की सुविधा प्रदान करने की आवश्यकता को संबोधित करता है, जहां वैयक्तिकृत एआई इंटरैक्शन का समर्थन करने के लिए उपयोगकर्ता-विशिष्ट और प्रासंगिक डेटा को तुरंत प्राप्त किया जाना चाहिए। यह एआई वर्कफ़्लो के ऑर्केस्ट्रेशन को बढ़ाता है, जिससे सभी प्लेटफार्मों पर निर्बाध एकीकरण सुनिश्चित होता है।

Azure मशीन लर्निंग एक शक्तिशाली क्लाउड-आधारित प्लेटफ़ॉर्म प्रदान करता है जिसे एंटरप्राइज़ स्तर पर मशीन लर्निंग वर्कफ़्लो प्रबंधित करने के लिए डिज़ाइन किया गया है। माइक्रोसॉफ्ट के पारिस्थितिकी तंत्र के हिस्से के रूप में, यह एज़्योर सेवाओं के साथ सहजता से एकीकृत होता है और साथ ही डेटा विज्ञान टीमों द्वारा आमतौर पर उपयोग किए जाने वाले ओपन-सोर्स टूल और फ्रेमवर्क की एक विस्तृत श्रृंखला का समर्थन करता है।

Azure ML stands out for its extensive compatibility with open-source technologies. It supports thousands of Python packages, including popular frameworks like TensorFlow, PyTorch, and scikit-learn, along with R support. The platform simplifies environment setup by providing pre-configured environments and containers optimized for these frameworks. For tracking experiments and managing models, Azure ML integrates with MLflow, offering a cohesive experience. Developers have flexibility in their choice of tools, whether it’s the Python SDK, Jupyter notebooks, R, CLI, or the Azure Machine Learning extension for Visual Studio Code.

जब CI/CD की बात आती है, तो Azure ML कुशल MLOps वर्कफ़्लो को सक्षम करते हुए, Azure DevOps और GitHub Actions के साथ एकीकृत होता है। इसके अतिरिक्त, Azure डेटा फ़ैक्टरी Azure ML के भीतर प्रशिक्षण और अनुमान पाइपलाइनों का समन्वय कर सकती है। बड़े पैमाने पर तैनाती के लिए, प्लेटफ़ॉर्म डॉकर छवियों के प्रबंधन के लिए Azure कंटेनर रजिस्ट्री और कंटेनरीकृत तैनाती के लिए Azure Kubernetes Service (AKS) का उपयोग करता है। यह होरोवोड के साथ एकीकरण के माध्यम से वितरित गहन शिक्षा का भी समर्थन करता है।

Azure ML को छोटे पैमाने की स्थानीय परियोजनाओं से लेकर उद्यम-व्यापी तैनाती तक, आसानी से बड़े पैमाने पर बनाया गया है। Azure Kubernetes Service (AKS) के साथ इसका एकीकरण सुनिश्चित करता है कि ML कार्यभार मांग के आधार पर गतिशील रूप से बढ़ सकता है। एज कंप्यूटिंग परिदृश्यों के लिए, Azure ML Azure IoT Edge के साथ काम करता है और अनुकूलित अनुमान को सक्षम करने के लिए ONNX रनटाइम का उपयोग करता है। माइक्रोसॉफ्ट फैब्रिक के हिस्से के रूप में, यह एक एकीकृत एनालिटिक्स प्लेटफॉर्म से लाभान्वित होता है, जो डेटा पेशेवरों के लिए तैयार किए गए विभिन्न टूल और सेवाओं को एक साथ लाता है। यह स्केलेबिलिटी, स्वचालन क्षमताओं के साथ मिलकर, जटिल एमएल वर्कफ़्लो के कुशल प्रबंधन की अनुमति देती है।

प्लेटफ़ॉर्म जटिल एमएल वर्कफ़्लो को स्वचालित करने में उत्कृष्टता प्राप्त करता है। Azure डेटा फ़ैक्टरी के साथ एकीकृत होकर, यह डेटा प्रोसेसिंग गतिविधियों के साथ-साथ प्रशिक्षण और अनुमान पाइपलाइन जैसे कार्यों के स्वचालन को सक्षम बनाता है। यह स्वचालन डेटा तैयारी, मॉडल प्रशिक्षण और तैनाती चरणों में सुचारू समन्वय सुनिश्चित करता है, मैन्युअल प्रयास को कम करता है और दक्षता बढ़ाता है।

Azure ML होरोवोड के माध्यम से वितरित प्रशिक्षण क्षमताओं के साथ बड़े भाषा मॉडल (एलएलएम) प्रशिक्षण का समर्थन करता है। यह अनुकूलित अनुमान के लिए ONNX रनटाइम का भी लाभ उठाता है, जो इसे संवादात्मक एआई और टेक्स्ट प्रोसेसिंग जैसे अनुप्रयोगों के लिए आदर्श बनाता है।

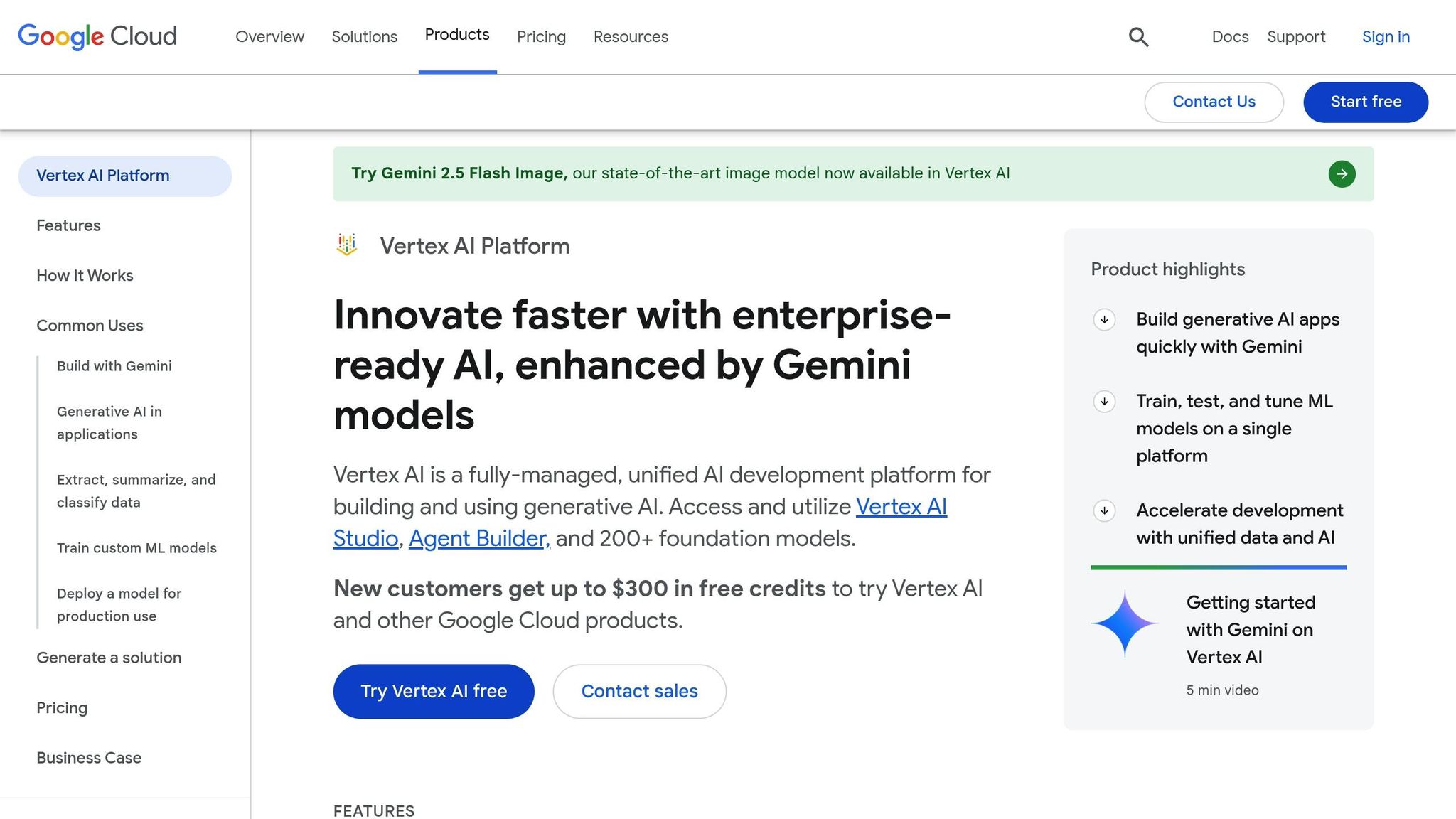

Google Vertex AI पाइपलाइन, Google क्लाउड के उन्नत बुनियादी ढांचे के साथ Kubeflow पाइपलाइन की शक्ति को संयोजित करते हुए, मशीन लर्निंग (ML) वर्कफ़्लो के प्रबंधन के लिए एक मजबूत समाधान प्रदान करता है। यह प्रयोग और उत्पादन के बीच के अंतर को पाटता है और Google की AI विशेषज्ञता द्वारा समर्थित एक सहज अनुभव प्रदान करता है।

वर्टेक्स एआई पाइपलाइन व्यापक एमएल पारिस्थितिकी तंत्र के भीतर सहजता से काम करने के लिए बनाई गई है। यह पायथन सहित लोकप्रिय प्रोग्रामिंग भाषाओं का समर्थन करता है, जिससे टीमों के लिए परिचित टूल के साथ रहना आसान हो जाता है। इसके अतिरिक्त, यह TensorFlow, PyTorch, XGBoost और scikit-learn जैसे व्यापक रूप से उपयोग किए जाने वाले ML फ्रेमवर्क के साथ एकीकृत होता है, जिससे यह सुनिश्चित होता है कि टीमें बिना किसी व्यवधान के अपने मौजूदा कोड और विशेषज्ञता का लाभ उठा सकती हैं।

The platform’s foundation on Kubeflow Pipelines ensures smooth management of containerized workflows. Teams can package ML components as Docker containers, enabling consistent execution across different environments. For those who prefer notebook-based development, Vertex AI Pipelines integrates seamlessly with Jupyter notebooks and Vertex AI Workbench, offering a familiar environment for experimentation. This cohesive integration creates a scalable and efficient platform for ML development.

Google क्लाउड के बुनियादी ढांचे और Google Kubernetes इंजन (GKE) द्वारा संचालित, Vertex AI पाइपलाइन को मांग वाले एमएल वर्कलोड को आसानी से संभालने के लिए डिज़ाइन किया गया है। यह कई जीपीयू और टीपीयू में वितरित प्रशिक्षण का समर्थन करता है, जो इसे बड़े पैमाने पर गहन शिक्षण परियोजनाओं के लिए एक उत्कृष्ट विकल्प बनाता है। TensorFlow उपयोगकर्ताओं को Tensor प्रोसेसिंग यूनिट (TPUs) के माध्यम से विशेष त्वरण से और अधिक लाभ होता है।

For organizations with variable workload needs, the platform offers preemptible instances to cut costs for fault-tolerant tasks. Its integration with Google Cloud’s global network ensures low-latency access to data and compute resources, regardless of location.

वर्टेक्स एआई पाइपलाइन पाइपलाइन-ए-कोड कार्यक्षमता के माध्यम से एमएल वर्कफ़्लो को सरल बनाती है। टीमें त्वरित और पुन: प्रयोज्य पाइपलाइन निर्माण को सक्षम करते हुए, पूर्व-निर्मित घटकों का उपयोग करके पायथन में वर्कफ़्लो को परिभाषित कर सकती हैं।

प्लेटफ़ॉर्म वर्टेक्स एआई फ़ीचर स्टोर के साथ भी एकीकृत होता है, फ़ीचर इंजीनियरिंग और सेवा को सुव्यवस्थित करता है। यह प्रशिक्षण और तैनाती वातावरण के बीच स्थिरता सुनिश्चित करता है, त्रुटियों को कम करता है और दक्षता में सुधार करता है।

वर्टेक्स एआई पाइपलाइन, वर्टेक्स एआई मॉडल गार्डन और पीएएलएम एपीआई से जुड़कर बड़े भाषा मॉडल (एलएलएम) के लिए वर्कफ़्लो का समर्थन करती है। यह एकीकरण टीमों को स्वचालित पाइपलाइनों के माध्यम से प्रक्रिया का प्रबंधन करते हुए अपने स्वयं के डेटा के साथ पूर्व-प्रशिक्षित भाषा मॉडल को ठीक करने की अनुमति देता है। एलएलएम के लिए वितरित प्रशिक्षण को टीपीयू बुनियादी ढांचे का उपयोग करके समर्थित किया जाता है, जिसमें एकल उपकरणों पर मेमोरी सीमाओं को दूर करने के लिए मॉडल और डेटा समानता जैसी तकनीकों को नियोजित किया जाता है।

अनुमान के लिए, प्लेटफ़ॉर्म वर्टेक्स एआई प्रेडिक्शन के साथ काम करता है, जो उतार-चढ़ाव वाले अनुरोध भार को संभालने के लिए ऑटो-स्केलिंग एंडपॉइंट प्रदान करता है। बैच पूर्वानुमान क्षमताएं भावना विश्लेषण या दस्तावेज़ वर्गीकरण जैसे कार्यों के लिए बड़े टेक्स्ट डेटासेट को संसाधित करना आसान बनाती हैं।

टीमों को खर्चों का प्रबंधन करने में मदद करने के लिए, वर्टेक्स एआई पाइपलाइन Google क्लाउड लागत प्रबंधन टूल के साथ एकीकृत होती है। ये उपकरण एमएल खर्च में विस्तृत जानकारी प्रदान करते हैं और उपयोगकर्ताओं को लागत पूर्वानुमान और नियंत्रण सुनिश्चित करते हुए बजट अलर्ट सेट करने की अनुमति देते हैं।

This section provides a balanced overview of the strengths and challenges of various platforms, helping you make informed decisions based on your organization’s needs. The key takeaways from the detailed platform reviews are summarized here.

Prompts.ai एंटरप्राइज़-स्तरीय AI ऑर्केस्ट्रेशन के लिए एक असाधारण विकल्प है, जो 35 से अधिक प्रमुख बड़े भाषा मॉडल (एलएलएम) के लिए एकीकृत इंटरफ़ेस प्रदान करता है। इसका पे-एज़-यू-गो TOKN सिस्टम 98% तक की लागत बचत को सक्षम बनाता है, जबकि वास्तविक समय फिनऑप्स नियंत्रण और मजबूत गवर्नेंस एड्रेस टूल फैलाव है। हालाँकि, एलएलएम ऑर्केस्ट्रेशन पर इसका फोकस पारंपरिक मशीन लर्निंग (एमएल) वर्कफ़्लो पर बहुत अधिक निर्भर संगठनों के लिए उपयुक्त नहीं हो सकता है, जो व्यापक एमएल लचीलेपन पर लागत दक्षता को प्राथमिकता देने वालों के लिए इसे आदर्श बनाता है।

एमएल एक्सटेंशन के साथ अपाचे एयरफ्लो का व्यापक रूप से एमएल पाइपलाइनों के प्रबंधन, प्रशिक्षण कार्यों के समन्वय, एआई मॉडल को तैनात करने और रिट्रीवल-ऑगमेंटेड जेनरेशन (आरएजी) वर्कफ़्लो को संभालने के लिए उपयोग किया जाता है। इसका एकीकरण GCP, AWS और Azure ML सेवाओं तक फैला हुआ है, जो एक परिपक्व पारिस्थितिकी तंत्र और मजबूत समुदाय द्वारा समर्थित है। हालाँकि, स्केलिंग जटिलता ला सकती है, और इसकी AI-मूल क्षमताएं एक्सटेंशन पर निर्भर करती हैं, जिससे रखरखाव ओवरहेड बढ़ सकता है।

डोमिनोज़ डेटा लैब डेटा विज्ञान टीमों के लिए तैयार एआई/एमएल मॉडल के एंड-टू-एंड प्रबंधन में उत्कृष्टता प्राप्त करता है। इसकी ताकत सहयोग और जीवनचक्र प्रबंधन में निहित है, लेकिन ये उच्च लाइसेंसिंग लागत और जटिलता के स्तर के साथ आते हैं जो छोटी टीमों को प्रभावित कर सकते हैं।

डेटारोबोट एआई प्लेटफ़ॉर्म स्वचालित मॉडल प्रशिक्षण को ऑर्केस्ट्रेशन के साथ जोड़ता है, जो शासन और पूर्वाग्रह का पता लगाने के लिए उपकरण प्रदान करता है। हालांकि यह एमएल पाइपलाइनों को सरल बनाता है, लेकिन ओपन-सोर्स विकल्पों की तुलना में इसकी प्रीमियम कीमत और सीमित लचीलापन कमियां हो सकती हैं।

प्रीफेक्ट ओरियन पायथन-आधारित एआई स्टैक के लिए एक मजबूत विकल्प है, जो निर्बाध एमएल पाइपलाइन एकीकरण को सक्षम करता है और गतिशील वर्कफ़्लो को प्रभावी ढंग से संभालता है। हालाँकि, इसका छोटा पारिस्थितिकी तंत्र और एंटरप्राइज़-ग्रेड सुविधाओं की कमी इसे बड़े संगठनों के लिए कम आकर्षक बना सकती है।

Flyte को ML और डेटा वर्कफ़्लो के लिए उद्देश्य से बनाया गया है, जो TensorFlow और PyTorch जैसे फ़्रेमवर्क के लिए मूल समर्थन प्रदान करता है। यह बड़े पैमाने पर कंटेनरीकृत एमएल वर्कफ़्लो को संभालता है लेकिन इसके लिए कुबेरनेट्स विशेषज्ञता की आवश्यकता होती है और यह अभी भी विकासशील पारिस्थितिकी तंत्र के भीतर काम करता है, जो कंटेनर ऑर्केस्ट्रेशन में नई टीमों के लिए चुनौतीपूर्ण हो सकता है।

टेक्टन वास्तविक समय एमएल ऑर्केस्ट्रेशन और फीचर संचालन में माहिर है, जो इसे फीचर-केंद्रित वर्कफ़्लो के लिए बहुत उपयुक्त बनाता है। हालाँकि, इसका संकीर्ण फोकस और उच्च लागत व्यापक वर्कफ़्लो क्षमताओं की आवश्यकता वाली छोटी टीमों या परियोजनाओं के लिए उपयुक्त नहीं हो सकती है।

एज़्योर एमएल ऑर्केस्ट्रेशन एंटरप्राइज-स्केल एआई ऑर्केस्ट्रेशन के लिए एक मजबूत सूट प्रदान करता है, जो एज़्योर इकोसिस्टम के साथ कसकर एकीकृत है, जिसमें डेटा फैक्ट्री और सिनैप्स जैसे टूल शामिल हैं। इसकी उन्नत सुविधाएँ, जैसे Microsoft AutoGen और SynapseML, जटिल वितरित AI वर्कफ़्लो का समर्थन करती हैं। मुख्य चुनौतियों में विक्रेता लॉक-इन और मूल्य निर्धारण जटिलता शामिल है, जो लागत पूर्वानुमान को कठिन बना सकती है।

Google Vertex AI Pipelines benefits from Google’s global infrastructure, offering reliable performance and TPU support. However, its dependency on Google Cloud services and potential cost increases with heavy usage may deter some organizations.

नीचे दी गई तालिका प्रत्येक प्लेटफ़ॉर्म की प्राथमिक शक्तियों और सीमाओं पर प्रकाश डालती है:

Selecting the right platform depends on your organization’s priorities, technical expertise, and budget. For cost-conscious teams focused on LLM orchestration, Prompts.ai is a strong contender. If flexibility for traditional ML workflows is essential, Apache Airflow or Flyte may be better options. Enterprise teams already committed to specific cloud ecosystems might lean toward Azure ML or Vertex AI, despite concerns about vendor lock-in.

तकनीकी विशेषज्ञता एक अन्य महत्वपूर्ण कारक है। फ़्लाइट जैसे प्लेटफ़ॉर्म को कुबेरनेट्स ज्ञान की आवश्यकता होती है, जबकि प्रीफेक्ट ओरियन पायथन डेवलपर्स के लिए अधिक सुलभ है। न्यूनतम कॉन्फ़िगरेशन के साथ स्वचालन चाहने वाले संगठनों के लिए, डेटारोबोट एक सुव्यवस्थित समाधान प्रदान करता है लेकिन अनुकूलन को सीमित करता है।

अंततः, बजट संबंधी विचार महत्वपूर्ण भूमिका निभाते हैं। अपाचे एयरफ़्लो जैसे ओपन-सोर्स प्लेटफ़ॉर्म लागत बचत प्रदान करते हैं लेकिन सेटअप और रखरखाव के लिए अधिक आंतरिक संसाधनों की मांग करते हैं। वाणिज्यिक समाधान, हालांकि अधिक सुविधा संपन्न और समर्थित हैं, उच्च लाइसेंसिंग लागत के साथ आते हैं। अग्रिम खर्चों के अलावा, प्रशिक्षण, रखरखाव और संभावित विक्रेता निर्भरता सहित स्वामित्व की कुल लागत पर विचार करें।

Choosing the right machine learning orchestration platform requires a careful balance of your organization’s needs, resources, and expertise. Here’s a summary of the key takeaways from our in-depth platform reviews.

Prompts.ai एलएलएम ऑर्केस्ट्रेशन और लागत प्रबंधन में अपने नेतृत्व के लिए जाना जाता है। 35 से अधिक मॉडलों का समर्थन करने वाले एकीकृत इंटरफ़ेस और इसके भुगतान के रूप में भुगतान TOKN क्रेडिट प्रणाली के साथ, यह टूल फैलाव को कम करते हुए और संवेदनशील अनुप्रयोगों के लिए मजबूत प्रशासन बनाए रखते हुए 98% तक की बचत प्रदान करता है।

व्यापक मशीन लर्निंग वर्कफ़्लो लचीलापन चाहने वालों के लिए, अपाचे एयरफ़्लो अपने एमएल एक्सटेंशन के साथ एक मजबूत मल्टी-क्लाउड पारिस्थितिकी तंत्र प्रदान करता है। हालाँकि, स्केलिंग करते समय इसकी जटिलता अतिरिक्त संसाधनों और विशेषज्ञता की मांग कर सकती है।

It’s essential to evaluate the total cost of ownership. While open-source platforms like Apache Airflow have low upfront costs, they require significant internal resources. On the other hand, commercial platforms such as DataRobot and Domino Data Lab deliver extensive features but come with higher price tags. Match the platform to your team’s technical strengths - for example, Flyte is ideal for Kubernetes-savvy teams, Prefect Orion suits Python-centric groups, and automated solutions like DataRobot work well for minimal configuration needs.

विशिष्ट क्लाउड परिवेशों में गहराई से एकीकृत संगठनों के लिए, Azure ML Orchestration और Google Vertex AI पाइपलाइन जैसे प्लेटफ़ॉर्म सहज संगतता प्रदान करते हैं। हालाँकि, संभावित विक्रेता लॉक-इन और मूल्य निर्धारण चुनौतियों से सावधान रहें।

Ultimately, the best platform for your organization depends on your unique priorities - whether it’s cost efficiency, workflow flexibility, enterprise-grade features, or cloud integration. Carefully assess your use cases, team capabilities, and budget to make an informed decision.

When choosing a platform for machine learning orchestration, it’s important to zero in on a few crucial aspects: scalability, user-friendliness, and compatibility with your current tools. A good platform should simplify processes like data preprocessing, model training, deployment, and monitoring, while being flexible enough to match your team’s technical skills.

लागत स्पष्टता भी उतनी ही महत्वपूर्ण है - वास्तविक समय व्यय ट्रैकिंग जैसी सुविधाएं एआई-संबंधित बजट प्रबंधन को और अधिक कुशल बना सकती हैं। ऐसे प्लेटफार्मों की तलाश करें जो सुरक्षा, अनुपालन और नए मॉडलों के सहज एकीकरण पर जोर देते हैं, यह सुनिश्चित करते हुए कि आपकी आवश्यकताएं बढ़ने के साथ-साथ आपके वर्कफ़्लो सुचारू और अनुकूलनीय बने रहें।

Prompts.ai 35 से अधिक बड़े भाषा मॉडलों को एक सुव्यवस्थित मंच पर एक साथ लाकर लागत में 98% तक की प्रभावशाली कटौती प्रदान करता है। यह दृष्टिकोण कई उपकरणों की बाजीगरी से जुड़ी परेशानी और बर्बादी को दूर करता है।

प्लेटफ़ॉर्म में एक एकीकृत फिनऑप्स परत भी है, जो वास्तविक समय में लागतों की लगातार निगरानी और समायोजन करती है। यह सुनिश्चित करता है कि असाधारण एआई प्रदर्शन को बनाए रखते हुए व्यवसायों को उनके निवेश से अधिकतम मूल्य मिले।

Open-source platforms like Apache Airflow and Kubeflow offer robust solutions for orchestrating machine learning workflows, but they aren’t without their hurdles. One notable issue is performance - users may encounter slower execution speeds and heightened latency, which can impact overall efficiency. Furthermore, their intricate architectures can introduce dependency bloat, leading to longer build times and additional complexity.

एक और चुनौती इन प्लेटफार्मों को विभिन्न निष्पादन परिवेशों के साथ एकीकृत करने में है। अनुकूलता सुनिश्चित करने के लिए अक्सर उच्च स्तर की विशेषज्ञता और काफी प्रयास की आवश्यकता होती है। कुशल संसाधन प्रबंधन भी एक समस्या बन सकता है, खासकर जब वर्कफ़्लो को स्केल करना या अद्वितीय कम्प्यूटेशनल आवश्यकताओं को संबोधित करना। हालाँकि ये प्लेटफ़ॉर्म बहुत अधिक लचीलापन प्रदान करते हैं, फिर भी वे हमेशा हर परिदृश्य के लिए सबसे उपयुक्त नहीं हो सकते हैं।