AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Plongez plus profondément pour trouver le cadre adapté à votre équipe et à vos flux de travail.

Prompts.ai sert de plate-forme centralisée basée sur le cloud connectant les utilisateurs d'entreprise à plus de 35 modèles d'IA de premier plan, notamment GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro et Kling, tous accessibles via une interface unique. Aucune installation de logiciel n'est requise, ce qui permet aux équipes de toute taille d'intégrer facilement l'IA dans leurs flux de travail.

La plateforme s’attaque à un défi majeur dans l’adoption de l’IA : la prolifération des outils. En fournissant un environnement unifié, il consolide la sélection de modèles, les flux de travail rapides et le suivi des performances dans un seul système. Cette approche fait passer l’utilisation de l’IA d’expériences ponctuelles et dispersées à des processus cohérents et évolutifs que les organisations peuvent facilement déployer dans tous les départements.

Prompts.ai se concentre sur l'automatisation des flux de travail d'IA d'entreprise, aidant les organisations à réduire les coûts inutiles tout en répondant aux problèmes de gouvernance. Des entreprises Fortune 500 aux agences de création et laboratoires de recherche, les utilisateurs peuvent créer des flux de travail conformes et vérifiables sans risquer d'exposer des données sensibles à plusieurs services tiers.

La plateforme a été reconnue par GenAI.Works comme la meilleure solution d'IA pour la résolution de problèmes et l'automatisation en entreprise, avec une note utilisateur impressionnante de 4,8 sur 5. Les entreprises s'appuient sur Prompts.ai pour des tâches telles que la rationalisation de la création de contenu, l'automatisation des flux de travail stratégiques et l'accélération du développement des propositions. Dans certains cas, des projets qui prenaient des semaines ont été réduits à une seule journée.

Un exemple notable vient de mai 2025, lorsque Johannes Vorillon, directeur indépendant de l’IA, a utilisé la plateforme pour intégrer de manière transparente les animations Google DeepMind Veo2 dans une vidéo promotionnelle pour Breitling et l’armée de l’air française. Ce projet a mis en évidence comment Prompts.ai permet une orchestration fluide de plusieurs outils d'IA.

Prompts.ai simplifie la façon dont les équipes travaillent avec l'IA en intégrant l'accès à plus de 35 modèles de langage et d'image via une interface unique. Cela élimine les tracas liés à la gestion de plusieurs abonnements, clés API et systèmes de facturation. Les utilisateurs peuvent combiner différents modèles pour des tâches spécifiques au sein d'un seul flux de travail, créant ainsi des pipelines d'orchestration transparents.

La plate-forme fonctionne sur un système de crédit TOKN, qui standardise l'utilisation sur tous les modèles, simplifiant ainsi le suivi des coûts et l'allocation des ressources. Les équipes peuvent basculer entre les modèles selon leurs besoins, en fonction des exigences de performances. Les forfaits professionnels incluent un nombre illimité d’espaces de travail et de collaborateurs, ce qui permet aux organisations d’adopter plus facilement l’IA.

Avec un modèle de tarification à l'utilisation, Prompts.ai aligne les coûts sur l'utilisation réelle, à partir de 0 $/mois pour l'exploration initiale. Les forfaits professionnels, allant de 99 $ à 129 $ par membre et par mois, offrent différents niveaux de crédits TOKN (250 000 à 1 000 000) et 10 Go de stockage cloud à tous les niveaux.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 juin 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

Les plans d'affaires (Core, Pro et Elite) incluent des outils de surveillance de la conformité et d'administration de la gouvernance, offrant une visibilité complète sur les interactions de l'IA et conservant des pistes d'audit détaillées pour répondre aux exigences réglementaires. Même les petites équipes et les professionnels individuels utilisant les forfaits Personal Creator et Family bénéficient de ces fonctionnalités de gouvernance de niveau entreprise.

Les données sensibles sont conservées dans un environnement centralisé et contrôlé, réduisant ainsi les risques associés à la diffusion d'informations entre plusieurs services tiers. Cette architecture sécurisée minimise non seulement les vulnérabilités potentielles, mais simplifie également la gestion de la conformité pour les organisations opérant sous des réglementations strictes.

Conçu avec une architecture cloud native, Prompts.ai permet aux organisations d'évoluer sans effort. Les équipes peuvent ajouter de nouveaux membres, étendre les espaces de travail et accéder à des modèles supplémentaires en quelques minutes, garantissant ainsi que l'adoption de l'IA peut se développer aussi rapidement que nécessaire.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI propose une solution d'automatisation des flux de travail alimentée par des interfaces conversationnelles. Bien que les détails spécifiques sur son architecture de déploiement et ses méthodes d'orchestration ne soient pas accessibles au public, l'accent mis sur les interfaces conversationnelles met en évidence un angle unique dans la rationalisation de l'automatisation des flux de travail.

IBM Watsonx Orchestrate apporte l'automatisation basée sur l'IA aux opérations de l'entreprise, en s'efforçant de rendre l'automatisation accessible aux professionnels plutôt qu'aux seuls développeurs. En permettant aux utilisateurs d'émettre des commandes en langage naturel, la plateforme simplifie les tâches complexes pour les équipes non techniques des ressources humaines, des finances, des ventes, du support client et des achats. Cette approche supprime le besoin d’expertise en codage, permettant aux équipes commerciales d’automatiser les processus de manière indépendante.

La plateforme brille dans l’automatisation des tâches répétitives qui font souvent perdre du temps aux employés. Avec des commandes linguistiques simples, les utilisateurs peuvent lancer des flux de travail pour des tâches telles que la planification d'entretiens, la synthèse des profils de candidats, le traitement des prêts et la génération de rapports. watsonx Orchestrate gère ces activités sur plusieurs systèmes backend tout en adhérant aux normes de sécurité de niveau entreprise.

Par exemple, une grande institution financière a mis en œuvre Watsonx Orchestrate pour rationaliser les fonctions de support client et de back-office. Les employés ont utilisé des saisies en langage naturel pour automatiser les flux de travail pour le traitement des prêts et les demandes de service. La plateforme s'est intégrée de manière transparente aux systèmes back-end, a maintenu la conformité grâce à une gouvernance intégrée et a apporté des améliorations notables : des temps de traitement plus rapides, moins d'erreurs manuelles et une plus grande satisfaction des clients. Cet exemple met en évidence la capacité de la plateforme à transformer les tâches courantes de l'entreprise en processus efficaces et automatisés.

IBM Watsonx Orchestrate propose des options de déploiement dans le cloud hybride, permettant aux flux de travail de s'exécuter dans le cloud, sur site ou dans les deux. Cette flexibilité est particulièrement précieuse pour les organisations ayant des politiques strictes de résidence des données ou une infrastructure existante. La plateforme exploite des modèles de langage étendus (LLM), des API et des applications d'entreprise pour exécuter des tâches en toute sécurité, garantissant ainsi la compatibilité avec divers environnements opérationnels.

watsonx Orchestrate s'intègre de manière transparente à divers systèmes, ce qui en fait une solution robuste pour l'automatisation d'entreprise. Il se connecte aux plateformes CRM, ERP et cloud comme AWS et Azure à l'aide de connecteurs visuels et d'API. De plus, il travaille en étroite collaboration avec les services IBM Watson et d'autres modèles IBM AI, étendant ses capacités au-delà de l'automatisation de base des flux de travail. Pour les utilisateurs avancés, l’accès programmatique à l’API permet une personnalisation et une intégration plus poussées avec les outils existants.

__XLATE_18__

« IBM Watsonx Orchestrate est conçu pour intégrer l'automatisation basée sur l'IA directement dans les flux de travail de l'entreprise. Contrairement aux outils centrés sur les développeurs, Watsonx Orchestrate cible les professionnels des ressources humaines, de la finance, des ventes et du support client qui souhaitent rationaliser les tâches sans codage lourd. -Domo

La plateforme comprend également des applications d'IA prédéfinies et des ensembles de compétences spécifiques au secteur, permettant une mise en œuvre plus rapide pour les cas d'utilisation courants. Cependant, les organisations doivent noter que ses fonctionnalités peuvent être plus limitées en dehors de l'écosystème IBM par rapport aux plates-formes offrant des options d'intégration plus larges.

IBM Watsonx Orchestrate se distingue par son cadre de gouvernance solide, ce qui en fait un choix privilégié pour les secteurs réglementés. Les contrôles d'accès basés sur les rôles garantissent que l'accès aux données est limité aux utilisateurs autorisés et à des fonctionnalités spécifiques.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

Conçu pour évoluer dans des environnements hybrides, Watsonx Orchestrate prend en charge à la fois les petites équipes et les grandes entreprises. Il améliore l'efficacité opérationnelle, garantit la conformité aux politiques, atténue les risques et augmente la productivité des employés. Les organisations peuvent commencer modestement - en se concentrant sur des départements spécifiques - et étendre progressivement leurs capacités d'automatisation à mesure qu'elles obtiennent des résultats et développent une expertise interne.

Apache Airflow est une plate-forme open source conçue pour orchestrer des flux de données complexes à l'aide de graphiques acycliques dirigés (DAG). Initialement développé par Airbnb et maintenant sous l'Apache Software Foundation, il est devenu un choix populaire pour la planification, la surveillance et la gestion des pipelines de données. Contrairement aux outils d'automatisation conçus pour les utilisateurs professionnels, Airflow est conçu pour les ingénieurs de données et les développeurs, offrant un contrôle programmatique sur l'exécution des flux de travail.

Airflow brille dans la gestion des pipelines de données qui impliquent des dépendances complexes, des tâches planifiées et une logique de transformation. Les équipes de données s'en servent à diverses fins, notamment pour coordonner les processus ETL (Extract, Transform, Load), former des modèles d'apprentissage automatique, exécuter des tâches de traitement par lots, ingérer des données provenant de plusieurs sources, transformer des ensembles de données et générer des rapports selon un calendrier. En définissant des flux de travail en Python, les développeurs bénéficient d'une grande flexibilité pour implémenter une logique personnalisée et gérer efficacement les erreurs.

La plateforme comprend une interface visuelle qui fournit des informations sur l'état du flux de travail, les dépendances des tâches et l'historique d'exécution. Cela facilite la surveillance des performances et le dépannage des pannes. Par exemple, si une tâche échoue, Airflow peut automatiquement la réessayer, envoyer des alertes ou ignorer les tâches suivantes pour éviter les problèmes en cascade. Cette fonctionnalité en fait un choix polyvalent pour différents besoins de déploiement.

Airflow peut être déployé sous la forme d'une configuration sur un seul serveur ou adapté à des clusters distribués, où le planificateur, les travailleurs et le serveur Web fonctionnent sur des machines distinctes. L'architecture est composée de plusieurs composants clés : un planificateur qui déclenche des tâches en fonction de plannings définis, des travailleurs qui exécutent des tâches, un serveur Web pour l'interface utilisateur et une base de données de métadonnées qui stocke les définitions de flux de travail et l'historique d'exécution.

Cette conception modulaire permet aux organisations d'adapter la capacité des employés de manière indépendante, en fonction des exigences de la charge de travail. Dans les environnements cloud natifs, Kubernetes est souvent utilisé pour déployer Airflow, KubernetesExecutor créant des pods isolés pour des tâches individuelles. Cette configuration améliore l'isolation des ressources et permet aux équipes d'allouer des ressources de calcul spécifiques pour chaque tâche. Pour ceux qui cherchent à réduire les frais de gestion de l’infrastructure, des services Airflow gérés sont disponibles, bien qu’ils entraînent des coûts opérationnels supplémentaires.

Les capacités d'intégration étendues d'Airflow le rendent hautement adaptable. Il propose des connecteurs prédéfinis pour les bases de données, les plates-formes cloud, les entrepôts de données et les systèmes de messagerie, ainsi que la possibilité de créer des opérateurs personnalisés à l'aide de Python. Cette flexibilité garantit qu’Airflow peut répondre à diverses exigences organisationnelles.

Le riche écosystème de bibliothèques de Python peut également être exploité dans les flux de travail, permettant des transformations et des analyses avancées de données directement dans les définitions de pipeline. Pour les applications d'IA et d'apprentissage automatique, Airflow s'intègre parfaitement à des frameworks tels que TensorFlow, PyTorch et scikit-learn. Ces intégrations aident les data scientists à orchestrer les flux de travail pour des tâches telles que la récupération de données, les fonctionnalités de prétraitement, la formation de modèles, l'évaluation des performances et le déploiement de modèles en production.

Airflow inclut un contrôle d'accès basé sur les rôles (RBAC) pour gérer les autorisations des utilisateurs dans les flux de travail et les fonctions administratives. Les administrateurs peuvent définir des rôles avec des privilèges spécifiques, garantissant que seuls les utilisateurs autorisés peuvent afficher, modifier ou exécuter certains DAG. Ce contrôle granulaire permet de maintenir l’intégrité du flux de travail et d’empêcher les modifications non autorisées.

Les options d'authentification incluent la connexion par mot de passe, l'intégration LDAP et les fournisseurs OAuth. Les informations d'identification sensibles sont gérées séparément via le système de connexions et de variables d'Airflow. Pour une sécurité renforcée, des outils externes de gestion des secrets tels que HashiCorp Vault ou AWS Secrets Manager peuvent être intégrés.

La journalisation d'audit est une autre fonctionnalité clé, permettant de suivre les actions des utilisateurs et les exécutions de flux de travail. Cela crée un enregistrement détaillé de l'activité, ce qui est inestimable à des fins de conformité et de dépannage.

Airflow évolue horizontalement en ajoutant davantage de nœuds de travail pour gérer des charges de travail accrues. La plate-forme prend en charge plusieurs types d'exécuteurs pour répartir les tâches efficacement : le LocalExecutor exécute les tâches sur la même machine que le planificateur, le CeleryExecutor répartit les tâches sur plusieurs machines de travail à l'aide d'une file d'attente de messages et le KubernetesExecutor fait tourner des pods isolés pour chaque tâche.

Pour optimiser les performances, une conception minutieuse du DAG et une allocation des ressources sont essentielles. Des volumes de tâches élevés peuvent mettre à rude épreuve le planificateur, de sorte que les équipes divisent souvent les grands DAG, ajustent les paramètres du planificateur et s'assurent que le magasin de métadonnées dispose de ressources suffisantes.

Airflow gère également efficacement les remplissages, permettant aux équipes de retraiter les données historiques lorsque la logique du flux de travail change. Bien que le remplissage rationalise les mises à jour, il peut consommer des ressources de calcul importantes, ce qui nécessite une planification minutieuse pour éviter toute interruption des charges de travail de production.

Étant open source, Airflow donne aux organisations un contrôle total sur leurs déploiements. Cependant, cela signifie également qu'ils doivent gérer l'infrastructure, la surveillance et les mises à niveau, ce qui nécessite des ressources d'ingénierie dédiées pour maintenir la fiabilité et les performances à grande échelle.

Kubeflow se distingue comme une plate-forme dédiée à la gestion des flux de travail d'apprentissage automatique, distincte des outils de flux de travail plus généraux. Conçue spécifiquement pour Kubernetes, cette solution open source prend en charge le cycle de vie complet de l'apprentissage automatique, offrant aux data scientists et aux ingénieurs ML les outils dont ils ont besoin pour créer, déployer et gérer des modèles prêts pour la production à l'aide des fonctionnalités natives de Kubernetes.

Kubeflow est conçu pour orchestrer des flux de travail complets d'apprentissage automatique dans les environnements Kubernetes. Il couvre chaque étape du cycle de vie du ML, y compris le prétraitement des données, l'ingénierie des fonctionnalités, la formation des modèles, la validation, le déploiement et la surveillance. En permettant aux équipes de créer des pipelines modulaires et réutilisables, Kubeflow simplifie la gestion des charges de travail de ML distribuées. Son approche centralisée facilite également le suivi des expériences et la surveillance des modèles dans divers projets. De plus, Kubeflow peut automatiser les flux de travail de recyclage lorsque de nouvelles données sont introduites, garantissant ainsi que les modèles restent à jour et pertinents.

Construit sur Kubernetes, Kubeflow exploite l'orchestration des conteneurs, la mise à l'échelle dynamique et la gestion des ressources pour optimiser les flux de travail de ML. Les utilisateurs peuvent interagir avec la plateforme via une interface Web pour la gestion visuelle ou une interface de ligne de commande pour l'automatisation. En fonction de la charge de travail, Kubeflow alloue dynamiquement des ressources, telles que le provisionnement de GPU pour les tâches de formation et de CPU pour l'inférence. Sa flexibilité permet un déploiement sur n'importe quel cluster Kubernetes, que ce soit sur site, dans le cloud ou dans des configurations hybrides, garantissant ainsi l'adaptabilité entre les environnements.

Kubeflow s'intègre parfaitement aux frameworks d'apprentissage automatique populaires tels que TensorFlow, PyTorch et XGBoost, tout en prenant également en charge les frameworks personnalisés grâce à sa conception extensible. Au-delà des frameworks ML, il se connecte à divers services cloud et solutions de stockage, permettant aux pipelines d'accéder au stockage d'objets pour les données, aux entrepôts de données pour la récupération de fonctionnalités et aux outils de surveillance pour le suivi des performances. Sa compatibilité avec les bibliothèques Python rationalise encore davantage la transition de l'expérimentation à la production.

Kubeflow utilise les capacités de mise à l'échelle inhérentes à Kubernetes pour répartir les charges de travail sur les ressources du cluster, ce qui le rend parfaitement adapté aux tâches de formation et de traitement de données à grande échelle. Cela garantit une utilisation efficace des ressources et prend en charge les opérations de ML hautes performances. Comme Akka l’a dit avec justesse :

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Grâce à sa capacité à allouer les ressources de manière indépendante, Kubeflow comble le fossé entre l'expérimentation et la production, offrant à la fois flexibilité et performances.

Flyte est une plate-forme d'orchestration cloud native conçue pour rationaliser la gestion des flux de travail d'apprentissage automatique (ML) conteneurisés à l'aide de Kubernetes. Cela simplifie le déploiement de pipelines ML en distribuant efficacement les ressources dans les environnements cloud. Cette approche garantit une mise à l’échelle fluide et des performances cohérentes, quelle que soit la taille du déploiement.

Flyte est conçu pour gérer les flux de travail ML de toute échelle, en allouant dynamiquement des ressources pour répondre à diverses demandes. Son architecture robuste garantit une gestion efficace des charges de travail, ce qui en fait un choix fiable pour un large éventail de tâches de ML sur les infrastructures basées sur le cloud.

Prefect est une plate-forme d'orchestration basée sur Python conçue pour simplifier la gestion des pipelines de données complexes et des flux de travail d'apprentissage automatique. Il se concentre sur la facilité d'utilisation, une surveillance claire et la minimisation des obstacles opérationnels, permettant aux data scientists et aux ingénieurs de se concentrer sur la création de flux de travail au lieu de se soucier de l'infrastructure.

Prefect brille dans l'automatisation des pipelines d'apprentissage automatique, des flux de travail cloud et des processus de transformation des données. Il est particulièrement adapté à la gestion des tâches ETL et des flux de travail d'apprentissage automatique complexes impliquant de multiples dépendances, des exécutions parallèles et un traitement en temps réel. Son système de planification flexible permet de déclencher des tâches en fonction d'intervalles de temps, d'événements spécifiques ou d'appels API, ce qui le rend adaptable à une variété de besoins d'automatisation.

Prefect est optimisé pour les environnements cloud, garantissant qu'il peut évoluer et s'adapter aux demandes d'infrastructure modernes. Construit nativement en Python, il s'intègre parfaitement aux écosystèmes de données basés sur Python, éliminant ainsi le besoin d'apprendre de nouveaux langages ou outils de programmation.

Prefect offre une compatibilité transparente avec une large gamme d'outils et de plateformes de données. Il s'intègre sans effort aux outils populaires tels que dbt, PostgreSQL, Snowflake et Looker, tout en prenant également en charge les systèmes en temps réel tels qu'Apache Kafka. Pour les environnements cloud, il fonctionne avec des fournisseurs majeurs tels qu'Amazon Web Services (AWS), Google Cloud Platform (GCP) et Microsoft Azure, offrant ainsi aux équipes la flexibilité nécessaire pour optimiser les charges de travail en fonction du coût et des performances. De plus, Prefect prend en charge les outils de conteneurisation tels que Docker et Kubernetes et fonctionne avec des frameworks de traitement distribué tels que Dask et Apache Spark. Pour tenir les équipes informées, il fournit également des notifications Slack pour les mises à jour du flux de travail.

Prefect est conçu pour gérer facilement des volumes de données croissants et une complexité croissante des flux de travail. Son moteur tolérant aux pannes garantit que les flux de travail peuvent récupérer des erreurs en réessayant les tâches ayant échoué ou en contournant les problèmes, ce qui le rend extrêmement fiable dans les environnements de production. La surveillance en temps réel offre des informations détaillées sur l'exécution des flux de travail, aidant ainsi les équipes à identifier et à résoudre rapidement les problèmes. Grâce à sa capacité à évoluer efficacement, Prefect bénéficie de la confiance des grandes entreprises technologiques pour gérer des flux de travail dynamiques. Pour les équipes qui débutent, Prefect propose un forfait gratuit, tandis que des tarifs personnalisés sont disponibles pour les déploiements plus importants nécessitant des fonctionnalités et une assistance supplémentaires.

Metaflow est une plate-forme d'infrastructure d'apprentissage automatique initialement développée par Netflix pour relever les défis liés à la mise à l'échelle des flux de travail d'apprentissage automatique. Il vise à rendre les processus conviviaux et efficaces, en aidant les data scientists à passer facilement des prototypes à la production sans avoir à gérer une infrastructure complexe.

Metaflow est conçu pour gérer des flux de travail d'apprentissage automatique évolutifs au niveau de la production. Il simplifie le parcours depuis l’analyse exploratoire des données et la formation du modèle jusqu’au déploiement. Les data scientists peuvent écrire des flux de travail en Python à l'aide de bibliothèques familières, tandis que la plate-forme s'occupe de la gestion des versions, de la gestion des dépendances et de l'allocation automatique des ressources de calcul.

La plateforme supprime le besoin de gestion manuelle de l'infrastructure en provisionnant automatiquement les ressources de calcul requises. Cela permet un passage transparent du développement local à la production cloud sans nécessiter aucune modification du code.

__XLATE_53__

« Metaflow orchestre des workflows de ML évolutifs avec simplicité en offrant des intégrations cloud rationalisées, une gestion des versions robuste et une abstraction de l'infrastructure pour un déploiement prêt pour la production. » - Akka.io

Le processus de déploiement de Metaflow est complété par sa capacité à s'intégrer facilement aux services cloud et aux plateformes de données. Sa conception native Python garantit la compatibilité avec les bibliothèques largement utilisées pour l'apprentissage automatique, le traitement des données et la visualisation, permettant aux équipes d'optimiser les outils sur lesquels elles s'appuient déjà.

Créé à l'origine par Netflix pour prendre en charge de nombreuses opérations d'apprentissage automatique, Metaflow dispose d'un puissant système de gestion de versions. Ce système suit les expériences, les ensembles de données et les versions de modèles, garantissant que les expériences sont reproductibles et permettant des restaurations faciles en cas de besoin.

Dagster complète la gamme de frameworks d'orchestration en se concentrant sur le maintien de l'intégrité des données tout en offrant une gestion adaptable des pipelines. Cet outil open source est conçu pour améliorer la qualité, suivre le traçage des données et garantir la visibilité dans les flux de travail d'apprentissage automatique (ML). À la base, Dagster se spécialise dans la création de pipelines de données fiables et sécurisés qui respectent des normes élevées d’intégrité des données et fournissent des informations claires sur les transformations.

Dagster est particulièrement efficace pour gérer les flux de travail ML où la qualité et la précision des données ne sont pas négociables. Il est conçu pour les équipes qui ont besoin d'une validation intégrée, d'un suivi robuste des métadonnées et d'une observabilité complète tout au long de leurs processus. Un exemple pratique de son utilité peut être vu dans le secteur de la santé, où les organisations s'appuient sur Dagster pour traiter les données de santé sensibles avec le niveau d'intégrité requis pour répondre à des critères stricts de conformité et de qualité.

Dagster permet aux développeurs de définir des flux de travail complexes directement dans le code, une fonctionnalité essentielle pour faire évoluer les opérations d'IA. Sa structure modulaire prend en charge le chaînage de modèles et d'agents pour créer des flux de travail avancés, complétés par une gestion automatisée des dépendances, des mécanismes de nouvelle tentative et une exécution parallèle. De plus, Dagster s'intègre parfaitement à diverses plates-formes cloud, API et bases de données vectorielles, ce qui le rend parfaitement adapté à la gestion de données et de tâches d'IA à grande échelle.

Cette architecture flexible garantit une intégration fluide avec divers systèmes.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen est un framework open source développé par Microsoft Research qui permet à plusieurs agents d'IA de collaborer par le biais de conversations pour résoudre des tâches complexes. Ce système permet aux développeurs de créer des applications dans lesquelles des agents spécialisés travaillent ensemble, chacun apportant son expertise unique pour atteindre des objectifs communs. En introduisant une interface conversationnelle, AutoGen simplifie le processus souvent complexe de coordination de plusieurs composants d'IA.

AutoGen introduit une nouvelle approche de l'orchestration multi-agents en tirant parti du dialogue comme moyen de collaboration. Ce cadre est particulièrement efficace dans les scénarios de résolution de problèmes qui nécessitent que plusieurs agents travaillent ensemble de manière dynamique. Par exemple, dans le développement de logiciels, un agent peut générer du code tandis qu'un autre se concentre sur les tests et la validation, les deux agents itérant pour affiner le résultat. Ce modèle conversationnel convient naturellement à des tâches telles que l'automatisation des flux de travail logiciels, l'aide à la recherche et la gestion de processus décisionnels complexes où diverses perspectives ou compétences améliorent les résultats.

Les équipes visant une amélioration itérative de leurs flux de travail trouvent AutoGen particulièrement attrayant. Sa capacité à faciliter les échanges entre agents reflète la collaboration humaine, permettant aux développeurs de concevoir plus facilement des systèmes qui évoluent et s'améliorent grâce à un dialogue et des commentaires continus.

AutoGen met l'accent sur la modularité tout en se démarquant par sa conception d'agent conversationnel. Chaque agent fonctionne avec des rôles et des instructions spécifiques, qui peuvent inclure l'accès à des outils, des API externes ou des modèles de langage. Le framework prend en charge à la fois les agents autonomes et les agents proxy utilisateur qui intègrent la contribution humaine, offrant ainsi une flexibilité dans la gestion des flux de travail.

Le système peut s'exécuter localement pendant le développement et s'adapter aux environnements cloud pour la production. Les développeurs peuvent définir la manière dont les agents interagissent, que ce soit par le biais de flux de travail séquentiels dans lesquels les agents se relaient ou de modèles plus complexes dans lesquels plusieurs agents contribuent simultanément. Grâce aux configurations basées sur Python, les équipes obtiennent un contrôle total sur la logique d'orchestration sans sacrifier la lisibilité, rationalisant ainsi le processus de gestion des interactions multi-agents.

AutoGen gère les complexités liées à la gestion de plusieurs appels de modèles et conversations d'agents, permettant aux développeurs de se concentrer sur l'élaboration de la logique et du comportement de leurs systèmes plutôt que de se soucier de l'infrastructure.

AutoGen s'intègre de manière transparente à Azure OpenAI Service et à d'autres modèles via des appels de fonction, offrant ainsi aux développeurs la flexibilité de sélectionner les backends d'IA. Il prend également en charge la connexion des agents à des outils et services externes, leur permettant de récupérer des données, d'exécuter du code ou d'interagir avec des API tierces au cours de leurs conversations.

Le framework permet aux développeurs de créer des types d'agents personnalisés, des modèles de conversation réutilisables et des modèles d'orchestration. Cette flexibilité signifie que les équipes peuvent exploiter des modèles préexistants pour des tâches courantes tout en les personnalisant en profondeur pour des besoins spécialisés.

Pour les organisations utilisant déjà des outils Microsoft, AutoGen offre une intégration facile avec les services Azure, Visual Studio Code et d'autres plateformes de développement. Malgré cet alignement avec l'écosystème Microsoft, le framework est indépendant de la plate-forme et fonctionne bien dans une variété d'environnements technologiques.

AutoGen met fortement l'accent sur le contrôle des capacités des agents et la gestion de l'accès aux ressources externes. Les développeurs définissent des autorisations spécifiques pour chaque agent, telles que les API auxquelles ils peuvent accéder ou les données qu'ils sont autorisés à récupérer. Cette approche granulaire garantit que les agents fonctionnent selon les principes du moindre privilège, en effectuant uniquement les tâches nécessaires à leurs rôles.

La nature conversationnelle du cadre crée intrinsèquement des pistes d’audit, enregistre les interactions des agents et les processus de prise de décision. Ces journaux assurent la transparence sur la manière dont les sorties sont générées, facilitant ainsi les efforts de conformité et de débogage. Les équipes peuvent consulter ces enregistrements pour analyser le comportement des agents et identifier les domaines à affiner.

Les capacités humaines dans la boucle améliorent la surveillance en permettant aux flux de travail de s'arrêter pour un examen humain aux points de décision critiques. Cette fonctionnalité garantit que les actions sensibles peuvent être évaluées avant de continuer, équilibrant ainsi l'efficacité de l'automatisation avec la gouvernance et le contrôle.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

Les organisations peuvent améliorer leurs performances en mettant en cache le contexte des conversations, en utilisant des modèles plus rapides pour les tâches de routine et en réservant des modèles plus avancés pour les raisonnements complexes. Concevoir des modèles de conversation pour minimiser les échanges inutiles améliore également l’efficacité. Le cas échéant, le framework prend en charge l'exécution d'agents parallèles, permettant à des tâches indépendantes de s'exécuter simultanément plutôt que séquentiellement.

Pour gérer des charges de travail élevées, AutoGen peut être déployé sur une infrastructure cloud à mise à l'échelle automatique, garantissant que le système peut gérer diverses demandes tout en maîtrisant les coûts. Les interactions entre agents sans état simplifient la mise à l'échelle horizontale, même si le maintien du contexte entre les échanges nécessite une planification réfléchie de l'architecture.

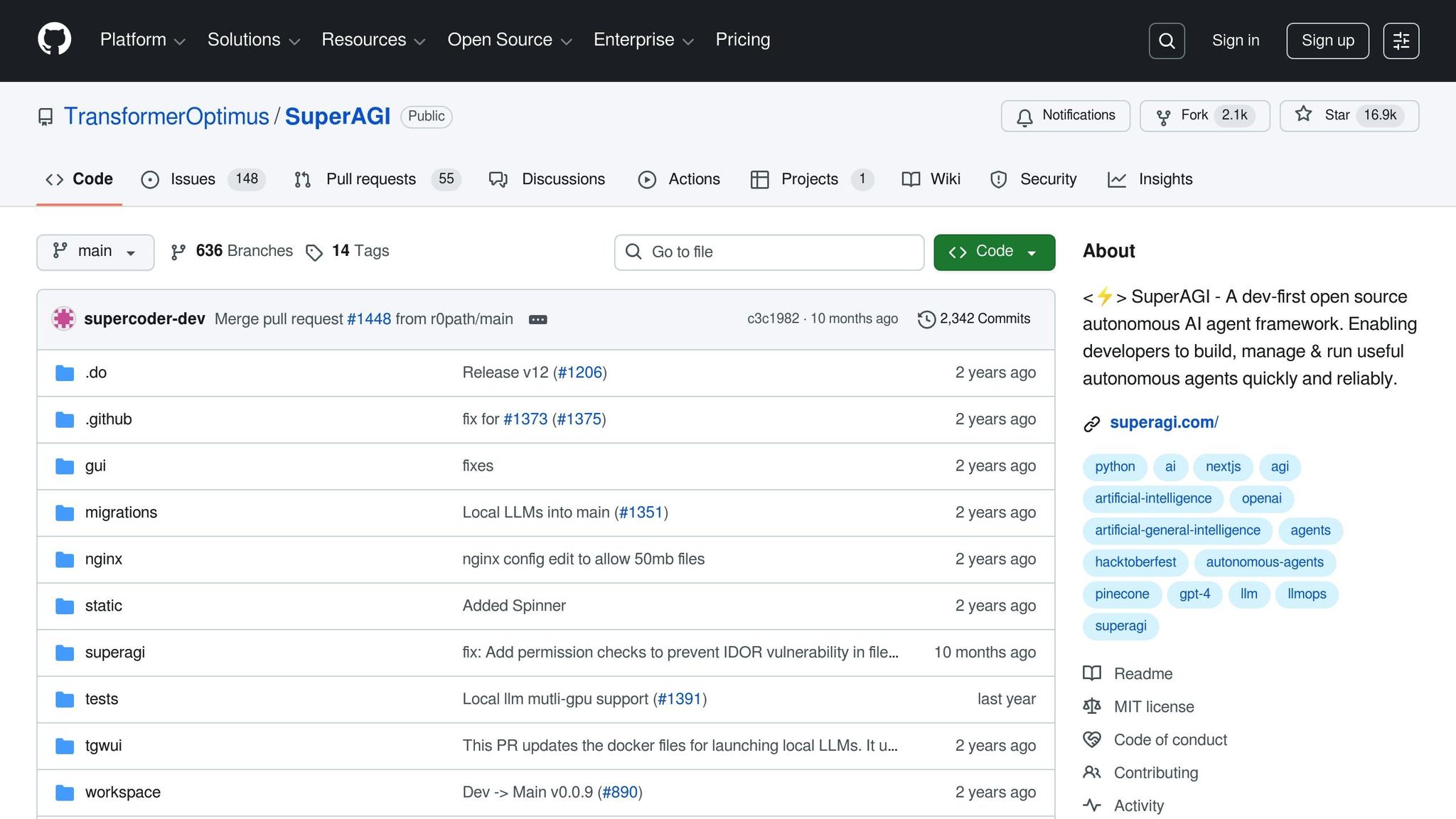

S'appuyant sur les frameworks d'orchestration que nous avons explorés, SuperAGI introduit une nouvelle façon de gérer la collaboration multi-agents. Cette plate-forme open source est conçue pour coordonner des agents d'IA autonomes, permettant aux développeurs de créer, déployer et superviser des agents capables de planifier, d'exécuter et de s'adapter aux tâches grâce à un apprentissage continu. SuperAGI permet à plusieurs agents de travailler ensemble de manière transparente, en déléguant dynamiquement des tâches et en collaborant pour relever des défis complexes. Il fusionne la gestion adaptative des tâches avec le travail d’équipe multi-agents, ce qui le distingue comme un outil puissant pour l’orchestration avancée de l’IA.

SuperAGI brille dans l'automatisation de tâches complexes et évolutives pour les entreprises. Ses réseaux d'agents excellent dans la planification et l'exécution avancées de tâches, s'améliorant continuellement grâce à l'apprentissage par renforcement et aux boucles de rétroaction. Cela le rend particulièrement utile pour les organisations gérant des opérations à grande échelle, où une coordination intelligente est essentielle. Les agents de la plateforme apprennent de leurs interactions et de leurs résultats, ce qui leur permet d'affiner leur comportement au fil du temps.

La fonctionnalité remarquable de la plateforme est sa délégation dynamique des tâches. Au lieu de s'en tenir à des flux de travail rigides, les agents évaluent les situations en temps réel, identifient les tâches prioritaires et les assignent aux membres du réseau les plus appropriés. Cette flexibilité garantit que les ressources sont allouées efficacement, même dans des scénarios complexes.

L'architecture de SuperAGI est conçue avec l'évolutivité et la modularité en son cœur. Les développeurs peuvent facilement étendre leurs réseaux d'agents et leurs charges de travail pour répondre à divers besoins d'applications. Chaque agent fonctionne de manière indépendante, mais communique de manière transparente, garantissant une collaboration fluide.

Une interface graphique conviviale permet aux équipes de visualiser les interactions des agents et d'affiner les configurations. Les tableaux de bord de surveillance fournissent des informations sur les performances des agents, aidant ainsi les développeurs à identifier et à résoudre les inefficacités. La plateforme prend également en charge l'exécution parallèle, permettant à plusieurs agents de gérer simultanément des tâches indépendantes. Cette conception augmente considérablement le débit, en particulier dans les environnements à forte demande.

SuperAGI propose un système de plug-in extensible qui s'intègre à des API tierces, des outils de flux de travail et des modules personnalisés. Cette flexibilité accélère le développement et encourage les contributions de la communauté des développeurs au sens large, enrichissant ainsi les capacités de la plateforme.

L'architecture distribuée et modulaire de la plateforme prend en charge la mise à l'échelle horizontale, ce qui la rend adaptable aux implémentations à grande échelle. Son utilisation de l’apprentissage par renforcement et des boucles de rétroaction améliore les performances globales, garantissant ainsi une allocation efficace des tâches. En permettant une collaboration efficace et un débit élevé, SuperAGI convient parfaitement aux organisations qui exigent des performances robustes dans des scénarios complexes et à volume élevé.

Choisir le bon framework d’orchestration d’IA signifie comprendre les forces et les limites de chaque option. Ces plates-formes sont conçues avec différentes priorités à l'esprit, répondant à des besoins tels que la sécurité au niveau de l'entreprise, l'adaptabilité des développeurs ou des flux de travail spécialisés tels que les pipelines d'apprentissage automatique. Chaque framework reflète sa philosophie de conception unique et ses cas d'utilisation cibles.

Par exemple, des plates-formes comme Prompts.ai excellent dans la centralisation de l'accès aux grands modèles de langage (LLM), tandis que des outils comme Apache Airflow et Prefect se concentrent sur l'automatisation générale des flux de travail. D'un autre côté, Kubeflow et Flyte sont conçus pour les pipelines d'apprentissage automatique, et des frameworks comme SuperAGI et Microsoft AutoGen repoussent les limites de la collaboration multi-agents en matière d'IA en permettant aux systèmes autonomes de gérer ensemble des tâches complexes.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Structures de coûts : les plates-formes traditionnelles facturent souvent par utilisateur ou par exécution, ce qui peut entraîner des coûts plus élevés à mesure que les opérations se développent. En revanche, Prompts.ai utilise un modèle de paiement à l'utilisation avec des crédits TOKN, liant directement les dépenses à l'utilisation. Cette approche est particulièrement utile lors de l'expérimentation de différents modèles ou de la gestion de charges de travail fluctuantes.

Sécurité et conformité : pour des secteurs comme la santé ou la finance, des mesures de sécurité robustes sont essentielles. Des plates-formes telles que Prompts.ai, IBM Watsonx Orchestrate et Prefect fournissent des outils de conformité intégrés tels que des pistes d'audit et des contrôles d'accès basés sur les rôles. Les options open source comme Apache Airflow nécessitent cependant une configuration supplémentaire pour répondre à des normes de conformité strictes.

Courbe d'apprentissage : la convivialité varie considérablement. Les plates-formes comme Prefect et Dagster sont plus conviviales pour les débutants, offrant des API Python intuitives et des messages d'erreur utiles. Parallèlement, Apache Airflow et Kubeflow exigent une expertise technique et des compétences en gestion d'infrastructure plus approfondies. Prompts.ai simplifie encore davantage cela avec une interface unifiée qui équilibre la facilité d'utilisation avec des fonctionnalités avancées pour les utilisateurs expérimentés.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Écosystème d'intégration : une intégration transparente avec les outils existants est essentielle. Apache Airflow est leader avec des centaines de plugins pour les services cloud, les bases de données et les outils de surveillance. Prompts.ai, quant à lui, se concentre spécifiquement sur les LLM, offrant un accès simplifié à des dizaines de modèles via une seule API.

Évolutivité : les plates-formes telles que Kubeflow et Flyte sont conçues pour une mise à l'échelle horizontale, tirant parti de Kubernetes pour la répartition de la charge de travail. Metaflow utilise les services AWS pour une mise à l'échelle élastique, tandis que Prefect prend en charge les options de mise à l'échelle gérées dans le cloud et auto-hébergées. SuperAGI utilise une architecture d'agents distribués, permettant une exécution parallèle, même si cela nécessite une coordination minutieuse.

Le meilleur framework pour vous dépend de vos flux de travail spécifiques. Pour l'orchestration LLM, Prompts.ai se distingue par son accès centralisé aux modèles et sa rentabilité. Les équipes d'ingénierie de données pourraient s'appuyer sur la fiabilité d'Apache Airflow, tandis que les équipes de ML travaillant sur la formation et le déploiement à grande échelle pourraient bénéficier de Kubeflow ou de Flyte. Si votre objectif est de créer des systèmes d'IA autonomes, SuperAGI ou Microsoft AutoGen pourraient être la solution idéale.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Par exemple, les équipes donnant la priorité à l’orchestration LLM pourraient trouver Prompts.ai particulièrement attrayant. Il fournit un accès centralisé à plus de 35 modèles, tels que GPT-5, Claude et Gemini, le tout via une interface unifiée. Le système de crédit TOKN par répartition supprime les frais d'abonnement tout en offrant un suivi des coûts en temps réel. Avec des fonctionnalités telles que des contrôles d'accès basés sur les rôles et des pistes d'audit, Prompts.ai est un choix judicieux pour les secteurs nécessitant une gouvernance stricte sans compromettre la vitesse.

Les équipes d'ingénierie de données travaillant avec des pipelines ETL complexes peuvent se tourner vers Apache Airflow pour son écosystème de plugins robuste et son évolutivité, bien que cela nécessite une expertise plus avancée. D'autre part, Prefect propose une approche native Python avec une gestion conviviale des erreurs, ce qui en fait une excellente option pour une intégration plus rapide de l'équipe.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

Les organisations explorant des systèmes d'IA autonomes pourraient envisager Microsoft AutoGen pour ses fonctionnalités de collaboration multi-agents ou SuperAGI pour la délégation dynamique de tâches. Ces outils sont idéaux pour la recherche ou les cas d’utilisation spécialisés, mais nécessitent souvent des compétences avancées en codage, ce qui les rend moins adaptés aux besoins de production immédiats.

En fin de compte, la sélection du bon cadre implique d'évaluer des facteurs tels que la modularité, l'extensibilité, l'observabilité et les fonctionnalités de gouvernance telles que les contrôles d'accès basés sur les rôles et les certifications de conformité. La flexibilité de déploiement et l’intégration avec les outils existants sont tout aussi importantes. Au-delà des fonctionnalités, tenez compte de l’expérience du développeur, notamment des SDK, de la documentation et du coût total de possession. La complexité de vos flux de travail – qu’il s’agisse de tâches simples mono-agent ou de systèmes multi-agents complexes avec mémoire persistante – doit également guider votre décision.

Le secteur s'oriente vers des systèmes d'IA intégrés et évolutifs, avec des frameworks open source qui gèrent la majorité des charges de travail de l'entreprise, tandis que les environnements d'exécution gérés par le fournisseur simplifient les défis opérationnels.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Lorsque vous choisissez un framework d'orchestration d'IA, il est essentiel de considérer dans quelle mesure il s'intègre à vos outils et systèmes actuels. Un framework doté de fortes capacités d'intégration garantit que tout fonctionne ensemble sans complications inutiles.

Faites attention à ses fonctionnalités d'automatisation, telles que la planification des flux de travail et la gestion des tâches, car elles peuvent simplifier les opérations et gagner du temps. Les mesures de sécurité et de gouvernance sont tout aussi importantes, qui protègent les données sensibles et vous aident à rester conforme aux réglementations.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai simplifie le défi de jongler avec plusieurs outils d'IA en réunissant plus de 35 grands modèles de langage au sein d'une plate-forme unifiée. Avec cette configuration, les utilisateurs peuvent facilement comparer les modèles côte à côte tout en conservant une surveillance complète de leurs flux de travail rapides, de la qualité de sortie et des performances globales.

Pour ajouter à son efficacité, Prompts.ai dispose d'une couche FinOps intégrée conçue pour optimiser les coûts. Cet outil fournit des informations en temps réel sur l'utilisation, les dépenses et le retour sur investissement (ROI), permettant aux organisations de gérer efficacement leurs ressources et de tirer le meilleur parti de leurs budgets IA.

Prompts.ai donne la priorité à la sécurité et à la conformité de niveau entreprise, en s'alignant sur les normes de l'industrie telles que SOC 2 Type II, HIPAA et GDPR pour protéger vos données à chaque étape.

Pour maintenir une surveillance et une conformité continues, Prompts.ai collabore avec Vanta et a commencé son processus d'audit SOC 2 Type II le 19 juin 2025. Ces étapes garantissent que vos flux de travail restent sécurisés, conformes et fiables pour les opérations de l'entreprise.