Die KI-Orchestrierung ist der Schlüssel zur Skalierung von KI-Operationen in Unternehmen. Da 95 % der KI-Pilotprojekte aufgrund schlechter Koordination scheitern, benötigen Unternehmen Tools zur Vereinheitlichung, Automatisierung und Verwaltung komplexer KI-Workflows. Im Jahr 2025 werden Plattformen eingeführt, die mehrere Modelle integrieren, Arbeitsabläufe sichern und Kosten optimieren und den Anwendern einen bis zu 60 % höheren ROI bieten.

Here’s a quick breakdown of the top solutions:

Jede Plattform bietet einzigartige Stärken in Bezug auf Skalierbarkeit, Interoperabilität, Governance und Kostenmanagement. Unabhängig davon, ob Sie Open-Source-Flexibilität oder Compliance auf Unternehmensebene benötigen, können diese Tools fragmentierte KI-Systeme in einheitliche, skalierbare Ökosysteme verwandeln.

Wählen Sie die richtige Plattform, um Ihre KI-Initiativen zu skalieren, die Koordination zu verbessern und den ROI zu maximieren.

Vergleich der KI-Orchestrierungsplattformen: Skalierbarkeit, Interoperabilität, Governance und Funktionalität. Kosten

Prompts.ai ist eine hochmoderne Unternehmensplattform, die darauf ausgelegt ist, KI-Vorgänge zu vereinfachen und zu rationalisieren. Es vereint über 35 erstklassige große Sprachmodelle – darunter GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro und Kling – in einer sicheren, einheitlichen Oberfläche. Durch die Zentralisierung des Zugriffs auf diese Modelle beseitigt die Plattform das Chaos bei der Verwaltung mehrerer Tools und hilft Unternehmen dabei, ihre KI-Bemühungen problemlos zu skalieren.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

Als zentraler Hub stellt Prompts.ai sicher, dass alle KI-gesteuerten Prozesse auf autorisierten, versionierten Eingabeaufforderungsvorlagen statt auf verstreuten, fest codierten Zeichenfolgen basieren. Seine Architektur ermöglicht eine mühelose Modellauswahl und direkte Leistungsvergleiche, sodass Teams das effektivste große Sprachmodell (LLM) für jede Aufgabe identifizieren und einsetzen können. All dies wird erreicht, ohne dass Code neu geschrieben oder Pipelines angepasst werden müssen, was Zeit und Aufwand spart.

Prompts.ai priorisiert Sicherheit und Kontrolle durch eine robuste rollenbasierte Zugriffskontrolle (RBAC). Dies ermöglicht es Unternehmen, präzise Berechtigungen dafür zu definieren, wer Eingabeaufforderungen in Produktionsumgebungen erstellen, ändern oder bereitstellen darf. Jede Interaktion wird sorgfältig mit Audit-Trails und Versionsverfolgung protokolliert und bietet so vollständige Transparenz. Dieses Governance-Framework hilft Unternehmen dabei, Compliance-Standards einzuhalten und gleichzeitig die Transparenz und Kontrolle über KI-Operationen aufrechtzuerhalten. Durch die Kombination strenger Sicherheitsmaßnahmen mit betrieblicher Effizienz hilft die Plattform Unternehmen dabei, KI sicher und effektiv zu verwalten.

Die Plattform umfasst eine FinOps-Ebene, die die Token-Nutzung verfolgt und KI-Ausgaben direkt mit den Geschäftsergebnissen verknüpft. Viele Unternehmen haben berichtet, dass sie durch die Konsolidierung von Lieferantenbeziehungen und die Reduzierung unnötiger Abonnements ihre Kosten um bis zu 98 % senken konnten. Mit Echtzeit-Nutzungs- und Leistungsmetriken können Teams ihre Ausgaben kontinuierlich überwachen und optimieren und so unerwartete Ausgaben am Monatsende vermeiden. Dieses Maß an finanzieller Transparenz verwandelt KI von einer Haushaltsunsicherheit in eine messbare Investition mit klaren Renditen.

LangChain zeichnet sich als leistungsstarkes Framework für KI-Anwendungen mit beeindruckenden 90 Millionen monatlichen Downloads und über 100.000 GitHub-Sternen aus. Sein modularer Aufbau unterteilt die Funktionalität in leichtgewichtige Pakete, wie z. B. langchain-core für grundlegende Abstraktionen und langchain-community für Integrationen von Drittanbietern. Dieser Ansatz sorgt für optimierte KI-Workflows ohne unnötigen Overhead und macht ihn zur ersten Wahl für die Bewältigung von Komplexität und Umfang.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

LangSmith hält sich an strenge Compliance-Standards, einschließlich HIPAA, SOC 2 Typ 2 und DSGVO. Es bietet eine detaillierte Ausführungsverfolgung und erstellt einen umfassenden Audit-Trail für Debugging und Compliance-Überprüfungen. LangGraph erweitert dies durch Human-in-the-Loop-Funktionen, einschließlich „Zeitreise“-Funktionen für Echtzeitprüfung, Rollback und Korrektur.

__XLATE_10__

Garrett Spong, Principal SWE, betont: „LangGraph legt die Grundlage dafür, wie wir KI-Workloads aufbauen und skalieren können – von Konversationsagenten über komplexe Aufgabenautomatisierung bis hin zu benutzerdefinierten LLM-gestützten Erlebnissen, die ‚einfach funktionieren‘.“

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

Kubeflow Pipelines (KFP) zeichnet sich durch eine beeindruckende Erfolgsbilanz aus: 258 Millionen PyPI-Downloads, 33.100 GitHub-Stars und eine florierende Community von über 3.000 Mitwirkenden. KFP wurde für die native Ausführung auf Kubernetes entwickelt und führt jeden Schritt einer Pipeline als separaten Pod aus, sodass die Rechenressourcen in Ihrem Cluster je nach Bedarf dynamisch skaliert werden können. Seine Architektur basiert auf einer Directed Asymmetric Graph (DAG)-Struktur, die die parallele Ausführung von Containeraufgaben ermöglicht, sofern keine spezifischen Datenabhängigkeiten definiert sind [18, 19]. Dieses Setup ist der Schlüssel zur effizienten Abwicklung komplexer Arbeitsabläufe.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

KFP gewährleistet Flexibilität und Portabilität durch sein IR-YAML-Format, das die nahtlose Ausführung von Pipelines über verschiedene KFP-Backends hinweg ermöglicht, von Open-Source-Setups bis hin zu verwalteten Diensten wie Google Cloud Vertex AI Pipelines. Das bedeutet, dass Sie lokal entwickeln und in großem Maßstab in der Cloud bereitstellen können, ohne Ihren Code neu schreiben zu müssen. Die Plattform lässt sich auch in beliebte Tools wie Spark, Ray und Dask zur Datenvorbereitung sowie KServe für skalierbare Modellinferenz integrieren. Mit seinem Python SDK können Datenwissenschaftler mithilfe vertrauter Codierungspraktiken komplexe Arbeitsabläufe definieren, während das Backend diese automatisch in Kubernetes-Operationen übersetzt.

Sicherheit und Governance sind für KFP ein wesentlicher Bestandteil. Es nutzt die integrierten Funktionen von Kubernetes, wie z. B. rollenbasierte Zugriffskontrolle (RBAC), Namespaces für die Isolierung und Netzwerkrichtlinien, um eine sichere Workflow-Ausführung zu gewährleisten. Die Plattform verfolgt Metadaten und Artefakte zentral und erstellt einen detaillierten Audit-Trail für jeden Pipeline-Lauf [8, 22]. Durch die Ausführung jedes Pipeline-Schritts in einem isolierten Container gewährleistet KFP die Prozessisolation und die sichere Datenverarbeitung. Administratoren haben die Möglichkeit, Ressourcenlimits für einzelne Aufgaben festzulegen, um eine gerechte Ressourcenverteilung zwischen den Teams sicherzustellen und eine Überbeanspruchung zu verhindern. Bei sensiblen Daten oder Workloads können Knotenselektoren verwendet werden, um Aufgaben auf bestimmte, sichere Hardware zu beschränken.

Während KFP selbst Open Source ist und kostenlos genutzt werden kann, fallen weiterhin Kosten im Zusammenhang mit der zugrunde liegenden Kubernetes-Infrastruktur an – sei es auf AWS EKS, Google GKE oder vor Ort. Verwaltete Versionen wie Google Cloud Vertex AI Pipelines basieren auf einem Pay-as-you-go-Preismodell [19, 20]. KFP umfasst außerdem Funktionen wie Wiederholungsmechanismen für vorübergehende Fehler, die dazu beitragen, die Kosten für den Neustart lang laufender Pipelines zu vermeiden, und Exit-Handler, die sicherstellen, dass Bereinigungsaufgaben auch dann ausgeführt werden, wenn frühere Schritte fehlschlagen. Diese Funktionen tragen zu einer effizienteren Ressourcennutzung und Kostenkontrolle bei.

Argo Workflows ist eine beliebte Workflow-Ausführungs-Engine, die speziell für Kubernetes entwickelt wurde und auf die sich über 200 Unternehmen in Produktionsumgebungen verlassen. Als Container-native Lösung orchestriert sie parallele Jobs, indem sie jeden Workflow-Schritt in einem isolierten Pod ausführt. Diese Architektur ermöglicht eine dynamische Skalierung basierend auf der verfügbaren Kapazität Ihres Kubernetes-Clusters und ist damit besonders effektiv für KI-Aufgaben, die eine flexible Ressourcenverwaltung erfordern.

Argo Workflows unterstützt die Skalierung durch vertikale Optimierung und Sharding. Durch Erhöhen des Parameters --workflow-workers können Sie mehr CPU-Kerne zuweisen, um den Workflow-Abgleich zu beschleunigen. Bei größeren Vorgängen kann Sharding implementiert werden, indem separate Installationen pro Namespace bereitgestellt werden oder mehrere Controller-Instanzen innerhalb desselben Clusters mithilfe von Instanz-IDs ausgeführt werden. Zum Schutz des Kubernetes-API-Servers setzt Argo eine clientseitige Ratenbegrenzung ein (Standard: 20 Abfragen pro Sekunde mit einem Burst von 30) und begrenzt die Parallelität von foreach-Schritten auf 100 Aufgaben. Dieser skalierbare Ansatz gewährleistet eine reibungslose Integration mit externen Systemen, auch bei hoher Arbeitslast.

Als Kubernetes Custom Resource Definition (CRD) lässt sich Argo nahtlos in jeden Kubernetes-Cluster integrieren und unterstützt bekannte KI-Plattformen wie Kubeflow Pipelines, Netflix Metaflow, Seldon und Kedro. Entwickler können Workflows mithilfe offizieller SDKs für Python (Hera), Java und Go definieren und bieten so Flexibilität bei der Sprachauswahl. Für die Artefaktverwaltung unterstützt Argo verschiedene Speicherlösungen, darunter AWS S3, Google Cloud Storage, Azure Blob Storage, Artifactory und Alibaba Cloud OSS. Diese Kompatibilität gewährleistet einen reibungslosen Datenfluss in verschiedenen Umgebungen. Darüber hinaus können Workflows mithilfe von Argo Events durch externe Signale wie Webhooks oder Speicheränderungen ausgelöst werden. Laut der Metaflow-Dokumentation ist Argo Workflows der einzige Produktions-Orchestrator, der das Auslösen von Ereignissen durch Argo Events unterstützt. Diese Kombination aus Flexibilität und Funktionalität macht es zu einer robusten Wahl für die Workflow-Automatisierung.

Argo Workflows nutzt Kubernetes-native Funktionen, um eine hohe Sicherheit zu gewährleisten. Die rollenbasierte Zugriffskontrolle (RBAC) verwaltet Berechtigungen für den Workflow-Controller, Benutzer und einzelne Pods. Um die Isolation zu verbessern, kann der Controller mithilfe des „Namespace-Install“-Modus auf einen einzelnen Namespace beschränkt werden. In Produktionsumgebungen unterstützt Argo Single Sign-On (SSO) über OAuth2 und OIDC und sichert die Daten während der Übertragung mit TLS-Verschlüsselung. Administratoren können Workflow-Einschränkungen erzwingen, sodass Benutzer nur vorab genehmigte Vorlagen übermitteln können, und Pod-Sicherheitskontexte verhindern, dass Pods als Root ausgeführt werden. Netzwerkrichtlinien regulieren den Datenverkehr sowohl für den Argo Server als auch für den Workflow Controller, und eine standardmäßige Rekursionstiefenbegrenzung von 100 Aufrufen verhindert Endlosschleifen.

Argo Workflows ist ein Open-Source-Tool, das unter der Apache-Lizenz 2.0 verfügbar ist und daher kostenlos verwendet werden kann. Um die Kosten zu verwalten, werden TTL-Strategien und Pod Garbage Collection (PodGC) eingesetzt, um abgeschlossene Arbeitsabläufe automatisch zu löschen und ungenutzte Pods zu bereinigen, wodurch die Ressourcenverschwendung reduziert wird. Aufgaben können mithilfe von Knotenselektoren und Affinitätsregeln auf einer kosteneffizienten Infrastruktur wie Spot-Instanzen geplant werden. Darüber hinaus wird die Ressourcennutzung pro Schritt verfolgt, sodass Benutzer ihre Ausgaben besser überwachen können. Wenn Sie in Controller-Protokollen eine „clientseitige Drosselung“ bemerken, kann die Erhöhung der Werte „--qps“ und „--burst“ die Kommunikationseffizienz mit der Kubernetes-API verbessern. Dieses durchdachte Design trägt dazu bei, Leistung und Kosteneffizienz in Einklang zu bringen.

Apache Airflow hat sich zu einem wichtigen Akteur bei der Verwaltung von KI-Workflows entwickelt und bietet ein flexibles, codebasiertes Framework für die Orchestrierung komplexer Vorgänge. Besonders hervorzuheben ist es bei Machine Learning Operations (MLOps), wo 23 % der Benutzer es anwenden, und bei generativen KI-Projekten, wo es von 9 % der Community verwendet wird. Airflow wurde unter der Apache-Lizenz 2.0 veröffentlicht und ermöglicht Entwicklern die Definition von Workflows in Python und die nahtlose Integration in jede Bibliothek für maschinelles Lernen.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

Der KubernetesExecutor ist besonders nützlich für die Bewältigung unvorhersehbarer, ressourcenintensiver Arbeitslasten. Funktionen wie Dynamic Task Mapping ermöglichen die Skalierung von Aufgaben auf der Grundlage von Echtzeitdaten und eignen sich somit perfekt für große Datensätze und Workflows mit mehreren Modellen. In der Zwischenzeit steigern aufschiebbare Operatoren die Effizienz, indem sie lange Wartezustände verwalten, z. B. die Überwachung des Modelltrainings, ohne Arbeitsplätze zu belegen. Dieser Ansatz steigert den Durchsatz und die Ressourcenauslastung erheblich.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

Die TaskFlow-API vereinfacht die Workflow-Erstellung, indem sie Python-Dekoratoren verwendet, um Skripte in Airflow-Aufgaben umzuwandeln und Datenübertragungen über XComs automatisch zu verwalten. Teams können Aufgaben an geeignete Umgebungen weiterleiten, z. B. Kubernetes-Pods für GPU-lastiges Training oder Spark-Cluster für die Datenvorverarbeitung. Darüber hinaus ermöglichen die REST-API und die Airflowctl-CLI eine sichere Integration mit CI/CD-Pipelines und sorgen so für eine reibungslose und überprüfbare Workflow-Verwaltung.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

Für die Datenverwaltung lässt sich Airflow in OpenLineage integrieren, einen Standard zur Verfolgung der Datenherkunft, der dabei hilft, Compliance-Anforderungen wie DSGVO und HIPAA zu erfüllen. Die airflowctl-CLI interagiert ausschließlich mit der REST-API und vermeidet für zusätzliche Sicherheit den direkten Zugriff auf die Metadatendatenbank. Teams können auch reproduzierbare Umgebungen mithilfe von Setup- und Teardown-Aufgaben verwalten und die Infrastruktur für eine bessere Übersicht und Konsistenz als Code behandeln.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

Azure Machine Learning bietet eine leistungsstarke Lösung für die KI-Anforderungen von Unternehmen mit fortschrittlichen GPUs, InfiniBand-Netzwerk, 99,9 % Verfügbarkeit und mehr als 100 Compliance-Zertifizierungen. Unterstützt durch ein Team aus 34.000 Ingenieuren und 15.000 Sicherheitsexperten gewährleistet es Zuverlässigkeit und Sicherheit im großen Maßstab.

Die Plattform ist darauf ausgelegt, Workloads jeder Größe zu bewältigen, indem sie verteiltes Computing über Daten, Modelle und Pipelines hinweg unterstützt und so die Ressourceneffizienz maximiert. Verwaltete Online-Endpunkte ermöglichen eine nahtlose Modellbereitstellung mit automatischer Skalierung, um Nachfragespitzen zu bewältigen. Zum Beispiel Marks & Spencer nutzte Azure ML, um Daten für über 30 Millionen Kunden zu verarbeiten und nutzte gleichzeitig Pipeline-Caching und Registrierungen, um sowohl Schulungszeit als auch Kosten zu reduzieren. In ähnlicher Weise entfielen bei BRF durch automatisiertes ML und MLOps manuelle Aufgaben für 15 Analysten, sodass diese sich auf höherwertige Arbeiten konzentrieren konnten.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

„Ohne den Prompt Flow von Azure AI wären wir gezwungen gewesen, in beträchtliche kundenspezifische Entwicklungen zu investieren, um eine Lösung bereitzustellen. Stattdessen konnten wir eine hohe Geschwindigkeit erreichen, indem wir unsere vorhandenen Microservices einfach in die Prompt Flow-Lösung integrieren.“

Azure ML unterstützt auch datenschutzschonendes verteiltes Training, wie Johan Bryssinck von Swift demonstriert hat, der die Plattform nutzte, um Modelle auf lokalen Edge-Geräten zu trainieren, anstatt Daten zu zentralisieren, wodurch sowohl Skalierbarkeit als auch Datenschutz gewährleistet wurden. Sein einheitlicher API-Vertrag sowie die Integrationen mit Azure Logic Apps und Azure Functions verbessern die Konnektivität mit externen Tools weiter.

Azure Machine Learning priorisiert die Sicherheit mit Funktionen wie Microsoft Entra ID für rollenbasierte Zugriffskontrolle (RBAC) und virtuellen Netzwerken, um Ressourcen zu isolieren und den API-Zugriff einzuschränken. Die Daten werden mit TLS 1.2/1.3-Verschlüsselung während der Übertragung und doppelter Verschlüsselung im Ruhezustand geschützt, mit Optionen für vom Kunden verwaltete Schlüssel für zusätzliche Kontrolle. Echtzeitschutzmaßnahmen wie Prompt Shields verhindern Jailbreaks und Prompt-Injection-Angriffe, während Customer Lockbox eine administrative Genehmigung für den Zugriff von Microsoft auf Kundendaten erfordert. Zusätzliche Tools verfolgen Asset-Versionen, Datenherkunft und Kontingente, und Microsoft Defender für Cloud bietet Laufzeitschutz vor Bedrohungen.

Azure Machine Learning basiert auf einem Pay-as-you-go-Preismodell, bei dem nur Rechenressourcen wie CPUs und spezielle GPUs in Rechnung gestellt werden. Unterstützende Dienste wie Blob Storage, Key Vault, Container Registry und Application Insights werden ebenfalls nutzungsbasiert abgerechnet. Teams können Hardware auswählen, die auf bestimmte Aufgaben zugeschnitten ist, während Funktionen wie Pipeline-Caching redundante Berechnungen reduzieren. Infrastructure as Code gewährleistet eine konsistente Bereitstellung und ein effizientes Ressourcenmanagement.

Google Vertex AI Pipelines erleichtert die Verwaltung der Infrastruktur durch die Automatisierung von Arbeitsabläufen für maschinelles Lernen (ML). Es organisiert Aufgaben in einem gerichteten azyklischen Graphen (DAG) aus containerisierten Komponenten, sodass sich Teams auf die Modellentwicklung statt auf die Serververwaltung konzentrieren können.

Vertex AI Pipelines verwendet einen serverlosen Ansatz zur Bewältigung von Arbeitslasten und delegiert intensive Verarbeitungsaufgaben an Tools wie BigQuery, Dataflow und Cloud Serverless für Apache Spark. Für verteilte Python- und ML-Berechnungen lässt es sich nahtlos in Ray auf Vertex AI integrieren.

Die Plattform unterstützt Knoten der Serien A3 und A3 Mega, die mit NVIDIA H100/H200-GPUs ausgestattet sind. A3 Mega-Knoten mit 8 H100-GPUs liefern eine beeindruckende knotenübergreifende Bandbreite von 1.600 Gbit/s. Vectra analysierte beispielsweise 300.000 monatliche Kundenanrufe mit Gemini und Vertex AI und erzielte dabei eine Steigerung der Analysegeschwindigkeit um 500 %.

Die Kosteneffizienz ist durch das Ausführungs-Caching integriert, das Ausgaben wiederverwendet, um die Kosten zu minimieren. Vertex ML Metadata gewährleistet die Reproduzierbarkeit, indem es die Herkunft von Artefakten, Parametern und Metriken im großen Maßstab verfolgt. Dieses skalierbare Design lässt sich mühelos in eine Vielzahl von Tools integrieren und macht es zu einer vielseitigen Lösung für ML-Workflows.

Das Google Cloud Pipeline Components (GCPC) SDK vereinfacht die Integration, indem es vorgefertigte Komponenten bietet, die Vertex AI-Dienste wie AutoML, benutzerdefinierte Trainingsjobs und Modellbereitstellung direkt in Pipelines verbinden.

Das Pipeline-Management ist flexibel und bietet Optionen wie Cloud Composer (verwalteter Apache Airflow) und Cloud Data Fusion-Trigger für die dienstübergreifende Orchestrierung von Workflows. Native Verbindungen zu BigQuery, Cloud Storage und Dataproc optimieren die Datenverarbeitung, während Metadaten zur projektübergreifenden Herkunftsverfolgung mit dem Dataplex Universal Catalog synchronisiert werden können. Darüber hinaus bietet der Model Garden Zugriff auf über 200 Modelle, darunter Gemini von Google, Claude von Anthropic und Llama von Meta.

Pipeline-Definitionen werden in ein standardisiertes YAML-Format kompiliert, um die Portabilität zwischen Repositorys wie Artifact Registry sicherzustellen.

Vertex AI Pipelines wurde unter Berücksichtigung von Governance und Sicherheit entwickelt. Dienstkonten stellen sicher, dass jede Komponente nur mit den erforderlichen Berechtigungen ausgeführt wird. VPC Service Controls schaffen einen sicheren Perimeter und verhindern, dass sensible Daten – wie Trainingsdatensätze, Modelle und Batch-Vorhersageergebnisse – die Netzwerkgrenze verlassen.

Für Organisationen mit strengen Compliance-Anforderungen unterstützt die Plattform zusätzlich zur Standardverschlüsselung im Ruhezustand von Google Cloud auch vom Kunden verwaltete Verschlüsselungsschlüssel (Customer-Managed Encryption Keys, CMEK). Vertex ML Metadata bietet einen detaillierten Prüfpfad, indem Parameter, Artefakte und Metriken aus jedem Pipeline-Lauf automatisch aufgezeichnet werden.

Sicherheitsfunktionen wie Model Armor schützen vor sofortiger Einschleusung und Datenexfiltration. Pipelines können so konfiguriert werden, dass sie in Peering-VPC-Netzwerken ausgeführt werden, und Cloud Logging ermöglicht es Teams, Pipeline-Ereignisse auf Sicherheitsanomalien zu überwachen.

Vertex AI Pipelines arbeitet nach einem Pay-as-you-go-Modell, bei dem Abrechnungsbezeichnungen automatisch zur Kostenverfolgung durch Cloud Billing-Exporte nach BigQuery angewendet werden. Durch die Zwischenspeicherung der Ausführung werden die Kosten durch die Wiederverwendung von Ausgaben weiter gesenkt.

Um die Kosten für störungstolerante Schulungsjobs zu senken, sind Spot-VMs zu ermäßigten Preisen erhältlich. Bei langfristigen Infrastrukturverpflichtungen bieten Committed Use Discounts (CUDs) Kosteneinsparungen und garantierte Kapazität. Der Dynamic Workload Scheduler (DWS) bietet Kapazität für flexible Workloads zu niedrigeren Listenpreisen, während dedizierte Schulungscluster reservierte Beschleunigerkapazität für Großaufträge gewährleisten.

IBM watsonx Orchestrate fungiert als zentraler Knotenpunkt und koordiniert KI-Agenten, indem es als Supervisor, Router und Planer für spezielle Tools und Basismodelle fungiert. Die Plattform unterstützt verschiedene Orchestrierungsansätze: React für explorative Aufgaben, Plan-Act für strukturierte Arbeitsabläufe und deterministische Orchestrierung für vorhersehbare Geschäftsprozesse.

watsonx Orchestrate wurde für groß angelegte Operationen entwickelt und nutzt Multi-Agenten-Orchestrierung, um Anfragen effizient und in Echtzeit an die entsprechenden Tools und großen Sprachmodelle (LLMs) weiterzuleiten. Unternehmen können watsonx Orchestrate als verwalteten Service in der IBM Cloud oder AWS bereitstellen oder es vor Ort installieren, um es an ihre bestehende Infrastruktur anzupassen.

Die Plattform hat bereits messbare Ergebnisse geliefert. IBM hat beispielsweise 94 % der 10 Millionen jährlichen HR-Anfragen sofort über watsonx Orchestrate gelöst, sodass sich HR-Teams auf höherwertige Aufgaben konzentrieren können. Ebenso haben Dun & Bradstreet verkürzte die Beschaffungszeit durch KI-gesteuerte Lieferantenrisikobewertungen um bis zu 20 %, wodurch Kunden über 10 % Bewertungszeit einsparten.

Um eine schnelle Bereitstellung zu unterstützen, umfasst die Plattform einen Agent Builder ohne Code und ein Agent Development Kit (ADK) zum Erstellen benutzerdefinierter Python-basierter Tools. Darüber hinaus bietet ein Katalog mit über 100 domänenspezifischen KI-Agenten und mehr als 400 vorgefertigten Tools skalierbare Komponenten für unterschiedliche betriebliche Anforderungen.

Diese Skalierbarkeit gewährleistet eine reibungslose Integration in bestehende Systeme und ermöglicht die Anpassung an eine Vielzahl von Unternehmensumgebungen.

Das AI Gateway der Plattform ermöglicht ein nahtloses Routing zwischen verschiedenen Basismodellen, darunter IBM Granite, OpenAI, Anthropic, Google Gemini, Mistral und Llama, und hilft Unternehmen dabei, eine Anbieterbindung zu vermeiden. Das Agent Development Kit unterstützt die Erstellung benutzerdefinierter Tools mithilfe von OpenAPI-Spezifikationen für Remote-Webdienste und Python für erweiterte Funktionen.

Durch die Integration mit Langflow wird eine visuelle Drag-and-Drop-Schnittstelle zum Entwerfen von KI-Anwendungen hinzugefügt, die dann in die Orchestrate-Umgebung importiert werden können. Darüber hinaus lässt sich watsonx Orchestrate mühelos mit Unternehmenssystemen wie Salesforce, SAP, Workday und Microsoft 365 verbinden, sodass keine umfangreichen Infrastrukturänderungen erforderlich sind.

Mit AgentOps überwacht die Plattform die Aktivitäten von KI-Agenten und setzt Echtzeitrichtlinien durch, um Zuverlässigkeit und Compliance sicherzustellen. Integrierte Leitplanken und eine zentrale Aufsicht tragen dazu bei, die Einhaltung interner Vorschriften sicherzustellen.

__XLATE_52__

„Mit AgentOps wird jede Aktion überwacht und gesteuert, sodass Anomalien in Echtzeit erkannt und korrigiert werden können.“ - IBM Newsroom

Die IBM Guardium-Integration erhöht die Sicherheit, indem sie nicht autorisierte KI-Bereitstellungen identifiziert und Schwachstellen oder Fehlkonfigurationen aufdeckt. Die Plattform implementiert außerdem eine rollenbasierte Zugriffskontrolle (RBAC), die vier Hauptrollen umfasst – Admin, Builder, Benutzer und Produktexperte –, um Umgebungseinstellungen zu schützen. Unternehmen, die watsonx.governance nutzen, haben von einer 30-prozentigen Steigerung des ROI ihrer KI-Initiativen berichtet.

Die Plattform bietet flexible Preise, um den unterschiedlichen organisatorischen Anforderungen gerecht zu werden:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31. Januar 2026.

Das UiPath AI Center bringt KI-Agenten, RPA-Bots und menschliche Mitarbeiter in Unternehmensabläufen zusammen und schafft so ein skalierbares Ökosystem, das den Anforderungen des Jahres 2025 gerecht wird. Im Kern nutzt die Plattform UiPath Maestro als intelligente Kontrollzentrale, die lang laufende Prozesse in komplexen Geschäftsabläufen verwaltet.

UiPath AI Center bietet zwei Bereitstellungsoptionen für unterschiedliche Geschäftsanforderungen: Automation Cloud, das sofortige elastische Skalierung bietet, und Automation Suite, maßgeschneidert für die Bereitstellung vor Ort. Sein MLOps-System verfügt über eine benutzerfreundliche Drag-and-Drop-Schnittstelle zum Bereitstellen und Überwachen von Modellen, sodass diese nahtlos auf eine unbegrenzte Anzahl von Robotern skaliert werden können. SunExpress Airlines meldete beispielsweise Einsparungen von über 200.000 US-Dollar und konnte gleichzeitig die Rückstände um zwei Monate reduzieren. Die Plattform stellt außerdem sicher, dass die Modelle durch kontinuierliche Human-in-the-Loop-Umschulung präzise bleiben, was sie zu einem leistungsstarken Werkzeug für die Integration von KI in verschiedene Systeme macht.

Die Plattform verfolgt eine „Bring Your Own Model“ (BYOM)-Strategie und ermöglicht die Integration mit Drittanbieter-Frameworks wie LangChain, Anthropic und Microsoft. Darüber hinaus ermöglicht das Agent2Agent (A2A)-Protokoll, das in Zusammenarbeit mit Google Cloud entwickelt wurde, eine reibungslose Kommunikation zwischen KI-Agenten über Unternehmensplattformen hinweg.

__XLATE_59__

Harrison Chase, CEO von LangChain, teilte mit: „Unsere Zusammenarbeit mit UiPath am Agent Protocol stellt sicher, dass LangGraph-Agenten nahtlos an UiPath-Automatisierungen teilnehmen können, wodurch ihre Reichweite erweitert wird und Entwickler in die Lage versetzt werden, kohärentere, plattformübergreifende Arbeitsabläufe zu erstellen.“

UiPath AI Center verbindet sich über standardisierte APIs mit Hunderten von SaaS-Anwendungen, unterstützt BPMN 2.0 für die Prozessmodellierung und nutzt Decision Model and Notation (DMN) für die Verwaltung von Geschäftsregeln. Ein bemerkenswertes Beispiel ist die Heritage Bank, Australiens größte Gegenseitigkeitsbank, die AI Centre nutzte, um ihren Kreditprüfungsprozess zu automatisieren, das Kundenerlebnis zu verbessern und gleichzeitig manuelle Backend-Aufgaben zu reduzieren.

Das UiPath AI Center priorisiert Governance und Sicherheit und bietet Zugriffskontrollen auf Projekt- und Mandantenebene, um Rückverfolgbarkeit und Compliance aufrechtzuerhalten. Seine kontrollierten Agenturfunktionen stellen sicher, dass KI-Agenten nicht autonom unbefugte oder unsichere Aktionen ausführen können.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

Das UiPath AI Center verwendet ein verbrauchsbasiertes Lizenzmodell mit KI-Einheiten, die Aktivitäten wie Modelltraining, Hosting und Vorhersagen messen. Diese lassen sich über Plattformeinheiten nahtlos in das umfassendere UiPath-Lizenzierungssystem integrieren und decken Orchestrierungs- und Ausführungsanforderungen ab. Um Unternehmen bei der Erkundung der Möglichkeiten zu unterstützen, ist sowohl für die Automation Cloud- als auch für die Automation Suite-Version eine 60-tägige kostenlose Testversion verfügbar, die es einfacher macht, den Wert einzuschätzen und gleichzeitig die Kosten unter Kontrolle zu halten.

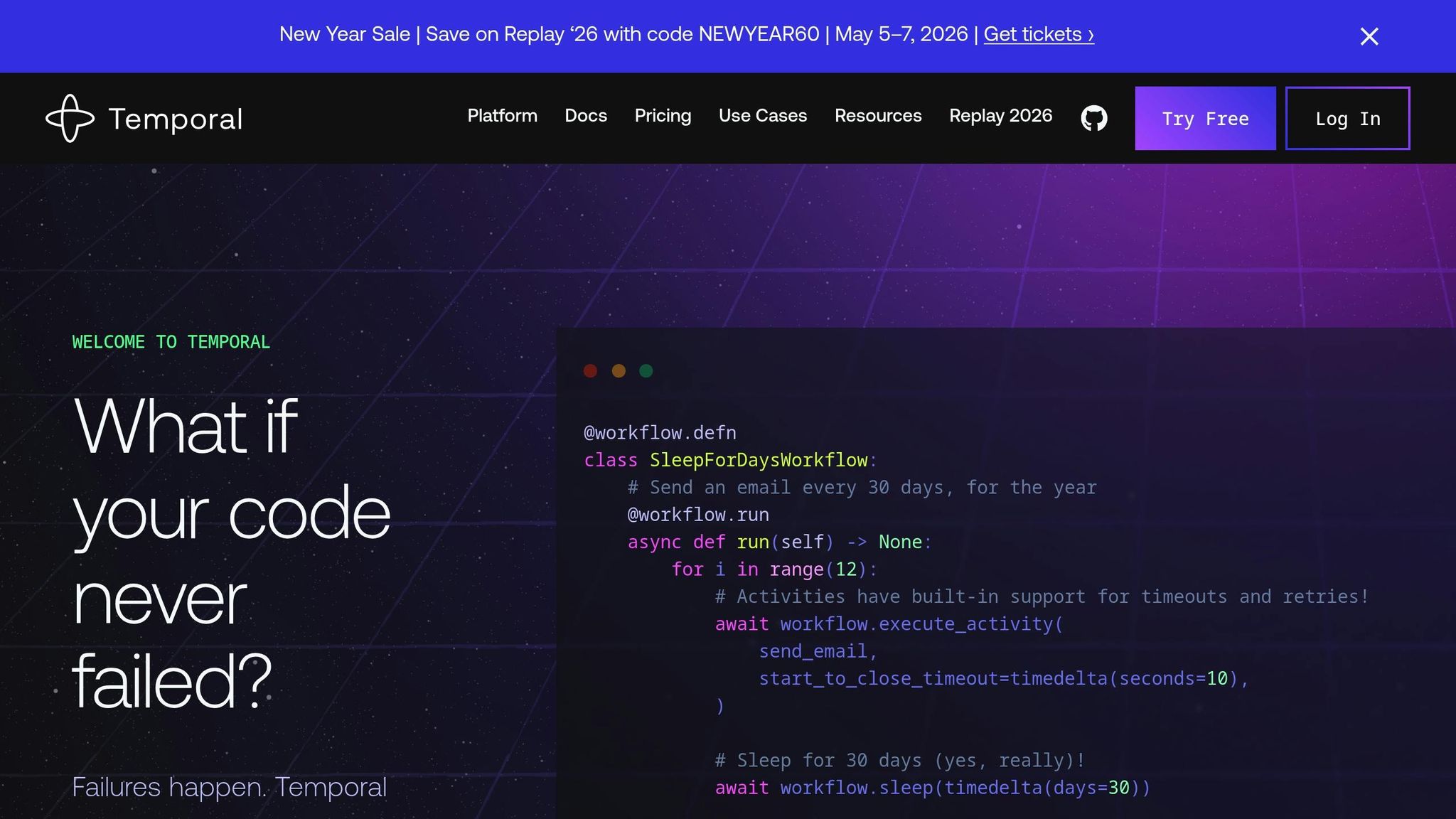

Temporal verfolgt einen einzigartigen Ansatz, indem es dauerhaften, fortsetzbaren Code verwendet, anstatt sich auf Konfigurationsdateien zu verlassen. Es erfasst jeden Workflow-Schritt in einem unveränderlichen Ereignisverlauf und stellt sicher, dass Prozesse nach einer Unterbrechung genau dort weitermachen können, wo sie aufgehört haben. Ein gutes Beispiel hierfür ist Replit, das seine Codierungsagenten-Steuerungsebene auf Temporal umgestellt hat, was die Zuverlässigkeit und Benutzererfahrung deutlich verbessert.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Lizzie Siegrist, Produktmanagerin, Retool

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

Diese Skalierbarkeit gewährleistet eine nahtlose Integration mit verschiedenen Tools und Systemen.

Entwickler können Workflows als Code in gängigen Sprachen wie Python, Go, Java, TypeScript, .NET und PHP schreiben. Temporal lässt sich außerdem mühelos in führende KI-Frameworks integrieren, darunter OpenAI Agents SDK, Pydantic AI, LangGraph und Crew AI. Die Unterstützung des Model Context Protocol (MCP) erhöht die Agentenzuverlässigkeit. Die Beobachtbarkeit wird durch Verbindungen mit KI-spezifischen Überwachungstools wie Langfuse verbessert. Gorgias nutzt diese Flexibilität beispielsweise, um über 15.000 E-Commerce-Marken bei der Verwaltung KI-gesteuerter Kundendienstmitarbeiter zu unterstützen.

Der Ereignisverlauf von Temporal bietet einen vollständigen, unveränderlichen Prüfpfad jeder Statusänderung in KI-Workflows. Diese Funktion unterstützt die Human-in-the-Loop-Governance und ermöglicht es, Arbeitsabläufe zur externen Validierung anzuhalten, bevor autonome Entscheidungen ausgeführt werden. Dieser Schutz ist besonders in Produktionsumgebungen nützlich, um Probleme wie LLM-Halluzinationen zu verhindern. Bei temporären Cloud-Bereitstellungen kann der Anbieter nicht auf Anwendungscode zugreifen, während die Open-Source-Serveroption mit MIT-Lizenz es Unternehmen ermöglicht, die Plattform in ihrer eigenen sicheren Infrastruktur zu hosten. Die Ingenieure von Netflix haben hervorgehoben, wie dieses Design den Wartungsaufwand minimiert und die Fehlerbehandlung vereinfacht.

Temporal Cloud basiert auf einem Pay-as-you-go-Modell, während der Open-Source-Temporal Server kostenlos selbst gehostet werden kann. Neue Benutzer können die Plattform mit einem kostenlosen Guthaben von 1.000 US-Dollar für Temporal Cloud erkunden. Durch das Anhalten von Arbeitsabläufen, ohne Rechenressourcen zu verbrauchen, können Benutzer die Infrastruktur- und Betriebskosten erheblich senken. Das Design von Temporal verbessert nicht nur die Effizienz und Zuverlässigkeit, sondern hält auch die Kosten unter Kontrolle, wenn der KI-Betrieb wächst.

Die Auswahl der idealen KI-Orchestrierungsplattform erfordert ein Gleichgewicht zwischen Flexibilität und Benutzerfreundlichkeit. Open-Source-Optionen wie Apache Airflow und LangChain bieten Herstellerunabhängigkeit und umfassende Anpassungsmöglichkeiten, erfordern jedoch fortgeschrittene technische Fähigkeiten und manuelle Konfigurationen für Sicherheit und Governance. Andererseits umfassen Unternehmensplattformen wie IBM watsonx Orchestrate und UiPath integrierte Funktionen wie rollenbasierte Zugriffskontrolle (RBAC), Prüfprotokolle und HIPAA-Konformität, sind jedoch mit Lizenzgebühren und eingeschränkter Flexibilität verbunden.

Skalierbarkeitsstrategien variieren stark je nach Plattform. Kubernetes-native Tools wie Kubeflow und Argo Workflows zeichnen sich durch Container-Portabilität aus, während die auf gerichteten azyklischen Graphen (DAG) basierende Planung von Apache Airflow effektiv für die Verwaltung komplexer Abhängigkeiten in Hybrid- und Multi-Cloud-Setups ist. Temporal ist für seinen hohen Durchsatz bekannt, während Azure Machine Learning und Google Vertex AI Pipelines ihre übergeordneten Cloud-Ökosysteme nutzen, um bei Spitzenbedarf Ressourcen dynamisch zuzuweisen. Diese Variationen verdeutlichen die Kompromisse, die Unternehmen bei der Bewertung von Lösungen berücksichtigen müssen.

Interoperabilität ist ein weiterer entscheidender Faktor für die Gewährleistung einheitlicher Arbeitsabläufe. Mit LangChain können Entwickler mehrere große Sprachmodelle (LLMs) und APIs verbinden, ohne bestehende Systeme überarbeiten zu müssen, und Kubeflow unterstützt Frameworks wie PyTorch, TensorFlow und JAX innerhalb einer einzigen Pipeline. Plattformen wie Prompts.ai zielen darauf ab, die Fragmentierung durch die Vereinheitlichung mehrerer Modelle zu reduzieren, während herstellerspezifische Plattformen wie Azure Machine Learning und IBM watsonx Orchestrate nahtlose native Integrationen bieten, für eine breitere Kompatibilität jedoch möglicherweise zusätzliche Konnektoren erfordern.

Auch betriebliche Kompromisse spielen eine Schlüsselrolle bei Einsatzentscheidungen und der Kapitalrendite (ROI). Governance und Kostenmanagement sind Bereiche, in denen sich die Plattformen erheblich unterscheiden. Unternehmenslösungen wie IBM watsonx Orchestrate und UiPath bieten zentralisierte Dashboards und robuste Sicherheitsfunktionen und eignen sich daher für regulierte Branchen wie das Gesundheitswesen und das Finanzwesen. Im Gegensatz dazu erfordern Open-Source-Tools oft eine manuelle Einrichtung, um eine vergleichbare Übersicht zu erreichen. Aus Kostengründen können Apache Airflow, LangChain und Kubeflow zwar kostenlos bereitgestellt werden, es können jedoch versteckte Kosten im Zusammenhang mit der Entwicklungszeit und dem Fachwissen anfallen. Temporal Cloud bietet Pay-as-you-go-Preise mit kostenlosem Guthaben in Höhe von 1.000 US-Dollar, während Prompts.ai die Kosten für KI-Software durch sein einheitliches TOKN-Guthabensystem, das wiederkehrende Gebühren eliminiert, erheblich senkt – bis zu 98 %.

Die folgende Tabelle bietet einen detaillierten Vergleich jeder Plattform in Bezug auf die wichtigsten Betriebsdimensionen:

Die Auswahl der besten KI-Orchestrierungsplattform hängt von den technischen Fähigkeiten, Compliance-Anforderungen und Wachstumsplänen Ihres Unternehmens ab. Open-Source-Optionen wie Apache Airflow und LangChain bieten unübertroffene Flexibilität ohne Lizenzgebühren und sind damit eine erste Wahl für entwicklerorientierte Teams bei Technologie-Startups und schnell wachsenden Unternehmen, die Wert auf modulare Setups legen. Allerdings erfordern diese Frameworks fortgeschrittene technische Fähigkeiten, um wichtige Funktionen wie Sicherheit, Governance und Skalierbarkeit zu konfigurieren. Andererseits richten sich Unternehmensplattformen wie IBM watsonx Orchestrate an Branchen wie das Gesundheitswesen und das Finanzwesen, in denen integrierte Compliance-Maßnahmen – wie rollenbasierte Zugriffskontrollen, Audit-Trails und Zertifizierungen wie HIPAA und SOC 2 – nicht verhandelbar sind. Diese Plattformen bieten häufig greifbare Vorteile, indem sie Arbeitsabläufe rationalisieren und Governance-Funktionen mit verbesserten Geschäftsergebnissen verknüpfen.

Für große Unternehmen sind Governance-lastige Plattformen unerlässlich, aber mittelständische Unternehmen benötigen oft Lösungen, die Kosten und Leistung in Einklang bringen. Prompts.ai vereinfacht diese Gleichung, indem es mehr als 35 Modelle in eine Schnittstelle integriert und FinOps-Kontrollen in Echtzeit und nutzungsbasierte TOKN-Gutschriften bietet, um die Tool-Fragmentierung und unerwartete Kosten zu minimieren. Unterdessen glänzen Kubernetes-native Tools wie Kubeflow Pipelines und Argo Workflows, wenn Portabilität und Hybrid-Cloud-Bereitstellungen von entscheidender Bedeutung sind, insbesondere für Data-Science-Teams, die komplexe Machine-Learning-Pipelines über verteilte Systeme hinweg verwalten.

Wie bereits erwähnt, unterstreicht das Aufkommen der agentischen KI – bei der autonome Agenten beim mehrstufigen Denken zusammenarbeiten – die wachsende Bedeutung einer nahtlosen Orchestrierung. Um Domo zu zitieren:

__XLATE_78__

„Für den Erfolg in der KI geht es nicht mehr darum, die meisten Modelle zu haben – es geht darum, sie effektiv zu orchestrieren.“

Für US-amerikanische Unternehmen ist es von entscheidender Bedeutung, Plattformen zu wählen, die ihrem aktuellen technischen Reifegrad entsprechen und gleichzeitig Spielraum für Skalierung bieten, da KI abteilungsübergreifend stärker integriert wird. Ein intelligenter Ausgangspunkt ist ein Pilotprojekt, das sich auf einen bestimmten Arbeitsablauf konzentriert und Eingaben, Ausgaben und Fehler verfolgt, um eine Beobachtbarkeitsbasislinie für die zukünftige Skalierung festzulegen. Die richtige Orchestrierungsplattform verbindet nicht nur KI-Tools – sie definiert neu, wie Teams zusammenarbeiten, Probleme lösen und in größerem Maßstab Werte schaffen.

KI-Orchestrierungsplattformen vereinfachen komplizierte Arbeitsabläufe, indem sie verschiedene KI-Modelle, Datenquellen und Prozesse in einem automatisierten System zusammenführen. Sie verwalten Aufgaben wie Planung, Ressourcenverteilung und API-Integration, minimieren den manuellen Aufwand und reduzieren gleichzeitig die Entwicklungszeit und die Betriebskosten erheblich.

Diese Plattformen sind so konzipiert, dass sie sich mühelos skalieren lassen und es Unternehmen ermöglichen, von der Bearbeitung einer Handvoll Aufgaben auf die Verwaltung Tausender Aufgaben zu expandieren, ohne ihre Infrastruktur überarbeiten zu müssen. Sie zeichnen sich dadurch aus, dass sie große Datenmengen verarbeiten, die Ressourcennutzung effizienter gestalten und eine konsistente Übersicht gewährleisten. Dies führt zu schnelleren Bereitstellungen, höherer Produktivität und KI-Lösungen, die den dynamischen Anforderungen von Unternehmen besser gerecht werden.

KI-Orchestrierungsplattformen regeln die Kosten oft über nutzungsbasierte Preismodelle, sodass Unternehmen nur für das zahlen, was sie nutzen, anstatt sich auf feste Lizenzen zu verpflichten. Viele dieser Plattformen sind mit Echtzeit-Finanztools ausgestattet, darunter Dashboards zur Überwachung der Ausgaben nach Modell oder Workflow, Budgetwarnsystemen und Workload-Tagging für eine detaillierte Kostenanalyse. Diese Tools stellen sicher, dass Unternehmen einen klaren Überblick über ihre KI-bezogenen Ausgaben haben und die Kontrolle über ihre Budgets behalten.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

Prompts.ai setzt den Standard für sichere KI-Orchestrierung im Jahr 2025 und bietet Unternehmen eine zuverlässige Plattform, um ihre KI-Operationen mühelos zu skalieren. Das einheitliche Dashboard soll die Verwaltung vereinfachen und verfügt über integrierte Governance-Tools, Kostenverfolgung in Echtzeit und unveränderliche Prüfprotokolle. Diese Funktionen stellen sicher, dass Unternehmen die Vorschriften einhalten und gleichzeitig die vollständige Kontrolle über ihre KI-Workflows behalten.

Ausgestattet mit Sicherheitsmaßnahmen der Enterprise-Klasse wie rollenbasierter Zugriffskontrolle, End-to-End-Verschlüsselung und kontinuierlicher Compliance-Überwachung schützt Prompts.ai sensible Daten in jeder Phase des Betriebs. Durch die Integration von über 35 führenden LLMs in ein einziges sicheres Framework werden Risiken reduziert und Unternehmen in die Lage versetzt, ihre KI-Fähigkeiten sicher und effizient zu erweitern.