AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

Tauchen Sie tiefer ein, um den richtigen Rahmen für Ihr Team und Ihre Arbeitsabläufe zu finden.

Prompts.ai dient als zentralisierte, cloudbasierte Plattform, die Unternehmensbenutzer mit über 35 führenden KI-Modellen verbindet, darunter GPT-5, Claude, LLaMA, Gemini, Grok-4, Flux Pro und Kling – alle zugänglich über eine einzige Schnittstelle. Es ist keine Softwareinstallation erforderlich, sodass Teams jeder Größe KI problemlos in ihre Arbeitsabläufe integrieren können.

Die Plattform bewältigt eine große Herausforderung bei der KI-Einführung: die Werkzeugwucherung. Durch die Bereitstellung einer einheitlichen Umgebung konsolidiert es die Modellauswahl, schnelle Arbeitsabläufe und die Leistungsverfolgung in einem einzigen System. Dieser Ansatz verlagert die KI-Nutzung von verstreuten, einmaligen Experimenten hin zu konsistenten, skalierbaren Prozessen, die Unternehmen problemlos abteilungsübergreifend implementieren können.

Prompts.ai konzentriert sich auf die Automatisierung von KI-Workflows in Unternehmen und hilft Unternehmen dabei, unnötige Kosten zu senken und gleichzeitig Governance-Bedenken auszuräumen. Von Fortune-500-Unternehmen bis hin zu Kreativagenturen und Forschungslaboren können Benutzer konforme, überprüfbare Arbeitsabläufe erstellen, ohne das Risiko einzugehen, dass sensible Daten mehreren Drittanbieterdiensten ausgesetzt werden.

Die Plattform wurde von GenAI.Works mit einer beeindruckenden Benutzerbewertung von 4,8 von 5 als beste KI-Lösung für die Problemlösung und Automatisierung in Unternehmen ausgezeichnet. Unternehmen verlassen sich auf Prompts.ai für Aufgaben wie die Rationalisierung der Inhaltserstellung, die Automatisierung strategischer Arbeitsabläufe und die Beschleunigung der Angebotsentwicklung. Teilweise konnten Projekte, die früher Wochen dauerten, auf nur noch einen Tag reduziert werden.

Ein bemerkenswertes Beispiel stammt aus dem Mai 2025, als der freiberufliche KI-Direktor Johannes Vorillon die Plattform nutzte, um Google DeepMind Veo2-Animationen nahtlos in ein Werbevideo für Breitling und die französische Luftwaffe zu integrieren. Dieses Projekt zeigte, wie Prompts.ai eine reibungslose Orchestrierung mehrerer KI-Tools ermöglicht.

Prompts.ai vereinfacht die Arbeit von Teams mit KI, indem es den Zugriff auf über 35 Sprach- und Bildmodelle über eine einzige Schnittstelle integriert. Dadurch entfällt der Aufwand für die Verwaltung mehrerer Abonnements, API-Schlüssel und Abrechnungssysteme. Benutzer können verschiedene Modelle für bestimmte Aufgaben innerhalb eines einzigen Workflows kombinieren und so nahtlose Orchestrierungspipelines erstellen.

Die Plattform basiert auf einem TOKN-Kreditsystem, das die Nutzung über alle Modelle hinweg standardisiert und so die Kostenverfolgung und Ressourcenzuweisung vereinfacht. Teams können je nach Leistungsanforderungen je nach Bedarf zwischen Modellen wechseln. Geschäftspläne umfassen unbegrenzte Arbeitsbereiche und Mitarbeiter, was es für Unternehmen einfacher macht, die KI-Einführung zu skalieren.

Mit einem Pay-as-you-go-Preismodell passt Prompts.ai die Kosten an die tatsächliche Nutzung an und beginnt bei 0 $/Monat für die erste Erkundung. Geschäftspläne, die monatlich zwischen 99 und 129 US-Dollar pro Mitglied liegen, bieten unterschiedliche Ebenen von TOKN-Guthaben (250.000 bis 1.000.000) und 10 GB Cloud-Speicher auf allen Ebenen.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19. Juni 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

Die Geschäftspläne (Core, Pro und Elite) umfassen Tools zur Compliance-Überwachung und Governance-Verwaltung, bieten vollständige Transparenz in KI-Interaktionen und führen detaillierte Prüfpfade, um regulatorische Anforderungen zu erfüllen. Auch kleinere Teams und einzelne Fachleute, die die Personal Creator- und Family-Pläne nutzen, profitieren von diesen Governance-Funktionen der Unternehmensklasse.

Sensible Daten werden in einer zentralen, kontrollierten Umgebung gespeichert, wodurch die Risiken verringert werden, die mit der Verbreitung von Informationen über mehrere Drittanbieterdienste verbunden sind. Diese sichere Architektur minimiert nicht nur potenzielle Schwachstellen, sondern vereinfacht auch das Compliance-Management für Unternehmen, die strengen Vorschriften unterliegen.

Prompts.ai basiert auf einer Cloud-nativen Architektur und ermöglicht Unternehmen eine mühelose Skalierung. Teams können innerhalb weniger Minuten neue Mitglieder hinzufügen, Arbeitsbereiche erweitern und auf zusätzliche Modelle zugreifen, um sicherzustellen, dass die KI-Einführung so schnell wie nötig wachsen kann.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

Kubiya AI bietet eine Lösung zur Workflow-Automatisierung, die auf Konversationsschnittstellen basiert. Während spezifische Details zur Bereitstellungsarchitektur und den Orchestrierungsmethoden nicht öffentlich verfügbar sind, unterstreicht der Schwerpunkt auf Konversationsschnittstellen einen einzigartigen Aspekt bei der Rationalisierung der Workflow-Automatisierung.

IBM watsonx Orchestrate bringt KI-gesteuerte Automatisierung in den Unternehmensbetrieb und konzentriert sich dabei darauf, die Automatisierung für Geschäftsleute und nicht nur für Entwickler zugänglich zu machen. Indem es Benutzern ermöglicht, Befehle in natürlicher Sprache zu erteilen, vereinfacht die Plattform komplexe Aufgaben für nicht-technische Teams in den Bereichen Personalwesen, Finanzen, Vertrieb, Kundensupport und Beschaffung. Dieser Ansatz macht Programmierkenntnisse überflüssig und versetzt Geschäftsteams in die Lage, Prozesse unabhängig voneinander zu automatisieren.

Die Plattform glänzt durch die Automatisierung wiederkehrender Aufgaben, die den Mitarbeitern oft Zeit kosten. Mit einfachen Sprachbefehlen können Benutzer Arbeitsabläufe für Aufgaben wie die Planung von Vorstellungsgesprächen, die Zusammenfassung von Kandidatenprofilen, die Bearbeitung von Krediten und die Erstellung von Berichten initiieren. watsonx Orchestrate verwaltet diese Aktivitäten über mehrere Backend-Systeme hinweg und hält dabei Sicherheitsstandards der Enterprise-Klasse ein.

Beispielsweise implementierte ein großes Finanzinstitut watsonx Orchestrate, um den Kundensupport und die Backoffice-Funktionen zu optimieren. Mitarbeiter nutzten Eingaben in natürlicher Sprache, um Arbeitsabläufe für die Kreditbearbeitung und Serviceanfragen zu automatisieren. Die Plattform ließ sich nahtlos in Backend-Systeme integrieren, sorgte durch integrierte Governance für die Einhaltung der Compliance und lieferte spürbare Verbesserungen: schnellere Bearbeitungszeiten, weniger manuelle Fehler und höhere Kundenzufriedenheit. Dieses Beispiel verdeutlicht die Fähigkeit der Plattform, routinemäßige Unternehmensaufgaben in effiziente, automatisierte Prozesse umzuwandeln.

IBM watsonx Orchestrate bietet Hybrid-Cloud-Bereitstellungsoptionen, die die Ausführung von Workflows in der Cloud, vor Ort oder über beide Systeme hinweg ermöglichen. Diese Flexibilität ist besonders wertvoll für Unternehmen mit strengen Datenresidenzrichtlinien oder veralteter Infrastruktur. Die Plattform nutzt Large Language Models (LLMs), APIs und Unternehmensanwendungen, um Aufgaben sicher auszuführen und so die Kompatibilität mit verschiedenen Betriebsumgebungen sicherzustellen.

watsonx Orchestrate lässt sich nahtlos in verschiedene Systeme integrieren und ist damit eine robuste Lösung für die Unternehmensautomatisierung. Es stellt über visuelle Konnektoren und APIs eine Verbindung zu CRM-, ERP- und Cloud-Plattformen wie AWS und Azure her. Darüber hinaus arbeitet es eng mit IBM Watson-Diensten und anderen IBM KI-Modellen zusammen und erweitert seine Funktionen über die grundlegende Workflow-Automatisierung hinaus. Für fortgeschrittene Benutzer ermöglicht der programmgesteuerte API-Zugriff eine weitere Anpassung und Integration mit vorhandenen Tools.

__XLATE_18__

„IBM watsonx Orchestrate wurde entwickelt, um KI-gestützte Automatisierung direkt in Geschäftsabläufe zu integrieren. Im Gegensatz zu entwicklerzentrierten Tools richtet sich watsonx Orchestrate an Fachleute in den Bereichen Personalwesen, Finanzen, Vertrieb und Kundensupport, die Aufgaben ohne aufwändige Programmierung rationalisieren möchten.“ - Domo

Die Plattform umfasst außerdem vorgefertigte KI-Anwendungen und branchenspezifische Fähigkeiten, was eine schnellere Implementierung für gängige Anwendungsfälle ermöglicht. Allerdings sollten Unternehmen beachten, dass die Funktionalität außerhalb des IBM-Ökosystems im Vergleich zu Plattformen mit umfassenderen Integrationsoptionen möglicherweise eingeschränkter ist.

IBM watsonx Orchestrate zeichnet sich durch sein starkes Governance-Framework aus und ist damit eine bevorzugte Wahl für regulierte Branchen. Rollenbasierte Zugriffskontrollen stellen sicher, dass der Datenzugriff auf autorisierte Benutzer und bestimmte Funktionalitäten beschränkt ist.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

watsonx Orchestrate ist für die Skalierung in Hybridumgebungen konzipiert und unterstützt sowohl kleine Teams als auch große Unternehmen. Es steigert die betriebliche Effizienz, stellt die Einhaltung von Richtlinien sicher, mindert Risiken und steigert die Mitarbeiterproduktivität. Unternehmen können klein anfangen – sich auf bestimmte Abteilungen konzentrieren – und die Automatisierungsmöglichkeiten schrittweise erweitern, wenn sie Ergebnisse sehen und internes Fachwissen entwickeln.

Apache Airflow ist eine Open-Source-Plattform zur Orchestrierung komplexer Datenworkflows mithilfe gerichteter azyklischer Graphen (DAGs). Ursprünglich von Airbnb entwickelt und jetzt unter der Apache Software Foundation, hat es sich zu einer beliebten Wahl für die Planung, Überwachung und Verwaltung von Datenpipelines entwickelt. Im Gegensatz zu Automatisierungstools, die auf Geschäftsanwender zugeschnitten sind, wurde Airflow speziell für Dateningenieure und Entwickler entwickelt und bietet programmgesteuerte Kontrolle über die Workflow-Ausführung.

Airflow glänzt bei der Verwaltung von Datenpipelines, die komplexe Abhängigkeiten, geplante Aufgaben und Transformationslogik beinhalten. Datenteams verlassen sich für eine Vielzahl von Zwecken darauf, darunter die Koordinierung von ETL-Prozessen (Extrahieren, Transformieren, Laden), das Trainieren von Modellen für maschinelles Lernen, die Ausführung von Stapelverarbeitungsaufträgen, die Aufnahme von Daten aus mehreren Quellen, die Transformation von Datensätzen und die Erstellung von Berichten nach einem Zeitplan. Durch die Definition von Workflows in Python erhalten Entwickler umfassende Flexibilität bei der Implementierung benutzerdefinierter Logik und der effektiven Fehlerbehandlung.

Die Plattform umfasst eine visuelle Schnittstelle, die Einblicke in den Workflow-Status, Aufgabenabhängigkeiten und den Ausführungsverlauf bietet. Dies erleichtert die Überwachung der Leistung und die Fehlerbehebung. Wenn beispielsweise eine Aufgabe fehlschlägt, kann Airflow sie automatisch wiederholen, Warnungen senden oder nachfolgende Aufgaben überspringen, um kaskadierende Probleme zu verhindern. Diese Funktionalität macht es zu einer vielseitigen Wahl für unterschiedliche Bereitstellungsanforderungen.

Airflow kann als Einzelserver-Setup bereitgestellt oder auf verteilte Cluster skaliert werden, bei denen der Scheduler, die Worker und der Webserver auf separaten Maschinen arbeiten. Die Architektur besteht aus mehreren Schlüsselkomponenten: einem Scheduler, der Aufgaben basierend auf definierten Zeitplänen auslöst, Workern, die Aufgaben ausführen, einem Webserver für die Benutzeroberfläche und einer Metadatendatenbank, die Workflow-Definitionen und den Ausführungsverlauf speichert.

Dieses modulare Design ermöglicht es Unternehmen, die Arbeitskapazität je nach Arbeitslastanforderungen unabhängig zu skalieren. In Cloud-nativen Umgebungen wird Kubernetes häufig zur Bereitstellung von Airflow verwendet, wobei der KubernetesExecutor isolierte Pods für einzelne Aufgaben erstellt. Dieses Setup verbessert die Ressourcenisolation und ermöglicht es Teams, jeder Aufgabe spezifische Rechenressourcen zuzuweisen. Für diejenigen, die den Verwaltungsaufwand für die Infrastruktur reduzieren möchten, stehen verwaltete Airflow-Dienste zur Verfügung, die jedoch mit zusätzlichen Betriebskosten verbunden sind.

Die umfangreichen Integrationsmöglichkeiten von Airflow machen es äußerst anpassungsfähig. Es bietet vorgefertigte Konnektoren für Datenbanken, Cloud-Plattformen, Data Warehouses und Messaging-Systeme sowie die Möglichkeit, benutzerdefinierte Operatoren mit Python zu erstellen. Diese Flexibilität stellt sicher, dass Airflow unterschiedliche organisatorische Anforderungen erfüllen kann.

Das umfangreiche Bibliotheksökosystem von Python kann auch innerhalb von Workflows genutzt werden und ermöglicht so erweiterte Datentransformationen und Analysen direkt in Pipeline-Definitionen. Für KI- und maschinelle Lernanwendungen lässt sich Airflow nahtlos in Frameworks wie TensorFlow, PyTorch und scikit-learn integrieren. Diese Integrationen helfen Datenwissenschaftlern, Arbeitsabläufe für Aufgaben wie das Abrufen von Daten, die Vorverarbeitung von Funktionen, das Training von Modellen, die Leistungsbewertung und die Bereitstellung von Modellen für die Produktion zu orchestrieren.

Airflow umfasst eine rollenbasierte Zugriffskontrolle (RBAC) zur Verwaltung von Benutzerberechtigungen über Arbeitsabläufe und Verwaltungsfunktionen hinweg. Administratoren können Rollen mit bestimmten Berechtigungen definieren und so sicherstellen, dass nur autorisierte Benutzer bestimmte DAGs anzeigen, bearbeiten oder ausführen können. Diese granulare Kontrolle trägt zur Aufrechterhaltung der Workflow-Integrität bei und verhindert unbefugte Änderungen.

Zu den Authentifizierungsoptionen gehören passwortbasierte Anmeldung, LDAP-Integration und OAuth-Anbieter. Sensible Anmeldeinformationen werden separat über das Verbindungs- und Variablensystem von Airflow verwaltet. Für mehr Sicherheit können externe Secret-Management-Tools wie HashiCorp Vault oder AWS Secrets Manager integriert werden.

Die Audit-Protokollierung ist eine weitere wichtige Funktion, die Benutzeraktionen und Workflow-Ausführungen verfolgt. Dadurch wird eine detaillierte Aktivitätsaufzeichnung erstellt, die für Compliance- und Fehlerbehebungszwecke von unschätzbarem Wert ist.

Der Luftstrom wird horizontal skaliert, indem weitere Worker-Knoten hinzugefügt werden, um erhöhte Arbeitslasten zu bewältigen. Die Plattform unterstützt mehrere Executor-Typen, um Aufgaben effektiv zu verteilen: Der LocalExecutor führt Aufgaben auf derselben Maschine wie der Scheduler aus, der CeleryExecutor verteilt Aufgaben mithilfe einer Nachrichtenwarteschlange auf mehrere Arbeitsmaschinen und der KubernetesExecutor erstellt für jede Aufgabe isolierte Pods.

Um die Leistung zu optimieren, sind ein sorgfältiges DAG-Design und eine sorgfältige Ressourcenzuweisung unerlässlich. Hohe Aufgabenvolumina können den Planer belasten, daher teilen Teams häufig große DAGs auf, passen die Planereinstellungen an und stellen sicher, dass der Metadatenspeicher über ausreichende Ressourcen verfügt.

Airflow verarbeitet auch Backfills effizient und ermöglicht es Teams, historische Daten erneut zu verarbeiten, wenn sich die Workflow-Logik ändert. Während das Backfilling Aktualisierungen rationalisiert, kann es erhebliche Rechenressourcen verbrauchen und erfordert eine sorgfältige Planung, um Unterbrechungen der Produktionsarbeitslasten zu vermeiden.

Als Open-Source-Lösung gibt Airflow Unternehmen die volle Kontrolle über ihre Bereitstellungen. Dies bedeutet jedoch auch, dass sie die Infrastruktur, Überwachung und Upgrades verwalten müssen, was spezielle technische Ressourcen erfordert, um Zuverlässigkeit und Leistung im großen Maßstab aufrechtzuerhalten.

Kubeflow zeichnet sich als dedizierte Plattform für die Verwaltung von Machine-Learning-Workflows aus und unterscheidet sich von allgemeineren Workflow-Tools. Diese speziell für Kubernetes entwickelte Open-Source-Lösung unterstützt den gesamten Lebenszyklus des maschinellen Lernens und gibt Datenwissenschaftlern und ML-Ingenieuren die Tools an die Hand, die sie zum Erstellen, Bereitstellen und Verwalten produktionsbereiter Modelle mithilfe nativer Kubernetes-Funktionen benötigen.

Kubeflow ist auf die Orchestrierung kompletter Machine-Learning-Workflows in Kubernetes-Umgebungen zugeschnitten. Es deckt alle Phasen des ML-Lebenszyklus ab, einschließlich Datenvorverarbeitung, Feature-Engineering, Modelltraining, Validierung, Bereitstellung und Überwachung. Indem es Teams ermöglicht, modulare und wiederverwendbare Pipelines zu erstellen, vereinfacht Kubeflow die Verwaltung verteilter ML-Workloads. Sein zentralisierter Ansatz hilft auch bei der Experimentverfolgung und Modellüberwachung über verschiedene Projekte hinweg. Darüber hinaus kann Kubeflow Umschulungsworkflows automatisieren, wenn neue Daten eingeführt werden, um sicherzustellen, dass Modelle aktuell und relevant bleiben.

Kubeflow basiert auf Kubernetes und nutzt Container-Orchestrierung, dynamische Skalierung und Ressourcenverwaltung, um ML-Workflows zu optimieren. Benutzer können mit der Plattform über eine webbasierte Schnittstelle zur visuellen Verwaltung oder eine Befehlszeilenschnittstelle zur Automatisierung interagieren. Je nach Arbeitslast weist Kubeflow Ressourcen dynamisch zu – etwa die Bereitstellung von GPUs für Trainingsaufgaben und CPUs für Inferenzen. Seine Flexibilität ermöglicht die Bereitstellung auf jedem Kubernetes-Cluster, sei es vor Ort, in der Cloud oder in Hybrid-Setups, und gewährleistet so die Anpassungsfähigkeit an alle Umgebungen.

Kubeflow lässt sich nahtlos in gängige Frameworks für maschinelles Lernen wie TensorFlow, PyTorch und XGBoost integrieren und unterstützt durch sein erweiterbares Design auch benutzerdefinierte Frameworks. Über ML-Frameworks hinaus verbindet es sich mit verschiedenen Cloud-Diensten und Speicherlösungen und ermöglicht Pipelines den Zugriff auf Objektspeicher für Daten, Data Warehouses für den Funktionsabruf und Überwachungstools für die Leistungsverfolgung. Die Kompatibilität mit Python-Bibliotheken vereinfacht den Übergang vom Experimentieren zur Produktion zusätzlich.

Kubeflow nutzt die inhärenten Skalierungsfunktionen von Kubernetes, um Arbeitslasten auf Clusterressourcen zu verteilen, wodurch es sich gut für umfangreiche Schulungs- und Datenverarbeitungsaufgaben eignet. Dies gewährleistet eine effiziente Ressourcennutzung und unterstützt leistungsstarke ML-Operationen. Wie Akka treffend feststellte:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

Mit seiner Fähigkeit, Ressourcen unabhängig zuzuweisen, schließt Kubeflow die Lücke zwischen Experimentieren und Produktion und bietet sowohl Flexibilität als auch Leistung.

Flyte ist eine cloudnative Orchestrierungsplattform, die darauf ausgelegt ist, die Verwaltung von Container-Workflows für maschinelles Lernen (ML) mithilfe von Kubernetes zu optimieren. Die Bereitstellung von ML-Pipelines wird weniger komplex, da Ressourcen effizient auf Cloud-Umgebungen verteilt werden. Dieser Ansatz gewährleistet eine reibungslose Skalierung und konsistente Leistung, unabhängig von der Bereitstellungsgröße.

Flyte ist darauf ausgelegt, ML-Workflows jeder Größenordnung zu bewältigen und Ressourcen dynamisch zuzuweisen, um unterschiedlichen Anforderungen gerecht zu werden. Seine robuste Architektur stellt sicher, dass Arbeitslasten effizient verwaltet werden, und macht es zu einer zuverlässigen Wahl für eine Vielzahl von ML-Aufgaben in cloudbasierten Infrastrukturen.

Prefect ist eine Python-basierte Orchestrierungsplattform, die die Verwaltung komplexer Datenpipelines und maschineller Lernworkflows einfacher machen soll. Der Schwerpunkt liegt auf Benutzerfreundlichkeit, klarer Überwachung und Minimierung betrieblicher Hürden, sodass sich Datenwissenschaftler und Ingenieure auf die Erstellung von Arbeitsabläufen konzentrieren können, anstatt sich um die Infrastruktur zu kümmern.

Prefect glänzt mit der Automatisierung von Pipelines für maschinelles Lernen, Cloud-Workflows und Datentransformationsprozessen. Es eignet sich besonders für die Bearbeitung von ETL-Aufgaben und komplizierten Machine-Learning-Workflows, die mehrere Abhängigkeiten, parallele Ausführungen und Echtzeitverarbeitung beinhalten. Sein flexibles Planungssystem ermöglicht das Auslösen von Aufgaben auf der Grundlage von Zeitintervallen, bestimmten Ereignissen oder API-Aufrufen und macht es so an eine Vielzahl von Automatisierungsanforderungen anpassbar.

Prefect ist für Cloud-Umgebungen optimiert und stellt sicher, dass es skaliert und an moderne Infrastrukturanforderungen angepasst werden kann. Es wurde nativ in Python entwickelt und lässt sich nahtlos in Python-basierte Datenökosysteme integrieren, sodass das Erlernen neuer Programmiersprachen oder Tools nicht mehr erforderlich ist.

Prefect bietet nahtlose Kompatibilität mit einer Vielzahl von Datentools und Plattformen. Es lässt sich mühelos in beliebte Tools wie dbt, PostgreSQL, Snowflake und Looker integrieren und unterstützt gleichzeitig Echtzeitsysteme wie Apache Kafka. Für Cloud-Umgebungen arbeitet es mit großen Anbietern wie Amazon Web Services (AWS), Google Cloud Platform (GCP) und Microsoft Azure zusammen und gibt Teams die Flexibilität, Arbeitslasten basierend auf Kosten und Leistung zu optimieren. Darüber hinaus unterstützt Prefect Containerisierungstools wie Docker und Kubernetes und arbeitet mit verteilten Verarbeitungsframeworks wie Dask und Apache Spark. Um Teams auf dem Laufenden zu halten, werden auch Slack-Benachrichtigungen für Workflow-Updates bereitgestellt.

Prefect ist darauf ausgelegt, wachsende Datenmengen und zunehmende Workflow-Komplexität problemlos zu bewältigen. Seine fehlertolerante Engine stellt sicher, dass Arbeitsabläufe nach Fehlern wiederhergestellt werden können, indem fehlgeschlagene Aufgaben erneut versucht oder Probleme umgangen werden, was es in Produktionsumgebungen äußerst zuverlässig macht. Die Echtzeitüberwachung bietet detaillierte Einblicke in die Workflow-Ausführung und hilft Teams, Probleme schnell zu erkennen und zu lösen. Aufgrund seiner Fähigkeit zur effizienten Skalierung vertrauen große Technologieunternehmen auf Prefect, wenn es um die Verwaltung dynamischer Arbeitsabläufe geht. Für Teams, die gerade erst anfangen, bietet Prefect einen kostenlosen Plan an, während für größere Bereitstellungen, die zusätzliche Funktionen und Support erfordern, individuelle Preise verfügbar sind.

Metaflow ist eine Infrastrukturplattform für maschinelles Lernen, die ursprünglich von Netflix entwickelt wurde, um die Herausforderungen der Skalierung von Arbeitsabläufen für maschinelles Lernen zu bewältigen. Der Schwerpunkt liegt darauf, Prozesse benutzerfreundlich und effizient zu gestalten und Datenwissenschaftlern dabei zu helfen, reibungslos vom Prototypen zur Produktion überzugehen, ohne sich mit komplexer Infrastruktur befassen zu müssen.

Metaflow wurde für die Verwaltung skalierbarer maschineller Lernworkflows auf Produktionsebene entwickelt. Es vereinfacht den Weg von der explorativen Datenanalyse und dem Modelltraining bis zur Bereitstellung. Datenwissenschaftler können mithilfe vertrauter Bibliotheken Workflows in Python schreiben, während die Plattform sich automatisch um die Versionierung, das Abhängigkeitsmanagement und die Zuweisung von Rechenressourcen kümmert.

Die Plattform macht eine manuelle Infrastrukturverwaltung überflüssig, indem sie die erforderlichen Rechenressourcen automatisch bereitstellt. Dies ermöglicht einen nahtlosen Übergang von der lokalen Entwicklung zur Cloud-Produktion, ohne dass Codeänderungen erforderlich sind.

__XLATE_53__

„Metaflow orchestriert skalierbare ML-Workflows auf einfache Weise, indem es optimierte Cloud-Integrationen, robuste Versionierung und Infrastrukturabstraktion für eine produktionsbereite Bereitstellung bietet.“ - Akka.io

Der Bereitstellungsprozess von Metaflow wird durch die Fähigkeit zur einfachen Integration in Cloud-Dienste und Datenplattformen ergänzt. Sein Python-natives Design gewährleistet die Kompatibilität mit weit verbreiteten Bibliotheken für maschinelles Lernen, Datenverarbeitung und Visualisierung, sodass Teams die Tools, auf die sie sich bereits verlassen, optimal nutzen können.

Metaflow wurde ursprünglich von Netflix zur Unterstützung umfangreicher maschineller Lernvorgänge entwickelt und verfügt über ein leistungsstarkes Versionierungssystem. Dieses System verfolgt Experimente, Datensätze und Modellversionen, stellt die Reproduzierbarkeit der Experimente sicher und ermöglicht bei Bedarf einfache Rollbacks.

Dagster erweitert das Angebot an Orchestrierungs-Frameworks, indem es sich auf die Aufrechterhaltung der Datenintegrität konzentriert und gleichzeitig ein anpassbares Pipeline-Management bietet. Dieses Open-Source-Tool wurde entwickelt, um die Qualität zu verbessern, die Datenherkunft zu verfolgen und die Transparenz in Arbeitsabläufen des maschinellen Lernens (ML) sicherzustellen. Im Kern ist Dagster auf den Aufbau typsicherer, zuverlässiger Datenpipelines spezialisiert, die hohe Standards der Datenintegrität einhalten und klare Einblicke in Transformationen bieten.

Dagster ist besonders effektiv für die Verwaltung von ML-Workflows, bei denen Datenqualität und -präzision nicht verhandelbar sind. Es ist auf Teams zugeschnitten, die eine integrierte Validierung, robuste Metadatenverfolgung und umfassende Beobachtbarkeit während ihrer gesamten Prozesse benötigen. Ein praktisches Beispiel für seinen Nutzen ist der Gesundheitssektor, wo Organisationen sich auf Dagster verlassen, um sensible Gesundheitsdaten mit dem Grad an Integrität zu verarbeiten, der zur Einhaltung strenger Compliance- und Qualitätsmaßstäbe erforderlich ist.

Dagster ermöglicht Entwicklern die Definition komplexer Arbeitsabläufe direkt im Code, eine wesentliche Funktion für die Skalierung von KI-Operationen. Seine modulare Struktur unterstützt die Verkettung von Modellen und Agenten zur Erstellung fortschrittlicher Arbeitsabläufe, komplett mit automatisiertem Abhängigkeitsmanagement, Wiederholungsmechanismen und paralleler Ausführung. Darüber hinaus lässt sich Dagster nahtlos in verschiedene Cloud-Plattformen, APIs und Vektordatenbanken integrieren, wodurch es sich gut für die Bewältigung umfangreicher Daten- und KI-Aufgaben eignet.

Diese flexible Architektur gewährleistet eine reibungslose Integration mit verschiedenen Systemen.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen ist ein von Microsoft Research entwickeltes Open-Source-Framework, das es mehreren KI-Agenten ermöglicht, durch Konversation zusammenzuarbeiten, um komplexe Aufgaben zu bewältigen. Mit diesem System können Entwickler Anwendungen erstellen, bei denen spezialisierte Agenten zusammenarbeiten und jeder sein einzigartiges Fachwissen einbringt, um gemeinsame Ziele zu erreichen. Durch die Einführung einer Konversationsschnittstelle vereinfacht AutoGen den oft komplizierten Prozess der Koordination mehrerer KI-Komponenten.

AutoGen führt einen neuen Ansatz zur Multi-Agenten-Orchestrierung ein, indem es den Dialog als Mittel der Zusammenarbeit nutzt. Dieses Framework ist besonders effektiv in Problemlösungsszenarien, die die dynamische Zusammenarbeit mehrerer Agenten erfordern. Beispielsweise könnte in der Softwareentwicklung ein Agent Code generieren, während sich ein anderer auf Tests und Validierung konzentriert, wobei beide Agenten iterieren, um die Ausgabe zu verfeinern. Dieses Gesprächsmodell eignet sich hervorragend für Aufgaben wie die Automatisierung von Software-Workflows, die Unterstützung bei der Recherche und die Abwicklung komplexer Entscheidungsprozesse, bei denen unterschiedliche Perspektiven oder Fähigkeiten die Ergebnisse verbessern.

Für Teams, die eine iterative Verbesserung ihrer Arbeitsabläufe anstreben, ist AutoGen besonders attraktiv. Seine Fähigkeit, den Austausch zwischen Agenten zu erleichtern, spiegelt die menschliche Zusammenarbeit wider und erleichtert Entwicklern die Entwicklung von Systemen, die sich durch kontinuierlichen Dialog und Feedback weiterentwickeln und verbessern.

AutoGen legt Wert auf Modularität und zeichnet sich gleichzeitig durch sein Conversational Agent-Design aus. Jeder Agent arbeitet mit spezifischen Rollen und Anweisungen, die den Zugriff auf Tools, externe APIs oder Sprachmodelle umfassen können. Das Framework unterstützt sowohl autonome Agenten als auch Benutzer-Proxy-Agenten, die menschliche Eingaben einbeziehen und so Flexibilität bei der Verwaltung von Arbeitsabläufen bieten.

Das System kann während der Entwicklung lokal ausgeführt und für die Produktion auf Cloud-Umgebungen skaliert werden. Entwickler können definieren, wie Agenten interagieren – sei es durch sequentielle Arbeitsabläufe, bei denen sich Agenten abwechseln, oder durch komplexere Muster, bei denen mehrere Agenten gleichzeitig Beiträge leisten. Mit Python-basierten Konfigurationen erhalten Teams die volle Kontrolle über die Orchestrierungslogik, ohne die Lesbarkeit zu beeinträchtigen, und optimieren so den Prozess der Verwaltung von Multi-Agent-Interaktionen.

AutoGen bewältigt die Komplexität der Verwaltung mehrerer Modellaufrufe und Agentengespräche und ermöglicht es Entwicklern, sich auf die Gestaltung der Logik und des Verhaltens ihrer Systeme zu konzentrieren, anstatt sich um die Infrastruktur zu kümmern.

AutoGen lässt sich über Funktionsaufrufe nahtlos in Azure OpenAI Service und andere Modelle integrieren und gibt Entwicklern Flexibilität bei der Auswahl von KI-Backends. Es unterstützt auch die Verbindung von Agenten mit externen Tools und Diensten, sodass sie während ihrer Gespräche Daten abrufen, Code ausführen oder mit APIs von Drittanbietern interagieren können.

Mit dem Framework können Entwickler benutzerdefinierte Agententypen, wiederverwendbare Konversationsmuster und Orchestrierungsvorlagen erstellen. Diese Flexibilität bedeutet, dass Teams bereits vorhandene Muster für allgemeine Aufgaben nutzen und gleichzeitig tiefgreifende Anpassungen an spezielle Anforderungen vornehmen können.

Für Unternehmen, die bereits Microsoft-Tools verwenden, bietet AutoGen eine einfache Integration mit Azure-Diensten, Visual Studio Code und anderen Entwicklungsplattformen. Trotz dieser Ausrichtung auf das Microsoft-Ökosystem ist das Framework plattformunabhängig und funktioniert gut in einer Vielzahl von Technologieumgebungen.

AutoGen legt großen Wert auf die Kontrolle der Agentenfunktionen und die Verwaltung des Zugriffs auf externe Ressourcen. Entwickler definieren für jeden Agenten spezifische Berechtigungen, etwa auf welche APIs er zugreifen kann oder welche Daten er abrufen darf. Dieser granulare Ansatz stellt sicher, dass Agenten nach dem Prinzip der geringsten Rechte arbeiten und nur die Aufgaben ausführen, die für ihre Rollen erforderlich sind.

Der Konversationscharakter des Frameworks erstellt von Natur aus Prüfpfade, protokolliert Agenteninteraktionen und Entscheidungsprozesse. Diese Protokolle bieten Transparenz darüber, wie Ausgaben generiert werden, und unterstützen die Compliance und Debugging-Bemühungen. Teams können diese Aufzeichnungen überprüfen, um das Agentenverhalten zu analysieren und Bereiche für Verbesserungen zu identifizieren.

Human-in-the-Loop-Funktionen verbessern die Übersicht, indem sie ermöglichen, dass Arbeitsabläufe an kritischen Entscheidungspunkten zur menschlichen Überprüfung angehalten werden. Diese Funktion stellt sicher, dass sensible Aktionen vor dem Fortfahren bewertet werden können, und sorgt so für ein Gleichgewicht zwischen Automatisierungseffizienz, Governance und Kontrolle.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

Unternehmen können die Leistung verbessern, indem sie den Konversationskontext zwischenspeichern, schnellere Modelle für Routineaufgaben verwenden und fortgeschrittenere Modelle für komplexe Überlegungen reservieren. Auch die Gestaltung von Gesprächsmustern zur Minimierung unnötiger Gespräche steigert die Effizienz. Bei Bedarf unterstützt das Framework die parallele Agentenausführung, sodass unabhängige Aufgaben gleichzeitig statt nacheinander ausgeführt werden können.

Um hohe Arbeitslasten zu bewältigen, kann AutoGen auf einer automatisch skalierenden Cloud-Infrastruktur bereitgestellt werden, um sicherzustellen, dass das System unterschiedliche Anforderungen bewältigen und gleichzeitig die Kosten unter Kontrolle halten kann. Zustandslose Agenteninteraktionen vereinfachen die horizontale Skalierung, obwohl die Aufrechterhaltung des Kontexts über Börsen hinweg eine durchdachte Architekturplanung erfordert.

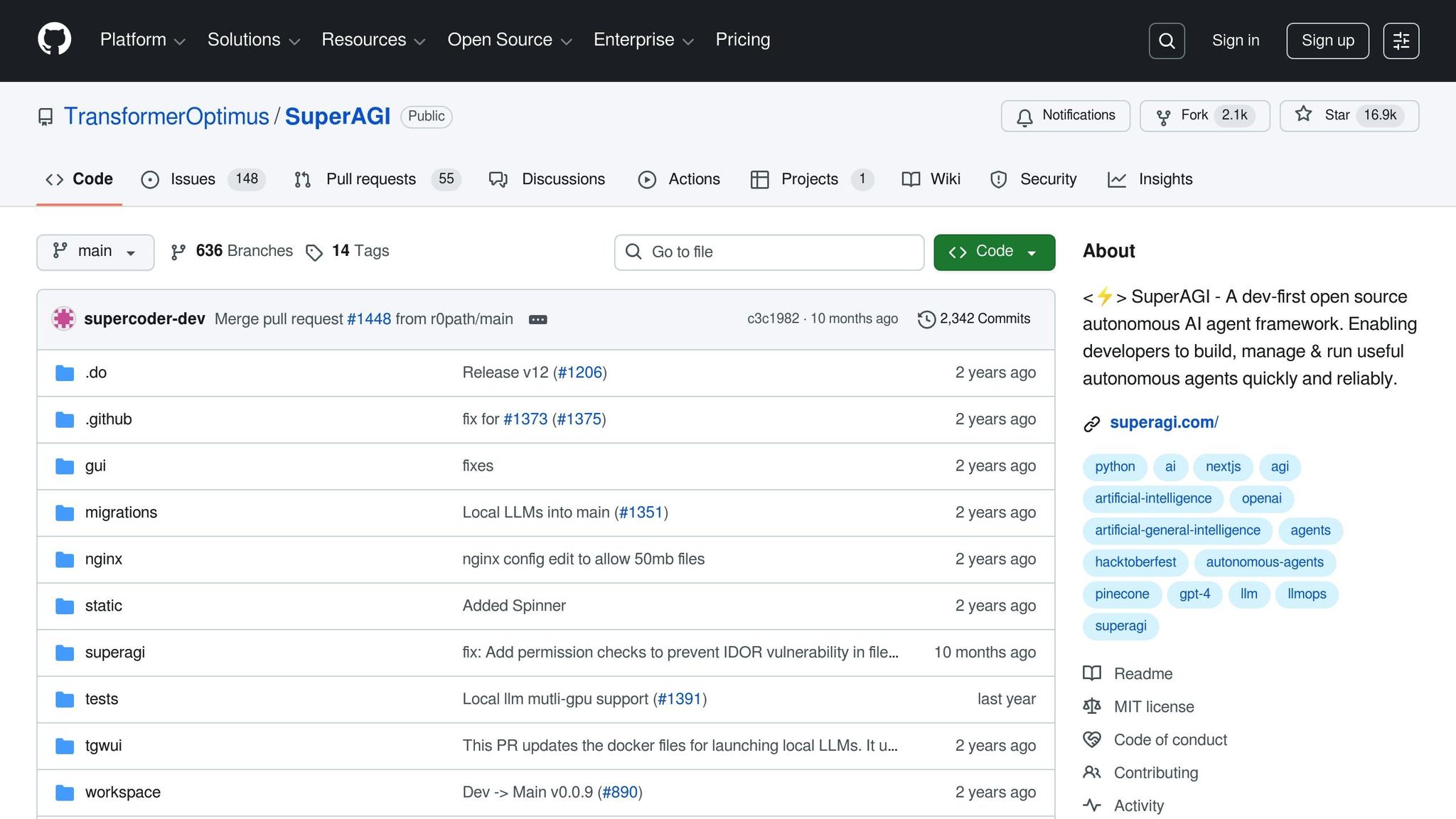

Aufbauend auf den von uns untersuchten Orchestrierungs-Frameworks stellt SuperAGI eine neue Möglichkeit zur Verwaltung der Zusammenarbeit mehrerer Agenten vor. Diese Open-Source-Plattform dient zur Koordinierung autonomer KI-Agenten und ermöglicht Entwicklern die Erstellung, Bereitstellung und Überwachung von Agenten, die durch kontinuierliches Lernen Aufgaben planen, ausführen und anpassen können. SuperAGI ermöglicht es mehreren Agenten, nahtlos zusammenzuarbeiten, Aufgaben dynamisch zu delegieren und bei der Bewältigung komplexer Herausforderungen zusammenzuarbeiten. Es verbindet adaptives Aufgabenmanagement mit der Teamarbeit mehrerer Agenten und zeichnet sich dadurch als leistungsstarkes Tool für die fortschrittliche KI-Orchestrierung aus.

SuperAGI glänzt mit der Automatisierung komplexer und sich weiterentwickelnder Aufgaben für Unternehmen. Seine Agentennetzwerke zeichnen sich durch fortschrittliche Aufgabenplanung und -ausführung aus und verbessern sich kontinuierlich durch verstärkendes Lernen und Feedbackschleifen. Dies macht es besonders nützlich für Organisationen, die große Operationen durchführen, bei denen eine intelligente Koordination von entscheidender Bedeutung ist. Agenten innerhalb der Plattform lernen aus ihren Interaktionen und Ergebnissen und können so ihr Verhalten im Laufe der Zeit verfeinern.

Das herausragende Merkmal der Plattform ist die dynamische Aufgabendelegierung. Anstatt sich an starre Arbeitsabläufe zu halten, bewerten Agenten Situationen in Echtzeit, identifizieren vorrangige Aufgaben und weisen sie den am besten geeigneten Netzwerkmitgliedern zu. Diese Flexibilität stellt sicher, dass Ressourcen auch in komplexen Szenarien effizient zugewiesen werden.

Die Architektur von SuperAGI ist im Kern auf Skalierbarkeit und Modularität ausgelegt. Entwickler können Agentennetzwerke und Arbeitslasten problemlos erweitern, um eine Vielzahl von Anwendungsanforderungen zu erfüllen. Jeder Agent arbeitet unabhängig, kommuniziert jedoch nahtlos und sorgt so für eine reibungslose Zusammenarbeit.

Eine benutzerfreundliche grafische Oberfläche ermöglicht es Teams, Agenteninteraktionen zu visualisieren und Konfigurationen zu optimieren. Überwachungs-Dashboards bieten Einblicke in die Agentenleistung und helfen Entwicklern, Ineffizienzen zu erkennen und zu beheben. Die Plattform unterstützt auch die parallele Ausführung, sodass mehrere Agenten gleichzeitig unabhängige Aufgaben bearbeiten können. Dieses Design steigert den Durchsatz erheblich, insbesondere in Umgebungen mit hoher Nachfrage.

SuperAGI verfügt über ein erweiterbares Plug-in-System, das sich in APIs, Workflow-Tools und benutzerdefinierte Module von Drittanbietern integrieren lässt. Diese Flexibilität beschleunigt die Entwicklung und fördert Beiträge aus der breiteren Entwicklergemeinschaft, wodurch die Fähigkeiten der Plattform bereichert werden.

Die verteilte, modulare Architektur der Plattform unterstützt die horizontale Skalierung und macht sie somit für groß angelegte Implementierungen anpassbar. Der Einsatz von verstärkendem Lernen und Feedbackschleifen verbessert die Gesamtleistung und stellt sicher, dass Aufgaben effizient verteilt werden. Da SuperAGI eine effektive Zusammenarbeit und einen hohen Durchsatz ermöglicht, eignet es sich gut für Unternehmen, die eine robuste Leistung in komplexen Szenarien mit hohem Volumen benötigen.

Um das richtige KI-Orchestrierungs-Framework auszuwählen, müssen Sie die Stärken und Grenzen jeder Option verstehen. Diese Plattformen sind mit unterschiedlichen Prioritäten konzipiert und erfüllen Anforderungen wie Sicherheit auf Unternehmensebene, Anpassungsfähigkeit für Entwickler oder spezielle Arbeitsabläufe wie Pipelines für maschinelles Lernen. Jedes Framework spiegelt seine einzigartige Designphilosophie und Zielanwendungsfälle wider.

Beispielsweise zeichnen sich Plattformen wie Prompts.ai durch die Zentralisierung des Zugriffs auf große Sprachmodelle (LLMs) aus, während Tools wie Apache Airflow und Prefect sich auf die allgemeine Workflow-Automatisierung konzentrieren. Andererseits sind Kubeflow und Flyte auf Pipelines für maschinelles Lernen zugeschnitten, und Frameworks wie SuperAGI und Microsoft AutoGen erweitern die Grenzen der KI-Zusammenarbeit mit mehreren Agenten, indem sie es autonomen Systemen ermöglichen, komplexe Aufgaben gemeinsam zu bewältigen.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

Kostenstrukturen: Herkömmliche Plattformen berechnen oft pro Benutzer oder Ausführung, was bei wachsendem Betrieb zu höheren Kosten führen kann. Im Gegensatz dazu verwendet Prompts.ai ein Pay-as-you-go-Modell mit TOKN-Guthaben, das die Ausgaben direkt mit der Nutzung verknüpft. Dieser Ansatz ist besonders hilfreich, wenn Sie mit verschiedenen Modellen experimentieren oder schwankende Arbeitslasten bewältigen.

Sicherheit und Compliance: Für Branchen wie das Gesundheitswesen oder das Finanzwesen sind robuste Sicherheitsmaßnahmen unerlässlich. Plattformen wie Prompts.ai, IBM watsonx Orchestrate und Prefect bieten integrierte Compliance-Tools wie Audit-Trails und rollenbasierte Zugriffskontrollen. Open-Source-Optionen wie Apache Airflow erfordern jedoch eine zusätzliche Konfiguration, um strenge Compliance-Standards zu erfüllen.

Lernkurve: Die Benutzerfreundlichkeit variiert stark. Plattformen wie Prefect und Dagster sind einsteigerfreundlicher und bieten intuitive Python-APIs und hilfreiche Fehlermeldungen. Unterdessen erfordern Apache Airflow und Kubeflow tiefergehende technische Fachkenntnisse und Fähigkeiten im Infrastrukturmanagement. Prompts.ai vereinfacht dies noch weiter mit einer einheitlichen Benutzeroberfläche, die Benutzerfreundlichkeit mit erweiterten Funktionen für Power-User vereint.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

Integrationsökosystem: Eine nahtlose Integration mit vorhandenen Tools ist von entscheidender Bedeutung. Apache Airflow ist führend mit Hunderten von Plugins für Cloud-Dienste, Datenbanken und Überwachungstools. Prompts.ai hingegen konzentriert sich speziell auf LLMs und bietet einen optimierten Zugriff auf Dutzende von Modellen über eine einzige API.

Skalierbarkeit: Plattformen wie Kubeflow und Flyte sind für die horizontale Skalierung konzipiert und nutzen Kubernetes für die Arbeitslastverteilung. Metaflow nutzt AWS-Dienste für die elastische Skalierung, während Prefect sowohl in der Cloud verwaltete als auch selbst gehostete Skalierungsoptionen unterstützt. SuperAGI verwendet eine verteilte Agentenarchitektur, die eine parallele Ausführung ermöglicht, allerdings erfordert dies eine sorgfältige Koordination.

Welches Framework für Sie am besten geeignet ist, hängt von Ihren spezifischen Arbeitsabläufen ab. Bei der LLM-Orchestrierung zeichnet sich Prompts.ai durch seinen zentralisierten Modellzugriff und seine Kosteneffizienz aus. Datenentwicklungsteams könnten auf die Zuverlässigkeit von Apache Airflow setzen, während ML-Teams, die an groß angelegten Schulungen und Bereitstellungen arbeiten, von Kubeflow oder Flyte profitieren könnten. Wenn Ihr Fokus auf dem Aufbau autonomer KI-Systeme liegt, könnten SuperAGI oder Microsoft AutoGen die richtige Lösung sein.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

Beispielsweise könnte Prompts.ai für Teams, die der LLM-Orchestrierung Priorität einräumen, besonders attraktiv sein. Es bietet zentralen Zugriff auf über 35 Modelle, wie GPT-5, Claude und Gemini, alles über eine einheitliche Schnittstelle. Das Pay-as-you-go-TOKN-Guthabensystem eliminiert Abonnementgebühren und bietet gleichzeitig eine Kostenverfolgung in Echtzeit. Mit Funktionen wie rollenbasierter Zugriffskontrolle und Audit-Trails ist Prompts.ai eine gute Wahl für Branchen, die eine strenge Governance ohne Kompromisse bei der Geschwindigkeit erfordern.

Datenentwicklungsteams, die mit komplexen ETL-Pipelines arbeiten, werden sich aufgrund des robusten Plugin-Ökosystems und der Skalierbarkeit möglicherweise für Apache Airflow entscheiden, erfordern jedoch fortgeschrittenere Fachkenntnisse. Andererseits bietet Prefect einen Python-nativen Ansatz mit benutzerfreundlicher Fehlerbehandlung, was es zu einer hervorragenden Option für ein schnelleres Team-Onboarding macht.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

Organisationen, die autonome KI-Systeme erforschen, könnten Microsoft AutoGen wegen seiner Funktionen für die Zusammenarbeit mit mehreren Agenten oder SuperAGI für die dynamische Aufgabendelegierung in Betracht ziehen. Diese Tools eignen sich ideal für die Forschung oder spezielle Anwendungsfälle, erfordern jedoch häufig fortgeschrittene Programmierkenntnisse, sodass sie für unmittelbare Produktionsanforderungen weniger geeignet sind.

Letztendlich umfasst die Auswahl des richtigen Frameworks die Bewertung von Faktoren wie Modularität, Erweiterbarkeit, Beobachtbarkeit und Governance-Funktionen wie rollenbasierte Zugriffskontrollen und Compliance-Zertifizierungen. Ebenso wichtig sind Bereitstellungsflexibilität und Integration mit vorhandenen Tools. Berücksichtigen Sie neben der Funktionalität auch die Entwicklererfahrung, einschließlich SDKs, Dokumentation und Gesamtbetriebskosten. Auch die Komplexität Ihrer Arbeitsabläufe – ob einfache Einzelagentenaufgaben oder komplizierte Multiagentensysteme mit persistentem Speicher – sollte Ihre Entscheidung leiten.

Die Branche tendiert zu skalierbaren, integrierten KI-Systemen, wobei Open-Source-Frameworks einen Großteil der Unternehmensarbeitslasten steuern, während vom Anbieter verwaltete Laufzeiten betriebliche Herausforderungen vereinfachen.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

Bei der Auswahl eines KI-Orchestrierungs-Frameworks ist es wichtig zu berücksichtigen, wie gut es sich in Ihre aktuellen Tools und Systeme integrieren lässt. Ein Framework mit starken Integrationsfähigkeiten stellt sicher, dass alles ohne unnötige Komplikationen zusammenarbeitet.

Achten Sie auf die Automatisierungsfunktionen wie Workflow-Planung und Aufgabenverwaltung, da diese Abläufe vereinfachen und Zeit sparen können. Ebenso wichtig sind Sicherheits- und Governance-Maßnahmen, die sensible Daten schützen und Ihnen helfen, die Vorschriften einzuhalten.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

Prompts.ai vereinfacht die Herausforderung, mehrere KI-Tools unter einen Hut zu bringen, indem es mehr als 35 große Sprachmodelle auf einer einheitlichen Plattform zusammenführt. Mit diesem Setup können Benutzer Modelle mühelos nebeneinander vergleichen und dabei den vollständigen Überblick über ihre schnellen Arbeitsabläufe, die Ausgabequalität und die Gesamtleistung behalten.

Um die Effizienz zu steigern, verfügt Prompts.ai über eine integrierte FinOps-Schicht zur Kostenoptimierung. Dieses Tool bietet Echtzeit-Einblicke in Nutzung, Ausgaben und Return on Investment (ROI) und ermöglicht es Unternehmen, ihre Ressourcen effektiv zu verwalten und das Beste aus ihren KI-Budgets herauszuholen.

Prompts.ai legt Wert auf Sicherheit und Compliance auf Unternehmensniveau und orientiert sich an Branchenstandards wie SOC 2 Typ II, HIPAA und DSGVO, um Ihre Daten in jeder Phase zu schützen.

Um eine kontinuierliche Überwachung und Compliance aufrechtzuerhalten, arbeitet Prompts.ai mit Vanta zusammen und hat am 19. Juni 2025 mit dem SOC 2 Typ II-Auditprozess begonnen. Diese Schritte stellen sicher, dass Ihre Arbeitsabläufe sicher, konform und zuverlässig für den Unternehmensbetrieb bleiben.