تعمل منصات تنسيق التعلم الآلي على تبسيط سير عمل الذكاء الاصطناعي، وتقليل التكاليف، وتعزيز قابلية التوسع. يقوم هذا الدليل بتقييم 10 منصات رائدة بناءً على ميزاتها وسهولة استخدامها وشفافية التكلفة لمساعدتك في اختيار الحل المناسب لاحتياجات عملك.

اختر نظامًا أساسيًا بناءً على أولوياتك: توفير التكاليف، أو قابلية التوسع، أو التكامل مع الأدوات الموجودة. بالنسبة لسير العمل الذي يتطلب الكثير من متطلبات LLM، فإن Prompts.ai هي الرائدة في المجموعة. لتلبية احتياجات التعلم الآلي الأوسع، يعد Airflow أو Kubeflow خيارين قويين مفتوحي المصدر. قد تفضل المؤسسات المستندة إلى السحابة Azure ML أو Vertex AI للتكامل السلس.

Prompts.ai عبارة عن منصة لتنسيق الذكاء الاصطناعي على مستوى المؤسسات مصممة لتبسيط إدارة أدوات الذكاء الاصطناعي. فهو يعالج تحديات انتشار الأدوات والنفقات الخفية، والتي غالبًا ما تعيق مبادرات الذكاء الاصطناعي قبل أن تتمكن من تحقيق نتائج قابلة للقياس.

من خلال التركيز على قابلية التشغيل البيني وقابلية التوسع وإدارة سير العمل بكفاءة، تعالج Prompts.ai نقاط الضعف الحرجة في عمليات الذكاء الاصطناعي للمؤسسات.

الميزة البارزة للمنصة هي قدرتها على توحيد الوصول إلى أكثر من 35 نموذجًا رائدًا للغات الكبيرة (LLMs) - بما في ذلك GPT-4، وClaude، وLLaMA، وGemini - من خلال واجهة واحدة آمنة. يزيل هذا الأسلوب التجزئة التي عادةً ما تؤدي إلى تعقيد عمليات نشر الذكاء الاصطناعي في المؤسسة.

يضمن Prompts.ai التوافق السلس بين النماذج من خلال تقديم واجهة موحدة تعمل عبر موفري LLM المختلفين. كما أنه يتكامل مع أدوات الأعمال المستخدمة على نطاق واسع مثل Slack وGmail وTrello، مما يجعله مناسبًا بشكل طبيعي لسير العمل الحالي.

تدعم بنية النظام الأساسي المقارنات جنبًا إلى جنب بين النماذج المختلفة، مما يسمح للمستخدمين بتقييم الأداء دون الحاجة إلى واجهات متعددة أو مفاتيح API. يعمل هذا النهج المبسط على تبسيط عملية اتخاذ القرار ويضمن اختيار النموذج الأفضل لكل حالة استخدام محددة.

تم تصميم Prompts.ai للتعامل مع المتطلبات على مستوى المؤسسة، ويتميز ببنية سحابية أصلية يمكن التوسع فيها بسهولة مع نمو الفرق وزيادة استخدام الذكاء الاصطناعي. تعد إضافة نماذج أو مستخدمين أو فرق جديدة عملية سريعة ومباشرة، ولا تتطلب تغييرات كبيرة في البنية التحتية.

يحل نظام رصيد TOKN للدفع عند الاستخدام الخاص بالمنصة محل الاشتراكات الشهرية الثابتة، مما يسهل على الشركات توسيع نطاق استخدام الذكاء الاصطناعي بناءً على الاحتياجات الفعلية. تعتبر هذه المرونة ذات قيمة خاصة للشركات ذات أعباء العمل المتقلبة أو تلك التي تجرب فرص التشغيل الآلي الجديدة.

تعمل Prompts.ai على تحويل مهام الذكاء الاصطناعي لمرة واحدة إلى مهام سير عمل منظمة وقابلة للتكرار. يمكن للفرق إنشاء مسارات عمل سريعة وموحدة لضمان مخرجات متسقة مع تقليل الوقت المستغرق في الهندسة السريعة اليدوية.

بالإضافة إلى ذلك، تدعم المنصة التخصيص المتقدم، بما في ذلك التدريب والضبط الدقيق لـ LoRAs (المحولات منخفضة الرتبة) وإنشاء وكلاء الذكاء الاصطناعي. تعمل هذه الميزات على تمكين المؤسسات من إنشاء مسارات عمل أتمتة مخصصة تتوافق مع أهداف أعمالها المحددة.

يوفر Prompts.ai، المصمم خصيصًا لسير عمل LLM، أدوات لإدارة المطالبات وتتبع الإصدارات ومراقبة الأداء.

ويتضمن أيضًا "توفير الوقت" المصمم من قبل الخبراء، وهو عبارة عن مسارات عمل معدة مسبقًا تم إنشاؤها بواسطة مهندسين سريعين معتمدين. تساعد هذه الحلول الجاهزة للاستخدام الشركات على تنفيذ حالات الاستخدام الشائعة بسرعة مع الحفاظ على معايير الجودة العالية.

تمثل التكاليف غير المتوقعة عقبة رئيسية أمام اعتماد الذكاء الاصطناعي في المؤسسات، وتعالج Prompts.ai هذه المشكلة من خلال رؤى الإنفاق في الوقت الفعلي. تقوم المنصة بتتبع كل رمز مميز يتم استخدامه عبر النماذج والفرق، مما يمنح المؤسسات رؤية واضحة لنفقات الذكاء الاصطناعي الخاصة بها. وفقًا لبيانات الشركة، يمكن أن يؤدي دمج أدوات الذكاء الاصطناعي من خلال Prompts.ai إلى توفير التكاليف بنسبة تصل إلى 98%. تأتي هذه الوفورات من تقليل اشتراكات البرامج وتحسين اختيار الطراز بناءً على الأداء والتكلفة.

تربط طبقة FinOps الخاصة بالمنصة الإنفاق على الذكاء الاصطناعي بنتائج الأعمال، مما يساعد الفرق المالية على تبرير الاستثمارات وتجنب تجاوز الميزانية. تضمن هذه الميزة أن تظل مبادرات الذكاء الاصطناعي قابلة للاستمرار من الناحية المالية مع تقديم قيمة قابلة للقياس.

Kubeflow عبارة عن منصة مفتوحة المصدر مصممة لتنسيق سير عمل التعلم الآلي (ML) على Kubernetes. تم تطويره في الأصل بواسطة Google ويديره الآن مجتمع CNCF، وهو يوفر مجموعة قوية من الأدوات لنشر وإدارة وتوسيع نطاق سير عمل تعلم الآلة في الحاويات بكفاءة.

Built for Kubernetes-focused organizations, Kubeflow simplifies the complexities of ML operations, transforming them into streamlined, repeatable workflows. Let’s explore its scalability, workflow automation, integration with large language models (LLMs), and how it helps manage costs.

يستفيد Kubeflow من التوسع الأفقي لـ Kubernetes لإدارة أعباء عمل تعلم الآلة المطلوبة على مستوى المؤسسة. ومن خلال توزيع المهام الحسابية عبر عقد متعددة، فإنه يتيح المعالجة الفعالة لمجموعات البيانات الكبيرة وتدريب النماذج المعقدة.

تم تصميم بنيتها لدعم التدريب الموزع لأطر العمل الشائعة مثل TensorFlow وPyTorch. يتيح ذلك للفرق توسيع نطاق أعباء العمل الخاصة بهم بسلاسة، بدءًا من الأجهزة الفردية وحتى وحدات معالجة الرسومات المتعددة، دون الحاجة إلى إجراء أي تغييرات على التعليمات البرمجية الخاصة بهم.

Kubernetes’ resource management features, such as quotas and limits, further enhance scalability. Organizations can allocate specific CPU, memory, and GPU resources to various teams or projects, ensuring resources are distributed fairly and no single workflow overburdens the system.

باستخدام Kubeflow Pipelines، يمكن للفرق إنشاء مسارات عمل قابلة للتكرار باستخدام إما واجهة مرئية أو Python SDK. يتم وضع كل خطوة في خط الأنابيب في حاوية ويتم التحكم في إصدارها، مما يجعلها قابلة لإعادة الاستخدام عبر مشاريع مختلفة.

تساعد قوالب خطوط الأنابيب المعدة مسبقًا على توحيد المهام المتكررة مثل المعالجة المسبقة للبيانات والتدريب النموذجي والتحقق من الصحة. ولا يؤدي هذا إلى تقليل وقت الإعداد للمشروعات الجديدة فحسب، بل يضمن أيضًا الاتساق بين الفرق. علاوة على ذلك، يعمل Kubeflow على تبسيط تتبع التجربة عن طريق تسجيل المعلمات والمقاييس والعناصر تلقائيًا من كل مسار تشغيل، مما يسهل على الفرق مقارنة إصدارات النماذج وتكرار النتائج الناجحة.

إن Kubeflow مجهز جيدًا لدعم سير عمل LLM من خلال إمكانات تقديم النماذج القابلة للتطوير، والمدعومة بواسطة KServe. يتيح ذلك نشر نقاط نهاية الاستدلال التي يمكنها التعامل مع المتطلبات العالية. بالإضافة إلى ذلك، يتيح التكامل مع المكتبات مثل Hugging Face Transformers للفرق إمكانية دمج حاملي شهادات الماجستير المدربين مسبقًا في مساراتهم بسلاسة.

يوفر Kubeflow رؤى تفصيلية حول استخدام البنية التحتية من خلال الاستفادة من أدوات مراقبة Kubernetes مثل Prometheus. ومن خلال تتبع استهلاك وحدة المعالجة المركزية والذاكرة ووحدة معالجة الرسومات، تكتسب الفرق الرؤية اللازمة لتحسين بنيتها التحتية وإدارة التكاليف بفعالية.

لقد تطور Apache Airflow ليصبح منصة قوية لإدارة سير عمل التعلم الآلي، وذلك بفضل ملحقاته المتخصصة. تم إنشاء هذه الأداة مفتوحة المصدر في البداية بواسطة Airbnb في عام 2014، وهي تلعب الآن دورًا حيويًا في عمليات تعلم الآلة للمؤسسات التي تتراوح من الشركات الناشئة إلى الشركات الكبرى.

إحدى ميزات Airflow البارزة هي إطار الرسم البياني غير الحلقي المباشر (DAG)، والذي يسمح للمستخدمين بتصميم مسارات عمل معقدة لتعلم الآلة كرمز، مما يتيح إنشاء خطوط أنابيب مرنة وقابلة للتخصيص بدرجة كبيرة.

تكمن قوة Airflow في قدرتها على التكامل بسلاسة مع مجموعة واسعة من أدوات وخدمات التعلم الآلي. يتيح النظام البيئي للمشغلين والخطافات اتصالات سلسة مع أي إطار عمل تعلم الآلة أو منصة سحابية تقريبًا. تتضمن عمليات التكامل الأصلية TensorFlow وPyTorch وScikit-learn، بالإضافة إلى خدمات التعلم الآلي المستندة إلى السحابة من AWS وGoogle Cloud وMicrosoft Azure.

تعمل حزمة موفري Airflow ML على تعزيز إمكانية التشغيل البيني بشكل أكبر من خلال تقديم مشغلين متخصصين لأدوات مثل MLflow وWeights & التحيزات. يتيح ذلك للفرق إنشاء مسارات عمل شاملة تربط أدوات متعددة دون الحاجة إلى رمز تكامل مخصص. على سبيل المثال، يمكن لـ DAG واحد جلب البيانات من Snowflake، ومعالجتها مسبقًا باستخدام Spark، وتدريب نموذج باستخدام TensorFlow، ونشره على Kubernetes - كل ذلك مع الحفاظ على التحكم الكامل والرؤية في كل خطوة.

يتفوق Airflow أيضًا في الاتصال بقاعدة البيانات، حيث يقدم دعمًا مدمجًا لـ PostgreSQL وMySQL وMongoDB والعديد من مصادر البيانات الأخرى. وهذا يجعله اختيارًا ممتازًا للمؤسسات التي تدير عمليات سير عمل تعلم الآلة المعقدة عبر أنظمة بيانات متنوعة.

يتم تشغيل قابلية التوسع في Airflow بواسطة CeleryExecutor وKubernetesExecutor، مما يسمح لأحمال العمل بالتوسع أفقيًا عبر العقد العاملة المتعددة. يعد KubernetesExecutor مناسبًا بشكل خاص لمهام ML، حيث يمكنه تخصيص الحاويات ديناميكيًا بمتطلبات موارد محددة لمراحل مختلفة من سير العمل.

With its task parallelization capabilities, Airflow enables teams to run multiple ML experiments simultaneously, significantly cutting down the time required for hyperparameter tuning and model comparisons. Resource pools can be configured to ensure that resource-intensive tasks, such as training, don’t overwhelm the system, while lighter processes continue uninterrupted.

بالنسبة للمؤسسات التي تعمل مع مجموعات كبيرة من البيانات، فإن تعامل Airflow مع عمليات الردم والالتقاط يضمن إمكانية معالجة البيانات التاريخية بكفاءة عند تقديم نماذج أو ميزات جديدة.

يعمل Airflow على تبسيط سير عمل تعلم الآلة عن طريق تحويلها إلى خطوط أنابيب موثقة يتم التحكم فيها بالإصدار باستخدام تعريفات DAG المستندة إلى Python. يتم تعريف كل خطوة بوضوح، بما في ذلك التبعيات ومنطق إعادة المحاولة ومعالجة الفشل، مما يضمن مسارات قوية يمكنها التعافي من الأخطاء تلقائيًا.

يعمل مشغلو أجهزة الاستشعار في النظام الأساسي على جعل سير العمل القائم على الأحداث ممكنًا، مما يؤدي إلى عمليات إعادة التدريب عند وصول بيانات جديدة أو عندما ينخفض أداء النموذج إلى ما دون الحدود المقبولة. تعد هذه الأتمتة ضرورية للحفاظ على دقة النموذج في بيئات الإنتاج الديناميكية حيث تتغير البيانات بشكل متكرر.

ومن خلال إدارة تبعيات المهام، يضمن Airflow تنفيذ مهام سير العمل بالتسلسل الصحيح. تنتظر المهام النهائية تلقائيًا حتى تنتهي العمليات الأولية بنجاح، مما يقلل من مخاطر حدوث أخطاء مثل نماذج التدريب على البيانات غير المكتملة أو التالفة. وهذا يلغي الكثير من التنسيق اليدوي المطلوب عادةً في خطوط الأنابيب المعقدة.

Although Airflow wasn’t initially designed for large language models (LLMs), recent developments have expanded its capabilities to handle fine-tuning pipelines for models like BERT and GPT variants. Airflow can now manage dependencies across tasks such as data preparation, tokenization, training, and evaluation.

إن قدرته على التعامل مع المهام طويلة الأمد تجعله مثاليًا لوظائف تدريب LLM التي قد تستغرق ساعات أو حتى أيام. يراقب Airflow هذه العمليات، ويرسل تنبيهات عند ظهور مشكلات، ويعيد تشغيل عمليات التشغيل الفاشلة من نقاط التفتيش تلقائيًا.

بالنسبة للمؤسسات التي تطبق أنظمة توليد الاسترجاع المعزز (RAG)، يمكن لـ Airflow تنسيق العملية بأكملها - بدءًا من استيعاب المستندات وإنشاء التضمين وحتى تحديث قواعد بيانات المتجهات وإعداد النماذج للنشر. بالإضافة إلى ذلك، يوفر Airflow الرؤى التشغيلية اللازمة لإبقاء التكاليف تحت السيطرة.

يوفر Airflow تسجيلاً ومراقبة تفصيلية على مستوى المهمة، مما يمنح الفرق رؤية واضحة لاستخدام الموارد عبر سير العمل الخاص بهم. يساعد هذا التتبع الدقيق المؤسسات على إدارة تكاليف الحوسبة بشكل أكثر فعالية، خاصة في البيئات السحابية حيث يمكن أن تختلف التكاليف بناءً على أنواع المثيلات والاستخدام.

تحدد ميزة تتبع مدة المهمة في النظام الأساسي الاختناقات في المسارات، مما يمكّن الفرق من تحسين تخصيص الموارد وتحسين الكفاءة. بالنسبة لعمليات النشر المستندة إلى السحابة، تعد هذه الرؤية أمرًا بالغ الأهمية للتحكم في النفقات المرتبطة بالمهام كثيفة الحوسبة.

من خلال مراقبة SLA، ينبه Airflow الفرق عندما تتجاوز عمليات سير العمل أوقات التشغيل المتوقعة، مما يسلط الضوء على أوجه القصور التي قد تؤدي إلى إنفاق غير ضروري. هذا التوازن بين التكلفة والأداء يجعل Airflow أداة قيمة للمؤسسات التي تهدف إلى تحسين عمليات تعلم الآلة الخاصة بها.

يبرز Domino Data Lab كمنصة قوية لتنظيم التعلم الآلي على مستوى المؤسسة. تم تصميمه للتعامل مع أعباء العمل المتزايدة وعمليات النشر واسعة النطاق، وهو يوفر أساسًا متينًا لإدارة الموارد بكفاءة والأداء القابل للتطوير.

Domino Data Lab’s architecture is designed to adapt to changing demands. It employs dynamic resource allocation and elastic scaling to automatically adjust resources based on workload needs. By integrating with cluster systems, it enables smooth transitions from small-scale experiments to extensive model training. Its advanced workload scheduling ensures resources are distributed efficiently across projects, delivering consistent performance in enterprise settings.

توفر منصة DataRobot AI حلاً قويًا على مستوى المؤسسة لإدارة عمليات التعلم الآلي. تعمل كطبقة ذكاء مركزية، فهي تربط أنظمة الذكاء الاصطناعي المختلفة، مما يجعلها قابلة للتكيف مع مجموعة من الإعدادات التقنية.

تم تصميم DataRobot مع وضع قابلية التشغيل البيني في الاعتبار، مما يوفر بنية مفتوحة تدعم استراتيجيات الذكاء الاصطناعي المتنوعة. يتيح هذا التصميم للمؤسسات تقييم واختيار مكونات الذكاء الاصطناعي التوليدية المصممة وفقًا لمتطلباتها الفريدة.

The platform supports deploying native, custom, and external models across different prediction environments. These deployments can occur on DataRobot’s infrastructure or external servers, providing flexibility for various operational needs.

لتبسيط التكامل، يتضمن النظام الأساسي حزم عميل REST API وPython. ويضمن ذلك انتقالات سلسة بين سير عمل البرمجة والواجهات المرئية، مما يلبي احتياجات المستخدمين التقنيين وغير التقنيين.

علاوة على ذلك، يتكامل DataRobot بسلاسة مع كبار موفري الخدمات السحابية وخدمات البيانات، مما يتيح الوصول المباشر إلى البيئات السحابية الحية. تجعل هذه الميزات DataRobot أداة فعالة لتبسيط وتوحيد سير عمل الذكاء الاصطناعي في المؤسسة.

يعمل Prefect Orion على تبسيط تنسيق سير عمل التعلم الآلي (ML)، مما يلبي احتياجات الفرق التي تعطي الأولوية لأتمتة تعلم الآلة التي يمكن الاعتماد عليها. من خلال التركيز على إمكانية الملاحظة وتجربة المطور البديهية، تجعل المنصة مراقبة سير عمل تعلم الآلة وتصحيح أخطاءها أكثر وضوحًا.

يقوم Prefect Orion بتحويل وظائف Python إلى سير عمل منسق من خلال نظامه القائم على الديكور. من خلال تطبيق مصممي @flow و@task، يمكن للفرق تكييف كود ML الحالي الخاص بهم مع سير العمل المُدار دون الحاجة إلى إعادة كتابة كاملة. ويدعم تصميمه المختلط التحولات السلسة بين التطوير المحلي وبيئات التنفيذ القابلة للتطوير، مما يضمن سهولة الاختبار وتصحيح الأخطاء. بالإضافة إلى ذلك، تعمل ميزات إعادة المحاولة المضمنة وآليات معالجة الفشل على إعادة تشغيل المهام تلقائيًا عند ظهور المشكلات. تتكامل هذه الأتمتة بسلاسة مع ميزات التنسيق الأوسع.

Prefect Orion’s architecture separates workflow logic from execution, enabling independent scaling of compute resources. Workflows can run on platforms like Kubernetes clusters, Docker containers, or cloud-based compute instances. The platform supports parallel task execution across multiple workers and uses work queues to optimize resource allocation. These features allow teams to efficiently manage diverse and demanding ML workloads.

تعمل Flyte على تبسيط تنسيق التعلم الآلي عن طريق تحويل وظائف Python إلى سير عمل آمن من حيث النوع ومعتمد على الديكور. من خلال التحقق من صحة وقت الترجمة، يتم اكتشاف الأخطاء مبكرًا، ويضمن تنفيذ الحاوية المعزولة نتائج موثوقة ومتسقة.

يستخدم Flyte أسلوبًا قائمًا على الديكور لتحويل وظائف Python إلى سير عمل. فهو يتتبع نسب البيانات تلقائيًا لكل عملية تنفيذ، مما يسهل عملية مراقبة وتدقيق العمليات. يمكن للفرق تحديد تبعيات المهام المعقدة باستخدام بناء جملة يدعم التنفيذ الشرطي والحلقات وإنشاء المهام الديناميكية استنادًا إلى بيانات وقت التشغيل.

توفر المنصة أيضًا قوالب سير العمل، والتي تسمح للفرق بإنشاء قوالب ذات معلمات. يمكن إعادة استخدام هذه القوالب بتكوينات مختلفة، مما يقلل من التعليمات البرمجية المتكررة ويتيح إجراء تجارب سريعة باستخدام معلمات تشعبية أو مجموعات بيانات مختلفة.

تعمل أدوات التشغيل الآلي هذه بسلاسة مع إمكانيات التوسع في Flyte، مما يضمن الكفاءة والمرونة في إدارة سير العمل.

يفصل Flyte تعريفات سير العمل عن تنفيذها، مما يتيح التوسع الأفقي عبر مجموعات Kubernetes. يضمن هذا التصميم عزل سير العمل مع السماح للفرق بمشاركة موارد الحوسبة في بيئة متعددة المستأجرين.

على مستوى المهمة، يمكن للفرق تحديد متطلبات موارد محددة، مثل احتياجات وحدة المعالجة المركزية أو الذاكرة أو وحدة معالجة الرسومات. تقوم Flyte بتوفير هذه الموارد وقياسها ديناميكيًا بناءً على متطلبات عبء العمل، مما يضمن الأداء الأمثل.

لتحقيق كفاءة التكلفة، تتكامل Flyte مع موفري الخدمات السحابية لاستخدام المثيلات الموضعية للمهام المجمعة غير الهامة. في حالة مقاطعة مثيل فوري، يقوم برنامج الجدولة الخاص به تلقائيًا بترحيل المهام إلى المثيلات عند الطلب، مما يتجنب الانقطاع.

يدعم Flyte التكامل السلس مع أطر العمل الشائعة مثل PyTorch وTensorFlow وscikit-learn وXGBoost. كما أنه يستوعب المهام واسعة النطاق باستخدام Spark.

بالنسبة للنماذج الأولية والتجريب، يتكامل Flyte مع Jupyter Notebooks، مما يسمح بتحويل خلايا دفتر الملاحظات إلى مهام سير عمل. هذه الميزة تسد الفجوة بين التطوير والإنتاج.

بالإضافة إلى ذلك، تسهل واجهة REST API الخاصة بشركة Flyte الاتصال بالأنظمة الخارجية وخطوط أنابيب CI/CD. يمكن للفرق تشغيل مهام سير العمل برمجيًا، ومراقبة تقدمها، واسترجاع النتائج باستخدام واجهات HTTP القياسية، مما يعزز المرونة والكفاءة التشغيلية.

Tecton عبارة عن منصة تخزين ميزات تعمل على سد الفجوة بين هندسة البيانات والتعلم الآلي من خلال تقديم ميزات موثوقة لكل من التدريب والاستدلال في الوقت الفعلي. ويضمن ذلك سير عمل تعلم الآلة بشكل أكثر سلاسة من خلال توفير وصول متسق إلى الميزات عبر بيئات مختلفة، واستكمال أدوات التنسيق الأخرى.

تتكامل Tecton بسلاسة مع البنية التحتية للمؤسسة باستخدام واجهة برمجة التطبيقات التعريفية المستندة إلى Python. يتيح ذلك للفرق تحديد الميزات باستخدام أنماط الترميز المألوفة مع التوافق مع مراجعة التعليمات البرمجية المحددة وسير عمل CI/CD. تدعم المنصة أيضًا اختبار الوحدة والتحكم في الإصدار، مما يجعل من السهل دمجها في خطوط الأنابيب الهندسية الحالية.

تستوعب خيارات استيعاب البيانات المرنة للنظام الأساسي مجموعة متنوعة من بنيات البيانات. يمكن للفرق سحب البيانات من مصادر الدفعات مثل S3 وGlue وSnowflake وRedshift، أو دفق البيانات من أدوات مثل Kinesis وKafka. يمكن بعد ذلك دفع البيانات عبر جداول الميزات أو واجهة برمجة تطبيقات Ingest ذات زمن الوصول المنخفض.

بالنسبة للتنسيق، تقدم Tecton وظائف التجسيد وواجهة برمجة تطبيقات Triggered Materialization، مما يتيح التكامل مع الأدوات الخارجية مثل Airflow أو Dagster أو Prefect لاحتياجات الجدولة المخصصة.

في يوليو 2025، أعلنت Tecton عن شراكة مع Modelbit لعرض إمكانية التشغيل البيني في سيناريوهات العالم الحقيقي. يسمح هذا التعاون لفرق تعلم الآلة ببناء خطوط أنابيب شاملة، حيث تدير Tecton الميزات الديناميكية ويتعامل Modelbit مع نشر النموذج والاستدلال. يسلط مثال الكشف عن الاحتيال الضوء على هذا التآزر: تقدم Tecton ميزات مثل سجل المعاملات وسلوك المستخدم، بينما تنشر Modelbit خط أنابيب الاستدلال، وتجمعها في واجهة برمجة تطبيقات واحدة منخفضة زمن الوصول للكشف عن الاحتيال في الوقت الفعلي.

Next, let’s explore how Tecton’s architecture scales to handle demanding ML workloads.

Tecton’s architecture is designed to scale, offering a flexible compute framework that supports Python (Ray & Arrow), Spark, and SQL engines. This flexibility allows teams to choose the right tool for their needs, whether it’s simple transformations or more complex feature engineering.

The platform’s latest version incorporates DuckDB and Arrow alongside the existing Spark and Snowflake-based systems. This setup provides fast local development while maintaining the scalability needed for large-scale production deployments.

The impact of Tecton’s scalability is evident in real-world use cases. For instance, Atlassian significantly reduced feature development time. Joshua Hanson, Principal Engineer at Atlassian, shared:

__XLATE_59__

"عندما بدأنا لأول مرة في بناء مسارات عمل الميزات الخاصة بنا، استغرق الأمر شهورًا - في كثير من الأحيان ثلاثة أشهر - لنقل الميزة من النموذج الأولي إلى الإنتاج. في هذه الأيام، مع Tecton، أصبح من الممكن تمامًا إنشاء ميزة في غضون يوم واحد. لقد غيرت Tecton قواعد اللعبة من حيث سير العمل والكفاءة."

This scalability advantage also lays the foundation for Tecton’s ability to automate feature workflows effectively.

تعمل Tecton على أتمتة دورة حياة الميزة بأكملها، بما في ذلك التجسيد والإصدار وتتبع النسب، مما يقلل من الجهد اليدوي ويعزز الكفاءة.

A standout feature is Tecton’s developer workflow experience. Joseph McAllister, Senior Engineer at Coinbase's ML Platform, noted:

__XLATE_62__

"ما يتألق في Tecton هو تجربة هندسة الميزات - سير عمل المطور. منذ البداية، عندما تقوم بإعداد مصدر بيانات جديد وإنشاء ميزة على Tecton، فإنك تعمل مع بيانات الإنتاج، وهذا يجعل من السهل حقًا التكرار السريع."

HelloFresh offers another example of Tecton’s impact. Benjamin Bertincourt, Senior Manager of ML Engineering, described their challenges before adopting Tecton:

__XLATE_64__

"قبل Tecton، تم إنشاء ميزاتنا بشكل مستقل باستخدام خطوط أنابيب Spark الفردية. ولم يتم تصميمها للمشاركة، ولم يتم فهرستها في كثير من الأحيان، وافتقرنا إلى القدرة على تقديم الميزات للاستدلال في الوقت الفعلي."

Tecton is preparing for the future of AI with its upcoming integration with Databricks. Announced in July 2025, this partnership will embed Tecton’s real-time data serving capabilities directly into Databricks workflows and tooling. By combining Tecton’s feature serving with Databricks’ Agent Bricks, teams will be able to build, deploy, and scale personalized AI agents more efficiently within the Databricks ecosystem.

يعالج هذا التكامل على وجه التحديد الحاجة إلى تقديم الميزات في الوقت الفعلي في تطبيقات LLM، حيث يجب جلب البيانات الخاصة بالمستخدم والبيانات السياقية بسرعة لدعم تفاعلات الذكاء الاصطناعي المخصصة. فهو يعزز تنسيق سير عمل الذكاء الاصطناعي، مما يضمن التكامل السلس عبر الأنظمة الأساسية.

يوفر Azure Machine Learning نظامًا أساسيًا قويًا قائمًا على السحابة مصممًا لإدارة سير عمل التعلم الآلي على مستوى المؤسسة. كجزء من النظام البيئي لشركة Microsoft، فهو يتكامل بسلاسة مع خدمات Azure بينما يدعم أيضًا مجموعة واسعة من الأدوات والأطر مفتوحة المصدر التي تستخدمها فرق علوم البيانات بشكل شائع.

Azure ML stands out for its extensive compatibility with open-source technologies. It supports thousands of Python packages, including popular frameworks like TensorFlow, PyTorch, and scikit-learn, along with R support. The platform simplifies environment setup by providing pre-configured environments and containers optimized for these frameworks. For tracking experiments and managing models, Azure ML integrates with MLflow, offering a cohesive experience. Developers have flexibility in their choice of tools, whether it’s the Python SDK, Jupyter notebooks, R, CLI, or the Azure Machine Learning extension for Visual Studio Code.

عندما يتعلق الأمر بـ CI/CD، يتكامل Azure ML مع Azure DevOps وGitHub Actions، مما يتيح سير عمل MLOps الفعال. بالإضافة إلى ذلك، يمكن لـ Azure Data Factory تنسيق مسارات التدريب والاستدلال داخل Azure ML. بالنسبة لعمليات النشر واسعة النطاق، يستخدم النظام الأساسي Azure Container Registry لإدارة صور Docker وخدمة Azure Kubernetes (AKS) لعمليات النشر في حاويات. كما أنه يدعم التعلم العميق الموزع من خلال تكامله مع Horovod.

تم تصميم Azure ML للتوسع بسهولة، بدءًا من المشاريع المحلية الصغيرة وحتى عمليات النشر على مستوى المؤسسة. ويضمن تكاملها مع خدمة Azure Kubernetes (AKS) إمكانية نمو أحمال عمل تعلم الآلة ديناميكيًا بناءً على الطلب. بالنسبة لسيناريوهات الحوسبة الطرفية، يعمل Azure ML مع Azure IoT Edge ويستخدم ONNX Runtime لتمكين الاستدلال المحسّن. وكجزء من Microsoft Fabric، فإنه يستفيد من منصة التحليلات الموحدة، التي تجمع بين الأدوات والخدمات المتنوعة المصممة لمحترفي البيانات. تسمح قابلية التوسع هذه، جنبًا إلى جنب مع إمكانيات التشغيل الآلي، بالإدارة الفعالة لسير عمل تعلم الآلة المعقد.

تتفوق المنصة في أتمتة سير عمل تعلم الآلة المعقد. من خلال التكامل مع Azure Data Factory، فإنه يتيح أتمتة المهام مثل التدريب وخطوط الاستدلال إلى جانب أنشطة معالجة البيانات. تضمن هذه الأتمتة التنسيق السلس عبر إعداد البيانات والتدريب النموذجي ومراحل النشر، مما يقلل من الجهد اليدوي ويزيد الكفاءة.

يدعم Azure ML التدريب على نماذج اللغات الكبيرة (LLM) مع إمكانات التدريب الموزعة عبر Horovod. كما أنه يستفيد أيضًا من ONNX Runtime لتحسين الاستدلال، مما يجعله مثاليًا لتطبيقات مثل الذكاء الاصطناعي للمحادثة ومعالجة النصوص.

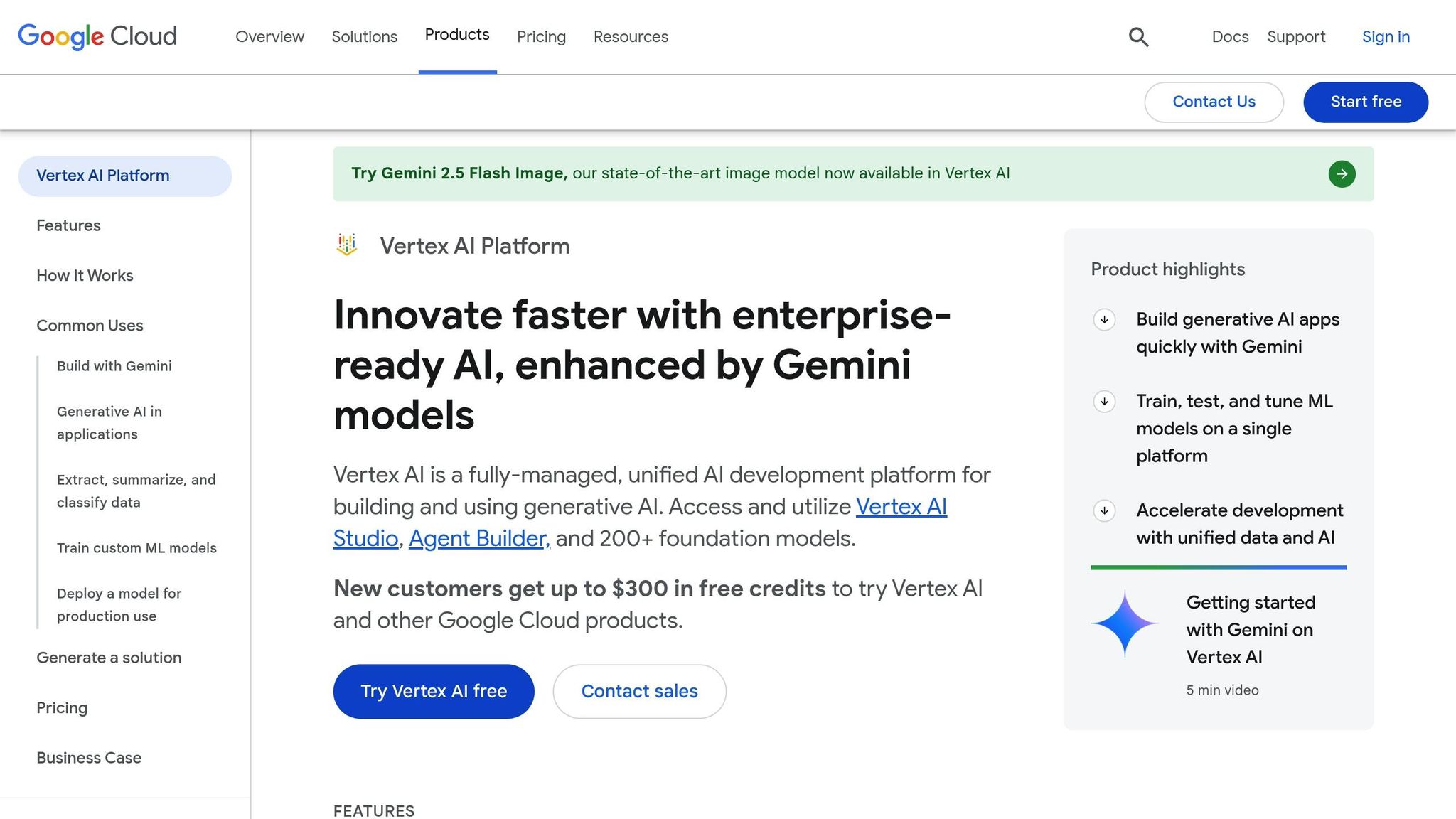

توفر Google Vertex AI Pipelines حلاً قويًا لإدارة سير عمل التعلم الآلي (ML)، حيث تجمع بين قوة Kubeflow Pipelines والبنية التحتية المتقدمة لـ Google Cloud. إنه يسد الفجوة بين التجريب والإنتاج، ويقدم تجربة سلسة مدعومة بخبرة Google في مجال الذكاء الاصطناعي.

تم تصميم Vertex AI Pipelines للعمل بسهولة ضمن النظام البيئي الأوسع لتعلم الآلة. وهو يدعم لغات البرمجة الشائعة، بما في ذلك Python، مما يسهل على الفرق الالتزام بالأدوات المألوفة. بالإضافة إلى ذلك، فهو يتكامل مع أطر تعلم الآلة المستخدمة على نطاق واسع مثل TensorFlow وPyTorch وXGBoost وscikit-learn، مما يضمن قدرة الفرق على الاستفادة من التعليمات البرمجية والخبرة الحالية دون انقطاع.

The platform’s foundation on Kubeflow Pipelines ensures smooth management of containerized workflows. Teams can package ML components as Docker containers, enabling consistent execution across different environments. For those who prefer notebook-based development, Vertex AI Pipelines integrates seamlessly with Jupyter notebooks and Vertex AI Workbench, offering a familiar environment for experimentation. This cohesive integration creates a scalable and efficient platform for ML development.

مدعومًا بالبنية التحتية لـ Google Cloud وGoogle Kubernetes Engine (GKE)، تم تصميم Vertex AI Pipelines للتعامل مع أعباء عمل تعلم الآلة الصعبة بسهولة. وهو يدعم التدريب الموزع عبر العديد من وحدات معالجة الرسومات ووحدات TPU، مما يجعله خيارًا ممتازًا لمشاريع التعلم العميق واسعة النطاق. يستفيد مستخدمو TensorFlow بشكل أكبر من التسريع المتخصص من خلال وحدات معالجة Tensor (TPUs).

For organizations with variable workload needs, the platform offers preemptible instances to cut costs for fault-tolerant tasks. Its integration with Google Cloud’s global network ensures low-latency access to data and compute resources, regardless of location.

تعمل Vertex AI Pipelines على تبسيط سير عمل التعلم الآلي من خلال وظيفة خط الأنابيب كرمز. يمكن للفرق تحديد مسارات العمل في Python باستخدام مكونات تم إنشاؤها مسبقًا، مما يتيح إنشاء خطوط أنابيب سريعة وقابلة لإعادة الاستخدام.

تتكامل المنصة أيضًا مع Vertex AI Features Store، مما يؤدي إلى تبسيط هندسة الميزات وتقديمها. وهذا يضمن الاتساق بين بيئات التدريب والنشر، مما يقلل الأخطاء ويحسن الكفاءة.

تدعم Vertex AI Pipelines سير العمل لنماذج اللغات الكبيرة (LLMs) من خلال الاتصال بـ Vertex AI Model Garden وPaLM API. يسمح هذا التكامل للفرق بضبط نماذج اللغة المدربة مسبقًا باستخدام بياناتهم الخاصة أثناء إدارة العملية من خلال مسارات آلية. يتم دعم التدريب الموزع لطلاب LLM باستخدام البنية التحتية لـ TPU، وذلك باستخدام تقنيات مثل توازي النماذج والبيانات للتغلب على قيود الذاكرة على الأجهزة الفردية.

وللاستدلال، تعمل المنصة مع Vertex AI Prediction، الذي يوفر نقاط نهاية قابلة للقياس التلقائي للتعامل مع أحمال الطلبات المتقلبة. تعمل إمكانات التنبؤ المجمعة على تسهيل معالجة مجموعات البيانات النصية الكبيرة لمهام مثل تحليل المشاعر أو تصنيف المستندات.

لمساعدة الفرق على إدارة النفقات، تتكامل Vertex AI Pipelines مع أدوات إدارة التكلفة السحابية من Google. توفر هذه الأدوات رؤى تفصيلية حول إنفاق تعلم الآلة وتسمح للمستخدمين بتعيين تنبيهات الميزانية، مما يضمن القدرة على التنبؤ بالتكلفة والتحكم فيها.

This section provides a balanced overview of the strengths and challenges of various platforms, helping you make informed decisions based on your organization’s needs. The key takeaways from the detailed platform reviews are summarized here.

يعد Prompts.ai خيارًا متميزًا لتنسيق الذكاء الاصطناعي على مستوى المؤسسة، حيث يقدم واجهة موحدة لأكثر من 35 نموذجًا رائدًا للغات الكبيرة (LLMs). يتيح نظام TOKN للدفع عند الاستخدام الخاص به توفير التكاليف بنسبة تصل إلى 98%، بينما تتحكم FinOps في الوقت الفعلي وامتداد أدوات معالجة الحوكمة القوية. ومع ذلك، فإن تركيزها على تنسيق LLM قد لا يناسب المؤسسات التي تعتمد بشكل كبير على سير عمل التعلم الآلي التقليدي (ML)، مما يجعلها مثالية لأولئك الذين يعطون الأولوية لفعالية التكلفة على مرونة تعلم الآلة الأوسع.

يتم استخدام Apache Airflow مع امتدادات ML على نطاق واسع لإدارة خطوط ML، وتنسيق وظائف التدريب، ونشر نماذج الذكاء الاصطناعي، والتعامل مع سير عمل الجيل المعزز للاسترجاع (RAG). تشمل عمليات التكامل الخاصة بها خدمات GCP وAWS وAzure ML، مدعومة بنظام بيئي ناضج ومجتمع قوي. ومع ذلك، يمكن أن يؤدي التوسع إلى التعقيد، وتعتمد قدرات الذكاء الاصطناعي الأصلية على الامتدادات، مما قد يزيد من تكاليف الصيانة.

يتفوق Domino Data Lab في الإدارة الشاملة لنماذج الذكاء الاصطناعي/التعلم الآلي، والمصممة خصيصًا لفرق علوم البيانات. وتكمن نقاط قوتها في التعاون وإدارة دورة الحياة، ولكنها تأتي مع تكاليف ترخيص عالية ومستوى من التعقيد قد يطغى على الفرق الصغيرة.

تجمع منصة DataRobot AI بين التدريب الآلي على النماذج والتنسيق، مما يوفر أدوات للحوكمة واكتشاف التحيز. على الرغم من أنه يبسط خطوط تعلم الآلة، إلا أن أسعاره المتميزة ومرونته المحدودة مقارنة بالبدائل مفتوحة المصدر يمكن أن تكون من عيوبه.

يُعد Prefect Orion خيارًا قويًا لمكدسات الذكاء الاصطناعي المستندة إلى Python، مما يتيح التكامل السلس لخطوط تعلم الآلة والتعامل مع سير العمل الديناميكي بفعالية. ومع ذلك، فإن نظامه البيئي الأصغر حجمًا وافتقاره إلى ميزات على مستوى المؤسسات قد يجعله أقل جاذبية للمؤسسات الأكبر حجمًا.

تم تصميم Flyte خصيصًا لسير عمل تعلم الآلة والبيانات، مما يوفر دعمًا أصليًا لأطر عمل مثل TensorFlow وPyTorch. إنه يتعامل مع سير عمل تعلم الآلة في حاويات على نطاق واسع ولكنه يتطلب خبرة Kubernetes ويعمل ضمن نظام بيئي لا يزال قيد التطوير، وهو ما قد يمثل تحديًا للفرق الجديدة في تنسيق الحاويات.

تتخصص Tecton في تنسيق تعلم الآلة في الوقت الفعلي وتشغيل الميزات، مما يجعلها مناسبة تمامًا لسير العمل الذي يركز على الميزات. ومع ذلك، فإن تركيزها الضيق وتكاليفها المرتفعة قد لا تناسب الفرق الصغيرة أو المشاريع التي تتطلب قدرات سير عمل أوسع.

توفر Azure ML Orchestration مجموعة قوية لتنسيق الذكاء الاصطناعي على مستوى المؤسسة، ومتكاملة بشكل وثيق مع النظام البيئي Azure، بما في ذلك أدوات مثل Data Factory وSynapse. تدعم ميزاته المتقدمة، مثل Microsoft AutoGen وSynapseML، سير عمل الذكاء الاصطناعي الموزع والمعقد. وتشمل التحديات الرئيسية تقييد البائعين وتعقيد التسعير، مما قد يجعل التنبؤ بالتكلفة أمرًا صعبًا.

Google Vertex AI Pipelines benefits from Google’s global infrastructure, offering reliable performance and TPU support. However, its dependency on Google Cloud services and potential cost increases with heavy usage may deter some organizations.

يسلط الجدول أدناه الضوء على نقاط القوة والقيود الأساسية لكل منصة:

Selecting the right platform depends on your organization’s priorities, technical expertise, and budget. For cost-conscious teams focused on LLM orchestration, Prompts.ai is a strong contender. If flexibility for traditional ML workflows is essential, Apache Airflow or Flyte may be better options. Enterprise teams already committed to specific cloud ecosystems might lean toward Azure ML or Vertex AI, despite concerns about vendor lock-in.

الخبرة الفنية هي عامل حاسم آخر. تتطلب الأنظمة الأساسية مثل Flyte معرفة Kubernetes، بينما يمكن الوصول إلى Prefect Orion بسهولة أكبر لمطوري Python. بالنسبة للمؤسسات التي تسعى إلى التشغيل الآلي بأقل قدر من التكوين، توفر DataRobot حلاً مبسطًا ولكنها تحد من التخصيص.

وأخيرا، تلعب اعتبارات الميزانية دورا هاما. توفر الأنظمة الأساسية مفتوحة المصدر مثل Apache Airflow وفورات في التكاليف ولكنها تتطلب المزيد من الموارد الداخلية للإعداد والصيانة. على الرغم من أن الحلول التجارية أكثر ثراءً بالميزات ودعمًا، إلا أنها تأتي بتكاليف ترخيص أعلى. بالإضافة إلى النفقات الأولية، ضع في الاعتبار التكلفة الإجمالية للملكية، بما في ذلك التدريب والصيانة والتبعيات المحتملة للبائع.

Choosing the right machine learning orchestration platform requires a careful balance of your organization’s needs, resources, and expertise. Here’s a summary of the key takeaways from our in-depth platform reviews.

تبرز Prompts.ai لقيادتها في تنسيق LLM وإدارة التكاليف. ومن خلال واجهة موحدة تدعم أكثر من 35 نموذجًا ونظام ائتمان TOKN للدفع أولاً بأول، فإنه يوفر ما يصل إلى 98% من التوفير مع تقليل انتشار الأدوات والحفاظ على إدارة قوية للتطبيقات الحساسة.

بالنسبة لأولئك الذين يبحثون عن مرونة أوسع في سير عمل التعلم الآلي، يوفر Apache Airflow مع ملحقات ML الخاصة به نظامًا بيئيًا قويًا متعدد السحابة. ومع ذلك، فإن تعقيدها عند التوسع قد يتطلب موارد وخبرات إضافية.

It’s essential to evaluate the total cost of ownership. While open-source platforms like Apache Airflow have low upfront costs, they require significant internal resources. On the other hand, commercial platforms such as DataRobot and Domino Data Lab deliver extensive features but come with higher price tags. Match the platform to your team’s technical strengths - for example, Flyte is ideal for Kubernetes-savvy teams, Prefect Orion suits Python-centric groups, and automated solutions like DataRobot work well for minimal configuration needs.

بالنسبة للمؤسسات المدمجة بعمق في بيئات سحابية محددة، توفر الأنظمة الأساسية مثل Azure ML Orchestration وGoogle Vertex AI Pipelines توافقًا سلسًا. ومع ذلك، يجب أن تضع في اعتبارك التحديات المحتملة المتعلقة بتقييد البائعين والتسعير.

Ultimately, the best platform for your organization depends on your unique priorities - whether it’s cost efficiency, workflow flexibility, enterprise-grade features, or cloud integration. Carefully assess your use cases, team capabilities, and budget to make an informed decision.

When choosing a platform for machine learning orchestration, it’s important to zero in on a few crucial aspects: scalability, user-friendliness, and compatibility with your current tools. A good platform should simplify processes like data preprocessing, model training, deployment, and monitoring, while being flexible enough to match your team’s technical skills.

من المهم بنفس القدر وضوح التكلفة - حيث يمكن لميزات مثل تتبع النفقات في الوقت الفعلي أن تجعل إدارة الميزانيات المتعلقة بالذكاء الاصطناعي أكثر كفاءة بكثير. ابحث عن الأنظمة الأساسية التي تؤكد على الأمان والامتثال والتكامل السهل للنماذج الجديدة، مما يضمن بقاء سير العمل لديك سلسًا وقابلاً للتكيف مع نمو متطلباتك.

توفر Prompts.ai تخفيضات مذهلة في التكلفة - تصل إلى 98% - من خلال الجمع بين أكثر من 35 نموذجًا لغويًا كبيرًا في منصة واحدة مبسطة. يزيل هذا الأسلوب المتاعب والنفايات المرتبطة بالتلاعب بأدوات متعددة.

تتميز المنصة أيضًا بطبقة FinOps متكاملة، والتي تراقب التكاليف وتعدلها بشكل مستمر في الوقت الفعلي. ويضمن ذلك حصول الشركات على أقصى قيمة من استثماراتها مع الحفاظ على أداء الذكاء الاصطناعي الاستثنائي.

Open-source platforms like Apache Airflow and Kubeflow offer robust solutions for orchestrating machine learning workflows, but they aren’t without their hurdles. One notable issue is performance - users may encounter slower execution speeds and heightened latency, which can impact overall efficiency. Furthermore, their intricate architectures can introduce dependency bloat, leading to longer build times and additional complexity.

ويكمن التحدي الآخر في دمج هذه المنصات مع بيئات التنفيذ المتنوعة. وهذا يتطلب في كثير من الأحيان مستوى عال من الخبرة وجهدًا كبيرًا لضمان التوافق. يمكن أن تصبح الإدارة الفعالة للموارد أيضًا نقطة ضعف، خاصة عند توسيع نطاق سير العمل أو معالجة المتطلبات الحسابية الفريدة. على الرغم من أن هذه المنصات توفر قدرًا كبيرًا من المرونة، إلا أنها قد لا تكون دائمًا الأفضل لكل السيناريوهات.