يعد تنسيق الذكاء الاصطناعي هو المفتاح لتوسيع نطاق عمليات الذكاء الاصطناعي للمؤسسات. مع فشل 95% من تجارب الذكاء الاصطناعي بسبب ضعف التنسيق، تحتاج الشركات إلى أدوات لتوحيد سير عمل الذكاء الاصطناعي المعقد وأتمتته وإدارته. يقدم مشهد 2025 منصات تعمل على دمج نماذج متعددة، وتأمين سير العمل، وتحسين التكاليف، مما يوفر عائد استثمار أعلى بنسبة تصل إلى 60% للمتبنين.

Here’s a quick breakdown of the top solutions:

توفر كل منصة نقاط قوة فريدة من حيث قابلية التوسع وقابلية التشغيل البيني والحوكمة وإدارة التكلفة. سواء كنت بحاجة إلى مرونة مفتوحة المصدر أو امتثال على مستوى المؤسسة، يمكن لهذه الأدوات تحويل أنظمة الذكاء الاصطناعي المجزأة إلى أنظمة بيئية موحدة وقابلة للتطوير.

اختر النظام الأساسي المناسب لتوسيع نطاق مبادرات الذكاء الاصطناعي الخاصة بك وتحسين التنسيق وزيادة عائد الاستثمار.

مقارنة منصات تنسيق الذكاء الاصطناعي: قابلية التوسع وقابلية التشغيل البيني والحوكمة والإدارة يكلف

Prompts.ai هي منصة مؤسسية متطورة مصممة لتبسيط وتبسيط عمليات الذكاء الاصطناعي. فهو يجمع ما يزيد عن 35 نموذجًا كبيرًا للغات من الدرجة الأولى - بما في ذلك GPT-5، وClaude، وLLaMA، وGemini، وGrok-4، وFlux Pro، وKling - في واجهة واحدة آمنة وموحدة. ومن خلال مركزية الوصول إلى هذه النماذج، تقضي المنصة على فوضى إدارة الأدوات المتعددة، مما يساعد المؤسسات على توسيع نطاق جهودها في مجال الذكاء الاصطناعي بسهولة.

Prompts.ai operates on a flexible pay-as-you-go system using TOKN credits, removing the need for recurring fees. This approach allows teams to quickly add models, users, or workflows without the burden of additional infrastructure. The platform’s unified interface acts as a command center, coordinating tasks and allocating resources efficiently across all integrated models. This scalable design ensures smooth cross-model integration, supporting businesses as their AI needs grow.

باعتباره مركزًا مركزيًا، يضمن Prompts.ai أن تعتمد جميع العمليات التي تعتمد على الذكاء الاصطناعي على قوالب مطالبات معتمدة يتم التحكم فيها بالإصدار بدلاً من السلاسل المتناثرة والمشفرة بشكل ثابت. تتيح بنيته سهولة اختيار النماذج وإجراء مقارنات الأداء جنبًا إلى جنب، مما يمكّن الفرق من تحديد ونشر نموذج اللغة الكبيرة الأكثر فعالية (LLM) لكل مهمة. يتم تحقيق كل هذا دون الحاجة إلى إعادة كتابة التعليمات البرمجية أو ضبط المسارات، مما يوفر الوقت والجهد.

تعطي Prompts.ai الأولوية للأمن والتحكم من خلال التحكم القوي في الوصول القائم على الأدوار (RBAC). يتيح ذلك للمؤسسات تحديد أذونات دقيقة لمن يمكنه إنشاء المطالبات أو تعديلها أو نشرها في بيئات الإنتاج. ويتم تسجيل كل تفاعل بدقة من خلال مسارات التدقيق وتتبع الإصدارات، مما يوفر شفافية كاملة. يساعد إطار الحوكمة هذا الشركات على تلبية معايير الامتثال مع الحفاظ على الرؤية والتحكم في عمليات الذكاء الاصطناعي. ومن خلال الجمع بين التدابير الأمنية الصارمة والكفاءة التشغيلية، تساعد المنصة المؤسسات على إدارة الذكاء الاصطناعي بأمان وفعالية.

تتضمن المنصة طبقة FinOps التي تتتبع استخدام الرمز المميز، وتربط مباشرة إنفاق الذكاء الاصطناعي بنتائج الأعمال. أبلغت العديد من المؤسسات عن خفض التكاليف بنسبة تصل إلى 98% من خلال دمج العلاقات مع البائعين وخفض الاشتراكات غير الضرورية. ومن خلال مقاييس الاستخدام والأداء في الوقت الفعلي، يمكن للفرق مراقبة الإنفاق وتحسينه بشكل مستمر، وتجنب النفقات غير المتوقعة في نهاية الشهر. وهذا المستوى من الشفافية المالية يحول الذكاء الاصطناعي من حالة عدم اليقين المتعلقة بالميزانية إلى استثمار قابل للقياس مع عوائد واضحة.

يبرز LangChain كإطار عمل قوي لتطبيقات الذكاء الاصطناعي، مع 90 مليون عملية تنزيل شهرية مثيرة للإعجاب وأكثر من 100000 نجمة على GitHub. يقسم تصميمه المعياري الوظائف إلى حزم خفيفة الوزن، مثل langchain-core للتجريدات التأسيسية وlangchain-community لتكاملات الطرف الثالث. ويضمن هذا النهج سير عمل الذكاء الاصطناعي بشكل مبسط دون أي تكاليف غير ضرورية، مما يجعله خيارًا مناسبًا لإدارة التعقيد والحجم.

LangChain employs LangGraph to handle intricate control flows, utilizing horizontally scalable servers and task queues. This architecture ensures durable execution, allowing agents to persist through failures and resume tasks without disruption. Between late 2024 and early 2025, Ellipsis scaled its operations to process over 500,000 requests and 80 million daily tokens, all while cutting debugging time by 90% thanks to LangChain’s orchestration capabilities. Similarly, during a viral launch in 2025, Meticulate managed to handle 1.5 million requests in just 24 hours, leveraging LangChain-compatible monitoring tools.

With over 1,000 integrations spanning model providers, vector databases, and APIs, LangChain excels in flexibility. Its Tools API simplifies interactions with external systems by automatically generating JSON schemas, enabling large language models to seamlessly connect with databases and CRMs. The platform’s observability layer, LangSmith, is framework-neutral, allowing teams to trace and monitor AI agents built with any codebase - not just LangChain libraries. For example, ParentLab used this modular framework to empower non-technical staff to update and deploy more than 70 prompts, saving over 400 engineering hours.

تلتزم LangSmith بمعايير الامتثال الصارمة، بما في ذلك HIPAA، وSOC 2 Type 2، وGDPR. وهو يوفر تتبعًا تفصيليًا للتنفيذ، مما يؤدي إلى إنشاء مسار تدقيق شامل لتصحيح الأخطاء ومراجعات الامتثال. تعمل LangGraph على تحسين ذلك من خلال ميزات الإنسان في الحلقة، بما في ذلك إمكانات "السفر عبر الزمن" للفحص في الوقت الفعلي والتراجع والتصحيح.

__XLATE_10__

يسلط غاريت سبونج، مدير SWE، الضوء على ما يلي: "تضع LangGraph الأساس لكيفية بناء أعباء عمل الذكاء الاصطناعي وتوسيع نطاقها - بدءًا من وكلاء المحادثة، وأتمتة المهام المعقدة، إلى التجارب المخصصة المدعومة من LLM والتي "تعمل فقط"".

LangSmith provides a free tier with 5,000 traces per month for debugging and monitoring. In production environments, it auto-scales while maintaining memory efficiency and enterprise-grade security. For instance, Gorgias conducted over 1,000 prompt iterations and 500 evaluations within five months, automating 20% of their customer support interactions. They achieved this while keeping costs in check through detailed usage tracking. LangChain’s ability to scale affordably makes it an essential tool for coordinated AI operations.

تتميز Kubeflow Pipelines (KFP) بسجل حافل مثير للإعجاب: 258 مليون عملية تنزيل لـ PyPI، و33,100 نجمة على GitHub، ومجتمع مزدهر يضم أكثر من 3,000 مساهم. تم تصميم KFP للتشغيل محليًا على Kubernetes، حيث ينفذ كل خطوة من خط الأنابيب كوحدة منفصلة، مما يسمح له بتوسيع موارد الحوسبة ديناميكيًا عبر مجموعتك حسب الحاجة. تعتمد بنيتها على بنية الرسم البياني غير الدوري المباشر (DAG)، مما يتيح التنفيذ المتوازي للمهام الحاوية ما لم يتم تحديد تبعيات بيانات محددة [18، 19]. يعد هذا الإعداد أمرًا أساسيًا لقدرته على التعامل مع مهام سير العمل المعقدة بكفاءة.

KFP is built for high performance, leveraging parallel execution and automated data management to maximize throughput [18, 19]. Users can define precise resource requirements - such as CPU, memory, and GPU - for each task, allowing the Kubernetes scheduler to allocate resources effectively. For instance, heavy computational tasks can be directed to GPU nodes, while lighter ones are assigned to CPU nodes. Additionally, KFP reduces redundancy by caching results for tasks that haven’t changed, cutting down on unnecessary compute usage [18, 19]. Some organizations have reported performance gains of up to 300% when compared to traditional machine learning workflow methods.

تضمن KFP المرونة وقابلية النقل من خلال تنسيق IR YAML الخاص بها، والذي يسمح بتشغيل خطوط الأنابيب بسلاسة عبر واجهات KFP الخلفية المختلفة، بدءًا من الإعدادات مفتوحة المصدر وحتى الخدمات المُدارة مثل Google Cloud Vertex AI Pipelines. وهذا يعني أنه يمكنك التطوير محليًا والنشر على نطاق واسع في السحابة دون إعادة كتابة التعليمات البرمجية الخاصة بك. تتكامل المنصة أيضًا مع الأدوات الشائعة مثل Spark وRay وDask لإعداد البيانات، بالإضافة إلى KServe لاستدلال النماذج القابلة للتطوير. باستخدام Python SDK، يمكن لعلماء البيانات تحديد مسارات العمل المعقدة باستخدام ممارسات الترميز المألوفة، بينما تقوم الواجهة الخلفية بترجمة هذه العمليات تلقائيًا إلى عمليات Kubernetes.

الأمن والحوكمة جزء لا يتجزأ من KFP. ويستخدم ميزات Kubernetes المضمنة، مثل التحكم في الوصول المستند إلى الدور (RBAC)، ومساحات الأسماء للعزل، وسياسات الشبكة، لضمان التنفيذ الآمن لسير العمل. تقوم المنصة بتتبع البيانات الوصفية والعناصر بشكل مركزي، مما يؤدي إلى إنشاء مسار تدقيق مفصل لكل تشغيل خط أنابيب [8، 22]. من خلال تشغيل كل خطوة من خطوات خط الأنابيب في حاوية معزولة، تحافظ KFP على عزل العملية والتعامل الآمن مع البيانات. يتمتع المسؤولون بالقدرة على تعيين حدود الموارد للمهام الفردية، مما يضمن التوزيع العادل للموارد عبر الفرق ومنع الإفراط في الاستخدام. بالنسبة للبيانات الحساسة أو أحمال العمل، يمكن استخدام محددات العقدة لتقييد المهام بأجهزة محددة وآمنة.

على الرغم من أن KFP نفسه مفتوح المصدر ومجاني الاستخدام، فإن التكاليف المرتبطة بالبنية الأساسية لـ Kubernetes - سواء على AWS EKS أو Google GKE أو محليًا - لا تزال سارية. تعمل الإصدارات المُدارة، مثل Google Cloud Vertex AI Pipelines، على نموذج تسعير الدفع أولاً بأول [19، 20]. يتضمن KFP أيضًا ميزات مثل آليات إعادة المحاولة للفشل العابر، والتي تساعد على تجنب تكلفة إعادة تشغيل خطوط الأنابيب طويلة الأمد، ومعالجات الخروج التي تضمن تنفيذ مهام التنظيف حتى في حالة فشل الخطوات السابقة. تساهم هذه الميزات في زيادة كفاءة استخدام الموارد والتحكم في التكاليف.

يعد Argo Workflows محرك تنفيذ سير عمل شائعًا مصممًا خصيصًا لـ Kubernetes، حيث تعتمد عليه أكثر من 200 مؤسسة في بيئات الإنتاج. وباعتباره حلاً أصليًا للحاوية، فإنه يقوم بتنسيق المهام المتوازية عن طريق تشغيل كل خطوة من خطوات سير العمل في حاوية معزولة. تتيح هذه البنية إمكانية التوسع الديناميكي استنادًا إلى السعة المتاحة لمجموعة Kubernetes الخاصة بك، مما يجعلها فعالة بشكل خاص لمهام الذكاء الاصطناعي التي تتطلب إدارة مرنة للموارد.

يدعم Argo Workflows التوسع من خلال التحسين الرأسي والتقسيم. من خلال زيادة المعلمة --workflow-workers، يمكنك تخصيص المزيد من مراكز وحدة المعالجة المركزية لتسريع عملية تسوية سير العمل. بالنسبة للعمليات الأكبر حجمًا، يمكن تنفيذ التقسيم عن طريق نشر عمليات تثبيت منفصلة لكل مساحة اسم أو تشغيل مثيلات وحدة تحكم متعددة داخل نفس المجموعة باستخدام معرفات المثيلات. لحماية خادم Kubernetes API، يستخدم Argo تحديد المعدل من جانب العميل (الافتراضي: 20 استعلامًا في الثانية مع دفعة من 30) ويحد من تزامن خطوات foreach عند 100 مهمة. ويضمن هذا النهج القابل للتطوير التكامل السلس مع الأنظمة الخارجية، حتى في ظل أعباء العمل الثقيلة.

باعتباره أحد تعريفات الموارد المخصصة لـ Kubernetes (CRD)، يتكامل Argo بسلاسة مع أي مجموعة Kubernetes ويعمل على تشغيل منصات الذكاء الاصطناعي البارزة مثل Kubeflow Pipelines وNetflix Metaflow وSeldon وKedro. يمكن للمطورين تحديد سير العمل باستخدام حزم SDK الرسمية لـ Python (Hera) وJava وGo، مما يوفر مرونة في اختيار اللغة. بالنسبة لإدارة العناصر، تدعم Argo حلول تخزين متنوعة، بما في ذلك AWS S3 وGoogle Cloud Storage وAzure Blob Storage وArtifactory وAlibaba Cloud OSS. ويضمن هذا التوافق تدفقًا سلسًا للبيانات عبر بيئات متنوعة. بالإضافة إلى ذلك، يمكن تشغيل سير العمل من خلال إشارات خارجية مثل خطافات الويب أو تغييرات التخزين باستخدام Argo Events. وفقًا لوثائق Metaflow، فإن Argo Workflows هو منسق الإنتاج الوحيد الذي يدعم تشغيل الأحداث من خلال أحداث Argo. هذا المزيج من المرونة والوظائف يجعله خيارًا قويًا لأتمتة سير العمل.

تستفيد Argo Workflows من ميزات Kubernetes الأصلية لضمان أمان قوي. يدير التحكم في الوصول المستند إلى الأدوار (RBAC) أذونات وحدة التحكم في سير العمل والمستخدمين والوحدات الفردية. لتعزيز العزل، يمكن تقييد وحدة التحكم بمساحة اسم واحدة باستخدام وضع "تثبيت مساحة الاسم". في بيئات الإنتاج، يدعم Argo الدخول الموحد (SSO) عبر OAuth2 وOIDC، مع تأمين البيانات أثناء النقل باستخدام تشفير TLS. يمكن للمسؤولين فرض قيود على سير العمل، مما يسمح للمستخدمين بإرسال القوالب المعتمدة مسبقًا فقط، وتساعد سياقات أمان Pod على منع تشغيل البودات كجذر. تنظم سياسات الشبكة حركة المرور لكل من Argo Server ووحدة تحكم سير العمل، ويمنع حد عمق التكرار الافتراضي البالغ 100 مكالمة تكرار الحلقات اللانهائية.

Argo Workflows هي أداة مفتوحة المصدر متاحة بموجب ترخيص Apache 2.0، مما يجعلها مجانية الاستخدام. لإدارة التكاليف، تستخدم استراتيجيات TTL وPod Garbage Collection (PodGC) لحذف سير العمل المكتمل تلقائيًا وتنظيف القرون غير المستخدمة، مما يقلل من إهدار الموارد. يمكن جدولة المهام على بنية أساسية فعالة من حيث التكلفة، مثل المثيلات الفورية، باستخدام محددات العقد وقواعد التقارب. بالإضافة إلى ذلك، يتم تتبع استخدام الموارد في كل خطوة، مما يساعد المستخدمين على مراقبة الإنفاق. إذا لاحظت "تقييدًا من جانب العميل" في سجلات وحدة التحكم، فإن زيادة قيم --qps و --burst يمكن أن تحسن كفاءة الاتصال مع واجهة برمجة تطبيقات Kubernetes. يساعد هذا التصميم المدروس على تحقيق التوازن بين الأداء وفعالية التكلفة.

أصبح Apache Airflow لاعبًا رئيسيًا في إدارة سير عمل الذكاء الاصطناعي، حيث يقدم إطارًا مرنًا قائمًا على التعليمات البرمجية لتنسيق العمليات المعقدة. إنها بارزة بشكل خاص في عمليات التعلم الآلي (MLOps)، حيث يطبقها 23% من مستخدميها، وفي مشاريع الذكاء الاصطناعي التوليدي، التي يستخدمها 9% من مجتمعها. تم إصدار Airflow بموجب ترخيص Apache 2.0، وهو يسمح للمطورين بتحديد سير العمل في Python، والتكامل بسلاسة مع أي مكتبة للتعلم الآلي.

Airflow’s modular design ensures it can handle workloads of any size. Using a message queue, it supports unlimited worker scaling, enabling efficient horizontal scaling for intensive tasks. The platform provides three main executors tailored to different needs:

يعد KubernetesExecutor مفيدًا بشكل خاص للتعامل مع أعباء العمل غير المتوقعة والمثقلة بالموارد. تسمح ميزات مثل تعيين المهام الديناميكية بتوسيع نطاق المهام استنادًا إلى البيانات في الوقت الفعلي، مما يجعلها مثالية لمجموعات البيانات الكبيرة وسير العمل متعدد النماذج. وفي الوقت نفسه، يعمل المشغلون المؤجلون على تحسين الكفاءة من خلال إدارة حالات الانتظار الطويلة، مثل مراقبة نموذج التدريب، دون شغل خانات العمال. يعزز هذا النهج بشكل كبير الإنتاجية واستخدام الموارد.

Airflow’s extensive interoperability ensures it fits seamlessly into diverse AI ecosystems. With over 80 independently versioned Provider Packages, it offers pre-built operators for platforms like OpenAI, AWS SageMaker, Azure ML, and Databricks. Its tool-agnostic nature allows it to coordinate services with APIs, including vector databases like Pinecone, Weaviate, and Qdrant, and specialized tools such as Cohere and LangChain.

تعمل واجهة برمجة تطبيقات TaskFlow على تبسيط إنشاء سير العمل باستخدام أدوات تزيين Python لتحويل البرامج النصية إلى مهام Airflow، وإدارة عمليات نقل البيانات تلقائيًا من خلال XComs. يمكن للفرق توجيه المهام إلى البيئات المناسبة، مثل كبسولات Kubernetes للتدريب المكثف على وحدة معالجة الرسومات أو مجموعات Spark للمعالجة المسبقة للبيانات. بالإضافة إلى ذلك، تتيح واجهة REST API وairflowctl CLI التكامل الآمن مع خطوط أنابيب CI/CD، مما يضمن إدارة سير العمل بشكل سلس وقابل للتدقيق.

Airflow’s architecture prioritizes security and governance. By separating the DAG processor from the scheduler, it ensures the scheduler cannot access or execute unauthorized code. Role-Based Access Control (RBAC) assigns specific roles - Deployment Manager, DAG Author, and Operations User - to limit permissions appropriately.

بالنسبة لإدارة البيانات، يتكامل Airflow مع OpenLineage، وهو معيار لتتبع نسب البيانات، مما يساعد على تلبية متطلبات الامتثال مثل القانون العام لحماية البيانات (GDPR) وHIPAA. يتفاعل airflowctl CLI حصريًا مع REST API، متجنبًا الوصول المباشر إلى قاعدة بيانات البيانات التعريفية لمزيد من الأمان. يمكن للفرق أيضًا إدارة البيئات القابلة للتكرار باستخدام مهام الإعداد والتفكيك، والتعامل مع البنية التحتية كرمز لتحسين المراقبة والاتساق.

Airflow supports cost-effective operations through managed services like AWS MWAA, Google Cloud Composer, and Astronomer, which offer usage-based pricing models. Teams can allocate tasks to appropriate resources - routing compute-heavy AI workflows to GPU instances while running lighter operations on more affordable CPU nodes. Deferrable sensors further cut costs by replacing synchronous versions, reducing resource usage when waiting for external APIs or data availability. With inference costs as low as $0.40 per million input tokens, Airflow’s efficient orchestration is a critical tool for managing budgets effectively.

يوفر Azure Machine Learning حلاً قويًا لاحتياجات الذكاء الاصطناعي للمؤسسات، ويتميز بوحدات معالجة رسومات متقدمة وشبكات InfiniBand ووقت تشغيل بنسبة 99.9% وأكثر من 100 شهادة امتثال. وبدعم من فريق مكون من 34000 مهندس و15000 خبير أمني، فهو يضمن الموثوقية والأمان على نطاق واسع.

تم تصميم النظام الأساسي للتعامل مع أعباء العمل من أي حجم من خلال دعمه للحوسبة الموزعة عبر البيانات والنماذج وخطوط الأنابيب، مما يزيد من كفاءة الموارد إلى الحد الأقصى. تعمل نقاط النهاية المُدارة عبر الإنترنت على تمكين النشر السلس للنموذج مع إمكانية التوسع التلقائي لاستيعاب الزيادات في الطلب. على سبيل المثال، ماركس & استخدم Spencer Azure ML لمعالجة البيانات لأكثر من 30 مليون عميل مع الاستفادة من التخزين المؤقت والسجلات لخطوط الأنابيب لتقليل وقت التدريب وتكاليفه. وبالمثل، في BRF، ألغت تعلم الآلة وعمليات MLOps المهام اليدوية لـ 15 محللًا، مما سمح لهم بالتركيز على العمل ذي القيمة الأعلى.

These scaling features integrate effortlessly with Azure ML’s broader ecosystem, providing a comprehensive solution for enterprise AI.

Azure Machine Learning connects seamlessly with tools like Apache Spark, Microsoft Fabric, Azure DevOps, and GitHub Actions, simplifying data preparation and automating AI workflows. Its model catalog includes foundation models from OpenAI, Meta, Hugging Face, and Cohere, enabling teams to fine-tune pre-trained models instead of building them from scratch. Papinder Dosanjh, Head of Data Science & Machine Learning at ASOS, highlighted the platform’s efficiency:

__XLATE_27__

"بدون التدفق الفوري لـ Azure AI، كنا سنضطر إلى الاستثمار في هندسة مخصصة كبيرة جدًا لتقديم حل. وبدلاً من ذلك، تمكنا من تحقيق سرعة كبيرة من خلال دمج خدماتنا الصغيرة الحالية بسهولة في حل التدفق السريع."

يدعم Azure ML أيضًا التدريب الموزع الذي يحافظ على الخصوصية، كما أوضح يوهان بريسينك في Swift، الذي استخدم النظام الأساسي لتدريب النماذج على أجهزة الحافة المحلية بدلاً من مركزية البيانات، مما يضمن قابلية التوسع وخصوصية البيانات. يعمل عقد واجهة برمجة التطبيقات (API) الموحد الخاص به، جنبًا إلى جنب مع عمليات التكامل مع تطبيقات Azure Logic ووظائف Azure، على تعزيز الاتصال بالأدوات الخارجية.

يعطي Azure Machine Learning الأولوية للأمان باستخدام ميزات مثل Microsoft Entra ID للتحكم في الوصول المستند إلى الدور (RBAC) والشبكات الافتراضية لعزل الموارد والحد من الوصول إلى واجهة برمجة التطبيقات. تتم حماية البيانات باستخدام تشفير TLS 1.2/1.3 أثناء النقل والتشفير المزدوج أثناء عدم النشاط، مع خيارات للمفاتيح التي يديرها العميل لمزيد من التحكم. تعمل الدفاعات في الوقت الفعلي، مثل Prompt Shields، على منع عمليات كسر الحماية وهجمات الحقن الفوري، بينما يتطلب Customer Lockbox موافقة إدارية لشركة Microsoft للوصول إلى بيانات العميل. تعمل الأدوات الإضافية على تتبع إصدارات الأصول وتسلسل البيانات والحصص، ويوفر Microsoft Defender for Cloud الحماية من التهديدات في وقت التشغيل.

يعمل Azure Machine Learning على نموذج تسعير الدفع أولاً بأول، حيث يتم فرض رسوم فقط على موارد الحوسبة مثل وحدات المعالجة المركزية (CPU) ووحدات معالجة الرسومات المتخصصة. تتم أيضًا محاسبة خدمات الدعم مثل Blob Storage وKey Vault وContainer Registry وApplication Insights بناءً على الاستخدام. يمكن للفرق اختيار أجهزة مصممة خصيصًا لمهام محددة، بينما تعمل ميزات مثل التخزين المؤقت لخطوط الأنابيب على تقليل العمليات الحسابية الزائدة عن الحاجة. تضمن البنية التحتية كتعليمات برمجية النشر المتسق والإدارة الفعالة للموارد.

تعمل Google Vertex AI Pipelines على التخلص من متاعب إدارة البنية التحتية من خلال أتمتة سير عمل التعلم الآلي (ML). فهو ينظم المهام في رسم بياني غير دوري موجه (DAG) للمكونات الموجودة في حاويات، مما يمكّن الفرق من التركيز على تطوير النموذج بدلاً من إدارة الخادم.

تستخدم Vertex AI Pipelines أسلوبًا بدون خادم للتعامل مع أعباء العمل، وتفويض مهام المعالجة المكثفة إلى أدوات مثل BigQuery، وDataflow، وCloud Serverless لـ Apache Spark. بالنسبة لحسابات Python وML الموزعة، فإنه يتكامل بسلاسة مع Ray on Vertex AI.

تدعم المنصة العقد من سلسلة A3 وA3 Mega المجهزة بوحدات معالجة الرسوميات NVIDIA H100/H200. توفر عقد A3 Mega، التي تتميز بـ 8 وحدات معالجة رسوميات H100، عرض نطاق ترددي مذهل يبلغ 1600 جيجابت في الثانية عبر العقد. على سبيل المثال، قامت شركة Vectra بتحليل 300000 مكالمة شهرية للعملاء باستخدام Gemini وVertex AI، مما أدى إلى زيادة بنسبة 500% في سرعة التحليل.

تم دمج كفاءة التكلفة مع التخزين المؤقت للتنفيذ، والذي يعيد استخدام المخرجات لتقليل النفقات. تضمن البيانات الوصفية لـ Vertex ML إمكانية التكرار من خلال تتبع نسب القطع الأثرية والمعلمات والمقاييس على نطاق واسع. يتكامل هذا التصميم القابل للتطوير بسهولة مع مجموعة متنوعة من الأدوات، مما يجعله حلاً متعدد الاستخدامات لسير عمل التعلم الآلي.

تعمل حزمة SDK لمكونات Google Cloud Pipeline (GCPC) على تبسيط عملية التكامل من خلال تقديم مكونات تم إنشاؤها مسبقًا والتي تربط خدمات Vertex AI، مثل AutoML، ومهام التدريب المخصصة، ونشر النماذج، مباشرةً في المسارات.

تتميز إدارة المسارات بالمرونة، مع خيارات مثل Cloud Composer (Apache Airflow المُدار) ومشغلات Cloud Data Fusion لتنظيم سير العمل عبر الخدمات. تعمل الاتصالات الأصلية بـ BigQuery وCloud Storage وDataproc على تبسيط عملية معالجة البيانات، بينما يمكن مزامنة البيانات التعريفية مع Dataplex Universal Catalog لتتبع النسب عبر المشروعات. بالإضافة إلى ذلك، توفر Model Garden إمكانية الوصول إلى أكثر من 200 نموذج، بما في ذلك Gemini من Google، وAnthropic's Claude، وMeta's Llama.

يتم تجميع تعريفات خطوط الأنابيب في تنسيق YAML موحد، مما يضمن إمكانية النقل عبر المستودعات مثل Artifact Registry.

تم تصميم Vertex AI Pipelines مع وضع الحوكمة والأمن في الاعتبار. تضمن حسابات الخدمة أن كل مكون يعمل بالأذونات اللازمة فقط. تعمل عناصر التحكم في خدمة VPC على إنشاء محيط آمن، مما يمنع البيانات الحساسة - مثل مجموعات بيانات التدريب والنماذج ونتائج التنبؤ المجمعة - من مغادرة حدود الشبكة.

بالنسبة للمؤسسات التي لديها احتياجات امتثال صارمة، يدعم النظام الأساسي مفاتيح التشفير التي يديرها العميل (CMEK) بالإضافة إلى التشفير الافتراضي في Google Cloud أثناء عدم النشاط. توفر Vertex ML Metadata مسارًا تفصيليًا للتدقيق من خلال تسجيل المعلمات والعناصر والمقاييس تلقائيًا من كل مسار تشغيل.

تعمل ميزات الأمان مثل Model Armor على الحماية من الحقن الفوري وتسرب البيانات. يمكن تكوين خطوط الأنابيب للتشغيل ضمن شبكات VPC النظيرة، ويسمح التسجيل السحابي للفرق بمراقبة أحداث خطوط الأنابيب بحثًا عن أي حالات شاذة أمنية.

تعمل Vertex AI Pipelines على نموذج الدفع أولاً بأول، مع تطبيق تسميات الفوترة تلقائيًا لتتبع التكلفة من خلال عمليات تصدير Cloud Billing إلى BigQuery. يؤدي التخزين المؤقت للتنفيذ إلى تقليل التكاليف عن طريق إعادة استخدام المخرجات.

لخفض نفقات وظائف التدريب التي تتحمل الاضطرابات، تتوفر أجهزة Spot VM بأسعار مخفضة. بالنسبة لالتزامات البنية التحتية طويلة الأجل، توفر خصومات الاستخدام الملتزم (CUDs) وفورات في التكاليف وقدرة مضمونة. يوفر برنامج جدولة عبء العمل الديناميكي (DWS) القدرة على التعامل مع أعباء العمل المرنة بأسعار قائمة أقل، بينما تضمن مجموعات التدريب المخصصة قدرة التسريع المحجوزة للوظائف واسعة النطاق.

يعمل IBM watsonx Orchesstrate كمركز مركزي، حيث يقوم بتنسيق وكلاء الذكاء الاصطناعي من خلال العمل كمشرف وجهاز توجيه ومخطط للأدوات المتخصصة ونماذج الأساس. تدعم المنصة أساليب التنسيق المختلفة: الرد على المهام الاستكشافية، وPlan-Act لسير العمل المنظم، والتنسيق الحتمي للعمليات التجارية التي يمكن التنبؤ بها.

يستخدم Watsonx Orchesstrate، المصمم للعمليات واسعة النطاق، تنسيقًا متعدد الوكلاء لتوجيه الطلبات بكفاءة إلى الأدوات المناسبة ونماذج اللغات الكبيرة (LLMs) في الوقت الفعلي. يمكن للمؤسسات اختيار نشر Watsonx Orchesstrate كخدمة مدارة على IBM Cloud أو AWS، أو تثبيته محليًا للتوافق مع البنية التحتية الحالية الخاصة بهم.

لقد حققت المنصة بالفعل نتائج قابلة للقياس. على سبيل المثال، قامت شركة IBM بحل 94% من 10 ملايين طلب سنوي للموارد البشرية على الفور من خلال Watsonx Orchesstrate، مما يسمح لفرق الموارد البشرية بالتركيز على المهام ذات القيمة الأعلى. وبالمثل، دان & أمبير؛ خفضت شركة Bradstreet وقت الشراء بنسبة تصل إلى 20% من خلال تقييمات مخاطر الموردين المستندة إلى الذكاء الاصطناعي، مما يوفر للعملاء ما يزيد عن 10% من وقت التقييم.

لدعم النشر السريع، يتضمن النظام الأساسي Agent Builder بدون تعليمات برمجية ومجموعة تطوير الوكيل (ADK) لإنشاء أدوات مخصصة تعتمد على Python. بالإضافة إلى ذلك، يوفر الكتالوج الذي يضم أكثر من 100 وكيل ذكاء اصطناعي خاص بالمجال وأكثر من 400 أداة تم إنشاؤها مسبقًا مكونات قابلة للتطوير لتلبية الاحتياجات التشغيلية المتنوعة.

وتضمن قابلية التوسع هذه التكامل السلس مع الأنظمة الحالية، مما يجعلها قابلة للتكيف مع مجموعة واسعة من بيئات المؤسسات.

تسهل بوابة الذكاء الاصطناعي الخاصة بالمنصة التوجيه السلس بين نماذج الأساس المختلفة، بما في ذلك IBM Granite وOpenAI وAnthropic وGoogle Gemini وMistral وLlama، مما يساعد المؤسسات على تجنب تقييد البائعين. تدعم Agent Development Kit إنشاء أدوات مخصصة باستخدام مواصفات OpenAPI لخدمات الويب عن بعد وPython للوظائف الموسعة.

يضيف التكامل مع Langflow واجهة سحب وإفلات مرئية لتصميم تطبيقات الذكاء الاصطناعي، والتي يمكن بعد ذلك استيرادها إلى بيئة Orchesstrate. علاوة على ذلك، يتصل Watsonx Orchesstrate بسهولة مع أنظمة المؤسسات مثل Salesforce وSAP وWorkday وMicrosoft 365، مما يلغي الحاجة إلى تغييرات واسعة النطاق في البنية التحتية.

باستخدام AgentOps، تراقب المنصة أنشطة وكيل الذكاء الاصطناعي وتفرض سياسات في الوقت الفعلي لضمان الموثوقية والامتثال. تساعد حواجز الحماية المدمجة والإشراف المركزي في الحفاظ على الالتزام باللوائح الداخلية.

__XLATE_52__

"باستخدام AgentOps، تتم مراقبة كل إجراء وإدارته، مما يسمح بوضع علامة على الحالات الشاذة وتصحيحها في الوقت الفعلي." - غرفة أخبار آي بي إم

يعمل تكامل IBM Guardium على تحسين الأمان من خلال تحديد عمليات نشر الذكاء الاصطناعي غير المصرح بها وكشف نقاط الضعف أو التكوينات الخاطئة. تطبق المنصة أيضًا التحكم في الوصول المستند إلى الأدوار (RBAC)، والذي يتضمن أربعة أدوار رئيسية - المسؤول، والمنشئ، والمستخدم، وخبير المنتج - لحماية إعدادات البيئة. أبلغت الشركات التي تستخدم watsonx.governance عن زيادة بنسبة 30% في عائد الاستثمار من مبادرات الذكاء الاصطناعي الخاصة بها.

توفر المنصة أسعارًا مرنة لتلبية الاحتياجات التنظيمية المختلفة:

For those looking to explore the platform, there’s a 30-day free trial, and annual subscriptions for the Essentials Plan come with a 10% discount if purchased by 31 يناير 2026.

يجمع مركز UiPath AI بين وكلاء الذكاء الاصطناعي وروبوتات RPA والعاملين البشريين ضمن سير عمل المؤسسة، مما يؤدي إلى إنشاء نظام بيئي قابل للتطوير مصمم لتلبية متطلبات عام 2025. في جوهره، تستفيد المنصة من UiPath Maestro كمركز تحكم ذكي، وإدارة العمليات طويلة الأمد عبر العمليات التجارية المعقدة.

يقدم UiPath AI Center خيارين للنشر ليناسب احتياجات الأعمال المتنوعة: Automation Cloud، الذي يوفر تحجيمًا مرنًا فوريًا، وAutomation Suite، المصمم خصيصًا للنشر محليًا. يتميز نظام MLOps الخاص به بواجهة سحب وإفلات سهلة الاستخدام لنشر النماذج ومراقبتها، مما يسمح لها بالتوسع بسلاسة عبر عدد غير محدود من الروبوتات. على سبيل المثال، أعلنت شركة SunExpress Airlines عن توفير أكثر من 200 ألف دولار مع تقليل الأعمال المتراكمة لمدة شهرين. تضمن المنصة أيضًا بقاء النماذج دقيقة من خلال إعادة التدريب المستمر للإنسان، مما يجعلها أداة قوية لدمج الذكاء الاصطناعي عبر الأنظمة المتنوعة.

تتبنى المنصة استراتيجية "إحضار النموذج الخاص بك" (BYOM)، مما يتيح التكامل مع أطر عمل الطرف الثالث مثل LangChain وAnthropic وMicrosoft. بالإضافة إلى ذلك، يسهل بروتوكول Agent2Agent (A2A)، الذي تم تطويره بالتعاون مع Google Cloud، الاتصال السلس بين وكلاء الذكاء الاصطناعي عبر منصات المؤسسة.

__XLATE_59__

شارك هاريسون تشيس، الرئيس التنفيذي لشركة LangChain: "يضمن تعاوننا مع UiPath على بروتوكول الوكيل أن يتمكن وكلاء LangGraph من المشاركة بسلاسة في عمليات أتمتة UiPath، وتوسيع نطاق وصولهم وتمكين المطورين من بناء سير عمل أكثر تماسكًا وعبر الأنظمة الأساسية."

يتصل UiPath AI Center بمئات تطبيقات SaaS من خلال واجهات برمجة التطبيقات القياسية، ويدعم BPMN 2.0 لنمذجة العمليات، ويستخدم نموذج القرار والترميز (DMN) لإدارة قواعد العمل. ومن الأمثلة البارزة على ذلك بنك التراث، وهو أكبر بنك مشترك في أستراليا، والذي استخدم مركز الذكاء الاصطناعي لأتمتة عملية مراجعة القروض، وتحسين تجارب العملاء مع تقليل المهام الخلفية اليدوية.

يعطي مركز UiPath AI الأولوية للحوكمة والأمن، ويقدم عناصر تحكم في الوصول على مستوى المشروع والمستأجر للحفاظ على إمكانية التتبع والامتثال. تضمن ميزات الوكالة الخاضعة للرقابة أن عملاء الذكاء الاصطناعي لا يمكنهم تنفيذ إجراءات غير مصرح بها أو غير آمنة بشكل مستقل.

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

Brian Lucas, Sr. Manager of Automation at Abercrombie & Fitch, noted: "UiPath Maestro is the orchestration layer that connects everything - robots, AI agents, and systems inside and outside UiPath – ensuring seamless coordination across several complex automated processes."

The platform’s MLOps command center provides complete visibility into data usage, model versions, performance metrics, and user actions, ensuring clear audit trails. For businesses requiring maximum control, the self-hosted Automation Suite offers full oversight of infrastructure and data management.

يستخدم مركز UiPath AI نموذج ترخيص قائم على الاستهلاك باستخدام وحدات الذكاء الاصطناعي، التي تقيس الأنشطة مثل تدريب النماذج والاستضافة والتنبؤات. يتم دمجها بسلاسة في نظام ترخيص UiPath الأوسع عبر وحدات النظام الأساسي، مما يغطي احتياجات التنسيق والتنفيذ. لمساعدة المؤسسات على استكشاف قدراتها، تتوفر نسخة تجريبية مجانية مدتها 60 يومًا لكل من إصدارات Automation Cloud وAutomation Suite، مما يسهل تقييم قيمتها مع الحفاظ على التكاليف تحت السيطرة.

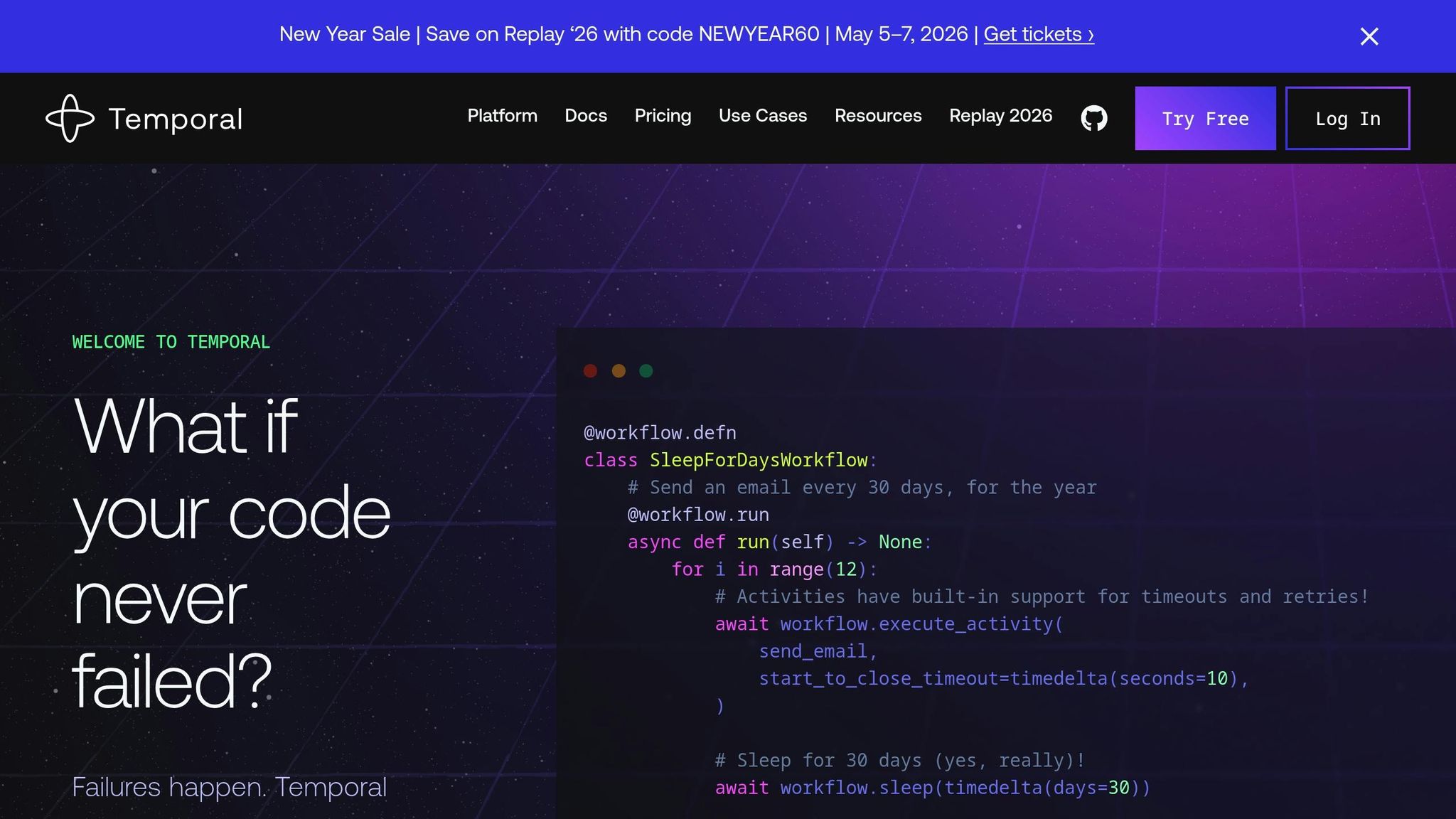

يتخذ Temporal أسلوبًا فريدًا من خلال استخدام تعليمات برمجية متينة وقابلة للاستئناف بدلاً من الاعتماد على ملفات التكوين. فهو يلتقط كل خطوة من خطوات سير العمل في سجل أحداث غير قابل للتغيير، مما يضمن إمكانية استئناف العمليات تمامًا من حيث توقفت بعد انقطاع. ومن الأمثلة الرائعة على ذلك شركة Replit، التي نقلت مستوى التحكم في وكيل التشفير الخاص بها إلى Temporal، مما أدى إلى تحسين الموثوقية وتجربة المستخدم بشكل كبير.

Temporal's architecture separates the orchestration engine from worker processes, allowing each to scale independently. Temporal Cloud can handle over 200 million executions per second, and workflows in waiting states incur no compute charges. Its ability to recover mid-process eliminates redundant API costs, enabling engineering teams to focus on business logic and roll out features 2–10 times faster.

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

ليزي سيجريست، مديرة المنتج، Retool

"We were able to get Retool Agents out in a matter of months and support a really robust experience out the gate with a really small team…It just wouldn't have been possible without Temporal."

تضمن قابلية التوسع هذه التكامل السلس مع الأدوات والأنظمة المختلفة.

يمكن للمطورين كتابة سير العمل كتعليمة برمجية باللغات الشائعة مثل Python وGo وJava وTypeScript و.NET وPHP. يتكامل Temporal أيضًا بسهولة مع أطر عمل الذكاء الاصطناعي الرائدة، بما في ذلك OpenAI Agents SDK وPydantic AI وLangGraph وCrew AI. يعزز دعمه لبروتوكول السياق النموذجي (MCP) موثوقية الوكيل. تم تحسين إمكانية المراقبة من خلال الاتصالات بأدوات المراقبة الخاصة بالذكاء الاصطناعي مثل Langfuse. على سبيل المثال، يستخدم Gorgias هذه المرونة لمساعدة أكثر من 15000 علامة تجارية للتجارة الإلكترونية في إدارة وكلاء خدمة العملاء المعتمدين على الذكاء الاصطناعي.

يوفر سجل الأحداث الخاص بـ Temporal مسار تدقيق كامل وغير قابل للتغيير لكل تغيير في الحالة في سير عمل الذكاء الاصطناعي. تدعم هذه الميزة الحوكمة البشرية، مما يتيح لسير العمل التوقف مؤقتًا للتحقق الخارجي قبل تنفيذ القرارات المستقلة. تعتبر هذه الحماية مفيدة بشكل خاص في بيئات الإنتاج لمنع حدوث مشكلات مثل هلوسة LLM. في عمليات نشر السحابة المؤقتة، لا يمكن للموفر الوصول إلى رمز التطبيق، بينما يتيح خيار الخادم مفتوح المصدر المرخص من MIT للمؤسسات استضافة النظام الأساسي داخل البنية التحتية الآمنة الخاصة بها. وقد سلط مهندسو Netflix الضوء على كيف يقلل هذا التصميم من الصيانة ويبسط معالجة الأعطال.

تعمل Temporal Cloud على نموذج الدفع أولاً بأول، في حين أن الخادم المؤقت مفتوح المصدر مجاني للاستضافة الذاتية. يمكن للمستخدمين الجدد استكشاف النظام الأساسي برصيد مجاني بقيمة 1000 دولار أمريكي للسحابة المؤقتة. من خلال تعليق سير العمل دون استهلاك موارد الحوسبة، يمكن للمستخدمين تقليل تكاليف البنية التحتية والتشغيل بشكل كبير. لا يعمل تصميم Temporal على تحسين الكفاءة والموثوقية فحسب، بل يبقي النفقات تحت السيطرة مع نمو عمليات الذكاء الاصطناعي.

يتطلب اختيار منصة تنسيق الذكاء الاصطناعي المثالية تحقيق التوازن بين المرونة وسهولة الاستخدام. توفر الخيارات مفتوحة المصدر مثل Apache Airflow وLangChain استقلالية البائع وتخصيصًا عميقًا ولكنها تتطلب مهارات فنية متقدمة وتكوينات يدوية للأمان والحوكمة. من ناحية أخرى، تتضمن منصات المؤسسات مثل IBM watsonx Orchesstrate وUiPath ميزات مدمجة مثل التحكم في الوصول المستند إلى الدور (RBAC)، ومسارات التدقيق، والامتثال لقانون HIPAA، على الرغم من أنها تأتي مع رسوم ترخيص ومرونة أقل.

تختلف استراتيجيات قابلية التوسع بشكل كبير عبر الأنظمة الأساسية. تتفوق أدوات Kubernetes الأصلية مثل Kubeflow وArgo Workflows في قابلية النقل بالحاويات، في حين أن الجدولة القائمة على الرسم البياني غير الدوري الموجه (DAG) من Apache Airflow فعالة لإدارة التبعيات المعقدة في الإعدادات الهجينة والمتعددة السحابية. تشتهر Temporal بإنتاجيتها العالية، في حين تستفيد Azure Machine Learning وGoogle Vertex AI Pipelines من أنظمتها البيئية السحابية الأصلية لتخصيص الموارد ديناميكيًا أثناء ذروة الطلب. تسلط هذه الاختلافات الضوء على المقايضات التي يجب على المؤسسات مراعاتها عند تقييم الحلول.

تعد إمكانية التشغيل البيني عاملاً حاسماً آخر لضمان سير العمل الموحد. يمكّن LangChain المطورين من ربط العديد من نماذج اللغات الكبيرة (LLMs) وواجهات برمجة التطبيقات (APIs) دون إصلاح الأنظمة الحالية، ويدعم Kubeflow أطر عمل مثل PyTorch وTensorFlow وJAX ضمن مسار واحد. تهدف الأنظمة الأساسية مثل Prompts.ai إلى تقليل التجزئة من خلال توحيد نماذج متعددة، في حين توفر الأنظمة الأساسية الخاصة بالموردين مثل Azure Machine Learning وIBM watsonx Orchesstrate عمليات تكامل أصلية سلسة ولكنها قد تتطلب موصلات إضافية لتحقيق توافق أوسع.

تلعب المقايضات التشغيلية أيضًا دورًا رئيسيًا في قرارات النشر وعائد الاستثمار (ROI). تعد الحوكمة وإدارة التكاليف من المجالات التي تختلف فيها المنصات بشكل كبير. توفر الحلول على مستوى المؤسسات مثل IBM watsonx Orchesstrate وUiPath لوحات معلومات مركزية وميزات أمان قوية، مما يجعلها مناسبة للصناعات الخاضعة للتنظيم مثل الرعاية الصحية والتمويل. في المقابل، غالبًا ما تتطلب الأدوات مفتوحة المصدر إعدادًا يدويًا لتحقيق مراقبة مماثلة. من منظور التكلفة، في حين أن Apache Airflow وLangChain وKubeflow متاحة للنشر مجانًا، فإنها يمكن أن تتحمل نفقات مخفية تتعلق بالوقت الهندسي والخبرة. تقدم Temporal Cloud تسعير الدفع أولاً بأول مع أرصدة مجانية بقيمة 1000 دولار أمريكي، بينما تعمل Prompts.ai على تقليل تكاليف برامج الذكاء الاصطناعي بشكل كبير - بما يصل إلى 98% - من خلال نظام ائتمان TOKN الموحد الذي يلغي الرسوم المتكررة.

يقدم الجدول أدناه مقارنة تفصيلية لكل منصة عبر الأبعاد التشغيلية الرئيسية:

يعتمد اختيار أفضل منصة لتنسيق الذكاء الاصطناعي على القدرات التقنية لمؤسستك واحتياجات الامتثال وخطط النمو. توفر الخيارات مفتوحة المصدر مثل Apache Airflow وLangChain مرونة لا مثيل لها بدون رسوم ترخيص، مما يجعلها خيارًا مفضلاً للفرق التي يقودها المطورون في الشركات الناشئة في مجال التكنولوجيا والشركات سريعة النمو التي تقدر الإعدادات المعيارية. ومع ذلك، تتطلب هذه الأطر مهارات هندسية متقدمة لتكوين الميزات المهمة مثل الأمان والحوكمة وقابلية التوسع. من ناحية أخرى، تلبي منصات المؤسسات مثل IBM watsonx Orchesstrate صناعات مثل الرعاية الصحية والتمويل، حيث تكون تدابير الامتثال المضمنة - مثل ضوابط الوصول القائمة على الأدوار، ومسارات التدقيق، والشهادات مثل HIPAA وSOC 2 - غير قابلة للتفاوض. غالبًا ما تحقق هذه المنصات عوائد ملموسة من خلال تبسيط سير العمل وربط ميزات الحوكمة بنتائج الأعمال المحسنة.

بالنسبة للمؤسسات الكبيرة، تعد المنصات ذات الحوكمة الثقيلة أمرًا ضروريًا، لكن الشركات متوسطة الحجم غالبًا ما تحتاج إلى حلول توازن بين التكلفة والأداء. تعمل Prompts.ai على تبسيط هذه المعادلة من خلال دمج أكثر من 35 نموذجًا في واجهة واحدة، مما يوفر عناصر تحكم FinOps في الوقت الفعلي وأرصدة TOKN للدفع حسب الاستخدام لتقليل تجزئة الأداة والنفقات غير المتوقعة. وفي الوقت نفسه، تتألق أدوات Kubernetes الأصلية مثل Kubeflow Pipelines وArgo Workflows عندما تكون قابلية النقل وعمليات النشر السحابية المختلطة أمرًا أساسيًا، خاصة بالنسبة لفرق علوم البيانات التي تدير خطوط أنابيب التعلم الآلي المعقدة عبر الأنظمة الموزعة.

وكما ناقشنا سابقًا، فإن ظهور الذكاء الاصطناعي الوكيل - حيث يتعاون الوكلاء المستقلون في التفكير متعدد الخطوات - يسلط الضوء على الأهمية المتزايدة للتنسيق السلس. على حد تعبير دومو:

__XLATE_78__

"لم يعد النجاح في الذكاء الاصطناعي يتعلق بامتلاك معظم النماذج، بل يتعلق بتنسيقها بفعالية".

بالنسبة للمؤسسات الأمريكية، من المهم اختيار الأنظمة الأساسية التي تتوافق مع نضجها الفني الحالي مع توفير مساحة للتوسع حيث يصبح الذكاء الاصطناعي أكثر تكاملاً عبر الأقسام. نقطة البداية الذكية هي مشروع تجريبي يركز على سير عمل محدد، وتتبع المدخلات والمخرجات والأخطاء لإنشاء خط أساس قابل للملاحظة للقياس المستقبلي. تقوم منصة التنسيق الصحيحة بما هو أكثر من مجرد توصيل أدوات الذكاء الاصطناعي - فهي تعيد تعريف كيفية تعاون الفرق وحل المشكلات وإنشاء القيمة على نطاق أوسع.

تعمل منصات تنسيق الذكاء الاصطناعي على تبسيط سير العمل المعقد من خلال الجمع بين نماذج الذكاء الاصطناعي المختلفة ومصادر البيانات والعمليات في نظام آلي واحد. إنهم يديرون المهام مثل الجدولة، وتوزيع الموارد، وتكامل واجهة برمجة التطبيقات (API)، مما يقلل من الجهد اليدوي مع تقليل وقت التطوير والنفقات التشغيلية بشكل كبير.

تم تصميم هذه المنصات للتوسع بسهولة، مما يمكّن الشركات من التوسع من التعامل مع عدد قليل من المهام إلى إدارة الآلاف دون إصلاح البنية التحتية الخاصة بها. إنهم يتفوقون في معالجة كميات كبيرة من البيانات، مما يجعل استخدام الموارد أكثر كفاءة، ويحافظون على مراقبة متسقة. ويؤدي ذلك إلى عمليات نشر أسرع وإنتاجية معززة وحلول الذكاء الاصطناعي المجهزة بشكل أفضل لتلبية الاحتياجات الديناميكية للمؤسسات.

غالبًا ما تتعامل منصات تنسيق الذكاء الاصطناعي مع النفقات من خلال نماذج التسعير القائمة على الاستخدام، مما يسمح للشركات بالدفع فقط مقابل ما تستخدمه بدلاً من الالتزام بالتراخيص الثابتة. تأتي العديد من هذه المنصات مجهزة بأدوات مالية في الوقت الفعلي، بما في ذلك لوحات المعلومات لمراقبة الإنفاق حسب النموذج أو سير العمل، وأنظمة تنبيه الميزانية، ووضع علامات على عبء العمل لتحليل مفصل للتكلفة. تضمن هذه الأدوات أن تتمتع الشركات برؤية واضحة لنفقاتها المتعلقة بالذكاء الاصطناعي وتحافظ على سيطرتها على ميزانياتها.

What sets prompts.ai apart is its intuitive interface combined with built-in cost-tracking capabilities, which can slash AI expenses by up to 98%. Subscription plans, ranging from $99–$129 per user per month, offer real-time monitoring of token usage and model-specific pricing, empowering teams to manage costs proactively. Unlike other platforms that depend on cloud billing integrations or manual usage exports - often causing delays and requiring additional engineering effort - prompts.ai delivers immediate cost visibility, saving both time and resources.

تحدد Prompts.ai معيارًا لتنسيق الذكاء الاصطناعي الآمن في عام 2025، مما يوفر للشركات منصة موثوقة لتوسيع نطاق عمليات الذكاء الاصطناعي الخاصة بها دون عناء. تم تصميم لوحة المعلومات الموحدة الخاصة بها لتبسيط الإدارة، وتتميز بأدوات حوكمة مدمجة، وتتبع التكلفة في الوقت الفعلي، ومسارات تدقيق غير قابلة للتغيير. تضمن هذه الميزات بقاء الشركات متوافقة مع الحفاظ على الإشراف الكامل على سير عمل الذكاء الاصطناعي الخاص بها.

مجهزة بتدابير أمنية على مستوى المؤسسات مثل التحكم في الوصول على أساس الدور، والتشفير الشامل، ومراقبة الامتثال المستمر، تعمل Prompts.ai على حماية البيانات الحساسة في كل مرحلة من مراحل التشغيل. ومن خلال دمج أكثر من 35 ماجستيرًا رائدًا في إدارة الأعمال في إطار عمل واحد آمن، فإنه يقلل من المخاطر ويمكّن الشركات من توسيع قدراتها في مجال الذكاء الاصطناعي بثقة وكفاءة.