AI orchestration ensures smooth collaboration between multiple AI tools and workflows, saving time and cutting costs. This guide covers the 11 best frameworks for managing AI processes, from enterprise-grade tools to open-source options. Whether you're streamlining LLM workflows, automating data pipelines, or managing machine learning lifecycles, there’s a solution for every need. Key frameworks include:

Quick Tip: Choose based on your team’s expertise, workflow complexity, and integration needs. For LLM orchestration, Prompts.ai excels. For data pipelines, Apache Airflow is reliable. For machine learning, Kubeflow or Flyte are strong options.

تعمق أكثر للعثور على إطار العمل المناسب لفريقك وسير العمل.

تعمل Prompts.ai كمنصة مركزية قائمة على السحابة تربط مستخدمي المؤسسات بأكثر من 35 نموذجًا رائدًا للذكاء الاصطناعي، بما في ذلك GPT-5 وClaude وLLaMA وGemini وGrok-4 وFlux Pro وKling - ويمكن الوصول إليها جميعًا من خلال واجهة واحدة. لا يلزم تثبيت أي برنامج، مما يسهل على الفرق من أي حجم دمج الذكاء الاصطناعي في سير العمل الخاص بهم.

تعالج المنصة تحديًا كبيرًا في اعتماد الذكاء الاصطناعي: انتشار الأدوات. ومن خلال توفير بيئة موحدة، فإنه يدمج اختيار النموذج وسير العمل الفوري وتتبع الأداء في نظام واحد. يعمل هذا النهج على تحويل استخدام الذكاء الاصطناعي من تجارب متفرقة لمرة واحدة إلى عمليات متسقة وقابلة للتطوير يمكن للمؤسسات نشرها عبر الأقسام بسهولة.

تركز Prompts.ai على أتمتة سير عمل الذكاء الاصطناعي في المؤسسة، مما يساعد المؤسسات على خفض التكاليف غير الضرورية مع معالجة مخاوف الحوكمة. من شركات Fortune 500 إلى الوكالات الإبداعية ومختبرات الأبحاث، يمكن للمستخدمين إنشاء سير عمل متوافق وقابل للتدقيق دون المخاطرة بالتعرض للبيانات الحساسة لخدمات متعددة تابعة لجهات خارجية.

تم الاعتراف بالمنصة من قبل GenAI.Works كأفضل حل للذكاء الاصطناعي لحل مشكلات المؤسسات والأتمتة، مع تصنيف مستخدم مثير للإعجاب يبلغ 4.8 من 5. تعتمد الشركات على Prompts.ai في مهام مثل تبسيط إنشاء المحتوى، وأتمتة سير العمل الاستراتيجي، وتسريع تطوير المقترحات. وفي بعض الحالات، تم تقليص المشاريع التي كانت تستغرق أسابيع إلى يوم واحد فقط.

أحد الأمثلة البارزة يأتي من مايو 2025، عندما استخدم مدير الذكاء الاصطناعي المستقل يوهانس فوريلون المنصة لدمج الرسوم المتحركة من Google DeepMind Veo2 بسلاسة في فيديو ترويجي لشركة بريتلينغ والقوات الجوية الفرنسية. سلط هذا المشروع الضوء على كيفية تمكين Prompts.ai من التنسيق السلس لأدوات الذكاء الاصطناعي المتعددة.

تعمل Prompts.ai على تبسيط كيفية عمل الفرق مع الذكاء الاصطناعي من خلال دمج الوصول إلى أكثر من 35 نموذجًا للغة والصور من خلال واجهة واحدة. يؤدي هذا إلى التخلص من متاعب إدارة الاشتراكات المتعددة ومفاتيح واجهة برمجة التطبيقات وأنظمة الفوترة. يمكن للمستخدمين الجمع بين نماذج مختلفة لمهام محددة ضمن سير عمل واحد، مما يؤدي إلى إنشاء خطوط أنابيب تزامن سلسة.

تعمل المنصة على نظام ائتمان TOKN، الذي يوحد الاستخدام عبر جميع النماذج، مما يجعل تتبع التكاليف وتخصيص الموارد أمرًا مباشرًا. يمكن للفرق التبديل بين النماذج حسب الحاجة، بناءً على متطلبات الأداء. تتضمن خطط الأعمال مساحات عمل وعددًا غير محدود من المتعاونين، مما يسهل على المؤسسات توسيع نطاق اعتماد الذكاء الاصطناعي.

باستخدام نموذج تسعير الدفع أولاً بأول، تعمل Prompts.ai على مواءمة التكاليف مع الاستخدام الفعلي، بدءًا من 0 دولار شهريًا للاستكشاف الأولي. تقدم خطط الأعمال، التي تتراوح من 99 دولارًا إلى 129 دولارًا لكل عضو شهريًا، مستويات مختلفة من أرصدة TOKN (250.000 إلى 1.000.000) و10 جيجابايت من التخزين السحابي عبر جميع المستويات.

Prompts.ai is built for enterprise-level security and compliance, adhering to SOC 2 Type II, HIPAA, and GDPR standards. The platform began its SOC 2 Type II audit on 19 يونيو 2025, and uses continuous monitoring through Vanta. Users can access real-time updates on the platform’s security and compliance status via a dedicated Trust Center at trust.prompts.ai.

تتضمن خطط الأعمال (Core وPro وElite) أدوات لمراقبة الامتثال وإدارة الحوكمة، مما يوفر رؤية كاملة لتفاعلات الذكاء الاصطناعي والحفاظ على مسارات تدقيق مفصلة لتلبية المتطلبات التنظيمية. حتى الفرق الصغيرة والمهنيين الأفراد الذين يستخدمون خطط Personal Creator وFamily يستفيدون من ميزات الإدارة على مستوى المؤسسات.

يتم الاحتفاظ بالبيانات الحساسة ضمن بيئة مركزية خاضعة للرقابة، مما يقلل من المخاطر المرتبطة بنشر المعلومات عبر خدمات خارجية متعددة. لا تقلل هذه البنية الآمنة من نقاط الضعف المحتملة فحسب، بل تعمل أيضًا على تبسيط إدارة الامتثال للمؤسسات التي تعمل بموجب لوائح صارمة.

تم تصميم Prompts.ai باستخدام بنية سحابية أصلية، وهو يمكّن المؤسسات من التوسع بسهولة. يمكن للفرق إضافة أعضاء جدد وتوسيع مساحات العمل والوصول إلى نماذج إضافية في غضون دقائق، مما يضمن إمكانية نمو اعتماد الذكاء الاصطناعي بالسرعة المطلوبة.

The platform’s real-time cost controls link token usage directly to business outcomes, offering transparency into spending and helping organizations optimize their AI investments. Users can compare model outputs side-by-side, allowing for informed decisions about which models are best suited for specific tasks.

Prompts.ai also provides detailed usage analytics, offering insights into team performance and resource consumption. These analytics help organizations pinpoint areas for improvement and justify their AI investments with measurable productivity gains. Users have reported up to a 10× increase in productivity when leveraging the platform’s workflow automation tools, demonstrating its ability to drive meaningful results.

يقدم Kubiya AI حلاً لأتمتة سير العمل مدعومًا بواجهات المحادثة. في حين أن التفاصيل المحددة حول بنية النشر وطرق التنسيق الخاصة بها غير متاحة للجمهور، فإن تركيزها على واجهات المحادثة يسلط الضوء على زاوية فريدة في تبسيط أتمتة سير العمل.

يقدم IBM watsonx Orchesstrate الأتمتة التي تعتمد على الذكاء الاصطناعي إلى عمليات المؤسسة، مع التركيز على جعل الأتمتة متاحة لمحترفي الأعمال بدلا من المطورين فقط. ومن خلال تمكين المستخدمين من إصدار أوامر باللغة الطبيعية، تعمل المنصة على تبسيط المهام المعقدة للفرق غير الفنية في مجالات الموارد البشرية والتمويل والمبيعات ودعم العملاء والمشتريات. يلغي هذا النهج الحاجة إلى خبرة في البرمجة، ويمكّن فرق العمل من أتمتة العمليات بشكل مستقل.

تتألق المنصة في أتمتة المهام المتكررة التي غالبًا ما تستنزف وقت الموظف. باستخدام أوامر اللغة البسيطة، يمكن للمستخدمين بدء سير العمل لمهام مثل جدولة المقابلات، وتلخيص ملفات تعريف المرشحين، ومعالجة القروض، وإنشاء التقارير. يتعامل Watsonx Orchesstrate مع هذه الأنشطة عبر أنظمة خلفية متعددة مع الالتزام بمعايير الأمان على مستوى المؤسسات.

على سبيل المثال، قامت إحدى المؤسسات المالية الكبرى بتطبيق Watsonx Orchesstrate لتبسيط دعم العملاء ووظائف المكتب الخلفي. استخدم الموظفون مدخلات اللغة الطبيعية لأتمتة سير العمل لمعالجة القروض وطلبات الخدمة. تم دمج النظام الأساسي بسلاسة مع الأنظمة الخلفية، وحافظ على الامتثال من خلال الإدارة المضمنة، وقدم تحسينات ملحوظة: أوقات معالجة أسرع، وأخطاء يدوية أقل، وزيادة رضا العملاء. يسلط هذا المثال الضوء على قدرة النظام الأساسي على تحويل مهام المؤسسة الروتينية إلى عمليات آلية فعالة.

يقدم IBM watsonx Orchesstrate خيارات نشر سحابية مختلطة، مما يسمح بتشغيل مسارات العمل في السحابة، أو محليا، أو عبر كليهما. تعتبر هذه المرونة ذات قيمة خاصة للمؤسسات التي لديها سياسات صارمة لموضع البيانات أو البنية التحتية القديمة. تستفيد المنصة من نماذج اللغات الكبيرة (LLMs) وواجهات برمجة التطبيقات (APIs) وتطبيقات المؤسسات لتنفيذ المهام بشكل آمن، مما يضمن التوافق مع بيئات التشغيل المختلفة.

يتكامل Watsonx Orchesstrate بسلاسة مع الأنظمة المتنوعة، مما يجعله حلاً قويًا لأتمتة المؤسسات. وهو يتصل بأنظمة إدارة علاقات العملاء (CRM) وتخطيط موارد المؤسسات (ERP) والأنظمة الأساسية السحابية مثل AWS وAzure باستخدام الموصلات المرئية وواجهات برمجة التطبيقات (APIs). بالإضافة إلى ذلك، فهو يعمل بشكل وثيق مع خدمات IBM Watson ونماذج IBM AI الأخرى، مما يوسع قدراته إلى ما هو أبعد من أتمتة سير العمل الأساسي. بالنسبة للمستخدمين المتقدمين، يسمح الوصول الآلي لواجهة برمجة التطبيقات (API) بمزيد من التخصيص والتكامل مع الأدوات الموجودة.

__XLATE_18__

"تم تصميم IBM watsonx Orchesstrate لجلب الأتمتة التي تعمل بالذكاء الاصطناعي مباشرة إلى سير عمل الأعمال. وعلى عكس الأدوات التي تركز على المطورين، يستهدف Watsonx Orchesstrate المتخصصين في مجال الموارد البشرية والتمويل والمبيعات ودعم العملاء الذين يرغبون في تبسيط المهام دون الحاجة إلى برمجة ثقيلة." - دومو

تتضمن المنصة أيضًا تطبيقات الذكاء الاصطناعي المعدة مسبقًا ومجموعات المهارات الخاصة بالصناعة، مما يتيح تنفيذًا أسرع لحالات الاستخدام الشائعة. ومع ذلك، يجب على المؤسسات ملاحظة أن وظائفها قد تكون محدودة أكثر خارج نظام IBM البيئي مقارنة بالأنظمة الأساسية ذات خيارات التكامل الأوسع.

يتميز IBM Watsonx Orchesstrate بإطار عمل الإدارة القوي الخاص به، مما يجعله الاختيار المفضل للصناعات الخاضعة للتنظيم. تضمن عناصر التحكم في الوصول المستندة إلى الدور أن يقتصر الوصول إلى البيانات على المستخدمين المصرح لهم ووظائف محددة.

The platform’s hybrid deployment options address privacy concerns by enabling organizations to keep sensitive data on-premises while utilizing cloud resources for less critical operations. Its compliance features make it particularly suitable for industries like finance and healthcare, where security, transparency, and regulatory adherence are critical.

تم تصميم Watsonx Orchesstrate للتوسع عبر البيئات المختلطة، وهو يدعم كلا من الفرق الصغيرة والمؤسسات الكبيرة. فهو يعزز الكفاءة التشغيلية، ويضمن الامتثال للسياسات، ويخفف المخاطر، ويعزز إنتاجية الموظفين. يمكن للمؤسسات أن تبدأ صغيرة - مع التركيز على أقسام محددة - وتوسيع قدرات التشغيل الآلي تدريجيًا عندما ترى النتائج وتطور الخبرة الداخلية.

Apache Airflow عبارة عن منصة مفتوحة المصدر مصممة لتنسيق سير عمل البيانات المعقدة باستخدام الرسوم البيانية غير الدورية الموجهة (DAGs). تم تطويره في البداية بواسطة Airbnb والآن تحت إشراف مؤسسة Apache Software Foundation، وقد أصبح خيارًا شائعًا لجدولة خطوط أنابيب البيانات ومراقبتها وإدارتها. على عكس أدوات الأتمتة المصممة لمستخدمي الأعمال، تم تصميم Airflow مع وضع مهندسي البيانات والمطورين في الاعتبار، مما يوفر تحكمًا برمجيًا في تنفيذ سير العمل.

يتألق تدفق الهواء في إدارة خطوط أنابيب البيانات التي تتضمن تبعيات معقدة ومهام مجدولة ومنطق التحويل. تعتمد فرق البيانات عليها لمجموعة متنوعة من الأغراض، بما في ذلك تنسيق عمليات ETL (الاستخراج والتحويل والتحميل)، وتدريب نماذج التعلم الآلي، وتشغيل مهام معالجة الدفعات، واستيعاب البيانات من مصادر متعددة، وتحويل مجموعات البيانات، وإنشاء التقارير وفقًا لجدول زمني. من خلال تحديد مسارات العمل في Python، يكتسب المطورون مرونة واسعة النطاق لتنفيذ المنطق المخصص والتعامل مع الأخطاء بفعالية.

يتضمن النظام الأساسي واجهة مرئية توفر رؤى حول حالة سير العمل وتبعيات المهام وسجل التنفيذ. وهذا يجعل من السهل مراقبة الأداء واستكشاف الأخطاء وإصلاحها. على سبيل المثال، في حالة فشل إحدى المهام، يمكن لـ Airflow إعادة المحاولة تلقائيًا أو إرسال تنبيهات أو تخطي المهام اللاحقة لمنع حدوث مشكلات متتالية. تجعل هذه الوظيفة خيارًا متعدد الاستخدامات لاحتياجات النشر المتنوعة.

يمكن نشر تدفق الهواء كإعداد خادم واحد أو توسيع نطاقه إلى مجموعات موزعة، حيث يعمل المجدول والعمال وخادم الويب على أجهزة منفصلة. تتكون البنية من عدة مكونات رئيسية: برنامج جدولة يقوم بتشغيل المهام بناءً على جداول زمنية محددة، والعاملين الذين ينفذون المهام، وخادم الويب لواجهة المستخدم، وقاعدة بيانات التعريف التي تخزن تعريفات سير العمل وتاريخ التنفيذ.

يسمح هذا التصميم المعياري للمؤسسات بتوسيع نطاق قدرة العامل بشكل مستقل، اعتمادًا على متطلبات عبء العمل. في البيئات السحابية الأصلية، غالبًا ما يتم استخدام Kubernetes لنشر Airflow، حيث يقوم KubernetesExecutor بإنشاء حجرات معزولة للمهام الفردية. يعمل هذا الإعداد على تحسين عزل الموارد ويتيح للفرق تخصيص موارد حوسبة محددة لكل مهمة. بالنسبة لأولئك الذين يتطلعون إلى تقليل النفقات العامة لإدارة البنية التحتية، تتوفر خدمات Airflow المُدارة، على الرغم من أن هذه الخدمات تأتي مع تكاليف تشغيلية إضافية.

إن قدرات التكامل الواسعة التي يتمتع بها Airflow تجعله قابلاً للتكيف بدرجة كبيرة. وهو يوفر موصلات معدة مسبقًا لقواعد البيانات والأنظمة الأساسية السحابية ومستودعات البيانات وأنظمة المراسلة، بالإضافة إلى القدرة على إنشاء عوامل تشغيل مخصصة باستخدام Python. تضمن هذه المرونة قدرة Airflow على تلبية المتطلبات التنظيمية المتنوعة.

يمكن أيضًا الاستفادة من النظام البيئي الغني لمكتبة Python ضمن سير العمل، مما يتيح تحويلات البيانات المتقدمة وتحليلها مباشرةً في تعريفات خطوط الأنابيب. بالنسبة لتطبيقات الذكاء الاصطناعي والتعلم الآلي، يتكامل Airflow بسلاسة مع أطر عمل مثل TensorFlow وPyTorch وscikit-learn. تساعد عمليات التكامل هذه علماء البيانات على تنسيق سير العمل لمهام مثل جلب البيانات، وميزات المعالجة المسبقة، ونماذج التدريب، وتقييم الأداء، ونشر النماذج في الإنتاج.

يتضمن Airflow التحكم في الوصول المستند إلى الأدوار (RBAC) لإدارة أذونات المستخدم عبر سير العمل والوظائف الإدارية. يمكن للمسؤولين تحديد الأدوار بامتيازات معينة، مما يضمن أنه يمكن للمستخدمين المصرح لهم فقط عرض DAGs معينة أو تحريرها أو تنفيذها. يساعد عنصر التحكم الدقيق هذا في الحفاظ على تكامل سير العمل ويمنع التغييرات غير المصرح بها.

تتضمن خيارات المصادقة تسجيل الدخول المعتمد على كلمة المرور، وتكامل LDAP، وموفري OAuth. تتم إدارة بيانات الاعتماد الحساسة بشكل منفصل من خلال نظام اتصالات ومتغيرات Airflow. لتعزيز الأمان، يمكن دمج أدوات إدارة السرية الخارجية مثل HashiCorp Vault أو AWS Secrets Manager.

يعد تسجيل التدقيق ميزة رئيسية أخرى، حيث يتتبع إجراءات المستخدم وعمليات تنفيذ سير العمل. يؤدي هذا إلى إنشاء سجل مفصل للنشاط، وهو أمر لا يقدر بثمن لأغراض الامتثال واستكشاف الأخطاء وإصلاحها.

يتم قياس تدفق الهواء أفقيًا عن طريق إضافة المزيد من العقد العاملة للتعامل مع أعباء العمل المتزايدة. يدعم النظام الأساسي العديد من أنواع المنفذين لتوزيع المهام بشكل فعال: يقوم LocalExecutor بتشغيل المهام على نفس الجهاز مثل المجدول، ويقوم CeleryExecutor بتوزيع المهام عبر أجهزة عاملة متعددة باستخدام قائمة انتظار الرسائل، ويقوم KubernetesExecutor بتدوير القرون المعزولة لكل مهمة.

لتحسين الأداء، يعد تصميم DAG الدقيق وتخصيص الموارد أمرًا ضروريًا. يمكن أن تؤدي أحجام المهام الكبيرة إلى إجهاد المجدول، لذلك غالبًا ما تقوم الفرق بتقسيم DAGs الكبيرة، وضبط إعدادات المجدول، والتأكد من أن مخزن بيانات التعريف يحتوي على موارد كافية.

يتعامل Airflow أيضًا مع عمليات الردم بكفاءة، مما يسمح للفرق بإعادة معالجة البيانات التاريخية عندما يتغير منطق سير العمل. على الرغم من أن عملية إعادة التعبئة تعمل على تبسيط التحديثات، إلا أنها يمكن أن تستهلك موارد حسابية كبيرة، مما يتطلب تخطيطًا دقيقًا لتجنب انقطاع أعباء عمل الإنتاج.

نظرًا لكونه مفتوح المصدر، فإن Airflow يمنح المؤسسات التحكم الكامل في عمليات النشر الخاصة بها. ومع ذلك، يعني هذا أيضًا أنه يجب عليهم إدارة البنية التحتية والمراقبة والتحديثات، الأمر الذي يتطلب موارد هندسية مخصصة للحفاظ على الموثوقية والأداء على نطاق واسع.

تبرز Kubeflow كمنصة مخصصة لإدارة سير عمل التعلم الآلي، وهي متميزة عن أدوات سير العمل ذات الأغراض العامة. تم تصميم هذا الحل مفتوح المصدر خصيصًا لـ Kubernetes، وهو يدعم دورة حياة التعلم الآلي الكاملة، مما يمنح علماء البيانات ومهندسي تعلم الآلة الأدوات التي يحتاجون إليها لإنشاء نماذج جاهزة للإنتاج ونشرها وإدارتها باستخدام إمكانات Kubernetes الأصلية.

تم تصميم Kubeflow لتنظيم سير عمل التعلم الآلي الكامل داخل بيئات Kubernetes. ويغطي كل مرحلة من مراحل دورة حياة تعلم الآلة، بما في ذلك المعالجة المسبقة للبيانات، وهندسة الميزات، والتدريب على النماذج، والتحقق من الصحة، والنشر، والمراقبة. من خلال تمكين الفرق من إنشاء خطوط أنابيب معيارية وقابلة لإعادة الاستخدام، يعمل Kubeflow على تبسيط إدارة أعباء عمل تعلم الآلة الموزعة. ويساعد نهجها المركزي أيضًا في تتبع التجارب والإشراف النموذجي عبر المشاريع المختلفة. بالإضافة إلى ذلك، يمكن لـ Kubeflow أتمتة سير عمل إعادة التدريب عند تقديم بيانات جديدة، مما يضمن بقاء النماذج محدثة وذات صلة.

يعتمد Kubeflow على Kubernetes، ويستفيد من تنسيق الحاويات والقياس الديناميكي وإدارة الموارد لتحسين سير عمل تعلم الآلة. يمكن للمستخدمين التفاعل مع النظام الأساسي من خلال واجهة قائمة على الويب للإدارة المرئية أو واجهة سطر الأوامر للأتمتة. اعتمادًا على عبء العمل، يقوم Kubeflow بتخصيص الموارد ديناميكيًا - مثل توفير وحدات معالجة الرسومات لمهام التدريب ووحدات المعالجة المركزية للاستدلال. تسمح مرونتها بالنشر على أي مجموعة Kubernetes، سواء كانت محلية أو في السحابة أو في إعدادات مختلطة، مما يضمن القدرة على التكيف عبر البيئات.

يتكامل Kubeflow بسلاسة مع أطر التعلم الآلي الشائعة مثل TensorFlow وPyTorch وXGBoost، بينما يدعم أيضًا أطر العمل المخصصة من خلال تصميمه القابل للتوسيع. وبعيدًا عن أطر تعلم الآلة، فهو يتصل بالعديد من الخدمات السحابية وحلول التخزين، مما يمكّن خطوط الأنابيب من الوصول إلى تخزين الكائنات للبيانات، ومستودعات البيانات لاسترجاع الميزات، وأدوات المراقبة لتتبع الأداء. يعمل توافقه مع مكتبات Python على تبسيط عملية الانتقال من التجريب إلى الإنتاج.

يستخدم Kubeflow إمكانات التوسع المتأصلة في Kubernetes لتوزيع أعباء العمل عبر موارد المجموعة، مما يجعله مناسبًا تمامًا لمهام التدريب ومعالجة البيانات واسعة النطاق. وهذا يضمن الاستخدام الفعال للموارد ويدعم عمليات تعلم الآلة عالية الأداء. كما قال عكا على نحو مناسب:

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

"Kubeflow provides robust orchestration of entire ML lifecycles in Kubernetes environments to ensure portability, scalability, and efficient management of distributed ML models." – Akka

بفضل قدرته على تخصيص الموارد بشكل مستقل، يقوم Kubeflow بسد الفجوة بين التجريب والإنتاج، مما يوفر المرونة والأداء.

Flyte عبارة عن منصة تنسيق سحابية أصلية مصممة لتبسيط إدارة سير عمل التعلم الآلي (ML) باستخدام Kubernetes. إنه يزيل التعقيد الناتج عن نشر مسارات تعلم الآلة من خلال توزيع الموارد بكفاءة عبر البيئات السحابية. ويضمن هذا الأسلوب التوسع السلس والأداء المتسق، بغض النظر عن حجم النشر.

تم تصميم Flyte للتعامل مع سير عمل تعلم الآلة على أي نطاق، وتخصيص الموارد ديناميكيًا لتلبية المتطلبات المتنوعة. تضمن بنيته القوية إدارة أعباء العمل بكفاءة، مما يجعله خيارًا موثوقًا به لمجموعة واسعة من مهام تعلم الآلة عبر البنى التحتية المستندة إلى السحابة.

Prefect عبارة عن منصة تنسيق قائمة على لغة Python مصممة لتسهيل إدارة خطوط البيانات المعقدة وسير عمل التعلم الآلي. فهو يركز على سهولة الاستخدام والمراقبة الواضحة وتقليل العقبات التشغيلية، مما يسمح لعلماء البيانات والمهندسين بالتركيز على إنشاء سير العمل بدلاً من القلق بشأن البنية التحتية.

يتألق المحافظ في أتمتة مسارات التعلم الآلي، وسير العمل السحابي، وعمليات تحويل البيانات. وهو مناسب بشكل خاص للتعامل مع مهام ETL وسير عمل التعلم الآلي المعقد الذي يتضمن تبعيات متعددة وعمليات تنفيذ متوازية ومعالجة في الوقت الفعلي. يتيح نظام الجدولة المرن الخاص به إمكانية تشغيل المهام بناءً على فترات زمنية أو أحداث محددة أو استدعاءات واجهة برمجة التطبيقات (API)، مما يجعله قابلاً للتكيف مع مجموعة متنوعة من احتياجات الأتمتة.

تم تحسين Prefect للبيئات السحابية، مما يضمن قدرته على التوسع والتكيف مع متطلبات البنية التحتية الحديثة. تم تصميمه أصلاً بلغة Python، وهو يتكامل بسلاسة مع أنظمة البيانات المستندة إلى Python، مما يلغي الحاجة إلى تعلم لغات أو أدوات برمجة جديدة.

يوفر Prefect توافقًا سلسًا مع مجموعة واسعة من أدوات ومنصات البيانات. فهو يتكامل بسهولة مع الأدوات الشائعة مثل dbt وPostgreSQL وSnowflake وLooker، بينما يدعم أيضًا أنظمة الوقت الفعلي مثل Apache Kafka. بالنسبة للبيئات السحابية، فهي تعمل مع مقدمي الخدمات الرئيسيين مثل Amazon Web Services (AWS) وGoogle Cloud Platform (GCP) وMicrosoft Azure، مما يمنح الفرق المرونة لتحسين أعباء العمل بناءً على التكلفة والأداء. بالإضافة إلى ذلك، يدعم Prefect أدوات النقل بالحاويات مثل Docker وKubernetes ويعمل مع أطر المعالجة الموزعة مثل Dask وApache Spark. لإبقاء الفرق على اطلاع، فإنه يوفر أيضًا إشعارات Slack لتحديثات سير العمل.

تم تصميم Prefect للتعامل مع أحجام البيانات المتزايدة وزيادة تعقيد سير العمل بسهولة. يضمن محركها المتسامح مع الأخطاء إمكانية استرداد سير العمل من الأخطاء عن طريق إعادة محاولة المهام الفاشلة أو تجاوز المشكلات، مما يجعله موثوقًا للغاية في بيئات الإنتاج. توفر المراقبة في الوقت الفعلي رؤى تفصيلية حول تنفيذ سير العمل، مما يساعد الفرق على تحديد المشكلات وحلها بسرعة. بفضل قدرته على التوسع بكفاءة، تحظى شركة Prefect بثقة شركات التكنولوجيا الكبرى لإدارة سير العمل الديناميكي. بالنسبة للفرق التي بدأت للتو، يقدم Prefect خطة مجانية، في حين يتوفر التسعير المخصص لعمليات النشر الأكبر التي تتطلب ميزات ودعمًا إضافيًا.

Metaflow عبارة عن منصة للبنية التحتية للتعلم الآلي تم تطويرها في البداية بواسطة Netflix لمواجهة تحديات توسيع نطاق سير عمل التعلم الآلي. وهو يركز على جعل العمليات سهلة الاستخدام وفعالة، مما يساعد علماء البيانات على الانتقال بسلاسة من النماذج الأولية إلى الإنتاج دون التعامل مع البنية التحتية المعقدة.

تم تصميم Metaflow لإدارة سير عمل التعلم الآلي القابل للتطوير على مستوى الإنتاج. إنه يبسط الرحلة من تحليل البيانات الاستكشافية والتدريب النموذجي إلى النشر. يمكن لعلماء البيانات كتابة سير العمل بلغة بايثون باستخدام مكتبات مألوفة، بينما تعتني المنصة بإصدار الإصدارات وإدارة التبعية وتخصيص موارد الحوسبة تلقائيًا.

يلغي النظام الأساسي الحاجة إلى إدارة البنية التحتية اليدوية من خلال توفير موارد الحوسبة المطلوبة تلقائيًا. يتيح ذلك التحول السلس من التطوير المحلي إلى الإنتاج السحابي دون الحاجة إلى أي تعديلات على التعليمات البرمجية.

__XLATE_53__

"تنظم Metaflow مسارات عمل تعلم الآلة القابلة للتطوير بكل بساطة من خلال تقديم عمليات تكامل سحابية مبسطة وإصدارات قوية وتجريد البنية التحتية للنشر الجاهز للإنتاج." - Akka.io

وتكتمل عملية نشر Metaflow بقدرتها على التكامل بسهولة مع الخدمات السحابية ومنصات البيانات. يضمن تصميمه الأصلي بلغة Python التوافق مع المكتبات المستخدمة على نطاق واسع للتعلم الآلي ومعالجة البيانات والتصور، مما يسمح للفرق بتحقيق أقصى قدر من الأدوات التي يعتمدون عليها بالفعل.

تم إنشاء Metaflow في الأصل بواسطة Netflix لدعم عمليات التعلم الآلي الشاملة، ويتميز بنظام إصدار قوي. يتتبع هذا النظام التجارب ومجموعات البيانات وإصدارات النماذج، مما يضمن إمكانية تكرار التجارب وتمكين التراجع بسهولة عند الحاجة.

يضيف Dagster إلى مجموعة أطر التنسيق من خلال التركيز على الحفاظ على سلامة البيانات مع توفير إدارة خطوط أنابيب قابلة للتكيف. تم تصميم هذه الأداة مفتوحة المصدر لتحسين الجودة وتتبع سلسلة البيانات وضمان الرؤية ضمن سير عمل التعلم الآلي (ML). تتخصص Dagster في جوهرها في بناء خطوط أنابيب بيانات آمنة وموثوقة تدعم معايير عالية من سلامة البيانات وتوفر رؤى واضحة للتحولات.

يعتبر Dagster فعالاً بشكل خاص في إدارة سير عمل تعلم الآلة حيث تكون جودة البيانات ودقتها غير قابلة للتفاوض. لقد تم تصميمه خصيصًا للفرق التي تحتاج إلى التحقق المضمن، وتتبع البيانات التعريفية القوية، وإمكانية المراقبة الشاملة خلال عملياتها. ويمكن رؤية مثال عملي لفائدتها في قطاع الرعاية الصحية، حيث تعتمد المؤسسات على Dagster لمعالجة بيانات الرعاية الصحية الحساسة بمستوى النزاهة المطلوب لتلبية معايير الامتثال الصارمة والجودة.

يمكّن Dagster المطورين من تحديد مسارات العمل المعقدة مباشرة في التعليمات البرمجية، وهي ميزة أساسية لتوسيع نطاق عمليات الذكاء الاصطناعي. يدعم هيكلها المعياري نماذج التسلسل والوكلاء لإنشاء مسارات عمل متقدمة، مع استكمال إدارة التبعية الآلية وآليات إعادة المحاولة والتنفيذ المتوازي. بالإضافة إلى ذلك، يتكامل Dagster بسلاسة مع العديد من المنصات السحابية وواجهات برمجة التطبيقات وقواعد بيانات المتجهات، مما يجعله مناسبًا تمامًا للتعامل مع البيانات واسعة النطاق ومهام الذكاء الاصطناعي.

تضمن هذه البنية المرنة التكامل السلس مع الأنظمة المتنوعة.

Dagster’s true strength lies in its ability to manage and monitor the data that flows between interconnected systems. It meticulously tracks every data transformation, offering teams the precision they need. Many technical teams choose Dagster to build customized MLOps stacks or implement detailed control layers for large language model (LLM) applications. Its transparency and adaptability allow organizations to create proprietary AI systems and experiment on the cutting edge, all while maintaining control over data quality and pipeline performance.

Dagster’s governance framework emphasizes data lineage and quality assurance. Its built-in tools catch and address errors at every stage of a pipeline, minimizing the risk of bad data spreading through the system. By prioritizing data accuracy and traceability, Dagster helps teams ensure their data meets required standards before it reaches production, supporting compliance efforts with clear and reliable records.

Dagster’s modular design is ideal for managing complex AI workflows in large-scale settings. It automatically handles dependencies, retries, and parallel execution, simplifying the orchestration of advanced AI systems. This makes it a dependable choice for organizations that need custom orchestration logic to support sophisticated AI operations.

Microsoft AutoGen هو إطار عمل مفتوح المصدر تم تطويره بواسطة Microsoft Research والذي يمكّن العديد من وكلاء الذكاء الاصطناعي من التعاون من خلال المحادثة لمعالجة المهام المعقدة. يسمح هذا النظام للمطورين بإنشاء تطبيقات حيث يعمل الوكلاء المتخصصون معًا، ويساهم كل منهم بخبرته الفريدة لتحقيق الأهداف المشتركة. من خلال تقديم واجهة محادثة، يعمل AutoGen على تبسيط العملية المعقدة غالبًا لتنسيق مكونات الذكاء الاصطناعي المتعددة.

يقدم AutoGen نهجًا جديدًا للتنسيق بين الوكلاء المتعددين من خلال الاستفادة من الحوار كوسيلة للتعاون. يعد إطار العمل هذا فعالاً بشكل خاص في سيناريوهات حل المشكلات التي تتطلب وكلاء متعددين للعمل معًا ديناميكيًا. على سبيل المثال، في تطوير البرمجيات، قد يقوم أحد الوكيل بإنشاء تعليمات برمجية بينما يركز وكيل آخر على الاختبار والتحقق من الصحة، مع تكرار كلا الوكيلين لتحسين المخرجات. يعد نموذج المحادثة هذا مناسبًا بشكل طبيعي لمهام مثل أتمتة سير عمل البرامج، والمساعدة في البحث، والتعامل مع عمليات صنع القرار المعقدة حيث تعمل وجهات النظر أو المهارات المتنوعة على تحسين النتائج.

الفرق التي تهدف إلى التحسين المتكرر في سير العمل تجد أن AutoGen جذاب بشكل خاص. إن قدرتها على تسهيل التبادلات ذهابًا وإيابًا بين الوكلاء تعكس التعاون البشري، مما يسهل على المطورين تصميم أنظمة تتطور وتتحسن من خلال الحوار المستمر وردود الفعل.

يؤكد AutoGen على النمطية بينما يتميز بتصميم وكيل المحادثة الخاص به. يعمل كل وكيل بأدوار وتعليمات محددة، والتي يمكن أن تتضمن الوصول إلى الأدوات أو واجهات برمجة التطبيقات الخارجية أو نماذج اللغة. يدعم إطار العمل كلاً من الوكلاء المستقلين ووكلاء وكيل المستخدم الذين يدمجون المدخلات البشرية، مما يوفر المرونة في إدارة سير العمل.

يمكن تشغيل النظام محليًا أثناء التطوير والتوسع في البيئات السحابية للإنتاج. يمكن للمطورين تحديد كيفية تفاعل الوكلاء - سواء من خلال سير العمل المتسلسل حيث يتناوب الوكلاء أو الأنماط الأكثر تعقيدًا حيث يساهم العديد من الوكلاء في وقت واحد. باستخدام التكوينات المستندة إلى Python، تحصل الفرق على التحكم الكامل في منطق التنسيق دون التضحية بإمكانية القراءة، وتبسيط عملية إدارة التفاعلات متعددة الوكلاء.

يتعامل AutoGen مع تعقيدات إدارة مكالمات النماذج المتعددة ومحادثات الوكلاء، مما يسمح للمطورين بالتركيز على صياغة منطق وسلوك أنظمتهم بدلاً من القلق بشأن البنية التحتية.

يتكامل AutoGen بسلاسة مع Azure OpenAI Service والنماذج الأخرى عبر استدعاءات الوظائف، مما يمنح المطورين المرونة في اختيار الواجهات الخلفية للذكاء الاصطناعي. كما أنه يدعم ربط الوكلاء بالأدوات والخدمات الخارجية، مما يمكنهم من استرداد البيانات أو تنفيذ التعليمات البرمجية أو التفاعل مع واجهات برمجة التطبيقات التابعة لجهات خارجية أثناء محادثاتهم.

يسمح إطار العمل للمطورين بإنشاء أنواع وكلاء مخصصة وأنماط محادثة قابلة لإعادة الاستخدام وقوالب تنسيق. تعني هذه المرونة أن الفرق يمكنها الاستفادة من الأنماط الموجودة مسبقًا للمهام المشتركة مع التخصيص العميق للاحتياجات المتخصصة.

بالنسبة للمؤسسات التي تستخدم أدوات Microsoft بالفعل، يوفر AutoGen تكاملًا سهلاً مع خدمات Azure وVisual Studio Code ومنصات التطوير الأخرى. على الرغم من هذا التوافق مع نظام Microsoft البيئي، فإن إطار العمل لا يعتمد على النظام الأساسي ويعمل بشكل جيد في مجموعة متنوعة من بيئات التكنولوجيا.

يركز AutoGen بشدة على التحكم في قدرات الوكيل وإدارة الوصول إلى الموارد الخارجية. يحدد المطورون أذونات محددة لكل وكيل، مثل واجهات برمجة التطبيقات التي يمكنهم الوصول إليها أو البيانات المسموح لهم باستردادها. يضمن هذا النهج التفصيلي أن يعمل الوكلاء وفقًا لمبادئ الامتيازات الأقل، ويؤدون فقط المهام الضرورية لأدوارهم.

تعمل طبيعة المحادثة للإطار بطبيعتها على إنشاء مسارات التدقيق وتسجيل تفاعلات الوكيل وعمليات صنع القرار. توفر هذه السجلات الشفافية حول كيفية إنشاء المخرجات، مما يساعد في جهود الامتثال وتصحيح الأخطاء. يمكن للفرق مراجعة هذه السجلات لتحليل سلوك الوكيل وتحديد المجالات التي تحتاج إلى تحسين.

تعمل قدرات الإنسان في الحلقة على تعزيز الإشراف من خلال السماح لسير العمل بالتوقف مؤقتًا للمراجعة البشرية عند نقاط القرار الحاسمة. تضمن هذه الميزة إمكانية تقييم الإجراءات الحساسة قبل المتابعة، وتحقيق التوازن بين كفاءة الأتمتة والحوكمة والتحكم.

AutoGen’s scalability relies heavily on the underlying language models and infrastructure supporting the agents. The framework itself introduces minimal overhead, with performance primarily influenced by model inference times and API call latency. For workflows involving multiple sequential agent exchanges, total execution time accumulates across these interactions.

يمكن للمؤسسات تحسين الأداء عن طريق تخزين سياق المحادثة مؤقتًا، واستخدام نماذج أسرع للمهام الروتينية، وحجز نماذج أكثر تقدمًا للاستدلال المعقد. كما أن تصميم أنماط المحادثة لتقليل التبادلات غير الضرورية يعزز الكفاءة أيضًا. عندما يكون ذلك مناسبًا، يدعم إطار العمل تنفيذ الوكيل المتوازي، مما يتيح تشغيل المهام المستقلة في وقت واحد بدلاً من التشغيل بالتسلسل.

للتعامل مع أعباء العمل العالية، يمكن نشر AutoGen على البنية التحتية السحابية ذات التوسع التلقائي، مما يضمن قدرة النظام على إدارة المتطلبات المتنوعة مع الحفاظ على التكاليف تحت السيطرة. تعمل تفاعلات الوكلاء عديمي الجنسية على تبسيط القياس الأفقي، على الرغم من أن الحفاظ على السياق عبر التبادلات يتطلب تخطيطًا مدروسًا للبنية.

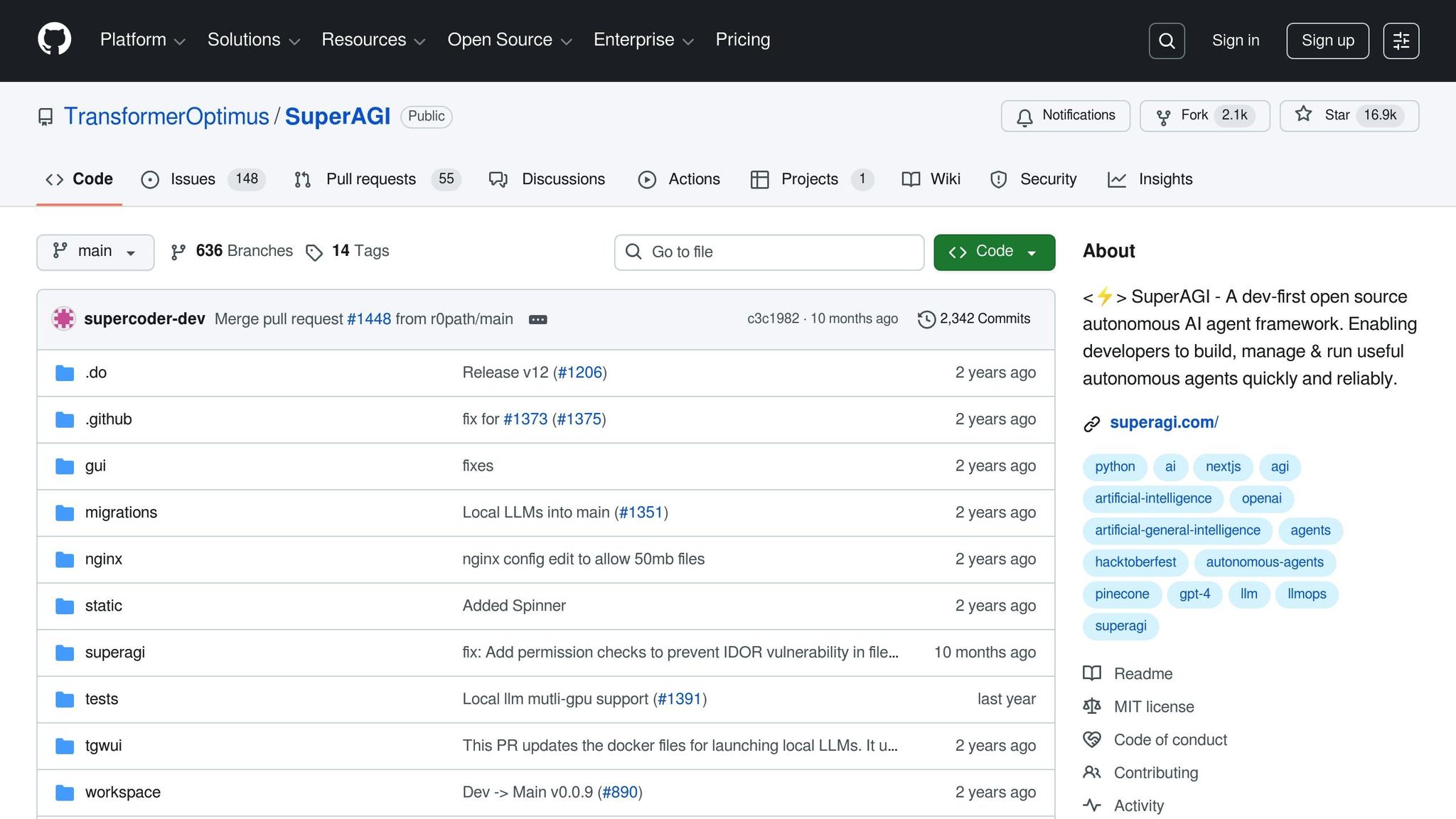

بناءً على أطر التنسيق التي اكتشفناها، تقدم SuperAGI طريقة جديدة لإدارة التعاون متعدد الوكلاء. تم تصميم هذه المنصة مفتوحة المصدر لتنسيق وكلاء الذكاء الاصطناعي المستقلين، وتمكين المطورين من إنشاء ونشر والإشراف على الوكلاء الذين يمكنهم تخطيط المهام وتنفيذها والتكيف معها من خلال التعلم المستمر. يتيح SuperAGI للعديد من الوكلاء العمل معًا بسلاسة، وتفويض المهام ديناميكيًا والتعاون لمواجهة التحديات المعقدة. فهو يدمج إدارة المهام التكيفية مع العمل الجماعي متعدد الوكلاء، مما يميزه كأداة قوية لتنسيق الذكاء الاصطناعي المتقدم.

تتألق SuperAGI في أتمتة المهام المعقدة والمتطورة للمؤسسات. تتفوق شبكات الوكلاء الخاصة بها في التخطيط المتقدم للمهام وتنفيذها، وتتحسن باستمرار من خلال التعلم المعزز وحلقات التغذية الراجعة. وهذا يجعله مفيدًا بشكل خاص للمؤسسات التي تتعامل مع عمليات واسعة النطاق، حيث يكون التنسيق الذكي أمرًا أساسيًا. يتعلم الوكلاء داخل المنصة من تفاعلاتهم ونتائجهم، مما يسمح لهم بتحسين سلوكهم بمرور الوقت.

الميزة البارزة للنظام الأساسي هي تفويض المهام الديناميكي. بدلاً من الالتزام بسير العمل الصارم، يقوم الوكلاء بتقييم المواقف في الوقت الفعلي، وتحديد المهام ذات الأولوية، وتعيينها إلى أعضاء الشبكة الأكثر ملاءمة. وتضمن هذه المرونة تخصيص الموارد بكفاءة، حتى في السيناريوهات المعقدة.

تم تصميم بنية SuperAGI مع قابلية التوسع والنمطية في جوهرها. يمكن للمطورين بسهولة توسيع شبكات الوكلاء وأحمال العمل لتلبية مجموعة متنوعة من احتياجات التطبيقات. يعمل كل وكيل بشكل مستقل، ومع ذلك يتواصلون بسلاسة، مما يضمن التعاون السلس.

تسمح الواجهة الرسومية سهلة الاستخدام للفرق بتصور تفاعلات الوكيل وضبط التكوينات. توفر لوحات معلومات المراقبة رؤى حول أداء الوكيل، مما يساعد المطورين على تحديد أوجه القصور ومعالجتها. تدعم المنصة أيضًا التنفيذ المتوازي، مما يتيح للعديد من الوكلاء التعامل مع المهام المستقلة في وقت واحد. يعمل هذا التصميم على تعزيز الإنتاجية بشكل كبير، خاصة في البيئات عالية الطلب.

يتميز SuperAGI بنظام إضافي قابل للتوسيع يتكامل مع واجهات برمجة التطبيقات التابعة لجهات خارجية وأدوات سير العمل والوحدات النمطية المخصصة. تعمل هذه المرونة على تسريع عملية التطوير وتشجيع المساهمات من مجتمع المطورين الأوسع، مما يؤدي إلى إثراء قدرات النظام الأساسي.

تدعم البنية المعيارية الموزعة للمنصة التوسع الأفقي، مما يجعلها قابلة للتكيف مع التطبيقات واسعة النطاق. يؤدي استخدامه للتعلم المعزز وحلقات التغذية الراجعة إلى تحسين الأداء العام، مما يضمن توزيع المهام بكفاءة. من خلال تمكين التعاون الفعال والإنتاجية العالية، يعد SuperAGI مناسبًا تمامًا للمؤسسات التي تتطلب أداءً قويًا في السيناريوهات المعقدة ذات الحجم الكبير.

إن اختيار إطار عمل تنسيق الذكاء الاصطناعي المناسب يعني فهم نقاط القوة والقيود في كل خيار. تم تصميم هذه الأنظمة الأساسية مع وضع أولويات مختلفة في الاعتبار، لتلبية احتياجات مثل الأمان على مستوى المؤسسة، أو قدرة المطورين على التكيف، أو سير العمل المتخصص مثل مسارات التعلم الآلي. يعكس كل إطار فلسفة التصميم الفريدة وحالات الاستخدام المستهدفة.

على سبيل المثال، تتفوق منصات مثل Prompts.ai في مركزية الوصول إلى نماذج اللغات الكبيرة (LLMs)، في حين تركز أدوات مثل Apache Airflow وPrefect على أتمتة سير العمل بشكل عام. من ناحية أخرى، تم تصميم Kubeflow وFlyte لخطوط التعلم الآلي، كما أن أطر العمل مثل SuperAGI وMicrosoft AutoGen تدفع حدود التعاون متعدد الوكلاء في مجال الذكاء الاصطناعي من خلال تمكين الأنظمة المستقلة من التعامل مع المهام المعقدة معًا.

The decision ultimately comes down to your organization’s specific needs. A startup building its first AI application will have very different requirements compared to a large enterprise managing hundreds of workflows. Factors like budget, team expertise, and existing infrastructure all play a role. Below, a table outlines key trade-offs for some of the most popular frameworks:

هياكل التكلفة: غالبًا ما تفرض المنصات التقليدية رسومًا على كل مستخدم أو تنفيذ، مما قد يؤدي إلى ارتفاع التكاليف مع نمو العمليات. في المقابل، تستخدم Prompts.ai نموذج الدفع أولاً بأول مع أرصدة TOKN، وربط النفقات مباشرة بالاستخدام. يعد هذا الأسلوب مفيدًا بشكل خاص عند تجربة نماذج مختلفة أو إدارة أعباء العمل المتقلبة.

الأمن والامتثال: بالنسبة لصناعات مثل الرعاية الصحية أو التمويل، تعد التدابير الأمنية القوية ضرورية. توفر الأنظمة الأساسية مثل Prompts.ai وIBM watsonx Orchesstrate وPrefect أدوات امتثال مدمجة مثل مسارات التدقيق وعناصر التحكم في الوصول المستندة إلى الأدوار. ومع ذلك، تتطلب الخيارات مفتوحة المصدر، مثل Apache Airflow، تكوينًا إضافيًا للوفاء بمعايير الامتثال الصارمة.

منحنى التعلم: تختلف سهولة الاستخدام على نطاق واسع. تعد الأنظمة الأساسية مثل Prefect وDagster أكثر ملاءمة للمبتدئين، حيث توفر واجهات برمجة تطبيقات Python البديهية ورسائل خطأ مفيدة. وفي الوقت نفسه، يتطلب Apache Airflow وKubeflow خبرة فنية أعمق ومهارات إدارة البنية التحتية. تعمل Prompts.ai على تبسيط ذلك بشكل أكبر من خلال واجهة موحدة توازن بين سهولة الاستخدام والميزات المتقدمة للمستخدمين المتميزين.

Community Support: The size and engagement of a platform’s community can greatly influence your experience. Apache Airflow benefits from a massive user base, ensuring plenty of resources and solutions are readily available. Newer platforms like Flyte and Dagster have smaller but active communities, though you might encounter less-documented scenarios.

نظام التكامل البيئي: يعد التكامل السلس مع الأدوات الحالية أمرًا بالغ الأهمية. يتصدر Apache Airflow مئات المكونات الإضافية للخدمات السحابية وقواعد البيانات وأدوات المراقبة. من ناحية أخرى، يركز Prompts.ai بشكل خاص على LLMs، مما يوفر وصولاً مبسطًا إلى عشرات النماذج عبر واجهة برمجة تطبيقات واحدة.

قابلية التوسع: تم تصميم الأنظمة الأساسية مثل Kubeflow وFlyte للتوسع الأفقي، والاستفادة من Kubernetes لتوزيع عبء العمل. يستخدم Metaflow خدمات AWS للتوسع المرن، بينما يدعم Prefect كلاً من خيارات التوسع المُدارة عبر السحابة والمستضافة ذاتيًا. تستخدم SuperAGI بنية الوكيل الموزع، مما يتيح التنفيذ المتوازي، على الرغم من أن هذا يتطلب تنسيقًا دقيقًا.

يعتمد أفضل إطار عمل بالنسبة لك على سير العمل المحدد لديك. بالنسبة لتنسيق LLM، تتميز Prompts.ai بوصولها المركزي إلى النموذج وفعاليتها من حيث التكلفة. قد تميل فرق هندسة البيانات نحو موثوقية Apache Airflow، بينما يمكن لفرق تعلم الآلة التي تعمل على التدريب والنشر على نطاق واسع الاستفادة من Kubeflow أو Flyte. إذا كان تركيزك ينصب على بناء أنظمة ذكاء اصطناعي مستقلة، فقد يكون SuperAGI أو Microsoft AutoGen هو المناسب لك.

Choosing an AI orchestration framework isn't about finding a universal solution - it’s about aligning the framework’s strengths with your organization’s workflows, technical skills, and long-term goals. Each of the frameworks discussed here caters to different needs, from automating workflows to managing machine learning pipelines or enabling multi-agent collaboration.

على سبيل المثال، قد تجد الفرق التي تعطي الأولوية لتنسيق LLM أن Prompts.ai جذابة بشكل خاص. فهو يوفر وصولاً مركزيًا لأكثر من 35 طرازًا، مثل GPT-5 وClaude وGemini، كل ذلك من خلال واجهة موحدة. يعمل نظام ائتمان TOKN للدفع أولاً بأول على إزالة رسوم الاشتراك مع تقديم تتبع التكلفة في الوقت الفعلي. بفضل ميزات مثل عناصر التحكم في الوصول المستندة إلى الأدوار ومسارات التدقيق، يعد Prompts.ai خيارًا قويًا للصناعات التي تتطلب حوكمة صارمة دون المساس بالسرعة.

قد تنجذب فرق هندسة البيانات التي تعمل مع خطوط أنابيب ETL المعقدة نحو Apache Airflow بسبب نظامها البيئي القوي للمكونات الإضافية وقابلية التوسع، على الرغم من أنها تتطلب خبرة أكثر تقدمًا. من ناحية أخرى، يقدم Prefect نهجًا أصليًا بلغة Python مع معالجة سهلة للأخطاء، مما يجعله خيارًا ممتازًا لتأهيل الفريق بشكل أسرع.

For machine learning practitioners, frameworks like Kubeflow and Flyte shine in handling large-scale training and deployment tasks. Kubeflow’s Kubernetes-native design supports distributed computing, while Flyte provides advanced versioning and type-safe workflows. Both, however, demand significant infrastructure knowledge. For teams already invested in AWS, Metaflow offers a simpler alternative tailored to data science workflows.

يمكن للمؤسسات التي تستكشف أنظمة الذكاء الاصطناعي المستقلة أن تفكر في Microsoft AutoGen لميزات التعاون متعدد الوكلاء أو SuperAGI لتفويض المهام الديناميكي. تعتبر هذه الأدوات مثالية للبحث أو حالات الاستخدام المتخصصة ولكنها غالبًا ما تتطلب مهارات ترميز متقدمة، مما يجعلها أقل ملاءمة لاحتياجات الإنتاج الفورية.

في النهاية، يتضمن اختيار الإطار الصحيح تقييم عوامل مثل النمطية وقابلية التوسعة وقابلية المراقبة وميزات الحوكمة مثل عناصر التحكم في الوصول المستندة إلى الأدوار وشهادات الامتثال. وتحظى مرونة النشر والتكامل مع الأدوات الحالية بنفس القدر من الأهمية. وبعيدًا عن الوظائف، ضع في اعتبارك تجربة المطور، بما في ذلك حزم SDK والوثائق والتكلفة الإجمالية للملكية. إن تعقيد سير العمل لديك - سواء كانت مهام وكيل واحد مباشرة أو أنظمة معقدة متعددة الوكلاء ذات ذاكرة ثابتة - يجب أن يوجه قرارك أيضًا.

تتجه الصناعة نحو أنظمة الذكاء الاصطناعي المتكاملة والقابلة للتطوير، مع أطر عمل مفتوحة المصدر تقود غالبية أعباء العمل في المؤسسة بينما تعمل أوقات التشغيل التي يديرها البائع على تبسيط التحديات التشغيلية.

Start by defining your specific use case, whether it involves LLMs, data pipelines, or ML training workflows. Assess your team’s technical expertise and current infrastructure. Running proof-of-concept trials with selected frameworks can help identify solutions that reduce complexity, enabling your team to focus on driving innovation.

عند اختيار إطار عمل تنسيق الذكاء الاصطناعي، من الضروري مراعاة مدى تكامله مع أدواتك وأنظمتك الحالية. يضمن إطار العمل الذي يتمتع بقدرات تكامل قوية أن كل شيء يعمل معًا دون تعقيدات غير ضرورية.

انتبه إلى ميزات التشغيل الآلي الخاصة به، مثل جدولة سير العمل وإدارة المهام، حيث يمكنها تبسيط العمليات وتوفير الوقت. ولا تقل أهمية عن ذلك التدابير الأمنية والحوكمة، التي تحمي البيانات الحساسة وتساعدك على البقاء متوافقًا مع اللوائح.

Opt for a framework that offers modularity and scalability, so it can grow and adapt alongside your evolving requirements. Lastly, prioritize a solution that’s intuitive and aligns with your team’s technical skill level, making both setup and daily use straightforward.

تعمل Prompts.ai على تبسيط التحدي المتمثل في التوفيق بين أدوات الذكاء الاصطناعي المتعددة من خلال الجمع بين أكثر من 35 نموذجًا لغويًا كبيرًا ضمن نظام أساسي موحد. باستخدام هذا الإعداد، يمكن للمستخدمين مقارنة النماذج جنبًا إلى جنب بسهولة مع الاحتفاظ بالإشراف الكامل على سير العمل الفوري وجودة المخرجات والأداء العام.

إضافة إلى كفاءتها، تتميز Prompts.ai بطبقة FinOps متكاملة مصممة لتحسين التكاليف. توفر هذه الأداة رؤى في الوقت الفعلي حول الاستخدام والإنفاق والعائد على الاستثمار (ROI)، مما يمكّن المؤسسات من إدارة مواردها بفعالية وتحقيق أقصى استفادة من ميزانيات الذكاء الاصطناعي الخاصة بها.

تعطي Prompts.ai الأولوية للأمان والامتثال على مستوى المؤسسة، بما يتماشى مع معايير الصناعة مثل SOC 2 Type II وHIPAA وGDPR لحماية بياناتك في كل مرحلة.

To uphold ongoing monitoring and compliance, Prompts.ai collaborates with Vanta and began its SOC 2 Type II audit process on 19 يونيو 2025. These steps ensure your workflows stay secure, compliant, and dependable for enterprise operations.